Programma

Le novità recenti di OpenAI sono particolarmente interessanti per chi usa GPT-5 mini: il nuovo modello GPT-5.4 mini è due volte più veloce e offre prestazioni migliori in tutte le aree. Inoltre, OpenAI ha rilasciato la versione più recente della sua classe di modelli più efficiente, GPT-5.4 nano.

In questo articolo, vedremo cosa sono GPT-5.4 mini e nano, come si comportano rispetto a GPT-5.4 e chi può trarre vantaggio dai nuovi modelli “corsia veloce” di OpenAI.

Dai un'occhiata anche al nostro confronto tra GPT-5.4 e Claude Opus e alla nostra guida a OpenAI Frontier.

Che cos'è GPT-5.4 mini?

GPT-5.4 mini è il più recente LLM “piccolo” di OpenAI, che sostituisce GPT-5 mini. Porta diversi miglioramenti significativi alle prestazioni del suo predecessore ed è due volte più veloce, uno dei principali punti di forza.

Nell’API supporta un’ampia gamma di funzionalità:

- Input di testo e immagini

- Uso di tool e function calling

- Ricerca sul web

- Uso del computer

- Skills

Che cos'è GPT-5.4 nano?

GPT-5.4 nano è la versione più piccola della nuova linea di modelli di OpenAI e sostituisce GPT-5 nano. Come suggerisce il nome, è ancora più efficiente del modello mini, con prestazioni inferiori. Ciononostante, GPT-5.4 nano supera il vecchio modello mini, GPT-5 mini, in molti benchmark.

Non supporta tante funzionalità quanto il modello mini, ma offre le funzionalità API standard di oggi come input di immagini, uso di tool, function calling e output strutturati.

A chi sono davvero destinati GPT-5.4 mini e nano?

La nuova release offre flessibilità nella scelta del modello giusto, considerando il classico compromesso tra prestazioni da un lato e latenza e prezzo dall’altro.

OpenAI consiglia mini e nano agli sviluppatori che lavorano su applicazioni in cui non vuoi lag. In pratica, cose che devono risultare reattive, dove gli utenti tollerano pochissimo il ritardo.

Per i compiti con forte componente di ragionamento e margini d’errore minimi, per la multimodalità e per i task agentici, GPT-5.4 resta la prima scelta.

Benchmark di GPT-5.4 mini e nano

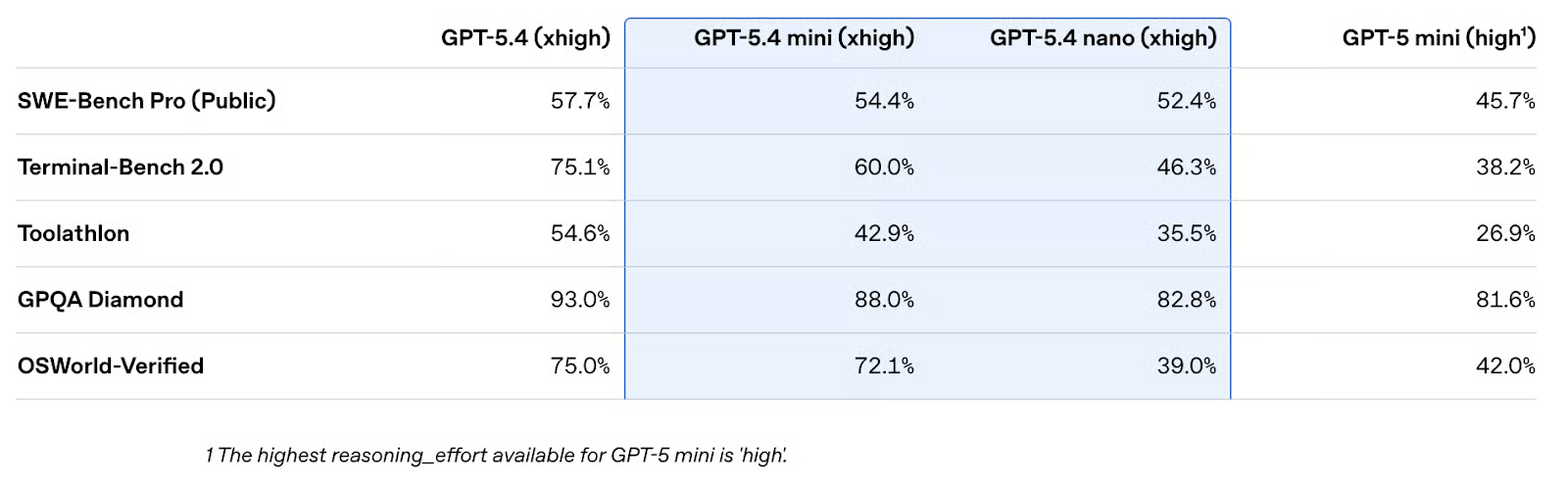

Diamo un’occhiata ai benchmark LLM. Alcuni risultati notevoli:

- Coding: Sia 5.4 mini (54,4%) che nano (52,4%) superano il 50% in SWE‑Bench Pro e non sono molto distanti da GPT-5.4. Il miglioramento rispetto a GPT-5 mini (45,7%) è significativo.

- Agenti da terminale: In Terminal‑Bench 2.0, la distanza tra le tre varianti dei modelli 5.4 emerge chiaramente. GPT-5.4 mini (60,0%) può competere con precedenti modelli di punta, come GPT 5.2 (62,2%), e 5.4 nano (46,3%) con GPT-5 (49,6%), ma sono lontani dalle prestazioni al top di GPT-5.4.

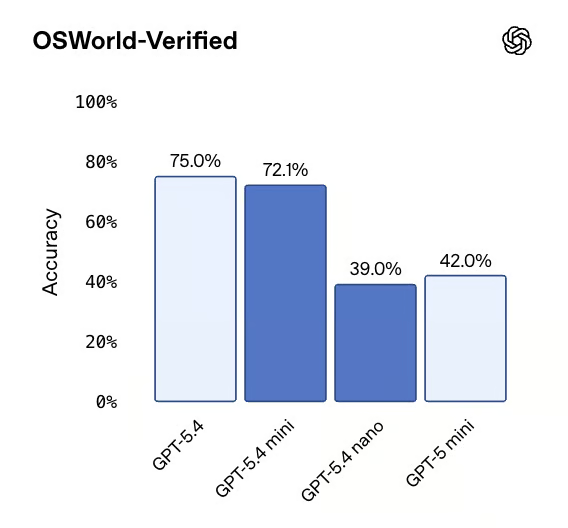

- Uso del computer: Mentre GPT-5.4 mini raggiunge un notevole 72,1% in OSWorld‑Verified, seguendo da vicino GPT-5.4, GPT-5.4 nano è chiaramente indietro (39,0%). È evidente che non è stato creato per task di uso del computer.

Un’altra cosa che ci ha colpito subito è che l’ordine dei punteggi dei benchmark è stato lo stesso in (quasi) tutte le categorie: GPT-5.4 > GPT-5.4 mini > GPT-5.4 nano > GPT-5 mini. In tutti i punteggi pubblicati, l’unica eccezione è stata che il vecchio modello mini ha superato GPT-5.4 nano nei domini di visione e uso del computer, che non sono le aree target di nano.

Resta però poco chiaro quanto faccia la differenza il nuovo livello di effort di ragionamento “xhigh”, che non era disponibile per GPT-5 mini.

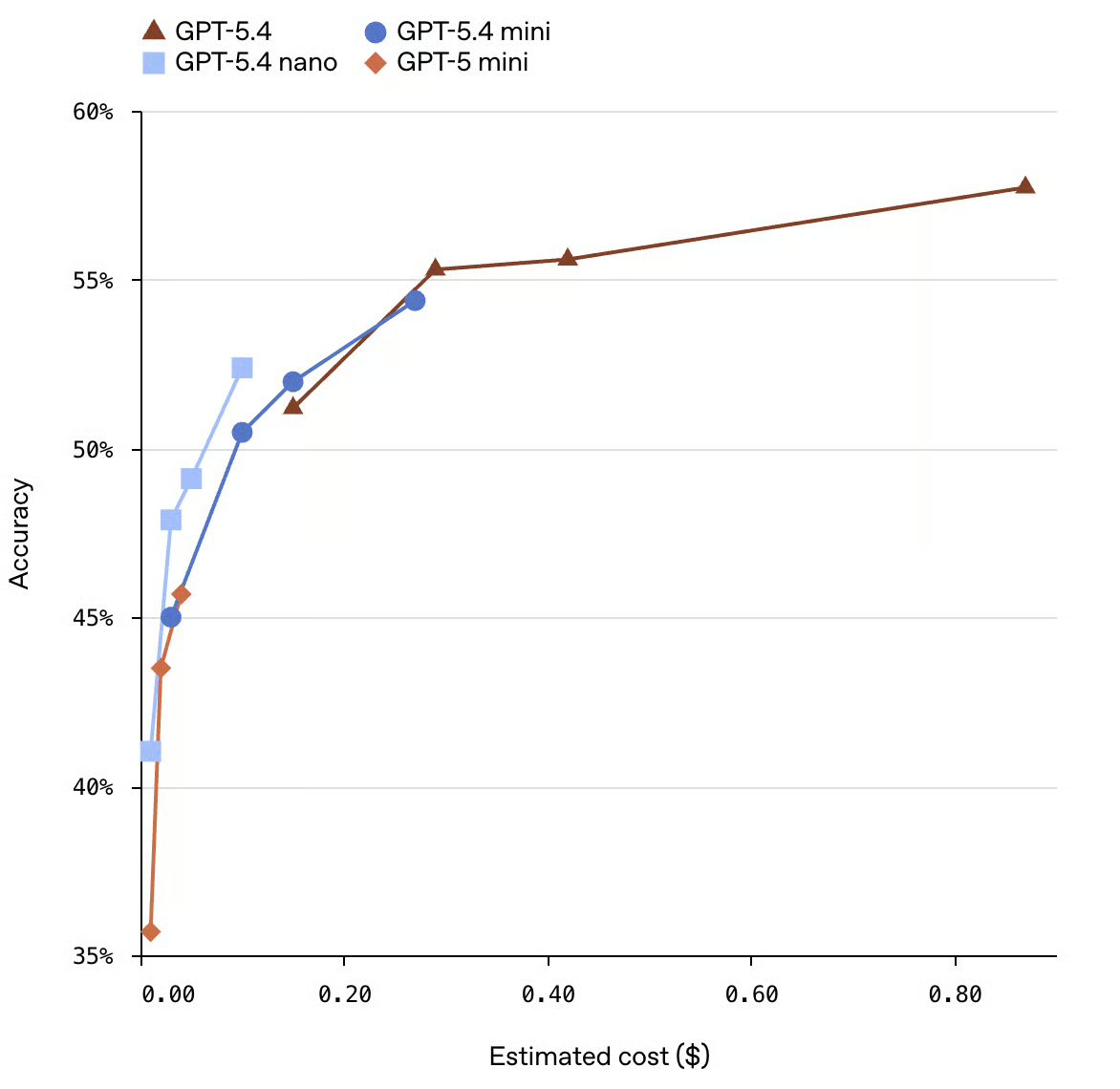

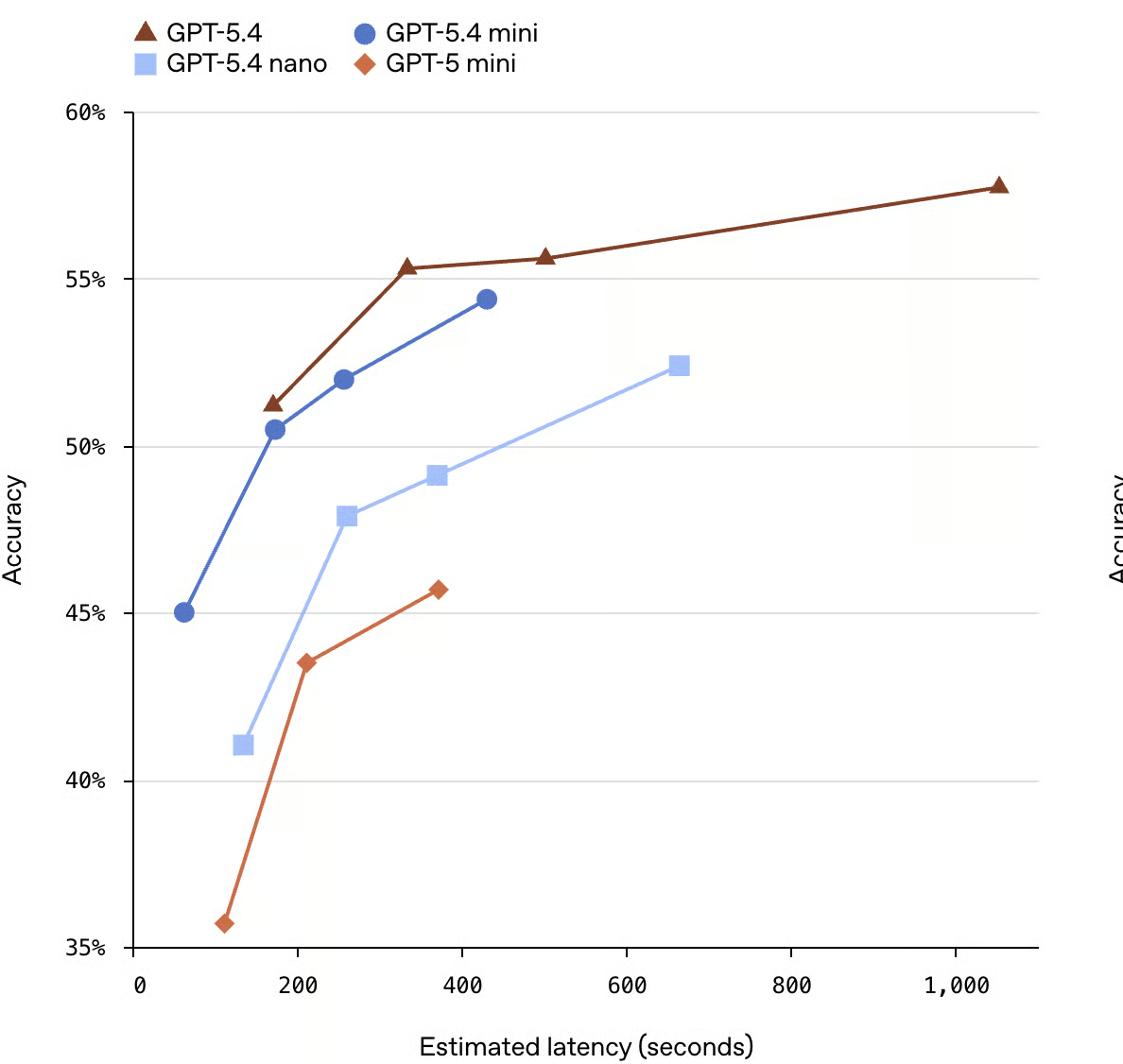

Ovviamente, però, le prestazioni non sono tutto. OpenAI vuole sottolineare il tema dei rendimenti decrescenti, come mostrato nei grafici forniti. Tra i quattro modelli confrontati, GPT-5.4 è il più lento e il più costoso.

Le curve illustrano i rendimenti decrescenti: puoi investire più calcolo/denaro in un modello e ottenere modesti guadagni di accuratezza, ma i salti diventano sempre più piccoli. Gli ultimi punti percentuali di GPT-5.4 costano molto più dei primi. Questo tipo di grafico aiuta gli ingegneri a decidere se vale la pena spremere quel 3–4% di accuratezza in più nella loro applicazione specifica.

Ci sentiamo però in dovere di valutare criticamente il grafico: l’asse Y parte dal 35%, non da 0%. Questo esagera davvero le differenze visive tra i modelli. Il vantaggio di GPT-5.4 su GPT-5 mini sembra più grande nel grafico che parte dal 35% di quanto apparirebbe in un grafico che parte da zero.

Inoltre, OpenAI sottolinea che queste cifre di latenza non provengono da run produttivi reali; sono stime modellate. C’è qualcosa di un po’ incongruo in questo. OpenAI fornisce molte indicazioni su decisioni infrastrutturali, e il loro grafico contiene solo stime modellate.

Troviamo anche strano guardare stime modellate senza barre d’errore. Scommetterei che, se OpenAI avesse scelto di includerle, si sarebbero sovrapposte parecchio.

Come accedere a GPT-5.4 mini e nano

Dovresti già trovare GPT‑5.4 mini nell’interfaccia browser di ChatGPT, in Codex e nell’API. In ChatGPT è il modello “Thinking” predefinito per gli utenti dei piani Free e Go, e il modello di fallback per tutti gli altri utenti che hanno raggiunto il rate limit di GPT-5.4 Thinking.

GPT‑5.4 nano, invece, è disponibile solo tramite API.

Prezzi di GPT-5.4 mini e nano

GPT-5.4 mini costa 0,75 $ per 1M di token in input e 4,50 $ per 1M di token in output. GPT‑5.4 nano, che, di nuovo, è disponibile solo nell’API, costa 0,20 $ per 1M di token in input e 1,25 $ per 1M di token in output. A questi prezzi, ottieni una finestra di contesto da 400k.

È ovviamente molto più economico del modello di punta di OpenAI (2,50/15 $ per 1M input/output).

GPT-5.4 mini e nano vs. Claude Haiku 4.5

Quel che è davvero interessante è che GPT-5.4 nano ha un prezzo inferiore rispetto a molti modelli piccoli concorrenti con prestazioni più basse, in particolare Claude Haiku 4.5, che costa 1 $ per milione di token in input e 5 $ per milione di token in output. Quindi OpenAI ha abbassato i prezzi rispetto a Claude Haiku in entrambi i casi.

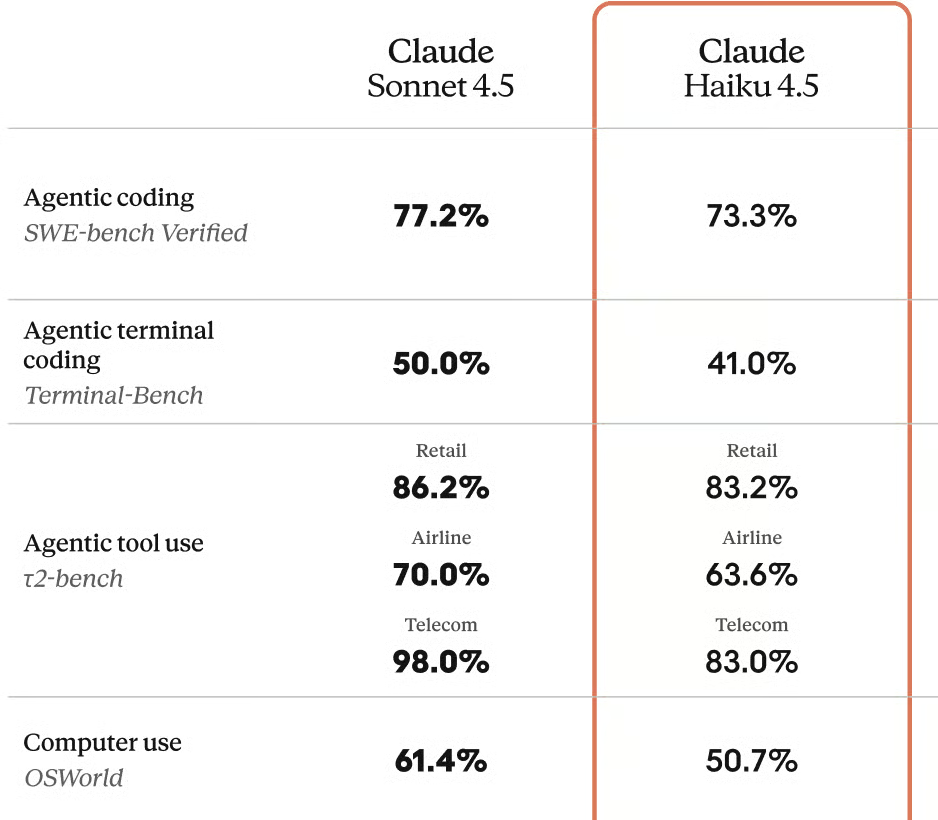

Ma come si confrontano i modelli nei test? Il confronto tra i due è un po’ complicato perché sono stati valutati su varianti di test diverse. I risultati di SWE-bench non sono affatto comparabili, poiché usano versioni del test completamente diverse. Claude Haiku 4.5 è stato testato su SWE-bench Verified e ha ottenuto un punteggio del 73,3%, mentre GPT-5.4 nano è stato testato su SWE-bench Pro (Public) e ha ottenuto il 52,4%. Pro è il test più recente e più difficile.

Punteggio di Claude Haiku 4.5: 50,7% su OSWorld

Nei due confronti più “puliti” mela con mela, GPT-5.4 nano è in vantaggio in entrambi.

- Con GPQA Diamond, GPT-5.4 nano ottiene un punteggio superiore del 9,8% e

- con τ2-bench Telecom, GPT-5.4 nano segna un +9,5%.

Tuttavia, Haiku 4.5 potrebbe avere un vantaggio su OSWorld per l’uso del computer, anche se, di nuovo, le varianti di benchmark rendono il confronto difficile.

- Claude Haiku 4.5 è stato testato su OSWorld standard e ha ottenuto il 50,7%

- GPT-5.4 nano è stato testato su OSWorld-Verified e ha ottenuto il 39,0%.

OSWorld-Verified è il test più difficile, ma il divario di quasi il 12% sembra piuttosto significativo. Siamo più cauti nel liquidare questo gap perché, a differenza di SWE-bench Verified e SWE-bench Pro, dove è noto che i modelli che vanno bene nella versione Verified spesso vanno peggio nella versione Pro, ci sono meno evidenze che la stessa dinamica valga per OSWorld e OSWorld-Verified.

Punteggio di GPT-5.4 nano: 39% su OSWorld-Verified

Cosa si dice su GPT-5.4 mini e nano

Molte reazioni online hanno indicato un pattern familiare nel tech: il modello di punta dell’anno scorso diventa il livello gratuito dell’anno prossimo. Tutto questo è previsto, ma il ritmo del cambiamento è impressionante.

C’è chi dice che la frontier AI abbia la svalutazione più rapida di qualunque prodotto mai costruito. Ci si chiede se il modello per cui oggi paghi un sovrapprezzo ti sembrerà ancora valido tra sei mesi. A volte gli sviluppatori potrebbero non voler semplicemente sostituire un modello con un altro se hanno seguito un processo di fine-tuning o se hanno effettuato calibrazioni di costi e prestazioni.

Conclusione

I benchmark mostrano una nitida scala di prestazioni da GPT-5.4 a 5.4 mini fino a 5.4 nano. Ma per molti task, la scelta pratica dipende più da latenza e budget che dallo spremere qualche punto percentuale in più.

Per molte app in produzione, GPT-5.4 mini può essere un ottimo nuovo default, dato che la qualità è abbastanza alta da sembrare frontier e al contempo abbastanza economico e veloce per un uso ad alto volume.

GPT-5.4 nano è più uno specialista per grandi carichi di lavoro in tempo reale molto sensibili alla latenza. È anche perfetto come sub‑agent per svolgere il lavoro “di massa” più semplice, delegato da modelli Thinking con prestazioni più elevate.

In un mondo in cui il modello di punta dell’anno scorso diventa il “mini” di quest’anno, progettare sistemi in grado di cambiare modello facilmente è la scelta migliore rispetto all’ottimizzazione per singole release. Ti consiglio il nostro corso su Building Scalable Agentic Systems, che affronta proprio questo tema e ti insegna a usare framework agentici come il Model Context Protocol (MCP).

GPT-5.4 mini e nano: FAQ

GPT‑5.4 mini è solo un GPT‑5 mini più veloce?

No, è sia più veloce sia significativamente più forte nei benchmark come SWE‑Bench Pro, mantenendo una finestra di contesto da 400k.

Qual è il principale compromesso tra GPT‑5.4 e 5.4 mini?

GPT‑5.4 resta il migliore per qualità massima; 5.4 mini sacrifica un po’ di accuratezza in cambio di una latenza e un costo molto migliori.

Quando dovrei usare GPT‑5.4 nano invece di mini?

Usa nano per carichi ultra‑sensibili alla latenza o a volumi molto alti, dove costi e velocità contano più dell’accuratezza di fascia alta.

GPT-5.4 mini e nano supportano tool e immagini?

Sì, entrambi supportano input di immagini, uso di tool, function calling e output strutturati nell’API.

GPT-5.4 mini e nano sono abbastanza validi per coding e agenti?

Sì. In particolare, 5.4 mini supera il 50% su SWE‑Bench Pro e ottiene punteggi competitivi su Terminal‑Bench 2.0, risultando forte per codice e agenti da terminale.

5.4 nano è più debole ma comunque abbastanza capace per molti task di supporto, come instradare richieste, agire come sub‑agent economico e gestire workflow da terminale semplici dove velocità e costo contano di più.

Sono uno scrittore e editor di data science, con contributi a articoli di ricerca su riviste scientifiche. Sono particolarmente interessato ad algebra lineare, statistica, R e affini. Inoltre, gioco anche parecchio a scacchi!

Tom è un data scientist e formatore tecnico. Scrive e gestisce i tutorial e i post del blog di DataCamp su data science. In precedenza, Tom ha lavorato nella data science presso Deutsche Telekom.