Cursus

Les récentes annonces d’OpenAI intéressent tout particulièrement les utilisateurs de GPT-5 mini : le nouveau modèle GPT-5.4 mini est deux fois plus rapide et affiche de meilleures performances sur l’ensemble des tâches. OpenAI a également publié la dernière version de sa classe de modèles la plus efficiente, GPT-5.4 nano.

Dans cet article, nous vous expliquons ce que sont GPT-5.4 mini et nano, comment ils se comparent à GPT-5.4, et qui peut tirer parti de ces nouveaux modèles « voie rapide » d’OpenAI.

Consultez aussi notre comparaison GPT-5.4 vs Claude Opus et notre guide sur OpenAI Frontier.

Qu’est-ce que GPT-5.4 mini ?

GPT-5.4 mini est le nouveau petit LLM d’OpenAI, qui remplace GPT-5 mini. Il apporte plusieurs améliorations significatives par rapport à son prédécesseur, tout en étant deux fois plus rapide, ce qui constitue l’un de ses principaux atouts.

Dans l’API, il prend en charge un large éventail de fonctionnalités :

- Entrées texte et image

- Utilisation d’outils et function calling

- Recherche web

- Utilisation d’ordinateur

- Skills

Qu’est-ce que GPT-5.4 nano ?

GPT-5.4 nano est la version la plus compacte de la nouvelle gamme de modèles d’OpenAI, et remplace GPT-5 nano. Comme son nom l’indique, il est encore plus efficient que le modèle mini, avec des performances moindres. Malgré tout, GPT-5.4 nano dépasse l’ancien modèle mini, GPT-5 mini, sur de nombreux benchmarks.

Il ne supporte pas autant de fonctionnalités que le modèle mini, mais propose les standards actuels de l’API : entrée image, utilisation d’outils, function calling et sorties structurées.

À qui s’adressent vraiment GPT-5.4 mini et nano ?

Cette sortie offre de la flexibilité pour choisir le bon modèle, en considérant l’arbitrage classique entre performance d’un côté, et latence et prix de l’autre.

OpenAI recommande mini et nano aux développeurs qui créent des applications où vous ne voulez aucun temps mort. En clair, des usages qui doivent paraître réactifs, où les utilisateurs tolèrent mal la latence.

Pour les tâches exigeant beaucoup de raisonnement avec peu de marge d’erreur, la multimodalité et les tâches agentiques, GPT-5.4 reste le premier choix.

Benchmarks de GPT-5.4 mini et nano

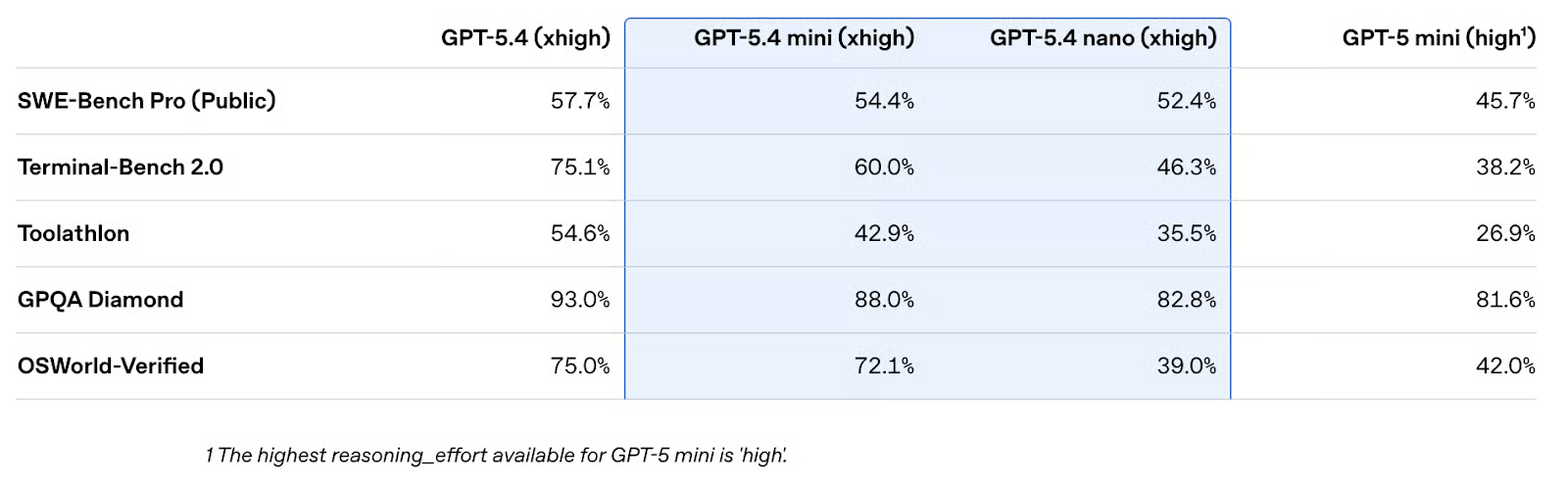

Jetons un œil aux benchmarks LLM. Quelques résultats marquants :

- Code : 5.4 mini (54,4 %) et nano (52,4 %) dépassent les 50 % au SWE‑Bench Pro et ne sont pas très loin de GPT-5.4. Le gain par rapport à GPT-5 mini (45,7 %) est net.

- Agents Terminal : Sur Terminal‑Bench 2.0, l’écart entre les trois déclinaisons de 5.4 apparaît clairement. GPT-5.4 mini (60,0 %) rivalise avec les anciens modèles phares comme GPT 5.2 (62,2 %), et 5.4 nano (46,3 %) avec GPT-5 (49,6 %), mais ils restent loin du niveau de tête de GPT-5.4.

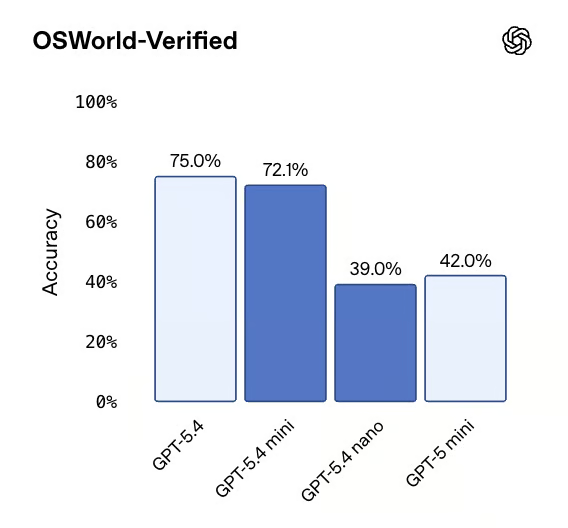

- Utilisation d’ordinateur : GPT-5.4 mini atteint un impressionnant 72,1 % sur OSWorld‑Verified, au plus près de GPT-5.4, tandis que GPT-5.4 nano est nettement derrière (39,0 %). On voit bien que ce n’est pas son terrain de jeu.

Autre point saisissant : l’ordre des scores reste (presque) identique dans toutes les catégories : GPT-5.4 > GPT-5.4 mini > GPT-5.4 nano > GPT-5 mini. Sur tous les scores publiés, seule exception : l’ancien modèle mini bat GPT-5.4 nano sur la vision et l’usage ordinateur, qui ne sont pas les cibles de nano.

Reste à voir l’impact réel du nouveau niveau d’effort de raisonnement « xhigh », qui n’existait pas pour GPT-5 mini.

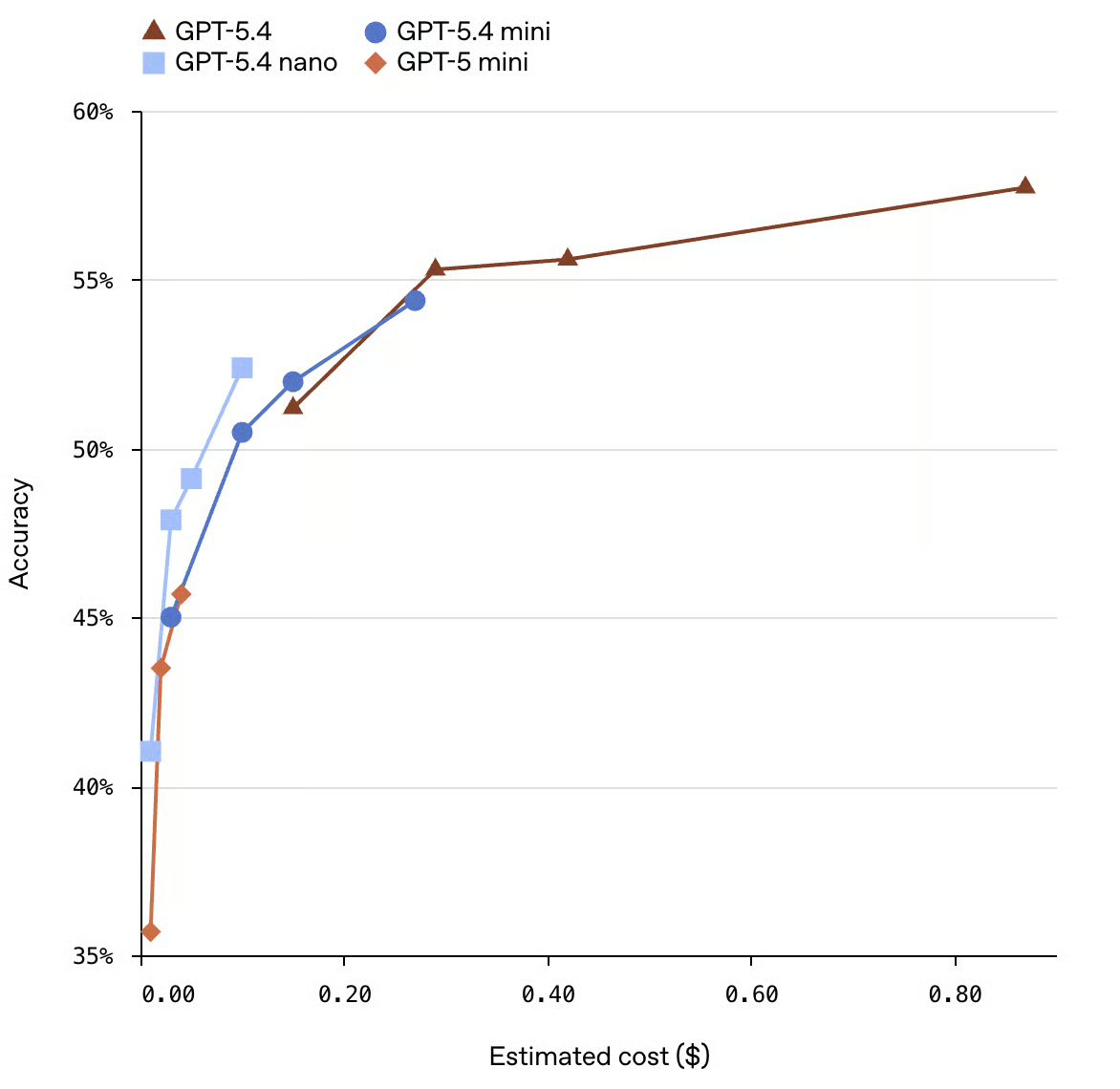

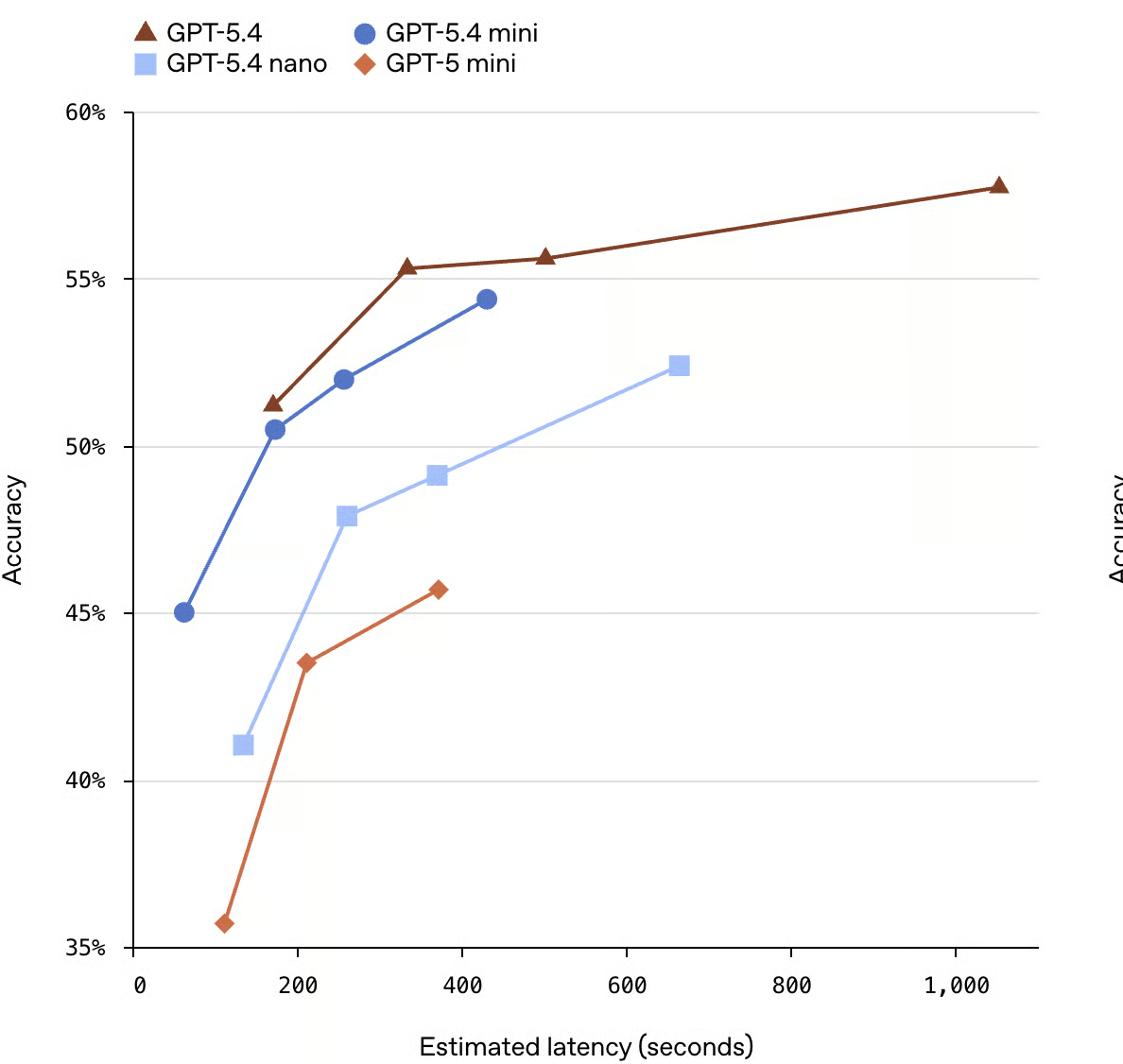

Évidemment, la performance ne fait pas tout. OpenAI met en avant la loi des rendements décroissants, illustrée par les graphiques fournis. Parmi les quatre modèles comparés, GPT-5.4 est le plus lent et le plus coûteux.

Les courbes illustrent ces rendements décroissants : vous pouvez investir plus de calcul/d’argent pour gagner un peu en précision, mais les gains se tassent. Les derniers points de pourcentage de GPT-5.4 coûtent beaucoup plus que les premiers. Ce type de graphique aide les ingénieurs à décider si aller chercher 3–4 % supplémentaires vaut le coût pour leur cas d’usage.

Nous nous sentons toutefois obligés de lire ce graphique avec esprit critique : l’axe Y commence à 35 %, pas à 0 %. Cela accentue visuellement les écarts entre modèles. L’avance de GPT-5.4 sur GPT-5 mini paraît plus grande sur un graphique démarrant à 35 % que sur un graphique démarrant à zéro.

De plus, OpenAI précise que ces chiffres de latence ne proviennent pas d’exécutions en production : ce sont des estimations issues d’un modèle. Il y a là quelque chose d’un peu paradoxal : OpenAI formule des recommandations d’infrastructure, mais le graphique ne montre que des estimations modélisées.

Il est aussi surprenant de voir des estimations sans barres d’erreur. On parierait volontiers que ces barres se chevaucheraient largement si OpenAI les avait incluses.

Comment accéder à GPT-5.4 mini et nano

Vous devriez déjà trouver GPT‑5.4 mini dans l’interface web de ChatGPT, dans Codex, et via l’API. Dans ChatGPT, c’est le modèle « Thinking » par défaut pour les utilisateurs des offres Free et Go, et le modèle de repli pour les autres utilisateurs ayant atteint leur limite de taux sur GPT-5.4 Thinking.

GPT‑5.4 nano, en revanche, n’est disponible que via l’API.

Tarifs de GPT-5.4 mini et nano

GPT-5.4 mini coûte 0,75 $ pour 1 M de tokens en entrée et 4,50 $ pour 1 M de tokens en sortie. GPT‑5.4 nano, qui n’est disponible que via l’API, coûte 0,20 $ pour 1 M de tokens en entrée et 1,25 $ pour 1 M de tokens en sortie. À ces tarifs, vous bénéficiez d’une fenêtre de contexte de 400 k.

C’est évidemment bien moins cher que le modèle phare d’OpenAI (2,50 $/15 $ par 1 M de tokens entrée/sortie).

GPT-5.4 mini et nano vs Claude Haiku 4.5

Ce qui est particulièrement intéressant, c’est que GPT-5.4 nano est proposé à un prix inférieur à celui de nombreux petits modèles moins performants chez les concurrents, notamment Claude Haiku 4.5, facturé 1 $ par million de tokens en entrée et 5 $ par million de tokens en sortie. OpenAI a donc cassé les prix de Claude Haiku sur les deux.

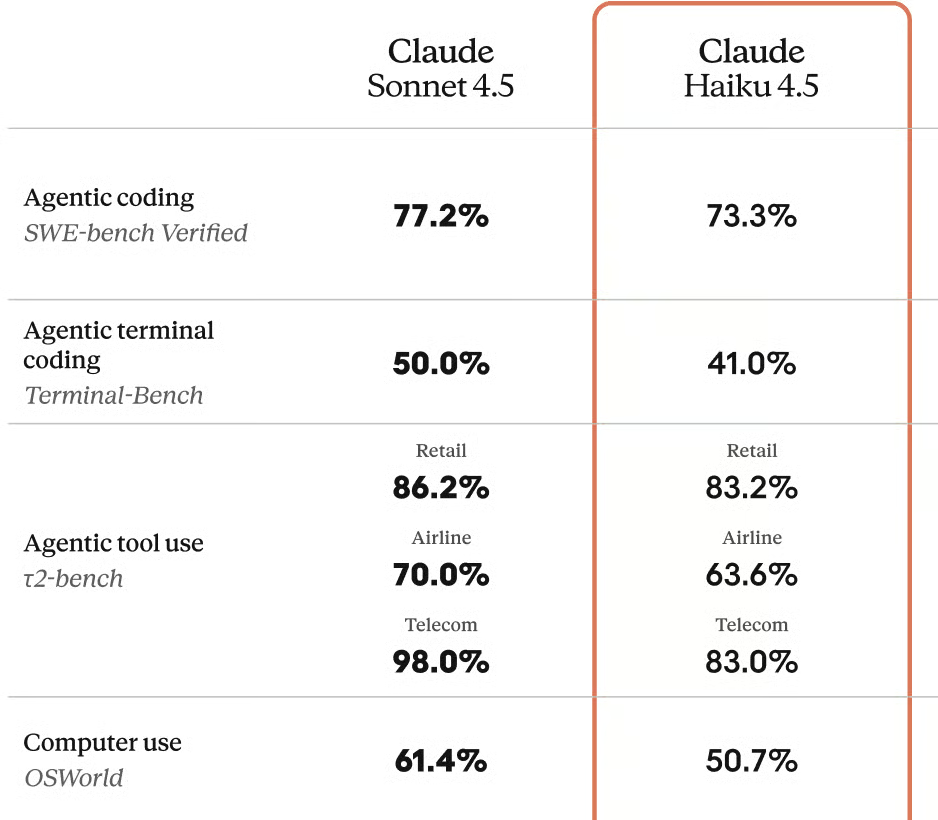

Mais comment les modèles se comparent-ils sur les tests ? La comparaison est un peu délicate car ils ont été évalués sur des variantes différentes. Les résultats SWE-bench ne sont pas comparables du tout, car les versions diffèrent. Claude Haiku 4.5 a été testé sur SWE-bench Verified avec un score de 73,3 %, et GPT-5.4 nano sur SWE-bench Pro (Public) avec 52,4 %. Pro est le test le plus récent et le plus difficile.

Score de 50,7 % pour Claude Haiku 4.5 sur OSWorld

Sur les deux comparaisons les plus « à périmètre constant », GPT-5.4 nano est devant.

- Sur GPQA Diamond, GPT-5.4 nano obtient 9,8 points de plus, et

- sur τ2-bench Telecom, GPT-5.4 nano obtient 9,5 points de plus.

En revanche, Haiku 4.5 pourrait avoir l’avantage sur l’usage ordinateur OSWorld, même si, là encore, les variantes compliquent la comparaison.

- Claude Haiku 4.5 a été testé sur OSWorld standard avec un score de 50,7 %

- GPT-5.4 nano a été testé sur OSWorld-Verified avec un score de 39,0 %.

OSWorld-Verified est plus difficile, mais l’écart de près de 12 points reste notable. Nous sommes plus prudents avant de balayer cet écart car, contrairement à SWE-bench Verified vs SWE-bench Pro, où l’on sait que les modèles performants sur Verified font souvent moins bien sur Pro, on a moins d’indices que la même logique s’applique à OSWorld et OSWorld-Verified.

Score de 39 % pour GPT-5.4 nano sur OSWorld-Verified

Ce que l’on dit de GPT-5.4 mini et nano

Beaucoup de réactions en ligne pointent un schéma bien connu dans la tech : le produit phare de l’an dernier devient le palier gratuit de l’année suivante. Rien de surprenant, mais le rythme du changement est saisissant.

On entend dire que la frontier AI est le produit qui se déprécie le plus vite jamais conçu. On s’interroge : le modèle pour lequel vous payez une prime aujourd’hui vous paraîtra-t-il toujours pertinent dans six mois ? Parfois, les développeurs ne veulent pas simplement remplacer un modèle s’ils ont réalisé un fine-tuning ou s’ils ont calibré coûts et performances.

Conclusion

Les benchmarks dessinent une véritable échelle de performances de GPT-5.4 à 5.4 mini, puis 5.4 nano. Mais pour beaucoup de cas d’usage, le choix pragmatique dépend davantage de la latence et du budget que de quelques points de pourcentage supplémentaires.

Pour de nombreuses applications en production, GPT-5.4 mini peut devenir un excellent nouveau défaut, avec une qualité suffisamment « frontier » tout en restant assez économique et rapide pour des volumes importants.

GPT-5.4 nano est plutôt un spécialiste des charges massives en temps réel, très sensibles à la latence. Il est aussi parfait comme sous‑agent pour traiter le « gros » du travail délégué par des modèles Thinking plus performants.

Dans un monde où le produit phare d’hier devient le « mini » d’aujourd’hui, concevoir des systèmes capables d’échanger facilement de modèle est préférable à l’optimisation pour une version unique. Je vous recommande notre cours Building Scalable Agentic Systems, qui aborde ce sujet et vous apprend à utiliser des frameworks agentiques comme le Model Context Protocol (MCP).

FAQ sur GPT-5.4 mini et nano

GPT‑5.4 mini est‑il simplement un GPT‑5 mini plus rapide ?

Non, il est à la fois plus rapide et nettement meilleur sur des benchmarks comme SWE‑Bench Pro, tout en conservant une fenêtre de contexte de 400 k.

Quel est l’arbitrage principal entre GPT‑5.4 et 5.4 mini ?

GPT‑5.4 reste le meilleur pour une qualité maximale ; 5.4 mini concède un peu de précision pour une latence et un coût bien meilleurs.

Quand utiliser GPT‑5.4 nano plutôt que mini ?

Choisissez nano pour des charges ultra sensibles à la latence ou à très grand volume, où le coût et la vitesse priment sur une précision de tout premier plan.

GPT-5.4 mini et nano prennent‑ils en charge les outils et les images ?

Oui, les deux prennent en charge l’entrée image, l’utilisation d’outils, le function calling et les sorties structurées dans l’API.

GPT-5.4 mini et nano sont‑ils assez bons pour le code et les agents ?

Oui. 5.4 mini dépasse les 50 % sur SWE‑Bench Pro et obtient des scores compétitifs sur Terminal‑Bench 2.0, ce qui en fait un bon choix pour le code et les agents terminal.

5.4 nano est plus faible mais reste suffisamment capable pour de nombreuses tâches de support, comme router des requêtes, agir comme sous‑agent économique et gérer de simples workflows en terminal où la vitesse et le coût priment.

Je suis rédacteur et éditeur dans le domaine de la science des données. Je suis particulièrement intéressé par l'algèbre linéaire, les statistiques, R, etc. Je joue également beaucoup aux échecs !

Rédacteur en chef Data Science chez DataCamp | Je suis passionné par la prévision et le développement à l'aide d'API.