Program

Berita terbaru dari OpenAI sangat menarik bagi pengguna GPT-5 mini: model baru GPT-5.4 mini dua kali lebih cepat dan menghadirkan peningkatan kinerja di semua area. Selain itu, OpenAI merilis versi terbaru dari kelas model mereka yang paling efisien, GPT-5.4 nano.

Dalam artikel ini, kami akan membahas apa itu GPT-5.4 mini dan nano, bagaimana kinerjanya dibandingkan dengan GPT-5.4, dan siapa yang dapat memperoleh manfaat dari model “jalur cepat” terbaru OpenAI.

Pastikan juga untuk melihat perbandingan kami antara GPT-5.4 vs Claude Opus serta panduan kami tentang OpenAI Frontier.

Apa Itu GPT-5.4 mini?

GPT-5.4 mini adalah LLM kecil terbaru dari OpenAI, menggantikan GPT-5 mini. Model ini membawa beberapa peningkatan signifikan atas pendahulunya, sekaligus dua kali lebih cepat—yang menjadi salah satu poin jual utamanya.

Di API, model ini mendukung beragam fitur:

- Input teks dan gambar

- Penggunaan tool dan pemanggilan fungsi

- Pencarian web

- Penggunaan komputer

- Keterampilan

Apa Itu GPT-5.4 nano?

GPT-5.4 nano adalah versi terkecil dari lini model terbaru OpenAI, menggantikan GPT-5 nano. Sesuai namanya, model ini bahkan lebih efisien daripada versi mini, dengan kinerja yang lebih rendah. Namun demikian, GPT-5.4 nano mengungguli model mini lama, GPT-5 mini, pada banyak tolok ukur.

Fitur yang didukung tidak sebanyak model mini, tetapi tetap menawarkan fitur API standar saat ini seperti input gambar, penggunaan tool, pemanggilan fungsi, dan keluaran terstruktur.

Siapa yang Cocok Menggunakan GPT-5.4 mini dan nano?

Rilis baru ini memberi fleksibilitas dalam memilih model yang tepat, dengan mempertimbangkan kompromi klasik antara kinerja di satu sisi, dan latensi serta harga di sisi lain.

OpenAI merekomendasikan mini dan nano untuk pengembang yang mengerjakan aplikasi yang tidak boleh terasa lag. Intinya, hal-hal yang perlu terasa responsif, di mana pengguna akan sangat tidak toleran terhadap penundaan.

Untuk tugas yang sangat bergantung pada penalaran dengan ruang kesalahan yang kecil, multimodalitas, dan tugas agentic, GPT-5.4 tetap menjadi pilihan utama.

Tolok Ukur GPT-5.4 mini dan nano

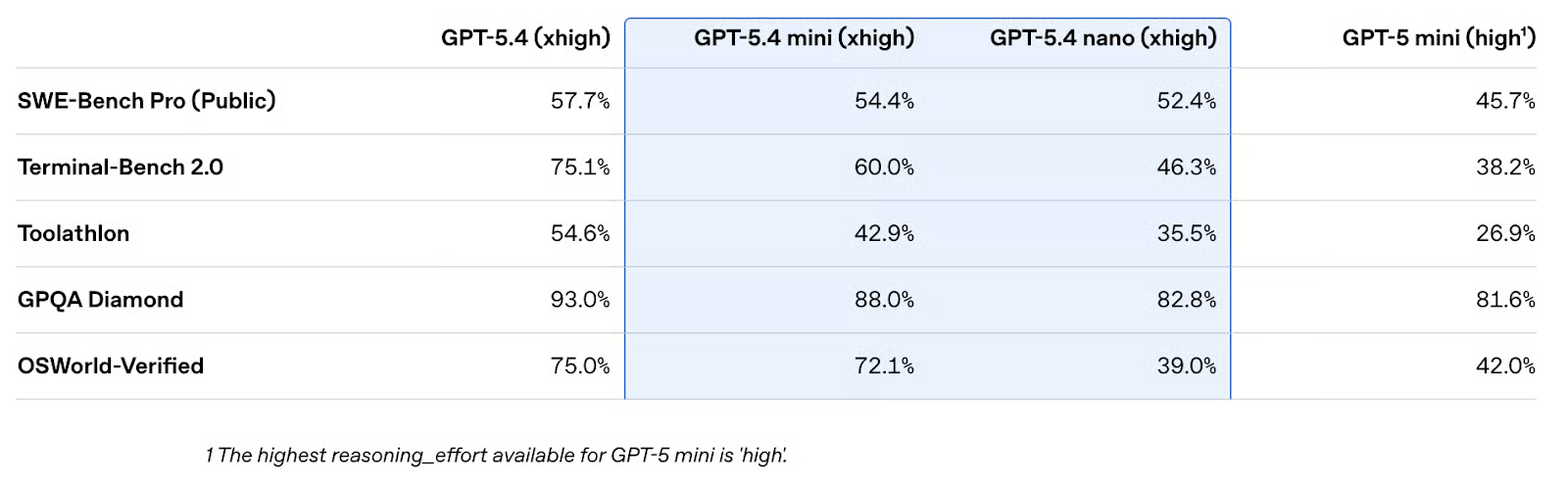

Mari kita lihat tolok ukur LLM. Beaberapa hasil yang menonjol:

- Koding: Baik 5.4 mini (54,4%) maupun nano (52,4%) mencapai skor SWE‑Bench Pro di atas 50% dan tidak jauh tertinggal dari GPT-5.4. Peningkatan terhadap GPT-5 mini (45,7%) tergolong signifikan.

- Agen terminal: Di Terminal‑Bench 2.0, jarak antara tiga varian model 5.4 terlihat jelas. GPT-5.4 mini (60,0%) dapat bersaing dengan model andalan sebelumnya, seperti GPT 5.2 (62,2%), dan 5.4 nano (46,3%) dengan GPT-5 (49,6%), namun keduanya masih jauh dari performa puncak GPT-5.4.

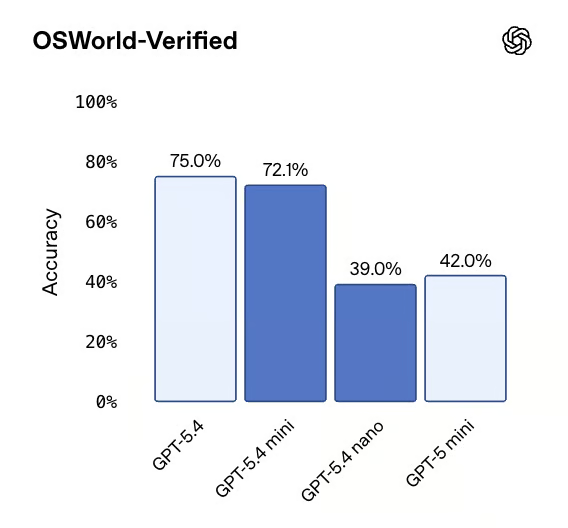

- Penggunaan komputer: Sementara GPT-5.4 mini meraih 72,1% yang impresif di OSWorld‑Verified, mendekati GPT-5.4, GPT-5.4 nano jelas tertinggal (39,0%). Jelas bahwa model ini tidak dibuat untuk tugas penggunaan komputer.

Hal lain yang langsung mencolok bagi kami adalah urutan skor tolok ukur sama di (hampir) semua kategori: GPT-5.4 > GPT-5.4 mini > GPT-5.4 nano > GPT-5 mini. Di semua skor yang dipublikasikan, satu-satunya pengecualian adalah model mini lama mengungguli GPT-5.4 nano pada domain visi dan penggunaan komputer, yang memang bukan area sasaran nano.

Namun, belum jelas seberapa besar perbedaan yang dihasilkan oleh tingkat upaya penalaran “xhigh” yang baru, yang tidak tersedia untuk GPT-5 mini.

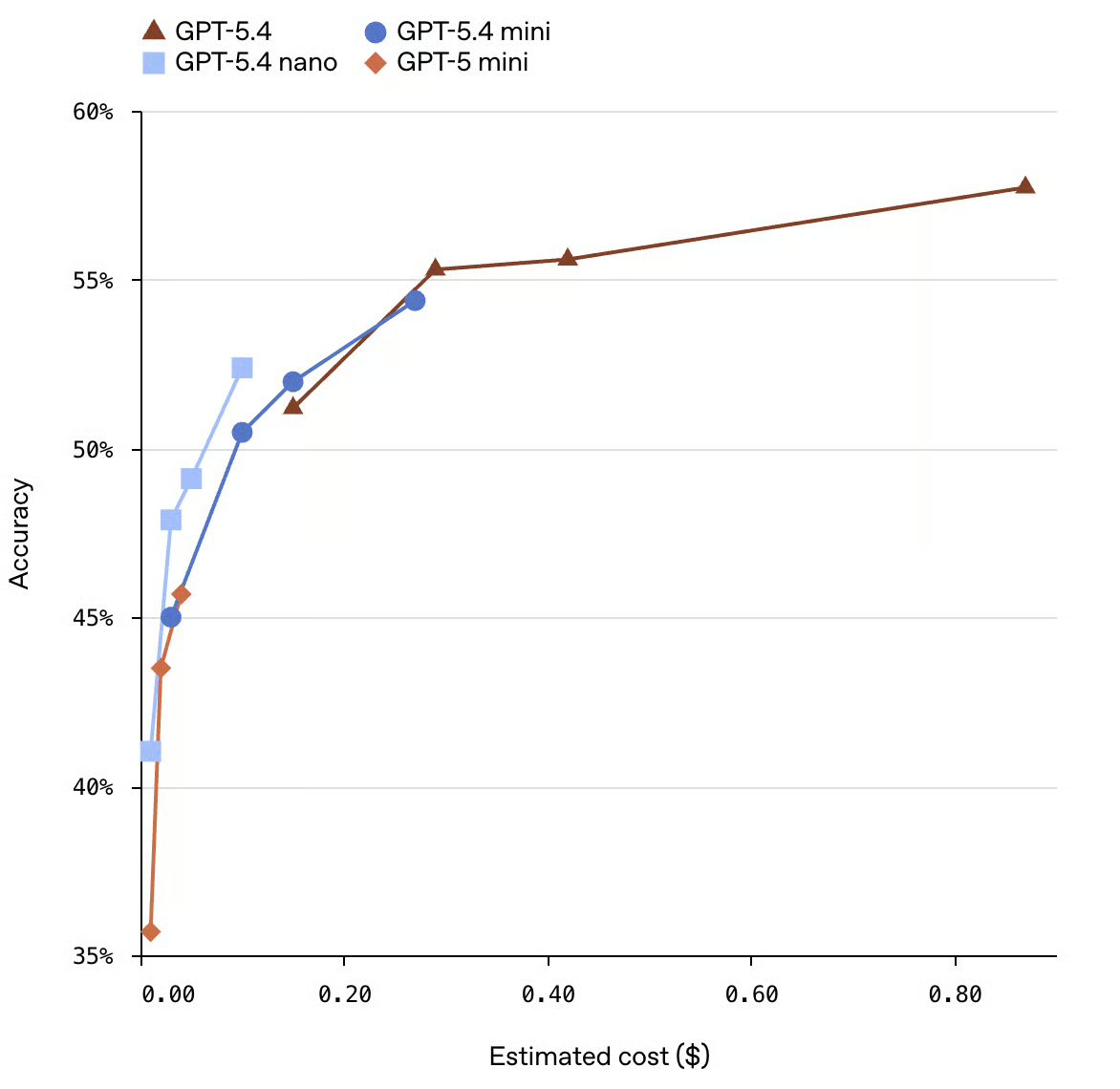

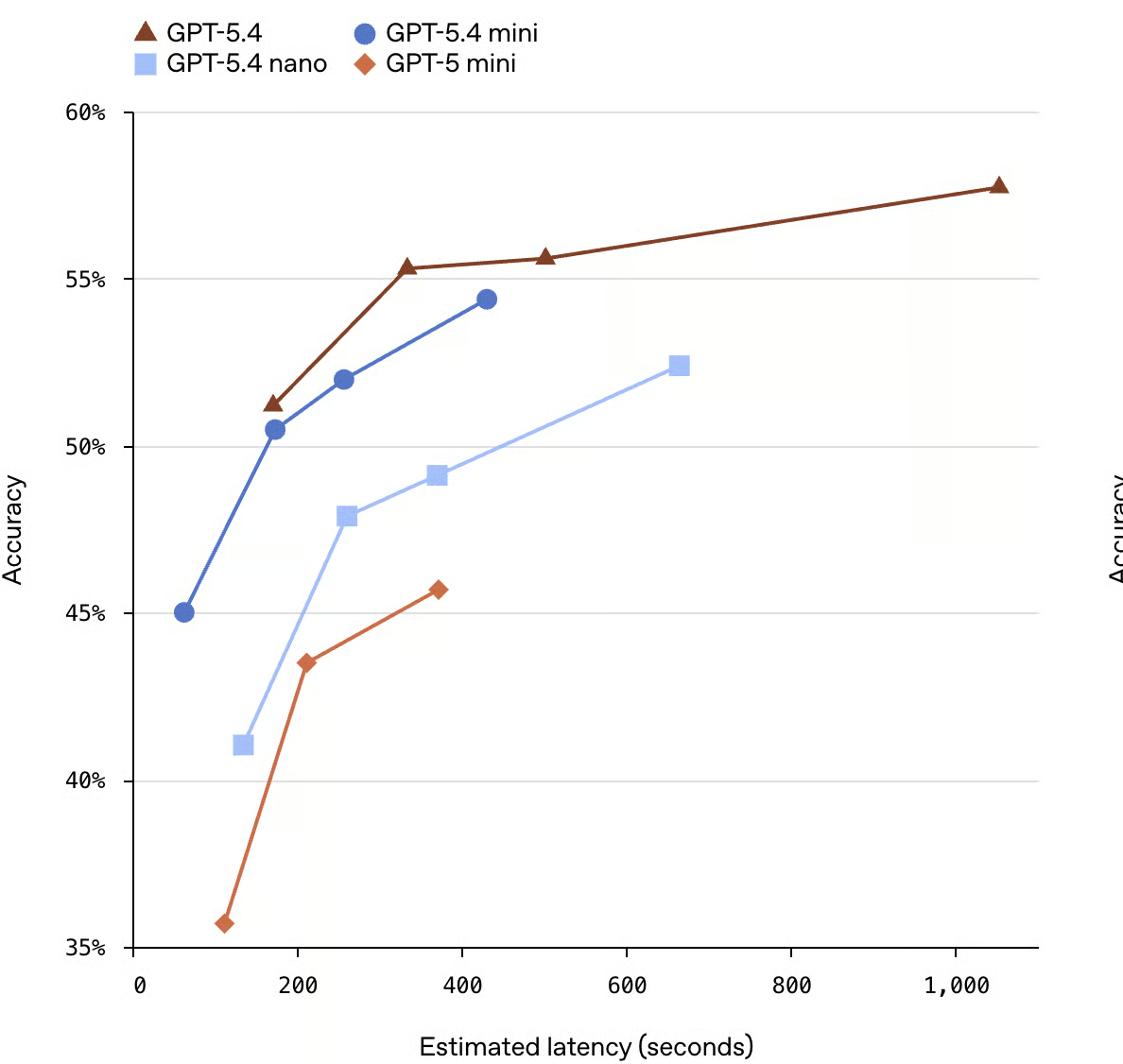

Namun tentu, kinerja bukan segalanya. OpenAI mencoba menekankan adanya diminishing returns, seperti yang ditunjukkan pada grafik yang mereka sediakan. Di antara empat model yang dibandingkan, GPT-5.4 adalah yang paling lambat dan paling mahal.

Kurva tersebut mengilustrasikan diminishing returns: Anda bisa mengeluarkan lebih banyak komputasi/uang untuk model dan mendapatkan kenaikan akurasi yang moderat, tetapi lonjakannya makin kecil. Beberapa persen terakhir pada GPT-5.4 berbiaya sangat jauh lebih mahal daripada persen awal. Grafik seperti ini membantu insinyur memutuskan apakah mengejar tambahan akurasi 3–4% layak dengan biaya pada aplikasi spesifik mereka.

Namun kami merasa perlu mengevaluasi grafik ini secara kritis: Sumbu-Y dimulai dari 35%, bukan 0%. Ini benar-benar melebih-lebihkan perbedaan visual antar model. Keunggulan GPT-5.4 atas GPT-5 mini terlihat lebih besar pada grafik yang dimulai di 35% dibandingkan jika grafik dimulai dari nol.

Selain itu, OpenAI menunjukkan bahwa angka latensi ini bukan dari run produksi nyata; ini adalah perkiraan hasil pemodelan. Ada sesuatu yang agak tidak selaras di sini. OpenAI banyak memberi saran tentang keputusan infrastruktur, namun grafiknya hanya berisi perkiraan pemodelan.

Kami juga merasa aneh melihat perkiraan pemodelan tanpa error bar. Saya menduga error bar akan banyak tumpang tindih jika OpenAI memilih untuk menyertakannya.

Cara Mengakses GPT-5.4 mini dan nano

Anda seharusnya sudah dapat menemukan GPT‑5.4 mini di antarmuka browser ChatGPT, Codex, dan di API. Di ChatGPT, ini adalah model “Thinking” default untuk pengguna tingkat Free dan Go, serta model fallback untuk semua pengguna lain yang telah mencapai batas laju Thinking GPT-5.4 mereka.

Namun, GPT‑5.4 nano hanya tersedia melalui API.

Harga GPT-5.4 mini dan nano

GPT-5.4 mini berharga $0,75 per 1M token input dan $4,50 per 1M token output. GPT‑5.4 nano, yang sekali lagi hanya tersedia di API, berharga $0,20 per 1M token input dan $1,25 per 1M token output. Dengan harga tersebut, Anda mendapatkan jendela konteks 400k.

Jelas jauh lebih murah daripada model andalan OpenAI ($2,50/$15 per 1M input/output).

GPT-5.4 mini dan nano vs. Claude Haiku 4.5

Yang benar-benar menarik adalah GPT-5.4 nano dibanderol lebih rendah daripada banyak model kecil berkinerja lebih rendah dari pesaing, yakni Claude Haiku 4.5, yang dihargai $1 per satu juta token input dan $5 per satu juta token output. Jadi OpenAI menekan harga Claude Haiku di kedua sisi.

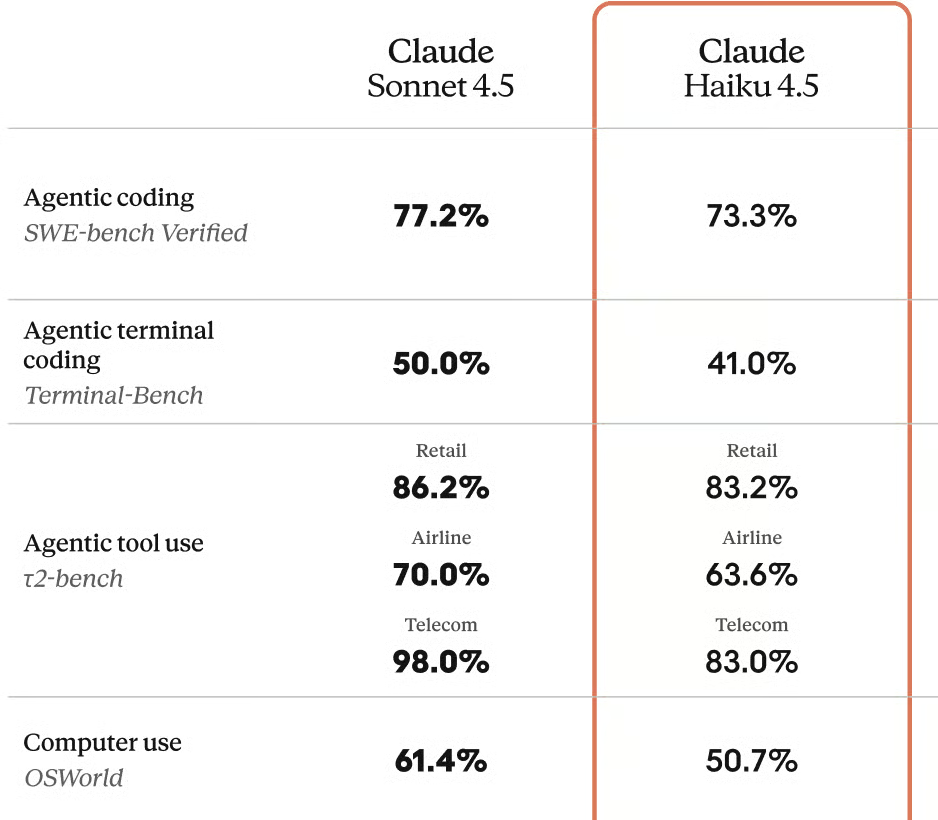

Namun bagaimana perbandingan model pada pengujian? Membandingkan keduanya agak rumit karena dievaluasi pada varian tes yang berbeda. Hasil SWE-bench sama sekali tidak dapat dibandingkan karena menggunakan versi yang sepenuhnya berbeda. Claude Haiku 4.5 diuji pada SWE-bench Verified dan meraih skor 73,3%, sementara GPT-5.4 nano diuji pada SWE-bench Pro (Publik) dan meraih skor 52,4%. Pro adalah tes yang lebih sulit dan lebih baru.

Skor Claude Haiku 4.5 sebesar 50,7% pada OSWorld

Pada dua perbandingan paling bersih apel-dengan-apel, GPT-5.4 nano unggul pada keduanya.

- Dengan GPQA Diamond, GPT-5.4 nano mencetak 9,8% lebih tinggi, dan

- dengan τ2-bench Telecom, GPT-5.4 nano mencetak 9,5% lebih tinggi.

Namun, Haiku 4.5 mungkin unggul pada penggunaan komputer OSWorld, meski lagi-lagi, varian tolok ukurnya membuat perbandingan menjadi sulit.

- Claude Haiku 4.5 diuji pada OSWorld standar dan meraih skor 50,7%

- GPT-5.4 nano diuji pada OSWorld-Verified dan meraih skor 39,0%.

OSWorld-Verified adalah tes yang lebih sulit, tetapi selisih hampir 12% terlihat cukup signifikan. Kami lebih berhati-hati untuk begitu saja menepis selisih ini karena, berbeda dengan SWE-bench Verified dan SWE-bench Pro, di mana diketahui model yang unggul pada versi Verified sering berkinerja lebih buruk pada versi Pro, masih sedikit bukti bahwa cerita yang sama berlaku untuk OSWorld dan OSWorld-Verified.

Skor GPT-5.4 nano sebesar 39% pada OSWorld-Verified

Apa Kata Orang tentang GPT-5.4 mini dan nano

Banyak reaksi online menyoroti pola yang familiar di dunia teknologi: andalan tahun lalu menjadi tingkat gratis tahun berikutnya. Semua ini memang dapat diperkirakan, tetapi laju perubahannya mencengangkan.

Orang-orang mengatakan AI frontier memiliki depresiasi tercepat dari produk mana pun yang pernah dibuat. Orang bertanya-tanya apakah model yang Anda bayar mahal hari ini masih terasa sepadan dalam enam bulan. Terkadang, pengembang mungkin tidak ingin begitu saja menukar satu model dengan model lain jika mereka telah melalui proses fine-tuning atau jika mereka telah melakukan kalibrasi biaya dan kinerja.

Kesimpulan

Tolok ukur menunjukkan tangga performa yang rapi dari GPT-5.4 ke 5.4 mini hingga 5.4 nano. Namun untuk banyak tugas, pilihan praktis lebih bergantung pada latensi dan anggaran daripada mengejar tambahan beberapa persen poin akurasi.

Untuk banyak aplikasi produksi, GPT-5.4 mini bisa menjadi default baru yang bagus, karena kualitasnya cukup untuk terasa frontier sambil tetap murah dan cepat untuk penggunaan volume tinggi.

GPT-5.4 nano lebih merupakan spesialis untuk beban kerja real-time besar yang sangat sensitif terhadap latensi. Model ini juga bagus untuk sub-agen dalam menangani pekerjaan “massal” yang lebih mudah, yang didelegasikan oleh model Thinking berkinerja lebih tinggi.

Di dunia di mana andalan tahun lalu menjadi “mini” tahun ini, merancang sistem yang dapat dengan mudah menukar model adalah pilihan yang lebih unggul dibanding mengoptimalkan rilis satu model. Saya merekomendasikan mengikuti kursus kami Building Scalable Agentic Systems, yang membahas pertanyaan ini dan mengajarkan Anda menggunakan kerangka agentic seperti Model Context Protocol (MCP).

GPT-5.4 mini dan nano: FAQ

Apakah GPT‑5.4 mini hanya versi GPT‑5 mini yang lebih cepat?

Tidak, model ini lebih cepat dan jauh lebih kuat pada tolok ukur seperti SWE‑Bench Pro, sambil mempertahankan jendela konteks 400k.

Apa kompromi utama antara GPT‑5.4 dan 5.4 mini?

GPT‑5.4 tetap terbaik untuk kualitas maksimum; 5.4 mini mengorbankan sedikit akurasi demi latensi dan biaya yang jauh lebih baik.

Kapan saya harus menggunakan GPT‑5.4 nano alih-alih mini?

Gunakan nano untuk beban kerja yang sangat sensitif terhadap latensi atau berjumlah sangat besar, di mana biaya dan kecepatan lebih penting daripada akurasi tingkat atas.

Apakah GPT-5.4 mini dan nano mendukung tool dan gambar?

Ya, keduanya mendukung input gambar, penggunaan tool, pemanggilan fungsi, dan keluaran terstruktur di API.

Apakah GPT-5.4 mini dan nano cukup andal untuk koding dan agen?

Ya. Khususnya 5.4 mini meraih lebih dari 50% pada SWE‑Bench Pro dan skor yang kompetitif pada Terminal‑Bench 2.0, sehingga kuat untuk kode dan agen terminal.

5.4 nano lebih lemah tetapi masih cukup mampu untuk banyak tugas pendukung, seperti merutekan permintaan, bertindak sebagai sub-agen murah, dan menangani alur kerja terminal sederhana di mana kecepatan dan biaya paling penting.

Saya penulis dan editor data science dengan kontribusi pada artikel riset di jurnal ilmiah. Saya sangat tertarik pada aljabar linear, statistika, R, dan sejenisnya. Saya juga cukup sering bermain catur!

Tom adalah seorang ilmuwan data dan pendidik teknis. Ia menulis dan mengelola tutorial serta artikel blog ilmu data DataCamp. Sebelumnya, Tom bekerja di bidang ilmu data di Deutsche Telekom.