Tracks

Tin tức gần đây từ OpenAI đặc biệt đáng chú ý đối với người dùng GPT-5 mini: mẫu GPT-5.4 mini mới nhanh gấp đôi và mang lại hiệu năng cải thiện trên mọi khía cạnh. Bên cạnh đó, OpenAI cũng phát hành phiên bản mới nhất của dòng mẫu hiệu quả nhất của họ, GPT-5.4 nano.

Trong bài viết này, chúng tôi sẽ giới thiệu GPT-5.4 mini và nano là gì, cách chúng hoạt động so với GPT-5.4, và ai có thể hưởng lợi từ các mẫu “làn nhanh” mới nhất của OpenAI.

Bạn cũng nên xem phần so sánh GPT-5.4 và Claude Opus cùng hướng dẫn về OpenAI Frontier.

GPT-5.4 mini là gì?

GPT-5.4 mini là LLM nhỏ mới nhất của OpenAI, thay thế GPT-5 mini. Mẫu này mang đến một số cải thiện đáng kể về hiệu năng so với phiên bản tiền nhiệm, đồng thời nhanh gấp đôi, đây là một trong những điểm mạnh chính.

Trong API, nó hỗ trợ nhiều tính năng:

- Đầu vào văn bản và hình ảnh

- Sử dụng công cụ và gọi hàm

- Tìm kiếm web

- Sử dụng máy tính

- Kỹ năng

GPT-5.4 nano là gì?

GPT-5.4 nano là phiên bản nhỏ nhất trong dòng mẫu mới nhất của OpenAI, thay thế GPT-5 nano. Đúng như tên gọi, nó còn hiệu quả hơn mẫu mini, nhưng hiệu năng thấp hơn. Dù vậy, GPT-5.4 nano vẫn vượt qua mẫu mini cũ, GPT-5 mini, trong nhiều bài kiểm tra chuẩn.

Nó không hỗ trợ nhiều tính năng như mẫu mini, nhưng vẫn cung cấp các tính năng API tiêu chuẩn hiện nay như đầu vào hình ảnh, sử dụng công cụ, gọi hàm và đầu ra có cấu trúc.

GPT-5.4 mini và nano thực sự dành cho ai?

Bản phát hành mới mang đến sự linh hoạt khi chọn đúng mẫu, xét đến đánh đổi kinh điển giữa hiệu năng ở một bên, và độ trễ cùng chi phí ở bên còn lại.

OpenAI khuyến nghị mini và nano cho các nhà phát triển đang xây dựng ứng dụng nơi bạn không muốn có độ trễ. Về cơ bản là những thứ cần cảm giác phản hồi tức thì, người dùng sẽ rất khó chịu nếu bị chậm trễ.

Với các tác vụ đòi hỏi lập luận nặng, ít sai sót, đa phương thức và tác tử, GPT-5.4 vẫn là lựa chọn hàng đầu.

Các điểm chuẩn của GPT-5.4 mini và nano

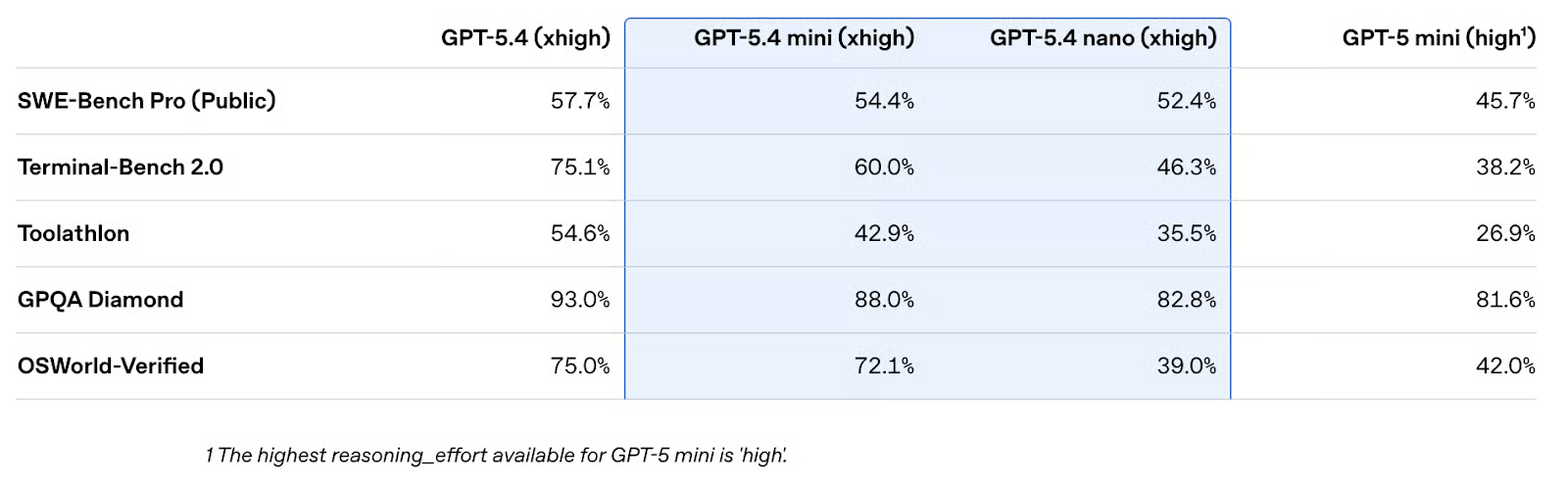

Hãy cùng xem các điểm chuẩn LLM. Một số kết quả đáng chú ý:

- Lập trình: Cả 5.4 mini (54,4%) và nano (52,4%) đều đạt điểm SWE‑Bench Pro trên 50% và không kém GPT-5.4 quá nhiều. Mức cải thiện so với GPT-5 mini (45,7%) là đáng kể.

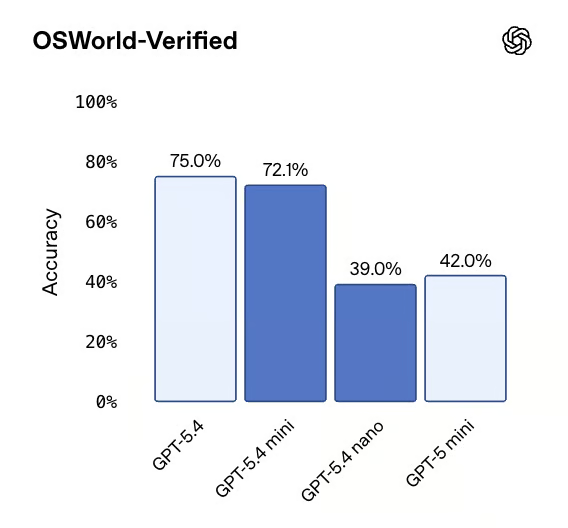

- Tác tử Terminal: Trong Terminal‑Bench 2.0, khoảng cách giữa ba biến thể của dòng 5.4 thể hiện rất rõ. GPT-5.4 mini (60,0%) có thể cạnh tranh với các mẫu chủ lực trước đây như GPT 5.2 (62,2%), và 5.4 nano (46,3%) với GPT-5 (49,6%), nhưng vẫn còn cách khá xa so với hiệu năng hàng đầu của GPT-5.4.

- Sử dụng máy tính: Trong khi GPT-5.4 mini đạt 72,1% ấn tượng ở OSWorld‑Verified, bám sát GPT-5.4, thì GPT-5.4 nano rõ ràng tụt lại phía sau (39,0%). Có thể thấy nó không được tạo ra cho các tác vụ sử dụng máy tính.

Một điều khiến chúng tôi chú ý ngay là thứ tự điểm số trong (gần như) mọi hạng mục đều giống nhau: GPT-5.4 > GPT-5.4 mini > GPT-5.4 nano > GPT-5 mini. Trong tất cả điểm số đã công bố, ngoại lệ duy nhất là mẫu mini cũ vượt GPT-5.4 nano ở các lĩnh vực thị giác và sử dụng máy tính, vốn không phải là thế mạnh mục tiêu của nano.

Tuy nhiên, chưa rõ mức chênh lệch do cấp độ nỗ lực lập luận “xhigh” mới tạo ra lớn đến đâu, vốn không có ở GPT-5 mini.

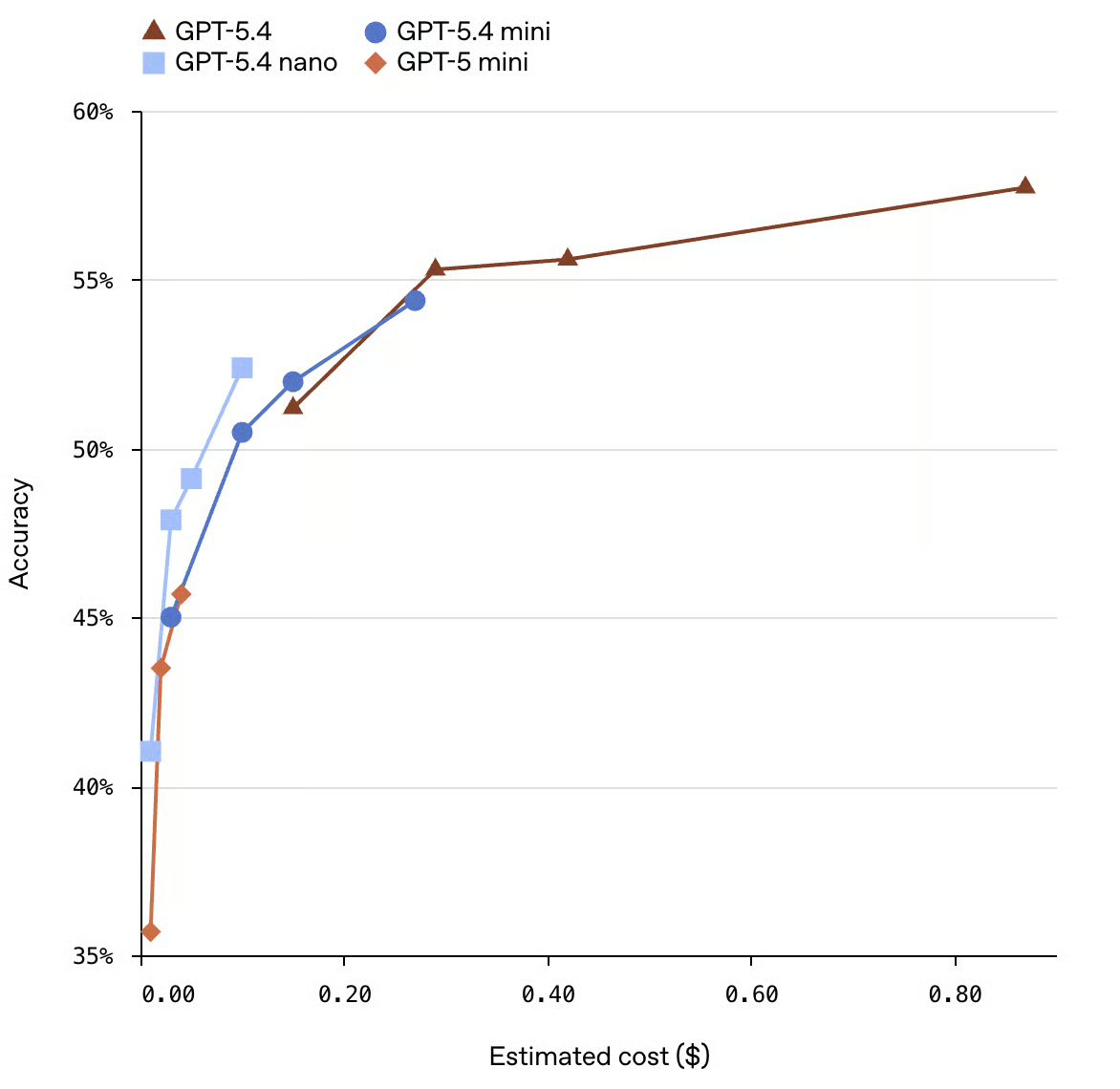

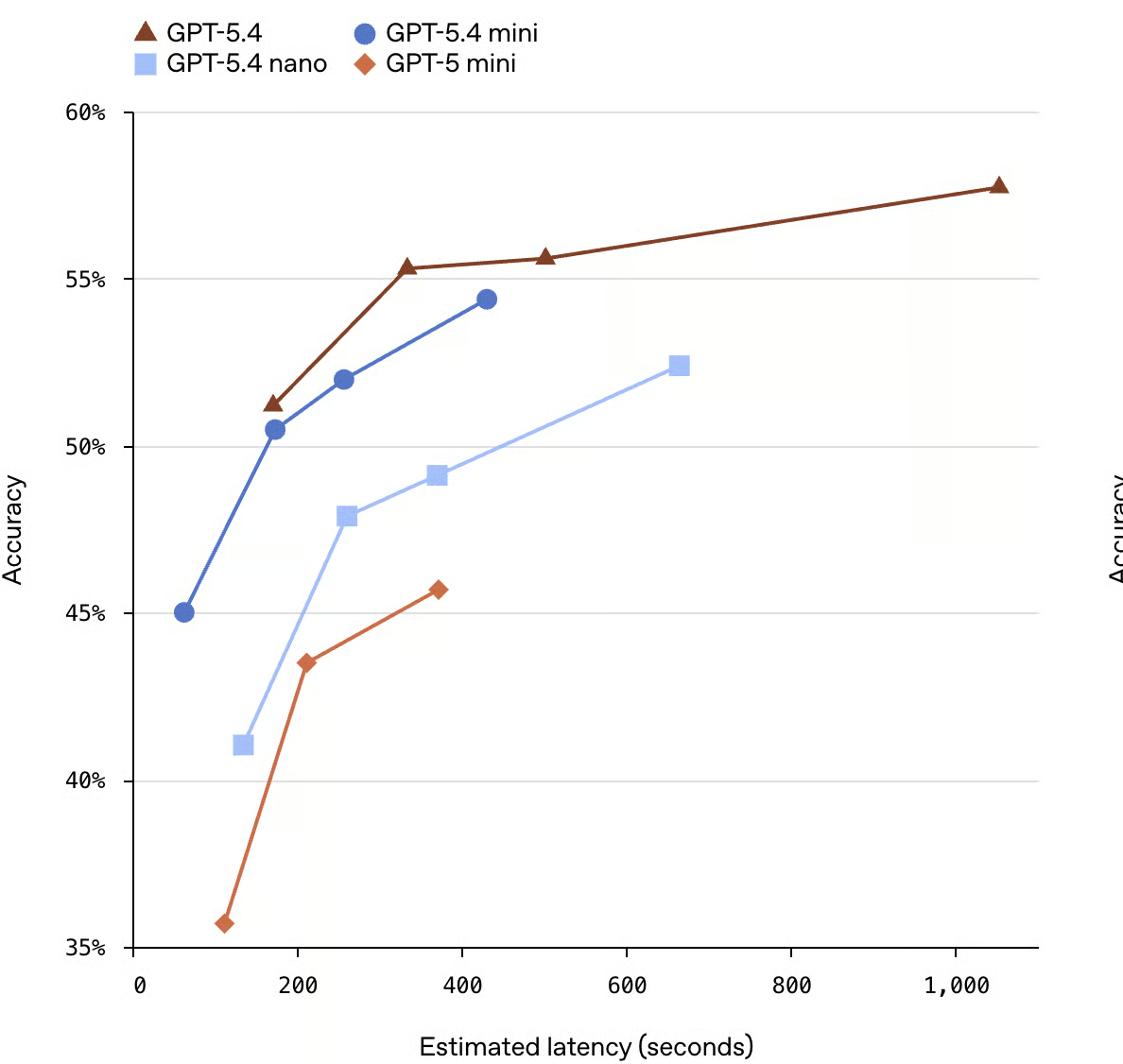

Dĩ nhiên, hiệu năng không phải là tất cả. OpenAI đang muốn nêu bật hiệu ứng lợi ích cận biên giảm dần, như các biểu đồ họ cung cấp. Trong bốn mẫu so sánh, GPT-5.4 là chậm nhất và đắt nhất.

Các đường cong minh họa lợi ích cận biên giảm dần: bạn có thể đầu tư thêm tài nguyên tính toán/tiền bạc vào một mẫu để nhận được mức tăng độ chính xác khiêm tốn, nhưng bước nhảy sẽ nhỏ dần. Vài phần trăm cuối cùng của GPT-5.4 tốn rất nhiều so với những phần trăm đầu tiên. Kiểu biểu đồ này giúp kỹ sư quyết định liệu việc cố nặn thêm 3–4% độ chính xác có đáng với chi phí trong ứng dụng cụ thể của họ hay không.

Tuy vậy, chúng tôi cũng thấy cần đánh giá biểu đồ một cách phản biện: Trục Y bắt đầu ở mức 35%, không phải 0%. Điều này thật sự phóng đại khác biệt trực quan giữa các mẫu. Lợi thế của GPT-5.4 trước GPT-5 mini trông lớn hơn trên biểu đồ bắt đầu từ 35% so với khi biểu đồ bắt đầu từ 0.

Ngoài ra, OpenAI lưu ý rằng các con số độ trễ này không đến từ các lượt chạy sản xuất thực; chúng là ước tính mô hình hóa. Có chút không tương xứng ở đây. OpenAI đưa ra nhiều gợi ý về quyết định hạ tầng, nhưng biểu đồ của họ chỉ có ước tính mô hình hóa.

Chúng tôi cũng thấy lạ khi xem các ước tính mô hình hóa mà không có thanh sai số. Tôi dám cá rằng nếu OpenAI thêm chúng vào, nhiều thanh sai số sẽ chồng lấn nhau.

Cách truy cập GPT-5.4 mini và nano

Bạn hiện đã có thể tìm thấy GPT‑5.4 mini trong giao diện trình duyệt ChatGPT, Codex và trong API. Trên ChatGPT, đây là mẫu “Thinking” mặc định cho người dùng gói Miễn phí và Go, và là mẫu dự phòng cho tất cả người dùng khác khi đã chạm giới hạn tốc độ Thinking của GPT-5.4.

Tuy nhiên, GPT‑5.4 nano chỉ có qua API.

Giá của GPT-5.4 mini và nano

GPT-5.4 mini có giá 0,75 USD cho mỗi 1 triệu token đầu vào và 4,50 USD cho mỗi 1 triệu token đầu ra. GPT‑5.4 nano, một lần nữa, chỉ có trong API, có giá 0,20 USD cho mỗi 1 triệu token đầu vào và 1,25 USD cho mỗi 1 triệu token đầu ra. Với các mức giá đó, bạn có cửa sổ ngữ cảnh 400k.

Rõ ràng rẻ hơn nhiều so với mẫu chủ lực của OpenAI (2,50/15 USD cho mỗi 1 triệu token vào/ra).

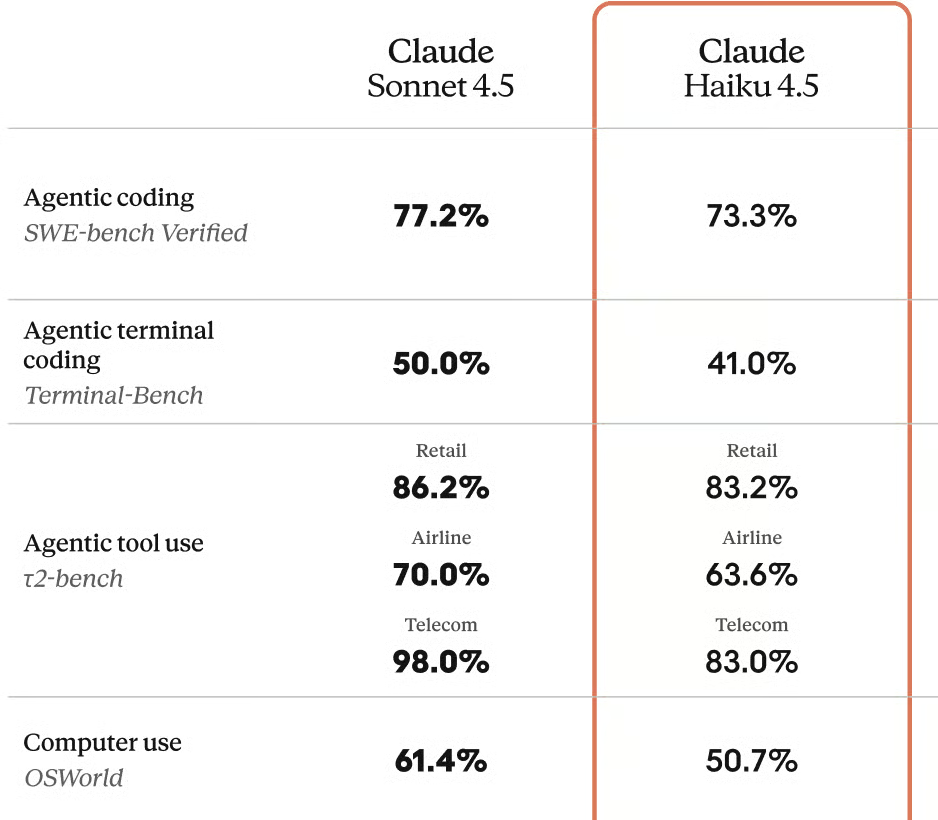

GPT-5.4 mini và nano so với Claude Haiku 4.5

Điều thực sự thú vị là GPT-5.4 nano có mức giá thấp hơn nhiều mẫu nhỏ hiệu năng thấp hơn từ đối thủ, cụ thể là Claude Haiku 4.5, có giá 1 USD cho mỗi triệu token đầu vào và 5 USD cho mỗi triệu token đầu ra. Như vậy OpenAI đã hạ giá so với Claude Haiku ở cả hai phía.

Nhưng các mẫu so sánh ra sao trong các bài test? Việc so sánh hơi khó vì chúng được đánh giá trên các biến thể kiểm tra khác nhau. Kết quả SWE-bench hoàn toàn không thể so sánh vì dùng phiên bản khác hẳn. Claude Haiku 4.5 được kiểm tra trên SWE-bench Verified và đạt 73,3%, còn GPT-5.4 nano được kiểm tra trên SWE-bench Pro (Public) và đạt 52,4%. Pro là bài test khó hơn và mới hơn.

Điểm 50,7% OSWorld của Claude Haiku 4.5

Ở hai phép so sánh “táo với táo” rõ ràng nhất, GPT-5.4 nano đều dẫn trước.

- Với GPQA Diamond, GPT-5.4 nano cao hơn 9,8%, và

- với τ2-bench Telecom, GPT-5.4 nano cao hơn 9,5%.

Tuy nhiên, Haiku 4.5 có thể nhỉnh hơn ở OSWorld về sử dụng máy tính, dù một lần nữa, các biến thể điểm chuẩn khiến so sánh trở nên khó.

- Claude Haiku 4.5 được kiểm tra trên OSWorld tiêu chuẩn và đạt 50,7%

- GPT-5.4 nano được kiểm tra trên OSWorld-Verified và đạt 39,0%.

OSWorld-Verified là bài test khó hơn, nhưng khoảng cách gần 12% trông khá đáng kể. Chúng tôi thận trọng hơn khi bác bỏ khoảng cách này bởi, không giống SWE-bench Verified và SWE-bench Pro, nơi đã biết rằng các mẫu làm tốt trên phiên bản Verified thường làm kém hơn trên phiên bản Pro, thì có ít bằng chứng hơn cho thấy câu chuyện tương tự áp dụng với OSWorld và OSWorld-Verified.

Điểm 39% OSWorld-Verified của GPT-5.4 nano

Mọi người nói gì về GPT-5.4 mini và nano

Nhiều phản ứng trực tuyến chỉ ra một mô thức quen thuộc trong công nghệ: mẫu chủ lực của năm ngoái trở thành hạng miễn phí của năm sau. Tất cả điều này đều có thể đoán trước, nhưng tốc độ thay đổi thì đáng kinh ngạc.

Mọi người nói rằng AI frontier có tốc độ mất giá nhanh nhất trong mọi sản phẩm từng được xây dựng. Người ta tự hỏi liệu mẫu mà hôm nay bạn trả phí cao có còn đáng giá sau sáu tháng nữa hay không. Đôi khi, nhà phát triển có thể không muốn đơn giản thay mẫu này bằng mẫu khác nếu họ đã trải qua quá trình tinh chỉnh hoặc đã hiệu chỉnh chi phí và hiệu năng.

Kết luận

Các điểm chuẩn cho thấy một “nấc thang” hiệu năng rõ ràng từ GPT-5.4 xuống 5.4 mini rồi 5.4 nano. Nhưng với nhiều tác vụ, lựa chọn thực tế phụ thuộc vào độ trễ và ngân sách nhiều hơn là cố gắng kiếm thêm vài phần trăm điểm.

Với nhiều ứng dụng sản xuất, GPT-5.4 mini có thể là mặc định mới tuyệt vời, vì chất lượng đủ tốt để mang cảm giác frontier trong khi vẫn rẻ và nhanh đủ cho khối lượng lớn.

GPT-5.4 nano phù hợp hơn với các khối lượng công việc theo thời gian thực lớn, rất nhạy với độ trễ. Nó cũng rất phù hợp làm các tác tử phụ để đảm nhiệm phần việc “đại trà” dễ hơn, do các mẫu Thinking hiệu năng cao hơn giao phó.

Trong một thế giới nơi mẫu chủ lực năm ngoái trở thành “mini” của năm nay, thiết kế hệ thống có thể hoán đổi mẫu dễ dàng là lựa chọn vượt trội so với tối ưu cho từng bản phát hành đơn lẻ. Tôi khuyến nghị bạn tham gia khóa học Xây dựng hệ thống tác tử có khả năng mở rộng, khóa học này đề cập câu hỏi đó và hướng dẫn bạn sử dụng các khung tác tử như Model Context Protocol (MCP).

GPT-5.4 mini và nano: Câu hỏi thường gặp

GPT‑5.4 mini chỉ là GPT‑5 mini nhanh hơn thôi đúng không?

Không. Mẫu này vừa nhanh hơn vừa mạnh hơn đáng kể trên các điểm chuẩn như SWE‑Bench Pro, đồng thời vẫn giữ cửa sổ ngữ cảnh 400k.

Sự đánh đổi chính giữa GPT‑5.4 và 5.4 mini là gì?

GPT‑5.4 vẫn tốt nhất nếu cần chất lượng tối đa; 5.4 mini đánh đổi một chút độ chính xác để có độ trễ và chi phí tốt hơn nhiều.

Khi nào tôi nên dùng GPT‑5.4 nano thay vì mini?

Hãy dùng nano cho các khối lượng công việc siêu nhạy với độ trễ hoặc rất lớn, nơi chi phí và tốc độ quan trọng hơn độ chính xác hàng đầu.

GPT-5.4 mini và nano có hỗ trợ công cụ và hình ảnh không?

Có. Cả hai đều hỗ trợ đầu vào hình ảnh, sử dụng công cụ, gọi hàm và đầu ra có cấu trúc trong API.

GPT-5.4 mini và nano có đủ tốt cho lập trình và tác tử không?

Có. 5.4 mini đặc biệt đạt trên 50% ở SWE‑Bench Pro và điểm cạnh tranh ở Terminal‑Bench 2.0, rất mạnh cho mã và tác tử terminal.

5.4 nano yếu hơn nhưng vẫn đủ đáp ứng cho nhiều tác vụ hỗ trợ, như định tuyến yêu cầu, đóng vai trò tác tử phụ giá rẻ và xử lý các quy trình terminal đơn giản nơi tốc độ và chi phí là quan trọng nhất.

Tôi là một cây bút và biên tập viên về khoa học dữ liệu, đã có bài đóng góp cho các nghiên cứu đăng trên tạp chí khoa học. Tôi đặc biệt quan tâm đến đại số tuyến tính, thống kê, R và các chủ đề tương tự. Tôi cũng chơi cờ vua khá thường xuyên!

Tom là một nhà khoa học dữ liệu và giảng viên kỹ thuật. Anh viết và quản lý các bài hướng dẫn và bài blog về khoa học dữ liệu của DataCamp. Trước đây, Tom làm việc trong lĩnh vực khoa học dữ liệu tại Deutsche Telekom.