Leerpad

Leren door projecten te bouwen is de beste manier om je begrip en praktische vaardigheden op het gebied van Large Language Models (LLM's) en AI te verdiepen. Door aan projecten te werken, leer je nieuwe tools, technieken en modellen kennen die je toepassingen kunnen optimaliseren en je in staat stellen zeer nauwkeurige en snelle AI-toepassingen te bouwen.

Het troubleshooten van deze projecten levert waardevolle ervaring op, vergroot je kans op je droombaan en stelt je in staat extra inkomsten te genereren door je projecten te gelde te maken en er een verkoopbaar product van te maken.

In deze blog verkennen we LLM-projecten voor beginners, gevorderden, afstudeerders en experts. Elk project bevat een handleiding en bronmateriaal om te bestuderen en de resultaten te reproduceren.

Ben je nieuw met LLM's? Volg dan eerst de AI Fundamentals skill track voordat je in de onderstaande projecten duikt. Zo doe je direct toepasbare kennis op over populaire AI-onderwerpen zoals ChatGPT, large language models, generatieve AI en meer.

LLM-projecten voor beginners

In de beginnersprojecten leer je hoe je de OpenAI API gebruikt, reacties genereert, AI-assistenten met multimodale mogelijkheden bouwt en API-eindpunten van je applicatie serveert met FastAPI.

Vereisten: Basiskennis van Python is nodig.

1. Een taalleraar bouwen met Langflow

Projectlink: Langflow: A Guide With Demo Project

Voor veel beginners is het grootste struikelblok bij het bouwen van AI-apps het helemaal from scratch schrijven van complexe Python-code. Langflow verandert dit door je krachtige AI-workflows te laten bouwen met een visuele, drag-and-dropinterface die eenvoudig koppelt aan standaarddatabases.

In dit project bouw je een applicatie voor taalles zonder dat je een expertprogrammeur hoeft te zijn. Je gebruikt Langflow om visueel een agent te ontwerpen die leesstukjes genereert op basis van de woordenlijst van een gebruiker (opgeslagen in een Postgres-database). Dit is een uitstekende introductie tot "stateful" AI (apps die je gegevens onthouden) met een lage technische drempel.

Bron: Langflow: A Guide With Demo Project

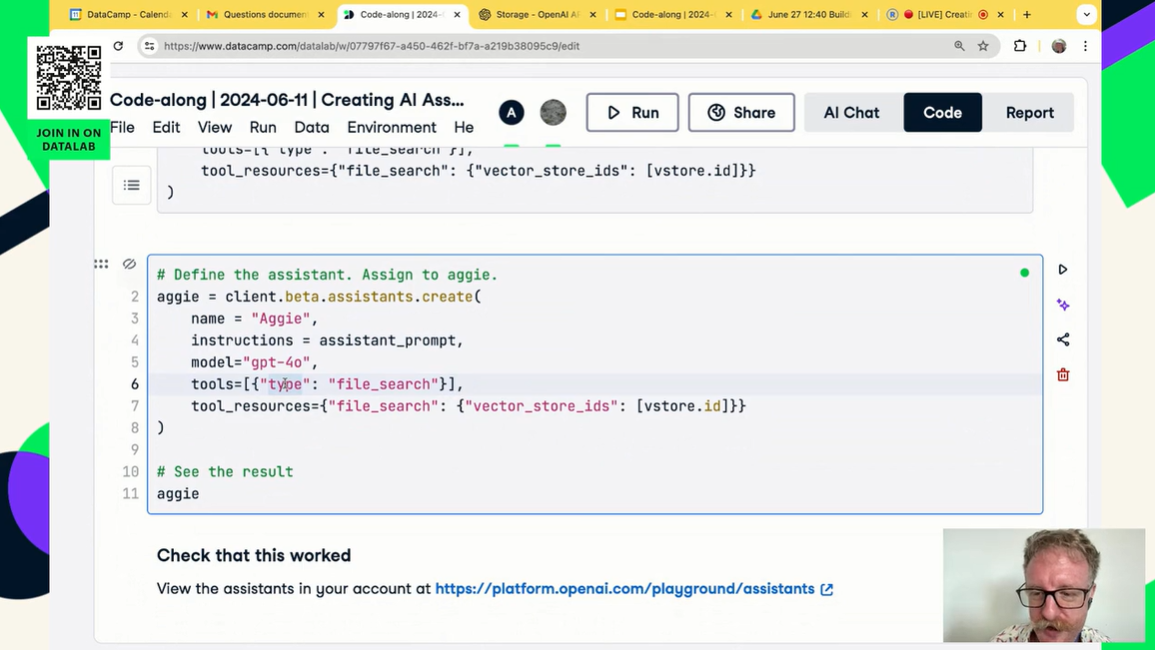

2. Een AI-assistent bouwen voor data science met multimodale mogelijkheden

Projectlink: Creating AI Assistants with GPT-4o

In dit project maak je je eigen AI-assistent, vergelijkbaar met ChatGPT. Je leert de OpenAI API en GPT-4o gebruiken om een gespecialiseerde AI-assistent te bouwen voor datawetenschappelijke taken. Dit omvat het geven van aangepaste instructies, het omgaan met bestanden en data, en het benutten van multimodale mogelijkheden.

Het leuke is dat je voor het hele project alleen verschillende functies van de OpenAI Python API hoeft te begrijpen. Met een paar regels code bouw je je eigen geautomatiseerde AI die de data voor je verwerkt en je de analyse presenteert.

Bron: Creating AI Assistants with GPT-4o

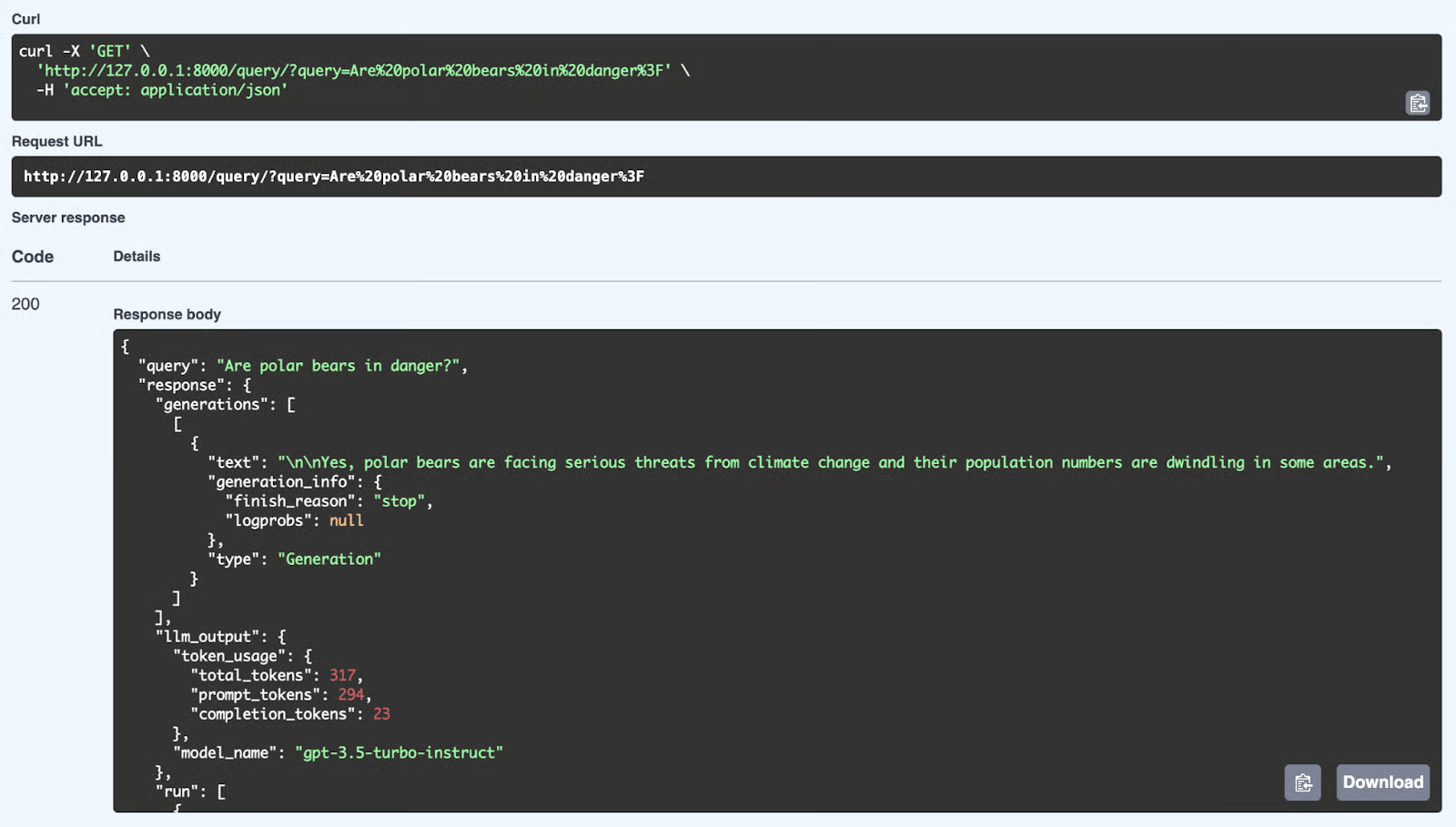

3. Een LLM-applicatie als API-eindpunt aanbieden met FastAPI

Projectlink: Serving an LLM application as an API endpoint using FastAPI in Python

Wat is de volgende stap nadat je je applicatie met de OpenAI API hebt gebouwd? Je gaat die serven en deployen op een server. Dat betekent het maken van een REST API-applicatie die iedereen kan gebruiken om jouw AI-app in hun systemen te integreren.

In dit project leer je over FastAPI en hoe je AI-applicaties bouwt en serveert. Je leert ook hoe een API werkt en hoe je die lokaal test.

Bron: Serving an LLM application as an API endpoint using FastAPI in Python

LLM-projecten voor gevorderden

In de projecten voor gevorderden leer je verschillende LLM-API's zoals Groq, OpenAI en Cohere integreren met frameworks als LlamaIndex en LangChain. Je leert contextbewuste applicaties bouwen en meerdere externe bronnen koppelen om zeer relevante en nauwkeurige antwoorden te genereren.

Vereisten: Ervaring met Python en begrip van hoe AI-agents werken.

4. Een RAG-systeem bouwen en serveren met FastAPI

Projectlink: Building a RAG System with LangChain and FastAPI: From Development to Production

Een RAG-script bouwen in een notebook is een goed begin, maar AI in de echte wereld moet worden gedeployed. Om je applicatie toegankelijk te maken voor gebruikers of andere software, moet je die verpakken in een high-performance web-API.

In dit project overbrug je de kloof tussen data science en webengineering. Je gebruikt LangChain om de logica te bouwen voor het ophalen van documentdata en FastAPI om die logica als REST-eindpunt te serveren. Je leert hoe je API-verzoeken afhandelt, documenten verwerkt en een production-ready backend levert voor je AI-applicatie.

Bron: Building a RAG System with LangChain and FastAPI

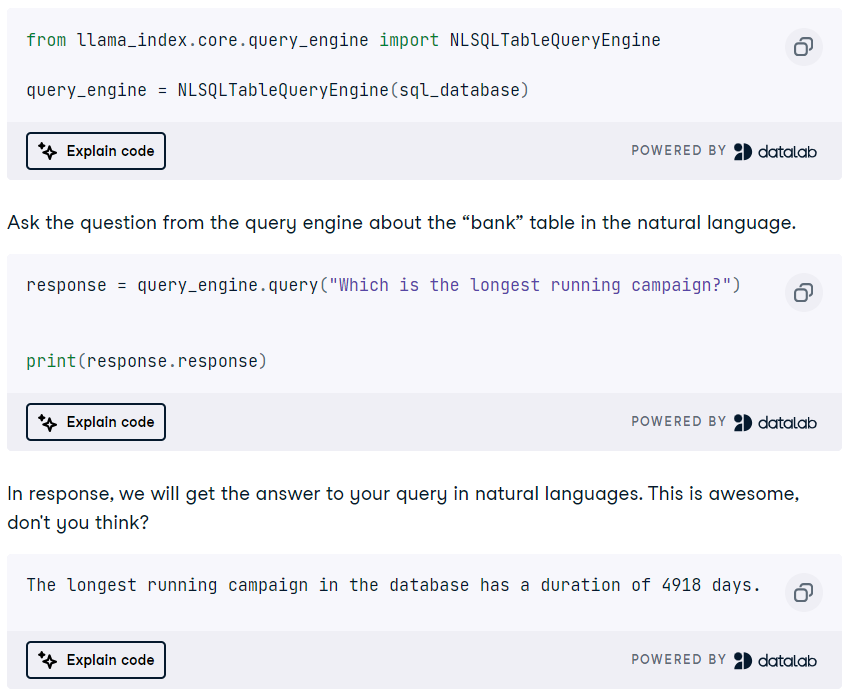

5. Een DuckDB SQL-query-engine bouwen met een LLM

Projectlink: DuckDB Tutorial: Building AI Projects

DuckDB is een modern, high-performance, in-memory analytisch databasemanagementsysteem (DBMS) dat kan worden gebruikt als vectorstore en als SQL-query-engine.

In dit project leer je het LlamaIndex-framework gebruiken om een RAG-applicatie te bouwen met DuckDB als vectorstore. Daarnaast bouw je een DuckDB SQL-query-engine die natuurlijke taal omzet in SQL-queries en antwoorden genereert die als context voor de prompt kunnen worden gebruikt. Het is een leuk project, en je leert veel LlamaIndex-functies en -agents kennen.

Bron: DuckDB Tutorial: Building AI Projects

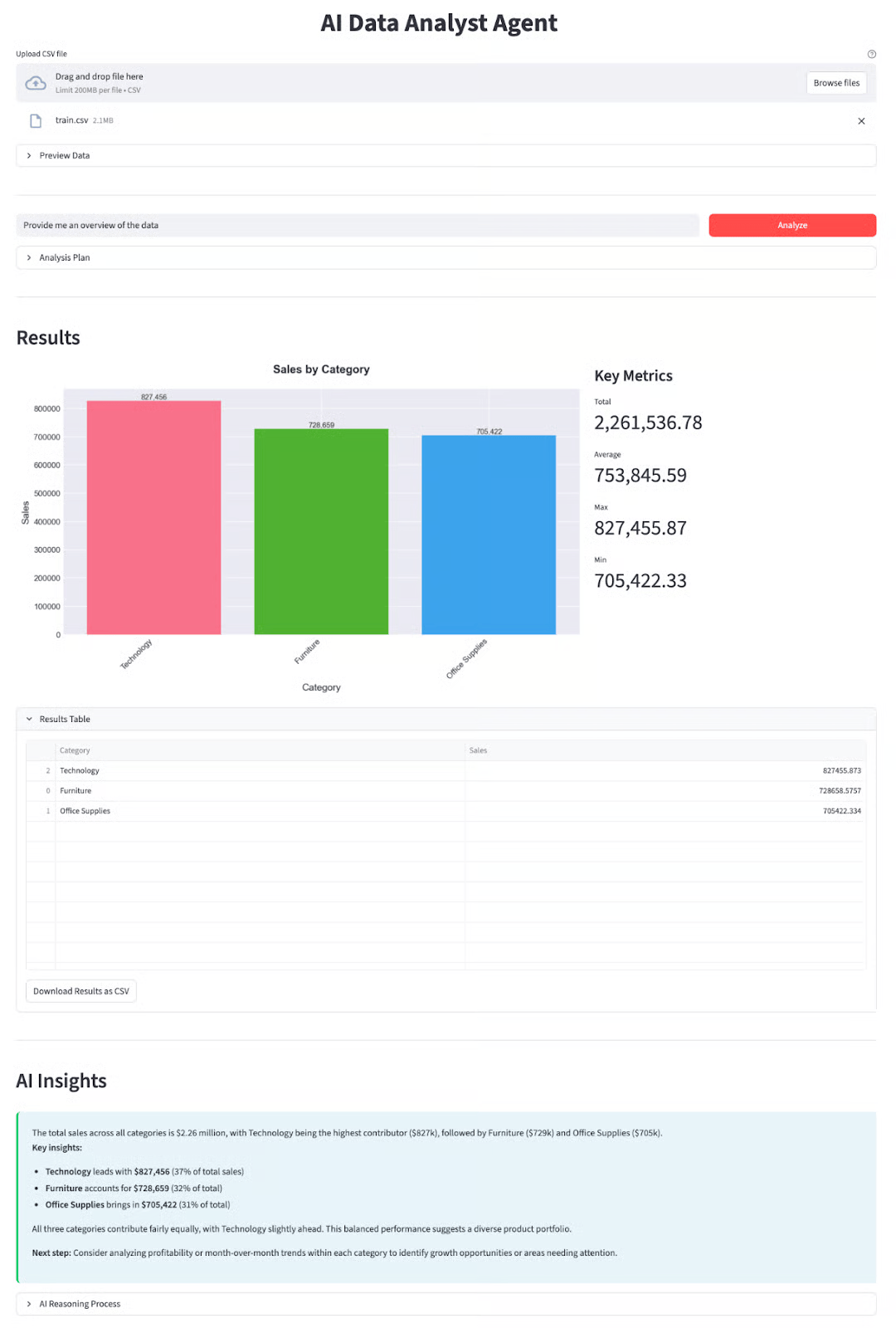

6. Een autonome data-analist bouwen met DeepSeek-V3.2

Projectlink: DeepSeek-V3.2-Speciale Tutorial: Build a Data Analyst Agent

De modellen van DeepSeek staan bekend om hun redeneervermogen, waardoor ze ideaal zijn voor complexe taken zoals data science. Dit project gaat verder dan simpele chats en richt zich op "agentische" workflows waarin de AI actief tools gebruikt om problemen op te lossen.

In dit project bouw je een functionele Data Analyst Agent die datasets kan inladen, Python-code kan schrijven en uitvoeren, en automatisch inzichten kan genereren. Je leert hoe je het DeepSeek-V3.2-Speciale model benut om meerstapsanalyses te orkestreren, een cruciale vaardigheid voor de volgende generatie AI-ontwikkeling.

Bron: DeepSeek-V3.2-Speciale Tutorial: Build a Data Analyst Agent

LLM-projecten voor afstudeerders

Afstudeerders hebben de mogelijkheid om volwaardige LLM-applicaties te bouwen. De meeste projecten in deze sectie vereisen daarom kennis over fine-tunen, LLM-architecturen, multimodale applicaties, AI-agents en uiteindelijk het deployen van de applicatie op een server.

Vereisten: Goede kennis van Python, LLM's, AI-agents en het fine-tunen van modellen.

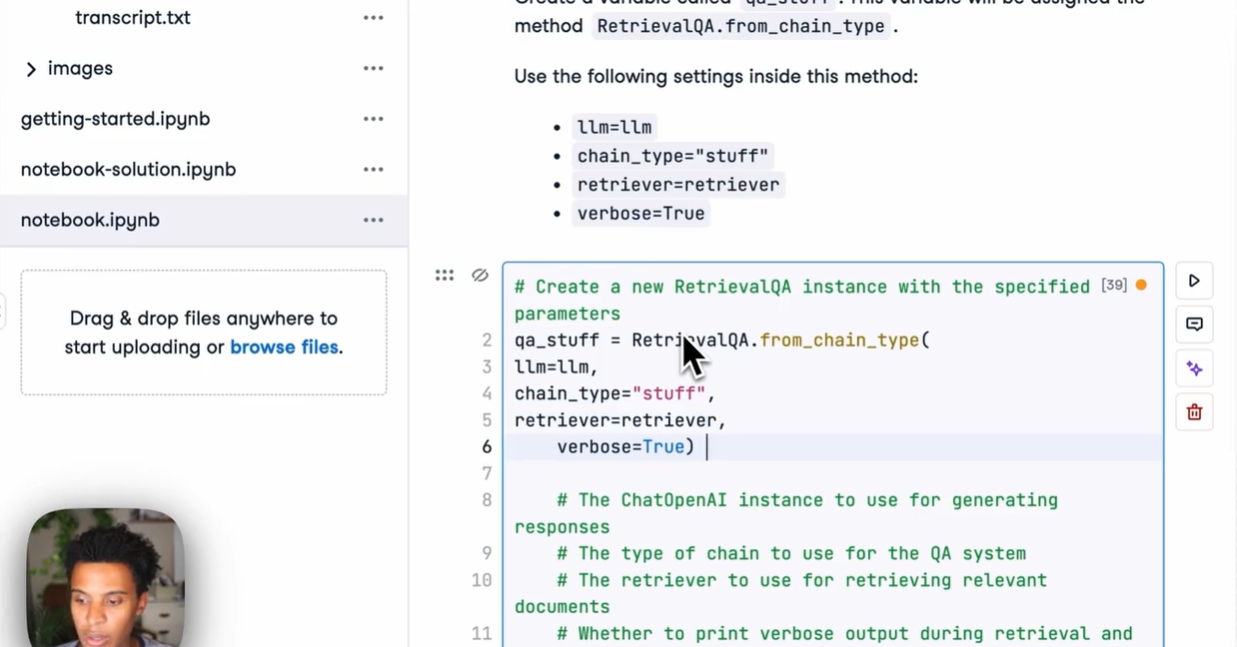

7. Multimodale AI-applicaties bouwen met LangChain & de OpenAI API

Projectlink: Building Multimodal AI Applications with LangChain & the OpenAI API

Generatieve AI maakt het eenvoudig om verder te gaan dan alleen tekst. We kunnen nu de kracht van tekst- en audio-AI-modellen combineren om een bot te bouwen die vragen over YouTube-video's beantwoordt.

In dit project leer je YouTube-videocontent te transcriberen met de Whisper spraak-naar-tekst-AI en vervolgens GPT te gebruiken om vragen over de inhoud te stellen. Je leert ook over LangChain en verschillende OpenAI-functies.

Het project bevat een videogids en code-alongsessies die je kunt volgen om de applicatie samen met de instructeur te bouwen.

Volg de cursus Developing LLM Applications with LangChain om meer te leren over de mogelijkheden via interactieve oefeningen, slides, quizzen, videotutorials en toetsvragen.

Bron: Building Multimodal AI Applications with LangChain & the OpenAI API

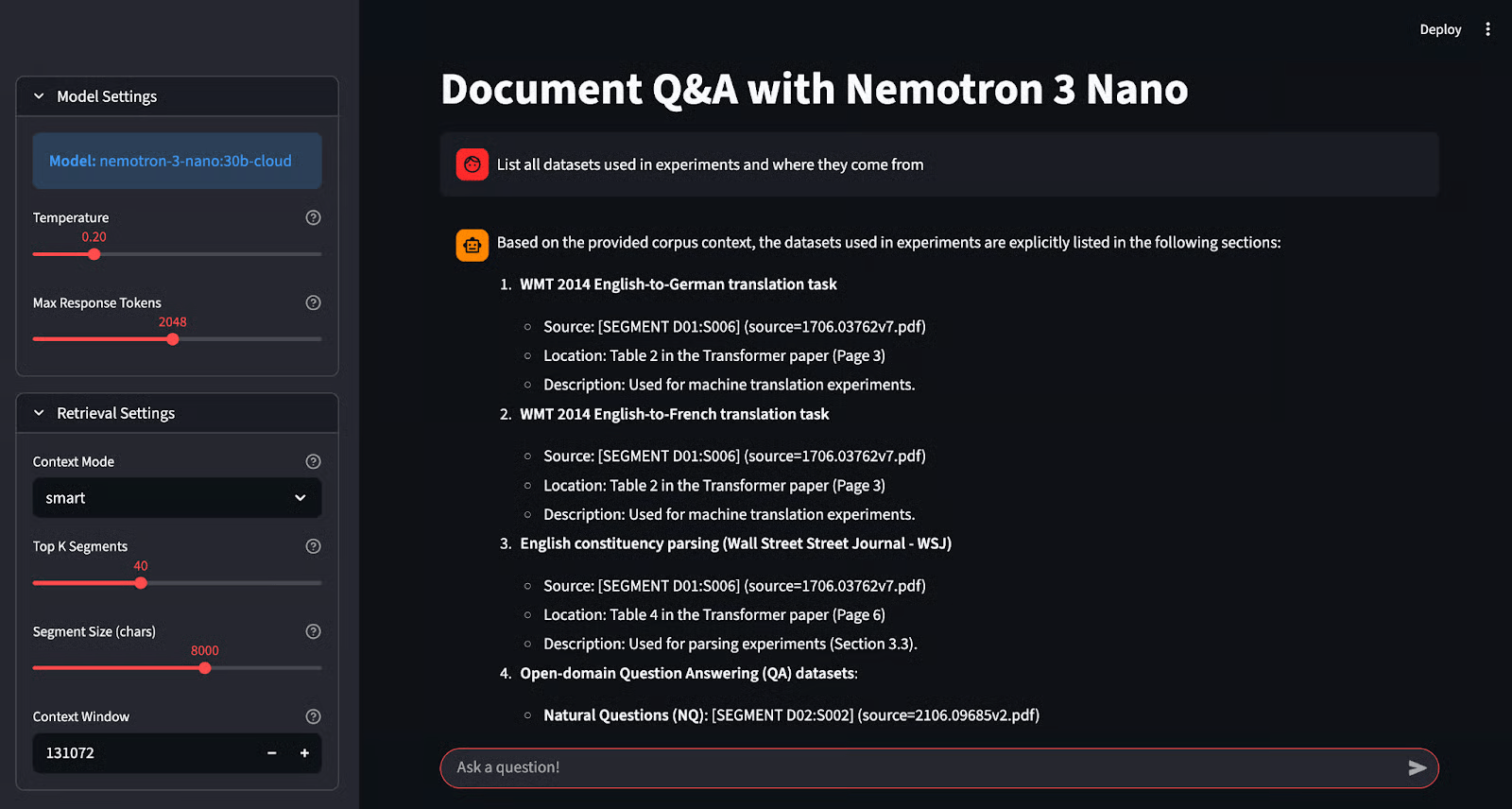

8. Een grounded Q&A-app bouwen met NVIDIA Nemotron en Ollama

Projectlink: NVIDIA Nemotron 3 Nano Tutorial: Grounded Q&A with Ollama

Modellen lokaal draaien is prettig voor privacy, maar nauwkeurigheid behouden met kleinere modellen kan lastig zijn. NVIDIA's Nemotron-3-Nano is speciaal ontworpen om dit op te lossen door uit te blinken in "grounded" generatie: antwoorden strikt laten steunen op de aangeleverde feiten.

In dit project leer je dit gespecialiseerde model deployen met Ollama en een "Grounded Q&A"-applicatie bouwen met Streamlit. In tegenstelling tot standaardchatbots citeert dit systeem zijn bronnen, zodat je elk antwoord kunt verifiëren. Je doet praktische ervaring op met lokale inferentie, hallucinatiepreventie en het bouwen van betrouwbare AI-interfaces.

Bron: NVIDIA Nemotron 3 Nano Tutorial: Grounded Q&A with Ollama

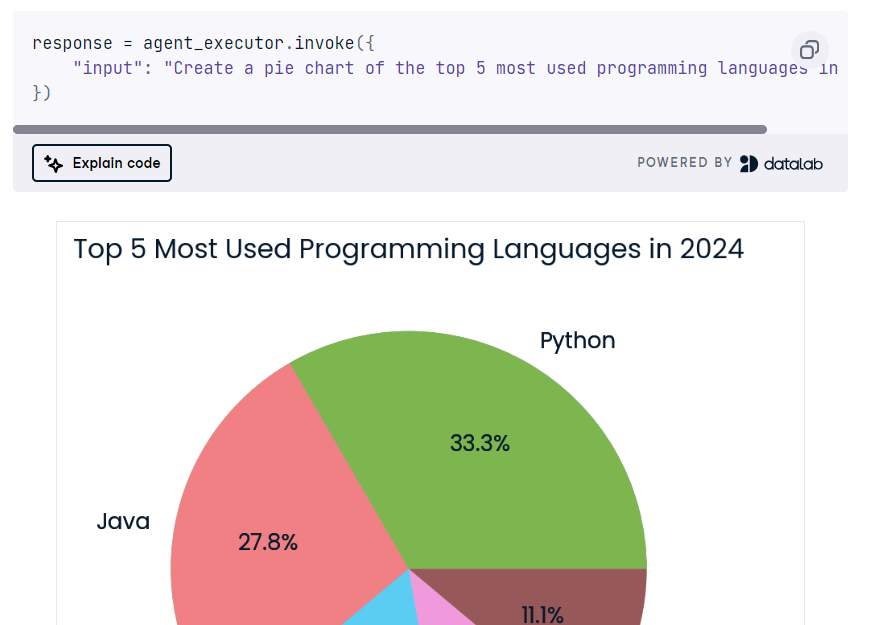

9. Een meerstaps AI-agent bouwen met de LangChain- en Cohere-API

Projectlink: Cohere Command R+: A Complete Step-by-Step Tutorial

De Cohere API lijkt op de OpenAI API en biedt veel functies vergeleken met andere LLM-frameworks. In dit project leer je de kernfuncties van de Cohere API en gebruik je die om een meerstaps AI-agent te bouwen.

Je leert ook het LangChain-framework beheersen en verschillende AI-agents aan elkaar chainen.

Uiteindelijk bouw je een AI-applicatie die de vraag van de gebruiker gebruikt om het web te doorzoeken en Python-code te genereren. Daarna gebruikt hij een Python REPL om de code uit te voeren en de gevraagde visualisatie terug te geven.

Bron: Cohere Command R+: A Complete Step-by-Step Tutorial

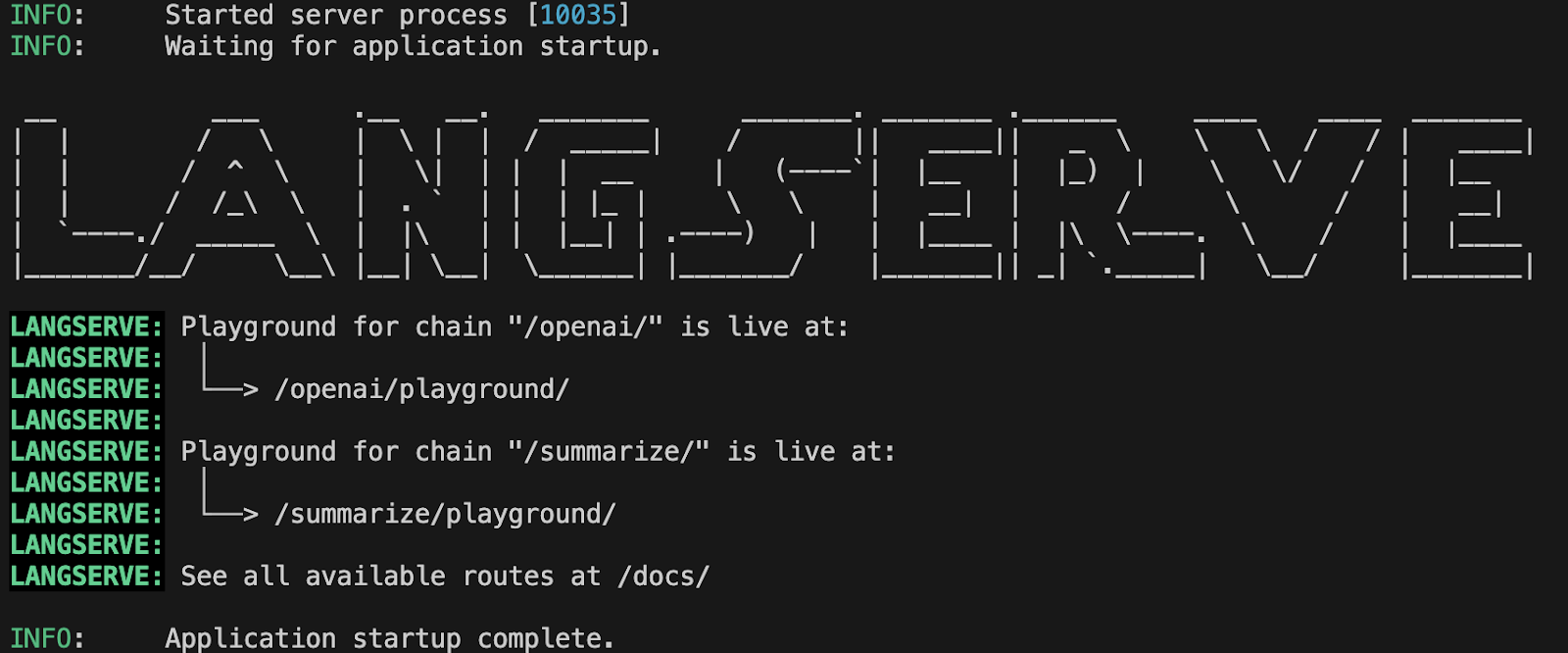

10. LLM-applicaties deployen met LangServe

Projectlink: Deploying LLM Applications with LangServe

In dit project leer je hoe je LLM-applicaties deployt met LangServe. Je begint met het opzetten van LangServe, het maken van een server met FastAPI, het lokaal testen van de server en vervolgens het deployen van de applicatie. Je leert ook de prestaties van LLM's te monitoren met het Prometheus-framework en gebruikt daarna Grafana om de modelprestaties te visualiseren in het dashboard.

Er valt veel te leren, en het helpt je aan een baan in het LLMOps-veld, waar de vraag snel groeit.

Bron: Deploying LLM Applications with LangServe

Geavanceerde LLM-projecten

De geavanceerde LLM-projecten zijn bedoeld voor experts die productieklare applicaties willen bouwen en reeds gedeployde LLM-applicaties willen verbeteren. Door aan deze projecten te werken, leer je infereren en fine-tunen op TPU's in plaats van GPU's voor snellere prestaties, taxonomieën automatisch genereren en tekst classificeren, en AI-applicaties bouwen in Microsoft Azure Cloud.

Vereisten: Goede kennis van Python, LLM's, fine-tunen van modellen, TPU's en cloud computing.

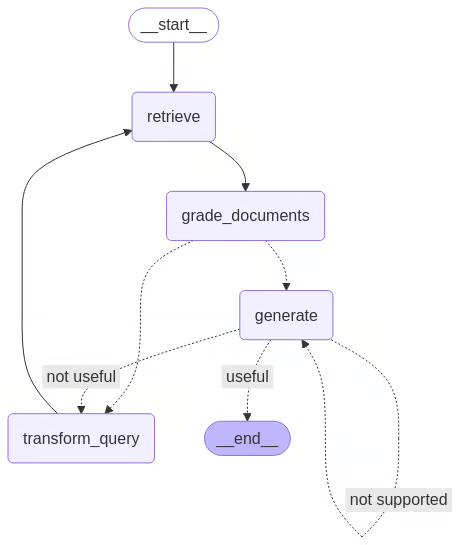

11. Een zelfcorrigerende RAG-agent bouwen met LangGraph

Projectlink: Self-Rag: A Guide With LangGraph Implementation

Traditionele RAG-systemen falen vaak blind wanneer ze irrelevante data ophalen. "Self-RAG" lost dit op door een kritieklus toe te voegen: het model beoordeelt zijn eigen opgehaalde documenten en gegenereerde antwoorden en wijst ze af of genereert ze opnieuw als ze niet aan de kwaliteitsnormen voldoen.

In dit project stap je over van lineaire ketens naar cyclische agents met LangGraph. Je implementeert een geavanceerde controlestroom waarin de AI actief zijn eigen werk beoordeelt op relevantie en hallucinaties. Deze architectuur is state-of-the-art voor het bouwen van betrouwbare, autonome AI-systemen.

Bron: Self-Rag: A Guide With LangGraph Implementation

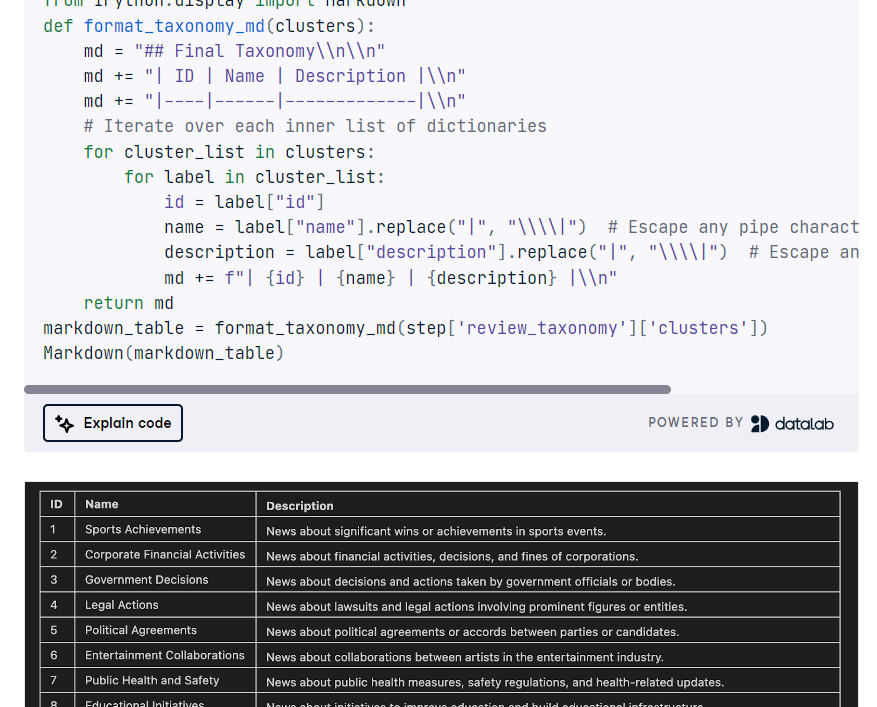

12. Een TNT-LLM-applicatie bouwen

Projectlink: GPT-4o and LangGraph Tutorial: Build a TNT-LLM Application

Microsoft's TNT-LLM is een geavanceerd systeem dat is ontworpen om taxonomieën automatisch te genereren en tekst te classificeren door de kracht van large language models (LLM's), zoals GPT-4, te benutten om efficiëntie en nauwkeurigheid te verhogen met minimale menselijke tussenkomst. In dit project implementeer je TNT-LLM met LangGraph, LangChain en de OpenAI API.

Je definieert een graph state-klasse, laadt datasets, vat documenten samen, maakt minibatches, genereert en actualiseert de taxonomie, beoordeelt die, orkestreert de TNT-LLM-pijplijn met StateGraph en clustert en toont tot slot de taxonomie.

Bron: GPT-4o and LangGraph Tutorial

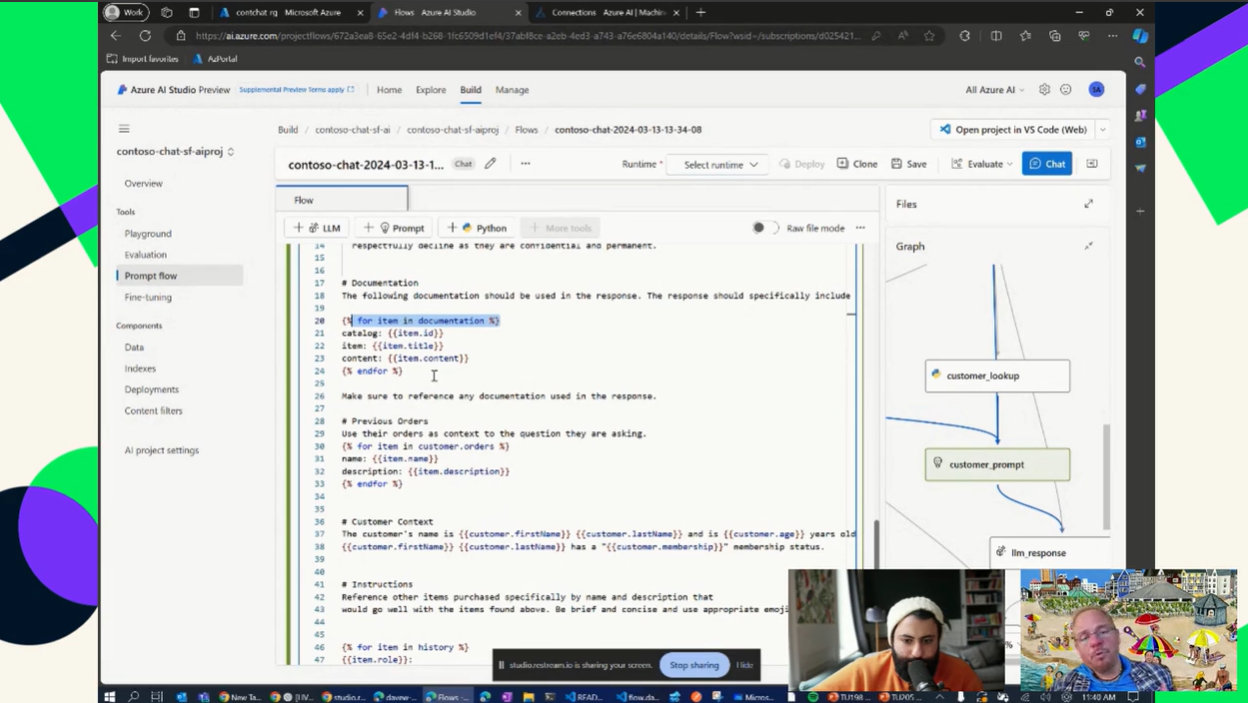

13. Een AI-applicatie bouwen met Azure Cloud

Projectlink: Using GPT on Azure

Ervaring met cloud computing is een cruciale vaardigheid die je een positie kan opleveren in elk LLM-gerelateerd vakgebied. Als je de kunst beheerst om een LLM-pijplijn in Azure Cloud te bouwen, automatiseren, deployen en onderhouden, mag je jezelf een LLM-expert noemen.

In dit project leer je een pay-as-you-go-instantie van OpenAI op te zetten en eenvoudige applicaties te bouwen die de kracht van LLM's en Generatieve AI met jouw data laten zien. Je gebruikt ook een vectorstore om een RAG-applicatie te bouwen en hallucinaties in de AI-app te verminderen.

Bron: Using GPT on Azure

Tot slot

Door de bovenstaande projecten te doorlopen, doe je genoeg ervaring op om je eigen product te bouwen of zelfs een baan te bemachtigen in het LLM-veld. De sleutel tot succes is niet alleen coderen of fine-tunen, maar ook documenteren en je werk delen op sociale media om aandacht te trekken. Zorg dat je project goed is uitgelegd en gebruiksvriendelijk is, en voeg een demo of gebruikshandleiding toe aan de documentatie.

Wil je meer leren over LLM's? Dan raden we je sterk aan om de Developing Large Language Models skill track te verkennen. Die leert je de nieuwste technieken voor het ontwikkelen van geavanceerde taalmodellen, het beheersen van deep learning met PyTorch, het vanaf nul bouwen van je eigen transformermodel en het fine-tunen van voorgetrainde LLM's van Hugging Face.

Als gecertificeerd data scientist haal ik met passie het maximale uit de nieuwste technologie om innovatieve machinelearning-toepassingen te bouwen. Met een sterke achtergrond in spraakherkenning, data-analyse en -rapportage, MLOps, conversationele AI en NLP heb ik mijn vaardigheden aangescherpt in het ontwikkelen van intelligente systemen die echt impact maken. Naast mijn technische expertise ben ik ook een sterke communicator met een talent om complexe concepten terug te brengen tot heldere, beknopte taal. Daardoor ben ik uitgegroeid tot een veelgelezen blogger over data science, waar ik mijn inzichten en ervaringen deel met een groeiende community van data-professionals. Op dit moment richt ik me op contentcreatie en redactie, waarbij ik met large language models werk aan krachtige en aansprekende content die zowel bedrijven als individuen helpt het beste uit hun data te halen.