Program

Belajar melalui pembangunan proyek adalah cara terbaik untuk memperdalam pemahaman dan keterampilan praktis Anda di bidang Large Language Models (LLM) dan AI. Dengan mengerjakan proyek, Anda akan mempelajari alat, teknik, dan model baru yang dapat mengoptimalkan aplikasi serta memungkinkan Anda membangun aplikasi AI yang sangat akurat dan cepat.

Mengatasi kendala dalam proyek-proyek ini akan memberi Anda pengalaman berharga, meningkatkan peluang mendapatkan pekerjaan impian, serta memungkinkan Anda memperoleh penghasilan tambahan dengan memonetisasi proyek dan menciptakan produk yang dapat dipasarkan.

Dalam blog ini, kita akan membahas proyek LLM yang dirancang untuk pemula, menengah, mahasiswa tingkat akhir, dan para ahli. Setiap proyek dilengkapi dengan panduan dan materi sumber untuk dipelajari serta direplikasi hasilnya.

Jika Anda baru mengenal LLM, silakan selesaikan AI Fundamentals skill track sebelum terjun ke proyek yang disebutkan di bawah ini. Ini akan membantu Anda memperoleh pengetahuan praktis tentang topik AI populer seperti ChatGPT, large language models, generative AI, dan lainnya.

Proyek LLM untuk Pemula

Dalam proyek tingkat pemula, Anda akan belajar cara menggunakan OpenAI API, menghasilkan respons, membangun asisten AI dengan kemampuan multimodal, serta menyajikan endpoint API dari aplikasi Anda menggunakan FastAPI.

Prasyarat: Pemahaman dasar Python diperlukan.

1. Membangun tutor bahasa dengan Langflow

Tautan proyek: Langflow: A Guide With Demo Project

Bagi banyak pemula, hambatan terbesar dalam membangun aplikasi AI adalah menulis kode Python yang kompleks dari nol. Langflow mengubah ini dengan memungkinkan Anda membangun alur kerja AI yang kuat menggunakan antarmuka visual seret-dan-lepas yang mudah terhubung ke basis data standar.

Dalam proyek ini, Anda akan membangun aplikasi tutor bahasa tanpa perlu menjadi ahli pemrograman. Anda akan menggunakan Langflow untuk merancang secara visual agen yang menghasilkan bacaan berdasarkan daftar kosakata pengguna (disimpan dalam basis data Postgres). Ini merupakan pengantar yang sangat baik untuk AI "stateful" (aplikasi yang mengingat data Anda) sambil tetap menjaga hambatan teknis tetap rendah.

Sumber: Langflow: A Guide With Demo Project

2. Membangun Asisten AI untuk data science dengan kemampuan multimodal

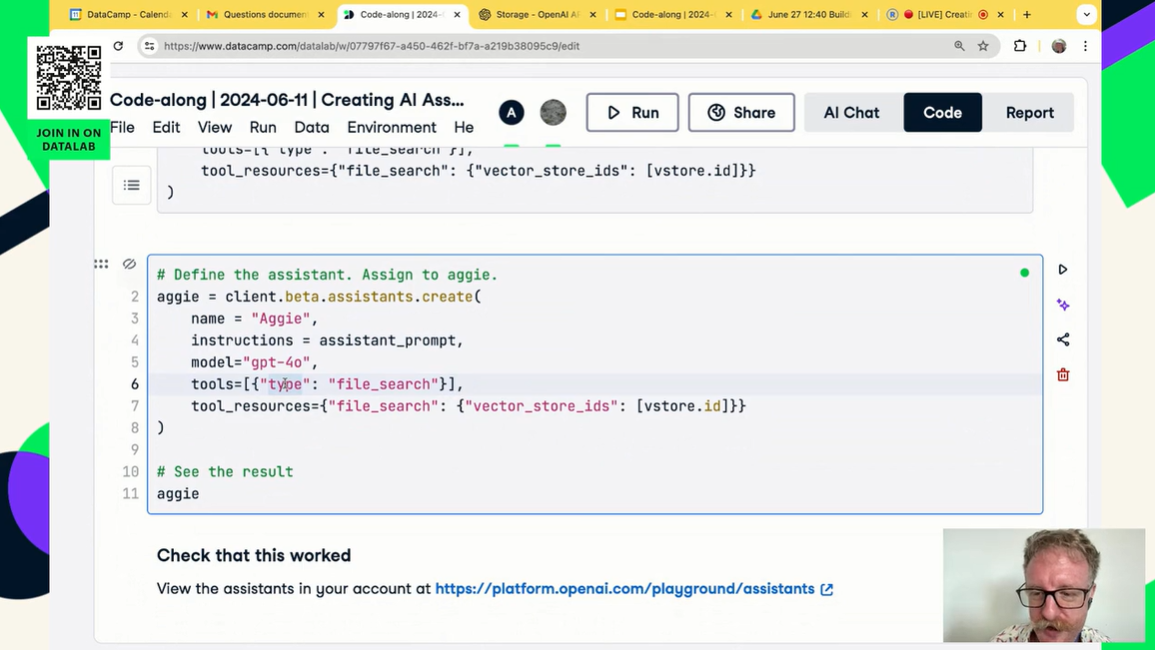

Tautan proyek: Creating AI Assistants with GPT-4o

Dalam proyek ini, Anda akan membuat asisten AI Anda sendiri yang mirip ChatGPT. Anda akan belajar menggunakan OpenAI API dan GPT-4o untuk membuat asisten AI khusus yang disesuaikan untuk tugas-tugas data science. Ini mencakup pemberian instruksi khusus, penanganan berkas dan data, serta penggunaan kemampuan multimodal.

Bagian menyenangkannya adalah seluruh proyek hanya mengharuskan Anda memahami berbagai fungsi OpenAI Python API. Dengan beberapa baris kode, Anda dapat membangun AI otomatis Anda sendiri yang akan memproses data dan menyajikan analisisnya kepada Anda.

Sumber: Creating AI Assistants with GPT-4o

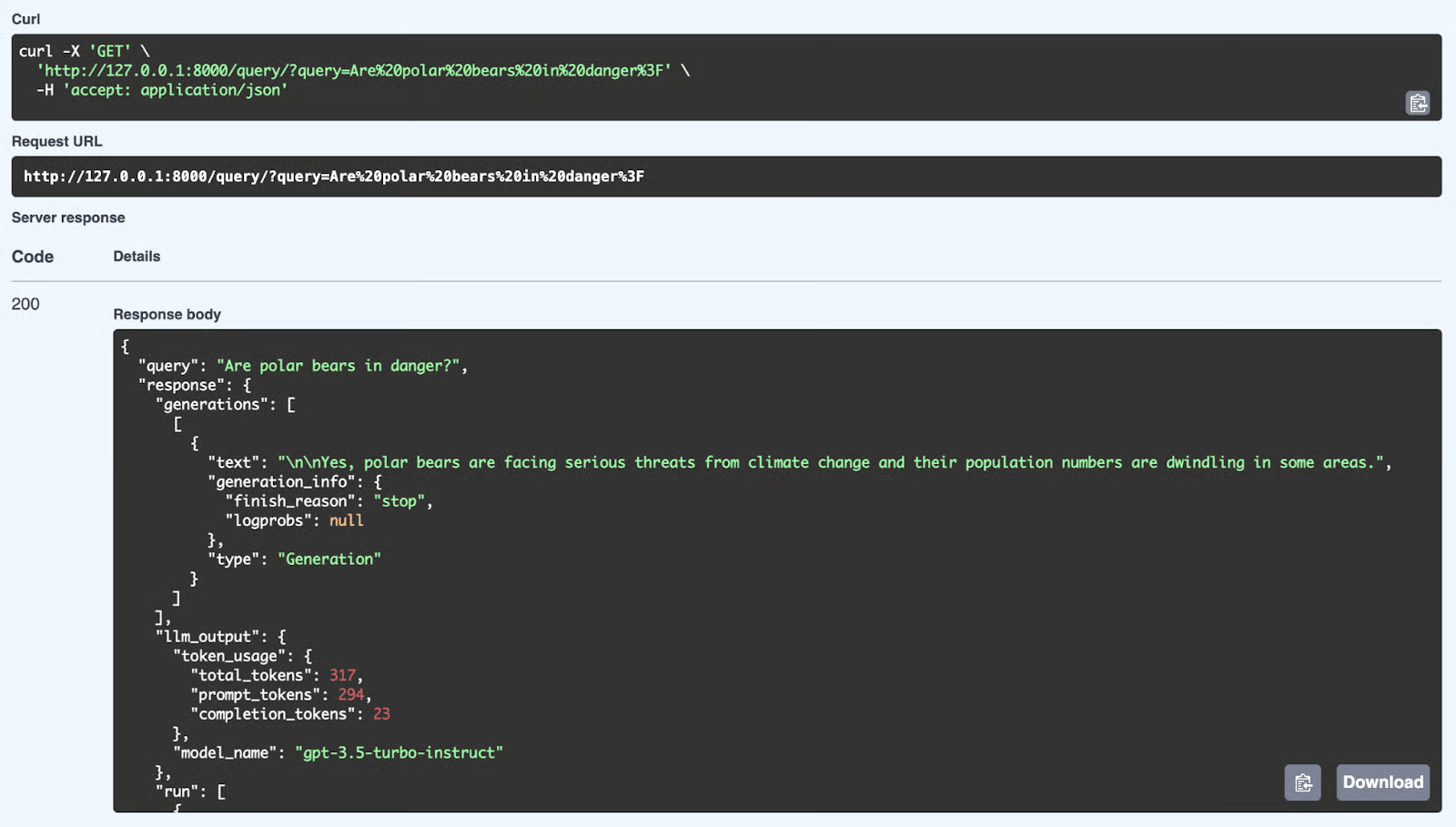

3. Menyajikan Aplikasi LLM sebagai endpoint API menggunakan FastAPI

Tautan proyek: Serving an LLM application as an API endpoint using FastAPI in Python

Apa langkah berikutnya setelah membangun aplikasi menggunakan OpenAI API? Anda akan menyajikan dan men-deploy-nya ke server. Ini berarti membuat aplikasi REST API yang dapat digunakan siapa pun untuk mengintegrasikan aplikasi AI Anda ke dalam sistem mereka.

Dalam proyek ini, Anda akan mempelajari FastAPI dan cara membangun serta menyajikan aplikasi AI. Anda juga akan mempelajari cara kerja API dan cara mengujinya secara lokal.

Sumber: Serving an LLM application as an API endpoint using FastAPI in Python

Proyek LLM Tingkat Menengah

Dalam proyek LLM tingkat menengah, Anda akan belajar mengintegrasikan berbagai API LLM seperti Groq, OpenAI, dan Cohere dengan kerangka kerja seperti LlamaIndex dan LangChain. Anda akan belajar membangun aplikasi yang sadar konteks dan menghubungkan banyak sumber eksternal untuk menghasilkan respons yang sangat relevan dan akurat.

Prasyarat: Pengalaman dengan Python dan pemahaman tentang cara kerja agen AI.

4. Membangun dan menyajikan sistem RAG dengan FastAPI

Tautan proyek: Building a RAG System with LangChain and FastAPI: From Development to Production

Membangun skrip RAG di notebook adalah awal yang bagus, tetapi AI dunia nyata perlu di-deploy. Agar aplikasi Anda dapat diakses oleh pengguna atau perangkat lunak lain, Anda harus membungkusnya dalam web API berperforma tinggi.

Dalam proyek ini, Anda akan menjembatani kesenjangan antara data science dan rekayasa web. Anda akan menggunakan LangChain untuk membangun logika pengambilan data dokumen dan FastAPI untuk menyajikan logika tersebut sebagai endpoint REST. Anda akan belajar menangani permintaan API, memproses dokumen, dan mengirim backend siap produksi untuk aplikasi AI Anda.

Sumber: Building a RAG System with LangChain and FastAPI

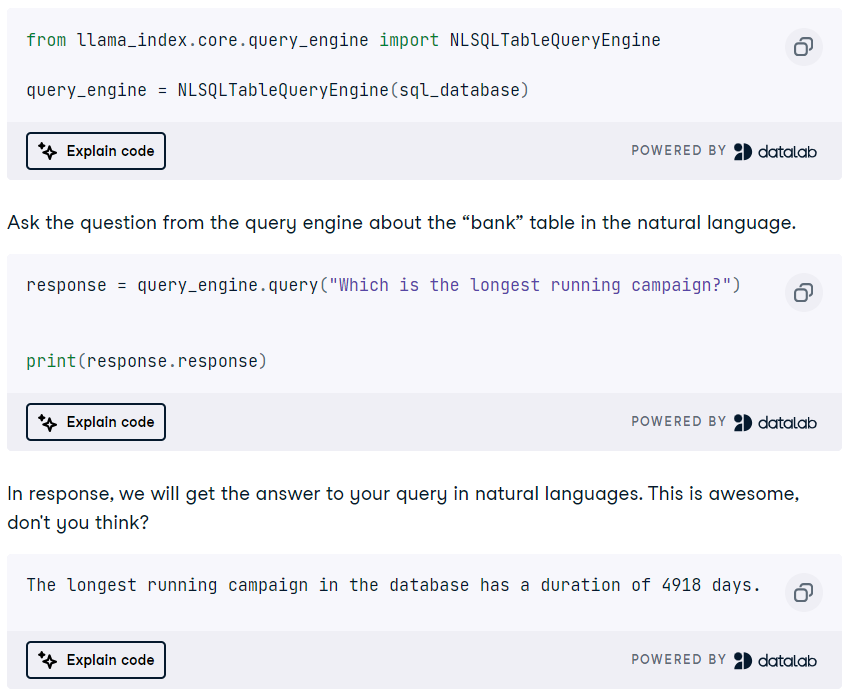

5. Membangun mesin kueri SQL DuckDB menggunakan LLM

Tautan proyek: DuckDB Tutorial: Building AI Projects

DuckDB adalah sistem manajemen basis data analitik modern, berperforma tinggi, dan in-memory yang dapat digunakan sebagai vector store dan mesin kueri SQL.

Dalam proyek ini, Anda akan mempelajari kerangka kerja LlamaIndex untuk membangun aplikasi RAG menggunakan DuckDB sebagai vector store. Selain itu, Anda akan membangun mesin kueri SQL DuckDB yang mengonversi bahasa alami menjadi kueri SQL dan menghasilkan respons yang dapat digunakan sebagai konteks untuk prompt. Ini proyek yang menyenangkan, dan Anda akan mempelajari banyak fungsi serta agen LlamaIndex.

Sumber: DuckDB Tutorial: Building AI Projects

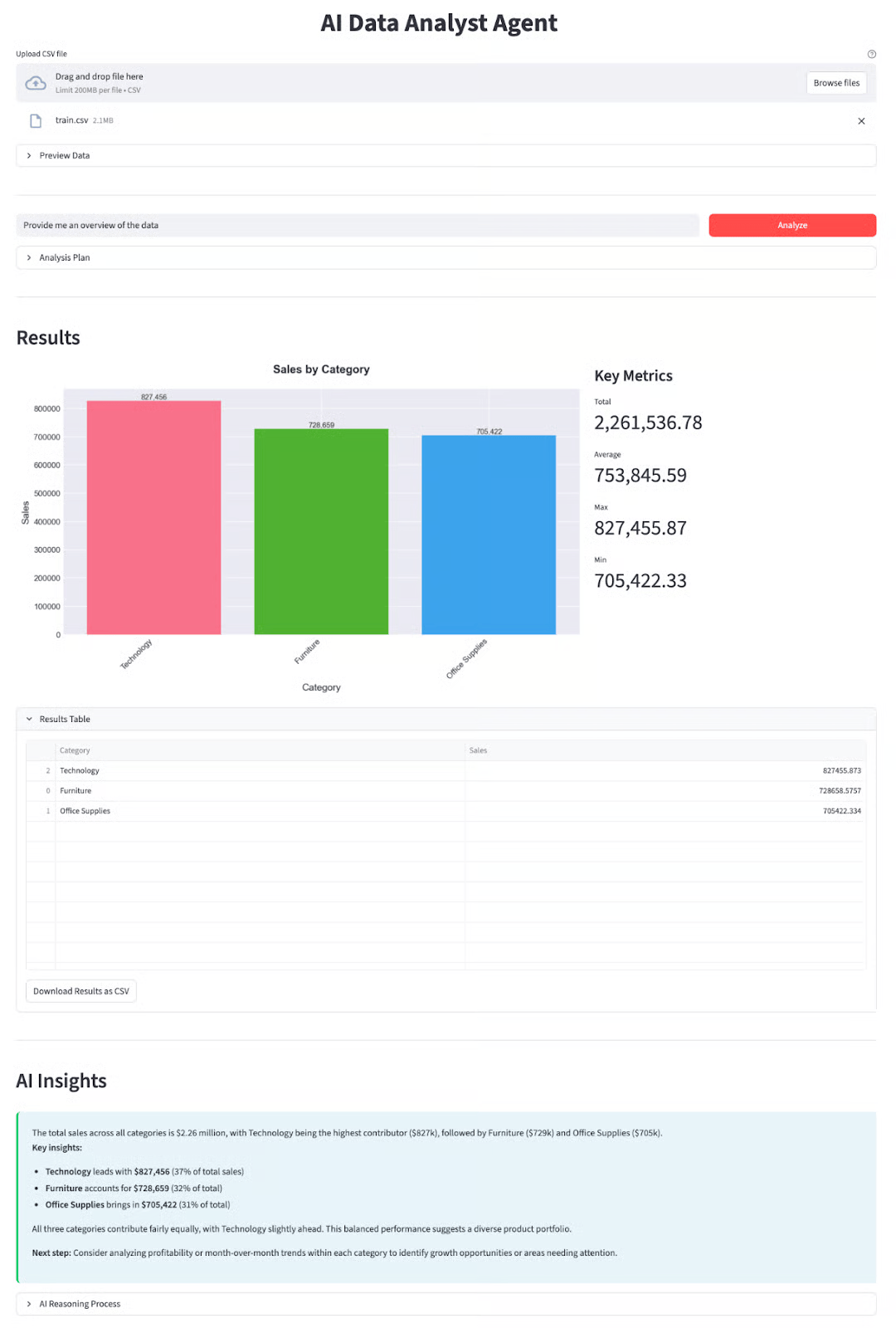

6. Membangun analis data otonom dengan DeepSeek-V3.2

Tautan proyek: DeepSeek-V3.2-Speciale Tutorial: Build a Data Analyst Agent

Model-model DeepSeek terkenal karena kemampuan penalarannya, sehingga ideal untuk tugas kompleks seperti data science. Melampaui percakapan sederhana, proyek ini berfokus pada alur kerja "agentic" di mana AI secara aktif menggunakan alat untuk memecahkan masalah.

Dalam proyek ini, Anda akan membangun Agen Analis Data fungsional yang dapat menyerap dataset, menulis dan mengeksekusi kode Python, serta menghasilkan insight secara otomatis. Anda akan belajar memanfaatkan model DeepSeek-V3.2-Speciale untuk mengorkestrasi tugas analisis multi-langkah, keterampilan krusial untuk generasi pengembangan AI berikutnya.

Sumber: DeepSeek-V3.2-Speciale Tutorial: Build a Data Analyst Agent

Proyek LLM untuk Mahasiswa Tingkat Akhir

Mahasiswa tingkat akhir memiliki kesempatan untuk membangun aplikasi LLM yang sesungguhnya. Oleh karena itu, sebagian besar proyek di bagian ini memerlukan pengetahuan tentang fine-tuning, arsitektur LLM, aplikasi multimodal, agen AI, dan pada akhirnya melakukan deployment aplikasi di server.

Prasyarat: Pemahaman yang baik tentang bahasa Python, LLM, agen AI, dan fine-tuning model.

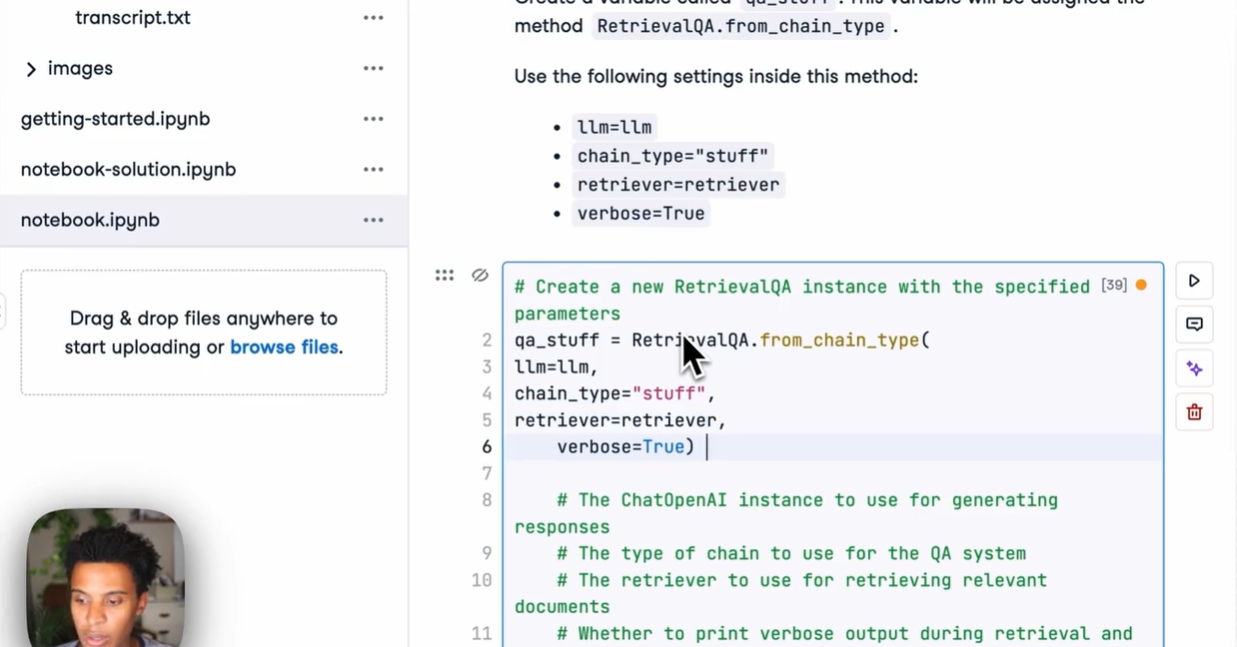

7. Membangun aplikasi AI multimodal dengan LangChain & OpenAI API

Tautan proyek: Building Multimodal AI Applications with LangChain & the OpenAI API

Generative AI memudahkan kita melampaui sekadar bekerja dengan teks. Kini kita dapat menggabungkan kekuatan model AI teks dan audio untuk membangun bot yang menjawab pertanyaan tentang video YouTube.

Dalam proyek ini, Anda akan belajar mentranskripsikan konten video YouTube dengan AI speech-to-text Whisper lalu menggunakan GPT untuk mengajukan pertanyaan tentang konten tersebut. Anda juga akan mempelajari LangChain dan berbagai fungsi OpenAI.

Proyek ini mencakup panduan video dan sesi code-along agar Anda dapat mengikuti dan membangun aplikasi bersama instruktur.

Ikuti kursus Developing LLM Applications with LangChain untuk mempelajari lebih lanjut fiturnya melalui latihan interaktif, slide, kuis, tutorial video, dan pertanyaan asesmen.

Sumber: Building Multimodal AI Applications with LangChain & the OpenAI API

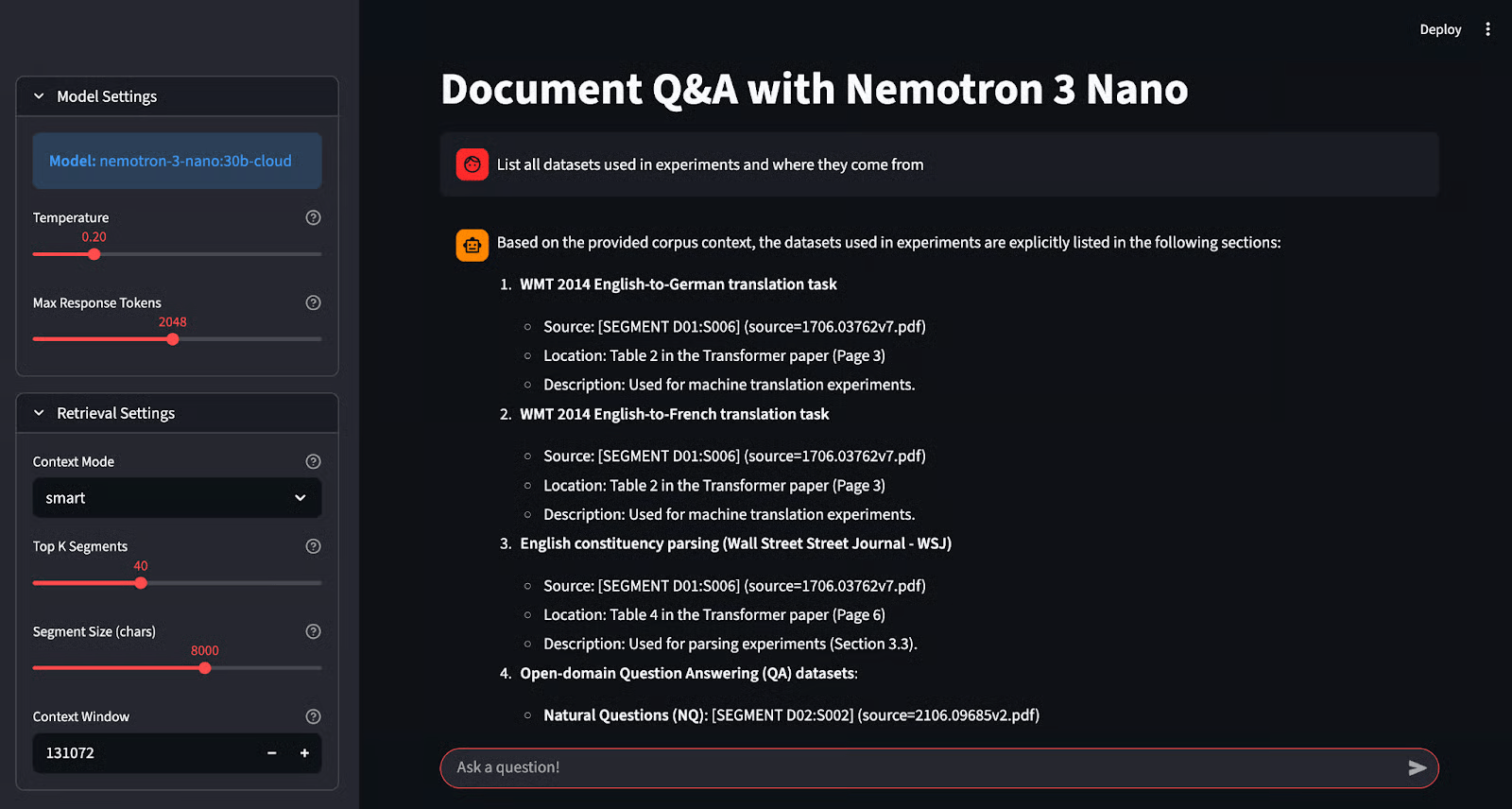

8. Membangun aplikasi Q&A grounded dengan NVIDIA Nemotron dan Ollama

Tautan proyek: NVIDIA Nemotron 3 Nano Tutorial: Grounded Q&A with Ollama

Menjalankan model secara lokal bagus untuk privasi, tetapi mempertahankan akurasi dengan model yang lebih kecil bisa sulit. Nemotron-3-Nano dari NVIDIA dirancang khusus untuk mengatasi hal ini dengan unggul dalam generasi "grounded", yang berarti memastikan jawaban sepenuhnya didukung oleh fakta yang diberikan.

Dalam proyek ini, Anda akan belajar melakukan deployment model khusus ini menggunakan Ollama dan membangun aplikasi "Grounded Q&A" dengan Streamlit. Tidak seperti chatbot standar, sistem ini mencantumkan sumbernya, sehingga Anda dapat memverifikasi setiap jawaban. Anda akan memperoleh pengalaman langsung dengan inferensi lokal, pencegahan halusinasi, dan membangun antarmuka AI yang tepercaya.

Sumber: NVIDIA Nemotron 3 Nano Tutorial: Grounded Q&A with Ollama

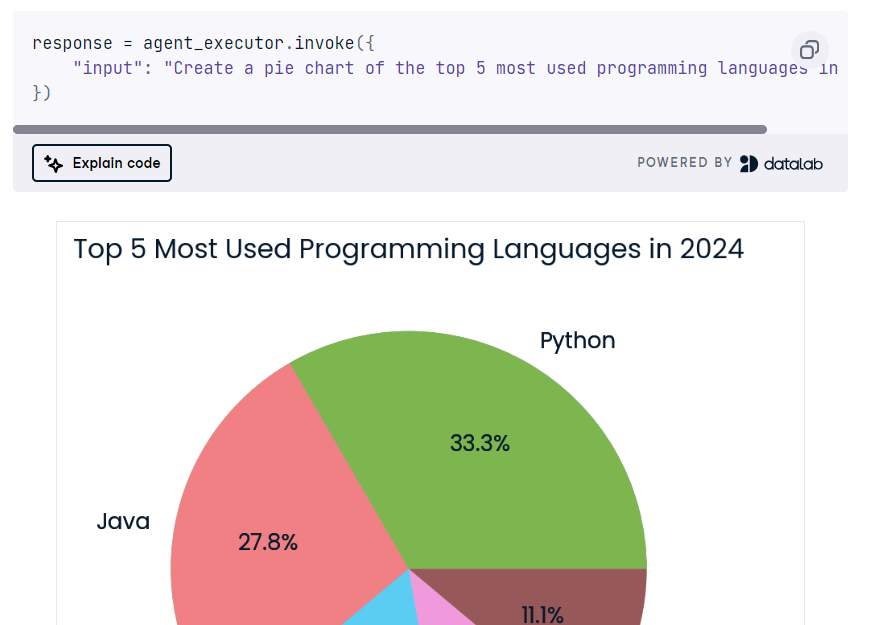

9. Membangun agen AI multi-langkah menggunakan LangChain dan Cohere API

Tautan proyek: Cohere Command R+: A Complete Step-by-Step Tutorial

Cohere API mirip dengan OpenAI API dan menawarkan banyak fitur dibandingkan kerangka kerja LLM lainnya. Dalam proyek ini, Anda akan mempelajari fitur inti Cohere API dan menggunakannya untuk membangun agen AI multi-langkah.

Anda juga akan menguasai kerangka kerja LangChain dan merangkai berbagai agen AI.

Pada akhirnya, Anda akan membangun aplikasi AI yang akan mengambil kueri pengguna untuk menelusuri web dan menghasilkan kode Python. Lalu, aplikasi akan menggunakan Python REPL untuk mengeksekusi kode dan mengembalikan visualisasi yang diminta pengguna.

Sumber: Cohere Command R+: A Complete Step-by-Step Tutorial

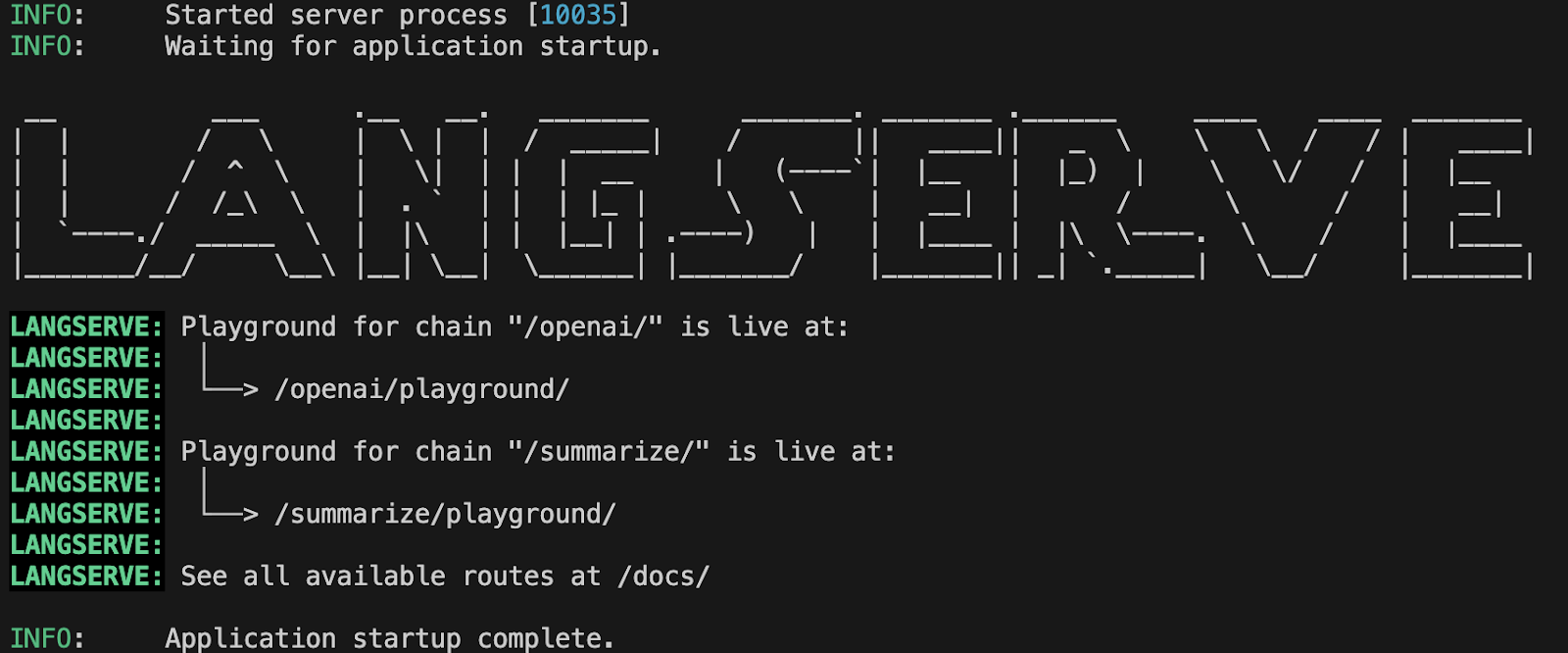

10. Deploy aplikasi LLM dengan LangServe

Tautan proyek: Deploying LLM Applications with LangServe

Dalam proyek ini, Anda akan belajar cara melakukan deployment aplikasi LLM menggunakan LangServe. Anda akan mulai dengan menyiapkan LangServe, membuat server menggunakan FastAPI, menguji server secara lokal, lalu melakukan deployment aplikasi. Anda juga akan belajar memantau kinerja LLM menggunakan kerangka kerja Prometheus dan kemudian menggunakan Grafana untuk memvisualisasikan kinerja model di dasbor.

Banyak yang bisa dipelajari, dan ini akan membantu Anda mendapatkan pekerjaan di bidang LLMOps yang permintaannya terus meningkat.

Sumber: Deploying LLM Applications with LangServe

Proyek LLM Tingkat Lanjut

Proyek LLM tingkat lanjut dirancang untuk para ahli yang ingin membangun aplikasi siap produksi dan meningkatkan aplikasi LLM yang sudah di-deploy. Dengan mengerjakan proyek-proyek ini, Anda akan belajar melakukan inferensi dan fine-tuning pada TPU alih-alih GPU untuk performa lebih cepat, mengotomatiskan pembuatan taksonomi dan klasifikasi teks, serta membangun aplikasi AI di Microsoft Azure Cloud.

Prasyarat: Pemahaman yang baik tentang Python, LLM, fine-tuning model, TPU, dan komputasi awan.

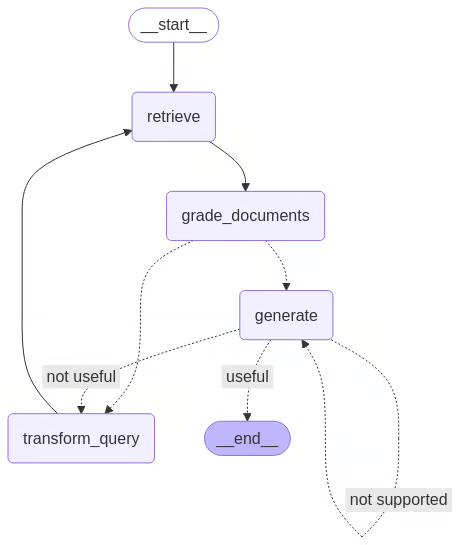

11. Membangun agen RAG yang dapat mengoreksi diri dengan LangGraph

Tautan proyek: Self-Rag: A Guide With LangGraph Implementation

Sistem RAG tradisional sering gagal begitu saja saat mengambil data yang tidak relevan. "Self-RAG" mengatasinya dengan menambahkan loop kritik: model mengevaluasi sendiri dokumen yang diambil dan jawaban yang dihasilkan, menolak atau menghasilkan ulang jika tidak memenuhi standar kualitas.

Dalam proyek ini, Anda akan beralih dari rantai linear ke agen siklik menggunakan LangGraph. Anda akan menerapkan alur kontrol canggih di mana AI secara aktif menilai sendiri pekerjaannya untuk relevansi dan halusinasi. Arsitektur ini mewakili teknik mutakhir dalam membangun sistem AI yang andal dan otonom.

Sumber: Self-Rag: A Guide With LangGraph Implementation

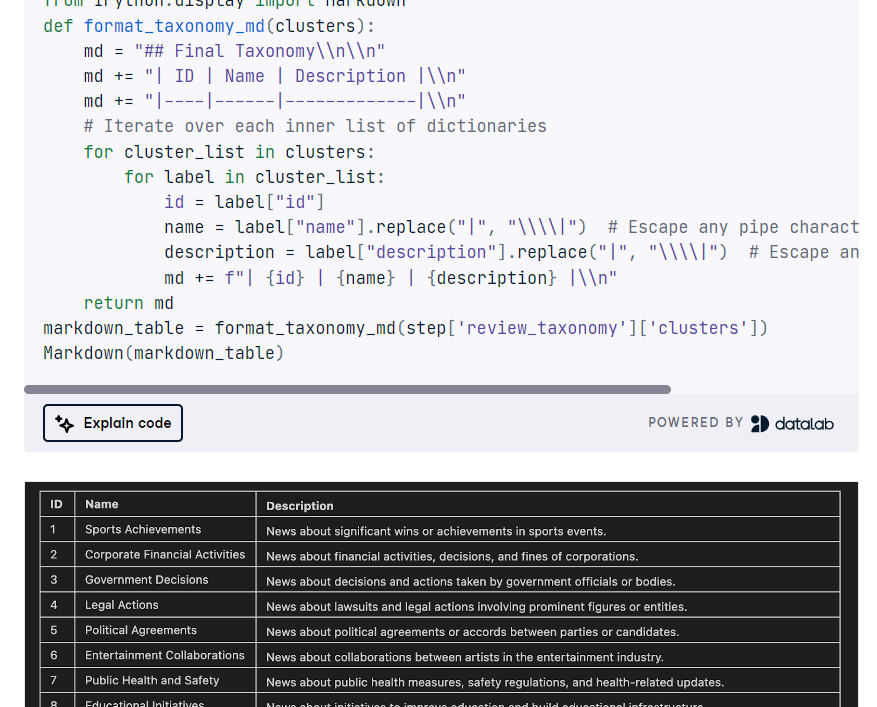

12. Membangun aplikasi TNT-LLM

Tautan proyek: GPT-4o and LangGraph Tutorial: Build a TNT-LLM Application

TNT-LLM dari Microsoft adalah sistem mutakhir yang dirancang untuk mengotomatiskan pembuatan taksonomi dan klasifikasi teks dengan memanfaatkan kekuatan large language models (LLM), seperti GPT-4, guna meningkatkan efisiensi dan akurasi dengan intervensi manusia minimal. Dalam proyek ini, Anda akan mengimplementasikan TNT-LLM menggunakan LangGraph, LangChain, dan OpenAI API.

Anda akan mendefinisikan kelas graph state, memuat dataset, merangkum dokumen, membuat minibatch, menghasilkan dan memperbarui taksonomi, meninjaunya, mengorkestrasi pipeline TNT-LLM dengan StateGraph, dan akhirnya melakukan klasterisasi serta menampilkan taksonomi.

Sumber: GPT-4o and LangGraph Tutorial

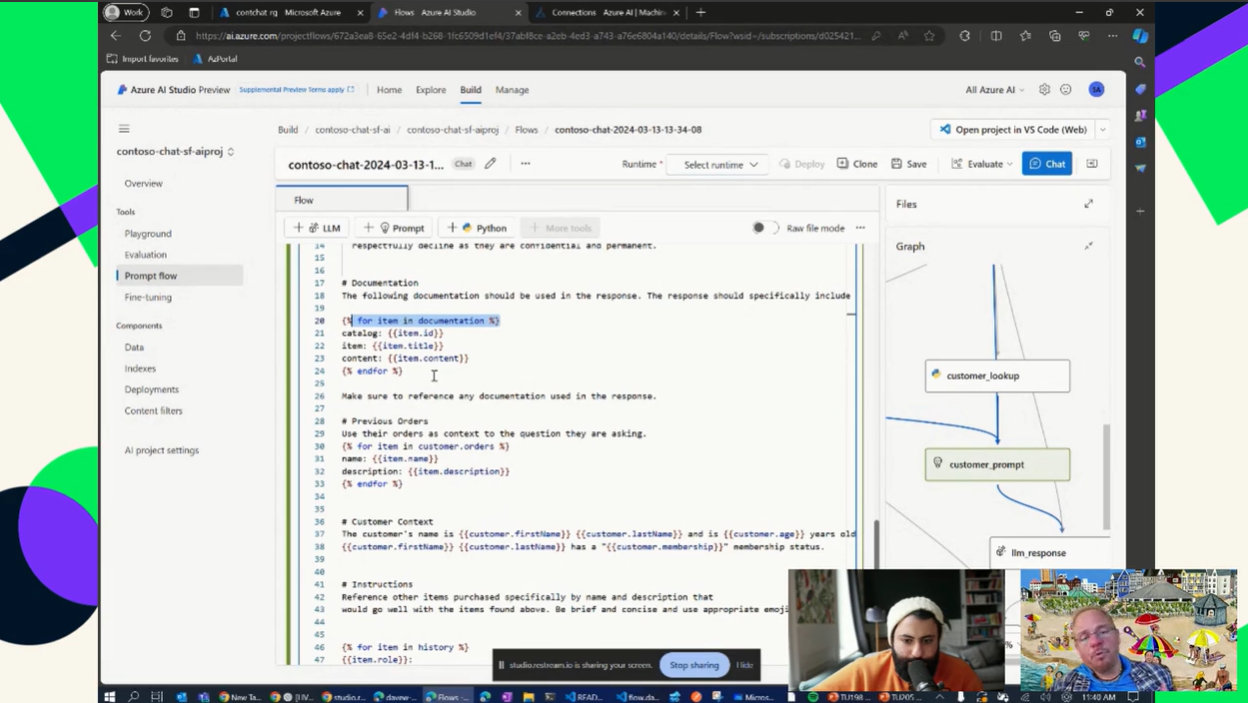

13. Membangun aplikasi AI menggunakan Azure cloud

Tautan proyek: Using GPT on Azure

Memperoleh pengalaman komputasi awan adalah keterampilan penting yang akan mengantarkan Anda ke posisi di bidang terkait LLM apa pun. Menguasai kemampuan membangun, mengotomatiskan, men-deploy, dan memelihara pipeline LLM di Azure cloud akan membuat Anda diakui sebagai pakar LLM.

Dalam proyek ini, Anda akan belajar menyiapkan instance OpenAI pay-as-you-go dan membangun aplikasi sederhana yang menunjukkan kekuatan LLM dan Generative AI dengan data Anda. Anda juga akan menggunakan vector store untuk membangun aplikasi RAG dan mengurangi halusinasi dalam aplikasi AI.

Sumber: Using GPT on Azure

Penutup

Mengerjakan proyek-proyek di atas akan memberi Anda cukup pengalaman untuk membangun produk Anda sendiri atau bahkan mendapatkan pekerjaan di bidang LLM. Kunci kesuksesan bukan hanya pada pengkodean atau fine-tuning, tetapi juga dokumentasi dan berbagi karya Anda di media sosial untuk menarik perhatian. Pastikan proyek Anda dijelaskan dengan baik dan ramah pengguna, serta sertakan demo atau panduan kebergunaan dalam dokumentasi.

Jika Anda tertarik mempelajari lebih lanjut tentang LLM, kami sangat merekomendasikan untuk mengeksplorasi Developing Large Language Models skill track. Anda akan mempelajari teknik terbaru untuk mengembangkan model bahasa mutakhir, menguasai deep learning dengan PyTorch, membangun model transformer Anda sendiri dari nol, serta melakukan fine-tuning LLM pra-latih dari Hugging Face.

Sebagai data scientist tersertifikasi, saya bersemangat memanfaatkan teknologi mutakhir untuk menciptakan aplikasi machine learning yang inovatif. Dengan latar belakang kuat di pengenalan ucapan, analisis dan pelaporan data, MLOps, conversational AI, dan NLP, saya mengasah keterampilan dalam mengembangkan sistem cerdas yang berdampak nyata. Selain keahlian teknis, saya juga komunikator andal yang mampu menyederhanakan konsep kompleks menjadi bahasa yang jelas dan ringkas. Karena itu, saya menjadi blogger yang dicari di bidang data science, membagikan wawasan dan pengalaman kepada komunitas profesional data yang terus berkembang. Saat ini, saya berfokus pada pembuatan dan penyuntingan konten, bekerja dengan large language model untuk mengembangkan konten yang kuat dan menarik agar membantu bisnis dan individu memaksimalkan data mereka.