Tracks

Học thông qua việc xây dựng dự án là cách tốt nhất để đào sâu kiến thức và kỹ năng thực hành trong lĩnh vực Mô hình ngôn ngữ lớn (LLM) và AI. Bằng cách làm dự án, bạn sẽ nắm bắt các công cụ, kỹ thuật và mô hình mới giúp tối ưu ứng dụng và cho phép bạn xây dựng các ứng dụng AI nhanh và chính xác cao.

Quá trình xử lý lỗi và khắc phục sự cố trong các dự án này sẽ mang lại kinh nghiệm quý giá, tăng cơ hội đạt được công việc mơ ước và giúp bạn tạo thêm thu nhập bằng cách thương mại hóa dự án để tạo ra sản phẩm có thể đưa ra thị trường.

Trong bài viết này, chúng ta sẽ khám phá các dự án LLM dành cho người mới bắt đầu, người ở trình độ trung cấp, sinh viên năm cuối và chuyên gia. Mỗi dự án đều có hướng dẫn và tài liệu nguồn để bạn nghiên cứu và tái hiện kết quả.

Nếu bạn mới làm quen với LLM, vui lòng hoàn thành lộ trình kỹ năng AI Fundamentals trước khi bắt tay vào các dự án bên dưới. Điều này sẽ giúp bạn có kiến thức thực chiến về các chủ đề AI phổ biến như ChatGPT, mô hình ngôn ngữ lớn, generative AI và nhiều hơn nữa.

Dự án LLM cho người mới bắt đầu

Ở các dự án cho người mới, bạn sẽ học cách sử dụng OpenAI API, tạo phản hồi, xây dựng trợ lý AI có khả năng đa phương thức và cung cấp các điểm cuối API của ứng dụng bằng FastAPI.

Yêu cầu tiên quyết: Cần hiểu biết cơ bản về Python.

1. Xây dựng gia sư ngôn ngữ với Langflow

Liên kết dự án: Langflow: Hướng dẫn kèm dự án demo

Với nhiều người mới bắt đầu, rào cản lớn nhất khi xây dựng ứng dụng AI là viết mã Python phức tạp từ đầu. Langflow thay đổi điều này bằng cách cho phép bạn xây dựng quy trình AI mạnh mẽ qua giao diện trực quan kéo‑thả, dễ dàng kết nối với các cơ sở dữ liệu tiêu chuẩn.

Trong dự án này, bạn sẽ xây dựng một ứng dụng gia sư ngôn ngữ mà không cần là chuyên gia viết mã. Bạn sẽ dùng Langflow để thiết kế trực quan một agent tạo đoạn văn đọc dựa trên danh sách từ vựng của người dùng (lưu trong cơ sở dữ liệu Postgres). Đây là phần mở đầu tuyệt vời cho AI "có trạng thái" (ứng dụng nhớ dữ liệu của bạn) đồng thời giữ rào cản kỹ thuật ở mức thấp.

Nguồn: Langflow: Hướng dẫn kèm dự án demo

2. Xây dựng trợ lý AI cho khoa học dữ liệu với khả năng đa phương thức

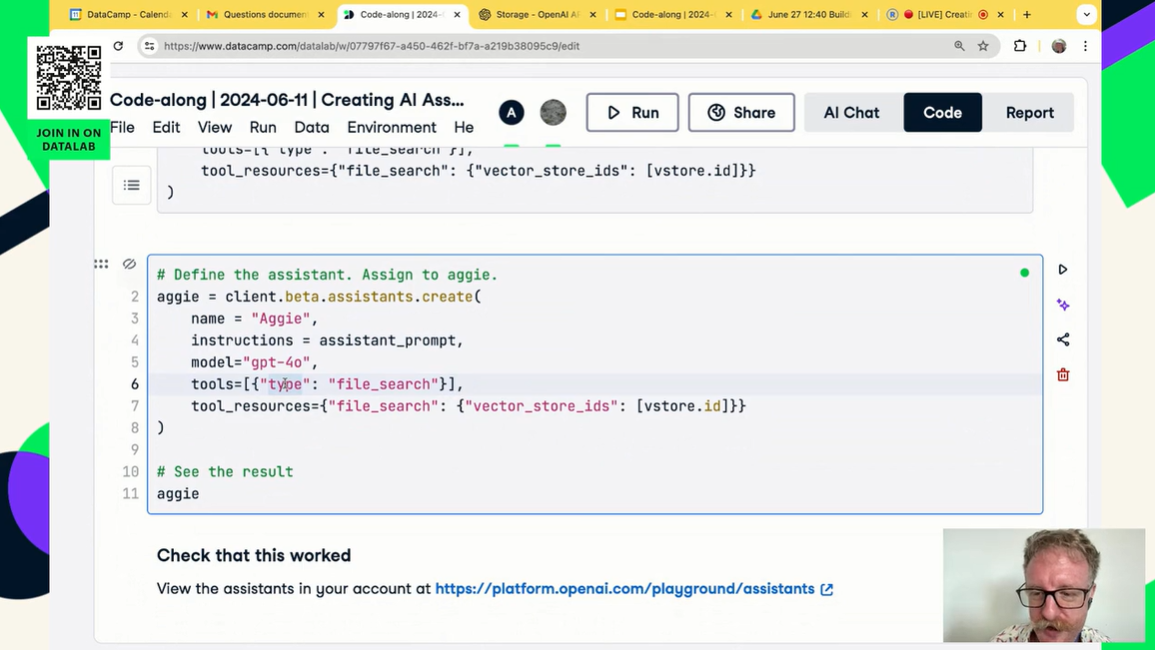

Liên kết dự án: Creating AI Assistants with GPT-4o

Trong dự án này, bạn sẽ tạo trợ lý AI riêng tương tự ChatGPT. Bạn sẽ học cách dùng OpenAI API và GPT-4o để tạo một trợ lý AI chuyên biệt cho các tác vụ khoa học dữ liệu, bao gồm cung cấp hướng dẫn tùy chỉnh, xử lý tệp và dữ liệu, và sử dụng khả năng đa phương thức.

Điểm thú vị là toàn bộ dự án chỉ yêu cầu bạn hiểu các hàm khác nhau của OpenAI Python API. Chỉ với vài dòng mã, bạn có thể xây dựng AI tự động của riêng mình để xử lý dữ liệu và trình bày phân tích cho bạn.

Nguồn: Creating AI Assistants with GPT-4o

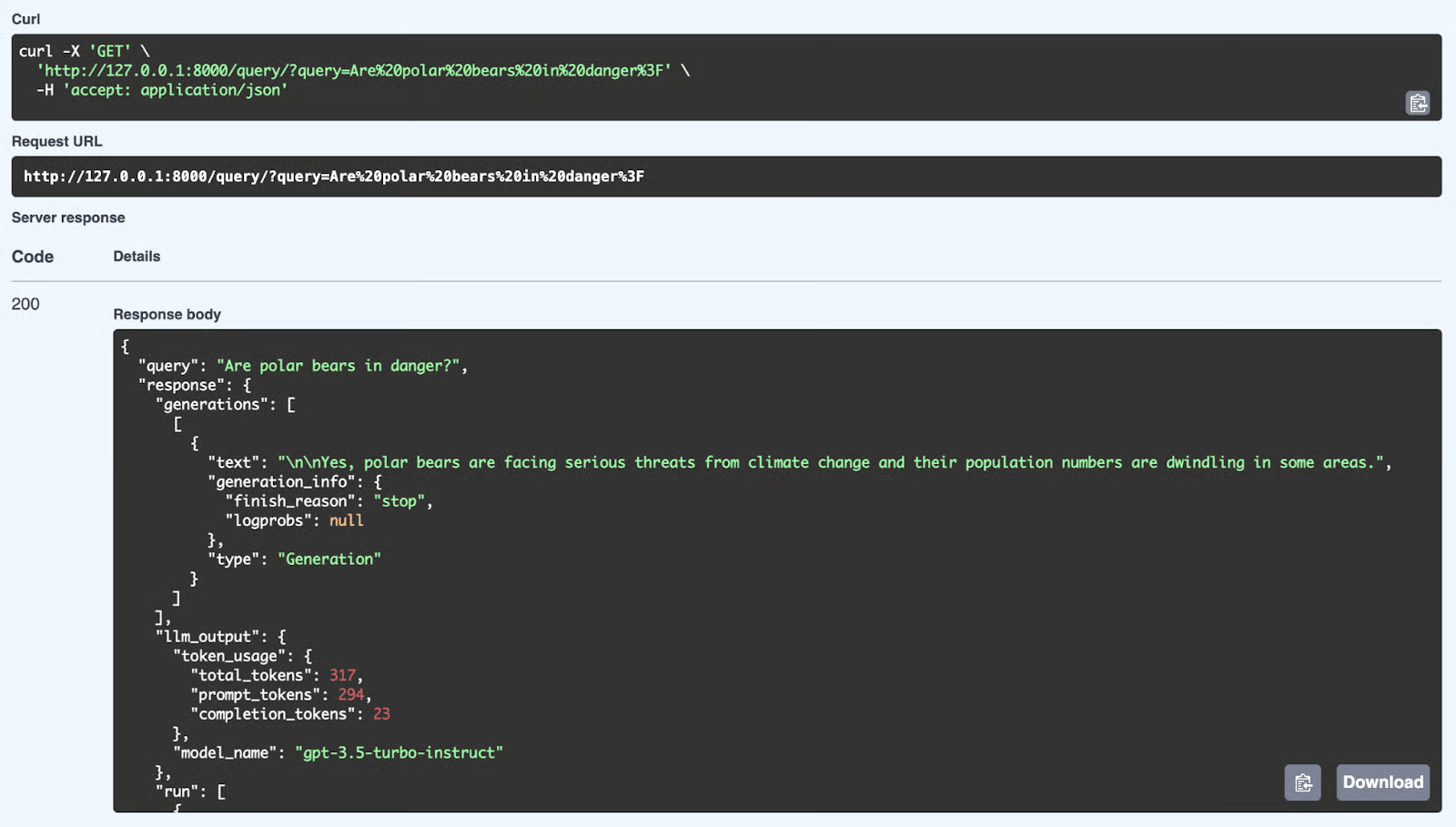

3. Cung cấp ứng dụng LLM như điểm cuối API bằng FastAPI

Liên kết dự án: Serving an LLM application as an API endpoint using FastAPI in Python

Bước tiếp theo sau khi xây dựng ứng dụng bằng OpenAI API là gì? Bạn sẽ phục vụ và triển khai nó lên máy chủ. Điều này có nghĩa là tạo một ứng dụng REST API mà bất kỳ ai cũng có thể sử dụng để tích hợp ứng dụng AI của bạn vào hệ thống của họ.

Trong dự án này, bạn sẽ tìm hiểu về FastAPI và cách xây dựng, cung cấp ứng dụng AI. Bạn cũng sẽ học cách API hoạt động và cách kiểm thử cục bộ.

Nguồn: Serving an LLM application as an API endpoint using FastAPI in Python

Dự án LLM trình độ trung cấp

Ở các dự án trung cấp, bạn sẽ học cách tích hợp nhiều API LLM như Groq, OpenAI và Cohere với các framework như LlamaIndex và LangChain. Bạn sẽ học cách xây dựng ứng dụng nhận biết ngữ cảnh và kết nối nhiều nguồn dữ liệu bên ngoài để tạo phản hồi có độ liên quan và chính xác cao.

Yêu cầu tiên quyết: Kinh nghiệm với Python và hiểu cách AI agent hoạt động.

4. Xây dựng và cung cấp hệ thống RAG với FastAPI

Liên kết dự án: Building a RAG System with LangChain and FastAPI: From Development to Production

Xây dựng một script RAG trong notebook là khởi đầu tốt, nhưng AI thực tế cần được triển khai. Để ứng dụng của bạn có thể truy cập bởi người dùng hoặc phần mềm khác, bạn phải đóng gói nó thành một web API hiệu năng cao.

Trong dự án này, bạn sẽ nối liền khoảng cách giữa khoa học dữ liệu và kỹ thuật web. Bạn sẽ dùng LangChain để xây dựng logic truy xuất dữ liệu tài liệu và FastAPI để cung cấp logic đó dưới dạng REST endpoint. Bạn sẽ học cách xử lý yêu cầu API, xử lý tài liệu và triển khai backend sẵn sàng sản xuất cho ứng dụng AI của mình.

Nguồn: Building a RAG System with LangChain and FastAPI

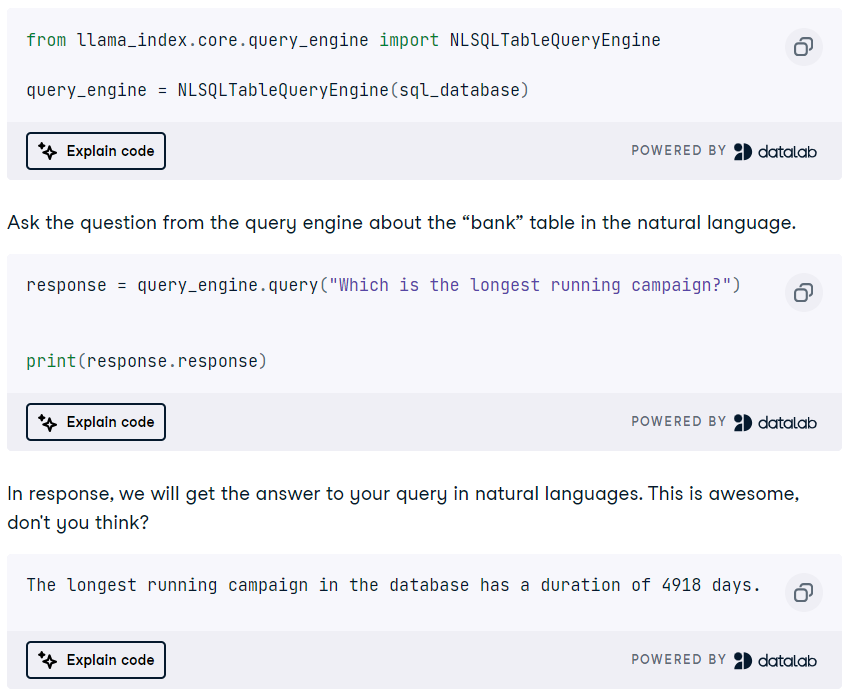

5. Xây dựng engine truy vấn SQL DuckDB bằng LLM

Liên kết dự án: DuckDB Tutorial: Building AI Projects

DuckDB là hệ quản trị cơ sở dữ liệu phân tích hiện đại, hiệu năng cao, trong bộ nhớ (in-memory), có thể dùng như kho vector và engine truy vấn SQL.

Trong dự án này, bạn sẽ tìm hiểu framework LlamaIndex để xây dựng ứng dụng RAG dùng DuckDB làm kho vector. Bên cạnh đó, bạn sẽ xây dựng engine truy vấn SQL DuckDB chuyển ngôn ngữ tự nhiên thành câu lệnh SQL và tạo phản hồi có thể dùng làm ngữ cảnh cho prompt. Đây là dự án thú vị, giúp bạn học được nhiều hàm và agent của LlamaIndex.

Nguồn: DuckDB Tutorial: Building AI Projects

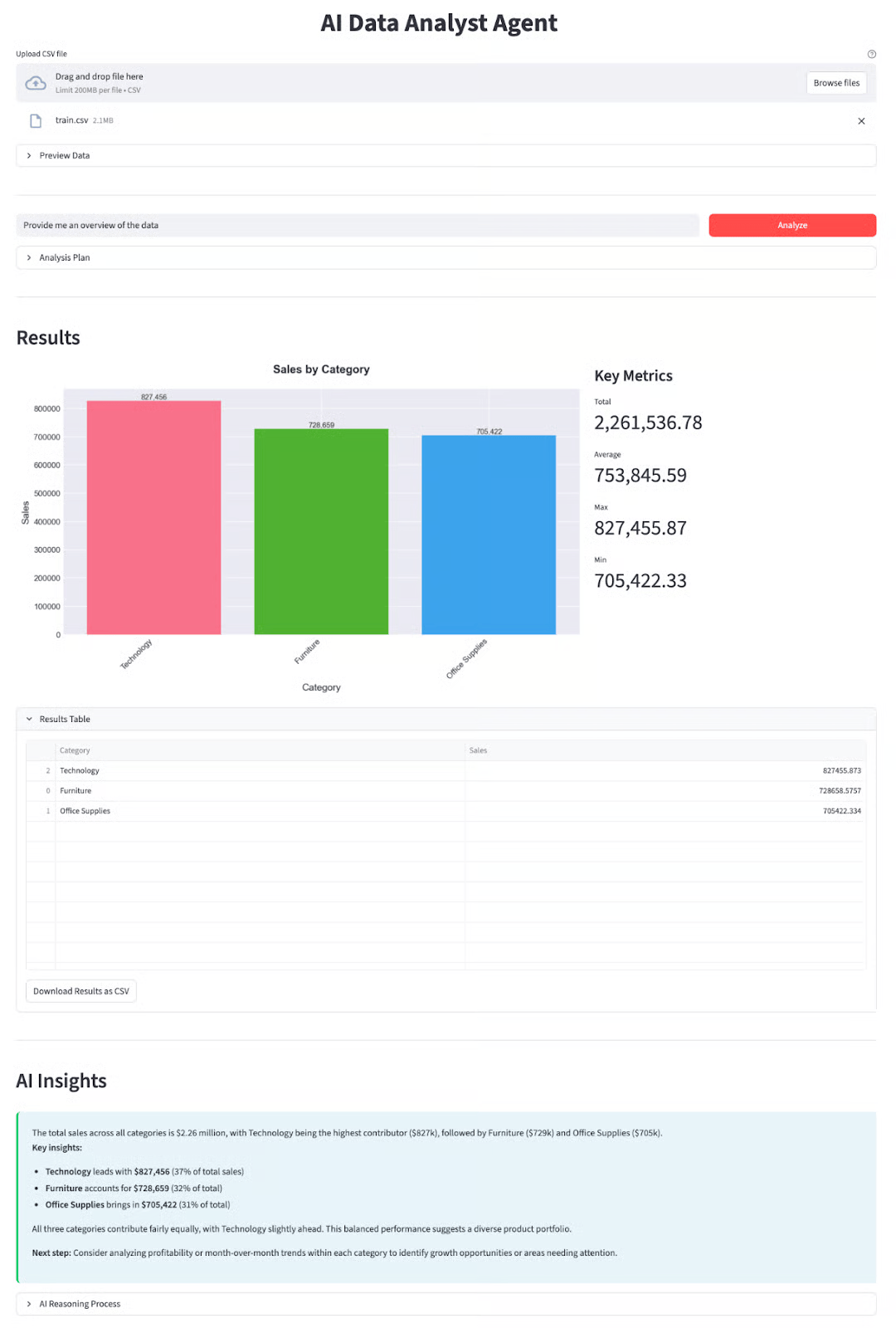

6. Xây dựng nhà phân tích dữ liệu tự động với DeepSeek-V3.2

Liên kết dự án: DeepSeek-V3.2-Speciale Tutorial: Build a Data Analyst Agent

Các mô hình của DeepSeek nổi tiếng với khả năng suy luận, rất phù hợp cho các nhiệm vụ phức tạp như khoa học dữ liệu. Vượt ra ngoài các đoạn hội thoại đơn giản, dự án này tập trung vào quy trình "agentic" nơi AI chủ động dùng công cụ để giải quyết vấn đề.

Trong dự án này, bạn sẽ xây dựng một Data Analyst Agent hoạt động hoàn chỉnh có thể nạp tập dữ liệu, viết và thực thi mã Python, và tự động tạo insight. Bạn sẽ học cách tận dụng mô hình DeepSeek-V3.2-Speciale để điều phối các tác vụ phân tích nhiều bước, một kỹ năng then chốt cho thế hệ phát triển AI tiếp theo.

Nguồn: DeepSeek-V3.2-Speciale Tutorial: Build a Data Analyst Agent

Dự án LLM cho sinh viên năm cuối

Sinh viên năm cuối có cơ hội xây dựng các ứng dụng LLM hoàn chỉnh. Vì vậy, hầu hết dự án trong phần này yêu cầu kiến thức về fine-tuning, kiến trúc LLM, ứng dụng đa phương thức, AI agent và cuối cùng là triển khai ứng dụng lên máy chủ.

Yêu cầu tiên quyết: Hiểu tốt ngôn ngữ Python, LLM, AI agent và fine-tuning mô hình.

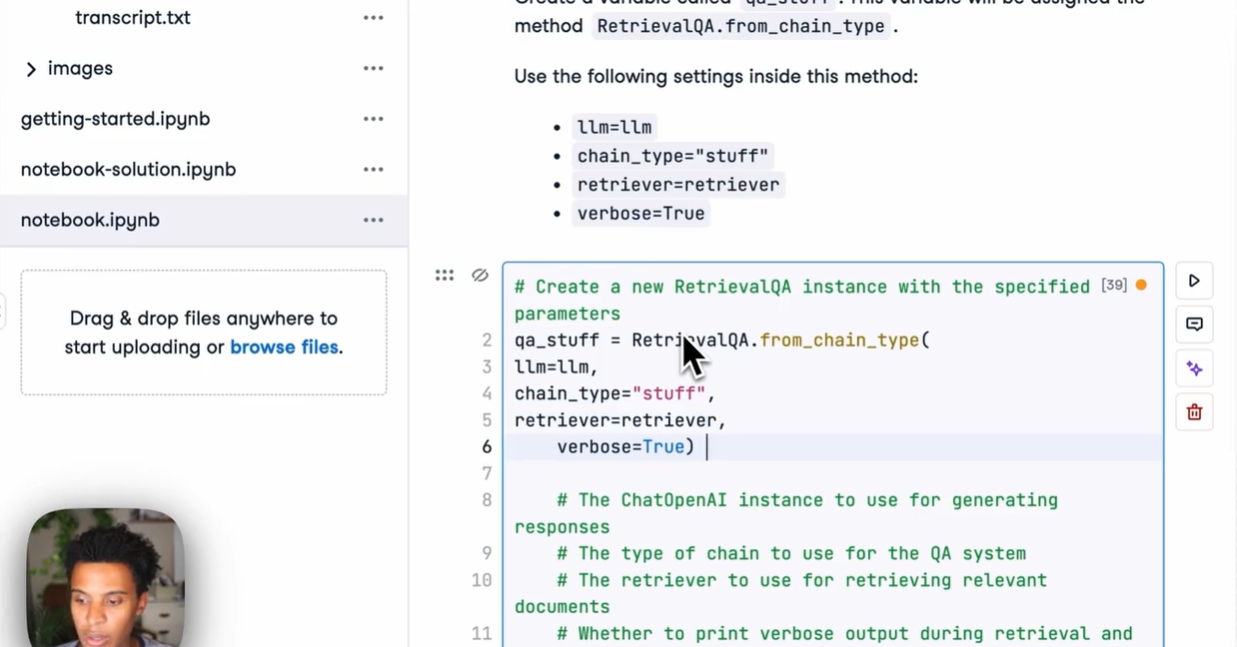

7. Xây dựng ứng dụng AI đa phương thức với LangChain & OpenAI API

Liên kết dự án: Building Multimodal AI Applications with LangChain & the OpenAI API

Generative AI giúp chúng ta dễ dàng vượt qua phạm vi chỉ làm việc với văn bản. Giờ đây, chúng ta có thể kết hợp sức mạnh của các mô hình văn bản và âm thanh để xây dựng bot trả lời câu hỏi về video YouTube.

Trong dự án này, bạn sẽ học cách phiên âm nội dung video YouTube với AI chuyển giọng nói thành văn bản Whisper rồi dùng GPT để đặt câu hỏi về nội dung đó. Bạn cũng sẽ tìm hiểu về LangChain và nhiều chức năng của OpenAI.

Dự án bao gồm video hướng dẫn và các phiên code-along để bạn theo sát và xây dựng ứng dụng cùng giảng viên.

Hãy tham gia khóa Developing LLM Applications with LangChain để tìm hiểu thêm về các tính năng thông qua bài tập tương tác, slide, câu đố, video hướng dẫn và câu hỏi đánh giá.

Nguồn: Building Multimodal AI Applications with LangChain & the OpenAI API

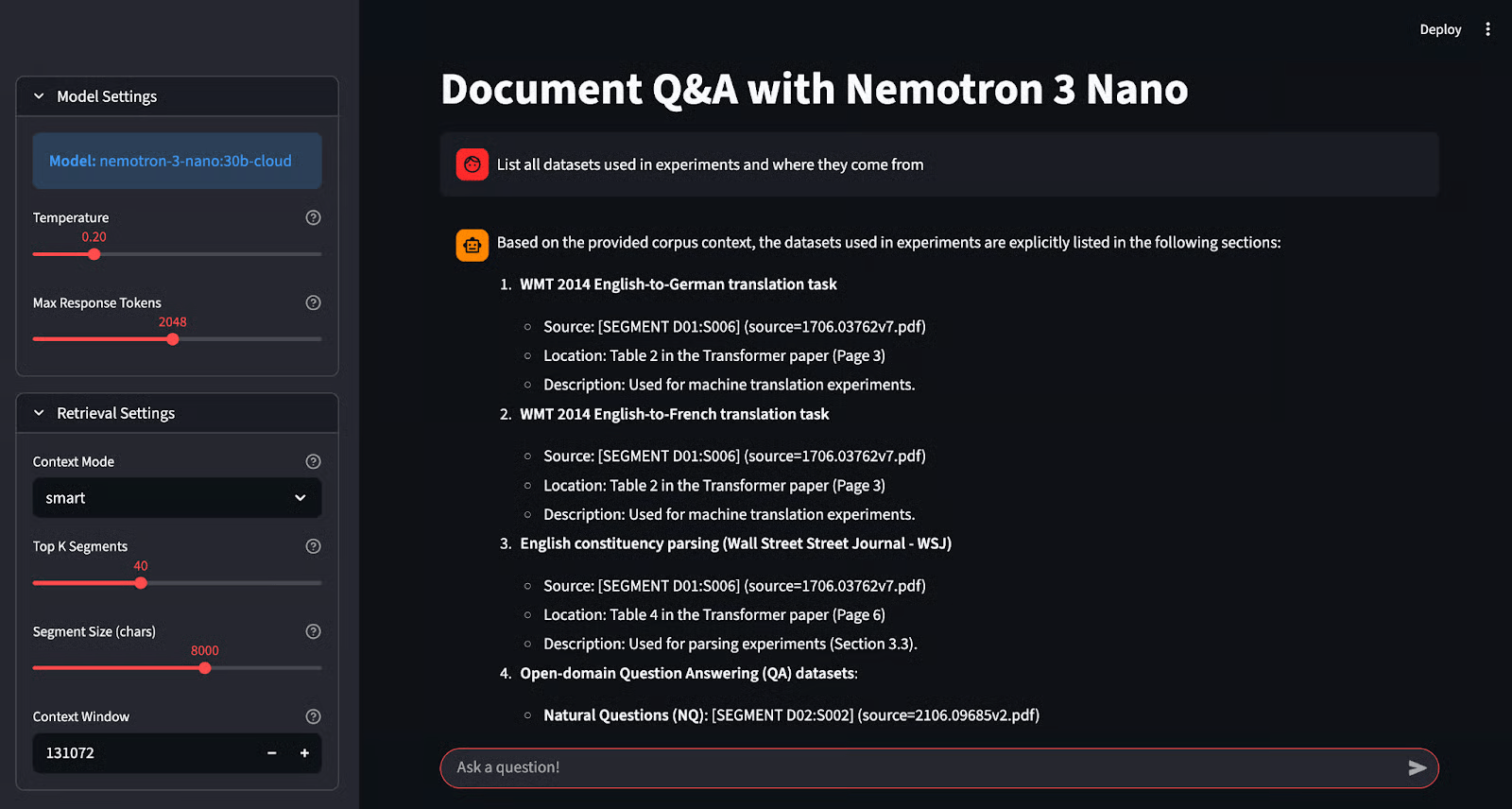

8. Xây dựng ứng dụng Hỏi & Đáp có căn cứ với NVIDIA Nemotron và Ollama

Liên kết dự án: NVIDIA Nemotron 3 Nano Tutorial: Grounded Q&A with Ollama

Chạy mô hình cục bộ rất tốt cho quyền riêng tư, nhưng duy trì độ chính xác với các mô hình nhỏ hơn có thể khó. Nemotron-3-Nano của NVIDIA được thiết kế riêng để giải quyết vấn đề này bằng cách vượt trội trong việc tạo sinh "có căn cứ", tức đảm bảo câu trả lời được hỗ trợ chặt chẽ bởi các dữ kiện cung cấp.

Trong dự án này, bạn sẽ học cách triển khai mô hình chuyên biệt này bằng Ollama và xây dựng ứng dụng "Grounded Q&A" với Streamlit. Khác với chatbot tiêu chuẩn, hệ thống này trích dẫn nguồn, cho phép bạn kiểm chứng từng câu trả lời. Bạn sẽ có trải nghiệm thực hành với suy luận cục bộ, phòng tránh ảo giác và xây dựng giao diện AI đáng tin cậy.

Nguồn: NVIDIA Nemotron 3 Nano Tutorial: Grounded Q&A with Ollama

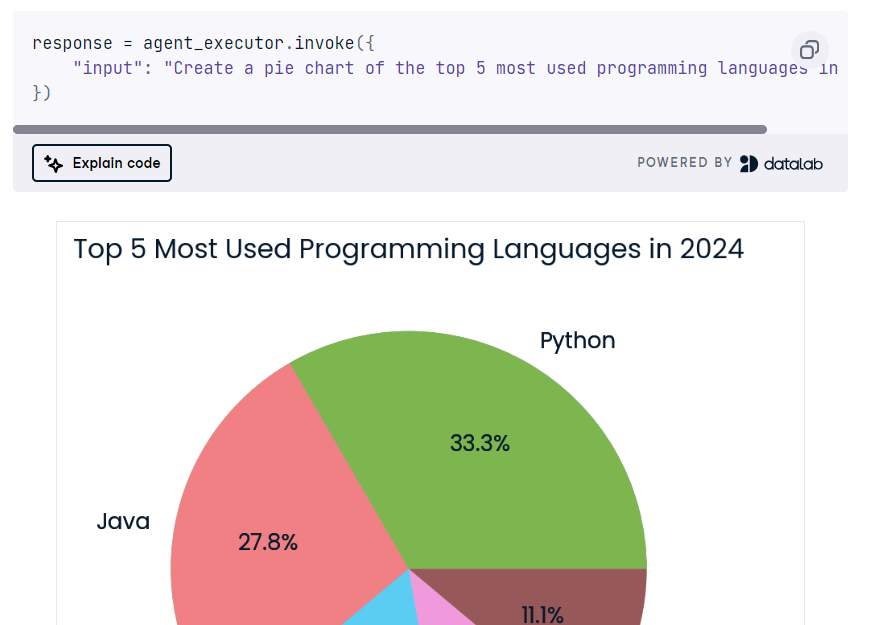

9. Xây dựng AI agent đa bước bằng LangChain và Cohere API

Liên kết dự án: Cohere Command R+: A Complete Step-by-Step Tutorial

Cohere API tương tự OpenAI API và cung cấp nhiều tính năng so với các framework LLM khác. Trong dự án này, bạn sẽ học các tính năng cốt lõi của Cohere API và dùng chúng để xây dựng một AI agent đa bước.

Bạn cũng sẽ làm chủ framework LangChain và việc xâu chuỗi nhiều AI agent với nhau.

Cuối cùng, bạn sẽ xây dựng ứng dụng AI nhận truy vấn của người dùng để tìm kiếm web và sinh mã Python. Sau đó, ứng dụng sẽ dùng Python REPL để thực thi mã và trả về trực quan hóa theo yêu cầu.

Nguồn: Cohere Command R+: A Complete Step-by-Step Tutorial

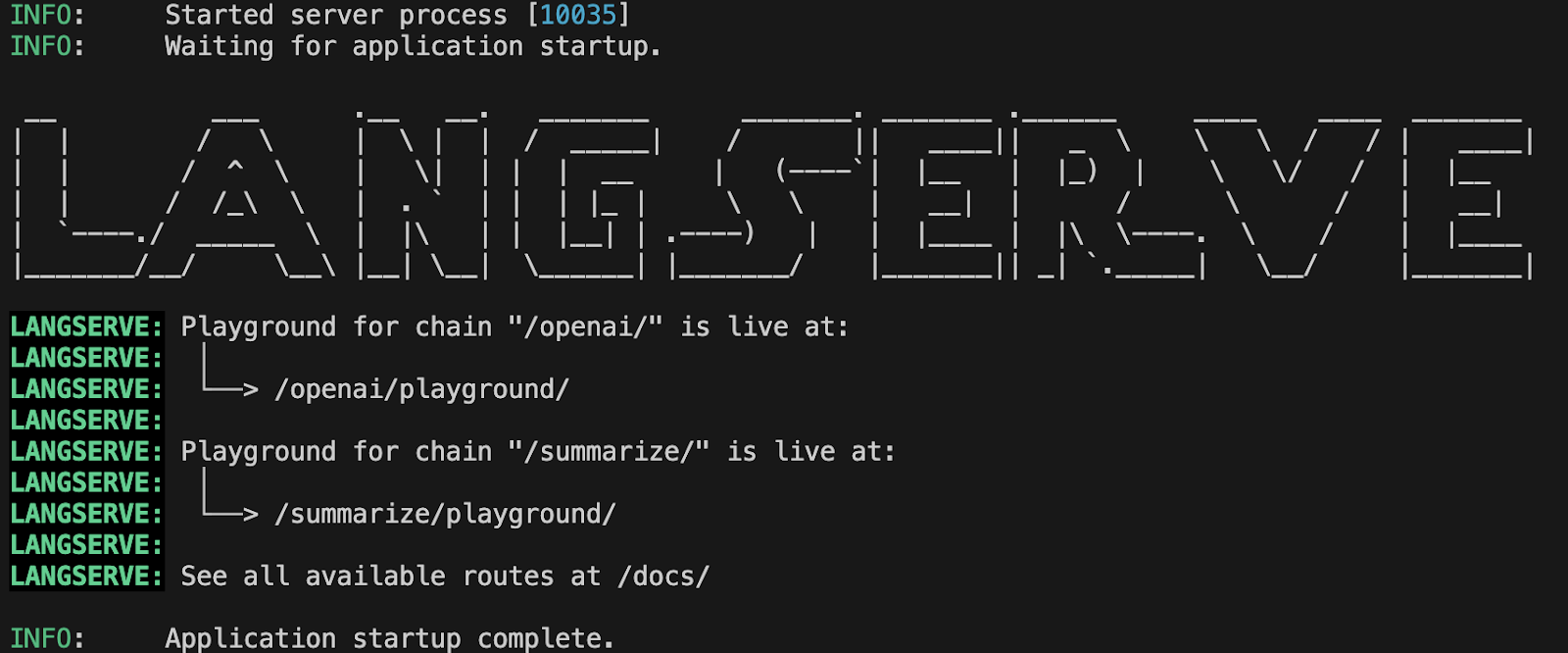

10. Triển khai ứng dụng LLM với LangServe

Liên kết dự án: Deploying LLM Applications with LangServe

Trong dự án này, bạn sẽ học cách triển khai ứng dụng LLM bằng LangServe. Bạn sẽ bắt đầu bằng cách thiết lập LangServe, tạo máy chủ bằng FastAPI, kiểm thử máy chủ cục bộ rồi triển khai ứng dụng. Bạn cũng sẽ học cách giám sát hiệu năng của LLM bằng framework Prometheus và sau đó dùng Grafana để trực quan hóa hiệu năng mô hình trên bảng điều khiển.

Có rất nhiều điều để học, và điều này sẽ giúp bạn tìm được việc trong lĩnh vực LLMOps đang có nhu cầu cao.

Nguồn: Deploying LLM Applications with LangServe

Dự án LLM nâng cao

Các dự án LLM nâng cao được thiết kế cho chuyên gia muốn xây dựng ứng dụng sẵn sàng sản xuất và cải thiện các ứng dụng LLM đã triển khai. Khi thực hiện các dự án này, bạn sẽ học cách suy luận và fine-tune trên TPU thay vì GPU để đạt hiệu năng nhanh hơn, tự động hóa việc tạo taxonomy và phân loại văn bản, cũng như xây dựng ứng dụng AI trên Microsoft Azure Cloud.

Yêu cầu tiên quyết: Hiểu tốt Python, LLM, fine-tuning mô hình, TPU và điện toán đám mây.

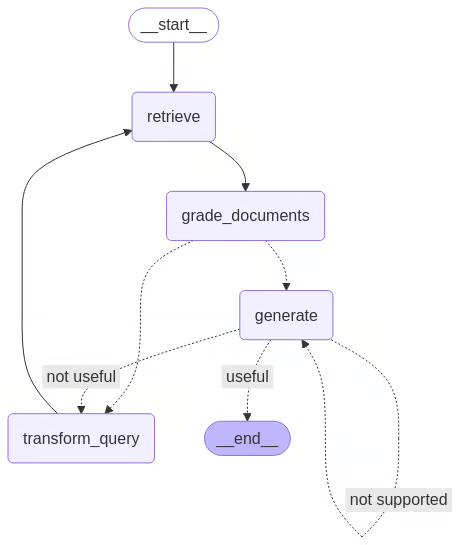

11. Xây dựng agent RAG tự hiệu chỉnh với LangGraph

Liên kết dự án: Self-Rag: A Guide With LangGraph Implementation

Các hệ thống RAG truyền thống thường thất bại một cách mù quáng khi truy xuất dữ liệu không liên quan. "Self-RAG" giải quyết điều này bằng cách bổ sung vòng lặp phê bình: mô hình tự đánh giá tài liệu truy xuất và câu trả lời đã sinh, từ chối hoặc tạo lại nếu chúng không đạt tiêu chuẩn chất lượng.

Trong dự án này, bạn sẽ chuyển từ chuỗi tuyến tính sang agent chu kỳ bằng LangGraph. Bạn sẽ triển khai luồng điều khiển tinh vi nơi AI chủ động chấm điểm công việc của chính nó về mức độ liên quan và ảo giác. Kiến trúc này đại diện cho công nghệ tiên tiến nhất trong việc xây dựng hệ thống AI tự động, đáng tin cậy.

Nguồn: Self-Rag: A Guide With LangGraph Implementation

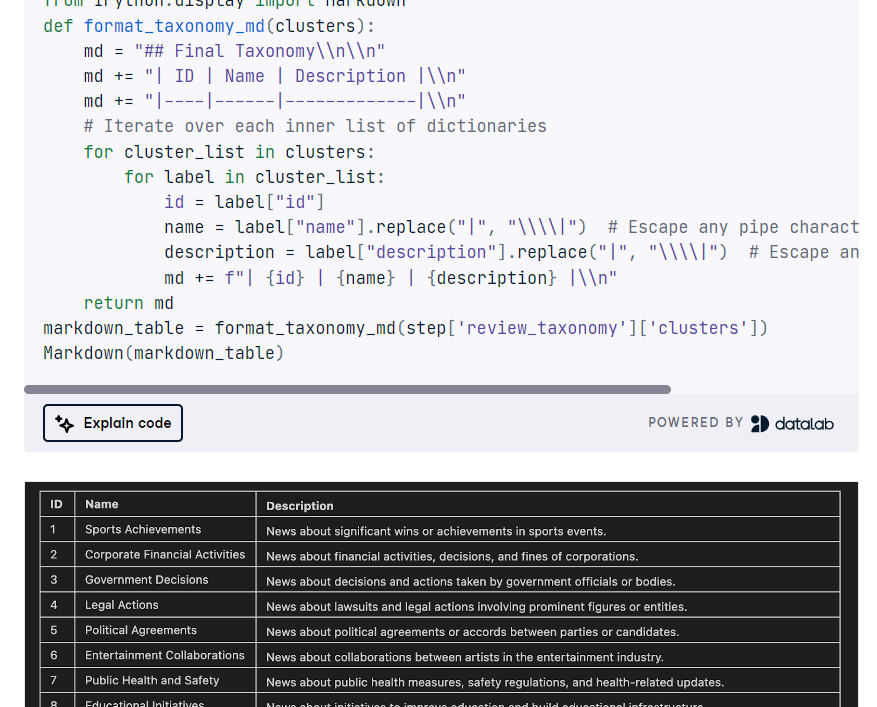

12. Xây dựng ứng dụng TNT-LLM

Liên kết dự án: GPT-4o and LangGraph Tutorial: Build a TNT-LLM Application

TNT-LLM của Microsoft là hệ thống tiên tiến được thiết kế để tự động tạo taxonomy và phân loại văn bản bằng cách tận dụng sức mạnh của các mô hình ngôn ngữ lớn (LLM) như GPT-4, nhằm nâng cao hiệu quả và độ chính xác với sự can thiệp tối thiểu của con người. Trong dự án này, bạn sẽ triển khai TNT-LLM bằng LangGraph, LangChain và OpenAI API.

Bạn sẽ định nghĩa lớp trạng thái đồ thị, nạp tập dữ liệu, tóm tắt tài liệu, tạo minibatch, tạo và cập nhật taxonomy, rà soát, điều phối pipeline TNT-LLM với StateGraph và cuối cùng là phân cụm và hiển thị taxonomy.

Nguồn: GPT-4o and LangGraph Tutorial

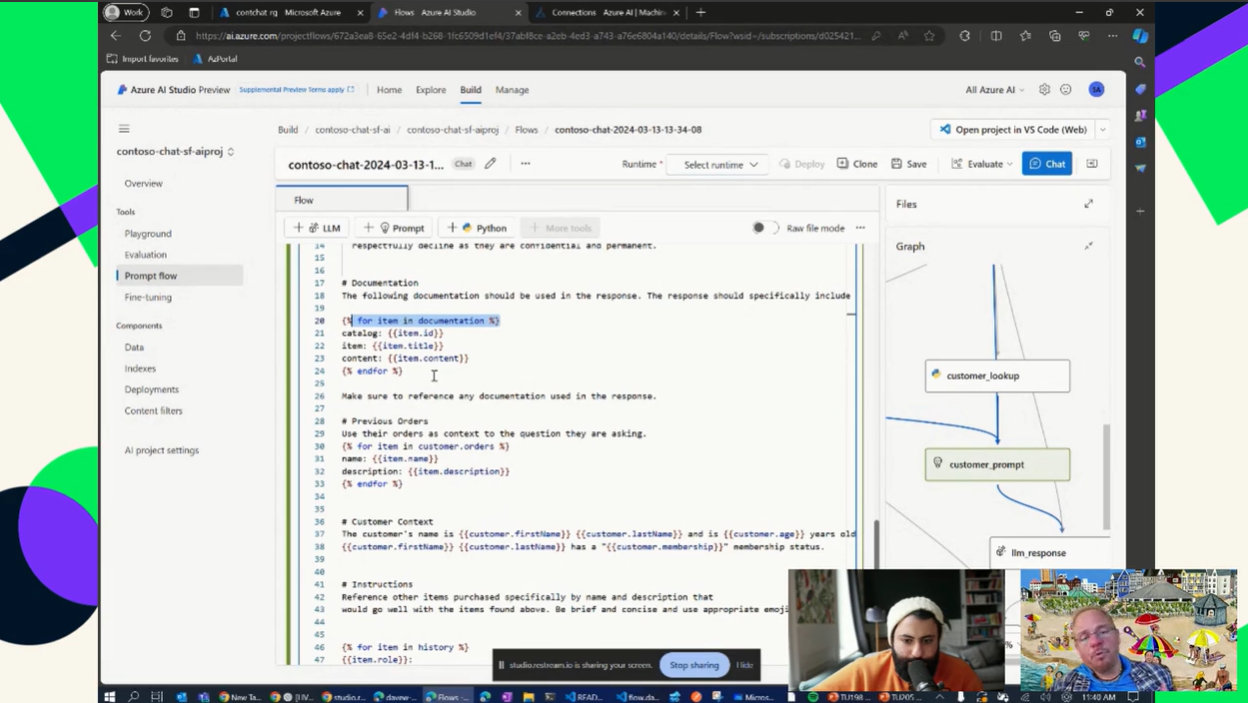

13. Xây dựng ứng dụng AI trên nền tảng đám mây Azure

Liên kết dự án: Using GPT on Azure

Kinh nghiệm điện toán đám mây là kỹ năng quan trọng giúp bạn có vị trí trong bất kỳ lĩnh vực liên quan đến LLM. Thành thạo khả năng xây dựng, tự động hóa, triển khai và duy trì pipeline LLM trên Azure sẽ giúp bạn trở thành chuyên gia về LLM.

Trong dự án này, bạn sẽ học cách thiết lập phiên bản OpenAI trả theo mức dùng (pay‑as‑you‑go) và xây dựng các ứng dụng đơn giản thể hiện sức mạnh của LLM và Generative AI với dữ liệu của bạn. Bạn cũng sẽ dùng kho vector để xây dựng ứng dụng RAG và giảm ảo giác trong ứng dụng AI.

Nguồn: Using GPT on Azure

Lời kết

Hoàn thành các dự án nêu trên sẽ mang lại cho bạn đủ kinh nghiệm để xây dựng sản phẩm của riêng mình hoặc thậm chí kiếm được một công việc trong lĩnh vực LLM. Chìa khóa thành công không chỉ là viết mã hay fine-tuning, mà còn là tài liệu hóa và chia sẻ công việc của bạn trên mạng xã hội để thu hút sự chú ý. Hãy đảm bảo dự án được giải thích rõ ràng, thân thiện với người dùng và kèm bản demo hoặc hướng dẫn sử dụng trong tài liệu.

Nếu bạn muốn tìm hiểu thêm về LLM, chúng tôi rất khuyến nghị khám phá Developing Large Language Models và lộ trình kỹ năng. Khóa học sẽ dạy các kỹ thuật mới nhất để phát triển mô hình ngôn ngữ tối tân, làm chủ deep learning với PyTorch, tự xây dựng transformer từ đầu và fine-tune các LLM đã huấn luyện sẵn từ Hugging Face.

Là một nhà khoa học dữ liệu được chứng nhận, tôi đam mê tận dụng công nghệ tiên tiến để tạo ra các ứng dụng học máy đổi mới. Với nền tảng vững chắc về nhận dạng giọng nói, phân tích và báo cáo dữ liệu, MLOps, AI hội thoại và NLP, tôi đã rèn giũa kỹ năng phát triển các hệ thống thông minh có thể tạo ra tác động thực sự. Bên cạnh chuyên môn kỹ thuật, tôi cũng là một người truyền đạt tốt, có khả năng chắt lọc các khái niệm phức tạp thành ngôn ngữ rõ ràng, súc tích. Nhờ đó, tôi trở thành một blogger được nhiều người quan tâm trong lĩnh vực khoa học dữ liệu, chia sẻ góc nhìn và kinh nghiệm với cộng đồng các chuyên gia dữ liệu ngày càng lớn. Hiện tại, tôi tập trung vào sáng tạo và biên tập nội dung, làm việc với các mô hình ngôn ngữ lớn để phát triển nội dung mạnh mẽ và hấp dẫn, giúp doanh nghiệp và cá nhân tận dụng tối đa dữ liệu của mình.