Programma

Imparare costruendo progetti è il modo migliore per approfondire la tua comprensione e le competenze pratiche nel campo dei Large Language Models (LLM) e dell'AI. Lavorando su progetti, acquisirai conoscenze su nuovi strumenti, tecniche e modelli che possono ottimizzare le tue applicazioni e permetterti di creare applicazioni AI estremamente accurate e veloci.

Risolvere i problemi di questi progetti ti offrirà un'esperienza preziosa, aumenterà le tue possibilità di ottenere il lavoro dei tuoi sogni e ti permetterà di guadagnare entrate extra monetizzando i tuoi progetti e creando un prodotto commercializzabile.

In questo blog, esploreremo progetti LLM pensati per principianti, livelli intermedi, studenti dell'ultimo anno ed esperti. Ogni progetto include una guida e materiali di riferimento per studiare e replicare i risultati.

Se sei nuovo agli LLM, completa prima il percorso di competenze AI Fundamentals prima di passare ai progetti qui sotto. Ti aiuterà a ottenere conoscenze operative su temi popolari dell'AI come ChatGPT, large language models, generative AI e altro ancora.

Progetti LLM per principianti

Nei progetti per principianti imparerai a usare l'API di OpenAI, generare risposte, creare assistenti AI con capacità multimodali e pubblicare gli endpoint API della tua applicazione usando FastAPI.

Prerequisiti: è necessaria una conoscenza di base di Python.

1. Creare un tutor linguistico con Langflow

Link al progetto: Langflow: guida con progetto demo

Per molti principianti, la barriera più grande nella creazione di app AI è scrivere da zero complessi script Python. Langflow cambia le carte in tavola permettendoti di costruire potenti flussi di lavoro AI con un'interfaccia visiva drag-and-drop che si connette facilmente ai database standard.

In questo progetto creerai un'applicazione tutor linguistico senza dover essere un programmatore esperto. Userai Langflow per progettare visivamente un agente che genera brani di lettura in base all'elenco di vocaboli di un utente (archiviato in un database Postgres). È un'ottima introduzione all'AI "stateful" (app che ricordano i tuoi dati) mantenendo bassa la barriera tecnica.

Fonte: Langflow: guida con progetto demo

2. Creare un assistente AI per la data science con capacità multimodali

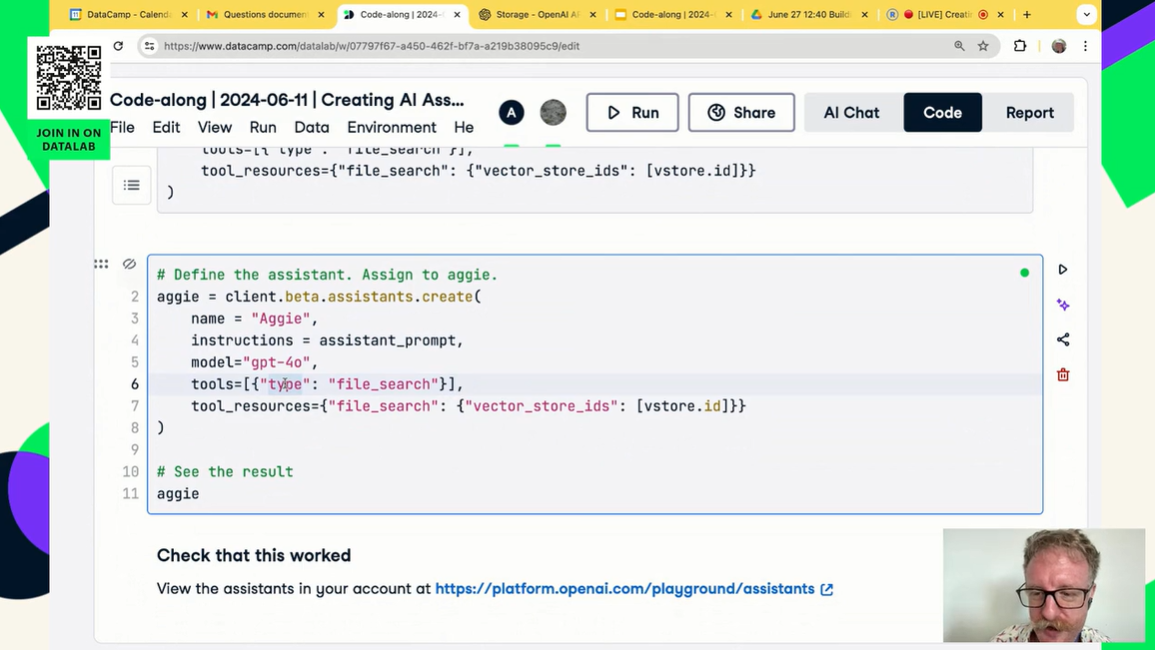

Link al progetto: Creare assistenti AI con GPT-4o

In questo progetto creerai il tuo assistente AI simile a ChatGPT. Imparerai a usare l'API di OpenAI e GPT-4o per creare un assistente AI specializzato per compiti di data science. Include istruzioni personalizzate, gestione di file e dati e l'uso di capacità multimodali.

La parte divertente è che l'intero progetto richiede solo di comprendere le varie funzioni dell'API Python di OpenAI. Con poche righe di codice puoi costruire una tua AI automatizzata che elaborerà i dati per te e ti presenterà l'analisi.

Fonte: Creare assistenti AI con GPT-4o

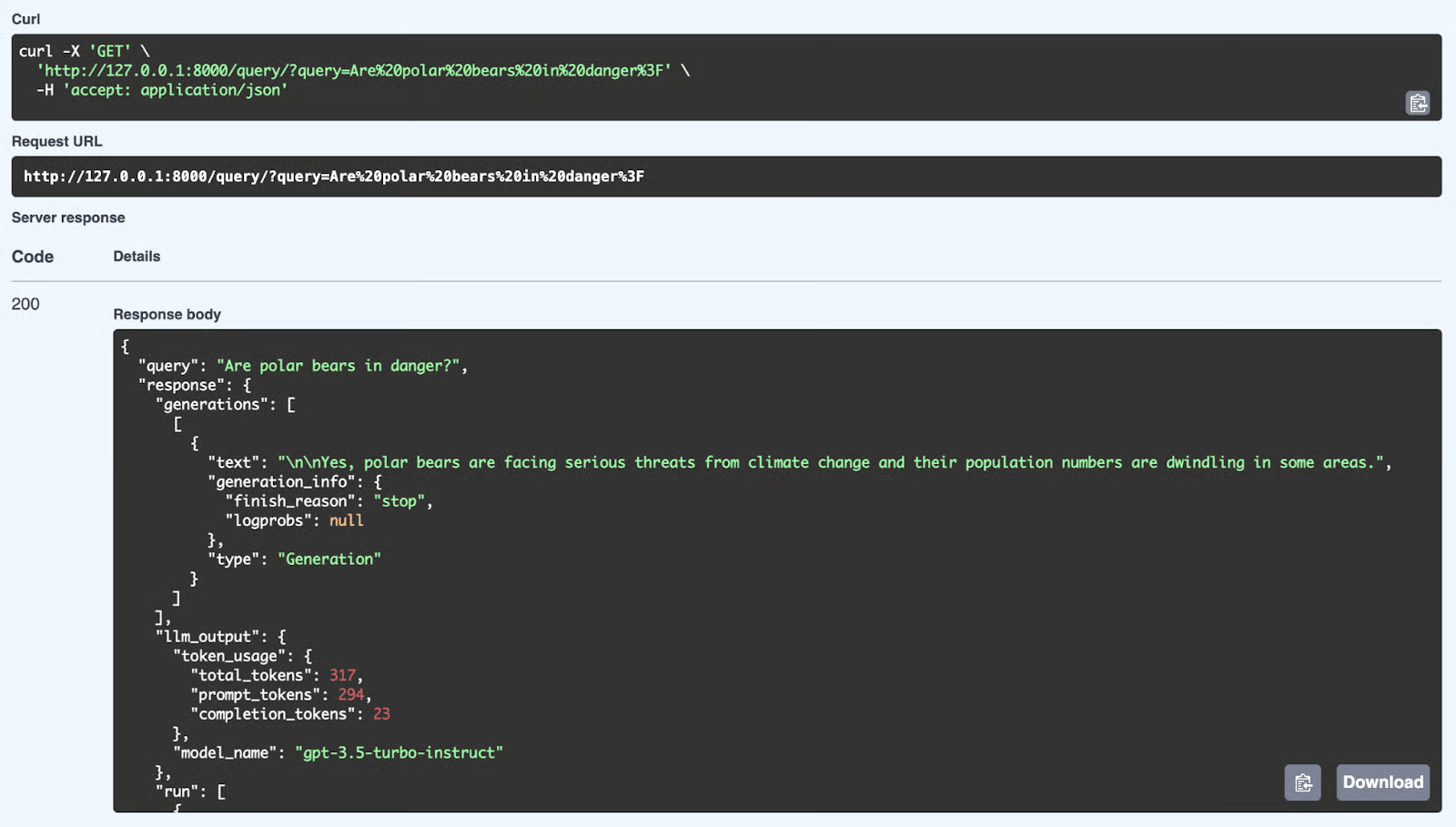

3. Pubblicare un'applicazione LLM come endpoint API usando FastAPI

Link al progetto: Pubblicare un'applicazione LLM come endpoint API usando FastAPI in Python

Qual è il passo successivo dopo aver creato la tua applicazione usando l'API di OpenAI? Servirla e distribuirla su un server. Ciò significa creare un'applicazione REST API che chiunque possa usare per integrare la tua applicazione AI nei propri sistemi.

In questo progetto imparerai a conoscere FastAPI e come creare e servire applicazioni AI. Imparerai anche come funziona un'API e come testarla in locale.

Fonte: Pubblicare un'applicazione LLM come endpoint API usando FastAPI in Python

Progetti LLM intermedi

Nei progetti LLM di livello intermedio imparerai a integrare varie API di LLM come Groq, OpenAI e Cohere con framework quali LlamaIndex e LangChain. Imparerai a creare applicazioni sensibili al contesto e a collegare più fonti esterne per generare risposte altamente pertinenti e accurate.

Prerequisiti: esperienza con Python e comprensione del funzionamento degli agenti AI.

4. Creare e pubblicare un sistema RAG con FastAPI

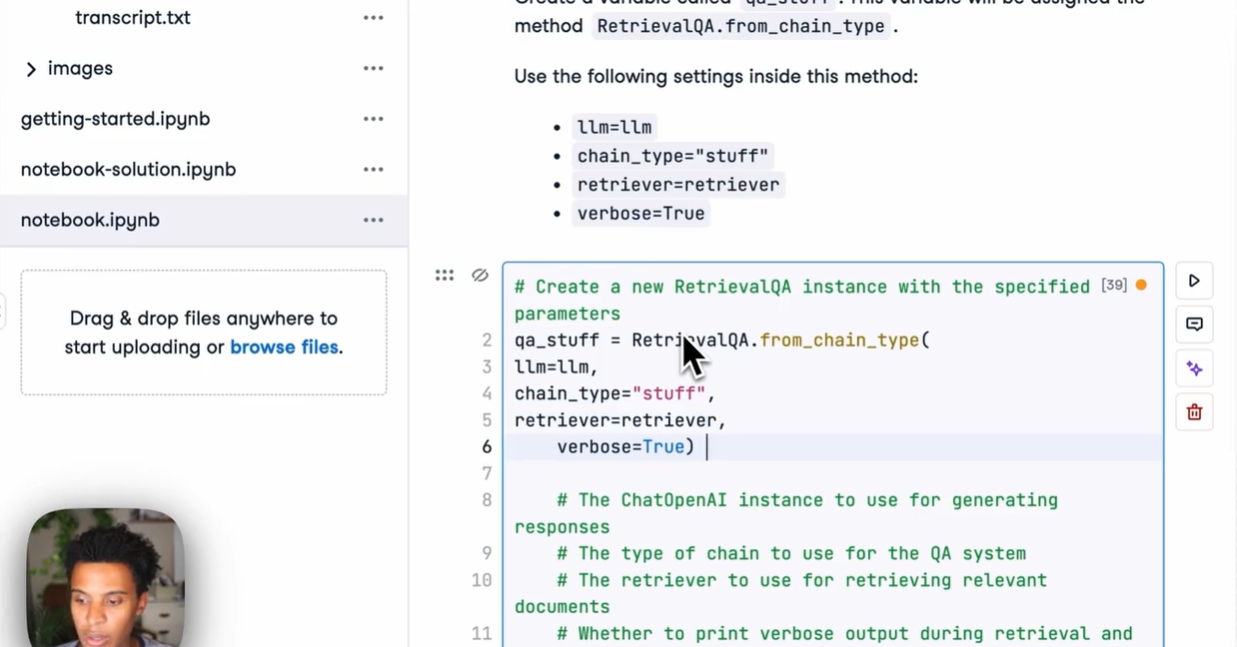

Link al progetto: Costruire un sistema RAG con LangChain e FastAPI: dallo sviluppo alla produzione

Scrivere uno script RAG in un notebook è un ottimo inizio, ma l'AI del mondo reale deve essere distribuita. Per rendere la tua applicazione accessibile agli utenti o ad altri software, devi incapsularla in una web API ad alte prestazioni.

In questo progetto colmerai il divario tra data science e ingegneria web. Userai LangChain per creare la logica di recupero dei documenti e FastAPI per servirla come endpoint REST. Imparerai a gestire richieste API, elaborare documenti e consegnare un backend pronto per la produzione per la tua applicazione AI.

Fonte: Costruire un sistema RAG con LangChain e FastAPI

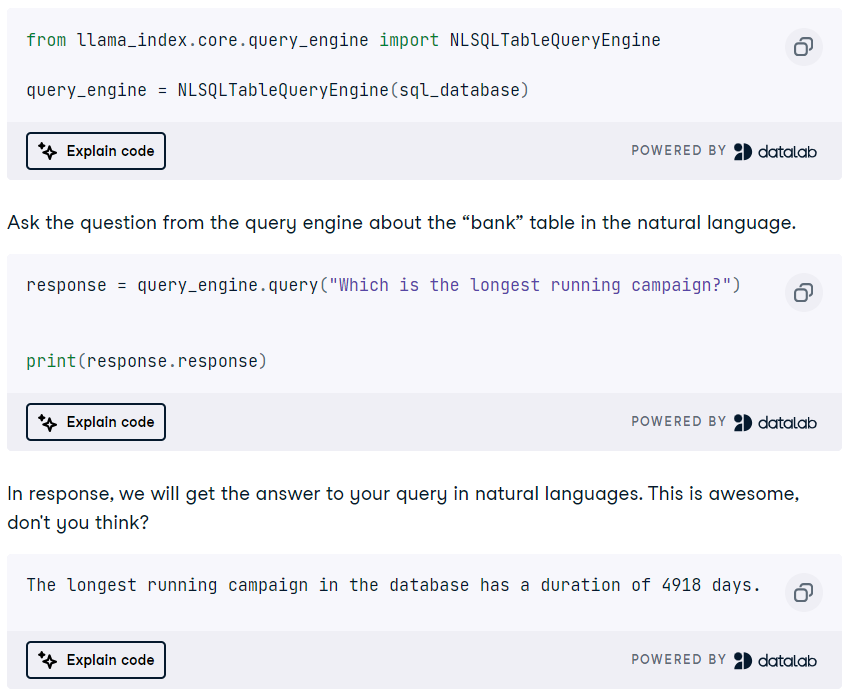

5. Creare un motore di query SQL DuckDB usando un LLM

Link al progetto: DuckDB Tutorial: costruire progetti AI

DuckDB è un moderno DBMS analitico in-memory ad alte prestazioni che può essere usato come archivio vettoriale e motore di query SQL.

In questo progetto imparerai a usare il framework LlamaIndex per costruire un'applicazione RAG usando DuckDB come archivio vettoriale. Inoltre, creerai un motore di query SQL DuckDB che converte il linguaggio naturale in query SQL e genera risposte da usare come contesto per il prompt. È un progetto divertente e imparerai molte funzioni e agenti di LlamaIndex.

Fonte: DuckDB Tutorial: costruire progetti AI

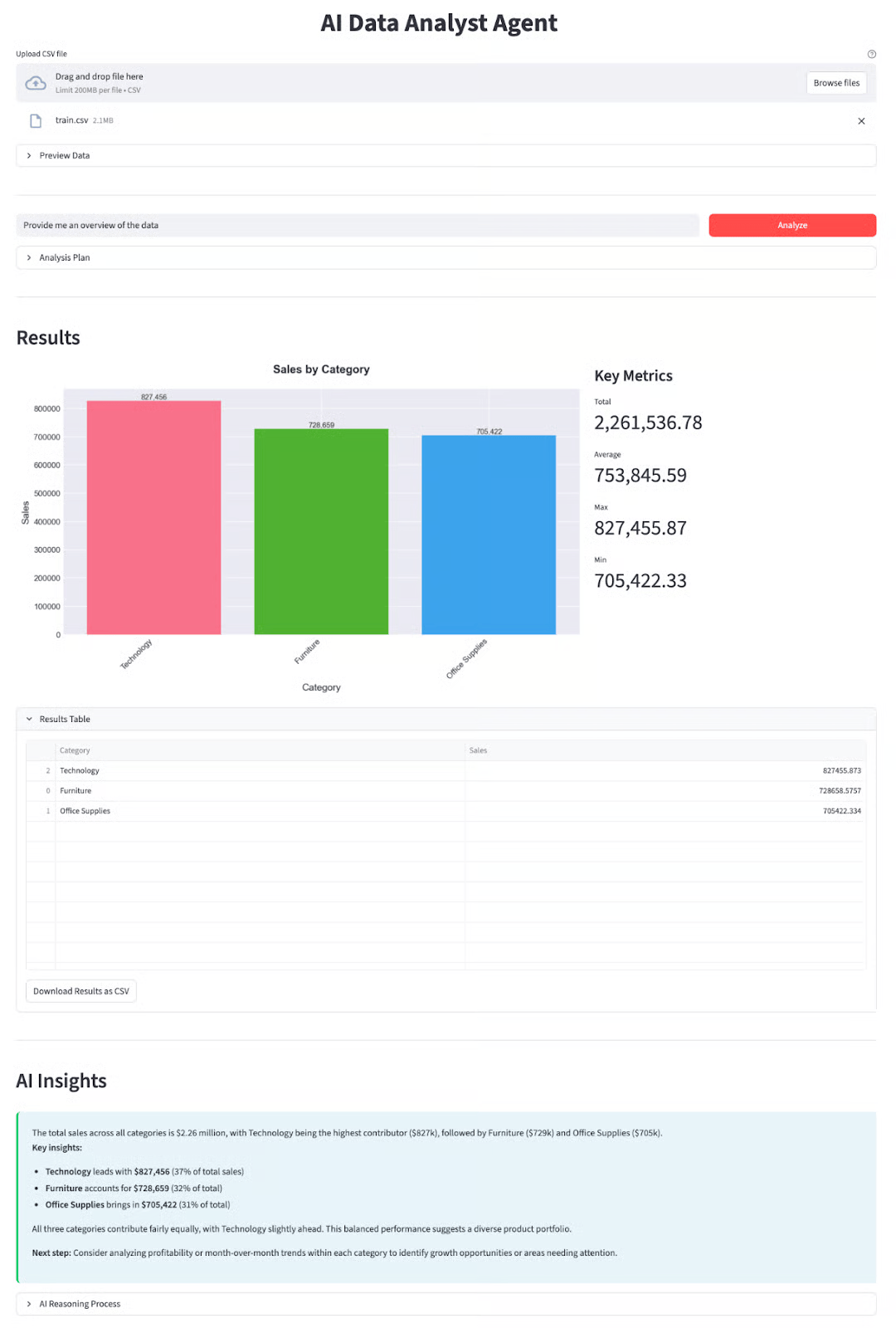

6. Creare un data analyst autonomo con DeepSeek-V3.2

Link al progetto: DeepSeek-V3.2-Speciale Tutorial: crea un agente Data Analyst

I modelli di DeepSeek sono diventati famosi per le loro capacità di ragionamento, rendendoli ideali per compiti complessi come la data science. Oltre le semplici chat, questo progetto si concentra su flussi di lavoro "agentici" in cui l'AI usa attivamente strumenti per risolvere problemi.

In questo progetto costruirai un agente Data Analyst funzionale in grado di acquisire dataset, scrivere ed eseguire codice Python e generare insight automaticamente. Imparerai a sfruttare il modello DeepSeek-V3.2-Speciale per orchestrare attività di analisi multi-step, una competenza cruciale per la prossima generazione di sviluppo AI.

Fonte: DeepSeek-V3.2-Speciale Tutorial: crea un agente Data Analyst

Progetti LLM per studenti dell'ultimo anno

Gli studenti dell'ultimo anno hanno l'opportunità di costruire vere applicazioni LLM. Pertanto, la maggior parte dei progetti in questa sezione richiede conoscenze su fine-tuning, architetture LLM, applicazioni multimodali, agenti AI e, infine, distribuzione dell'applicazione su un server.

Prerequisiti: ottima conoscenza del linguaggio Python, degli LLM, degli agenti AI e del fine-tuning dei modelli.

7. Creare applicazioni AI multimodali con LangChain e l'API di OpenAI

Link al progetto: Building Multimodal AI Applications with LangChain & the OpenAI API

La Generative AI rende facile andare oltre il semplice lavoro con il testo. Possiamo ora combinare la potenza di modelli AI per testo e audio per costruire un bot che risponde a domande sui video di YouTube.

In questo progetto imparerai a trascrivere i contenuti dei video YouTube con l'AI speech-to-text Whisper e poi usare GPT per porre domande sui contenuti. Imparerai anche LangChain e varie funzioni di OpenAI.

Il progetto include una guida video e sessioni di code-along da seguire per costruire l'applicazione insieme all'istruttore.

Segui il corso Developing LLM Applications with LangChain per approfondire le sue funzionalità con esercizi interattivi, slide, quiz, tutorial video e domande di valutazione.

Fonte: Building Multimodal AI Applications with LangChain & the OpenAI API

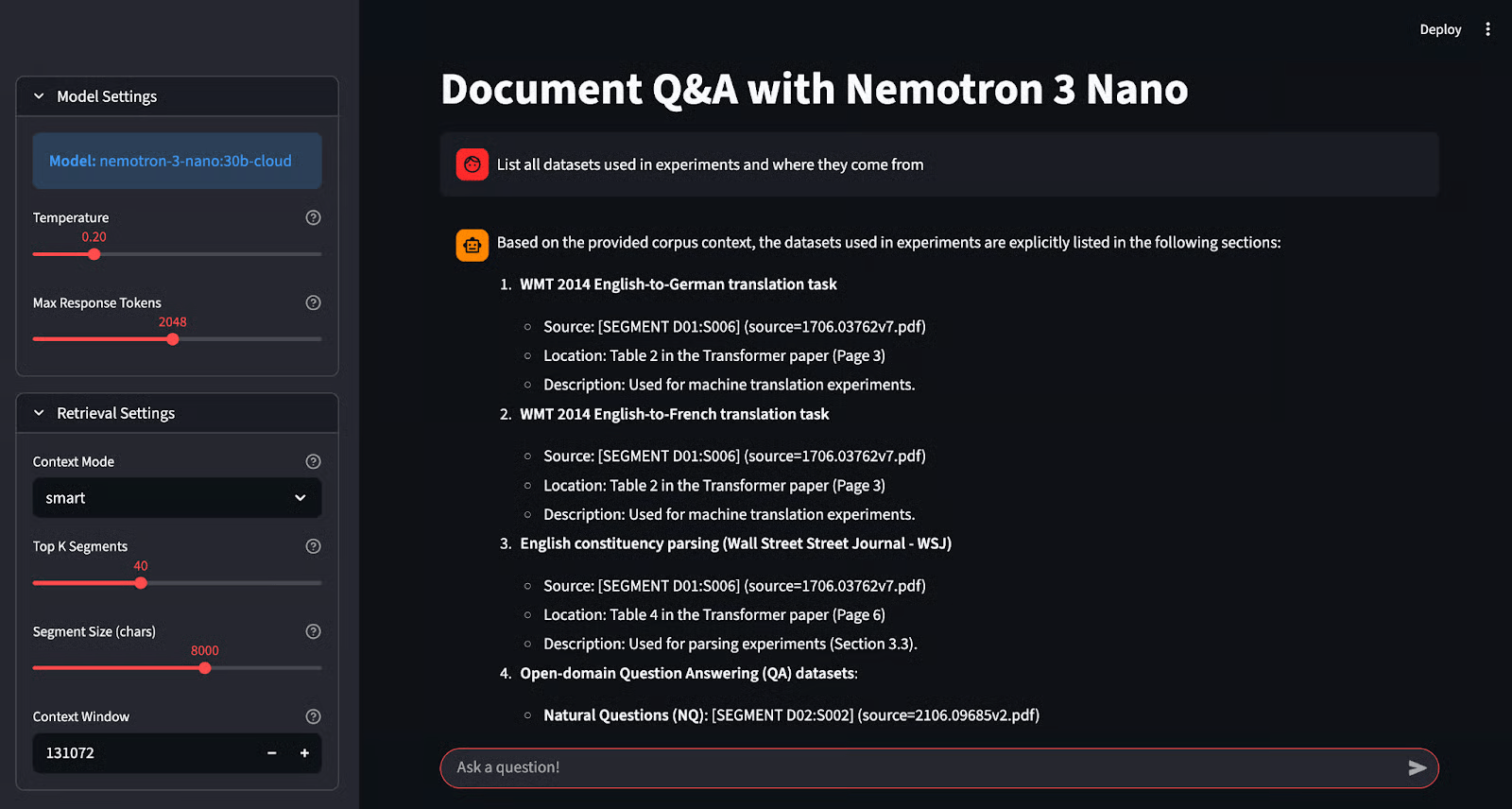

8. Creare un'app di Q&A grounded con NVIDIA Nemotron e Ollama

Link al progetto: NVIDIA Nemotron 3 Nano Tutorial: Grounded Q&A con Ollama

Eseguire i modelli in locale è ottimo per la privacy, ma mantenere l'accuratezza con modelli più piccoli può essere difficile. Nemotron-3-Nano di NVIDIA è progettato proprio per risolvere questo problema eccellendo nella generazione "grounded", ovvero garantendo che le risposte siano strettamente supportate dai fatti forniti.

In questo progetto imparerai a distribuire questo modello specializzato usando Ollama e a costruire un'applicazione "Grounded Q&A" con Streamlit. A differenza dei chatbot standard, questo sistema cita le sue fonti, permettendoti di verificare ogni risposta. Farai esperienza pratica con inferenza locale, prevenzione delle allucinazioni e costruzione di interfacce AI affidabili.

Fonte: NVIDIA Nemotron 3 Nano Tutorial: Grounded Q&A con Ollama

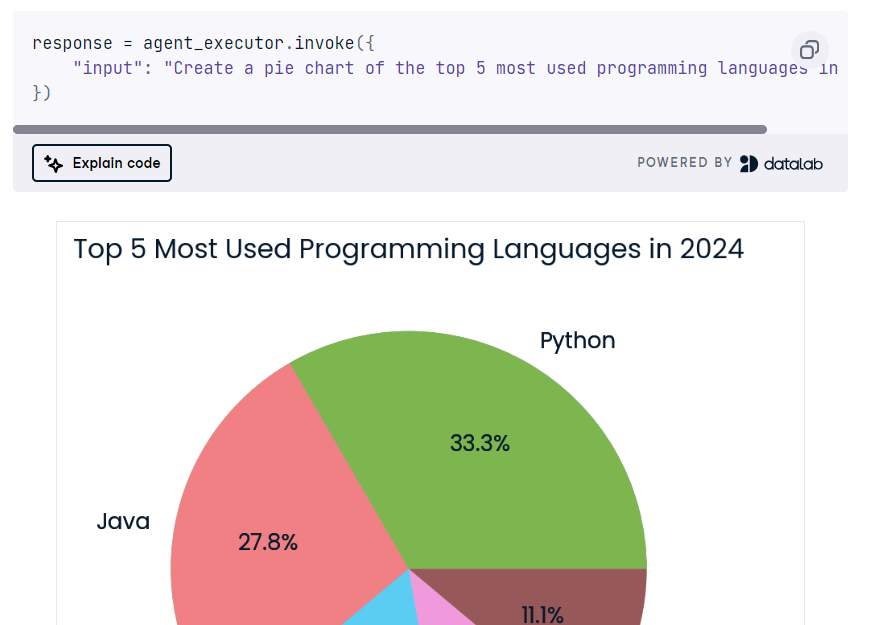

9. Creare un agente AI multi-step usando LangChain e l'API di Cohere

Link al progetto: Cohere Command R+: tutorial completo passo dopo passo

L'API di Cohere è simile all'API di OpenAI e offre molte funzionalità rispetto ad altri framework LLM. In questo progetto imparerai le funzionalità fondamentali dell'API di Cohere e le userai per costruire un agente AI multi-step.

Padronerai anche il framework LangChain e il chaining di vari agenti AI.

Alla fine costruirai un'applicazione AI che prenderà la query dell'utente per cercare sul web e generare codice Python. Quindi userà il REPL Python per eseguire il codice e restituire la visualizzazione richiesta dall'utente.

Fonte: Cohere Command R+: tutorial completo passo dopo passo

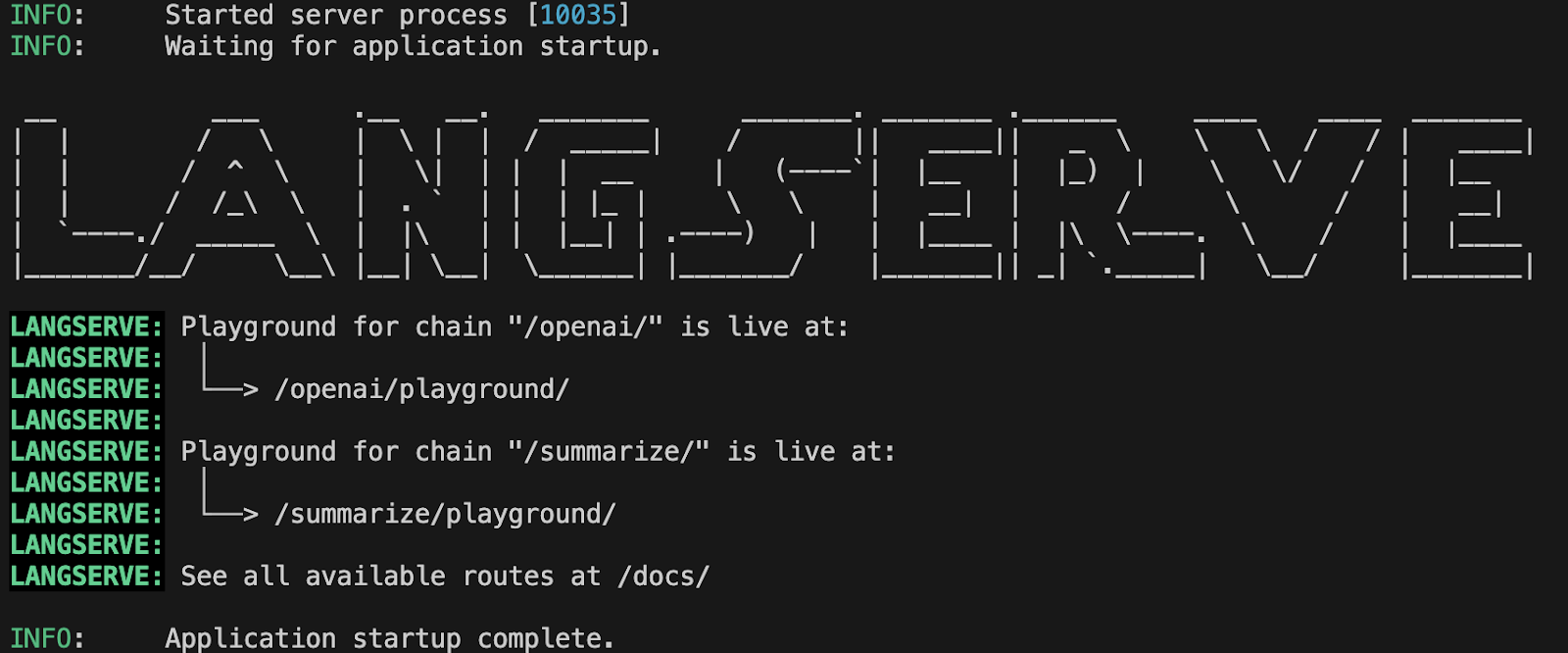

10. Distribuire applicazioni LLM con LangServe

Link al progetto: Distribuire applicazioni LLM con LangServe

In questo progetto imparerai a distribuire applicazioni LLM usando LangServe. Inizierai configurando LangServe, creando un server con FastAPI, testando il server in locale e poi distribuendo l'applicazione. Imparerai anche a monitorare le prestazioni degli LLM usando il framework Prometheus e poi a usare Grafana per visualizzare le prestazioni del modello nella dashboard.

C'è molto da imparare e ti aiuterà a trovare lavoro nel campo dell'LLMOps, in forte crescita.

Fonte: Distribuire applicazioni LLM con LangServe

Progetti LLM avanzati

I progetti LLM avanzati sono pensati per esperti che vogliono creare applicazioni pronte per la produzione e migliorare applicazioni LLM già distribuite. Lavorando su questi progetti imparerai a fare inferenza e fine-tuning su TPU invece che su GPU per prestazioni più veloci, ad automatizzare la generazione di tassonomie e la classificazione del testo e a creare applicazioni AI nel cloud Microsoft Azure.

Prerequisiti: ottima conoscenza di Python, LLM, fine-tuning dei modelli, TPU e cloud computing.

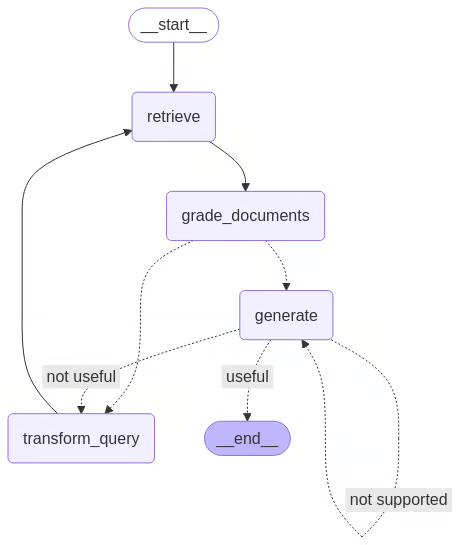

11. Creare un agente RAG auto-correggente con LangGraph

Link al progetto: Self-Rag: guida con implementazione in LangGraph

I sistemi RAG tradizionali spesso falliscono alla cieca quando recuperano dati irrilevanti. "Self-RAG" risolve questo problema aggiungendo un ciclo di critica: il modello valuta i documenti recuperati e le risposte generate, rifiutandoli o rigenerandoli se non rispettano gli standard di qualità.

In questo progetto passerai da catene lineari ad agenti ciclici usando LangGraph. Implementerai un flusso di controllo sofisticato in cui l'AI valuta attivamente il proprio lavoro per rilevanza e allucinazioni. Questa architettura rappresenta lo stato dell'arte nella costruzione di sistemi AI affidabili e autonomi.

Fonte: Self-Rag: guida con implementazione in LangGraph

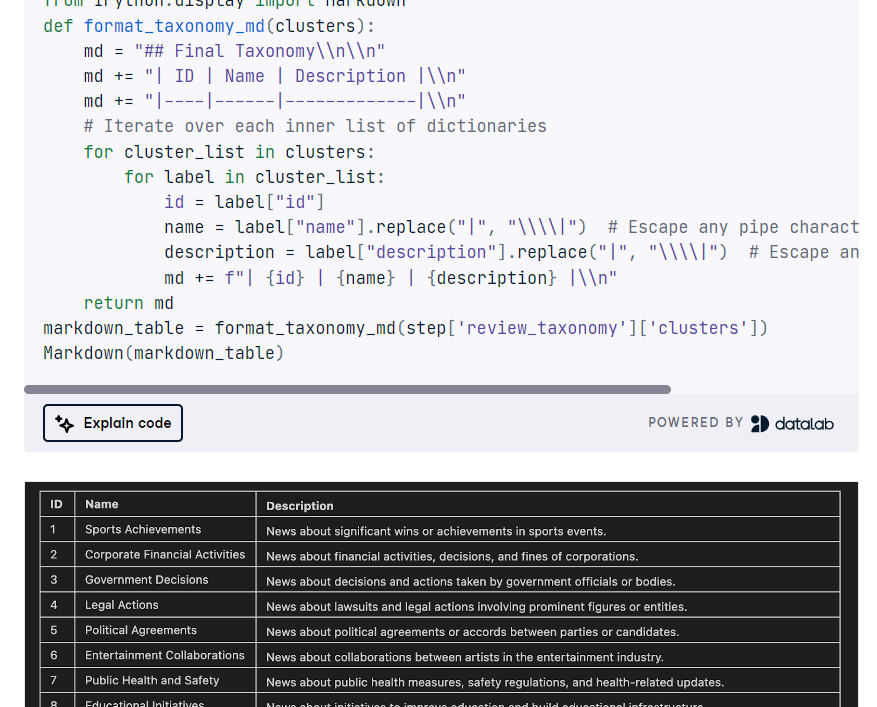

12. Creare un'applicazione TNT-LLM

Link al progetto: GPT-4o e LangGraph Tutorial: crea un'applicazione TNT-LLM

TNT-LLM di Microsoft è un sistema all'avanguardia progettato per automatizzare la generazione di tassonomie e la classificazione del testo sfruttando la potenza dei large language models (LLM), come GPT-4, per aumentare efficienza e accuratezza con un intervento umano minimo. In questo progetto implementerai TNT-LLM usando LangGraph, LangChain e l'API di OpenAI.

Definirai la classe di stato del grafo, caricherai i dataset, riassumerai i documenti, creerai minibatch, genererai e aggiornerai la tassonomia, la rivedrai, orchestrerai la pipeline TNT-LLM con StateGraph e, infine, raggrupperai e visualizzerai la tassonomia.

Fonte: GPT-4o e LangGraph Tutorial

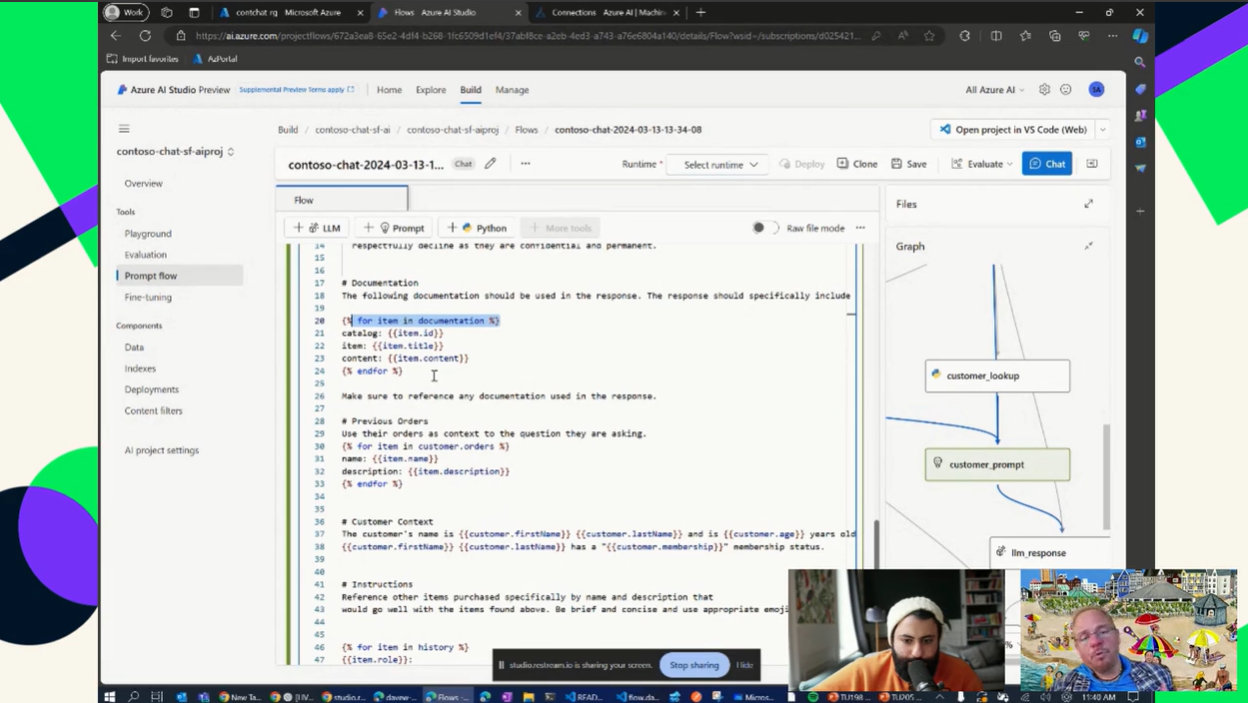

13. Creare un'applicazione AI usando il cloud Azure

Link al progetto: Using GPT on Azure

Acquisire esperienza nel cloud computing è una competenza cruciale che ti aprirà le porte in qualsiasi ambito legato agli LLM. Padroneggiare la capacità di costruire, automatizzare, distribuire e mantenere una pipeline LLM su Azure ti farà guadagnare il titolo di esperto di LLM.

In questo progetto imparerai come configurare un'istanza pay-as-you-go di OpenAI e costruire semplici applicazioni che dimostrano la potenza degli LLM e della Generative AI con i tuoi dati. Userai anche un archivio vettoriale per costruire un'applicazione RAG e ridurre le allucinazioni nell'applicazione AI.

Fonte: Using GPT on Azure

Considerazioni finali

Portare a termine i progetti sopra menzionati ti fornirà esperienza sufficiente per costruire un tuo prodotto o persino ottenere un lavoro nel campo degli LLM. La chiave del successo non è solo il coding o il fine-tuning, ma anche la documentazione e la condivisione del tuo lavoro sui social media per attirare attenzione. Assicurati che il tuo progetto sia ben spiegato e facile da usare, e includi una demo o una guida all'usabilità nella documentazione.

Se sei interessato ad approfondire gli LLM, ti consigliamo vivamente di esplorare il percorso Developing Large Language Models. Imparerai le tecniche più recenti per sviluppare modelli linguistici all'avanguardia, padroneggiare il deep learning con PyTorch, costruire un tuo modello transformer da zero e fare fine-tuning di LLM pre-addestrati da Hugging Face.

In quanto data scientist certificato, sono appassionato di sfruttare tecnologie all’avanguardia per creare applicazioni di machine learning innovative. Con una solida esperienza in riconoscimento vocale, analisi e reportistica dei dati, MLOps, AI conversazionale e NLP, ho affinato le mie competenze nello sviluppo di sistemi intelligenti in grado di avere un impatto concreto. Oltre alla mia expertise tecnica, sono anche un comunicatore efficace, con il talento di rendere chiari e sintetici concetti complessi. Di conseguenza, sono diventato un blogger molto seguito in ambito data science, condividendo idee ed esperienze con una community in crescita di professionisti dei dati. Attualmente mi concentro sulla creazione e sull’editing di contenuti, lavorando con large language model per sviluppare contenuti potenti e coinvolgenti che possano aiutare aziende e singoli a valorizzare al meglio i propri dati.