Curso

Desde seu lançamento em novembro de 2022, o ChatGPT tem atraído a atenção global. Esse inovador chatbot de IA é capaz de interpretar instruções em linguagem natural e produzir respostas que se assemelham a conversas humanas em uma grande variedade de assuntos.

O advento de grandes modelos de linguagem, como o GPT-4, abriu novas possibilidades no campo do processamento de linguagem natural. Com o lançamento da API ChatGPT pela OpenAI, agora podemos integrar facilmente recursos de IA conversacional em nossos aplicativos. Neste guia para iniciantes, exploraremos o que a API do ChatGPT oferece e como começar a usá-la usando um cliente Python.

O que é GPT?

GPT, abreviação de Generative Pre-trained Transformer, é uma série de modelos de linguagem desenvolvidos pela OpenAI. Esses modelos, que evoluíram do GPT-1 para o GPT-4, são treinados em vastos dados de texto e podem ser aprimorados ainda mais para tarefas específicas de linguagem. Eles são excelentes na geração de textos coerentes, prevendo palavras subsequentes. O ChatGPT, uma IA de conversação baseada nesses modelos, interage em linguagem natural e é treinado para ser seguro, confiável e informativo, com conhecimento atualizado até março de 2023.

O que é a API do ChatGPT?

Uma API (Interface de Programação de Aplicativos) permite que dois programas de software se comuniquem entre si. As APIs expõem determinadas funções e dados de um aplicativo a outros aplicativos. Por exemplo, a API do Twitter permite que os desenvolvedores acessem perfis de usuários, tweets, tendências, etc., do Twitter e criem seus próprios aplicativos usando esses dados.

A API ChatGPT fornece acesso aos modelos de IA de conversação da OpenAI, como GPT-4, GPT-4 turbo, GPT-3, etc. Ele nos permite aproveitar esses modelos de linguagem em nossos aplicativos por meio da API. Pode haver vários casos de uso em que, usando essas APIs, você pode criar funcionalidades e recursos interessantes em seus aplicativos que sejam úteis para seus usuários. Isso pode incluir:

- Criação de chatbots e assistentes virtuais

- Automatização dos fluxos de trabalho de suporte ao cliente

- Geração de conteúdo como e-mails, relatórios e muito mais

- Resposta a perguntas específicas do domínio

Principais recursos da API do ChatGPT

Vamos examinar alguns dos motivos pelos quais você pode optar por usar a API do ChatGPT em seu projeto:

Compreensão de linguagem natural

O ChatGPT apresenta recursos excepcionais de compreensão de linguagem natural. Ele foi desenvolvido com base na arquitetura GPT-3, que permite interpretar e processar uma ampla variedade de entradas de linguagem natural, incluindo perguntas, comandos e declarações.

Essa compreensão é facilitada por seu treinamento em um vasto corpus de dados de texto, tornando-o hábil em reconhecer várias nuances linguísticas e gerar respostas precisas e contextualmente relevantes.

Geração de respostas contextuais

A API é excelente na geração de textos que não são apenas coerentes, mas também contextualmente relevantes. Isso significa que o ChatGPT pode fornecer respostas que se alinham perfeitamente com o fluxo da conversa, mantendo a relevância para o contexto fornecido anteriormente.

Sua capacidade de lidar com longas sequências de texto permite que ele compreenda as dependências dentro de uma conversa, garantindo assim que as respostas não sejam apenas precisas, mas também significativas dentro do contexto determinado.

Alguns dos principais recursos oferecidos pela API incluem:

- Compreensão de linguagem natural

- Geração de respostas contextuais

- Capacidade de responder a perguntas de acompanhamento

- Suporte para fluxos de trabalho de conversação

Como usar a API do ChatGPT

A biblioteca da API OpenAI Python oferece uma maneira simples e eficiente de interagir com a API REST da OpenAI a partir de qualquer aplicativo Python 3.7+. Este guia detalhado tem o objetivo de ajudá-lo a entender como usar a biblioteca de forma eficaz.

Instalação

Para começar a usar a biblioteca, instale-a usando o pip:

!pip install openaiUso

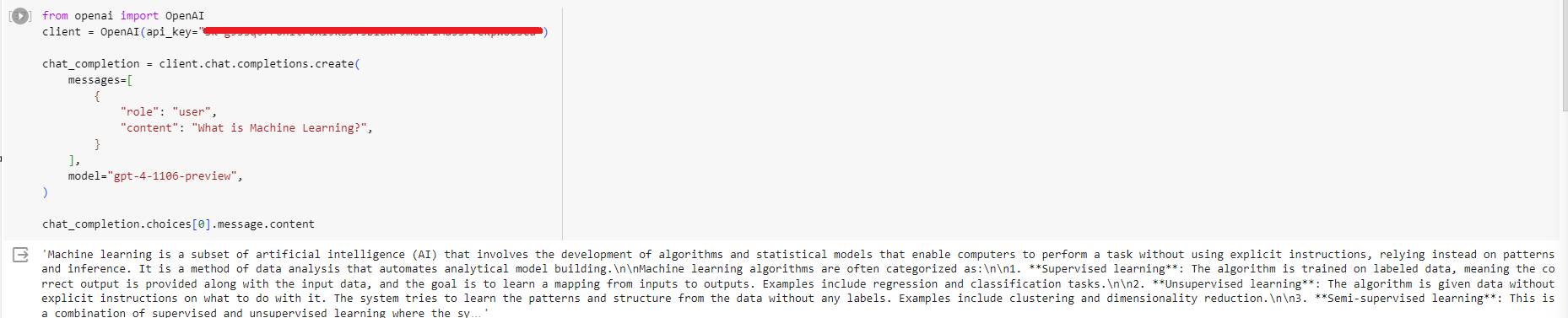

Para usar a biblioteca, você precisará importá-la e criar um cliente OpenAI:

from openai import OpenAI

client = OpenAI(api_key="...")

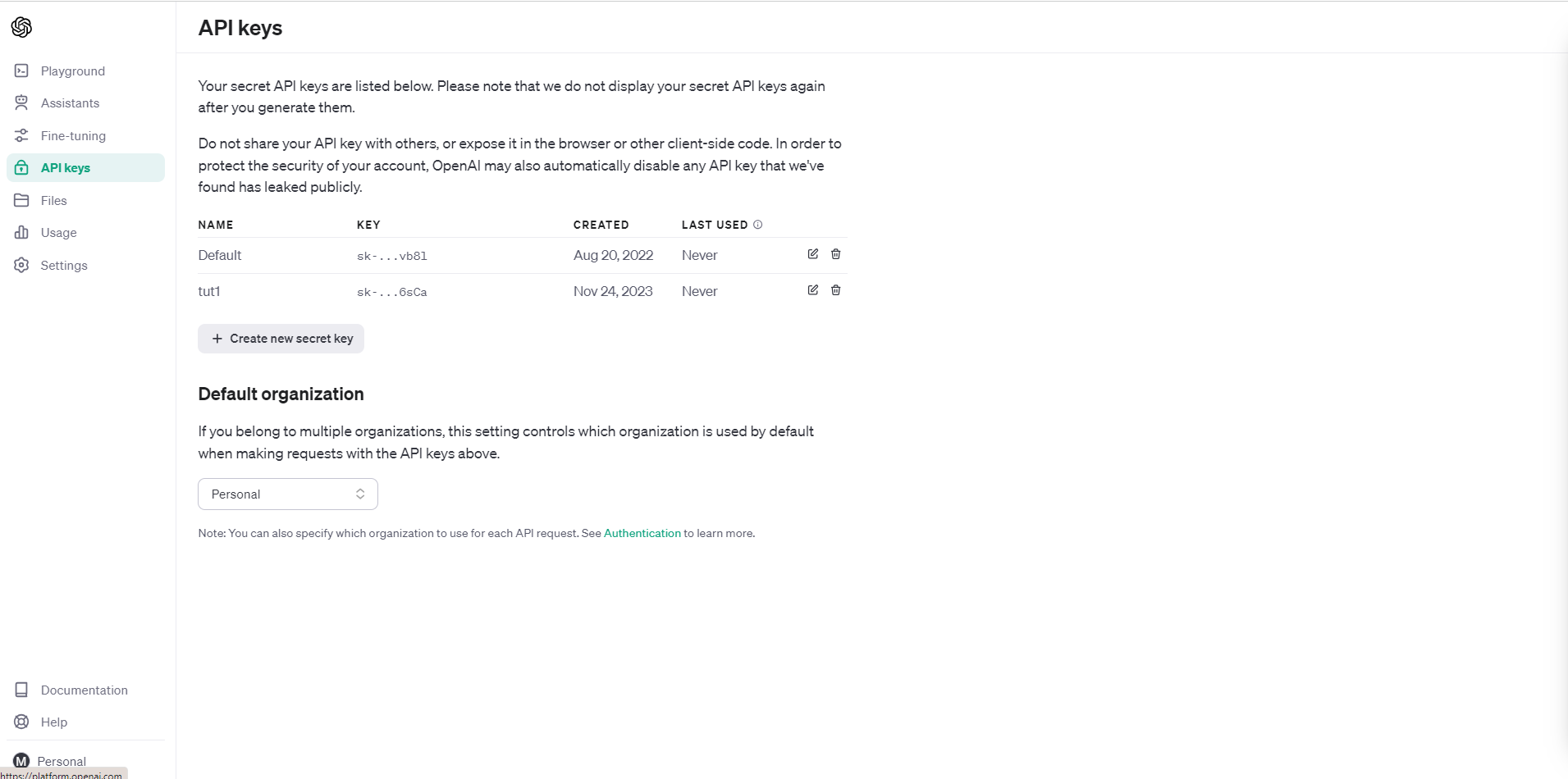

Você pode gerar uma chave fazendo login em platform.openai.com

Depois de ter a chave, você poderá fazer chamadas de API, como criar conclusões de bate-papo:

chat_completion = client.chat.completions.create(

messages=[

{

"role": "user",

"content": "What is Machine Learning?",

}

],

model="gpt-4-1106-preview",

)

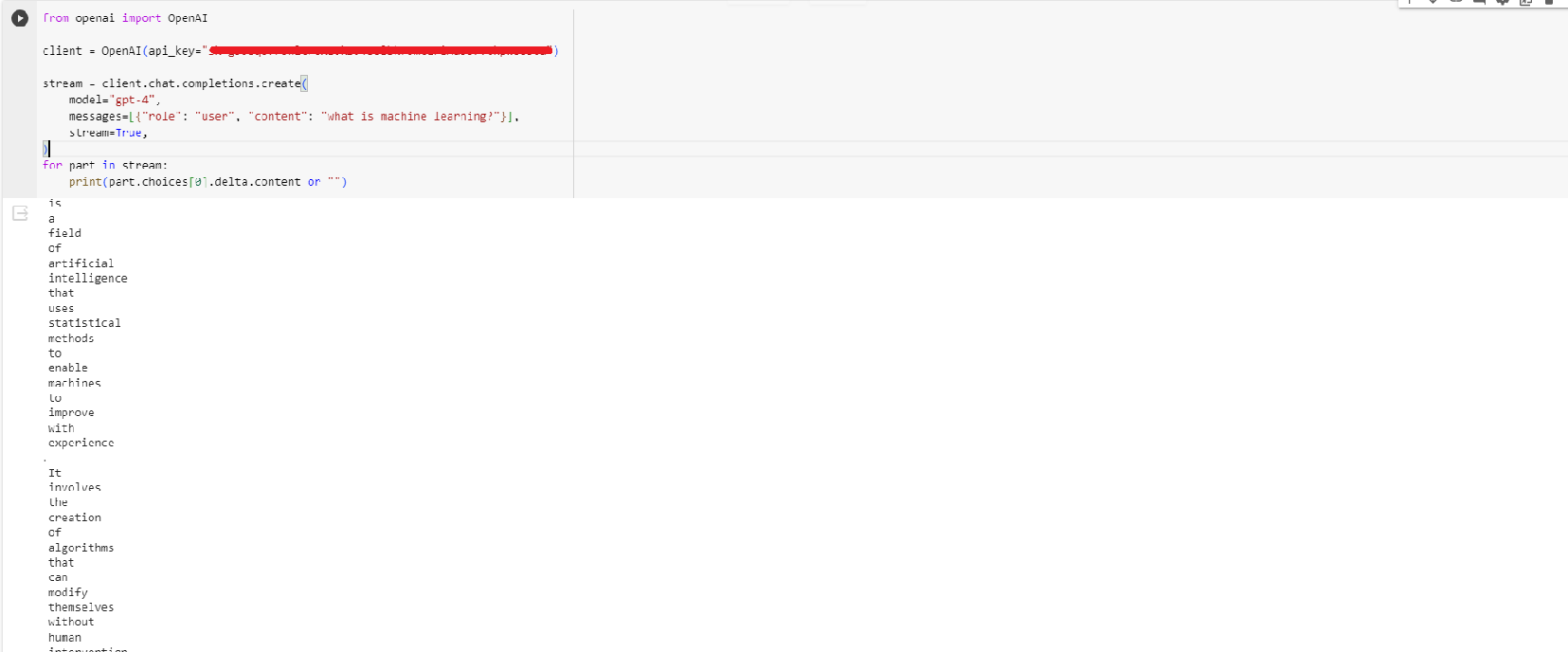

A biblioteca também oferece suporte a respostas de fluxo contínuo usando eventos do lado do servidor (SSE). Aqui está um exemplo de como transmitir respostas:

from openai import OpenAI

client = OpenAI(api_key="...")

stream = client.chat.completions.create(

model="gpt-4",

messages=[{"role": "user", "content": "what is machine learning?"}],

stream=True,

)

for part in stream:

print(part.choices[0].delta.content or "")

Modelos e preços da OpenAI

A OpenAI oferece uma gama de diferentes modelos de IA que os usuários podem aproveitar por meio de sua API. Os modelos diferem em seus recursos, preços e casos de uso pretendidos.

O principal modelo GPT-4 é o mais capaz e mais caro, a partir de US$ 0,03 por 1.000 tokens para entrada e US$ 0,06 por 1.000 tokens para saída. O GPT-4 representa o estado da arte em processamento de linguagem natural, com a capacidade de entender e gerar texto semelhante ao humano. Ele suporta até 128.000 tokens de contexto. A família GPT-4 inclui o modelo básico GPT-4 e o GPT-4-32k, que usa 32.000 tokens de contexto.

Um modelo turbo GPT-4 recém-lançado vem com 128k de comprimento de contexto, com suporte a visão e é mais potente que o GPT-4. A melhor parte é o preço. Seu preço é de apenas US$ 0,01 por 1.000 tokens para entrada e US$ 0,03 por 1.000 tokens para saída.

Para um processamento de linguagem natural mais econômico, a OpenAI oferece a família de modelos GPT-3.5. O GPT-3.5 Turbo é otimizado para aplicativos de conversação com 16.000 tokens de contexto, com preço de US$ 0,0010 por 1.000 tokens de entrada e US$ 0,0020 por 1.000 tokens de saída. O GPT-3.5 Turbo Instruct é um modelo de instrução com 4.000 tokens de contexto, com preço um pouco mais alto, de US$ 0,0015 por 1.000 tokens de entrada e US$ 0,0020 por 1.000 tokens de saída.

Além dos principais modelos de linguagem, a OpenAI oferece outros recursos por meio de sua API. A API Assistants facilita a criação de assistentes de IA, fornecendo ferramentas como recuperação e interpretação de código. Os modelos de imagem podem gerar e editar imagens. Os modelos de incorporação podem representar o texto como vetores numéricos. Há também opções para ajustar os modelos para aplicações específicas.

A OpenAI oferece uma gama de modelos avançados de IA que os desenvolvedores podem aproveitar por meio de uma API simples de pagamento conforme o uso. A escolha do modelo depende das necessidades específicas da aplicação e do orçamento. O GPT-4 oferece recursos de ponta a um preço premium, enquanto modelos como o GPT-3.5 equilibram desempenho e custo para muitas aplicações.

Você pode consultar a documentação oficial para saber mais sobre todos os modelos disponíveis e seus preços de API.

Flexibilidade e personalização

A API fornece muitos parâmetros para personalizar o comportamento do modelo de acordo com as necessidades do seu aplicativo:

Autenticação

- api_key (str): Sua chave de API para autenticar solicitações. Necessário.

Modelos

- modelo (str): A ID do modelo a ser usado. Especifica o modelo a ser usado para a conclusão.

Entrada

- prompt (str): O(s) prompt(s) para o qual gerar conclusões. Normalmente, o texto.

- suffix (str): O sufixo que vem depois de uma conclusão do texto gerado.

Saída

- max_tokens (int): O número máximo de tokens a serem gerados na conclusão. Entre 1 e 4096.

- stop (str): Até 4 sequências em que a API deixará de gerar mais tokens.

- temperatura (flutuante): Controla a aleatoriedade. Os valores variam de 0,0 a 2,0. Valores mais altos significam que o modelo assumirá mais riscos.

- top_p (float): Alternativa à amostragem com temperatura, chamada de amostragem de núcleo. Os valores variam de 0,0 a 1,0. Valores mais altos significam que o modelo assumirá mais riscos.

- n (int): Quantas conclusões devem ser geradas para cada prompt.

- stream (bool): Se o progresso parcial deve ser transmitido de volta. Se definido, os tokens serão enviados como eventos enviados pelo servidor somente de dados à medida que se tornarem disponíveis.

Como moldar o comportamento da API do ChatGPT

Os três principais tipos de mensagens que moldam o comportamento de um chatbot são as mensagens do "sistema", do "usuário" e do "assistente". As mensagens do sistema representam os processos internos do chatbot, as mensagens do usuário são as entradas dos humanos e as mensagens do assistente são as respostas do chatbot.

As mensagens do sistema permitem que o chatbot acompanhe o estado da conversa, entenda o contexto e determine as respostas apropriadas. Por exemplo, as mensagens do sistema podem registrar o tópico atual da discussão, o humor do usuário ou as conversas anteriores com esse usuário. Esses metadados definem como o chatbot interpreta as mensagens do usuário e cria mensagens de assistente.

As mensagens do usuário fornecem a entrada de conversação bruta que o chatbot deve analisar e reagir. O chatbot usa o processamento de linguagem natural para extrair o significado dessas mensagens e determinar a intenção. Diferentes frases, duração, pontuação e conteúdo da mensagem do usuário provocarão diferentes respostas do chatbot.

Por fim, as mensagens do assistente representam as respostas do chatbot moldadas por sua análise do estado do sistema e da entrada de mensagens do usuário. O tom, a personalidade e o conteúdo das informações das mensagens dos assistentes determinam, em última análise, a experiência do usuário. A engenharia cuidadosa das regras do chatbot e da IA que gera as mensagens do assistente é fundamental para criar um diálogo envolvente e útil.

Conclusão

A API do ChatGPT representa um avanço significativo no campo da IA de conversação, oferecendo uma ferramenta versátil e poderosa para desenvolvedores e inovadores. Sua capacidade de entender e gerar linguagem natural, combinada com a flexibilidade de ser integrada a vários aplicativos, faz dela um recurso inestimável para a criação de soluções sofisticadas orientadas por IA.

Seja para criar chatbots avançados, automatizar o suporte ao cliente, gerar conteúdo criativo ou responder a perguntas específicas do domínio, a API do ChatGPT fornece as ferramentas e os recursos necessários para dar vida a essas ideias.

A ampla variedade de modelos oferecidos pela OpenAI, cada um adaptado a diferentes casos de uso e considerações orçamentárias, garante que os desenvolvedores possam selecionar a ferramenta mais adequada às suas necessidades. Desde o GPT-4 de última geração até as variantes mais econômicas do GPT-3.5, a escolha do modelo pode ser ajustada com precisão aos requisitos específicos da aplicação.

O guia abrangente fornecido aqui serve como um excelente ponto de partida para qualquer pessoa que queira aproveitar o poder dessa tecnologia de ponta.

Interessado em saber mais sobre esse tópico? Confira este tutorial prático e as práticas recomendadas da API OpenAI ou inscreva-se em um curso gratuito sobre como trabalhar com a API OpenAI.