Curso

Com o lançamento do ChatGPT, em meio ao hype da IA, a OpenAI lançou o GPT-4, seu principal produto com extraordinários recursos de IA generativa. Durante seu lançamento em março de 2023, ela falou sobre as possibilidades da IA generativa multimodal por meio da GPT-4. A multimodalidade na IA generativa refere-se à capacidade de um sistema de processar, compreender e/ou gerar resultados para mais de um tipo de dados.

Saiba mais sobre como os LLMs funcionam hoje, iniciando nosso Curso de Conceitos de Modelos de Linguagem Grande (LLMs).

Após meses de silêncio, em setembro de 2023, a OpenAI anunciou esse recurso multimodal para o ChatGPT, que agora pode ver, ouvir e falar, indicando novos recursos de imagem e voz implementados no ChatGPT. Espera-se que a capacidade multimodal dos sistemas de IA, quando aperfeiçoada, abra novas possibilidades e inovações para vários setores.

Neste tutorial, apresentaremos os recursos de imagem e entenderemos o modelo de visão GPT-4, que permite que o ChatGPT "veja". Finalmente, entenderíamos as limitações atuais do modelo e lhe forneceríamos mais recursos.

O que é a visão GPT-4?

O GPT-4 Vision (GPT-4V) é um modelo multimodal que permite que um usuário carregue uma imagem como entrada e participe de uma conversa com o modelo. A conversa pode incluir perguntas ou instruções na forma de um prompt, orientando o modelo a executar tarefas com base na entrada fornecida na forma de uma imagem.

O modelo GPT-4V foi desenvolvido com base nos recursos existentes do GPT-4, oferecendo análise visual além dos recursos de interação de texto existentes. Cobrimos a introdução amigável para iniciantes à API OpenAI, que o ajudará a se atualizar sobre os desenvolvimentos anteriores ao lançamento do modelo GPT-4V.

Principais recursos do GPT-4 Vision

- Entradas visuais: O principal recurso do recém-lançado GPT-4 Vision é que agora ele pode aceitar conteúdo visual, como fotografias, capturas de tela e documentos, e executar uma variedade de tarefas.

- Detecção e análise de objetos: O modelo pode identificar e fornecer informações sobre objetos em imagens.

- Análise de dados: GPT-4 A visão é proficiente na interpretação e análise de dados apresentados em formatos visuais, como gráficos, diagramas e outras visualizações de dados.

- Decifração de texto: O modelo é capaz de ler e interpretar anotações manuscritas e textos em imagens.

Agora que já entendemos alguns dos muitos recursos do GPT-4 Vision, vamos colocá-lo em prática para experimentá-lo melhor.

Prática: Primeiros passos com o GPT-4 Vision

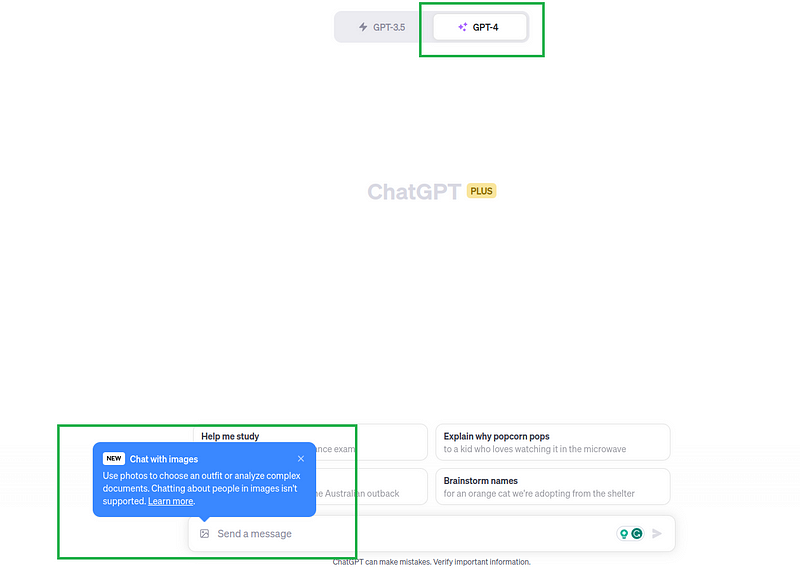

O GPT-4 Vision está atualmente (a partir de outubro de 2023) disponível apenas para os usuários do ChatGPT Plus e Enterprise. O ChatGPT Plus custa US$ 20/mês, e pode ser atualizado a partir de suas contas gratuitas regulares do ChatGPT.

Supondo que você seja completamente novo no ChatGPT, veja como acessar o GPT-4 Vision:

- Visite o site do OpenAI ChatGPT e registre-se em uma conta.

- Faça login na sua conta e navegue até a opção "Upgrade to Plus".

- Faça o upgrade para obter acesso ao ChatGPT Plus (Observação: trata-se de uma assinatura mensal de US$ 20)

- Selecione o "GPT-4" como seu modelo na janela de bate-papo, conforme mostrado no diagrama abaixo.

- Clique no ícone de imagem para carregar a imagem e adicione um prompt instruindo o GPT-4 a executá-la.

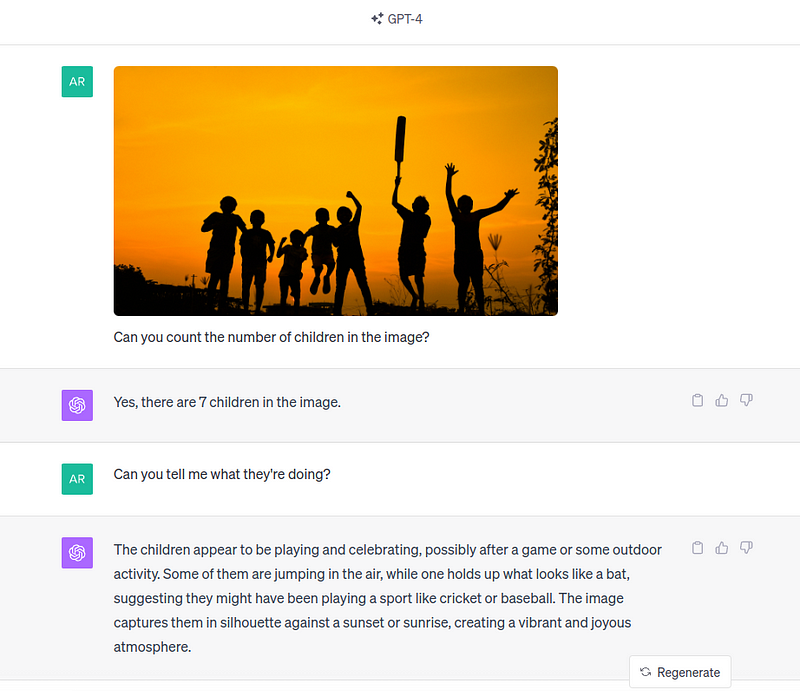

Aqui, o GPT-4 Vision faz um bom trabalho ao entender que as crianças estavam jogando críquete com base no taco na mão de uma criança. No mundo da IA, essa tarefa é conhecida como detecção de objetos, em que os objetos identificados são as crianças e o morcego. Confira nosso tutorial sobre detecção de objetos YOLO para saber mais.

Da mesma forma, você pode prosseguir para executar uma tarefa diferente melhor, dependendo do seu caso de uso.

GPT-4 Vision Casos de uso e exemplos do mundo real

Agora que já entendemos seus recursos, vamos estendê-los a algumas aplicações práticas no setor:

1. Pesquisa acadêmica

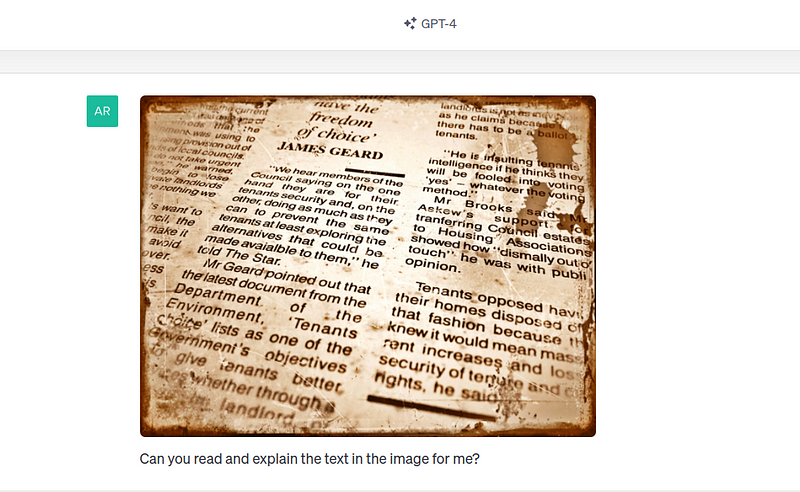

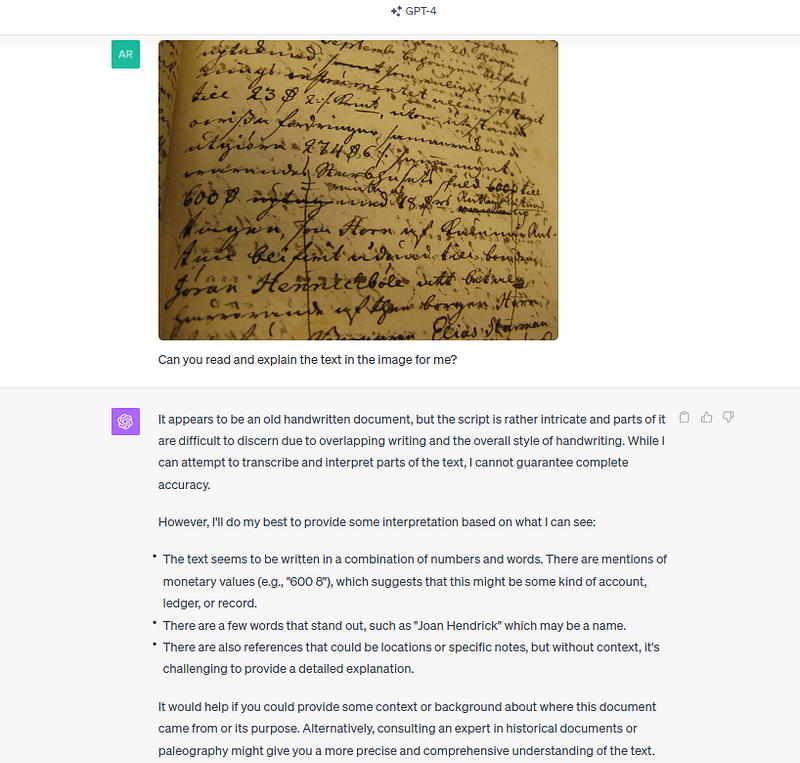

A integração do GPT-4 Vision de modelagem avançada de linguagem com recursos visuais abre novas possibilidades em campos acadêmicos, especialmente na decifração de manuscritos históricos. Tradicionalmente, essa tarefa tem sido um esforço meticuloso e demorado, realizado por paleógrafos e historiadores especializados.

Primeiro, apresentamos uma imagem que parece ser parte de um artigo de jornal antigo:

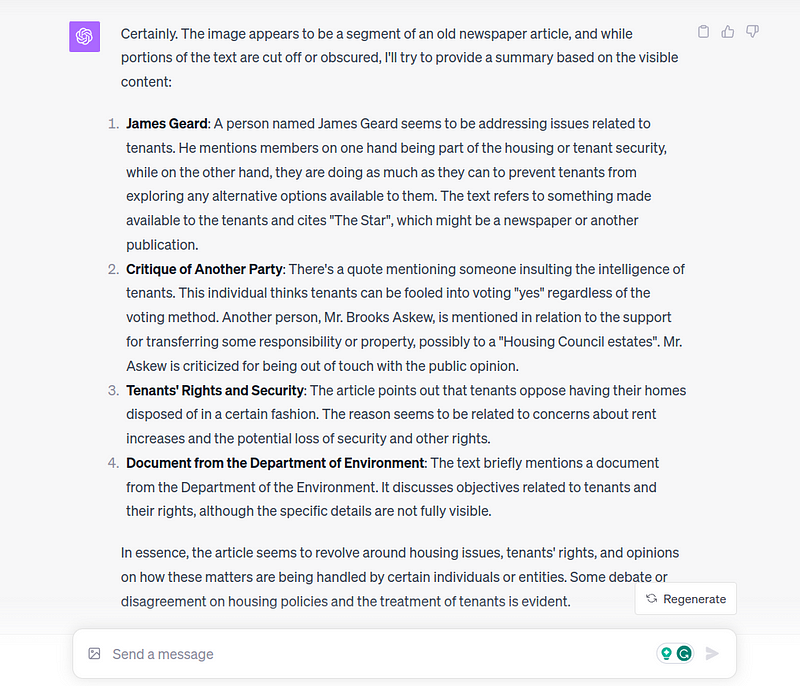

O GPT-4 Vision faz um bom trabalho de leitura e interpretação do conteúdo da imagem:

O modelo foi capaz de ler, decifrar o conteúdo e fornecer uma análise do mesmo, ao mesmo tempo em que forneceu uma resposta realista de que algumas partes da imagem foram cortadas e obscurecidas.

No entanto, também vale a pena observar que o modelo tem dificuldades quando recebe manuscritos complexos, especialmente em outros idiomas (mais sobre isso mais tarde), como visto abaixo:

2. Desenvolvimento web

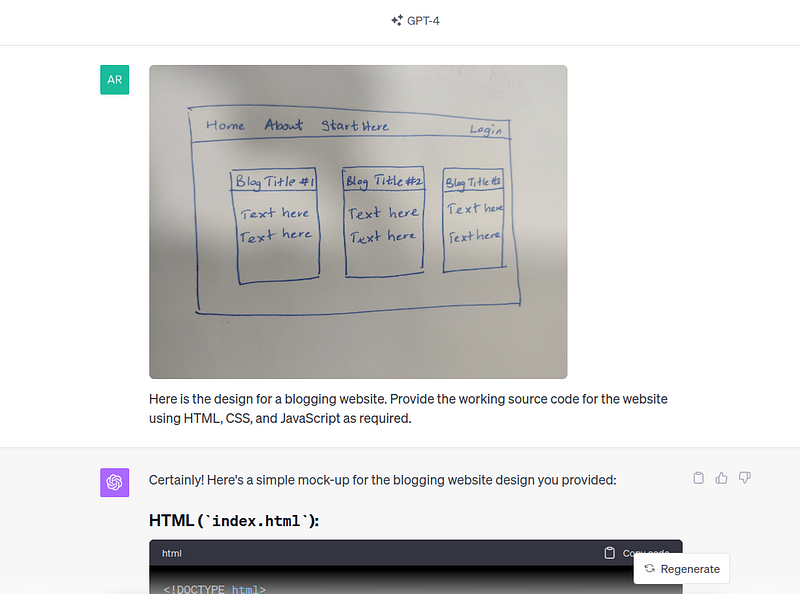

A visão do GPT-4 pode escrever código para um site quando lhe é fornecida uma imagem visual do design necessário. Ele abrange desde um design visual até o código-fonte de um site. Essa capacidade única do modelo pode reduzir drasticamente o tempo necessário para criar sites.

Vamos solicitar o GPT-4 Vision com um design simples desenhado à mão para um site de blog.

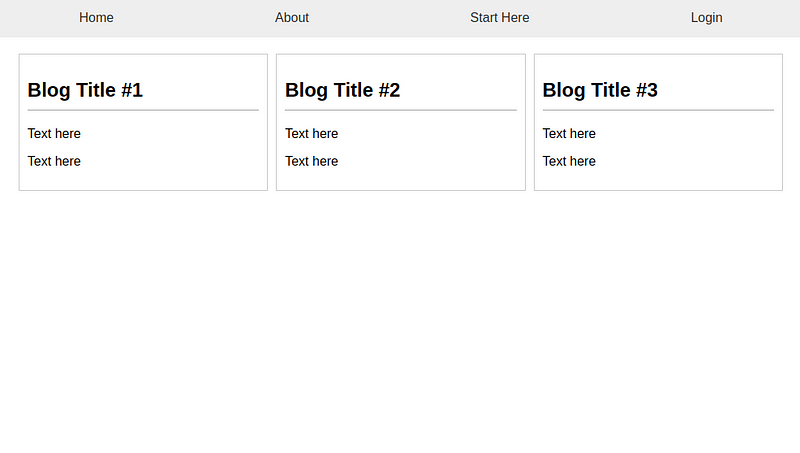

Depois que ele fornece o código-fonte, basta copiar e colar e criar os arquivos HTML e CSS conforme as instruções. Esta é a aparência do site:

Não é muito parecido? É claro que demos um exemplo simples, mas você pode partir daqui e desenvolver um site mais complexo e personalizado em uma fração do tempo, graças ao recém-lançado modelo GPT-4 Vision.

3. Interpretação dos dados

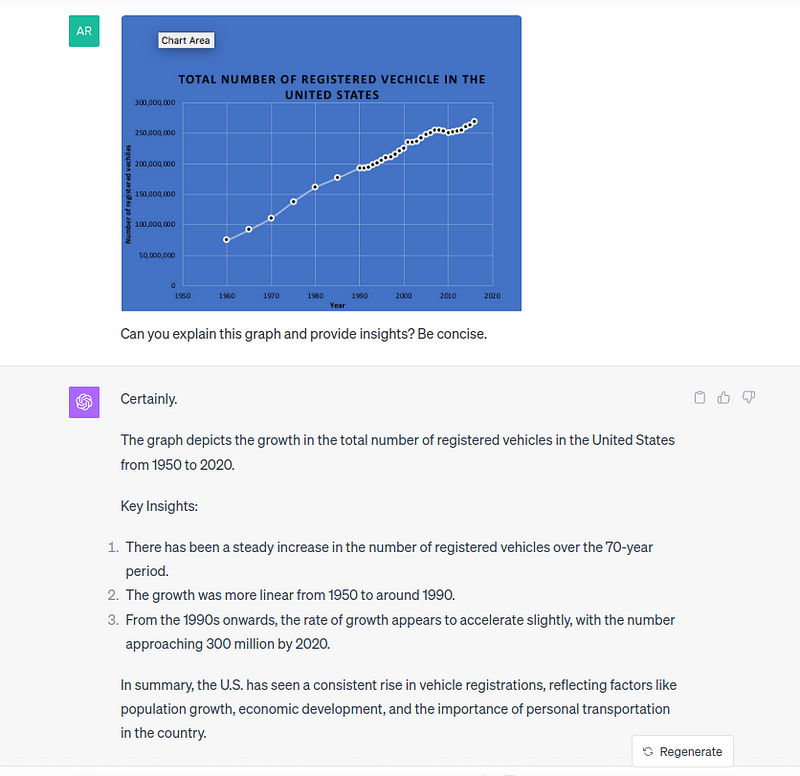

O modelo é capaz de analisar visualizações de dados para interpretar os dados subjacentes e fornecer insights importantes com base nas visualizações. Para testar esse recurso, podemos simplesmente apresentar um gráfico e solicitar insights.

Embora faça um bom trabalho de compreensão do contexto geral do gráfico e da tendência linear, ele comete erros ao mencionar o ano inicial como 1950, embora os pontos de dados comecem apenas a partir de 1960. O modelo também deriva fatores como crescimento populacional e desenvolvimento econômico - embora possam ser verdadeiros, esses insights não podem ser derivados apenas desse gráfico específico.

É possível fazer várias perguntas de acompanhamento para refinar o resultado inicial do modelo GPT-4 Vision. Com base em nossos testes, ainda é necessário ter uma pessoa no circuito para analisar os insights, e o modelo pode aumentar a produtividade dos casos de uso de interpretação de dados.

4. Criação de conteúdo criativo

Com o advento do ChatGPT, a mídia social está repleta de várias técnicas de engenharia de prompt, e muitos encontraram maneiras surpreendentes e criativas de usar a tecnologia generativa a seu favor.

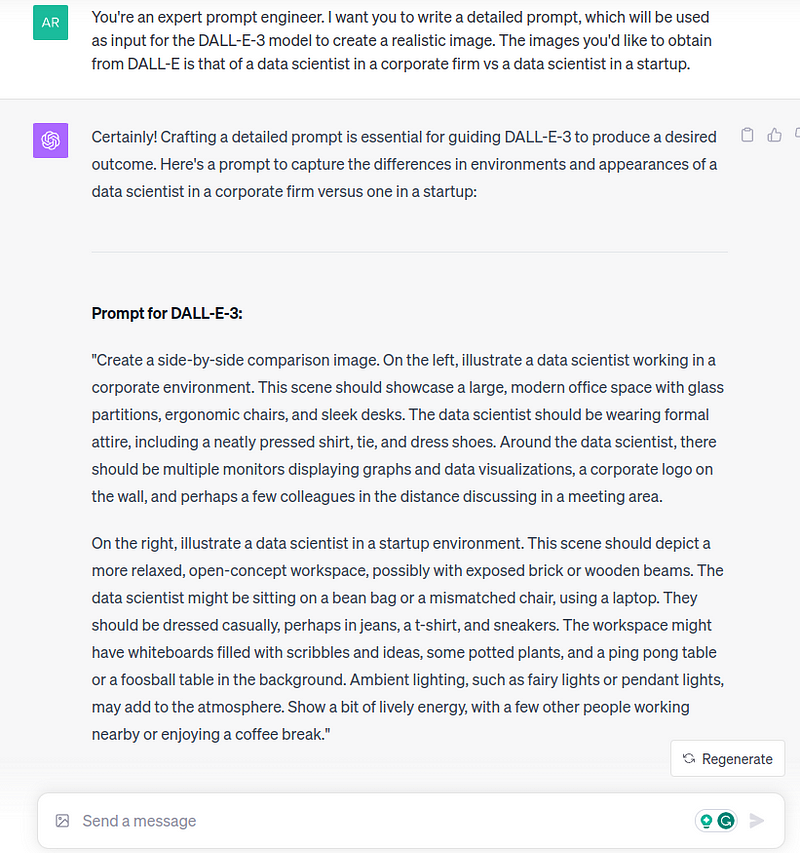

Para este tutorial, usaremos o DALL-E-3 (que também está disponível no ChatGPT Plus) junto com o GPT-4 Vision para criar uma publicação de mídia social de forma criativa.

Etapa 1: Peça ao GPT-4 para criar um prompt para gerar uma imagem. Digamos que você queira criar um post contrastando as diferenças entre a função de cientista de dados em uma startup e em uma empresa.

Etapa 2: Use o prompt e gere uma imagem do DALL-E. Você pode ajustar e refinar o prompt até ficar satisfeito com o resultado.

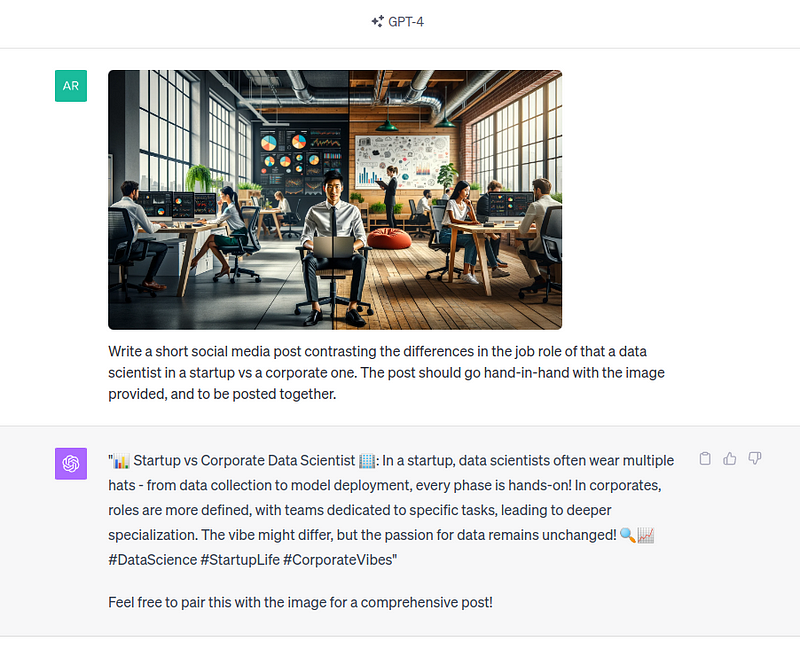

Etapa 3: Use a imagem e peça ao GPT-4 Vision para criar uma postagem que combine com a imagem.

Ao ajustar e fornecer um prompt mais detalhado, é possível obter um resultado melhor e explorar mais a geração de conteúdo criativo. É importante observar que não é recomendável enviar spam para a Internet ou para as mídias sociais com conteúdo gerado por IA, pois esse conteúdo tem suas próprias limitações. Em vez disso, verifique os fatos e refine-os com suas próprias experiências.

Obviamente, essa não é uma lista exaustiva de casos de uso possíveis - o GPT-4 Vision é capaz de muitos outros. Em vez disso, trate isso como uma inspiração e um ponto de partida para explorar sua curiosidade aplicando a tecnologia a um domínio de sua escolha.

Limitações e riscos atenuantes da visão GPT-4

Há um último aspecto que você precisa conhecer antes de usar o GPT-4 Vision em casos de uso: as limitações e os riscos associados a ele.

Isso é particularmente importante porque a própria OpenAI levou alguns meses a mais desde o lançamento do GPT-4, em março de 2023, para testá-lo com seu exercício de "equipe vermelha" interna e externa para determinar as deficiências dessa tecnologia generativa, que foram descritas no cartão do sistema.

1. Precisão e confiabilidade

Embora o modelo GPT-4 represente um progresso significativo em termos de confiabilidade e precisão, nem sempre é esse o caso. De acordo com a OpenAI, com base nos testes internos, o GPT-4 Vision ainda pode ser pouco confiável e impreciso em alguns momentos. A equipe chega a mencionar que "o ChatGPT pode cometer erros. Verifique informações importantes." abaixo da barra de bate-papo quando inserimos texto e imagens.

Portanto, é de extrema importância que os usuários avaliem criticamente o resultado do modelo e permaneçam atentos.

2. Preocupações com privacidade e preconceito

De acordo com a OpenAI, semelhante a seus antecessores, o GPT-4 Vision continua a reforçar preconceitos sociais e visões de mundo, incluindo associações estereotipadas e humilhantes prejudiciais a determinados grupos marginalizados. Portanto, é importante entender essa limitação e tomar outras medidas necessárias para lidar com o viés dentro do próprio caso de uso e não depender do modelo para resolvê-lo.

Além das preocupações com o viés, os dados compartilhados com o ChatGPT podem ser usados para treinar modelos, a menos que se opte por não usá-los; portanto, é importante estar atento para não compartilhar informações confidenciais ou privadas com o modelo. Os usuários também podem optar por não compartilhar dados para melhorar os modelos acessando "Controles de dados" na seção "Configurações e Beta".

3. Restrito a tarefas de risco

O GPT-4 Vision não é capaz de responder a perguntas que solicitam a identificação de indivíduos específicos em uma imagem. Esse é um comportamento de "recusa" esperado por design. Além disso, a OpenAI aconselha a não usar o GPT-4 Vision em tarefas de alto risco, que incluem:

- Proficiência científica: O modelo pode não reconhecer textos ou caracteres, ignorar símbolos matemáticos das imagens fornecidas com informações científicas e não conseguir reconhecer localizações espaciais e mapeamentos de cores.

- Orientação médica: O modelo às vezes fornece respostas corretas para perguntas baseadas em imagens médicas, mas às vezes falha na mesma pergunta. Devido às inconsistências nas respostas, as respostas ou os resultados do modelo não devem ser considerados como substitutos de uma orientação médica profissional.

- Riscos de desinformação: Diz-se que as pessoas acreditam em declarações (independentemente de serem verdadeiras ou não) quando acompanhadas de imagens. O modelo pode ser usado para gerar conteúdo de texto plausível, realista e direcionado, adaptado para uma entrada de imagem e, portanto, possui o risco de desinformação.

- Conteúdo de ódio: O modelo se recusa a responder a perguntas com símbolos de ódio e conteúdo extremista em alguns casos, mas nem sempre é esse o caso. Esse continua sendo um problema desafiador para a OpenAI resolver.

Portanto, como usuários, precisamos estar atentos ao usar o GPT-4 Vision de forma responsável, especialmente em tarefas de alto risco e contextos sensíveis mencionados acima.

Conclusão

Este tutorial forneceu a você uma introdução abrangente ao recém-lançado modelo GPT-4 Vision. Você também foi alertado sobre as limitações e os riscos que o modelo apresenta e agora entende como e quando usar o modelo.

A maneira mais prática de dominar a nova tecnologia é colocá-la em suas mãos e experimentá-la, fornecendo vários avisos para avaliar seus recursos e, com o tempo, você se sentirá mais confortável com ela.

Embora essa ferramenta seja relativamente nova e tenha um mês de existência, ela foi desenvolvida com base nos princípios dos modelos de linguagem grande e do GPT-4. Aqui estão mais alguns recursos relacionados se você quiser se aprofundar nos conceitos básicos subjacentes e relacionados do modelo GPT-4 Vision: