course

În analitica datelor, încercăm mereu să înțelegem cum se raportează variabilele unele la altele. Probabil ați întâlnit două măsuri statistice utilizate frecvent în acest scop: covarianța și corelația. Aceste măsuri sună similar și sunt adesea confundate. Dar care este diferența dintre ele și cum ar trebui folosite?

Ambele descriu modul în care variabilele se mișcă împreună. Totuși, în ciuda asemănărilor, covarianța și corelația răspund la întrebări ușor diferite și, prin urmare, joacă roluri distincte în fluxurile de lucru cu date. Covarianța surprinde variabilitatea comună brută dintre caracteristici, în timp ce corelația standardizează această relație pentru a putea fi comparată mai ușor.

Să explorăm cum această diferență subtilă influențează alegerea măsurii în diferite situații.

Ce este covarianța?

Covarianța măsoară modul în care două variabile se mișcă împreună. Ne spune dacă creșterile unei variabile tind să coincidă cu creșteri sau scăderi ale alteia. Există trei tipuri de covarianță:

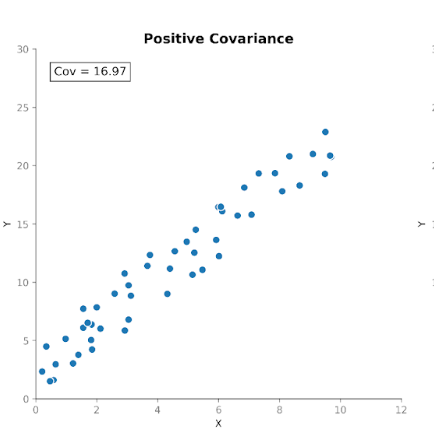

- Covarianță pozitivă: când o variabilă crește pe măsură ce cealaltă crește.

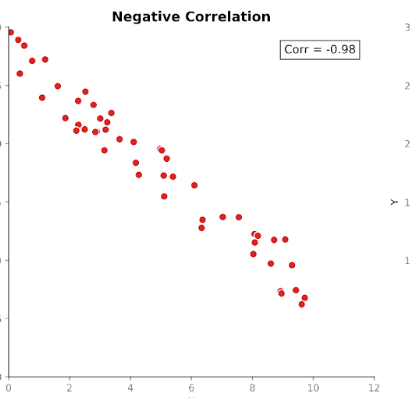

- Covarianță negativă: când o variabilă crește în timp ce cealaltă scade.

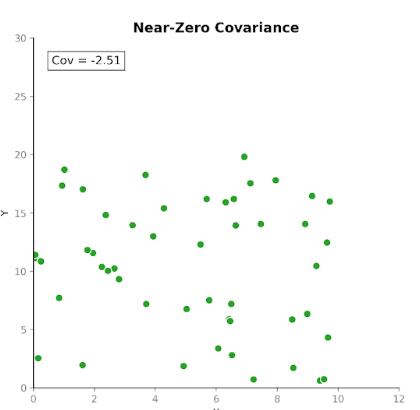

- Covarianță aproape zero: când nu există o relație direcțională consecventă.

Aceasta face ca covarianța să fie utilă pentru a detecta modul în care variabilele se mișcă una în raport cu cealaltă.

Totuși, deși direcția relației este utilă, interpretarea magnitudinii covarianței nu este atât de simplă. Magnitudinea depinde de unitățile de măsură, precum și de scara variabilelor. Conversia unităților, de exemplu din centimetri în metri, poate schimba dramatic magnitudinea covarianței fără a afecta relația de bază.

Din acest motiv, covarianța este folosită mai des ca bloc de construcție computațional intern decât ca statistică rezumativă de sine stătătoare.

Ce este corelația?

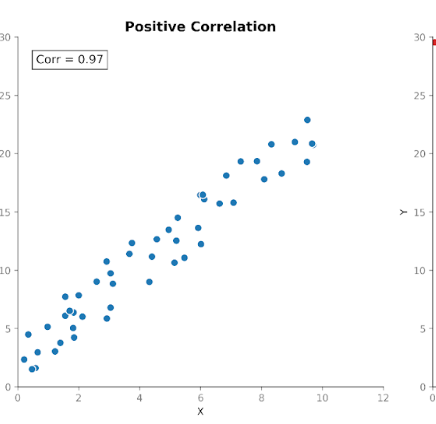

Corelația măsoară atât intensitatea, cât și direcția relației dintre două variabile. Ea pornește de la covarianță, standardizând însă magnitudinea astfel încât unitățile să nu mai influențeze rezultatul.

Valorile corelației se încadrează într-un interval fix între +1 (o relație perfect pozitivă) și -1 (o relație perfect negativă). O valoare a corelației de 0 ne spune că nu există o relație liniară.

Această scală standardizată face ca interpretarea corelației să fie mai ușoară decât a covarianței. Dacă vedem o valoare de 0,8, putem ști imediat că există o relație puternică între variabile, indiferent de unitățile folosite în măsurarea inițială.

Această standardizare permite, de asemenea, comparații semnificative între seturi de date, caracteristici și domenii. De aceea corelația este atât de des folosită în analizele exploratorii și în investigațiile de caracteristici.

Covarianță vs. corelație: diferențe cheie

Covarianța și corelația descriu proprietăți înrudite ale relațiilor dintre variabile, dar servesc scopuri analitice diferite.

În termeni practici, covarianța reflectă co-variabilitatea brută, în timp ce corelația reflectă aceeași relație într-o formă standardizată. Înțelegerea acestei distincții ajută la stabilirea măsurii potrivite pentru o sarcină analitică dată.

|

Covarianță |

Corelație |

|

|

Măsoară |

Relație liniară (ne-standardizată) |

Relație liniară (standardizată) |

|

Sensibilitate la scară |

Scară dictată de unități |

Interval fix (−1 la +1) |

|

Unități |

Are unități |

Fără unități |

|

Interpretabilitate |

Magnitudine greu de interpretat |

Direcție și magnitudine ușor de interpretat |

|

Comparabilitate |

Comparabilitate limitată între seturi de date |

Direct comparabilă între seturi de date |

|

Utilizare obișnuită |

Modelare și construcție de matrici |

Explorare și comunicare |

|

Avantaj |

Păstrează scara originală |

Standardizează pentru comparație |

Exemplu: covarianță vs. corelație

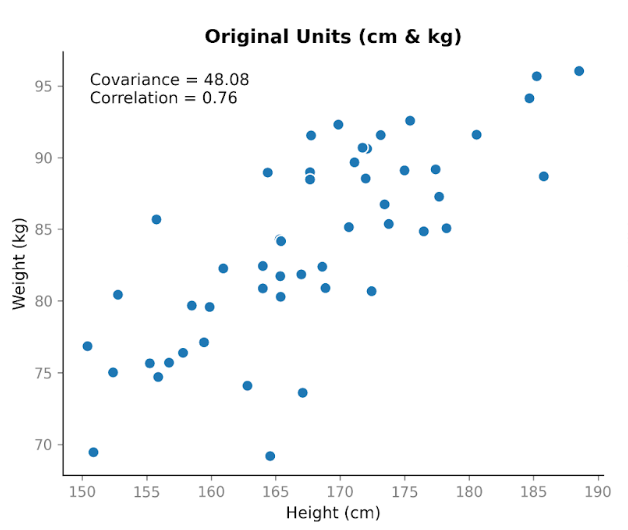

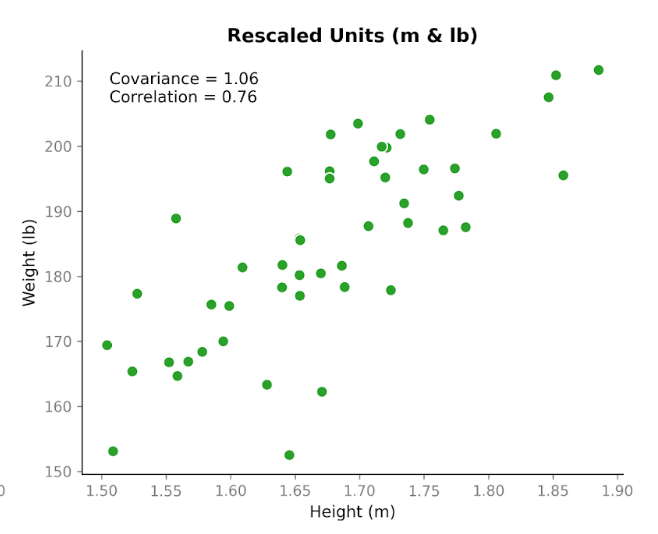

Să presupunem că colectăm date pentru două variabile: înălțime și greutate. Ne așteptăm să fie corelate, deoarece, în general, persoanele mai înalte tind să cântărească mai mult. Când reprezentăm înălțimea în centimetri în raport cu greutatea în kilograme, vedem o tendință ascendentă clară. Pe măsură ce înălțimea crește, tinde să crească și greutatea.

Când calculăm covarianța, obținem o valoare pozitivă: 48,08. Faptul că este pozitivă ne spune că cele două variabile se mișcă în aceeași direcție. Când înălțimea este peste medie, de obicei și greutatea este peste medie.

Acum devine interesant. Să luăm exact aceleași date și să schimbăm unitățile. Vom converti înălțimea din centimetri în metri și greutatea din kilograme în livre. Oamenii nu s-au schimbat. Relația nu s-a schimbat. Modelul din diagrama de dispersie arată la fel. Dar când recalculăm covarianța, numărul este diferit: 1,06. Este în continuare pozitiv, însă magnitudinea este foarte diferită. Și singurul lucru pe care l-am schimbat au fost unitățile.

Acest lucru ilustrează o proprietate importantă a covarianței: surprinde direcția, dar magnitudinea ei depinde de scară. Dacă întindem sau comprimăm una dintre variabile schimbând unitățile, covarianța se întinde sau se comprimă la rândul ei.

Acum, să privim corelația folosind aceleași date, înainte și după conversia unităților. Corelația folosind centimetri și kilograme este 0,76. După conversia în metri și livre, este tot 0,76.

Spre deosebire de covarianță, corelația ajustează variabilitatea fiecărei variabile înainte de a măsura relația dintre ele. Datorită acestei ajustări, valoarea nu se schimbă când trecem la alte unități. Ea se concentrează doar pe cât de strâns urmează punctele un model liniar și dacă acel model are pantă ascendentă sau descendentă.

Acest exemplu simplu evidențiază principala diferență dintre aceste metrici: covarianța reflectă atât direcția, cât și scara, în timp ce corelația reflectă intensitatea relației independent de scară. În practică, acest lucru înseamnă că corelația este mai fiabilă pentru a compara relații între variabile măsurate pe scări diferite, în timp ce covarianța este mai relevantă în contexte în care contează magnitudinea variabilității, cum ar fi modelarea.

Covarianța poate fi greu de interpretat

După cum am discutat, covarianța ne spune dacă două variabile se mișcă în aceeași direcție, dar magnitudinea ei este dificil de interpretat.

Problema principală este că covarianța depinde de scara variabilelor, nu doar de relația lor. Dacă valorile uneia sau ambelor variabile sunt mai mari sau mai răspândite, covarianța va tinde și ea să fie mai mare.

Această sensibilitate provine din două surse. Prima este unitatea datelor. Schimbarea unităților modifică covarianța. Măsurarea venitului în dolari versus mii de dolari produce valori de covarianță foarte diferite, deși relația este identică.

A doua sursă este cantitatea de variabilitate a variabilei. Chiar și când unitățile rămân aceleași, un set de date cu un interval mai larg sau o dispersie mai mare va produce, de obicei, o covarianță mai mare decât un set mai strâns cu aceeași relație de bază. O covarianță mare nu indică neapărat o relație puternică. Poate reflecta pur și simplu scări mai mari sau o variabilitate mai ridicată în date.

Din cauza acestei sensibilități la scară, covarianța este adesea folosită intern, de exemplu la ajustarea modelelor, în loc să fie raportată direct.

De ce este corelația folosită mai des

Corelația rezolvă multe dintre provocările de interpretare ale covarianței prin standardizarea relației dintre variabile. Deoarece valorile corelației sunt întotdeauna între −1 și +1, magnitudinea este imediat semnificativă: valorile apropiate de 1 sau −1 indică relații liniare puternice, în timp ce valorile apropiate de 0 indică relații liniare slabe sau inexistente. Această standardizare permite și comparații directe între variabile sau seturi de date, făcând corelația mai ușor de comunicat și interpretat.

Aceste proprietăți fac corelația deosebit de utilă pentru analiza exploratorie a datelor, inspectarea relațiilor dintre caracteristici, detectarea redundanței sau a multicoliniarității și raportarea constatărilor. Matricile de corelație și hărțile termice sunt, de asemenea, utile ca instrumente de primă trecere atunci când examinăm seturi de date.

Totuși, corelația nu înlocuiește complet covarianța. Deoarece corelația elimină efectele scării, ea reflectă doar forța relației, nu variabilitatea brută. În contexte de modelare, cum ar fi analiza componentelor principale sau modelele statistice multivariate, scara originală surprinsă de covarianță poate fi importantă pentru înțelegerea structurii varianței și pentru ghidarea comportamentului algoritmilor.

O perspectivă de algebră liniară

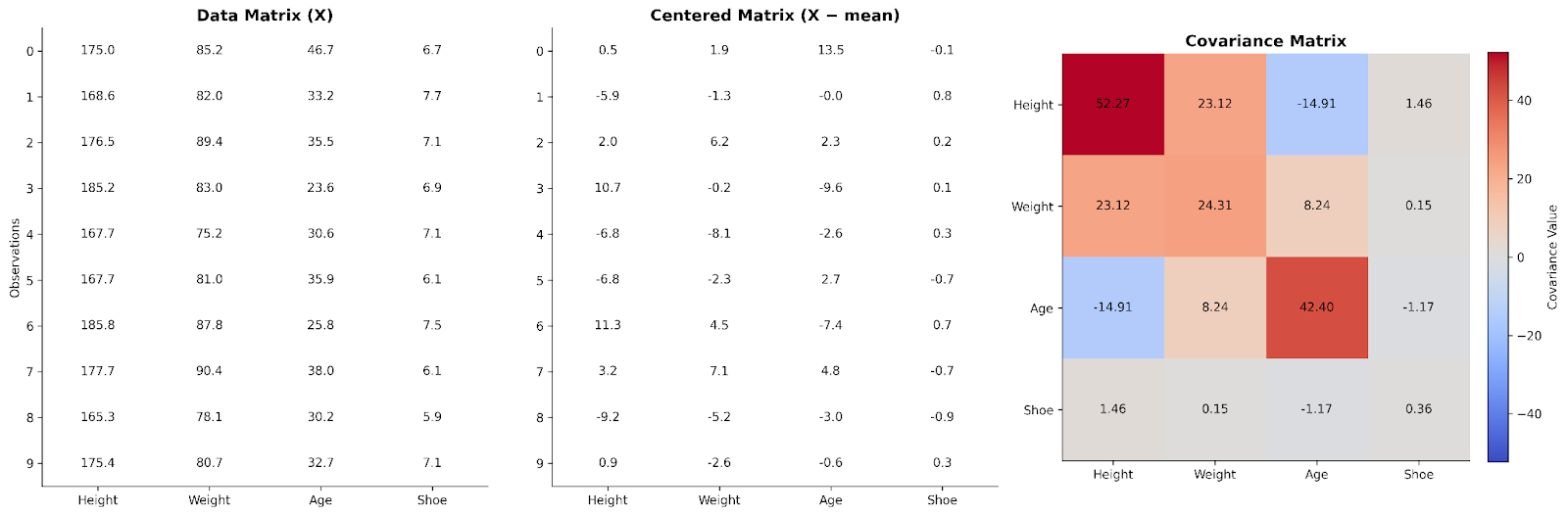

Până acum am privit covarianța între variabile pereche cu pereche. Algebra liniară ne arată cum să extindem această idee la întregul set de date dintr-odată. Putem face asta aranjând datele într-o matrice.

Într-o matrice de date de bază, fiecare rând reprezintă o observație, iar fiecare coloană reprezintă o variabilă. Pentru a înțelege relațiile dintre variabile, putem mai întâi centra datele scăzând media coloanei din fiecare valoare. Acest pas asigură că ne concentrăm pe abaterile față de valorile tipice, nu pe valorile absolute.

Înmulțirea matricei de date centrate cu transpusa ei produce o structură care surprinde modul în care variabilele se mișcă împreună. Acest produs, după scalare, este matricea de covarianță. Din perspectiva algebrei liniare, matricea de covarianță rezumă modul în care variabilitatea este distribuită de-a lungul dimensiunilor setului de date.

A privi covarianța în acest fel ajută la explicarea motivului pentru care apare atât de frecvent în știința datelor. Multe algoritmuri, inclusiv analiza componentelor principale (PCA) și alte tehnici de reducere a dimensionalității, se bazează pe această reprezentare matricială pentru a înțelege tiparele și structura din date. Conceptual, matricea de covarianță oferă o hartă a modului în care interacționează diferitele dimensiuni ale setului de date.

Aici putem vedea date pentru patru variabile aranjate într-o matrice de date. Aceasta este apoi centrată și folosită pentru a construi o matrice de covarianță.

Dacă doriți să aprofundați algebra liniară pentru știința datelor, consultați cursul nostru Linear Algebra for Data Science in R, care acoperă fundamentele necesare pentru a înțelege abordările bazate pe matrici, precum covarianța.

Matrici de covarianță și de corelație

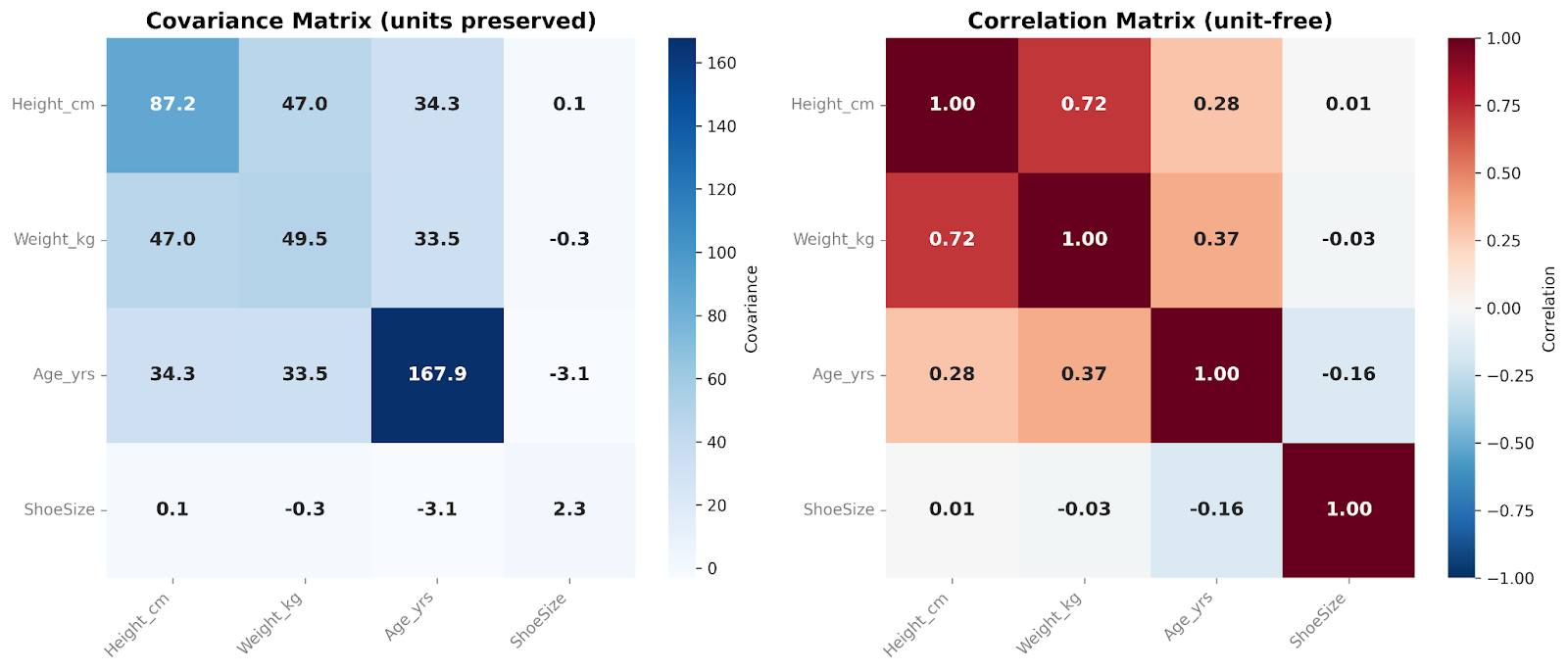

Matricea de covarianță rezumă modul în care variabilele se mișcă împreună pe întregul set de date. În practică, examinăm adesea aceste relații folosind fie matrici de covarianță, fie de corelație, în funcție de faptul că dorim să păstrăm scara originală sau să standardizăm rezultatele.

O matrice de covarianță conține covarianțele dintre toate perechile de variabile. Numerele de pe diagonală arată varianța în cadrul fiecărei variabile, în timp ce numerele din afara diagonalei reflectă modul în care variabilele se schimbă împreună. Deoarece covarianța păstrează scara și unitățile originale ale datelor, matricea surprinde structura brută a variabilității. Acest lucru face ca matricile de covarianță să fie deosebit de utile în fluxurile de lucru de modelare și în analizele multivariate.

O matrice de corelație, pe de altă parte, standardizează aceste relații. Fiecare element de pe diagonală este egal cu 1, deoarece fiecare variabilă se corelează perfect cu ea însăși. Toate valorile din afara diagonalei se situează între −1 și +1, indicând corelația dintre variabile. Prin eliminarea efectelor scării, matricile de corelație sunt mai ușor de interpretat de către oameni și permit comparații directe între variabile. Ele sunt deosebit de utile în analiza exploratorie a datelor și pentru identificarea rapidă a relațiilor liniare puternice sau slabe între caracteristici.

În aceste matrici, comparăm patru variabile între ele. Îmi place să adaug o suprapunere de tip heatmap atunci când prezint aceste matrici. Culoarea fiecărei celule ne ajută să vedem, dintr-o privire, magnitudinea relativă a valorilor de covarianță sau corelație.

Cum se convertește covarianța în corelație

Conceptual, corelația este derivată din covarianță prin standardizarea relației dintre variabile. Pur și simplu împărțiți covarianța la deviația standard a fiecărei variabile. Această scalare elimină unitățile și magnitudinea variabilelor, producând o măsură standardizată care se încadrează întotdeauna între −1 și +1. Această transformare este motivul pentru care valorile corelației sunt direct comparabile între variabile sau seturi de date diferite.

În practică, conversia covarianței în corelație este realizată automat în majoritatea programelor statistice, astfel încât analiștii rareori trebuie să o calculeze manual. Totuși, este întotdeauna important să înțelegeți ce face software-ul în spate. De exemplu, înțelegerea modului în care covarianța este convertită în corelație explică de ce nu puteți converti în direcția opusă (cel puțin nu fără informații despre deviația standard a ambelor). Corelația nu mai conține unitățile sau informația privind magnitudinea necesare pentru a converti în covarianță.

Când să folosiți covarianța și corelația

Covarianța este cea mai utilă atunci când scara și unitățile datelor sunt semnificative sau când aveți nevoie de structura brută a variabilității datelor. Este utilizată frecvent în modelarea multivariată, în modele probabilistice și în construirea matricilor de covarianță pentru metode bazate pe algebră liniară. În aceste contexte, păstrarea variabilității originale permite algoritmilor să surprindă structura reală a datelor și să înțeleagă cum variază împreună dimensiunile.

Corelația, în schimb, este mai potrivită pentru interpretarea de către oameni, comparații între seturi de date și analize exploratorii. Îmi place să folosesc această metrică în vizualizări, cum ar fi hărțile termice, astfel încât să pot vedea și comunica aceste relații dintr-o privire. Deoarece corelația standardizează relația, este utilă și în pregătirea datelor pentru tehnici în care este important ca toate caracteristicile să fie pe o scară comparabilă.

Covarianță vs. corelație în știința datelor și statistici

Adesea, ambele măsuri apar în același flux de lucru. Matricile de covarianță formează fundația matematică a multor tehnici multivariate, deoarece păstrează variabilitatea originală a datelor. Matricile de corelație, pe de altă parte, sunt folosite frecvent în etapele exploratorii pentru a înțelege structura setului de date înainte de modelare.

Unele modele pot folosi oricare dintre statistici, în funcție de obiectiv. Luați în considerare analiza componentelor principale (PCA). Când PCA este efectuată pe o matrice de covarianță, variabilele cu varianță mai mare exercită în mod natural o influență mai mare asupra componentelor rezultate. Acest lucru poate fi uneori de dorit dacă diferențele de scară reflectă diferențe semnificative în variabilitate. De exemplu, dacă analizați randamentele zilnice ale acțiunilor, o acțiune mai volatilă poate modela în mod adecvat componentele principale, deoarece acea variabilitate reflectă un comportament real al pieței.

Folosirea unei matrici de corelație, în schimb, standardizează variabilele înainte de descompunere. Fiecare caracteristică este plasată pe aceeași scară, astfel încât nicio variabilă nu domină doar pentru că are unități mai mari sau un interval numeric mai larg. Această abordare poate fi mai potrivită atunci când variabilele sunt măsurate în unități diferite, cum ar fi înălțimea (cm), greutatea (kg), tensiunea arterială (mmHg) și colesterolul (mg/dL).

Nicio abordare nu este universal mai bună. Alegerea adecvată depinde de faptul dacă diferențele de scară reflectă o structură semnificativă sau sunt pur și simplu artefacte ale măsurării.

Idei greșite comune despre covarianță și corelație

O idee greșită des întâlnită este că o covarianță mare indică automat o relație puternică. Totuși, valorile mari ale covarianței pot reflecta pur și simplu scara sau variabilitatea variabilelor, nu intensitatea relației lor. Dacă doriți să cunoașteți intensitatea relației, trebuie să o standardizați privind corelația.

Probabil ați auzit expresia „corelația nu implică cauzalitate” de aproape un milion de ori! Și totuși, este probabil cea mai comună idee greșită pe care o întâlnesc. Este de înțeles să vedeți o corelație puternică și să presupuneți o legătură cauzală. Este o scurtătură pe care creierul nostru a folosit-o timp de milenii pentru a ne ține strămoșii în viață. Totuși, ca practicieni ai datelor, trebuie să rezistăm acestei scurtături și să recunoaștem că doar corelația nu este suficientă pentru a dovedi un efect cauzal. Corelația măsoară asocierea, nu influența cauzală, iar factori externi pot determina simultan ambele variabile.

O altă idee greșită foarte frecventă este că covarianța și corelația sunt, practic, același lucru. Totuși, nu sunt interschimbabile. Deși corelația este derivată din covarianță, ea standardizează relația, devenind o metrică distinctă, care nu este întotdeauna un înlocuitor potrivit pentru covarianță în calcule.

În cele din urmă, este important să rețineți că aceste statistici evaluează doar relațiile liniare. Pot exista tipare neliniare chiar și atunci când corelația și covarianța sunt mici sau aproape de zero, astfel încât bazarea exclusivă pe aceste statistici poate trece cu vederea structuri importante din date. Vă recomand întotdeauna să reprezentați grafic datele și să le priviți înainte de a încerca să interpretați măsurile statistice. Acest lucru vă poate salva dacă există o relație neliniară evidentă.

Sfaturi practice pentru interpretarea relațiilor dintre variabile

În primul rând, luați întotdeauna în considerare scara măsurătorii. Diferențele de unități sau de variabilitate pot afecta măsurile brute precum covarianța, așa că este important să știți ce reprezintă numerele dumneavoastră.

În al doilea rând, stabiliți ce aveți nevoie de la datele dumneavoastră. Covarianța este cea mai utilă atunci când păstrarea variabilității brute este importantă. Acesta este adesea cazul în modelare sau atunci când construiți matrici de covarianță pentru analize multivariate. În aceste contexte, magnitudinea variației poartă informații semnificative. Dar dacă nu aveți nevoie de acea variabilitate brută, este posibil să preferați standardizarea și interpretabilitatea corelației.

În al treilea rând, reprezentați-vă întotdeauna, întotdeauna, întotdeauna datele și priviți-le! Inspecția vizuală vă poate ghida analizele și completează rezumatele statistice. Puteți folosi diagrame de dispersie pentru a depista tipare perechi sau matrici pentru a obține rapid o imagine de ansamblu a multor variabile simultan.

În cele din urmă, gândiți-vă la implicațiile în aval ale alegerilor de măsurare. Alegerea între o măsură brută precum covarianța și o măsură standardizată precum corelația va influența rezultatele modelării și interpretările. Așadar, asigurați-vă că selecția este aliniată cu obiectivele dumneavoastră analitice.

Concluzie

Covarianța și corelația sunt măsuri strâns înrudite care descriu modul în care variabilele se mișcă împreună, dar servesc scopuri distincte: covarianța păstrează scara originală, iar corelația standardizează pentru comparație.

Dacă sunteți interesat(ă) să aflați mai multe despre explorarea datelor, consultați Python Exploratory Data Analysis Tutorial. Pentru a învăța cum să stabiliți dacă corelația dumneavoastră arată cu adevărat cauzalitate, consultați Hypothesis Testing in R.

Întrebări frecvente

Care este diferența dintre covarianță și corelație?

Deși ambele măsoară modul în care variabilele se mișcă împreună, covarianța păstrează scara și unitățile, în timp ce corelația le standardizează pentru comparații mai ușoare.

Este o covarianță mare același lucru cu o relație puternică?

Nu neapărat. Magnitudinea covarianței este puternic influențată de scară și dispersie. Pentru a determina intensitatea relației, corelația este statistica mai potrivită.

Funcționează covarianța sau corelația pentru relații neliniare?

Nu în mod fiabil. Aceste statistici sunt concepute pentru a evalua doar relațiile liniare.

De ce corelația nu are unități?

La conversia covarianței în corelație, unitățile se reduc prin împărțire, rezultând un număr fără unități pentru corelație.

Ar trebui să folosesc covarianță sau corelație pentru PCA?

PCA poate fi efectuată folosind fie o matrice de covarianță, fie una de corelație. Dacă diferența de magnitudine dintre variabile este semnificativă și comparabilă, o matrice de covarianță va surprinde acea variație. Totuși, dacă unitățile variabilelor nu sunt direct comparabile, o matrice de corelație standardizează relațiile. Alegerea depinde de variabilele pe care le folosiți și de obiectivul dumneavoastră.