Kurs

In der Datenanalyse versuchen wir ständig zu verstehen, wie Variablen miteinander zusammenhängen. Dabei bist du sicher auf zwei gängige statistische Maße gestoßen: Kovarianz und Korrelation. Sie klingen ähnlich und werden oft verwechselt. Doch worin unterscheiden sie sich, und wie setzt man sie richtig ein?

Beide beschreiben, wie sich Variablen gemeinsam bewegen. Trotz der Ähnlichkeiten beantworten Kovarianz und Korrelation jedoch leicht unterschiedliche Fragen und übernehmen daher verschiedene Rollen im Datenworkflow. Die Kovarianz erfasst die rohe gemeinsame Variabilität zwischen Merkmalen, während die Korrelation diese Beziehung standardisiert, damit sie leichter vergleichbar ist.

Schauen wir uns an, wie dieser feine Unterschied beeinflusst, welches Maß wir in welcher Situation nutzen.

Was ist Kovarianz?

Kovarianz misst, wie sich zwei Variablen gemeinsam bewegen. Sie zeigt, ob Anstiege der einen Variable tendenziell mit Anstiegen oder mit Rückgängen der anderen einhergehen. Es gibt drei Arten von Kovarianz:

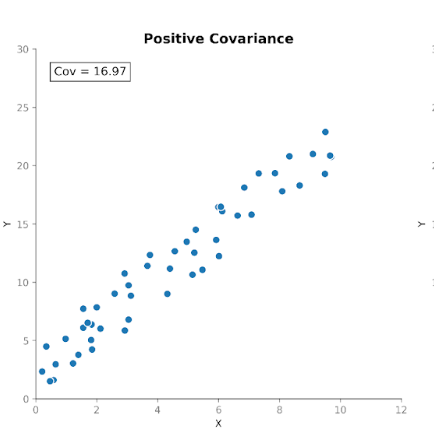

- Positive Kovarianz: Wenn die eine Variable zunimmt, während auch die andere zunimmt.

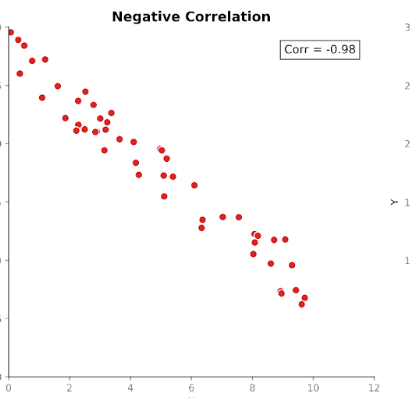

- Negative Kovarianz: Wenn die eine Variable zunimmt, während die andere abnimmt.

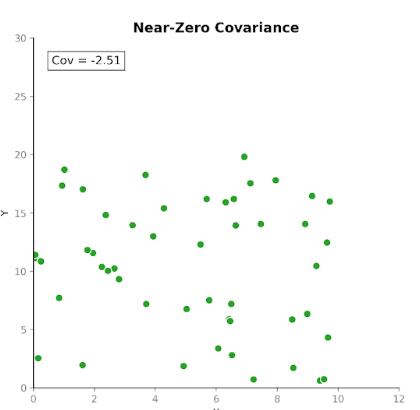

- Nahe null: Wenn es keine konsistente gerichtete Beziehung gibt.

Damit eignet sich die Kovarianz gut, um zu erkennen, wie sich Variablen zueinander verhalten.

Während die Richtung der Beziehung hilfreich ist, lässt sich der Betrag der Kovarianz jedoch nicht so einfach interpretieren. Er hängt von den Maßeinheiten und der Skalierung der Variablen ab. Eine Umrechnung der Einheiten, etwa von Zentimetern auf Meter, kann die Größe der Kovarianz drastisch verändern, ohne die zugrunde liegende Beziehung zu beeinflussen.

Aus diesem Grund wird die Kovarianz häufiger als internes Rechenbauteil verwendet als als eigenständige Kennzahl.

Was ist Korrelation?

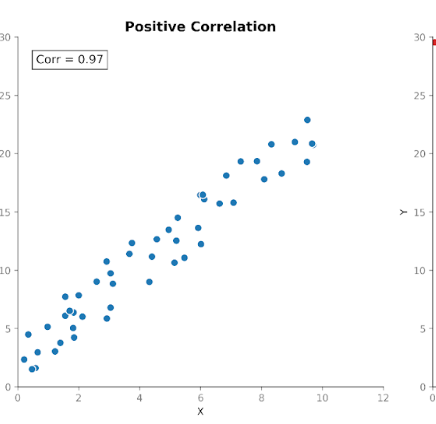

Korrelation misst sowohl die Stärke als auch die Richtung der Beziehung zwischen zwei Variablen. Sie baut auf der Kovarianz auf, indem sie den Betrag standardisiert, sodass Einheiten keinen Einfluss mehr haben.

Korrelationswerte liegen stets in einem festen Bereich zwischen +1 (perfekt positiv) und -1 (perfekt negativ). Ein Wert von 0 bedeutet, dass kein linearer Zusammenhang besteht.

Diese standardisierte Skala macht die Korrelation leichter interpretierbar als die Kovarianz. Wenn wir einen Wert von 0,8 sehen, wissen wir sofort, dass ein starker Zusammenhang besteht – unabhängig von den ursprünglichen Maßeinheiten.

Diese Standardisierung ermöglicht außerdem sinnvolle Vergleiche über Datensätze, Merkmale und Domänen hinweg. Deshalb wird die Korrelation so häufig in der explorativen Datenanalyse und bei Feature-Untersuchungen eingesetzt.

Kovarianz vs. Korrelation: Die wichtigsten Unterschiede

Kovarianz und Korrelation beschreiben verwandte Eigenschaften von Variablenbeziehungen, dienen aber unterschiedlichen analytischen Zwecken.

Praktisch betrachtet spiegelt die Kovarianz die rohe Mit-Variabilität wider, während die Korrelation dieselbe Beziehung in standardisierter Form darstellt. Dieses Verständnis hilft dir, das passende Maß für deine Analyseaufgabe zu wählen.

|

Kovarianz |

Korrelation |

|

|

Misst |

Linearen Zusammenhang (nicht standardisiert) |

Linearen Zusammenhang (standardisiert) |

|

Skalensensitivität |

Skala wird durch Einheiten bestimmt |

Fester Bereich (−1 bis +1) |

|

Einheiten |

Hat Einheiten |

Einheitenfrei |

|

Interpretierbarkeit |

Betrag schwer zu deuten |

Richtung und Betrag leicht zu deuten |

|

Vergleichbarkeit |

Begrenzte Vergleichbarkeit über Datensätze hinweg |

Direkt vergleichbar über Datensätze hinweg |

|

Typische Nutzung |

Modellierung und Matrixkonstruktion |

Exploration und Kommunikation |

|

Vorteil |

Erhält die Originalskala |

Standardisiert für den Vergleich |

Beispiel: Kovarianz vs. Korrelation

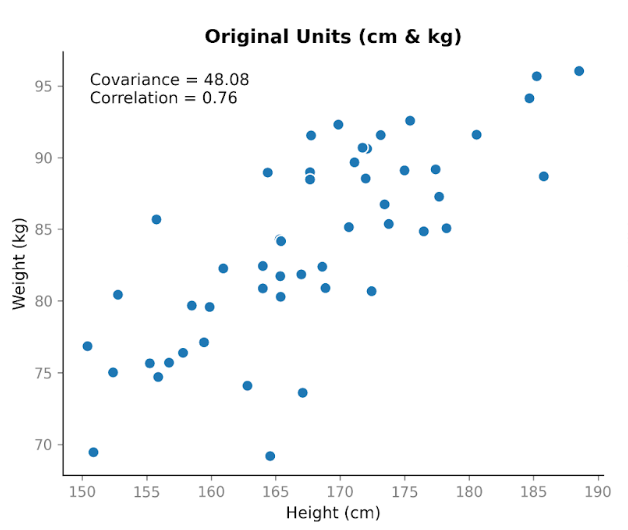

Angenommen, wir erheben Daten zu zwei Variablen: Größe und Gewicht. Wir erwarten einen Zusammenhang, da größere Menschen im Allgemeinen mehr wiegen. Tragen wir die Körpergröße in Zentimetern gegen das Gewicht in Kilogramm auf, sehen wir einen klaren Aufwärtstrend. Mit zunehmender Größe nimmt typischerweise auch das Gewicht zu.

Berechnen wir die Kovarianz, erhalten wir einen positiven Wert: 48,08. Dass er positiv ist, zeigt, dass sich beide Variablen in dieselbe Richtung bewegen. Liegt die Größe über dem Durchschnitt, ist in der Regel auch das Gewicht über dem Durchschnitt.

Jetzt wird es spannend: Wir nehmen exakt dieselben Daten und ändern nur die Einheiten. Wir wandeln die Größe von Zentimetern in Meter und das Gewicht von Kilogramm in Pfund um. Die Personen haben sich nicht verändert. Die Beziehung hat sich nicht verändert. Das Muster im Streudiagramm sieht gleich aus. Doch die neu berechnete Kovarianz ist anders: 1,06. Immer noch positiv, aber der Betrag ist sehr unterschiedlich. Und wir haben nur die Einheiten geändert.

Das zeigt eine wichtige Eigenschaft der Kovarianz: Sie erfasst die Richtung, aber ihr Betrag hängt von der Skala ab. Strecken oder stauchen wir eine Variable durch Einheitenwechsel, wird auch die Kovarianz größer oder kleiner.

Betrachten wir nun die Korrelation mit denselben Daten vor und nach der Umrechnung. Die Korrelation mit Zentimetern und Kilogramm beträgt 0,76. Nach der Umrechnung in Meter und Pfund beträgt sie weiterhin 0,76.

Im Gegensatz zur Kovarianz berücksichtigt die Korrelation zunächst die Variabilität jeder Variable, bevor sie den Zusammenhang misst. Durch diese Anpassung ändert sich der Wert beim Einheitenwechsel nicht. Er spiegelt nur wider, wie eng die Punkte einem linearen Muster folgen und ob die Tendenz nach oben oder unten verläuft.

Dieses einfache Beispiel zeigt den Hauptunterschied: Die Kovarianz bildet Richtung und Skala ab, während die Korrelation die Beziehungsstärke unabhängig von der Skala widerspiegelt. In der Praxis ist die Korrelation daher zuverlässiger für Vergleiche von Beziehungen über unterschiedlich skalierte Variablen hinweg, während die Kovarianz dort relevant ist, wo der Variabilitätsbetrag zählt, etwa in der Modellierung.

Kovarianz ist oft schwer zu interpretieren

Wie besprochen, zeigt die Kovarianz, ob sich zwei Variablen in dieselbe Richtung bewegen, doch ihr Betrag ist schwer zu interpretieren.

Das Hauptproblem: Die Kovarianz hängt von der Skala der Variablen ab, nicht nur von ihrer Beziehung. Sind die Werte einer oder beider Variablen größer oder breiter gestreut, fällt die Kovarianz tendenziell ebenfalls größer aus.

Diese Empfindlichkeit hat zwei Ursachen. Erstens die Maßeinheiten der Daten. Einheitenwechsel verändert die Kovarianz. Einkommen in Dollar versus Tausend Dollar zu messen, liefert sehr unterschiedliche Kovarianzwerte, obwohl die Beziehung identisch ist.

Zweitens die Variabilität der Variable. Auch bei gleichen Einheiten erzeugt ein Datensatz mit größerer Spannweite in der Regel eine höhere Kovarianz als ein enger Datensatz mit gleicher zugrunde liegender Beziehung. Eine große Kovarianz bedeutet also nicht zwingend einen starken Zusammenhang. Sie kann schlicht größere Skalen oder höhere Streuung widerspiegeln.

Wegen dieser Skalenempfindlichkeit wird die Kovarianz oft intern genutzt, etwa zum Fitten von Modellen, statt als Ergebnis berichtet.

Warum Korrelation häufiger genutzt wird

Die Korrelation umgeht viele Interpretationsprobleme der Kovarianz, indem sie die Beziehung zwischen Variablen standardisiert. Da Korrelationswerte immer zwischen −1 und +1 liegen, ist der Betrag sofort aussagekräftig: Werte nahe 1 oder −1 zeigen starke lineare Beziehungen, Werte nahe 0 einen schwachen oder keinen linearen Zusammenhang. Diese Standardisierung erlaubt auch direkte Vergleiche über Variablen oder Datensätze hinweg und erleichtert Kommunikation und Interpretation.

Diese Eigenschaften machen die Korrelation besonders nützlich für explorative Analysen, die Untersuchung von Feature-Zusammenhängen, das Erkennen von Redundanz oder Multikollinearität sowie für die Ergebnisberichterstattung. Korrelationsmatrizen und Heatmaps sind zudem hervorragende First-Look-Tools für Datensätze.

Allerdings ersetzt die Korrelation die Kovarianz nicht vollständig. Weil sie Skaleneffekte entfernt, bildet sie nur die Beziehungsstärke ab, nicht die rohe Variabilität. In der Modellierung, etwa bei der Hauptkomponentenanalyse oder multivariaten Verfahren, kann die von der Kovarianz eingefangene Originalskala wichtig sein, um die Varianzstruktur zu verstehen und das Verhalten von Algorithmen zu steuern.

Ein Blick aus der Linearen Algebra

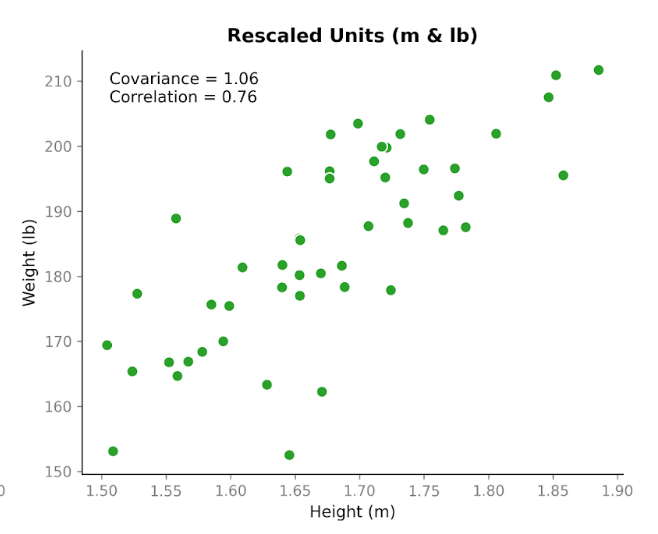

Bisher haben wir die Kovarianz paarweise betrachtet. Die Lineare Algebra zeigt, wie wir das Konzept auf den gesamten Datensatz skalieren: indem wir die Daten in einer Matrix anordnen.

In einer einfachen Datenmatrix repräsentiert jede Zeile eine Beobachtung und jede Spalte eine Variable. Um Beziehungen zu verstehen, zentrieren wir zunächst die Daten, indem wir vom Spaltenmittelwert jeden Wert abziehen. So betrachten wir Abweichungen von typischen Werten statt absolute Werte.

Multiplizieren wir die zentrierte Datenmatrix mit ihrer Transponierten, erhalten wir eine Struktur, die erfasst, wie Variablen gemeinsam variieren. Dieses Produkt ist – nach geeigneter Skalierung – die Kovarianzmatrix. Aus Sicht der Linearen Algebra fasst die Kovarianzmatrix zusammen, wie sich die Variabilität über die Dimensionen des Datensatzes verteilt.

So gedacht wird klar, warum die Kovarianz in der Data Science so häufig vorkommt. Viele Algorithmen, darunter die Hauptkomponentenanalyse (PCA) und andere Dimensionalitätsreduktionsverfahren, stützen sich auf diese Matrixdarstellung, um Muster und Strukturen in den Daten zu erkennen. Konzeptionell liefert die Kovarianzmatrix eine Landkarte der Interaktionen zwischen den Dimensionen des Datensatzes.

Hier sehen wir Daten für vier Variablen in einer Datenmatrix. Sie wird zentriert und zur Bildung einer Kovarianzmatrix genutzt.

Wenn du tiefer in Lineare Algebra für Data Science einsteigen möchtest, schau dir unseren Linear Algebra for Data Science in R-Kurs an, der die Grundlagen für matrixbasierte Ansätze wie die Kovarianz vermittelt.

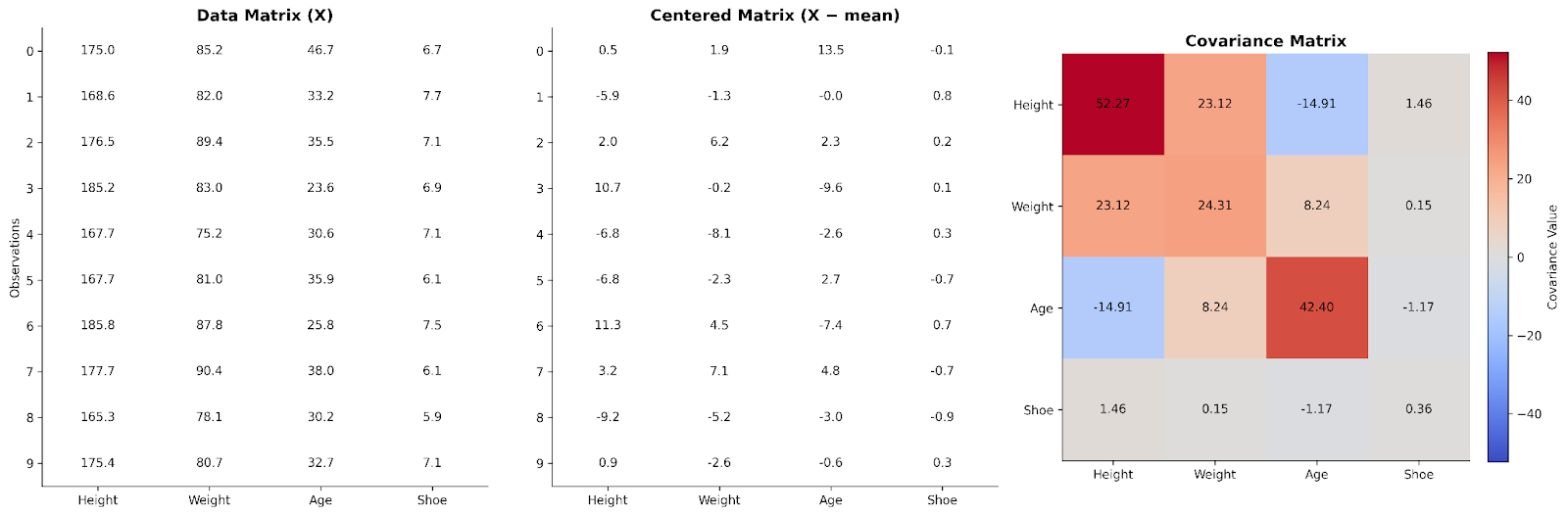

Kovarianz- und Korrelationsmatrizen

Die Kovarianzmatrix fasst zusammen, wie Variablen über einen gesamten Datensatz gemeinsam variieren. In der Praxis betrachten wir diese Beziehungen oft mithilfe von Kovarianz- oder Korrelationsmatrizen – je nachdem, ob wir die Originalskala beibehalten oder die Ergebnisse standardisieren wollen.

Eine Kovarianzmatrix enthält die Kovarianzen aller Variablenpaare. Die Diagonale zeigt die Varianz jeder Variable, die Nebendiagonalen spiegeln die gemeinsame Veränderung zwischen Variablen wider. Weil die Kovarianz Skala und Einheiten erhält, bildet die Matrix die rohe Struktur der Variabilität ab. Das macht Kovarianzmatrizen besonders nützlich in Modellierungsworkflows und multivariaten Analysen.

Eine Korrelationsmatrix hingegen standardisiert diese Beziehungen. Jeder Diagonaleintrag ist 1, da jede Variable perfekt mit sich selbst korreliert. Alle Nebendiagonalen liegen zwischen −1 und +1 und zeigen die Korrelation zwischen Variablen. Durch das Entfernen von Skaleneffekten sind Korrelationsmatrizen für Menschen leichter zu interpretieren und erlauben direkte Vergleiche. Sie sind besonders nützlich in der explorativen Datenanalyse, um starke oder schwache lineare Beziehungen zwischen Features schnell zu erkennen.

In diesen Matrizen vergleichen wir vier Variablen miteinander. Ich füge bei Präsentationen gern eine Heatmap-Überlagerung hinzu. Die Zellfarben machen auf einen Blick die relative Größe der Kovarianz- oder Korrelationswerte sichtbar.

So wandelst du Kovarianz in Korrelation um

Konzeptionell leitet sich die Korrelation aus der Kovarianz ab, indem die Beziehung zwischen Variablen standardisiert wird. Du teilst die Kovarianz einfach durch die Standardabweichung jeder Variable. Diese Skalierung entfernt Einheiten und Beträge und ergibt ein standardisiertes Maß, das immer zwischen −1 und +1 liegt. Deshalb sind Korrelationswerte direkt über verschiedene Variablen oder Datensätze hinweg vergleichbar.

In der Praxis übernimmt das die meiste Statistiksoftware automatisch, sodass man selten manuell rechnen muss. Es ist jedoch wichtig zu verstehen, was die Software im Hintergrund tut. Zum Beispiel erklärt das Verständnis der Umrechnung von Kovarianz in Korrelation, warum die Umkehrung nicht möglich ist – zumindest nicht ohne Informationen zu den Standardabweichungen beider Variablen. Die Korrelation enthält keine Einheiten oder Betragsinformationen mehr, die für die Rückrechnung zur Kovarianz nötig wären.

Wann du Kovarianz und Korrelation einsetzt

Die Kovarianz ist am nützlichsten, wenn Skala und Einheiten der Daten bedeutsam sind oder wenn du die rohe Struktur der Variabilität benötigst. Sie wird häufig in multivariaten Modellen, probabilistischen Modellen und beim Aufbau von Kovarianzmatrizen für linearalgebraische Methoden eingesetzt. In diesen Kontexten ermöglicht die Erhaltung der Originalvariabilität, dass Algorithmen die wahre Struktur der Daten erfassen und verstehen, wie Dimensionen gemeinsam variieren.

Die Korrelation eignet sich hingegen besser für menschliche Interpretation, Vergleiche zwischen Datensätzen und explorative Analysen. Ich nutze dieses Maß gern in Visualisierungen wie Heatmaps, um Beziehungen auf einen Blick zu sehen und zu kommunizieren. Weil die Korrelation standardisiert, hilft sie auch bei der Vorbereitung der Daten für Verfahren, bei denen eine vergleichbare Skala aller Features wichtig sein kann.

Kovarianz vs. Korrelation in Data Science und Statistik

Oft tauchen beide Maße im selben Workflow auf. Kovarianzmatrizen bilden das mathematische Fundament vieler multivariater Techniken, weil sie die ursprüngliche Variabilität erhalten. Korrelationsmatrizen werden dagegen häufig in der explorativen Phase genutzt, um die Struktur des Datensatzes vor der Modellierung zu verstehen.

Manche Modelle können je nach Ziel beides verwenden – etwa die Hauptkomponentenanalyse (PCA). Wird PCA auf Basis einer Kovarianzmatrix durchgeführt, beeinflussen Variablen mit größerer Varianz die Komponenten stärker. Das kann wünschenswert sein, wenn Skalendifferenzen echte Unterschiede in der Variabilität widerspiegeln. Analysierst du zum Beispiel tägliche Aktienrenditen, kann ein volatilerer Titel die Hauptkomponenten sinnvoll prägen, weil diese Variabilität reales Marktverhalten abbildet.

Wird stattdessen eine Korrelationsmatrix genutzt, werden die Variablen vor der Zerlegung standardisiert. Jedes Feature liegt auf derselben Skala, sodass keine Variable dominiert, nur weil sie größere Einheiten oder eine breitere Zahlenrange hat. Das ist etwa dann geeigneter, wenn Variablen in unterschiedlichen Einheiten gemessen werden, zum Beispiel Größe (cm), Gewicht (kg), Blutdruck (mmHg) und Cholesterin (mg/dL).

Kein Ansatz ist grundsätzlich besser. Die richtige Wahl hängt davon ab, ob Skalendifferenzen eine sinnvolle Struktur ausdrücken oder lediglich Messartefakte sind.

Häufige Missverständnisse zu Kovarianz und Korrelation

Ein verbreitetes Missverständnis ist, dass eine hohe Kovarianz automatisch eine starke Beziehung bedeutet. Große Kovarianzwerte können jedoch schlicht die Skala oder Streuung der Variablen widerspiegeln – nicht die Stärke des Zusammenhangs. Wenn du die Beziehungsstärke wissen willst, musst du standardisieren und auf die Korrelation schauen.

Den Satz „Korrelation impliziert keine Kausalität“ hast du vermutlich schon unzählige Male gehört – und dennoch ist es das häufigste Missverständnis. Es ist nachvollziehbar, bei starker Korrelation eine kausale Verbindung zu vermuten. Dieses mentale Shortcut hat unserem Gehirn über Jahrtausende das Überleben gesichert. Als Datenprofis müssen wir jedoch widerstehen: Korrelation allein belegt keine Kausalität. Sie misst Assoziation, keine Ursache-Wirkungs-Beziehung, und externe Faktoren können beide Variablen gleichzeitig beeinflussen.

Ebenfalls häufig: Kovarianz und Korrelation seien im Grunde dasselbe. Das stimmt nicht. Zwar leitet sich die Korrelation aus der Kovarianz ab, doch sie standardisiert die Beziehung und ist damit ein anderes Maß, das nicht immer als Ersatz in Berechnungen taugt.

Zuletzt wichtig: Beide Kennzahlen bewerten nur lineare Zusammenhänge. Es können nichtlineare Muster existieren, selbst wenn Korrelation und Kovarianz niedrig oder nahe null sind. Sich ausschließlich auf diese Statistiken zu stützen, kann wichtige Strukturen übersehen. Ich empfehle immer: Plotte deine Daten und schau sie dir an, bevor du interpretierst. Das rettet dich, wenn ein offensichtlicher nichtlinearer Zusammenhang vorliegt.

Profi-Tipps zur Interpretation von Variablenbeziehungen

Erstens: Achte immer auf die Skala deiner Messung. Unterschiede in Einheiten oder Streuung beeinflussen rohe Maße wie die Kovarianz – du solltest wissen, was deine Zahlen repräsentieren.

Zweitens: Kläre, was du von deinen Daten brauchst. Die Kovarianz ist am hilfreichsten, wenn die rohe Variabilität wichtig ist. Das ist oft in der Modellierung oder beim Aufbau von Kovarianzmatrizen für multivariate Analysen der Fall. Dort trägt die Größenordnung der Variation sinnvolle Information. Wenn du diese Rohvariabilität nicht brauchst, profitierst du von der Standardisierung und Interpretierbarkeit der Korrelation.

Drittens: Immer, immer, immer Daten plotten! Visuelle Prüfungen leiten die Analyse und ergänzen statistische Zusammenfassungen. Nutze Scatterplots für Paarbeziehungen oder Matrizen, um viele Variablen auf einen Blick zu überblicken.

Und zuletzt: Denke an die Folgen deiner Messwahl. Ob du ein rohes Maß wie Kovarianz oder ein standardisiertes wie Korrelation nutzt, beeinflusst Modellierung und Interpretation. Richte deine Wahl daher an deinen Analysezielen aus.

Fazit

Kovarianz und Korrelation beschreiben eng verwandte Phänomene gemeinsamer Variabilität, erfüllen aber unterschiedliche Zwecke: Die Kovarianz erhält die Originalskala, die Korrelation standardisiert für den Vergleich.

Wenn du mehr darüber lernen willst, wie du deine Daten erkundest, schau dir das Python Exploratory Data Analysis Tutorial an. Und wenn du herausfinden möchtest, ob eine Korrelation wirklich Kausalität nahelegt, sieh dir Hypothesis Testing in R an.

Ich bin promoviert und habe 13 Jahre Erfahrung in der Arbeit mit Daten in der biologischen Forschung. Ich entwickle Software in verschiedenen Programmiersprachen, darunter Python, MATLAB und R. Meine Leidenschaft ist es, meine Liebe zum Lernen mit der Welt zu teilen.

FAQs

Was ist der Unterschied zwischen Kovarianz und Korrelation?

Beide messen, wie sich Variablen gemeinsam bewegen. Die Kovarianz erhält jedoch Skala und Einheiten, während die Korrelation standardisiert und so Vergleiche erleichtert.

Ist eine hohe Kovarianz gleichbedeutend mit einer starken Beziehung?

Nicht unbedingt. Die Größenordnung der Kovarianz wird stark von Skala und Streuung beeinflusst. Um die Stärke der Beziehung zu bestimmen, ist die Korrelation das bessere Maß.

Funktionieren Kovarianz oder Korrelation auch bei nichtlinearen Beziehungen?

Nicht zuverlässig. Diese Statistiken sind nur für die Bewertung linearer Beziehungen gedacht.

Warum hat die Korrelation keine Einheiten?

Bei der Umrechnung von Kovarianz in Korrelation werden die Einheiten herausdividiert, sodass die Korrelation einheitslos ist.

Sollte ich für meine PCA Kovarianz oder Korrelation nutzen?

PCA kann entweder mit einer Kovarianz- oder mit einer Korrelationsmatrix durchgeführt werden. Sind Größenunterschiede zwischen Variablen bedeutsam und vergleichbar, bildet eine Kovarianzmatrix diese Variation ab. Sind die Einheiten jedoch nicht direkt vergleichbar, standardisiert eine Korrelationsmatrix die Beziehungen. Die Wahl hängt von deinen Variablen und deinem Ziel ab.