Curso

Em análise de dados, estamos sempre tentando entender como as variáveis se relacionam. Você provavelmente já se deparou com duas medidas estatísticas muito usadas para isso: covariância e correlação. Elas soam parecidas e costumam ser confundidas. Mas qual a diferença entre elas e como usar cada uma?

Ambas descrevem como variáveis se movem juntas. No entanto, apesar das semelhanças, covariância e correlação respondem a perguntas ligeiramente diferentes e, por isso, cumprem papéis distintos no fluxo de trabalho com dados. A covariância captura a variabilidade conjunta bruta entre os atributos, enquanto a correlação padroniza essa relação para facilitar a comparação.

Vamos explorar como essa diferença sutil afeta a escolha da medida em diferentes contextos.

O que é covariância?

Covariância mede como duas variáveis se movem juntas. Ela indica se aumentos em uma variável tendem a coincidir com aumentos ou diminuições na outra. Há três tipos de covariância:

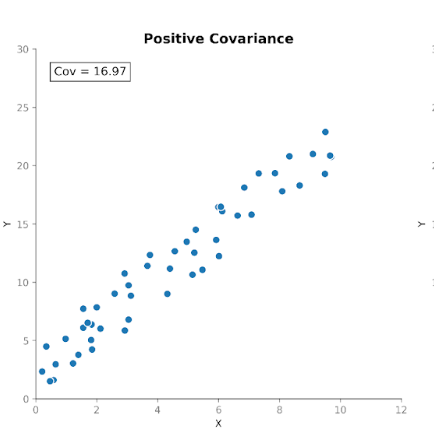

- Covariância positiva: quando uma variável aumenta à medida que a outra aumenta.

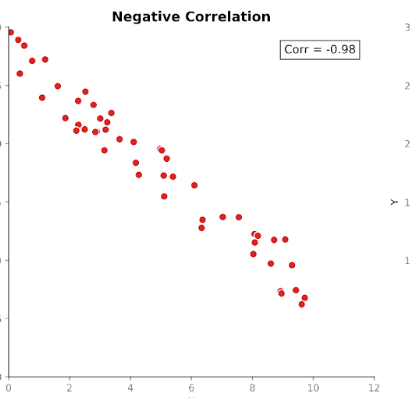

- Covariância negativa: quando uma variável aumenta enquanto a outra diminui.

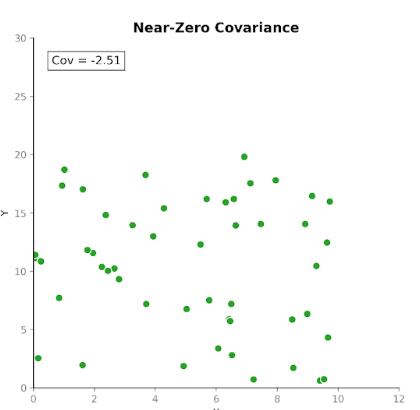

- Covariância próxima de zero: quando não há uma relação direcional consistente.

Isso torna a covariância útil para detectar como variáveis se movem em relação umas às outras.

Porém, embora a direção da relação seja útil, interpretar a magnitude da covariância não é tão simples. A magnitude depende das unidades de medida e da escala das variáveis. Converter unidades, por exemplo, de centímetros para metros, pode mudar drasticamente a magnitude da covariância sem afetar a relação subjacente.

Por esse motivo, a covariância é usada com mais frequência como um bloco de construção computacional interno do que como uma estatística descritiva isolada.

O que é correlação?

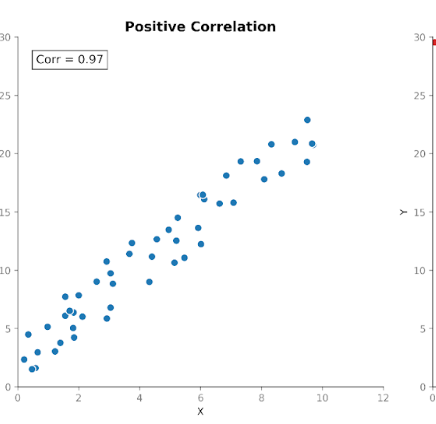

Correlação mede a força e a direção da relação entre duas variáveis. Ela parte da covariância, mas padroniza a magnitude para que as unidades não a influenciem.

Os valores de correlação ficam em um intervalo fixo entre +1 (relação perfeitamente positiva) e -1 (relação perfeitamente negativa). Um valor 0 indica ausência de relação linear.

Essa escala padronizada torna a correlação mais fácil de interpretar do que a covariância. Se vemos um valor de 0,8, sabemos imediatamente que há uma relação forte entre as variáveis, independentemente das unidades usadas na medição original.

Essa padronização também permite comparações significativas entre conjuntos de dados, atributos e domínios. Por isso a correlação é tão usada em análises exploratórias e investigações de features.

Covariância vs. correlação: principais diferenças

Covariância e correlação descrevem propriedades relacionadas dos vínculos entre variáveis, mas servem a propósitos analíticos diferentes.

Na prática, a covariância reflete a co-variabilidade bruta, enquanto a correlação reflete essa mesma relação em forma padronizada. Entender essa distinção ajuda a determinar qual medida se ajusta melhor à tarefa analítica.

|

Covariância |

Correlação |

|

|

Mede |

Relação linear (não padronizada) |

Relação linear (padronizada) |

|

Sensibilidade à escala |

Escala ditada pelas unidades |

Intervalo fixo (−1 a +1) |

|

Unidades |

Tem unidades |

Sem unidade |

|

Interpretabilidade |

Magnitude difícil de interpretar |

Direção e magnitude fáceis de interpretar |

|

Comparabilidade |

Comparabilidade limitada entre datasets |

Comparável diretamente entre datasets |

|

Uso comum |

Modelagem e construção de matrizes |

Exploração e comunicação |

|

Vantagem |

Preserva a escala original |

Padroniza para comparação |

Exemplo de covariância vs. correlação

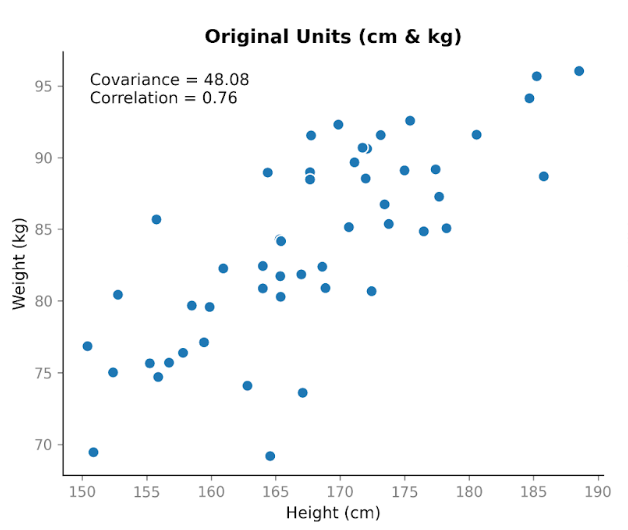

Suponha que coletamos dados de duas variáveis: altura e peso. Esperamos que sejam relacionadas, já que, em geral, pessoas mais altas tendem a pesar mais. Ao plotar altura em centímetros contra peso em quilogramas, vemos uma tendência ascendente clara. Conforme a altura aumenta, o peso tende a aumentar também.

Ao calcular a covariância, obtemos um valor positivo: 48,08. O fato de ser positivo nos diz que as duas variáveis se movem na mesma direção. Quando a altura está acima da média, o peso geralmente também está acima da média.

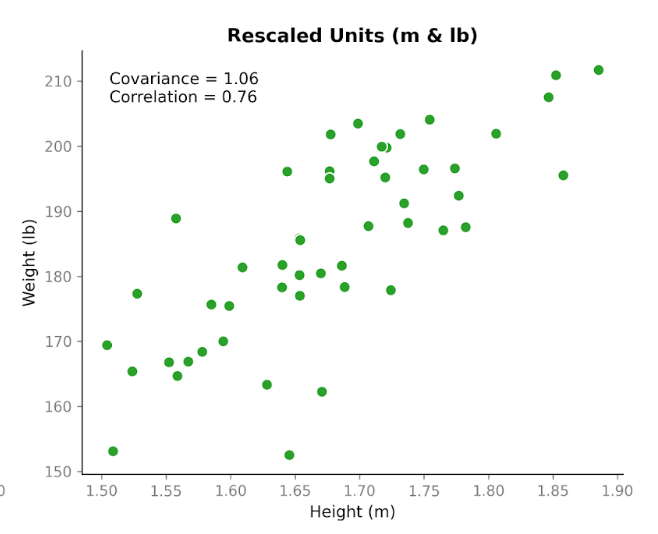

Agora vem a parte interessante. Vamos pegar exatamente os mesmos dados e mudar as unidades. Converteremos a altura de centímetros para metros e o peso de quilogramas para libras. As pessoas não mudaram. A relação não mudou. O padrão no gráfico de dispersão parece o mesmo. Mas, ao recalcular a covariância, o número é diferente: 1,06. Continua positivo, mas a magnitude é bem diferente. E a única coisa que mudamos foram as unidades.

Isso mostra uma propriedade importante da covariância: ela captura a direção, mas sua magnitude depende da escala. Se esticarmos ou encolhermos uma das variáveis ao mudar as unidades, a covariância também se estica ou encolhe.

Agora, vamos olhar a correlação usando os mesmos dados antes e depois da conversão de unidades. A correlação usando centímetros e quilogramas é 0,76. Após converter para metros e libras, continua sendo 0,76.

Diferente da covariância, a correlação ajusta a variabilidade de cada variável antes de medir a relação entre elas. Por causa desse ajuste, o valor não muda quando trocamos as unidades. Ela foca em quão bem os pontos seguem um padrão linear e se esse padrão tem inclinação positiva ou negativa.

Este exemplo simples destaca a principal diferença entre essas métricas: a covariância reflete direção e escala, enquanto a correlação reflete a força da relação independentemente da escala. Na prática, isso significa que a correlação é mais confiável para comparar relações entre variáveis medidas em escalas diferentes, enquanto a covariância é mais relevante quando a magnitude da variabilidade importa, como em modelagem.

Covariância pode ser difícil de interpretar

Como vimos, a covariância nos diz se duas variáveis se movem na mesma direção, mas sua magnitude é difícil de interpretar.

O principal problema é que a covariância depende da escala das variáveis, não apenas da relação entre elas. Se os valores de uma ou ambas as variáveis forem maiores ou mais espalhados, a covariância também tende a ser maior.

Essa sensibilidade vem de duas fontes. A primeira são as unidades dos dados. Mudar as unidades muda a covariância. Medir renda em reais versus milhares de reais produz valores de covariância bem diferentes, embora a relação seja idêntica.

A segunda fonte é a quantidade de variabilidade na variável. Mesmo mantendo as unidades, um conjunto de dados com maior faixa ou dispersão geralmente produz uma covariância maior do que um conjunto mais concentrado com a mesma relação subjacente. Uma covariância alta não indica necessariamente uma relação forte. Ela pode simplesmente refletir escalas maiores ou maior variabilidade nos dados.

Por causa dessa sensibilidade à escala, a covariância costuma ser usada internamente, como no ajuste de modelos, em vez de ser reportada diretamente.

Por que a correlação é usada com mais frequência

A correlação resolve muitos dos desafios de interpretabilidade da covariância ao padronizar a relação entre variáveis. Como os valores de correlação sempre ficam entre −1 e +1, a magnitude é imediatamente significativa: valores próximos de 1 ou −1 indicam relações lineares fortes, enquanto valores perto de 0 indicam relação linear fraca ou inexistente. Essa padronização também permite comparações diretas entre variáveis ou datasets, facilitando a comunicação e a interpretação.

Essas propriedades tornam a correlação particularmente útil para análise exploratória, inspeção de relações entre features, detecção de redundância ou multicolinearidade e comunicação de achados. Matrizes e heatmaps de correlação também são ótimas como primeira passada ao examinar datasets.

Dito isso, a correlação não substitui completamente a covariância. Como a correlação remove os efeitos de escala, ela reflete apenas a força da relação, não a variabilidade bruta. Em contextos de modelagem, como análise de componentes principais ou modelos estatísticos multivariados, a escala original capturada pela covariância pode ser importante para entender a estrutura de variância e orientar o comportamento dos algoritmos.

Uma perspectiva de álgebra linear

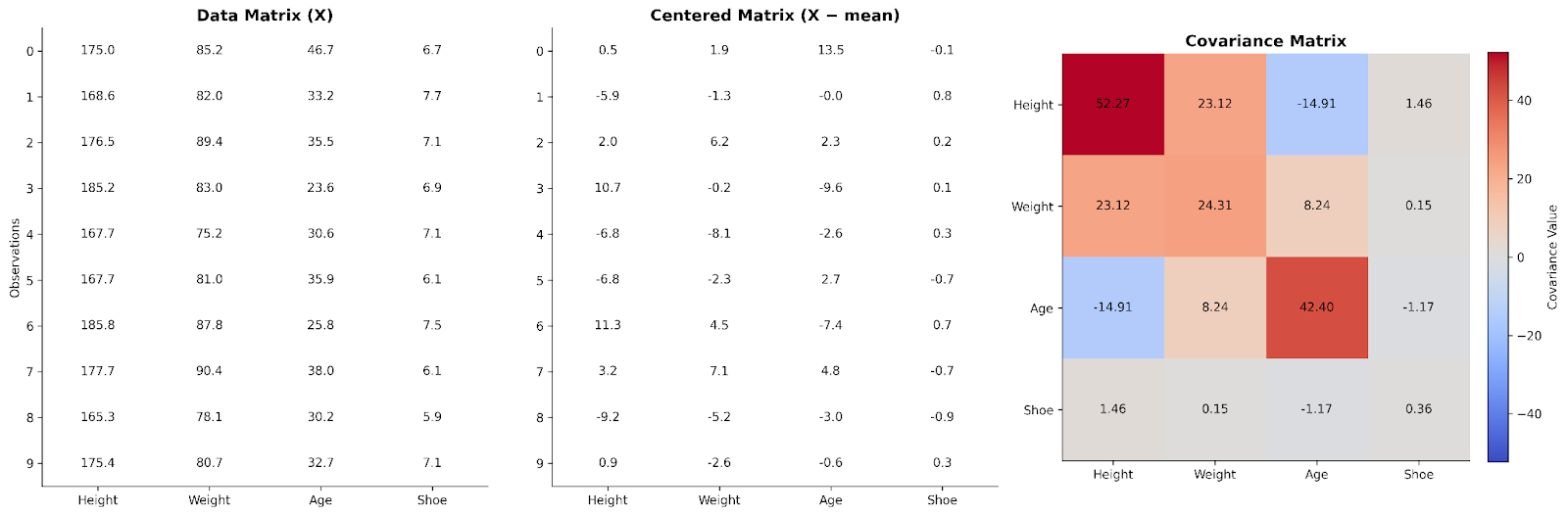

Até aqui, vimos a covariância entre variáveis aos pares. A álgebra linear mostra como ampliar essa ideia para o dataset inteiro de uma vez. Fazemos isso organizando os dados em uma matriz.

Em uma matriz de dados básica, cada linha representa uma observação e cada coluna, uma variável. Para entender as relações entre variáveis, podemos primeiro centralizar os dados subtraindo a média da coluna de cada valor. Essa etapa garante que estamos focando nos desvios em relação aos valores típicos, e não nos valores absolutos.

Multiplicar a matriz de dados centralizada por sua transposta produz uma estrutura que captura como as variáveis se movem juntas. Esse produto, após o escalonamento, é a matriz de covariância. Do ponto de vista da álgebra linear, a matriz de covariância resume como a variabilidade é distribuída pelas dimensões do dataset.

Pensar na covariância dessa forma ajuda a explicar por que ela aparece com tanta frequência em ciência de dados. Muitos algoritmos, incluindo principal component analysis (PCA) e outras técnicas de redução de dimensionalidade, dependem dessa representação matricial para entender padrões e estrutura nos dados. Conceitualmente, a matriz de covariância fornece um mapa de como as diferentes dimensões do dataset interagem.

Aqui vemos dados de quatro variáveis organizados em uma matriz de dados. Ela é então centralizada e usada para construir uma matriz de covariância.

Se você quiser se aprofundar em álgebra linear para ciência de dados, confira nosso curso Linear Algebra for Data Science in R, que cobre as bases necessárias para entender abordagens baseadas em matrizes, como a covariância.

Matrizes de covariância e de correlação

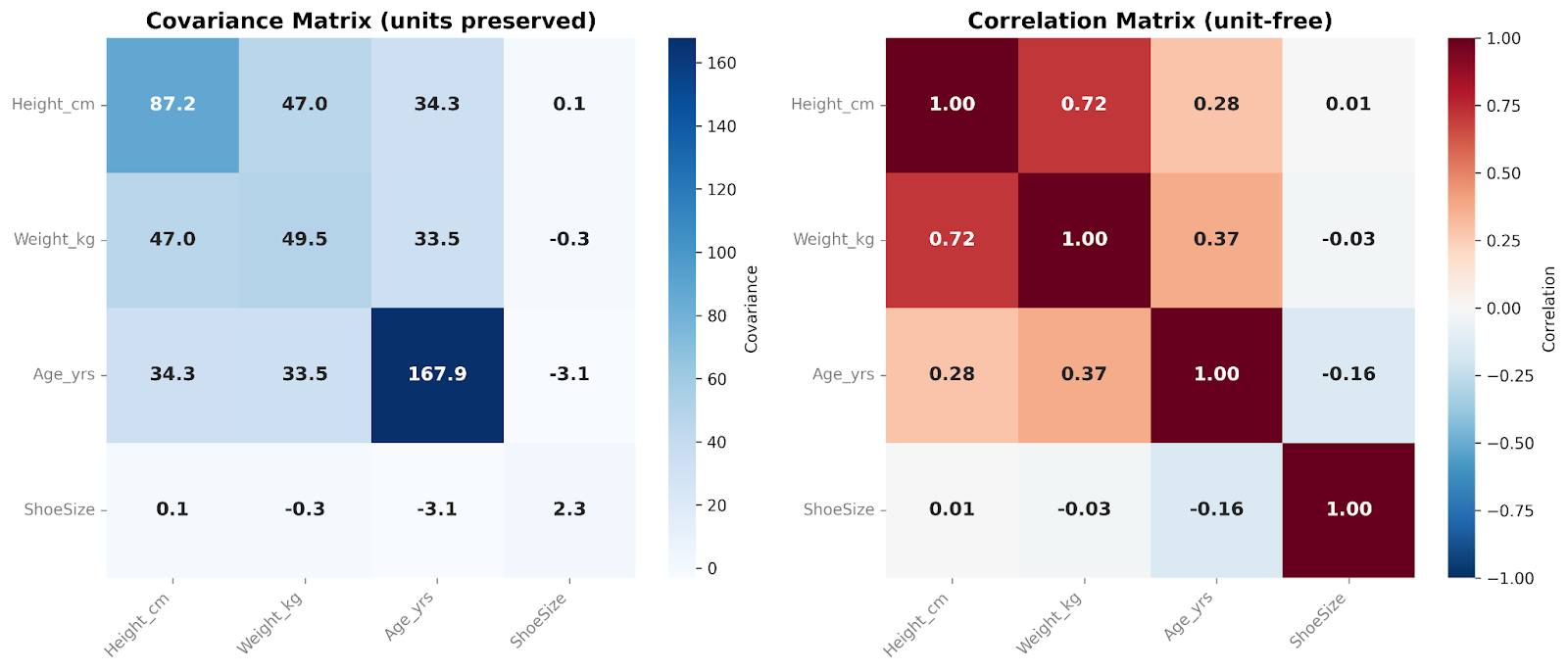

A matriz de covariância resume como variáveis se movem juntas em todo o dataset. Na prática, costumamos examinar essas relações usando matrizes de covariância ou de correlação, dependendo se queremos preservar a escala original ou padronizar os resultados.

Uma matriz de covariância contém as covariâncias entre todos os pares de variáveis. Os números na diagonal mostram a variância de cada variável, enquanto os fora da diagonal refletem como as variáveis mudam juntas. Como a covariância preserva a escala e as unidades originais, a matriz captura a estrutura bruta da variabilidade. Isso torna as matrizes de covariância especialmente úteis em fluxos de modelagem e análises multivariadas.

Uma matriz de correlação, por outro lado, padroniza essas relações. Cada entrada da diagonal é igual a 1, já que toda variável se correlaciona perfeitamente consigo mesma. Todos os valores fora da diagonal ficam entre −1 e +1, mostrando a correlação entre variáveis. Ao remover os efeitos de escala, matrizes de correlação são mais fáceis de interpretar e permitem comparação direta entre variáveis. Elas são especialmente úteis na análise exploratória e para identificar rapidamente relações lineares fortes ou fracas entre features.

Nessas matrizes, estamos comparando quatro variáveis entre si. Eu gosto de adicionar um overlay de heatmap ao apresentar essas matrizes. A cor de cada célula ajuda a ver, de relance, a magnitude relativa dos valores de covariância ou correlação.

Como converter covariância em correlação

Conceitualmente, a correlação é derivada da covariância ao padronizar a relação entre variáveis. Basta dividir a covariância pelo desvio-padrão de cada variável. Esse escalonamento remove as unidades e a magnitude das variáveis, gerando uma medida padronizada que sempre fica entre −1 e +1. Essa transformação explica por que valores de correlação são diretamente comparáveis entre variáveis ou datasets diferentes.

Na prática, a conversão de covariância para correlação é feita automaticamente na maioria dos softwares estatísticos, então raramente precisamos calculá-la manualmente. Ainda assim, é importante entender o que seu software faz nos bastidores. Por exemplo, entender como a covariância é convertida em correlação explica por que você não consegue converter no sentido oposto (pelo menos não sem a informação do desvio-padrão de ambas). A correlação não contém mais as unidades nem a informação de magnitude necessárias para voltar à covariância.

Quando usar covariância e correlação

A covariância é mais útil quando a escala e as unidades dos dados são significativas ou quando você precisa da estrutura bruta da variabilidade. Ela é comum em modelagem multivariada, modelos probabilísticos e na construção de matrizes de covariância para métodos baseados em álgebra linear. Nesses contextos, preservar a variabilidade original permite que os algoritmos capturem a estrutura real dos dados e entendam como as dimensões variam juntas.

A correlação, por sua vez, é mais adequada para interpretação humana, comparações entre datasets e análises exploratórias. Eu gosto de usar essa métrica em visualizações, como heatmaps, para ver e comunicar essas relações de relance. Como a correlação padroniza a relação, ela também ajuda a preparar os dados para técnicas em que colocar todas as features em escalas comparáveis é importante.

Covariância vs. correlação em data science e estatística

Muitas vezes, ambas as medidas aparecem no mesmo fluxo. Matrizes de covariância formam a base matemática de muitas técnicas multivariadas porque retêm a variabilidade original dos dados. Matrizes de correlação, por outro lado, são usadas com frequência nas etapas exploratórias para entender a estrutura do dataset antes da modelagem.

Alguns modelos podem usar qualquer uma das estatísticas, dependendo do objetivo. Considere a análise de componentes principais (PCA). Quando a PCA é realizada sobre uma matriz de covariância, variáveis com maior variância influenciam mais naturalmente os componentes resultantes. Isso pode ser desejável quando diferenças de escala refletem diferenças significativas de variabilidade. Por exemplo, ao analisar retornos diários de ações, uma ação mais volátil pode, com razão, moldar os componentes principais, pois essa variabilidade reflete o comportamento real do mercado.

Usar uma matriz de correlação, em vez disso, padroniza as variáveis antes da decomposição. Cada feature fica na mesma escala, então nenhuma domina apenas por ter unidades maiores ou uma faixa numérica mais ampla. Essa abordagem pode ser mais adequada quando as variáveis são medidas em unidades diferentes, como altura (cm), peso (kg), pressão arterial (mmHg) e colesterol (mg/dL).

Nenhuma abordagem é universalmente melhor. A escolha apropriada depende de as diferenças de escala refletirem uma estrutura significativa ou serem apenas artefatos de medição.

Equívocos comuns sobre covariância e correlação

Um equívoco comum é achar que uma covariância alta indica automaticamente uma relação forte. No entanto, valores grandes de covariância podem simplesmente refletir a escala ou a variabilidade das variáveis, e não a força da relação. Se você quer saber a força da relação, é preciso padronizá-la olhando a correlação.

Você provavelmente já ouviu a frase "correlação não implica causalidade" um milhão de vezes! Ainda assim, esse é, provavelmente, o equívoco mais comum que encontro. É compreensível olhar uma correlação forte e assumir um vínculo causal. É um atalho que nosso cérebro usa há milênios. Porém, como profissionais de dados, precisamos resistir a esse atalho e reconhecer que a correlação, sozinha, não prova efeito causal. Correlação mede associação, não influência causal, e fatores externos podem estar dirigindo ambas as variáveis ao mesmo tempo.

Outro equívoco muito comum é que covariância e correlação são basicamente a mesma coisa. Não são intercambiáveis. Embora a correlação seja derivada da covariância, ela padroniza a relação, tornando-se uma métrica diferente que nem sempre substitui adequadamente a covariância em cálculos.

Por fim, é importante lembrar que essas estatísticas avaliam apenas relações lineares. Padrões não lineares podem existir mesmo quando correlação e covariância são baixas ou próximas de zero; confiar apenas nessas estatísticas pode ocultar estruturas importantes nos dados. Eu sempre recomendo plotar seus dados e olhar para eles antes de interpretar medidas estatísticas. Isso pode te salvar quando houver uma relação não linear evidente.

Dicas de ouro para interpretar relações entre variáveis

Primeiro, considere sempre a escala da sua medição. Diferenças de unidades ou de variabilidade afetam medidas brutas como a covariância, então é importante saber o que os números representam.

Segundo, entenda o que você precisa dos seus dados. A covariância é mais útil quando preservar a variabilidade bruta é importante. Isso é comum em modelagem ou na construção de matrizes de covariância para análises multivariadas. Nesses contextos, a magnitude da variação carrega informação relevante. Mas, se você não precisa dessa variabilidade bruta, pode preferir a padronização e a interpretabilidade da correlação.

Terceiro: sempre, sempre, sempre plote seus dados e olhe para eles! A inspeção visual pode orientar suas análises e complementa os resumos estatísticos. Use gráficos de dispersão para identificar padrões par a par, ou matrizes para ter uma visão rápida de muitas variáveis de uma vez.

Por fim, pense nas implicações a jusante das suas escolhas de medição. Escolher entre uma medida bruta, como a covariância, e uma padronizada, como a correlação, vai influenciar seus resultados de modelagem e interpretações. Então alinhe sua escolha aos seus objetivos analíticos.

Conclusão

Covariância e correlação são medidas intimamente relacionadas que descrevem como variáveis se movem juntas, mas têm propósitos distintos: a covariância preserva a escala original, enquanto a correlação padroniza para comparação.

Se você quer aprender mais sobre como explorar seus dados, confira o Python Exploratory Data Analysis Tutorial. Para aprender a avaliar se a sua correlação realmente indica causalidade, confira o curso Hypothesis Testing in R.

Sou PhD e tenho 13 anos de experiência trabalhando com dados em um ambiente de pesquisa biológica. Crio software em várias linguagens de programação, incluindo Python, MATLAB e R. Sou apaixonado por compartilhar meu amor pelo aprendizado com o mundo.

FAQs

Qual é a diferença entre covariância e correlação?

Embora ambas meçam como variáveis se movem juntas, a covariância preserva a escala e as unidades, enquanto a correlação padroniza essas medidas para facilitar a comparação.

Covariância alta é o mesmo que relação forte?

Nem sempre. A magnitude da covariância é fortemente afetada pela escala e pela dispersão. Para determinar a força da relação, a correlação é a estatística mais adequada.

Covariância ou correlação funcionam com relações não lineares?

De forma confiável, não. Essas estatísticas avaliam apenas relações lineares.

Por que a correlação não tem unidades?

Ao converter covariância em correlação, as unidades se cancelam na divisão, resultando em um número sem unidade para a correlação.

Devo usar covariância ou correlação na minha PCA?

PCA pode ser feita usando uma matriz de covariância ou de correlação. Se a diferença de magnitudes entre as variáveis é significativa e comparável, uma matriz de covariância capturará essa variação. Porém, se as unidades não são diretamente comparáveis, uma matriz de correlação padroniza as relações. A escolha depende das variáveis usadas e do seu objetivo.