Cours

En analyse de données, nous cherchons en permanence à comprendre comment les variables se relient entre elles. Vous avez probablement rencontré deux mesures statistiques courantes pour cela : la covariance et la corrélation. Elles semblent proches et sont souvent confondues. Mais quelle est la différence, et comment bien les utiliser ?

Toutes deux décrivent la manière dont des variables évoluent de concert. Toutefois, malgré leurs similitudes, covariance et corrélation répondent à des questions légèrement différentes et jouent donc des rôles distincts dans un flux d'analyse. La covariance saisit la variabilité conjointe brute entre des caractéristiques, tandis que la corrélation standardise cette relation pour en faciliter la comparaison.

Voyons comment cette nuance influe sur le choix de l'une ou l'autre mesure selon les situations.

Qu'est-ce que la covariance ?

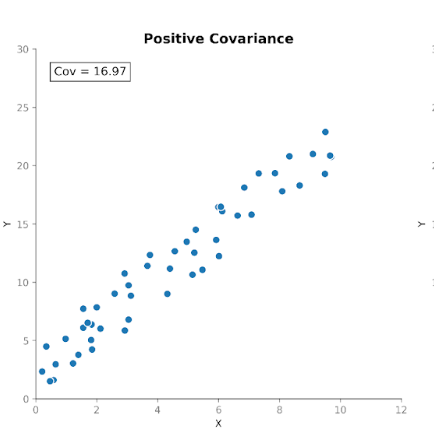

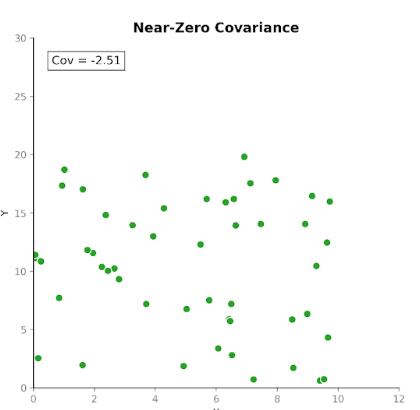

La covariance mesure comment deux variables évoluent ensemble. Elle indique si l'augmentation d'une variable a tendance à coïncider avec l'augmentation ou la diminution d'une autre. On distingue trois types de covariance :

- Covariance positive : quand une variable augmente à mesure que l'autre augmente.

- Covariance négative : quand une variable augmente tandis que l'autre diminue.

- Covariance proche de zéro : lorsqu'il n'y a pas de relation directionnelle systématique.

La covariance est donc utile pour détecter comment des variables évoluent l'une par rapport à l'autre.

Cependant, si le sens de la relation est informatif, l'interprétation de la magnitude de la covariance l'est beaucoup moins. Cette magnitude dépend des unités de mesure et de l'échelle des variables. Convertir des unités, par exemple de centimètres en mètres, peut modifier fortement l'amplitude de la covariance sans affecter la relation sous-jacente.

Pour cette raison, la covariance est plus souvent utilisée comme brique de calcul interne que comme indicateur synthétique pris isolément.

Qu'est-ce que la corrélation ?

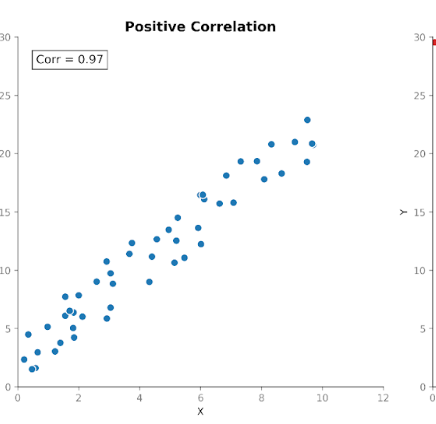

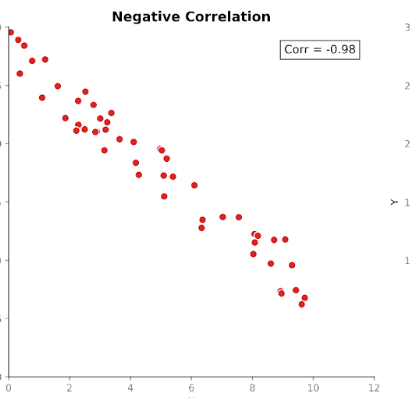

La corrélation mesure à la fois l'intensité et le sens de la relation entre deux variables. Elle s'appuie sur la covariance en en standardisant l'amplitude, de sorte que les unités n'influencent plus la mesure.

Les valeurs de corrélation se situent dans un intervalle fixe, entre +1 (relation parfaitement positive) et −1 (relation parfaitement négative). Une valeur de 0 indique l'absence de relation linéaire.

Cette échelle standardisée rend la corrélation plus facile à interpréter que la covariance. Si nous observons une valeur de 0,8, nous savons immédiatement qu'il existe une relation forte entre les variables, quelles que soient les unités de mesure initiales.

Cette standardisation permet aussi des comparaisons pertinentes entre jeux de données, variables et domaines. C'est pourquoi la corrélation est si couramment utilisée en analyse exploratoire et lors de l'étude de caractéristiques.

Covariance vs corrélation : différences clés

Covariance et corrélation décrivent des propriétés liées des relations entre variables, mais elles servent des objectifs analytiques différents.

Concrètement, la covariance reflète la co-variabilité brute, tandis que la corrélation reflète cette même relation sous forme standardisée. Comprendre cette distinction aide à choisir la mesure la plus adaptée à une tâche analytique donnée.

|

Covariance |

Corrélation |

|

|

Mesure |

Relation linéaire (non standardisée) |

Relation linéaire (standardisée) |

|

Sensibilité à l'échelle |

Échelle dictée par les unités |

Plage fixe (−1 à +1) |

|

Unités |

Avec unités |

Sans unité |

|

Interprétabilité |

Magnitude difficile à interpréter |

Sens et magnitude faciles à interpréter |

|

Comparabilité |

Comparabilité limitée entre jeux de données |

Directement comparable entre jeux de données |

|

Usage courant |

Modélisation et construction de matrices |

Exploration et communication |

|

Avantage |

Préserve l'échelle d'origine |

Standardise pour la comparaison |

Exemple : covariance vs corrélation

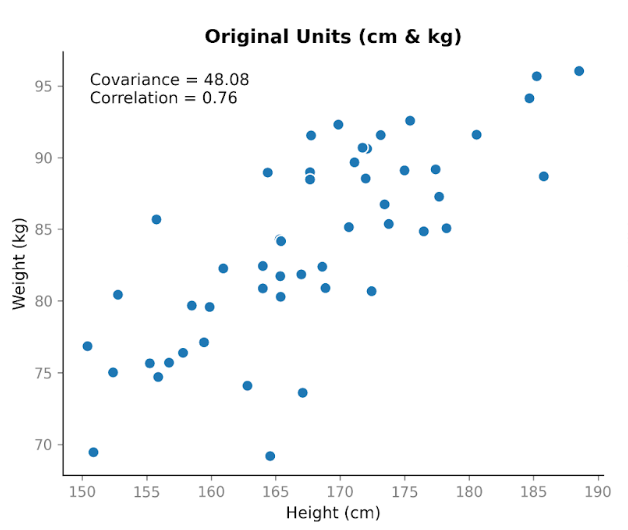

Supposons que nous recueillions des données sur deux variables : la taille et le poids. Nous nous attendons à ce qu'elles soient liées, car en général, les personnes plus grandes pèsent davantage. En représentant la taille en centimètres face au poids en kilogrammes, on observe une tendance nette à la hausse : à mesure que la taille augmente, le poids a tendance à augmenter aussi.

En calculant la covariance, on obtient une valeur positive : 48,08. Le fait qu'elle soit positive nous indique que les deux variables évoluent dans le même sens. Quand la taille est supérieure à la moyenne, le poids l'est généralement aussi.

Là où cela devient intéressant, c'est si l'on conserve exactement les mêmes données mais que l'on change les unités. Convertissons la taille de centimètres en mètres, et le poids de kilogrammes en livres. Les personnes n'ont pas changé. La relation non plus. Le nuage de points a le même aspect. Mais lorsque nous recalculons la covariance, le nombre est différent : 1,06. Il reste positif, mais l'amplitude est très différente. Et la seule chose que nous avons modifiée, ce sont les unités.

Cela illustre une propriété importante de la covariance : elle capte le sens de la relation, mais sa magnitude dépend de l'échelle. Si l'on étire ou contracte l'une des variables en changeant d'unités, la covariance s'étire ou se contracte elle aussi.

Regardons maintenant la corrélation sur les mêmes données, avant et après conversion d'unités. La corrélation avec des centimètres et des kilogrammes est de 0,76. Après conversion en mètres et en livres, elle reste de 0,76.

À la différence de la covariance, la corrélation ajuste la variabilité de chaque variable avant de mesurer leur relation. Grâce à cet ajustement, la valeur ne change pas lorsque l'on change d'unités. Elle se concentre sur la façon dont les points suivent un motif linéaire et sur l'orientation de cette pente (montante ou descendante).

Ce simple exemple met en évidence la différence majeure entre ces métriques : la covariance reflète à la fois le sens et l'échelle, alors que la corrélation reflète l'intensité de la relation indépendamment de l'échelle. En pratique, cela signifie que la corrélation est plus fiable pour comparer des relations entre variables mesurées sur des échelles différentes, tandis que la covariance est plus pertinente lorsque l'amplitude de la variabilité compte, par exemple en modélisation.

La covariance peut être difficile à interpréter

Comme nous l'avons vu, la covariance indique si deux variables évoluent dans le même sens, mais sa magnitude est délicate à interpréter.

Le problème principal est que la covariance dépend de l'échelle des variables, pas seulement de leur relation. Si les valeurs de l'une ou des deux variables sont plus grandes ou plus dispersées, la covariance aura aussi tendance à être plus élevée.

Cette sensibilité provient de deux sources. La première est l'unité des données. Changer d'unités modifie la covariance. Mesurer un revenu en dollars versus en milliers de dollars produit des covariances très différentes, alors que la relation est identique.

La seconde source est la quantité de variabilité de la variable. Même avec des unités inchangées, un jeu de données à étendue plus large ou plus dispersé produira généralement une covariance plus élevée qu'un jeu plus resserré présentant la même relation sous-jacente. Une grande covariance n'indique donc pas nécessairement une relation forte : elle peut simplement traduire des échelles plus grandes ou une plus forte variabilité des données.

En raison de cette sensibilité à l'échelle, la covariance est souvent utilisée en interne, par exemple pour l'ajustement de modèles, plutôt que reportée telle quelle.

Pourquoi la corrélation est plus souvent utilisée

La corrélation répond à de nombreux défis d'interprétation de la covariance en standardisant la relation entre variables. Comme les valeurs de corrélation sont toujours comprises entre −1 et +1, leur magnitude est immédiatement parlante : des valeurs proches de 1 ou −1 indiquent des relations linéaires fortes, tandis que des valeurs proches de 0 indiquent une relation linéaire faible ou nulle. Cette standardisation permet aussi la comparaison directe entre variables ou jeux de données, ce qui facilite la communication et l'interprétation.

Ces propriétés rendent la corrélation particulièrement utile en analyse exploratoire, pour inspecter les relations entre caractéristiques, détecter les redondances ou la multicolinéarité, et pour présenter des résultats. Les matrices de corrélation et les heatmaps sont également de bons outils de premier niveau pour examiner un jeu de données.

Cela dit, la corrélation ne remplace pas entièrement la covariance. Comme elle supprime les effets d'échelle, elle ne reflète que l'intensité de la relation, pas la variabilité brute. En modélisation, comme en analyse en composantes principales ou dans des modèles statistiques multivariés, l'échelle d'origine captée par la covariance peut être importante pour comprendre la structure de variance et guider le comportement des algorithmes.

Une perspective algèbre linéaire

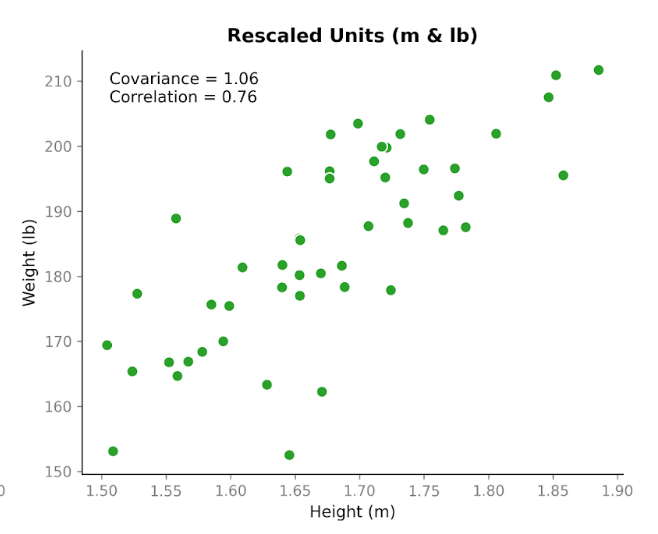

Jusqu'ici, nous avons regardé la covariance entre variables, deux à deux. L'algèbre linéaire nous montre comment généraliser cette idée à l'ensemble du jeu de données d'un coup, en organisant les données en matrice.

Dans une matrice de données classique, chaque ligne représente une observation et chaque colonne une variable. Pour analyser les relations entre variables, on commence par centrer les données en soustrayant à chaque valeur la moyenne de sa colonne. Cette étape permet de se concentrer sur les écarts aux valeurs typiques plutôt que sur les valeurs absolues.

Multiplier la matrice centrée par sa transposée produit une structure qui capture la co-évolution des variables. Ce produit, après mise à l'échelle, est la matrice de covariance. D'un point de vue algèbre linéaire, la matrice de covariance résume la façon dont la variabilité se répartit sur les dimensions du jeu de données.

Penser la covariance de cette manière explique pourquoi elle apparaît si souvent en data science. De nombreux algorithmes, dont l'analyse en composantes principales (PCA) et d'autres techniques de réduction de dimension, s'appuient sur cette représentation matricielle pour comprendre les motifs et la structure des données. Conceptuellement, la matrice de covariance fournit une cartographie des interactions entre les différentes dimensions du jeu de données.

Ici, nous voyons des données pour quatre variables organisées en matrice. Elles sont ensuite centrées et utilisées pour construire une matrice de covariance.

Pour approfondir l'algèbre linéaire appliquée à la data science, découvrez notre cours Linear Algebra for Data Science in R qui couvre les fondamentaux nécessaires pour comprendre les approches matricielles comme la covariance.

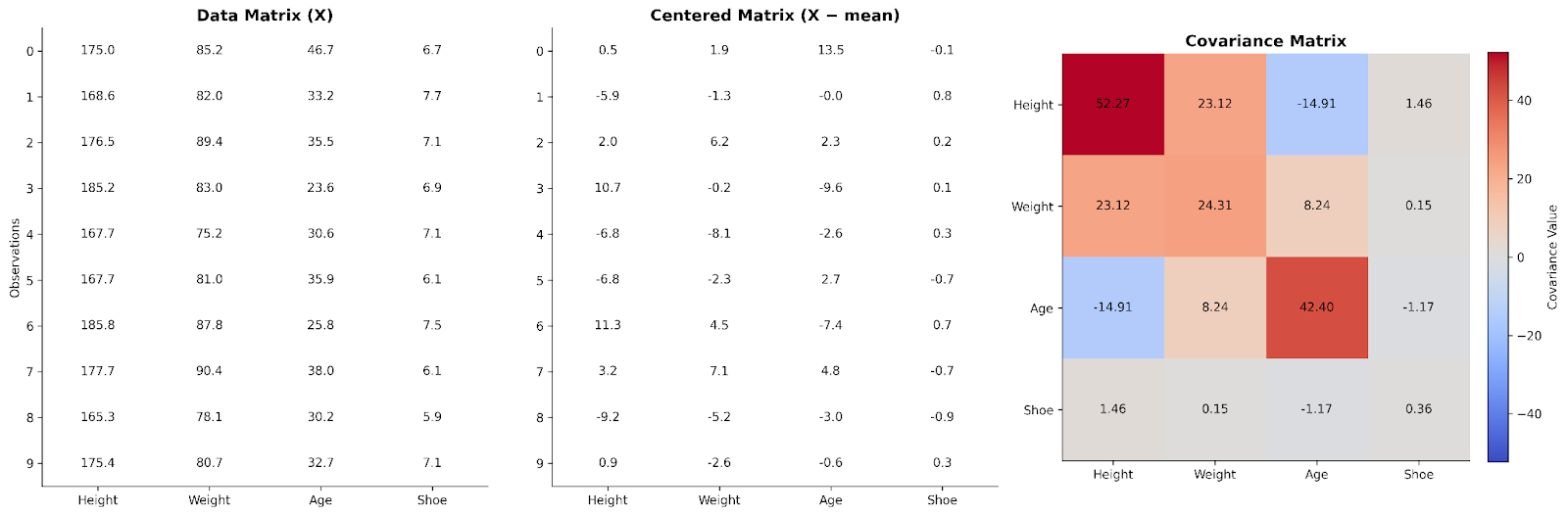

Matrices de covariance et de corrélation

La matrice de covariance résume la co-évolution des variables sur l'ensemble d'un jeu de données. En pratique, nous examinons souvent ces relations via des matrices de covariance ou de corrélation, selon que l'on souhaite préserver l'échelle d'origine ou standardiser les résultats.

Une matrice de covariance contient les covariances entre toutes les paires de variables. Les éléments diagonaux indiquent la variance de chaque variable, tandis que les éléments hors diagonale reflètent la façon dont les variables varient ensemble. Comme la covariance préserve l'échelle et les unités d'origine, la matrice capture la structure brute de la variabilité. Cela la rend particulièrement utile en modélisation et en analyses multivariées.

Une matrice de corrélation, au contraire, standardise ces relations. Chaque élément diagonal vaut 1, puisqu'une variable est parfaitement corrélée avec elle-même. Tous les éléments hors diagonale sont compris entre −1 et +1 et indiquent la corrélation entre variables. En supprimant les effets d'échelle, les matrices de corrélation sont plus faciles à lire et permettent des comparaisons directes entre variables. Elles sont particulièrement utiles en analyse exploratoire et pour identifier rapidement des relations linéaires fortes ou faibles entre caractéristiques.

Dans ces matrices, nous comparons quatre variables entre elles. J'aime ajouter une superposition de heatmap lors de la présentation de ces matrices : la couleur de chaque cellule permet de visualiser d'un coup d'œil la magnitude relative des valeurs de covariance ou de corrélation.

Comment convertir une covariance en corrélation

Conceptuellement, la corrélation est dérivée de la covariance en standardisant la relation entre variables. Il suffit de diviser la covariance par l'écart type de chaque variable. Cette mise à l'échelle supprime les unités et la magnitude des variables, produisant une mesure standardisée toujours comprise entre −1 et +1. C'est cette transformation qui rend les corrélations directement comparables entre variables ou jeux de données différents.

En pratique, la conversion est effectuée automatiquement par la plupart des logiciels statistiques, si bien que les analystes n'ont que rarement à la calculer manuellement. Il reste toutefois essentiel de comprendre ce que fait votre logiciel en arrière-plan. Par exemple, comprendre comment la covariance est convertie en corrélation explique pourquoi l'on ne peut pas faire l'inverse (du moins pas sans connaître l'écart type des deux variables). La corrélation ne contient plus les unités ni l'information de magnitude nécessaires pour revenir à une covariance.

Quand utiliser la covariance et la corrélation

La covariance est la plus utile lorsque l'échelle et les unités des données ont du sens, ou lorsque vous avez besoin de la structure brute de la variabilité. Elle est couramment utilisée en modélisation multivariée, dans les modèles probabilistes, et pour construire des matrices de covariance pour des méthodes fondées sur l'algèbre linéaire. Dans ces contextes, préserver la variabilité d'origine permet aux algorithmes de capter la véritable structure des données et de comprendre la co-variabilité des dimensions.

La corrélation, en revanche, se prête mieux à l'interprétation humaine, aux comparaisons entre jeux de données et aux analyses exploratoires. J'aime utiliser cette mesure dans des visualisations, comme des heatmaps, pour voir et communiquer ces relations en un clin d'œil. Comme la corrélation standardise la relation, elle est aussi utile pour préparer vos données à des techniques où mettre toutes les caractéristiques à la même échelle peut être important.

Covariance vs corrélation en data science et en statistiques

Souvent, les deux mesures apparaissent dans un même flux de travail. Les matrices de covariance constituent le socle mathématique de nombreuses techniques multivariées car elles conservent la variabilité d'origine des données. Les matrices de corrélation, quant à elles, sont fréquemment utilisées en phase exploratoire pour comprendre la structure du jeu de données avant la modélisation.

Certains modèles peuvent utiliser l'une ou l'autre statistique, selon l'objectif. Prenons la PCA. Lorsqu'elle est réalisée sur une matrice de covariance, les variables à plus forte variance influencent naturellement davantage les composantes obtenues. Cela peut être souhaitable si les différences d'échelle reflètent des différences de variabilité significatives. Par exemple, en analysant des rendements boursiers quotidiens, une action plus volatile peut légitimement façonner les composantes principales, car cette variabilité reflète un comportement réel du marché.

Utiliser une matrice de corrélation à la place revient à standardiser les variables avant la décomposition. Chaque caractéristique est placée sur la même échelle, de sorte qu'aucune variable ne domine simplement parce qu'elle a des unités plus grandes ou une plage numérique plus large. Cette approche peut être plus appropriée lorsque les variables sont mesurées dans des unités différentes, comme la taille (cm), le poids (kg), la pression artérielle (mmHg) et le cholestérol (mg/dL).

Aucune des deux approches n'est universellement meilleure. Le bon choix dépend de savoir si les différences d'échelle reflètent une structure pertinente ou ne sont que des artefacts de mesure.

Idées reçues fréquentes sur la covariance et la corrélation

Une idée reçue fréquente est qu'une covariance élevée indique automatiquement une relation forte. Or, de grandes valeurs de covariance peuvent simplement refléter l'échelle ou la variabilité des variables, plutôt que l'intensité de leur relation. Si vous cherchez à connaître la force de la relation, il faut la standardiser en examinant la corrélation.

Vous avez sans doute entendu l'expression « corrélation n'implique pas causalité » des centaines de fois ! Et pourtant, cela reste probablement l'erreur la plus courante que je rencontre. Il est naturel de voir une corrélation forte et d'en déduire un lien causal : c'est un raccourci mental qui a aidé nos ancêtres à survivre. Mais en tant que praticiens de la donnée, nous devons résister à ce biais et reconnaître que la corrélation seule ne suffit pas à prouver un effet causal. La corrélation mesure une association, pas une influence causale, et des facteurs externes peuvent piloter simultanément les deux variables.

Autre idée reçue : la covariance et la corrélation seraient pratiquement identiques. Ce n'est pas le cas. Bien que la corrélation soit dérivée de la covariance, elle standardise la relation, en faisant une métrique distincte qui ne remplace pas toujours la covariance dans les calculs.

Enfin, rappelez-vous que ces statistiques évaluent uniquement les relations linéaires. Des motifs non linéaires peuvent exister même lorsque les corrélations et covariances sont faibles ou proches de zéro ; s'y fier exclusivement peut faire passer à côté d'une structure importante. Je vous recommande toujours de tracer vos données et de les observer avant d'interpréter des mesures statistiques : cela peut vraiment vous éviter des erreurs si la relation est manifestement non linéaire.

Conseils pour interpréter les relations entre variables

Premièrement, tenez toujours compte de l'échelle de mesure. Les différences d'unités ou de variabilité peuvent affecter des mesures brutes comme la covariance ; il est donc crucial de savoir ce que représentent vos nombres.

Deuxièmement, clarifiez votre besoin. La covariance est la plus utile lorsque préserver la variabilité brute est important : c'est souvent le cas en modélisation ou lors de la construction de matrices de covariance pour des analyses multivariées. Dans ces contextes, l'amplitude des variations porte une information pertinente. Mais si vous n'avez pas besoin de cette variabilité brute, vous préférerez sans doute la standardisation et la lisibilité de la corrélation.

Troisièmement : tracez toujours, toujours, toujours vos données ! L'inspection visuelle guide l'analyse et complète les résumés statistiques. Utilisez des nuages de points pour repérer des motifs binaires, ou des matrices pour obtenir un aperçu rapide de nombreuses variables d'un coup.

Enfin, réfléchissez aux implications de vos choix de mesure sur la suite. Choisir entre une mesure brute comme la covariance et une mesure standardisée comme la corrélation influencera vos modèles et vos interprétations. Alignez votre sélection sur vos objectifs d'analyse.

Conclusion

Covariance et corrélation sont deux mesures étroitement liées qui décrivent la co-évolution de variables, mais elles servent des objectifs distincts : la covariance préserve l'échelle d'origine, tandis que la corrélation standardise pour faciliter la comparaison.

Si vous souhaitez approfondir l'exploration de vos données, consultez le tutoriel Python sur l'analyse exploratoire des données. Pour apprendre à déterminer si votre corrélation traduit réellement une causalité, découvrez le cours Hypothesis Testing in R.

Je suis titulaire d'un doctorat et j'ai 13 ans d'expérience dans le traitement des données dans un environnement de recherche biologique. Je crée des logiciels dans plusieurs langages de programmation, notamment Python, MATLAB et R. Je suis passionné par le partage de mon amour de l'apprentissage avec le monde.

FAQs

Quelle est la différence entre covariance et corrélation ?

Bien qu'elles mesurent toutes deux la co-évolution des variables, la covariance préserve l'échelle et les unités, tandis que la corrélation les standardise pour faciliter les comparaisons.

Une covariance élevée signifie-t-elle une relation forte ?

Pas nécessairement. La magnitude de la covariance est fortement influencée par l'échelle et la dispersion. Pour évaluer la force de la relation, la corrélation est plus indiquée.

La covariance ou la corrélation fonctionnent-elles pour des relations non linéaires ?

Pas de manière fiable. Ces statistiques sont conçues pour évaluer uniquement des relations linéaires.

Pourquoi la corrélation n'a-t-elle pas d'unités ?

Lors de la conversion de la covariance en corrélation, les unités s'éliminent par la division, ce qui laisse un nombre sans unité pour la corrélation.

Dois-je utiliser la covariance ou la corrélation pour ma PCA ?

La PCA peut s'appuyer sur une matrice de covariance ou de corrélation. Si les différences de magnitude entre variables sont pertinentes et comparables, une matrice de covariance les capturera. En revanche, si les unités ne sont pas directement comparables, une matrice de corrélation standardise les relations. Le choix dépend des variables et de votre objectif.