Curso

En analítica de datos, siempre intentamos entender cómo se relacionan unas variables con otras. Seguramente te hayas topado con dos medidas estadísticas muy usadas para ello: covarianza y correlación. Suenan parecido y a menudo se confunden. Pero, ¿en qué se diferencian y cómo conviene usarlas?

Ambas describen cómo se mueven las variables conjuntamente. Sin embargo, pese a sus similitudes, covarianza y correlación responden a preguntas ligeramente distintas y desempeñan papeles diferentes en los flujos de trabajo con datos. La covarianza capta la variabilidad conjunta en bruto entre características, mientras que la correlación estandariza esa relación para facilitar su comparación.

Veamos cómo esta sutil diferencia influye en qué medida usamos según cada situación.

¿Qué es la covarianza?

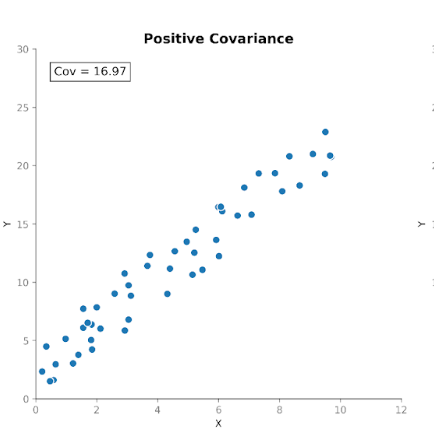

La covarianza mide cómo se mueven juntas dos variables. Nos indica si los aumentos en una variable tienden a coincidir con aumentos o descensos en la otra. Hay tres tipos de covarianza:

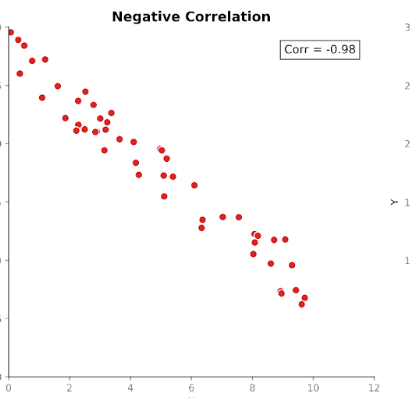

- Covarianza positiva: cuando una variable aumenta a la vez que la otra.

- Covarianza negativa: cuando una variable aumenta mientras la otra disminuye.

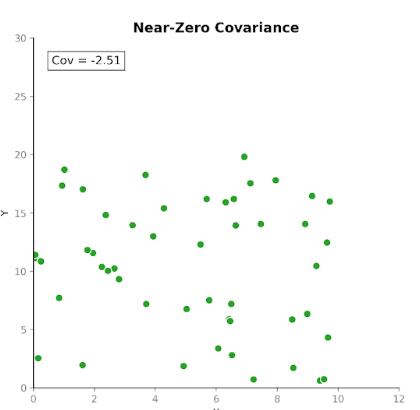

- Covarianza cercana a cero: cuando no hay una relación direccional consistente.

Esto hace que la covarianza sea útil para detectar cómo se mueven las variables entre sí.

Ahora bien, aunque la dirección de la relación es útil, interpretar la magnitud de la covarianza no es tan sencillo. La magnitud depende de las unidades de medida y de la escala de las variables. Convertir unidades, por ejemplo de centímetros a metros, puede cambiar drásticamente la magnitud de la covarianza sin afectar a la relación subyacente.

Por este motivo, la covarianza se utiliza más como un bloque de construcción computacional interno que como una estadística resumida en solitario.

¿Qué es la correlación?

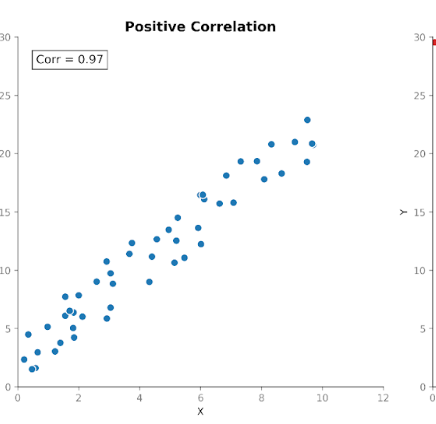

La correlación mide tanto la fuerza como la dirección de la relación entre dos variables. Parte de la covarianza, pero estandariza la magnitud para que las unidades dejen de influir.

Los valores de correlación se sitúan en un rango fijo entre +1 (relación perfectamente positiva) y -1 (relación perfectamente negativa). Un valor de correlación de 0 indica que no existe relación lineal.

Esta escala estandarizada hace que la correlación sea más fácil de interpretar que la covarianza. Si vemos un valor de 0,8, sabemos al instante que hay una relación fuerte entre las variables, independientemente de las unidades usadas en la medición original.

Esta estandarización también permite comparaciones significativas entre conjuntos de datos, características y dominios. Por eso la correlación se usa tan a menudo en análisis exploratorios y en investigaciones de características.

Covarianza vs. correlación: diferencias clave

Covarianza y correlación describen propiedades relacionadas de las relaciones entre variables, pero sirven a fines analíticos diferentes.

En la práctica, la covarianza refleja la co-variabilidad en bruto, mientras que la correlación refleja esa misma relación en forma estandarizada. Entender esta distinción ayuda a decidir qué medida encaja mejor con cada tarea analítica.

|

Covarianza |

Correlación |

|

|

Mide |

Relación lineal (no estandarizada) |

Relación lineal (estandarizada) |

|

Sensibilidad a la escala |

Escala dictada por las unidades |

Rango fijo (−1 a +1) |

|

Unidades |

Tiene unidades |

Sin unidades |

|

Interpretabilidad |

Magnitud difícil de interpretar |

Dirección y magnitud fáciles de interpretar |

|

Comparabilidad |

Comparabilidad limitada entre datasets |

Directamente comparable entre datasets |

|

Uso habitual |

Modelado y construcción de matrices |

Exploración y comunicación |

|

Ventaja |

Conserva la escala original |

Estandariza para comparar |

Ejemplo de covarianza vs. correlación

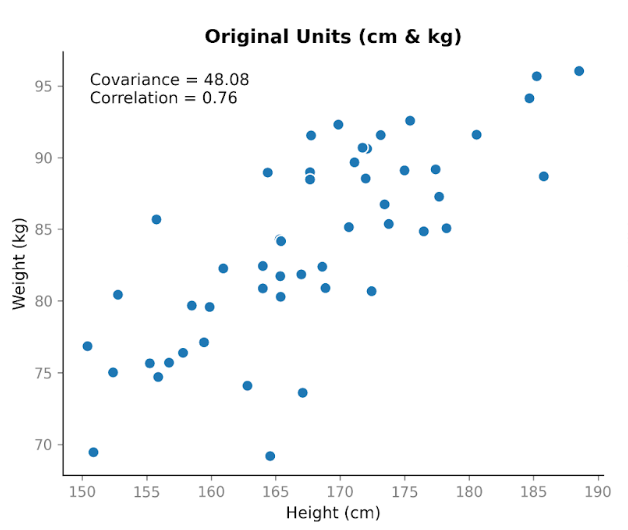

Supongamos que recogemos datos de dos variables: altura y peso. Esperamos que estén relacionadas, ya que en general las personas más altas suelen pesar más. Si representamos la altura en centímetros frente al peso en kilogramos, vemos una clara tendencia ascendente. A medida que aumenta la altura, el peso también tiende a aumentar.

Al calcular la covarianza, obtenemos un valor positivo: 48,08. Que sea positivo nos dice que las dos variables se mueven en la misma dirección. Cuando la altura está por encima de la media, el peso suele estar también por encima de la media.

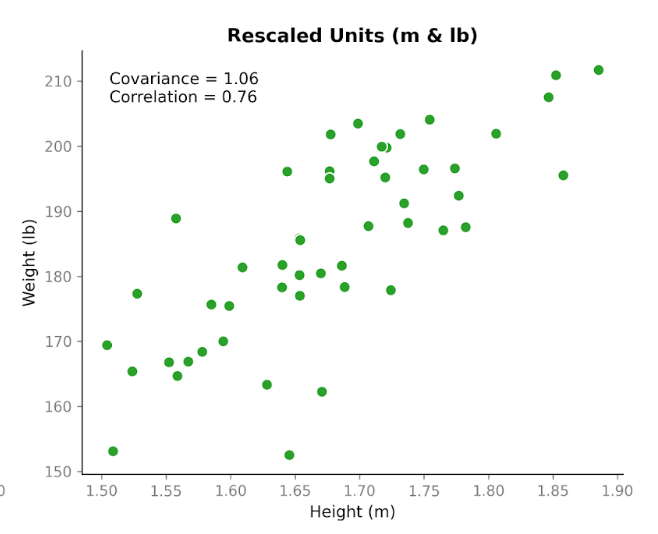

Aquí viene lo interesante. Tomemos exactamente los mismos datos y cambiemos las unidades. Convertimos la altura de centímetros a metros y el peso de kilogramos a libras. Las personas no han cambiado. La relación no ha cambiado. El patrón en el diagrama de dispersión se ve igual. Pero al recalcular la covarianza, el número es distinto: 1,06. Sigue siendo positivo, pero la magnitud es muy diferente. Y lo único que hemos cambiado son las unidades.

Esto muestra una propiedad importante de la covarianza: capta la dirección, pero su magnitud depende de la escala. Si estiramos o comprimimos una de las variables cambiando las unidades, la covarianza también se estira o se encoge.

Ahora, veamos la correlación usando los mismos datos antes y después del cambio de unidades. La correlación usando centímetros y kilogramos es 0,76. Tras convertir a metros y libras, sigue siendo 0,76.

A diferencia de la covarianza, la correlación ajusta por la variabilidad de cada variable antes de medir la relación entre ellas. Gracias a ese ajuste, el valor no cambia cuando cambiamos las unidades. Se centra únicamente en cuán estrechamente los puntos siguen un patrón lineal y si ese patrón tiene pendiente ascendente o descendente.

Este sencillo ejemplo destaca la principal diferencia entre estas métricas: la covarianza refleja tanto la dirección como la escala, mientras que la correlación refleja la fuerza de la relación independientemente de la escala. En la práctica, esto significa que la correlación es más fiable para comparar relaciones entre variables medidas en escalas distintas, mientras que la covarianza es más relevante en contextos donde importa la magnitud de la variabilidad, como en el modelado.

La covarianza puede ser difícil de interpretar

Como hemos visto, la covarianza nos dice si dos variables se mueven en la misma dirección, pero su magnitud es complicada de interpretar.

El problema principal es que la covarianza depende de la escala de las variables, no solo de su relación. Si los valores de una o ambas variables son mayores o están más dispersos, la covarianza también tenderá a ser mayor.

Esta sensibilidad proviene de dos fuentes. La primera son las unidades de los datos. Cambiar de unidades cambia la covarianza. Medir ingresos en dólares frente a miles de dólares produce valores de covarianza muy distintos, aunque la relación sea idéntica.

La segunda fuente es la cantidad de variabilidad de la variable. Incluso manteniendo las mismas unidades, un conjunto de datos con un rango más amplio o mayor dispersión producirá típicamente una covarianza mayor que otro más concentrado con la misma relación subyacente. Una covarianza grande no indica necesariamente una relación fuerte. Puede reflejar simplemente escalas mayores o una variabilidad más alta en los datos.

Por esta sensibilidad a la escala, la covarianza suele usarse internamente, por ejemplo para ajustar modelos, en lugar de comunicarse directamente.

Por qué la correlación se usa más a menudo

La correlación resuelve muchos de los problemas de interpretabilidad de la covarianza al estandarizar la relación entre variables. Como los valores de correlación siempre están entre −1 y +1, su magnitud es inmediatamente significativa: valores cercanos a 1 o −1 indican relaciones lineales fuertes, mientras que valores cercanos a 0 indican relaciones lineales débiles o nulas. Esta estandarización también permite comparar directamente entre variables o datasets, lo que facilita comunicar e interpretar resultados.

Estas propiedades hacen que la correlación sea especialmente útil para el análisis exploratorio de datos, inspeccionar relaciones entre características, detectar redundancias o multicolinealidad y presentar hallazgos. Las matrices de correlación y los mapas de calor también son herramientas de primer vistazo muy útiles al examinar datasets.

Dicho esto, la correlación no sustituye por completo a la covarianza. Como la correlación elimina los efectos de escala, solo refleja la fuerza de la relación, no la variabilidad en bruto. En contextos de modelado, como el análisis de componentes principales o los modelos estadísticos multivariantes, la escala original que capta la covarianza puede ser importante para entender la estructura de varianzas y guiar el comportamiento de los algoritmos.

Una perspectiva de álgebra lineal

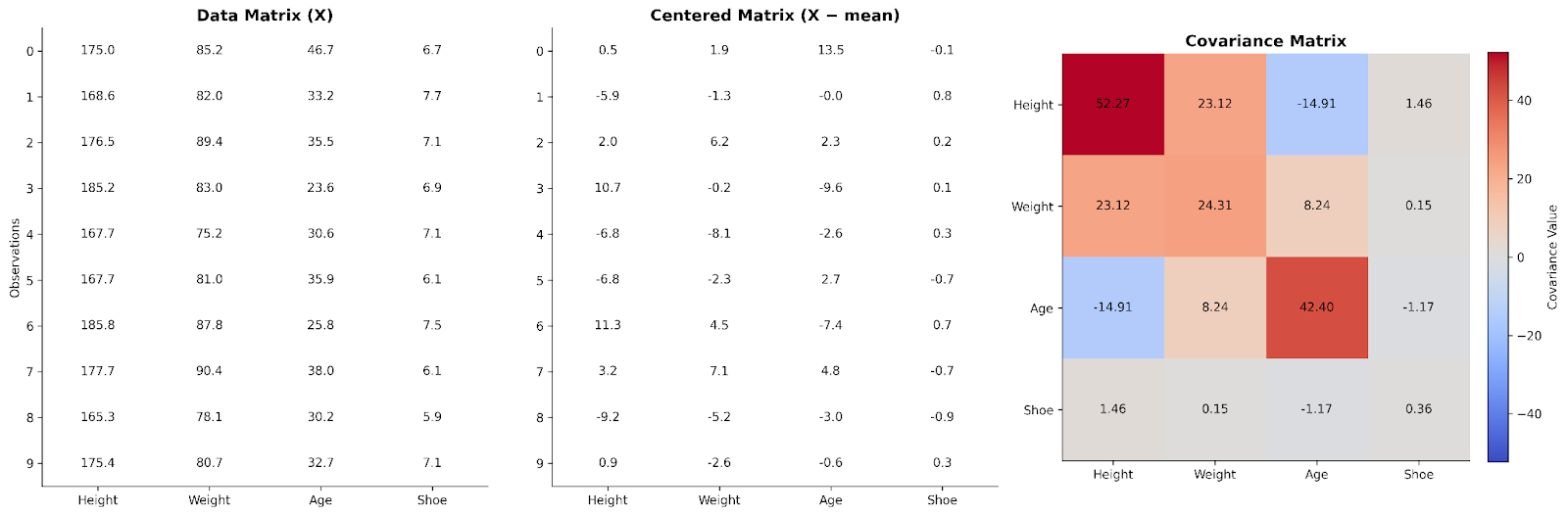

Hasta ahora hemos visto la covarianza entre variables de dos en dos. El álgebra lineal nos muestra cómo escalar esa idea a todo el conjunto de datos de una vez. Podemos hacerlo organizando los datos en una matriz.

En una matriz de datos básica, cada fila representa una observación y cada columna una variable. Para entender las relaciones entre variables, primero podemos centrar los datos restando a cada valor la media de su columna. Este paso asegura que nos fijamos en desviaciones respecto a los valores típicos, y no en valores absolutos.

Multiplicar la matriz de datos centrada por su traspuesta produce una estructura que capta cómo se mueven las variables conjuntamente. Ese producto, tras escalarlo, es la matriz de covarianzas. Desde la perspectiva del álgebra lineal, la matriz de covarianzas resume cómo se distribuye la variabilidad a lo largo de las dimensiones del dataset.

Pensar así en la covarianza ayuda a explicar por qué aparece tan a menudo en ciencia de datos. Muchos algoritmos, incluido el análisis de componentes principales (PCA) y otras técnicas de reducción de dimensionalidad, dependen de esta representación matricial para entender patrones y estructura en los datos. Conceptualmente, la matriz de covarianzas proporciona un mapa de cómo interactúan las diferentes dimensiones del dataset.

Aquí vemos datos de cuatro variables dispuestos en una matriz de datos. Luego se centran y se usan para crear una matriz de covarianzas.

Si quieres profundizar en álgebra lineal para ciencia de datos, echa un vistazo a nuestro curso Linear Algebra for Data Science in R, que cubre las bases necesarias para entender enfoques matriciales como la covarianza.

Matrices de covarianza y de correlación

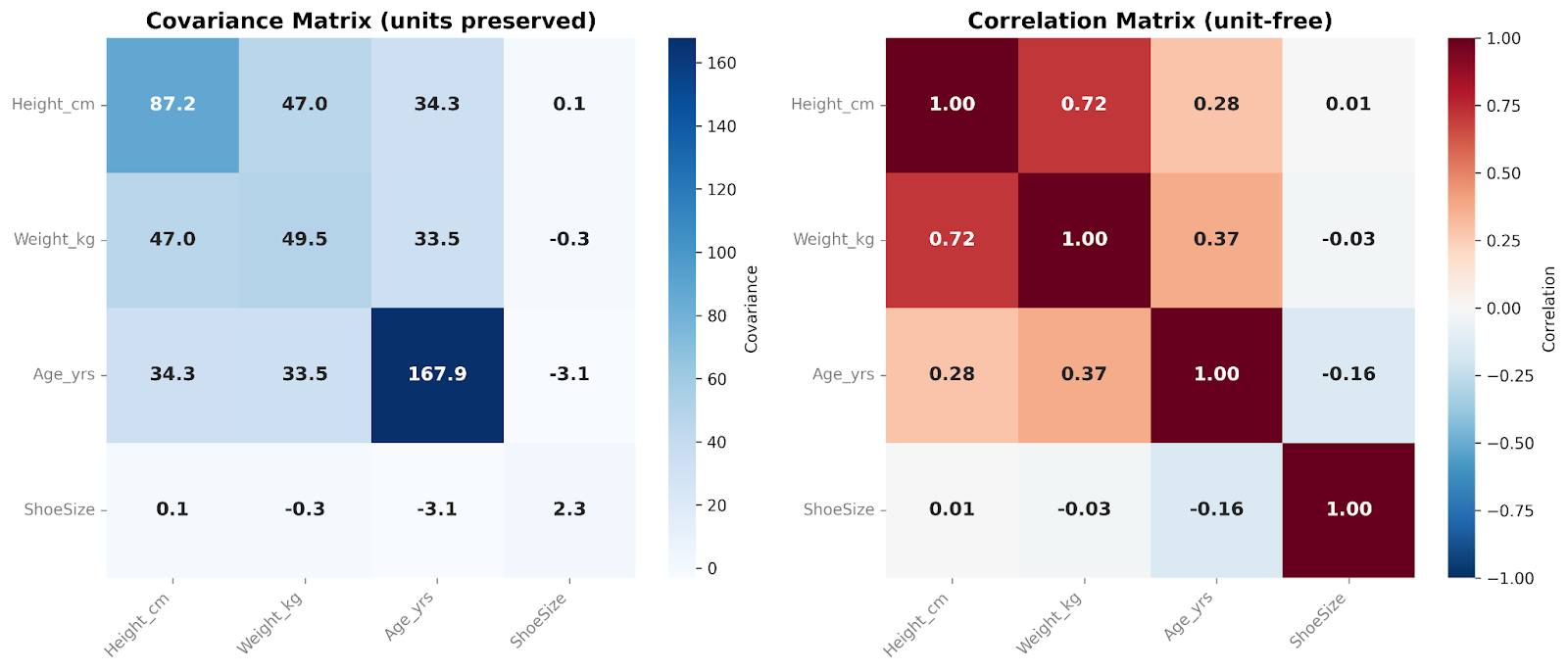

La matriz de covarianzas resume cómo se mueven conjuntamente las variables en todo un dataset. En la práctica, solemos examinar estas relaciones con matrices de covarianzas o de correlaciones, según queramos conservar la escala original o estandarizar los resultados.

Una matriz de covarianzas contiene las covarianzas entre todos los pares de variables. Los números de la diagonal muestran la varianza dentro de cada variable, mientras que los valores fuera de la diagonal reflejan cómo cambian juntas las variables. Como la covarianza conserva la escala y las unidades originales de los datos, la matriz capta la estructura de variabilidad en bruto. Esto las hace especialmente útiles en flujos de trabajo de modelado y análisis multivariante.

Una matriz de correlaciones, por su parte, estandariza estas relaciones. Cada entrada diagonal es 1, ya que toda variable se correlaciona exactamente consigo misma. Todos los valores fuera de la diagonal están entre −1 y +1 y muestran la correlación entre variables. Al eliminar los efectos de escala, las matrices de correlación son más fáciles de interpretar por las personas y permiten comparar directamente entre variables. Son especialmente útiles en análisis exploratorio y para identificar rápidamente relaciones lineales fuertes o débiles entre características.

En estas matrices, comparamos cuatro variables entre sí. Me gusta añadir un mapa de calor como superposición al presentar estas matrices. El color de cada celda nos ayuda a ver, de un vistazo, la magnitud relativa de los valores de covarianza o correlación.

Cómo convertir covarianza en correlación

Conceptualmente, la correlación se deriva de la covarianza estandarizando la relación entre variables. Simplemente divides la covarianza por la desviación estándar de cada variable. Este escalado elimina las unidades y la magnitud de las variables, generando una medida estandarizada que siempre cae entre −1 y +1. Esta transformación explica por qué los valores de correlación son directamente comparables entre distintas variables o datasets.

En la práctica, convertir covarianza a correlación se hace automáticamente en la mayoría de los programas estadísticos, por lo que rara vez tendrás que calcularla a mano. Aun así, siempre es importante entender qué hace el software “por detrás”. Por ejemplo, comprender cómo se convierte la covarianza en correlación explica por qué no puedes convertir en la dirección opuesta de forma directa (al menos no sin la información de la desviación estándar de ambas). La correlación ya no contiene las unidades ni la información de magnitud necesarias para volver a la covarianza.

Cuándo usar covarianza y correlación

La covarianza es más útil cuando la escala y las unidades de los datos son significativas o cuando necesitas la estructura en bruto de la variabilidad de tus datos. Se usa habitualmente en modelado multivariante, modelos probabilísticos y en la construcción de matrices de covarianzas para métodos basados en álgebra lineal. En estos contextos, conservar la variabilidad original permite que los algoritmos capten la verdadera estructura de los datos y entiendan cómo varían conjuntamente las dimensiones.

La correlación, en cambio, se adapta mejor a la interpretación humana, las comparaciones entre datasets y los análisis exploratorios. Me gusta usar esta métrica en visualizaciones, como mapas de calor, para ver y comunicar estas relaciones de un vistazo. Como la correlación estandariza la relación, también ayuda a preparar los datos para técnicas en las que puede ser importante poner todas las características en una escala comparable.

Covarianza vs. correlación en ciencia de datos y estadística

A menudo, ambas medidas aparecen en el mismo flujo de trabajo. Las matrices de covarianzas forman la base matemática de muchas técnicas multivariantes porque conservan la variabilidad original de los datos. Las matrices de correlaciones, por su parte, se usan con frecuencia en las fases exploratorias para entender la estructura del dataset antes de modelar.

Algunos modelos pueden usar una u otra estadística, en función del objetivo. Considera el análisis de componentes principales (PCA). Cuando el PCA se realiza sobre una matriz de covarianzas, las variables con mayor varianza influyen de forma natural más en los componentes resultantes. A veces esto es deseable si las diferencias de escala reflejan diferencias de variabilidad con sentido. Por ejemplo, si analizas rentabilidades diarias de acciones, una acción más volátil puede influir apropiadamente en los componentes principales porque esa variabilidad refleja el comportamiento real del mercado.

Usar en su lugar una matriz de correlaciones estandariza las variables antes de la descomposición. Cada característica se coloca en la misma escala, de modo que ninguna domina solo por tener unidades mayores o un rango numérico más amplio. Este enfoque puede ser más adecuado cuando las variables se miden en unidades diferentes, como altura (cm), peso (kg), presión arterial (mmHg) y colesterol (mg/dL).

Ningún enfoque es universalmente mejor. La elección adecuada depende de si las diferencias de escala reflejan estructura con significado o son simplemente artefactos de medición.

Ideas equivocadas comunes sobre covarianza y correlación

Una idea equivocada habitual es que una covarianza alta indica automáticamente una relación fuerte. Sin embargo, valores grandes de covarianza pueden reflejar simplemente la escala o la variabilidad de las variables, y no la fuerza de su relación. Si quieres conocer la fuerza de la relación, necesitas estandarizarla mirando la correlación.

Seguro que has oído la frase «correlación no implica causalidad» cerca de un millón de veces. ¡Y aun así sigue siendo la idea equivocada más común que me encuentro! Es comprensible ver una correlación fuerte y asumir un vínculo causal. Es un atajo que nuestro cerebro ha usado durante milenios para mantener con vida a nuestros antepasados. Sin embargo, como profesionales de datos, debemos resistir ese atajo mental y reconocer que la correlación por sí sola no basta para demostrar un efecto causal. La correlación mide asociación, no influencia causal, y factores externos pueden impulsar ambas variables simultáneamente.

Otra idea muy común es que covarianza y correlación son básicamente lo mismo. No lo son e intercambiarlas puede ser un error. Aunque la correlación se derive de la covarianza, la estandariza, convirtiéndola en una métrica distinta que no siempre es un sustituto adecuado de la covarianza en cálculos.

Por último, recuerda que estas estadísticas solo evalúan relaciones lineales. Pueden existir patrones no lineales incluso cuando la correlación y la covarianza son bajas o cercanas a cero, así que confiar solo en estas estadísticas puede hacerte pasar por alto estructuras importantes en los datos. Siempre te recomiendo que representes los datos y los mires antes de interpretar medidas estadísticas. Esto puede salvarte si existe una relación no lineal evidente.

Consejos pro para interpretar relaciones entre variables

Primero, ten siempre en cuenta la escala de tu medición. Las diferencias de unidades o de variabilidad pueden afectar a medidas en bruto como la covarianza, así que es importante saber qué representan tus números.

Segundo, clarifica qué necesitas de tus datos. La covarianza es más útil cuando es importante conservar la variabilidad en bruto. Suele ser el caso en el modelado o al construir matrices de covarianzas para análisis multivariantes. En estos contextos, la magnitud de la variación aporta información valiosa. Pero si no necesitas esa variabilidad en bruto, quizá prefieras la estandarización y la interpretabilidad de la correlación.

Tercero: ¡siempre, siempre, siempre representa tus datos y obsérvalos! La inspección visual puede guiar tus análisis y complementar los resúmenes estadísticos. Puedes usar diagramas de dispersión para detectar patrones por pares o matrices para obtener una visión rápida de muchas variables a la vez.

Por último, piensa en las implicaciones aguas abajo de tus elecciones de medida. Elegir entre una medida en bruto como la covarianza y una estandarizada como la correlación influirá en los resultados de tus modelos y en tus interpretaciones. Asegúrate de alinear tu elección con tus objetivos analíticos.

Conclusión

La covarianza y la correlación son medidas estrechamente relacionadas que describen cómo se mueven juntas las variables, pero cumplen fines distintos: la covarianza conserva la escala original, mientras que la correlación estandariza para poder comparar.

Si te interesa aprender más sobre cómo explorar tus datos, echa un vistazo al Python Exploratory Data Analysis Tutorial. Para aprender a determinar si tu correlación realmente indica causalidad, consulta Hypothesis Testing in R.

Soy doctor con 13 años de experiencia trabajando con datos en un entorno de investigación biológica. Creo software en varios lenguajes de programación, como Python, MATLAB y R. Me apasiona compartir mi amor por el aprendizaje con el mundo.

FAQs

¿Cuál es la diferencia entre covarianza y correlación?

Aunque ambas miden cómo se mueven juntas las variables, la covarianza conserva escala y unidades, mientras que la correlación las estandariza para facilitar la comparación.

¿Una covarianza alta equivale a una relación fuerte?

No necesariamente. La magnitud de la covarianza está muy afectada por la escala y la dispersión. Para determinar la fuerza de la relación, la correlación es la estadística más adecuada.

¿Funcionan la covarianza o la correlación con relaciones no lineales?

No de forma fiable. Estas estadísticas están pensadas para evaluar solo relaciones lineales.

¿Por qué la correlación no tiene unidades?

Al convertir covarianza en correlación, las unidades se cancelan al dividir, quedando un número sin unidades para la correlación.

¿Debo usar covarianza o correlación para mi PCA?

El PCA puede hacerse usando una matriz de covarianzas o de correlaciones. Si las diferencias de magnitud entre variables son significativas y comparables, una matriz de covarianzas captará esa variación. Sin embargo, si las unidades de las variables no son directamente comparables, una matriz de correlaciones estandariza las relaciones. Lo que elijas depende de las variables que uses y de tu objetivo.