track

Google tocmai a lansat a doua iterație a modelului de generare de imagini, Nano Banana 2. Când Nano Banana a fost lansat prima dată, a făcut senzație, devenind rapid cel mai bun și mai rapid model de generare de imagini cu AI.

În acest articol, analizăm în profunzime noul model, explorăm noile sale funcții și învățăm cum să îl folosim prin API cu Python.

Dacă, în general, vă interesează generarea de imagini, vă recomand să consultați ghidurile noastre pentru următoarele modele:

Ce este Nano Banana 2?

Nano Banana 2, cunoscut și ca Gemini 3.1 Flash Image, este cel mai nou model AI de generare și editare de imagini de la Google DeepMind, aflat la stadiul de vârf al tehnologiei. Îmbină cunoașterea avansată despre lume, calitatea și raționamentul din Nano Banana Pro cu viteza fulgerătoare a lui Gemini Flash, făcând posibilă crearea de înaltă fidelitate și iterația rapidă în același flux de lucru.

Capabilități cheie

Iată o prezentare generală a principalelor funcții ale Nano Banana 2:

- Acuratețe îmbunătățită: Își fundamentează generările pe cunoștințele despre lumea reală ale lui Gemini și pe semnale de imagini web în timp real, pentru a reda mai precis subiecte specifice. Ideal pentru infografice, diagrame și vizualizări de date.

- Tipografie îmbunătățită: Produce text lizibil și corect în interiorul imaginilor și admite localizare și traducere direct în imagine.

- Control creativ: Coerență îmbunătățită a subiectelor pentru narațiuni și storyboard-uri. Modelul menține asemănarea pentru până la cinci personaje și fidelitatea pentru până la 14 obiecte într-un singur flux de lucru.

- Fiabilitate: Respectare precisă a instrucțiunilor pentru a surprinde mai bine solicitări complexe și nuanțate.

- Rezoluție înaltă: Specificații gata de producție, cu rapoarte de aspect și rezoluții flexibile de la 512 pixeli până la 4K.

- Calitate vizuală: Îmbunătățiri de fidelitate vizuală, cu texturi mai bogate, iluminare vibrantă și detalii mai clare la viteza Flash.

Dacă sunteți nou(ă) în Nano Banana, poate doriți mai întâi să citiți articolul nostru anterior despre prima iterație, Nano Banana Pro.

Cum accesați Nano Banana 2

În acest articol, explicăm cum să folosiți Nano Banana 2 folosind API-ul cu Python. Totuși, noile modele sunt disponibile în întregul ecosistem Gemini:

- Aplicația Gemini: Nano Banana 2 este acum modelul implicit pentru imagini în modurile Fast, Thinking și Pro. Abonații Google AI Pro și Ultra pot totuși regenera cu Nano Banana Pro din meniul cu trei puncte pentru sarcini specializate, cu acuratețe factuală maximă.

- Căutare: Disponibil în AI Mode și Lens în aplicația Google și în browserele mobile/desktop, cu disponibilitate extinsă (inclusiv 141 de noi țări/teritorii și opt limbi suplimentare).

- AI Studio + Gemini API: Disponibil în preview (vedeți prețurile). De asemenea, disponibil în Google Antigravity.

- Google Cloud: În preview prin Gemini API în Vertex AI.

- Flow: Acum este modelul implicit de generare de imagini pentru toți utilizatorii Flow.

- Google Ads: Propulsează sugestiile creative în timpul creării campaniilor.

Prețuri API

În acest articol, vom folosi Nano Banana 2 prin API, ceea ce înseamnă că nu vom avea nevoie de un abonament, ci vom plăti pentru fiecare imagine generată.

Am găsit tabelul oficial de prețuri puțin cam greu de înțeles. De obicei, modelele AI de imagini specifică un preț fix per imagine.

Pentru a simplifica, am făcut calcule care estimează prețul așteptat în funcție de dimensiunea imaginii. Rețineți că acestea nu sunt prețuri exacte, deoarece pot varia ușor.

|

Dimensiunea imaginii |

Cost per imagine |

|

512px |

$0.045 |

|

1024px (1K) |

$0.067 |

|

2048px (2K) |

$0.101 |

|

4096px (4K) |

$0.151 |

Nano Banana 2 poate efectua căutări pe web pentru a genera rezultate mai precise. Este o funcție foarte utilă, dar trebuie luată în calcul la preț, deoarece căutările implică un cost suplimentar.

Primele 5.000 de interogări Google Search pe lună sunt gratuite atunci când folosiți fundamentarea cu Google Search. După aceea, costă 14 USD per 1.000 de interogări Google Search.

Generarea primei noastre imagini cu Nano Banana 2

Fără alte preambuluri, să începem cu Nano Banana 2.

Generarea cheii API

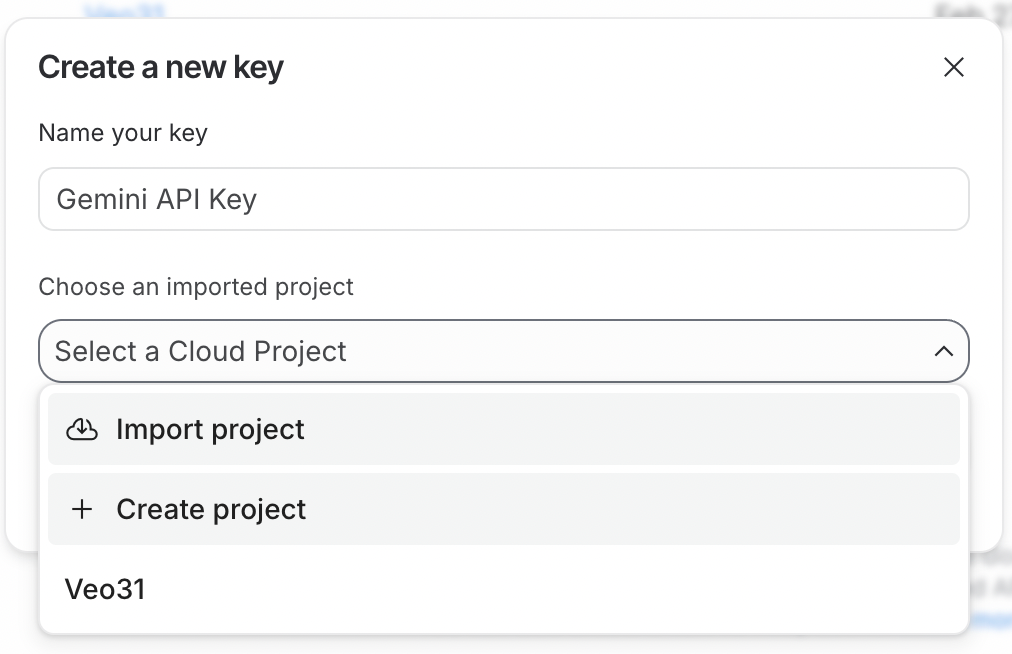

Pentru a folosi API-ul, trebuie mai întâi să generăm o cheie API. Pentru aceasta, autentificați-vă mai întâi în Google AI Studio. Apoi dați click pe butonul Create API Key din colțul din dreapta sus.

Cheia API trebuie legată de un proiect Google Cloud. Google AI Studio ușurează acest lucru, permițând crearea unui proiect direct în procesul de generare a cheii API.

Pentru a folosi cheia API, proiectul Google Cloud la care este legată trebuie să aibă facturarea activată. Dacă tocmai ați creat un proiect nou, trebuie să o activați făcând clic pe butonul Set up billing de lângă cheia API.

În final, copiați cheia API și lipiți-o într-un fișier numit .env cu următorul format:

GEMINI_API_KEY=<paste_key_here>Acest fișier .env trebuie creat în același folder în care vom scrie scripturile Python.

Configurarea mediului

În continuare, trebuie să instalăm dependențele Python necesare pentru a interacționa cu Gemini API. Pentru a face acest lucru, rulați următoarea comandă:

pip install google-genai python-dotenv pillowAceasta instalează următoarele pachete:

-

google-genai: Pachetul oficial Google pentru AI generativ. Este folosit pentru a crea ușor un client care interacționează cu Gemini API. -

python-dotenv: Un pachet utilitar folosit pentru a încărca cheia API din fișierul .env. -

pillow: O bibliotecă pentru imagini, care simplifică încărcarea imaginilor de oferit ca input pentru Nano Banana 2.

Generarea unei imagini

Iată codul Python complet pentru a genera o imagine:

from google import genai

from dotenv import load_dotenv

from google.genai import types

import time

# Load API key

load_dotenv()

client = genai.Client()

prompt = """

Lego version of the empire state building being built.

"""

# Make API request

response = client.models.generate_content(

model="gemini-3.1-flash-image-preview",

contents=[prompt],

config=types.GenerateContentConfig(

response_modalities=["Image"],

image_config=types.ImageConfig(

aspect_ratio="16:9",

image_size="4K",

),

)

)

# Save the image and display output text if any

for part in response.parts:

if part.text is not None:

print(part.text)

elif part.inline_data is not None:

image = part.as_image()

image.save(f"image_{int(time.time())}.png")Iată rezultatul:

Rapoarte de aspect și rezoluție acceptate

În cererea de mai sus, am specificat raportul de aspect folosind parametrul aspect_ratio și rezoluția folosind parametrul image_size.

Nano Banana 2 acceptă o gamă largă de rapoarte de aspect și rezoluții, de la 512 pixeli până la 4K. Iată lista completă a valorilor acceptate:

-

aspect_ratio: "1:1","1:4","1:8","2:3","3:2","3:4","4:1","4:3","4:5","5:4","8:1","9:16","16:9","21:9" -

image_size(rezoluție): "512px", "1K", "2K", "4K"

Să lucrăm practic cu Nano Banana 2

Acum că am configurat totul și am creat cu succes prima imagine, este timpul să punem la încercare funcțiile anunțate.

Editare de imagini cu consistența subiectului

Putem furniza imagini modelului încărcându-le cu PIL (instalat din pachetul pillow) și incluzându-le în lista contents.

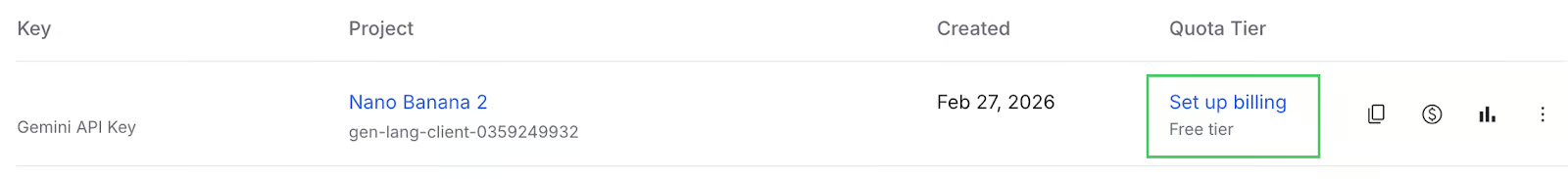

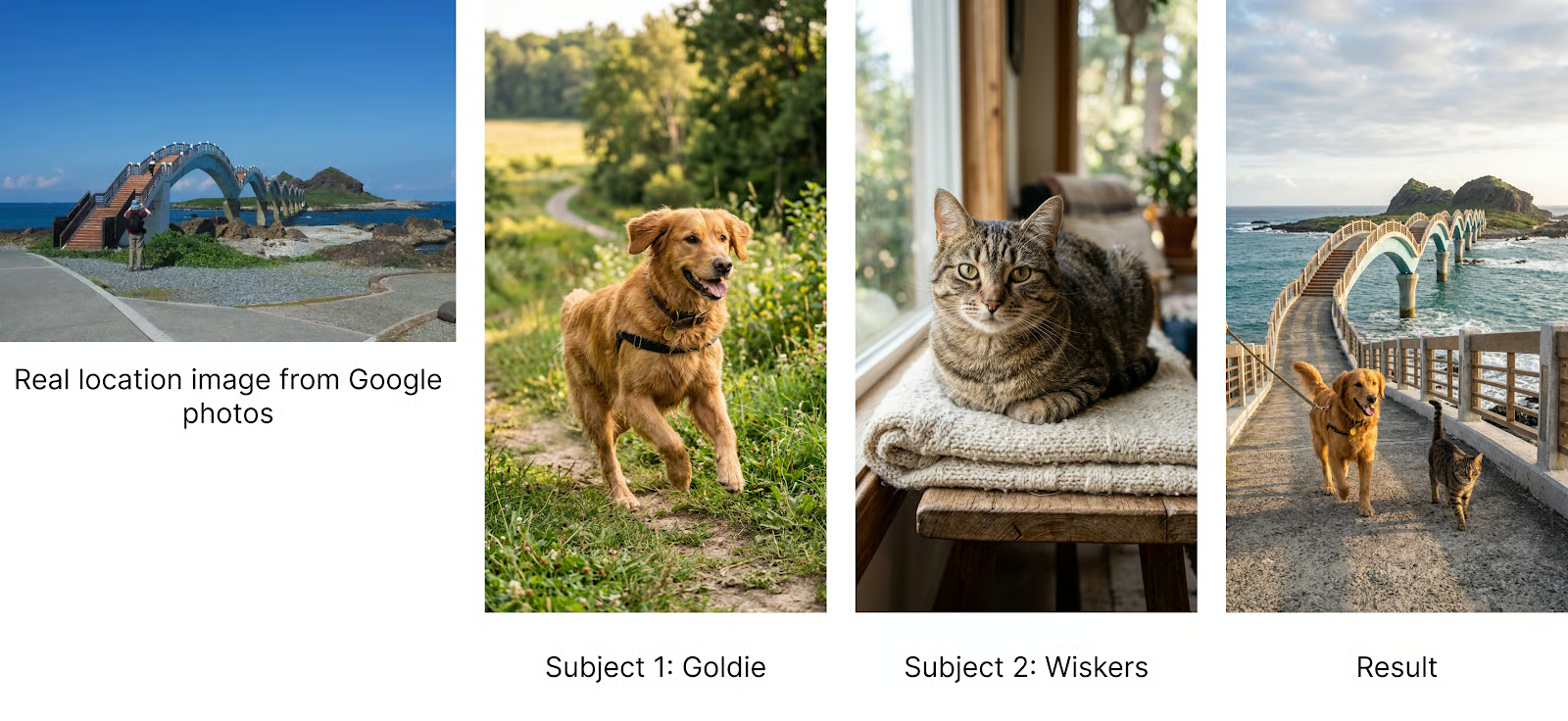

Una dintre principalele funcții ale Nano Banana 2 este capacitatea sa de a păstra subiectele atunci când generează imagini. Când am încercat alte modele precum iterația anterioară a Nano Banana sau GPT-Image, am observat adesea că era greu să generez imagini bazate pe subiecte reale, deoarece modelul tindea să le modifice aspectul.

Din documentația lor, menționează că modelul poate susține până la cinci personaje și 10 obiecte, pentru un total de 14 referințe. Nu definesc explicit personaje și obiecte, dar intuitiv înseamnă că modelul a fost antrenat pentru a genera scene care pot include până la 4 subiecte principale și până la 10 obiecte secundare cu care aceste subiecte interacționează.

Modelul nu oferă explicit parametri pentru trimiterea imaginilor cu personaje și obiecte. În schimb, acest lucru se face în prompt. Am inspectat codul sursă al unor dintre demo-urile lor pentru a înțelege cum structurează un prompt care să se refere la acestea.

Șablonul pe care l-am găsit a fost următorul:

<subject_name> (<Character #number>) = Image <#index>De exemplu, cu două personaje numite „Alice” și „Bob”, ar fi:

Subjects: Alice (Character 1) = Image 0, Bob (Character 2) = Image 1Mai jos este un exemplu complet de cod care arată cum să îi puneți în poză pe doi animale de companie, un câine și o pisică, împreună într-o fotografie.

from google import genai

from dotenv import load_dotenv

from google.genai import types

import time

from PIL import Image

# Load API key

load_dotenv()

client = genai.Client()

prompt = """

Goldie and Wiskers are posing together.

Subjects: Goldie (Character 1) = Image 0, Wiskers (Character 2) = Image 1

Maintain strict subject consistency for characters.

Adjust the subject composition/pose as appropriate for the scene.

"""

dog = Image.open("dog.png")

cat = Image.open("cat.png")

# Make API request

response = client.models.generate_content(

model="gemini-3.1-flash-image-preview",

contents=[prompt, dog, cat],

config=types.GenerateContentConfig(

response_modalities=["Image"],

image_config=types.ImageConfig(

aspect_ratio="9:16",

),

)

)

# Save the image and display output text if any

for part in response.parts:

if part.text is not None:

print(part.text)

elif part.inline_data is not None:

image = part.as_image()

image.save(f"image_{int(time.time())}.png")

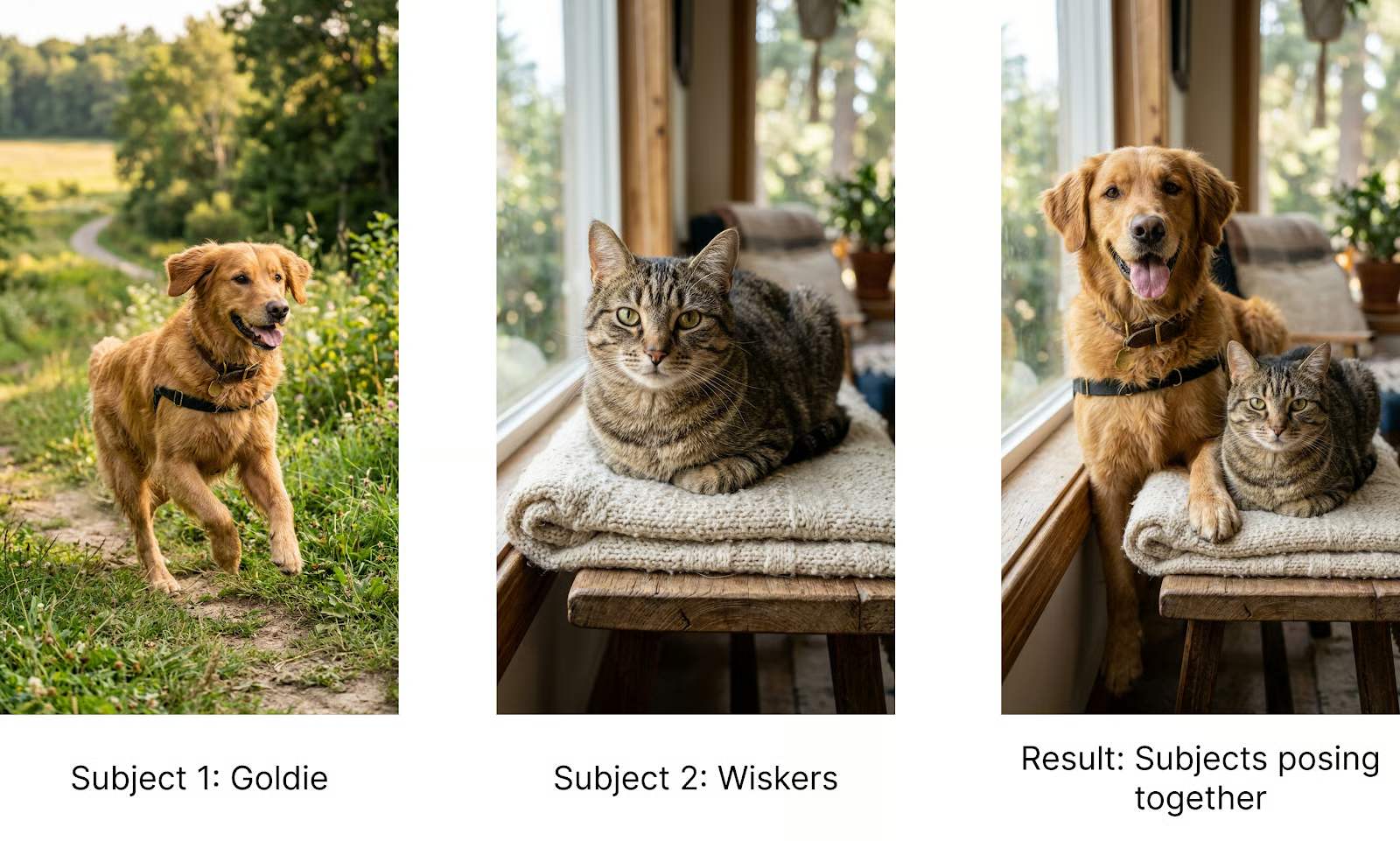

Încorporarea obiectelor

După cum s-a menționat mai sus, acest șablon nu face parte din documentația oficială. Probabil că modelul poate înțelege fiecare parte din prompt și din imagini. Totuși, când implementăm o aplicație reală în care dorim rezultate consecvente, cea mai bună practică este să fim cât mai preciși și consecvenți în prompt, așa că recomand folosirea acestui șablon.

Exemplul lor extinde șablonul pentru referințe la obiecte pur și simplu înlocuind „Character” cu „Object”, pentru a indica modelului că imaginea se referă la un obiect și nu la subiectul principal.

Pentru a demonstra acest lucru, să îi punem câinelui o anumită pereche de ochelari de soare și pisicii o șapcă, furnizând două referințe la obiecte. Acesta este promptul pe care l-am folosit:

Goldie and Wiskers are posing together. Goldie is wearing the Glasses, and Wiskers is wearing the Hat.

Subjects: Goldie (Pet 1) = Image 0, Wiskers (Pet 2) = Image 1, Glasses (Object 1) = Image 3, Hat (Object 2) = Image 4.

Maintain strict subject consistency for characters and objects.

Adjust the subject composition/pose as appropriate for the scene.Iată rezultatul:

Generare de imagini fundamentată pe căutare

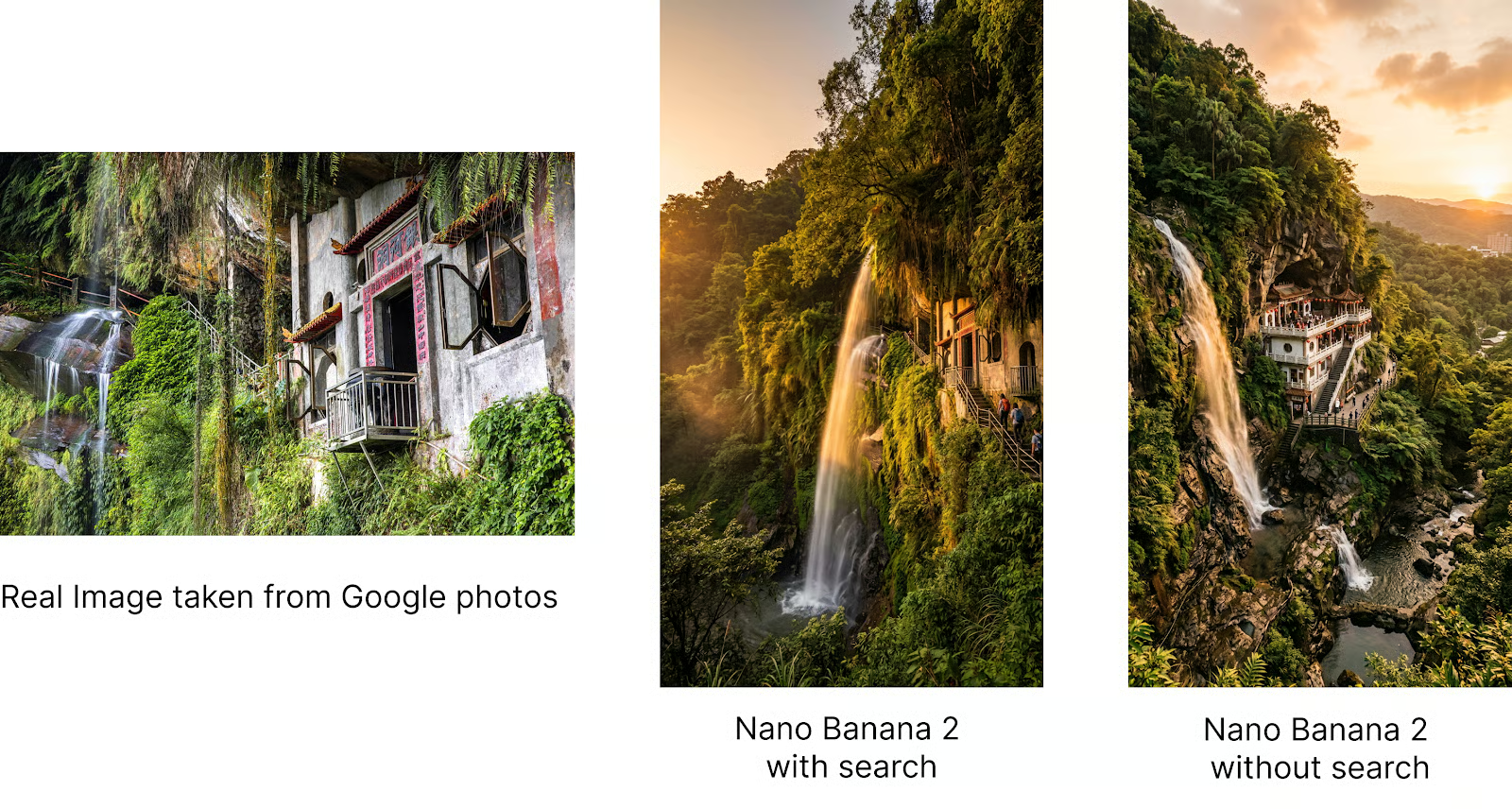

Nano Banana 2 face posibilă fundamentarea generării de imagini pe căutare, astfel încât rezultatele să fie mai precise. Acest lucru este util mai ales când generăm imagini care trebuie să fie în concordanță cu realitatea, cum ar fi imagini ale unei locații sau ale unei specii specifice de animal.

Locuiesc în Taiwan și, recent, a fost organizată o drumeție în care organizatorul a folosit o imagine generată cu Nano Banana pentru a ilustra locul drumeției. Totuși, imaginea nu era deloc precisă, iar oamenii au fost dezamăgiți pentru că arăta total diferit față de cea reală.

Acest lucru m-a făcut curios să văd dacă Nano Banana 2 poate gestiona asta.

Putem activa atât căutarea web, cât și căutarea de imagini folosind parametrul tools în cererea de generare.

Iată un exemplu complet:

from google import genai

from dotenv import load_dotenv

from google.genai import types

import time

# Load API key

load_dotenv()

client = genai.Client()

prompt = """

Create an image of the Yinhe Cave (銀河洞) in Taiwan at golden hour.

- Use Image Search to search for an image of the specified place.

- Keep the location and the view as close to the real reference as possible.

"""

# Make API request

response = client.models.generate_content(

model="gemini-3.1-flash-image-preview",

contents=[prompt],

config=types.GenerateContentConfig(

response_modalities=["Image"],

image_config=types.ImageConfig(

aspect_ratio="9:16",

),

tools=[

types.Tool(google_search=types.GoogleSearch(

search_types=types.SearchTypes(

web_search=types.WebSearch(), # Enables web search

image_search=types.ImageSearch() # Enables image search

)

))

]

)

)

# Save the image and display output text if any

for part in response.parts:

if part.text is not None:

print(part.text)

elif part.inline_data is not None:

image = part.as_image()

image.save(f"image_{int(time.time())}.png")Mai jos arătăm rezultatele. Mai întâi, imaginea reală luată din Google Photos, apoi imaginea generată de Nano Banana 2 folosind căutarea și, în final, imaginea generată fără căutare. Observăm că folosirea căutării face rezultatele foarte precise.

Echipa Gemini a construit un demo numit Window View care folosește această idee pentru a crea o mică aplicație ce arată locuri specifice printr-o fereastră. Este un bun exemplu al capacității modelului de a înțelege lumea reală.

Combinarea consistenței subiectului cu înțelegerea lumii

Oferind modelului abilitatea de a genera locații reale cu mare precizie, putem plasa subiecte specifice în locații din lumea reală.

Să încercăm să-i plasăm pe Goldie și Wiskers într-o locație din Taiwan. Am selectat această locație pentru că am vrut să văd dacă modelul poate gestiona locuri care nu sunt celebre în toată lumea.

Acesta a fost promptul:

Goldie and Wiskers are traveling across the Sanxiantai Arch Bridge in Taiwan.

Subjects: Goldie (Pet 1) = Image 0, Wiskers (Pet 2) = Image 1

Use image search to find visual references of the location.

Maintain strict subject consistency for characters and objects.

Adjust the subject composition/pose as appropriate for the scene.Rețineți că promptul cere explicit modelului să facă o căutare de imagini. Am constatat că, atunci când folosim unelte, este întotdeauna mai bine să cerem explicit modelului să le folosească în prompt.

Iată o imagine cu cele două personaje călătorind împreună:

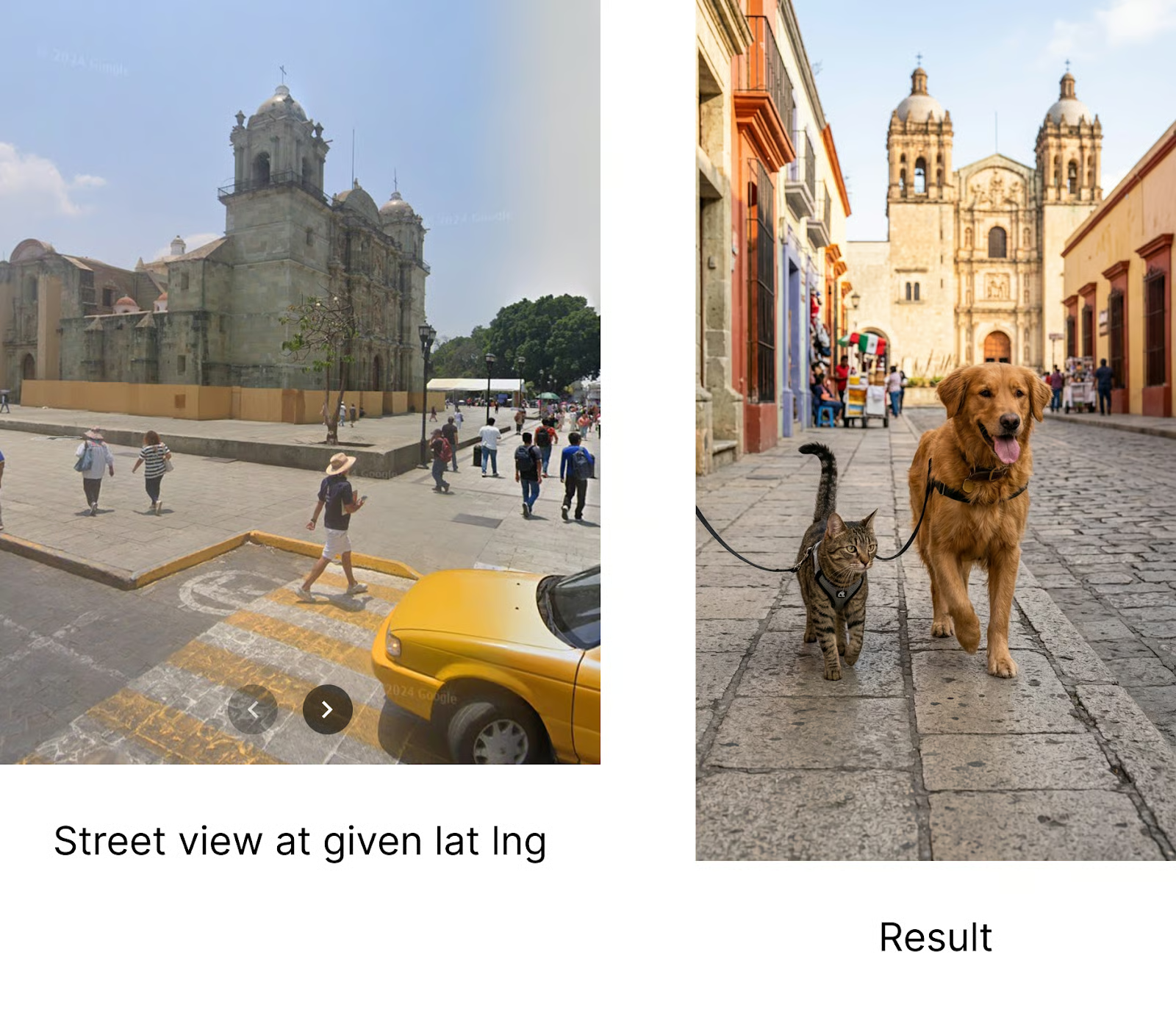

Pentru a merge mai departe, am încercat chiar să specific locația furnizând latitudinea și longitudinea, și a funcționat!

Goldie and Wiskers are at the location with a latitude of 17.0621186 and a longitude of -96.7255102.

Subjects: Goldie (Pet 1) = Image 0, Wiskers (Pet 2) = Image 1

Use image search to find visual references of the location.

Maintain strict subject consistency for characters and objects.

Adjust the subject composition/pose as appropriate for the scene.

Chiar dacă locația nu este exact aceeași latitudine și longitudine, elementele din imagine corespund cu ceea ce vedem în acea locație, ceea ce este, după părerea mea, impresionant.

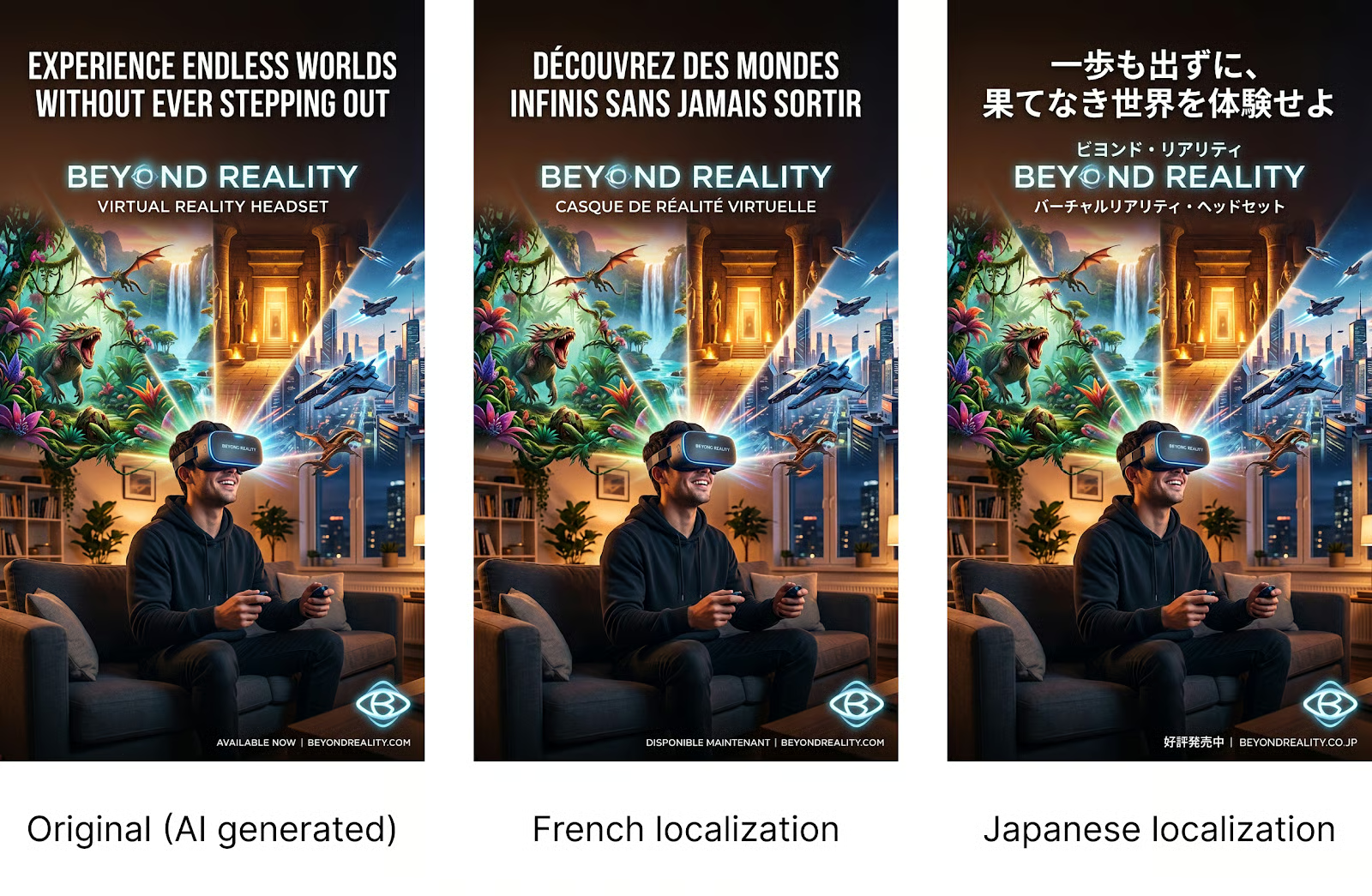

Localizarea textului

Nano Banana 2 îmbunătățește modelele anterioare de imagini bazate pe Flash, oferind redări de text mai consecvente și mai fiabile.

Textul poate apărea acum la fel de clar și corect ca grafica din jur. Nano Banana 2 permite și localizarea în imagine, făcând posibilă crearea sau traducerea textului în mai multe limbi direct în imaginea generată.

Am testat localizarea generând un poster pentru un brand fictiv de căști de realitate virtuală, „Beyond Reality”. Apoi am folosit pur și simplu un prompt de tip:

Change the language of the poster to Japanese.Iată rezultatele după schimbarea limbii textului de pe poster în franceză și apoi în japoneză:

Este interesant că modelul a fost suficient de inteligent să nu traducă numele brandului, deși acest lucru nu a fost specificat în prompt.

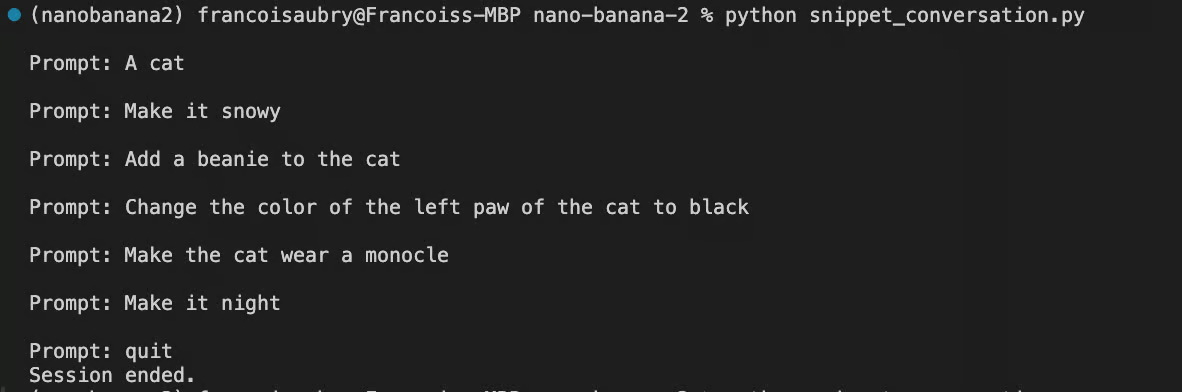

Mod conversație

Ultima funcție pe care o explorăm este modul conversație. Exemplele anterioare nu sunt interactive. Trimitem o cerere către API și obținem un rezultat. Dacă dorim să iterăm pe acel rezultat, trebuie să construim o nouă cerere cu acea imagine și modificările dorite.

O modalitate mai bună este să folosim modul chat. În modul chat, creăm o conversație folosind funcția client.chats.create(), apoi trimitem mesaje înainte și înapoi folosind funcția client.send_message(). Putem folosi acest lucru pentru a implementa un flux de editare prin chat:

- Utilizatorul trimite un prompt

- Nano Banana 2 generează o imagine pe baza promptului și a imaginii anterioare (dacă există)

- Imaginea este afișată utilizatorului

- Utilizatorul trimite un prompt de editare, întorcându-se la pasul 2.

Iată un script complet care implementează acest flux:

from google import genai

from google.genai import types

from dotenv import load_dotenv

from PIL import Image

import time

load_dotenv()

client = genai.Client()

# Initialize the chat session

chat = client.chats.create(

model="gemini-3.1-flash-image-preview",

config=types.GenerateContentConfig(

response_modalities=['TEXT', 'IMAGE'],

tools=[{"google_search": {}}]

)

)

# We keep track of the latest image object to send back as context

latest_image = None

while True:

user_input = input("\nPrompt: ")

if user_input.lower() in ['quit', 'exit', 'q']:

break

# Construct the message content

# If we have a previous image, we include it so the model knows what to edit

content = [user_input]

if latest_image:

content.append(latest_image)

try:

response = chat.send_message(content)

for part in response.parts:

# Handle Text Response

if part.text:

print(f"\nAI: {part.text}")

elif part.inline_data is not None:

image = part.as_image()

filename = f"image_{int(time.time())}.png"

image.save(filename)

print("Saved image", filename)

latest_image = Image.open(filename)

latest_image.show()

except Exception as e:

print(f"An error occurred: {e}")

print("Session ended.")Rulând acest script, putem edita o imagine iterativ direct în terminal astfel:

Iată rezultatele acestei interacțiuni:

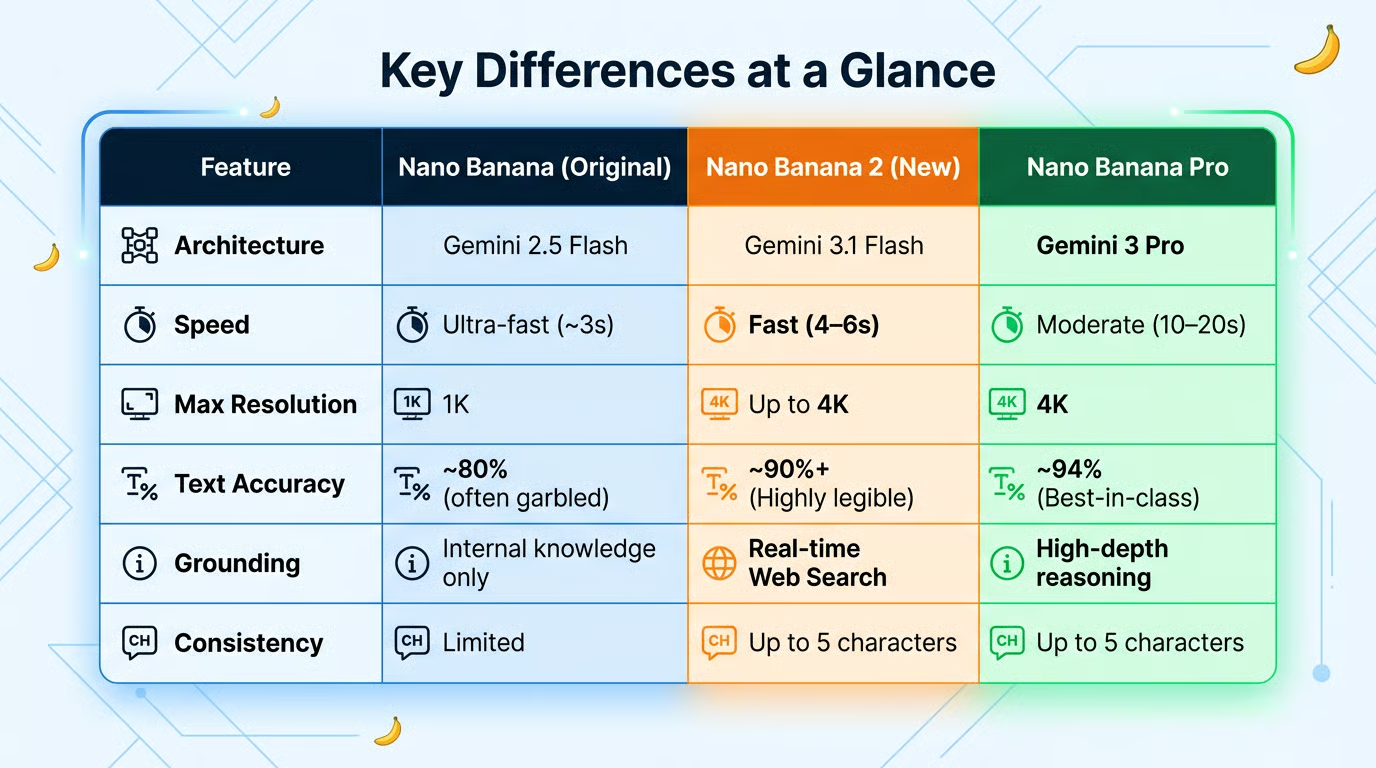

Nano Banana vs. Nano Banana 2

Tabelul de mai jos evidențiază principalele diferențe între modelele Nano Banana. După cum am menționat, noua versiune aduce îmbunătățiri semnificative în acuratețe, consistență și rezoluție, rulând în același timp doar puțin mai lent decât prima iterație.

Tabelul a fost de fapt generat de Nano Banana 2, oferindu-i datele.

Când să folosiți Nano Banana Pro

Deși Nano Banana 2 este noul standard, Nano Banana Pro rămâne disponibil pentru sarcini de tip „Thinking” și specializate. Ați putea alege în continuare Pro pentru:

- Realism extrem: Pro are încă un mic avantaj în fizica iluminării și texturile pielii.

- Raționament complex: Pro este mai bun la „parcurgerea cu gândul” a instrucțiunilor spațiale (de ex., „persoana din spatele celui de-al doilea stâlp din stânga”).

Concluzie

Nano Banana 2 se simte ca un adevărat succesor, deoarece reduce dramatic „derapajul” între iterații, permițându-vă să fixați un anumit look și să îl mențineți în mod fiabil prin scene, formate și limbi.

Între o persistență mai puternică a subiectului, o respectare mai strictă a instrucțiunilor, realism fundamentat pe căutare și editări conversaționale care ajustează în loc să redeseneze, este mult mai ușor să păstrați identitatea, layoutul și stilul intacte în timp ce explorați variații.

Redarea textului la nivel de producție ajută la menținerea consecventă a elementelor de brand, iar rapoartele de aspect flexibile fac scalarea unei campanii pe bannere, postere și povești mobile fără întreruperi. Pentru echipele care construiesc storyboard-uri, fotografii de produs sau materiale creative pentru mai multe piețe, oferă repetabilitate fără a sacrifica viteza sau fidelitatea.

Nano Banana 2 umple clar golul dintre Nano Banana și Nano Banana Pro: viteza sa este practic la ritmul aproape instantaneu al lui Nano Banana Flash, în timp ce capabilitățile, fidelitatea vizuală, respectarea precisă a instrucțiunilor, consistența subiectului și realismul fundamentat pe căutare ajung frecvent aproape de Nano Banana Pro.

Dacă doriți să aflați mai multe despre conceptele din spatele unor instrumente precum Nano Banana 2, vă recomandăm cursul nostru Generative AI Concepts.

Nano Banana 2 Întrebări frecvente

Care este numele modelului Nano Banana 2 când folosim API-ul?

Numele tehnic al lui Nano Banana 2 este gemini-3.1-flash-image-preview.

Oferă Nano Banana 2 un nivel gratuit pentru generarea de imagini?

Dacă aveți un abonament Gemini, Nano Banana 2 este noul implicit, deci îl puteți accesa acolo. Când folosiți API-ul, nu există un nivel gratuit, dar fiecare imagine este foarte ieftin de generat.

Este Nano Banana 2 mai bun decât Nano Banana Pro?

Nano Banana 2 se situează între Nano Banana și Nano Banana Pro. Este mult mai rapid decât Nano Banana Pro și obține rezultate similare.

Este activată implicit fundamentarea pe căutare în Nano Banana 2?

Nu, pentru a folosi fundamentarea pe căutare trebuie să furnizăm explicit acele unelte modelului. Primele 5.000 de cereri de căutare sunt gratuite. Cererile ulterioare costă 0,014 USD, pe lângă costul generării imaginii.