Track

Google ने इमेज जनरेशन मॉडल का दूसरा संस्करण, Nano Banana 2, जारी किया है। जब Nano Banana पहली बार लॉन्च हुआ था, तो उसने दुनिया का ध्यान खींच लिया और जल्दी ही सबसे बेहतर और तेज़ AI इमेज जनरेशन मॉडल बन गया।

इस लेख में, हम उनके नए मॉडल का गहराई से अध्ययन करेंगे, इसकी नई विशेषताओं का पता लगाएंगे, और Python के साथ API के जरिए इसका उपयोग करना सीखेंगे।

यदि आप सामान्य रूप से इमेज जनरेशन में रुचि रखते हैं, तो मैं निम्न मॉडलों पर हमारे गाइड देखने की सलाह दूंगा:

Nano Banana 2 क्या है?

Nano Banana 2, जिसे Gemini 3.1 Flash Image के नाम से भी जाना जाता है, Google DeepMind का नवीनतम अत्याधुनिक इमेज जनरेशन और एडिटिंग AI मॉडल है। यह Nano Banana Pro के उन्नत विश्व-ज्ञान, गुणवत्ता और रीजनिंग को Gemini Flash की बिजली-सी तेज़ गति के साथ जोड़ता है, जिससे उच्च-फिडेलिटी क्रिएशन और तेज़ इटेरेशन एक ही वर्कफ़्लो में संभव हो जाता है।

मुख्य क्षमताएँ

यहाँ Nano Banana 2 की प्रमुख विशेषताओं का एक अवलोकन है:

- बेहतर सटीकता: Gemini के वास्तविक‑दुनिया के ज्ञान और रियल-टाइम वेब इमेज सिग्नल्स पर आधारित जनरेशन, जिससे विशिष्ट विषयों का अधिक सटीक रेंडर मिलता है। इन्फोग्राफिक्स, डायग्राम और डेटा विज़ुअलाइज़ेशन के लिए आदर्श।

- उन्नत टाइपोग्राफी: इमेज के भीतर पठनीय और सटीक टेक्स्ट बनाता है और इमेज के अंदर ही लोकलाइज़ेशन और अनुवाद का समर्थन करता है।

- क्रिएटिव कंट्रोल: नैरेटिव और स्टोरीबोर्ड के लिए सब्जेक्ट कंसिस्टेंसी में सुधार। मॉडल एक ही वर्कफ़्लो में पाँच तक कैरेक्टर्स की समानता और 14 तक ऑब्जेक्ट्स की फिडेलिटी बनाए रखता है।

- विश्वसनीयता: जटिल, सूक्ष्म प्रॉम्प्ट्स को बेहतर तरीके से कैप्चर करने के लिए सटीक निर्देश-अनुसरण।

- हाई रेज़ोल्यूशन: 512 पिक्सेल से 4K तक लचीले आस्पेक्ट रेशियो और रेज़ोल्यूशन के साथ प्रोडक्शन-तैयार स्पेसिफिकेशंस।

- विज़ुअल क्वालिटी: रिच टेक्स्चर, जीवंत लाइटिंग, और अधिक शार्प डिटेल के साथ विज़ुअल फिडेलिटी अपग्रेड—वह भी Flash स्पीड पर।

यदि आप Nano Banana में नए हैं, तो पहले हमारे Nano Banana Pro पर पिछले लेख को पढ़ना चाहेंगे।

Nano Banana 2 तक कैसे पहुँचें

इस लेख में, हम Python के साथ API के जरिए Nano Banana 2 का उपयोग करना कवर करेंगे। हालाँकि, नए मॉडल पूरे Gemini इकोसिस्टम में उपलब्ध हैं:

- Gemini ऐप: Nano Banana 2 अब Fast, Thinking और Pro मोड्स में डिफॉल्ट इमेज मॉडल है। Google AI Pro और Ultra सब्सक्राइबर्स विशेष, अधिकतम तथ्य-सटीकता वाले टास्क्स के लिए तीन-डॉट मेन्यू के जरिए अब भी Nano Banana Pro से फिर जनरेट कर सकते हैं।

- Search: Google ऐप और मोबाइल/डेस्कटॉप ब्राउज़र्स में AI Mode और Lens में उपलब्ध, और विस्तारित उपलब्धता (141 नए देश/क्षेत्र और आठ अतिरिक्त भाषाएँ) के साथ।

- AI Studio + Gemini API: प्रीव्यू में उपलब्ध (प्राइसिंग देखें)। Google Antigravity में भी उपलब्ध।

- Google Cloud: Vertex AI में Gemini API के जरिए प्रीव्यू में।

- Flow: सभी Flow उपयोगकर्ताओं के लिए अब डिफॉल्ट इमेज जनरेशन मॉडल।

- Google Ads: कैम्पेन क्रिएशन के दौरान क्रिएटिव सजेशंस को पावर करता है।

API प्राइसिंग

इस लेख में, हम API के साथ Nano Banana 2 का उपयोग करेंगे, जिसका अर्थ है कि हमें सब्सक्रिप्शन की आवश्यकता नहीं होगी और इसके बजाय हम हर जनरेट हुई इमेज के लिए भुगतान करेंगे।

मुझे आधिकारिक प्राइसिंग टेबल थोड़ी बहुत जटिल लगी। आम तौर पर, AI इमेज मॉडल प्रति इमेज एक निश्चित कीमत बताते हैं।

इसे सरल बनाने के लिए, मैंने इमेज साइज के आधार पर अनुमानित कीमतों की गणना की। ध्यान दें कि ये सटीक कीमतें नहीं हैं—इनमें थोड़ा बदलाव हो सकता है।

|

इमेज साइज |

प्रति इमेज लागत |

|

512px |

$0.045 |

|

1024px (1K) |

$0.067 |

|

2048px (2K) |

$0.101 |

|

4096px (4K) |

$0.151 |

Nano Banana 2 वेब सर्च करके अधिक सटीक परिणाम जनरेट कर सकता है। यह एक बहुत उपयोगी फीचर है, लेकिन इसकी कीमत में इसे भी शामिल करना होगा, क्योंकि सर्च का अतिरिक्त शुल्क लगता है।

Google Search के साथ ग्राउंडिंग का उपयोग करने पर प्रति माह पहले 5,000 Google Search क्वेरीज़ मुफ्त हैं। उसके बाद, 1,000 क्वेरीज़ पर $14 का खर्च आता है।

अपनी पहली Nano Banana 2 इमेज जनरेट करना

चलो, बिना देर किए Nano Banana 2 के साथ शुरुआत करते हैं।

API कुंजी जनरेट करना

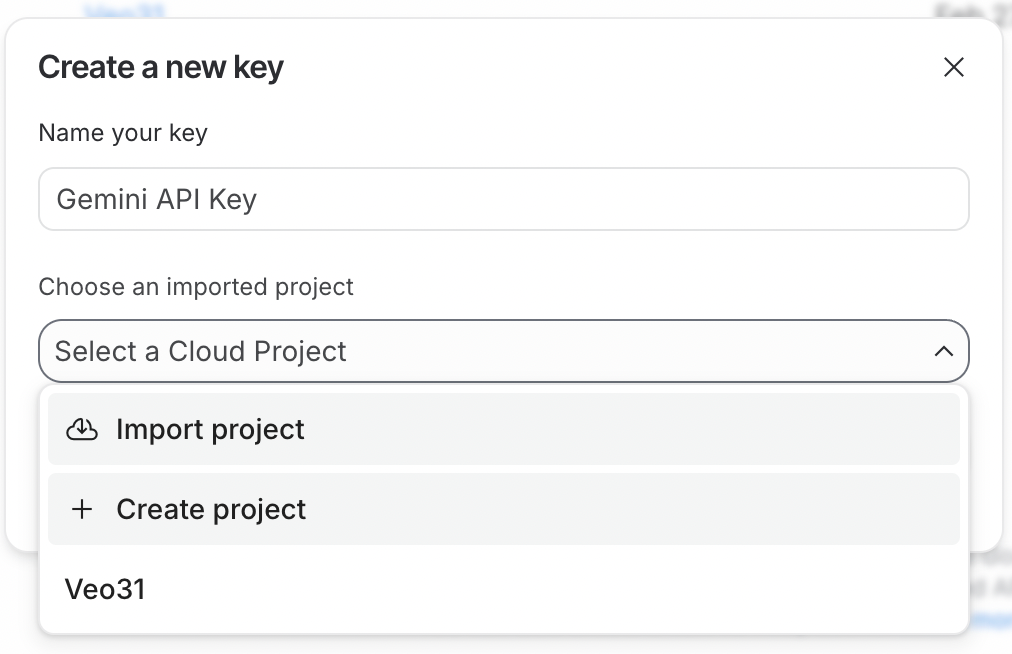

API का उपयोग करने के लिए, हमें पहले एक API कुंजी जनरेट करनी होगी। ऐसा करने के लिए, पहले Google AI Studio में साइन इन करें। फिर ऊपर-दाएँ कोने में Create API Key बटन पर क्लिक करें।

API कुंजी को किसी Google Cloud प्रोजेक्ट से लिंक होना चाहिए। Google AI Studio इसे आसान बनाता है—API कुंजी जनरेशन प्रक्रिया के दौरान सीधे प्रोजेक्ट बनाने की सुविधा देता है।

API कुंजी का उपयोग करने के लिए, उससे लिंक Google Cloud प्रोजेक्ट में बिलिंग सक्षम होनी चाहिए। यदि आपने नया प्रोजेक्ट बनाया है, तो API कुंजी के पास वाले Set up billing बटन पर क्लिक करके इसे सक्षम करें।

अंत में, API कुंजी कॉपी करें और उसे .env नाम की फ़ाइल में निम्न प्रारूप में पेस्ट करें:

GEMINI_API_KEY=<paste_key_here>यह .env फ़ाइल उसी फ़ोल्डर में बनाई जानी चाहिए जहाँ हम Python स्क्रिप्ट लिखेंगे।

एन्वायरनमेंट सेटअप

अब हमें Gemini API के साथ इंटरैक्ट करने के लिए आवश्यक Python डिपेंडेंसीज़ इंस्टॉल करनी होंगी। इसके लिए, निम्न कमांड चलाएँ:

pip install google-genai python-dotenv pillowयह निम्न पैकेज इंस्टॉल करता है:

-

google-genai: आधिकारिक Google जनरेटिव AI पैकेज। Gemini API के साथ इंटरैक्ट करने के लिए क्लाइंट बनाना आसान बनाता है। -

python-dotenv:.envफ़ाइल से API कुंजी लोड करने के लिए यूटिलिटी पैकेज। -

pillow: एक इमेज लाइब्रेरी, जिससे Nano Banana 2 को इनपुट के रूप में देने के लिए इमेज लोड करना आसान होता है।

इमेज जनरेट करना

इमेज जनरेट करने के लिए पूरा Python कोड यहाँ है:

from google import genai

from dotenv import load_dotenv

from google.genai import types

import time

# Load API key

load_dotenv()

client = genai.Client()

prompt = """

Lego version of the empire state building being built.

"""

# Make API request

response = client.models.generate_content(

model="gemini-3.1-flash-image-preview",

contents=[prompt],

config=types.GenerateContentConfig(

response_modalities=["Image"],

image_config=types.ImageConfig(

aspect_ratio="16:9",

image_size="4K",

),

)

)

# Save the image and display output text if any

for part in response.parts:

if part.text is not None:

print(part.text)

elif part.inline_data is not None:

image = part.as_image()

image.save(f"image_{int(time.time())}.png")यह रहा परिणाम:

समर्थित आस्पेक्ट्स और रेज़ोल्यूशन

ऊपर के अनुरोध में, हमने aspect_ratio पैरामीटर से आस्पेक्ट रेशियो और image_size पैरामीटर से रेज़ोल्यूशन निर्दिष्ट किया था।

Nano Banana 2 512 पिक्सेल से 4K तक के विभिन्न आस्पेक्ट रेशियो और रेज़ोल्यूशन को सपोर्ट करता है। समर्थित मानों की पूरी सूची यहाँ है:

-

aspect_ratio: "1:1","1:4","1:8","2:3","3:2","3:4","4:1","4:3","4:5","5:4","8:1","9:16","16:9","21:9" -

image_size(रेज़ोल्यूशन): "512px", "1K", "2K", "4K"

Nano Banana 2 के साथ हैंड्स-ऑन

अब जब सेटअप पूरा हो गया है और हमारी पहली इमेज बन गई है, तो विज्ञापित फीचर्स को परखने का समय है।

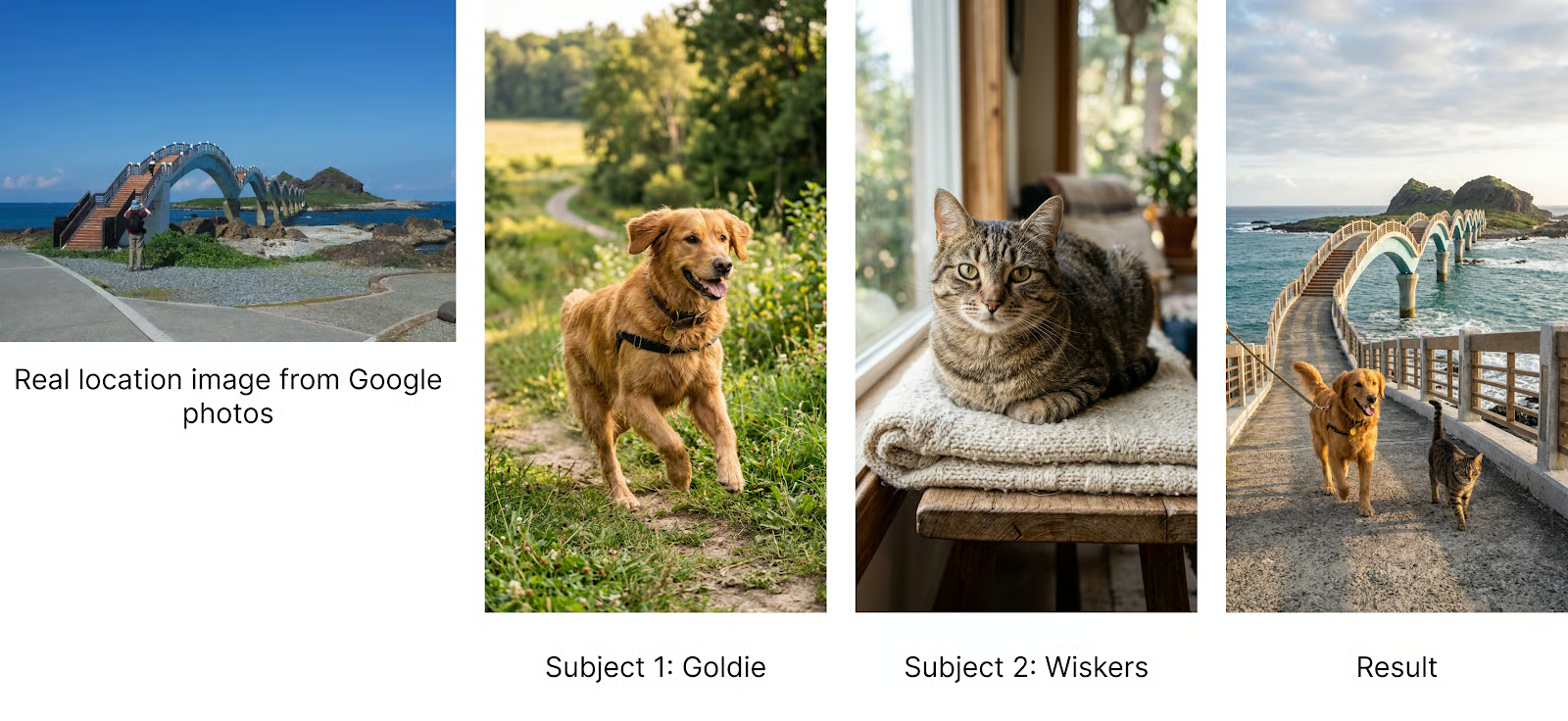

सब्जेक्ट कंसिस्टेंसी के साथ इमेज एडिटिंग

हम PIL (जो pillow पैकेज से इंस्टॉल होती है) से इमेज लोड करके और उन्हें contents सूची में शामिल करके मॉडल को इमेज दे सकते हैं।

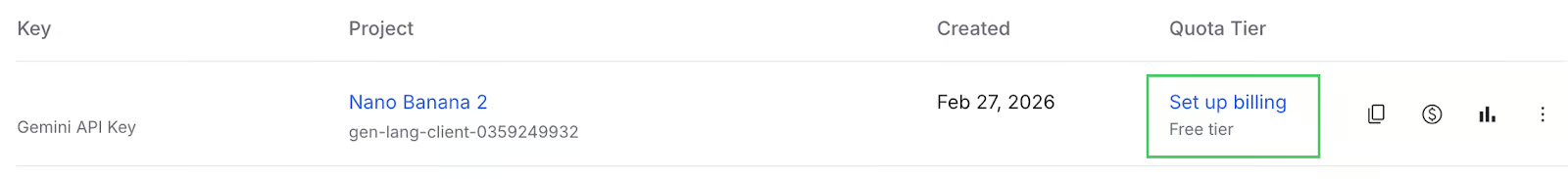

Nano Banana 2 की मुख्य विशेषताओं में से एक है इमेज जनरेट करते समय सब्जेक्ट्स को संरक्षित रखने की क्षमता। जब Nano Banana के पिछले संस्करण या GPT-Image जैसे अन्य मॉडलों को आज़माया, तो मुझे अकसर लगा कि वास्तविक विषयों पर आधारित इमेज जनरेट करना कठिन है, क्योंकि मॉडल उनके लुक में बदलाव कर देता था।

डॉक्यूमेंटेशन में बताया गया है कि मॉडल पाँच तक कैरेक्टर्स और 10 ऑब्जेक्ट्स—कुल 14 रेफरेंसेज़—सपोर्ट कर सकता है। वे कैरेक्टर्स और ऑब्जेक्ट्स की स्पष्ट परिभाषा नहीं देते, लेकिन सहज रूप से इसका मतलब है कि मॉडल ऐसे दृश्यों को जनरेट करने के लिए प्रशिक्षित है जिनमें 4 तक मुख्य सब्जेक्ट्स और 10 तक सेकेंडरी ऑब्जेक्ट्स रखे जा सकें जिनके साथ ये सब्जेक्ट्स इंटरैक्ट करते हैं।

मॉडल कैरेक्टर इमेज और ऑब्जेक्ट्स सबमिट करने के लिए अलग पैरामीटर प्रदान नहीं करता। इसके बजाय, यह प्रॉम्प्ट में किया जाता है। मैंने उनके कुछ डेमो का सोर्स कोड देखकर समझा कि वे प्रॉम्प्ट को इन संदर्भों के लिए कैसे स्ट्रक्चर करते हैं।

मुझे मिला टेम्पलेट यह था:

<subject_name> (<Character #number>) = Image <#index>उदाहरण के लिए, दो कैरेक्टर्स "Alice" और "Bob" के साथ यह होगा:

Subjects: Alice (Character 1) = Image 0, Bob (Character 2) = Image 1नीचे पूरा कोड उदाहरण है जो दिखाता है कि कैसे दो पालतू जानवरों—एक कुत्ता और एक बिल्ली—को साथ में फोटो में पोज़ कराया जाए।

from google import genai

from dotenv import load_dotenv

from google.genai import types

import time

from PIL import Image

# Load API key

load_dotenv()

client = genai.Client()

prompt = """

Goldie and Wiskers are posing together.

Subjects: Goldie (Character 1) = Image 0, Wiskers (Character 2) = Image 1

Maintain strict subject consistency for characters.

Adjust the subject composition/pose as appropriate for the scene.

"""

dog = Image.open("dog.png")

cat = Image.open("cat.png")

# Make API request

response = client.models.generate_content(

model="gemini-3.1-flash-image-preview",

contents=[prompt, dog, cat],

config=types.GenerateContentConfig(

response_modalities=["Image"],

image_config=types.ImageConfig(

aspect_ratio="9:16",

),

)

)

# Save the image and display output text if any

for part in response.parts:

if part.text is not None:

print(part.text)

elif part.inline_data is not None:

image = part.as_image()

image.save(f"image_{int(time.time())}.png")

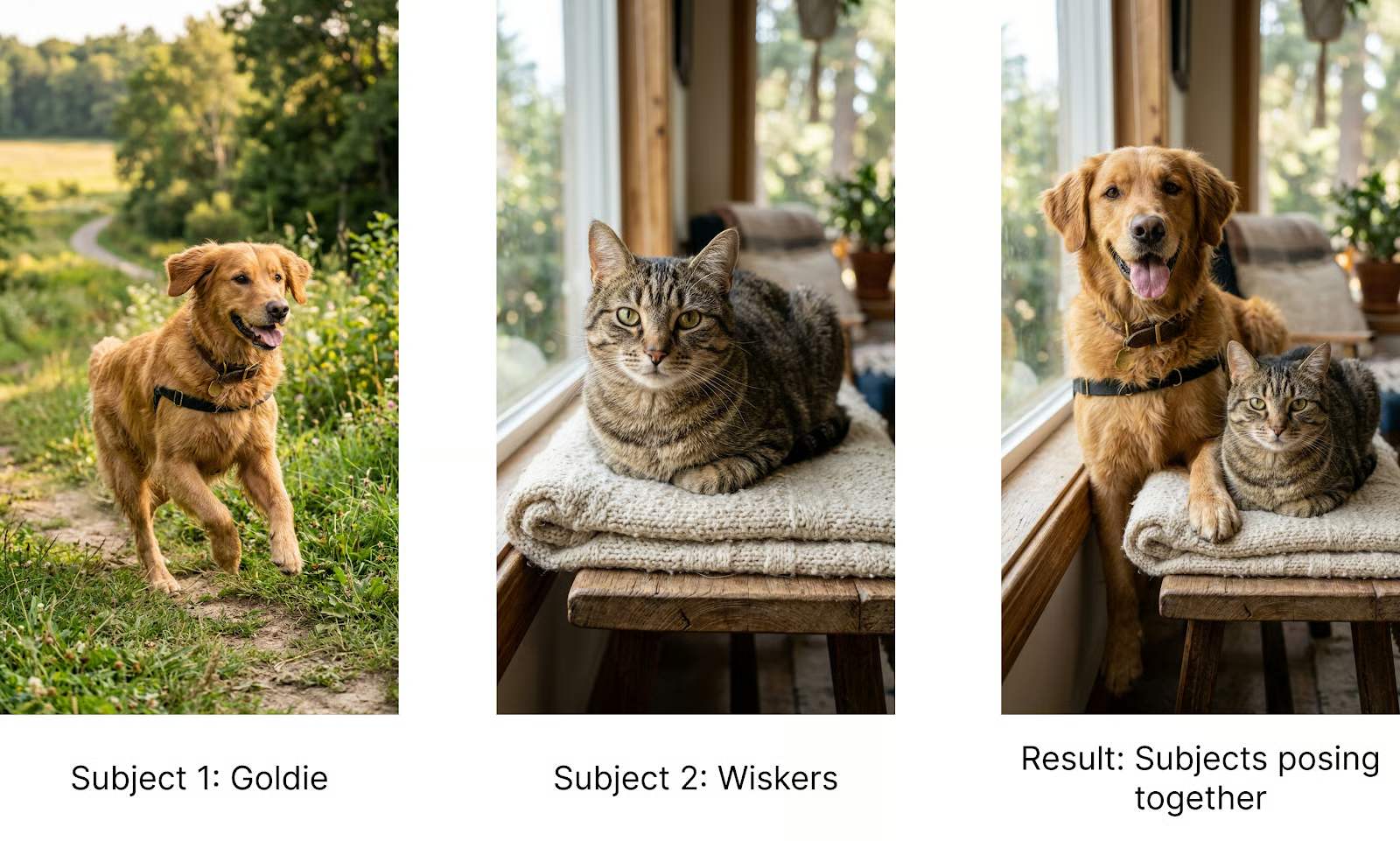

ऑब्जेक्ट्स शामिल करना

जैसा कि ऊपर बताया गया, यह टेम्पलेट आधिकारिक डॉक्यूमेंटेशन का हिस्सा नहीं है। मॉडल शायद प्रॉम्प्ट और इमेज से ही हर भाग को समझ सकता है। फिर भी, जब हम किसी वास्तविक एप्लिकेशन में कंसिस्टेंट परिणाम चाहते हैं, तो प्रॉम्प्ट में यथासंभव सटीक और एकरूप होना सर्वश्रेष्ठ प्रैक्टिस है, इसलिए मैं इस टेम्पलेट का उपयोग करने की सलाह देता/देती हूँ।

उनके उदाहरण में ऑब्जेक्ट रेफरेंस के लिए टेम्पलेट को बस "Character" को "Object" से बदलकर बढ़ाया गया है, ताकि मॉडल जान ले कि इमेज किसी ऑब्जेक्ट को संदर्भित करती है, न कि मुख्य सब्जेक्ट को।

इसे दिखाने के लिए, चलिए कुत्ते को खास चश्मा और बिल्ली को टोपी पहनाते हैं, जिसके लिए हम दो ऑब्जेक्ट रेफरेंस देंगे। मैंने यह प्रॉम्प्ट उपयोग किया:

Goldie and Wiskers are posing together. Goldie is wearing the Glasses, and Wiskers is wearing the Hat.

Subjects: Goldie (Pet 1) = Image 0, Wiskers (Pet 2) = Image 1, Glasses (Object 1) = Image 3, Hat (Object 2) = Image 4.

Maintain strict subject consistency for characters and objects.

Adjust the subject composition/pose as appropriate for the scene.यह रहा परिणाम:

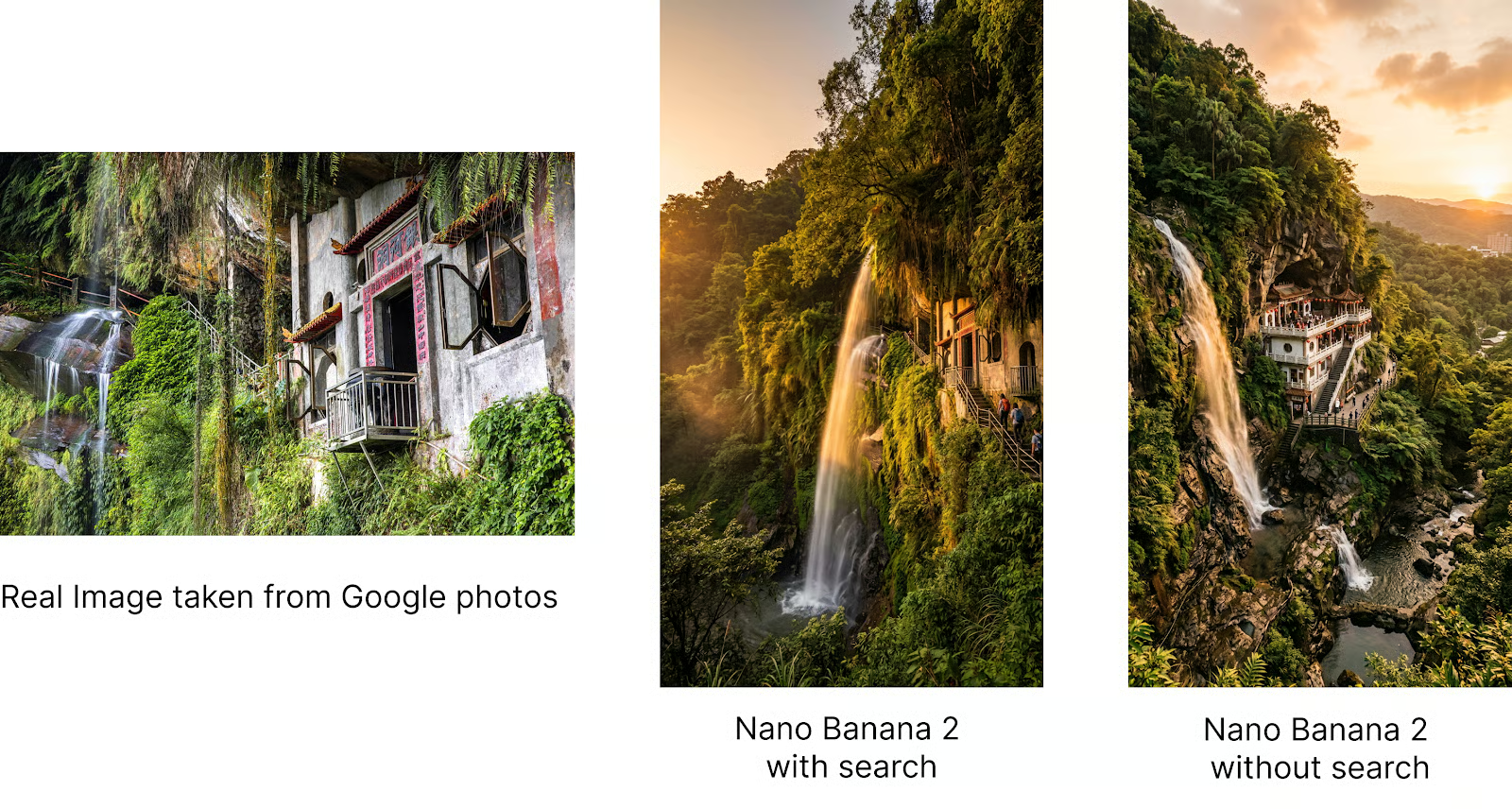

सर्च के साथ ग्राउंडेड इमेज जनरेशन

Nano Banana 2 जनरेशन को सर्च पर ग्राउंड करना संभव बनाता है, ताकि परिणाम अधिक सटीक हों। यह विशेष रूप से तब उपयोगी है जब वास्तविकता के अनुरूप इमेज बनानी हों, जैसे किसी स्थान या किसी विशेष प्रजाति के जानवर की इमेज।

मैं ताइवान में रहा/रही हूँ, और हाल ही में एक संगठित हाइक हुई, जहाँ आयोजक ने हाइकिंग लोकेशन दिखाने के लिए Nano Banana से जनरेट की गई इमेज का उपयोग किया। लेकिन इमेज बिल्कुल सटीक नहीं थी, और लोग निराश हुए क्योंकि वह वास्तविक स्थान से बिल्कुल अलग दिखती थी।

इससे मुझे जिज्ञासा हुई कि क्या Nano Banana 2 इसे संभाल सकता है।

हम जनरेशन रिक्वेस्ट में tools पैरामीटर का उपयोग करके वेब सर्च और इमेज सर्च दोनों सक्षम कर सकते हैं।

पूरा उदाहरण यहाँ है:

from google import genai

from dotenv import load_dotenv

from google.genai import types

import time

# Load API key

load_dotenv()

client = genai.Client()

prompt = """

Create an image of the Yinhe Cave (銀河洞) in Taiwan at golden hour.

- Use Image Search to search for an image of the specified place.

- Keep the location and the view as close to the real reference as possible.

"""

# Make API request

response = client.models.generate_content(

model="gemini-3.1-flash-image-preview",

contents=[prompt],

config=types.GenerateContentConfig(

response_modalities=["Image"],

image_config=types.ImageConfig(

aspect_ratio="9:16",

),

tools=[

types.Tool(google_search=types.GoogleSearch(

search_types=types.SearchTypes(

web_search=types.WebSearch(), # Enables web search

image_search=types.ImageSearch() # Enables image search

)

))

]

)

)

# Save the image and display output text if any

for part in response.parts:

if part.text is not None:

print(part.text)

elif part.inline_data is not None:

image = part.as_image()

image.save(f"image_{int(time.time())}.png")नीचे हम परिणाम दिखाते हैं। पहले, Google Photos से ली गई वास्तविक इमेज; फिर सर्च का उपयोग करके Nano Banana 2 द्वारा जनरेट की गई इमेज; और अंत में बिना सर्च के जनरेट की गई इमेज। हम देखते हैं कि सर्च से परिणाम बहुत सटीक हो जाते हैं।

Gemini टीम ने Window View नाम का एक डेमो बनाया है जो इस विचार का उपयोग करके एक छोटा ऐप बनाता है जो खिड़की के जरिए विशिष्ट स्थानों को दिखाता है। यह मॉडल की वास्तविक दुनिया को समझने की क्षमता का अच्छा प्रदर्शन है।

विश्व-समझ के साथ सब्जेक्ट कंसिस्टेंसी को जोड़ना

जब मॉडल वास्तविक स्थानों को उच्च परिशुद्धता के साथ जनरेट कर सकता है, तो हम विशिष्ट सब्जेक्ट्स को वास्तविक स्थानों पर रख सकते हैं।

आइए गोल्डी और विस्कर्स को ताइवान के एक स्थान पर रखते हैं। मैंने यह स्थान इसलिए चुना क्योंकि मैं देखना चाहता/चाहती था कि मॉडल प्रसिद्ध स्थानों के अलावा भी लोकेशन संभाल सकता है या नहीं।

यह रहा प्रॉम्प्ट:

Goldie and Wiskers are traveling across the Sanxiantai Arch Bridge in Taiwan.

Subjects: Goldie (Pet 1) = Image 0, Wiskers (Pet 2) = Image 1

Use image search to find visual references of the location.

Maintain strict subject consistency for characters and objects.

Adjust the subject composition/pose as appropriate for the scene.ध्यान दें कि प्रॉम्प्ट मॉडल को स्पष्ट रूप से इमेज सर्च करने के लिए कहता है। मैंने पाया है कि जब टूल्स का उपयोग करते हैं, तो प्रॉम्प्ट में उन्हें स्पष्ट रूप से उपयोग करने के लिए कहना बेहतर रहता है।

यह रही हमारे दोनों कैरेक्टर्स की साथ यात्रा करते हुए इमेज:

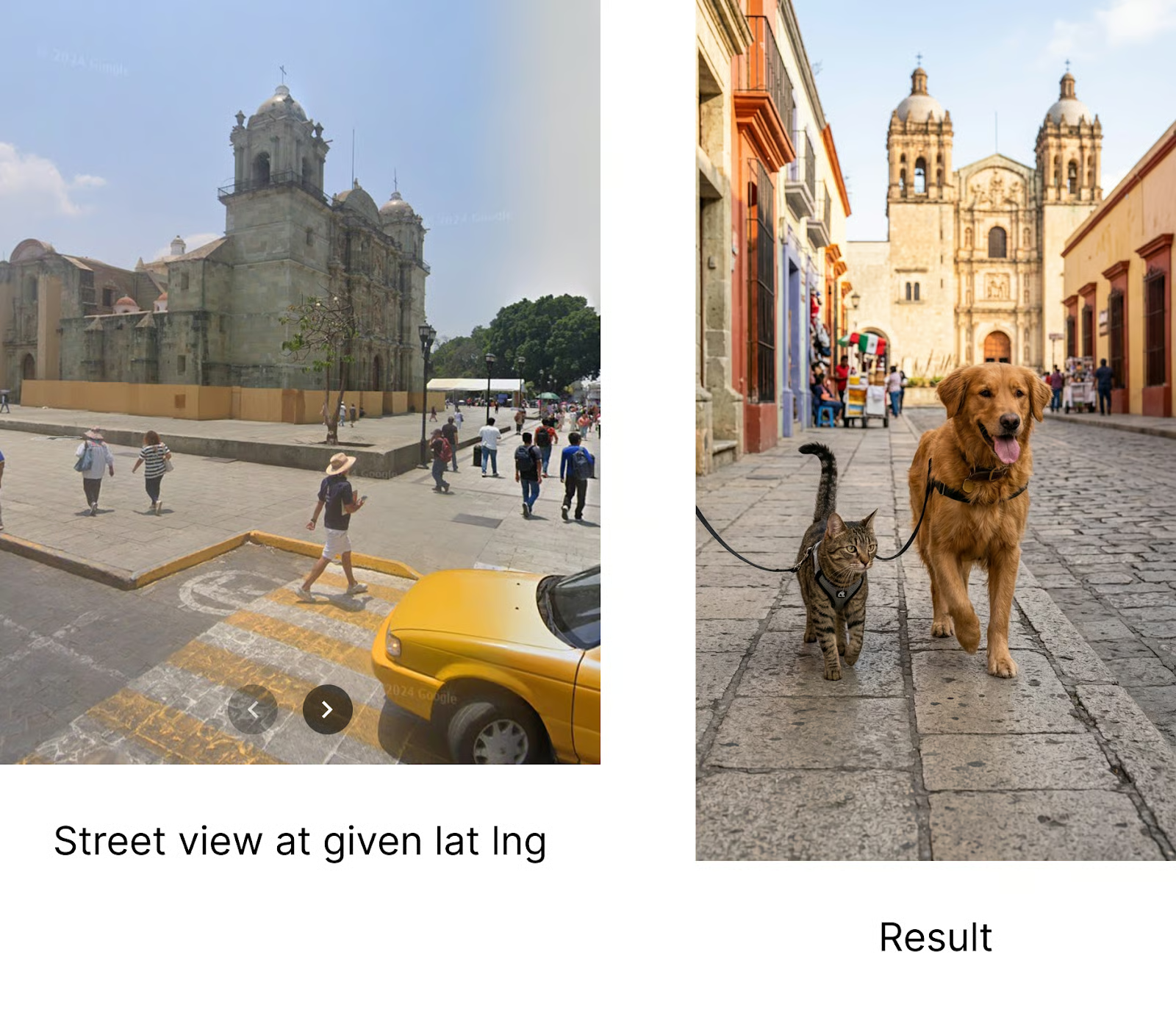

इसे और आगे बढ़ाने के लिए, मैंने लोकेशन को लैटिट्यूड और लॉन्गिट्यूड देकर भी निर्दिष्ट किया—और यह काम कर गया!

Goldie and Wiskers are at the location with a latitude of 17.0621186 and a longitude of -96.7255102.

Subjects: Goldie (Pet 1) = Image 0, Wiskers (Pet 2) = Image 1

Use image search to find visual references of the location.

Maintain strict subject consistency for characters and objects.

Adjust the subject composition/pose as appropriate for the scene.

भले ही लोकेशन बिल्कुल वही लैटिट्यूड-लॉन्गिट्यूड न हो, इमेज के तत्व वहाँ के दृश्य से मेल खाते हैं—जो मेरे विचार में काफ़ी प्रभावशाली है।

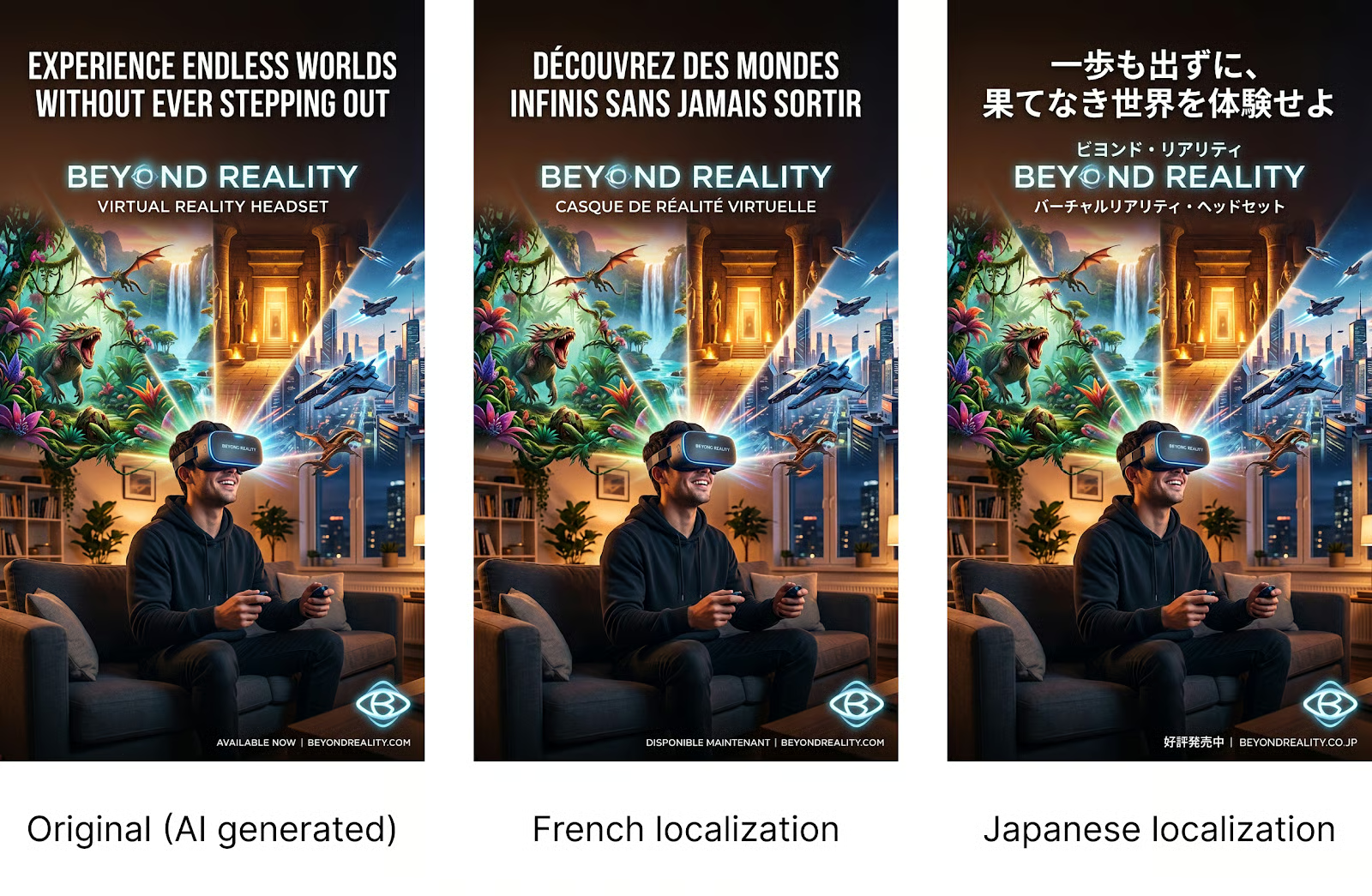

टेक्स्ट लोकलाइज़ेशन

Nano Banana 2 पहले के Flash‑आधारित इमेज मॉडलों की तुलना में अधिक कंसिस्टेंट और भरोसेमंद टेक्स्ट रेंडरिंग प्रदान करता है।

अब टेक्स्ट आसपास के ग्राफिक्स जितना ही शार्प और सटीक दिख सकता है। Nano Banana 2 इमेज के अंदर ही लोकलाइज़ेशन सक्षम करता है, जिससे जनरेट की गई इमेज के भीतर सीधे कई भाषाओं में टेक्स्ट बनाना या अनुवाद करना संभव होता है।

मैंने "Beyond Reality" नामक एक काल्पनिक वर्चुअल रियलिटी हेडसेट ब्रांड के लिए पोस्टर बनाकर लोकलाइज़ेशन का परीक्षण किया। फिर मैंने बस इस तरह का प्रॉम्प्ट दिया:

Change the language of the poster to Japanese.यहाँ पोस्टर के टेक्स्ट की भाषा पहले फ्रेंच और फिर जापानी में बदलने के बाद के परिणाम हैं:

यह दिलचस्प है कि मॉडल ने ब्रांड नाम का अनुवाद नहीं किया, जबकि यह प्रॉम्प्ट में निर्दिष्ट नहीं था।

कन्वर्सेशन मोड

आखिरी फीचर जिसका हम अन्वेषण करते हैं वह है कन्वर्सेशन मोड। पिछले उदाहरण इंटरैक्टिव नहीं हैं। हम API को एक रिक्वेस्ट भेजते हैं और परिणाम प्राप्त करते हैं। यदि हमें उसी परिणाम पर इटेरेट करना हो, तो हमें उस इमेज और वांछित बदलावों के साथ नई रिक्वेस्ट बनानी पड़ती है।

एक बेहतर तरीका है चैट मोड का उपयोग करना। चैट मोड में, हम client.chats.create() फ़ंक्शन से चैट बनाते हैं, फिर client.send_message() फ़ंक्शन से आगे‑पीछे संदेश भेजते हैं। हम इसका उपयोग चैट एडिटिंग वर्कफ़्लो को लागू करने के लिए कर सकते हैं:

- यूज़र एक प्रॉम्प्ट भेजता है

- Nano Banana 2 प्रॉम्प्ट और पिछली इमेज (यदि मौजूद हो) के आधार पर इमेज जनरेट करता है

- इमेज यूज़र को दिखाई जाती है

- यूज़र एडिट प्रॉम्प्ट भेजता है और फिर चरण 2 पर लौटता है।

इस फ्लो को लागू करने वाली पूरी स्क्रिप्ट यहाँ है:

from google import genai

from google.genai import types

from dotenv import load_dotenv

from PIL import Image

import time

load_dotenv()

client = genai.Client()

# Initialize the chat session

chat = client.chats.create(

model="gemini-3.1-flash-image-preview",

config=types.GenerateContentConfig(

response_modalities=['TEXT', 'IMAGE'],

tools=[{"google_search": {}}]

)

)

# We keep track of the latest image object to send back as context

latest_image = None

while True:

user_input = input("\nPrompt: ")

if user_input.lower() in ['quit', 'exit', 'q']:

break

# Construct the message content

# If we have a previous image, we include it so the model knows what to edit

content = [user_input]

if latest_image:

content.append(latest_image)

try:

response = chat.send_message(content)

for part in response.parts:

# Handle Text Response

if part.text:

print(f"\nAI: {part.text}")

elif part.inline_data is not None:

image = part.as_image()

filename = f"image_{int(time.time())}.png"

image.save(filename)

print("Saved image", filename)

latest_image = Image.open(filename)

latest_image.show()

except Exception as e:

print(f"An error occurred: {e}")

print("Session ended.")इस स्क्रिप्ट को चलाते समय, हम सीधे टर्मिनल में इमेज को चरणबद्ध तरीके से एडिट कर सकते हैं, इस प्रकार:

इस इंटरैक्शन से प्राप्त परिणाम यहाँ हैं:

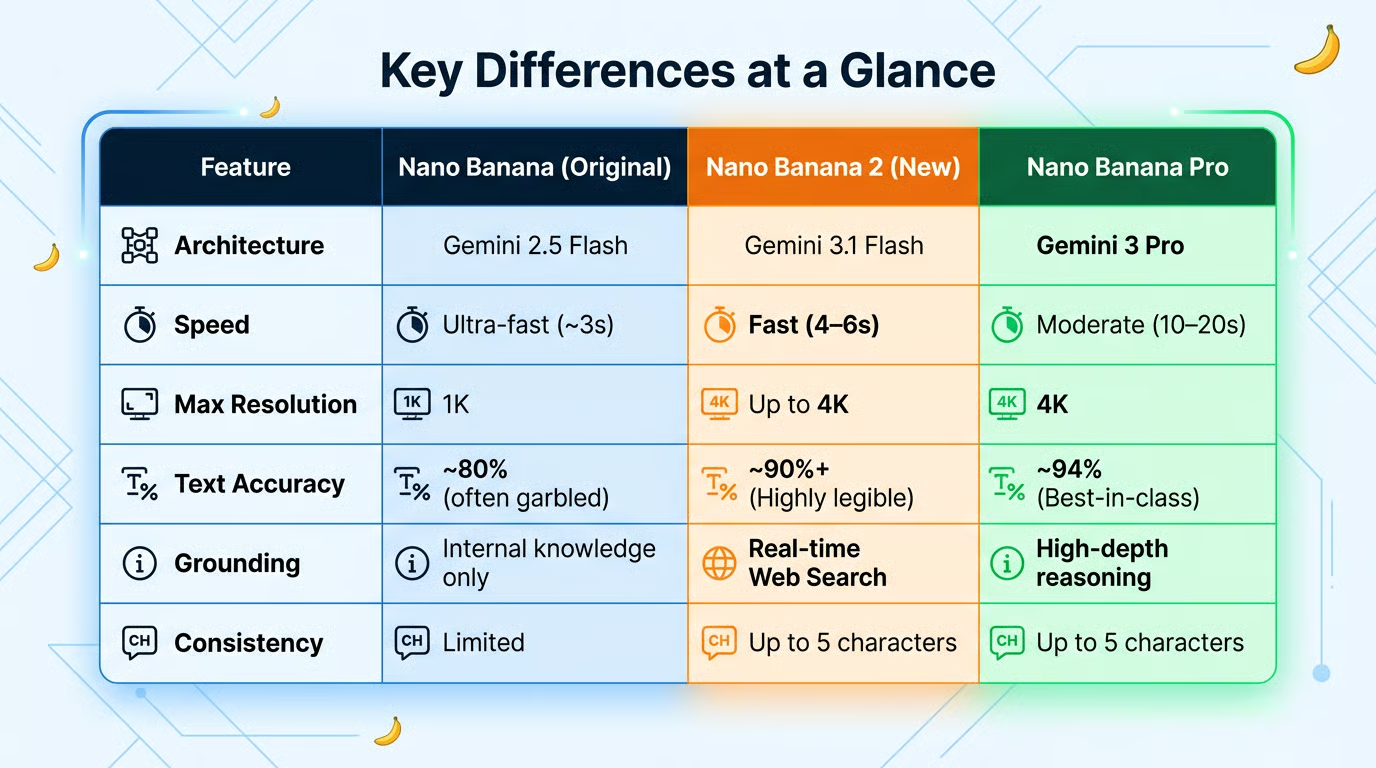

Nano Banana बनाम Nano Banana 2

नीचे दी गई तालिका Nano Banana मॉडलों के मुख्य अंतर को दर्शाती है। जैसा कि पहले बताया गया, नए संस्करण में सटीकता, कंसिस्टेंसी और रेज़ोल्यूशन में उल्लेखनीय सुधार हैं, जबकि यह पहली इटरेशन की तुलना में केवल थोड़ा धीमा चलता है।

यह तालिका वास्तव में Nano Banana 2 ने दिए गए डेटा के आधार पर जनरेट की थी।

Nano Banana Pro कब उपयोग करें

हालाँकि Nano Banana 2 नया मानक है, Nano Banana Pro अभी भी "Thinking" और विशेष कार्यों के लिए उपलब्ध है। आप अभी भी Pro को इन स्थितियों में चुन सकते हैं:

- अत्यधिक रियलिज़्म: लाइटिंग फिज़िक्स और स्किन टेक्स्चर्स में Pro का थोड़ा बढ़त है।

- जटिल रीजनिंग: Pro स्पैटियल इंस्ट्रक्शन्स को "सोचकर" समझने में बेहतर है (जैसे, "बाएँ दूसरी स्तंभ के पीछे वाला व्यक्ति")।

निष्कर्ष

Nano Banana 2 सच में एक उत्तराधिकारी जैसा लगता है क्योंकि यह इटेरेशनों के बीच "ड्रिफ्ट" को नाटकीय रूप से घटा देता है, जिससे आप किसी लुक को लॉक कर सकते हैं और उसे दृश्यों, फ़ॉर्मैट्स, और भाषाओं में भरोसेमंद ढंग से आगे ले जा सकते हैं।

बेहतर सब्जेक्ट पर्सिस्टेंस, टाइटर इंस्ट्रक्शन फॉलोइंग, सर्च‑ग्राउंडेड रियलिज़्म, और ऐसे कन्वर्सेशनल एडिट्स जो फिर से ड्रॉ करने के बजाय छोटे‑मोटे बदलाव करते हैं—इन सबके साथ, वैरिएशंस एक्सप्लोर करते समय पहचान, लेआउट और स्टाइल को बरकरार रखना कहीं आसान हो गया है।

प्रोडक्शन‑ग्रेड टेक्स्ट रेंडरिंग ब्रांड एलिमेंट्स को कंसिस्टेंट बनाए रखने में मदद करती है, और लचीले आस्पेक्ट रेशियो बैनर्स, पोस्टर्स और मोबाइल स्टोरीज़ में कैम्पेन स्केल करना सहज बना देते हैं। स्टोरीबोर्ड्स, प्रोडक्ट शॉट्स, या मल्टी‑लोकेल क्रिएटिव्स बनाने वाली टीमों के लिए, यह गति या फिडेलिटी के साथ समझौता किए बिना दोहराव सुनिश्चित करता है।

Nano Banana 2, Nano Banana और Nano Banana Pro के बीच की खाई को पाटता है: इसकी स्पीड व्यावहारिक रूप से Nano Banana की लगभग तात्कालिक Flash रफ्तार जैसी है, जबकि इसकी क्षमताएँ, विज़ुअल फिडेलिटी, सटीक निर्देश‑अनुसरण, सब्जेक्ट कंसिस्टेंसी और सर्च‑ग्राउंडेड रियलिज़्म अक्सर Nano Banana Pro के क़रीब पहुँचते हैं।

यदि आप Nano Banana 2 जैसे टूल्स के पीछे की अवधारणाओं के बारे में और सीखना चाहते हैं, तो हमारा Generative AI Concepts कोर्स करने की सलाह देता/देती हूँ।

Nano Banana 2 FAQs

API का उपयोग करते समय Nano Banana 2 का मॉडल नाम क्या है?

Nano Banana 2 का तकनीकी नाम gemini-3.1-flash-image-preview है।

क्या Nano Banana 2 इमेज जनरेशन के लिए फ्री टियर प्रदान करता है?

यदि आपके पास Gemini सब्सक्रिप्शन है, तो Nano Banana 2 नया डिफॉल्ट है, इसलिए आप उसे वहीं एक्सेस कर सकते हैं। API का उपयोग करते समय, कोई फ्री टियर नहीं है, लेकिन प्रत्येक इमेज जनरेट करना बहुत सस्ता है।

क्या Nano Banana 2, Nano Banana Pro से बेहतर है?

Nano Banana 2, Nano Banana और Nano Banana Pro के बीच आता है। यह Nano Banana Pro से कहीं तेज़ है और समान परिणाम हासिल करता है।

क्या Nano Banana 2 में सर्च ग्राउंडिंग डिफॉल्ट रूप से सक्षम होती है?

नहीं, सर्च ग्राउंडिंग का उपयोग करने के लिए हमें वे टूल्स मॉडल को स्पष्ट रूप से प्रदान करने होते हैं। पहली 5,000 सर्च रिक्वेस्ट्स मुफ्त हैं। उसके बाद, इमेज जनरेशन लागत के ऊपर प्रति रिक्वेस्ट $0.014 का खर्च आता है।