Cursus

Large language models (LLM’s) worden steeds complexer en groter, en het uitrollen ervan brengt flinke uitdagingen met zich mee.

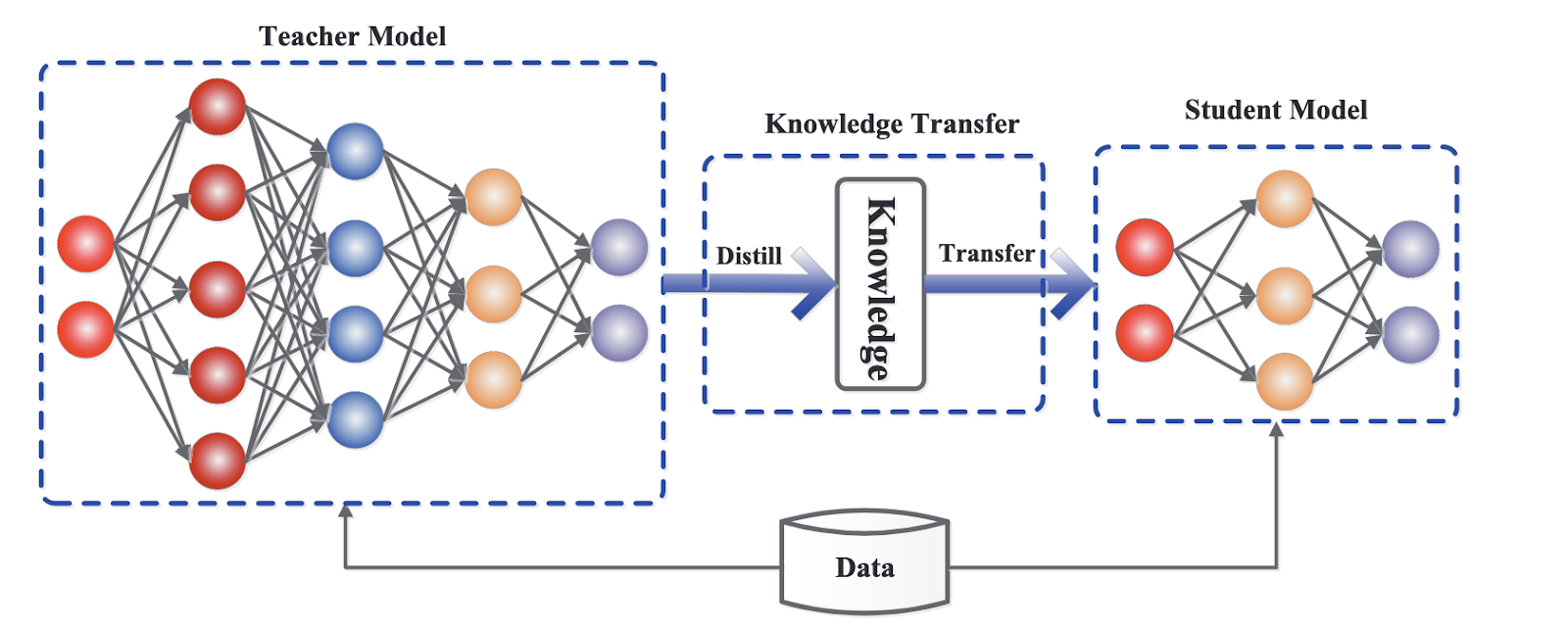

LLM-distillatie biedt een krachtige oplossing: kennis overdragen van een groter, complexer taalmodel (de “teacher”) naar een kleinere, efficiëntere versie (de “student”).

Een recent voorbeeld in de AI-wereld is de distillatie van GPT-4o mini (student) vanaf GPT-4o (teacher).

Je kunt dit vergelijken met een docent die kennis overdraagt aan een student, met als doel de essentie te destilleren zonder de ballast van de complexiteit van het grotere model. Laten we verder kijken!

Wat is LLM-distillatie?

LLM-distillatie is een techniek die het doel heeft de prestaties van een groot taalmodel te benaderen, terwijl de omvang en rekenvereisten worden verkleind.

Stel je een ervaren professor voor die zijn expertise deelt met een nieuwe student. De professor, die het teacher-model vertegenwoordigt, draagt complexe concepten en inzichten over, terwijl het student-model leert deze lessen op een eenvoudigere en efficiëntere manier na te bootsen.

Dit proces behoudt niet alleen de kerncompetenties van de teacher, maar optimaliseert de student ook voor snellere en flexibelere toepassingen.

Waarom is LLM-distillatie belangrijk?

De toenemende omvang en rekenvereisten van grote taalmodellen belemmeren brede adoptie en uitrol. Hoogwaardige hardware en stijgend energieverbruik beperken vaak de toegankelijkheid, zeker in omgevingen met beperkte middelen zoals mobiele apparaten of edge computing-platforms.

LLM-distillatie pakt deze uitdagingen aan door kleinere en snellere modellen te produceren, ideaal voor integratie op een breder scala aan apparaten en platforms.

Deze innovatie democratiseert niet alleen de toegang tot geavanceerde AI, maar ondersteunt ook realtime-toepassingen waar snelheid en efficiëntie cruciaal zijn. Door toegankelijkere en schaalbare AI-oplossingen mogelijk te maken, versnelt LLM-distillatie de praktische inzet van AI-technologieën.

Hoe LLM-distillatie werkt: het kennisoverdrachtsproces

Het LLM-distillatieproces omvat verschillende technieken die ervoor zorgen dat het student-model kerninformatie behoudt en tegelijk efficiënter werkt. Hier bespreken we de belangrijkste mechanismen achter effectieve kennisoverdracht.

Teacher-studentparadigma

Het teacher-studentparadigma vormt de kern van LLM-distillatie en drijft de kennisoverdracht. In deze opzet draagt een groter, geavanceerder model zijn kennis over aan een kleiner, lichter model.

Het teacher-model, vaak een state-of-the-art taalmodel met uitgebreide training en rekenkracht, fungeert als rijke informatiebron. De student is ontworpen om van de teacher te leren door diens gedrag na te bootsen en kennis te internaliseren.

De primaire taak van het student-model is de output van de teacher te reproduceren, met een veel kleinere omvang en lagere rekenvereisten. Dit houdt in dat de student leert van de voorspellingen, aanpassingen en reacties van de teacher op uiteenlopende input.

Zo kan de student een vergelijkbaar prestatieniveau en begrip bereiken, waardoor het geschikt is voor inzet in omgevingen met beperkte middelen.

Distillatietechnieken

Er worden diverse distillatietechnieken gebruikt om kennis van de teacher naar de student over te dragen. Deze zorgen ervoor dat de student niet alleen efficiënt leert, maar ook de essentiële kennis en capaciteiten van de teacher behoudt. Enkele prominente technieken in LLM-distillatie:

Knowledge distillation (KD)

Een van de bekendste technieken is knowledge distillation (KD). Bij KD wordt de student getraind met de outputkansen van de teacher, de zogeheten soft targets, naast de grondwaarheidslabels, de hard targets.

Soft targets geven een genuanceerd beeld van de voorspellingen van de teacher, met een kansverdeling over mogelijke uitkomsten in plaats van één juist antwoord. Deze extra informatie helpt de student subtiele patronen en complexe kennis in de reacties van de teacher te vangen.

Door soft targets te gebruiken, leert de student het beslisproces van de teacher beter begrijpen, wat tot nauwkeurigere en betrouwbaardere prestaties leidt. Deze aanpak bewaart cruciale kennis en maakt de training van de student vloeiender en effectiever.

Algemeen framework voor knowledge distillation. Bron

Andere distillatietechnieken

Naast KD zijn er meerdere technieken die het distillatieproces kunnen verbeteren:

- Data-augmentatie: Hierbij wordt extra trainingsdata gegenereerd met het teacher-model. Met een groter en diverser dataset wordt de student blootgesteld aan meer scenario’s en voorbeelden, wat de generalisatie verbetert.

- Distillatie van tussenlagen: In plaats van alleen de eindoutput te gebruiken, wordt kennis uit tussenlagen van de teacher naar de student overgedragen. Zo leert de student rijkere, gestructureerde representaties en presteert die beter.

- Multi-teacherdistillatie: Een student kan leren van meerdere teacher-modellen. Door kennis te aggregeren uit verschillende teachers krijgt de student een breder begrip en meer robuustheid.

Voordelen van LLM-distillatie

LLM-distillatie biedt tal van voordelen die de bruikbaarheid en efficiëntie van taalmodellen vergroten, waardoor ze praktischer worden voor uiteenlopende toepassingen.

Hier bespreken we een paar kernvoordelen.

Kleiner modelformaat

Een van de belangrijkste voordelen is dat modellen merkbaar kleiner worden. Door kennis van een grote teacher naar een kleine student over te brengen, behoudt de student veel van de capaciteiten, maar dan in fractie van de omvang.

Dit levert op:

- Snellere inferentie: Kleinere modellen verwerken data sneller, wat leidt tot kortere responstijden.

- Minder opslagruimte: Kleinere modellen nemen minder ruimte in, wat beheer en opslag eenvoudiger maakt, zeker bij beperkte capaciteit.

Verbeterde inferentiesnelheid

De kleinere omvang vertaalt zich direct in snellere inferentie. Dit is vooral belangrijk voor toepassingen die realtime verwerking en snelle reacties vereisen.

Zo komt dit tot uiting:

- Realtime-applicaties: Snellere inferentie maakt inzet in chatbots, virtuele assistenten en interactieve systemen haalbaar, waar lage latency cruciaal is.

- Apparaten met beperkte resources: Gedistilleerde modellen draaien op smartphones, tablets en edge devices zonder prestatieverlies.

Lagere rekenkosten

Een ander voordeel is lagere rekenkosten. Kleinere modellen vragen minder rekenkracht, wat kostenbesparingen oplevert:

- Cloudomgevingen: Kleinere modellen draaien in cloudomgevingen met minder dure hardware en lager energieverbruik.

- On-premises implementaties: Kleinere modellen betekenen lagere infrastructuur- en onderhoudskosten voor organisaties die on-premises draaien.

Grotere toegankelijkheid en uitrol

Gedistilleerde LLM’s zijn veelzijdiger en toegankelijker, waardoor uitrol over platforms mogelijk is. Dit heeft meerdere implicaties:

- Mobiele apparaten: Inzet op mobiele devices maakt geavanceerde AI-functies mogelijk in draagbare, gebruiksvriendelijke vormen.

- Edge-apparaten: Dicht bij de bron draaien vermindert afhankelijkheid van constante connectiviteit en verbetert dataprivacy.

- Brede toepassingen: Van zorg tot finance en onderwijs: gedistilleerde modellen zijn in talloze toepassingen te integreren, waardoor geavanceerde AI voor meer sectoren en gebruikers beschikbaar komt.

Toepassingen van gedistilleerde LLM’s

De voordelen van LLM-distillatie gaan verder dan efficiëntie en kosten. Gedistilleerde taalmodellen zijn inzetbaar voor uiteenlopende natural language processing (NLP)-taken en sectorspecifieke use-cases, waardoor AI-oplossingen breed toegankelijk worden.

Efficiënte NLP-taken

Gedistilleerde LLM’s blinken uit in veel NLP-taken. Door hun kleinere omvang en goede prestaties zijn ze ideaal voor realtime verwerking met minder rekenkracht.

Chatbots

Gedistilleerde LLM’s maken kleinere, snellere chatbots mogelijk die klantenservice soepel afhandelen. Ze begrijpen en beantwoorden vragen in realtime, zonder zware rekenkracht.

Tekstsamenvatting

Samenvattingstools op basis van gedistilleerde LLM’s kunnen nieuwsartikelen, documenten of socialmediastromen tot bondige kernpunten terugbrengen, zodat gebruikers snel de essentie zien.

Machinevertaling

Gedistilleerde modellen versnellen en verbreden vertaalservices op apparaten. Ze draaien op telefoons, tablets en zelfs offline, met realtimevertaling en lagere latency en rekenlast.

Andere taken

Naast gangbare NLP-taken presteren gedistilleerde LLM’s ook goed in specialistische gebieden die snelle verwerking en nauwkeurigheid vragen.

- Sentimentsanalyse: Het sentiment van teksten analyseren, zoals reviews of posts, gaat sneller en makkelijker, zodat bedrijven snel publiek sentiment en feedback peilen.

- Vragen beantwoorden: Gedistilleerde modellen voeden systemen die gebruikersvragen accuraat en vlot beantwoorden, bijvoorbeeld in assistenten en educatieve tools.

- Tekstgeneratie: Coherente, contextueel relevante tekst voor contentcreatie, storytelling of automatische rapportage wordt gestroomlijnd met gedistilleerde LLM’s.

Use-cases per sector

Gedistilleerde LLM’s beperken zich niet tot algemene NLP-taken. Ze kunnen ook sectoren veranderen door processen en gebruikerservaringen te verbeteren en innovatie te stimuleren.

Zorg

In de zorgsector verwerken gedistilleerde LLM’s patiëntendossiers en diagnostische data efficiënter, wat snellere en nauwkeurigere diagnoses ondersteunt. Ze kunnen in medische apparaten worden ingezet voor realtime data-analyse en besluitvorming.

Financiën

De financiële sector profiteert via betere fraudedetectiesystemen en klantinteractiemodellen. Door snel transacties en vragen te doorgronden, helpen LLM’s fraude voorkomen en gepersonaliseerd advies te bieden.

Onderwijs

In het onderwijs faciliteren gedistilleerde LLM’s adaptieve leersystemen en gepersonaliseerde tutoring. Ze analyseren prestaties en bieden maatwerkcontent, wat leerresultaten verbetert en onderwijs toegankelijker maakt.

LLM-distillatie implementeren

Het implementeren van LLM-distillatie vraagt om meerdere stappen en gespecialiseerde frameworks en libraries. Hier bespreken we de tools en stappen om een groot taalmodel te distilleren.

Frameworks en libraries

Er zijn diverse frameworks en libraries die het distillatieproces stroomlijnen, elk met eigen functies voor LLM-distillatie.

Hugging Face Transformers

De Hugging Face Transformers-library is een populaire tool voor LLM-distillatie. Het bevat een Distiller-klasse die de kennisoverdracht van teacher naar student vereenvoudigt.

Met de Distiller-klasse kun je voorgetrainde modellen inzetten, ze finetunen op specifieke datasets en distillatietechnieken toepassen voor optimale resultaten.

Andere libraries

Naast Hugging Face Transformers ondersteunen ook andere libraries LLM-distillatie:

- TensorFlow Model Optimization: Tools voor pruning, kwantisatie en distillatie; een veelzijdige keuze voor het creëren van modellen.

- PyTorch Distiller: PyTorch-

Distilleris bedoeld om deep learning-modellen te comprimeren, met ondersteuning voor distillatie en handige utilities voor efficiëntiebeheer. - DeepSpeed: Ontwikkeld door Microsoft; een optimalisatielibrary met features voor modeldistillatie, voor training en uitrol van grote modellen.

Betrokken stappen

Het implementeren van LLM-distillatie vraagt zorgvuldige planning en uitvoering. Dit zijn de belangrijkste stappen.

Datavoorbereiding

Begin met een geschikt trainingsdataset voor de student. Het dataset moet representatief zijn voor de taken, zodat de student goed generaliseert.

Data-augmentatie kan het dataset verder verrijken en de student blootstellen aan meer voorbeelden.

Selectie van het teacher-model

Een passend teacher-model kiezen is cruciaal. Het moet een goed presterend, voorgetraind model zijn met hoge nauwkeurigheid op de doeltaken. De kwaliteit en eigenschappen van de teacher bepalen direct de prestaties van de student.

Distillatieproces

Het distillatieproces omvat:

- Trainingssetup: Initialiseer de student en configureer de trainingsomgeving, inclusief hyperparameters zoals learning rate en batchgrootte.

- Kennisoverdracht: Gebruik de teacher om soft targets (kansverdelingen) te genereren voor de trainingsdata. Train de student met deze soft targets, samen met hard targets (grondwaarheid).

- Trainingslus: Train met een combinatie van soft en hard targets. Minimaliseer de verliesfunctie, die het verschil meet tussen voorspellingen van de student en de soft targets van de teacher.

Evaluatiemetrieken

De prestaties van het gedistilleerde model evalueren is essentieel. Veelgebruikte metriek zijn:

- Nauwkeurigheid: Het percentage correcte voorspellingen ten opzichte van de grondwaarheid.

- Inferentiesnelheid: De tijd die de student nodig heeft om input te verwerken en output te genereren.

- Modelgrootte: De mate van reductie in omvang en de voordelen voor opslag en rekenefficiëntie.

- Resourcegebruik: Monitor de benodigde rekenmiddelen tijdens inferentie en check of het binnen de beperkingen van de doelinfrastructuur past.

Ik ga dieper in op LLM-evaluatie in dit artikel over LLM-evaluatie: metriek, methodologieën, best practices.

LLM-distillatie: uitdagingen en best practices

Hoewel LLM-distillatie veel voordelen biedt, zijn er ook uitdagingen die je moet adresseren voor een succesvolle implementatie.

Kennisverlies

Een van de grootste hobbels is mogelijk kennisverlies. Tijdens distillatie wordt niet altijd alle nuance en detail van de teacher volledig door de student vastgelegd, met prestatieverlies als gevolg. Dit speelt vooral bij taken die diepe of specialistische kennis vragen.

Strategieën om kennisverlies te beperken:

- Distillatie van tussenlagen: Kennisoverdracht uit tussenlagen helpt de student rijkere, gestructureerde informatie te leren.

- Data-augmentatie: Met door de teacher gegenereerde augmented data krijgt de student een breder trainingspalet.

- Iteratieve distillatie: Meerdere rondes distillatie laten de student stapsgewijs meer kennis van de teacher vastleggen.

Hyperparametertuning

Zorgvuldige tuning is cruciaal. Belangrijke hyperparameters, zoals temperatuur en learning rate, beïnvloeden sterk hoe goed de student leert van de teacher:

- Temperatuur: Stuurt de ‘zachtheid’ van de kansverdeling van de teacher. Hogere temperaturen leveren zachtere verdelingen op, wat het leren van de student kan verbeteren.

- Learning rate: Het juiste tempo balanceert snelheid en stabiliteit. Zo convergeert de student optimaal zonder over- of underfitting.

Effectiviteit evalueren

Het beoordelen van de effectiviteit is onmisbaar om te garanderen dat het model aan de gewenste criteria voldoet, zeker vergeleken met voorgangers en alternatieven. Vergelijk de student met de teacher en andere baselines om te zien in hoeverre functionaliteit is behouden of verbeterd.

Richt je op de volgende metriek:

- Nauwkeurigheid: Hoe verhoudt de nauwkeurigheid van de student zich tot de teacher en baselines; inzicht in verlies of behoud van precisie.

- Inferentiesnelheid: Vergelijk de snelheid van de student met die van de teacher om tijdswinst te tonen.

- Modelgrootte: Beoordeel de verschillen in omvang en de efficiëntiewinst door distillatie.

- Resourcegebruik: Analyseer het gebruik van rekenmiddelen en check of de student een zuiniger alternatief is zonder prestatiedaling.

Best practices

Door best practices te volgen, vergroot je de effectiviteit van LLM-distillatie. De nadruk ligt op experimenteren, continu evalueren en strategisch implementeren.

- Experimenteren: Probeer regelmatig verschillende technieken en hyperparameters om de beste configuratie voor jouw use-case te vinden.

- Continue evaluatie: Evalueer de prestaties doorlopend met relevante benchmarks en datasets. Iteratief testen en bijschaven is cruciaal.

- Gebalanceerde training: Combineer soft targets van de teacher met hard targets. Zo leert de student nuance zonder nauwkeurigheid te verliezen.

- Regelmatige updates: Blijf op de hoogte van de nieuwste onderzoeksontwikkelingen en neem nieuwe technieken op in je proces.

Onderzoek en toekomst

Het veld van LLM-distillatie ontwikkelt zich razendsnel. In deze sectie: trends, huidige onderzoeksuitdagingen en opkomende technieken.

Recente research en vooruitgang

Recent onderzoek richt zich op nieuwe technieken en architecturen om de efficiëntie en effectiviteit van distillatie te vergroten. Enkele opvallende ontwikkelingen:

- Progressieve distillatie: Kennis wordt in stappen gedistilleerd, waarbij tussentijdse studenten progressief van de teacher worden afgeleid. Dit verbetert vaak prestaties en stabiliteit.

- Taak-agnostische distillatie: Methoden om kennis taak-agnostisch te distilleren, zodat de student over taken kan generaliseren zonder taak-specifieke fine-tuning. Dit kan trainingsduur en rekenkosten voor nieuwe toepassingen sterk verlagen.

- Cross-modale distillatie: Kennis distilleren over verschillende modaliteiten (tekst, beeld, audio). Doel: veelzijdige studenten die meerdere inputtypen aankunnen en zo de toepasbaarheid vergroten.

Open problemen en toekomstige richtingen

Ondanks de vooruitgang blijven er uitdagingen en open vragen:

- Betere generalisatie: Studentmodellen consistent goed laten presteren over diverse taken en datasets blijft een speerpunt.

- Kennisoverdracht tussen domeinen: Effectieve overdracht naar nieuwe, afwijkende domeinen zonder groot prestatieverlies is een belangrijk doel.

- Schaalbaarheid: Technieken opschalen voor steeds grotere modellen en datasets is een aanhoudende uitdaging; optimalisatie van het proces staat centraal.

Opkomende technieken

Nieuwe technieken worden continu ontwikkeld om deze uitdagingen aan te pakken en het veld vooruit te helpen. Veelbelovende benaderingen zijn:

- Zero-shot- en few-shot-aanpassingen: Zero-shot- en few-shot-capaciteiten integreren vergroot de veelzijdigheid, omdat taken met weinig tot geen taak-specifieke data kunnen worden uitgevoerd.

- Zelfdistillatie: De student wordt getraind met eigen voorspellingen als soft targets. Dit kan prestaties en robuustheid verbeteren door iteratief geleerde kennis te benutten.

- Adversariële distillatie: Adversarial training combineren met distillatie. De student leert niet alleen de teacher na te bootsen, maar ook robuust te zijn tegen adversariële aanvallen, wat de veiligheid en betrouwbaarheid vergroot.

Conclusie

LLM-distillatie is een cruciale techniek om grote taalmodellen praktischer en efficiënter te maken. Door essentiële kennis van een complexe teacher naar een kleinere student over te dragen, blijft de prestatie behouden terwijl omvang en rekenlast afnemen.

Dit maakt snellere, toegankelijkere AI-toepassingen mogelijk in uiteenlopende sectoren, van realtime NLP-taken tot specialistische use-cases in zorg en finance. De implementatie vraagt zorgvuldige planning en de juiste tools, maar de baten—zoals lagere kosten en bredere uitrol—zijn aanzienlijk.

Naarmate onderzoek vordert, zal LLM-distillatie een steeds grotere rol spelen in het democratiseren van AI, zodat krachtige modellen toegankelijker en bruikbaarder worden in diverse contexten.