Corso

I large language model (LLM) continuano a crescere in complessità e dimensioni, e metterli in produzione comporta sfide significative.

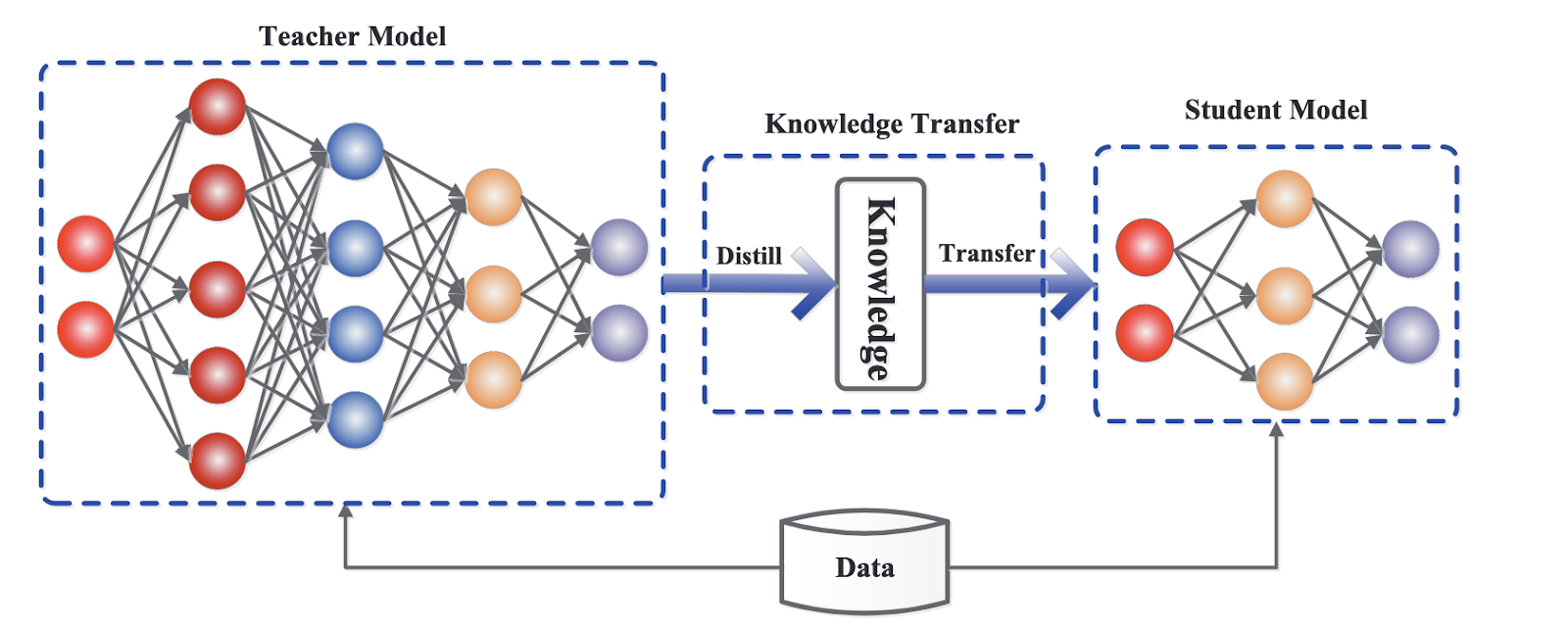

La distillazione degli LLM emerge come una soluzione potente a questo problema, consentendo di trasferire la conoscenza da un modello linguistico più grande e complesso (il "teacher") a una versione più piccola ed efficiente (lo "student").

Un esempio recente nel mondo dell’AI è la distillazione di GPT-4o mini (student) da GPT-4o (teacher).

Questo processo è paragonabile a un insegnante che trasmette il proprio sapere a uno studente, con l’obiettivo di distillare le conoscenze essenziali senza il fardello della complessità del modello più grande. Scopriamone di più!

Che cos’è la distillazione degli LLM?

La distillazione degli LLM è una tecnica che punta a replicare le prestazioni di un large language model riducendone al contempo dimensioni e requisiti computazionali.

Immagina un professore esperto che condivide la sua competenza con un nuovo studente. Il professore, che rappresenta il modello teacher, trasmette concetti e intuizioni complessi, mentre il modello student impara a imitarne gli insegnamenti in modo più semplice ed efficiente.

Questo processo non solo conserva le competenze chiave del teacher, ma ottimizza anche lo student per applicazioni più rapide e versatili.

Perché la distillazione degli LLM è importante?

L’aumento delle dimensioni e dei requisiti computazionali dei large language model ne ostacola l’adozione e il deployment su larga scala. Hardware ad alte prestazioni e consumi energetici in crescita limitano spesso l’accessibilità di questi modelli, soprattutto in contesti con risorse ridotte come i dispositivi mobili o le piattaforme di edge computing.

La distillazione degli LLM affronta queste sfide producendo modelli più piccoli e veloci, ideali per l’integrazione su un ventaglio più ampio di dispositivi e piattaforme.

Questa innovazione non solo democratizza l’accesso all’AI avanzata, ma supporta anche applicazioni in tempo reale, dove velocità ed efficienza sono fondamentali. Abilitando soluzioni di AI più accessibili e scalabili, la distillazione aiuta a far progredire l’implementazione pratica delle tecnologie di AI.

Come funziona la distillazione degli LLM: il processo di trasferimento della conoscenza

La distillazione degli LLM comprende diverse tecniche per fare in modo che il modello student mantenga le informazioni chiave operando in modo più efficiente. Di seguito esploriamo i meccanismi che rendono efficace questo trasferimento di conoscenza.

Paradigma teacher-student

Il paradigma teacher-student è il cuore della distillazione degli LLM, un concetto fondamentale che guida il trasferimento della conoscenza. In questa impostazione, un modello più grande e avanzato trasferisce il suo sapere a un modello più piccolo e leggero.

Il modello teacher, spesso uno stato dell’arte addestrato con ampie risorse, funge da ricca fonte di informazioni. Lo student, invece, è progettato per apprendere dal teacher imitando il suo comportamento e interiorizzandone le conoscenze.

Il compito principale dello student è replicare gli output del teacher mantenendo dimensioni molto più contenute e requisiti computazionali ridotti. Questo comporta osservare e apprendere dalle previsioni, dagli aggiustamenti e dalle risposte del teacher a vari input.

Così facendo, lo student può raggiungere un livello di prestazioni e comprensione paragonabile, diventando adatto al deployment in ambienti con risorse limitate.

Tecniche di distillazione

Per trasferire conoscenza dal teacher allo student si usano diverse tecniche. Questi metodi assicurano che lo student non solo impari in modo efficiente, ma conservi anche le conoscenze e le capacità essenziali del teacher. Ecco alcune tra le più diffuse nella distillazione degli LLM.

Knowledge distillation (KD)

Una delle tecniche più note è la knowledge distillation (KD). In KD, il modello student viene addestrato usando le probabilità di output del teacher, dette soft target, insieme alle etichette di verità a terra, dette hard target.

I soft target offrono una visione sfumata delle previsioni del teacher, fornendo una distribuzione di probabilità sugli output possibili anziché una singola risposta corretta. Queste informazioni aggiuntive aiutano lo student a cogliere i pattern sottili e le conoscenze complesse racchiuse nelle risposte del teacher.

Usando i soft target, lo student può comprendere meglio il processo decisionale del teacher, ottenendo prestazioni più accurate e affidabili. Questo approccio preserva le conoscenze critiche del teacher e rende l’addestramento dello student più fluido ed efficace.

Framework generico per la knowledge distillation. Fonte

Altre tecniche di distillazione

Oltre alla KD, diverse altre tecniche possono migliorare il processo:

- Data augmentation: consiste nel generare dati di addestramento aggiuntivi usando il modello teacher. Con un dataset più ampio e variegato, lo student è esposto a più scenari ed esempi, migliorando la capacità di generalizzazione.

- Distillazione degli strati intermedi: invece di concentrarsi solo sugli output finali, questo metodo trasferisce conoscenza dagli strati intermedi del teacher allo student. Imparando da queste rappresentazioni intermedie, lo student può catturare informazioni più dettagliate e strutturate, migliorando le prestazioni complessive.

- Distillazione multi-teacher: uno student può beneficiare dell’apprendimento da più modelli teacher. Aggregando conoscenze diverse, lo student ottiene una comprensione più completa e una maggiore robustezza, integrando prospettive e intuizioni differenti.

Vantaggi della distillazione degli LLM

La distillazione offre numerosi vantaggi che migliorano usabilità ed efficienza dei modelli linguistici, rendendoli più pratici per applicazioni diverse.

Ecco alcuni dei principali benefici.

Riduzione delle dimensioni del modello

Uno dei vantaggi principali è la creazione di modelli sensibilmente più piccoli. Trasferendo conoscenza da un teacher grande a uno student piccolo, il modello risultante conserva gran parte delle capacità del teacher pur avendo una frazione delle sue dimensioni.

La riduzione delle dimensioni porta a:

- Inferenza più rapida: i modelli più piccoli elaborano i dati più velocemente, con tempi di risposta inferiori.

- Minori requisiti di archiviazione: occupano meno spazio, facilitando gestione e storage, soprattutto in ambienti con capacità limitata.

Velocità di inferenza migliorata

Le dimensioni ridotte dei modelli distillati si traducono direttamente in una velocità di inferenza superiore. È particolarmente importante per applicazioni che richiedono elaborazione in tempo reale e risposte rapide.

Ecco come si manifesta questo vantaggio:

- Applicazioni real-time: velocità di inferenza maggiori rendono fattibile l’uso in chatbot, assistenti virtuali e sistemi interattivi dove la latenza è cruciale.

- Dispositivi con risorse limitate: i modelli distillati possono essere eseguiti su smartphone, tablet e dispositivi edge senza compromettere le prestazioni.

Costi computazionali inferiori

Un altro vantaggio rilevante è la riduzione dei costi computazionali. I modelli più piccoli richiedono meno potenza per essere eseguiti, con risparmi in vari ambiti:

- Ambienti cloud: eseguire modelli più piccoli nel cloud riduce la necessità di hardware costoso e ad alte prestazioni e abbassa i consumi energetici.

- Deployment on-premise: modelli più piccoli significano costi infrastrutturali e di manutenzione inferiori per le organizzazioni che preferiscono soluzioni on-premise.

Accessibilità e deployment più ampi

Gli LLM distillati sono più versatili e accessibili, consentendo il deployment su più piattaforme. Questa maggiore diffusione ha diverse implicazioni:

- Dispositivi mobili: i modelli distillati possono essere eseguiti su dispositivi mobili, abilitando funzionalità di AI avanzate in formati portatili e intuitivi.

- Dispositivi edge: la possibilità di eseguire modelli su dispositivi edge avvicina le capacità di AI al luogo in cui i dati sono generati, riducendo la necessità di connettività costante e migliorando la privacy.

- Applicazioni più ampie: dalla sanità alla finanza fino all’istruzione, i modelli distillati possono essere integrati in molte applicazioni, rendendo l’AI avanzata accessibile a più settori e utenti.

Applicazioni degli LLM distillati

I vantaggi della distillazione vanno ben oltre l’efficienza e i risparmi. I modelli linguistici distillati si applicano a un’ampia gamma di attività di natural language processing (NLP) e casi d’uso specifici di settore, rendendo le soluzioni di AI accessibili in vari ambiti.

Task NLP efficienti

Gli LLM distillati eccellono in molti compiti di NLP. Le loro dimensioni ridotte e le prestazioni migliorate li rendono ideali per task che richiedono elaborazione in tempo reale e minore potenza computazionale.

Chatbot

Gli LLM distillati permettono di sviluppare chatbot più piccoli e veloci che gestiscono con fluidità assistenza e supporto. Questi chatbot comprendono e rispondono alle domande in tempo reale, offrendo un’esperienza senza attriti senza richiedere ingenti risorse.

Riassunto di testi

Strumenti di sintesi basati su LLM distillati possono condensare articoli, documenti o feed social in riepiloghi concisi. Aiutano gli utenti a cogliere rapidamente i punti chiave senza leggere testi lunghi.

Traduzione automatica

I modelli distillati rendono i servizi di traduzione più veloci e accessibili sui dispositivi. Possono essere distribuiti su telefoni, tablet e anche in app offline, fornendo traduzioni in tempo reale con minore latenza e overhead computazionale.

Altri task

Gli LLM distillati non sono utili solo per i compiti comuni di NLP, ma brillano anche in ambiti specializzati che richiedono elaborazione rapida e risultati accurati.

- Analisi del sentiment: analizzare il sentiment dei testi, come recensioni o post social, diventa più semplice e rapido, consentendo alle aziende di valutare velocemente opinioni e feedback.

- Question answering: i modelli distillati possono alimentare sistemi che rispondono con precisione e prontezza, migliorando l’esperienza utente in assistenti virtuali e strumenti educativi.

- Generazione di testo: creare testi coerenti e pertinenti al contesto, per content creation, storytelling o report automatici, è più snello con LLM distillati.

Casi d’uso industriali

Gli LLM distillati non si limitano ai classici task di NLP. Possono incidere su molti settori migliorando processi ed esperienze utente e stimolando l’innovazione.

Sanità

Nel settore sanitario, gli LLM distillati possono elaborare cartelle cliniche e dati diagnostici in modo più efficiente, abilitando diagnosi più rapide e accurate. Possono essere integrati in dispositivi medici, supportando medici e operatori con analisi dati e decisioni in tempo reale.

Finanza

Il settore finanziario beneficia di modelli distillati grazie a sistemi di rilevamento frodi potenziati e modelli per l’interazione con i clienti. Decifrando rapidamente pattern di transazioni e richieste, aiutano a prevenire attività fraudolente e a fornire consulenza e supporto personalizzati.

Istruzione

Nell’istruzione, gli LLM distillati facilitano la creazione di sistemi di apprendimento adattivi e piattaforme di tutoraggio personalizzate. Questi sistemi analizzano il rendimento e offrono contenuti su misura, migliorando gli esiti e rendendo l’istruzione più accessibile ed efficace.

Implementare la distillazione degli LLM

Implementare la distillazione richiede una serie di passaggi e l’uso di framework e librerie specializzate pensate per agevolare il processo. Vediamo strumenti e fasi necessari per distillare un large language model.

Framework e librerie

Per semplificare la distillazione sono disponibili vari framework e librerie, ognuno con caratteristiche utili al processo.

Hugging Face transformers

La libreria Hugging Face Transformers è uno strumento molto diffuso per implementare la distillazione. Include una classe Distiller che semplifica il trasferimento di conoscenza da un teacher a uno student.

Usando la classe Distiller è possibile sfruttare modelli pre-addestrati, affinarli su dataset specifici e applicare tecniche di distillazione per risultati ottimali.

Altre librerie

Oltre a Hugging Face Transformers, molte altre librerie supportano la distillazione degli LLM:

- TensorFlow Model Optimization: questa libreria offre strumenti per pruning, quantizzazione e distillazione, risultando una scelta versatile per creare modelli.

- PyTorch Distiller: il

Distillerdi PyTorch è pensato per comprimere modelli di deep learning, con supporto alla distillazione. Offre varie utility per gestire il processo e migliorare l’efficienza. - DeepSpeed: sviluppata da Microsoft, è una libreria di ottimizzazione per il deep learning che include funzionalità per la distillazione, abilitando training e deployment di modelli di grandi dimensioni.

Fasi del processo

Implementare la distillazione richiede pianificazione ed esecuzione attente. Ecco i passaggi chiave.

Preparazione dei dati

Il primo passo è predisporre un dataset adatto ad addestrare lo student. Il dataset dovrebbe rappresentare i compiti che il modello svolgerà, così che lo student impari a generalizzare bene.

Le tecniche di data augmentation possono arricchire il dataset, fornendo allo student una gamma più ampia di esempi da cui apprendere.

Selezione del modello teacher

La scelta di un teacher adeguato è necessaria per una distillazione efficace. Dovrebbe essere un modello pre-addestrato ad alte prestazioni e con elevata accuratezza sui task target. La qualità e le caratteristiche del teacher influenzano direttamente le prestazioni dello student.

Processo di distillazione

Il processo comprende i passaggi seguenti:

- Impostazione del training: inizializza il modello student e configura l’ambiente di training, inclusi iperparametri come learning rate e batch size.

- Trasferimento della conoscenza: usa il teacher per generare soft target (distribuzioni di probabilità) per i dati di training. Questi, insieme agli hard target (etichette di verità a terra), vengono usati per addestrare lo student.

- Training loop: addestra lo student combinando soft e hard target. L’obiettivo è minimizzare la funzione di loss, che misura la differenza tra le previsioni dello student e i soft target del teacher.

Metriche di valutazione

Valutare le prestazioni del modello distillato è essenziale per verificarne il rispetto dei criteri desiderati. Le metriche comuni includono:

- Accuratezza: percentuale di previsioni corrette dello student rispetto alla verità a terra.

- Velocità di inferenza: tempo impiegato dal modello per elaborare input e generare output.

- Dimensioni del modello: valutazione della riduzione dimensionale e dei benefici associati in termini di storage ed efficienza computazionale.

- Utilizzo delle risorse: monitoraggio delle risorse computazionali richieste in inferenza, verificando che soddisfi i vincoli dell’ambiente di deployment.

Approfondisco la valutazione degli LLM in questo articolo su LLM Evaluation: Metriche, metodologie, best practice.

Distillazione degli LLM: sfide e best practice

Sebbene offra numerosi benefici, la distillazione presenta anche diverse sfide da affrontare per garantire un’implementazione di successo.

Perdita di conoscenza

Una delle difficoltà principali è il potenziale di perdita di conoscenza. Durante la distillazione, alcune informazioni e caratteristiche sottili del teacher potrebbero non essere pienamente catturate dallo student, con un calo di prestazioni. Il problema può essere marcato nei compiti che richiedono comprensione profonda o conoscenze specialistiche.

Ecco alcune strategie per mitigare la perdita di conoscenza:

- Distillazione degli strati intermedi: trasferire conoscenza dagli strati intermedi aiuta lo student a catturare informazioni più ricche e strutturate.

- Data augmentation: usare dati aumentati generati dal teacher fornisce allo student una gamma più ampia di esempi, favorendone l’apprendimento.

- Distillazione iterativa: affinare lo student con più cicli di distillazione può portarlo a catturare progressivamente più conoscenza del teacher.

Ottimizzazione degli iperparametri

Un’attenta messa a punto degli iperparametri è vitale. Parametri come temperatura e learning rate influenzano in modo significativo la capacità dello student di apprendere dal teacher:

- Temperatura: controlla la “morbidezza” della distribuzione di probabilità generata dal teacher. Valori più alti producono distribuzioni più morbide, aiutando lo student a imparare più a fondo dalle previsioni del teacher.

- Learning rate: regolarlo è essenziale per bilanciare velocità e stabilità del training. Un valore adeguato assicura che lo student converga verso una soluzione ottimale senza overfitting o underfitting.

Valutazione dell’efficacia

Valutare l’efficacia del modello distillato è indispensabile per garantire che soddisfi i criteri di prestazione desiderati, soprattutto rispetto ai predecessori e alle alternative. Ciò implica confrontare lo student con il teacher e con altre baseline, per capire quanto la distillazione abbia preservato o migliorato la funzionalità.

Per valutare l’efficacia, è importante concentrarsi su queste metriche:

- Accuratezza: confronta l’accuratezza dello student con quella del teacher e di altre baseline, rilevando eventuali perdite o mantenimenti di precisione.

- Velocità di inferenza: confronta i tempi di elaborazione tra student e teacher, evidenziando i miglioramenti.

- Dimensioni del modello: valuta le differenze dimensionali tra student e teacher, nonché altre baseline, per misurare i guadagni di efficienza.

- Utilizzo delle risorse: analizza come l’uso di risorse dello student si confronta con quello del teacher, assicurando un’alternativa più economica senza compromettere le prestazioni.

Best practice

Seguire le best practice può aumentare l’efficacia della distillazione. Queste linee guida enfatizzano sperimentazione, valutazione continua e implementazione strategica.

- Sperimentazione: prova regolarmente tecniche e impostazioni di iperparametri diverse per individuare le configurazioni migliori per il tuo caso d’uso.

- Valutazione continua: valuta costantemente le prestazioni dello student con benchmark e dataset pertinenti. Test e affinamenti iterativi sono la chiave per risultati ottimali.

- Training bilanciato: verifica di combinare i soft target del teacher con gli hard target. Questo aiuta lo student a cogliere le sfumature mantenendo l’accuratezza.

- Aggiornamenti regolari: resta aggiornato sugli sviluppi della ricerca e integra nuove tecniche e risultati nel tuo processo.

Ricerca e direzioni future

Il campo della distillazione degli LLM evolve rapidamente. In questa sezione esploriamo trend, sfide di ricerca attuali e tecniche emergenti.

Ricerche e progressi recenti

Le ricerche recenti si concentrano su nuove tecniche e architetture per aumentare efficienza ed efficacia della distillazione. Tra i progressi notevoli:

- Distillazione progressiva: distillare la conoscenza per fasi, dove modelli student intermedi vengono distillati progressivamente dal teacher. Questa tecnica mostra promesse nel migliorare prestazioni e stabilità del modello finale.

- Distillazione task-agnostic: si esplorano metodi per distillare conoscenza in modo indipendente dal task, consentendo allo student di generalizzare su compiti diversi senza fine-tuning specifico. Ciò può ridurre moltissimo tempi e risorse per nuove applicazioni.

- Distillazione cross-modale: un altro ambito emergente è la distillazione di conoscenza tra modalità diverse, come testo, immagini e audio. L’obiettivo è creare student versatili in grado di gestire tipi di input multipli, ampliando l’applicabilità dei modelli distillati.

Problemi aperti e direzioni future

Nonostante i progressi, restano diverse sfide e questioni aperte:

- Migliorare la generalizzazione: una sfida chiave è aumentare la capacità di generalizzare dei modelli distillati su vari task e dataset.

- Trasferimento cross-domain: trasferire efficacemente conoscenza tra domini differenti è un’altra area critica. Sviluppare metodi che mantengano le prestazioni su domini nuovi e distinti è un obiettivo importante.

- Scalabilità: scalare le tecniche per gestire modelli e dataset sempre più grandi in modo efficiente resta una sfida. La ricerca punta a ottimizzare il processo per renderlo più scalabile.

Tecniche emergenti

Tecniche e innovazioni emergenti vengono sviluppate continuamente per affrontare queste sfide e far avanzare il campo. Alcuni approcci promettenti:

- Adattamenti zero-shot e few-shot: integrare capacità zero-shot e few-shot nei modelli distillati è un’area in crescita. Queste tecniche permettono di svolgere compiti con pochi o nessun dato specifico, aumentando versatilità e praticità.

- Self-distillation: nello self-distillation, lo student viene addestrato usando le proprie previsioni come soft target. Questo può migliorarne prestazioni e robustezza sfruttando iterativamente la conoscenza appresa.

- Distillazione avversaria: combinare training avversario e distillazione è un altro approccio innovativo. La distillazione avversaria addestra lo student non solo a imitare il teacher, ma anche a resistere agli attacchi avversari, migliorandone sicurezza e affidabilità.

Conclusione

La distillazione degli LLM è una tecnica decisiva per rendere i large language model più pratici ed efficienti. Trasferendo conoscenze essenziali da un teacher complesso a uno student più piccolo, preserva le prestazioni riducendo dimensioni e requisiti computazionali.

Questo processo abilita applicazioni di AI più rapide e accessibili in vari settori, dai task NLP in tempo reale ai casi d’uso specializzati in sanità e finanza. Implementare la distillazione richiede pianificazione attenta e gli strumenti giusti, ma i benefici—come costi inferiori e deployment più ampio—sono notevoli.

Con il progresso della ricerca, la distillazione avrà un ruolo sempre più importante nella democratizzazione dell’AI, rendendo i modelli potenti più accessibili e usabili in contesti diversi.