Kursus

Model bahasa besar (LLM) terus tumbuh dalam kompleksitas dan ukuran, dan penerapannya menghadirkan tantangan yang signifikan.

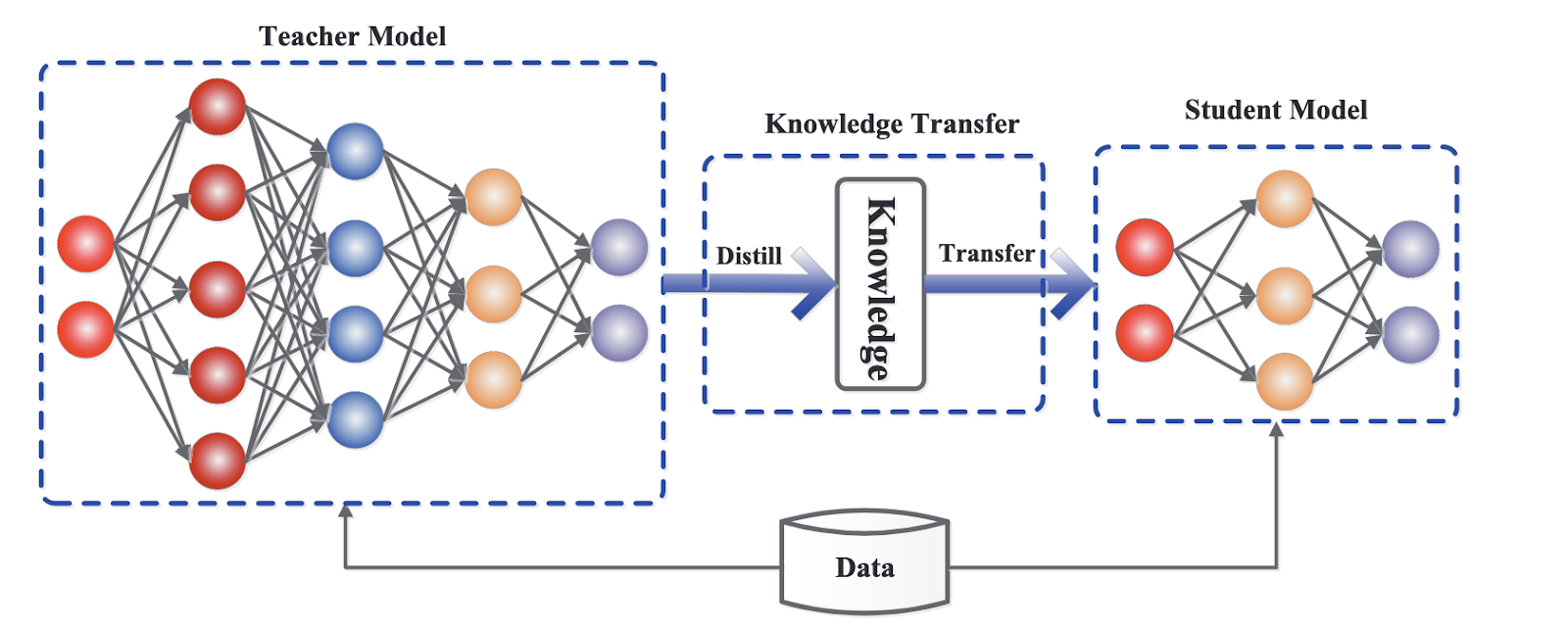

Distilasi LLM muncul sebagai solusi ampuh untuk masalah ini, memungkinkan transfer pengetahuan dari model bahasa yang lebih besar dan kompleks ("guru") ke versi yang lebih kecil dan efisien ("murid").

Contoh terbaru di dunia AI adalah distilasi GPT-4o mini (murid) dari GPT-4o (guru).

Proses ini bisa dianalogikan seperti guru yang menurunkan ilmu kepada siswa, dengan tujuan menyarikan pengetahuan esensial tanpa beban kompleksitas model yang lebih besar. Mari kita pelajari lebih lanjut!

Apa Itu Distilasi LLM?

Distilasi LLM adalah teknik yang berupaya mereplikasi kinerja model bahasa besar sambil mengurangi ukuran dan kebutuhan komputasinya.

Bayangkan seorang profesor berpengalaman membagikan keahliannya kepada siswa baru. Profesor, yang merepresentasikan model guru, menyampaikan konsep dan wawasan yang kompleks, sementara model murid belajar meniru ajaran tersebut dengan cara yang lebih sederhana dan efisien.

Proses ini tidak hanya mempertahankan kompetensi inti dari sang guru, tetapi juga mengoptimalkan murid untuk aplikasi yang lebih cepat dan serbaguna.

Mengapa Distilasi LLM Penting?

Ukuran yang terus meningkat dan kebutuhan komputasi model bahasa besar menghambat adopsi dan penerapan secara luas. Perangkat keras berkinerja tinggi dan konsumsi energi yang meningkat sering kali membatasi aksesibilitas model-model ini, khususnya di lingkungan dengan sumber daya terbatas seperti perangkat seluler atau platform komputasi tepi.

Distilasi LLM mengatasi tantangan ini dengan menghasilkan model yang lebih kecil dan lebih cepat, sehingga ideal untuk diintegrasikan ke berbagai perangkat dan platform.

Inovasi ini tidak hanya mendemokratisasi akses ke AI tingkat lanjut, tetapi juga mendukung aplikasi waktu nyata di mana kecepatan dan efisiensi sangat dihargai. Dengan memungkinkan solusi AI yang lebih mudah diakses dan dapat diskalakan, distilasi LLM membantu memajukan implementasi praktis teknologi AI.

Cara Kerja Distilasi LLM: Proses Transfer Pengetahuan

Proses distilasi LLM melibatkan beberapa teknik yang memastikan model murid mempertahankan informasi kunci sambil beroperasi lebih efisien. Di sini, kita bahas mekanisme utama yang membuat transfer pengetahuan ini efektif.

Paradigma guru-murid

Paradigma guru-murid berada di jantung distilasi LLM, sebuah konsep dasar yang mendorong proses transfer pengetahuan. Dalam pengaturan ini, model yang lebih besar dan lebih canggih menurunkan pengetahuannya ke model yang lebih kecil dan ringan.

Model guru, sering kali merupakan model bahasa mutakhir dengan pelatihan dan sumber daya komputasi yang luas, berperan sebagai sumber informasi yang kaya. Di sisi lain, model murid dirancang untuk belajar dari guru dengan meniru perilakunya dan menginternalisasi pengetahuannya.

Tugas utama model murid adalah mereplikasi keluaran guru sambil tetap berukuran jauh lebih kecil dan membutuhkan komputasi yang lebih rendah. Proses ini melibatkan pengamatan dan pembelajaran dari prediksi, penyesuaian, dan respons guru terhadap berbagai masukan.

Dengan demikian, murid dapat mencapai tingkat kinerja dan pemahaman yang sebanding, sehingga cocok untuk diterapkan di lingkungan dengan keterbatasan sumber daya.

Teknik distilasi

Berbagai teknik distilasi digunakan untuk mentransfer pengetahuan dari guru ke murid. Metode-metode ini memastikan model murid tidak hanya belajar secara efisien, tetapi juga mempertahankan pengetahuan dan kemampuan esensial dari model guru. Berikut beberapa teknik paling menonjol yang digunakan dalam distilasi LLM.

Knowledge distillation (KD)

Salah satu teknik paling menonjol dalam distilasi LLM adalah knowledge distillation (KD). Dalam KD, model murid dilatih menggunakan probabilitas keluaran model guru, yang dikenal sebagai soft targets, bersamaan dengan label kebenaran dasar yang disebut hard targets.

Soft targets memberikan pandangan bernuansa tentang prediksi guru, menawarkan distribusi probabilitas atas kemungkinan keluaran alih-alih satu jawaban benar. Informasi tambahan ini membantu model murid menangkap pola halus dan pengetahuan rumit yang tersandi dalam respons guru.

Dengan menggunakan soft targets, model murid dapat lebih memahami proses pengambilan keputusan guru, sehingga menghasilkan kinerja yang lebih akurat dan andal. Pendekatan ini tidak hanya mempertahankan pengetahuan kritis dari guru, tetapi juga memungkinkan proses pelatihan yang lebih mulus dan efektif bagi murid.

Kerangka umum untuk knowledge distillation. Sumber

Teknik distilasi lainnya

Di luar KD, beberapa teknik lain dapat meningkatkan proses distilasi LLM:

- Augmentasi data: Ini melibatkan pembuatan data pelatihan tambahan menggunakan model guru. Dengan membuat dataset yang lebih besar dan lebih inklusif, murid dapat terekspos pada beragam skenario dan contoh, sehingga meningkatkan kemampuan generalisasi.

- Distilasi lapisan perantara: Alih-alih berfokus hanya pada keluaran akhir, metode ini mentransfer pengetahuan dari lapisan perantara model guru ke murid. Dengan belajar dari representasi perantara ini, murid dapat menangkap informasi yang lebih terperinci dan terstruktur, menghasilkan kinerja keseluruhan yang lebih baik.

- Distilasi multi-guru: Model murid dapat memperoleh manfaat dengan belajar dari beberapa model guru. Dengan menggabungkan pengetahuan dari berbagai guru, murid dapat mencapai pemahaman yang lebih komprehensif dan ketangguhan yang lebih baik, karena ia mengintegrasikan beragam perspektif dan wawasan.

Manfaat Distilasi LLM

Distilasi LLM menawarkan berbagai manfaat besar yang meningkatkan kegunaan dan efisiensi model bahasa, menjadikannya lebih praktis untuk beragam aplikasi.

Berikut beberapa keunggulan utamanya.

Ukuran model berkurang

Salah satu manfaat utama distilasi LLM adalah terciptanya model yang jauh lebih kecil. Dengan mentransfer pengetahuan dari model guru yang besar ke model murid yang lebih kecil, murid mempertahankan banyak kemampuan guru meski ukurannya hanya sebagian kecil.

Pengurangan ukuran ini menghasilkan:

- Inferensi lebih cepat: Model yang lebih kecil memproses data lebih cepat, menghasilkan waktu respons yang lebih singkat.

- Kebutuhan penyimpanan berkurang: Model yang lebih kecil memerlukan ruang lebih sedikit, sehingga lebih mudah disimpan dan dikelola, terutama di lingkungan dengan kapasitas terbatas.

Kecepatan inferensi meningkat

Ukuran model hasil distilasi yang lebih kecil berbanding lurus dengan peningkatan kecepatan inferensi. Ini sangat penting untuk aplikasi yang memerlukan pemrosesan waktu nyata dan respons cepat.

Berikut wujud manfaatnya:

- Aplikasi waktu nyata: Kecepatan inferensi yang lebih tinggi memungkinkan penerapan model terdistilasi pada aplikasi waktu nyata seperti chatbot, asisten virtual, dan sistem interaktif di mana latensi adalah faktor krusial.

- Perangkat dengan sumber daya terbatas: Model terdistilasi dapat dijalankan pada perangkat dengan sumber daya komputasi terbatas, seperti ponsel pintar, tablet, dan perangkat tepi, tanpa mengorbankan kinerja.

Biaya komputasi lebih rendah

Keuntungan lain yang patut dicatat dari distilasi LLM adalah pengurangan biaya komputasi. Model yang lebih kecil membutuhkan daya komputasi lebih sedikit untuk berjalan, yang menghasilkan penghematan biaya di beberapa area:

- Lingkungan cloud: Menjalankan model yang lebih kecil di lingkungan cloud mengurangi kebutuhan perangkat keras berperforma tinggi yang mahal dan menurunkan konsumsi energi.

- Penerapan on-premise: Model yang lebih kecil berarti biaya infrastruktur dan pemeliharaan yang lebih rendah bagi organisasi yang memilih penerapan on-premise.

Aksesibilitas dan penerapan yang lebih luas

LLM terdistilasi lebih serbaguna dan mudah diakses, memungkinkan penerapan lintas platform. Jangkauan yang diperluas ini memiliki beberapa implikasi:

- Perangkat seluler: Model terdistilasi dapat diterapkan di perangkat seluler, menghadirkan fitur AI canggih dalam format portabel yang ramah pengguna.

- Perangkat tepi: Kemampuan berjalan di perangkat tepi menghadirkan kapabilitas AI lebih dekat ke tempat data dihasilkan, mengurangi kebutuhan konektivitas terus-menerus dan meningkatkan privasi data.

- Aplikasi yang lebih luas: Mulai dari kesehatan hingga keuangan hingga pendidikan, model terdistilasi dapat diintegrasikan ke banyak aplikasi, membuat AI tingkat lanjut lebih mudah diakses berbagai industri dan pengguna.

Aplikasi LLM Terdistilasi

Manfaat distilasi LLM melampaui efisiensi model dan penghematan biaya. Model bahasa terdistilasi dapat diterapkan di berbagai tugas pemrosesan bahasa alami (NLP) dan use case spesifik industri, membuat solusi AI dapat diakses di berbagai bidang.

Tugas NLP yang efisien

LLM terdistilasi unggul dalam banyak tugas pemrosesan bahasa alami. Ukurannya yang lebih kecil dan kinerja yang ditingkatkan membuatnya ideal untuk tugas yang memerlukan pemrosesan waktu nyata dan daya komputasi lebih rendah.

Chatbot

LLM terdistilasi memungkinkan pengembangan chatbot yang lebih kecil dan cepat yang dapat menangani tugas layanan dan dukungan pelanggan dengan lancar. Chatbot ini dapat memahami dan merespons pertanyaan pengguna secara waktu nyata, memberikan pengalaman pelanggan yang mulus tanpa memerlukan komputasi yang ekstensif.

Perangkuman teks

Alat perangkuman berbasis LLM terdistilasi dapat memadatkan artikel berita, dokumen, atau linimasa media sosial menjadi ringkasan yang singkat. Ini membantu pengguna cepat memahami poin-poin utama tanpa harus membaca teks yang panjang.

Penerjemahan mesin

Model terdistilasi membuat layanan penerjemahan lebih cepat dan mudah diakses di berbagai perangkat. Model ini dapat diterapkan pada ponsel, tablet, bahkan aplikasi offline, menghadirkan terjemahan waktu nyata dengan latensi dan beban komputasi yang lebih rendah.

Tugas lainnya

LLM terdistilasi tidak hanya berharga untuk tugas NLP umum, tetapi juga unggul di area spesialis yang memerlukan pemrosesan cepat dan hasil akurat.

- Analisis sentimen: Menganalisis sentimen teks, seperti ulasan atau unggahan media sosial, menjadi lebih mudah dan cepat dengan model terdistilasi, memungkinkan bisnis menilai opini publik dan umpan balik pelanggan dengan cepat.

- Penjawaban pertanyaan: Model terdistilasi dapat menjalankan sistem yang menjawab pertanyaan pengguna secara akurat dan cepat, meningkatkan pengalaman pengguna dalam aplikasi seperti asisten virtual dan alat edukasi.

- Generasi teks: Pembuatan teks yang koheren dan relevan secara konteks, baik untuk pembuatan konten, bercerita, maupun generasi laporan otomatis, menjadi lebih efisien dengan LLM terdistilasi.

Use case industri

LLM terdistilasi tidak hanya terbatas pada tugas NLP umum. Model ini juga dapat berdampak pada banyak industri dengan memperbaiki proses, pengalaman pengguna, dan mendorong inovasi.

Kesehatan

Di industri kesehatan, LLM terdistilasi dapat memproses rekam medis dan data diagnostik dengan lebih efisien, memungkinkan diagnosis yang lebih cepat dan akurat. Model ini dapat diterapkan dalam perangkat medis, mendukung dokter dan tenaga kesehatan dengan analisis data waktu nyata dan pengambilan keputusan.

Keuangan

Sektor keuangan diuntungkan dengan model terdistilasi melalui peningkatan sistem deteksi penipuan dan model interaksi pelanggan. Dengan cepat mengurai pola transaksi dan pertanyaan pelanggan, LLM terdistilasi membantu mencegah aktivitas penipuan dan memberikan saran serta dukungan finansial yang dipersonalisasi.

Pendidikan

Di bidang pendidikan, LLM terdistilasi memfasilitasi pembuatan sistem pembelajaran adaptif dan platform tutor personal. Sistem ini dapat menganalisis kinerja siswa dan menawarkan konten pembelajaran yang disesuaikan, meningkatkan hasil belajar dan membuat pendidikan lebih mudah diakses serta berdampak.

Mengimplementasikan Distilasi LLM

Mengimplementasikan distilasi LLM melibatkan serangkaian langkah dan penggunaan kerangka kerja serta pustaka khusus yang dirancang untuk memfasilitasi proses. Di sini, kita bahas alat dan langkah yang diperlukan untuk mendistilasi model bahasa besar.

Kerangka kerja dan pustaka

Untuk merampingkan proses distilasi, beberapa kerangka kerja dan pustaka tersedia, masing-masing menawarkan fitur unik untuk mendukung distilasi LLM.

Hugging Face transformers

Pustaka Hugging Face transformers adalah alat populer untuk mengimplementasikan distilasi LLM. Pustaka ini mencakup kelas Distiller yang menyederhanakan proses transfer pengetahuan dari model guru ke model murid.

Dengan menggunakan kelas Distiller, praktisi dapat memanfaatkan model pralatih, melakukan fine-tuning pada dataset tertentu, dan menerapkan teknik distilasi untuk mencapai hasil optimal.

Pustaka lainnya

Selain Hugging Face Transformers, banyak pustaka lain yang mendukung distilasi LLM:

- Optimisasi model TensorFlow: Pustaka ini menyediakan alat untuk pruning, kuantisasi, dan distilasi model, menjadikannya pilihan serbaguna untuk membangun model.

- PyTorch distiller: PyTorch

Distillerdirancang untuk mengompresi model pembelajaran mendalam, termasuk dukungan untuk teknik distilasi. Pustaka ini menawarkan berbagai utilitas untuk mengelola proses distilasi dan meningkatkan efisiensi model. - DeepSpeed: Dikembangkan oleh Microsoft, DeepSpeed adalah pustaka optimisasi pembelajaran mendalam yang mencakup fitur untuk distilasi model, memungkinkan pelatihan dan penerapan model besar.

Langkah-langkah yang terlibat

Mengimplementasikan distilasi LLM memerlukan perencanaan dan eksekusi yang cermat. Berikut langkah-langkah kunci yang terlibat dalam prosesnya.

Persiapan data

Langkah pertama dalam proses distilasi adalah menyiapkan dataset yang sesuai untuk melatih model murid. Dataset harus representatif terhadap tugas yang akan dijalankan model, memastikan model murid belajar untuk mengeneralisasi dengan baik.

Teknik augmentasi data juga dapat meningkatkan dataset, memberikan model murid rentang contoh yang lebih luas untuk dipelajari.

Pemilihan model guru

Memilih model guru yang tepat diperlukan untuk distilasi yang berhasil. Model guru harus merupakan model pralatih berkinerja baik dengan tingkat akurasi tinggi pada tugas target. Kualitas dan atribut model guru secara langsung memengaruhi kinerja model murid.

Proses distilasi

Proses distilasi melibatkan langkah-langkah berikut:

- Penyiapan pelatihan: Inisialisasi model murid dan konfigurasikan lingkungan pelatihan, termasuk hiperparameter seperti laju pembelajaran dan ukuran batch.

- Transfer pengetahuan: Gunakan model guru untuk menghasilkan soft targets (distribusi probabilitas) untuk data pelatihan. Soft targets ini, bersama hard targets (label kebenaran dasar), digunakan untuk melatih model murid.

- Loop pelatihan: Latih model murid dengan kombinasi soft targets dan hard targets. Tujuannya adalah meminimalkan fungsi loss, yang mengukur perbedaan antara prediksi model murid dan soft targets dari model guru.

Metrik Evaluasi

Mengevaluasi kinerja model terdistilasi penting untuk memastikan ia memenuhi kriteria yang diinginkan. Metrik evaluasi umum meliputi:

- Akurasi: Ukuran persentase prediksi benar yang dibuat model murid dibandingkan dengan kebenaran dasar.

- Kecepatan inferensi: Menilai waktu yang dibutuhkan model murid untuk memproses masukan dan menghasilkan keluaran.

- Ukuran model: Evaluasi pengurangan ukuran model dan manfaat terkait dalam hal penyimpanan dan efisiensi komputasi.

- Pemanfaatan sumber daya: Memantau sumber daya komputasi yang diperlukan model murid saat inferensi, memastikan ia memenuhi batasan lingkungan penerapan.

Saya membahas evaluasi LLM lebih mendalam dalam artikel tentang Evaluasi LLM: Metrik, Metodologi, Praktik Terbaik.

Distilasi LLM: Tantangan dan Praktik Terbaik

Meski menawarkan banyak manfaat, distilasi LLM juga menghadirkan beberapa tantangan yang harus diatasi untuk memastikan implementasi yang sukses.

Kehilangan pengetahuan

Salah satu hambatan utama dalam distilasi LLM adalah potensi kehilangan pengetahuan. Selama proses distilasi, sebagian informasi bernuansa dan fitur dari model guru mungkin tidak sepenuhnya tertangkap oleh model murid, yang menyebabkan penurunan kinerja. Masalah ini bisa sangat terasa pada tugas yang memerlukan pemahaman mendalam atau pengetahuan khusus.

Berikut beberapa strategi yang dapat kita terapkan untuk mengurangi kehilangan pengetahuan:

- Distilasi lapisan perantara: Mentransfer pengetahuan dari lapisan perantara model guru dapat membantu model murid menangkap informasi yang lebih terperinci dan terstruktur.

- Augmentasi data: Menggunakan data hasil augmentasi yang dihasilkan model guru dapat memberikan model murid rentang contoh pelatihan yang lebih luas, sehingga membantu proses belajarnya.

- Distilasi iteratif: Memurnikan model murid melalui beberapa putaran distilasi dapat membuatnya semakin banyak menangkap pengetahuan dari guru secara progresif.

Penalaan hiperparameter

Penalaan hiperparameter yang cermat sangat penting untuk keberhasilan proses distilasi. Hiperparameter kunci, seperti temperatur dan laju pembelajaran, sangat memengaruhi kemampuan model murid untuk belajar dari guru:

- Temperatur: Parameter ini mengontrol kelunakan distribusi probabilitas yang dihasilkan model guru. Temperatur yang lebih tinggi menghasilkan distribusi probabilitas yang lebih lunak, yang dapat membantu model murid belajar lebih menyeluruh dari prediksi guru.

- Laju pembelajaran: Menyetel laju pembelajaran penting untuk menyeimbangkan kecepatan dan stabilitas proses pelatihan. Laju yang tepat memastikan model murid berkongvergensi ke solusi optimal tanpa overfitting atau underfitting.

Mengevaluasi efektivitas

Mengevaluasi efektivitas model terdistilasi adalah langkah yang tidak terelakkan untuk menjamin bahwa model memenuhi kriteria kinerja yang diinginkan, khususnya dibandingkan pendahulu dan alternatifnya. Ini melibatkan perbandingan kinerja murid dengan guru dan baseline lain untuk memahami seberapa baik proses distilasi mempertahankan atau meningkatkan fungsionalitas model.

Untuk menilai efektivitas model terdistilasi, penting berfokus pada metrik berikut:

- Akurasi: Ukur bagaimana akurasi model murid dibandingkan dengan model guru dan baseline lain, untuk melihat potensi kehilangan atau retensi ketelitian.

- Kecepatan inferensi: Bandingkan kecepatan inferensi model murid dengan model guru, menyoroti peningkatan waktu pemrosesan.

- Ukuran model: Nilai perbedaan ukuran model antara murid dan guru, serta baseline lain, untuk mengevaluasi keuntungan efisiensi dari distilasi.

- Pemanfaatan sumber daya: Analisis bagaimana penggunaan sumber daya model murid dibandingkan dengan model guru, memastikan model murid menawarkan alternatif yang lebih ekonomis tanpa mengorbankan kinerja.

Praktik terbaik

Mematuhi praktik terbaik dapat meningkatkan efektivitas distilasi LLM. Pedoman ini menekankan eksperimen, evaluasi berkelanjutan, dan implementasi strategis.

- Eksperimen: Secara berkala bereksperimen dengan berbagai teknik distilasi dan setelan hiperparameter untuk mengidentifikasi konfigurasi terbaik bagi use case Anda.

- Evaluasi berkelanjutan: Secara kontinu evaluasi kinerja model murid menggunakan tolok ukur dan dataset yang relevan. Pengujian dan penyempurnaan iteratif adalah kunci untuk mencapai hasil optimal.

- Pelatihan seimbang: Pastikan proses pelatihan yang seimbang dengan mengombinasikan soft targets dari model guru dengan hard targets. Pendekatan ini membantu model murid menangkap pengetahuan bernuansa sambil menjaga akurasi.

- Pembaruan rutin: Tetap mengikuti perkembangan terbaru riset distilasi LLM dan masukkan teknik serta temuan baru ke dalam proses distilasi Anda.

Riset dan Arah Masa Depan

Bidang distilasi LLM berkembang pesat. Bagian ini membahas tren terbaru, tantangan riset saat ini, dan teknik yang sedang muncul dalam distilasi LLM.

Riset dan kemajuan terbaru

Riset terbaru dalam distilasi LLM berfokus pada pengembangan teknik dan arsitektur baru untuk meningkatkan efisiensi dan efektivitas proses distilasi. Beberapa kemajuan penting meliputi:

- Distilasi progresif: Ini melibatkan distilasi pengetahuan secara bertahap, di mana model murid perantara secara progresif didistilasi dari model guru. Teknik ini menunjukkan potensi dalam meningkatkan kinerja dan stabilitas model murid akhir.

- Distilasi agnostik tugas: Para peneliti mengeksplorasi metode untuk mendistilasi pengetahuan secara agnostik tugas, memungkinkan model murid melakukan generalisasi lintas tugas tanpa memerlukan fine-tuning khusus tugas. Pendekatan ini dapat sangat mengurangi waktu pelatihan dan sumber daya komputasi yang dibutuhkan untuk aplikasi baru.

- Distilasi lintas modal: Area lain yang berkembang adalah distilasi pengetahuan lintas modalitas, seperti teks, gambar, dan audio. Distilasi lintas modal bertujuan menciptakan model murid yang serbaguna dan mampu menangani berbagai jenis data masukan, memperluas keberterapan model terdistilasi.

Masalah terbuka dan arah masa depan

Meski kemajuan signifikan telah dicapai, sejumlah tantangan dan pertanyaan riset terbuka tetap ada dalam bidang distilasi LLM:

- Meningkatkan generalisasi: Salah satu tantangan kunci adalah meningkatkan kemampuan generalisasi model terdistilasi. Memastikan model murid berkinerja baik di berbagai tugas dan dataset tetap menjadi area riset yang berkelanjutan.

- Transfer pengetahuan lintas domain: Transfer pengetahuan yang efektif di berbagai domain adalah area krusial lainnya. Mengembangkan metode untuk mendistilasi pengetahuan yang dapat diterapkan ke domain baru dan berbeda tanpa kehilangan kinerja yang signifikan merupakan tujuan penting.

- Skalabilitas: Menskalakan teknik distilasi untuk menangani model dan dataset yang semakin besar secara efisien adalah tantangan yang terus-menerus. Riset berfokus pada pengoptimalan proses distilasi agar lebih skalabel.

Teknik yang muncul

Teknik dan inovasi baru terus dikembangkan untuk mengatasi tantangan ini dan mendorong bidang ini maju. Beberapa pendekatan yang menjanjikan antara lain:

- Adaptasi zero-shot dan few-shot: Mengintegrasikan kapabilitas zero-shot dan few-shot ke dalam model terdistilasi adalah area riset yang berkembang. Teknik ini memungkinkan model melakukan tugas dengan sedikit atau tanpa data pelatihan khusus tugas, meningkatkan fleksibilitas dan kepraktisannya.

- Self-distillation: Dalam self-distillation, model murid dilatih menggunakan prediksinya sendiri sebagai soft targets. Pendekatan ini dapat meningkatkan kinerja dan ketangguhan model dengan memanfaatkan pengetahuan yang telah dipelajarinya secara iteratif.

- Distilasi adversarial: Menggabungkan pelatihan adversarial dengan teknik distilasi adalah pendekatan inovatif lainnya. Distilasi adversarial melibatkan pelatihan model murid untuk tidak hanya meniru guru, tetapi juga tangguh terhadap serangan adversarial, sehingga meningkatkan keamanan dan keandalannya.

Kesimpulan

Distilasi LLM adalah teknik penting untuk membuat model bahasa besar menjadi lebih praktis dan efisien. Dengan mentransfer pengetahuan esensial dari model guru yang kompleks ke model murid yang lebih kecil, distilasi mempertahankan kinerja sambil mengurangi ukuran dan kebutuhan komputasi.

Proses ini memungkinkan aplikasi AI yang lebih cepat dan mudah diakses di berbagai industri, mulai dari tugas NLP waktu nyata hingga use case khusus di bidang kesehatan dan keuangan. Mengimplementasikan distilasi LLM memerlukan perencanaan yang cermat dan alat yang tepat, namun manfaatnya—seperti biaya lebih rendah dan penerapan yang lebih luas—sangat besar.

Seiring riset terus berkembang, distilasi LLM akan memainkan peran yang semakin penting dalam mendemokratisasi AI, membuat model yang kuat lebih mudah diakses dan digunakan dalam berbagai konteks.