Courses

Các mô hình ngôn ngữ lớn (LLM) ngày càng phức tạp và có kích thước lớn hơn, và việc triển khai chúng đặt ra không ít thách thức.

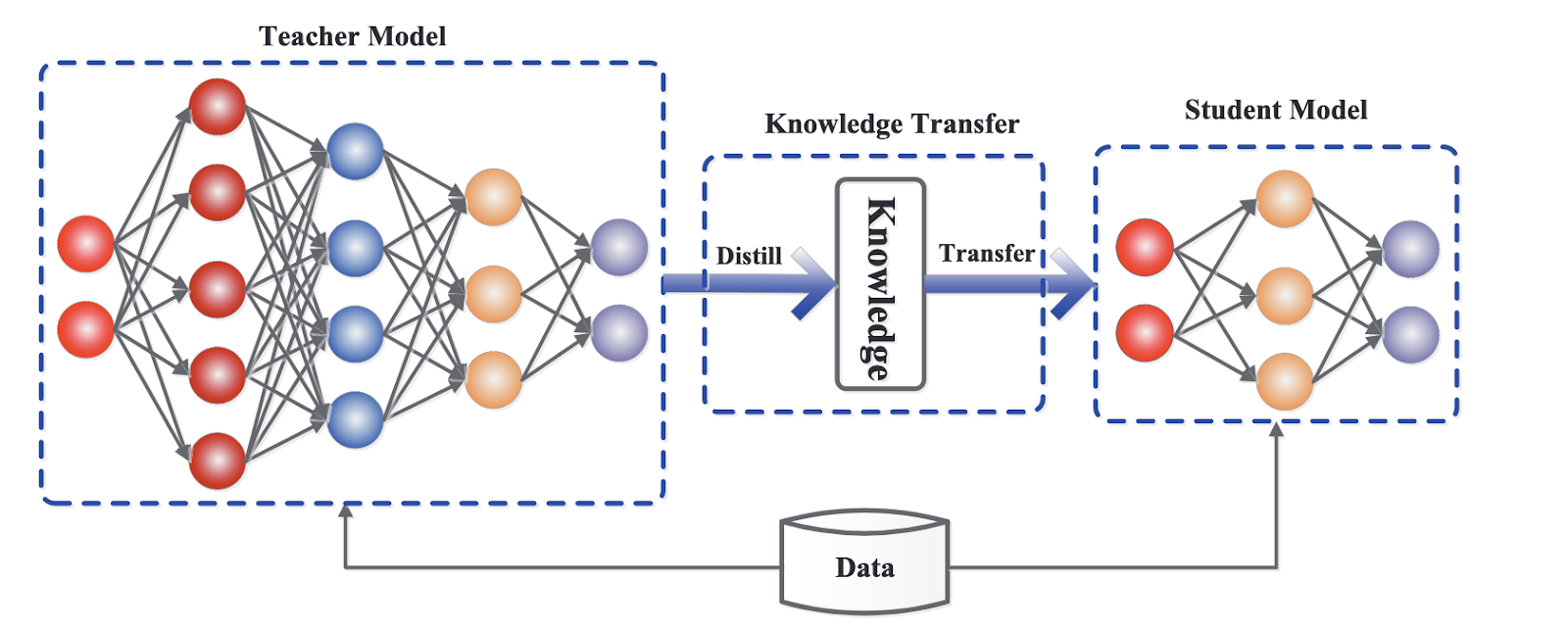

Distillation cho LLM nổi lên như một giải pháp mạnh mẽ cho vấn đề này, cho phép chuyển giao tri thức từ một mô hình ngôn ngữ lớn, phức tạp ("giáo viên") sang một phiên bản nhỏ hơn, hiệu quả hơn ("học sinh").

Một ví dụ gần đây trong giới AI là quá trình distillation của GPT-4o mini (học sinh) từ GPT-4o (giáo viên).

Quá trình này có thể ví như thầy truyền đạt kiến thức cho trò, với mục tiêu chắt lọc tri thức cốt lõi mà không mang theo sự cồng kềnh từ độ phức tạp của mô hình lớn. Hãy cùng tìm hiểu thêm!

Distillation cho LLM là gì?

Distillation cho LLM là một kỹ thuật nhằm tái tạo hiệu năng của một mô hình ngôn ngữ lớn trong khi giảm kích thước và nhu cầu tính toán của nó.

Hãy tưởng tượng một giáo sư dày dặn kinh nghiệm đang chia sẻ chuyên môn của mình với một sinh viên mới. Giáo sư, đại diện cho mô hình giáo viên, truyền đạt các khái niệm và insight phức tạp, trong khi mô hình học sinh học cách mô phỏng các chỉ dẫn đó theo cách đơn giản và hiệu quả hơn.

Quá trình này không chỉ giữ lại năng lực cốt lõi của giáo viên mà còn tối ưu hóa học sinh cho các ứng dụng nhanh hơn và linh hoạt hơn.

Vì sao Distillation cho LLM quan trọng?

Kích thước ngày càng lớn và yêu cầu tính toán của các mô hình ngôn ngữ lớn cản trở việc áp dụng và triển khai rộng rãi. Phần cứng hiệu năng cao và mức tiêu thụ năng lượng tăng thường giới hạn khả năng tiếp cận các mô hình này, đặc biệt trong môi trường hạn chế tài nguyên như thiết bị di động hoặc nền tảng điện toán biên.

Distillation cho LLM giải quyết các thách thức này bằng cách tạo ra các mô hình nhỏ hơn và nhanh hơn, lý tưởng để tích hợp trên nhiều thiết bị và nền tảng hơn.

Đổi mới này không chỉ dân chủ hóa khả năng tiếp cận AI tiên tiến mà còn hỗ trợ các ứng dụng thời gian thực nơi tốc độ và hiệu quả được coi trọng. Bằng cách cho phép các giải pháp AI dễ tiếp cận và có thể mở rộng hơn, distillation cho LLM góp phần thúc đẩy triển khai AI trong thực tế.

Cách Distillation cho LLM hoạt động: Quy trình chuyển giao tri thức

Quy trình distillation cho LLM bao gồm một số kỹ thuật để đảm bảo mô hình học sinh giữ lại thông tin chủ chốt trong khi vận hành hiệu quả hơn. Dưới đây, chúng ta khám phá các cơ chế cốt lõi giúp việc chuyển giao tri thức trở nên hiệu quả.

Mô hình giáo viên - học sinh

Mô hình giáo viên - học sinh là trọng tâm của distillation cho LLM, một khái niệm nền tảng điều khiển quá trình chuyển giao tri thức. Trong thiết lập này, một mô hình lớn, tiên tiến sẽ truyền đạt kiến thức cho một mô hình nhỏ, gọn nhẹ.

Mô hình giáo viên, thường là một mô hình ngôn ngữ tối tân với quá trình huấn luyện và tài nguyên tính toán đồ sộ, đóng vai trò là nguồn thông tin phong phú. Ngược lại, mô hình học sinh được thiết kế để học từ giáo viên bằng cách mô phỏng hành vi và nội hóa tri thức của nó.

Nhiệm vụ chính của mô hình học sinh là tái tạo đầu ra của giáo viên trong khi vẫn duy trì kích thước nhỏ hơn nhiều và nhu cầu tính toán giảm. Quá trình này bao gồm việc học sinh quan sát và học từ các dự đoán, điều chỉnh và phản hồi của giáo viên trước nhiều đầu vào khác nhau.

Bằng cách đó, học sinh có thể đạt mức hiệu năng và hiểu biết tương đương, phù hợp để triển khai trong các môi trường hạn chế tài nguyên.

Các kỹ thuật distillation

Nhiều kỹ thuật distillation được sử dụng để chuyển giao tri thức từ giáo viên sang học sinh. Các phương pháp này đảm bảo mô hình học sinh không chỉ học hiệu quả mà còn giữ lại tri thức và năng lực cốt lõi của mô hình giáo viên. Dưới đây là một số kỹ thuật nổi bật nhất trong distillation cho LLM.

Knowledge distillation (KD)

Một trong những kỹ thuật tiêu biểu nhất trong distillation cho LLM là knowledge distillation (KD). Trong KD, mô hình học sinh được huấn luyện bằng cách sử dụng các xác suất đầu ra của mô hình giáo viên, gọi là soft targets, cùng với nhãn sự thật gốc, gọi là hard targets.

Soft targets cung cấp góc nhìn tinh tế về dự đoán của giáo viên, đưa ra phân phối xác suất trên các đầu ra khả dĩ thay vì chỉ một đáp án đúng. Thông tin bổ sung này giúp mô hình học sinh nắm bắt các mẫu tinh vi và tri thức phức tạp được mã hóa trong phản hồi của giáo viên.

Bằng việc dùng soft targets, mô hình học sinh có thể hiểu rõ hơn quá trình ra quyết định của giáo viên, dẫn đến hiệu năng chính xác và đáng tin cậy hơn. Cách tiếp cận này không chỉ giữ tri thức then chốt từ giáo viên mà còn giúp quá trình huấn luyện của học sinh mượt mà và hiệu quả hơn.

Khung làm việc tổng quát cho knowledge distillation. Nguồn

Các kỹ thuật distillation khác

Ngoài KD, còn có một số kỹ thuật khác có thể cải thiện quá trình distillation cho LLM:

- Tăng cường dữ liệu: Tạo thêm dữ liệu huấn luyện bằng mô hình giáo viên. Bằng cách xây dựng bộ dữ liệu lớn hơn và bao quát hơn, học sinh được tiếp xúc với nhiều kịch bản và ví dụ hơn, cải thiện khả năng khái quát hóa.

- Distillation tầng trung gian: Thay vì chỉ tập trung vào đầu ra cuối, phương pháp này chuyển giao tri thức từ các tầng trung gian của mô hình giáo viên sang học sinh. Học từ các biểu diễn trung gian giúp học sinh nắm bắt thông tin chi tiết và có cấu trúc hơn, từ đó nâng cao hiệu năng tổng thể.

- Distillation đa giáo viên: Mô hình học sinh có thể hưởng lợi khi học từ nhiều mô hình giáo viên. Bằng cách tổng hợp tri thức từ nhiều giáo viên, học sinh đạt được hiểu biết toàn diện và độ vững mạnh cao hơn nhờ tích hợp các góc nhìn và insight khác nhau.

Lợi ích của Distillation cho LLM

Distillation cho LLM mang lại nhiều lợi ích đáng kể, nâng cao tính hữu dụng và hiệu quả của các mô hình ngôn ngữ, khiến chúng thực tiễn hơn cho các ứng dụng đa dạng.

Dưới đây là một số ưu điểm chính.

Giảm kích thước mô hình

Một lợi ích quan trọng của distillation cho LLM là tạo ra các mô hình nhỏ hơn thấy rõ. Bằng cách chuyển giao tri thức từ mô hình giáo viên lớn sang mô hình học sinh nhỏ, mô hình học sinh giữ được phần lớn năng lực của giáo viên trong khi chỉ bằng một phần kích thước.

Việc giảm kích thước mô hình dẫn đến:

- Suy luận nhanh hơn: Mô hình nhỏ xử lý dữ liệu nhanh hơn, cho thời gian phản hồi ngắn hơn.

- Giảm yêu cầu lưu trữ: Mô hình nhỏ chiếm ít dung lượng hơn, giúp lưu trữ và quản lý dễ dàng, nhất là trong môi trường hạn chế bộ nhớ.

Tốc độ suy luận cải thiện

Kích thước nhỏ hơn của các mô hình đã distill chuyển hóa trực tiếp thành tốc độ suy luận cao hơn. Điều này đặc biệt quan trọng cho các ứng dụng cần xử lý theo thời gian thực và phản hồi nhanh.

Cụ thể lợi ích này thể hiện như sau:

- Ứng dụng thời gian thực: Tốc độ suy luận nhanh cho phép triển khai mô hình đã distill trong các ứng dụng thời gian thực như chatbot, trợ lý ảo và hệ thống tương tác nơi độ trễ là yếu tố sống còn.

- Thiết bị hạn chế tài nguyên: Mô hình đã distill có thể triển khai trên thiết bị với tài nguyên tính toán hạn chế như điện thoại thông minh, máy tính bảng và thiết bị biên mà không làm suy giảm hiệu năng.

Giảm chi phí tính toán

Một lợi thế đáng chú ý khác của distillation cho LLM là giảm chi phí tính toán. Mô hình nhỏ cần ít năng lực tính toán hơn để chạy, dẫn đến tiết kiệm chi phí ở nhiều khía cạnh:

- Môi trường đám mây: Vận hành mô hình nhỏ trong môi trường đám mây giảm nhu cầu phần cứng đắt đỏ, hiệu năng cao và hạ thấp mức tiêu thụ năng lượng.

- Triển khai on-premise: Mô hình nhỏ đồng nghĩa với chi phí hạ tầng và bảo trì thấp hơn cho các tổ chức ưa thích triển khai on-premise.

Khả năng tiếp cận và triển khai rộng hơn

Các LLM đã distill linh hoạt và dễ tiếp cận hơn, cho phép triển khai đa nền tảng. Phạm vi mở rộng này mang lại một số hệ quả:

- Thiết bị di động: Mô hình đã distill có thể triển khai trên thiết bị di động, mang các tính năng AI tiên tiến đến định dạng di động, thân thiện người dùng.

- Thiết bị biên: Khả năng chạy trên thiết bị biên đưa năng lực AI đến gần nơi dữ liệu được tạo ra, giảm nhu cầu kết nối liên tục và tăng cường quyền riêng tư dữ liệu.

- Ứng dụng rộng rãi: Từ y tế đến tài chính đến giáo dục, các mô hình đã distill có thể tích hợp vào vô số ứng dụng, giúp AI tiên tiến dễ tiếp cận hơn cho nhiều ngành và người dùng.

Ứng dụng của các LLM đã distill

Lợi ích của distillation cho LLM vượt xa hiệu quả mô hình và tiết kiệm chi phí. Các mô hình ngôn ngữ đã distill có thể áp dụng cho nhiều tác vụ xử lý ngôn ngữ tự nhiên (NLP) và các bài toán theo ngành, giúp giải pháp AI khả dụng ở nhiều lĩnh vực.

Các tác vụ NLP hiệu quả

LLM đã distill vượt trội trong nhiều tác vụ xử lý ngôn ngữ tự nhiên. Kích thước giảm và hiệu năng tăng khiến chúng lý tưởng cho các tác vụ cần xử lý thời gian thực và ít tài nguyên tính toán.

Chatbot

LLM đã distill cho phép phát triển các chatbot nhỏ hơn, nhanh hơn, có thể xử lý mượt mà các tác vụ dịch vụ và hỗ trợ khách hàng. Những chatbot này hiểu và phản hồi truy vấn theo thời gian thực, mang lại trải nghiệm liền mạch mà không cần tính toán đồ sộ.

Tóm tắt văn bản

Các công cụ tóm tắt được hỗ trợ bởi LLM đã distill có thể cô đọng bài báo, tài liệu hoặc dòng thời gian mạng xã hội thành bản tóm lược súc tích. Điều này giúp người dùng nắm nhanh ý chính mà không phải đọc các văn bản dài.

Dịch máy

Các mô hình đã distill giúp dịch thuật nhanh hơn và khả dụng hơn trên nhiều thiết bị. Chúng có thể triển khai trên điện thoại, máy tính bảng, thậm chí ứng dụng ngoại tuyến, cung cấp dịch theo thời gian thực với độ trễ và chi phí tính toán thấp.

Các tác vụ khác

LLM đã distill không chỉ hữu ích cho các tác vụ NLP phổ biến mà còn nổi bật trong các mảng chuyên biệt đòi hỏi xử lý nhanh và kết quả chính xác.

- Phân tích cảm xúc: Phân tích cảm xúc văn bản như đánh giá hoặc bài đăng mạng xã hội trở nên dễ và nhanh hơn với mô hình đã distill, giúp doanh nghiệp nhanh chóng đo lường dư luận và phản hồi khách hàng.

- Hỏi đáp: Mô hình đã distill có thể vận hành các hệ thống trả lời câu hỏi chính xác và kịp thời, nâng cao trải nghiệm trong trợ lý ảo và công cụ giáo dục.

- Sinh văn bản: Việc tạo văn bản mạch lạc, phù hợp ngữ cảnh — từ sáng tạo nội dung, kể chuyện đến tạo báo cáo tự động — trở nên gọn nhẹ hơn với LLM đã distill.

Các kịch bản theo ngành

LLM đã distill không chỉ giới hạn ở tác vụ NLP tổng quát. Chúng còn có thể tác động đến nhiều ngành bằng cách cải thiện quy trình, trải nghiệm người dùng và thúc đẩy đổi mới.

Y tế

Trong ngành y tế, LLM đã distill có thể xử lý hồ sơ bệnh nhân và dữ liệu chẩn đoán hiệu quả hơn, cho phép chẩn đoán nhanh và chính xác hơn. Các mô hình này có thể triển khai trong thiết bị y tế, hỗ trợ bác sĩ và nhân viên y tế với phân tích dữ liệu và ra quyết định theo thời gian thực.

Tài chính

Ngành tài chính hưởng lợi từ mô hình đã distill thông qua các hệ thống phát hiện gian lận và mô hình tương tác khách hàng được nâng cấp. Bằng cách nhanh chóng giải mã mẫu giao dịch và truy vấn khách hàng, LLM đã distill giúp ngăn chặn gian lận và cung cấp tư vấn tài chính cá nhân hóa.

Giáo dục

Trong giáo dục, LLM đã distill hỗ trợ xây dựng hệ thống học tập thích ứng và nền tảng gia sư cá nhân hóa. Các hệ thống này có thể phân tích hiệu suất người học và cung cấp nội dung phù hợp, nâng cao kết quả học tập và mở rộng khả năng tiếp cận.

Triển khai Distillation cho LLM

Triển khai distillation cho LLM bao gồm một chuỗi bước và sử dụng các framework, thư viện chuyên dụng được thiết kế để hỗ trợ quy trình. Dưới đây là công cụ và bước cần thiết để distill một mô hình ngôn ngữ lớn.

Framework và thư viện

Để đơn giản hóa quy trình distillation, có một số framework và thư viện sẵn có, mỗi cái cung cấp các tính năng riêng để hỗ trợ distillation cho LLM.

Hugging Face transformers

Thư viện Hugging Face transformers là công cụ phổ biến để triển khai distillation cho LLM. Nó bao gồm lớp Distiller giúp đơn giản hóa việc chuyển giao tri thức từ mô hình giáo viên sang mô hình học sinh.

Sử dụng lớp Distiller, người thực hành có thể tận dụng các mô hình đã huấn luyện sẵn, tinh chỉnh trên tập dữ liệu cụ thể và áp dụng kỹ thuật distillation để đạt kết quả tối ưu.

Các thư viện khác

Ngoài Hugging Face Transformers, còn có nhiều thư viện khác hỗ trợ distillation cho LLM:

- TensorFlow model optimization: Thư viện này cung cấp công cụ cho pruning, lượng tử hóa và distillation mô hình, là lựa chọn linh hoạt để tạo mô hình.

- PyTorch distiller: PyTorch

Distillerđược thiết kế để nén các mô hình học sâu, bao gồm hỗ trợ các kỹ thuật distillation. Nó cung cấp nhiều tiện ích để quản lý quy trình distillation và cải thiện hiệu quả mô hình. - DeepSpeed: Được phát triển bởi Microsoft, DeepSpeed là thư viện tối ưu hóa học sâu bao gồm các tính năng cho distillation mô hình, cho phép huấn luyện và triển khai các mô hình lớn.

Các bước liên quan

Triển khai distillation cho LLM đòi hỏi lập kế hoạch và thực thi cẩn trọng. Dưới đây là các bước chính của quy trình.

Chuẩn bị dữ liệu

Bước đầu tiên là chuẩn bị bộ dữ liệu phù hợp để huấn luyện mô hình học sinh. Bộ dữ liệu cần đại diện cho các tác vụ mà mô hình sẽ thực hiện, đảm bảo mô hình học sinh học cách khái quát tốt.

Kỹ thuật tăng cường dữ liệu cũng có thể làm phong phú bộ dữ liệu, cung cấp cho mô hình học sinh nhiều ví dụ hơn để học.

Chọn mô hình giáo viên

Việc chọn mô hình giáo viên phù hợp là điều kiện cần cho distillation thành công. Mô hình giáo viên nên là mô hình đã huấn luyện trước với hiệu năng cao trên các tác vụ mục tiêu. Chất lượng và thuộc tính của mô hình giáo viên ảnh hưởng trực tiếp đến hiệu năng của mô hình học sinh.

Quy trình distillation

Quy trình distillation bao gồm các bước sau:

- Thiết lập huấn luyện: Khởi tạo mô hình học sinh và cấu hình môi trường huấn luyện, bao gồm siêu tham số như tốc độ học và kích thước batch.

- Chuyển giao tri thức: Sử dụng mô hình giáo viên để tạo soft targets (phân phối xác suất) cho dữ liệu huấn luyện. Các soft targets này, cùng với hard targets (nhãn sự thật), được dùng để huấn luyện mô hình học sinh.

- Vòng lặp huấn luyện: Huấn luyện mô hình học sinh bằng cách kết hợp soft targets và hard targets. Mục tiêu là tối thiểu hóa hàm mất mát, đo lường chênh lệch giữa dự đoán của học sinh và soft targets do giáo viên cung cấp.

Chỉ số đánh giá

Đánh giá hiệu năng của mô hình đã distill là cần thiết để đảm bảo đáp ứng tiêu chí mong muốn. Các chỉ số phổ biến gồm:

- Độ chính xác: Tỷ lệ dự đoán đúng của mô hình học sinh so với sự thật gốc.

- Tốc độ suy luận: Thời gian mô hình học sinh cần để xử lý đầu vào và tạo đầu ra.

- Kích thước mô hình: Đánh giá mức giảm kích thước mô hình và lợi ích liên quan về lưu trữ, hiệu quả tính toán.

- Mức sử dụng tài nguyên: Theo dõi tài nguyên tính toán mô hình học sinh cần khi suy luận, xác nhận xem có đáp ứng ràng buộc của môi trường triển khai hay không.

Tôi trình bày sâu hơn về đánh giá LLM trong bài viết Đánh giá LLM: Chỉ số, Phương pháp luận, Thực hành tốt.

Distillation cho LLM: Thách thức và Thực hành tốt

Dù distillation cho LLM mang lại nhiều lợi ích, nó cũng đặt ra một số thách thức cần giải quyết để đảm bảo triển khai thành công.

Mất mát tri thức

Một trong những trở ngại chính là nguy cơ mất mát tri thức. Trong quá trình distillation, một số thông tin tinh tế và đặc trưng của mô hình giáo viên có thể không được mô hình học sinh nắm bắt đầy đủ, dẫn đến suy giảm hiệu năng. Vấn đề này đặc biệt rõ ở các tác vụ đòi hỏi hiểu biết sâu hoặc kiến thức chuyên biệt.

Dưới đây là vài chiến lược có thể áp dụng để giảm mất mát tri thức:

- Distillation tầng trung gian: Chuyển giao tri thức từ các tầng trung gian của mô hình giáo viên giúp mô hình học sinh nắm bắt thông tin chi tiết và có cấu trúc hơn.

- Tăng cường dữ liệu: Dùng dữ liệu tăng cường do mô hình giáo viên tạo ra có thể cung cấp cho mô hình học sinh tập ví dụ rộng hơn, hỗ trợ quá trình học.

- Distillation lặp: Tinh chỉnh mô hình học sinh qua nhiều vòng distillation giúp dần dần nắm bắt nhiều tri thức hơn từ giáo viên.

Tối ưu siêu tham số

Việc tinh chỉnh siêu tham số cẩn trọng là tối quan trọng cho sự thành công của quá trình distillation. Các siêu tham số chủ chốt như nhiệt độ và tốc độ học ảnh hưởng mạnh tới khả năng học của mô hình học sinh từ giáo viên:

- Nhiệt độ: Tham số này điều khiển độ “mềm” của phân phối xác suất do mô hình giáo viên tạo ra. Nhiệt độ cao tạo phân phối mềm hơn, giúp mô hình học sinh học kỹ hơn từ dự đoán của giáo viên.

- Tốc độ học: Điều chỉnh tốc độ học là thiết yếu để cân bằng tốc độ và độ ổn định của quá trình huấn luyện. Tốc độ học phù hợp đảm bảo mô hình học sinh hội tụ tới nghiệm tối ưu mà không quá khớp hay thiếu khớp.

Đánh giá hiệu quả

Đánh giá hiệu quả của mô hình đã distill là bước không thể thiếu để đảm bảo đáp ứng tiêu chí hiệu năng mong muốn, đặc biệt khi so với tiền nhiệm và phương án thay thế. Điều này bao gồm so sánh hiệu năng của học sinh với giáo viên và các baseline khác để hiểu mức độ bảo toàn hoặc cải thiện chức năng mô hình.

Để đo lường hiệu quả của mô hình đã distill, cần tập trung vào các chỉ số sau:

- Độ chính xác: Đo mức độ chính xác của mô hình học sinh so với mô hình giáo viên và các baseline, qua đó nhận diện sự mất mát hay giữ vững độ chính xác.

- Tốc độ suy luận: So sánh tốc độ suy luận của mô hình học sinh với giáo viên, làm nổi bật cải thiện về thời gian xử lý.

- Kích thước mô hình: Đánh giá khác biệt kích thước giữa mô hình học sinh và giáo viên, cũng như các baseline khác, để lượng hóa lợi ích hiệu quả do distillation mang lại.

- Mức sử dụng tài nguyên: Phân tích mức dùng tài nguyên của mô hình học sinh so với giáo viên, đảm bảo mô hình học sinh kinh tế hơn mà không đánh đổi hiệu năng.

Thực hành tốt

Tuân thủ thực hành tốt có thể nâng cao hiệu quả của distillation cho LLM. Những hướng dẫn này nhấn mạnh thử nghiệm, đánh giá liên tục và triển khai có chiến lược.

- Thử nghiệm: Thường xuyên thử các kỹ thuật distillation và cấu hình siêu tham số khác nhau để xác định thiết lập tốt nhất cho trường hợp sử dụng của bạn.

- Đánh giá liên tục: Liên tục đánh giá hiệu năng của mô hình học sinh bằng các benchmark và tập dữ liệu phù hợp. Kiểm thử lặp và tinh chỉnh là chìa khóa để đạt kết quả tối ưu.

- Huấn luyện cân bằng: Đảm bảo quy trình huấn luyện cân bằng bằng cách kết hợp soft targets từ mô hình giáo viên với hard targets. Cách này giúp mô hình học sinh nắm bắt tri thức tinh tế trong khi vẫn duy trì độ chính xác.

- Cập nhật thường xuyên: Theo dõi các tiến bộ mới nhất trong nghiên cứu distillation cho LLM và tích hợp kỹ thuật, phát hiện mới vào quy trình của bạn.

Nghiên cứu và Hướng đi Tương lai

Lĩnh vực distillation cho LLM đang phát triển nhanh chóng. Phần này khám phá các xu hướng mới, thách thức nghiên cứu hiện tại và kỹ thuật đang nổi trong distillation cho LLM.

Nghiên cứu và tiến bộ mới nhất

Gần đây, nghiên cứu tập trung phát triển kỹ thuật và kiến trúc mới nhằm tăng hiệu quả và tính hiệu lực của quá trình distillation. Một số tiến bộ đáng chú ý gồm:

- Distillation tiến dần: Chắt lọc tri thức theo từng giai đoạn, trong đó các mô hình học sinh trung gian lần lượt được distill từ giáo viên. Kỹ thuật này cho thấy hứa hẹn trong việc cải thiện hiệu năng và độ ổn định của mô hình học sinh cuối.

- Distillation phi nhiệm vụ: Các nhà nghiên cứu đang khám phá phương pháp distill tri thức theo cách không phụ thuộc nhiệm vụ, cho phép mô hình học sinh khái quát qua nhiều tác vụ mà không cần tinh chỉnh theo từng tác vụ. Cách tiếp cận này có thể giảm đáng kể thời gian huấn luyện và tài nguyên tính toán cho ứng dụng mới.

- Distillation xuyên phương thức: Một hướng khác đang nổi là distill tri thức giữa các mô thức khác nhau như văn bản, hình ảnh và âm thanh. Mục tiêu là tạo mô hình học sinh đa năng có thể xử lý nhiều loại dữ liệu đầu vào, mở rộng khả năng ứng dụng của mô hình đã distill.

Bài toán mở và hướng tương lai

Dù tiến bộ đáng kể, vẫn còn nhiều thách thức và câu hỏi nghiên cứu bỏ ngỏ trong lĩnh vực distillation cho LLM:

- Tăng cường khả năng khái quát: Một thách thức then chốt là cải thiện khả năng khái quát của mô hình đã distill. Đảm bảo mô hình học sinh hoạt động tốt trên nhiều tác vụ và tập dữ liệu vẫn là hướng nghiên cứu liên tục.

- Chuyển giao tri thức xuyên miền: Chuyển giao tri thức hiệu quả giữa các miền khác nhau là lĩnh vực then chốt khác. Phát triển phương pháp distill tri thức có thể áp dụng cho miền mới, khác biệt mà không suy giảm hiệu năng là mục tiêu quan trọng.

- Khả năng mở rộng: Mở rộng kỹ thuật distillation để xử lý các mô hình và bộ dữ liệu ngày càng lớn một cách hiệu quả vẫn là thách thức thường trực. Nghiên cứu tập trung tối ưu hóa quy trình distillation để tăng tính mở rộng.

Kỹ thuật đang nổi

Các kỹ thuật và đổi mới mới liên tục được phát triển để giải quyết các thách thức này và thúc đẩy lĩnh vực tiến lên. Một số hướng tiếp cận hứa hẹn gồm:

- Thích ứng học zero-shot và few-shot: Tích hợp năng lực zero-shot và few-shot vào mô hình đã distill là hướng nghiên cứu đang phát triển. Các kỹ thuật này cho phép mô hình thực hiện tác vụ với ít hoặc không có dữ liệu huấn luyện chuyên biệt, tăng tính linh hoạt và thực tiễn.

- Self-distillation: Trong self-distillation, mô hình học sinh được huấn luyện bằng chính dự đoán của nó như soft targets. Cách tiếp cận này có thể cải thiện hiệu năng và độ vững bằng cách lặp lại việc tận dụng tri thức đã học.

- Adversarial distillation: Kết hợp huấn luyện đối kháng với kỹ thuật distillation là một hướng sáng tạo khác. Adversarial distillation huấn luyện mô hình học sinh không chỉ mô phỏng giáo viên mà còn vững vàng trước các cuộc tấn công đối kháng, nâng cao bảo mật và độ tin cậy.

Kết luận

Distillation cho LLM là kỹ thuật then chốt giúp các mô hình ngôn ngữ lớn trở nên thực tiễn và hiệu quả hơn. Bằng cách chuyển giao tri thức thiết yếu từ mô hình giáo viên phức tạp sang mô hình học sinh nhỏ, distillation giữ vững hiệu năng đồng thời giảm kích thước và nhu cầu tính toán.

Quy trình này cho phép các ứng dụng AI nhanh hơn, dễ tiếp cận hơn trong nhiều ngành, từ tác vụ NLP thời gian thực đến các bài toán chuyên biệt trong y tế và tài chính. Triển khai distillation cho LLM đòi hỏi kế hoạch kỹ lưỡng và công cụ phù hợp, nhưng lợi ích — như chi phí thấp hơn và phạm vi triển khai rộng hơn — là rất đáng kể.

Khi nghiên cứu tiếp tục tiến triển, distillation cho LLM sẽ ngày càng đóng vai trò quan trọng trong việc dân chủ hóa AI, giúp các mô hình mạnh mẽ trở nên dễ tiếp cận và hữu dụng trong nhiều bối cảnh.