Cursus

In dit artikel hebben we enkele van de meest voorkomende vragen voor sollicitatiegesprekken over machine learning op een rij gezet die je kunt tegenkomen wanneer je solliciteert naar een functie in de sector of wanneer je zelf een kandidaat interviewt. Door deze vragen te oefenen en antwoorden voor te bereiden, zorg je ervoor dat je gesprek vlot verloopt.

Basisvragen voor sollicitaties over machine learning

Basisvragen hebben betrekking op terminologie, algoritmen en methodologieën. Interviewers stellen deze vragen om de technische kennis van de kandidaat te beoordelen.

Wat is semi-supervised machine learning?

Semi-supervised learning is een mix van supervised en unsupervised learning. Het algoritme wordt getraind op een combinatie van gelabelde en ongelabelde data. Het wordt meestal gebruikt wanneer we een heel kleine gelabelde dataset en een grote ongelabelde dataset hebben.

Eenvoudig gezegd: het unsupervised algoritme wordt gebruikt om clusters te maken en met behulp van bestaande gelabelde data labelen we de rest van de ongelabelde data. Een semi-supervised algoritme gaat uit van de continuïteitsaanname, clusteraanname en manifoldaanname.

Het wordt doorgaans gebruikt om de kosten van het verzamelen van gelabelde data te besparen. Bijvoorbeeld bij classificatie van eiwitsequenties, automatische spraakherkenning en zelfrijdende auto's.

Hoe kies je welk algoritme je gebruikt voor een dataset?

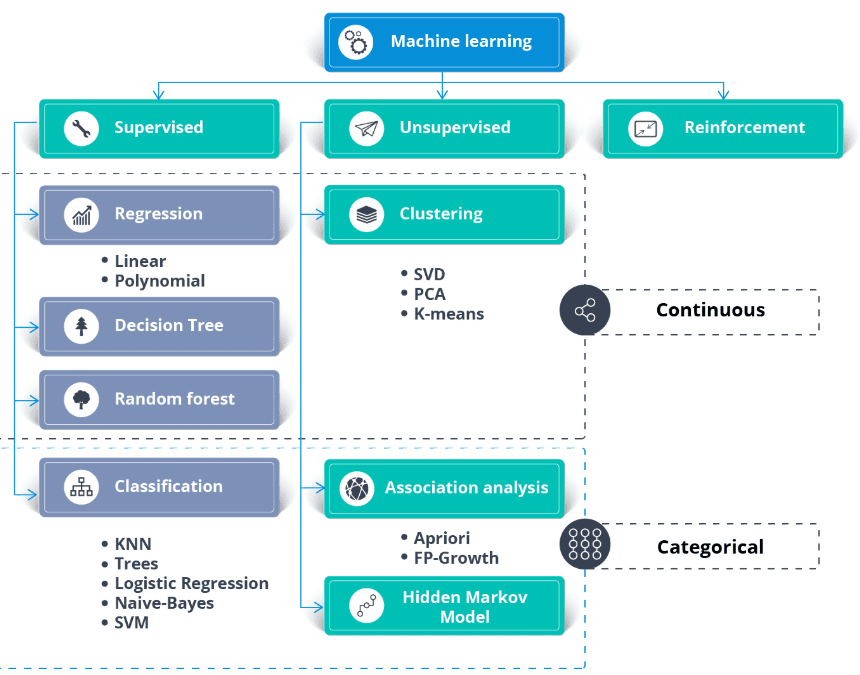

Naast de dataset heb je een zakelijke usecase of applicatie-eisen nodig. Je kunt supervised en unsupervised learning op dezelfde data toepassen.

In het algemeen:

- Supervised learning-algoritmen vereisen gelabelde data.

- Regressie-algoritmen vereisen continue numerieke doelen

- Classificatie-algoritmen vereisen categorische doelen

- Unsupervised learning-algoritmen vereisen ongelabelde data.

- Semi-supervised learning vereist een combinatie van gelabelde en ongelabelde datasets.

- Reinforcement learning-algoritmen vereisen gegevens over omgeving, agent, toestand en beloning.

Afbeelding van thecleverprogrammer

Leer de basisprincipes van machine learning met onze cursus.

Leg het K Nearest Neighbor-algoritme uit.

De K Nearest Neighbor (KNN) is een supervised learning-classificator. Het gebruikt nabijheid om labels te classificeren of de groepering van individuele datapunten te voorspellen. We kunnen het gebruiken voor regressie en classificatie. Het KNN-algoritme is niet-parametrisch, wat betekent dat het geen aannames doet over de onderliggende dataverdeling.

In de KNN-classificator:

- We zoeken K-buren die het dichtst bij het witte punt liggen. In het onderstaande voorbeeld kozen we k=5.

- Om de vijf dichtstbijzijnde buren te vinden, berekenen we de euclidische afstand tussen het witte punt en de andere punten. Vervolgens kiezen we de 5 punten die het dichtst bij het witte punt liggen.

- Er zijn drie rode en twee groene punten bij K=5. Omdat rood de meerderheid heeft, wijzen we er een rood label aan toe.

Afbeelding van Codesigner's Dev Story

Leer alles over supervised learning-classificatie- en regressiemodellen met een korte cursus.

Wat is feature importance in machine learning en hoe bepaal je die?

Feature importance verwijst naar technieken die een score toekennen aan inputfeatures op basis van hoe nuttig ze zijn bij het voorspellen van een doelvariabele. Het speelt een cruciale rol bij het begrijpen van de onderliggende datastructuur, het gedrag van het model en het beter interpreteerbaar maken van het model.

Er zijn verschillende methoden om feature importance te bepalen:

- Modelgebaseerde importantie: Sommige algoritmen zoals Decision Trees en Random Forests bieden ingebouwde methoden om feature importance te evalueren. Random Forests berekenen bijvoorbeeld de afname in knoop-onzuiverheid, gewogen naar de kans om die knoop te bereiken, gemiddeld over alle bomen.

- Permutatie-importance: Dit houdt in dat individuele variabelen in de validatieset worden doorgeschud en het effect op de modelprestatie wordt geobserveerd. Een sterke afname in prestatie duidt op hoge importantie.

- SHAP (SHapley Additive exPlanations): Deze benadering gebruikt speltheorie om de bijdrage van elke feature aan de predictie in een complex model te meten. SHAP-waarden geven diepgaand inzicht in het modelgedrag en zijn bijzonder nuttig voor complexe modellen zoals gradient boosting-machines of neurale netwerken.

- Correlatiecoëfficiënten: Eenvoudige statistische maten zoals Pearson of Spearman kunnen inzicht geven in de lineaire relatie tussen elke feature en de doelvariabele.

Het begrijpen van feature importance is essentieel voor modeloptimalisatie, het verminderen van overfitting door niet-informatieve features te verwijderen en het verbeteren van de interpretatie van het model, vooral in domeinen waar inzicht in het beslissingsproces van het model cruciaal is.

Wat is overfitting in machine learning en hoe kun je het voorkomen?

Overfitting treedt op wanneer een model goed presteert op trainingsdata, maar niet generaliseert naar onzichtbare data omdat het de trainingsdata heeft gememoriseerd in plaats van de onderliggende patronen te leren. Je kunt het voorkomen door:

- Cross-validatietechnieken te gebruiken.

- Regularisatie toe te passen (L1, L2).

- De modelcomplexiteit te verminderen.

- Meer trainingsdata te verzamelen of data-augmentatie te gebruiken.

Wat is het verschil tussen supervised en unsupervised learning?

- Supervised learning: Het model wordt getraind op gelabelde data, waarbij de doelvariabele bekend is. Voorbeelden zijn classificatie en regressie.

- Unsupervised learning: Het model wordt getraind op ongelabelde data om patronen of groeperingen te vinden. Voorbeelden zijn clustering en dimensionale reductie.

Wat is een confusion matrix en waarom is die nuttig?

Een confusion matrix is een tabel die wordt gebruikt om de prestaties van een classificatiemodel te evalueren. Hij toont het aantal true positives, true negatives, false positives en false negatives. Hij is nuttig voor het berekenen van metrics zoals accuracy, precision, recall en F1-score.

Wat is het verschil tussen parametrische en niet-parametrische modellen?

Parametrische modellen: Deze doen aannames over de onderliggende dataverdeling en hebben een vast aantal parameters (bijv. lineaire regressie).

Niet-parametrische modellen: Deze doen geen aannames over de dataverdeling en kunnen zich aanpassen aan complexiteit naarmate er meer data bijkomt (bijv. K-Nearest Neighbors).

Wat is de bias-variance trade-off in machine learning?

De bias-variance trade-off verwijst naar de balans tussen het vermogen van een model om complexe patronen te vangen (lage bias) en zijn gevoeligheid voor fluctuaties in de trainingsdata (lage variantie). Een goed model bereikt een balans door zowel bias als variantie te minimaliseren om underfitting en overfitting te vermijden.

Technische interviewvragen over machine learning

Het technische interview gaat meer over het beoordelen van je kennis van processen en hoe goed je bent toegerust om met onzekerheid om te gaan. De hiring manager zal vragen stellen over dataverwerking, modeltraining en -validatie en geavanceerde algoritmen.

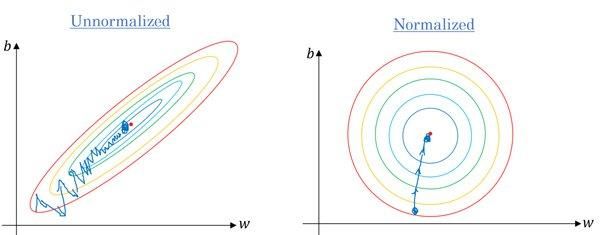

Klopt het dat we onze featurewaarden moeten schalen als ze sterk variëren?

Ja. De meeste algoritmen gebruiken de euclidische afstand tussen datapunten, en als de featurewaarden sterk variëren, zullen de resultaten behoorlijk verschillen. In de meeste gevallen zorgen uitschieters ervoor dat machine-learningmodellen slechter presteren op de testdataset.

We gebruiken ook feature scaling om de convergentietijd te verkorten. Het duurt langer voor gradient descent om lokale minima te bereiken wanneer features niet genormaliseerd zijn.

Gradiënt zonder en met schaling | Quora

Vaardigheden in feature engineering zijn zeer gewild. Je kunt alles over het onderwerp leren met een DataCamp-cursus, zoals Feature Engineering for Machine Learning in Python.

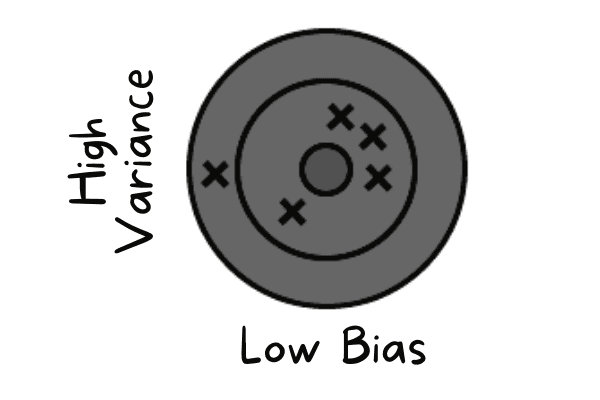

Het model dat je hebt getraind heeft een lage bias en hoge variantie. Hoe pak je dat aan?

Lage bias treedt op wanneer het model waarden voorspelt die dicht bij de werkelijke waarde liggen. Het imiteert de trainingsdataset. Het model heeft geen generalisatie, wat betekent dat het bij testen op onzichtbare data slecht zal presteren.

Lage bias en hoge variantie | Auteur

Om deze problemen op te lossen, gebruiken we bagging-algoritmen, omdat die een dataset opdelen in subsets met gerandomiseerde sampling. Vervolgens genereren we sets modellen met behulp van deze samples met één enkel algoritme. Daarna combineren we de modelvoorspellingen met voting-classificatie of middelen.

Voor hoge variantie kunnen we regularisatietechnieken gebruiken. Die bestraffen hogere modelcoëfficiënten om de modelcomplexiteit te verlagen. Verder kunnen we de topfeatures selecteren uit de feature-importancegrafiek en het model daarmee trainen.

Wat is model drift en hoe detecteer je dit in productie?

Model drift treedt op wanneer de prestaties van een model in de loop van de tijd achteruitgaan omdat de data in de echte wereld verandert ten opzichte van de trainingsdata. Er zijn twee hoofdtypen:

- Data drift (covariateshift): De inputdataverdeling verandert (bijv. gebruikers uploaden 's nachts in plaats van overdag afbeeldingen). Je detecteert dit door de statistische afstand (zoals KL-divergentie) tussen featureverdelingen in training en productie te monitoren.

- Concept drift: De relatie tussen inputs en outputs verandert (bijv. de definitie van "spam" verandert in de tijd). Je detecteert dit door downstream businessmetrics (zoals click-through rate) te monitoren of de ground-truth-nauwkeurigheid als die beschikbaar is.

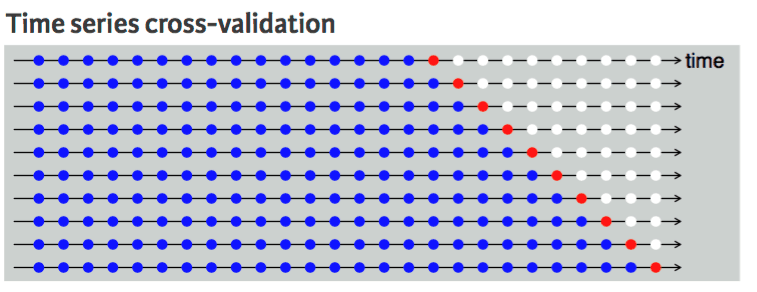

Welke cross-validatietechniek raad je aan voor een tijdreeksdataset en waarom?

Cross-validatie wordt gebruikt om de modelprestatie robuust te evalueren en overfitting te voorkomen. In het algemeen kiezen cross-validatietechnieken willekeurig samples uit de data en splitsen die in train- en testsets. Het aantal splits is gebaseerd op de K-waarde.

Bijvoorbeeld, als K = 5, zijn er vier folds voor training en één voor testen. Dit wordt vijf keer herhaald om te meten hoe het model op afzonderlijke folds presteerde.

Dit kan niet bij een tijdreeksdataset, omdat het niet logisch is om een waarde uit de toekomst te gebruiken om een waarde uit het verleden te voorspellen. Er is temporele afhankelijkheid tussen observaties, en we kunnen de data slechts in één richting splitsen zodat de waarden in de testdataset na de trainingsset liggen.

Het diagram toont dat k-fold-splitsing voor tijdreeksen unidirectioneel is. De blauwe punten zijn de trainingsset, het rode punt is de testset en wit is ongebruikte data. We zien dat we bij elke iteratie vooruit schuiven met de trainingsset, terwijl de testset vóór de trainingsset blijft en niet willekeurig is geselecteerd.

Cross-validatie voor tijdreeksen | UC Business Analytics R Programming Guide

Leer over manipulatie, analyse, visualisatie en modellering van tijdreeksdata met Time Series with Python.

Interviewvragen voor computer vision-engineering

De meeste machine-learningbanen op LinkedIn, Glassdoor en Indeed zijn rolspecifiek. Tijdens het gesprek ligt de focus dan ook op rolspecifieke vragen. Voor de rol van computer vision engineer zal de hiring manager focussen op vragen over beeldverwerking.

Waarom kunnen inputs bij computer vision-problemen enorm worden? Leg uit met een voorbeeld.

Stel je een afbeelding voor van 250 X 250 en een volledig verbonden eerste verborgen laag met 1000 verborgen units. Voor deze afbeelding zijn de inputfeatures 250 X 250 X 3 = 187.500, en de gewichtenmatrix in de eerste verborgen laag is een matrix van 187.500 X 1000. Deze aantallen zijn enorm voor opslag en berekening, en om dit probleem te bestrijden gebruiken we convolutieoperaties.

Leer beeldverwerking met een korte cursus Image Processing in Python

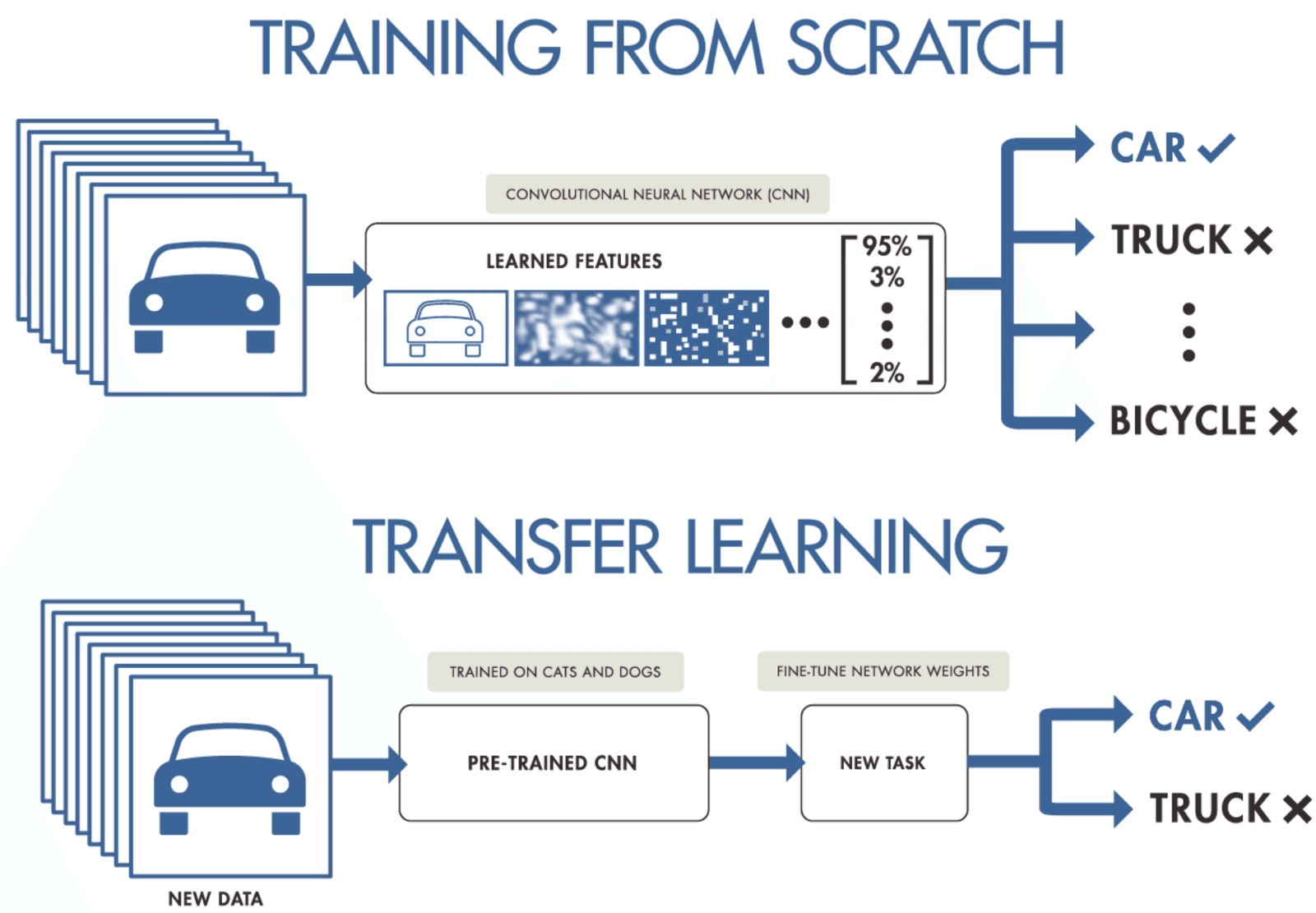

Welke aanpak gebruik je om een convolutioneel neuraal netwerk te trainen als je een kleine dataset hebt?

Als je niet genoeg data hebt om een convolutioneel neuraal netwerk te trainen, kun je transfer learning gebruiken om je model te trainen en resultaten op state-of-the-art-niveau te behalen. Je hebt een voorgetraind model nodig dat is getraind op een algemene maar grotere dataset. Daarna finetune je het op nieuwere data door de laatste lagen van de modellen te trainen.

Transfer learning stelt data scientists in staat om modellen op kleinere data te trainen met minder resources, rekenkracht en opslag. Je vindt eenvoudig open-source voorgetrainde modellen voor diverse usecases, en de meeste hebben een commerciële licentie, wat betekent dat je ze kunt gebruiken om je applicatie te bouwen.

Transfer learning door purnasai gudikandula

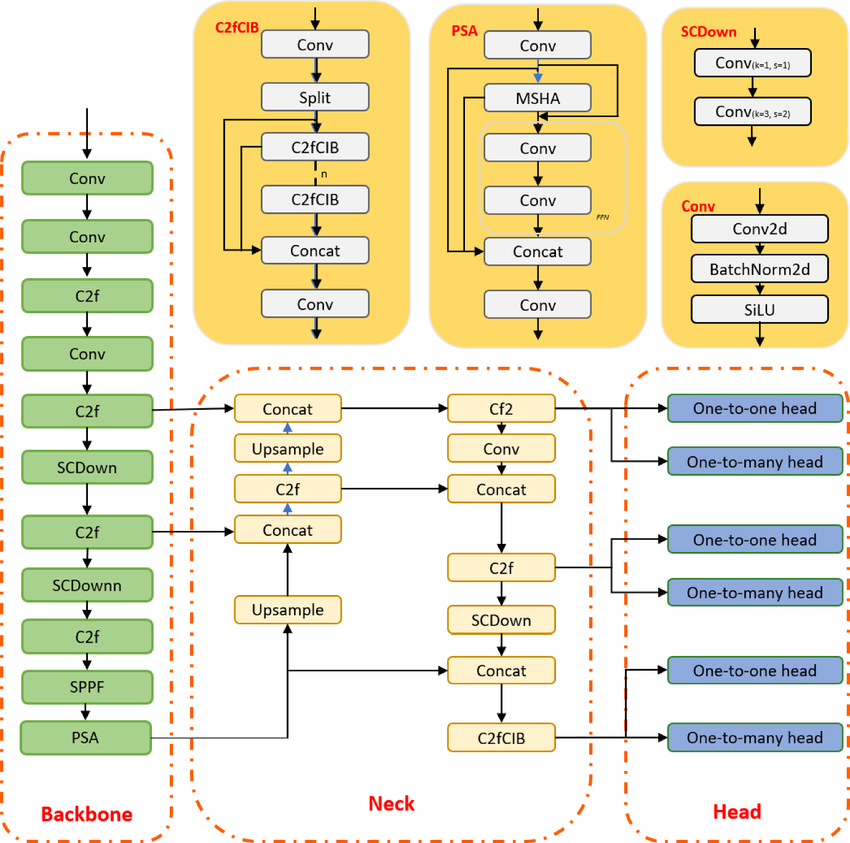

Wat is het state-of-the-art objectdetectie-algoritme YOLO, en hoe is de architectuur recent geëvolueerd?

YOLO is een objectdetectie-algoritme op basis van convolutionele neurale netwerken en kan realtime resultaten leveren. Het YOLO-algoritme vereist één forward pass door een CNN om het object te herkennen. Het voorspelt zowel verschillende klassewaarschijnlijkheden als begrenzingsvakken.

Het model is getraind om verschillende objecten te detecteren, en bedrijven gebruiken transfer learning om het te finetunen op nieuwe data voor moderne toepassingen zoals autonoom rijden, natuurbehoud en beveiliging.

YOLOv10-modelarchitectuur | researchgate

NLP-engineering interviewvragen

Natural Language Processing (NLP) is een van de pijlers van moderne AI-toepassingen. Verwacht vragen die de kloof overbruggen tussen taalkundige theorie en praktische implementatie, waarbij je vermogen wordt getest om ongestructureerde tekstdata te verwerken, analyseren en er betekenis uit te halen met zowel klassieke technieken als moderne deep-learningbenaderingen.

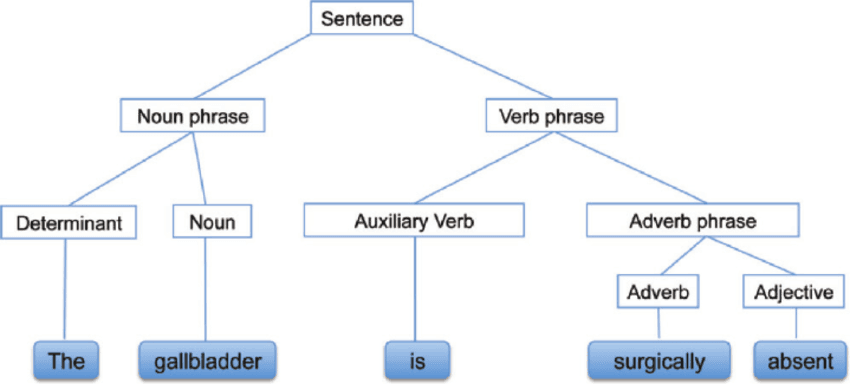

Wat is syntactische analyse?

Syntactische analyse, ook wel syntaxanalyse of parsing genoemd, is een tekstanalyse die ons de logische betekenis achter de zin of een deel van de zin geeft. Ze richt zich op de relatie tussen woorden en de grammaticale structuur van zinnen. Je kunt ook zeggen dat het het verwerken van natuurlijke taal is met behulp van grammaticale regels.

Syntactische analyse | researchgate

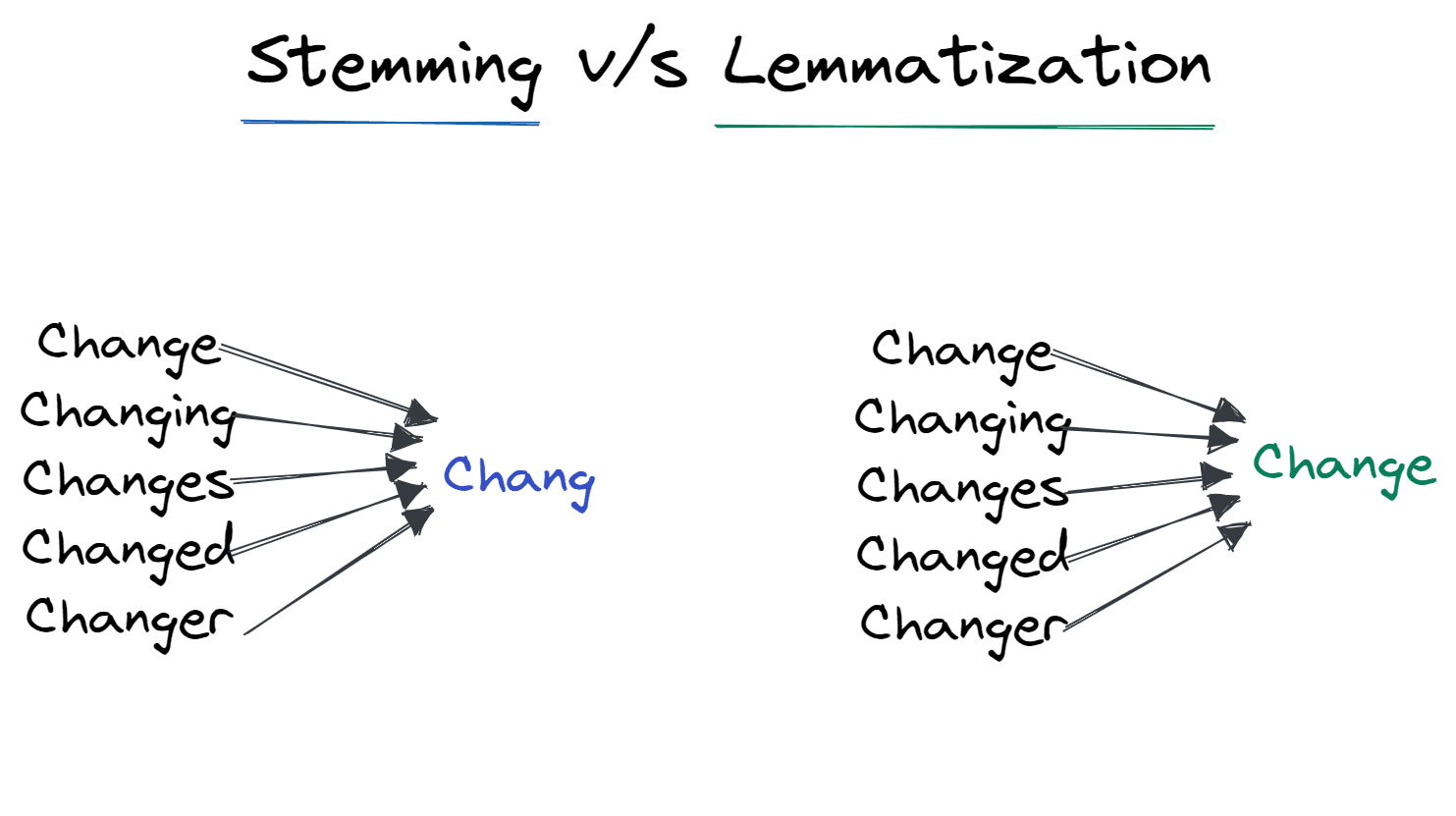

Wat zijn stemming en lemmatisering?

Stemming en lemmatisering zijn normalisatietechnieken die worden gebruikt om de structurele variatie van woorden in een zin te minimaliseren.

Stemming verwijdert de affixen die aan het woord zijn toegevoegd en laat het in stamvorm achter. Bijvoorbeeld: Changing naar Chang.

Het wordt veel gebruikt door zoekmachines voor opslagoptimalisatie. In plaats van alle vormen van de woorden op te slaan, slaan ze alleen de stammen op.

Lemmatisering zet het woord om naar zijn lemma. De output is het grondwoord in plaats van het stamwoord. Na lemmatisering krijgen we een geldig woord dat betekenis heeft. Bijvoorbeeld: Changing naar Change.

Stemming vs. lemmatisering | Auteur

Wat zijn moderne technieken om de inferentiesnelheid van LLM's in productie te optimaliseren?

Het optimaliseren van grote transformers vereist het aanpakken van zowel geheugenbandbreedte- als rekenknelpunten:

- Kwantisatie: Modelgewichten terugbrengen van FP16 (16-bit) naar INT8 of INT4 met minimaal accuraatsheidsverlies. Zo passen grotere modellen in kleinere GPU-geheugens.

- PagedAttention (vLLM): Een geheugentechniek die de KV-cache (Key-Value) behandelt als virtuele geheugensjablonen, waardoor 2-4x hogere throughput mogelijk is door geheugensfragmentatie te elimineren.

- Speculatieve decodering: Een klein "draft"-model gebruiken om snel de volgende paar tokens te voorspellen, die vervolgens parallel door het grote model worden geverifieerd. Dit benut het feit dat geheugen I/O vaak trager is dan compute voor losse tokens.

Leer de basis van NLP door de skill track Natural Language Processing in Python te voltooien.

LLM-engineering interviewvragen

Nu LLM's het huidige AI-landschap domineren, geven interviewers de voorkeur aan kandidaten die begrijpen hoe ze deze effectief inzetten. Deze sectie focust op enkele van de grootste praktische engineeringuitdagingen van 2026.

Wat is een contextvenster van een LLM en hoe ga je om met taken die meer context vereisen dan het model in één keer aankan?

Een contextvenster van een LLM is de maximale hoeveelheid tekst (gemeten in tokens) die het model in één keer kan meenemen bij het genereren van een antwoord, en het beperkt direct hoeveel “werkgeheugen” het model effectief heeft.

Zelfs nu grote contextvensters vaker voorkomen, schalen prestatie en kosten niet lineair: lange prompts verhogen de latency en kunnen nog steeds tot betrouwbaarheidsproblemen leiden wanneer de relevante informatie diep in het midden van de context begraven ligt.

In interviews zou ik praktische strategieën uitleggen voor taken met lange documenten:

- Gebruik chunking (splits documenten in semantisch betekenisvolle secties) en haal alleen de meest relevante chunks op voor een gegeven vraag.

- Geef de voorkeur aan Retrieval-Augmented Generation (RAG) wanneer je feitelijke onderbouwing en gerichte retrieval nodig hebt in plaats van elke keer een heel document te sturen, wat kosten kan verlagen en “lost in the middle”-gedrag kan voorkomen.

- Gebruik samenvattingen of hiërarchische notities (samenvatting van secties → samenvatting van samenvattingen) wanneer je een globaal overzicht nodig hebt, en haal vervolgens details op aanvraag op.

Hoe beperk je hallucinaties in Large Language Models?

Hallucinaties treden op wanneer een LLM aannemelijk maar feitelijk onjuiste informatie genereert. In 2026 is mitigatie gelaagd:

- Retrieval-Augmented Generation (RAG): Het model "gronden" door het te dwingen alleen te antwoorden op basis van opgehaalde documenten uit een vertrouwde kennisbank.

- Prompt engineering: Technieken zoals Chain-of-Thought (het model vragen zijn redenering stap voor stap uit te leggen) en Few-Shot Prompting (geverifieerde voorbeelden geven) verlagen fouten aanzienlijk.

- Confidence scoring & self-consistency: Meerdere antwoorden genereren voor dezelfde prompt en de meest consistente kiezen, of het model vragen zijn eigen vertrouwen te beoordelen vóór het antwoord.

- Guardrails: Post-processinglagen implementeren (zoals NeMo Guardrails) om outputs te factchecken aan de hand van gedefinieerde regels voordat ze aan de gebruiker worden getoond.

Wanneer kies je Retrieval-Augmented Generation (RAG) boven fine-tuning?

Dit is een klassiek "trade-off"-vraagstuk. De beslissing hangt af van actualiteit van data en domeinspecificiteit:

- Kies RAG wanneer: Je wilt dat het model toegang heeft tot up-to-date informatie (bijv. aandelenkoersen, recent nieuws) of private data die vaak verandert. RAG is goedkoper en vermindert hallucinaties omdat het het model de exacte context geeft.

- Kies fine-tuning wanneer: Je wilt dat het model een specifieke gedragsstijl, toon of format leert (bijv. praten als een piraat of code schrijven in een propriëtaire interne taal). Fine-tuning bakt kennis in de gewichten maar lost het "knowledge cutoff"-probleem niet op.

- Hybride aanpak: In veel productiesystemen finetune je een model om domeinspecifiek jargon te begrijpen en gebruik je vervolgens RAG om het van de nieuwste feiten te voorzien.

De vraag wordt uitgebreider besproken in onze blog over RAG vs fine-tuning.

Interviewvragen over reinforcement learning-engineering

Reinforcement learning (RL) pakt problemen aan waarbij een agent leert door te interageren met een omgeving in plaats van uit statische datasets. Wees voorbereid om uit te leggen hoe RL werkt en kernconcepten zoals policies te bespreken.

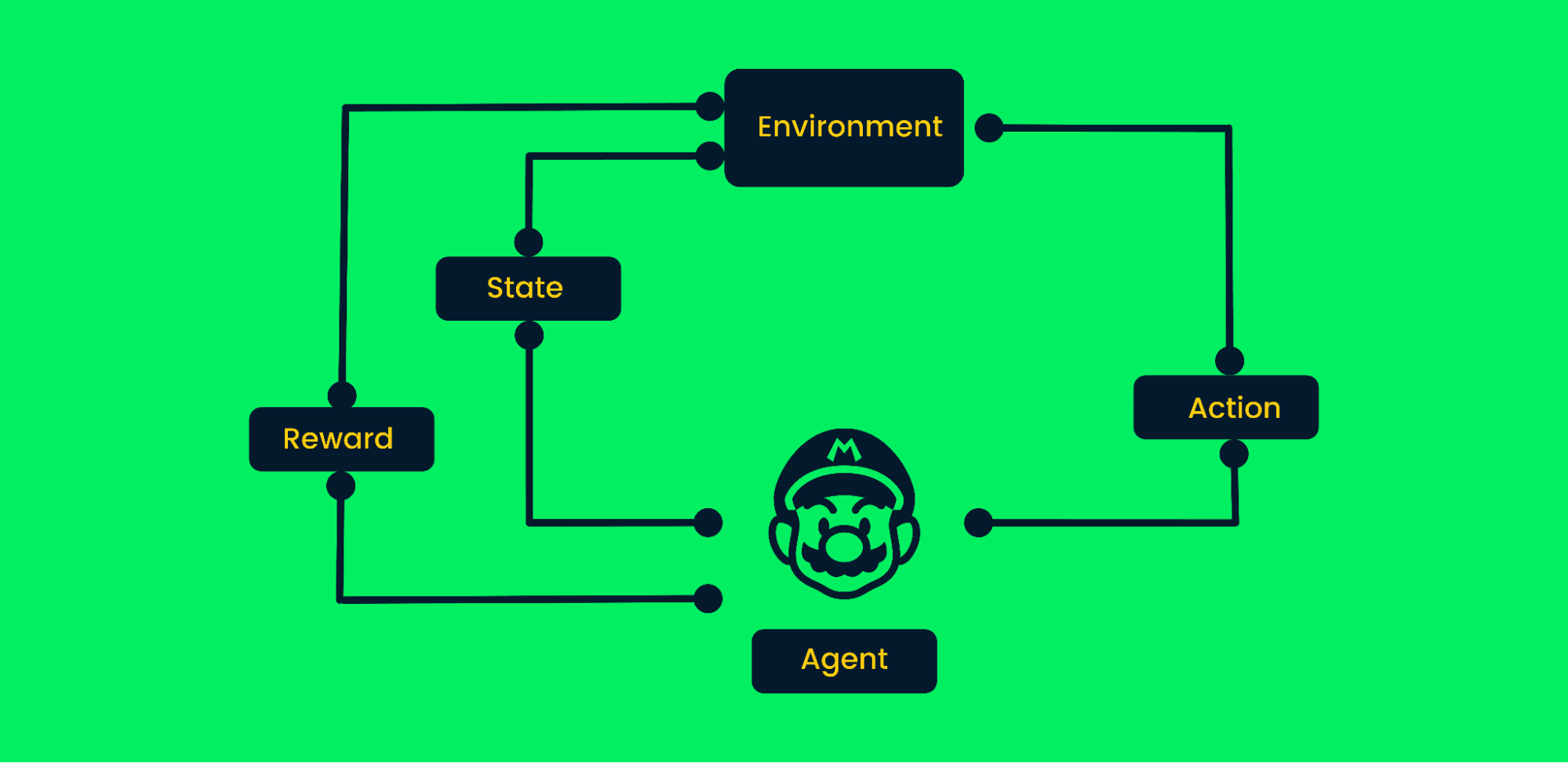

Welke stappen zijn betrokken bij een typisch reinforcement learning-algoritme?

Reinforcement learning gebruikt trial-and-error om doelen te bereiken. Het is een doelgericht algoritme en leert van de omgeving door de juiste stappen te zetten om de cumulatieve beloning te maximaliseren.

In een typisch reinforcement learning-proces:

- Aan het begin ontvangt de agent toestand nul van de omgeving

- Op basis van de toestand onderneemt de agent een actie

- De toestand is veranderd en de agent bevindt zich op een nieuwe plek in de omgeving.

- De agent ontvangt de beloning als hij de juiste stap heeft gezet.

- Het proces herhaalt zich totdat de agent het best mogelijke pad heeft geleerd om het doel te bereiken door de cumulatieve beloningen te maximaliseren.

Reinforcement learning-framework | Auteur

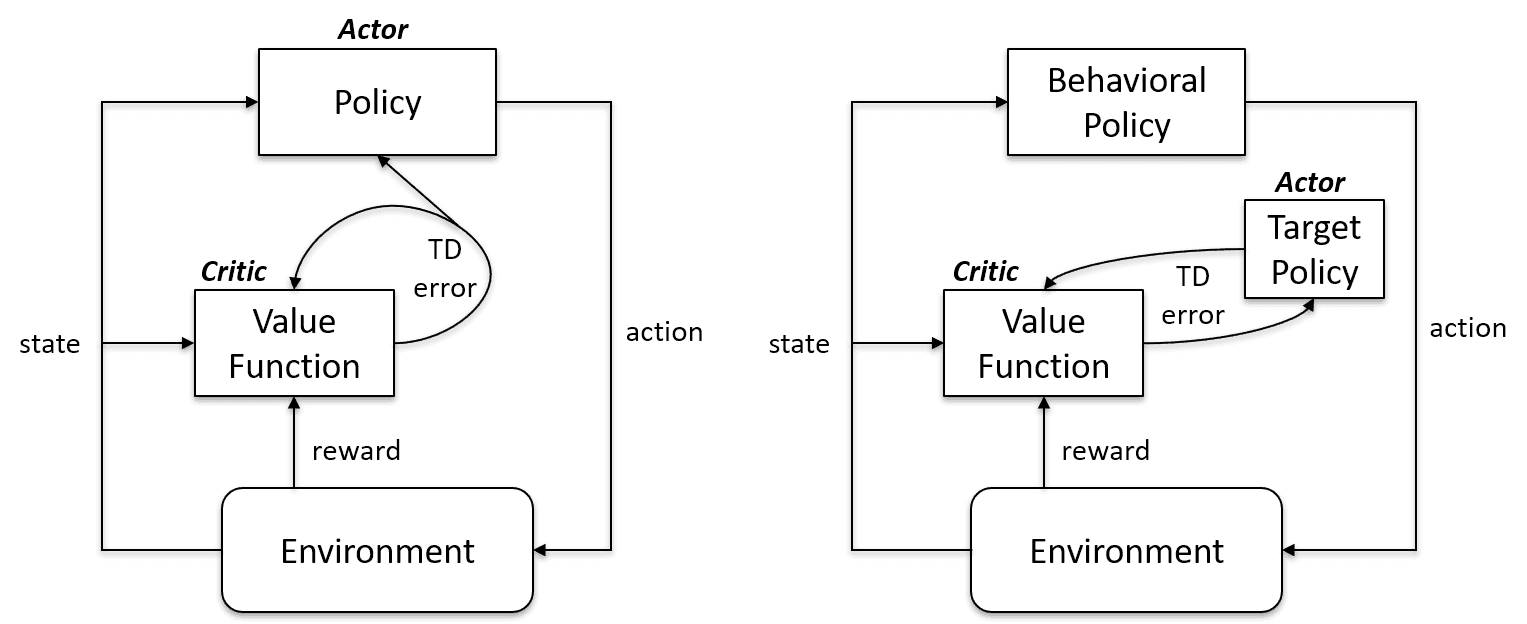

Wat is het verschil tussen off-policy en on-policy learning?

On-policy-leeralgoritmen evalueren en verbeteren hetzelfde beleid om te handelen en bij te werken. Met andere woorden: het beleid dat wordt gebruikt voor het updaten en het beleid dat wordt gebruikt om te handelen zijn hetzelfde.

Target policy == Behavior policy

On-policy-algoritmen zijn Sarsa, Monte Carlo voor on-policy, value iteration en policy iteration

Off-policy-leeralgoritmen zijn volledig anders, omdat het geüpdatete beleid verschilt van het behavior policy. In Q-learning bijvoorbeeld leert de agent van een optimaal beleid met behulp van een greedy policy en onderneemt acties met andere policies.

Target policy != Behavior policy

On-policy vs. off-policy | Artificial Intelligence Stack Exchange

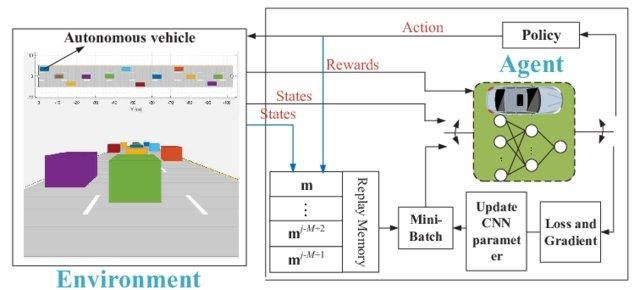

Waarom hebben we “Deep” Q-learning nodig?

Eenvoudig Q-learning is prima. Het lost het probleem op kleinere schaal op, maar faalt op grote schaal.

Stel dat de omgeving 1000 toestanden en 1000 acties per toestand heeft. We hebben dan een Q-tabel van miljoenen cellen nodig. Het spel schaken en Go vereisen een nog grotere tabel. Hier komt deep Q-learning te hulp.

Het gebruikt een neuraal netwerk om de Q-waardefunctie te benaderen. De neurale netwerken nemen toestanden als input en geven de Q-waarde van alle mogelijke acties als output.

Deep Q-netwerk voor autonoom rijden | researchgate

FAANG-vragen voor machine learning engineers

Hieronder hebben we enkele mogelijke vragen uiteengezet die de interviewer je kan stellen bij enkele van de grootste techbedrijven:

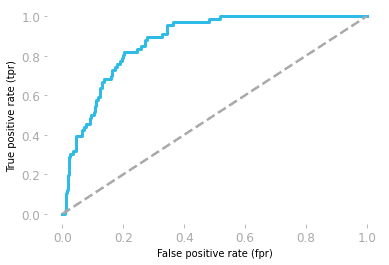

Wat is de interpretatie van het ROC-gebied onder de curve?

Receiver operating characteristics (ROC) tonen de trade-off tussen sensitiviteit en specificiteit.

- Sensitiviteit: de kans dat het model een positieve uitkomst voorspelt wanneer de werkelijke waarde ook positief is.

- Specificiteit: de kans dat het model een negatieve uitkomst voorspelt wanneer de werkelijke waarde ook negatief is.

De curve wordt uitgezet met de false positive rate (FP/(TN + FP)) en true positive rate (TP/(TP + FN))

Het gebied onder de curve (AUC) toont de modelprestatie. Als het gebied onder de ROC-curve 0,5 is, is ons model volledig willekeurig. Een model met AUC dicht bij 1 is beter.

ROC-curve door Hadrien Jean

Hoe evalueer je generatieve AI-modellen waarvoor geen enkele "ground truth" bestaat?

In tegenstelling tot classificatie (waar een antwoord goed of fout is), vereist GenAI vaak menselijke evaluatie of "LLM-as-a-Judge"-frameworks:

- Referentievrije metrics: Een sterker model (zoals GPT-4) gebruiken om het antwoord van een kleiner model te beoordelen op criteria als "behulpzaamheid", "veiligheid" en "coherentie".

- RAGAS (Retrieval Augmented Generation Assessment): Een standaardframework dat specifiek "faithfulness" (komt het antwoord uit de context?) en "answer relevance" (beantwoordde het de vraag van de gebruiker?) meet.

- Menselijke evaluatie (Elo-ratings): Voor eindvalidatie, twee modeloutputs naast elkaar vergelijken (A/B-testen) en een Elo-rating berekenen, vergelijkbaar met het LMArena-leaderboard.

Wat zijn de methoden om dimensionaliteit te reduceren?

Voor dimensionale reductie kunnen we featureselectie of feature-extractiemethoden gebruiken.

Featureselectie is het proces van het kiezen van optimale features en het verwijderen van irrelevante features. We gebruiken filter-, wrapper- en embedded-methoden om feature-importance te analyseren en minder belangrijke features te verwijderen om de modelprestatie te verbeteren.

Feature-extractie transformeert de ruimte met meerdere dimensies naar minder dimensies. Er gaat geen informatie verloren tijdens dit proces en het gebruikt minder resources om de data te verwerken. De meest gangbare extractietechnieken zijn lineaire discriminantanalyse (LDA), kernel-PCA en quadratische discriminantanalyse.

Hoe bepaal je drempels voor een classificator?

In het geval van een spamclassificator geeft een logistische regressie een waarschijnlijkheid terug. We gebruiken ofwel de waarschijnlijkheid van 0,8999 of we zetten die om in een klasse (Spam/Geen spam) met behulp van een drempel.

Meestal is de drempel van een classificator 0,5, maar in sommige gevallen moeten we deze fijn afstellen om de nauwkeurigheid te verbeteren. De drempel van 0,5 betekent dat als de waarschijnlijkheid gelijk is aan of groter is dan 0,5, het spam is, en als deze lager is, het geen spam is.

Om de drempel te vinden, kunnen we precision-recall-curves en ROC-curves gebruiken, grid search en handmatig de waarde aanpassen om een betere CV te krijgen.

Word een professionele machine learning engineer door de Machine Learning Scientist with Python-carrièreroute te voltooien.

Wat zijn de aannames van lineaire regressie?

Lineaire regressie wordt gebruikt om de relatie tussen features (X) en doel (y) te begrijpen. Voordat we het model trainen, moeten we aan een paar aannames voldoen:

- De residuen zijn onafhankelijk

- Er is een lineaire relatie tussen de onafhankelijke variabele X en de afhankelijke variabele y.

- Constante residuvariantie op elk niveau van X

- De residuen zijn normaal verdeeld.

Let op: de residuen in lineaire regressie zijn het verschil tussen werkelijke en voorspelde waarden.

Schrijf een functie find_bigrams die een string neemt en een lijst met alle bigrams retourneert.

Tijdens codeerinterviews krijg je vragen over machine learning, maar in sommige gevallen beoordelen ze je Python-vaardigheden met algemene codeervragen. Word een expert Python-programmeur met de Python Programmer-carrièreroute.

Een bigramfunctie maken is vrij eenvoudig. Je hebt twee lussen nodig met de zip-functie.

- In de bigram-functie nemen we een lijst van de zin als input

- Een lus maken om toegang te krijgen tot een enkele zin

- De zin verlagen naar lowercase en splitsen in een lijst met woorden

zipgebruiken om een combinatie te maken van het vorige woord en het volgende woord- De output toevoegen aan het resultaat

- De resultaten afdrukken.

Het is vrij eenvoudig als je het probleem opdeelt en zip gebruikt.

def bigram(text_list:list):

result = []

for ls in text_list:

words = ls.lower().split()

for bi in zip(words, words[1:]):

result.append(bi)

return result

text = ["Data drives everything", "Get the skills you need for the future of work"]

print(bigram(text))Resultaten:

[('Data', 'drives'), ('drives', 'everything'), ('Get', 'the'), ('the', 'skills'), ('skills', 'you'), ('you', 'need'), ('need', 'for'), ('for', 'the'), ('the', 'future'), ('future', 'of'), ('of', 'work')]Wat is de activatiefunctie in machine learning?

De activatiefunctie is een niet-lineaire transformatie in neurale netwerken. We voeren de input door de activatiefunctie voordat we deze naar de volgende laag sturen.

De netto-invoerwaarde kan variëren van -inf tot +inf, en het neuron weet niet hoe hij de waarden moet begrenzen en kan daardoor het vuurgepatroon niet bepalen. De activatiefunctie bepaalt of een neuron moet worden geactiveerd om de netto-invoerwaarden te begrenzen.

Meest voorkomende typen activatiefuncties:

- Stapfunctie

- Sigmoidfunctie

- ReLU

- Leaky ReLU

Hoe zou je een restaurantaanbeveling op Facebook bouwen?

Het antwoord is helemaal aan jou. Maar voordat je antwoordt, moet je bedenken welk zakelijk doel je wilt bereiken om een prestatiemetric te kiezen en hoe je de data gaat verzamelen.

In een typisch machine-learning-systeemontwerp:

- Verzamelen, opschonen en analyseren we de data.

- Voeren we feature engineering uit

- Kiezen we een methodologie, algoritme of machine-learningmodel

- Train en evalueren we de prestatie op test- en validatiedatasets.

- Stroomlijnen we de processen en zetten we het model in productie.

Je moet ervoor zorgen dat je de focus legt op het ontwerp in plaats van op theorie of modelarchitectuur. Zorg dat je praat over modelinference en hoe het verbeteren daarvan de totale opbrengsten verhoogt.

Geef ook een overzicht van waarom je een bepaalde methodologie boven een andere hebt gekozen.

Leer meer over het bouwen van recommendsystemen met een DataCamp-cursus.

Gegeven twee strings A en B, schrijf een functie can_shift die teruggeeft of A een aantal plaatsen kan worden verschoven om B te krijgen.

Het oplossen van codeeruitdagingen en werken aan je Python-vaardigheden vergroot je kans om de codeerfase van het interview te halen.

Voordat je begint met oplossen, moet je de vraag begrijpen. Je moet simpelweg een booleaanse functie maken die True retourneert als je door de letters in string B te verschuiven string A krijgt.

A = 'abid'

B = 'bida'

can_shift(A, B) == True- Geef false terug als de lengte van de strings niet gelijk is.

- Loop over het bereik van de lengte van string A

- Maak mut_a om verschillende combinaties van karakters te maken met string A

- Als mut_a tijdens de lus gelijk is aan string B, retourneer True, anders False.

def can_shift(a, b):

if len(a) != len(b):

return False

for i in range(len(a)):

mut_a = a[i:] + a[:i]

if mut_a == b:

return True

return False

A = 'abid'

B = 'bida'

print(can_shift(A, B))

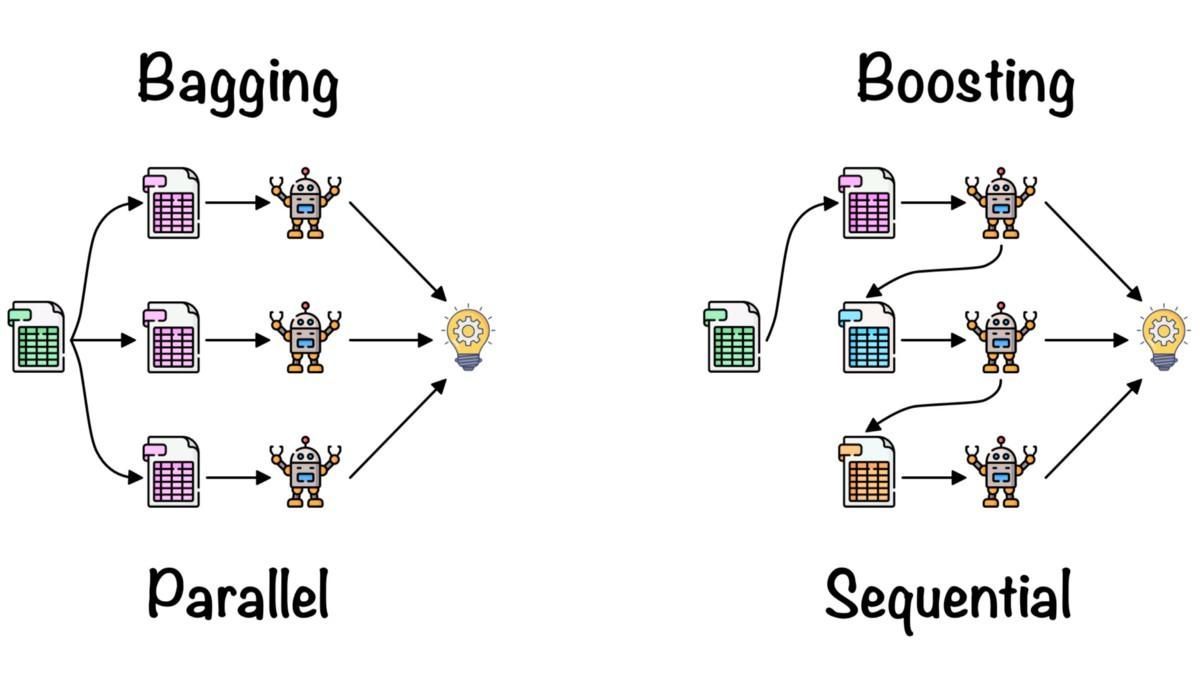

>>> TrueWat is ensemble learning?

Ensemble learning wordt gebruikt om de inzichten van meerdere machine-learningmodellen te combineren om de nauwkeurigheid en prestatiemetrics te verbeteren.

Eenvoudige ensemblemethoden:

- Gemiddelde/mean: we middelen de voorspellingen van meerdere sterk presterende modellen.

- Gewogen gemiddelde: we kennen verschillende gewichten toe aan modellen op basis van de prestatie en combineren ze vervolgens.

Geavanceerde ensemblemethoden:

- Bagging wordt gebruikt om variantiefouten te minimaliseren. Het maakt willekeurig subsets van trainingsdata en traint die op modellen. De combinatie van modellen verlaagt de variantie en maakt het betrouwbaarder dan een enkel model.

- Boosting wordt gebruikt om biasfouten te verminderen en superieure predictieve modellen te produceren. Het is een iteratieve ensemblemethode die de gewichten aanpast op basis van de laatste classificatie. Boosting-algoritmen geven meer gewicht aan observaties die het vorige model onjuist voorspelde.

Bagging en boosting door Fernando López

Leer meer over middelen, bagging, stacking en boosting met de cursus Ensemble Methods in Python.

Conclusie

Nu we onze verkenning van essentiële vragen voor sollicitaties over machine learning afronden, is het duidelijk dat succes in zulke gesprekken een mix vereist van theoretische kennis, praktische vaardigheden en bewustzijn van de nieuwste trends en technologieën in het veld. Van het begrijpen van basisconcepten zoals semi-supervised learning en algoritmekeuze, tot het verdiepen in de complexiteit van specifieke algoritmen zoals KNN, en het aangaan van rolspecifieke uitdagingen in NLP, computer vision of reinforcement learning: de reikwijdte is groot.

Of je nu een beginner bent die het veld wil betreden of een ervaren professional die verder wil groeien, continu leren en oefenen is de sleutel. DataCamp biedt een uitgebreide Machine Learning Scientist with Python-route die een gestructureerde en diepgaande manier biedt om je vaardigheden te verbeteren.

FAQs

Hoe ziet een sollicitatiegesprek voor machine learning eruit?

Technische interviews voor machine learning zijn doorgaans opgedeeld in meerdere onderdelen:

- Codeerinterview

- Algoritmen en dataverwerking

- Rolspecifiek interview

- ML-systeemontwerpinterview

- Machine learning operations en best practices

De niet-technische of on-site interviews maken ook deel uit van het sollicitatieproces voor machine learning, maar die zijn algemener en bedrijfsspecifiek.

Is het makkelijk om sollicitaties voor machine learning bij Amazon te halen?

Nee, je moet je voorbereiden op verschillende fasen van het gesprek. Je moet je voorbereiden op een online assessment, een telefoonscreening door de recruiter, een technische telefoonscreening en het on-site gesprek. Elke fase test je vaardigheden en kennis.

Hebben machine learning engineers codeerinterviews?

Ja. Het zal je probleemoplossende vaardigheden in Python en je SQL-data-analysevaardigheden testen. Bovendien krijg je vragen over machine-learningtools. Het is beter om te oefenen met coderen door codeeruitdagingen te doen, zoals DataCamp-toetsen.

Wat zijn de belangrijkste taken van een AI/ML-engineer?

Over het algemeen onderzoeken, ontwerpen en ontwikkelen AI/ML-engineers machine-learningsystemen, maar het varieert per baan en per bedrijf.

Bovendien:

- Ze schonen data op, voeren datavalidatie uit en verrijken data voor modeltraining.

- Ze stemmen de modelarchitectuur en hyperparameters af voor betere resultaten.

- Ze begrijpen het bedrijf en de beschikbaarheid van data.

- Prestatiemetrics, algoritmen en uitrolstrategie.

- Soms zijn ze ook betrokken bij cloud computing en development operations.

Hoe bereid ik me voor op een sollicitatiegesprek over machine learning?

Leer over het bedrijf en de functieverantwoordelijkheden, los codeeruitdagingen op, bekijk eerdere projecten, ontwerp en leer over de end-to-end-levenscyclus van machine learning, oefen met mock-interviewvragen en lees over de laatste ontwikkelingen op het gebied van AI/ML. Dit is belangrijk, of je nu net machine learning engineer wordt, of dat je al jaren professioneel werkt met machine learning.