Program

Yeni kurumsal yapay zeka paradoksu şu: Eylemi yapay zeka aracılarına ne kadar çok devredersek, kendi irademizi o kadar kaybederiz. Aracı çağında darboğaz üretim değil, değerlendirme ve güvendir.

Öncelikle insan yargımızı destekleyen yapay zeka sistemlerine alıştık. Çoğu durumda, bu sistemlerin insan yargımızı ve önyargılarımızı onaylamasına ve onları anlamlı biçimde sorgulamamasına da alıştık. Metin üretir, bilgiyi özetler veya bize öneriler sunarlar.

Yine de karar verici ve onaylayıcı insan olarak kalıyordu.

Yapay zeka aracıları bunu değiştirdi. Aracı sistemler yalnızca öneri üretmez; karmaşık kurumsal ekosistemlerde planlamak, karar vermek ve eyleme geçmek üzere tasarlanmıştır.

İş akışlarını tetikler, API çağırır, para hareket ettirir ve kayıtları güncellerler. İnsan onayını beklemeden süreçleri başlatırlar. Bu, kurumsal risk manzarasını değiştirir.

Sorun şu ki aracı sistemler eyleme geçtiğinde sonuçlar maliyetli olabilir. Bir aracının 300 bin dolarlık tedarik hatası yaptığında, “kararı araç verdi” artık geçerli bir savunma değildir. İş açısından kayıp gerçektir ve birinin hesap vermesi gerekir. Sorumluluğunuz, aracı eyleme geçti diye ortadan kalkmaz.

Kurumlar özerk aracıların hızını, ölçeğini ve verimliliğini ister, ancak hesap verebilirlik otomatikleştirilemez. Eylemi bir aracıya devretmek, sorumluluğu devretmek anlamına gelmez.

Merkezi soru şu: Aracı yapay zekayı irademizden vazgeçmeden nasıl ölçeklendiririz?

Yardımcı Yapay Zekadan Aracı Yapay Zekaya

Buna yanıt vermek için yardımcı yapay zeka ile aracı yapay zekayı ayırt etmeliyiz.

- Yardımcı yapay zeka varsayılan olarak döngüde insanla çalışır. Bir öneri sunar; siz “kabul et”e tıklarsınız. Asıl sahip yine insandır.

- Aracı yapay zeka planlamadan iş akışlarını yürütmeye ve bağımsız dağıtıma kadar tüm süreci devralır. Aracılar veritabanlarında gezinir, API’lerle arayüz kurar ve bir hedefe ulaşmak için kendi kararlarını verir.

Fark, kontrol düzeyindedir. Yardımcı sistemlerde irade açıkça insandadır. Yetki ve hesap verebilirlik daha çok örtüşür; insanlar karar verir, sistemler destekler. Ancak aracı sistemlerde sistem eyleme geçer, nihai hesap verebilirlik ise insanda kalır.

Paradoks burada derinleşir.

Özerklik arttıkça sürekli insan gözetimi (döngüde insan) uygulanamaz hale gelir. Ancak gözetimi azaltmak, politika ihlalleri, hatalar ve istem dışı sonuçlar gibi risklere maruziyeti artırır. Aracıları aşırı kısıtlamak ise özerkliği teorik kılar; ölçek ve verimlilikten yararlanamayız.

Asıl Darboğaz: Değerlendirme

Ölçekli otomasyon vaat eden tedarikçilerin sayısı çok. Aracılar planlar üretir, karar verir ve herhangi bir insan ekibinden daha hızlı eyleme geçer.

Ancak aracıların eyleme geçtiği noktada kurumların yeni bir sorusu olur: Bu eylemlerin doğru, güvenli ve politikalarımızla uyumlu olduğunu nasıl bileceğiz?

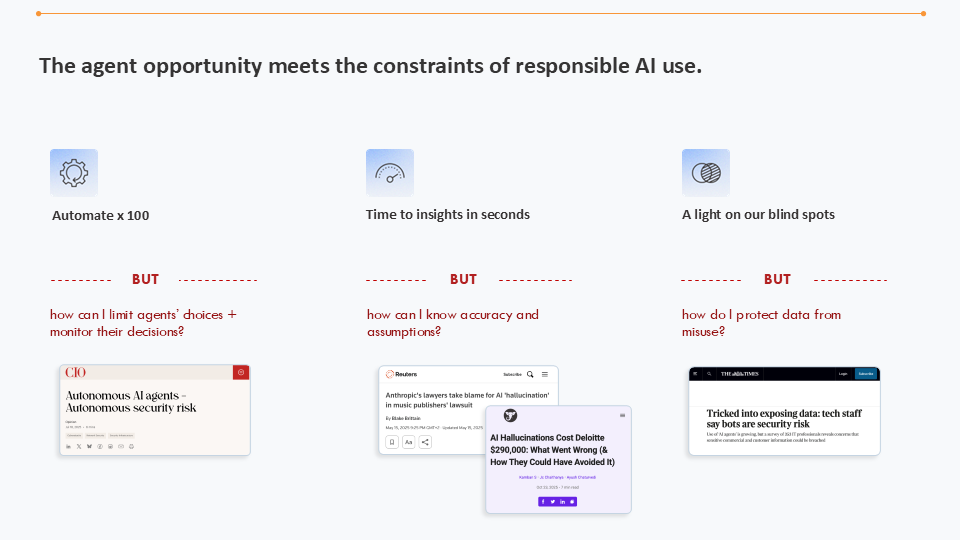

Aracı fırsatları sorumlu yapay zeka kullanımının kısıtlarıyla karşılaştığında ne olur

Buradaki yaygın içgüdü onay adımları eklemektir: İmzayı atacak bir gözden geçirici ve istisnaları tırmandırma. Ancak geleneksel “döngüde insan” yaklaşımı ölçekta bozulur.

Sürekli çalışan bir aracı günde yüzlerce, hatta binlerce karar verebilir. Her eylem elle değerlendirilecekse, nihai “ispat işi” başlangıçtaki zaman tasarrufunu aşar. Yürütmeyi otomatikleştirir, değerlendirmede yeni bir darboğaz yaratırız.

Bir karmaşa daha var. Bir aracının aldığı eylemlerin doğru, güvenli ve emniyetli olup olmadığını değerlendiririz. Peki ya “hayır” demek? Sistem ne zaman eyleme geçmemesi gerektiğini biliyor mu?

Bu, aracı yapay zekanın en büyük sorunlarından biri olabilir: Faydalı bir aracı politika çakışmalarını saptayabilmeli ve “Bunu yapamam” ya da “Bunu bir insana iletmem gerek” diyebilmelidir. Bu yetenek olmadan aracı, eyleme geçip geçmemesi gerektiğine bakmadan çıktı üreten bir makineye dönüşür.

Ölçekte bu davranış bir yükümlülüğe dönüşür.

Bu bizi yeniden paradoksa getirir.

İnsanlar her şeyi gözden geçiremiyorsa ve aracıların kendi sınırlarını güvenilir biçimde değerlendirmesi mümkün değilse, değerlendirme dağıtımdan sonra eklenen gayriresmî bir katman olarak kalamaz. Sistemlerin içine tasarlanması gerekir

Değerlendirme, Sonradan Düşünülmüş Elle İş Değil, Altyapı Olmalı

Mesele, değerlendirme gerekip gerekmediği değil, nasıl uygulandığıdır.

KNIME’da bunu pratikte gördük. Bir vakada, veri içgörülerinden eylemler üreten bir aracı inşa ettik. İşimizi ciddi biçimde hızlandırdı ancak neredeyse her içgörüyü sorgular hale geldik. Aracılara körü körüne güvenmemeliyiz, fakat ölçeklemek için güvenin var olması gerekir.

Dönüm noktası, geri bildirimi iş akışına entegre ettiğimizde geldi. Her “başarısızlığı” etiketleyip belirleyerek aracı, döngüdeki biz insanlardan öğrenip gelişti. Zamanla aracı iyileşti ve güven arttı.

Buradaki dersimiz şu oldu: Güveni sisteme inşa etmek gerekir; değerlendirme ve geri bildirim bir ek süreç değil, sistemin parçası olmalıdır.

Hedef: Yönetişimli Özerklik

Hedef sınırsız özerklik ya da kalıcı insan gözetimi değil; sistemlerin açıkça tanımlanmış sınırlar içinde bağımsız hareket ettiği “yönetişimli özerklik”tir.

Platformlarımız, aracı yanlışsa ne olacağı, kaç hatanın kabul edilebilir olduğu ve başarısızlığın maliyeti ile otomasyonun faydasının nasıl dengeleneceği gibi durumlara yanıt vermelidir.

Yönetişimli özerklik, kuruluşların önceden şunları tanımlamasını gerektirir:

|

Açık güvenlik şeritleri ve kısıtlar |

Örneğin, bir aracının müdahale olmaksızın hangi koşullarda eyleme geçebileceği |

|

Tanımlı hata tolerans düzeyleri |

Örneğin, özerk yürütme için gerekli güven eşiği |

|

Kademeli yaygınlaştırma stratejileri |

Örneğin, başlangıç aşamasında aracıların öğrenip gelişebileceği yüksek düzeyde insan incelemesi bulunur |

Bir aracı, tanımlı bir kesinlik düzeyinin üzerinde özerk çalışabilir. Bu eşiğin altında ise insan incelemesine başvurması gerekir. Zamanla güven ve performans arttıkça, hata oranları azaldıkça bu eşikler uyarlanabilir, ancak tırmandırma mekanizması yerinde kalır.

Önemlisi, insanın geçersiz kılma yetkisi her zaman mümkün olmalıdır. Özerklik rutin müdahaleyi azaltmalı, ancak ortadan kaldırmamalıdır.

Bu yaklaşım paradoksu yeniden çerçeveler: İrade devredildiğinde kaybolmaz; güvenlik şeritleri çerçevesinde kullanılır.

Güvenlik Şeridi Çerçevesini Tasarlamak

Aracı sistemlerde güvenin daha iyi modellerden değil, daha iyi çerçevelerden geleceğine inanıyorum.

Kuruluşların, sistem altyapısının parçası olan bir güvenlik şeridi çerçevesine ihtiyacı var. Bu çerçeve, aracıları yetkilendirir ama onları deterministik mantığa bağlı tutar.

Sağlam bir kurumsal çerçeve şunları içermelidir:

1. İş akışlarına entegre açık güvenlik şeritleri

Aracılar bir sonraki eylemlerini belirlemek için yalnızca veriye güvenmemelidir. Kuruluşun düzenleyici, finansal ve organizasyonel politikalarıyla uyumlu, önceden tanımlanmış kural ve kısıtlar içinde çalışmalıdırlar.

Bu kural ve kısıtların iş akışlarına entegre edilmesi gerekir. Böylece politikalar uygulanabilir hale gelir.

2. Aracıların nasıl inşa ettiğine dair tam görünürlük ve denetlenebilirlik

Kuruluşların, kararların nasıl kurulduğu ve yürütüldüğüne dair izlenebilirliğe ihtiyacı vardır.

Sadece aracının sonucunu görmek yetmez; kuruluşlar onun “düşünme” sürecini – akıl yürütme yolunu, araç kullanımını ve veri kaynaklarını – inceleyebilmelidir.

Bu, bir kararın neden alındığını açıklayan bir denetim izi sağlar. Hesap verebilirlik yaratır, düzenleyici uyumu destekler ve olay sonrası analizi mümkün kılar.

3. Deterministik araçlar

Aracılar, deterministik mantığın zaten var olduğu alanlarda doğaçlama yapmamalıdır.

Bir aracının her seferinde karmaşık bir vergi marjını nasıl hesaplayacağını tahmin etmesine izin vermek yerine, o özel hesabı yürütmesi için sabit ve doğrulanmış bir araç (bir “düğüm” ya da alt görev) verin.

Böylece aracı, potansiyel olarak yüksek riskli bağlamlarda belirsiz akıl yürütme üreten biri yerine güvenilir araçların orkestratörüne dönüşür.

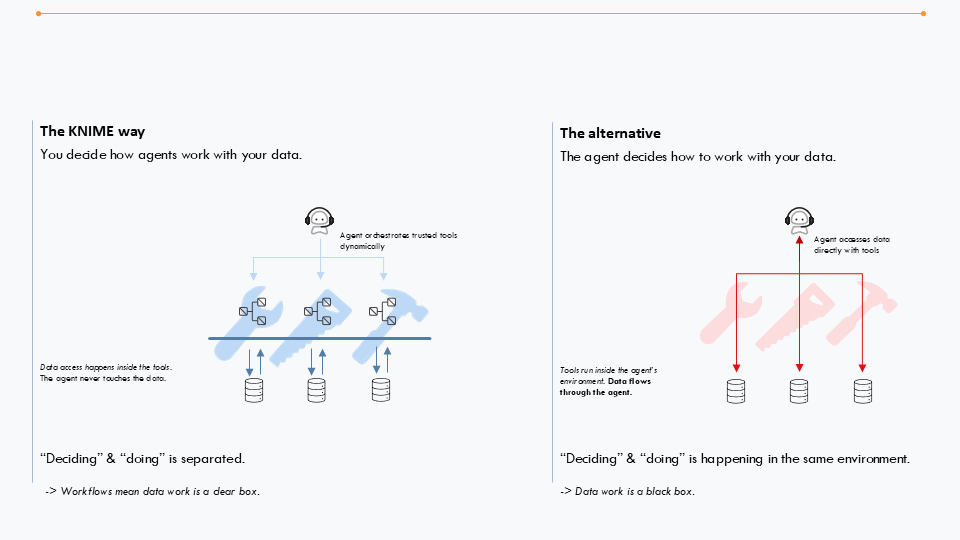

4. Veri erişimi üzerinde kontrol

Derin veri erişimi her zaman gerekli değildir.

Aracılar “gerektiği kadar bil” ilkesine göre veri erişmelidir. Bir destek aracısının görüşme geçmişine ve bilgi tabanına ihtiyacı varken, etkili olmak için muhtemelen bir müşterinin sosyal güvenlik numarasına ihtiyacı yoktur.

5. Geri bildirim döngüleri ve sürekli bakım

Aracı sistemler pilot aşamadan tek adımda özerkliğe geçmemelidir.

Erken aşamalar daha yüksek düzeyde insan incelemesi ve etkin izleme içerebilir. Ancak zamanla performans istikrara kavuşup başarısızlık biçimleri anlaşıldıkça özerklik genişletilebilir.

Sürekli bakım şarttır. Aracılar sürekli bakıma ve optimizasyona ihtiyaç duyar. Veriler kayabilir, eskir; düzenlemeler değişebilir. Aracılar izlenip yeniden ayarlanmazsa yanlış ya da eski bilgilere dayanarak karar verirler.

Mimari Önemlidir

Yönetişimli özerkliği ölçekte uygulamak için kurumun yönetişim katmanı, tekil model ve tedarikçilerin üzerinde konumlanmalı; tedarikçiye bağımlılığı önlemelidir.

Yönetişim, mimari bir katman olarak var olmalı; alttaki yapay zekayı değiştirirken güvenlik şeritlerini korumanıza imkan vermelidir.

Bu bağlamda orkestrasyon, deterministik mantık ve şeffaf yürütmeyi birleştiren platformlar stratejik önemdedir. Kuruluşların, aracıların kurumsal veri ve süreçlerle nasıl etkileşeceğine karar vermesini sağlarlar.

Daha iyi modellerin otomatik olarak daha iyi kararlara yol açtığı yönünde bir yanlış kanı var. En zararlı olaylar model hatalarına değil, sorumluluğu tasarlamadan sorumluluk devreden insanlara dayanacaktır. Kontrol modelde değil, sistemdedir.

KNIME, aracı geliştirmede en iyi uygulamaları izler ve aracının veriye asla dokunmamasını sağlar

Paradoksu Çözün

Kurumsal yapay zeka paradoksu ortadan kalkmayacak: Kuruluşlar daha fazla verim ve ölçekten faydalanmak için daha fazla özerklik isteyecek, ancak düzenleyici denetimler ve risk artacaktır.

Temel içgörü, iradenin tasarımla güvenceye alınması gerektiğidir.

Aracı çağının en önemli başarısızlıkları büyük olasılıkla teknolojinin kendisinden değil, kötü tasarlanmış yönetişimden kaynaklanacaktır. Başarılı olacak kuruluşlar, özerkliği kasıtlı olarak tasarlayan ve denetimi yapısal olarak yerleştirenlerdir.

Pastanın üzerindeki çilek ise yapay zeka platformunuzun entegre yönetişim yetenekleri sunmasıdır. Böylece kuruluşlar otomasyonu ve değerlendirmeyi ölçeklendirebilir. Bu DataCamp web semineriyle yapay zeka yönetişimi için bir oyun kitabı geliştirme hakkında daha fazla bilgi edinebilirsiniz.

Iris Adae, KNIME'da Veri ve Analitik Başkan Yardımcısıdır. Burada küresel veri stratejisine liderlik eder ve kuruluşların karmaşık verileri eyleme dönüştürülebilir içgörülere çevirmesine yardımcı olan ölçeklenebilir ve erişilebilir analitik yaklaşımlarını savunur. 2015'ten beri KNIME'da çalışmaktadır.