Programma

Il nuovo paradosso dell’AI in azienda è questo: più deleghiamo l’azione ad agenti AI, più perdiamo la nostra agency. Nell’era agentica, il collo di bottiglia non è la generazione, ma la valutazione e la fiducia.

Ci siamo abituati a sistemi di AI che supportano principalmente il nostro giudizio umano. In molti casi, ci siamo anche abituati al fatto che questi sistemi confermino il nostro giudizio e i nostri bias, senza metterli realmente in discussione. Generano testo, riassumono informazioni o forniscono raccomandazioni.

Tuttavia, l’umano restava il decisore e l’approvatore.

Gli agenti AI hanno cambiato questo equilibrio. I sistemi agentici non si limitano a generare suggerimenti, ma sono progettati per pianificare, decidere e agire all’interno di ecosistemi organizzativi complessi.

Attivano workflow, chiamano API, spostano denaro e aggiornano record. Avviano processi senza necessariamente attendere la conferma umana. Questo cambia il profilo di rischio dell’azienda.

Il problema è che quando i sistemi agentici agiscono, le conseguenze possono essere costose. Se un agente commette un errore di approvvigionamento da 300.000 $, “è stato lo strumento a decidere” non è più una difesa valida. La perdita per l’azienda è reale e qualcuno deve essere responsabile. La tua responsabilità non scompare solo perché ha agito l’agente.

Le aziende vogliono velocità, scala ed efficienza dagli agenti autonomi, ma la responsabilità non può essere automatizzata. Delegare l’azione a un agente non significa delegare la responsabilità.

La domanda centrale è: come possiamo scalare l’uso dell’AI agentica senza rinunciare alla nostra agency?

Dall’AI assistiva all’AI agentica

Per rispondere, dobbiamo distinguere tra AI assistiva e AI agentica.

- AI assistiva opera con un umano nel loop per impostazione predefinita. Fornisce una proposta; tu fai clic su "accetta". L’umano resta il principale responsabile.

- AI agentica si prende carico dell’intero processo, dalla pianificazione all’esecuzione dei workflow fino al deployment in autonomia. Gli agenti navigano tra database, interfacciano API e prendono decisioni per raggiungere un obiettivo.

La differenza sta nel livello di controllo. Nei sistemi assistivi, l’agency è chiaramente in capo all’umano. Autorità e responsabilità tendono ad allinearsi, con gli umani a decidere e i sistemi a supportare. Ma nei sistemi agentici è il sistema ad agire, mentre la responsabilità finale resta all’umano.

Ed è qui che il paradosso peggiora.

All’aumentare dell’autonomia, una supervisione umana costante (human-in-the-loop) diventa impraticabile. Ma ridurre la supervisione aumenta l’esposizione al rischio, come violazioni di policy, errori e conseguenze indesiderate. E se vincoliamo troppo gli agenti, l’autonomia resta teorica e perdiamo scala ed efficienza.

Il vero collo di bottiglia: la valutazione

Non mancano vendor che promettono automazione su larga scala. Gli agenti producono piani, prendono decisioni e agiscono più velocemente di qualsiasi team umano.

Ma quando gli agenti agiscono, le aziende si trovano davanti a una nuova domanda: come facciamo a sapere che quelle azioni sono corrette, sicure e allineate alle nostre policy?

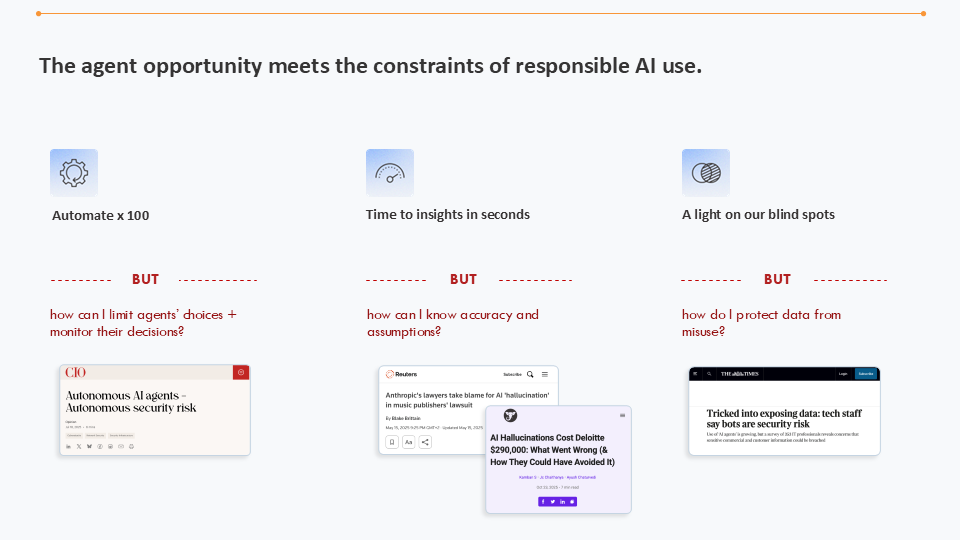

Cosa succede quando le opportunità degli agenti incontrano i vincoli di un uso responsabile dell’AI

L’istinto comune qui è aggiungere passaggi di approvazione: un revisore che firmi e l’escalation delle eccezioni. Tuttavia, il tradizionale “human-in-the-loop” non regge alla scala.

Un agente che opera in continuo può prendere centinaia o anche migliaia di decisioni al giorno. Se ogni azione richiede una valutazione manuale, il “lavoro di verifica” finale supererà il risparmio di tempo iniziale. Avremo automatizzato l’esecuzione per reintrodurre un collo di bottiglia nella valutazione.

C’è poi un’altra complicazione. Valutiamo se le azioni di un agente sono corrette, sicure e protette. Ma che dire del dire “no”? Il sistema sa quando non agire?

Questo potrebbe essere uno dei problemi più grandi dell’AI agentica: un agente utile deve saper rilevare conflitti con le policy, per esempio, e dire “non posso farlo” o “devo inoltrarlo a un umano”. Senza questa capacità, gli agenti diventano macchine di output, generando risultati a prescindere che dovrebbero o meno.

Su larga scala, questo tipo di comportamento diventa una responsabilità.

E torniamo al paradosso.

Se gli umani non possono rivedere tutto e gli agenti non sanno valutare in modo affidabile i propri limiti, allora la valutazione non può restare uno strato informale aggiunto dopo il deployment. Deve essere progettata all’interno del sistema stesso

La valutazione come infrastruttura, non un ripensamento manuale

Il punto quindi non è se la valutazione sia necessaria, ma come venga implementata.

In KNIME l’abbiamo visto in pratica. In un caso, abbiamo costruito un agente che generava azioni a partire da insight sui dati. Ci ha aiutato moltissimo ad accelerare il lavoro, ma ci siamo ritrovati a mettere in discussione quasi ogni singolo insight. Non dovremmo fidarci ciecamente degli agenti, ma la fiducia è necessaria per scalare.

La svolta è arrivata quando abbiamo integrato il feedback nel workflow. Etichettando e identificando ogni “fallimento”, l’agente ha imparato e migliorato grazie a noi, gli umani nel loop. Col tempo, l’agente è migliorato e la fiducia è aumentata.

La lezione è stata di costruire la fiducia nel sistema: valutazione e feedback devono far parte del sistema, non essere un processo accessorio.

L’obiettivo è l’autonomia governata

L’obiettivo non è l’autonomia illimitata o la supervisione umana permanente, ma l’“autonomia governata”, in cui i sistemi agiscono in modo indipendente entro confini chiaramente definiti.

Le nostre piattaforme devono avere risposte a situazioni come cosa succede se l’agente sbaglia, quante sono le imprecisioni accettabili e qual è il costo del fallimento rispetto al beneficio dell’automazione.

L’autonomia governata richiede che le organizzazioni definiscano in anticipo:

|

Paratie e vincoli chiari |

Per esempio, le condizioni in cui un agente può agire senza intervento |

|

Livelli di tolleranza all’errore definiti |

Per esempio, le soglie di confidenza necessarie per l’esecuzione autonoma |

|

Strategie di roll-out graduale |

Per esempio, il roll-out iniziale prevede un alto livello di revisione umana nelle fasi iniziali, da cui gli agenti possono imparare e migliorare |

Un agente può operare in autonomia sopra un determinato livello di certezza. Sotto quella soglia, deve deferire alla revisione umana. Nel tempo, man mano che fiducia e prestazioni migliorano e i tassi di errore diminuiscono, tali soglie possono adattarsi, ma il meccanismo di escalation resta in vigore.

Fondamentale è che l’override umano resti sempre possibile. L’autonomia dovrebbe ridurre il coinvolgimento di routine, non eliminarlo.

Questo approccio riformula il paradosso: l’agency non si perde quando si delega, ma si esercita all’interno di un framework di paratie.

Progettare il framework di paratie

Credo che la fiducia nei sistemi agentici non deriverà da modelli migliori, ma da framework migliori.

Le aziende hanno bisogno di un framework di paratie che faccia parte dell’infrastruttura di sistema. Questo abilita gli agenti mantenendoli legati a una logica deterministica.

Un framework aziendale solido dovrebbe includere:

1. Paratie esplicite integrate nei workflow

Gli agenti non dovrebbero basarsi solo sui dati per determinare le azioni successive. Devono operare entro regole e vincoli predefiniti, allineati alle policy regolamentari, finanziarie e organizzative dell’azienda.

Queste regole e questi vincoli devono essere integrati nei workflow. In questo modo, le policy diventano applicabili.

2. Piena visibilità e auditabilità su come gli agenti costruiscono

Le aziende hanno bisogno di tracciabilità su come vengono costruite ed eseguite le decisioni.

Non basta vedere l’esito dell’agente; le organizzazioni devono poter ispezionare il suo processo di "pensiero" – il percorso di ragionamento, oltre all’uso degli strumenti e alle fonti dati.

Questo consente un audit trail che spiega perché è stata presa una decisione. Crea responsabilità, supporta la conformità normativa e abilita l’analisi post-incidente.

3. Strumenti deterministici

Gli agenti non dovrebbero improvvisare in aree in cui esiste già una logica deterministica.

Invece di lasciare a un agente il compito di indovinare ogni volta come calcolare un margine fiscale complesso, fornisci uno strumento fisso e verificato (un “nodo” o sotto-attività) per eseguire quel calcolo specifico.

In questo modo, l’agente diventa un orchestratore di strumenti affidabili anziché un generatore di ragionamenti incerti in contesti potenzialmente ad alto rischio.

4. Controllo sull’accesso ai dati

Un accesso profondo ai dati non è sempre necessario.

Gli agenti dovrebbero accedere ai dati su base “need-to-know”. Mentre un agente di supporto necessita della cronologia delle conversazioni e di una knowledge base, probabilmente non ha bisogno del numero di previdenza sociale di un cliente per essere efficace.

5. Loop di feedback e manutenzione continua

I sistemi agentici non dovrebbero passare dal pilota all’autonomia in un solo passo.

Le fasi iniziali possono prevedere livelli più alti di revisione umana e monitoraggio attivo. Ma nel tempo, man mano che le prestazioni si stabilizzano e le modalità di fallimento sono comprese, l’autonomia può essere ampliata.

La manutenzione continua è essenziale. Gli agenti devono essere mantenuti e ottimizzati in modo continuo. I dati possono cambiare, diventare obsoleti e le normative possono variare. Se gli agenti non vengono monitorati e ricalibrati, prenderanno decisioni basate su informazioni imprecise o datate.

L’architettura conta

Per implementare l’autonomia governata su larga scala, il livello di governance di un’organizzazione dovrebbe stare al di sopra dei singoli modelli e vendor, evitando il lock-in.

La governance dovrebbe esistere come livello architetturale, permettendoti di sostituire l’AI sottostante mantenendo intatte le paratie.

In questo contesto sono strategicamente importanti le piattaforme che combinano orchestrazione, logica deterministica ed esecuzione trasparente. Consentono alle organizzazioni di decidere come gli agenti interagiscono con dati e processi aziendali.

C’è un’idea sbagliata secondo cui modelli migliori portino automaticamente a decisioni migliori. Gli incidenti più dannosi non saranno riconducibili a errori di modello, ma a esseri umani che delegano la responsabilità senza progettarla. Il controllo risiede nel sistema, non nel modello.

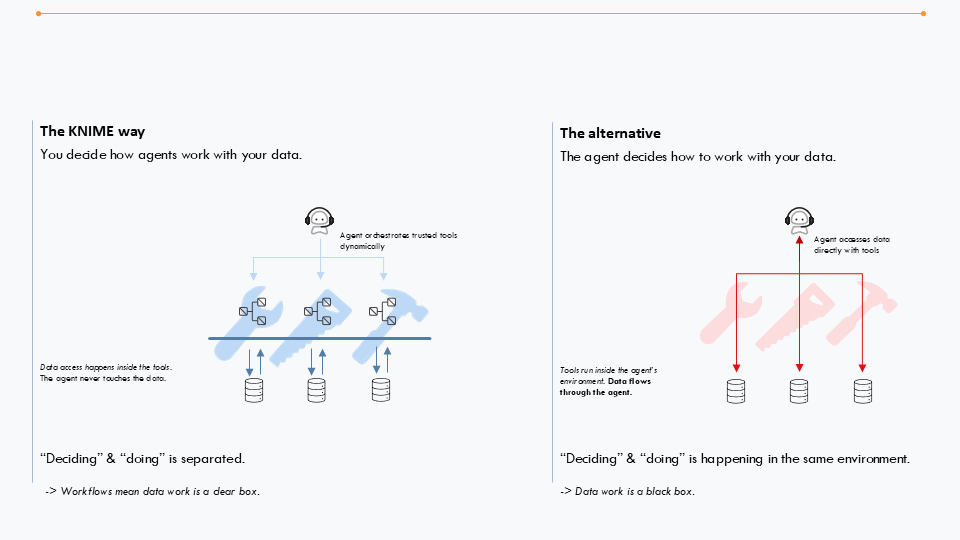

KNIME segue le best practice per costruire agenti e garantisce che l’agente non tocchi mai i dati

Risolvi il paradosso

Il paradosso dell’AI in azienda non scomparirà: le organizzazioni vorranno maggiore autonomia per beneficiare di più efficienza e scala, ma aumenteranno le ispezioni regolatorie e il rischio.

L’intuizione chiave è che l’agency deve essere garantita dalla progettazione.

I fallimenti più significativi dell’era agentica probabilmente non deriveranno dalla tecnologia in sé, ma da una governance progettata male. Avranno successo le organizzazioni che progettano l’autonomia intenzionalmente e incorporano la supervisione in modo strutturale.

La ciliegina sulla torta è quando la tua piattaforma AI offre funzionalità di governance integrate. In questo modo le organizzazioni possono scalare l’automazione e la valutazione. Puoi saperne di più su come sviluppare un playbook per la governance dell’AI con questo webinar di DataCamp.

Iris Adae è VP of Data & Analytics presso KNIME, dove guida la strategia dati globale e promuove analisi scalabili e accessibili che aiutano le organizzazioni a trasformare dati complessi in insight azionabili. Lavora in KNIME dal 2015.