Programa

O novo paradoxo da IA nas empresas é este: quanto mais delegamos ações a agentes de IA, mais perdemos nossa própria autonomia. Na era dos agentes, o gargalo não é a geração, e sim a avaliação e a confiança.

Nos acostumamos a sistemas de IA que servem principalmente para apoiar nosso julgamento humano. Em muitos casos, também nos habituamos a que esses sistemas confirmem nossos julgamentos e vieses, sem desafiá-los de forma significativa. Eles geram textos, resumem informações ou nos dão recomendações.

Ainda assim, o humano permanecia como decisor e aprovador.

Agentes de IA mudaram isso. Sistemas com agentes não apenas geram sugestões, mas são projetados para planejar, decidir e agir em ecossistemas organizacionais complexos.

Eles disparam workflows, chamam APIs, movimentam dinheiro e atualizam registros. Iniciam processos sem necessariamente esperar confirmação humana. Isso muda o panorama de risco das empresas.

O problema é que, quando sistemas com agentes agem, as consequências podem ser caras. Quando um agente comete um erro de compra de US$ 300 mil, “a ferramenta decidiu” deixa de ser uma defesa aceitável. A perda para o negócio é real, e alguém precisa ser responsabilizado. Sua responsabilidade não desaparece só porque o agente agiu.

As empresas querem velocidade, escala e eficiência de agentes autônomos, mas a accountability não pode ser automatizada. Delegar a ação a um agente não é o mesmo que delegar a responsabilidade.

A questão central é: como escalar o uso de IA com agentes sem abrir mão da autonomia?

Da IA assistencial à IA com agentes

Para responder, precisamos distinguir IA assistencial de IA com agentes.

- IA assistencial opera com o humano no loop por padrão. Ela apresenta uma proposta; você clica em “aceitar”. O humano segue como principal responsável.

- IA com agentes assume o processo completo, do planejamento à execução de workflows e à implantação de forma independente. Os agentes navegam por bancos de dados, interagem com APIs e tomam suas próprias decisões para alcançar um objetivo.

A diferença está no nível de controle. Em sistemas assistenciais, a autonomia está claramente com o humano. Autoridade e responsabilidade tendem a se alinhar: humanos decidem e sistemas apoiam. Mas em sistemas com agentes, o sistema age enquanto a responsabilidade final permanece com o humano.

É aí que o paradoxo se intensifica.

À medida que a autonomia aumenta, a supervisão humana constante (o humano no loop) se torna impraticável. Mas reduzir a supervisão amplia a exposição a riscos, como violações de políticas, erros e efeitos colaterais indesejados. E prender os agentes em limites apertados torna a autonomia teórica — perdemos escala e eficiência.

O verdadeiro gargalo: avaliação

Não faltam fornecedores prometendo automação em escala. Agentes produzem planos, tomam decisões e agem mais rápido que qualquer time humano.

Mas quando os agentes agem, surge uma nova pergunta para as empresas: como saber se essas ações são corretas, seguras e alinhadas às nossas políticas?

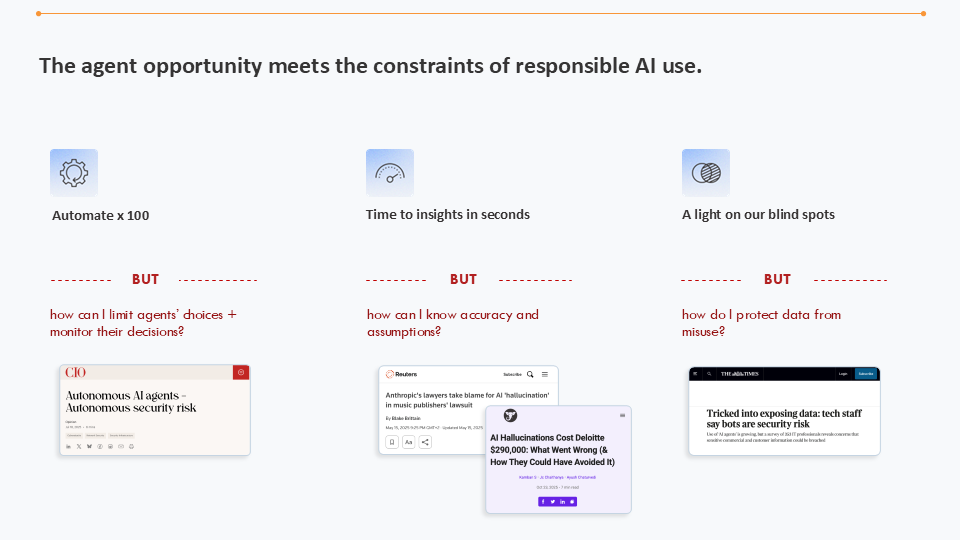

O que acontece quando as oportunidades de agentes encontram as restrições do uso responsável de IA

O instinto comum aqui é adicionar etapas de aprovação: um revisor para dar o aceite e escalar exceções. Porém, o tradicional “humano no loop” desmorona na escala.

Um agente operando continuamente pode tomar centenas ou até milhares de decisões por dia. Se cada ação exigir avaliação manual, o “trabalho de prova” final vai superar as economias de tempo iniciais. Teremos automatizado a execução apenas para reintroduzir um gargalo na avaliação.

E há outra complicação. Avaliamos se as ações de um agente são corretas, seguras e protegidas. Mas e quando é preciso dizer “não”? O sistema sabe quando não agir?

Esse pode ser um dos maiores problemas da IA com agentes: um agente útil precisa detectar conflitos com políticas e dizer “não posso fazer isso” ou “preciso encaminhar para um humano”. Sem essa capacidade, os agentes viram máquinas de output, gerando resultados quer devam ou não.

Em escala, esse comportamento vira passivo.

Voltamos então ao paradoxo.

Se humanos não conseguem revisar tudo e agentes não avaliam seus próprios limites de forma confiável, a avaliação não pode continuar como uma camada informal adicionada depois da implantação. Ela precisa ser desenhada dentro do próprio sistema.

Avaliação como infraestrutura, não como remendo manual

A questão, portanto, não é se a avaliação é necessária, mas como ela é implementada.

Na KNIME, vimos isso na prática. Em um caso, construímos um agente que gerava ações a partir de insights de dados. Ele ajudou muito a acelerar nosso trabalho, mas nos pegamos questionando praticamente cada insight. Não devemos confiar cegamente nos agentes, mas a confiança é essencial para escalar.

O ponto de virada veio quando integramos feedback ao workflow. Ao rotular e identificar cada “falha”, o agente aprendeu e melhorou conosco, os humanos no loop. Com o tempo, o agente evoluiu e a confiança aumentou.

Nossa lição foi construir a confiança no sistema: avaliação e feedback precisam fazer parte do sistema, não ser um processo à parte.

Autonomia governada é o objetivo

O objetivo não é autonomia irrestrita nem supervisão humana permanente, e sim “autonomia governada”: sistemas que atuam de forma independente dentro de limites bem definidos.

Nossas plataformas precisam ter respostas para situações como o que acontece se o agente errar, quantos erros são aceitáveis e qual é o custo da falha versus o benefício da automação.

Autonomia governada exige que as organizações definam, de antemão:

|

Regras e limites claros |

Por exemplo, as condições sob as quais um agente pode agir sem intervenção |

|

Níveis definidos de tolerância a erros |

Por exemplo, os limiares de confiança necessários para a execução autônoma |

|

Estrategias de roll-out gradual |

Por exemplo, o roll-out inicial envolveria alto nível de revisão humana nas primeiras etapas, a partir do qual os agentes podem aprender e melhorar |

Um agente pode operar de forma autônoma acima de um nível de certeza definido. Abaixo desse limiar, ele deve encaminhar para revisão humana. Com o tempo, à medida que a confiança e o desempenho melhoram e a taxa de erro cai, esses limiares podem ser ajustados, mas o mecanismo de escalonamento permanece.

E é crucial que a intervenção humana sempre seja possível. A autonomia deve reduzir o envolvimento rotineiro, não eliminá-lo.

Essa abordagem ressignifica o paradoxo: a autonomia não se perde ao delegar — ela é exercida com base em um framework de guardrails.

Desenhando o framework de guardrails

Acredito que a confiança em sistemas com agentes não virá de modelos melhores, e sim de frameworks melhores.

As empresas precisam de um framework de guardrails que faça parte da infraestrutura do sistema. Ele dá poder aos agentes, mantendo-os ancorados em lógica determinística.

Um framework corporativo robusto deve incluir:

1. Guardrails explícitos integrados aos workflows

Os agentes não devem depender apenas dos dados para decidir seus próximos passos. Eles precisam operar dentro de regras e restrições pré-definidas, alinhadas às políticas regulatórias, financeiras e organizacionais da empresa.

Essas regras e restrições precisam estar integradas aos workflows. Assim, as políticas passam a ser aplicáveis de fato.

2. Visibilidade e auditabilidade completas de como os agentes constroem

As empresas precisam de rastreabilidade sobre como as decisões são construídas e executadas.

Não basta ver apenas o resultado do agente; as organizações devem poder inspecionar seu “raciocínio” — o caminho de reasoning, além do uso de ferramentas e das fontes de dados.

Isso possibilita uma trilha de auditoria que explica por que uma decisão foi tomada. Cria accountability, apoia a conformidade regulatória e viabiliza análise pós-incidente.

3. Ferramentas determinísticas

Os agentes não devem improvisar em áreas onde já existe lógica determinística.

Em vez de deixar um agente “chutar” como calcular uma margem tributária complexa toda vez, dê a ele uma ferramenta fixa e verificada (um “nó” ou sub-tarefa) para executar esse cálculo específico.

Assim, o agente vira um orquestrador de ferramentas confiáveis, e não um gerador de raciocínio incerto em contextos potencialmente de alto risco.

4. Controle sobre o acesso a dados

Acesso profundo a dados nem sempre é necessário.

Os agentes devem acessar dados no princípio do “precisa saber”. Enquanto um agente de suporte precisa do histórico de conversas e de uma base de conhecimento, provavelmente não precisa do número do CPF do cliente para ser eficaz.

5. Loops de feedback e manutenção contínua

Sistemas com agentes não devem passar do piloto à autonomia em um único passo.

As fases iniciais podem envolver níveis maiores de revisão humana e monitoramento ativo. Com o tempo, à medida que o desempenho estabiliza e os modos de falha são compreendidos, a autonomia pode ser expandida.

A manutenção contínua é essencial. Os agentes precisam ser constantemente mantidos e otimizados. Dados podem mudar, ficar desatualizados, e regulamentos podem evoluir. Se os agentes não forem monitorados e recalibrados, tomarão decisões com base em informações imprecisas ou antigas.

A arquitetura faz diferença

Para implementar autonomia governada em escala, a camada de governança da organização deve ficar acima de modelos e fornecedores específicos, evitando lock-in de fornecedor.

A governança deve existir como uma camada arquitetural, permitindo trocar a IA subjacente mantendo os guardrails intactos.

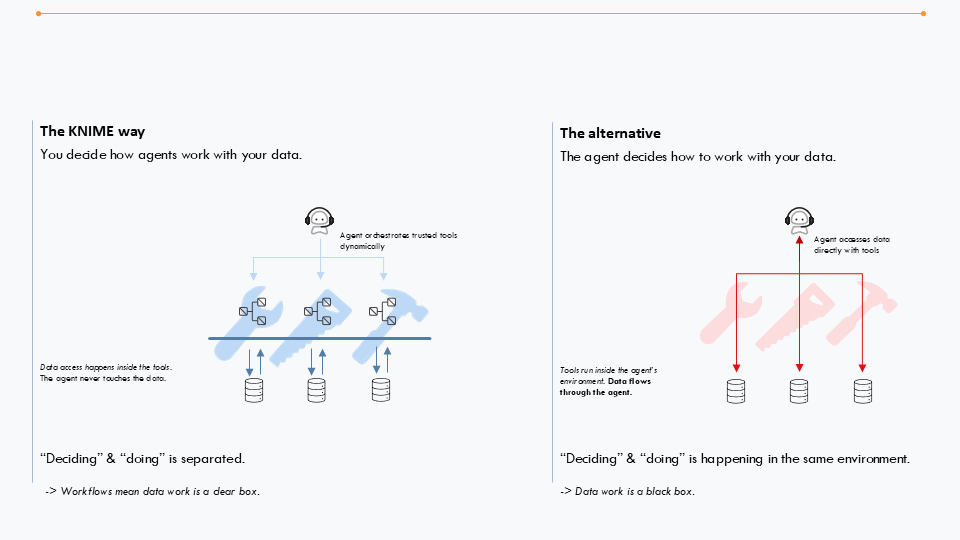

Plataformas que combinam orquestração, lógica determinística e execução transparente são estrategicamente importantes nesse contexto. Elas permitem que as organizações decidam como os agentes interagem com dados e processos corporativos.

Há um equívoco de que modelos melhores levam automaticamente a decisões melhores. Os incidentes mais danosos não vão se dever a erros de modelo, mas a humanos delegando responsabilidade sem desenhar a responsabilidade. O controle reside no sistema, não no modelo.

A KNIME segue as melhores práticas para construir agentes e garante que o agente nunca toque nos dados

Resolva o paradoxo

O paradoxo da IA nas empresas não vai desaparecer: as organizações vão buscar mais autonomia para ganhar eficiência e escala, enquanto inspeções regulatórias e riscos vão aumentar.

A grande sacada é que a autonomia precisa ser garantida por design.

As falhas mais significativas da era dos agentes provavelmente não virão da tecnologia em si, mas de governança mal desenhada. Vão se destacar as organizações que projetarem a autonomia de forma intencional e incorporarem a supervisão de forma estrutural.

A cereja do bolo é quando sua plataforma de IA oferece capacidades de governança integradas. Assim, as organizações conseguem escalar a automação e a avaliação. Você pode saber mais sobre como desenvolver um playbook de governança de IA neste webinar da DataCamp.

Iris Adae é VP de Dados & Analytics na KNIME, onde lidera a estratégia global de dados e defende análises escaláveis e acessíveis que ajudam as organizações a transformar dados complexos em insights acionáveis. Ela atua na KNIME desde 2015.