programa

La nueva paradoja de la IA en la empresa es esta: cuanto más delegamos acciones en agentes de IA, más perdemos nuestra propia capacidad de decisión. En la era agéntica, el cuello de botella no es la generación, sino la evaluación y la confianza.

Nos hemos acostumbrado a sistemas de IA que, sobre todo, respaldan nuestro juicio humano. En muchos casos, también nos hemos habituado a que esos sistemas confirmen nuestro juicio y sesgos, sin cuestionarlos de forma significativa. Generan texto, resumen información o nos dan recomendaciones.

Aun así, la persona seguía siendo quien decidía y aprobaba.

Los agentes de IA han cambiado eso. Los sistemas agénticos no solo generan sugerencias, sino que están diseñados para planificar, decidir y actuar en ecosistemas organizativos complejos.

Ponen en marcha flujos de trabajo, llaman a APIs, mueven dinero y actualizan registros. Inician procesos sin esperar necesariamente una confirmación humana. Esto cambia el mapa de riesgos de la empresa.

El problema es que, cuando los sistemas agénticos actúan, las consecuencias pueden ser costosas. Si un agente comete un error de compra de 300.000 $, “la herramienta tomó la decisión” deja de ser una defensa válida. La pérdida para el negocio es real y alguien debe asumir la responsabilidad. Tu responsabilidad no desaparece solo porque actuó el agente.

Las empresas quieren la rapidez, la escala y la eficiencia de los agentes autónomos, pero la rendición de cuentas no se puede automatizar. Delegar la acción en un agente no significa delegar la responsabilidad.

La pregunta central es: ¿cómo escalamos el uso de IA agéntica sin renunciar a nuestra agencia?

De la IA asistiva a la IA agéntica

Para responder, hay que distinguir entre IA asistiva e IA agéntica.

- IA asistiva funciona por defecto con una persona en el ciclo. Ofrece una propuesta; tú haces clic en "aceptar". La persona sigue siendo la propietaria principal.

- IA agéntica asume el proceso completo, desde la planificación hasta la ejecución de flujos de trabajo y el despliegue de forma independiente. Los agentes navegan por bases de datos, se conectan con APIs y toman sus propias decisiones para lograr un objetivo.

La diferencia está en el nivel de control. En los sistemas asistivos, la agencia recae claramente en la persona. Autoridad y responsabilidad tienden a alinearse: las personas deciden y los sistemas apoyan. Pero en los sistemas agénticos, el sistema actúa mientras la responsabilidad final sigue en la persona.

Aquí es donde la paradoja se agrava.

A medida que aumenta la autonomía, la supervisión humana constante (persona en el ciclo) se vuelve inviable. Pero reducir la supervisión aumenta la exposición a riesgos como incumplimientos de políticas, errores y consecuencias no deseadas. Y restringir demasiado a los agentes vuelve la autonomía teórica y perdemos escala y eficiencia.

El verdadero cuello de botella: la evaluación

No faltan proveedores que prometan automatización a gran escala. Los agentes elaboran planes, toman decisiones y actúan más rápido que cualquier equipo humano.

Pero cuando los agentes actúan, surge una nueva pregunta para las empresas: ¿cómo sabemos que esas acciones son correctas, seguras y acordes con nuestras políticas?

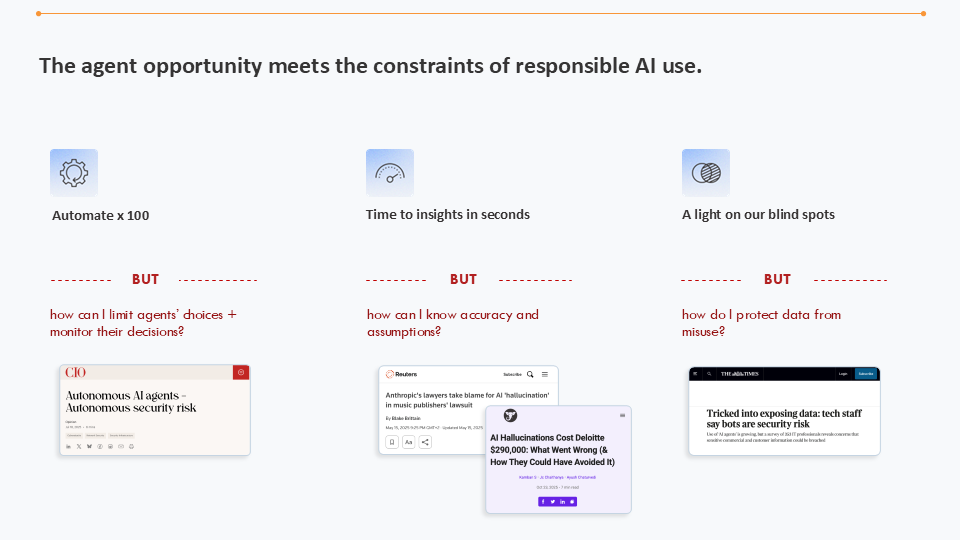

Qué ocurre cuando las oportunidades de los agentes se encuentran con las restricciones del uso responsable de la IA

El instinto habitual es añadir pasos de aprobación: una persona revisora que firme y escalar las excepciones. Sin embargo, el clásico “humano en el ciclo” no escala.

Un agente operando de forma continua puede tomar cientos o incluso miles de decisiones al día. Si cada acción requiere evaluación manual, el “trabajo de comprobación” final superará el ahorro inicial de tiempo. Habríamos automatizado la ejecución solo para reintroducir un cuello de botella en la evaluación.

Y hay otra complicación. Evaluamos si las acciones de un agente son correctas, seguras y fiables. Pero ¿qué pasa con decir “no”? ¿Sabe el sistema cuándo no debe actuar?

Este puede ser uno de los mayores problemas de la IA agéntica: un agente útil debe ser capaz de detectar conflictos con las políticas, por ejemplo, y decir “no puedo hacer esto” o “tengo que derivarlo a una persona”. Sin esta capacidad, los agentes se convierten en máquinas de salida, generando resultados tanto si deben como si no.

A escala, este tipo de comportamiento se convierte en un pasivo.

Y volvemos a la paradoja.

Si las personas no pueden revisarlo todo y los agentes no pueden evaluar de forma fiable sus propios límites, la evaluación no puede seguir siendo una capa informal añadida tras el despliegue. Debe diseñarse dentro del propio sistema.

La evaluación como infraestructura, no como ocurrencia tardía

La cuestión no es si la evaluación es necesaria, sino cómo se implementa.

En KNIME lo hemos visto en la práctica. En un caso, construimos un agente que generaba acciones a partir de insights de datos. Nos ayudó enormemente a acelerar el trabajo, pero nos sorprendimos cuestionando casi cada insight. No debemos confiar ciegamente en los agentes, pero la confianza es imprescindible para escalar.

El punto de inflexión llegó cuando integramos el feedback en el flujo de trabajo. Al etiquetar e identificar cada “fallo”, el agente aprendía y mejoraba con nosotros, las personas en el ciclo. Con el tiempo, el agente mejoró y la confianza creció.

La lección fue incorporar la confianza en el sistema: la evaluación y el feedback deben ser parte del sistema, no un proceso accesorio.

La autonomía gobernada es el objetivo

El objetivo no es una autonomía sin límites ni una supervisión humana permanente, sino una “autonomía gobernada”, donde los sistemas actúan de forma independiente dentro de límites claramente definidos.

Nuestras plataformas deben prever qué pasa si el agente se equivoca, cuántos errores son aceptables y cuál es el coste del fallo frente al beneficio de la automatización.

La autonomía gobernada exige que las organizaciones definan, de antemano:

|

Límites y restricciones claros |

Por ejemplo, en qué condiciones un agente puede actuar sin intervención |

|

Niveles de tolerancia al error |

Por ejemplo, los umbrales de confianza necesarios para la ejecución autónoma |

|

Estrategias de despliegue gradual |

Por ejemplo, un despliegue inicial con un alto nivel de revisión humana en las primeras etapas, del que los agentes puedan aprender y mejorar |

Un agente podría operar de forma autónoma por encima de un nivel de certeza definido. Por debajo de ese umbral, debe remitir a revisión humana. Con el tiempo, a medida que aumenten la confianza y el rendimiento y disminuyan las tasas de error, esos umbrales pueden ajustarse, pero el mecanismo de escalado debe mantenerse.

Es fundamental que la anulación humana siempre sea posible. La autonomía debe reducir la intervención rutinaria, no eliminarla.

Este enfoque replantea la paradoja: la agencia no se pierde al delegarla, sino que se ejerce con base en un marco de guardarraíles.

Diseñar el marco de guardarraíles

Creo que la confianza en los sistemas agénticos no vendrá de mejores modelos, sino de mejores marcos.

Las empresas necesitan un marco de guardarraíles que forme parte de la infraestructura del sistema. Empodera a los agentes a la vez que los ancla a una lógica determinista.

Un marco empresarial robusto debería incluir:

1. Guardarraíles explícitos integrados en los flujos de trabajo

Los agentes no deberían basarse solo en los datos para decidir sus próximas acciones. Deben operar dentro de reglas y restricciones predefinidas, alineadas con las políticas regulatorias, financieras y organizativas de la empresa.

Estas reglas y restricciones deben integrarse en los flujos de trabajo. Así, las políticas se vuelven exigibles.

2. Visibilidad y auditabilidad completas de cómo construyen los agentes

Las empresas necesitan trazabilidad sobre cómo se construyen y ejecutan las decisiones.

No basta con ver el resultado del agente; las organizaciones deben poder inspeccionar su proceso de “pensamiento”: la ruta de razonamiento, así como el uso de herramientas y las fuentes de datos.

Esto permite un registro de auditoría que explique por qué se tomó una decisión. Crea responsabilidad, apoya el cumplimiento normativo y facilita el análisis postincidente.

3. Herramientas deterministas

Los agentes no deberían improvisar en áreas donde ya existe lógica determinista.

En lugar de dejar que un agente adivine cómo calcular cada vez un margen fiscal complejo, dale una herramienta fija y verificada (un “nodo” o subtarea) para ejecutar ese cálculo específico.

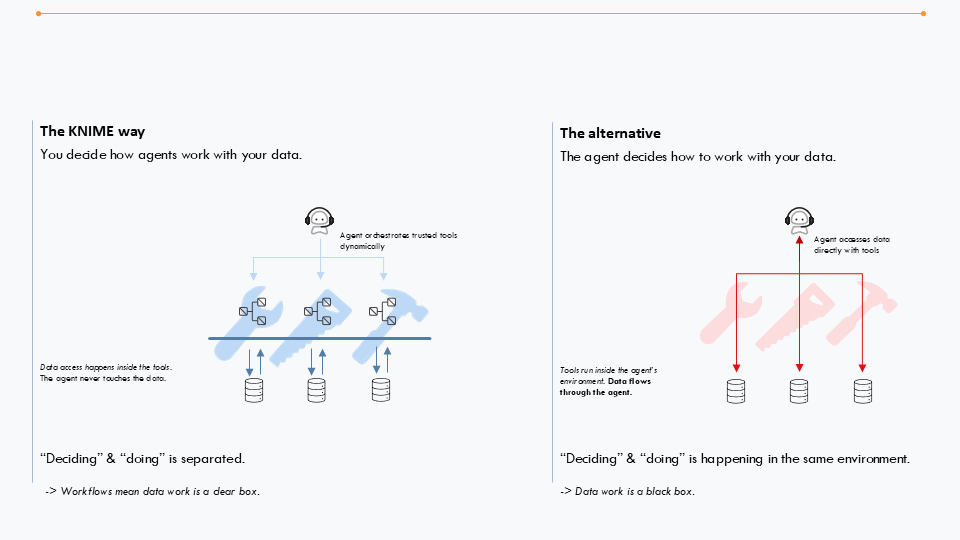

Así, el agente se convierte en orquestador de herramientas fiables, no en generador de razonamientos inciertos en contextos potencialmente de alto riesgo.

4. Control del acceso a los datos

Un acceso profundo a los datos no siempre es necesario.

Los agentes deberían acceder a los datos bajo el principio de “necesidad de saber”. Aunque un agente de soporte necesita el historial de conversación y una base de conocimiento, probablemente no necesite el número de la seguridad social de un cliente para ser eficaz.

5. Bucles de feedback y mantenimiento continuo

Los sistemas agénticos no deberían pasar del piloto a la autonomía en un solo paso.

Las fases iniciales pueden implicar niveles más altos de revisión humana y monitorización activa. Con el tiempo, cuando el rendimiento se estabilice y se comprendan los modos de fallo, la autonomía podrá ampliarse.

El mantenimiento continuo es esencial. Los agentes deben mantenerse y optimizarse de forma continua. Los datos pueden desplazarse, quedar obsoletos y la normativa puede cambiar. Si los agentes no se monitorizan y recalibran, tomarán decisiones basadas en información inexacta o antigua.

La arquitectura importa

Para implantar autonomía gobernada a escala, la capa de gobernanza de una organización debe situarse por encima de modelos y proveedores concretos, evitando el bloqueo con proveedores.

La gobernanza debe existir como una capa arquitectónica que te permita cambiar la IA subyacente manteniendo intactos los guardarraíles.

Las plataformas que combinan orquestación, lógica determinista y ejecución transparente son estratégicas en este contexto. Permiten decidir cómo interactúan los agentes con los datos y procesos de la empresa.

Existe la idea equivocada de que mejores modelos conducen automáticamente a mejores decisiones. Los incidentes más dañinos no se deberán tanto a errores del modelo, sino a personas que delegan responsabilidad sin diseñar la responsabilidad. El control reside en el sistema, no en el modelo.

KNIME sigue las buenas prácticas para construir agentes y garantiza que el agente nunca toque los datos

Resolver la paradoja

La paradoja de la IA en la empresa no va a desaparecer: las organizaciones querrán más autonomía para ganar eficiencia y escala, pero aumentarán las inspecciones regulatorias y el riesgo.

La clave es garantizar la agencia desde el diseño.

Los fallos más significativos de la era agéntica probablemente no provengan de la tecnología en sí, sino de una gobernanza mal diseñada. Las organizaciones que triunfen serán las que diseñen la autonomía de forma intencional e integren la supervisión de manera estructural.

La guinda es cuando tu plataforma de IA ofrece capacidades de gobernanza integradas. Así, las organizaciones pueden escalar la automatización y la evaluación. Puedes saber más sobre cómo elaborar un playbook de gobernanza de IA en este webinar de DataCamp.

Iris Adae es VP de Data & Analytics en KNIME, donde lidera la estrategia global de datos y defiende una analítica escalable y accesible que ayuda a las organizaciones a convertir datos complejos en insights accionables. Trabaja en KNIME desde 2015.