Program

Paradoks AI enterprise yang baru adalah ini: Semakin banyak kita mendelegasikan tindakan kepada agen AI, semakin kita kehilangan agensi kita sendiri. Di era agentik, evaluasi dan kepercayaan, bukan generasi, menjadi titik hambat.

Kita telah terbiasa dengan sistem AI yang terutama mendukung penilaian manusia. Dalam banyak kasus, kita juga terbiasa dengan sistem ini yang mengonfirmasi penilaian dan bias manusia, tanpa benar-benar menantangnya. Mereka menghasilkan teks, merangkum informasi, atau memberi kita rekomendasi.

Namun demikian, manusia tetap menjadi pengambil keputusan dan pemberi persetujuan.

Agen AI telah mengubah itu. Sistem agentik tidak hanya membuat saran, tetapi dirancang untuk merencanakan, memutuskan, dan bertindak di seluruh ekosistem organisasi yang kompleks.

Mereka memicu alur kerja, memanggil API, memindahkan uang, dan memperbarui catatan. Mereka memulai proses tanpa harus selalu menunggu konfirmasi manusia. Ini mengubah lanskap risiko enterprise.

Masalahnya adalah ketika sistem agentik bertindak, konsekuensinya bisa mahal. Ketika sebuah agen membuat kesalahan pengadaan senilai $300 ribu, “alat yang mengambil keputusan” bukan lagi pembelaan yang layak. Kerugiannya nyata bagi bisnis, dan seseorang harus bertanggung jawab. Tanggung jawab Anda tidak hilang hanya karena agen yang bertindak.

Perusahaan menginginkan kecepatan, skala, dan efisiensi dari agen otonom, tetapi akuntabilitas tidak bisa diautomasi. Mendelegasikan tindakan kepada agen tidak berarti mendelegasikan tanggung jawab.

Pertanyaan utamanya adalah: Bagaimana kita menskalakan penggunaan AI agentik tanpa menyerahkan agensi?

Dari AI Asistif ke AI Agentik

Untuk menjawabnya, kita perlu membedakan antara AI asistif dan AI agentik.

- AI asistif secara bawaan beroperasi dengan manusia di dalam proses. Ia memberi usulan; Anda mengklik "terima". Manusia tetap menjadi pemilik utama.

- AI agentik mengambil alih seluruh proses dari perencanaan hingga mengeksekusi alur kerja dan melakukan penerapan secara mandiri. Agen menavigasi basis data, berinteraksi dengan API, dan membuat keputusan sendiri untuk mencapai tujuan.

Perbedaannya adalah tingkat kendali. Dalam sistem asistif, agensi jelas berada pada manusia. Otoritas dan akuntabilitas lebih selaras, dengan manusia yang memutuskan dan sistem yang mendukung. Namun dalam sistem agentik, sistem yang bertindak, sementara akuntabilitas akhir tetap pada manusia.

Di sinilah paradoksnya memburuk.

Seiring meningkatnya otonomi, pengawasan manusia yang konstan (human-in-the-loop) menjadi tidak praktis. Namun mengurangi pengawasan meningkatkan eksposur terhadap risiko, seperti pelanggaran kebijakan, kesalahan, dan konsekuensi yang tidak diinginkan. Dan membatasi agen terlalu ketat membuat otonomi hanya teoritis, sehingga kita kehilangan skala dan efisiensi.

Titik Hambat Sebenarnya: Evaluasi

Tidak kekurangan vendor yang menjanjikan otomatisasi dalam skala besar. Agen membuat rencana, mengambil keputusan, dan bertindak lebih cepat daripada tim manusia mana pun.

Namun ketika agen bertindak, perusahaan menghadapi pertanyaan baru: Bagaimana kita tahu tindakan tersebut benar, aman, dan selaras dengan kebijakan kita?

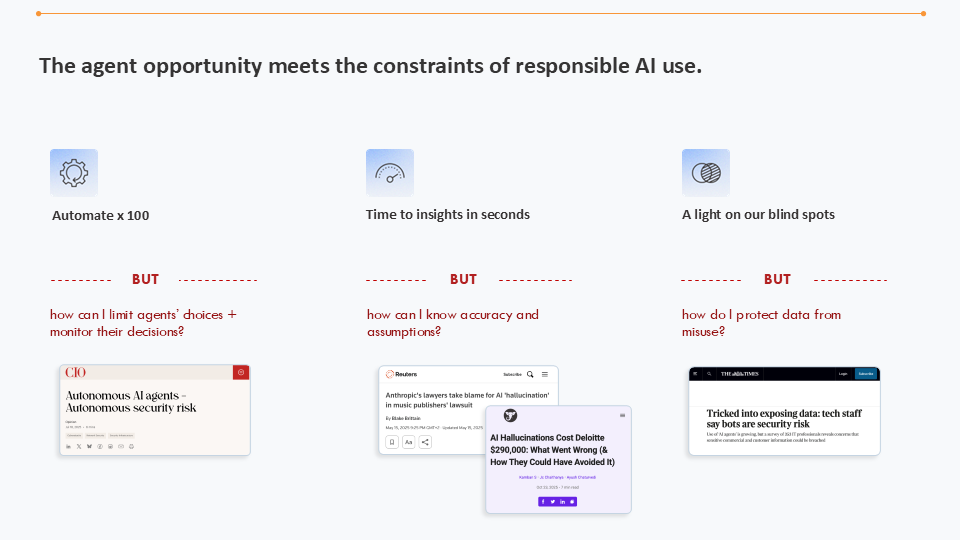

Apa yang terjadi ketika peluang agen bertemu dengan batasan penggunaan AI yang bertanggung jawab

Naluri umum di sini adalah menambah langkah persetujuan: peninjau untuk menandatangani, dan mengeskalasi pengecualian. Namun, pola tradisional “human-in-the-loop” runtuh pada skala besar.

Sebuah agen yang beroperasi terus-menerus dapat membuat ratusan bahkan ribuan keputusan per hari. Jika setiap tindakan memerlukan evaluasi manual, “pekerjaan pembuktian” akhirnya akan melampaui penghematan waktu awal. Kita akan mengotomatiskan eksekusi hanya untuk memperkenalkan kembali titik hambat pada evaluasi.

Dan ada komplikasi lain. Kita mengevaluasi apakah tindakan yang diambil agen itu benar, aman, dan terjamin. Namun bagaimana dengan mengatakan “tidak”? Apakah sistem tahu kapan tidak bertindak?

Ini mungkin salah satu masalah terbesar AI agentik: Agen yang berguna harus mampu mendeteksi konflik kebijakan, misalnya, dan mengatakan “Saya tidak bisa melakukan ini” atau “Saya perlu meneruskan ini ke manusia.” Tanpa kemampuan ini, agen menjadi mesin keluaran, menghasilkan hasil apakah seharusnya atau tidak.

Dalam skala besar, perilaku seperti ini menjadi liabilitas.

Ini membawa kita kembali ke paradoks.

Jika manusia tidak bisa meninjau semuanya dan agen tidak bisa secara andal menilai batasnya sendiri, maka evaluasi tidak boleh tetap menjadi lapisan informal yang ditambahkan setelah penerapan. Evaluasi harus dirancang ke dalam sistem itu sendiri

Evaluasi sebagai Infrastruktur, Bukan Pekerjaan Manual Belakangan

Persoalannya bukan apakah evaluasi diperlukan, melainkan bagaimana implementasinya.

Di KNIME, kami telah melihat ini dalam praktik. Dalam satu kasus, kami membangun agen yang menghasilkan tindakan dari wawasan data. Ini sangat membantu mempercepat pekerjaan kami, tetapi kami mendapati diri kami mempertanyakan hampir setiap wawasan. Kita tidak boleh mempercayai agen secara membabi buta, tetapi kepercayaan perlu ada untuk melakukan skala.

Titik baliknya datang saat kami mengintegrasikan umpan balik ke dalam alur kerja. Dengan memberi label dan mengidentifikasi setiap “kegagalan”, agen belajar dan meningkat dari kami, manusia di dalam proses. Seiring waktu, agen membaik, dan kepercayaan meningkat.

Pelajaran kami di sini adalah membangun kepercayaan ke dalam sistem: Evaluasi dan umpan balik harus menjadi bagian dari sistem, bukan proses tambahan.

Tujuannya adalah Otonomi Bertata Kelola

Tujuannya bukan otonomi tanpa batas atau pengawasan manusia permanen, melainkan “otonomi bertata kelola,” di mana sistem bertindak secara mandiri dalam batasan yang jelas.

Platform kami perlu memiliki jawaban untuk situasi seperti apa yang terjadi jika agen salah, berapa banyak kesalahan yang dapat diterima, dan berapa biaya kegagalan dibanding manfaat otomatisasi.

Otonomi bertata kelola mengharuskan organisasi mendefinisikan, sebelumnya:

|

Rambu dan batasan yang jelas |

Misalnya, kondisi di mana agen boleh bertindak tanpa intervensi |

|

Tingkat toleransi kesalahan yang terdefinisi |

Misalnya, ambang keyakinan yang diperlukan untuk eksekusi otonom |

|

Strategi peluncuran bertahap |

Misalnya, peluncuran awal melibatkan tingkat tinjauan manusia yang tinggi pada tahap awal, yang darinya agen dapat belajar dan meningkat |

Sebuah agen dapat beroperasi secara otonom di atas tingkat kepastian yang ditetapkan. Di bawah ambang itu, ia harus menyerahkan ke tinjauan manusia. Seiring waktu, ketika kepercayaan dan kinerja meningkat dan tingkat kesalahan menurun, ambang tersebut dapat beradaptasi, tetapi mekanisme eskalasi tetap ada.

Yang penting, pengambilalihan oleh manusia harus selalu memungkinkan. Otonomi seharusnya mengurangi keterlibatan rutin, bukan menghilangkannya.

Pendekatan ini membingkai ulang paradoks: Agensi tidak hilang saat didelegasikan, tetapi dijalankan berdasarkan kerangka rambu pengaman.

Merancang Kerangka Rambu Pengaman

Saya percaya bahwa kepercayaan pada sistem agentik tidak akan datang dari model yang lebih baik, melainkan dari kerangka yang lebih baik.

Perusahaan memerlukan kerangka rambu pengaman yang menjadi bagian dari infrastruktur sistem. Kerangka ini memberdayakan agen sekaligus menjaganya terikat pada logika deterministik.

Kerangka enterprise yang kuat harus mencakup:

1. Rambu pengaman eksplisit yang terintegrasi ke dalam alur kerja

Agen tidak boleh hanya mengandalkan data untuk menentukan tindakan berikutnya. Mereka harus beroperasi dalam aturan dan batasan yang telah ditetapkan, selaras dengan kebijakan regulasi, keuangan, dan organisasi perusahaan.

Aturan dan batasan ini perlu diintegrasikan ke dalam alur kerja. Dengan begitu, kebijakan menjadi dapat ditegakkan.

2. Visibilitas penuh dan kemampuan audit atas cara agen dibangun

Perusahaan membutuhkan keterlacakan tentang bagaimana keputusan disusun dan dieksekusi.

Melihat hasil agen saja tidak cukup; organisasi harus dapat memeriksa proses "berpikir"nya – jalur penalaran, serta penggunaan alat dan sumber data.

Ini memungkinkan jejak audit yang menjelaskan mengapa keputusan dibuat. Hal ini menciptakan akuntabilitas, mendukung kepatuhan regulatif, dan memungkinkan analisis pasca-insiden.

3. Alat deterministik

Agen tidak boleh berimprovisasi di area yang sudah ada logika deterministiknya.

Alih-alih membiarkan agen menebak cara menghitung margin pajak yang kompleks setiap saat, berikan alat tetap yang terverifikasi (sebuah "node" atau sub-tugas) untuk mengeksekusi perhitungan spesifik tersebut.

Dengan cara ini, agen menjadi orkestrator alat yang andal alih-alih generator penalaran yang tidak pasti dalam konteks berisiko tinggi.

4. Kontrol atas akses data

Akses data yang dalam tidak selalu diperlukan.

Agen harus mengakses data berdasarkan prinsip “perlu-tahu”. Sementara agen dukungan membutuhkan riwayat percakapan dan basis pengetahuan, kemungkinan besar ia tidak memerlukan nomor jaminan sosial pelanggan untuk efektif.

5. Loop umpan balik dan pemeliharaan berkelanjutan

Sistem agentik tidak boleh berpindah dari pilot ke otonomi dalam satu langkah.

Fase awal mungkin melibatkan tingkat tinjauan manusia yang lebih tinggi dan pemantauan aktif. Namun seiring waktu, ketika kinerja stabil dan mode kegagalan dipahami, otonomi dapat diperluas.

Pemeliharaan berkelanjutan itu penting. Agen perlu terus dipelihara dan dioptimalkan. Data dapat bergeser, menjadi usang, dan regulasi dapat berubah. Jika agen tidak dipantau dan dikalibrasi ulang, mereka akan mengambil keputusan berdasarkan informasi yang tidak akurat atau lama.

Arsitektur Itu Penting

Untuk menerapkan otonomi bertata kelola dalam skala besar, lapisan tata kelola organisasi harus berada di atas model dan vendor individual, menghindari penguncian vendor.

Tata kelola harus ada sebagai lapisan arsitektural, memungkinkan Anda untuk mengganti AI yang mendasari sambil menjaga rambu pengaman tetap utuh.

Platform yang menggabungkan orkestrasi, logika deterministik, dan eksekusi yang transparan sangat penting secara strategis dalam konteks ini. Platform tersebut memungkinkan organisasi memutuskan bagaimana agen berinteraksi dengan data dan proses enterprise.

Ada kesalahpahaman bahwa model yang lebih baik secara otomatis menghasilkan keputusan yang lebih baik. Insiden paling merusak tidak akan ditelusuri ke kesalahan model, melainkan ke manusia yang mendelegasikan tanggung jawab tanpa merancang tanggung jawab itu. Kendali berada pada sistem, bukan model.

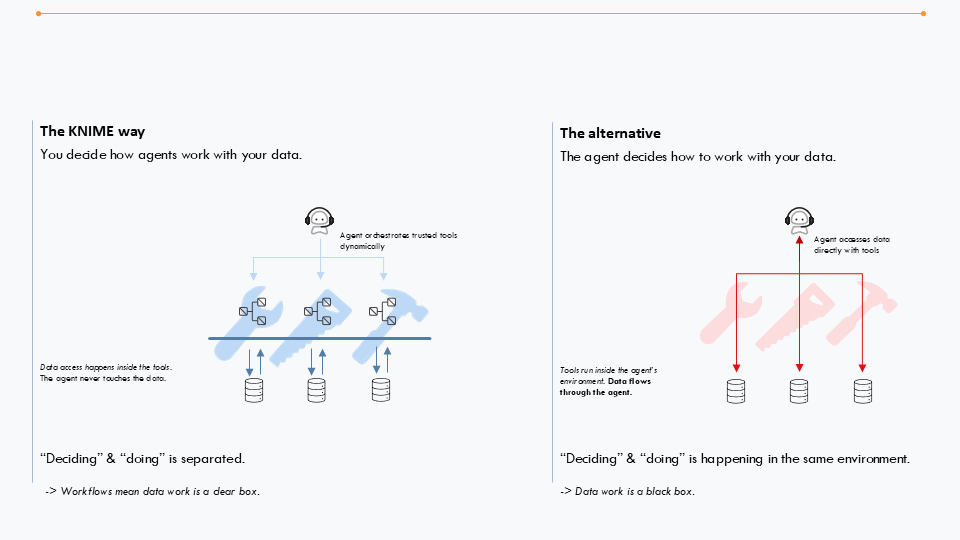

KNIME mengikuti praktik terbaik untuk membangun agen dan memastikan agen tidak pernah menyentuh data

Menyelesaikan Paradoks

Paradoks AI enterprise tidak akan hilang: Organisasi akan menginginkan otonomi yang lebih besar untuk memperoleh efisiensi dan skala yang lebih tinggi, tetapi inspeksi regulatif dan risiko akan meningkat.

Wawasan utamanya adalah bahwa agensi perlu dijamin melalui desain.

Kegagalan paling signifikan di era agentik kecil kemungkinannya berasal dari teknologinya sendiri, melainkan dari tata kelola yang dirancang dengan buruk. Organisasi yang berhasil adalah mereka yang merancang otonomi secara sengaja dan menanamkan pengawasan secara struktural.

Nilai tambah tertinggi adalah ketika platform AI Anda menyediakan kapabilitas tata kelola terintegrasi. Dengan cara ini, organisasi dapat menskalakan otomatisasi dan evaluasi. Anda dapat mempelajari lebih lanjut tentang mengembangkan playbook untuk tata kelola AI melalui webinar DataCamp ini.

Iris Adae adalah VP Data & Analytics di KNIME, di mana ia memimpin strategi data global dan mengusung analitik yang skalabel dan mudah diakses untuk membantu organisasi mengubah data kompleks menjadi wawasan yang dapat ditindaklanjuti. Ia telah bekerja di KNIME sejak 2015.