Tracks

Nghịch lý AI doanh nghiệp mới là thế này: Càng giao phó hành động cho tác tử AI, chúng ta càng đánh mất quyền chủ động của chính mình. Trong kỷ nguyên tác tử, đánh giá và niềm tin, chứ không phải tạo sinh, mới là nút thắt cổ chai.

Chúng ta đã quen với các hệ thống AI chủ yếu hỗ trợ phán đoán của con người. Nhiều trường hợp, chúng ta cũng quen với việc các hệ thống này xác nhận phán đoán và thiên kiến của con người, chứ không thật sự thách thức chúng. Chúng tạo văn bản, tóm tắt thông tin, hoặc đưa ra khuyến nghị.

Tuy nhiên, con người vẫn là người ra quyết định và phê duyệt.

Tác tử AI đã làm thay đổi điều đó. Hệ thống mang tính tác tử không chỉ đưa ra gợi ý, mà còn được thiết kế để lập kế hoạch, quyết định và hành động trong các hệ sinh thái tổ chức phức tạp.

Chúng kích hoạt quy trình làm việc, gọi API, chuyển tiền và cập nhật hồ sơ. Chúng khởi xướng quy trình mà không nhất thiết phải chờ xác nhận của con người. Điều này thay đổi bức tranh rủi ro của doanh nghiệp.

Vấn đề là khi hệ thống tác tử hành động, hậu quả có thể rất tốn kém. Khi một tác tử mắc lỗi mua sắm trị giá 300.000 đô, câu “công cụ đã quyết định” không còn là lời biện hộ khả dĩ. Tổn thất đối với doanh nghiệp là có thật, và ai đó phải chịu trách nhiệm. Trách nhiệm của bạn không biến mất chỉ vì tác tử đã hành động.

Doanh nghiệp muốn tốc độ, quy mô và hiệu quả của các tác tử tự chủ, nhưng trách nhiệm không thể tự động hóa. Ủy quyền hành động cho tác tử không đồng nghĩa với ủy quyền trách nhiệm.

Câu hỏi cốt lõi là: Làm sao mở rộng việc sử dụng AI mang tính tác tử mà không từ bỏ quyền chủ động?

Từ AI Hỗ Trợ đến AI Mang Tính Tác Tử

Để trả lời, chúng ta cần phân biệt giữa AI hỗ trợ và AI mang tính tác tử.

- AI hỗ trợ mặc định có con người trong vòng lặp. Nó đưa ra đề xuất; bạn bấm "chấp nhận." Con người vẫn là chủ thể chính.

- AI mang tính tác tử tiếp quản toàn bộ quy trình từ lập kế hoạch đến thực thi quy trình làm việc và triển khai độc lập. Tác tử điều hướng cơ sở dữ liệu, tương tác với API và tự đưa ra quyết định để đạt mục tiêu.

Sự khác biệt nằm ở mức độ kiểm soát. Trong hệ thống hỗ trợ, quyền chủ động rõ ràng thuộc về con người. Thẩm quyền và trách nhiệm có xu hướng đồng nhất, con người quyết định và hệ thống hỗ trợ. Nhưng trong hệ thống mang tính tác tử, hệ thống hành động, trong khi trách nhiệm cuối cùng vẫn thuộc về con người.

Đây là lúc nghịch lý trở nên trầm trọng hơn.

Khi mức độ tự chủ tăng, việc giám sát liên tục của con người (con người trong vòng lặp) trở nên bất khả thi. Nhưng giảm giám sát lại làm tăng mức độ phơi nhiễm rủi ro, như vi phạm chính sách, sai sót và hệ quả ngoài ý muốn. Còn nếu kìm hãm tác tử quá chặt, tính tự chủ trở thành lý thuyết, và chúng ta đánh mất lợi ích về quy mô và hiệu quả.

Nút Thắt Thực Sự: Đánh Giá

Không thiếu nhà cung cấp hứa hẹn tự động hóa ở quy mô lớn. Tác tử lập kế hoạch, ra quyết định và hành động nhanh hơn bất kỳ đội ngũ nào.

Nhưng khi tác tử hành động, doanh nghiệp đối mặt với câu hỏi mới: Làm sao biết những hành động đó là đúng, an toàn và phù hợp với chính sách của chúng ta?

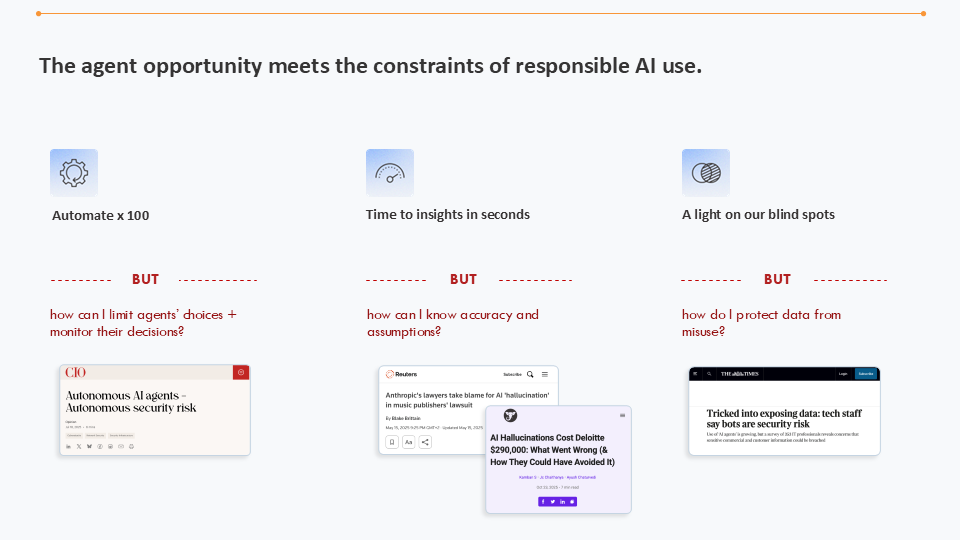

Điều gì xảy ra khi cơ hội cho tác tử gặp phải các ràng buộc của việc sử dụng AI có trách nhiệm

Bản năng phổ biến là thêm bước phê duyệt: có người rà soát và phê chuẩn, và leo thang ngoại lệ. Tuy nhiên, mô hình truyền thống “con người trong vòng lặp” sẽ sụp đổ ở quy mô lớn.

Một tác tử vận hành liên tục có thể đưa ra hàng trăm, thậm chí hàng nghìn quyết định mỗi ngày. Nếu mỗi hành động đều cần đánh giá thủ công, thì “bằng chứng” cuối cùng sẽ vượt quá phần thời gian tiết kiệm ban đầu. Chúng ta sẽ tự động hóa thực thi chỉ để tạo lại nút thắt trong khâu đánh giá.

Và còn một phức tạp khác. Chúng ta đánh giá liệu hành động tác tử thực hiện có đúng, an toàn và bảo mật hay không. Nhưng còn chuyện nói “không” thì sao? Hệ thống có biết khi nào không nên hành động không?

Đây có thể là một trong những vấn đề lớn nhất của AI mang tính tác tử: Một tác tử hữu ích cần có khả năng phát hiện xung đột chính sách, chẳng hạn, và nói “Tôi không thể làm điều này” hoặc “Tôi cần chuyển cho con người xử lý.” Không có năng lực này, tác tử trở thành máy phát ra kết quả, tạo đầu ra dù có nên hay không.

Ở quy mô lớn, kiểu hành vi này sẽ trở thành gánh nặng rủi ro.

Điều này đưa chúng ta trở lại nghịch lý.

Nếu con người không thể rà soát mọi thứ và tác tử không thể tự đánh giá giới hạn của mình một cách tin cậy, thì đánh giá không thể chỉ là một lớp nghiệp vụ bổ sung sau khi triển khai. Nó phải được thiết kế ngay trong bản thân hệ thống

Xem Đánh Giá Như Hạ Tầng, Không Phải Khâu Thủ Công Bổ Sung

Vấn đề vì thế không phải là có cần đánh giá hay không, mà là được triển khai như thế nào.

Tại KNIME, chúng tôi đã thấy điều này trong thực tế. Có lần, chúng tôi xây dựng một tác tử tạo hành động từ insight dữ liệu. Nó giúp tăng tốc công việc đáng kể, nhưng chúng tôi lại tự vấn gần như mọi insight. Chúng ta không nên mù quáng tin tác tử, nhưng niềm tin là điều kiện cần để mở rộng quy mô.

Bước ngoặt đến khi chúng tôi tích hợp phản hồi vào quy trình. Bằng cách gắn nhãn và xác định từng “thất bại”, tác tử học hỏi và cải thiện từ chúng tôi, những con người trong vòng lặp. Theo thời gian, tác tử tiến bộ và niềm tin tăng lên.

Bài học là xây dựng niềm tin vào ngay trong hệ thống: Đánh giá và phản hồi phải trở thành một phần của hệ thống, không phải quy trình gắn thêm.

Mục Tiêu Là Tự Chủ Có Kiểm Soát

Mục tiêu không phải là tự chủ không giới hạn hay giám sát vĩnh viễn của con người, mà là “tự chủ có kiểm soát”, nơi hệ thống hành động độc lập trong các ranh giới được xác định rõ ràng.

Nền tảng của chúng ta cần có câu trả lời cho các tình huống như điều gì xảy ra nếu tác tử sai, có thể chấp nhận bao nhiêu lỗi, và chi phí thất bại so với lợi ích tự động hóa là gì.

Tự chủ có kiểm soát đòi hỏi tổ chức xác định trước:

|

Hàng rào và ràng buộc rõ ràng |

Ví dụ, các điều kiện mà theo đó một tác tử có thể hành động mà không cần can thiệp |

|

Mức dung sai lỗi được xác định |

Ví dụ, các ngưỡng độ tin cậy cần có để tự động thực thi |

|

Chiến lược triển khai dần dần |

Ví dụ, giai đoạn ban đầu sẽ có mức độ rà soát của con người cao để tác tử học hỏi và cải thiện |

Một tác tử có thể vận hành tự chủ trên một mức độ chắc chắn được xác định. Dưới ngưỡng đó, nó phải chuyển cho con người xem xét. Theo thời gian, khi niềm tin và hiệu năng cải thiện và tỷ lệ lỗi giảm, các ngưỡng có thể điều chỉnh, nhưng cơ chế leo thang vẫn phải tồn tại.

Quan trọng là khả năng con người ghi đè phải luôn khả dụng. Tự chủ nên giảm sự can dự thường nhật, chứ không loại bỏ nó.

Cách tiếp cận này tái định khung nghịch lý: Quyền chủ động không mất đi khi được ủy quyền, mà được thực thi dựa trên một khung hàng rào.

Thiết Kế Khung Hàng Rào

Tôi tin rằng niềm tin vào hệ thống mang tính tác tử sẽ đến không phải từ các mô hình tốt hơn, mà từ các khung tốt hơn.

Doanh nghiệp cần một khung hàng rào như một phần của hạ tầng hệ thống. Nó trao quyền cho tác tử đồng thời buộc chúng gắn với logic tất định.

Một khung doanh nghiệp vững chắc nên bao gồm:

1. Hàng rào rõ ràng được tích hợp vào quy trình làm việc

Tác tử không nên chỉ dựa vào dữ liệu để quyết định bước tiếp theo. Chúng phải vận hành trong các quy tắc và ràng buộc định sẵn, phù hợp với chính sách pháp lý, tài chính và tổ chức của doanh nghiệp.

Các quy tắc và ràng buộc này cần được tích hợp vào quy trình làm việc. Như vậy, chính sách mới có thể được thực thi.

2. Khả năng quan sát đầy đủ và kiểm toán được về cách tác tử xây dựng

Doanh nghiệp cần khả năng truy vết cách các quyết định được hình thành và thực thi.

Chỉ nhìn thấy kết quả của tác tử là chưa đủ; tổ chức phải có thể kiểm tra quá trình “tư duy” của nó – lộ trình lập luận, cũng như việc sử dụng công cụ và nguồn dữ liệu.

Điều này cho phép có một đường mòn kiểm toán giải thích vì sao quyết định được đưa ra. Nó tạo tính trách nhiệm, hỗ trợ tuân thủ quy định, và cho phép phân tích sau sự cố.

3. Công cụ tất định

Tác tử không nên ứng biến ở những nơi đã có logic tất định.

Thay vì để tác tử đoán cách tính một biên lợi thuế phức tạp mỗi lần, hãy cung cấp cho nó một công cụ cố định, đã được xác minh (một “nút” hoặc tác vụ con) để thực thi phép tính đó.

Bằng cách này, tác tử trở thành người điều phối các công cụ đáng tin cậy thay vì tạo ra lập luận bất định trong bối cảnh có thể rủi ro cao.

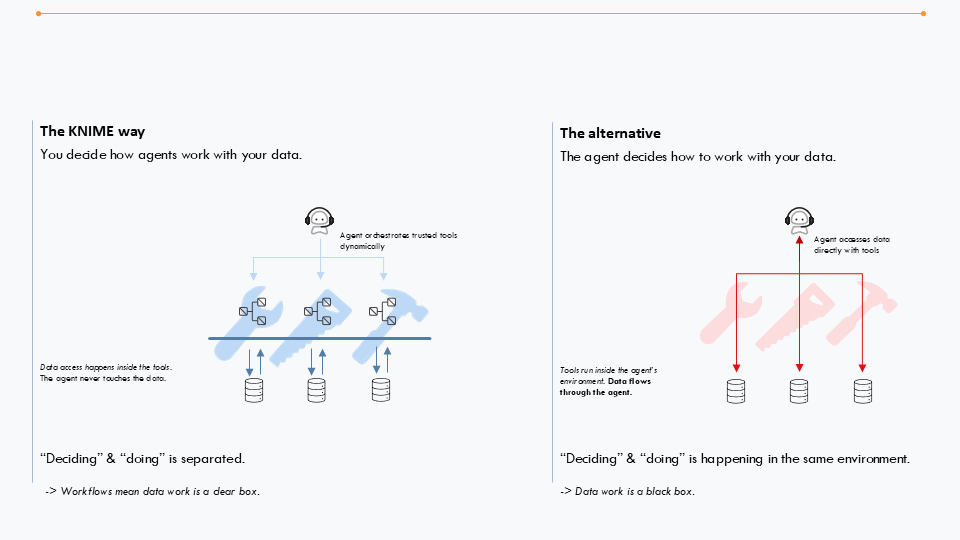

4. Kiểm soát quyền truy cập dữ liệu

Truy cập dữ liệu sâu không phải lúc nào cũng cần thiết.

Tác tử nên truy cập dữ liệu theo nguyên tắc “cần biết”. Trong khi một tác tử hỗ trợ cần lịch sử hội thoại và kho tri thức, có lẽ nó không cần số an sinh xã hội của khách hàng để hoạt động hiệu quả.

5. Vòng lặp phản hồi và bảo trì liên tục

Hệ thống mang tính tác tử không nên chuyển từ thử nghiệm sang tự chủ chỉ trong một bước.

Giai đoạn đầu có thể bao gồm mức độ rà soát của con người cao và giám sát chủ động. Nhưng theo thời gian, khi hiệu năng ổn định và hiểu rõ các chế độ lỗi, có thể mở rộng quyền tự chủ.

Bảo trì liên tục là thiết yếu. Tác tử cần được bảo trì và tối ưu thường xuyên. Dữ liệu có thể dịch chuyển, lỗi thời, và quy định có thể thay đổi. Nếu không được giám sát và hiệu chỉnh, tác tử sẽ đưa ra quyết định dựa trên thông tin không chính xác hoặc cũ.

Kiến Trúc Là Yếu Tố Quan Trọng

Để triển khai tự chủ có kiểm soát ở quy mô lớn, lớp quản trị của tổ chức nên nằm trên các mô hình và nhà cung cấp riêng lẻ, tránh bị khóa chặt vào nhà cung cấp.

Quản trị nên tồn tại như một lớp kiến trúc, cho phép bạn hoán đổi AI nền tảng trong khi vẫn giữ nguyên hàng rào.

Các nền tảng kết hợp điều phối, logic tất định và thực thi minh bạch có ý nghĩa chiến lược trong bối cảnh này. Chúng cho phép tổ chức quyết định cách tác tử tương tác với dữ liệu và quy trình doanh nghiệp.

Có một quan niệm sai lầm rằng mô hình tốt hơn sẽ tự động dẫn đến quyết định tốt hơn. Những sự cố gây thiệt hại nhất sẽ không xuất phát từ lỗi của mô hình, mà từ việc con người ủy quyền trách nhiệm mà không thiết kế trách nhiệm. Quyền kiểm soát nằm ở hệ thống, không phải mô hình.

KNIME tuân thủ các thực hành tốt nhất để xây dựng tác tử và đảm bảo tác tử không bao giờ chạm vào dữ liệu

Tháo Gỡ Nghịch Lý

Nghịch lý AI doanh nghiệp sẽ không biến mất: Tổ chức sẽ muốn tự chủ nhiều hơn để hưởng lợi về hiệu quả và quy mô, nhưng kiểm tra quy định và rủi ro sẽ tăng.

Điều then chốt là quyền chủ động cần được đảm bảo bằng thiết kế.

Những thất bại nghiêm trọng nhất của kỷ nguyên tác tử có lẽ không đến từ bản thân công nghệ, mà từ quản trị kém thiết kế. Những tổ chức thành công sẽ là những tổ chức thiết kế tự chủ một cách có chủ đích và nhúng giám sát một cách cấu trúc.

Điểm cộng nữa là khi nền tảng AI của bạn cung cấp các năng lực quản trị tích hợp. Bằng cách này, tổ chức có thể mở rộng tự động hóa và đánh giá. Bạn có thể tìm hiểu thêm về xây dựng sổ tay cho quản trị AI với hội thảo trên web của DataCamp này.

Iris Adae là Phó Chủ tịch Phụ trách Dữ liệu & Phân tích tại KNIME, nơi cô lãnh đạo chiến lược dữ liệu toàn cầu và thúc đẩy các giải pháp phân tích có thể mở rộng, dễ tiếp cận, giúp các tổ chức chuyển đổi dữ liệu phức tạp thành thông tin chi tiết có thể hành động. Cô làm việc tại KNIME từ năm 2015.