Program

Üretken yapay zeka (Generative AI veya GenAI olarak da bilinir) metin, görsel veya video gibi yeni içerikler üretmeye odaklanan bir yapay zeka alt dalıdır ve çeşitli yapay zeka teknolojilerini kullanır.

GenAI ilerledikçe yazılım geliştirme gibi birçok diğer teknoloji alanına sızıyor. Temellerine dair geniş bir bilgi birikimi bu alanlarda giderek daha önemli hale geliyor.

veri bilimciler, makine öğrenimi uygulayıcıları ve AI mühendisleri gibi roller için üretken yapay zeka kritik bir konudur.

İşte bir mülakatta karşınıza çıkabilecek 30 GenAI mülakat sorusu.

Temel Üretken Yapay Zeka Mülakat Soruları

Önce bazı temel Üretken Yapay Zeka mülakat sorularıyla başlayalım. Bunlar, temel kavram ve ilkeleri ne kadar anladığınızı ölçer.

Ayrıştırıcı (discriminative) ve üretici (generative) modeller arasındaki temel farklar nelerdir?

Ayrıştırıcı modeller sınıflar arasındaki karar sınırını ve onları ayırt eden örüntüleri öğrenir. P(y|x) yani belirli bir etiketin y olma olasılığını, verilen girdi verisi x için tahmin eder. Bu modeller farklı kategorileri ayırt etmeye odaklanır (ör. 'Bu e-posta spam mi?').

Üretici modeller verinin dağılımını, ortak olasılığı modelleyerek P(x,y) öğrenir; bu, bu dağılımdan veri örnekleri üretmeyi içerir. Binlerce rakam görüntüsüyle eğitildikten sonra, bu örnekleme yeni bir rakam görüntüsü üretebilir.

Daha fazlası için şu blogu okuyun: Üretici ve Ayrıştırıcı Modeller: Farklar ve Kullanım Alanları.

Büyük Dil Modelleri (LLM'ler) bağlamında token ve gömme (embedding) nedir?

Token'lar, bir LLM'in işlediği metnin temel birimleridir; tüm sözcükler, heceler veya tek tek harfler olabilir (örneğin, "generative" kelimesi "gener", "at", "ive" olarak bölünebilir).

Gömme vektörleri, bu token'ların anlamlarına göre çok boyutlu bir uzaya yerleştirilen sayısal temsilleridir. Bu dönüşüm, modelin anlamsal anlamı yakalamasını ve sözcükler arasındaki ilişkileri anlamasını sağlar; örneğin "king" ile "queen" arasındaki yakınlığı fark etmek gibi.

Generative Adversarial Networks (GAN) temel ilkelerini açıklayabilir misiniz?

GAN'ler iki sinir ağının birlikte rekabet etmesiyle (Adversarial kelimesi buradan gelir) oluşturulur: bir üretici (generator) ve bir ayrıştırıcı (discriminator).

Üretici sahte veri örnekleri oluştururken ayrıştırıcı bunları gerçek eğitim verisiyle karşılaştırarak değerlendirir. İki ağ eşzamanlı olarak eğitilir:

- Üreticinin amacı, ayrıştırıcının ayırt edemeyeceği kadar gerçek veriye benzeyen görüntüler üretmektir.

- Ayrıştırıcının amacı, verilen bir görüntünün gerçek mi yoksa üretilmiş mi olduğunu doğru biçimde belirlemektir.

Bu rekabetçi öğrenme sayesinde üretici, eğitim verisine benzer son derece gerçekçi veriler üretme konusunda ustalaşır.

Gerçek dünyada üretken yapay zekanın bazı popüler uygulamaları nelerdir?

- Metin üretimi: Sohbet botları, içerik üretimi veya çeviride kullanılır (ChatGPT, Claude, Gemini).

- Görsel üretimi: Sanat veya tasarım için gerçekçi görseller üretme (ör. ChatGPT Images, Nano Banana Pro, Stable Diffusion).

- Kodlama ajanları: Yazılım mühendisliğinde kullanılan, baştan sona kod modülleri yazma.

- Retrieval-Augmented Generation (RAG): Müşteri hizmetleri veya dahili vikilerde kullanılan kurumsal bilgi getirimi.

- İlaç keşfi: İlaçlar için yeni moleküler yapılar tasarlama.

- Veri çoğaltma (augmentation): Az verili veri kümelerini makine öğrenimi için genişletme.

Üretken yapay zeka modellerini eğitme ve değerlendirmeyle ilgili bazı zorluklar nelerdir?

- Hesaplama maliyeti: Daha karmaşık modelleri eğitmek için yüksek hesaplama gücü ve donanım gereksinimleri.

- Eğitim karmaşıklığı: Üretici modellerin eğitimi zor olabilir ve birçok incelik içerir.

- Değerlendirme metrikleri: Model çıktılarının kalitesini ve çeşitliliğini nicel olarak değerlendirmek zordur.

- Veri gereksinimleri: Üretici modeller genellikle yüksek kalite ve çeşitlilikte çok büyük miktarda veri gerektirir. Bu tür verilerin toplanması zaman alıcı ve pahalı olabilir.

- Önyargı ve adalet: Kontrolsüz modeller, eğitim verisinde bulunan önyargıları büyütebilir ve adil olmayan çıktılara yol açabilir.

Üretken yapay zekanın kullanımına ilişkin bazı etik hususlar nelerdir?

GenAI'nın yaygın kullanımı ve kullanım senaryoları, performanslarının etik açısından kapsamlı şekilde değerlendirilmesini gerektirir. Bazı örnekler şunlardır:

- Deepfake'ler: Sahte ama aşırı gerçekçi medya oluşturmak, yanlış bilginin yayılmasına veya kişilerin itibarının zedelenmesine neden olabilir.

- Önyargılı üretim: Eğitim verisindeki tarihsel ve toplumsal önyargıların güçlendirilmesi.

- Fikri mülkiyet: Veride telifli materyalin yetkisiz kullanımı.

Üretken yapay zeka insan yaratıcılığını nasıl destekleyebilir veya artırabilir?

Her ne kadar AI modellerinin halüsinasyonları hatalı çıktılar üretebilse de, bu üretici modeller birçok açıdan ve kullanımda faydalıdır. Çeşitli alanlardaki uzmanlara yaratıcı ilham olarak kullanılabilirler:

- Sanat ve tasarım: Sanat ve tasarımda ilham sağlama.

- Yazma desteği: Başlık ve fikir önerileri ya da metin tamamlama.

- Müzik: Ritimler ve armoniler besteleme.

- Programlama: Mevcut kodu optimize etme veya bir uygulama sorununa yaklaşım yolları sunma.

Temel model ile ince ayarlı (fine-tuned) model arasındaki fark nedir?

Bir Temel Model (GPT-5.2 gibi), genel örüntüleri, akıl yürütmeyi ve dil yapısını öğrenmek için geniş internet verisi üzerinde eğitilir.

İnce Ayarlı bir model, bu genelist tabanı alır ve daha küçük, seçilmiş bir veri kümesi üzerinde belirli bir görevi (örneğin tıbbi teşhis veya belirli bir kodlama dilinde konuşma) ustalıkla yapacak şekilde daha ileri eğitilir. İnce ayar, geniş çok yönlülüğü belirli bir alanda derin uzmanlıkla değiş tokuş eder.

Orta Düzey Üretken Yapay Zeka Mülakat Soruları

Artık temelleri ele aldığımıza göre, orta düzey üretken yapay zeka mülakat sorularını inceleyelim.

GAN'lerde "Mod Çökmesi" (Mode Collapse) nedir ve nasıl ele alınır?

Nasıl ki bir içerik üretici, belirli bir video formatının daha fazla erişim ve etkileşim getirdiğini fark edip buna saplanabiliyorsa, bir GAN'in üretici modeli de ayrıştırıcı modeli kandıran sınırlı çeşitlilikte çıktılara takılı kalabilir. Bu, üreticinin az sayıda çıktı üretmesine ve üretilen verinin çeşitlilik ve esnekliğinin kaybolmasına yol açar.

Olası çözümler arasında, hiperparametreleri ve çeşitli optimizasyon algoritmalarını ayarlayarak eğitim tekniklerine odaklanmak, çeşitliliği teşvik eden düzenlileştirmeler uygulamak veya farklı üretim modlarını kapsamak için birden fazla üreticiyi birleştirmek sayılabilir.

Varyasyonel Otokodlayıcı (VAE) nasıl çalışır?

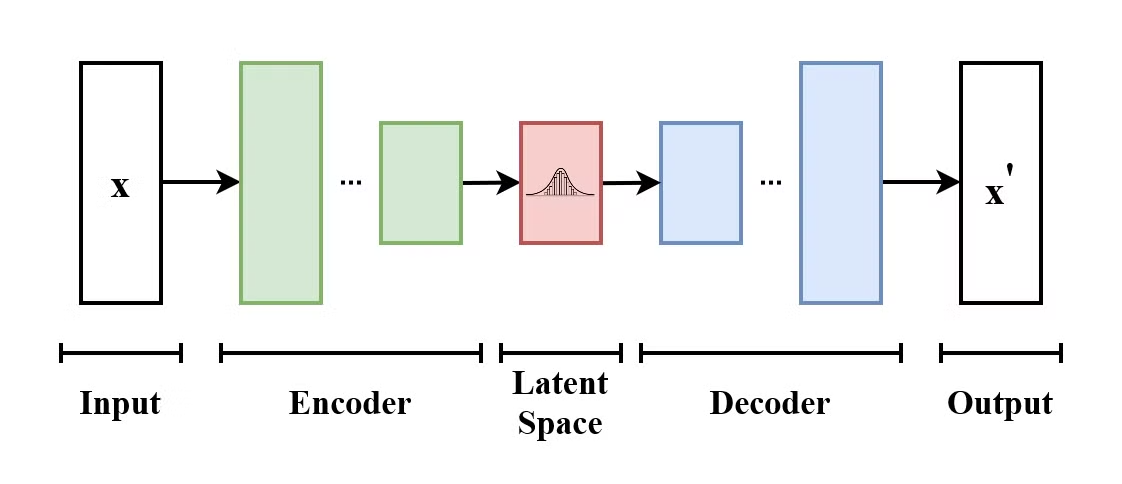

Bir Varyasyonel Otokodlayıcı (VAE), girdi verisini bir gizil (latent) uzaya kodlamayı ve oradan çözerek özgün girdiyi yeniden oluşturmeyi öğrenen bir tür üretici modeldir. VAE'ler kodlayıcı-çözücü modellerdir:

- Kodlayıcı, girdiyi gizil uzay üzerinde bir dağılıma eşler.

- Çözücü, bu gizil uzay dağılımından örnekleyerek girdiyi yeniden oluşturur.

Varyasyonel Otokodlayıcının yapısı. (Kaynak: Wikimedia Commons)

VAE'leri geleneksel otokodlayıcılardan ayıran, gizil uzayın bilinen bir dağılımı (örneğin Gauss) takip etmesini teşvik etmesidir. Bu da, gizil uzaydan örnekleyerek yeni veri üretmekte daha kullanışlı olmalarını sağlar.

Retrieval-Augmented Generation (RAG) ile ince ayar (fine-tuning) arasındaki farkı açıklayın. Hangisini ne zaman kullanırsınız?

RAG bir modeli, yeniden eğitmeden güncel gerçekleri çekmek için harici veri kaynaklarına (örneğin şirket vikinize) bağlar. Modelin parametreleri aynı kalır; yalnızca ek verilere erişir.

İnce ayar, modelin iç ağırlıklarını, nasıl konuştuğunu, davrandığını veya akıl yürüttüğünü değiştirecek şekilde ayarlar; ancak yeni olgusal bilgi eklemede iyi değildir.

Güncel bilgilere (haberler, özel şirket verisi) veya belirli bir atfa ihtiyaç duyduğunuzda RAG kullanın. Modelin yeni bir "davranış"ı, dili veya belirli bir çıktı formatını (ör. SQL ile konuşma) öğrenmesi gerektiğinde ince ayarı kullanın.

Bir LLM uygulamasını nasıl değerlendirirsiniz? 'LLM-as-a-Judge''ı açıklayın.

Üretilen örnekleri değerlendirmek, veri kipine (görsel, metin, video vb.) bağlı karmaşık bir görevdir. Geleneksel metin metrikleri (doğruluk gibi) yaratıcı görevler için yetersizdir; çünkü anlamı değil, yalnızca sözcük örtüşmesini kontrol ederler.

LLM kıyasları ve lider tabloları, bir modelin belirli bir görevi ne kadar iyi yerine getirdiğini ölçmek için standartlaştırılmış testler kullanır. Modelleri karşılaştırmak ve kipler içinde/arasındaki ilerlemeyi takip etmek için faydalıdırlar.

LLM-as-a-Judge, Gemini 3 gibi çok yetkin bir "öğretmen" modelin, daha küçük bir modelin çıktısını doğruya bağlılık, faydalılık ve ton gibi belirli ölçütlere göre notladığı modern bir değerlendirme çerçevesidir. Bu, manuel insan incelemesinin yavaşlığı ve maliyeti olmadan insan tercihlerini yaklaşık olarak ölçekli biçimde elde etmeyi sağlar.

GAN eğitiminde kararlılığı ve yakınsamayı iyileştirmek için hangi teknikler vardır?

GAN eğitiminde kararlılığı ve yakınsamayı iyileştirmek, mod çökmesini önlemek, verimli eğitim sağlamak ve iyi sonuçlar elde etmek için önemlidir. İşte kararlılığı ve yakınsamayı artırmaya yönelik bazı teknikler:

- Wasserstein GAN (WGAN): Kayıp fonksiyonu olarak Wasserstein uzaklığını kullanır; eğitim kararlılığını artırır ve daha pürüzsüz gradyanlar sağlar.

- İki Zaman Ölçekli Güncelleme Kuralı (TTUR): Üretici ve ayrıştırıcı için ayrı öğrenme hızları kullanmak.

- Etiket Yumuşatma: Aşırı güveni önlemek için etiketleri yumuşatır.

- Uyarlamalı öğrenme hızları: Öğrenme hızını dinamik yönetmeye yardımcı olan Adam gibi optimize ediciler kullanmak.

- Gradyan cezası: Lipschitz sürekliliğini dayatmak için ayrıştırıcıda büyük gradyanları cezalandırır ve daha kararlı eğitim sağlar.

Üretken yapay zeka modelleriyle üretilen içeriğin üslubunu veya özelliklerini nasıl kontrol edebilirsiniz?

GenAI çıktılarının üslubunu kontrol etmek için yaygın birkaç teknik vardır:

- İstem (prompt) tasarımı: İstenen çıktı üslubunu, içeriğin üslup veya tonunu vurgulayan ayrıntılı istemlerle belirtin. Bu, hem metinden-metine hem metinden-görüntüye modellerde etkili ve basit bir yöntemdir. Söz konusu belirli modelin gereksinimleri veya dokümantasyonuyla uyumlu yapıldığında çok daha etkilidir.

- Sıcaklık ve örnekleme kontrolü: Sıcaklık parametresi çıktının ne kadar rastgele olacağını kontrol eder. Düşük sıcaklıklar daha temkinli ve öngörülebilir token seçimi, yüksek sıcaklık ise daha yaratıcı üretim sağlar. Top-k ve top-p gibi diğer parametreler de modelin olası bir sonraki tokenları ne kadar yaratıcı seçtiğini kontrol edebilir.

- Yapılandırılmış çıktılar: Yapı için modern modeller "JSON Modu" veya "Yapılandırılmış Çıktılar" kullanır; bu, modelin serbest metin yerine katı biçimde geçerli JSON veya XML şemaları üretmesini kısıtlar.

- Sistem istemleri: Sistem istemleri her yeni mesajla birlikte modele gönderilir. Belirli kişilikleri veya kuralları korumak için kullanıcı girdilerinin önüne geçen kalıcı davranışsal talimatlar ayarlamakta kullanılabilirler.

- Üslup aktarımı (Görseller): Destekleyen modellerde çıkarım sırasında kullanılabilecek bir diğer teknik, bir görselin (referans görsel) üslubunu giriş görseline uygulamaktır.

- İnce ayar: Önceden eğitilmiş bir modeli, istenen üslup veya tonu içeren belirli bir veri kümesi üzerinde ince ayarlayabiliriz. Bu, modele ek belirli üslupları veya nitelikleri öğretmek için modeli ilave verilerle daha ileri eğitmek anlamına gelir.

- Pekiştirmeli öğrenme: Geri bildirim sağlayarak modelin belirli çıktıları tercih etmesini ve diğerlerinden uzak durmasını yönlendirebiliriz. Bu geri bildirim, modeli pekiştirmeli öğrenmeyle değiştirmede kullanılır. Zamanla model, kullanıcıların ve/veya tercih veri kümelerinin tercihlerine hizalanır. LLM bağlamında buna örnek, insan geri bildiriminden pekiştirmeli öğrenme (RLHF)dir.

Üretken yapay zeka modellerindeki önyargı sorununu ele almak için hangi yollar vardır?

Modelin önyargısız ve adil olmasını sağlamak, her aşamada yinelenen ayarlamalar ve izleme gerektirir.

Öncelikle, test verisinin eğitim verisine sızmadığından emin olarak veri kontaminasyonu engellenmelidir. Aksi halde model, genellemek yerine veriyi ezberleyecektir.

Ayrıca eğitim verisinin mümkün olduğunca çeşitli ve kapsayıcı olması sağlanmalıdır. Eğitim sırasında, kayıp fonksiyonuna adalet hedefleri ekleyerek modeli daha adil üretime yönlendirebiliriz.

Model çıktıları düzenli olarak önyargı açısından izlenmelidir. Kamu güvenini artırmak için modelin karar verme sürecini, veri kümesi ayrıntılarını ve ön işleme adımlarını olabildiğince şeffaf kılmak faydalıdır.

Üretici modellerde "Gizil Uzay" (Latent Space) kavramını ve önemini tartışabilir misiniz?

Üretici modeller bağlamında gizil uzay, verinin temel özelliklerini yakalayan ve benzer girdilerin birbirine daha yakın eşlendiği daha düşük boyutlu bir uzaydır. Bu gizil uzaydan örnekleme yapmak, modellere yeni veriler üretme ve belirli öznitelikleri veya özellikleri (görsel varyasyonları üretme) manipüle etme olanağı verir.

Gizil uzaylar, kontrol edilebilir, eğitime sadık ve çeşitli çıktılar üretmenin anahtarıdır.

Üretken yapay zeka modellerinin geliştirilmesinde öz denetimli (self-supervised) öğrenmenin rolü nedir?

Öz denetimli öğrenmenin temel fikri, elle etiketlemeye gerek kalmadan yararlı temsiller öğrenmek için geniş etiketlenmemiş veri derlemlerinden yararlanmaktır. BERT ve GPT gibi modeller, sonraki token tahmini ve dilin yapı ve anlamsal özelliklerini öğrenme gibi öz denetimli yöntemlerle eğitilir. Bu, elde edilmesi maliyetli ve zaman alıcı olan etiketli veriye bağımlılığı azaltır ve modellerin eğitim için geniş etiketlenmemiş veri kümelerinden yararlanmasını sağlar.

Low-Rank Adaptation (LoRA) nedir?

70 milyar parametreli devasa bir modeli yeniden eğitmek çoğu kurum için son derece pahalı ve yavaştır. Low-Rank Adaptation (LoRA), ana model ağırlıklarını dondurup yalnızca üstte yer alan küçük bir "adaptör" katmanını (genellikle toplam parametrelerin %1'inden az) eğiterek bunu çözer. Bu sayede tek bir temel modelden onlarca farklı "özel" modeli sunabilir, hesaplama maliyetini ve depolama ihtiyaçlarını ciddi biçimde azaltabilirsiniz.

İleri Düzey Üretken Yapay Zeka Mülakat Soruları

Daha kıdemli rolleri hedefleyenler veya Üretken Yapay Zeka konusunda derin bir anlayış sergilemek isteyenler için, bazı ileri düzey mülakat sorularını inceleyelim.

"Difüzyon Modelleri" kavramını ve eski mimarilerden nasıl ayrıldıklarını açıklayın.

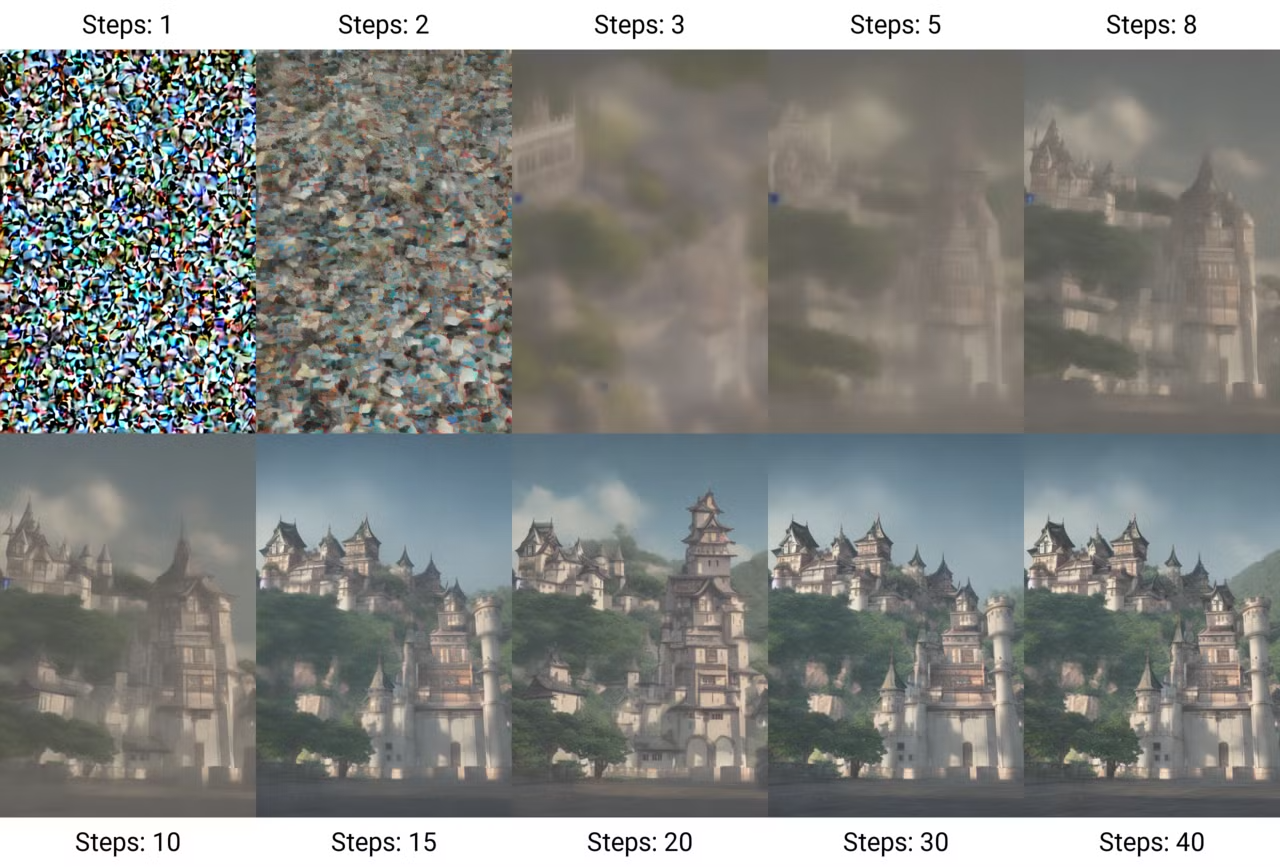

Difüzyon Modelleri, temelde bir görsele kademeli olarak gürültü ekleyip yalnızca gürültü kalana dek bunu sürdürerek ve ardından bu süreci tersine çevirmeyi öğrenerek gürültüden yeni örnekler üretir. Bu sürece difüzyon denir. Bu modeller, yüksek kaliteli ve çok ayrıntılı görseller üretebilme becerileriyle popülerlik kazanmıştır.

Difüzyon adımlarıyla bir görselin üretilmesi. (Kaynak: Wikimedia Commons)

Bu modellerin eğitimi iki adımdan oluşur:

- İleri süreç (difüzyon): Girdi görseline çoklu adımlarda aşamalı olarak gürültü eklemek ve veri tamamen gürültüye dönüşene dek sürdürmek.

- Ters süreç (gürültü giderme): Gürültüden özgün veriyi geri kazanmayı öğrenmek. Bu, bir sinir ağını gürültüyü tahmin edecek şekilde eğitip görseli adım adım gürültüden arındırarak özgün veriyi geri kazanana dek sürdürerek yapılır.

Eğitim kararsızlığıyla sıklıkla boğuşan eski GAN'lerin aksine, difüzyon modelleri daha kararlı ve ölçeklenebilirdir; ancak yinelemeli doğaları nedeniyle daha yavaş olabilirler.

Güncel varyantlar olan gizil difüzyon, üretimi hızlandırmak için sıkıştırılmış bir "gizil uzay"da çalışır ve flow matching mimarileri, daha da iyi performans için standart difüzyonun yerini almaya başlamıştır.

Transformer mimarisi nasıl çalışır ve temel darboğazı nedir?

Transformer mimarisi, “Attention is All You Need” makalesinde tanıtılmış olup, özellikle doğal dil işleme (NLP) alanında üretken yapay zekayı dönüştürmüştür.

Geleneksel yinelemeli sinir ağlarının (RNN) veriyi sıralı şekilde işlemesinin aksine, transformer'lar öz-dikkat (self-attention) mekanizmasını kullanarak girdinin farklı bölümlerine aynı anda ağırlık atar. Bu, bağlamsal ilişkileri etkili biçimde yakalamayı sağlar ve dizilerin paralel işlenmesine olanak vererek eğitimi önemli ölçüde hızlandırır.

Temel darboğaz, bu dikkat mekanizmasının dizi uzunluğuyla karesel olarak ölçeklenmesidir—bağlam penceresini iki katına çıkarmak, hesaplamayı dört katına çıkarır. Bu da "sonsuz bağlamı" teoride mümkün, fakat hesaplama açısından pahalı kılar ve daha verimli dikkat yöntemlerine yönelik araştırmaları tetikler.

"Akıl Yürütme Modeli" (Sistem 2 düşünme) nedir ve standart bir LLM'den nasıl ayrılır?

Standart LLM'ler "Sistem 1" düşünürler olarak hareket eder; yüzey düzeyindeki örüntülere dayanarak bir sonraki kelimeyi anında tahmin ederler.

Akıl Yürütme Modelleri (Gemini 3 veya DeepSeek-R1 gibi), yanıt vermeden önce gizli bir "Düşünce Zinciri" üretmek üzere eğitilir; bu da onların "düşünmesine", plan yapmasına ve hatalarını kendi kendine düzeltmesine olanak tanır. Bu, onları karmaşık matematik, kodlama ve mantık bulmacalarında belirgin biçimde daha iyi kılar; ancak çalıştırılmaları daha yavaş ve daha pahalıdır.

Üretken yapay zeka ile yüksek çözünürlüklü veya uzun biçimli içerik üretmenin zorluklarını tartışabilir misiniz?

AI üretiminin karmaşıklığını artırdıkça şu konuları da ele almalısınız:

- Hesaplama maliyeti: Yüksek çözünürlüklü çıktılar daha büyük ağlar ve daha fazla hesaplama gücü gerektirir.

- Çoklu GPU eğitimi: Daha büyük modeller tek bir GPU'ya sığmayabilir ve çoklu GPU eğitimi gerekir. Çevrimiçi platformlar, bu tür sistemlerin uygulanmasındaki karmaşıklığı hafifletebilir.

- Eğitim kararlılığı: Daha büyük ağlar ve karmaşık mimariler, kararlı bir eğitim prosedürü sürdürmeyi zorlaştırır.

- Veri kalitesi: Daha yüksek çözünürlük ve daha uzun içerik, daha yüksek kaliteli veri gerektirir.

Üretken yapay zeka alanındaki ortaya çıkan eğilimler ve araştırma yönelimleri nelerdir?

GenAI alanı hızlı bir şekilde evrilip yeniden şekilleniyor. Buna şunlar dahildir:

- Multimodal Modeller: Metin, ses ve görsel gibi birden çok veri biçimini entegre etme.

- Küçük dil modelleri (SLM'ler): Büyük dil modellerinin aksine, SLM'ler verimlilikleri ve uyarlanabilirlikleri nedeniyle ilgi görüyor. Daha az hesaplama kaynağı gerektirdiklerinden, sınırlı yeteneklere sahip ortamlara dağıtım için uygundurlar—bu konuda daha fazlası için uç (edge) AI blogunu okuyun.

- Etik AI: Üretici modellerin hizalı performansını sağlamak için çerçeveler geliştirme.

- Video için Üretici Modeller: GenAI ile ultra gerçekçi ve tutarlı videolar üretimindeki ilerlemeler. En yeni örnekler arasında Sora AI, Meta Movie Gen ve Runway Act-One yer alır.

Sağlık gibi belirli bir sektörde kişiselleştirilmiş içerik üretmek için üretken yapay zekayı kullanan bir sistemi nasıl tasarlarsınız?

Sektöre özgü kullanım senaryoları için üretken yapay zekayı kullanan bir sistem tasarlamak kapsamlı bir yaklaşımdır. Genel yönergeler, diğer sektörlere göre uyarlanıp değiştirilebilir.

- Sektör ihtiyaçlarını anlama: Bir sektörün alan bilgisi, böyle bir sistemin tasarımına yön veren kararları büyük ölçüde etkiler. İlk adım, sektörün genel ve pratik bilgisini; temellerini, kavramlarını, hedeflerini ve gereksinimlerini edinmektir.

- Veri toplama ve yönetimi: Olası veri sağlayıcılarını belirleyin. Sağlıkta bu, tedavi ayrıntıları, hasta bilgileri, tıbbi kılavuzlar vb. ile ilgili olarak sağlık hizmeti sunucularından veri toplamaktır. Veri Gizliliği ve Güvenliği gibi sektöre özgü güvenlik önlemleri belirlenip gözetilmelidir. Verinin yüksek kaliteli, doğru, güncel ve farklı grupları temsil edici olduğundan emin olun.

- Model seçimi: Önceden eğitilmiş modelleri ince ayarlayıp ayarlamayacağınıza veya sıfırdan mimariler geliştirip geliştirmeyeceğinize karar verin. Projenin türüne bağlı olarak en uygun üretken yapay zeka modeli değişebilir. GPT-4o gibi bir model tak-çalıştır bir seçenek olabilir. Bazı alanlarda, gizlilik nedenleriyle yerelde barındırılan modeller gerekir. Bu durumda açık kaynak modeller tercih edilmelidir. Bu modelleri, daha önce topladığınız sektöre özgü veriler üzerinde ince ayar yapmayı düşünün.

- Çıktı doğrulama: Üretilen içeriğin uygulamaya konmadan önce uzmanlar ve profesyoneller tarafından doğrulandığı kapsamlı bir değerlendirme süreci uygulayın.

- Ölçeklenebilirlik: Gerekli yükleri performansı bozmadan karşılayacak ölçeklenebilir bir bulut tabanlı altyapı tasarlayın.

- Hukuki ve etik hususlar: AI kullanımına ilişkin net etik yönergeler belirleyin ve modelinizin olası sınırlamalarını şeffafça iletin. Fikri mülkiyet haklarına saygı gösterin ve bunlarla ilgili sorunları ele alın.

- Sürekli iyileştirme: Sistemin performansını ve uzmanların üretilen içeriğe yönelik değerlendirmelerini düzenli olarak gözden geçirin. Daha fazla içgörü ve veri toplayarak modeli daha iyiye uyarlayın.

LLM'ler bağlamında "bağlam içi öğrenme" (in-context learning) kavramını açıklayın.

Bağlam içi öğrenme, LLM'lerin ek ince ayara gerek olmadan sağlanan bağlama göre üslup ve çıktısını değiştirme yeteneğidir.

few-shot öğrenme veya prompt mühendisliği olarak da adlandırılabilir. Bu, istenen yanıtın bir veya birden çok örneğini belirtmekle ya da modelin nasıl davranması gerektiğini açıkça tarif etmekle sağlanabilir.

Bağlam içi öğrenmenin sınırlamaları da vardır. Kısa vadelidir ve göreve özeldir; çünkü model, bu tekniği kullandığınız diğer oturumlarda gerçekten bir bilgi tutmaz.

Ayrıca, istenen çıktı karmaşıksa, model çok sayıda örneğe ihtiyaç duyabilir. Verilen örnekler yeterince açık değilse veya görev modelin kapasitesini aşıyorsa, bazen hatalı veya tutarsız çıktılar üretebilir.

İstemler, modelden istenen davranışları veya çıktıları ortaya çıkarmak için stratejik olarak nasıl tasarlanabilir? Etkili prompt mühendisliği için en iyi uygulamalar nelerdir?

İstemleme, LLM'leri belirli görevlere yanıt vermeye yönlendirmede önemlidir. Etkili istemler, few-shot öğrenme, görev ayrıştırma ve istem şablonları gibi tekniklerle modelin ince ayar ihtiyacını bile azaltabilir.

Etkili prompt mühendisliği için bazı en iyi uygulamalar şunlardır:

- Açık ve öz olun: Modele tam olarak hangi görevi yapmasını istediğinizi bilecek şekilde net talimatlar verin. Düz ve doğrudan olun.

- Örnek kullanın: Bağlam içi öğrenme için birkaç girdi-çıktı çifti göstermek, modelin görevi istediğiniz şekilde anlamasına yardımcı olur.

- Karmaşık görevleri parçalayın: Görev karmaşıksa, onu daha küçük adımlara bölmek yanıt kalitesini artırabilir.

- Kısıtlar veya formatlar belirleyin: Belirli bir çıktı üslubu, formatı veya uzunluğu gerekiyorsa, bu gereksinimleri istem içinde açıkça belirtin.

Daha fazlası için şu blogu okuyun: İstem Optimizasyon Teknikleri.

Üretken yapay zeka modellerinin çıkarım (inference) hızını optimize etmek için hangi teknikler vardır?

- Model budama (pruning): Model boyutunu azaltmak için gereksiz ağırlık/katmanların kaldırılması.

- Kantizasyon: Model ağırlıklarının hassasiyetini fp16/int8'e düşürmek.

- Bilgi damıtma (distillation): Daha küçük bir modeli daha büyük olanı taklit edecek şekilde eğitmek.

- GPU hızlandırma: Özelleşmiş donanım kullanmak.

"Koşullu Üretim" (Conditional Generation) kavramını ve Koşullu GAN'larda (cGAN) nasıl uygulandığını açıklayabilir misiniz?

Koşullu Üretim, modelin belirli koşullar veya bağlamlara göre çıktı üretmesini içerir. Bu, üretilen içerik üzerinde daha fazla kontrol sağlar. Koşullu GAN'lerde (cGAN) hem üretici hem de ayrıştırıcı, sınıf etiketleri gibi ek bilgilerle koşullandırılır. Nasıl çalıştığı şöyledir:

- Üretici: Koşula uygun veri üretmek için hem gürültüyü hem koşullu bilgiyi (ör. sınıf etiketi) alır.

- Ayrıştırıcı: Üretilen verinin gerçekliğini, koşullu bilgiyi de dikkate alarak değerlendirir.

Mixture of Experts (MoE) mimarisini açıklayabilir misiniz? Neden büyük modeller için tercih edilir?

Mixture of Experts (MoE), tek bir yoğun sinir ağı yerine birçok uzmanlaşmış "uzman" alt ağı kullanır. Her bir token için bir yönlendirici, veriyi işlemesi adına yalnızca en alakalı uzmanları seçer; bu da bir modelin 100 milyar parametresi olsa bile çıkarımda yalnızca 10 milyarını kullanabileceği anlamına gelir.

Bu mimari, modellerin inanılmaz derecede zeki (yüksek toplam parametre sayısı) olurken aynı zamanda hızlı ve ucuz çalışmasını (düşük aktif parametre sayısı) sağlar.

Bir AI Mühendisi İçin Üretken Yapay Zeka Mülakat Soruları

Üretken yapay zekaya odaklanan bir AI mühendisliği rolü için mülakata giriyorsanız, üretici modelleri tasarlama, uygulama ve dağıtma yeteneğinizi değerlendiren sorular bekleyin.

Ajanslı (agentic) iş akışı ile standart bir sohbet botu arasındaki fark nedir?

Standart bir sohbet botu pasiftir: bir sorgu alır ve eğitimi temelinde metin bir yanıt üretir.

Ajanslı bir iş akışı, LLM'e araçlara (web tarayıcı, kod yorumlayıcı veya API gibi) erişim ve bir hedefi çözmek için çok adımlı bir süreç planlama özerkliği verir. Ajan, web'de arama yapmayı, veriyi Python koduyla analiz etmeyi ve ardından bir rapor yazmayı planlayabilir; görev tamamlanana kadar döngüyü sürdürebilir.

Guardrails kullanarak LLM dağıtımında güvenliği ve sağlamlığı nasıl sağlarsınız?

LLM'lerin güvenliğini ve sağlamlığını sağlamak çeşitli zorluklar barındırır. Birincil zorluk, bu modellerin geniş hatta filtrelenmemiş veri kaynaklarıyla eğitilmeleri nedeniyle zararlı veya önyargılı çıktılar üretme potansiyelidir; toksik veya yanıltıcı içerik üretebilirler.

LLM kaynaklı içeriğin bir diğer büyük sorunu, modelin gerçekte yanlış olan bilgileri kendinden emin bir üslupla üretmesi anlamına gelen halüsinasyon tehlikesidir. Bir başka zorluk da, modelin güvenlik önlemlerini ihlal edip zararlı veya etik dışı yanıtlar üreten düşmanca istemlere karşı güvenliktir; bu, çeşitli modellerde defalarca kanıtlanmıştır.

Güvenlik filtreleri ve moderasyon katmanları eklemek, üretilen zararlı içeriği tespit etmeye ve kaldırmaya yardımcı olabilir. Sürekli insan denetimi (human-in-the-loop) model güvenliğini daha da artırır.

Buna ek olarak mühendisler, kullanıcı ile model arasına yerleştirilen açık Guardrails (NeMo Guardrails veya Llama Guard gibi) uygulamalıdır. Bu sistemler, girdileri prompt enjeksiyonu girişimleri veya KKB (Kişisel Kimlik Bilgileri) sızıntıları için tarar ve çıktıları, kullanıcıya ulaşmadan önce toksik veya halüsinatif yanıtları yakalamak için tarar. Bu, modelin olasılıksal doğasından bağımsız çalışan deterministik bir güvenlik katmanı oluşturur.

Üretken yapay zekayla ilgili zorlayıcı bir projeyi anlatın. Temel zorluklar nelerdi ve bunların üstesinden nasıl geldiniz?

Bu sorunun yanıtı, projelerinize ve deneyimlerinize oldukça özeldir. Yine de aşağıdaki noktaları aklınızda tutabilirsiniz:

- Belirli bir proje seçin: Önyargı, model doğruluğu veya halüsinasyon gibi net AI zorlukları olan bir proje seçin.

- Zorluğu netleştirin ve teknik/operasyonel güçlüğü açıklayın.

- Yaklaşımınızı gösterin : Veri çoğaltma, model ayarı veya uzmanlarla iş birliği gibi yararlandığınız temel stratejilerden bahsedin.

- Sonuçları vurgulayın ve etkiyi sayısallaştırın—artırılmış doğruluk, daha iyi kullanıcı etkileşimi veya bir iş probleminin çözülmesi.

Üretici yapay zeka modellerini üretim ortamlarında uygulama ve dağıtma deneyiminizi tartışabilir misiniz?

Yukarıdaki soruda olduğu gibi, bu soru da deneyiminize dayalı yanıtlanabilir; ancak şunları da aklınızda bulundurun:

- Dağıtıma odaklanın: Altyapıdan (bulut hizmetleri, MLOps araçları) ve temel dağıtım görevlerinden (ölçekleme, düşük gecikme optimizasyonu) bahsedin. Ayrıntıya girmenize gerek yok; oyuna hâkim olduğunuzu göstermeniz yeterlidir.

- Bir zorluktan bahsedin: Uzmanlığınızı göstermek için kaçınılması gereken bir-iki yaygın zorluğu anmanız faydalı olur.

- Dağıtım sonrası konuları ele alın: Tutarlı performans için izleme ve bakım stratejilerini dahil edin.

- Güvenliği ele alın: Yayın sırasında önyargı veya güvenliği ele almak için alınan önlemlerden bahsedin.

Uzun metin pencerelerinde "ortada kaybolma" (lost in the middle) olgusunu nasıl ele alırsınız?

Bağlam pencereleri çok büyük olsa bile (ör. 1 milyon token), LLM'ler sıklıkla istemin ortasına gömülü bilgiyi getirmekte zorlanır; başlangıç ve sona öncelik verir.

Mühendisler bunu, en kritik getirilen parçaları bağlam penceresinin başına veya sonuna taşıyan akıllı yeniden sıralama algoritmalarıyla hafifletir. Bir diğer strateji, uzun belgenin bölümlerini modelin bağımsız olarak özetlediği ve ardından bunları nihai bir yanıt için birleştirdiği "harita-azalt" (map-reduce) algoritmasıdır.

Uçtan uca bir RAG sistemi kurma görevine nasıl yaklaşırsınız?

Bir RAG sistemi kurmak sistematik bir yaklaşım gerektirir. Hat şu şekilde görünebilir:

- Etkili Parçalama: Bağlamın korunmasını sağlamak için belgeleri, keyfi karakter sayılarına göre değil, anlamsal veya özyinelemeli stratejilerle anlamlı segmentlere bölün.

- Vektör Depolama: Bu parçaları yüksek performanslı bir gömme modeliyle gömün ve ön filtreleme için zengin meta veriler (tarih veya yazarlar gibi) ekleyerek bir vektör veritabanında saklayın.

- Hibrit Arama: Belirli terimler ve daha geniş kavramları yakalamak için anahtar sözcük aramasını (BM25) vektör aramayla (anlamsal benzerlik) birleştiren bir getirim katmanı uygulayın.

- Yeniden sıralama: İlk getirilen sonuçları yeniden puanlamak için bir çapraz kodlayıcı model uygulayın ve alakasız "gürültü" parçalarını LLM'ye ulaşmadan önce agresif biçimde ayıklayın.

- Atıf ve Üretim: Halüsinasyonu önlemek için LLM'yi yalnızca sağlanan bağlama dayanarak yanıt üretmeye yönlendirin ve belirli kaynak belgeleri atıf olarak vermesini şart koşun.

Üretken yapay zeka alanında heyecan verici bulduğunuz açık araştırma soruları veya alanlar nelerdir?

Yanıt burada da kişisel tercihlere bağlıdır; ancak şu başlıklardan bahsedebilirsiniz:

- Model yorumlanabilirliğini artırma: Üretici modelleri daha şeffaf ve yorumlanabilir kılmak.

- Etik çerçeveler: Sorumlu AI için yönergeler geliştirmek.

- Çapraz kip üretim: Birden fazla veri türü (görsel, metin vb.) üzerinden içerik üretmek.

- Düşmanca dayanıklılık: Modelleri düşmanca saldırılara karşı dirençli kılmak.

- Akıl yürütme yetenekleri: LLM'lerin akıl yürütme gücünü artırmak.

Sonuç

Üretken Yapay Zeka, hayatımızın ve kariyerlerimizin çeşitli yönlerini etkilemenin yollarını buldukça, temel konulara meraklı bir gözle bakmak hayati önem taşır. Bir mülakatta sorulabilecek olası GenAI soruları belirli role ve şirkete bağlı olsa da, mülakat hazırlık yolculuğunuza başlamanıza yardımcı olmak için 30 soru ve yanıtı örneklemeye çalıştım.

Daha fazla mülakat sorusu keşfetmek için şu blogları öneririm:

Yapay Zeka alanında yüksek lisans öğrencisi ve yapay zeka teknik yazarı. En yeni yapay zeka teknolojilerine dair içgörüler paylaşıyorum, ML araştırmalarını erişilebilir kılıyor ve sizi ön planda tutmak için karmaşık YZ konularını sadeleştiriyorum.