Tracks

Trí tuệ nhân tạo tạo sinh (còn được gọi là Generative AI hoặc GenAI) là một phân nhánh của AI tập trung vào việc tạo nội dung mới, như văn bản, hình ảnh hoặc video, bằng nhiều công nghệ AI khác nhau.

Khi GenAI phát triển, nó len lỏi vào nhiều lĩnh vực công nghệ khác, như phát triển phần mềm. Kiến thức rộng về các nền tảng cơ bản của nó sẽ ngày càng trở nên quan trọng trong các lĩnh vực này.

Đối với các vai trò như nhà khoa học dữ liệu, người làm machine learning và kỹ sư AI, AI tạo sinh là một chủ đề then chốt cần nắm vững.

Dưới đây là 30 câu hỏi phỏng vấn GenAI mà bạn có thể gặp trong một buổi phỏng vấn.

Câu hỏi phỏng vấn cơ bản về AI tạo sinh

Hãy bắt đầu với một số câu hỏi nền tảng về AI tạo sinh. Chúng sẽ kiểm tra mức độ hiểu biết của bạn về các khái niệm và nguyên tắc cốt lõi.

Sự khác nhau chính giữa mô hình phân biệt (discriminative) và mô hình tạo sinh (generative) là gì?

Mô hình phân biệt học ranh giới quyết định giữa các lớp và các mẫu giúp phân biệt chúng. Chúng ước lượng xác suất P(y|x), tức xác suất của nhãn y cụ thể khi biết dữ liệu đầu vào x. Các mô hình này tập trung vào việc phân biệt giữa các danh mục khác nhau (ví dụ: "Email này có phải spam không?").

Mô hình tạo sinh học phân phối của chính dữ liệu bằng cách mô hình hóa xác suất đồng thời P(x,y), bao gồm việc lấy mẫu các điểm dữ liệu từ phân phối này. Sau khi được huấn luyện trên hàng nghìn ảnh chữ số, việc lấy mẫu này có thể sinh ra một ảnh chữ số mới.

Đọc thêm trong blog này về Mô hình tạo sinh vs mô hình phân biệt: Khác nhau & Trường hợp sử dụng.

Token và embedding trong bối cảnh Mô hình ngôn ngữ lớn (LLM) là gì?

Token là các đơn vị văn bản cơ bản mà một LLM xử lý; chúng có thể là từ hoàn chỉnh, âm tiết, hoặc thậm chí từng chữ cái (ví dụ, từ "generative" có thể được tách thành "gener", "at", "ive").

Embedding là các biểu diễn vectơ số của những token đó, đặt chúng vào một không gian đa chiều dựa trên ý nghĩa. Việc chuyển đổi này giúp mô hình nắm bắt ngữ nghĩa và hiểu mối quan hệ giữa các từ, chẳng hạn nhận ra "king" gần với "queen".

Bạn có thể giải thích các nguyên lý cơ bản đằng sau Mạng đối nghịch tạo sinh (GAN) không?

GAN gồm hai mạng nơ-ron cạnh tranh với nhau (vì vậy mới có chữ Adversarial): một bộ sinh (generator) và một bộ phân biệt (discriminator).

Bộ sinh tạo ra mẫu dữ liệu giả, còn bộ phân biệt đánh giá chúng so với dữ liệu huấn luyện thật. Hai mạng được huấn luyện đồng thời:

- Bộ sinh nhằm tạo ra ảnh không thể phân biệt với dữ liệu thật để bộ phân biệt không nhận ra.

- Bộ phân biệt nhằm xác định chính xác một ảnh là thật hay được sinh ra.

Thông qua học cạnh tranh, bộ sinh dần thành thạo trong việc tạo dữ liệu rất chân thực, tương tự dữ liệu huấn luyện.

Một số ứng dụng phổ biến của AI tạo sinh trong thực tế là gì?

- Sinh văn bản: Dùng trong chatbot, sáng tạo nội dung hoặc dịch thuật (ChatGPT, Claude, Gemini).

- Sinh hình ảnh: Tạo ra hình ảnh chân thực cho nghệ thuật hoặc thiết kế (ví dụ, ChatGPT Images, Nano Banana Pro, Stable Diffusion).

- Tác nhân lập trình (coding agents): Viết trọn các mô-đun mã, được dùng trong kỹ nghệ phần mềm.

- Retrieval-Augmented Generation (RAG): Truy xuất tri thức doanh nghiệp, dùng trong chăm sóc khách hàng hoặc wiki nội bộ.

- Phát hiện thuốc: Thiết kế cấu trúc phân tử mới cho dược phẩm.

- Bổ sung dữ liệu (data augmentation): Mở rộng các bộ dữ liệu ít mẫu cho machine learning.

Một số thách thức khi huấn luyện và đánh giá mô hình AI tạo sinh là gì?

- Chi phí tính toán: Yêu cầu năng lực tính toán và phần cứng cao để huấn luyện các mô hình phức tạp hơn.

- Độ phức tạp huấn luyện: Huấn luyện mô hình tạo sinh có thể khó và nhiều tinh chỉnh.

- Chỉ số đánh giá: Khó đánh giá định lượng chất lượng và tính đa dạng của đầu ra mô hình.

- Yêu cầu dữ liệu: Mô hình tạo sinh thường cần lượng dữ liệu khổng lồ, chất lượng cao và đa dạng. Thu thập dữ liệu như vậy có thể tốn thời gian và chi phí.

- Thiên lệch và công bằng: Nếu không kiểm soát, mô hình có thể khuếch đại thiên lệch có trong dữ liệu huấn luyện, dẫn tới đầu ra thiếu công bằng.

Những cân nhắc đạo đức nào xoay quanh việc sử dụng AI tạo sinh?

Việc sử dụng rộng rãi GenAI và các trường hợp ứng dụng của nó đòi hỏi đánh giá kỹ lưỡng hiệu năng về mặt đạo đức. Một số ví dụ gồm:

- Deepfake: Tạo ra nội dung giả nhưng siêu chân thực có thể lan truyền thông tin sai lệch hoặc bôi nhọ cá nhân.

- Sinh có thiên lệch: Khuếch đại các thiên lệch lịch sử và xã hội trong dữ liệu huấn luyện.

- Sở hữu trí tuệ: Sử dụng trái phép tài liệu có bản quyền trong dữ liệu.

AI tạo sinh có thể được dùng để bổ trợ hoặc nâng cao tính sáng tạo của con người như thế nào?

Mặc dù hiện tượng ảo giác của các mô hình AI có thể tạo ra đầu ra sai lệch, các mô hình tạo sinh lại hữu ích ở nhiều khía cạnh và mục đích. Chúng có thể được dùng như nguồn cảm hứng sáng tạo cho chuyên gia ở nhiều lĩnh vực:

- Nghệ thuật và thiết kế: Gợi ý ý tưởng trong nghệ thuật và thiết kế.

- Hỗ trợ viết: Đề xuất tiêu đề, ý tưởng viết hoặc hoàn thiện văn bản.

- Âm nhạc: Sáng tác nhịp điệu và hoà âm.

- Lập trình: Tối ưu mã hiện có hoặc gợi ý cách tiếp cận một bài toán hiện thực hóa.

Sự khác nhau giữa mô hình nền tảng và mô hình fine-tune là gì?

Một Mô hình Nền tảng (như GPT-5.2) được huấn luyện trên lượng lớn dữ liệu internet rộng để học các mẫu tổng quát, suy luận và cấu trúc ngôn ngữ.

Một mô hình Fine-Tuned lấy nền tảng tổng quát này và huấn luyện tiếp trên một tập dữ liệu nhỏ hơn, được chọn lọc để làm chủ một nhiệm vụ cụ thể, như chẩn đoán y khoa hoặc nói bằng một ngôn ngữ lập trình cụ thể. Fine-tuning đánh đổi tính đa năng rộng cho mức độ chuyên sâu hơn trong một lĩnh vực cụ thể.

Câu hỏi phỏng vấn trung cấp về AI tạo sinh

Sau khi đã bao quát những điều cơ bản, hãy khám phá một số câu hỏi phỏng vấn AI tạo sinh ở mức trung cấp.

"Mode Collapse" trong GAN là gì và xử lý ra sao?

Tương tự như một nhà sáng tạo nội dung thấy định dạng video nào đó mang lại nhiều lượt tiếp cận và tương tác hơn, bộ sinh của GAN có thể bị ám ảnh vào một số ít kiểu đầu ra đánh lừa được bộ phân biệt. Hệ quả là bộ sinh chỉ tạo một tập đầu ra nhỏ, làm giảm tính đa dạng và linh hoạt của dữ liệu sinh ra.

Các giải pháp có thể gồm tập trung vào kỹ thuật huấn luyện bằng cách điều chỉnh siêu tham số và các thuật toán tối ưu khác nhau, áp dụng các quy chuẩn hoá (regularization) khuyến khích đa dạng, hoặc kết hợp nhiều bộ sinh để bao phủ các "mode" sinh dữ liệu khác nhau.

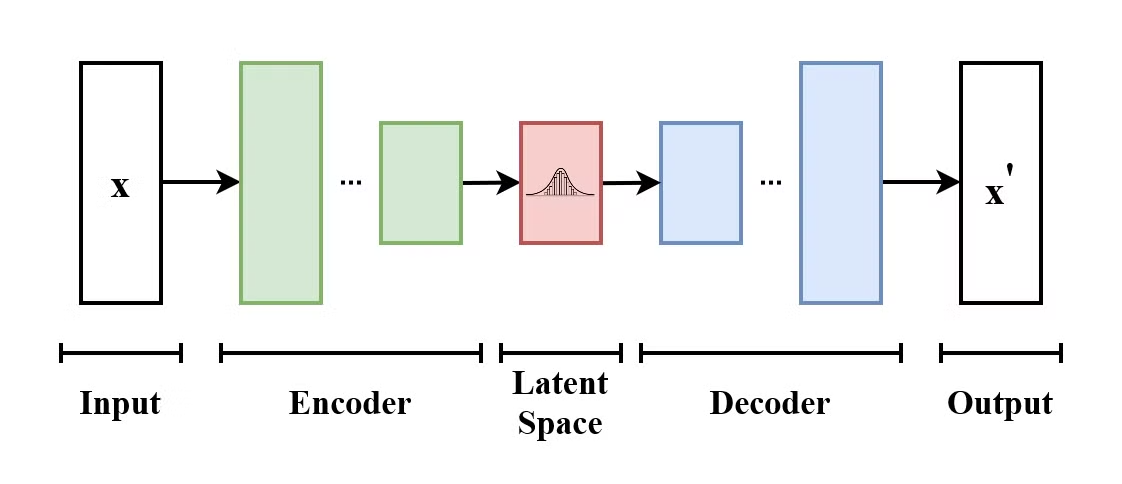

Variational Autoencoder (VAE) hoạt động như thế nào?

Một Variational Autoencoder (VAE) là một loại mô hình tạo sinh học cách mã hoá dữ liệu đầu vào vào không gian tiềm ẩn và giải mã ngược để tái tạo dữ liệu gốc. VAE là các mô hình mã hoá - giải mã:

- Bộ mã hoá ánh xạ dữ liệu đầu vào thành một phân phối trên không gian tiềm ẩn.

- Bộ giải mã lấy mẫu từ phân phối không gian tiềm ẩn này để tái tạo dữ liệu đầu vào.

Cấu trúc của Variational Autoencoder. (Nguồn: Wikimedia Commons)

Điểm khác biệt của VAE so với autoencoder truyền thống là VAE khuyến khích không gian tiềm ẩn tuân theo một phân phối đã biết (như Gaussian). Điều này khiến chúng hữu ích hơn trong việc sinh dữ liệu mới bằng cách lấy mẫu từ không gian tiềm ẩn này.

Giải thích sự khác nhau giữa Retrieval-Augmented Generation (RAG) và fine-tuning. Khi nào dùng cái nào?

RAG kết nối mô hình với các nguồn dữ liệu bên ngoài (như wiki công ty của bạn) để truy xuất thông tin cập nhật mà không cần huấn luyện lại mô hình. Tham số của mô hình giữ nguyên; nó chỉ được truy cập thêm dữ liệu.

Fine-tuning sửa đổi trọng số bên trong của mô hình để thay đổi cách nó nói, hành xử hoặc suy luận, nhưng không phù hợp để bổ sung kiến thức thực tế mới.

Dùng RAG khi bạn cần thông tin cập nhật (tin tức, dữ liệu riêng của công ty) hoặc trích dẫn cụ thể. Dùng fine-tuning khi bạn cần mô hình học một "hành vi" mới, ngôn ngữ, hoặc định dạng đầu ra cụ thể (ví dụ: nói bằng mã SQL).

Bạn sẽ đánh giá một ứng dụng LLM như thế nào? Giải thích 'LLM-as-a-Judge'.

Đánh giá các mẫu được sinh là nhiệm vụ phức tạp và phụ thuộc vào kiểu dữ liệu (hình ảnh, văn bản, video, v.v.). Những chỉ số văn bản truyền thống như độ chính xác là chưa đủ cho các tác vụ sáng tạo vì chúng chỉ kiểm tra độ trùng từ, không phải ý nghĩa.

Bộ chuẩn và bảng xếp hạng LLM dùng các bài kiểm tra chuẩn hoá để đo mức độ mô hình xử lý một nhiệm vụ. Chúng hữu ích để so sánh mô hình và theo dõi tiến bộ trong hoặc giữa các kiểu dữ liệu.

LLM-as-a-Judge là khung đánh giá hiện đại, nơi một mô hình "giáo viên" rất mạnh (như Gemini 3) chấm điểm đầu ra của một mô hình nhỏ hơn dựa trên các tiêu chí cụ thể, bao gồm tính trung thực, hữu ích và giọng điệu. Điều này cung cấp cách tiếp cận quy mô để xấp xỉ sở thích của con người mà không chậm và tốn kém như đánh giá thủ công.

Một số kỹ thuật cải thiện độ ổn định và hội tụ khi huấn luyện GAN là gì?

Cải thiện độ ổn định và hội tụ khi huấn luyện GAN quan trọng để tránh mode collapse, đảm bảo huấn luyện hiệu quả và đạt kết quả tốt. Dưới đây là một số kỹ thuật:

- Wasserstein GAN (WGAN): Dùng khoảng cách Wasserstein làm hàm mất mát, cải thiện ổn định và cung cấp gradient mượt hơn.

- Quy tắc cập nhật hai thang thời gian (TTUR): Dùng tốc độ học riêng cho bộ sinh và bộ phân biệt.

- Làm mềm nhãn (Label Smoothing): Làm mềm nhãn để tránh quá tự tin.

- Tốc độ học thích nghi: Dùng các bộ tối ưu như Adam để điều chỉnh động tốc độ học.

- Phạt gradient: Phạt các gradient lớn ở bộ phân biệt để đảm bảo tính liên tục Lipschitz cho huấn luyện ổn định hơn.

Bạn có thể kiểm soát phong cách hoặc thuộc tính của nội dung sinh ra bằng các mô hình AI tạo sinh như thế nào?

Có một số kỹ thuật phổ biến để kiểm soát phong cách đầu ra GenAI:

- Kỹ thuật nhắc lệnh (prompt engineering): Chỉ định phong cách mong muốn bằng cách cung cấp lời nhắc chi tiết nêu bật phong cách hoặc giọng điệu của nội dung. Đây là phương pháp hiệu quả và đơn giản cho cả mô hình văn bản-đến-văn bản và văn bản-đến-hình ảnh. Phương pháp càng hiệu quả hơn nếu bạn làm phù hợp với yêu cầu cụ thể hoặc tài liệu của chính mô hình đó.

- Nhiệt độ và điều khiển lấy mẫu: Tham số temperature điều khiển mức độ ngẫu nhiên của đầu ra. Nhiệt độ thấp đồng nghĩa lựa chọn token thận trọng và dự đoán hơn, nhiệt độ cao cho phép sáng tạo hơn. Các tham số khác như top-k và top-p cũng có thể điều khiển mức độ sáng tạo khi mô hình chọn token kế tiếp trong quá trình sinh.

- Đầu ra có cấu trúc: Đối với cấu trúc, các mô hình hiện đại dùng "Chế độ JSON" hoặc "Đầu ra có cấu trúc", buộc mô hình chỉ sinh JSON hoặc XML hợp lệ thay vì văn bản tự do.

- System prompt: System prompt được gửi kèm với mọi tin nhắn mới tới mô hình. Chúng có thể dùng để đặt các chỉ dẫn hành vi bền vững ghi đè đầu vào người dùng nhằm duy trì persona hoặc quy tắc cụ thể.

- Chuyển phong cách (hình ảnh): Một kỹ thuật khác có thể dùng khi suy luận, với các mô hình hỗ trợ, là áp dụng phong cách của một hình ảnh (ảnh tham chiếu) lên ảnh đầu vào.

- Fine-tuning: Ta có thể dùng mô hình đã được tiền huấn luyện và tinh chỉnh nó trên một bộ dữ liệu cụ thể chứa phong cách hoặc giọng điệu mong muốn. Tức là huấn luyện thêm mô hình trên dữ liệu bổ sung để học các phong cách hay thuộc tính cụ thể.

- Học tăng cường: Có thể dẫn dắt mô hình ưa thích một số đầu ra và tránh đầu ra khác bằng cách cung cấp phản hồi. Phản hồi này sẽ được dùng để điều chỉnh mô hình thông qua học tăng cường. Theo thời gian, mô hình sẽ được căn chỉnh theo sở thích của người dùng và/hoặc tập dữ liệu sở thích. Một ví dụ trong bối cảnh LLM là học tăng cường từ phản hồi con người (RLHF).

Một số cách xử lý vấn đề thiên lệch trong các mô hình AI tạo sinh là gì?

Đảm bảo mô hình không thiên lệch và công bằng cần các điều chỉnh lặp lại và giám sát qua từng giai đoạn.

Trước tiên, cần ngăn ô nhiễm dữ liệu bằng cách đảm bảo không có dữ liệu kiểm thử rò rỉ vào dữ liệu huấn luyện. Khi đó, mô hình sẽ học thuộc lòng dữ liệu thay vì khái quát hoá.

Tiếp theo, cần đảm bảo dữ liệu huấn luyện đa dạng và bao quát nhất có thể. Trong quá trình huấn luyện, ta có thể dẫn hướng mô hình tới sinh đầu ra công bằng hơn bằng cách đưa các mục tiêu công bằng vào hàm mất mát.

Đầu ra của mô hình phải được theo dõi thường xuyên để phát hiện thiên lệch. Để xây dựng niềm tin công chúng, nên minh bạch quy trình ra quyết định của mô hình, chi tiết tập dữ liệu và các bước tiền xử lý ở mức có thể.

Bạn có thể thảo luận về khái niệm "không gian tiềm ẩn" trong các mô hình tạo sinh và tầm quan trọng của nó?

Trong bối cảnh mô hình tạo sinh, không gian tiềm ẩn là không gian chiều thấp hơn nắm bắt các đặc trưng cốt lõi của dữ liệu theo cách các đầu vào tương tự được ánh xạ gần nhau. Lấy mẫu từ không gian này cho phép mô hình sinh dữ liệu mới và thao tác các thuộc tính/đặc trưng cụ thể (tạo biến thể ảnh).

Không gian tiềm ẩn là chìa khóa để tạo ra đầu ra có thể kiểm soát, trung thành với dữ liệu huấn luyện và đa dạng.

Vai trò của học tự giám sát trong phát triển mô hình AI tạo sinh là gì?

Ý tưởng cốt lõi của học tự giám sát là tận dụng kho dữ liệu không gán nhãn khổng lồ để học biểu diễn hữu ích mà không cần gán nhãn thủ công. Các mô hình như BERT và GPT được huấn luyện bằng các phương pháp tự giám sát như dự đoán token tiếp theo, học cấu trúc và ngữ nghĩa ngôn ngữ. Điều này giảm phụ thuộc vào dữ liệu có nhãn, vốn tốn kém và mất thời gian để thu thập, qua đó cho phép mô hình tận dụng các tập dữ liệu không gán nhãn lớn cho huấn luyện.

Low-Rank Adaptation (LoRA) là gì?

Huấn luyện lại một mô hình khổng lồ 70 tỷ tham số là quá đắt đỏ và chậm đối với hầu hết tổ chức. Low-Rank Adaptation (LoRA) giải quyết bằng cách đóng băng trọng số chính của mô hình và chỉ huấn luyện một lớp "adapter" nhỏ (thường dưới 1% tổng tham số) đặt chồng lên. Điều này cho phép bạn phục vụ hàng chục mô hình "tùy biến" khác nhau từ một mô hình nền tảng duy nhất, giảm mạnh chi phí tính toán và nhu cầu lưu trữ.

Câu hỏi phỏng vấn nâng cao về AI tạo sinh

Dành cho những ai tìm kiếm vai trò cấp cao hơn hoặc muốn thể hiện hiểu biết sâu về AI tạo sinh, hãy khám phá một số câu hỏi phỏng vấn nâng cao.

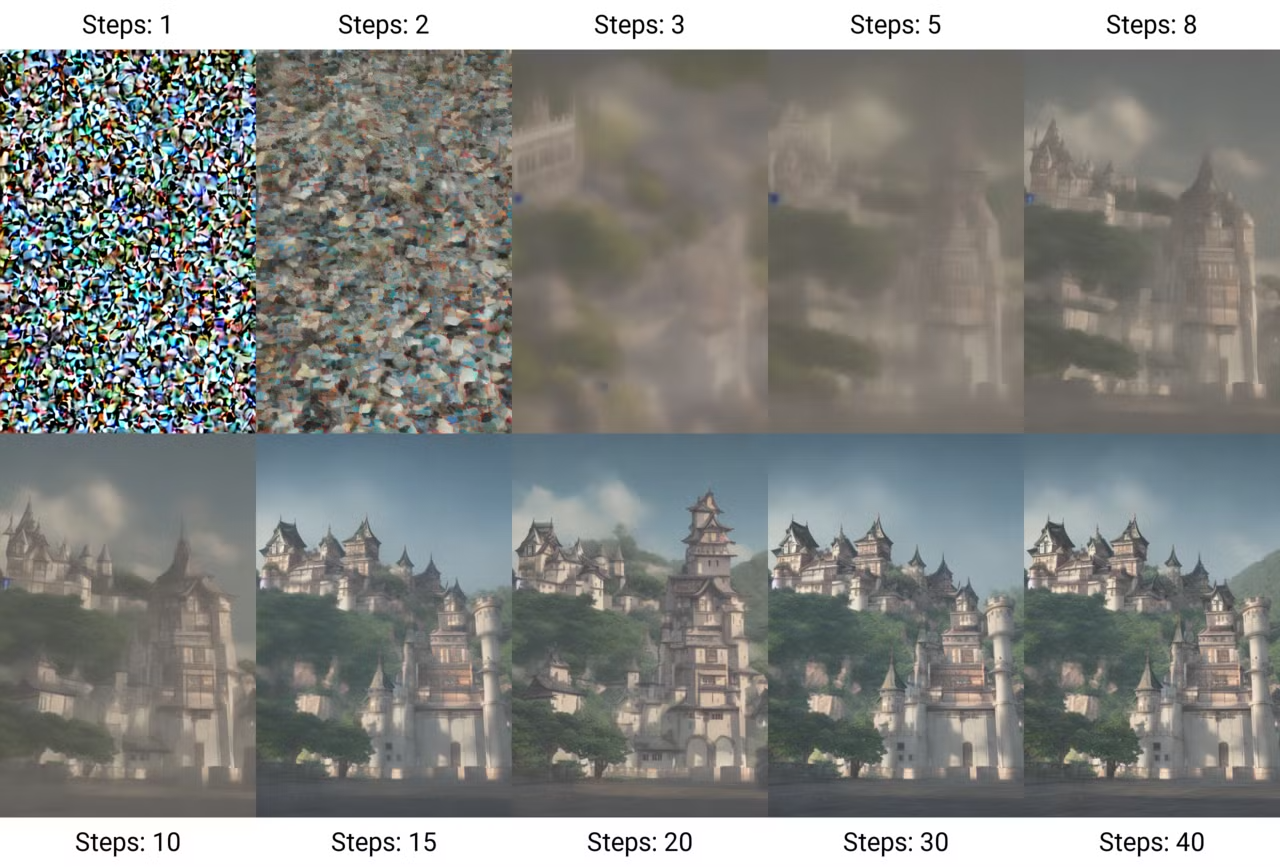

Giải thích khái niệm "Mô hình khuếch tán" (Diffusion Models) và chúng khác gì so với kiến trúc cũ hơn.

Mô hình khuếch tán hoạt động chủ yếu bằng cách dần thêm nhiễu vào ảnh cho đến khi chỉ còn nhiễu—và sau đó học cách đảo ngược quá trình này để sinh mẫu mới từ nhiễu. Quá trình này gọi là diffusion. Các mô hình này nổi tiếng nhờ khả năng tạo ảnh chất lượng cao và chi tiết.

Quy trình sinh ảnh qua các bước khuếch tán. (Nguồn: Wikimedia Commons)

Quy trình huấn luyện các mô hình này gồm hai bước:

- Quá trình tiến (khuếch tán): Lấy ảnh đầu vào và lần lượt thêm nhiễu qua nhiều bước cho đến khi dữ liệu biến thành nhiễu thuần.

- Quá trình đảo (khử nhiễu): Học cách khôi phục dữ liệu gốc từ nhiễu. Điều này được thực hiện bằng cách huấn luyện một mạng nơ-ron dự đoán nhiễu là gì, rồi khử nhiễu ảnh từng bước cho đến khi dữ liệu gốc được phục hồi từ nhiễu.

Khác với GAN cũ thường gặp bất ổn huấn luyện, mô hình khuếch tán ổn định và mở rộng tốt hơn, dù có thể chậm hơn do tính chất lặp.

Các biến thể hiện đại như khuếch tán tiềm ẩn hoạt động trong "không gian tiềm ẩn" nén để tăng tốc sinh, và kiến trúc flow matching hiện đang thay thế khuếch tán chuẩn để đạt hiệu năng tốt hơn nữa.

Kiến trúc Transformer hoạt động thế nào và nút thắt chính của nó là gì?

Kiến trúc transformer được giới thiệu trong bài báo "Attention is All You Need" đã cách mạng hoá lĩnh vực AI tạo sinh, đặc biệt trong xử lý ngôn ngữ tự nhiên (NLP).

Khác với mạng nơ-ron hồi quy (RNN) truyền thống xử lý dữ liệu tuần tự, transformer dùng cơ chế tự chú ý để gán trọng số cho các phần khác nhau của đầu vào đồng thời. Điều này cho phép mô hình nắm bắt quan hệ ngữ cảnh hiệu quả và xử lý song song chuỗi, giúp tăng tốc huấn luyện đáng kể.

Nút thắt chính là cơ chế chú ý này có độ phức tạp tăng theo bình phương độ dài chuỗi—nhân đôi cửa sổ ngữ cảnh đòi hỏi bốn lần tài nguyên tính toán. Điều này khiến "ngữ cảnh vô hạn" về lý thuyết là khả thi nhưng rất tốn kém, thúc đẩy nghiên cứu về phương pháp chú ý hiệu quả hơn.

"Mô hình suy luận" (tư duy Hệ 2) là gì và khác gì so với LLM tiêu chuẩn?

LLM tiêu chuẩn hoạt động như "Hệ 1": dự đoán từ tiếp theo ngay lập tức dựa trên các mẫu bề mặt.

Mô hình Suy luận (như Gemini 3 hoặc DeepSeek-R1) được huấn luyện để tạo ra một "Chuỗi suy nghĩ" ẩn trước khi đưa ra câu trả lời, cho phép chúng "suy nghĩ", lập kế hoạch và tự sửa lỗi. Điều này giúp chúng vượt trội trong toán phức tạp, lập trình và câu đố logic, dù chậm hơn và tốn chi phí chạy hơn.

Bạn có thể thảo luận về những thách thức khi sinh nội dung độ phân giải cao hoặc dạng dài bằng AI tạo sinh?

Khi tăng độ phức tạp của việc sinh bằng AI, bạn cũng cần giải quyết:

- Chi phí tính toán: Đầu ra độ phân giải cao cần mạng lớn hơn và nhiều tài nguyên tính toán hơn.

- Huấn luyện đa GPU: Mô hình lớn có thể không vừa một GPU, cần huấn luyện đa GPU. Các nền tảng trực tuyến có thể giảm bớt độ phức tạp triển khai.

- Ổn định huấn luyện: Mạng lớn và kiến trúc phức tạp khiến việc duy trì quy trình huấn luyện ổn định khó hơn.

- Chất lượng dữ liệu: Đầu ra độ phân giải cao và nội dung dạng dài đòi hỏi dữ liệu chất lượng cao hơn.

Một số xu hướng nổi lên và hướng nghiên cứu trong lĩnh vực AI tạo sinh là gì?

Lĩnh vực GenAI đang phát triển và tái định hình rất nhanh. Bao gồm:

- Mô hình đa phương thức: Tích hợp nhiều định dạng dữ liệu như văn bản, âm thanh và hình ảnh.

- Mô hình ngôn ngữ nhỏ (SLM): Khác với mô hình ngôn ngữ lớn, SLM đang được quan tâm nhờ hiệu quả và khả năng thích ứng. Chúng cần ít tài nguyên tính toán hơn, phù hợp triển khai trong môi trường hạn chế—đọc thêm trong blog về edge AI.

- AI đạo đức: Phát triển khung đảm bảo hiệu năng của mô hình tạo sinh được căn chỉnh.

- Mô hình tạo sinh cho video: Tiến bộ trong việc sinh video siêu chân thực và nhất quán bằng GenAI. Ví dụ mới nhất gồm Sora AI, Meta Movie Gen và Runway Act-One.

Bạn sẽ thiết kế một hệ thống dùng AI tạo sinh để tạo nội dung cá nhân hoá trong một ngành cụ thể, như y tế, như thế nào?

Thiết kế hệ thống dùng AI tạo sinh cho các bài toán theo ngành là một cách tiếp cận toàn diện. Các hướng dẫn chung có thể điều chỉnh và áp dụng sang ngành khác.

- Hiểu nhu cầu ngành: Kiến thức miền của ngành ảnh hưởng lớn đến các quyết định thiết kế hệ thống. Bước đầu là nắm kiến thức tổng quan và thực tế về ngành, nền tảng, khái niệm, mục tiêu và yêu cầu.

- Thu thập và quản lý dữ liệu: Xác định nhà cung cấp dữ liệu khả dĩ. Trong y tế, điều này nghĩa là thu thập dữ liệu từ nhà cung cấp dịch vụ y tế về chi tiết điều trị, thông tin bệnh nhân, hướng dẫn y khoa, v.v. Cần xác định và tuân thủ các rào chắn đặc thù ngành về Bảo mật và quyền riêng tư dữ liệu. Đảm bảo dữ liệu chất lượng cao, chính xác, cập nhật và đại diện cho các nhóm đa dạng.

- Lựa chọn mô hình: Quyết định tinh chỉnh mô hình tiền huấn luyện hay tự thiết kế kiến trúc từ đầu. Tùy dự án, các mô hình AI tạo sinh tối ưu có thể khác nhau. Một mô hình như GPT-4o có thể là lựa chọn cắm-là-chạy tốt. Một số lĩnh vực có thể yêu cầu mô hình lưu trữ nội bộ vì lý do riêng tư. Khi đó, mô hình mã nguồn mở là hướng đi. Cân nhắc tinh chỉnh các mô hình này trên dữ liệu đặc thù ngành đã thu thập.

- Thẩm định đầu ra: Triển khai quy trình đánh giá kỹ lưỡng nơi chuyên gia xác thực nội dung sinh ra trước khi đưa vào thực hành.

- Khả năng mở rộng: Thiết kế hạ tầng đám mây có thể mở rộng để xử lý tải yêu cầu mà không ảnh hưởng hiệu năng.

- Cân nhắc pháp lý và đạo đức: Đặt ra hướng dẫn đạo đức rõ ràng cho việc dùng AI và truyền thông minh bạch về các hạn chế tiềm ẩn của mô hình. Tôn trọng quyền sở hữu trí tuệ và xử lý các vấn đề liên quan.

- Cải tiến liên tục: Thường xuyên rà soát hiệu năng hệ thống và đánh giá của chuyên gia về nội dung sinh ra. Thu thập thêm insight và dữ liệu để điều chỉnh mô hình tốt hơn.

Giải thích khái niệm "học trong ngữ cảnh" (in-context learning) trong bối cảnh LLM.

Học trong ngữ cảnh là khả năng của LLM điều chỉnh phong cách và đầu ra dựa trên ngữ cảnh được cung cấp mà không cần tinh chỉnh thêm.

Nó cũng có thể được gọi là few-shot learning hoặc kỹ thuật nhắc lệnh. Có thể đạt được bằng cách nêu một hoặc nhiều ví dụ về phản hồi mong muốn hoặc mô tả rõ ràng cách mô hình nên hành xử.

Học trong ngữ cảnh cũng có hạn chế. Nó mang tính ngắn hạn và theo tác vụ, vì mô hình không thực sự giữ lại kiến thức trong các phiên khác khi dùng kỹ thuật này.

Ngoài ra, nếu đầu ra yêu cầu phức tạp, mô hình có thể cần nhiều ví dụ. Nếu ví dụ cung cấp không đủ rõ hoặc tác vụ khó hơn khả năng của mô hình, đôi khi nó có thể sinh đầu ra sai hoặc rời rạc.

Có thể thiết kế prompt chiến lược để gợi ra hành vi hoặc đầu ra mong muốn từ mô hình như thế nào? Thực hành tốt nhất cho prompt engineering là gì?

Prompt đóng vai trò quan trọng trong việc định hướng LLM phản hồi theo tác vụ cụ thể. Prompt hiệu quả thậm chí có thể giảm nhu cầu tinh chỉnh mô hình bằng cách dùng các kỹ thuật như few-shot learning, phân rã nhiệm vụ và mẫu prompt.

Một số thực hành tốt nhất cho prompt engineering hiệu quả gồm:

- Rõ ràng và súc tích: Cung cấp chỉ dẫn cụ thể để mô hình biết chính xác tác vụ bạn muốn. Trình bày thẳng thắn, đi thẳng vào trọng tâm.

- Dùng ví dụ: Với học trong ngữ cảnh, việc nêu vài cặp đầu vào–đầu ra giúp mô hình hiểu tác vụ theo cách bạn mong muốn.

- Chia nhỏ tác vụ phức tạp: Nếu tác vụ phức tạp, chia nhỏ thành các bước có thể cải thiện chất lượng phản hồi.

- Đặt ràng buộc hoặc định dạng: Nếu bạn cần phong cách, định dạng hoặc độ dài cụ thể, hãy nêu rõ trong prompt.

Đọc thêm trong blog về Kỹ thuật tối ưu hoá prompt.

Một số kỹ thuật tối ưu tốc độ suy luận của mô hình AI tạo sinh là gì?

- Cắt tỉa mô hình (model pruning): Loại bỏ trọng số/tầng không cần thiết để giảm kích thước mô hình.

- Lượng tử hoá: Giảm độ chính xác trọng số mô hình xuống fp16/int8.

- Chưng cất tri thức: Huấn luyện mô hình nhỏ hơn bắt chước mô hình lớn.

- Gia tốc GPU: Sử dụng phần cứng chuyên dụng.

Bạn có thể giải thích khái niệm "Sinh có điều kiện" và cách áp dụng trong các mô hình như Conditional GAN (cGAN) không?

Sinh có điều kiện là việc mô hình tạo đầu ra dựa trên các điều kiện hoặc ngữ cảnh nhất định. Điều này cho phép kiểm soát nội dung sinh ra tốt hơn. Trong cGAN, cả bộ sinh và bộ phân biệt đều được điều kiện hoá bởi thông tin bổ sung như nhãn lớp. Cách hoạt động:

- Bộ sinh: Nhận cả nhiễu và thông tin điều kiện (ví dụ nhãn lớp) để tạo dữ liệu phù hợp điều kiện.

- Bộ phân biệt: Đánh giá tính xác thực của dữ liệu sinh ra đồng thời xét đến thông tin điều kiện.

Bạn có thể giải thích kiến trúc Mixture of Experts (MoE)? Vì sao nó được ưa chuộng cho mô hình lớn?

Mixture of Experts (MoE) thay thế một mạng dày đặc duy nhất bằng nhiều mạng con "chuyên gia" chuyên biệt. Với mỗi token, một bộ định tuyến chọn chỉ các chuyên gia liên quan nhất để xử lý dữ liệu, nghĩa là một mô hình có thể có 100 tỷ tham số nhưng chỉ dùng 10 tỷ khi suy luận.

Kiến trúc này cho phép mô hình rất thông minh (tổng tham số cao) trong khi vẫn chạy nhanh và rẻ (số tham số hoạt động thấp).

Câu hỏi phỏng vấn AI tạo sinh cho Kỹ sư AI

Nếu bạn phỏng vấn cho vai trò kỹ sư AI tập trung vào AI tạo sinh, hãy kỳ vọng các câu hỏi đánh giá khả năng thiết kế, triển khai và đưa mô hình tạo sinh vào vận hành.

Quy trình tác nhân (agentic workflow) khác gì so với chatbot tiêu chuẩn?

Một chatbot tiêu chuẩn mang tính thụ động: nhận truy vấn và đưa ra câu trả lời văn bản dựa trên những gì đã được huấn luyện.

Một quy trình tác nhân trao cho LLM quyền truy cập công cụ (như trình duyệt web, trình thông dịch mã, hoặc API) và khả năng tự chủ để lên kế hoạch quy trình nhiều bước nhằm giải quyết mục tiêu. Tác nhân có thể lên kế hoạch tìm kiếm web, phân tích dữ liệu bằng mã Python, rồi viết báo cáo, lặp lại cho đến khi hoàn tất nhiệm vụ.

Bạn đảm bảo an toàn và độ vững khi triển khai LLM bằng Guardrails như thế nào?

Đảm bảo an toàn và độ vững cho LLM đi kèm nhiều thách thức. Thách thức chính gồm khả năng sinh đầu ra gây hại hoặc thiên lệch, vì các mô hình được huấn luyện trên nguồn dữ liệu khổng lồ hoặc thậm chí không lọc và có thể tạo nội dung độc hại hoặc gây hiểu lầm.

Một vấn đề lớn khác với nội dung do LLM tạo là nguy cơ ảo giác, khi mô hình tạo ra nội dung nghe có vẻ rất tự tin nhưng thực ra sai. Thách thức nữa là bảo mật trước các prompt đối kháng phá vỡ biện pháp an toàn của mô hình và tạo ra phản hồi có hại hoặc phi đạo đức, điều đã được chứng minh nhiều lần với các mô hình khác nhau.

Tích hợp các bộ lọc an toàn và lớp kiểm duyệt có thể giúp xác định và loại bỏ nội dung có hại được sinh ra. Giám sát con người liên tục trong vòng lặp càng tăng cường an toàn mô hình.

Ngoài ra, kỹ sư phải triển khai Guardrails rõ ràng (như NeMo Guardrails hoặc Llama Guard) đặt giữa người dùng và mô hình. Các hệ thống này quét đầu vào để chặn tấn công prompt injection hoặc rò rỉ PII (thông tin nhận dạng cá nhân) và quét đầu ra để bắt các phản hồi độc hại hoặc ảo giác trước khi đến tay người dùng. Điều này tạo một lớp an toàn tất định vận hành độc lập với bản chất xác suất của mô hình.

Hãy mô tả một dự án thách thức liên quan đến AI tạo sinh mà bạn đã thực hiện. Thách thức chính là gì và bạn đã vượt qua thế nào?

Câu trả lời phụ thuộc vào dự án và trải nghiệm của bạn. Tuy nhiên, bạn có thể lưu ý các điểm sau khi trả lời dạng câu hỏi này:

- Chọn một dự án cụ thể có thách thức AI rõ ràng như thiên lệch, độ chính xác mô hình, hoặc ảo giác.

- Làm rõ thách thức và giải thích khó khăn kỹ thuật hoặc vận hành.

- Trình bày cách tiếp cận bằng cách nêu chiến lược then chốt bạn áp dụng như bổ sung dữ liệu, tinh chỉnh mô hình, hoặc hợp tác với chuyên gia.

- Nêu bật kết quả và định lượng tác động—cải thiện độ chính xác, tăng tương tác người dùng, hoặc giải quyết vấn đề kinh doanh.

Bạn có thể thảo luận về kinh nghiệm triển khai và đưa mô hình AI tạo sinh vào môi trường sản xuất?

Tương tự câu trên, câu này có thể trả lời dựa trên kinh nghiệm của bạn, nhưng cũng nên lưu ý:

- Tập trung vào triển khai: Đề cập hạ tầng (dịch vụ đám mây, công cụ MLOps) và các nhiệm vụ then chốt (mở rộng, tối ưu độ trễ thấp). Không cần đi sâu chi tiết; cho thấy bạn nắm vững là đủ.

- Đề cập một thách thức: Nêu một hai thách thức phổ biến để tránh, thể hiện chuyên môn của bạn.

- Đề cập giai đoạn hậu triển khai: Bao gồm chiến lược giám sát và bảo trì để đảm bảo hiệu năng ổn định.

- Xử lý an toàn: Nêu các biện pháp xử lý thiên lệch hoặc an toàn trong quá trình triển khai.

Bạn xử lý hiện tượng "mất thông tin ở giữa" trong cửa sổ văn bản dài như thế nào?

Ngay cả với cửa sổ ngữ cảnh rất lớn (ví dụ 1 triệu token), LLM thường gặp khó trong việc truy xuất thông tin bị chôn giữa prompt, ưu tiên phần đầu và cuối.

Kỹ sư khắc phục bằng cách dùng thuật toán xếp hạng lại thông minh để di chuyển những đoạn truy xuất quan trọng nhất lên đầu hoặc cuối cửa sổ ngữ cảnh. Chiến lược khác là thuật toán "map-reduce", nơi mô hình tóm tắt từng phần tài liệu dài một cách độc lập trước khi kết hợp cho câu trả lời cuối.

Bạn sẽ tiếp cận nhiệm vụ xây dựng hệ thống RAG đầu-cuối như thế nào?

Xây dựng hệ thống RAG đòi hỏi cách tiếp cận có hệ thống. Pipeline có thể như sau:

- Chunking hiệu quả: Dùng chiến lược theo ngữ nghĩa hoặc đệ quy để chia tài liệu thành các đoạn có ý nghĩa (thay vì cắt theo số ký tự tuỳ ý) để đảm bảo giữ ngữ cảnh.

- Lưu trữ vectơ: Nhúng (embed) các đoạn này bằng một mô hình embedding hiệu năng cao và lưu trong cơ sở dữ liệu vectơ, gắn kèm metadata phong phú (như ngày tháng hoặc tác giả) để tiền lọc.

- Tìm kiếm lai: Triển khai lớp truy xuất kết hợp tìm kiếm từ khóa (BM25) cho khớp chính xác với tìm kiếm vectơ (tương đồng ngữ nghĩa) để bắt cả thuật ngữ cụ thể và khái niệm rộng hơn.

- Xếp hạng lại: Áp dụng mô hình cross-encoder để chấm điểm lại các kết quả truy xuất hàng đầu, lọc mạnh các đoạn "nhiễu" không liên quan trước khi đưa tới LLM.

- Trích dẫn & sinh đáp án: Nhắc LLM tạo câu trả lời nghiêm ngặt dựa trên ngữ cảnh cung cấp và yêu cầu trích dẫn tài liệu nguồn cụ thể để ngăn ảo giác.

Một số câu hỏi nghiên cứu mở hoặc mảng bạn thấy hứng thú nhất trong AI tạo sinh là gì?

Câu trả lời cũng phụ thuộc sở thích cá nhân, nhưng đây là vài chủ đề bạn có thể đề cập:

- Cải thiện khả năng diễn giải mô hình: Khiến mô hình tạo sinh minh bạch và dễ hiểu hơn.

- Khung đạo đức: Phát triển hướng dẫn cho AI có trách nhiệm.

- Sinh xuyên phương thức: Sinh nội dung qua nhiều kiểu dữ liệu (hình ảnh, văn bản, v.v.).

- Vững vàng trước tấn công đối kháng: Khiến mô hình kháng cự tấn công đối kháng.

- Năng lực suy luận: Tăng cường sức mạnh suy luận của LLM.

Kết luận

Khi AI tạo sinh ngày càng ảnh hưởng đến nhiều mặt cuộc sống và sự nghiệp của chúng ta, việc giữ tinh thần tò mò với các chủ đề thiết yếu là rất quan trọng. Dù câu hỏi GenAI trong phỏng vấn phụ thuộc vào vai trò và công ty cụ thể, tôi đã cố gắng chọn lọc 30 câu hỏi và đáp án để giúp bạn bắt đầu hành trình chuẩn bị phỏng vấn.

Để khám phá thêm câu hỏi phỏng vấn, tôi gợi ý các blog sau:

Học viên cao học ngành Trí tuệ nhân tạo và chuyên viên biên tập kỹ thuật AI. Tôi chia sẻ những góc nhìn về công nghệ AI mới nhất, giúp phổ biến nghiên cứu ML và đơn giản hóa các chủ đề AI phức tạp để bạn luôn đi đầu.