Leerpad

Generatieve kunstmatige intelligentie (ook wel Generative AI of GenAI) is een subcategorie van AI die zich richt op het creëren van nieuwe content, zoals tekst, beeld of video, met behulp van verschillende AI-technologieën.

Naarmate GenAI voortschrijdt, sijpelt het door in veel andere techdomeinen, zoals softwareontwikkeling. Brede kennis van de basisbeginselen wordt in deze velden steeds relevanter.

Voor rollen zoals datascientists, machine learning-practitioners en AI-engineers is generatieve AI een cruciaal onderwerp om goed te beheersen.

Hier zijn 30 GenAI-interviewvragen die je tijdens een sollicitatie kunt krijgen.

Basis interviewvragen over generatieve AI

Laten we beginnen met een paar fundamentele interviewvragen over generatieve AI. Deze toetsen je begrip van de kernconcepten en -principes.

Wat zijn de belangrijkste verschillen tussen discriminatieve en generatieve modellen?

Discriminatieve modellen leren de beslissingsgrens tussen klassen en patronen die ze van elkaar onderscheiden. Ze schatten de waarschijnlijkheid P(y|x), de kans op een bepaald label y gegeven de inputdata x. Deze modellen focussen op het onderscheiden van verschillende categorieën (bijv. ‘Is deze e-mail spam?’).

Generatieve modellen leren de verdeling van de data zelf door de gezamenlijke waarschijnlijkheid te modelleren P(x,y), wat inhoudt dat ze datapuntjes uit deze verdeling samplen. Na training op duizenden afbeeldingen van cijfers kan dit samplen een nieuwe afbeelding van een cijfer opleveren.

Lees meer in deze blog over Generative vs Discriminative Models: Differences & Use Cases.

Wat zijn tokens en embeddings in de context van Large Language Models (LLM’s)?

Tokens zijn de fundamentele teksteenheden die een LLM verwerkt; het kunnen hele woorden, lettergrepen of zelfs individuele letters zijn (bijvoorbeeld, het woord "generative" kan worden opgesplitst in "gener", "at", "ive").

Embeddings zijn de numerieke vectorrepresentaties van die tokens die ze plaatsen in een multidimensionale ruimte op basis van hun betekenis. Deze conversie stelt het model in staat semantische betekenis te vangen en relaties tussen woorden te begrijpen, bijvoorbeeld herkennen dat "king" dicht bij "queen" ligt.

Kun je de basisprincipes achter Generative Adversarial Networks (GAN’s) uitleggen?

GAN’s bestaan uit twee concurrerende neurale netwerken (vandaar Adversarial): een generator en een discriminator.

De generator maakt valse datasamples, terwijl de discriminator ze vergelijkt met de echte trainingsdata. De twee netwerken worden gelijktijdig getraind:

- De generator probeert beelden te produceren die zo niet te onderscheiden zijn van de echte data dat de discriminator het verschil niet ziet.

- De discriminator probeert nauwkeurig te bepalen of een gegeven afbeelding echt of gegenereerd is.

Door dit competitieve leerproces wordt de generator vaardig in het produceren van zeer realistische data die lijkt op de trainingsdata.

Wat zijn populaire toepassingen van generatieve AI in de echte wereld?

- Tekstgeneratie: Gebruikt in chatbots, contentcreatie of vertaling (ChatGPT, Claude, Gemini).

- Beeldgeneratie: Realistische beelden produceren voor kunst of design (bijv. ChatGPT Images, Nano Banana Pro, Stable Diffusion).

- Code-agents: Complete code-modules schrijven, gebruikt in software engineering.

- Retrieval-Augmented Generation (RAG): Enterprise-kennisopvraging, gebruikt in klantenservice of voor interne wiki’s.

- Medicijnontdekking: Nieuwe moleculaire structuren voor medicijnen ontwerpen.

- Data-augmentatie: Datasets met weinig data uitbreiden voor machine learning.

Wat zijn uitdagingen bij het trainen en evalueren van generatieve AI-modellen?

- Rekenkosten: Hoge rekenkracht en hardware-eisen voor het trainen van complexere modellen.

- Trainingscomplexiteit: Het trainen van generatieve modellen kan uitdagend zijn en vol nuances.

- Evaluatiemetrics: Het is lastig om de kwaliteit en diversiteit van modeluitvoer kwantitatief te beoordelen.

- Data-eisen: Generatieve modellen vereisen vaak enorme hoeveelheden data met hoge kwaliteit en diversiteit. Het verzamelen daarvan kan tijdrovend en duur zijn.

- Bias en eerlijkheid: Ongecontroleerde modellen kunnen de vooroordelen in de trainingsdata versterken, wat leidt tot oneerlijke uitkomsten.

Wat zijn ethische overwegingen rond het gebruik van generatieve AI?

Het brede gebruik van GenAI en de toepassingen ervan vraagt om een grondige evaluatie van de prestaties op het gebied van ethiek. Voorbeelden zijn onder meer:

- Deepfakes: Het creëren van nep maar hyperrealistisch beeldmateriaal kan desinformatie verspreiden of personen zwartmaken.

- Gekleurde generatie: Historische en maatschappelijke vooroordelen in de trainingsdata versterken.

- Intellectueel eigendom: Ongeautoriseerd gebruik van auteursrechtelijk beschermd materiaal in de data.

Hoe kan generatieve AI menselijke creativiteit aanvullen of versterken?

Hoewel hallucinaties van AI-modellen foutieve output kunnen opleveren, zijn deze generatieve modellen in veel opzichten nuttig. Ze kunnen dienen als creatieve inspiratie voor experts in uiteenlopende domeinen:

- Kunst en design: Inspiratie bieden voor kunst en ontwerp.

- Schrijfhulp: Titels en schrijfideeën of tekstaanvulling voorstellen.

- Muziek: Beats en harmonieën componeren.

- Programmeren: Bestaande code optimaliseren of manieren aandragen om een implementatieprobleem aan te pakken.

Wat is het verschil tussen een foundation model en een fijn-afgesteld model?

Een Foundation Model (zoals GPT-5.2) is getraind op enorme hoeveelheden brede internetdata om algemene patronen, redeneren en taalstructuur te leren.

Een fijn-afgesteld model neemt deze generalistische basis en traint verder op een kleinere, samengestelde dataset om een specifieke taak te beheersen, zoals medische diagnose of spreken in een specifieke programmeertaal. Fine-tuning ruilt brede veelzijdigheid in voor diepere expertise in een specifiek domein.

Gevorderde basis: intermediate interviewvragen over generatieve AI

Nu we de basis hebben behandeld, gaan we verder met enkele intermediate interviewvragen over generatieve AI.

Wat is "Mode Collapse" in GAN’s, en hoe pak je dat aan?

Net zoals een contentmaker kan ontdekken dat een bepaalde videoformule meer bereik en interactie oplevert, kan de generator in een GAN gefixeerd raken op een beperkte variatie aan outputs die de discriminator misleidt. Daardoor produceert de generator een kleine set outputs, ten koste van de diversiteit en flexibiliteit van de gegenereerde data.

Mogelijke oplossingen zijn het verfijnen van trainingstechnieken door hyperparameters en optimalisatie-algoritmen aan te passen, regularisaties toe te passen die diversiteit bevorderen, of meerdere generators te combineren om verschillende modi van datageneratie te dekken.

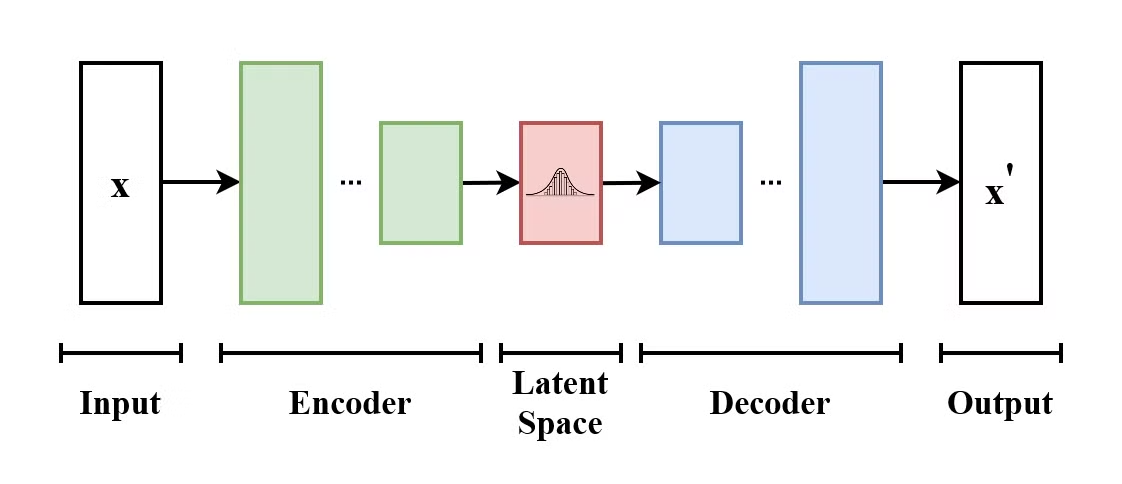

Hoe werkt een Variational Autoencoder (VAE)?

Een Variational Autoencoder (VAE) is een type generatief model dat leert om inputdata te encoderen naar een latente ruimte en deze weer te decoderen om de originele input te reconstrueren. VAE’s zijn encoder-decoder-modellen:

- De encoder projecteert de inputdata naar een distributie over de latente ruimte.

- De decoder sampled uit deze latente-ruimtedistributie om de inputdata te reconstrueren.

De structuur van een Variational Autoencoder. (Bron: Wikimedia Commons)

Wat VAE’s onderscheidt van traditionele autoencoders is dat een VAE de latente ruimte stimuleert om een bekende verdeling (zoals Gaussisch) te volgen. Dit maakt ze geschikter voor het genereren van nieuwe data door te samplen uit deze latente ruimte.

Leg het verschil uit tussen Retrieval-Augmented Generation (RAG) en fine-tuning. Wanneer kies je welke?

RAG verbindt een model met externe databronnen (zoals de wiki van je bedrijf) om actuele feiten op te halen zonder het model te hertrainen. De parameters van het model blijven hetzelfde; het krijgt alleen toegang tot extra data.

Fine-tuning past de interne gewichten van het model aan om te veranderen hoe het spreekt, zich gedraagt of redeneert, maar is niet geschikt om nieuwe feitelijke kennis toe te voegen.

Gebruik RAG wanneer je actuele feiten nodig hebt (nieuws, private bedrijfsdata) of een specifieke bronvermelding. Gebruik fine-tuning wanneer je wilt dat het model een nieuw "gedrag", een taal of een specifiek outputformaat leert (bijv. spreken in SQL-code).

Hoe zou je een LLM-toepassing evalueren? Leg 'LLM-as-a-Judge' uit.

Het beoordelen van gegenereerde samples is complex en hangt af van de datamodaliteit (beeld, tekst, video, enz.). Traditionele tekst-metrics, zoals nauwkeurigheid, zijn onvoldoende voor creatieve taken omdat ze alleen woordoverlap checken, niet de betekenis.

LLM-benchmarks en leaderboards gebruiken gestandaardiseerde tests om te meten hoe goed een model een bepaalde taak aan kan. Ze zijn nuttig om modellen te vergelijken en voortgang te volgen binnen of over modaliteiten heen.

LLM-as-a-Judge is een modern evaluatiekader waarbij een zeer capabel "leraren"-model (zoals Gemini 3) de output van een kleiner model beoordeelt op specifieke criteria, waaronder betrouwbaarheid, behulpzaamheid en toon. Dit biedt een schaalbare manier om menselijke voorkeur te benaderen zonder de traagheid en kosten van handmatige beoordeling.

Welke technieken verbeteren de stabiliteit en convergentie van GAN-training?

Het verbeteren van stabiliteit en convergentie bij GAN-training is belangrijk om mode collapse te voorkomen, efficiënt te trainen en goede resultaten te behalen. Enkele technieken:

- Wasserstein GAN (WGAN): Gebruikt de Wasserstein-afstand als verliesfunctie, wat de training stabiliseert en vloeiendere gradiënten geeft.

- Two-Timescale Update Rule (TTUR): Afzonderlijke leersnelheden voor generator en discriminator gebruiken.

- Label smoothing: Labels verzachten om overmatige zelfverzekerdheid te voorkomen.

- Adaptieve leersnelheden: Optimizers zoals Adam gebruiken om de leersnelheid dynamisch te beheren.

- Gradient penalty: Grote gradiënten in de discriminator bestraffen om Lipschitz-continuïteit af te dwingen voor stabielere training.

Hoe kun je de stijl of attributen van gegenereerde content sturen met generatieve AI-modellen?

Er zijn verschillende veelgebruikte technieken om de stijl van GenAI-outputs te sturen:

- Prompt engineering: De gewenste outputstijl specificeren door gedetailleerde prompts te geven die de stijl of toon van de generatie benadrukken. Dit is een effectieve en eenvoudige methode bij zowel text-to-text als text-to-image-modellen. Het werkt nog beter als je het afstemt op de specifieke vereisten of documentatie van het betreffende model.

- Temperatuur en samplingcontrole: De temperatuur-parameter bepaalt hoe willekeurig de outputs zijn. Lagere temperaturen betekenen conservatievere en voorspelbare tokenkeuze, hogere temperaturen laten creatievere generatie toe. Andere parameters, zoals top-k en top-p, sturen ook hoe creatief het model mogelijke volgende tokens kiest tijdens het genereren.

- Gestructureerde output: Voor structuur gebruiken moderne modellen "JSON Mode" of "Structured Outputs", die het model beperken tot strikt geldige JSON- of XML-schema’s in plaats van vrije tekst.

- Systeemprompts: Systeemprompts worden met elk nieuw bericht naar het model gestuurd. Ze kunnen worden gebruikt om persistente gedragsinstructies vast te leggen die gebruikersinvoer overschrijven om specifieke persona’s of regels te handhaven.

- Stijltransfer (afbeeldingen): Een andere techniek die tijdens inferentie kan worden gebruikt bij modellen die dit ondersteunen, is de stijl van één afbeelding (referentieafbeelding) toepassen op een invoerafbeelding.

- Fine-tuning: We kunnen een voorgetraind model gebruiken en het fijn-afstellen op een specifieke dataset met de gewenste stijl of toon. Dit betekent verder trainen op extra data om specifieke stijlen of attributen te leren.

- Reinforcement learning: We kunnen het model sturen om bepaalde outputs te verkiezen en andere te vermijden door feedback te geven. Deze feedback wordt gebruikt om het model te wijzigen via reinforcement learning. Na verloop van tijd wordt het model afgestemd op de voorkeuren van gebruikers en/of voorkeursdatasets. Een voorbeeld hiervan, in de context van LLM’s, is Reinforcement Learning from Human Feedback (RLHF).

Hoe pak je bias in generatieve AI-modellen aan?

Zorgen dat het model onbevooroordeeld en eerlijk is, vereist iteratieve aanpassing en monitoring in elke fase.

Allereerst moet datacontaminatie worden voorkomen door ervoor te zorgen dat geen testdata in de trainingsdata terechtkomt. Anders leert het model de data te memoriseren in plaats van te generaliseren.

Verder moet de trainingsdata zo divers en inclusief mogelijk zijn. Tijdens training kunnen we het model richting eerlijkere generatie sturen door fairness-doelstellingen in de verliesfunctie op te nemen.

De modeluitvoer moet regelmatig op bias worden gemonitord. Om publiek vertrouwen op te bouwen helpt het om het beslissingsproces van het model, details over de dataset en de preprocess-stappen zo transparant mogelijk te maken.

Kun je het concept "latente ruimte" in generatieve modellen en het belang ervan toelichten?

In de context van generatieve modellen is de latente ruimte een lager-dimensionale ruimte die de essentiële kenmerken van de data vastlegt, zodanig dat vergelijkbare inputs dichter bij elkaar worden geprojecteerd. Samplen uit deze latente ruimte stelt modellen in staat nieuwe data te genereren en specifieke attributen of kenmerken te manipuleren (variaties van afbeeldingen genereren).

Latente ruimten zijn cruciaal om outputs te genereren die stuurbaar, trouw aan de trainingsdata en divers zijn.

Wat is de rol van self-supervised learning bij de ontwikkeling van generatieve AI-modellen?

Het kernidee van self-supervised learning is een enorme hoeveelheid ongestructureerde, ongelabelde data benutten om bruikbare representaties te leren zonder handmatige labeling. Modellen zoals BERT en GPT worden getraind met self-supervised methoden zoals next-token prediction en het leren van structuur en semantiek van talen. Dit vermindert de afhankelijkheid van gelabelde data, die kostbaar en tijdrovend is, en stelt modellen in staat om enorme ongelabelde datasets te benutten voor training.

Wat is Low-Rank Adaptation (LoRA)?

Het hertrainen van een massaal model met 70 miljard parameters is voor de meeste organisaties prohibitief duur en traag. Low-Rank Adaptation (LoRA) lost dit op door de hoofdgewichten van het model te bevriezen en alleen een piepkleine "adapter"-laag te trainen (vaak minder dan 1% van het totale aantal parameters) die erbovenop zit. Zo kun je tientallen verschillende "aangepaste" modellen serveren vanuit één basismodel, wat de rekenkosten en opslagbehoefte drastisch verlaagt.

Geavanceerde interviewvragen over generatieve AI

Voor wie op zoek is naar seniorrollen of een diep begrip van generatieve AI wil tonen, volgen hier enkele geavanceerde vragen.

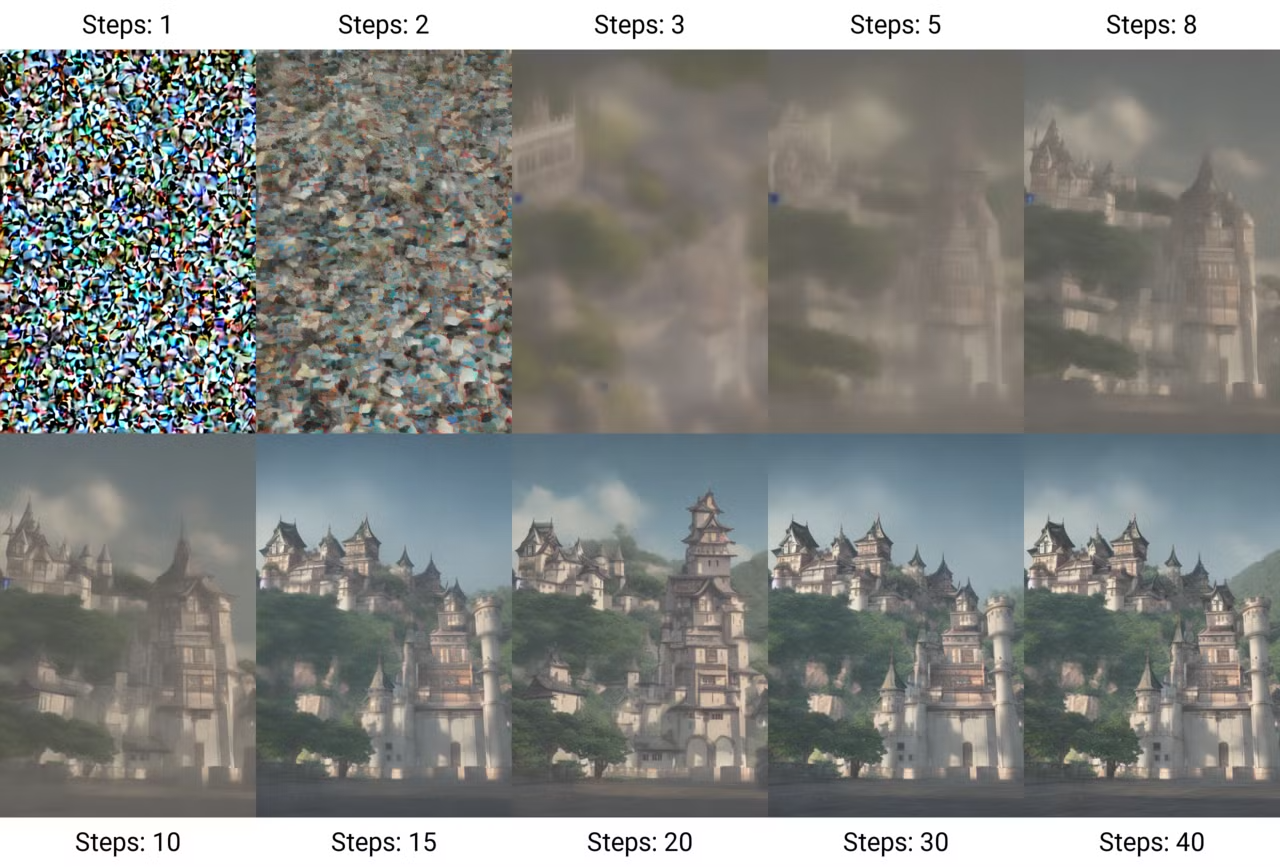

Leg het concept "diffusiemodellen" uit en hoe ze verschillen van oudere architecturen.

Diffusiemodellen werken voornamelijk door geleidelijk ruis toe te voegen aan een afbeelding totdat alleen ruis overblijft—en vervolgens te leren hoe je dit proces omkeert om nieuwe samples uit ruis te genereren. Dit proces heet diffusie. Deze modellen zijn populair vanwege hun vermogen om afbeeldingen van hoge kwaliteit en met veel detail te produceren.

Generatie van een afbeelding via diffusie-stappen. (Bron: Wikimedia Commons)

Het trainen van deze modellen omvat twee stappen:

- Het voorwaartse proces (diffusie): Een invoerafbeelding nemen en er in meerdere stappen steeds meer ruis aan toevoegen, totdat de data in pure ruis is veranderd.

- Het omgekeerde proces (denoising): Leren hoe je de originele data uit de ruis terughaalt. Dit gebeurt door een neuraal netwerk te trainen om te voorspellen wat de ruis is, en vervolgens de afbeelding stap voor stap te ontruisen totdat de originele data uit de ruis is hersteld.

In tegenstelling tot oudere GAN’s, die vaak kampten met instabiele training, zijn diffusiemodellen stabieler en schaalbaarder, al kunnen ze door hun iteratieve aard trager zijn.

Moderne varianten zoals latente diffusie werken in een gecomprimeerde "latente ruimte" om de generatie te versnellen, en flow matching-architecturen vervangen nu standaarddiffusie voor nog betere prestaties.

Hoe werkt de Transformer-architectuur en wat is de grootste bottleneck?

De Transformer-architectuur, geïntroduceerd in de paper “Attention is All You Need”, heeft het veld van generatieve AI revolutionair veranderd, vooral in natural language processing (NLP).

In tegenstelling tot traditionele recurrente neurale netwerken (RNN’s), die data sequentieel verwerken, gebruiken Transformers self-attention om gewichten toe te kennen aan verschillende delen van de inputdata tegelijk. Dit stelt het model in staat contextuele relaties effectief vast te leggen en maakt parallelle verwerking van sequenties mogelijk, wat de training aanzienlijk versnelt.

De grootste bottleneck is dat dit aandachtmechanisme kwadratisch schaalt met de sequentielengte—het verdubbelen van de contextwindow vereist vier keer zoveel compute. Daardoor is “oneindige context” theoretisch mogelijk maar computationeel kostbaar, wat onderzoek aanjaagt naar efficiëntere attention-methoden.

Wat is een "Reasoning Model" (System 2-denken), en hoe verschilt het van een standaard LLM?

Standaard LLM’s handelen als "System 1"-denkers: ze voorspellen direct het volgende woord op basis van oppervlakkige patronen.

Reasoning-modellen (zoals Gemini 3 of DeepSeek-R1) zijn getraind om een verborgen "Chain of Thought" te genereren voordat ze een antwoord geven, waardoor ze kunnen "denken", plannen en fouten zelf corrigeren. Hierdoor presteren ze aanzienlijk beter bij complexe wiskunde, coderen en logische puzzels, al zijn ze trager en duurder in gebruik.

Welke uitdagingen spelen bij het genereren van hoge-resolutie of langvormige content met generatieve AI?

Naarmate je de complexiteit van AI-generatie opvoert, moet je ook het volgende aanpakken:

- Rekenkosten: Hoge-resolutie outputs vereisen grotere netwerken en meer rekenkracht.

- Multi-GPU-training: Grotere modellen passen mogelijk niet op één GPU en vereisen multi-GPU-training. Online platforms kunnen de complexiteit van zulke systemen verminderen.

- Trainingsstabiliteit: Grotere netwerken en complexere architecturen maken het moeilijker om stabiele training te behouden.

- Datakwaliteit: Hogere resolutie en langere content vereisen data van hogere kwaliteit.

Wat zijn opkomende trends en onderzoekslijnen in generatieve AI?

Het GenAI-veld evolueert en verandert razendsnel. Dit omvat:

- Multimodale modellen: Meerdere dataformaten integreren, zoals tekst, audio en beelden.

- Small language models (SLM’s): In tegenstelling tot groot taalmodellen winnen SLM’s aan terrein door hun efficiëntie en aanpasbaarheid. Ze vergen minder rekenmiddelen, waardoor ze geschikt zijn voor omgevingen met beperkte mogelijkheden—lees meer in deze blog over edge AI.

- Ethische AI: Kaders ontwikkelen om afgestemde prestaties van generatieve modellen te waarborgen.

- Generatieve modellen voor video: Doorbraken in het genereren van ultrarealistische en consistente video’s met GenAI. Recente voorbeelden zijn Sora AI, Meta Movie Gen en Runway Act-One.

Hoe zou je een systeem ontwerpen dat generatieve AI gebruikt om gepersonaliseerde content te maken in een specifieke sector, zoals de zorg?

Het ontwerpen van een systeem dat generatieve AI gebruikt voor sectorspecifieke use-cases vergt een grondige aanpak. De algemene richtlijnen kunnen ook voor andere sectoren worden aangepast.

- Begrijp de behoeften van de sector: Domeinkennis heeft grote invloed op de ontwerpkeuzes. Stap één is algemene en praktische kennis opdoen van de sector, de basis, concepten, doelen en vereisten.

- Dataverzameling en -beheer: Mogelijke dataleveranciers identificeren. In de zorg betekent dit data verzamelen van zorgverleners over behandelgegevens, patiëntinformatie, medische richtlijnen, enz. De sectorspecifieke randvoorwaarden rond dataprivacy en -beveiliging moeten worden vastgesteld en gerespecteerd. Zorg dat de data van hoge kwaliteit, accuraat, actueel en representatief voor diverse groepen is.

- Modelkeuze: Bepaal of je voorgetrainde modellen fijn-afstelt of eigen architecturen vanaf nul ontwikkelt. Afhankelijk van het project kunnen optimale generatieve AI-modellen variëren. Een model als GPT-4o kan een goede plug-and-play-keuze zijn. Sommige domeinen vereisen om privacyredenen lokaal gehoste modellen. In dat geval zijn open-sourcemodellen aangewezen. Overweeg deze modellen fijn-af te stemmen op de sectorspecifieke data die je eerder verzamelde.

- Outputvalidatie: Implementeer een grondig evaluatieproces waarbij experts en professionals de gegenereerde content valideren voordat deze wordt gebruikt.

- Schaalbaarheid: Ontwerp een schaalbare cloudgebaseerde infrastructuur om de vereiste belasting aan te kunnen zonder dat de prestaties instorten.

- Juridische en ethische overwegingen: Stel duidelijke ethische richtlijnen op voor AI-gebruik en communiceer de mogelijke beperkingen van je model transparant. Respecteer intellectuele eigendomsrechten en pak gerelateerde kwesties aan.

- Continue verbetering: Evalueer regelmatig de prestaties van het systeem en de beoordelingen van experts over de gegenereerde content. Verzamel meer inzichten en data om het model te verbeteren.

Leg het concept "in-context learning" uit in de context van LLM’s.

In-context learning verwijst naar het vermogen van LLM’s om hun stijl en output aan te passen op basis van de gegeven context zonder extra fine-tuning.

Het kan ook worden aangeduid als few-shot learning of prompt engineering. Dit kan door één of meerdere voorbeelden van de gewenste respons te geven of door duidelijk te beschrijven hoe het model zich moet gedragen.

In-context learning heeft ook beperkingen. Het is kortstondig en taakgebonden, omdat het model geen kennis behoudt in andere sessies van deze techniek.

Bovendien kan het model bij complexe vereiste output veel voorbeelden nodig hebben. Als de voorbeelden niet duidelijk genoeg zijn of de taak moeilijker is dan wat het model aankan, kan het soms onjuiste of inconsistente output genereren.

Hoe ontwerp je prompts strategisch om gewenst gedrag of gewenste output uit het model te krijgen? Wat zijn best practices voor effectieve prompt engineering?

Prompting is belangrijk om LLM’s te sturen naar specifieke taken. Effectieve prompts kunnen de noodzaak van fine-tuning verminderen met technieken zoals few-shot learning, taakdecompositie en prompttemplates.

Enkele best practices voor effectieve prompt engineering:

- Wees duidelijk en beknopt: Geef specifieke instructies zodat het model precies weet welke taak je wilt. Wees rechtlijnig en to the point.

- Gebruik voorbeelden: Voor in-context learning helpt het om een paar input-outputparen te tonen zodat het model de taak begrijpt zoals jij dat wilt.

- Breek complexe taken op: Als de taak ingewikkeld is, kan opsplitsen in kleinere stappen de kwaliteit van het antwoord verbeteren.

- Stel beperkingen of formaten in: Als je een specifieke stijl, formaat of lengte nodig hebt, vermeld die eisen dan duidelijk in de prompt.

Lees meer in deze blog over Prompt Optimization Techniques.

Welke technieken optimaliseren de inferentiesnelheid van generatieve AI-modellen?

- Model pruning: Onnodige gewichten/lagen verwijderen om de modelgrootte te verkleinen.

- Quantization: De precisie van modelgewichten reduceren naar fp16/int8.

- Knowledge distillation: Een kleiner model trainen om een groter model na te bootsen.

- GPU-acceleratie: Gespecialiseerde hardware gebruiken.

Kun je het concept "Conditionele Generatie" uitleggen en hoe dit wordt toegepast in modellen zoals Conditional GANs (cGAN’s)?

Conditionele generatie houdt in dat het model output genereert op basis van bepaalde voorwaarden of context. Dit biedt meer controle over de gegenereerde content. In cGAN’s worden zowel de generator als de discriminator geconditioneerd op extra informatie, zoals klasselabels. Zo werkt het:

- Generator: Ontvangt zowel ruis als conditionele informatie (bijv. een klasselabel) om data te produceren die bij de voorwaarde past.

- Discriminator: Beoordeelt de echtheid van de gegenereerde data en houdt daarbij rekening met de conditionele informatie.

Kun je de Mixture of Experts (MoE)-architectuur uitleggen? Waarom heeft die de voorkeur voor grote modellen?

Mixture of Experts (MoE) vervangt één dicht neuraal netwerk door veel gespecialiseerde "expert"-subnetwerken. Voor een gegeven token selecteert een router alleen de meest relevante experts om de data te verwerken, waardoor een model 100 miljard parameters kan hebben maar er voor inferentie slechts 10 miljard actief gebruikt.

Deze architectuur maakt modellen extreem slim (hoog totaal aantal parameters) terwijl ze snel en goedkoop blijven draaien (laag actief aantal parameters).

Interviewvragen over generatieve AI voor een AI-engineer

Als je solliciteert naar een AI-engineeringrol met focus op generatieve AI, kun je vragen verwachten die je vermogen toetsen om generatieve modellen te ontwerpen, implementeren en uit te rollen.

Wat is een agentische workflow versus een standaard chatbot?

Een standaard chatbot is passief: hij ontvangt een vraag en geeft een tekstantwoord op basis van zijn training.

Een agentische workflow geeft de LLM toegang tot tools (zoals een webbrowser, code-interpreter of API) en de autonomie om een meerstappenplan te maken om een doel op te lossen. De agent kan plannen om het web te doorzoeken, de data met Python-code te analyseren en vervolgens een rapport te schrijven, en dit herhalen tot de taak voltooid is.

Hoe borg je veiligheid en robuustheid bij LLM-deployment met Guardrails?

Het waarborgen van de veiligheid en robuustheid van LLM’s brengt verschillende uitdagingen met zich mee. Een primaire uitdaging is de potentiële generatie van schadelijke of bevooroordeelde output, aangezien deze modellen zijn getraind op enorme of zelfs ongefilterde databronnen en toxische of misleidende content kunnen produceren.

Een ander groot probleem met LLM-output is het gevaar van hallucinatie, waarbij het model zelfverzekerd klinkende content genereert die feitelijk onjuist is. Ook de beveiliging tegen adversarial prompts die de veiligheidsmaatregelen omzeilen en schadelijke of onethische reacties uitlokken, is een uitdaging, zoals herhaaldelijk is aangetoond bij diverse modellen.

Het opnemen van veiligheidsfilters en moderatielagen kan helpen om schadelijke content in de kiem te smoren. Voortdurende human-in-the-loop-toezicht verhoogt de veiligheid verder.

Daarnaast moeten engineers expliciete Guardrails (zoals NeMo Guardrails of Llama Guard) implementeren die tussen de gebruiker en het model in zitten. Deze systemen scannen input om prompt injection-pogingen of PII-lekken (Persoonlijk Identificeerbare Informatie) te blokkeren en scannen output om toxische of hallucinatoire reacties te onderscheppen voordat ze de gebruiker bereiken. Zo ontstaat een deterministische veiligheidslaag die onafhankelijk werkt van de probabilistische aard van het model.

Beschrijf een uitdagend project met generatieve AI dat je hebt aangepakt. Wat waren de belangrijkste uitdagingen en hoe heb je die overwonnen?

Het antwoord op deze vraag is sterk afhankelijk van je projecten en ervaring. Je kunt echter deze punten in gedachten houden bij het antwoorden:

- Kies een specifiek project met duidelijke AI-uitdagingen zoals bias, modelnauwkeurigheid of hallucinatie.

- Verduidelijk de uitdaging en leg de technische of operationele moeilijkheid uit.

- Laat je aanpak zien door sleutelstrategieën te noemen zoals data-augmentatie, modelafstemming of samenwerking met experts.

- Benadruk resultaten en kwantificeer de impact—verbeterde nauwkeurigheid, betere gebruikersbetrokkenheid of het oplossen van een businessprobleem.

Kun je je ervaring bespreken met het implementeren en uitrollen van generatieve AI-modellen in productieomgevingen?

Net als de vraag hierboven kun je dit beantwoorden op basis van je ervaring, maar houd ook rekening met het volgende:

- Focus op deployment: Noem infrastructuur (clouddiensten, MLOps-tools) en kerntaken bij uitrol (schalen, optimalisatie voor lage latency). Je hoeft niet de diepte in; laten zien dat je bij de tijd bent is voldoende.

- Noem een uitdaging: Het loont om één of twee veelvoorkomende valkuilen te noemen, om je expertise te tonen.

- Bespreek post-deployment: Neem monitoring- en onderhoudsstrategieën op om consistente prestaties te garanderen.

- Adresseeer veiligheid: Noem maatregelen tegen bias of voor veiligheid tijdens de uitrol.

Hoe ga je om met het "lost in the middle"-fenomeen in lange tekstvensters?

Zelfs met enorme contextvensters (bijv. 1 miljoen tokens) hebben LLM’s vaak moeite om informatie in het midden van de prompt terug te vinden; ze geven prioriteit aan het begin en einde.

Engineers mitigeren dit met slimme re-ranking-algoritmen die de belangrijkste teruggehaalde stukken naar het begin of het einde van het contextvenster verplaatsen. Een andere strategie is het "map-reduce"-algoritme, waarbij het model secties van het lange document afzonderlijk samenvat voordat ze worden gecombineerd tot een eindantwoord.

Hoe zou je het bouwen van een end-to-end RAG-systeem aanpakken?

Het bouwen van een RAG-systeem vereist een systematische aanpak. Zo kan de pijplijn eruitzien:

- Effectief chunken: Gebruik semantische of recursieve strategieën om documenten op te splitsen in betekenisvolle segmenten (in plaats van willekeurige tekentaantallen) zodat context behouden blijft.

- Vectoropslag: Embed deze chunks met een high-performance embeddingmodel en sla ze op in een vectordatabase, met rijke metadata (zoals data of auteurs) voor prefiltering.

- Hybride search: Implementeer een retrievallaag die keyword search (BM25) voor exacte matches combineert met vector search (semantische gelijkenis) om zowel specifieke termen als bredere concepten te vangen.

- Re-ranking: Pas een cross-encoder-model toe om de topresultaten opnieuw te scoren en agressief irrelevante "ruis"-chunks te filteren voordat ze de LLM bereiken.

- Bronvermelding & generatie: Prompt de LLM om antwoorden strikt te baseren op de geboden context en vraag om specifieke bronverwijzingen om hallucinatie te voorkomen.

Wat zijn open onderzoeksvragen of gebieden die je het meest interessant vindt in generatieve AI?

Het antwoord hangt ook hier af van je persoonlijke voorkeuren, maar dit zijn onderwerpen die je kunt noemen:

- Modelinterpreteerbaarheid verbeteren: Generatieve modellen transparanter en interpreteerbaarder maken.

- Ethische kaders: Richtlijnen ontwikkelen voor verantwoorde AI.

- Cross-modale generatie: Content genereren over meerdere datatypes (beeld, tekst, enz.).

- Adversarial robuustheid: Modellen resistent maken tegen adversarial attacks.

- Redeneervermogen: Het redeneervermogen van LLM’s vergroten.

Conclusie

Nu generatieve AI allerlei aspecten van ons leven en werk beïnvloedt, is het essentieel om nieuwsgierig te blijven naar de kernonderwerpen. Hoewel de mogelijke GenAI-vragen tijdens een interview afhangen van de specifieke rol en het bedrijf, heb ik 30 vragen en antwoorden verzameld om je op weg te helpen met je voorbereidingen.

Voor meer interviewvragen raad ik deze blogs aan:

Masterstudent Kunstmatige Intelligentie en AI-technisch schrijver. Ik deel inzichten over de nieuwste AI-technologie, maak ML-onderzoek toegankelijk en vereenvoudig complexe AI-onderwerpen die nodig zijn om jou voorop te houden.