Program

Kecerdasan buatan generatif (juga dikenal sebagai Generative AI atau GenAI) adalah subkategori AI yang berfokus pada pembuatan konten baru, seperti teks, gambar, atau video, menggunakan berbagai teknologi AI.

Seiring kemajuan GenAI, dampaknya merembes ke banyak bidang teknologi lain, seperti pengembangan perangkat lunak. Pengetahuan luas tentang dasarnya akan semakin relevan di bidang-bidang ini.

Untuk peran seperti data scientist, praktisi machine learning, dan insinyur AI, AI generatif adalah topik krusial yang harus dikuasai.

Berikut 30 pertanyaan wawancara GenAI yang mungkin ditanyakan selama wawancara.

Pertanyaan Wawancara AI Generatif Dasar

Mari mulai dengan beberapa pertanyaan wawancara AI Generatif yang mendasar. Ini akan menguji pemahaman Anda tentang konsep dan prinsip inti.

Apa perbedaan utama antara model diskriminatif dan generatif?

Model diskriminatif mempelajari batas keputusan antar kelas dan pola yang membedakannya. Model ini mengestimasi probabilitas P(y|x), yaitu probabilitas label tertentu y, diberikan data masukan x. Model ini berfokus membedakan kategori berbeda (misalnya, 'Apakah email ini spam?').

Model generatif mempelajari distribusi data itu sendiri dengan memodelkan probabilitas gabungan P(x,y), yang melibatkan pengambilan sampel titik data dari distribusi ini. Setelah dilatih pada ribuan gambar digit, pengambilan sampel ini dapat menghasilkan gambar digit baru.

Baca lebih lanjut di blog ini tentang Generative vs Discriminative Models: Differences & Use Cases.

Apa itu token dan embedding dalam konteks Large Language Models (LLM)?

Token adalah unit dasar teks yang diproses LLM; bisa berupa kata utuh, suku kata, atau bahkan huruf individual (misalnya, kata "generative" bisa dipecah menjadi "gener", "at", "ive").

Embedding adalah representasi vektor numerik dari token-token tersebut yang menempatkannya dalam ruang multi-dimensi berdasarkan maknanya. Konversi ini memungkinkan model menangkap makna semantik dan memahami hubungan antar kata, misalnya mengenali bahwa "king" dekat dengan "queen".

Bisakah Anda menjelaskan prinsip dasar di balik Generative Adversarial Networks (GAN)?

GAN terdiri dari dua jaringan saraf yang saling berkompetisi (karena itu disebut Adversarial): generator dan discriminator.

Generator membuat sampel data palsu sementara discriminator mengevaluasinya terhadap data latih yang asli. Kedua jaringan dilatih secara simultan:

- Generator bertujuan menghasilkan gambar yang sedemikian mirip dengan data asli sehingga discriminator tidak dapat membedakannya.

- Discriminator bertujuan mengidentifikasi dengan akurat apakah suatu gambar asli atau hasil generasi.

Melalui pembelajaran kompetitif ini, generator menjadi andal menghasilkan data yang sangat realistis dan mirip dengan data latih.

Apa saja aplikasi populer AI generatif di dunia nyata?

- Pembuatan teks: Digunakan dalam chatbot, pembuatan konten, atau penerjemahan (ChatGPT, Claude, Gemini).

- Pembuatan gambar: Menghasilkan gambar realistis untuk seni atau desain (mis., ChatGPT Images, Nano Banana Pro, Stable Diffusion).

- Agen pengodean: Menulis seluruh modul kode, digunakan dalam rekayasa perangkat lunak.

- Retrieval-Augmented Generation (RAG): Pengambilan pengetahuan perusahaan, digunakan dalam layanan pelanggan atau wiki internal.

- Penemuan obat: Merancang struktur molekul baru untuk obat.

- Augmentasi data: Memperluas dataset yang minim untuk machine learning.

Apa saja tantangan terkait pelatihan dan evaluasi model AI generatif?

- Biaya komputasi: Kebutuhan daya komputasi dan perangkat keras yang tinggi untuk melatih model yang lebih kompleks.

- Kerumitan pelatihan: Melatih model generatif bisa menantang dan penuh nuansa.

- Metrik evaluasi: Sulit menilai secara kuantitatif kualitas dan keragaman keluaran model.

- Kebutuhan data: Model generatif sering memerlukan data dalam jumlah besar dengan kualitas dan keragaman tinggi. Pengumpulannya bisa memakan waktu dan mahal.

- Bias dan keadilan: Model yang tidak diawasi dapat memperkuat bias dalam data latih, yang menghasilkan keluaran tidak adil.

Apa saja pertimbangan etis terkait penggunaan AI generatif?

Penggunaan GenAI yang meluas dan berbagai kasus penggunaannya memerlukan evaluasi menyeluruh terhadap kinerjanya dari sisi etika. Beberapa contohnya meliputi:

- Deepfake: Membuat media palsu namun sangat realistis dapat menyebarkan misinformasi atau mencemarkan nama baik individu.

- Generasi yang bias: Memperkuat bias historis dan sosial dalam data latih.

- Kekayaan intelektual: Penggunaan materi berhak cipta tanpa izin dalam data.

Bagaimana AI generatif dapat digunakan untuk menambah atau meningkatkan kreativitas manusia?

Walau halusinasi model AI bisa menghasilkan keluaran keliru, model generatif bermanfaat dalam banyak hal dan penggunaan. Model ini dapat menjadi inspirasi kreatif bagi para ahli di berbagai bidang:

- Seni dan desain: Memberikan inspirasi dalam seni dan desain.

- Asistensi menulis: Mengusulkan judul dan ide penulisan atau melengkapi teks.

- Musik: Menggubah ketukan dan harmoni.

- Pemrograman: Mengoptimalkan kode yang ada atau menawarkan pendekatan untuk masalah implementasi.

Apa perbedaan antara foundation model dan model yang di-fine-tune?

Sebuah Foundation Model (seperti GPT-5.2) dilatih pada sejumlah besar data internet yang luas untuk mempelajari pola umum, penalaran, dan struktur bahasa.

Model Fine-Tuned mengambil basis generalis ini dan melatihnya lebih lanjut pada dataset yang lebih kecil dan terkurasi untuk menguasai tugas spesifik, seperti diagnosis medis atau berbicara dalam bahasa pemrograman tertentu. Fine-tuning menukar keserbabisa luas dengan keahlian yang lebih mendalam di bidang tertentu.

Pertanyaan Wawancara AI Generatif Tingkat Menengah

Setelah membahas dasar-dasarnya, mari jelajahi beberapa pertanyaan wawancara AI generatif tingkat menengah.

Apa itu "Mode Collapse" dalam GAN, dan bagaimana menanganinya?

Layaknya kreator konten yang mendapati format video tertentu menghasilkan jangkauan dan interaksi lebih besar, model generatif dalam GAN bisa menjadi terpaku pada keragaman keluaran yang terbatas yang mampu mengecoh model discriminator. Akibatnya generator menghasilkan set keluaran yang kecil, mengorbankan keragaman dan fleksibilitas data yang dihasilkan.

Solusi yang mungkin mencakup fokus pada teknik pelatihan dengan menyesuaikan hiperparameter dan berbagai algoritme optimisasi, menerapkan regularisasi yang mendorong keragaman, atau menggabungkan beberapa generator untuk mencakup berbagai mode generasi data.

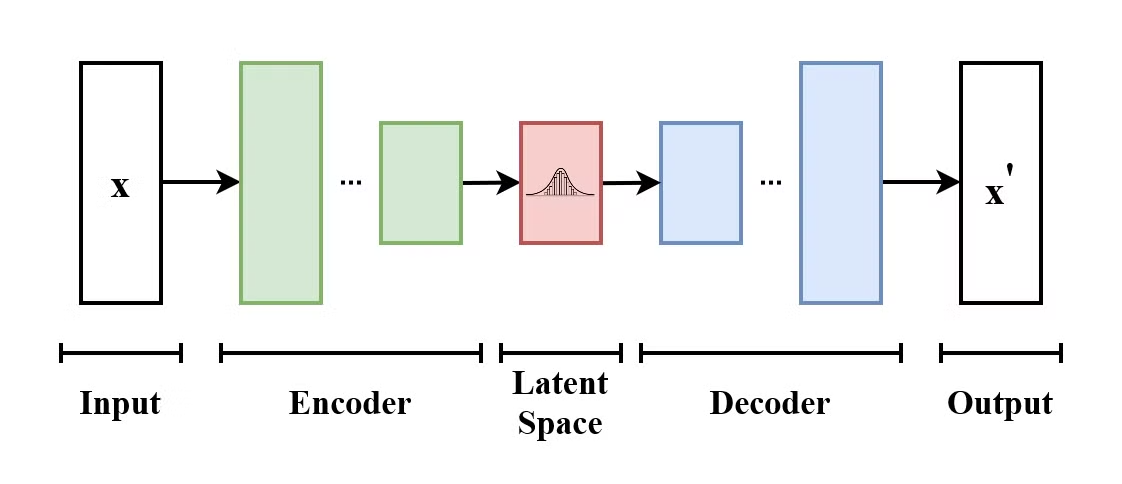

Bagaimana cara kerja Variational Autoencoder (VAE)?

Sebuah Variational Autoencoder (VAE) adalah jenis model generatif yang belajar mengenkode data masukan ke ruang laten dan mendekodenya kembali untuk merekonstruksi data masukan asli. VAE adalah model encoder-decoder:

- Bagian encoder memetakan data masukan ke distribusi atas ruang laten.

- Bagian decoder mengambil sampel dari distribusi ruang laten ini untuk merekonstruksi data masukan.

Struktur Variational Autoencoder. (Sumber: Wikimedia Commons)

Yang membedakan VAE dari autoencoder tradisional adalah VAE mendorong ruang laten untuk mengikuti distribusi yang diketahui (seperti Gaussian). Ini membuatnya lebih berguna untuk menghasilkan data baru dengan mengambil sampel dari ruang laten ini.

Jelaskan perbedaan antara Retrieval-Augmented Generation (RAG) dan fine-tuning. Kapan Anda menggunakan salah satunya?

RAG menghubungkan model ke sumber data eksternal (seperti wiki perusahaan Anda) untuk mengambil fakta terbaru tanpa melatih ulang model. Parameter model tetap sama; model hanya mendapat akses ke data tambahan.

Fine-tuning memodifikasi bobot internal model untuk mengubah cara model berbicara, berperilaku, atau bernalar, tetapi tidak bagus untuk menambahkan pengetahuan faktual baru.

Gunakan RAG ketika Anda memerlukan fakta terbaru (berita, data perusahaan privat) atau sitasi spesifik. Gunakan fine-tuning ketika Anda perlu model mempelajari "perilaku" baru, bahasa, atau format keluaran tertentu (mis., berbicara dalam kode SQL).

Bagaimana Anda mengevaluasi aplikasi LLM? Jelaskan 'LLM-as-a-Judge'.

Menilai sampel yang dihasilkan adalah tugas kompleks yang bergantung pada modalitas data (gambar, teks, video, dll.). Tradisionalnya, metrik teks seperti akurasi tidak memadai untuk tugas kreatif karena hanya memeriksa tumpang tindih kata, bukan makna.

Tolok ukur dan papan peringkat LLM menggunakan tes standar untuk mengukur seberapa baik model menangani tugas tertentu. Ini membantu membandingkan model dan melacak kemajuan dalam atau lintas modalitas.

LLM-as-a-Judge adalah kerangka evaluasi modern di mana model "guru" yang sangat mumpuni (seperti Gemini 3) menilai keluaran model yang lebih kecil berdasarkan kriteria tertentu, termasuk ketepatan, kebermanfaatan, dan nada. Ini menyediakan cara berskala untuk mendekati preferensi manusia tanpa kelambatan dan biaya tinjauan manusia manual.

Apa saja teknik untuk meningkatkan stabilitas dan konvergensi pelatihan GAN?

Meningkatkan stabilitas dan konvergensi pelatihan GAN penting untuk menghindari mode collapse, memastikan pelatihan efisien, dan mencapai hasil yang baik. Berikut beberapa teknik untuk meningkatkannya:

- Wasserstein GAN (WGAN): Menggunakan jarak Wasserstein sebagai fungsi loss, meningkatkan stabilitas pelatihan dan memberikan gradien yang lebih halus.

- Two-Timescale Update Rule (TTUR): Menggunakan laju pembelajaran terpisah untuk generator dan discriminator.

- Label Smoothing: Melembutkan label untuk mencegah kepercayaan berlebihan.

- Laju pembelajaran adaptif: Menggunakan optimizer seperti Adam untuk membantu mengelola laju pembelajaran secara dinamis.

- Gradient penalty: Memberi penalti pada gradien besar di discriminator untuk menegakkan kontinuitas Lipschitz demi pelatihan yang lebih stabil.

Bagaimana Anda mengendalikan gaya atau atribut konten yang dihasilkan menggunakan model AI generatif?

Ada beberapa teknik umum untuk mengendalikan gaya keluaran GenAI:

- Prompt engineering: Menentukan gaya keluaran yang diinginkan dengan memberi prompt detail yang menonjolkan gaya atau nada konten. Ini cara efektif dan sederhana baik pada model text-to-text maupun text-to-image. Akan jauh lebih efektif bila selaras dengan persyaratan spesifik atau dokumentasi model terkait.

- Kontrol temperature dan sampling: Parameter temperature mengendalikan seberapa acak keluaran. Temperature rendah berarti pemilihan token yang lebih konservatif dan prediktif, dan temperature tinggi memungkinkan generasi yang lebih kreatif. Parameter lain seperti top-k dan top-p juga dapat mengatur seberapa kreatif model memilih token berikutnya saat menghasilkan.

- Keluaran terstruktur: Untuk struktur, model modern memanfaatkan "JSON Mode" atau "Structured Outputs," yang membatasi model agar secara ketat menghasilkan skema JSON atau XML yang valid alih-alih teks bebas.

- System prompts: System prompt dikirim bersama setiap pesan baru ke model. Ini dapat digunakan untuk menetapkan instruksi perilaku persisten yang mengesampingkan masukan pengguna untuk mempertahankan persona atau aturan tertentu.

- Style transfer (Gambar): Teknik lain yang dapat digunakan saat inferensi pada model yang mendukungnya adalah menerapkan gaya satu gambar (gambar referensi) ke gambar masukan.

- Fine-tuning: Kita dapat menggunakan model pralatih dan melakukan fine-tune pada dataset spesifik yang berisi gaya atau nada yang diinginkan. Ini berarti melatih model lebih lanjut pada data tambahan untuk mempelajari gaya atau atribut tertentu.

- Reinforcement learning: Kita dapat membimbing model untuk lebih menyukai keluaran tertentu dan menjauh dari keluaran lain dengan memberikan umpan balik. Umpan balik ini digunakan untuk memodifikasi model melalui reinforcement learning. Seiring waktu, model akan selaras dengan preferensi pengguna dan/atau dataset preferensi. Contohnya, dalam konteks LLM, adalah Reinforcement learning from human feedback (RLHF).

Apa saja cara untuk menangani isu bias dalam model AI generatif?

Memastikan model tidak bias dan adil memerlukan penyesuaian iteratif dan pemantauan di setiap fase.

Pertama, kontaminasi data harus dicegah dengan memastikan tidak ada data uji yang bocor ke data latih. Jika terjadi, model akan dilatih untuk menghafal data alih-alih menggeneralisasinya.

Selanjutnya, kita harus memastikan data latih seberagam dan seinklusif mungkin. Selama pelatihan, kita bisa membimbing model menuju generasi yang lebih adil dengan memasukkan tujuan keadilan ke dalam fungsi loss.

Keluaran model harus dipantau secara berkala untuk mendeteksi bias. Untuk membangun kepercayaan publik, membantu bila proses pengambilan keputusan model, detail dataset, dan langkah prapemrosesan dibuat setransparan mungkin.

Bisakah Anda membahas konsep "Latent Space" dalam model generatif dan pentingnya?

Dalam konteks model Generatif, ruang laten adalah ruang berdimensi lebih rendah yang menangkap fitur esensial data sedemikian rupa sehingga masukan yang mirip dipetakan lebih dekat satu sama lain. Mengambil sampel dari ruang laten ini memungkinkan model menghasilkan data baru dan memanipulasi atribut atau fitur spesifik (menghasilkan variasi gambar).

Ruang laten adalah kunci untuk menghasilkan keluaran yang dapat dikendalikan, setia pada data latih, dan beragam.

Apa peran pembelajaran swasupervisi dalam pengembangan model AI generatif?

Gagasan utama pembelajaran swasupervisi adalah memanfaatkan korpus data tanpa label yang sangat besar untuk mempelajari representasi yang berguna tanpa perlu pelabelan manual. Model seperti BERT dan GPT dilatih dengan metode swasupervisi seperti prediksi token berikutnya, serta mempelajari struktur dan semantik bahasa. Ini mengurangi ketergantungan pada data berlabel, yang mahal dan memakan waktu untuk diperoleh, sehingga memungkinkan model memanfaatkan dataset tanpa label yang luas untuk pelatihan.

Apa itu Low-Rank Adaptation (LoRA)?

Melatih ulang model raksasa berparameter 70 miliar sangat mahal dan lambat bagi sebagian besar organisasi. Low-Rank Adaptation (LoRA) mengatasinya dengan membekukan bobot model utama dan hanya melatih lapisan "adapter" kecil (sering kurang dari 1% dari total parameter) yang ditempatkan di atasnya. Ini memungkinkan Anda menyajikan puluhan model "kustom" berbeda dari satu model dasar, secara drastis mengurangi biaya komputasi dan kebutuhan penyimpanan.

Pertanyaan Wawancara AI Generatif Tingkat Lanjut

Bagi yang mengejar peran lebih senior atau ingin menunjukkan pemahaman mendalam tentang AI Generatif, mari jelajahi beberapa pertanyaan wawancara tingkat lanjut.

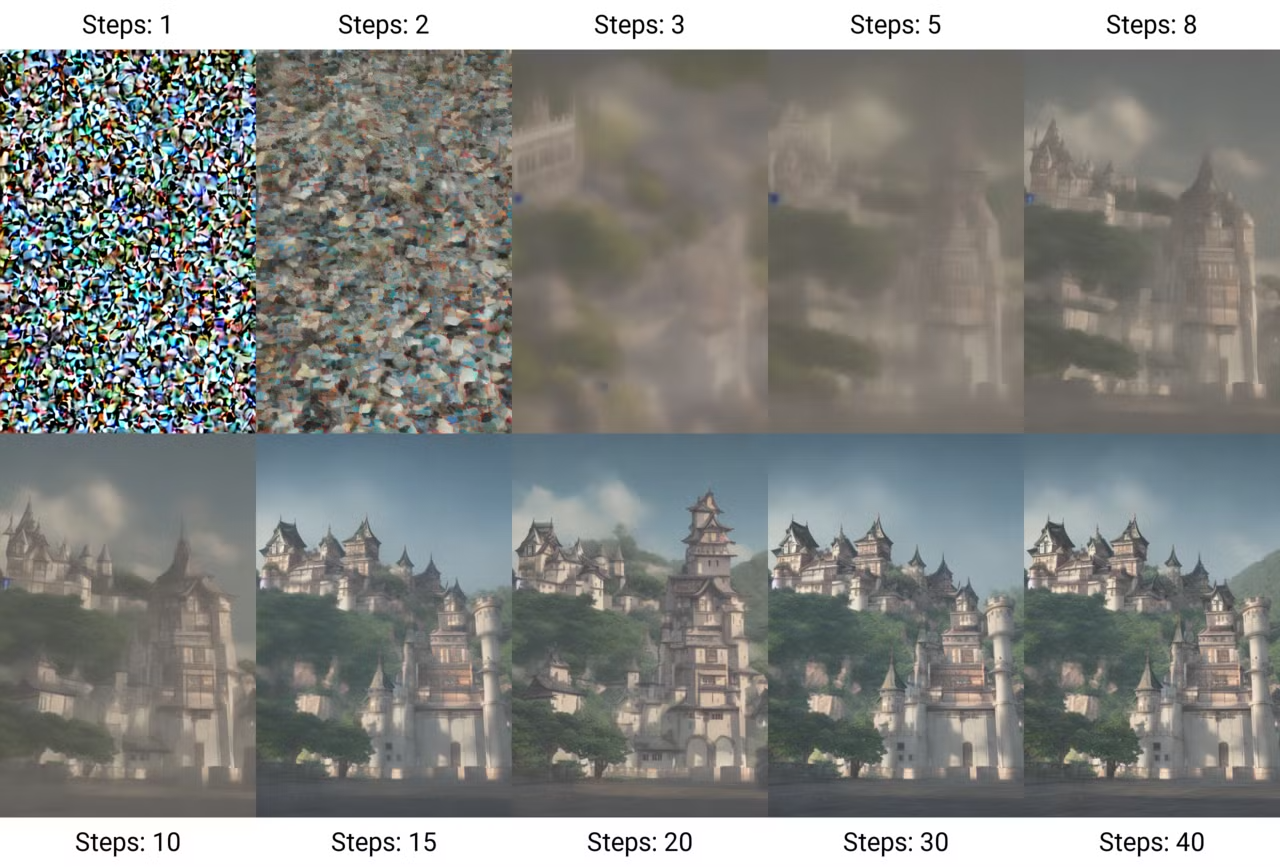

Jelaskan konsep "Diffusion Models" dan bagaimana perbedaannya dari arsitektur lama.

Diffusion Models bekerja terutama dengan menambahkan noise secara bertahap ke sebuah gambar hingga hanya tersisa noise—lalu mempelajari cara membalik proses ini untuk menghasilkan sampel baru dari noise. Proses ini disebut difusi. Model ini populer karena kemampuannya menghasilkan gambar yang berkualitas tinggi dan sangat detail.

Generasi sebuah gambar melalui langkah-langkah difusi. (Sumber: Wikimedia Commons)

Proses pelatihan model ini mencakup dua langkah:

- Proses maju (difusi): Mengambil gambar masukan dan menambahkan noise secara progresif selama beberapa langkah, hingga data berubah menjadi noise murni.

- Proses balik (denoising): Mempelajari cara mendapatkan kembali data asli dari noise. Ini dilakukan dengan melatih jaringan saraf untuk memprediksi apa itu noise, lalu melakukan denoising gambar selangkah demi selangkah hingga data asli dipulihkan dari noise.

Berbeda dengan GAN lama yang sering mengalami instabilitas pelatihan, model difusi lebih stabil dan dapat diskalakan, meski bisa lebih lambat karena sifatnya yang iteratif.

Varian modern seperti latent diffusion beroperasi di "ruang laten" terkompresi untuk mempercepat generasi, dan arsitektur flow matching kini menggantikan difusi standar demi kinerja yang lebih baik.

Bagaimana arsitektur Transformer bekerja, dan apa hambatan utamanya?

Arsitektur transformer yang diperkenalkan dalam makalah “Attention is All You Need”, merevolusi bidang AI generatif, khususnya dalam pemrosesan bahasa alami (NLP).

Tidak seperti recurrent neural network (RNN) tradisional yang memproses data secara berurutan, transformer menggunakan mekanisme self-attention untuk memberi bobot pada bagian-bagian berbeda dari masukan secara simultan. Ini memungkinkan model menangkap hubungan kontekstual secara efektif dan memungkinkan pemrosesan paralel urutan, yang secara signifikan mempercepat pelatihan.

Hambatan utama adalah mekanisme attention ini diskalakan secara kuadrat dengan panjang urutan—menggandakan context window memerlukan empat kali komputasi. Ini membuat "konteks tak terbatas" secara teoritis memungkinkan namun mahal secara komputasi, mendorong riset ke metode attention yang lebih efisien.

Apa itu "Reasoning Model" (pemikiran Sistem 2), dan bagaimana perbedaannya dari LLM standar?

LLM standar bertindak sebagai pemikir "Sistem 1", memprediksi kata berikutnya secara langsung berdasarkan pola permukaan.

Reasoning Model (seperti Gemini 3 atau DeepSeek-R1) dilatih untuk menghasilkan "rantai pemikiran" tersembunyi sebelum memberikan jawaban, memungkinkan mereka "berpikir", merencanakan, dan mengoreksi diri. Ini membuatnya jauh lebih baik dalam matematika kompleks, pengodean, dan teka-teki logika, meski lebih lambat dan lebih mahal dijalankan.

Bisakah Anda membahas tantangan menghasilkan konten beresolusi tinggi atau bentuk panjang menggunakan AI generatif?

Saat Anda meningkatkan kompleksitas generasi AI, Anda juga harus menangani:

- Biaya komputasi: Keluaran beresolusi tinggi memerlukan jaringan lebih besar dan daya komputasi lebih banyak.

- Pelatihan multi-GPU: Model yang lebih besar mungkin tidak muat dalam satu GPU, memerlukan pelatihan multi-GPU. Platform daring dapat mengurangi kerumitan implementasinya.

- Stabilitas pelatihan: Jaringan lebih besar dan arsitektur lebih kompleks membuat pemeliharaan prosedur pelatihan yang stabil lebih menantang.

- Kualitas data: Resolusi lebih tinggi dan konten bentuk panjang memerlukan data berkualitas lebih tinggi.

Apa saja tren dan arah riset yang muncul di bidang AI generatif?

Bidang GenAI berkembang dan bertransformasi dengan cepat. Ini mencakup:

- Model multimodal: Mengintegrasikan berbagai format data seperti teks, audio, dan gambar.

- Small language models (SLM): Berbeda dari large language models, SLM makin diminati karena efisiensi dan adaptabilitasnya. Model ini memerlukan sumber daya komputasi lebih sedikit, cocok untuk penerapan di lingkungan dengan kapabilitas terbatas—baca selengkapnya di blog tentang edge AI.

- AI etis: Mengembangkan kerangka kerja untuk memastikan kinerja model generatif yang selaras.

- Model Generatif untuk Video: Kemajuan dalam menghasilkan video yang sangat realistis dan konsisten melalui GenAI. Contoh terbaru termasuk Sora AI, Meta Movie Gen, dan Runway Act-One.

Bagaimana Anda merancang sistem untuk menggunakan AI generatif dalam membuat konten yang dipersonalisasi di industri spesifik, seperti kesehatan?

Merancang sistem yang menggunakan AI generatif untuk kasus penggunaan khusus industri membutuhkan pendekatan menyeluruh. Pedoman umum dapat disesuaikan dan dimodifikasi lintas industri lainnya.

- Memahami kebutuhan industri: Pengetahuan domain sebuah industri sangat memengaruhi keputusan yang mengarah pada desain sistem seperti ini. Langkah pertama adalah memperoleh pengetahuan umum dan praktis tentang industri, dasar-dasar, konsep, tujuan, dan kebutuhan.

- Pengumpulan dan pengelolaan data: Identifikasi penyedia data yang memungkinkan. Dalam kesehatan, ini berarti mengumpulkan data dari penyedia layanan kesehatan mengenai detail perawatan, informasi pasien, pedoman medis, dll. Rambu-rambu khusus industri terkait Privasi dan Keamanan Data harus diidentifikasi dan dipatuhi. Pastikan data berkualitas tinggi, akurat, mutakhir, dan mewakili kelompok yang beragam.

- Pemilihan model: Putuskan apakah akan melakukan fine-tune model pralatih atau merancang arsitektur dari nol. Bergantung pada jenis proyek, model AI generatif yang optimal dapat bervariasi. Model seperti GPT-4o mungkin pilihan plug-and-play yang baik. Beberapa domain mungkin memerlukan model yang di-host secara lokal untuk alasan privasi. Dalam hal ini, model open-source adalah pilihan yang tepat. Pertimbangkan untuk melakukan fine-tune model ini pada data khusus industri yang Anda kumpulkan sebelumnya.

- Validasi keluaran: Terapkan proses evaluasi menyeluruh di mana para ahli dan profesional memvalidasi konten yang dihasilkan sebelum dipraktikkan.

- Skalabilitas: Rancang infrastruktur berbasis cloud yang dapat diskalakan untuk menangani beban yang diperlukan tanpa mengorbankan kinerja.

- Pertimbangan legal dan etis: Tetapkan pedoman etis yang jelas untuk penggunaan AI dan komunikasikan keterbatasan model Anda secara transparan. Hormati hak kekayaan intelektual dan tangani isu terkait.

- Perbaikan berkelanjutan: Tinjau secara berkala kinerja sistem dan evaluasi para ahli terhadap konten yang dihasilkan. Kumpulkan lebih banyak wawasan dan data untuk memodifikasi model agar lebih baik.

Jelaskan konsep "in-context learning" dalam konteks LLM.

In-context learning mengacu pada kemampuan LLM untuk memodifikasi gaya dan keluarannya berdasarkan konteks yang diberikan tanpa perlu fine-tuning tambahan.

Ini juga dapat disebut sebagai few-shot learning atau prompt engineering. Ini dapat dicapai dengan menentukan satu atau banyak contoh respons yang diinginkan atau dengan menjelaskan dengan jelas bagaimana model harus berperilaku.

In-context learning juga memiliki keterbatasan. Ini bersifat jangka pendek dan spesifik tugas, karena model tidak benar-benar mempertahankan pengetahuan pada sesi lain saat menggunakan teknik ini.

Selain itu, jika keluaran yang diperlukan kompleks, model mungkin membutuhkan banyak contoh. Jika contoh yang diberikan kurang jelas atau tugasnya lebih sulit daripada kemampuan model, terkadang model menghasilkan keluaran yang salah atau tidak koheren.

Bagaimana prompt dapat dirancang secara strategis untuk memunculkan perilaku atau keluaran yang diinginkan dari model? Apa praktik terbaik untuk prompt engineering yang efektif?

Prompting penting untuk mengarahkan LLM dalam merespons tugas tertentu. Prompt yang efektif bahkan dapat mengurangi kebutuhan fine-tuning model dengan menggunakan teknik seperti few-shot learning, dekomposisi tugas, dan templat prompt.

Beberapa praktik terbaik untuk prompt engineering yang efektif meliputi:

- Jelas dan ringkas: Berikan instruksi spesifik agar model tahu persis tugas yang Anda inginkan. Sampaikan secara lugas dan to the point.

- Gunakan contoh: Untuk in-context learning, menampilkan beberapa pasangan input-output membantu model memahami tugas sebagaimana Anda inginkan.

- Uraikan tugas kompleks: Jika tugas rumit, menguraikannya menjadi langkah-langkah kecil dapat meningkatkan kualitas respons.

- Tetapkan batasan atau format: Jika Anda memerlukan gaya, format, atau panjang keluaran tertentu, nyatakan persyaratan tersebut dengan jelas dalam prompt.

Baca lebih lanjut di blog ini tentang Prompt Optimization Techniques.

Apa saja teknik untuk mengoptimalkan kecepatan inferensi model AI generatif?

- Pemangkasan model (pruning): Menghapus bobot/lapisan yang tidak perlu untuk mengurangi ukuran model.

- Kuantisasi: Mengurangi presisi bobot model ke fp16/int8.

- Knowledge distillation: Melatih model yang lebih kecil untuk meniru model yang lebih besar.

- Akselerasi GPU: Menggunakan perangkat keras khusus.

Bisakah Anda menjelaskan konsep "Conditional Generation" dan penerapannya pada model seperti Conditional GAN (cGAN)?

Conditional Generation melibatkan model yang menghasilkan keluaran berdasarkan kondisi atau konteks tertentu. Ini memungkinkan kontrol lebih atas konten yang dihasilkan. Dalam Conditional GAN (cGAN), baik generator maupun discriminator dikondisikan pada informasi tambahan, seperti label kelas. Cara kerjanya:

- Generator: Menerima noise dan informasi kondisional (mis., label kelas) untuk menghasilkan data yang selaras dengan kondisi.

- Discriminator: Mengevaluasi keaslian data yang dihasilkan sambil mempertimbangkan informasi kondisional.

Bisakah Anda menjelaskan arsitektur Mixture of Experts (MoE)? Mengapa lebih disukai untuk model besar?

Mixture of Experts (MoE) menggantikan satu jaringan saraf padat dengan banyak sub-jaringan "ahli" yang terspesialisasi. Untuk setiap token, sebuah router memilih hanya ahli yang paling relevan untuk memproses data, artinya sebuah model bisa memiliki 100 miliar parameter tetapi hanya menggunakan 10 miliar saat inferensi.

Arsitektur ini memungkinkan model sangat cerdas (jumlah parameter total tinggi) sekaligus tetap cepat dan murah dijalankan (jumlah parameter aktif rendah).

Pertanyaan Wawancara AI Generatif untuk Seorang Insinyur AI

Jika Anda diwawancarai untuk peran rekayasa AI dengan fokus pada AI generatif, harapkan pertanyaan yang menilai kemampuan Anda merancang, mengimplementasikan, dan menerapkan model generatif.

Apa perbedaan alur kerja agentic dibanding chatbot standar?

Chatbot standar bersifat pasif: menerima pertanyaan dan menghasilkan jawaban teks berdasarkan pelatihannya.

Sebuah alur kerja agentic memberi LLM akses ke alat (seperti peramban web, interpreter kode, atau API) dan otonomi untuk merencanakan proses multi-langkah guna menyelesaikan tujuan. Agen dapat merencanakan untuk menelusuri web, menganalisis data dengan kode Python, lalu menulis laporan, berulang hingga tugas tuntas.

Bagaimana Anda memastikan keamanan dan ketangguhan dalam penerapan LLM menggunakan Guardrails?

Memastikan keamanan dan ketangguhan LLM memiliki beberapa tantangan. Tantangan utama mencakup potensi menghasilkan keluaran yang berbahaya atau bias, karena model ini dilatih pada sumber data yang luas bahkan tidak tersaring dan dapat menghasilkan konten toksik atau menyesatkan.

Isu besar lainnya pada konten yang dihasilkan LLM adalah bahaya halusinasi, ketika model menghasilkan konten yang terdengar meyakinkan namun sebenarnya salah. Tantangan lain adalah keamanan terhadap prompt adversarial yang melanggar langkah-langkah keamanan model dan menghasilkan respons berbahaya atau tidak etis, seperti yang telah terbukti berkali-kali pada berbagai model.

Memasukkan filter keamanan dan lapisan moderasi dapat membantu mengidentifikasi dan menghapus konten berbahaya yang dihasilkan. Pengawasan human-in-the-loop yang berkelanjutan semakin meningkatkan keamanan model.

Selain itu, insinyur harus menerapkan Guardrails eksplisit (seperti NeMo Guardrails atau Llama Guard) yang berada di antara pengguna dan model. Sistem ini memindai masukan untuk memblokir upaya prompt injection atau kebocoran PII (Personally Identifiable Information) dan memindai keluaran untuk menangkap respons yang toksik atau berhalusinasi sebelum sampai ke pengguna. Ini menciptakan lapisan keamanan deterministik yang beroperasi secara independen dari sifat probabilistik model.

Jelaskan proyek menantang yang melibatkan AI generatif yang pernah Anda tangani. Apa tantangan utamanya, dan bagaimana Anda mengatasinya?

Menjawab pertanyaan ini sangat subjektif terhadap proyek dan pengalaman Anda. Namun, Anda dapat mengingat poin-poin ini saat menjawab pertanyaan seperti ini:

- Pilih proyek spesifik dengan tantangan AI yang jelas seperti bias, akurasi model, atau halusinasi.

- Perjelas tantangannya dan jelaskan kesulitan teknis atau operasionalnya.

- Tunjukkan pendekatan Anda dengan menyebutkan strategi kunci yang Anda gunakan seperti augmentasi data, tuning model, atau kolaborasi dengan para ahli.

- Soroti hasil dan kuantifikasi dampaknya—peningkatan akurasi, keterlibatan pengguna yang lebih baik, atau penyelesaian masalah bisnis.

Bisakah Anda membahas pengalaman Anda dalam mengimplementasikan dan menerapkan model AI generatif di lingkungan produksi?

Seperti halnya pertanyaan di atas, pertanyaan ini dapat dijawab berdasarkan pengalaman Anda, namun juga dengan tetap mengingat untuk:

- Fokus pada penerapan: Sebutkan infrastruktur (layanan cloud, alat MLOps) dan tugas penerapan kunci (skala, optimasi latensi rendah). Tidak perlu masuk ke detail. Menunjukkan bahwa Anda mengikuti perkembangan sudah memadai.

- Sebutkan tantangan: Ada baiknya menyebut satu dua tantangan umum yang perlu dihindari, untuk menunjukkan keahlian Anda.

- Bahas pasca-penerapan: Sertakan strategi pemantauan dan pemeliharaan untuk memastikan kinerja konsisten.

- Tanggapi aspek keamanan: Sebutkan langkah yang diambil untuk menangani bias atau keamanan selama peluncuran.

Bagaimana Anda menangani fenomena "lost in the middle" pada jendela teks panjang?

Bahkan dengan context window yang sangat besar (mis., 1 juta token), LLM sering kesulitan mengambil informasi yang terkubur di tengah prompt, memprioritaskan bagian awal dan akhir.

Insinyur mengatasinya dengan menggunakan algoritme re-ranking cerdas yang memindahkan potongan yang paling kritis ke awal atau akhir context window. Strategi lain adalah algoritme "map-reduce", di mana model merangkum bagian-bagian dokumen panjang secara terpisah sebelum menggabungkannya untuk jawaban akhir.

Bagaimana pendekatan Anda untuk membangun sistem RAG end-to-end?

Membangun sistem RAG memerlukan pendekatan sistematis. Berikut gambaran pipelinenya:

- Chunking yang efektif: Gunakan strategi semantik atau rekursif untuk membagi dokumen menjadi segmen bermakna (bukan hitungan karakter arbitrer) agar konteks terjaga.

- Penyimpanan vektor: Embedding potongan-potongan ini menggunakan model embedding berkinerja tinggi dan simpan dalam basis data vektor, sertakan metadata kaya (seperti tanggal atau penulis) untuk pra-penyaringan.

- Pencarian hibrida: Terapkan lapisan retrieval yang menggabungkan pencarian kata kunci (BM25) untuk kecocokan tepat dengan pencarian vektor (kemiripan semantik) untuk menangkap istilah spesifik dan konsep yang lebih luas.

- Re-ranking: Terapkan model cross-encoder untuk menilai ulang hasil teratas yang diambil, menyaring agresif potongan "noise" yang tidak relevan sebelum mencapai LLM.

- Sitasi & Generasi: Instruksikan LLM untuk menghasilkan jawaban secara ketat berdasarkan konteks yang disediakan dan wajibkan mencantumkan dokumen sumber spesifik untuk mencegah halusinasi.

Apa saja pertanyaan riset terbuka atau area yang paling menarik bagi Anda di bidang AI generatif?

Jawabannya juga bergantung pada preferensi pribadi Anda, namun berikut beberapa topik yang bisa disebutkan:

- Meningkatkan interpretabilitas model: Membuat model generatif lebih transparan dan dapat diinterpretasi.

- Kerangka etis: Mengembangkan pedoman untuk AI yang bertanggung jawab.

- Generasi lintas modal: Menghasilkan konten melalui berbagai tipe data (gambar, teks, dll.).

- Ketahanan adversarial: Membuat model tahan terhadap serangan adversarial.

- Kemampuan penalaran: Meningkatkan daya penalaran LLM.

Kesimpulan

Karena AI Generatif semakin memengaruhi berbagai aspek kehidupan dan karier kita, penting untuk terus mencermati topik-topik esensial. Walau pertanyaan GenAI yang mungkin ditanyakan saat wawancara bergantung pada peran dan perusahaan spesifik, saya telah mencoba merangkum 30 pertanyaan dan jawaban untuk membantu Anda memulai perjalanan persiapan wawancara.

Untuk mengeksplorasi lebih banyak pertanyaan wawancara, saya merekomendasikan blog berikut:

Mahasiswa magister Kecerdasan Buatan dan penulis teknis AI. Saya berbagi wawasan tentang teknologi AI terbaru, membuat riset ML lebih mudah diakses, dan menyederhanakan topik AI yang kompleks agar Anda tetap terdepan.