Programma

L’intelligenza artificiale generativa (nota anche come Generative AI o GenAI) è una sottocategoria dell’IA che si concentra sulla creazione di nuovi contenuti, come testo, immagini o video, utilizzando diverse tecnologie di IA.

Con l’avanzare della GenAI, il suo impatto si estende a molti altri campi tecnologici, come lo sviluppo software. Una solida conoscenza dei fondamenti continuerà a essere sempre più rilevante in questi ambiti.

Per ruoli come data scientist, praticanti di machine learning e ingegneri dell’IA, l’IA generativa è un argomento critico da padroneggiare.

Ecco 30 domande da colloquio su GenAI che potresti ricevere durante un’intervista.

Domande base per colloqui sull’IA generativa

Partiamo da alcune domande fondamentali sull’IA generativa. Queste verificano la tua comprensione dei concetti e dei principi chiave.

Quali sono le differenze principali tra modelli discriminativi e generativi?

I modelli discriminativi apprendono il confine decisionale tra le classi e i pattern che le differenziano. Stimano la probabilità P(y|x), cioè la probabilità di un’etichetta specifica y dato l’input x. Questi modelli si concentrano nel distinguere tra categorie diverse (ad es. “Questa email è spam?”).

I modelli generativi apprendono la distribuzione dei dati stessi modellando la probabilità congiunta P(x,y), che implica il campionamento di punti dati da questa distribuzione. Dopo l’addestramento su migliaia di immagini di cifre, tale campionamento può produrre una nuova immagine di una cifra.

Leggi di più in questo blog su Modelli generativi vs discriminativi: differenze e casi d’uso.

Cosa sono token ed embedding nel contesto dei Large Language Models (LLM)?

I token sono le unità fondamentali di testo che un LLM elabora; possono essere parole intere, sillabe o persino singole lettere (per esempio, la parola "generative" potrebbe essere suddivisa in "gener", "at", "ive").

Gli embedding sono rappresentazioni vettoriali numeriche di quei token che li collocano in uno spazio multidimensionale in base al loro significato. Questa conversione consente al modello di cogliere il significato semantico e comprendere le relazioni tra le parole, ad esempio riconoscendo che "king" è vicino a "queen".

Puoi spiegare i principi di base delle Generative Adversarial Networks (GAN)?

Le GAN sono composte da due reti neurali che competono tra loro (da qui il termine Adversarial): un generatore e un discriminatore.

Il generatore crea campioni di dati falsi mentre il discriminatore li valuta rispetto ai dati reali di training. Le due reti vengono addestrate simultaneamente:

- Il generatore mira a produrre immagini così indistinguibili dai dati reali che il discriminatore non riesca a notare la differenza.

- Il discriminatore mira a identificare accuratamente se un’immagine è reale o generata.

Attraverso questo apprendimento competitivo, il generatore diventa abile nel produrre dati altamente realistici simili a quelli di training.

Quali sono alcune applicazioni popolari dell’IA generativa nel mondo reale?

- Generazione di testo: usata in chatbot, creazione di contenuti o traduzione (ChatGPT, Claude, Gemini).

- Generazione di immagini: produzione di immagini realistiche per arte o design (ad es. ChatGPT Images, Nano Banana Pro, Stable Diffusion).

- Agent per il coding: scrittura di interi moduli di codice, usata in ingegneria del software.

- Retrieval-Augmented Generation (RAG): recupero di conoscenza aziendale, usato nell’assistenza clienti o per wiki interni.

- Scoperta di farmaci: progettazione di nuove strutture molecolari per i farmaci.

- Data augmentation: ampliamento di dataset ridotti per il machine learning.

Quali sono alcune sfide associate all’addestramento e alla valutazione di modelli di IA generativa?

- Costo computazionale: elevate risorse computazionali e requisiti hardware per addestrare modelli più complessi.

- Complessità dell’addestramento: addestrare modelli generativi può essere impegnativo e ricco di sfumature.

- Metriche di valutazione: è difficile valutare quantitativamente la qualità e la diversità degli output del modello.

- Requisiti di dati: i modelli generativi spesso richiedono enormi quantità di dati di alta qualità e diversità. La raccolta di tali dati può essere dispendiosa in termini di tempo e costi.

- Bias ed equità: se non controllati, i modelli possono amplificare i bias presenti nei dati di training, producendo output non equi.

Quali considerazioni etiche circondano l’uso dell’IA generativa?

L’ampio uso della GenAI e dei suoi casi d’uso richiede una valutazione accurata delle prestazioni in termini di etica. Alcuni esempi includono:

- Deepfake: la creazione di media falsi ma iper-realistici può diffondere disinformazione o diffamare individui.

- Generazione distorta: amplificazione di bias storici e sociali presenti nei dati di training.

- Proprietà intellettuale: uso non autorizzato di materiale coperto da copyright nei dati.

In che modo l’IA generativa può potenziare o migliorare la creatività umana?

Sebbene le allucinazioni dei modelli di IA possano produrre output errati, questi modelli generativi sono utili in molti ambiti e usi. Possono essere impiegati come fonte di ispirazione creativa per esperti in vari campi:

- Arte e design: fornire ispirazione in ambito artistico e di design.

- Assistenza alla scrittura: suggerire titoli e idee di scrittura o completare testi.

- Musica: comporre beat e armonie.

- Programmazione: ottimizzare codice esistente o proporre approcci a un problema di implementazione.

Qual è la differenza tra un foundation model e un modello fine-tuned?

Un Foundation Model (come GPT-5.2) è addestrato su enormi quantità di dati generici dal web per apprendere pattern generali, ragionamento e struttura del linguaggio.

Un modello Fine-Tuned parte da questa base generalista e viene addestrato ulteriormente su un dataset più piccolo e curato per padroneggiare un compito specifico, come la diagnosi medica o parlare in un particolare linguaggio di programmazione. Il fine-tuning scambia la versatilità ampia con una competenza più profonda in un dominio specifico.

Domande intermedie per colloqui sull’IA generativa

Ora che abbiamo coperto le basi, esploriamo alcune domande intermedie sull’IA generativa.

Cos’è il “Mode Collapse” nelle GAN e come affrontarlo?

Così come un creator che scopre che un certo formato di video porta più visibilità e interazioni, il modello generativo di una GAN può fissarsi su una limitata varietà di output che ingannano il discriminatore. Il risultato è che il generatore produce un insieme ridotto di output, a scapito della diversità e della flessibilità dei dati generati.

Possibili soluzioni includono concentrarsi sulle tecniche di training regolando iperparametri e algoritmi di ottimizzazione, applicare regolarizzazioni che promuovano la diversità o combinare più generatori per coprire modalità diverse di generazione dei dati.

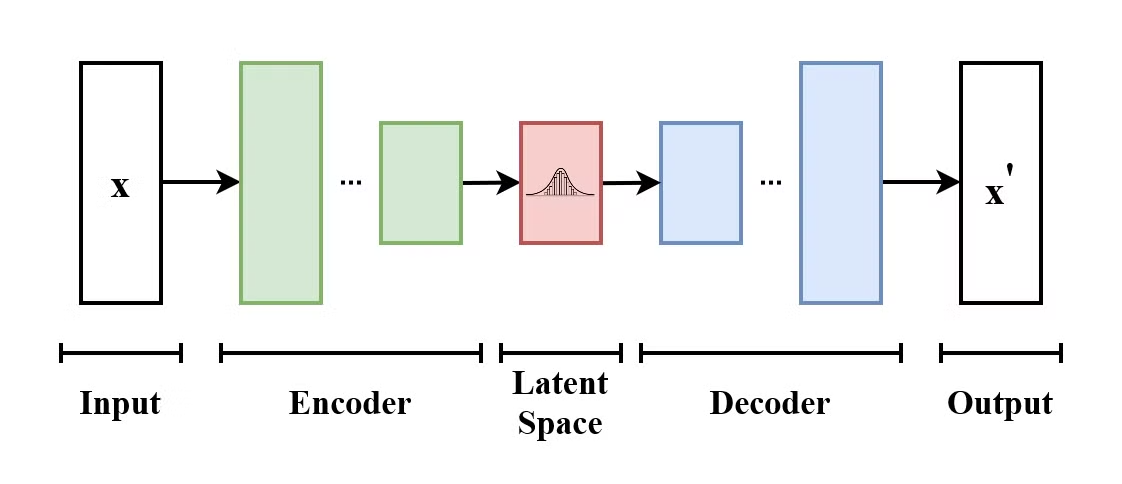

Come funziona un Variational Autoencoder (VAE)?

Un Variational Autoencoder (VAE) è un tipo di modello generativo che impara a codificare i dati di input in uno spazio latente e a decodificarli per ricostruire l’input originale. I VAE sono modelli encoder-decoder:

- L’encoder mappa i dati di input in una distribuzione sullo spazio latente.

- Il decoder campiona da questa distribuzione latente per ricostruire i dati di input.

La struttura di un Variational Autoencoder. (Fonte: Wikimedia Commons)

La differenza rispetto agli autoencoder tradizionali è che il VAE incoraggia lo spazio latente a seguire una distribuzione nota (come la gaussiana). Questo li rende più utili per generare nuovi dati campionando da questo spazio latente.

Spiega la differenza tra Retrieval-Augmented Generation (RAG) e fine-tuning. Quando useresti l’uno o l’altro?

RAG collega un modello a fonti di dati esterne (come la wiki aziendale) per recuperare fatti aggiornati senza riaddestrare il modello. I parametri del modello restano invariati; ha semplicemente accesso a dati aggiuntivi.

Il fine-tuning modifica i pesi interni del modello per cambiare come parla, si comporta o ragiona, ma non è adatto ad aggiungere nuove conoscenze fattuali.

Usa RAG quando ti servono fatti aggiornati (notizie, dati aziendali privati) o una citazione specifica. Usa il fine-tuning quando vuoi che il modello apprenda un nuovo “comportamento”, linguaggio o formato di output specifico (ad es. parlare in SQL).

Come valuteresti un’applicazione LLM? Spiega “LLM-as-a-Judge”.

Valutare i campioni generati è un compito complesso che dipende dalla modalità dei dati (immagine, testo, video, ecc.). Le tradizionali metriche testuali, come l’accuratezza, sono insufficienti per compiti creativi perché verificano solo la sovrapposizione di parole, non il significato.

Benchmark e classifiche LLM usano test standardizzati per misurare quanto bene un modello gestisce un dato compito. Sono utili per confrontare i modelli e tracciare i progressi all’interno o tra modalità.

LLM-as-a-Judge è un framework di valutazione moderno in cui un modello “insegnante” molto capace (come Gemini 3) valuta gli output di un modello più piccolo in base a criteri specifici, inclusi aderenza ai fatti, utilità e tono. Fornisce un modo scalabile per approssimare le preferenze umane senza la lentezza e i costi della revisione manuale.

Quali tecniche migliorano stabilità e convergenza nel training delle GAN?

Migliorare stabilità e convergenza è importante per evitare il mode collapse, garantire un training efficiente e ottenere buoni risultati. Ecco alcune tecniche utili:

- Wasserstein GAN (WGAN): usa la distanza di Wasserstein come funzione di perdita, migliorando la stabilità del training e fornendo gradienti più regolari.

- Two-Timescale Update Rule (TTUR): utilizza tassi di apprendimento separati per generatore e discriminatore.

- Label smoothing: ammorbidisce le etichette per prevenire eccessiva sicurezza.

- Learning rate adattivi: usare ottimizzatori come Adam per gestire dinamicamente il learning rate.

- Penalità di gradiente: penalizza grandi gradienti nel discriminatore per imporre la continuità Lipschitz e rendere il training più stabile.

Come puoi controllare lo stile o gli attributi dei contenuti generati con modelli di IA generativa?

Esistono diverse tecniche comuni per controllare lo stile degli output GenAI:

- Prompt engineering: specifica lo stile desiderato fornendo prompt dettagliati che evidenzino stile o tono del contenuto generato. È un metodo efficace e semplice sia nei modelli text-to-text che text-to-image. È molto più efficace se allineato ai requisiti specifici o alla documentazione del modello in questione.

- Temperatura e controllo del campionamento: il parametro di temperatura controlla quanto siano casuali gli output. Temperature basse significano una selezione di token più conservativa e prevedibile, temperature alte consentono una generazione più creativa. Altri parametri, come top-k e top-p, possono anch’essi regolare quanto creativamente il modello seleziona i possibili token successivi durante la generazione.

- Output strutturati: per imporre struttura, i modelli moderni utilizzano “JSON Mode” o “Structured Outputs”, che vincolano il modello a generare rigorosamente JSON o XML validi anziché testo libero.

- System prompt: i system prompt vengono inviati insieme a ogni nuovo messaggio al modello. Possono essere usati per impostare istruzioni comportamentali persistenti che hanno priorità sugli input dell’utente per mantenere specifiche personae o regole.

- Style transfer (immagini): un’altra tecnica utilizzabile in inferenza, per i modelli che la supportano, è applicare lo stile di un’immagine (immagine di riferimento) a un’immagine di input.

- Fine-tuning: possiamo usare un modello preaddestrato e affinarlo su un dataset specifico che contenga lo stile o il tono desiderato. Significa proseguire l’addestramento su dati aggiuntivi per apprendere stili o attributi specifici.

- Reinforcement learning: possiamo guidare il modello a preferire certi output ed evitare altri fornendo feedback. Questo feedback viene usato per modificare il modello tramite apprendimento per rinforzo. Nel tempo, il modello si allinea alle preferenze degli utenti e/o dei dataset di preferenze. Un esempio, nel contesto degli LLM, è il Reinforcement Learning from Human Feedback (RLHF).

Quali sono alcuni modi per affrontare il problema del bias nei modelli di IA generativa?

Garantire che il modello sia imparziale ed equo richiede aggiustamenti e monitoraggio iterativi in ogni fase.

Innanzitutto, bisogna prevenire la contaminazione dei dati assicurandosi che i dati di test non finiscano in training. In tal caso, il modello imparerebbe a memorizzare i dati anziché generalizzarli.

Inoltre, dobbiamo garantire che i dati di training siano il più possibile diversificati e inclusivi. Durante l’addestramento, possiamo guidare il modello verso una generazione più equa incorporando obiettivi di fairness nella funzione di perdita.

Gli output del modello devono essere regolarmente monitorati per individuare bias. Per costruire fiducia pubblica, aiuta rendere il più trasparente possibile il processo decisionale del modello, i dettagli del dataset e gli step di pre-processing.

Puoi discutere il concetto di “spazio latente” nei modelli generativi e la sua importanza?

Nel contesto dei modelli generativi, lo spazio latente è uno spazio a dimensionalità inferiore che cattura le caratteristiche essenziali dei dati in modo che input simili vengano mappati più vicini tra loro. Campionare da questo spazio consente ai modelli di generare nuovi dati e manipolare attributi o caratteristiche specifiche (generando variazioni di immagini).

Gli spazi latenti sono fondamentali per generare output controllabili, fedeli ai dati di training e diversificati.

Qual è il ruolo del self-supervised learning nello sviluppo di modelli di IA generativa?

L’idea chiave del self-supervised learning è sfruttare un vasto corpus di dati non etichettati per apprendere rappresentazioni utili senza bisogno di annotazioni manuali. Modelli come BERT e GPT sono addestrati con metodi self-supervised come la predizione del token successivo, apprendendo struttura e semantica delle lingue. Questo riduce la dipendenza da dati etichettati, costosi e lenti da ottenere, consentendo di fatto di sfruttare enormi dataset non etichettati per l’addestramento.

Cos’è la Low-Rank Adaptation (LoRA)?

Riaddestrare un modello enorme da 70 miliardi di parametri è proibitivamente costoso e lento per la maggior parte delle organizzazioni. Low-Rank Adaptation (LoRA) risolve congelando i pesi del modello principale e addestrando solo un piccolo livello “adapter” (spesso meno dell’1% dei parametri totali) che si sovrappone. Ciò consente di servire dozzine di modelli “custom” partendo da un unico modello base, riducendo drasticamente costi computazionali e necessità di storage.

Domande avanzate per colloqui sull’IA generativa

Per chi punta a ruoli più senior o vuole dimostrare una comprensione profonda della GenAI, esploriamo alcune domande avanzate.

Spiega il concetto di “modelli di diffusione” e in cosa differiscono dalle architetture precedenti.

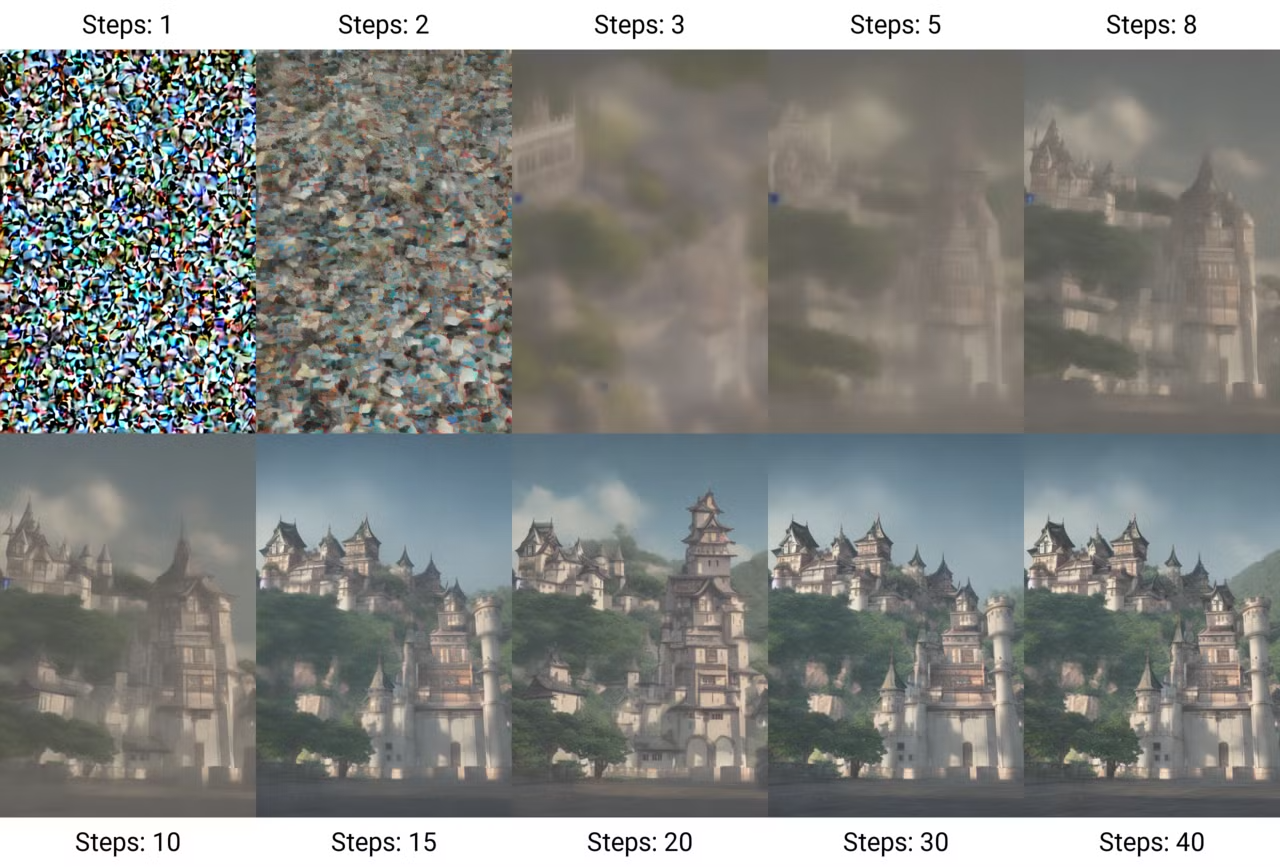

I modelli di diffusione operano aggiungendo gradualmente rumore a un’immagine finché non resta solo rumore—per poi imparare a invertire questo processo per generare nuovi campioni a partire dal rumore. Questo processo è detto diffusione. Questi modelli sono popolari per la capacità di produrre immagini di alta qualità e molto dettagliate.

Generazione di un’immagine attraverso step di diffusione. (Fonte: Wikimedia Commons)

Il training di questi modelli include due step:

- Processo forward (diffusione): si prende un’immagine di input e si aggiunge progressivamente rumore in più step, finché i dati diventano puro rumore.

- Processo inverso (denoising): si impara a recuperare i dati originali dal rumore. Questo avviene addestrando una rete neurale a predire il rumore, quindi a denoizzare l’immagine passo dopo passo finché i dati originali emergono dal rumore.

A differenza delle vecchie GAN, spesso affette da instabilità nel training, i modelli di diffusione sono più stabili e scalabili, sebbene possano essere più lenti per via della natura iterativa.

Varianti moderne come la diffusione latente operano in uno “spazio latente” compresso per accelerare la generazione, e le architetture di flow matching stanno sostituendo la diffusione standard per prestazioni ancora migliori.

Come funziona l’architettura Transformer e qual è il suo principale collo di bottiglia?

L’architettura transformer introdotta nell’articolo “Attention is All You Need” ha rivoluzionato il campo dell’IA generativa, in particolare nell’elaborazione del linguaggio naturale (NLP).

A differenza delle RNN tradizionali, che elaborano i dati in modo sequenziale, i transformer usano il meccanismo di self-attention per attribuire pesi a diverse parti dell’input simultaneamente. Ciò consente al modello di catturare efficacemente le relazioni contestuali e di elaborare in parallelo le sequenze, accelerando notevolmente l’addestramento.

Il principale collo di bottiglia è che questo meccanismo di attenzione scala quadraticamente con la lunghezza della sequenza—raddoppiare la context window richiede quattro volte il compute. Ciò rende l’“infinite context” teoricamente possibile ma computazionalmente costoso, spingendo la ricerca verso metodi di attenzione più efficienti.

Cos’è un “Reasoning Model” (pensiero di Sistema 2) e in che cosa differisce da un LLM standard?

Gli LLM standard agiscono come pensatori “Sistema 1”, prevedendo immediatamente la parola successiva basandosi su pattern superficiali.

I Reasoning Model (come Gemini 3 o DeepSeek-R1) sono addestrati a generare una “Chain of Thought” nascosta prima di fornire una risposta, permettendo loro di “pensare”, pianificare e autocorreggere gli errori. Questo li rende notevolmente migliori in matematica complessa, coding e rompicapi logici, sebbene siano più lenti e costosi da eseguire.

Puoi discutere le sfide della generazione di contenuti ad alta risoluzione o long-form con l’IA generativa?

Aumentando la complessità della generazione con l’IA, dovresti anche affrontare:

- Costo computazionale: output ad alta risoluzione richiedono reti più grandi e più potenza computazionale.

- Training multi-GPU: modelli più grandi possono non entrare in una singola GPU, richiedendo training su più GPU. Piattaforme online possono mitigare la complessità di tali sistemi.

- Stabilità del training: reti più grandi e architetture più complesse rendono più difficile mantenere procedure stabili di addestramento.

- Qualità dei dati: contenuti ad alta risoluzione e long-form richiedono dati di qualità superiore.

Quali sono alcune tendenze emergenti e direzioni di ricerca nel campo della GenAI?

Il campo della GenAI si evolve e si ridefinisce rapidamente. Questo include:

- Modelli multimodali: integrazione di più formati di dati come testo, audio e immagini.

- Small Language Models (SLM): a differenza dei large language models, gli SLM stanno guadagnando terreno per efficienza e adattabilità. Richiedono meno risorse computazionali, rendendoli adatti a contesti con capacità limitate—leggi di più in questo blog su edge AI.

- AI etica: sviluppo di framework per garantire prestazioni allineate dei modelli generativi.

- Modelli generativi per video: progressi nella generazione di video ultra-realistici e coerenti tramite GenAI. Gli ultimi esempi includono Sora AI, Meta Movie Gen e Runway Act-One.

Come progetteresti un sistema che usi l’IA generativa per creare contenuti personalizzati in un settore specifico, come l’healthcare?

Progettare un sistema che usi la GenAI per casi d’uso specifici di settore richiede un approccio accurato. Le linee guida generali possono essere adattate e modificate anche per altri settori.

- Comprendere le esigenze del settore: la conoscenza del dominio ha un impatto rilevante sulle decisioni di design del sistema. Il primo passo è acquisire una conoscenza generale e pratica del settore, dei fondamenti, dei concetti, degli obiettivi e dei requisiti.

- Raccolta e gestione dei dati: identifica i possibili fornitori di dati. Nell’healthcare significa raccogliere dati da strutture sanitarie su trattamenti, informazioni sui pazienti, linee guida mediche, ecc. Le barriere specifiche del settore relative a privacy e sicurezza dei dati devono essere identificate e rispettate. Assicurati che i dati siano di alta qualità, accurati, aggiornati e rappresentativi di gruppi diversi.

- Selezione del modello: decidi se effettuare il fine-tuning di modelli preaddestrati o progettare architetture da zero. A seconda del tipo di progetto, i modelli generativi ottimali possono variare. Un modello come GPT-4o può essere una buona scelta plug-and-play. Alcuni domini potrebbero richiedere modelli ospitati in locale per motivi di privacy. In tal caso, i modelli open source sono la via giusta. Considera il fine-tuning su dati specifici del settore raccolti in precedenza.

- Validazione degli output: implementa un processo di valutazione approfondito in cui esperti e professionisti convalidano i contenuti generati prima dell’uso pratico.

- Scalabilità: progetta un’infrastruttura cloud scalabile per gestire i carichi richiesti senza compromettere le prestazioni.

- Aspetti legali ed etici: definisci linee guida etiche chiare per l’uso dell’IA e comunica in modo trasparente le possibili limitazioni del modello. Rispetta i diritti di proprietà intellettuale e affronta eventuali problematiche correlate.

- Miglioramento continuo: rivedi regolarmente le prestazioni del sistema e le valutazioni degli esperti sui contenuti generati. Raccogli nuove informazioni e dati per aggiornare il modello in meglio.

Spiega il concetto di “in-context learning” nel contesto degli LLM.

L’in-context learning è la capacità degli LLM di modificare stile e output in base al contesto fornito senza necessità di ulteriore fine-tuning.

Può essere chiamato anche few-shot learning o prompt engineering. Si ottiene specificando uno o più esempi della risposta desiderata o descrivendo chiaramente come il modello dovrebbe comportarsi.

L’in-context learning ha anche limitazioni. È a breve termine e specifico del compito, poiché il modello non “trattiene” realmente la conoscenza in altre sessioni di utilizzo di questa tecnica.

Inoltre, se l’output richiesto è complesso, il modello potrebbe aver bisogno di molti esempi. Se gli esempi non sono abbastanza chiari o il compito è più difficile di quanto il modello possa gestire, talvolta può generare output errati o incoerenti.

Come progettare prompt per ottenere comportamenti o output desiderati dal modello? Best practice per un prompt engineering efficace

Il prompting è importante per indirizzare gli LLM a svolgere compiti specifici. Prompt efficaci possono persino ridurre la necessità di fine-tuning usando tecniche come few-shot learning, scomposizione del compito e template di prompt.

Alcune best practice per un prompt engineering efficace includono:

- Sii chiaro e conciso: fornisci istruzioni specifiche così che il modello sappia esattamente quale compito svolgere. Sii diretto e al punto.

- Usa esempi: per l’in-context learning, mostrare alcune coppie input-output aiuta il modello a comprendere il compito nel modo desiderato.

- Scomponi compiti complessi: se il compito è complicato, suddividerlo in step più piccoli può migliorare la qualità della risposta.

- Imposta vincoli o formati: se ti serve uno stile, un formato o una lunghezza specifici, dichiarali chiaramente nel prompt.

Leggi di più in questo blog su Tecniche di ottimizzazione dei prompt.

Quali tecniche esistono per ottimizzare la velocità di inferenza dei modelli di IA generativa?

- Pruning del modello: rimozione di pesi/livelli non necessari per ridurre la dimensione del modello.

- Quantizzazione: riduzione della precisione dei pesi a fp16/int8.

- Knowledge distillation: addestrare un modello più piccolo a imitare uno più grande.

- Accelerazione GPU: uso di hardware specializzato.

Puoi spiegare il concetto di “Generazione Condizionata” e come si applica in modelli come le Conditional GAN (cGAN)?

La Generazione Condizionata prevede che il modello generi output basandosi su determinate condizioni o contesti. Questo consente un maggiore controllo sui contenuti generati. Nelle Conditional GAN (cGAN), sia il generatore che il discriminatore sono condizionati da informazioni aggiuntive, come le etichette di classe. Funziona così:

- Generatore: riceve sia rumore che informazioni condizionali (ad es. un’etichetta di classe) per produrre dati coerenti con la condizione.

- Discriminatore: valuta l’autenticità dei dati generati considerando anche le informazioni condizionali.

Puoi spiegare l’architettura Mixture of Experts (MoE)? Perché è preferita per modelli di grandi dimensioni?

La Mixture of Experts (MoE) sostituisce una singola rete neurale densa con molte sotto-reti specializzate “expert”. Per ogni token, un router seleziona solo gli expert più rilevanti per elaborare i dati, per cui un modello può avere 100 miliardi di parametri ma usarne solo 10 miliardi in inferenza.

Questa architettura consente ai modelli di essere estremamente intelligenti (alto numero totale di parametri) restando al contempo veloci ed economici da eseguire (basso numero di parametri attivi).

Domande su IA generativa per un AI Engineer

Se stai sostenendo un colloquio per un ruolo di AI engineering con focus sulla GenAI, aspettati domande che valutino la tua capacità di progettare, implementare e mettere in produzione modelli generativi.

Cos’è un workflow agentico rispetto a un chatbot standard?

Un chatbot standard è passivo: riceve una richiesta e restituisce una risposta testuale in base al suo training.

Un workflow agentico dà all’LLM accesso a strumenti (come un browser web, un interprete di codice o un’API) e l’autonomia di pianificare un processo multi-step per raggiungere un obiettivo. L’agente può pianificare di cercare sul web, analizzare i dati con codice Python e poi scrivere un report, iterando finché il compito non è completato.

Come garantisci sicurezza e robustezza nel deployment di LLM usando Guardrail?

Garantire sicurezza e robustezza degli LLM comporta diverse sfide. Una primaria riguarda il potenziale di generare output dannosi o distorti, poiché questi modelli sono addestrati su fonti ampie o persino non filtrate e possono produrre contenuti tossici o fuorvianti.

Un altro problema rilevante dei contenuti generati dagli LLM è il rischio di allucinazione, quando il modello genera contenuti con tono sicuro che però sono informazioni errate. Un’ulteriore sfida è la sicurezza contro prompt avversari che violano le misure di sicurezza del modello e producono risposte dannose o non etiche, come dimostrato più volte su vari modelli.

Integrare filtri di sicurezza e livelli di moderazione può aiutare a individuare e rimuovere contenuti dannosi generati. Un monitoraggio continuo con human-in-the-loop migliora ulteriormente la sicurezza del modello.

Inoltre, gli ingegneri devono implementare espliciti Guardrail (come NeMo Guardrails o Llama Guard) che si interpongono tra utente e modello. Questi sistemi analizzano gli input per bloccare tentativi di prompt injection o fuoriuscita di PII (dati personali identificabili) e analizzano gli output per intercettare risposte tossiche o allucinatorie prima che raggiungano l’utente. Questo crea un livello di sicurezza deterministico che opera indipendentemente dalla natura probabilistica del modello.

Descrivi un progetto impegnativo con l’IA generativa che hai affrontato. Quali erano le principali sfide e come le hai superate?

La risposta è molto soggettiva rispetto ai tuoi progetti ed esperienze. Puoi però tenere a mente questi punti quando rispondi a domande simili:

- Seleziona un progetto specifico con sfide di IA chiare come bias, accuratezza del modello o allucinazioni.

- Chiarisci la sfida ed esplicita la difficoltà tecnica o operativa.

- Mostra il tuo approccio menzionando strategie chiave adottate come data augmentation, tuning del modello o collaborazione con esperti.

- Evidenzia i risultati e quantifica l’impatto—miglioramento dell’accuratezza, maggiore coinvolgimento degli utenti o risoluzione di un problema di business.

Puoi parlare della tua esperienza nell’implementazione e messa in produzione di modelli di IA generativa?

Come per la domanda precedente, puoi rispondere in base alla tua esperienza, tenendo però a mente di:

- Concentrarti sul deployment: menziona l’infrastruttura (servizi cloud, strumenti MLOps) e i task chiave di deployment (scalabilità, ottimizzazione a bassa latenza). Non serve scendere nei dettagli: dimostrare padronanza è sufficiente.

- Menzionare una sfida: vale la pena citare una o due sfide comuni da evitare, per dimostrare la tua esperienza.

- Coprire il post-deployment: includi strategie di monitoraggio e manutenzione per garantire prestazioni costanti.

- Affrontare la sicurezza: menziona le misure adottate per gestire bias o sicurezza durante il rollout.

Come gestisci il fenomeno “lost in the middle” nelle finestre di contesto lunghe?

Anche con context window enormi (ad es. 1 milione di token), gli LLM spesso faticano a recuperare informazioni sepolte nel mezzo del prompt, dando priorità a inizio e fine.

Gli ingegneri mitigano con algoritmi di re-ranking intelligenti che spostano i chunk recuperati più critici all’inizio o alla fine della finestra di contesto. Un’altra strategia è l’algoritmo “map-reduce”, in cui il modello riassume sezioni del documento lungo in modo indipendente prima di combinarle per una risposta finale.

Come imposteresti la costruzione di un sistema RAG end-to-end?

Costruire un sistema RAG richiede un approccio sistematico. Ecco come potrebbe essere la pipeline:

- Chunking efficace: usa strategie semantiche o ricorsive per suddividere i documenti in segmenti significativi (anziché in base a conteggi arbitrari di caratteri) per preservare il contesto.

- Archiviazione vettoriale: crea embedding dei chunk con un modello ad alte prestazioni e memorizzali in un database vettoriale, allegando metadati ricchi (come date o autori) per il pre-filtraggio.

- Ricerca ibrida: implementa un livello di retrieval che combina ricerca per parole chiave (BM25) per match esatti con ricerca vettoriale (similarità semantica) per catturare sia termini specifici sia concetti più ampi.

- Re-ranking: applica un modello cross-encoder per ricalibrare i migliori risultati recuperati, filtrando in modo aggressivo i chunk “rumorosi” irrilevanti prima che raggiungano l’LLM.

- Citazioni e generazione: chiedi all’LLM di generare risposte basandosi rigorosamente sul contesto fornito e richiedi di citare documenti sorgente specifici per prevenire allucinazioni.

Quali sono alcune domande di ricerca aperte o aree che trovi più interessanti nel campo della GenAI?

La risposta qui dipende dalle preferenze personali, ma ecco alcuni temi che puoi menzionare:

- Migliorare l’interpretabilità dei modelli: rendere i modelli generativi più trasparenti e interpretabili.

- Framework etici: sviluppare linee guida per un’IA responsabile.

- Generazione cross-modale: generare contenuti attraverso più tipi di dati (immagine, testo, ecc.).

- Robustezza avversaria: rendere i modelli resistenti agli attacchi avversari.

- Capacità di ragionamento: aumentare il potere di ragionamento degli LLM.

Conclusione

Poiché l’IA generativa sta trovando modi per influenzare vari aspetti delle nostre vite e carriere, è vitale mantenere uno sguardo curioso sugli argomenti essenziali. Sebbene le possibili domande su GenAI in un colloquio dipendano dallo specifico ruolo e dall’azienda, ho cercato di raccogliere 30 domande e risposte per aiutarti a iniziare la preparazione.

Per esplorare altre domande da colloquio, consiglio questi blog:

Studente magistrale in Intelligenza Artificiale e technical writer in ambito AI. Condivido approfondimenti sulle tecnologie AI più recenti, rendo la ricerca di ML accessibile e semplifico argomenti complessi legati all’AI, per aiutarti a restare in prima linea.