Program

Büyük dil modelleri (LLM'ler) yapay zekâda giderek daha önemli hale geldi ve çeşitli sektörlerde uygulama alanı buldu.

LLM uzmanlığına sahip profesyonellere olan talep arttıkça, bu makale temel kavramları, ileri teknikleri ve pratik uygulamaları kapsayan kapsamlı bir mülakat soru ve cevap seti sunar.

Bir iş görüşmesine hazırlanıyor ya da yalnızca bilginizi genişletmek istiyorsanız, bu makale işinize yarayacaktır.

Temel LLM Mülakat Soruları

LLM'leri anlamak için temel kavramlarla başlamak önemlidir. Bu temeller, mimari, kilit mekanizmalar ve tipik zorluklar gibi önemli yönleri kapsar ve daha ileri konuları öğrenmek için sağlam bir temel sağlar.

Transformer mimarisi nedir ve LLM'lerde nasıl kullanılır?

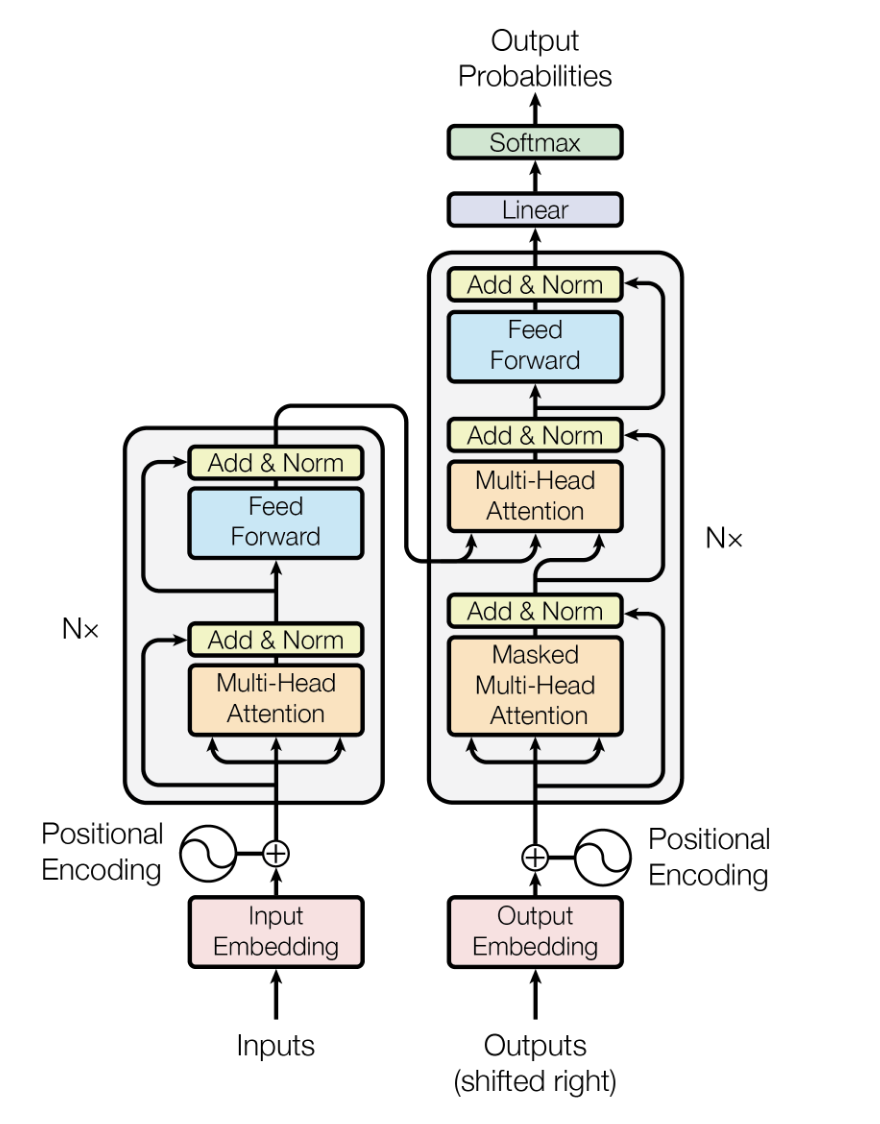

Transformer mimarisi, Vaswani ve ark. tarafından 2017'de tanıtılan, sıralı verileri önceki modellere (tekrarlayan sinir ağları - RNN ve uzun-kısa süreli bellek - LSTM gibi) kıyasla daha verimli ve performanslı şekilde işlemek üzere tasarlanmış bir derin öğrenme modelidir.

Girdiyi paralel olarak işlemek için öz-dikkat (self-attention) mekanizmalarına dayanır; bu da onu yüksek ölçeklenebilir kılar ve uzun menzilli bağımlılıkları yakalayabilmesini sağlar.

LLM'lerde Transformer mimarisi, modellerin büyük miktarda metni verimli şekilde işlemesini ve bağlama uygun, tutarlı çıktılar üretmesini sağlayan omurgayı oluşturur.

Transformer model mimarisi. Kaynak

LLM'lerde "bağlam penceresi" kavramını ve önemini açıklayın.

LLM'lerdeki bağlam penceresi, modelin dil üretirken veya anlarken aynı anda dikkate alabileceği metin aralığını (token veya kelime cinsinden) ifade eder. Bağlam penceresinin önemi, modelin mantıklı ve ilgili yanıtlar üretebilme becerisi üzerindeki etkisinden kaynaklanır.

Genel olarak, daha büyük bir bağlam penceresi modelin daha fazla bağlamı dikkate almasını sağlar; bu da özellikle karmaşık veya uzun konuşmalarda daha iyi anlama ve metin üretimine yol açar. Ancak bu durum hesaplama gereksinimlerini de artırır; dolayısıyla performans ve verimlilik arasında bir denge gerekir.

Ayrıca, son araştırmalar birçok modelin ilan edilen sınırlarına gelmeden çok önce performansının düştüğünü gösteriyor. Modeller, bağlamın ortasındaki bilginin göz ardı edildiği veya arka plana itildiği "arada kaybolma" olgusunu sergileyebilir. Bu nedenle, özenle seçilmiş, ilgili bağlamın küçük pencerelerde kullanılması, büyük pencereleri gürültüyle doldurmaktan çoğu zaman daha iyi sonuç verir.

LLM'ler için bazı yaygın ön eğitim hedefleri nelerdir ve nasıl çalışırlar?

LLM'ler için yaygın ön eğitim hedefleri maskeleme tabanlı dil modelleme (MLM) ve otoregresif dil modellemedir. MLM'de bir cümledeki rastgele kelimeler maskelenir ve modelden, çevreleyen bağlama dayanarak bu maskelenmiş kelimeleri tahmin etmesi istenir. Bu, modelin iki yönlü bağlamı anlamasına yardımcı olur.

Otoregresif dil modellemede, model bir dizideki bir sonraki kelimeyi tahmin eder ve metni her seferinde bir token üretecek şekilde eğitilir. Her iki hedef de modelin büyük metin derlemelerinden dil kalıplarını ve anlamsal yapıları öğrenmesini sağlar ve belirli görevlere ince ayar için sağlam bir temel sunar.

LLM bağlamında ince ayar (fine-tuning) nedir ve neden önemlidir?

İnce ayar, önceden eğitilmiş bir modelin alınarak daha küçük ve göreve özgü bir veri kümesi üzerinde yeniden eğitilmesidir. Bu süreç, modelin genel dil anlayışını belirli uygulamanın nüanslarına uyarlamasına yardımcı olur ve performansı artırır.

Bu, ön eğitim sırasında edinilen geniş dil bilgisinden yararlanırken modeli duygu analizi, metin özetleme veya soru-cevap gibi belirli uygulamalarda iyi performans gösterecek şekilde uyarladığı için önemli bir tekniktir.

LLM kullanımıyla ilişkili bazı yaygın zorluklar nelerdir?

LLM kullanımı çeşitli zorluklar içerir, örneğin:

- Hesaplama kaynakları: LLM'ler önemli ölçüde işlem gücü ve bellek gerektirir; bu da eğitim ve yaygınlaştırmayı kaynak yoğun hale getirir.

- Önyargı ve adillik: LLM'ler, eğitim verilerinde bulunan önyargıları farkında olmadan öğrenip yayabilir ve bu da adil olmayan çıktılara yol açabilir.

- Yorumlanabilirlik: LLM'lerin aldığı kararları anlamak ve açıklamak, karmaşık ve opak doğaları nedeniyle zor olabilir.

- Veri gizliliği: Eğitim için büyük veri kümelerinin kullanılması, veri gizliliği ve güvenliğiyle ilgili kaygıları artırabilir.

- Maliyet: LLM'lerin geliştirilmesi, eğitilmesi ve yaygınlaştırılması pahalı olabilir; bu da daha küçük kuruluşlar için erişilebilirliği sınırlar.

LLM'ler, sözlük dışı (OOV) kelime veya tokenları nasıl ele alır?

LLM'ler, Byte Pair Encoding (BPE) ve WordPiece gibi alt birim (subword) tokenleştirme tekniklerini kullanarak sözlük dışı (OOV) kelime veya tokenları ele alır. Bu teknikler, bilinmeyen kelimeleri modelin işleyebileceği daha küçük, bilinen alt birimlere böler.

Bu yaklaşım, bir kelime eğitim sırasında görülmemiş olsa bile modelin, parçalarına dayanarak metni anlayıp üretebilmesini sağlar; böylece esneklik ve sağlamlık artar.

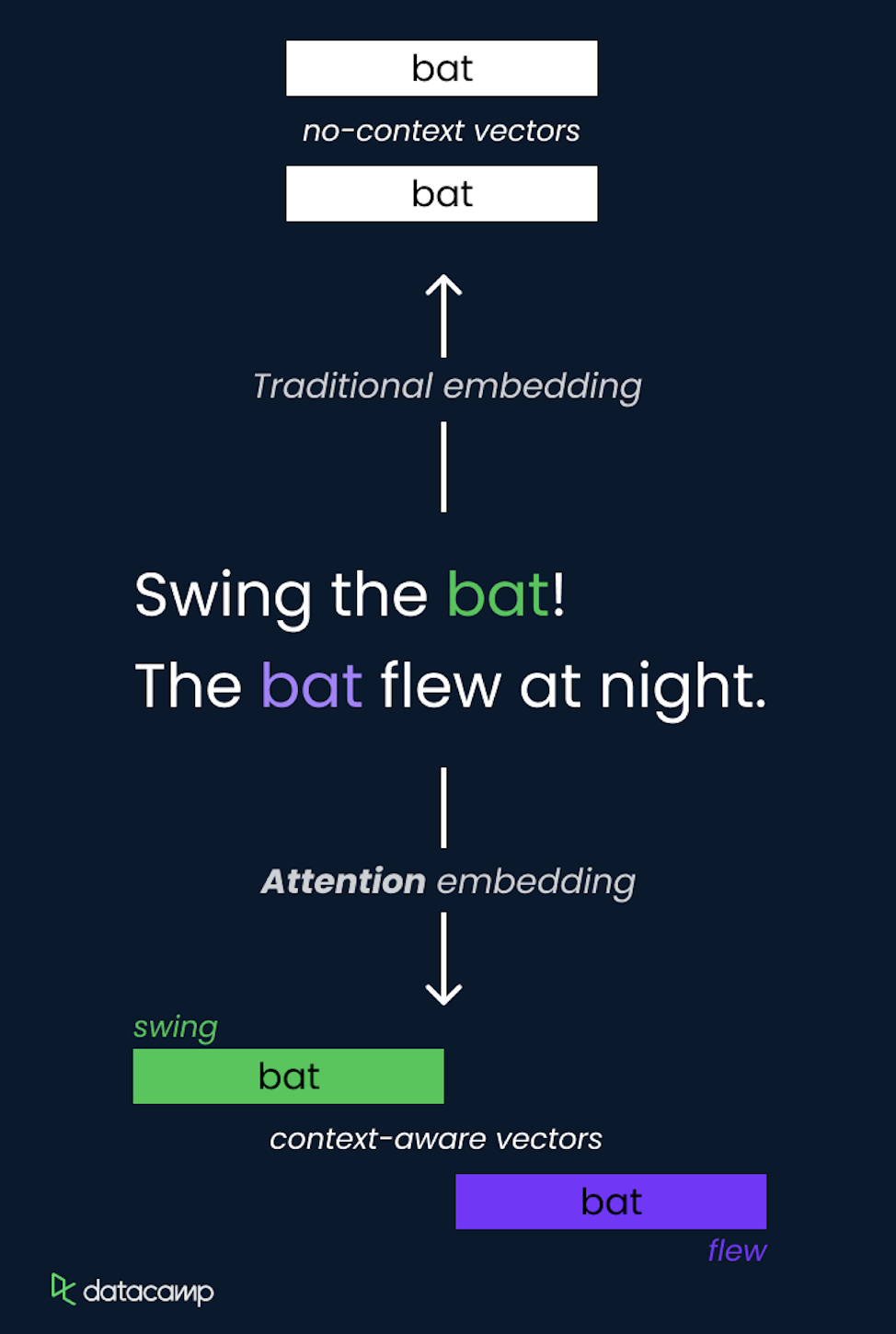

Gömme (embedding) katmanları nedir ve LLM'lerde neden önemlidir?

Gömme katmanları, kelime gibi kategorik verileri yoğun vektör temsillerine dönüştürmek için LLM'lerde kullanılan önemli bir bileşendir. Bu gömmeler, kelimeleri benzer kelimelerin daha yakın konumlandığı sürekli bir vektör uzayında temsil ederek aralarındaki anlamsal ilişkileri yakalar. LLM'lerde gömme katmanlarının önemi şunları içerir:

- Boyut indirgeme: Girdi verisinin boyutunu azaltarak modelin işlemesini daha yönetilebilir hale getirirler.

- Anlamsal anlayış: Gömmeler, kelimeler arasındaki incelikli anlamsal anlamları ve ilişkileri yakalayarak modelin insan benzeri metinleri anlama ve üretme yeteneğini artırır.

- Aktarım öğrenmesi: Önceden eğitilmiş gömmeler farklı model ve görevlerde kullanılabilir; bu da belirli uygulamalara ince ayar yapılabilecek sağlam bir dil anlayışı temeli sağlar.

Modern LLM konumsal kodlamaları nasıl çalışır ve Rotary Position Embeddings (RoPE) neden standart hale geldi?

Konumsal kodlamalar, transformerlara her tokenın dizide nerede bulunduğunu söyler.

Geleneksel sinüzoidal konumsal kodlamalar (Vaswani ve ark., 2017), konumları statik olarak kodlamak için sabit matematiksel fonksiyonlar kullanırdı. Daha yakın zamanda tanıtılan Rotary Position Embeddings (RoPE), temelde üstün özellikler sunduğu için modern LLM'lerde standart haline geldi.

RoPE, konumları karmaşık vektör uzayında dönme açıları olarak temsil ederek, token gömmelerini konumlarına orantılı bir açıyla döndürerek çalışır. Bu geometrik yaklaşım daha verimlidir ve eğitim sırasında görülenlerden daha uzun dizilere doğal olarak enterpolasyon yapmayı destekler; bu da bağlam pencerelerini genişletmek için kritik bir yetenektir. GPT-5.2 ve Gemini 3 gibi modeller, konumsal kodlama olarak RoPE kullanır.

Orta Düzey LLM Mülakat Soruları

Temel kavramların üzerine inşa edilen orta düzey sorular, LLM performansını optimize etmek için kullanılan pratik tekniklere ve hesaplama verimliliği ile model yorumlanabilirliğiyle ilgili zorluklara odaklanır.

LLM'lerde dikkat (attention) kavramını ve nasıl uygulandığını açıklayın.

LLM'lerde dikkat kavramı, modelin tahmin yaparken girdi dizisinin farklı bölümlerine odaklanmasına olanak tanıyan bir yöntemdir. Girdideki diğer tokenlara dinamik olarak ağırlıklar atar ve mevcut görev için en ilgili olanları öne çıkarır.

Bu, öz-dikkat kullanılarak uygulanır; model, dizideki her token için diğer tüm tokenlara göre dikkat skorları hesaplar ve böylece mesafeden bağımsız olarak bağımlılıkları yakalayabilir.

Öz-dikkat mekanizması, Transformer mimarisinin temel bir bileşenidir; bilgiyi verimli işlemeyi ve uzun menzilli ilişkileri yakalamayı sağlar.

LLM işleminde tokenleştirmenin (tokenization) rolü nedir?

Tokenleştirme, ham metni kelime, alt birim veya karakter olabilen daha küçük birimlere (tokenlara) dönüştürür.

LLM işleminde tokenleştirmenin rolü kritiktir, çünkü metni modelin anlayıp işleyebileceği bir formata dönüştürür.

Etkili tokenleştirme, nadir kelimeler ve farklı diller dâhil olmak üzere çok çeşitli girdilerin yönetilebilir parçalara ayrılmasını sağlayarak modelin bunlarla başa çıkabilmesini temin eder. Bu adım, girdi standardizasyonu sağlar ve modelin veride anlamlı kalıpları öğrenmesine yardımcı olduğu için eğitim ve çıkarımda (inference) gereklidir.

Bir LLM'in performansını nasıl ölçersiniz?

Araştırmacılar ve uygulayıcılar, bir LLM'in performansını ölçmek için çok sayıda değerlendirme metriği geliştirmiştir. Klasik metrikler şunlardır:

- Perpleksite: Modelin bir örneği ne kadar iyi tahmin ettiğini ölçer; dil modelleme görevlerinde yaygın olarak kullanılır.

- Doğruluk: Metin sınıflandırma gibi görevlerde doğru tahminlerin oranını ölçmek için kullanılır.

- F1 Skoru: Kesinlik ve duyarlılığın harmonik ortalaması; adlandırılmış varlık tanıma gibi görevlerde kullanılır.

- BLEU (Bilingual Evaluation Understudy) skoru: Makine tarafından üretilen metnin referans çevirilerle kalitesini ölçer; makine çevirisinde yaygın olarak kullanılır.

- ROUGE (Recall-Oriented Understudy for Gisting Evaluation): Üretilen metin ile referans metin arasındaki örtüşmeyi değerlendiren metrikler kümesi; özetleme görevlerinde sıklıkla kullanılır. Bu metrikler, modelin etkinliğini nicelleştirmeye ve daha ileri iyileştirmeleri yönlendirmeye yardımcı olur.

Geleneksel metriklerin ötesinde, uygulayıcılar artık farklı amaçlar için standartlaştırılmış kıyaslamalar kullanıyor; örneğin MMLU (57 görevli bilgi testi), MMMU-Pro (çok modlu akıl yürütme) ve HumanEval (kod üretimi). Ayrıca, LMArena gibi liderlik tabloları LLM'leri insan tercihlerine göre sıralar. Yayına alınmış sistemlerde, gerçek dünyadaki halüsinasyon oranlarını, gecikmeyi ve token verimliliğini ölçmek kritik hale gelmiştir.

Bir LLM'in çıktılarını kontrol etmek için hangi teknikler kullanılabilir?

Bir LLM'in çıktılarını kontrol etmek için çeşitli teknikler kullanılabilir, örneğin:

- Sıcaklık (temperature): Örnekleme sırasında bu parametrenin ayarlanması, çıktının rastgeleliğini kontrol eder. Daha düşük sıcaklıklar daha belirleyici çıktılar üretirken, daha yüksek değerler daha çeşitli sonuçlar döndürür.

- Top-K örnekleme: Örnekleme havuzunu en olası K tokene sınırlar; daha az ilgili veya anlamsız metinlerin üretilme olasılığını azaltır.

- Top-P (çekirdek) örnekleme: Kümülatif olasılığı P eşiğini aşan en küçük kümeden token seçer; çeşitlilik ve tutarlılık arasında denge sağlar.

- Prompt mühendisliği: Bağlam veya örnekler sağlayarak modeli istenen çıktılara yönlendirecek spesifik istemler tasarlamak.

- Kontrol tokenları: Modele belirli bir tarzda, biçimde veya içerik türünde metin üretmesi için sinyal veren özel tokenlar kullanmak.

LLM'lerin hesaplama maliyetini azaltmak için hangi yaklaşımlar kullanılabilir?

LLM'lerin hesaplama maliyetini azaltmak için şunları kullanabiliriz:

- Model budama (pruning): Modelden daha az önemli ağırlıkların veya nöronların kaldırılması; böylece boyut ve hesaplama gereksinimleri azalır.

- Kantizasyon: Model ağırlıklarını yüksek hassasiyetten (ör. 32-bit kayan nokta) düşük hassasiyete (ör. 8-bit tamsayı) dönüştürmek; bellek kullanımını azaltır ve çıkarımı hızlandırır.

- Damıtma (distillation): Daha küçük bir modelin (öğrenci), daha büyük ve önceden eğitilmiş bir modeli (öğretmen) taklit edecek şekilde eğitilmesi; daha az kaynakla benzer performans sağlar.

- Seyrek dikkat: Dikkat mekanizmasını tokenların bir alt kümesine sınırlayan seyrek transformerlar gibi teknikler kullanmak; hesaplama yükünü azaltır.

- Verimli mimariler: Reformer veya Longformer gibi, performansı korurken hesaplama gereksinimlerini en aza indirecek şekilde tasarlanmış verimli model mimarileri geliştirmek ve kullanmak.

LLM'lerde model yorumlanabilirliğinin önemi nedir ve nasıl sağlanabilir?

Model yorumlanabilirliği, bir LLM'in kararları nasıl aldığını anlamak için gereklidir; bu da güven inşa etmek, hesap verebilirliği sağlamak ve önyargıları tespit edip azaltmak açısından önemlidir. Yorumlanabilirlik farklı yaklaşımlarla sağlanabilir, örneğin:

- Dikkat görselleştirme: Modelin girişin hangi bölümlerine odaklandığını görmek için dikkat ağırlıklarının analiz edilmesi.

- Önem (saliency) haritaları: Model çıktısı üzerinde en büyük etkiye sahip girdi özelliklerinin vurgulanması.

- Modelden bağımsız yöntemler: Bireysel tahminleri açıklamak için LIME (Yerel Yorumlanabilir Modelden Bağımsız Açıklamalar) gibi teknikler kullanmak.

- Katman bazlı alaka yayılımı: Model tahminlerinin her katman veya nöronun katkılarına ayrıştırılması.

LLM'ler metindeki uzun vadeli bağımlılıkları nasıl ele alır?

LLM'ler, mimarileri sayesinde; özellikle de tüm tokenları aynı anda dikkate almalarını sağlayan öz-dikkat mekanizmasıyla uzun vadeli bağımlılıkları ele alır. Uzak tokenlara dikkat edebilme yeteneği, LLM'lerin uzun bağlamlar boyunca ilişkileri ve bağımlılıkları yakalamasına yardımcı olur.

Ayrıca, Transformer-XL ve Longformer gibi gelişmiş modeller, bağlam penceresini genişletmek ve daha uzun dizileri daha etkili şekilde yönetmek için özel olarak tasarlanmıştır; böylece uzun vadeli bağımlılıkların daha iyi ele alınması sağlanır.

Modern üretim modelleri, uzun vadeli bağımlılıkları ele almak ve genişleyen bağlam pencereleriyle bozulan performansı karşılamak için daha gelişmiş stratejiler kullanır; örneğin:

- Daha iyi uzunluk ekstrapolasyonu ve üstün konum kodlaması için Rotary Position Embeddings (RoPE).

- Uzun diziler için optimize edilmiş dikkat kalıpları; grup-sorgu ve çok başlı dikkat varyantları dâhil.

- Yalnızca bağlam penceresi kapasitesine güvenmek yerine RAG ile dikkatli bilgi entegrasyonu.

Retrieval-Augmented Generation (RAG) nedir ve nasıl evrildi?

RAG, metin üretimi sırasında dış kaynaklardan ilgili bilgileri getirmek için getirme (retrieval) mekanizmalarını üretici modellerle birleştirir. Bu yaklaşım, doğrudan iki kritik LLM kısıtını ele alır: halüsinasyon ve bilginin güncelliği. Geleneksel RAG nispeten basit getirme ve üretim hatları kullanır; ancak "RAG 2.0" evresinde önemli ölçüde daha sofistike hale gelmiştir.

RAG 2.0'ın temel özellikleri şunlardır:

- Özyinelemeli getirme: Modeller, getirilen bilgilerdeki boşlukları değerlendirir ve tek bir getirme geçişine güvenmek yerine bilgi boşluklarını doldurmak için proaktif olarak ikincil veya üçüncül aramalar yapar.

- Çok modlu getirme: Metin, görseller, PDF'ler, videolar ve hatta API çağrıları gibi çeşitli formatlar arasında entegrasyon; daha zengin bağlam toplama olanağı sunar.

- Hibrit indeksleme: Hem sözcüksel hem de anlamsal uygunluğu yakalamak için BM25 (anahtar kelime tabanlı) ve vektör (anlamsal) aramanın birleştirilmesi

- Yeniden sıralama katmanları: Gürültüyü ve ilgisiz bilgileri azaltmak için ilk getirme sonuçlarının akıllı filtrelenmesi

- Aracı (agentic) uyarlama: Sistemlerin, sorgu karmaşıklığına ve alana göre getirme yaklaşımlarını seçtiği dinamik strateji belirleme

RAG 2.0, LLM'lerle birlikte kullanıldığında, temel modellere kıyasla üretim sistemlerinde halüsinasyon oranlarını %40-60 azaltır.

İleri Düzey LLM Mülakat Soruları

LLM'lerde ileri düzey kavramları anlamak, bu modellerin başarabileceklerinin sınırlarını zorlamak isteyen profesyoneller için faydalıdır. Bu bölüm, alandaki karmaşık konuları ve sık karşılaşılan zorlukları inceler.

LLM'lerde "few-shot learning" kavramını ve avantajlarını açıklayın.

Few-shot öğrenme, LLM'lerin yalnızca birkaç örnek kullanarak yeni görevleri öğrenip gerçekleştirme becerisini ifade eder. Bu yetenek, LLM'in kapsamlı ön eğitim bilgisinden yararlanarak az sayıdaki örnekten genelleme yapmasını sağlar.

Few-shot öğrenmenin başlıca avantajları; büyük göreve özgü veri kümelerine olan ihtiyacı en aza indirerek veri gereksinimlerini azaltması, modele minimum ince ayarla çeşitli görevlere uyum sağlama esnekliği kazandırması ve daha düşük veri gereksinimleri ile daha kısa eğitim sürelerinin veri toplama ve hesaplama kaynaklarında önemli maliyet tasarruflarına dönüşmesidir.

Otoregresif ve maskeleme tabanlı dil modelleri arasındaki farklar nelerdir?

Otoregresif ve maskeleme tabanlı dil modelleri, ağırlıklı olarak tahmin yaklaşımları ve görev uygunlukları açısından farklılaşır. GPT-5.2, Claude 4.5 Opus ve Gemini 3 gibi otoregresif modeller, önceki kelimelere dayanarak bir dizideki bir sonraki kelimeyi tahmin eder ve metni her seferinde bir token üreterek oluşturur.

Bu modeller özellikle metin üretimi görevleri için uygundur. Buna karşılık, BERT gibi maskeleme tabanlı dil modelleri, bir cümledeki kelimeleri rastgele maskeler ve modelden, çevreleyen bağlama dayanarak bu maskelenmiş kelimeleri tahmin etmesini ister. Bu iki yönlü yaklaşım, modelin bağlamı her iki yönden de anlamasını sağlar ve onu metin sınıflandırma ve soru-cevap görevleri için ideal kılar.

Harici bilgiyi bir LLM'e nasıl dahil edebilirsiniz?

Harici bilginin bir LLM'e dahil edilmesi birkaç yöntemle sağlanabilir:

- Bilgi grafiği entegrasyonu: Bağlamsal bilgi sağlamak için model girdisinin, yapılandırılmış bilgi grafiklerinden gelen bilgilerle zenginleştirilmesi.

- Retrieval-Augmented Generation (RAG): Metin üretimi sırasında dış kaynaklardan ilgili bilgileri getirmek için getirme yöntemlerinin üretici modellerle birleştirilmesi. Modern RAG 2.0 sistemleri, basit getirme yaklaşımlarına kıyasla üstün bilgi entegrasyonu için özyinelemeli getirme, hibrit indeksleme ve yeniden sıralamayı kullanır.

- Alan-özel verilerle ince ayar: Modelin, gerekli bilgileri içeren ek veri setleri üzerinde eğitilerek belirli görev veya alanlar için uzmanlaştırılması.

- Prompt mühendisliği: Çıkarım sırasında modelin harici bilgiyi etkili şekilde kullanmasını sağlayacak istemler tasarlamak.

LLM'leri üretime alırken karşılaşılan bazı zorluklar nelerdir?

LLM'leri üretime almak çeşitli zorluklar içerir:

- Ölçeklenebilirlik: Modelin büyük hacimli istekleri verimli şekilde karşılayabilmesini sağlamak genellikle önemli hesaplama kaynakları ve optimize altyapı gerektirir.

- Gecikme: Sohbet botları ve sanal asistanlar gibi uygulamalarda gerçek zamanlıya yakın yanıtlar üretmek için yanıt süresini en aza indirmek kritik önemdedir.

- İzleme ve bakım: Model performansını sürekli izlemek ve gelişen veri ile görevlere uyum sağlayacak şekilde güncellemek; sağlam izleme sistemleri ve düzenli güncellemeler gerektirir.

- Etik ve hukuki hususlar: Önyargı, gizlilik ve düzenlemelere uyumla ilgili meselelerin ele alınması, etik sorunlardan ve hukuki sonuçlardan kaçınmak için esastır.

- Kaynak yönetimi: Çıkarım için gereken önemli hesaplama kaynaklarının yönetimi; donanım ve yazılım yapılandırmalarını optimize ederek maliyet etkinliğini sağlamayı içerir.

Yayına alınmış LLM'lerde zamanla model bozulması (degradation) nasıl ele alınır?

Model bozulması, temel veri dağılımındaki değişiklikler nedeniyle bir LLM'in performansının zamanla düşmesi durumunda ortaya çıkar. Model bozulmasını ele almak için performansı korumak üzere güncellenmiş verilerle düzenli yeniden eğitim gerekir. Bozulma işaretlerini tespit etmek ve model performansını izlemek için sürekli izleme şarttır.

Artımlı öğrenme teknikleri, modelin daha önce öğrendiği bilgileri unutmadan yeni verilerden öğrenmesini sağlar. Ayrıca, A/B testleri mevcut modelin performansını yeni sürümlerle karşılaştırır ve tam yayına almadan önce potansiyel iyileştirmelerin belirlenmesine yardımcı olur.

LLM'lerin etik kullanımını sağlamak için hangi teknikler uygulanabilir?

LLM'lerin etik kullanımını sağlamak için çeşitli teknikler uygulanabilir:

- Önyargı azaltma: Dengeli veri setleri ve önyargı tespit araçları kullanmak gibi stratejilerle eğitim verileri ve model çıktılarındaki önyargıların belirlenip azaltılması.

- Şeffaflık ve açıklanabilirlik: Güven ve hesap verebilirliği artırmak için yorumlanabilir ve açıklanabilir çıktılar üreten modeller geliştirmek; dikkat görselleştirme ve önem haritaları dâhil.

- Kullanıcı rızası ve gizlilik: Eğitim ve çıkarımda kullanılan verilerin gizlilik düzenlemelerine uygun olmasını sağlamak ve gerektiğinde kullanıcı rızasını almak.

- Adillik denetimleri: Model davranışının adillik ve etik etkilerini değerlendirmek için düzenli denetimler yapmak.

- Sorumlu yaygınlaştırma: Modelin ürettiği zararlı veya uygunsuz içeriklerin yönetilmesi dâhil sorumlu yapay zekâ yaygınlaştırması için kılavuz ve politikalar belirlemek.

LLM'lerle kullanılan verilerin güvenliğini nasıl sağlarsınız?

LLM'lerle kullanılan verilerin güvenliğini sağlamak, çeşitli önlemlerin uygulanmasını gerektirir. Buna, yetkisiz erişime karşı koruma için beklemede ve aktarım sırasında verilerin şifrelenmesi dâhildir. Hassas verilere yalnızca yetkili personelin erişebilmesini sağlamak için sıkı erişim kontrolleri gereklidir.

Eğitim veya çıkarım öncesinde kişisel olarak tanımlanabilir bilgilerin (PII) kaldırılması için verilerin anonimleştirilmesi de kritiktir. Ayrıca GDPR veya CCPA gibi veri koruma düzenlemelerine uyum, hukuki sorunlardan kaçınmak için zorunludur.

Bu önlemler, veri bütünlüğünü, gizliliğini ve erişilebilirliğini korumaya yardımcı olur. Bu koruma, kullanıcı güvenini sürdürmek ve düzenleyici standartlara uymak için kritiktir.

İnsan geri bildiriminden pekiştirmeli öğrenme (RLHF) LLM çıktı kalitesini ve güvenliğini nasıl iyileştirir ve DPO ile RLAIF gibi daha yeni hizalama yöntemleriyle nasıl karşılaştırılır?

RLHF, bir LLM'i insan değerlendiricilerden alınan geri bildirimi dahil ederek çıktıları insan tercihleriyle hizalayacak şekilde eğitmeye yönelik bir tekniktir. Bu yinelemeli süreç, modelin yalnızca doğru değil aynı zamanda güvenli, önyargısız ve faydalı yanıtlar üretmeyi öğrenmesine yardımcı olur.

Bununla birlikte RLHF, bazı zorluklar barındırır. Bunlardan biri, insan geri bildirimindeki potansiyel önyargıdır; farklı değerlendiriciler farklı tercih ve yorumlara sahip olabilir.

Bir diğer zorluk, geri bildirim sürecinin ölçeklenebilirliğidir; büyük miktarda insan geri bildirimi toplamak ve bunları dahil etmek zaman alıcı ve maliyetli olabilir. Ek olarak, RLHF'de kullanılan ödül modelinin istenen davranış ve değerleri doğru şekilde yakalamasını sağlamak güçtür. PPO (Proximal Policy Optimization) optimizasyon adımı, karmaşıklık ekler ve eğitim sırasında kararsızlığa neden olabilir.

RLHF'in birçok sınırlamasını ele alan modern alternatifler ortaya çıkmıştır:

- DPO (Direct Preference Optimization): Ayrı bir ödül modelini tamamen ortadan kaldırır ve ödül sinyallerini doğrudan tercih çiftlerinden türetir. Bu yaklaşım, PPO tabanlı RLHF'ye göre daha basit, daha kararlı ve hesaplama açısından verimlidir. DPO, bugün büyük yapay zekâ laboratuvarları tarafından geleneksel RLHF'ye bir alternatif veya tamamlayıcı olarak yaygın şekilde benimsenmiştir.

- GRPO (Gradient-based Reward Policy Optimization): DPO'nun sadeliğini PPO tarzı öğrenmenin bazı yönleriyle birleştiren bir varyant; ara çözümler sunar.

- RLAIF (Reinforcement Learning from AI Feedback): İnsan değerlendiriciler yerine yapay zekâ geri bildirimi (daha güçlü modellerden veya uzman değerlendiricilerden gelen puanlar gibi) kullanır. Bu yaklaşım, yapay zekâ geri bildirimi üretmek insan geri bildirimi toplamaktan daha ucuz ve hızlı olduğundan ölçeklenebilirlik zorluklarını ve maliyetleri önemli ölçüde azaltır.

Çoğu üretim modeli, saf PPO tabanlı RLHF yerine DPO, RLAIF veya hibrit kombinasyonlar kullanır.

Durum uzayı modellerini (Mamba gibi) Transformerlarla karşılaştırın. Ödünleşimler nelerdir ve her birini ne zaman kullanırsınız?

Bilgi temelli halüsinasyonlar, modelin doğru bilgilere sahip olmadığı (veya bilgilerin güncel olmadığı) durumlarda, kulağa makul gelen bilgileri uydurmasıyla ortaya çıkar. Çözümler genellikle şunları içerir:

- Modeli getirme (RAG) ile temellendirmek

- Doğrulanmış kaynaklar eklemek

- Alana özel ince ayar yapmak

Mantık temelli halüsinasyonlar, modelin ilgili bilgiye sahip olduğu ancak hatalı akıl yürüttüğü veya tutarsızlıklar ürettiği durumlarda görülür. Yaygın çözümler şunlardır:

- Yapılandırılmış istemler

- Doğrulama/kendi kendini kontrol adımları (çoğunlukla aracı iş akışlarıyla)

- Hedefli değerlendirme

LLM'lerde bilgi temelli ve mantık temelli halüsinasyonlar arasındaki fark nedir ve her birine nasıl yaklaşılır?

Bugün LLM'lerde Transformerlar baskın olsa da, Mamba gibi durum uzayı modelleri (SSM'ler), temelde farklı hesaplama ve performans özelliklerine sahip rekabetçi bir mimari paradigma olarak ortaya çıktı. Her ikisini de anlamak, modern LLM profesyonelleri için giderek daha önemli hale geliyor.

Transformerlar:

- Güçlü yönler: Bilgi getirme, kopyala/yapıştır görevleri ve bağlam içi öğrenmede mükemmel. Ölçeklenebilirlikte kanıtlanmış mimari; kapsamlı araç ve altyapı desteği. Kod üretimi ve çeşitli kıyaslamalarda güçlü ampirik performans.

- Zayıf yönler: O(N²) dikkat karmaşıklığı, karesel bellek ve hesaplama gereksinimleri oluşturur. Bu durum, çok uzun dizilerde (>100K token) performans düşüşü ve uzun bağlamlı uygulamalarda yüksek gecikme olarak kendini gösterir.

- Kullanım alanları ve öneriler: Bugün üretimdeki çoğu LLM (GPT, Claude, Gemini, Llama). Mevcut gerçek dünya uygulamaları ve öngörülebilir gelecek için önerilir.

Durum Uzayı Modelleri (Mamba, Mamba-2):

- Güçlü yönler: O(N) karmaşıklık ve doğrusal bellek ölçeklenmesi. Uzun dizilerde (>50K token) 5-10 kat daha hızlı çıkarım. Sinyal işleme için daha sağlam kuramsal temeller. Daha öngörülebilir ölçeklenme davranışı.

- Zayıf yönler: Transformerlarla karşılaştırılabilir performansa ulaşmak için 10 kat daha fazla eğitim verisi gerektirir. Bilgi getirme ve kopyalama görevlerinde daha zayıf. Daha az olgun ekosistem; daha az araç, kütüphane ve eğitilmiş model.

- Kullanım alanları ve öneriler: Uzun belge işleme, gecikme kısıtlı gerçek zamanlı sistemler, akış uygulamaları ve O(N) ölçeklemenin kritik olduğu uzmanlaşmış alanlar gibi özelleşmiş uygulamalar için gelişmekte olan bir seçenek.

Son araştırmalar, Transformerlar ile SSM'lerin doğrudan rakip olmaktan ziyade tamamlayıcı olduğunu; farklı kullanım alanları ve kısıtların farklı mimarileri tercih ettirdiğini gösteriyor. Transformerlar, genel amaçlı LLM'ler için pratik seçim olmaya devam ediyor ve şimdilik muhtemelen baskın olacak. Farklı hesaplama ve görev gereksinimleri için uzmanlaşmış modellerin yer aldığı bir hibrit gelecek olasıdır.

Prompt Mühendisleri için LLM Mülakat Soruları

Prompt mühendisliği, LLM'lerden yararlanmanın önemli bir yönüdür. Modelden istenen yanıtları üretmek için kesin ve etkili istemler hazırlamayı içerir. Bu bölüm, prompt mühendislerinin karşılaşabileceği temel soruları inceler.

Prompt mühendisliği nedir ve LLM'lerle çalışmak için neden kritiktir?

Prompt mühendisliği, LLM'leri doğru ve ilgili çıktılar üretmeye yönlendirmek için istemlerin tasarlanması ve iyileştirilmesini içerir. LLM'lerle çalışırken kritiktir; çünkü istemin kalitesi, modelin performansını doğrudan etkiler.

Etkili istemler, modelin görevi anlama, doğru ve ilgili yanıtlar üretme yeteneğini artırabilir ve hataların olasılığını azaltabilir.

Prompt mühendisliği, metin üretiminden karmaşık problem çözmeye kadar çeşitli uygulamalarda LLM'lerden en yüksek faydayı almak için gereklidir.

Farklı istem tekniklerine (zero-shot, few-shot, chain-of-thought) örnekler verebilir ve ne zaman kullanılacaklarını açıklayabilir misiniz?

- Zero-shot istemleme: Modele örnek vermeden yalnızca görev tanımı sağlanır. Genellikle örneklerin bulunmadığı durumlarda veya modelin genel anlayışını ve esnekliğini test etmek istediğimizde kullanılır.

- Few-shot istemleme: Görev tanımıyla birlikte birkaç örnek sağlanır ve model yönlendirilir. Modelin görevi daha iyi anlaması için bağlam veya örneklere ihtiyaç duyduğu durumlarda kullanışlıdır.

- Chain-of-Thought istemleme: Karmaşık bir görevi modelin takip edebileceği daha küçük, ardışık adımlara böler. Mantıksal akıl yürütme ve çok adımlı problem çözme gerektiren görevlerde yararlı olabilir.

- Aracı (agentic) istemleme: Modelleri; araçlar/API'ler çağıran, bilgi toplayan ve birden çok adımda akıl yürüten otonom ajanlar gibi davranacak şekilde yapılandırmak. İstemler, eylem uzayı tanımlarını, araç açıklamalarını ve açık akıl yürütme gerekliliklerini içerir.

Bir istemin etkinliğini nasıl değerlendirirsiniz?

Bir istemin etkinliğini değerlendirmek şunları içerir:

- Çıktı kalitesi: Model yanıtlarının alaka düzeyi, tutarlılığı ve doğruluğunun değerlendirilmesi.

- Tutarlılık: Modelin farklı girdilerde tutarlı şekilde yüksek kaliteli çıktılar üretip üretmediğinin kontrolü.

- Göreve özgü metrikler: Performansı ölçmek için çeviride BLEU veya özetlemede ROUGE gibi göreve özgü metriklerin kullanılması.

- İnsan değerlendirmesi: Model çıktılarına nitel geri bildirim sağlamak üzere insan değerlendiricilerin dâhil edilmesi.

- A/B testleri: Farklı istemlerin karşılaştırılarak hangisinin daha iyi performans verdiğinin belirlenmesi.

Prompt tasarımında yaygın tuzaklardan (ör. yönlendirici sorular, belirsiz talimatlar) kaçınmak için hangi stratejiler kullanılabilir?

- Yönlendirici sorulardan kaçının: İstemlerin belirli bir cevabı ima etmediğinden emin olun; bu, modelin yanıtında önyargıya yol açabilir.

- Açık ve özlü talimatlar: Belirsizliği azaltmak için açık ve anlaşılır talimatlar verin.

- Bağlam sağlama: Modelin görevi anlamasına yardımcı olmak için ilgili bağlamı ekleyin; ancak gereksiz bilgiyle aşırı yüklemekten kaçının.

- Yinelemeli test: Model çıktıları ve performansına göre istemleri sürekli test edip iyileştirin.

LLM performansını artırmak için yinelemeli prompt iyileştirmeye nasıl yaklaşırsınız?

Yinelemeli prompt iyileştirme şunları içerir:

- İlk tasarım: Görev gereksinimlerine dayalı temel bir istemle başlamak.

- Test ve değerlendirme: İstemin performansını çeşitli metriklerle değerlendirmek ve geri bildirim almak.

- Analiz: İstemdeki zayıflıkları veya iyileştirme alanlarını belirlemek.

- İyileştirme: Belirlenen sorunları gidermek için istemde ayarlamalar yapmak.

- Tekrar: İstenen performans elde edilene kadar test ve iyileştirme sürecini yinelemek.

Prompt mühendisliği sürecini kolaylaştırmak için hangi araç veya çerçeveleri kullanırsınız?

Prompt mühendisliği sürecini kolaylaştırabilecek çeşitli araç ve çerçeveler vardır:

- LLM'e özgü platformlar: İstem zincirleme ve aracı sistemler kurmak için LangChain ve LlamaIndex; hızlı prototipleme ve dağıtım için Vercel AI SDK.

- İstem testi ve optimizasyonu: PromptFoo (senaryolar arasında otomatik istem testi), DSPy (programatik istem optimizasyonu), Haystack (RAG hattı inşası).

- Etkileşimli geliştirme ortamları (IDE'ler): Deneyler için Jupyter Notebook; LLM uzantılarıyla VS Code (GitHub Copilot, Cursor); etkileşimli UI prototipleri oluşturmak için Streamlit.

- API'ler ve SDK'lar: OpenAI API, Anthropic SDK, Together AI ve yerel model dağıtımı için LM Studio.

- Sürüm kontrolü ve iş birliği: Git tabanlı istem sürümleme; deney takibi ve karşılaştırma için Weights & Biases; modelleri ve istemleri paylaşmak için HuggingFace Hub.

- Aracı çerçeveleri: AutoGPT, OpenAI Assistants API, karmaşık çok adımlı aracı iş akışları için LangGraph.

- Değerlendirme ve izleme: Ragas (RAG değerlendirme metrikleri), LangSmith (izleme, hata ayıklama ve üretim izleme), Braintrust (uçtan uca LLM gözlemlenebilirliği).

Prompt mühendisliğiyle LLM çıktılarındaki halüsinasyon veya önyargı gibi zorlukları nasıl ele alırsınız?

Bu soru, LLM tarafından üretilen içeriğin etik ve pratik yönlerine odaklanır. Güçlü bir yanıt, bu sorunların farkında olunduğunu gösterir ve aşağıdaki gibi teknikleri tartışır.

Halüsinasyon azaltma teknikleri:

- Gerçek doğrulama istemleri: Modeli, bilgilerini güvenilir kaynaklara karşı doğrulamaya ve açıkça kanıt göstermeye teşvik eden istemler ekleyin.

- Getirme entegrasyonu: Yanıtları gerçek belgelere dayandırmak için RAG veya RAG 2.0 sistemlerini kullanın; böylece modelin getirilen bilgilere referans vermesi zorunlu kılınarak uydurma olgular azaltılır.

- Aracı doğrulama döngüleri: Modelin yanıt vermeden önce kendi çalışmasını kontrol ettiği çok adımlı doğrulama yapacak şekilde istemleri yapılandırın; esasen kendi kendini doğrulayan ajanlar oluşturun.

- Kısıt temelli istemler: Tutarsızlıkları veya desteklenmeyen iddiaları görünür kılacak çıktı biçimi ve mantıksal kısıtları tanımlayın.

Önyargı azaltma teknikleri:

- Çeşitli bakış açıları istemleri: Sonuca varmadan önce modelin birden fazla bakış açısını ve paydaş perspektiflerini dikkate almasını sağlayın.

- Önyargı tespit istemleri: Modelden kendi akıl yürütmesindeki ve çıktısındaki potansiyel önyargıları tespit etmesini isteyin.

- Karşı olgusal (counterfactual) istemler: İlk varsayımları sorgulamak ve akıl yürütmenin sağlamlığını test etmek için alternatif senaryolar veya perspektifler talep edin.

- Talimat netliği: Yanıtların dengeli olmasını, sınırlamaları kabul etmesini ve ayrımcı dilden kaçınmasını açıkça belirtin.

Prompt şablonlarının rolünü ve prompt mühendisliğinde nasıl kullanıldıklarını açıklayabilir misiniz?

Prompt şablonları, genellikle belirli bilgiler veya talimatlar için yer tutucular içeren yapılandırılmış bir istem formatı sağlar. Farklı görev ve senaryolarda yeniden kullanılabilirler; bu da prompt tasarımında tutarlılığı ve verimliliği artırır.

İyi bir yanıt, prompt şablonlarının en iyi uygulamaları kapsayacak, alan-özel bilgiyi içerecek ve çeşitli uygulamalar için etkili istemler üretme sürecini kolaylaştıracak şekilde nasıl kullanılabileceğini açıklar.

Tokenleştirici seçimi, prompt mühendisliğini ve model performansını nasıl etkiler?

Tokenleştirici, LLM'in girdi istemini nasıl yorumlayıp işleyeceğinde kritik rol oynar. Farklı tokenleştiricilerin farklı sözlük boyutları vardır ve sözlük dışı (OOV) kelimeleri farklı şekilde ele alırlar. Byte Pair Encoding (BPE) gibi bir alt birim tokenleştirici, OOV kelimeleri daha küçük alt birimlere bölerek işleyebilirken, kelime tabanlı bir tokenleştirici bunları bilinmeyen tokenlar olarak ele alabilir.

Tokenleştirici seçimi, çeşitli şekillerde model performansını etkileyebilir. Örneğin, alt birim tokenleştirici nadir veya teknik terimlerin anlamını yakalamada daha etkili olabilirken, kelime tabanlı bir tokenleştirici genel amaçlı dil görevleri için daha basit ve hızlı olabilir.

Prompt mühendisliğinde tokenleştirici seçimi, istemlerin nasıl yapılandırılacağını etkileyebilir. Örneğin, alt birim tokenleştirici kullanıyorsanız, kelimelerin alt birimlere nasıl bölündüğüne daha fazla dikkat ederek modelin amaçlanan anlamı yakalamasını sağlamanız gerekebilir.

Aracı (agentic) istemleme nedir ve geleneksel prompt mühendisliğinden nasıl farklıdır?

Aracı istemleme, modelin bir hedefi tamamlayana kadar plan yapan, eyleme geçen (örneğin araçlar/API'ler çağıran veya belgeleri getiren), sonuçları gözlemleyen ve yineleyen bir “ajan” gibi davranması talimatını veren bir istem tasarım yaklaşımıdır.

Geleneksel prompt mühendisliği, net talimatlar, örnekler ve biçim kısıtlarıyla tek seferde mümkün olan en iyi yanıtı almaya çalışırken; aracı istemleme, çok adımlı bir kontrol döngüsünü (planla → uygula → gözlemle → iyileştir) vurgular.

Özellikle doğruluğun, modelin yalnızca dahili bilgisine güvenmek yerine harici sistemlerle (veritabanları, arama, kod yürütme) etkileşim kurmasına veya ara sonuçları doğrulamasına bağlı olduğu görevlerde kullanışlıdır.

İyi aracı istemler genellikle amacı, mevcut araçları/eylemleri, hangi eylemin seçileceğine nasıl karar verileceğini ve ne zaman durulacağını tanımlar. Halüsinasyonları azaltmak ve güvenilirliği artırmak için açık doğrulama adımları (ör. “getirilen kaynakları kontrol et” veya “nihai yanıttan önce yeniden hesapla”) eklemek de yaygındır.

Sonuç

Bu rehber, temel ilkelerden ileri stratejilere kadar LLM'ler hakkında yapılacak görüşmelere hazırlanmanıza yardımcı olacak bir mülakat soru seti sundu.

İster bir mülakata hazırlanıyor olun, ister bilginizi pekiştirmek isteyin; bu içgörüler, yapay zekâ alanında yolunuzu bulmanız ve başarıya ulaşmanız için gereken donanımı sağlayacaktır.

Yapay zekâ ve LLM'lerdeki en güncel gelişmeleri okumak isterseniz şu konuları öneririm: