Programma

I large language model (LLM) sono diventati sempre più importanti nell’intelligenza artificiale, con applicazioni in diversi settori.

Con l’aumentare della domanda di professionisti con competenze sugli LLM, questo articolo fornisce un set completo di domande e risposte da colloquio, che coprono concetti fondamentali, tecniche avanzate e applicazioni pratiche.

Se ti stai preparando per un colloquio di lavoro o vuoi semplicemente ampliare le tue conoscenze, questo articolo ti sarà utile.

Domande di base sugli LLM

Per comprendere gli LLM, è importante partire dai concetti fondamentali. Queste domande iniziali coprono aspetti essenziali come l’architettura, i meccanismi chiave e le sfide tipiche, offrendo una base solida per approfondire argomenti più avanzati.

Che cos’è l’architettura Transformer e come viene usata negli LLM?

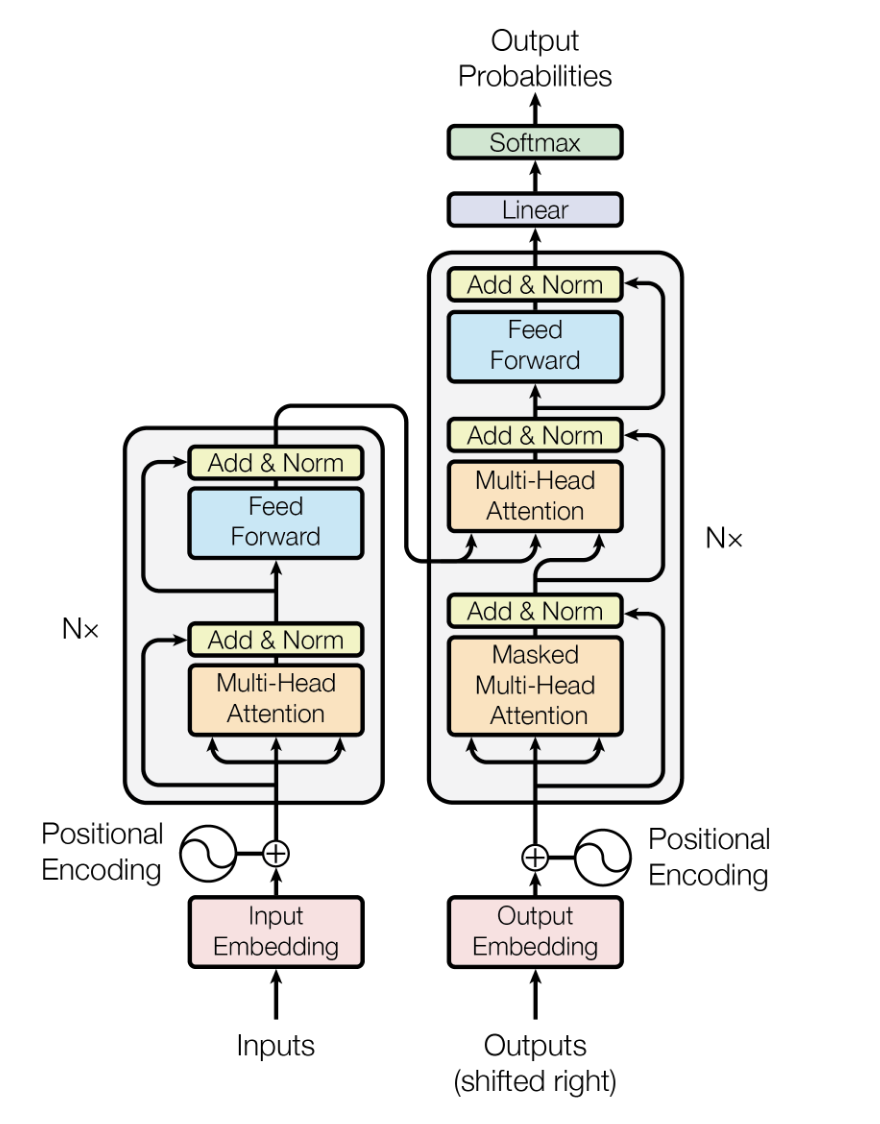

L’architettura Transformer è un modello di deep learning introdotto da Vaswani et al. nel 2017, progettato per gestire dati sequenziali con maggiore efficienza e prestazioni rispetto a modelli precedenti come le reti neurali ricorrenti (RNN) e le long short-term memory (LSTM).

Si basa su meccanismi di self-attention per processare gli input in parallelo, risultando altamente scalabile e capace di catturare dipendenze a lungo raggio.

Negli LLM, l’architettura Transformer costituisce la spina dorsale, permettendo ai modelli di elaborare grandi quantità di testo in modo efficiente e generare output testuali coerenti e rilevanti rispetto al contesto.

L’architettura del modello Transformer. Fonte

Spiega il concetto di "finestra di contesto" negli LLM e la sua importanza.

La finestra di contesto negli LLM indica l’intervallo di testo (in termini di token o parole) che il modello può considerare in un’unica volta quando genera o comprende il linguaggio. L’importanza della finestra di contesto risiede nel suo impatto sulla capacità del modello di produrre risposte logiche e pertinenti.

In generale, una finestra di contesto più ampia permette al modello di considerare più informazioni, favorendo una migliore comprensione e generazione del testo, soprattutto in conversazioni complesse o lunghe. Tuttavia, aumenta anche i requisiti computazionali, richiedendo un equilibrio tra prestazioni ed efficienza.

Inoltre, ricerche recenti mostrano che molti modelli degradano nelle prestazioni ben prima dei limiti dichiarati. I modelli possono manifestare il fenomeno del "lost in the middle", in cui le informazioni al centro del contesto vengono ignorate o de-prioritizzate. Pertanto, un contesto curato e pertinente in finestre più piccole spesso supera l’uso di finestre più grandi riempite di rumore.

Quali sono alcuni comuni obiettivi di pre-training per gli LLM e come funzionano?

Tra i comuni obiettivi di pre-training per gli LLM ci sono il masked language modeling (MLM) e il language modeling autoregressivo. Nell’MLM, alcune parole di una frase vengono mascherate a caso e il modello viene addestrato a prevederle in base al contesto circostante. Questo aiuta il modello a comprendere il contesto bidirezionale.

Il language modeling autoregressivo consiste nel prevedere la parola successiva in una sequenza, addestrando il modello a generare testo un token alla volta. Entrambi gli obiettivi permettono al modello di apprendere schemi linguistici e semantica da ampi corpora, fornendo una base solida per il fine-tuning su compiti specifici.

Che cos’è il fine-tuning nel contesto degli LLM e perché è importante?

Il fine-tuning, nel contesto degli LLM, consiste nel prendere un modello pre-addestrato e addestrarlo ulteriormente su un dataset più piccolo e specifico per il compito. Questo processo aiuta il modello ad adattare la comprensione linguistica generale alle sfumature dell’applicazione specifica, migliorandone così le prestazioni.

È una tecnica importante perché sfrutta l’ampia conoscenza linguistica acquisita durante il pre-training, modificando al contempo il modello per ottenere buoni risultati su applicazioni specifiche, come l’analisi del sentiment, il riassunto di testi o il question answering.

Quali sono alcune sfide comuni legate all’uso degli LLM?

L’uso degli LLM comporta diverse sfide, tra cui:

- Risorse computazionali: gli LLM richiedono notevole potenza di calcolo e memoria, rendendo addestramento e deployment intensivi in termini di risorse.

- Bias ed equità: gli LLM possono apprendere e propagare involontariamente bias presenti nei dati di addestramento, producendo output ingiusti o distorti.

- Interpretabilità: comprendere e spiegare le decisioni prese dagli LLM può essere difficile a causa della loro natura complessa e opaca.

- Privacy dei dati: l’uso di grandi dataset per l’addestramento può sollevare preoccupazioni sulla privacy e la sicurezza dei dati.

- Costo: lo sviluppo, l’addestramento e il deployment degli LLM possono essere costosi, limitandone l’accessibilità per le organizzazioni più piccole.

Come gestiscono gli LLM le parole o i token fuori vocabolario (OOV)?

Gli LLM gestiscono parole o token fuori vocabolario (OOV) usando tecniche come la tokenizzazione a sotto-parole (ad es. Byte Pair Encoding, BPE, e WordPiece). Queste tecniche suddividono parole sconosciute in unità sub-lessicali più piccole e note che il modello può processare.

Questo approccio garantisce che, anche se una parola non è stata vista in addestramento, il modello possa comunque comprendere e generare testo basandosi sulle sue parti costitutive, migliorando flessibilità e robustezza.

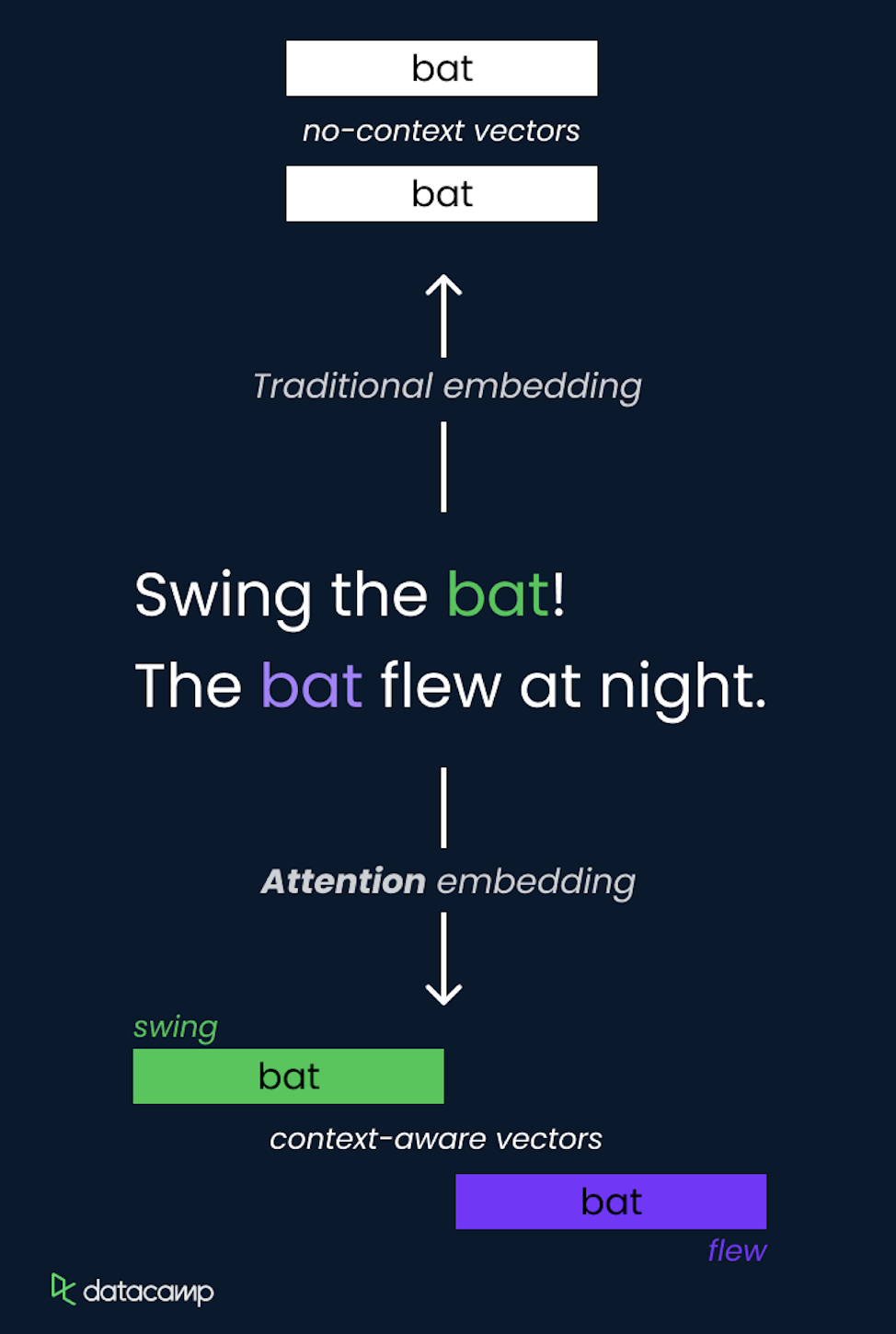

Cosa sono i livelli di embedding e perché sono importanti negli LLM?

Gli strati di embedding sono una componente significativa degli LLM utilizzata per convertire dati categorici, come le parole, in rappresentazioni vettoriali dense. Questi embedding catturano le relazioni semantiche tra le parole rappresentandole in uno spazio vettoriale continuo, dove parole simili risultano più vicine. L’importanza degli embedding negli LLM include:

- Riduzione della dimensionalità: riducono la dimensionalità dei dati di input, rendendoli più gestibili per il modello.

- Comprensione semantica: gli embedding catturano significati e relazioni semantiche sfumate tra le parole, migliorando la capacità del modello di comprendere e generare testo simile a quello umano.

- Transfer learning: embedding pre-addestrati possono essere riutilizzati tra modelli e compiti diversi, offrendo una solida base di comprensione linguistica da perfezionare per applicazioni specifiche.

Come funzionano i moderni positional encoding degli LLM e perché i Rotary Position Embeddings (RoPE) sono diventati lo standard?

I positional encoding indicano ai transformer la posizione di ciascun token nella sequenza.

I tradizionali positional encoding sinusoidali (da Vaswani et al., 2017) usavano funzioni matematiche fisse per codificare staticamente le posizioni. I Rotary Position Embeddings (RoPE), introdotti più recentemente, sono diventati lo standard nei moderni LLM perché offrono proprietà fondamentalmente superiori.

RoPE funziona rappresentando le posizioni come angoli di rotazione in uno spazio vettoriale complesso, ruotando gli embedding dei token di un angolo proporzionale alla loro posizione. Questo approccio geometrico è più efficiente e supporta naturalmente l’interpolazione verso sequenze più lunghe di quelle viste in addestramento, una capacità cruciale per estendere le finestre di contesto. Modelli come GPT-5.2 e Gemini 3 usano RoPE come positional encoding.

Domande intermedie sugli LLM

Sulla base dei concetti di base, le domande di livello intermedio approfondiscono le tecniche pratiche usate per ottimizzare le prestazioni degli LLM e affrontare sfide legate all’efficienza computazionale e all’interpretabilità del modello.

Spiega il concetto di attention negli LLM e come viene implementato.

Il concetto di attention negli LLM è un metodo che consente al modello di concentrarsi su parti diverse della sequenza di input durante le previsioni. Assegna dinamicamente pesi agli altri token in input, evidenziando quelli più rilevanti per il compito corrente.

Viene implementato tramite self-attention, in cui il modello calcola gli score di attenzione per ciascun token rispetto a tutti gli altri token della sequenza, permettendo di catturare dipendenze indipendentemente dalla distanza.

Il meccanismo di self-attention è un componente centrale dell’architettura Transformer, che le consente di elaborare informazioni in modo efficiente e catturare relazioni a lungo raggio.

Qual è il ruolo della tokenizzazione nell’elaborazione degli LLM?

La tokenizzazione converte il testo grezzo in unità più piccole chiamate token, che possono essere parole, sotto-parole o caratteri.

Il ruolo della tokenizzazione nell’elaborazione degli LLM è fondamentale perché trasforma il testo in un formato che il modello può comprendere ed elaborare.

Una tokenizzazione efficace assicura che il modello riesca a gestire un’ampia varietà di input, inclusi termini rari e lingue diverse, suddividendoli in parti gestibili. Questo passaggio è necessario per un addestramento e un’inferenza ottimali, poiché standardizza l’input e aiuta il modello a imparare pattern significativi nei dati.

Come misuri le prestazioni di un LLM?

Ricercatori e professionisti hanno sviluppato numerose metriche di valutazione per misurare le prestazioni di un LLM. Le metriche classiche includono:

- Perplexity: misura quanto bene il modello prevede un campione, comunemente usata nei compiti di language modeling.

- Accuratezza: usata per compiti come la classificazione del testo per misurare la quota di previsioni corrette.

- F1 Score: media armonica di precision e recall, usata per compiti come il riconoscimento di entità nominate.

- Punteggio BLEU (Bilingual Evaluation Understudy): misura la qualità del testo generato dalla macchina rispetto a traduzioni di riferimento, comunemente usato nella traduzione automatica.

- ROUGE (Recall-Oriented Understudy for Gisting Evaluation): insieme di metriche che valutano la sovrapposizione tra testo generato e testo di riferimento, spesso usate nei compiti di sintesi. Aiutano a quantificare l’efficacia del modello e a guidarne i miglioramenti.

Oltre alle metriche tradizionali, oggi si usano benchmark standardizzati per scopi diversi, come MMLU (test di conoscenza su 57 compiti), MMMU-Pro (ragionamento multimodale) e HumanEval (generazione di codice). Inoltre, classifiche come LMArena ordinano gli LLM in base alle preferenze umane. Per i sistemi in produzione, è diventato essenziale misurare tassi di allucinazione nel mondo reale, latenza ed efficienza dei token.

Quali sono alcune tecniche per controllare l’output di un LLM?

Si possono usare diverse tecniche per controllare l’output di un LLM, tra cui:

- Temperatura: regolando questo parametro durante il campionamento si controlla la casualità dell’output. Temperature più basse producono risultati più deterministici, mentre valori più alti restituiscono esiti più vari.

- Top-K sampling: limita il pool di campionamento ai K token più probabili, riducendo la probabilità di generare testo meno pertinente o insensato.

- Top-P (nucleus) sampling: sceglie i token dal più piccolo insieme la cui probabilità cumulativa supera una soglia P, bilanciando diversità e coerenza.

- Prompt engineering: progettare prompt specifici per guidare il modello verso gli output desiderati fornendo contesto o esempi.

- Token di controllo: uso di token speciali per segnalare al modello di generare testo in uno specifico stile, formato o tipo di contenuto.

Quali approcci si possono adottare per ridurre il costo computazionale degli LLM?

Per ridurre il costo computazionale degli LLM, si possono adottare:

- Pruning del modello: rimozione di pesi o neuroni meno importanti per ridurre dimensioni e requisiti computazionali.

- Quantizzazione: conversione dei pesi del modello da alta precisione (es. floating point a 32 bit) a bassa precisione (es. interi a 8 bit) per ridurre l’uso di memoria e velocizzare l’inferenza.

- Distillazione: addestrare un modello più piccolo (studente) a imitare il comportamento di un modello grande pre-addestrato (insegnante) per ottenere prestazioni simili con meno risorse.

- Attention sparsa: uso di tecniche come gli sparse transformer per limitare il meccanismo di attention a un sottoinsieme di token, riducendo il carico computazionale.

- Architetture efficienti: sviluppo e uso di architetture di modello progettate per minimizzare le richieste computazionali mantenendo le prestazioni, come Reformer o Longformer.

Qual è l’importanza dell’interpretabilità del modello negli LLM e come si può ottenere?

L’interpretabilità del modello è essenziale per capire come un LLM prende decisioni, fondamentale per costruire fiducia, garantire responsabilità e individuare e mitigare i bias. Per ottenere interpretabilità si possono adottare diversi approcci, tra cui:

- Visualizzazione dell’attenzione: analizzare i pesi di attention per vedere su quali parti dell’input si concentra il modello.

- Mappe di salienza: evidenziare le caratteristiche dell’input che hanno maggiore influenza sull’output del modello.

- Metodi agnostici al modello: usare tecniche come LIME (Local Interpretable Model-agnostic Explanations) per spiegare previsioni individuali.

- Propagazione della rilevanza layer-wise: scomporre le previsioni del modello in contributi di ciascun layer o neurone.

Come gestiscono gli LLM le dipendenze a lungo termine nel testo?

Gli LLM gestiscono le dipendenze a lungo termine nel testo tramite la loro architettura, in particolare il meccanismo di self-attention, che permette di considerare simultaneamente tutti i token della sequenza di input. Questa capacità di prestare attenzione a token distanti aiuta gli LLM a catturare relazioni e dipendenze su contesti estesi.

Inoltre, modelli avanzati come Transformer-XL e Longformer sono specificamente progettati per estendere la finestra di contesto e gestire sequenze più lunghe in modo più efficace, garantendo una migliore gestione delle dipendenze a lungo termine.

I modelli moderni in produzione usano strategie più avanzate per gestire le dipendenze a lungo termine e contrastare il degrado delle prestazioni con l’espansione della finestra di contesto, come:

- Rotary Position Embeddings (RoPE) per una migliore estrapolazione in lunghezza e un encoding di posizione superiore.

- Pattern di attention ottimizzati per sequenze lunghe, inclusi varianti di grouped-query e multi-head attention.

- Integrazione attenta della conoscenza tramite RAG invece di fare affidamento esclusivo sulla capacità della finestra di contesto.

Che cos’è la Retrieval-Augmented Generation (RAG) e come si è evoluta?

La RAG combina meccanismi di recupero con modelli generativi per reperire informazioni rilevanti da fonti esterne durante la generazione del testo. Questo approccio affronta direttamente due limiti critici degli LLM: le allucinazioni e l’attualità della conoscenza. La RAG tradizionale usa pipeline di recupero e generazione relativamente semplici, ma con l’evoluzione verso la "RAG 2.0" è diventata significativamente più sofisticata.

Le caratteristiche chiave della RAG 2.0 includono:

- Recupero ricorsivo: i modelli ragionano sui vuoti nelle informazioni recuperate ed effettuano in modo proattivo ricerche secondarie o terziarie per colmare le lacune, invece di affidarsi a un’unica passata di recupero

- Recupero multimodale: integrazione tra formati diversi—testo, immagini, PDF, video e persino chiamate API—per raccogliere contesti più ricchi

- Indicizzazione ibrida: combinazione di ricerca BM25 (basata su keyword) e vettoriale (semantica) per catturare sia rilevanza lessicale sia semantica

- Layer di re-ranking: filtro intelligente dei risultati iniziali del recupero per ridurre rumore e informazioni irrilevanti

- Adattamento agentico: selezione dinamica della strategia in cui il sistema sceglie gli approcci di recupero in base alla complessità della query e al dominio

La RAG 2.0, combinata con gli LLM, riduce efficacemente i tassi di allucinazione del 40–60% nei sistemi in produzione rispetto ai modelli base.

Domande avanzate sugli LLM

Comprendere i concetti avanzati negli LLM è utile per i professionisti che mirano a spingere i limiti di ciò che questi modelli possono ottenere. Questa sezione esplora argomenti complessi e sfide comuni del settore.

Spiega il concetto di "few-shot learning" negli LLM e i suoi vantaggi.

Il few-shot learning negli LLM indica la capacità del modello di apprendere ed eseguire nuovi compiti usando solo pochi esempi. Questa capacità sfrutta l’ampia conoscenza pre-addestrata dell’LLM, permettendogli di generalizzare a partire da un numero ridotto di istanze.

I principali vantaggi del few-shot learning includono minori requisiti di dati, poiché si riduce la necessità di grandi dataset specifici per il compito, maggiore flessibilità, consentendo al modello di adattarsi a vari compiti con un fine-tuning minimo, ed efficienza dei costi, poiché requisiti di dati inferiori e tempi di addestramento ridotti si traducono in risparmi significativi nella raccolta dei dati e nelle risorse computazionali.

Quali sono le differenze tra modelli autoregressivi e masked language model?

I modelli autoregressivi e i masked language model differiscono principalmente nell’approccio predittivo e nell’idoneità ai compiti. I modelli autoregressivi, come GPT-5.2, Claude 4.5 Opus e Gemini 3, prevedono la parola successiva in una sequenza sulla base delle parole precedenti, generando testo un token alla volta.

Questi modelli sono particolarmente adatti ai compiti di generazione di testo. Al contrario, i masked language model, come BERT, mascherano casualmente parole in una frase e addestrano il modello a prevederle in base al contesto circostante. Questo approccio bidirezionale aiuta il modello a comprendere il contesto in entrambe le direzioni, rendendolo ideale per compiti di classificazione del testo e question answering.

Come puoi incorporare conoscenza esterna in un LLM?

L’integrazione di conoscenza esterna in un LLM può essere ottenuta con diversi metodi:

- Integrazione di knowledge graph: arricchire l’input del modello con informazioni provenienti da knowledge graph strutturati per fornire contesto.

- Retrieval-Augmented Generation (RAG): combina metodi di recupero con modelli generativi per reperire informazioni rilevanti da fonti esterne durante la generazione del testo. I moderni sistemi RAG 2.0 usano recupero ricorsivo, indicizzazione ibrida e re-ranking per un’integrazione della conoscenza superiore rispetto agli approcci di recupero semplici.

- Fine-tuning con dati specifici di dominio: addestrare il modello su dataset aggiuntivi che contengono la conoscenza richiesta per specializzarlo in compiti o domini specifici.

- Prompt engineering: progettare prompt che guidino il modello a utilizzare efficacemente la conoscenza esterna in fase di inferenza.

Quali sono alcune sfide legate al deployment degli LLM in produzione?

Il deployment degli LLM in produzione comporta diverse sfide:

- Scalabilità: garantire che il modello possa gestire grandi volumi di richieste in modo efficiente spesso richiede risorse computazionali significative e un’infrastruttura ottimizzata.

- Latenza: minimizzare il tempo di risposta per fornire output in tempo reale o quasi reale è fondamentale per applicazioni come chatbot e assistenti virtuali.

- Monitoraggio e manutenzione: monitorare continuamente le prestazioni del modello e aggiornarlo per gestire dati e compiti in evoluzione richiede sistemi di monitoraggio robusti e aggiornamenti regolari.

- Considerazioni etiche e legali: affrontare questioni legate a bias, privacy e conformità normativa è essenziale per evitare problemi etici e legali.

- Gestione delle risorse: gestire le risorse computazionali significative richieste per l’inferenza assicurando la convenienza economica implica ottimizzare configurazioni hardware e software.

Come gestisci il degrado del modello nel tempo negli LLM in produzione?

Il degrado del modello si verifica quando le prestazioni di un LLM diminuiscono nel tempo a causa di cambiamenti nella distribuzione dei dati sottostante. Per gestirlo, è necessario il riaddestramento regolare con dati aggiornati per mantenere le prestazioni. Un monitoraggio continuo è necessario per tracciare le prestazioni del modello e rilevare segnali di degrado.

Tecniche di apprendimento incrementale consentono al modello di apprendere da nuovi dati senza dimenticare quanto già appreso. Inoltre, l’A/B testing confronta le prestazioni del modello attuale con nuove versioni e aiuta a individuare possibili miglioramenti prima del deployment completo.

Quali tecniche assicurano l’uso etico degli LLM?

Per garantire l’uso etico degli LLM, si possono implementare diverse tecniche:

- Mitigazione dei bias: applicazione di strategie per identificare e ridurre i bias nei dati di addestramento e negli output del modello, come l’uso di dataset bilanciati e strumenti di rilevamento dei bias.

- Trasparenza e spiegabilità: sviluppo di modelli che forniscano output interpretabili e spiegabili per favorire fiducia e responsabilità, incluso l’uso di visualizzazioni dell’attenzione e mappe di salienza.

- Consenso dell’utente e privacy: assicurare che i dati usati per addestramento e inferenza rispettino le normative sulla privacy e ottenere il consenso dell’utente quando necessario.

- Audit di equità: condurre audit regolari per valutare l’equità e le implicazioni etiche del comportamento del modello.

- Deployment responsabile: definizione di linee guida e policy per il responsible AI, incluso il trattamento di contenuti dannosi o inappropriati generati dal modello.

Come puoi garantire la sicurezza dei dati usati con gli LLM?

La sicurezza dei dati usati con gli LLM richiede l’implementazione di varie misure. Tra queste, l’uso di tecniche di cifratura per i dati a riposo e in transito per proteggerli da accessi non autorizzati. Controlli di accesso rigorosi sono necessari per garantire che solo il personale autorizzato possa accedere ai dati sensibili.

È inoltre fondamentale anonimizzare i dati per rimuovere le informazioni personali identificabili (PII) prima di usarli per addestramento o inferenza. Inoltre, la conformità a normative sulla protezione dei dati come GDPR o CCPA è essenziale per evitare problemi legali.

Queste misure aiutano a proteggere integrità, riservatezza e disponibilità dei dati. Tale protezione è cruciale per mantenere la fiducia degli utenti e rispettare gli standard normativi.

In che modo il reinforcement learning from human feedback (RLHF) migliora qualità e sicurezza dell’output degli LLM e come si confronta con metodi di allineamento più recenti come DPO e RLAIF?

RLHF è una tecnica che consiste nell’addestrare un LLM ad allineare i propri output alle preferenze umane incorporando il feedback dei valutatori. Questo processo iterativo aiuta il modello a generare risposte non solo accurate ma anche sicure, non di parte e utili.

Tuttavia, l’RLHF presenta sfide. Una riguarda il potenziale bias nel feedback umano, poiché valutatori diversi possono avere preferenze e interpretazioni differenti.

Un’altra sfida è la scalabilità del processo di feedback, poiché raccogliere e incorporare grandi quantità di feedback umano può essere dispendioso in termini di tempo e costi. Inoltre, garantire che il modello di ricompensa usato nell’RLHF catturi accuratamente i comportamenti e i valori desiderati può essere complesso. Lo step di ottimizzazione PPO (Proximal Policy Optimization) aggiunge complessità e può introdurre instabilità durante l’addestramento.

Sono emerse alternative moderne che affrontano molte delle limitazioni dell’RLHF:

- DPO (Direct Preference Optimization): elimina completamente il modello di ricompensa separato, usando segnali di ricompensa impliciti derivati direttamente da coppie di preferenze. Questo approccio è più semplice, stabile ed efficiente dal punto di vista computazionale rispetto all’RLHF basato su PPO. Il DPO è ora ampiamente adottato dai principali laboratori di AI come alternativa o complemento all’RLHF tradizionale.

- GRPO (Gradient-based Reward Policy Optimization): una variante che combina i benefici della semplicità del DPO con aspetti dell’apprendimento in stile PPO, offrendo compromessi intermedi.

- RLAIF (Reinforcement Learning from AI Feedback): sostituisce i valutatori umani con feedback generato da AI (come valutazioni da modelli più forti o valutatori specializzati). Questo approccio riduce drasticamente le sfide di scalabilità e i costi, poiché generare feedback AI è più economico e veloce della raccolta di feedback umano.

La maggior parte dei modelli in produzione usa DPO, RLAIF o combinazioni ibride piuttosto che un RLHF puro basato su PPO.

Confronta i modelli state-space (come Mamba) con i Transformer. Quali sono i trade-off e quando useresti ciascuno?

Le allucinazioni basate sulla conoscenza si verificano quando il modello non dispone dei fatti corretti (o ha fatti obsoleti) e quindi inventa informazioni plausibili. Le correzioni in genere prevedono:

- Ancorare il modello al recupero (RAG)

- Aggiungere fonti verificate

- Fine-tuning specifico di dominio

Le allucinazioni basate sulla logica si verificano quando il modello dispone di informazioni pertinenti ma ragiona in modo errato o produce incongruenze. Le correzioni comuni sono:

- Prompt strutturati

- Passaggi di verifica/self-check (spesso tramite workflow agentici

- Valutazioni mirate

Qual è la differenza tra allucinazioni basate sulla conoscenza e sulla logica negli LLM e come affrontarle?

Sebbene oggi i Transformer dominino gli LLM, i modelli state-space (SSM) come Mamba sono emersi come un paradigma architetturale competitivo con proprietà computazionali e prestazionali fondamentalmente diverse. Conoscere entrambi è sempre più importante per i professionisti moderni degli LLM.

Transformer:

- Punti di forza: eccellenti nel recupero di informazioni, compiti di copia/incolla e in-context learning. Architettura collaudata su larga scala con tooling e infrastruttura estesi. Forti prestazioni empiriche sulla generazione di codice e su benchmark eterogenei.

- Punti deboli: complessità di attention O(N²) che comporta requisiti quadratici di memoria e calcolo. Questo si traduce in degrado delle prestazioni su sequenze molto lunghe (>100K token) e alta latenza per applicazioni a lungo contesto.

- Casi d’uso e raccomandazioni: la maggior parte degli LLM in produzione oggi (GPT, Claude, Gemini, Llama). Raccomandati per applicazioni reali attuali e nel prossimo futuro.

State-Space Models (Mamba, Mamba-2):

- Punti di forza: complessità O(N) con scalabilità lineare della memoria. Inferenza 5–10x più veloce su sequenze lunghe (>50K token). Fondamenti teorici migliori per l’elaborazione dei segnali. Comportamento di scalabilità più prevedibile.

- Punti deboli: richiedono 10x più dati di addestramento rispetto ai Transformer per raggiungere prestazioni comparabili. Più deboli su recupero di informazioni e compiti di copia. Ecosistema meno maturo con meno strumenti, librerie e modelli addestrati.

- Casi d’uso e raccomandazioni: in crescita per applicazioni specializzate—elaborazione di documenti lunghi, sistemi real-time con vincoli di latenza, applicazioni in streaming e potenzialmente domini specializzati in cui la scalabilità O(N) è critica.

Ricerche recenti dimostrano che Transformer e SSM sono complementari più che direttamente in competizione, con casi d’uso e vincoli diversi che favoriscono architetture differenti. I Transformer restano la scelta pratica per LLM generalisti e probabilmente continueranno a dominare per ora. È probabile un futuro ibrido, con modelli specializzati per diversi requisiti computazionali e di compito.

Domande sugli LLM per i Prompt Engineer

Il prompt engineering è un aspetto importante nell’utilizzo degli LLM. Consiste nel creare prompt precisi ed efficaci per generare dal modello le risposte desiderate. Questa sezione esamina le principali domande che i prompt engineer possono incontrare.

Che cos’è il prompt engineering e perché è cruciale per lavorare con gli LLM?

Il prompt engineering consiste nel progettare e perfezionare i prompt per guidare gli LLM nella generazione di output accurati e pertinenti. È fondamentale per lavorare con gli LLM perché la qualità del prompt impatta direttamente sulle prestazioni del modello.

Prompt efficaci possono migliorare la capacità del modello di comprendere il compito, generare risposte accurate e rilevanti e ridurre la probabilità di errori.

Il prompt engineering è essenziale per massimizzare l’utilità degli LLM in varie applicazioni, dalla generazione di testo alla risoluzione di problemi complessi.

Puoi fornire esempi di diverse tecniche di prompting (zero-shot, few-shot, chain-of-thought) e spiegare quando usarle?

- Zero-shot prompting: si fornisce al modello la descrizione del compito senza esempi. Tipicamente usato quando non sono disponibili esempi o quando si vuole testare la comprensione generale e la flessibilità del modello.

- Few-shot prompting: si forniscono alcuni esempi insieme alla descrizione del compito per guidare il modello. Utile quando il modello necessita di contesto o esempi per comprendere meglio il compito.

- Chain-of-Thought prompting: scompone un compito complesso in passaggi più piccoli e sequenziali che il modello possa seguire. Può essere utile per compiti che richiedono ragionamento logico e problem solving multi-step.

- Agentic prompting: strutturare i prompt per far agire i modelli come agenti autonomi che chiamano tool/API, raccolgono informazioni e ragionano su più passaggi. I prompt includono definizioni dello spazio di azione, descrizioni degli strumenti e requisiti espliciti di ragionamento.

Come valuti l’efficacia di un prompt?

Valutare l’efficacia di un prompt comporta:

- Qualità dell’output: valutare pertinenza, coerenza e accuratezza delle risposte del modello.

- Coerenza: verificare che il modello produca costantemente output di alta qualità su input differenti.

- Metriche specifiche del compito: usare metriche di valutazione specifiche, come BLEU per la traduzione o ROUGE per la sintesi, per misurare le prestazioni.

- Valutazione umana: coinvolgere revisori umani per fornire feedback qualitativo sugli output del modello.

- A/B testing: confrontare prompt diversi per determinare quale offra le prestazioni migliori.

Quali strategie adotti per evitare errori comuni nella progettazione dei prompt (ad es. domande suggestive, istruzioni ambigue)?

- Evitare domande suggestive: assicurarsi che i prompt non implichino una risposta specifica, cosa che potrebbe influenzare l’output del modello.

- Istruzioni chiare e concise: fornire istruzioni non ambigue e dirette per ridurre la confusione.

- Fornire contesto: includere il contesto rilevante per aiutare il modello a comprendere il compito senza sovraccaricarlo di informazioni inutili.

- Test iterativi: testare e perfezionare continuamente i prompt in base agli output e alle prestazioni del modello.

Come affronti il perfezionamento iterativo dei prompt per migliorare le prestazioni degli LLM?

Il perfezionamento iterativo dei prompt prevede:

- Progettazione iniziale: partire da un prompt di base basato sui requisiti del compito.

- Test e valutazione: valutare le prestazioni del prompt con varie metriche e ottenere feedback.

- Analisi: individuare debolezze o aree di miglioramento del prompt.

- Perfezionamento: apportare modifiche al prompt per affrontare i problemi individuati.

- Ripetizione: ripetere il processo di test e perfezionamento finché non si raggiungono le prestazioni desiderate.

Quali strumenti o framework usi per semplificare il processo di prompt engineering?

Diversi strumenti e framework possono semplificare il processo di prompt engineering:

- Piattaforme specifiche per LLM: LangChain e LlamaIndex per concatenazione di prompt e creazione di sistemi agentici; Vercel AI SDK per prototipazione e deployment rapidi.

- Test e ottimizzazione dei prompt: PromptFoo (test automatizzati dei prompt in vari scenari), DSPy (ottimizzazione programmabile dei prompt), Haystack (costruzione di pipeline RAG).

- Ambienti di sviluppo interattivi (IDE): Jupyter Notebook per la sperimentazione, VS Code con estensioni LLM (GitHub Copilot, Cursor), Streamlit per creare prototipi UI interattivi.

- API e SDK: OpenAI API, Anthropic SDK, Together AI e LM Studio per il deployment locale dei modelli.

- Versionamento e collaborazione: versionamento dei prompt con Git, Weights & Biases per tracciare e confrontare esperimenti, HuggingFace Hub per condividere modelli e prompt.

- Framework agentici: AutoGPT, OpenAI Assistants API, LangGraph per costruire workflow agentici complessi multi-step.

- Valutazione e monitoraggio: Ragas (metriche di valutazione RAG), LangSmith (tracing, debugging e monitoraggio in produzione), Braintrust (osservabilità end-to-end degli LLM).

Come gestisci tramite prompt engineering sfide come allucinazioni o bias negli output degli LLM?

Questa domanda affronta le questioni etiche e pratiche dei contenuti generati dagli LLM. Una buona risposta dovrebbe mostrare consapevolezza di questi problemi e discutere tecniche come le seguenti.

Tecniche di mitigazione delle allucinazioni:

- Prompt per la verifica dei fatti: incorporare prompt che incoraggino il modello a verificare le informazioni rispetto a fonti affidabili e a citare esplicitamente le evidenze.

- Integrazione del recupero: usare sistemi RAG o RAG 2.0 per ancorare le risposte a documenti reali, riducendo i fatti inventati richiedendo al modello di fare riferimento alle informazioni recuperate.

- Loop di verifica agentici: strutturare i prompt per far eseguire al modello verifiche multi-step, in cui controlla il proprio lavoro prima di rispondere—creando di fatto agenti di auto-verifica.

- Prompt basati su vincoli: definire il formato dell’output e vincoli logici che rendano evidenti incoerenze o affermazioni non supportate.

Tecniche di mitigazione dei bias:

- Prompt per prospettive diverse: guidare il modello a considerare molteplici punti di vista e prospettive degli stakeholder prima di concludere.

- Prompt di rilevamento dei bias: chiedere al modello di identificare potenziali bias nel proprio ragionamento e output.

- Prompt controfattuali: richiedere scenari o prospettive alternative per mettere in discussione le ipotesi iniziali e testare la robustezza del ragionamento.

- Chiarezza delle istruzioni: specificare esplicitamente che le risposte devono essere equilibrate, riconoscere i limiti ed evitare linguaggio discriminatorio.

Puoi spiegare il ruolo dei template di prompt e come vengono usati nel prompt engineering?

I template di prompt forniscono un formato strutturato per i prompt, spesso con segnaposto per informazioni o istruzioni specifiche. Possono essere riutilizzati in compiti e scenari diversi, migliorando coerenza ed efficienza nella progettazione dei prompt.

Una buona risposta spiegherebbe come i template possano racchiudere best practice, incorporare conoscenze specifiche di dominio e semplificare il processo di generazione di prompt efficaci per varie applicazioni.

In che modo la scelta di un tokenizer influisce sul prompt engineering e sulle prestazioni del modello?

Il tokenizer ha un ruolo cruciale nel modo in cui l’LLM interpreta ed elabora il prompt di input. Tokenizer diversi hanno dimensioni di vocabolario differenti e gestiscono in modo diverso le parole fuori vocabolario (OOV). Un tokenizer a sotto-parole come il Byte Pair Encoding (BPE) può gestire le parole OOV suddividendole in sotto-unità più piccole, mentre un tokenizer basato su parole potrebbe trattarle come token sconosciuti.

La scelta del tokenizer può influire sulle prestazioni del modello in diversi modi. Ad esempio, un tokenizer a sotto-parole può essere più efficace nel catturare il significato di termini rari o tecnici, mentre un tokenizer basato su parole può essere più semplice e veloce per compiti linguistici generici.

Nel prompt engineering, la scelta del tokenizer può influenzare la struttura dei prompt. Ad esempio, usando un tokenizer a sotto-parole potresti dover prestare più attenzione a come le parole vengono suddivise per garantire che il modello colga il significato desiderato.

Che cos’è l’agentic prompting e in cosa differisce dal prompt engineering tradizionale?

L’agentic prompting è un approccio di progettazione dei prompt in cui si istruisce il modello ad agire come un “agente” che può pianificare, compiere azioni (ad esempio chiamare tool/API o recuperare documenti), osservare i risultati e iterare finché non completa un obiettivo.

A differenza del prompt engineering tradizionale, che mira soprattutto a ottenere la miglior risposta possibile in un solo colpo attraverso istruzioni chiare, esempi e vincoli di formattazione, l’agentic prompting enfatizza un ciclo di controllo multi-step (pianifica → agisci → osserva → perfeziona).

È particolarmente utile per compiti in cui la correttezza dipende dall’interazione con sistemi esterni (database, ricerca, esecuzione di codice) o dalla verifica di risultati intermedi, piuttosto che dal solo sapere interno del modello.

I buoni prompt agentici definiscono in genere l’obiettivo, gli strumenti/azioni disponibili, come decidere quale azione intraprendere e quando fermarsi. È anche comune aggiungere passaggi espliciti di verifica (ad es. “controlla le fonti recuperate” o “ricalcola prima della risposta finale”) per ridurre le allucinazioni e migliorare l’affidabilità.

Conclusione

Questa guida ha fornito un set di domande da colloquio per aiutarti a prepararti a discussioni sugli LLM, dai principi di base alle strategie avanzate.

Che tu stia preparando un colloquio o voglia consolidare la tua comprensione, queste informazioni ti forniranno le conoscenze necessarie per orientarti ed eccellere nel campo dell’intelligenza artificiale.

Se vuoi leggere le ultime novità su AI e LLM, ti consiglio questi argomenti: