Leerpad

Large language models (LLM’s) zijn steeds belangrijker geworden binnen kunstmatige intelligentie, met toepassingen in uiteenlopende sectoren.

Nu de vraag naar professionals met LLM-expertise groeit, biedt dit artikel een uitgebreide set interviewvragen en -antwoorden, van basisbegrippen tot geavanceerde technieken en praktische toepassingen.

Of je je nu voorbereidt op een sollicitatiegesprek of je kennis wilt uitbreiden, dit artikel komt van pas.

Basisvragen over LLM’s

Om LLM’s te begrijpen, is het belangrijk te beginnen bij de basisconcepten. Deze fundamenten bestrijken essentiële aspecten zoals architectuur, kernmechanismen en typische uitdagingen, en vormen een solide basis om verder te leren over meer geavanceerde onderwerpen.

Wat is de Transformer-architectuur en hoe wordt die gebruikt in LLM’s?

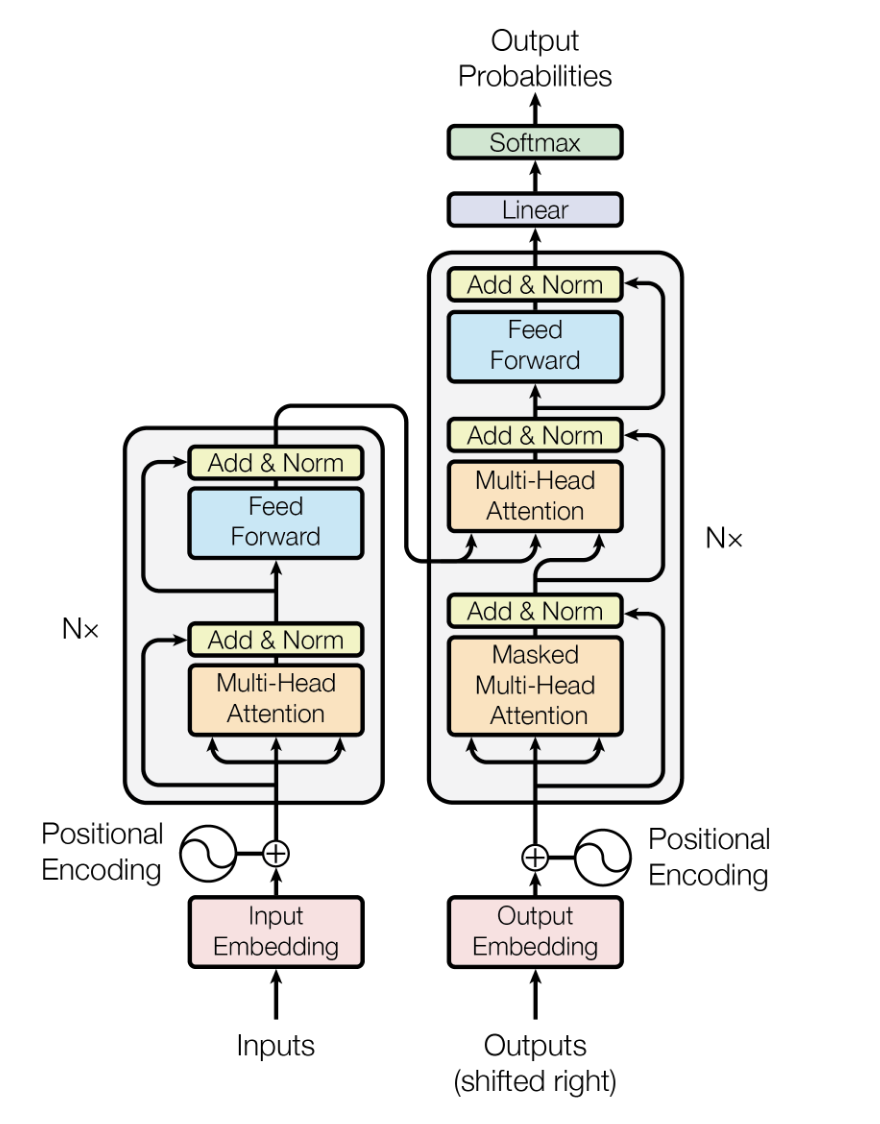

De Transformer-architectuur is een deep-learningmodel, geïntroduceerd door Vaswani et al. in 2017, ontworpen om sequentiële data efficiënter en met betere prestaties te verwerken dan eerdere modellen zoals recurrent neural networks (RNN’s) en long short-term memory (LSTM’s).

Het steunt op self-attention-mechanismen om inputdata parallel te verwerken, waardoor het zeer schaalbaar is en lange-afstandsafhankelijkheden kan vastleggen.

In LLM’s vormt de Transformer-architectuur de ruggengraat, waardoor modellen grote hoeveelheden tekst efficiënt kunnen verwerken en contextueel relevante, coherente tekst kunnen genereren.

De Transformer-modelarchitectuur. Bron

Leg het concept van de "context window" in LLM’s uit en waarom die belangrijk is.

De context window in LLM’s verwijst naar de hoeveelheid tekst (in termen van tokens of woorden) die het model in één keer kan meenemen bij het genereren of begrijpen van taal. De betekenis van de context window ligt in de invloed op het vermogen van het model om logische en relevante antwoorden te geven.

Over het algemeen stelt een grotere context window het model in staat meer context mee te nemen, wat leidt tot beter begrip en betere tekstgeneratie, vooral in complexe of lange gesprekken. Daartegenover staat dat de rekenvereisten toenemen, waardoor het een afweging is tussen prestaties en efficiëntie.

Daarnaast laat recent onderzoek zien dat veel modellen al vóór hun opgegeven limieten slechter presteren. Modellen kunnen een “lost in the middle”-fenomeen vertonen, waarbij informatie in het midden van de context wordt genegeerd of minder prioriteit krijgt. Daarom presteert zorgvuldig geselecteerde, relevante context in kleinere vensters vaak beter dan het vullen van grotere vensters met ruis.

Wat zijn enkele gangbare pre-trainingsdoelen voor LLM’s en hoe werken die?

Veelgebruikte pre-trainingsdoelen voor LLM’s zijn masked language modeling (MLM) en autoregressieve taalmodellering. Bij MLM worden willekeurige woorden in een zin gemaskeerd en wordt het model getraind om de gemaskeerde woorden te voorspellen op basis van de omringende context. Dit helpt het model om bidirectionele context te begrijpen.

Autoregressieve taalmodellering houdt in dat het volgende woord in een reeks wordt voorspeld, en dat het model wordt getraind om tekst token voor token te genereren. Beide doelen laten het model taalpatronen en semantiek leren uit grote corpora en vormen zo een stevige basis voor fine-tuning op specifieke taken.

Wat is fine-tuning in de context van LLM’s en waarom is het belangrijk?

Fine-tuning in de context van LLM’s houdt in dat je een voorgetraind model neemt en het verder traint op een kleinere, taakspecifieke dataset. Dit helpt het model zijn algemene taalbegrip aan te passen aan de nuances van de specifieke toepassing en verbetert zo de prestaties.

Dit is belangrijk omdat het de brede taalkennis uit de pre-training benut, terwijl het model wordt bijgestuurd om goed te presteren op specifieke toepassingen, zoals sentimentanalyse, samenvatten of vraag-en-antwoord.

Wat zijn enkele veelvoorkomende uitdagingen bij het gebruik van LLM’s?

Het gebruik van LLM’s kent verschillende uitdagingen, waaronder:

- Rekenbronnen: LLM’s vereisen veel rekenkracht en geheugen, waardoor training en uitrol intensief zijn qua middelen.

- Bias en eerlijkheid: LLM’s kunnen onbedoeld vooroordelen leren en versterken die in de trainingsdata aanwezig zijn, wat kan leiden tot oneerlijke of partijdige output.

- Interpretabiliteit: De beslissingen van LLM’s begrijpen en uitleggen is lastig door hun complexe en ondoorzichtige aard.

- Dataprivacy: Het gebruik van grote datasets voor training kan zorgen oproepen over privacy en beveiliging.

- Kosten: De ontwikkeling, training en uitrol van LLM’s kunnen duur zijn, wat de toegankelijkheid voor kleinere organisaties beperkt.

Hoe gaan LLM’s om met out-of-vocabulary (OOV)-woorden of -tokens?

LLM’s gaan met out-of-vocabulary (OOV)-woorden of -tokens om via technieken als subword-tokenisatie (bijv. Byte Pair Encoding of BPE, en WordPiece). Deze technieken splitsen onbekende woorden op in kleinere, bekende subword-eenheden die het model kan verwerken.

Zo kan het model, zelfs als een woord niet tijdens training is gezien, de tekst nog begrijpen en genereren op basis van de samenstellende delen. Dat vergroot flexibiliteit en robuustheid.

Wat zijn embedding-lagen en waarom zijn ze belangrijk in LLM’s?

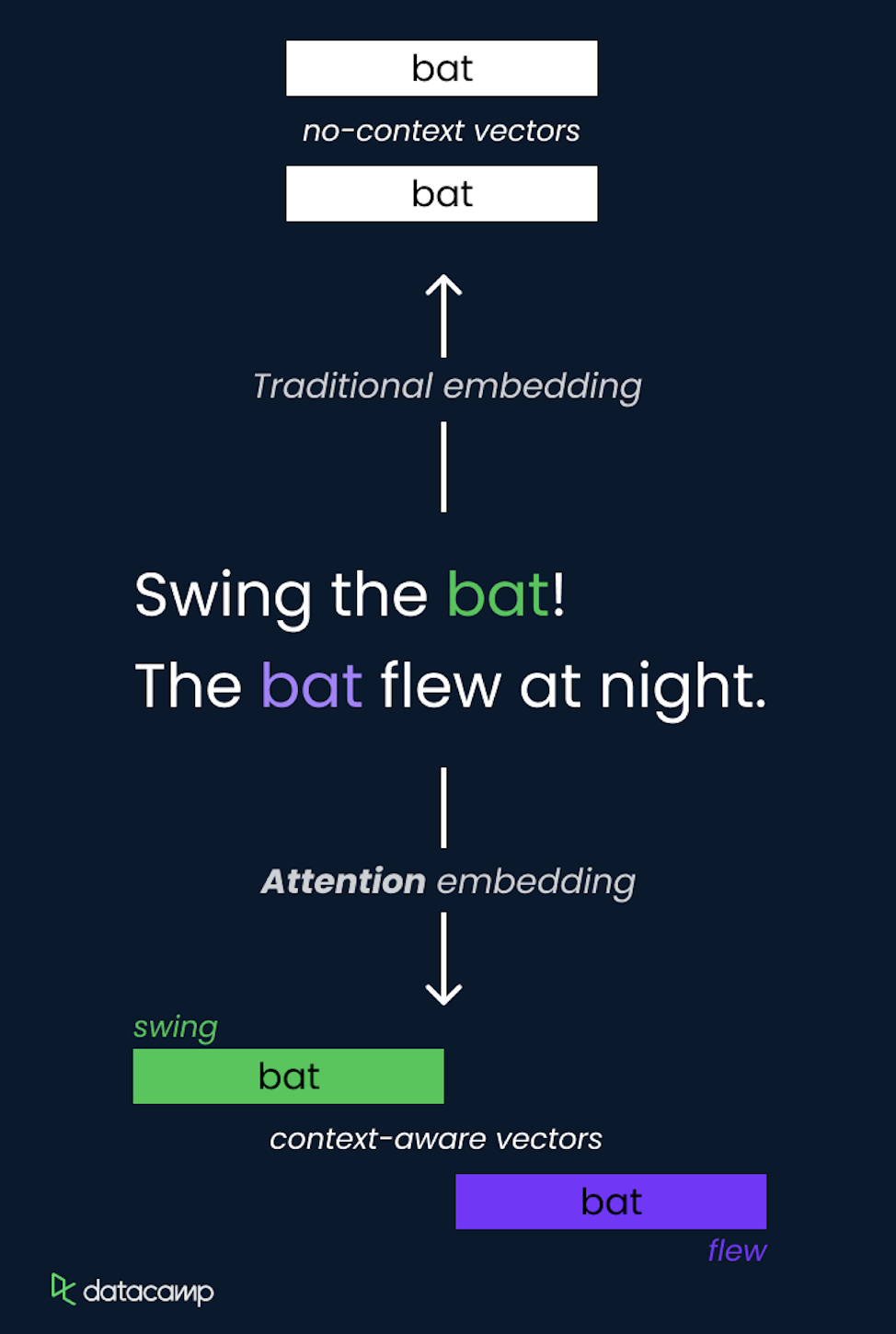

Embedding-lagen zijn een belangrijk onderdeel in LLM’s om categorische data, zoals woorden, om te zetten naar dichte vectorrepresentaties. Deze embeddings vangen semantische relaties tussen woorden door ze te representeren in een continue vectorruimte, waarin vergelijkbare woorden dichter bij elkaar liggen. De importantie van embedding-lagen in LLM’s omvat:

- Dimensiereductie: Ze verlagen de dimensionaliteit van de inputdata, waardoor die beter hanteerbaar wordt voor het model.

- Semantisch begrip: Embeddings leggen genuanceerde semantische betekenissen en relaties tussen woorden vast, wat het vermogen van het model om mensachtige tekst te begrijpen en te genereren vergroot.

- Transfer learning: Voorgetrainde embeddings kunnen in verschillende modellen en taken worden hergebruikt en vormen zo een solide basis van taalbegrip die kan worden gefinetuned voor specifieke toepassingen.

Hoe werken moderne positionele coderingen in LLM’s, en waarom zijn Rotary Position Embeddings (RoPE) standaard geworden?

Positionele coderingen geven transformers aan waar elk token zich in de sequentie bevindt.

Traditionele sinusvormige positionele coderingen (van Vaswani et al. 2017) gebruikten vaste wiskundige functies om posities statisch te coderen. Rotary Position Embeddings (RoPE), recenter geïntroduceerd, zijn de standaard geworden in moderne LLM’s omdat ze fundamenteel superieure eigenschappen bieden.

RoPE werkt door posities te representeren als rotatiehoeken in een complexe vectorruimte, waarbij token-embeddings worden geroteerd met een hoek evenredig aan hun positie. Deze geometrische benadering is efficiënter en ondersteunt van nature interpolatie naar langere sequenties dan tijdens training gezien, wat cruciaal is om contextvensters te vergroten. Modellen zoals GPT-5.2 en Gemini 3 gebruiken RoPE als hun positionele codering.

Middelgeavanceerde LLM-sollicitatievragen

Voortbouwend op de basis duiken vragen op middelniveau in de praktische technieken om LLM-prestaties te optimaliseren en uitdagingen aan te pakken rond rekenefficiëntie en modeluitlegbaarheid.

Leg het concept van attention in LLM’s uit en hoe het wordt geïmplementeerd.

Attention is een methode waarmee het model zich kan richten op verschillende delen van de inputsequentie bij het doen van voorspellingen. Het kent dynamisch gewichten toe aan andere tokens in de input en markeert zo de meest relevante voor de huidige taak.

Dit wordt geïmplementeerd via self-attention, waarbij het model attentiescores berekent voor elk token ten opzichte van alle andere tokens in de sequentie, zodat het afhankelijkheden kan vastleggen ongeacht hun afstand.

Het self-attention-mechanisme is een kernonderdeel van de Transformer-architectuur en maakt efficiënte verwerking en het vastleggen van langetermijnrelaties mogelijk.

Wat is de rol van tokenisatie in LLM-verwerking?

Tokenisatie zet ruwe tekst om in kleinere eenheden, tokens genoemd, die woorden, subwords of karakters kunnen zijn.

De rol van tokenisatie in LLM-verwerking is cruciaal omdat het tekst omzet in een formaat dat het model kan begrijpen en verwerken.

Effectieve tokenisatie zorgt ervoor dat het model een breed scala aan input aankan, inclusief zeldzame woorden en verschillende talen, door ze op te splitsen in hanteerbare stukjes. Deze stap is noodzakelijk voor optimale training en inferentie, omdat ze de input standaardiseert en het model helpt betekenisvolle patronen in de data te leren.

Hoe meet je de prestaties van een LLM?

Onderzoekers en practitioners hebben tal van evaluatiemetrics ontwikkeld om de prestaties van een LLM te meten. Klassieke metrics zijn onder meer:

- Perplexity: Meet hoe goed het model een sample voorspelt, vaak gebruikt bij taalmodellering.

- Nauwkeurigheid (accuracy): Gebruikt voor taken als tekstclassificatie om het aandeel correcte voorspellingen te meten.

- F1-score: Een harmonisch gemiddelde van precision en recall, gebruikt voor taken als named entity recognition.

- BLEU (Bilingual Evaluation Understudy)-score: Meet de kwaliteit van door een machine gegenereerde tekst ten opzichte van referentievertalingen, veelgebruikt bij machinevertaling.

- ROUGE (Recall-Oriented Understudy for Gisting Evaluation): Een set metrics die de overlap tussen gegenereerde tekst en referentietekst evalueren, vaak gebruikt bij samenvatting. Ze helpen de effectiviteit van het model te kwantificeren en verdere verbeteringen te sturen.

Naast traditionele metrics gebruiken practitioners nu gestandaardiseerde benchmarks voor verschillende doelen, zoals MMLU (57-taken kennistest), MMMU-Pro (multimodale redenering) en HumanEval (codegeneratie). Daarnaast rangschikken leaderboards zoals LMArena LLM’s op basis van menselijke voorkeur. Voor uitgerolde systemen zijn het meten van hallucinatiepercentages in de praktijk, latency en tokenefficiëntie essentieel geworden.

Welke technieken kun je gebruiken om de output van een LLM te sturen?

Er zijn verschillende technieken om de output van een LLM te sturen, waaronder:

- Temperatuur: Het aanpassen van deze parameter tijdens sampling stuurt de willekeurigheid van de output. Lagere temperaturen leveren deterministischere output op, hogere waarden geven gevarieerdere resultaten.

- Top-K-sampling: Beperkt de keus tot de K meest waarschijnlijke tokens, waardoor de kans op minder relevante of onsamenhangende tekst afneemt.

- Top-P- (nucleus) sampling: Kiest tokens uit de kleinste set waarvan de cumulatieve waarschijnlijkheid een drempel P overschrijdt, wat diversiteit en samenhang in balans brengt.

- Prompt engineering: Specifieke prompts opstellen om het model te sturen naar gewenste output door context of voorbeelden te geven.

- Controle-tokens: Speciale tokens gebruiken om het model aan te geven tekst in een bepaalde stijl, opmaak of contenttype te genereren.

Welke benaderingen zijn er om de rekenkosten van LLM’s te verlagen?

Om de rekenkosten van LLM’s te verlagen, kun je inzetten op:

- Model pruning: Minder belangrijke gewichten of neuronen uit het model verwijderen om de omvang en rekenlast te beperken.

- Kwantisatie: Modelgewichten omzetten van hoge precisie (bijv. 32-bit floating-point) naar lagere precisie (bijv. 8-bit integer) om het geheugenverbruik te verminderen en inferentie te versnellen.

- Distillatie: Een kleiner model (student) trainen om het gedrag van een groter, voorgetraind model (leraar) na te bootsen, zodat met minder middelen vergelijkbare prestaties worden gehaald.

- Sparse attention: Technieken zoals sparse transformers gebruiken om het attention-mechanisme te beperken tot een subset van tokens en zo de rekenlast te verlagen.

- Efficiënte architecturen: Efficiënte modelarchitecturen ontwikkelen en gebruiken die de rekenvraag minimaliseren en toch prestaties behouden, zoals de Reformer of Longformer.

Waarom is modeluitlegbaarheid belangrijk bij LLM’s en hoe kun je die bereiken?

Modeluitlegbaarheid is cruciaal om te begrijpen hoe een LLM beslissingen neemt, wat belangrijk is voor vertrouwen, verantwoording en het identificeren en mitigeren van biases. Uitlegbaarheid bereiken kan via verschillende benaderingen, zoals:

- Attention-visualisatie: Attentiewegingen analyseren om te zien op welke delen van de input het model focust.

- Saliency maps: Inputfeatures markeren die de grootste invloed hebben op de output van het model.

- Model-agnostische methoden: Technieken zoals LIME (Local Interpretable Model-agnostic Explanations) gebruiken om individuele voorspellingen uit te leggen.

- Layer-wise relevance propagation: De voorspellingen van het model uitsplitsen naar bijdragen van elke laag of neuron.

Hoe gaan LLM’s om met langetermijnafhankelijkheden in tekst?

LLM’s verwerken langetermijnafhankelijkheden in tekst via hun architectuur, met name het self-attention-mechanisme, waarmee ze alle tokens in de inputsequentie tegelijk kunnen meenemen. Dit vermogen om naar verre tokens te kijken helpt LLM’s relaties en afhankelijkheden over lange contexten vast te leggen.

Daarnaast zijn geavanceerde modellen zoals Transformer-XL en Longformer specifiek ontworpen om de context window te vergroten en langere sequenties effectiever te verwerken, wat zorgt voor betere omgang met langetermijnafhankelijkheden.

Moderne productiemodellen gebruiken geavanceerdere strategieën om langetermijnafhankelijkheden te verwerken en prestatiedegradatie bij grotere contextvensters tegen te gaan, zoals:

- Rotary Position Embeddings (RoPE) voor betere lengte-extrapolatie en superieure positionele codering.

- Op lange sequenties geoptimaliseerde attention-patronen, waaronder grouped-query- en multi-head-varianten.

- Zorgvuldige kennisintegratie via RAG in plaats van uitsluitend te vertrouwen op de capaciteit van het contextvenster.

Wat is Retrieval-Augmented Generation (RAG) en hoe heeft het zich ontwikkeld?

RAG combineert retrievalmechanismen met generatieve modellen om tijdens tekstgeneratie relevante informatie uit externe bronnen op te halen. Deze aanpak pakt direct twee belangrijke LLM-beperkingen aan: hallucinaties en actualiteit van kennis. Traditionele RAG gebruikt relatief eenvoudige pipelines voor ophalen en genereren, maar in zijn evolutie naar “RAG 2.0” is het aanzienlijk geavanceerder geworden.

Belangrijke kenmerken van RAG 2.0 zijn:

- Recursief ophalen: Modellen redeneren over hiaten in opgehaalde informatie en voeren proactief tweede of derde zoekacties uit om kennishiaten te dichten, in plaats van te vertrouwen op één enkele ophaalstap

- Multimodaal ophalen: Integratie over diverse formaten—tekst, afbeeldingen, pdf’s, video’s en zelfs API-calls—voor rijkere contextverzameling

- Hybride indexering: Gecombineerde BM25 (keyword-gebaseerd) en vector- (semantische) zoekopdrachten om zowel lexicale als semantische relevantie te vangen

- Re-ranking-lagen: Slim filteren van initiële ophaalresultaten om ruis en irrelevante informatie te verminderen

- Agentische adaptatie: Dynamische strategiekeuze waarbij het systeem ophaalaanpakken selecteert op basis van vraagcomplexiteit en domein

RAG 2.0, gecombineerd met LLM’s, reduceert hallucinatiepercentages in productiesystemen effectief met 40–60% vergeleken met basismodellen.

Geavanceerde LLM-sollicitatievragen

Geavanceerde concepten in LLM’s begrijpen is nuttig voor professionals die de grenzen willen verleggen van wat deze modellen kunnen. Dit deel verkent complexe onderwerpen en veelvoorkomende uitdagingen in het veld.

Leg het concept “few-shot learning” in LLM’s uit en de voordelen ervan.

Few-shot learning in LLM’s verwijst naar het vermogen van het model om nieuwe taken te leren en uit te voeren met slechts enkele voorbeelden. Deze capaciteit benut de uitgebreide, voorgetrainde kennis van het LLM, waardoor het kan generaliseren op basis van een klein aantal voorbeelden.

De belangrijkste voordelen van few-shot learning zijn minder data-eisen, doordat grote taakspecifieke datasets minder nodig zijn; meer flexibiliteit, doordat het model zich met minimale fine-tuning kan aanpassen aan uiteenlopende taken; en kostenefficiëntie, omdat minder data en kortere trainingstijden leiden tot aanzienlijke besparingen in dataverzameling en rekenmiddelen.

Wat zijn de verschillen tussen autoregressieve en gemaskeerde taalmodellen?

Autoregressieve en gemaskeerde taalmodellen verschillen vooral in hun voorspellingsaanpak en taakgeschiktheid. Autoregressieve modellen, zoals GPT-5.2, Claude 4.5 Opus en Gemini 3, voorspellen het volgende woord in een reeks op basis van de voorgaande woorden en genereren tekst token voor token.

Deze modellen zijn bij uitstek geschikt voor tekstgeneratie. Daarentegen maskeren gemaskeerde taalmodellen, zoals BERT, willekeurig woorden in een zin en trainen ze het model om deze gemaskeerde woorden te voorspellen op basis van de omringende context. Deze bidirectionele aanpak helpt het model context vanuit beide richtingen te begrijpen, wat het ideaal maakt voor tekstclassificatie en vraag-en-antwoord.

Hoe kun je externe kennis in een LLM integreren?

Externe kennis in een LLM integreren kan op verschillende manieren:

- Kennisgraafintegratie: De input van het model verrijken met informatie uit gestructureerde kennisgrafen om context te bieden.

- Retrieval-Augmented Generation (RAG): Combineert retrievalmethoden met generatieve modellen om tijdens tekstgeneratie relevante informatie uit externe bronnen op te halen. Moderne RAG 2.0-systemen gebruiken recursief ophalen, hybride indexering en re-ranking voor superieure kennisintegratie vergeleken met eenvoudige retrievalaanpakken.

- Fine-tuning met domeinspecifieke data: Het model trainen op extra datasets met de vereiste kennis om het te specialiseren voor specifieke taken of domeinen.

- Prompt engineering: Prompts ontwerpen die het model tijdens inferentie effectief naar externe kennis laten grijpen.

Wat zijn uitdagingen bij het uitrollen van LLM’s in productie?

Het uitrollen van LLM’s in productie brengt diverse uitdagingen met zich mee:

- Schaalbaarheid: Zorgen dat het model grote aantallen verzoeken efficiënt kan afhandelen, vereist vaak aanzienlijke rekenbronnen en geoptimaliseerde infrastructuur.

- Latency: De responstijd minimaliseren om real-time of near-real-time output te leveren is cruciaal voor toepassingen zoals chatbots en virtuele assistenten.

- Monitoring en onderhoud: Continue prestatiemonitoring en updates om veranderende data en taken aan te kunnen, vereisen robuuste monitoringsystemen en regelmatige updates.

- Ethische en juridische overwegingen: Vraagstukken rond bias, privacy en naleving van regelgeving aanpakken is essentieel om ethische valkuilen en juridische consequenties te vermijden.

- Resourcebeheer: Het beheren van de aanzienlijke rekenmiddelen die voor inferentie nodig zijn om kosteneffectiviteit te waarborgen, inclusief het optimaliseren van hardware- en softwareconfiguraties.

Hoe ga je om met modeldegradatie in de tijd bij uitgerolde LLM’s?

Modeldegradatie treedt op wanneer de prestaties van een LLM in de loop van de tijd afnemen door veranderingen in de onderliggende dataverdeling. Om dit te adresseren, is regelmatige hertraining met geüpdatete data nodig om prestaties te behouden. Continue monitoring is noodzakelijk om de prestaties van het model te volgen en tekenen van degradatie te detecteren.

Incrementele leertechnieken stellen het model in staat te leren van nieuwe data zonder eerder geleerde informatie te vergeten. Daarnaast vergelijkt A/B-testen de prestaties van het huidige model met nieuwe versies en helpt zo verbeteringen te identificeren vóór volledige uitrol.

Welke technieken kun je toepassen om het ethische gebruik van LLM’s te waarborgen?

Om het ethische gebruik van LLM’s te borgen, kun je verschillende technieken implementeren:

- Biasmitigatie: Strategieën toepassen om vooroordelen in trainingsdata en modeloutput te identificeren en te verminderen, zoals gebalanceerde datasets en bias-detectietools.

- Transparantie en uitlegbaarheid: Modellen ontwikkelen die interpreteerbare en uitlegbare output geven om vertrouwen en verantwoording te bevorderen, inclusief gebruik van attention-visualisatie en saliency maps.

- Toestemming van gebruikers en privacy: Zorgen dat data voor training en inferentie voldoet aan privacyregels en waar nodig toestemming verkrijgen.

- Eerlijkheidsaudits: Regelmatig audits uitvoeren om de eerlijkheid en ethische implicaties van het modelgedrag te evalueren.

- Verantwoorde uitrol: Richtlijnen en beleid opstellen voor verantwoorde AI-uitrol, inclusief het omgaan met schadelijke of ongepaste content die het model kan genereren.

Hoe waarborg je de veiligheid van data die met LLM’s wordt gebruikt?

Dataveiligheid bij LLM’s vereist diverse maatregelen. Denk aan encryptie voor data in rust en tijdens transport om ongeautoriseerde toegang te voorkomen. Strikte toegangscontrole is nodig om te waarborgen dat alleen geautoriseerd personeel toegang heeft tot gevoelige data.

Data anonimiseren om persoonsgegevens (PII) te verwijderen voordat die voor training of inferentie wordt gebruikt, is ook cruciaal. Daarnaast is naleving van regelgeving voor gegevensbescherming, zoals de AVG of CCPA, essentieel om juridische problemen te vermijden.

Deze maatregelen beschermen de integriteit, vertrouwelijkheid en beschikbaarheid van data. Die bescherming is cruciaal om gebruikersvertrouwen te behouden en aan regelgeving te voldoen.

Hoe verbetert reinforcement learning from human feedback (RLHF) de kwaliteit en veiligheid van LLM-output, en hoe verhoudt het zich tot nieuwere alignment-methoden zoals DPO en RLAIF?

RLHF is een techniek waarbij een LLM wordt getraind om zijn output af te stemmen op menselijke voorkeuren door feedback van menselijke beoordelaars te incorporeren. Dit iteratieve proces helpt het model om reacties te geven die niet alleen accuraat zijn, maar ook veilig, onbevooroordeeld en behulpzaam.

RLHF kent echter uitdagingen. Eén daarvan is mogelijke bias in de menselijke feedback, omdat verschillende beoordelaars uiteenlopende voorkeuren en interpretaties kunnen hebben.

Een andere uitdaging is de schaalbaarheid van het feedbackproces, aangezien het verzamelen en verwerken van veel menselijke feedback tijdrovend en kostbaar kan zijn. Daarnaast is het lastig om te waarborgen dat het beloningsmodel in RLHF de gewenste gedragingen en waarden nauwkeurig vastlegt. De PPO (Proximal Policy Optimization)-stap voegt complexiteit toe en kan instabiliteit tijdens training introduceren.

Er zijn moderne alternatieven ontstaan die veel RLHF-beperkingen adresseren:

- DPO (Direct Preference Optimization): Schrapt het aparte beloningsmodel volledig en gebruikt impliciete beloningssignalen die rechtstreeks zijn afgeleid van voorkeursparen. Deze aanpak is eenvoudiger, stabieler en computationeel efficiënter dan PPO-gebaseerde RLHF. DPO wordt nu breed omarmd door grote AI-labs als alternatief of aanvulling op traditionele RLHF.

- GRPO (Gradient-based Reward Policy Optimization): Een variant die de voordelen van DPO’s eenvoud combineert met aspecten van PPO-achtige learning en zo tussenvormen biedt.

- RLAIF (Reinforcement Learning from AI Feedback): Vervangt menselijke beoordelaars door AI-feedback (zoals beoordelingen van sterkere modellen of gespecialiseerde evaluatoren). Deze aanpak verkleint schaalbaarheidsuitdagingen en kosten drastisch, omdat AI-feedback genereren goedkoper en sneller is dan menselijke feedback verzamelen.

De meeste productiemodellen gebruiken DPO, RLAIF of hybride combinaties in plaats van pure, op PPO gebaseerde RLHF.

Vergelijk state-space-modellen (zoals Mamba) met Transformers. Wat zijn de trade-offs en wanneer gebruik je welke?

Kennisgebaseerde hallucinaties ontstaan wanneer het model niet over de juiste feiten beschikt (of verouderde feiten heeft) en daarom aannemelijk klinkende informatie verzint. Oplossingen omvatten doorgaans:

- Het model gronden met retrieval (RAG)

- Gecontroleerde bronnen toevoegen

- Domeinspecifieke fine-tuning

Logische hallucinaties ontstaan wanneer het model wel over relevante informatie beschikt, maar onjuist redeneert of inconsistenties produceert. Veelvoorkomende oplossingen zijn:

- Gestructureerde prompting

- Verificatie-/zelfcontrolestappen (vaak via agentische workflows

- Gerichte evaluatie

Wat is het verschil tussen kennisgebaseerde en logische hallucinaties in LLM’s en hoe pak je elk aan?

Hoewel Transformers vandaag de dag dominant zijn bij LLM’s, zijn state-space-modellen (SSM’s) zoals Mamba opgekomen als een concurrerend architecturaal paradigma met fundamenteel andere rekenkundige en prestatie-eigenschappen. Beide begrijpen wordt steeds belangrijker voor moderne LLM-professionals.

Transformers:

- Sterktes: Uitstekend in informatie-ophalen, kopieer/plak-taken en in-context learning. Beproefde architectuur op schaal met uitgebreide tooling en infrastructuur. Sterke empirische prestaties bij codegeneratie en diverse benchmarks.

- Zwakkes: O(N²)-attentioncomplexiteit zorgt voor kwadratische geheugen- en rekenvereisten. Dit uit zich in prestatieafname bij zeer lange sequenties (>100K tokens) en hoge latency voor long-context-toepassingen.

- Use-cases en aanbevelingen: De meeste productie-LLM’s vandaag (GPT, Claude, Gemini, Llama). Aanbevolen voor huidige real-world toepassingen en de nabije toekomst.

State-Space-modellen (Mamba, Mamba-2):

- Sterktes: O(N)-complexiteit met lineaire geheugenschaal. 5–10x snellere inferentie op lange sequenties (>50K tokens). Betere theoretische fundamenten voor signaalverwerking. Meer voorspelbaar schaalgedrag.

- Zwakkes: Vereisen 10x meer trainingsdata dan Transformers om vergelijkbare prestaties te halen. Zwakker in informatie-ophalen en kopieertaken. Minder volwassen ecosysteem met minder tools, libraries en getrainde modellen.

- Use-cases en aanbevelingen: In opkomst voor gespecialiseerde toepassingen—verwerking van lange documenten, realtime systemen met latency-eisen, streamingtoepassingen en mogelijk gespecialiseerde domeinen waar O(N)-schaal cruciaal is.

Recent onderzoek laat zien dat Transformers en SSM’s complementair zijn in plaats van direct concurrerend, met uiteenlopende use-cases en randvoorwaarden die verschillende architecturen begunstigen. Transformers blijven de praktische keuze voor general-purpose LLM’s en zullen naar verwachting voorlopig domineren. Een hybride toekomst ligt voor de hand, met gespecialiseerde modellen voor verschillende reken- en taakvereisten.

LLM-sollicitatievragen voor prompt engineers

Prompt engineering is een belangrijk aspect van het benutten van LLM’s. Het omvat het zorgvuldig formuleren van precieze en effectieve prompts om gewenste reacties van het model te genereren. Dit deel behandelt kernvragen die prompt engineers kunnen tegenkomen.

Wat is prompt engineering en waarom is het cruciaal bij werken met LLM’s?

Prompt engineering draait om het ontwerpen en verfijnen van prompts om LLM’s te sturen naar accurate en relevante output. Het is cruciaal omdat de kwaliteit van de prompt direct de prestaties van het model beïnvloedt.

Effectieve prompts kunnen het vermogen van het model om de taak te begrijpen vergroten, leiden tot accurate en relevante antwoorden en de kans op fouten verkleinen.

Prompt engineering is essentieel om de waarde van LLM’s te maximaliseren in uiteenlopende toepassingen, van tekstgeneratie tot complexe probleemoplossing.

Kun je voorbeelden geven van verschillende promptingtechnieken (zero-shot, few-shot, chain-of-thought) en uitleggen wanneer je ze gebruikt?

- Zero-shot prompting: Je geeft het model een taakbeschrijving zonder voorbeelden. Gebruikelijk wanneer er geen voorbeelden beschikbaar zijn of wanneer je het algemene begrip en de flexibiliteit van het model wilt testen.

- Few-shot prompting: Je levert enkele voorbeelden samen met de taakbeschrijving om het model te sturen. Handig wanneer het model context of voorbeelden nodig heeft om de taak beter te begrijpen.

- Chain-of-Thought prompting: Je breekt een complexe taak op in kleinere, opeenvolgende stappen die het model kan volgen. Dit is nuttig voor taken die logische redenering en meerstapsprobleemoplossing vereisen.

- Agentische prompting: Structuur prompts zodat modellen optreden als autonome agenten die tools/API’s aanroepen, informatie verzamelen en over meerdere stappen redeneren. Prompts bevatten definities van de actieruimte, toolbeschrijvingen en expliciete redeneervereisten.

Hoe evalueer je de effectiviteit van een prompt?

De effectiviteit van een prompt evalueren omvat:

- Outputkwaliteit: Relevantie, samenhang en nauwkeurigheid van de modelreacties beoordelen.

- Consistentie: Controleren of het model consequent hoogwaardige output genereert over verschillende inputvarianten.

- Taakspecifieke metrics: Taakspecifieke evaluatiemetrics gebruiken, zoals BLEU voor vertaling of ROUGE voor samenvatting, om prestaties te meten.

- Menselijke evaluatie: Menselijke reviewers betrekken om kwalitatieve feedback te geven op de output van het model.

- A/B-testen: Verschillende prompts vergelijken om te bepalen welke betere prestaties oplevert.

Wat zijn strategieën om veelvoorkomende valkuilen in promptontwerp te vermijden (bijv. sturende vragen, dubbelzinnige instructies)?

- Vermijd sturende vragen: Zorg dat prompts geen specifiek antwoord suggereren, wat de reactie van het model kan vertekenen.

- Duidelijke en beknopte instructies: Geef ondubbelzinnige, duidelijke instructies om verwarring te verminderen.

- Context bieden: Voeg relevante context toe zodat het model de taak begrijpt zonder het te overladen met onnodige informatie.

- Iteratief testen: Prompts continu testen en verfijnen op basis van modeloutput en prestaties.

Hoe pak je iteratieve promptverfijning aan om LLM-prestaties te verbeteren?

Iteratieve promptverfijning omvat:

- Initiëel ontwerp: Begin met een basisprompt op basis van taakeisen.

- Testen en evaluatie: De prestaties van de prompt beoordelen met verschillende metrics en feedback verzamelen.

- Analyse: Zwakke punten of verbeterpunten in de prompt identificeren.

- Verfijning: Aanpassingen doorvoeren aan de prompt om geïdentificeerde issues te adresseren.

- Herhalen: Het test- en verfijningsproces herhalen totdat de gewenste prestaties zijn bereikt.

Welke tools of frameworks gebruik je om het promptengineeringproces te stroomlijnen?

Diverse tools en frameworks kunnen het promptengineeringproces stroomlijnen:

- Platforms specifiek voor LLM’s: LangChain en LlamaIndex voor prompt-chaining en het bouwen van agentische systemen; Vercel AI SDK voor snelle prototypering en uitrol.

- Prompttesten & optimalisatie: PromptFoo (geautomatiseerd prompttesten over scenario’s), DSPy (programmatische promptoptimalisatie), Haystack (RAG-pipelineconstructie).

- Interactieve ontwikkelomgevingen (IDE’s): Jupyter Notebook voor experimenten, VS Code met LLM-extensies (GitHub Copilot, Cursor), Streamlit voor interactieve UI-prototypes.

- API’s en SDK’s: OpenAI API, Anthropic SDK, Together AI en LM Studio voor lokale modeluitrol.

- Versiebeheer & samenwerking: Git-gebaseerde promptversiebeheer, Weights & Biases voor experimenttracking en -vergelijking, HuggingFace Hub voor het delen van modellen en prompts.

- Agentische frameworks: AutoGPT, OpenAI Assistants API, LangGraph voor het bouwen van complexe, meerstaps agentische workflows.

- Evaluatie & monitoring: Ragas (RAG-evaluatiemetrics), LangSmith (tracing, debugging en monitoring in productie), Braintrust (end-to-end LLM-observability).

Hoe ga je via prompt engineering om met uitdagingen zoals hallucinatie of bias in LLM-output?

Deze vraag raakt aan de ethische en praktische kwesties rond door LLM’s gegenereerde content. Een sterk antwoord toont bewustzijn van deze problemen en bespreekt technieken zoals de volgende.

Technieken om hallucinaties te mitigeren:

- Feitenverificatieprompts: Prompts opnemen die het model aanmoedigen om informatie te verifiëren aan de hand van betrouwbare bronnen en expliciet bewijs te citeren.

- Integratie van retrieval: RAG of RAG 2.0 gebruiken om antwoorden te gronden in echte documenten en zo verzonnen feiten te verminderen door van het model te eisen dat het naar opgehaalde informatie verwijst.

- Agentische verificatielussen: Prompts structureren zodat het model meerstaps verificatie uitvoert en zijn werk checkt vóór het antwoorden—feitelijk zelfverificatie-agenten creëren.

- Constraint-gebaseerde prompts: Het outputformaat en logische constraints definiëren die inconsistenties of niet-onderbouwde claims zichtbaar maken.

Technieken om bias te mitigeren:

- Divers-perspectiefprompts: Het model sturen om meerdere standpunten en stakeholders mee te nemen vóór een conclusie.

- Bias-detectieprompts: Het model vragen mogelijke vooroordelen in zijn eigen redenering en output te identificeren.

- Counterfactual prompts: Alternatieve scenario’s of perspectieven vragen om initiële aannames uit te dagen en de robuustheid van de redenering te testen.

- Instructieclariteit: Expliciet specificeren dat antwoorden in balans moeten zijn, beperkingen moeten erkennen en discriminerende taal moeten vermijden.

Kun je de rol van prompttemplates uitleggen en hoe ze worden gebruikt in prompt engineering?

Prompttemplates bieden een gestructureerd format voor prompts, vaak met placeholders voor specifieke informatie of instructies. Ze kunnen worden hergebruikt in verschillende taken en scenario’s en verbeteren de consistentie en efficiëntie van promptontwerp.

Een goed antwoord laat zien hoe prompttemplates best practices kunnen vastleggen, domeinspecifieke kennis kunnen opnemen en het genereren van effectieve prompts voor diverse toepassingen kunnen stroomlijnen.

Hoe beïnvloedt de keuze van een tokenizer prompt engineering en modelprestaties?

De tokenizer speelt een cruciale rol in hoe het LLM de inputprompt interpreteert en verwerkt. Verschillende tokenizers hebben uiteenlopende vocabulairgroottes en gaan anders om met out-of-vocabulary (OOV)-woorden. Een subword-tokenizer zoals Byte Pair Encoding (BPE) kan OOV-woorden aan door ze op te splitsen in kleinere subword-eenheden, terwijl een woordgebaseerde tokenizer ze als onbekende tokens kan behandelen.

De keuze van tokenizer kan de prestaties van het model op meerdere manieren beïnvloeden. Zo kan een subword-tokenizer effectiever zijn in het vastleggen van de betekenis van zeldzame of technische termen, terwijl een woordgebaseerde tokenizer eenvoudiger en sneller kan zijn voor algemene taaltoepassingen.

Bij prompt engineering kan de keuze van tokenizer bepalen hoe je je prompts structureert. Gebruik je bijvoorbeeld een subword-tokenizer, dan moet je mogelijk beter letten op hoe woorden in subwords worden opgesplitst om te borgen dat het model de beoogde betekenis oppikt.

Wat is agentische prompting en hoe verschilt het van traditionele prompt engineering?

Agentische prompting is een promptontwerpaanpak waarbij het model wordt geïnstrueerd om te handelen als een “agent” die kan plannen, acties kan uitvoeren (bijvoorbeeld tools/API’s aanroepen of documenten ophalen), de resultaten kan observeren en kan itereren totdat een doel is bereikt.

In tegenstelling tot traditionele prompt engineering, die vooral probeert om in één keer het beste mogelijke antwoord te krijgen via duidelijke instructies, voorbeelden en opmaakconstraints, legt agentische prompting de nadruk op een meerstaps controllus (plannen → handelen → observeren → verfijnen).

Het is vooral nuttig voor taken waarbij correctheid afhangt van interactie met externe systemen (databases, zoeken, code-uitvoering) of het verifiëren van tussentijdse resultaten, in plaats van te vertrouwen op alleen de interne kennis van het model.

Goede agentische prompts definiëren doorgaans het doel, de beschikbare tools/acties, hoe te beslissen welke actie te nemen en wanneer te stoppen. Het is ook gebruikelijk om expliciete verificatiestappen toe te voegen (bijv. “controleer opgehaalde bronnen” of “reken opnieuw vóór het eindantwoord”) om hallucinaties te verminderen en de betrouwbaarheid te verhogen.

Conclusie

Deze gids bood een set interviewvragen om je voor te bereiden op gesprekken over LLM’s, van basisprincipes tot geavanceerde strategieën.

Of je nu een interview voorbereidt of je begrip wilt verstevigen, deze inzichten geven je de kennis om je weg te vinden en te excelleren op het gebied van kunstmatige intelligentie.

Wil je lezen over het nieuwste in AI en LLM’s? Dan raad ik deze onderwerpen aan: