Program

Large language models (LLM) menjadi semakin penting dalam kecerdasan buatan, dengan aplikasi di berbagai industri.

Seiring meningkatnya permintaan terhadap profesional yang memiliki keahlian LLM, artikel ini menyediakan kumpulan pertanyaan dan jawaban wawancara yang komprehensif, mencakup konsep dasar, teknik lanjutan, dan penerapan praktis.

Jika Anda sedang mempersiapkan wawancara kerja atau sekadar ingin memperluas pengetahuan, artikel ini akan bermanfaat.

Pertanyaan Wawancara LLM Dasar

Untuk memahami LLM, penting untuk memulai dari konsep fundamental. Pertanyaan-pertanyaan dasar ini mencakup aspek penting seperti arsitektur, mekanisme kunci, dan tantangan umum, sehingga memberikan landasan kuat untuk mempelajari topik yang lebih lanjut.

Apa itu arsitektur Transformer, dan bagaimana penggunaannya dalam LLM?

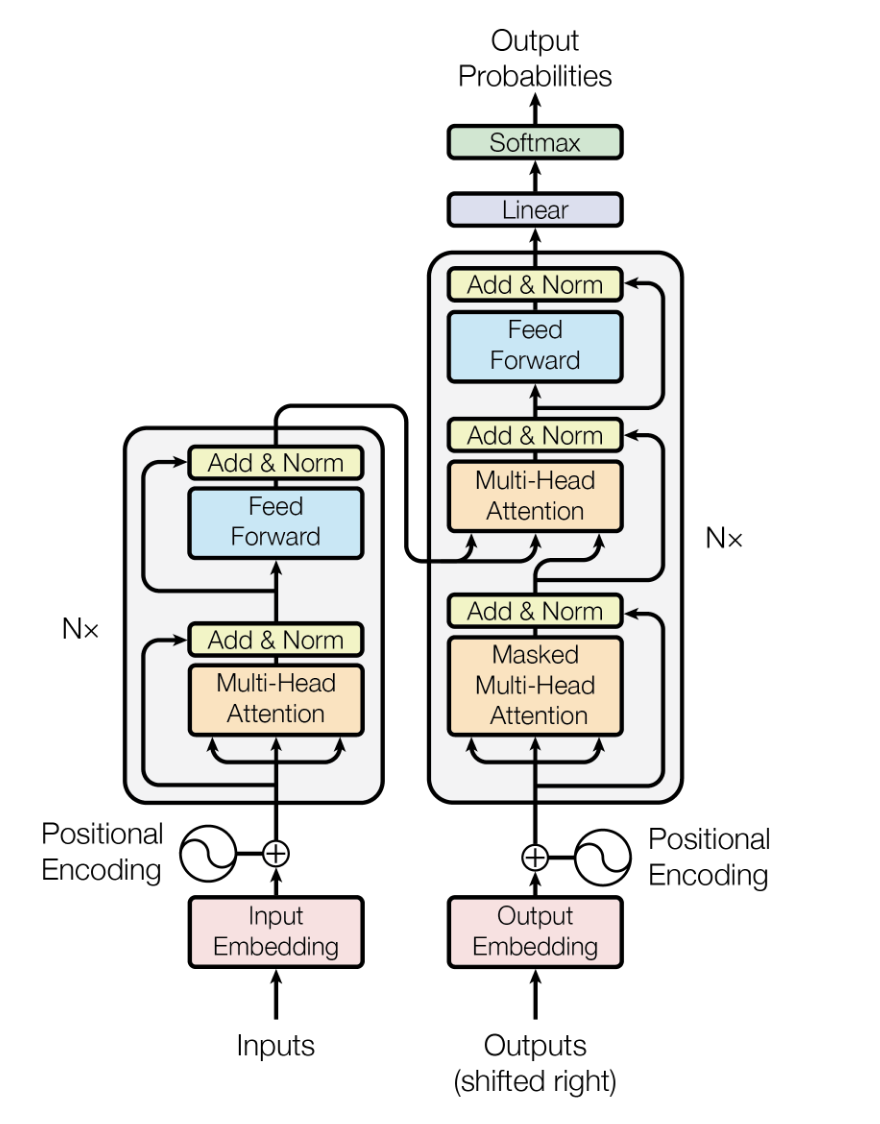

Arsitektur Transformer adalah model deep learning yang diperkenalkan oleh Vaswani dkk. pada 2017, dirancang untuk menangani data sekuensial dengan efisiensi dan kinerja yang lebih baik dibandingkan model sebelumnya seperti recurrent neural networks (RNN) dan long short-term memory (LSTM).

Model ini mengandalkan mekanisme self-attention untuk memproses data masukan secara paralel, sehingga sangat skalabel dan mampu menangkap ketergantungan jarak jauh.

Dalam LLM, arsitektur Transformer menjadi tulang punggung, memungkinkan model memproses data teks dalam jumlah besar secara efisien dan menghasilkan keluaran teks yang relevan secara kontekstual dan koheren.

Arsitektur model Transformer. Sumber

Jelaskan konsep "context window" dalam LLM dan signifikansinya.

Context window dalam LLM mengacu pada rentang teks (dalam token atau kata) yang dapat dipertimbangkan model sekaligus saat menghasilkan atau memahami bahasa. Signifikansi context window terletak pada dampaknya terhadap kemampuan model untuk menghasilkan respons yang logis dan relevan.

Secara umum, context window yang lebih besar memungkinkan model mempertimbangkan lebih banyak konteks, sehingga menghasilkan pemahaman dan generasi teks yang lebih baik, terutama dalam percakapan yang kompleks atau panjang. Namun, ini juga meningkatkan kebutuhan komputasi, sehingga perlu keseimbangan antara kinerja dan efisiensi.

Selain itu, riset terbaru mengungkapkan bahwa kebanyakan model menunjukkan penurunan kinerja jauh sebelum batas yang diiklankan. Model dapat menunjukkan fenomena "lost in the middle" di mana informasi di bagian tengah konteks diabaikan atau tidak diprioritaskan. Oleh karena itu, konteks yang terkurasi dan relevan dalam jendela yang lebih kecil sering kali mengungguli pengisian jendela besar dengan noise.

Apa saja tujuan pra-pelatihan umum untuk LLM, dan bagaimana cara kerjanya?

Tujuan pra-pelatihan umum untuk LLM mencakup masked language modeling (MLM) dan autoregressive language modeling. Pada MLM, kata-kata acak dalam sebuah kalimat ditutupi (masked), dan model dilatih untuk memprediksi kata yang ditutupi berdasarkan konteks sekitarnya. Ini membantu model memahami konteks dua arah.

Autoregressive language modeling melibatkan prediksi kata berikutnya dalam sebuah urutan dan melatih model untuk menghasilkan teks satu token demi satu. Kedua tujuan ini memungkinkan model mempelajari pola bahasa dan semantik dari korpus besar, menyediakan fondasi kuat untuk fine-tuning pada tugas spesifik.

Apa itu fine-tuning dalam konteks LLM, dan mengapa hal ini penting?

Fine-tuning dalam konteks LLM melibatkan pengambilan model pra-terlatih dan melatihnya lebih lanjut pada dataset yang lebih kecil dan spesifik untuk tugas tertentu. Proses ini membantu model menyesuaikan pemahaman bahasa umum dengan nuansa aplikasi spesifik, sehingga meningkatkan kinerja.

Ini adalah teknik penting karena memanfaatkan pengetahuan bahasa yang luas yang diperoleh selama pra-pelatihan sambil memodifikasi model agar berkinerja baik pada aplikasi tertentu, seperti analisis sentimen, peringkasan teks, atau tanya jawab.

Apa saja tantangan umum yang terkait dengan penggunaan LLM?

Menggunakan LLM memiliki beberapa tantangan, termasuk:

- Sumber daya komputasi: LLM memerlukan daya komputasi dan memori yang signifikan, sehingga pelatihan dan penerapannya membutuhkan sumber daya besar.

- Bias dan keadilan: LLM dapat secara tidak sengaja mempelajari dan menyebarkan bias yang ada dalam data pelatihan, menghasilkan keluaran yang tidak adil atau bias.

- Interpretabilitas: Memahami dan menjelaskan keputusan yang dibuat LLM bisa sulit karena sifatnya yang kompleks dan tidak transparan.

- Privasi data: Penggunaan dataset besar untuk pelatihan dapat menimbulkan kekhawatiran terkait privasi dan keamanan data.

- Biaya: Pengembangan, pelatihan, dan penerapan LLM bisa mahal, sehingga membatasi aksesibilitasnya bagi organisasi yang lebih kecil.

Bagaimana LLM menangani kata atau token yang di luar kosakata (OOV)?

LLM menangani kata atau token di luar kosakata (OOV) menggunakan teknik seperti tokenisasi sub-kata (misalnya Byte Pair Encoding atau BPE, dan WordPiece). Teknik-teknik ini memecah kata yang tidak dikenal menjadi unit sub-kata yang lebih kecil dan dikenal oleh model.

Pendekatan ini memastikan bahwa meskipun sebuah kata tidak terlihat saat pelatihan, model tetap dapat memahami dan menghasilkan teks berdasarkan bagian-bagiannya, sehingga meningkatkan fleksibilitas dan ketangguhan.

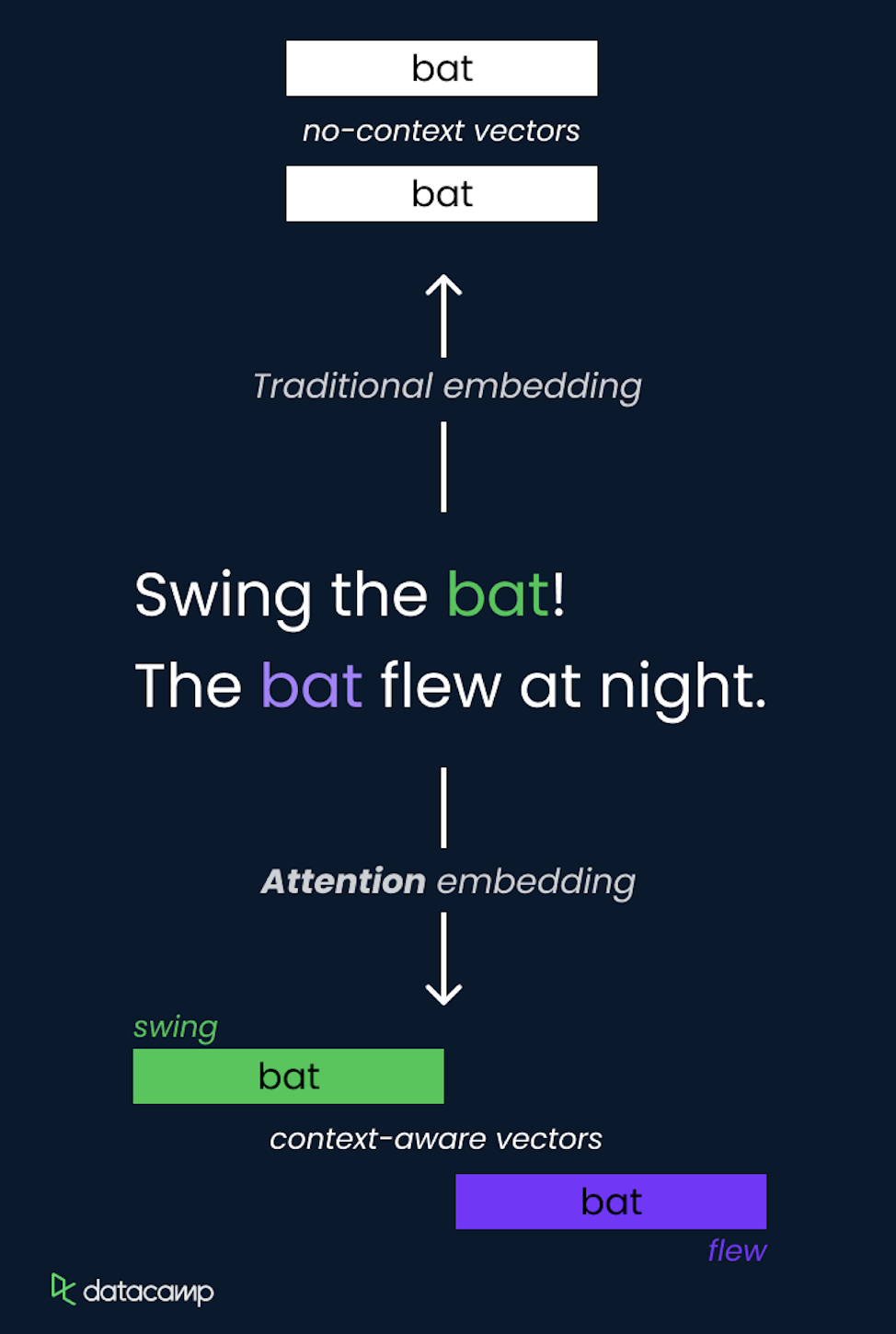

Apa itu embedding layer, dan mengapa penting dalam LLM?

Embedding layer adalah komponen penting dalam LLM yang digunakan untuk mengubah data kategorikal, seperti kata, menjadi representasi vektor dens. Embedding ini menangkap hubungan semantik antar-kata dengan merepresentasikannya dalam ruang vektor kontinu di mana kata-kata yang mirip memiliki kedekatan lebih kuat. Pentingnya embedding layer dalam LLM mencakup:

- Reduksi dimensi: Mengurangi dimensi data masukan, sehingga lebih mudah dikelola oleh model.

- Pemahaman semantik: Embedding menangkap makna semantik yang bernuansa serta hubungan antar-kata, meningkatkan kemampuan model memahami dan menghasilkan teks yang mirip manusia.

- Transfer learning: Embedding pra-terlatih dapat digunakan lintas model dan tugas berbeda, menyediakan fondasi pemahaman bahasa yang dapat di-fine-tune untuk aplikasi spesifik.

Bagaimana cara kerja positional encoding LLM modern, dan mengapa Rotary Position Embeddings (RoPE) menjadi standar?

Positional encoding memberi tahu transformer posisi setiap token dalam urutan.

Positional encoding sinusoidal tradisional (dari Vaswani dkk. 2017) menggunakan fungsi matematis tetap untuk menyandikan posisi secara statis. Rotary Position Embeddings (RoPE), yang diperkenalkan belakangan, menjadi standar pada LLM modern karena menawarkan sifat yang secara fundamental lebih unggul.

RoPE bekerja dengan merepresentasikan posisi sebagai sudut rotasi dalam ruang vektor kompleks, memutar embedding token dengan sudut yang proporsional terhadap posisinya. Pendekatan geometris ini lebih efisien dan secara alami mendukung interpolasi ke sekuens yang lebih panjang daripada yang terlihat saat pelatihan, yang merupakan kemampuan krusial untuk memperluas context window. Model seperti GPT-5.2 dan Gemini 3 menggunakan RoPE sebagai positional encoding mereka.

Pertanyaan Wawancara LLM Tingkat Menengah

Membangun di atas konsep dasar, pertanyaan tingkat menengah membahas teknik praktis untuk mengoptimalkan kinerja LLM serta mengatasi tantangan terkait efisiensi komputasi dan interpretabilitas model.

Jelaskan konsep attention dalam LLM dan bagaimana implementasinya.

Konsep attention dalam LLM adalah metode yang memungkinkan model memfokuskan diri pada bagian-bagian berbeda dari urutan masukan saat membuat prediksi. Metode ini secara dinamis memberikan bobot pada token lain dalam masukan, menyoroti yang paling relevan untuk tugas saat ini.

Hal ini diimplementasikan menggunakan self-attention, di mana model menghitung skor attention untuk setiap token relatif terhadap semua token lain dalam urutan, memungkinkannya menangkap ketergantungan tanpa memandang jarak.

Mekanisme self-attention adalah komponen inti arsitektur Transformer, yang memungkinkannya memproses informasi secara efisien dan menangkap hubungan jarak jauh.

Apa peran tokenisasi dalam pemrosesan LLM?

Tokenisasi mengubah teks mentah menjadi unit-unit yang lebih kecil yang disebut token, yang bisa berupa kata, sub-kata, atau karakter.

Peran tokenisasi dalam pemrosesan LLM sangat penting karena mengubah teks menjadi format yang dapat dipahami dan diproses oleh model.

Tokenisasi yang efektif memastikan model dapat menangani beragam masukan, termasuk kata langka dan berbagai bahasa, dengan memecahnya menjadi bagian yang mudah dikelola. Langkah ini diperlukan untuk pelatihan dan inferensi yang optimal, karena menstandarkan masukan dan membantu model mempelajari pola yang bermakna dalam data.

Bagaimana Anda mengukur kinerja sebuah LLM?

Peneliti dan praktisi telah mengembangkan banyak metrik evaluasi untuk menilai kinerja LLM. Metrik klasik meliputi:

- Perplexity: Mengukur seberapa baik model memprediksi sebuah sampel, lazim digunakan dalam tugas pemodelan bahasa.

- Akurasi: Digunakan pada tugas seperti klasifikasi teks untuk mengukur proporsi prediksi yang benar.

- Skor F1: Rata-rata harmonik dari precision dan recall, digunakan pada tugas seperti pengenalan entitas bernama.

- Skor BLEU (Bilingual Evaluation Understudy): Mengukur kualitas teks yang dihasilkan mesin terhadap terjemahan acuan, umum dipakai pada penerjemahan mesin.

- ROUGE (Recall-Oriented Understudy for Gisting Evaluation): Sekumpulan metrik yang mengevaluasi tumpang tindih antara teks yang dihasilkan dan teks acuan, sering digunakan pada tugas peringkasan. Metrik-metrik ini membantu mengkuantifikasi efektivitas model dan memandu peningkatan lebih lanjut.

Di luar metrik tradisional, praktisi kini menggunakan benchmark standar untuk berbagai tujuan, seperti MMLU (uji pengetahuan 57 tugas), MMMU-Pro (penalaran multimodal), dan HumanEval (generasi kode). Selain itu, leaderboard seperti LMArena memberi peringkat LLM berdasarkan preferensi manusia. Untuk sistem yang sudah diterapkan, mengukur tingkat halusinasi di dunia nyata, latensi, dan efisiensi token menjadi esensial.

Apa saja teknik untuk mengendalikan keluaran LLM?

Beberapa teknik dapat digunakan untuk mengendalikan keluaran LLM, termasuk:

- Temperatur: Mengatur parameter ini saat sampling mengontrol tingkat keacakan keluaran. Temperatur rendah menghasilkan keluaran yang lebih deterministik, sementara nilai lebih tinggi menghasilkan keluaran lebih bervariasi.

- Top-K sampling: Membatasi kolam sampling pada K token paling mungkin, mengurangi peluang menghasilkan teks yang kurang relevan atau tidak masuk akal.

- Top-P (nucleus) sampling: Memilih token dari himpunan terkecil yang probabilitas kumulatifnya melebihi ambang P, menyeimbangkan keragaman dan koherensi.

- Prompt engineering: Merancang prompt spesifik untuk mengarahkan model agar menghasilkan keluaran yang diinginkan dengan memberikan konteks atau contoh.

- Control token: Menggunakan token khusus untuk memberi sinyal kepada model agar menghasilkan teks dalam gaya, format, atau jenis konten tertentu.

Apa saja pendekatan untuk mengurangi biaya komputasi LLM?

Untuk mengurangi biaya komputasi LLM, kita dapat menerapkan:

- Model pruning: Menghapus bobot atau neuron yang kurang penting dari model untuk mengurangi ukuran dan kebutuhan komputasinya.

- Kuantisasi: Mengonversi bobot model dari presisi tinggi (misalnya floating-point 32-bit) ke presisi lebih rendah (misalnya integer 8-bit) untuk mengurangi penggunaan memori dan mempercepat inferensi.

- Distillation: Melatih model yang lebih kecil (siswa) untuk meniru perilaku model besar pra-terlatih (guru) guna mencapai kinerja serupa dengan sumber daya lebih sedikit.

- Sparse attention: Menggunakan teknik seperti sparse transformer untuk membatasi mekanisme attention pada subset token, sehingga mengurangi beban komputasi.

- Arsitektur efisien: Mengembangkan dan menggunakan arsitektur model yang efisien yang dirancang khusus untuk meminimalkan kebutuhan komputasi sambil mempertahankan kinerja, seperti Reformer atau Longformer.

Seberapa penting interpretabilitas model dalam LLM, dan bagaimana cara mencapainya?

Interpretabilitas model penting untuk memahami bagaimana LLM mengambil keputusan, yang krusial untuk membangun kepercayaan, memastikan akuntabilitas, serta mengidentifikasi dan mengurangi bias. Mencapai interpretabilitas dapat melibatkan berbagai pendekatan, seperti:

- Visualisasi attention: Menganalisis bobot attention untuk melihat bagian masukan mana yang difokuskan model.

- Peta saliens: Menyoroti fitur masukan yang memiliki pengaruh terbesar pada keluaran model.

- Metode Model-Agnostic: Menggunakan teknik seperti LIME (Local Interpretable Model-agnostic Explanations) untuk menjelaskan prediksi individual.

- Layer-wise relevance propagation: Menguraikan prediksi model menjadi kontribusi dari tiap layer atau neuron.

Bagaimana LLM menangani ketergantungan jangka panjang dalam teks?

LLM menangani ketergantungan jangka panjang dalam teks melalui arsitekturnya, khususnya mekanisme self-attention, yang memungkinkan model mempertimbangkan semua token dalam urutan masukan secara bersamaan. Kemampuan untuk memberi perhatian pada token yang jauh membantu LLM menangkap hubungan dan ketergantungan dalam konteks panjang.

Selain itu, model lanjutan seperti Transformer-XL dan Longformer secara khusus dirancang untuk memperluas context window dan mengelola urutan yang lebih panjang secara lebih efektif, sehingga memastikan penanganan ketergantungan jangka panjang yang lebih baik.

Model produksi modern menggunakan strategi yang lebih maju untuk menangani ketergantungan jangka panjang dan melawan penurunan kinerja saat context window diperluas, seperti:

- Rotary Position Embeddings (RoPE) untuk ekstrapolasi panjang yang lebih baik dan penyandian posisi yang unggul.

- Pola attention yang dioptimalkan untuk sekuens panjang, termasuk grouped-query dan varian multi-head attention.

- Integrasi pengetahuan yang cermat melalui RAG alih-alih hanya mengandalkan kapasitas context window.

Apa itu Retrieval-Augmented Generation (RAG) dan bagaimana perkembangannya?

RAG menggabungkan mekanisme retrieval dengan model generatif untuk mengambil informasi relevan dari sumber eksternal selama proses generasi teks. Pendekatan ini secara langsung mengatasi dua keterbatasan kritis LLM: halusinasi dan kebaruan pengetahuan. RAG tradisional menggunakan pipeline retrieval dan generasi yang relatif sederhana, tetapi dalam evolusinya ke "RAG 2.0", pendekatan ini menjadi jauh lebih canggih.

Fitur utama RAG 2.0 meliputi:

- Recursive retrieval: Model menalar tentang celah pada informasi yang diambil dan secara proaktif melakukan pencarian sekunder atau tersier untuk mengisi kekosongan pengetahuan alih-alih mengandalkan satu kali retrieval

- Multimodal retrieval: Integrasi lintas berbagai format—teks, gambar, PDF, video, bahkan panggilan API—yang memungkinkan pengumpulan konteks lebih kaya

- Hybrid indexing: Kombinasi pencarian BM25 (berbasis kata kunci) dan vektor (semantik) untuk menangkap relevansi leksikal dan semantik

- Lapisan re-ranking: Pemfilteran cerdas terhadap hasil retrieval awal untuk mengurangi noise dan informasi yang tidak relevan

- Adaptasi agen: Pemilihan strategi dinamis di mana sistem memilih pendekatan retrieval berdasarkan kompleksitas dan domain kueri

RAG 2.0, jika dikombinasikan dengan LLM, secara efektif mengurangi tingkat halusinasi sebesar 40–60% dalam sistem produksi dibandingkan model dasar.

Pertanyaan Wawancara LLM Tingkat Lanjut

Memahami konsep lanjutan dalam LLM bermanfaat bagi profesional yang ingin mendorong batas kemampuan model ini. Bagian ini membahas topik kompleks dan tantangan umum di bidang ini.

Jelaskan konsep "few-shot learning" dalam LLM dan keunggulannya.

Few-shot learning dalam LLM mengacu pada kemampuan model untuk mempelajari dan melakukan tugas baru hanya dengan beberapa contoh. Kemampuan ini memanfaatkan pengetahuan pra-pelatihan LLM yang luas, memungkinkannya melakukan generalisasi dari sejumlah kecil contoh.

Keunggulan utama few-shot learning mencakup kebutuhan data yang lebih sedikit karena kebutuhan akan dataset besar khusus tugas diminimalkan, fleksibilitas yang meningkat karena model dapat beradaptasi dengan berbagai tugas dengan fine-tuning minimal, serta efisiensi biaya, karena kebutuhan data lebih rendah dan waktu pelatihan berkurang yang berarti penghematan signifikan dalam pengumpulan data dan sumber daya komputasi.

Apa perbedaan antara model bahasa autoregresif dan masked?

Model bahasa autoregresif dan masked berbeda terutama pada pendekatan prediksi dan kesesuaian tugas. Model autoregresif, seperti GPT-5.2, Claude 4.5 Opus, dan Gemini 3, memprediksi kata berikutnya dalam urutan berdasarkan kata-kata sebelumnya, menghasilkan teks satu token demi satu.

Model ini sangat cocok untuk tugas generasi teks. Sebaliknya, masked language model, seperti BERT, secara acak menutupi kata-kata dalam kalimat dan melatih model untuk memprediksi kata yang ditutupi berdasarkan konteks sekitarnya. Pendekatan dua arah ini membantu model memahami konteks dari kedua arah, menjadikannya ideal untuk tugas klasifikasi teks dan tanya jawab.

Bagaimana Anda dapat mengintegrasikan pengetahuan eksternal ke dalam LLM?

Mengintegrasikan pengetahuan eksternal ke dalam LLM dapat dicapai melalui beberapa metode:

- Integrasi knowledge graph: Menambah masukan model dengan informasi dari knowledge graph terstruktur untuk menyediakan konteks.

- Retrieval-Augmented Generation (RAG): Menggabungkan metode retrieval dengan model generatif untuk mengambil informasi relevan dari sumber eksternal selama generasi teks. Sistem RAG 2.0 modern menggunakan recursive retrieval, hybrid indexing, dan re-ranking untuk integrasi pengetahuan yang lebih unggul dibandingkan pendekatan retrieval sederhana.

- Fine-tuning dengan data spesifik domain: Melatih model pada dataset tambahan yang berisi pengetahuan yang diperlukan untuk mengkhususkan diri pada tugas atau domain tertentu.

- Prompt engineering: Merancang prompt yang mengarahkan model untuk menggunakan pengetahuan eksternal secara efektif saat inferensi.

Apa saja tantangan terkait penerapan LLM di produksi?

Menerapkan LLM di produksi melibatkan berbagai tantangan:

- Skalabilitas: Memastikan model dapat menangani volume permintaan besar secara efisien sering kali memerlukan sumber daya komputasi dan infrastruktur yang dioptimalkan.

- Latensi: Meminimalkan waktu respons untuk menyediakan keluaran real-time atau mendekati real-time sangat penting untuk aplikasi seperti chatbot dan asisten virtual.

- Pemantauan dan pemeliharaan: Pemantauan kinerja model secara berkelanjutan dan pembaruan untuk menangani data dan tugas yang berkembang memerlukan sistem pemantauan yang andal dan pembaruan rutin.

- Pertimbangan etis dan legal: Menangani isu terkait bias, privasi, dan kepatuhan terhadap regulasi sangat penting untuk menghindari masalah etis dan konsekuensi hukum.

- Manajemen sumber daya: Mengelola sumber daya komputasi yang signifikan untuk inferensi agar tetap hemat biaya, yang melibatkan optimasi konfigurasi perangkat keras dan perangkat lunak.

Bagaimana Anda menangani degradasi model seiring waktu pada LLM yang diterapkan?

Degradasi model terjadi ketika kinerja LLM menurun seiring waktu akibat perubahan distribusi data yang mendasari. Menangani degradasi model melibatkan pelatihan ulang secara berkala dengan data terbaru untuk mempertahankan kinerja. Pemantauan berkelanjutan diperlukan untuk melacak kinerja model dan mendeteksi tanda-tanda degradasi.

Teknik pembelajaran inkremental memungkinkan model belajar dari data baru tanpa melupakan informasi yang telah dipelajari sebelumnya. Selain itu, pengujian A/B membandingkan kinerja model saat ini dengan versi baru dan membantu mengidentifikasi potensi perbaikan sebelum penerapan penuh.

Apa saja teknik untuk memastikan penggunaan LLM yang etis?

Untuk memastikan penggunaan LLM yang etis, beberapa teknik dapat diterapkan:

- Mitigasi bias: Menerapkan strategi untuk mengidentifikasi dan mengurangi bias dalam data pelatihan dan keluaran model, seperti menggunakan dataset seimbang dan alat deteksi bias.

- Transparansi dan keterjelasan: Mengembangkan model yang memberikan keluaran yang dapat ditafsirkan dan dijelaskan untuk mendorong kepercayaan dan akuntabilitas, termasuk menggunakan visualisasi attention dan peta saliens.

- Persetujuan pengguna dan privasi: Memastikan data yang digunakan untuk pelatihan dan inferensi mematuhi regulasi privasi serta memperoleh persetujuan pengguna bila diperlukan.

- Audit keadilan: Melakukan audit rutin untuk mengevaluasi keadilan dan implikasi etis perilaku model.

- Penerapan yang bertanggung jawab: Menetapkan pedoman dan kebijakan untuk AI yang bertanggung jawab, termasuk penanganan konten berbahaya atau tidak pantas yang dihasilkan model.

Bagaimana Anda memastikan keamanan data yang digunakan dengan LLM?

Mengamankan data yang digunakan dengan LLM memerlukan penerapan berbagai langkah. Ini termasuk penggunaan teknik enkripsi untuk data saat disimpan dan saat ditransmisikan guna melindungi dari akses tidak sah. Kontrol akses yang ketat diperlukan agar hanya personel berwenang yang dapat mengakses data sensitif.

Meng-anonimkan data untuk menghapus informasi identitas pribadi (PII) sebelum digunakan untuk pelatihan atau inferensi juga penting. Selain itu, kepatuhan terhadap regulasi perlindungan data seperti GDPR atau CCPA sangat penting untuk menghindari masalah hukum.

Langkah-langkah ini membantu melindungi integritas, kerahasiaan, dan ketersediaan data. Perlindungan ini krusial untuk menjaga kepercayaan pengguna dan mematuhi standar regulasi.

Bagaimana reinforcement learning from human feedback (RLHF) meningkatkan kualitas dan keamanan keluaran LLM, dan bagaimana perbandingannya dengan metode alignment yang lebih baru seperti DPO dan RLAIF?

RLHF adalah teknik yang melibatkan pelatihan LLM untuk menyelaraskan keluarannya dengan preferensi manusia dengan memasukkan umpan balik dari evaluator manusia. Proses iteratif ini membantu model belajar menghasilkan respons yang tidak hanya akurat tetapi juga aman, tidak bias, dan membantu.

Namun, RLHF memiliki tantangan. Salah satunya adalah potensi bias dalam umpan balik manusia, karena evaluator berbeda mungkin memiliki preferensi dan interpretasi yang bervariasi.

Tantangan lain adalah skalabilitas proses umpan balik, karena mengumpulkan dan memasukkan umpan balik manusia dalam jumlah besar dapat memakan waktu dan mahal. Selain itu, memastikan bahwa model reward yang digunakan dalam RLHF secara akurat menangkap perilaku dan nilai yang diinginkan bisa jadi rumit. Langkah optimisasi PPO (Proximal Policy Optimization) menambah kompleksitas dan dapat memperkenalkan ketidakstabilan selama pelatihan.

Alternatif modern telah muncul yang mengatasi banyak keterbatasan RLHF:

- DPO (Direct Preference Optimization): Menghilangkan model reward terpisah sepenuhnya, menggunakan sinyal reward implisit yang diturunkan langsung dari pasangan preferensi. Pendekatan ini lebih sederhana, lebih stabil, dan lebih efisien secara komputasi dibandingkan RLHF berbasis PPO. DPO kini banyak diadopsi oleh laboratorium AI besar sebagai alternatif atau pelengkap RLHF tradisional.

- GRPO (Gradient-based Reward Policy Optimization): Varian yang menggabungkan manfaat kesederhanaan DPO dengan aspek pembelajaran ala PPO, menawarkan kompromi di tengah.

- RLAIF (Reinforcement Learning from AI Feedback): Menggantikan evaluator manusia dengan umpan balik AI (seperti penilaian dari model yang lebih kuat atau evaluator khusus). Pendekatan ini secara dramatis mengurangi tantangan skalabilitas dan biaya karena menghasilkan umpan balik AI lebih murah dan cepat daripada mengumpulkan umpan balik manusia.

Sebagian besar model produksi menggunakan DPO, RLAIF, atau kombinasi hibrida alih-alih RLHF berbasis PPO murni.

Bandingkan state-space model (seperti Mamba) dengan Transformer. Apa saja trade-off-nya, dan kapan Anda akan menggunakan masing-masing?

Halusinasi berbasis pengetahuan terjadi saat model tidak memiliki fakta yang tepat (atau faktanya usang), sehingga ia menciptakan informasi yang terdengar masuk akal. Perbaikannya biasanya meliputi:

- Mendaratkan (grounding) model dengan retrieval (RAG)

- Menambahkan sumber yang terverifikasi

- Fine-tuning spesifik domain

Halusinasi berbasis logika terjadi saat model memiliki informasi relevan namun bernalar secara keliru atau menghasilkan inkonsistensi. Perbaikan umum adalah:

- Prompt terstruktur

- Langkah verifikasi/self-check (sering melalui workflow agen)

- Evaluasi terarah

Apa perbedaan antara halusinasi berbasis pengetahuan dan berbasis logika dalam LLM, dan bagaimana Anda menangani masing-masingnya?

Meskipun Transformer mendominasi LLM saat ini, state-space model (SSM) seperti Mamba muncul sebagai paradigma arsitektural kompetitif dengan sifat komputasi dan kinerja yang secara fundamental berbeda. Memahami keduanya semakin penting bagi profesional LLM modern.

Transformer:

- Kekuatan: Unggul dalam pengambilan informasi, tugas salin/tempel, dan in-context learning. Arsitektur yang telah terbukti pada skala besar dengan perangkat dan infrastruktur yang luas. Kinerja empiris yang kuat pada generasi kode dan berbagai benchmark.

- Kelemahan: Kompleksitas attention O(N²) menciptakan kebutuhan memori dan komputasi kuadratik. Ini tampak sebagai penurunan kinerja pada sekuens sangat panjang (>100K token) dan latensi tinggi untuk aplikasi konteks panjang.

- Use case dan rekomendasi: Sebagian besar LLM produksi saat ini (GPT, Claude, Gemini, Llama). Direkomendasikan untuk aplikasi dunia nyata saat ini dan dalam waktu mendatang.

State-Space Model (Mamba, Mamba-2):

- Kekuatan: Kompleksitas O(N) dengan skala memori linear. Inferensi 5–10x lebih cepat pada sekuens panjang (>50K token). Landasan teoretis yang lebih baik untuk pemrosesan sinyal. Perilaku penskalaan yang lebih prediktif.

- Kelemahan: Memerlukan data pelatihan 10x lebih banyak daripada Transformer untuk mencapai kinerja yang sebanding. Lebih lemah pada tugas pengambilan informasi dan penyalinan. Ekosistem kurang matang dengan lebih sedikit alat, pustaka, dan model terlatih.

- Use case dan rekomendasi: Muncul untuk aplikasi khusus—pemrosesan dokumen panjang, sistem real-time dengan kendala latensi, aplikasi streaming, dan berpotensi domain khusus di mana penskalaan O(N) sangat kritikal.

Riset terbaru menunjukkan bahwa Transformer dan SSM saling melengkapi alih-alih bersaing langsung, dengan use case dan kendala berbeda yang memfavoritkan arsitektur yang berbeda. Transformer tetap menjadi pilihan praktis untuk LLM serbaguna dan kemungkinan akan tetap mendominasi untuk saat ini. Masa depan hibrida mungkin terjadi, dengan model khusus untuk kebutuhan komputasi dan tugas yang berbeda.

Pertanyaan Wawancara LLM untuk Prompt Engineer

Prompt engineering adalah aspek penting dalam memanfaatkan LLM. Ini melibatkan perancangan prompt yang tepat dan efektif untuk menghasilkan respons yang diinginkan dari model. Bagian ini menelaah pertanyaan kunci yang mungkin ditemui prompt engineer.

Apa itu prompt engineering, dan mengapa penting saat bekerja dengan LLM?

Prompt engineering melibatkan perancangan dan penyempurnaan prompt untuk mengarahkan LLM menghasilkan keluaran yang akurat dan relevan. Hal ini penting saat bekerja dengan LLM karena kualitas prompt berdampak langsung pada kinerja model.

Prompt yang efektif dapat meningkatkan kemampuan model memahami tugas, menghasilkan respons yang akurat dan relevan, serta mengurangi kemungkinan kesalahan.

Prompt engineering sangat penting untuk memaksimalkan kegunaan LLM dalam berbagai aplikasi, mulai dari generasi teks hingga pemecahan masalah yang kompleks.

Bisakah Anda memberikan contoh teknik prompting yang berbeda (zero-shot, few-shot, chain-of-thought) dan menjelaskan kapan menggunakannya?

- Zero-shot prompting: Memberikan deskripsi tugas kepada model tanpa contoh apa pun. Biasanya digunakan saat tidak ada contoh yang tersedia atau ketika kita ingin menguji pemahaman umum dan fleksibilitas model.

- Few-shot prompting: Menyediakan beberapa contoh bersama deskripsi tugas untuk membimbing model. Ini berguna saat model membutuhkan konteks atau contoh untuk lebih memahami tugas.

- Chain-of-Thought prompting: Menguraikan tugas kompleks menjadi langkah-langkah kecil berurutan yang dapat diikuti model. Ini bermanfaat untuk tugas yang memerlukan penalaran logis dan pemecahan masalah multi-langkah.

- Agentic prompting: Menyusun prompt agar model bertindak sebagai agen otonom yang memanggil alat/API, mengumpulkan informasi, dan bernalar lintas beberapa langkah. Prompt mencakup definisi ruang aksi, deskripsi alat, dan kebutuhan penalaran eksplisit.

Bagaimana Anda mengevaluasi efektivitas sebuah prompt?

Mengevaluasi efektivitas prompt melibatkan:

- Kualitas keluaran: Menilai relevansi, koherensi, dan akurasi respons model.

- Konsistensi: Memeriksa apakah model secara konsisten menghasilkan keluaran berkualitas tinggi di berbagai masukan.

- Metrik spesifik tugas: Menggunakan metrik evaluasi spesifik tugas, seperti BLEU untuk terjemahan atau ROUGE untuk peringkasan, untuk mengukur kinerja.

- Evaluasi manusia: Melibatkan peninjau manusia untuk memberikan umpan balik kualitatif terhadap keluaran model.

- Pengujian A/B: Membandingkan berbagai prompt untuk menentukan mana yang memberikan kinerja lebih baik.

Apa saja strategi untuk menghindari jebakan umum dalam desain prompt (misalnya pertanyaan mengarahkan, instruksi ambigu)?

- Hindari pertanyaan mengarahkan: Pastikan prompt tidak menyiratkan jawaban tertentu, yang dapat membiaskan respons model.

- Instruksi yang jelas dan ringkas: Berikan instruksi yang tidak ambigu dan lugas untuk mengurangi kebingungan.

- Penyediaan konteks: Sertakan konteks yang relevan agar model memahami tugas tanpa membebani dengan informasi yang tidak perlu.

- Pengujian iteratif: Terus uji dan perbaiki prompt berdasarkan keluaran dan kinerja model.

Bagaimana pendekatan Anda terhadap penyempurnaan prompt secara iteratif untuk meningkatkan kinerja LLM?

Penyempurnaan prompt secara iteratif melibatkan:

- Desain awal: Mulai dengan prompt dasar berdasarkan kebutuhan tugas.

- Pengujian dan evaluasi: Menilai kinerja prompt menggunakan berbagai metrik dan memperoleh umpan balik.

- Analisis: Mengidentifikasi kelemahan atau area yang perlu ditingkatkan pada prompt.

- Penyempurnaan: Melakukan penyesuaian pada prompt untuk mengatasi masalah yang diidentifikasi.

- Ulangi: Ulangi proses pengujian dan penyempurnaan hingga kinerja yang diinginkan tercapai.

Alat atau kerangka kerja apa yang Anda gunakan untuk menyederhanakan proses prompt engineering?

Beberapa alat dan kerangka kerja dapat menyederhanakan proses prompt engineering:

- Platform khusus LLM: LangChain dan LlamaIndex untuk perangkaian prompt dan membangun sistem agen; Vercel AI SDK untuk prototipe cepat dan penerapan.

- Pengujian & optimasi prompt: PromptFoo (pengujian prompt otomatis lintas skenario), DSPy (optimasi prompt terprogram), Haystack (konstruksi pipeline RAG).

- Lingkungan pengembangan interaktif (IDE): Jupyter Notebook untuk eksperimen, VS Code dengan ekstensi LLM (GitHub Copilot, Cursor), Streamlit untuk membangun prototipe UI interaktif.

- API dan SDK: OpenAI API, Anthropic SDK, Together AI, dan LM Studio untuk penerapan model lokal.

- Kendali versi & kolaborasi: Versioning prompt berbasis Git, Weights & Biases untuk pelacakan dan perbandingan eksperimen, HuggingFace Hub untuk berbagi model dan prompt.

- Kerangka agen: AutoGPT, OpenAI Assistants API, LangGraph untuk membangun workflow agen multi-langkah yang kompleks.

- Evaluasi & pemantauan: Ragas (metrik evaluasi RAG), LangSmith (tracing, debugging, dan pemantauan produksi), Braintrust (observabilitas LLM end-to-end).

Bagaimana Anda menangani tantangan seperti halusinasi atau bias dalam keluaran LLM melalui prompt engineering?

Pertanyaan ini menyoroti isu etis dan praktis dari konten yang dihasilkan LLM. Jawaban yang kuat akan menunjukkan kesadaran atas masalah ini dan membahas teknik seperti berikut.

Teknik mitigasi halusinasi:

- Prompt verifikasi fakta: Menyertakan prompt yang mendorong model untuk memverifikasi informasinya terhadap sumber tepercaya dan secara eksplisit mencantumkan bukti.

- Integrasi retrieval: Menggunakan RAG atau sistem RAG 2.0 untuk mengaitkan respons pada dokumen nyata, mengurangi fakta yang dibuat-buat dengan mewajibkan model merujuk informasi yang diambil.

- Loop verifikasi agen: Menyusun prompt agar model melakukan verifikasi multi-langkah, di mana ia memeriksa pekerjaannya sendiri sebelum merespons—pada dasarnya menciptakan agen verifikasi mandiri.

- Prompt berbasis kendala: Mendefinisikan format keluaran dan kendala logis yang membuat inkonsistensi atau klaim tanpa dukungan menjadi nyata.

Teknik mitigasi bias:

- Prompt perspektif beragam: Mengarahkan model untuk mempertimbangkan berbagai sudut pandang dan pemangku kepentingan sebelum menyimpulkan.

- Prompt deteksi bias: Meminta model mengidentifikasi potensi bias dalam penalaran dan keluarannya sendiri.

- Prompt kontrafaktual: Meminta skenario atau perspektif alternatif untuk menantang asumsi awal dan menguji ketangguhan penalaran.

- Kejelasan instruksi: Secara eksplisit menyebutkan bahwa respons harus seimbang, mengakui keterbatasan, dan menghindari bahasa diskriminatif.

Dapatkah Anda menjelaskan peran template prompt dan bagaimana penggunaannya dalam prompt engineering?

Template prompt menyediakan format terstruktur untuk prompt, sering kali mencakup placeholder untuk informasi atau instruksi tertentu. Template dapat digunakan kembali di berbagai tugas dan skenario, meningkatkan konsistensi dan efisiensi dalam desain prompt.

Jawaban yang baik akan menjelaskan bagaimana template prompt dapat digunakan untuk mengenkapsulasi praktik terbaik, memasukkan pengetahuan spesifik domain, dan menyederhanakan proses pembuatan prompt yang efektif untuk berbagai aplikasi.

Bagaimana pilihan tokenizer memengaruhi prompt engineering dan kinerja model?

Tokenizer memainkan peran krusial dalam bagaimana LLM menafsirkan dan memproses prompt masukan. Tokenizer berbeda memiliki ukuran kosakata yang bervariasi dan menangani kata di luar kosakata (OOV) secara berbeda. Tokenizer sub-kata seperti Byte Pair Encoding (BPE) dapat menangani kata OOV dengan memecahnya menjadi unit sub-kata yang lebih kecil, sementara tokenizer berbasis kata mungkin memperlakukannya sebagai token tidak dikenal.

Pilihan tokenizer dapat memengaruhi kinerja model dalam beberapa cara. Misalnya, tokenizer sub-kata mungkin lebih efektif menangkap makna istilah langka atau teknis, sementara tokenizer berbasis kata mungkin lebih sederhana dan cepat untuk tugas bahasa umum.

Dalam prompt engineering, pilihan tokenizer dapat memengaruhi bagaimana Anda menyusun prompt. Misalnya, jika menggunakan tokenizer sub-kata, Anda mungkin perlu lebih memperhatikan cara kata dipecah menjadi sub-kata untuk memastikan model menangkap makna yang dimaksud.

Apa itu agentic prompting, dan bagaimana bedanya dengan prompt engineering tradisional?

Agentic prompting adalah pendekatan desain prompt di mana model diinstruksikan untuk bertindak seperti “agen” yang dapat merencanakan, mengambil tindakan (misalnya memanggil alat/API atau mengambil dokumen), mengamati hasilnya, dan mengulang hingga menyelesaikan tujuan.

Tidak seperti prompt engineering tradisional, yang terutama berupaya mendapatkan respons terbaik dalam satu kali percobaan melalui instruksi jelas, contoh, dan batasan format, agentic prompting menekankan loop kontrol multi-langkah (rencana → bertindak → observasi → perbaikan).

Pendekatan ini sangat berguna untuk tugas yang ketepatannya bergantung pada interaksi dengan sistem eksternal (basis data, pencarian, eksekusi kode) atau verifikasi hasil antara, alih-alih hanya mengandalkan pengetahuan internal model.

Prompt agen yang baik biasanya mendefinisikan tujuan, alat/tindakan yang tersedia, cara memutuskan tindakan yang diambil, dan kapan harus berhenti. Umumnya juga ditambahkan langkah verifikasi eksplisit (misalnya “periksa sumber yang diambil” atau “hitung ulang sebelum jawaban akhir”) untuk mengurangi halusinasi dan meningkatkan keandalan.

Kesimpulan

Panduan ini menyediakan kumpulan pertanyaan wawancara untuk membantu Anda mempersiapkan diskusi tentang LLM, mulai dari prinsip dasar hingga strategi lanjutan.

Baik Anda sedang mempersiapkan wawancara atau ingin memantapkan pemahaman, wawasan ini akan membekali Anda dengan pengetahuan yang diperlukan untuk menavigasi dan unggul di bidang kecerdasan buatan.

Jika Anda ingin membaca yang terbaru tentang AI dan LLM, saya merekomendasikan topik berikut: