Tracks

Large language models (LLM) ngày càng quan trọng trong trí tuệ nhân tạo, với ứng dụng trên nhiều lĩnh vực.

Khi nhu cầu về chuyên gia có chuyên môn LLM tăng lên, bài viết này cung cấp một bộ câu hỏi và câu trả lời phỏng vấn toàn diện, bao quát các khái niệm căn bản, kỹ thuật nâng cao và ứng dụng thực tiễn.

Dù bạn đang chuẩn bị cho buổi phỏng vấn hay chỉ muốn mở rộng kiến thức, bài viết này sẽ hữu ích.

Câu hỏi phỏng vấn LLM cơ bản

Để hiểu LLM, điều quan trọng là bắt đầu từ các khái niệm nền tảng. Những câu hỏi này bao quát các khía cạnh cốt lõi như kiến trúc, cơ chế chủ đạo và thách thức điển hình, đặt nền móng vững chắc để học các chủ đề nâng cao hơn.

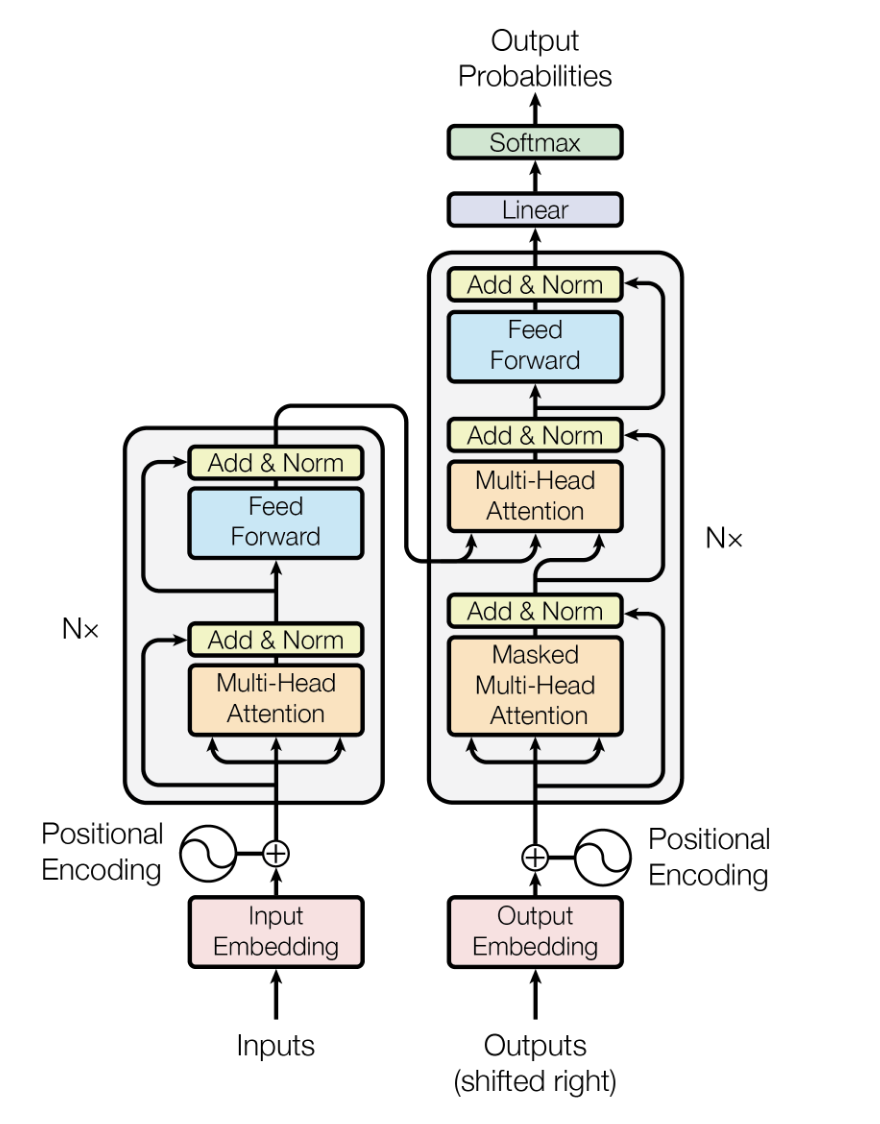

Kiến trúc Transformer là gì và được sử dụng như thế nào trong LLM?

Kiến trúc Transformer là một mô hình học sâu do Vaswani et al. giới thiệu năm 2017, được thiết kế để xử lý dữ liệu tuần tự với hiệu suất và hiệu quả cao hơn các mô hình trước đây như mạng nơ-ron hồi tiếp (RNN) và long short-term memory (LSTM).

Nó dựa vào cơ chế tự chú ý để xử lý dữ liệu đầu vào song song, giúp khả năng mở rộng cao và nắm bắt được phụ thuộc tầm xa.

Trong LLM, kiến trúc Transformer đóng vai trò xương sống, cho phép mô hình xử lý khối lượng lớn văn bản hiệu quả và tạo đầu ra có ngữ cảnh phù hợp, mạch lạc.

Kiến trúc mô hình Transformer. Nguồn

Giải thích khái niệm "cửa sổ ngữ cảnh" trong LLM và ý nghĩa của nó.

Cửa sổ ngữ cảnh trong LLM đề cập đến phạm vi văn bản (tính theo token hoặc từ) mà mô hình có thể xem xét cùng lúc khi tạo hoặc hiểu ngôn ngữ. Ý nghĩa của cửa sổ ngữ cảnh nằm ở tác động của nó đến khả năng tạo ra phản hồi logic và phù hợp của mô hình.

Nhìn chung, cửa sổ ngữ cảnh lớn hơn cho phép mô hình cân nhắc nhiều thông tin hơn, dẫn đến hiểu và sinh văn bản tốt hơn, đặc biệt trong hội thoại phức tạp hoặc dài. Tuy nhiên, nó cũng làm tăng yêu cầu tính toán, cần cân bằng giữa hiệu năng và hiệu quả.

Ngoài ra, nghiên cứu gần đây cho thấy đa số mô hình suy giảm hiệu năng đáng kể trước khi chạm tới giới hạn công bố. Mô hình có thể thể hiện hiện tượng "lạc ở giữa" khi thông tin ở trung tâm ngữ cảnh bị bỏ qua hoặc giảm ưu tiên. Do đó, việc tuyển chọn ngữ cảnh phù hợp trong các cửa sổ nhỏ hơn thường hiệu quả hơn so với việc nhồi nhét cửa sổ lớn bằng nhiễu.

Một số mục tiêu tiền huấn luyện phổ biến cho LLM là gì và chúng hoạt động ra sao?

Các mục tiêu tiền huấn luyện phổ biến cho LLM gồm masked language modeling (MLM) và autoregressive language modeling. Trong MLM, các từ ngẫu nhiên trong câu được che lại, và mô hình được huấn luyện để dự đoán những từ bị che dựa trên ngữ cảnh xung quanh. Điều này giúp mô hình hiểu ngữ cảnh hai chiều.

Autoregressive language modeling liên quan đến việc dự đoán từ kế tiếp trong chuỗi và huấn luyện mô hình sinh văn bản từng token một. Cả hai mục tiêu giúp mô hình học mẫu ngôn ngữ và ngữ nghĩa từ các kho ngữ liệu lớn, tạo nền tảng vững chắc để tinh chỉnh cho các tác vụ cụ thể.

Fine-tuning trong bối cảnh LLM là gì và vì sao quan trọng?

Fine-tuning trong bối cảnh LLM là việc lấy một mô hình tiền huấn luyện và tiếp tục huấn luyện nó trên một tập dữ liệu nhỏ hơn, theo từng tác vụ cụ thể. Quy trình này giúp mô hình điều chỉnh hiểu biết ngôn ngữ tổng quát cho phù hợp với sắc thái của ứng dụng cụ thể, từ đó cải thiện hiệu năng.

Đây là kỹ thuật quan trọng vì tận dụng kiến thức ngôn ngữ rộng đã tích lũy trong giai đoạn tiền huấn luyện, đồng thời điều chỉnh mô hình để hoạt động tốt ở các ứng dụng cụ thể như phân tích cảm xúc, tóm tắt văn bản hoặc hỏi đáp.

Một số thách thức thường gặp khi sử dụng LLM là gì?

Việc sử dụng LLM đi kèm nhiều thách thức, bao gồm:

- Tài nguyên tính toán: LLM đòi hỏi sức mạnh tính toán và bộ nhớ lớn, khiến việc huấn luyện và triển khai tốn nhiều tài nguyên.

- Thiên lệch và công bằng: LLM có thể vô tình học và lan truyền thiên lệch trong dữ liệu huấn luyện, dẫn đến đầu ra không công bằng hoặc thiên vị.

- Khả năng diễn giải: Việc hiểu và giải thích các quyết định của LLM có thể khó do bản chất phức tạp và không minh bạch.

- Quyền riêng tư dữ liệu: Việc dùng các bộ dữ liệu lớn để huấn luyện có thể làm dấy lên lo ngại về quyền riêng tư và an ninh dữ liệu.

- Chi phí: Phát triển, huấn luyện và triển khai LLM có thể tốn kém, hạn chế khả năng tiếp cận của các tổ chức nhỏ.

LLM xử lý từ hoặc token ngoài từ điển (OOV) như thế nào?

LLM xử lý từ hoặc token ngoài từ điển (OOV) bằng các kỹ thuật như tách token theo đơn vị con (ví dụ: Byte Pair Encoding hoặc BPE, và WordPiece). Các kỹ thuật này chia nhỏ những từ không quen thuộc thành các đơn vị con đã biết để mô hình có thể xử lý.

Cách tiếp cận này đảm bảo rằng ngay cả khi một từ không xuất hiện trong quá trình huấn luyện, mô hình vẫn có thể hiểu và sinh văn bản dựa trên các thành phần cấu tạo, cải thiện tính linh hoạt và độ vững.

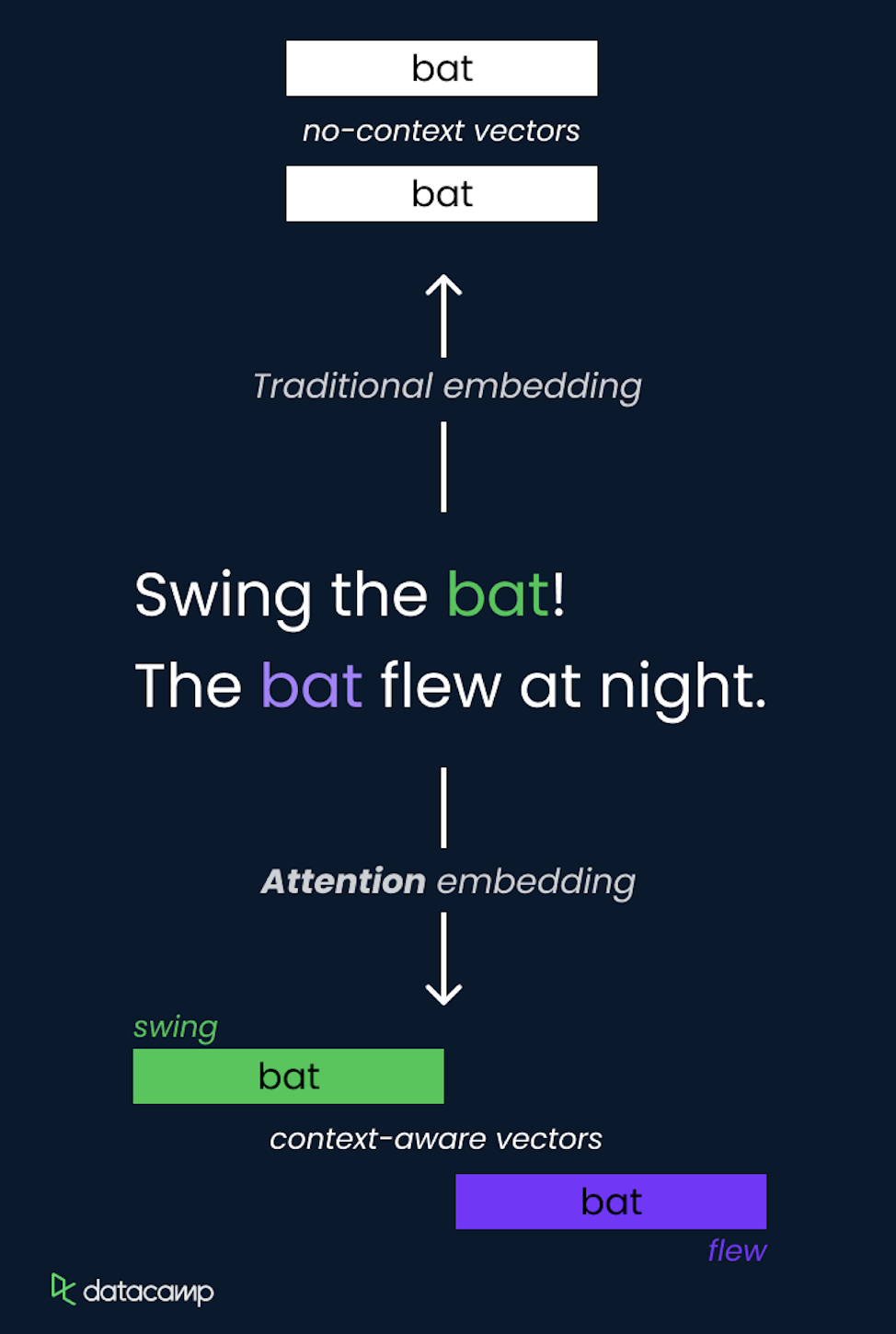

Các lớp nhúng (embedding) là gì và vì sao quan trọng trong LLM?

Các lớp embedding là thành phần quan trọng trong LLM dùng để chuyển đổi dữ liệu phân loại, như từ, thành các biểu diễn véc-tơ đặc. Các embedding này nắm bắt quan hệ ngữ nghĩa giữa các từ bằng cách biểu diễn chúng trong không gian véc-tơ liên tục, nơi các từ tương tự nằm gần nhau hơn. Tầm quan trọng của embedding trong LLM bao gồm:

- Giảm chiều dữ liệu: Chúng giảm chiều của dữ liệu đầu vào, giúp mô hình xử lý dễ dàng hơn.

- Hiểu ngữ nghĩa: Embedding nắm bắt sắc thái ngữ nghĩa và quan hệ giữa các từ, tăng cường khả năng hiểu và sinh ngôn ngữ tự nhiên của mô hình.

- Học chuyển giao: Embedding tiền huấn luyện có thể dùng giữa các mô hình và tác vụ khác nhau, cung cấp nền tảng hiểu ngôn ngữ vững chắc để tinh chỉnh cho ứng dụng cụ thể.

Mã hóa vị trí trong LLM hiện đại hoạt động thế nào, và vì sao Rotary Position Embeddings (RoPE) trở thành tiêu chuẩn?

Mã hóa vị trí cho transformer biết vị trí của từng token trong chuỗi.

Mã hóa vị trí hình sin truyền thống (Vaswani et al., 2017) dùng các hàm toán học cố định để mã hóa vị trí tĩnh. Rotary Position Embeddings (RoPE), được giới thiệu gần đây, đã trở thành tiêu chuẩn trong LLM hiện đại vì mang lại các đặc tính vượt trội về bản chất.

RoPE hoạt động bằng cách biểu diễn vị trí như các góc quay trong không gian véc-tơ phức, quay embedding của token theo một góc tỉ lệ với vị trí của nó. Cách tiếp cận hình học này hiệu quả hơn và tự nhiên hỗ trợ nội suy sang các chuỗi dài hơn so với dữ liệu huấn luyện, đây là năng lực quan trọng để mở rộng cửa sổ ngữ cảnh. Các mô hình như GPT-5.2 và Gemini 3 sử dụng RoPE làm mã hóa vị trí.

Câu hỏi phỏng vấn LLM trung cấp

Dựa trên các khái niệm cơ bản, những câu hỏi trung cấp đi sâu vào kỹ thuật thực hành nhằm tối ưu hiệu năng LLM và giải quyết thách thức về hiệu quả tính toán cũng như khả năng diễn giải mô hình.

Giải thích khái niệm attention trong LLM và cách triển khai.

Attention trong LLM là phương pháp cho phép mô hình tập trung vào các phần khác nhau của chuỗi đầu vào khi đưa ra dự đoán. Nó gán trọng số động cho các token khác trong đầu vào, làm nổi bật những token liên quan nhất cho tác vụ hiện tại.

Điều này được triển khai bằng self-attention, nơi mô hình tính điểm attention cho mỗi token so với tất cả token còn lại trong chuỗi, cho phép nắm bắt phụ thuộc bất kể khoảng cách.

Cơ chế self-attention là thành phần cốt lõi của kiến trúc Transformer, giúp xử lý thông tin hiệu quả và nắm bắt quan hệ tầm xa.

Vai trò của tokenization trong xử lý LLM là gì?

Tokenization chuyển văn bản thô thành các đơn vị nhỏ hơn gọi là token, có thể là từ, đơn vị con hoặc ký tự.

Vai trò của tokenization rất quan trọng vì nó biến văn bản thành định dạng mà mô hình có thể hiểu và xử lý.

Tokenization hiệu quả đảm bảo mô hình có thể xử lý nhiều loại đầu vào, bao gồm từ hiếm và ngôn ngữ khác nhau, bằng cách chia nhỏ chúng thành phần dễ quản lý. Bước này cần thiết để tối ưu huấn luyện và suy luận, vì chuẩn hóa đầu vào và giúp mô hình học các mẫu có ý nghĩa trong dữ liệu.

Bạn đo lường hiệu năng của một LLM như thế nào?

Các nhà nghiên cứu và thực hành đã phát triển nhiều thước đo để đánh giá hiệu năng của LLM. Các chỉ số cổ điển gồm:

- Perplexity: Đo mức độ mô hình dự đoán một mẫu, thường dùng trong tác vụ mô hình hóa ngôn ngữ.

- Accuracy: Dùng cho các tác vụ như phân loại văn bản để đo tỷ lệ dự đoán đúng.

- F1 Score: Trung bình điều hòa giữa precision và recall, dùng cho các tác vụ như nhận diện thực thể có tên.

- Điểm BLEU (Bilingual Evaluation Understudy): Đo chất lượng văn bản do máy sinh so với bản dịch tham chiếu, thường dùng trong dịch máy.

- ROUGE (Recall-Oriented Understudy for Gisting Evaluation): Bộ chỉ số đánh giá mức độ trùng lặp giữa văn bản sinh và văn bản tham chiếu, thường dùng trong tóm tắt. Chúng giúp định lượng hiệu quả của mô hình và định hướng cải tiến.

Vượt ra ngoài các chỉ số truyền thống, hiện nay người thực hành dùng các benchmark tiêu chuẩn hóa cho nhiều mục đích khác nhau, như MMLU (bài kiểm tra kiến thức 57 tác vụ), MMMU-Pro (lý luận đa phương thức), và HumanEval (sinh mã). Bên cạnh đó, các bảng xếp hạng như LMArena đánh giá LLM theo sở thích của con người. Với hệ thống triển khai, việc đo tỉ lệ ảo giác trong thực tế, độ trễ và hiệu quả token đã trở nên thiết yếu.

Những kỹ thuật nào để kiểm soát đầu ra của LLM?

Có nhiều kỹ thuật kiểm soát đầu ra của LLM, bao gồm:

- Temperature: Điều chỉnh tham số này khi lấy mẫu để kiểm soát độ ngẫu nhiên của đầu ra. Nhiệt độ thấp cho kết quả quyết định hơn, trong khi giá trị cao tạo kết quả đa dạng hơn.

- Top-K sampling: Giới hạn tập lấy mẫu trong K token có xác suất cao nhất, giảm khả năng sinh văn bản ít liên quan hoặc vô nghĩa.

- Top-P (nucleus) sampling: Chọn token từ tập nhỏ nhất có tổng xác suất vượt ngưỡng P, cân bằng tính đa dạng và mạch lạc.

- Prompt engineering: Thiết kế prompt cụ thể để dẫn hướng mô hình tạo đầu ra mong muốn bằng cách cung cấp ngữ cảnh hoặc ví dụ.

- Control token: Dùng token đặc biệt để yêu cầu mô hình sinh văn bản theo phong cách, định dạng hoặc loại nội dung cụ thể.

Những cách tiếp cận nào giúp giảm chi phí tính toán của LLM?

Để giảm chi phí tính toán của LLM, có thể áp dụng:

- Cắt tỉa mô hình (pruning): Loại bỏ các trọng số hoặc nơ-ron ít quan trọng để giảm kích thước và yêu cầu tính toán.

- Lượng tử hóa (quantization): Chuyển trọng số từ độ chính xác cao (ví dụ: float 32-bit) sang thấp hơn (ví dụ: int 8-bit) để giảm bộ nhớ và tăng tốc suy luận.

- Distillation: Huấn luyện mô hình nhỏ hơn (học trò) để mô phỏng hành vi của mô hình lớn đã tiền huấn luyện (giáo viên) nhằm đạt hiệu năng tương tự với ít tài nguyên hơn.

- Sparse attention: Dùng kỹ thuật như sparse transformer để giới hạn cơ chế attention vào một tập con token, giảm tải tính toán.

- Kiến trúc hiệu quả: Phát triển và sử dụng các kiến trúc mô hình hiệu quả nhằm tối thiểu hóa nhu cầu tính toán nhưng vẫn duy trì hiệu năng, như Reformer hoặc Longformer.

Tầm quan trọng của khả năng diễn giải mô hình trong LLM là gì và đạt được bằng cách nào?

Khả năng diễn giải mô hình là cần thiết để hiểu cách LLM đưa ra quyết định, quan trọng cho việc xây dựng niềm tin, đảm bảo trách nhiệm giải trình và xác định, giảm thiểu thiên lệch. Đạt được tính diễn giải có thể thông qua các cách tiếp cận như:

- Trực quan hóa attention: Phân tích trọng số attention để xem mô hình tập trung vào phần nào của đầu vào.

- Bản đồ độ nổi (saliency map): Làm nổi bật các đặc trưng đầu vào có ảnh hưởng lớn nhất tới đầu ra của mô hình.

- Phương pháp bất khả tri mô hình: Dùng các kỹ thuật như LIME (Local Interpretable Model-agnostic Explanations) để giải thích dự đoán riêng lẻ.

- Lan truyền mức độ liên quan theo lớp: Phân rã dự đoán của mô hình thành đóng góp từ mỗi lớp hoặc nơ-ron.

LLM xử lý phụ thuộc dài hạn trong văn bản như thế nào?

LLM xử lý phụ thuộc dài hạn thông qua kiến trúc của chúng, đặc biệt là cơ chế self-attention, cho phép xem xét đồng thời tất cả token trong chuỗi đầu vào. Khả năng này giúp LLM nắm bắt quan hệ và phụ thuộc trên ngữ cảnh dài.

Ngoài ra, các mô hình tiên tiến như Transformer-XL và Longformer được thiết kế để mở rộng cửa sổ ngữ cảnh và xử lý chuỗi dài hiệu quả hơn, đảm bảo quản lý phụ thuộc dài hạn tốt hơn.

Các mô hình sản xuất hiện đại dùng chiến lược nâng cao để xử lý phụ thuộc dài hạn và chống suy giảm hiệu năng khi mở rộng cửa sổ ngữ cảnh, như:

- Rotary Position Embeddings (RoPE) để ngoại suy độ dài tốt hơn và mã hóa vị trí vượt trội.

- Mẫu attention tối ưu cho chuỗi dài, bao gồm biến thể grouped-query và multi-head.

- Tích hợp tri thức cẩn trọng qua RAG thay vì chỉ dựa vào dung lượng cửa sổ ngữ cảnh.

Retrieval-Augmented Generation (RAG) là gì và đã phát triển như thế nào?

RAG kết hợp cơ chế truy xuất với mô hình sinh để lấy thông tin liên quan từ nguồn bên ngoài trong quá trình tạo văn bản. Cách tiếp cận này trực tiếp giải quyết hai hạn chế quan trọng của LLM: ảo giác và tính cập nhật tri thức. RAG truyền thống dùng pipeline truy xuất và sinh khá đơn giản, nhưng khi tiến hóa thành "RAG 2.0", nó đã tinh vi hơn đáng kể.

Các đặc trưng chính của RAG 2.0 gồm:

- Truy xuất đệ quy: Mô hình suy luận về khoảng trống trong thông tin đã truy xuất và chủ động thực hiện tìm kiếm bậc hai hoặc ba để lấp đầy, thay vì chỉ một lượt truy xuất.

- Truy xuất đa phương thức: Tích hợp nhiều định dạng—văn bản, hình ảnh, PDF, video, thậm chí cả cuộc gọi API—giúp thu thập ngữ cảnh phong phú hơn

- Lập chỉ mục lai (hybrid): Kết hợp tìm kiếm BM25 (theo từ khóa) và vector (ngữ nghĩa) để bao quát cả mức độ liên quan theo từ vựng và ngữ nghĩa

- Lớp xếp hạng lại: Lọc thông minh kết quả truy xuất ban đầu để giảm nhiễu và thông tin không liên quan

- Thích ứng kiểu agent: Lựa chọn chiến lược động, nơi hệ thống chọn cách truy xuất dựa trên độ phức tạp truy vấn và miền nội dung

RAG 2.0, khi kết hợp với LLM, giúp giảm tỷ lệ ảo giác 40-60% trong hệ thống sản xuất so với mô hình gốc.

Câu hỏi phỏng vấn LLM nâng cao

Hiểu các khái niệm nâng cao trong LLM hữu ích cho những chuyên gia muốn thúc đẩy giới hạn năng lực của các mô hình này. Phần này khám phá chủ đề phức tạp và thách thức thường gặp trong lĩnh vực.

Giải thích khái niệm "few-shot learning" trong LLM và lợi ích của nó.

Few-shot learning trong LLM là khả năng mô hình học và thực hiện tác vụ mới chỉ với vài ví dụ. Năng lực này tận dụng kiến thức tiền huấn luyện phong phú, giúp mô hình khái quát từ số lượng mẫu nhỏ.

Lợi ích chính gồm giảm yêu cầu dữ liệu do không cần các tập dữ liệu lớn theo tác vụ, tăng tính linh hoạt khi mô hình thích ứng với nhiều tác vụ với ít tinh chỉnh, và tiết kiệm chi phí vì nhu cầu dữ liệu và thời gian huấn luyện thấp hơn giúp giảm đáng kể chi phí thu thập dữ liệu và tài nguyên tính toán.

Sự khác nhau giữa mô hình ngôn ngữ tự hồi quy và mô hình che từ (masked) là gì?

Hai loại mô hình khác nhau chủ yếu ở cách dự đoán và mức phù hợp tác vụ. Mô hình tự hồi quy như GPT-5.2, Claude 4.5 Opus và Gemini 3, dự đoán từ kế tiếp dựa trên các từ trước đó, sinh văn bản từng token một.

Những mô hình này đặc biệt phù hợp cho tác vụ sinh văn bản. Ngược lại, mô hình che từ như BERT, che ngẫu nhiên các từ trong câu và huấn luyện mô hình dự đoán các từ bị che dựa trên ngữ cảnh xung quanh. Tiếp cận hai chiều này giúp mô hình hiểu ngữ cảnh từ cả hai hướng, phù hợp cho phân loại văn bản và hỏi đáp.

Bạn có thể tích hợp tri thức bên ngoài vào LLM bằng cách nào?

Tích hợp tri thức bên ngoài vào LLM có thể thực hiện bằng nhiều phương pháp:

- Tích hợp đồ thị tri thức: Bổ sung đầu vào mô hình bằng thông tin từ các đồ thị tri thức có cấu trúc để cung cấp ngữ cảnh.

- Retrieval-Augmented Generation (RAG): Kết hợp phương pháp truy xuất với mô hình sinh để lấy thông tin liên quan từ nguồn bên ngoài trong quá trình tạo văn bản. Hệ thống RAG 2.0 hiện đại dùng truy xuất đệ quy, lập chỉ mục lai và xếp hạng lại để tích hợp tri thức vượt trội so với các cách truy xuất đơn giản.

- Fine-tuning với dữ liệu theo miền: Huấn luyện mô hình trên dữ liệu bổ sung chứa tri thức cần thiết để chuyên biệt hóa cho các tác vụ hoặc miền cụ thể.

- Prompt engineering: Thiết kế prompt dẫn hướng mô hình sử dụng hiệu quả tri thức bên ngoài trong quá trình suy luận.

Một số thách thức khi triển khai LLM vào sản xuất là gì?

Triển khai LLM vào sản xuất bao gồm nhiều thách thức:

- Khả năng mở rộng: Đảm bảo mô hình xử lý hiệu quả khối lượng lớn yêu cầu, thường cần tài nguyên tính toán đáng kể và hạ tầng tối ưu.

- Độ trễ: Giảm thời gian phản hồi để cung cấp kết quả theo thời gian thực hoặc gần thực, rất quan trọng cho chatbot và trợ lý ảo.

- Giám sát và bảo trì: Liên tục theo dõi hiệu năng mô hình và cập nhật để xử lý dữ liệu, tác vụ phát sinh đòi hỏi hệ thống giám sát vững chắc và cập nhật thường xuyên.

- Cân nhắc đạo đức và pháp lý: Giải quyết các vấn đề về thiên lệch, quyền riêng tư và tuân thủ quy định là thiết yếu để tránh rủi ro đạo đức và pháp lý.

- Quản lý tài nguyên: Quản lý tài nguyên tính toán lớn cần cho suy luận nhằm đảm bảo hiệu quả chi phí, bao gồm tối ưu cấu hình phần cứng và phần mềm.

Bạn xử lý sự suy giảm mô hình theo thời gian trong LLM triển khai như thế nào?

Suy giảm mô hình xảy ra khi hiệu năng LLM giảm theo thời gian do thay đổi phân phối dữ liệu nền. Xử lý suy giảm cần huấn luyện lại định kỳ với dữ liệu cập nhật để duy trì hiệu năng. Cần giám sát liên tục để theo dõi hiệu năng và phát hiện dấu hiệu suy giảm.

Các kỹ thuật học gia tăng cho phép mô hình học từ dữ liệu mới mà không quên thông tin đã học. Ngoài ra, A/B testing so sánh hiệu năng mô hình hiện tại với phiên bản mới và giúp xác định cải tiến tiềm năng trước khi triển khai đầy đủ.

Những kỹ thuật nào đảm bảo sử dụng LLM có đạo đức?

Để đảm bảo sử dụng LLM có đạo đức, có thể áp dụng các kỹ thuật sau:

- Giảm thiểu thiên lệch: Áp dụng chiến lược xác định và giảm thiên lệch trong dữ liệu huấn luyện và đầu ra, như dùng tập dữ liệu cân bằng và công cụ phát hiện thiên lệch.

- Minh bạch và khả giải thích: Phát triển mô hình cung cấp đầu ra có thể giải thích để tăng niềm tin và trách nhiệm, bao gồm dùng trực quan hóa attention và saliency map.

- Sự đồng ý của người dùng và quyền riêng tư: Đảm bảo dữ liệu dùng cho huấn luyện và suy luận tuân thủ quy định về quyền riêng tư và có sự đồng ý của người dùng khi cần.

- Đánh giá công bằng: Thực hiện kiểm toán định kỳ để đánh giá tính công bằng và hệ quả đạo đức trong hành vi của mô hình.

- Triển khai có trách nhiệm: Thiết lập hướng dẫn và chính sách cho AI có trách nhiệm, bao gồm xử lý nội dung gây hại hoặc không phù hợp do mô hình tạo ra.

Bạn đảm bảo an ninh cho dữ liệu sử dụng với LLM như thế nào?

Bảo mật dữ liệu sử dụng với LLM cần triển khai nhiều biện pháp. Bao gồm dùng kỹ thuật mã hóa cho dữ liệu khi lưu trữ và khi truyền để bảo vệ khỏi truy cập trái phép. Cần kiểm soát truy cập nghiêm ngặt để chỉ người được ủy quyền mới có thể truy cập dữ liệu nhạy cảm.

Cũng cần ẩn danh dữ liệu để loại bỏ thông tin nhận dạng cá nhân (PII) trước khi dùng cho huấn luyện hoặc suy luận. Ngoài ra, tuân thủ các quy định bảo vệ dữ liệu như GDPR hoặc CCPA là thiết yếu để tránh vấn đề pháp lý.

Các biện pháp này giúp bảo vệ tính toàn vẹn, bảo mật và sẵn sàng của dữ liệu. Sự bảo vệ này rất quan trọng để duy trì niềm tin người dùng và tuân thủ chuẩn mực pháp lý.

Reinforcement learning từ phản hồi con người (RLHF) cải thiện chất lượng và an toàn đầu ra LLM như thế nào, và so với các phương pháp căn chỉnh mới như DPO và RLAIF ra sao?

RLHF là kỹ thuật huấn luyện LLM để căn chỉnh đầu ra theo sở thích của con người bằng cách đưa phản hồi của người đánh giá vào quy trình. Quá trình lặp này giúp mô hình học cách tạo phản hồi không chỉ chính xác mà còn an toàn, không thiên lệch và hữu ích.

Tuy nhiên, RLHF có thách thức. Một thách thức là nguy cơ thiên lệch trong phản hồi của con người, vì các đánh giá viên có thể có sở thích và diễn giải khác nhau.

Thách thức khác là khả năng mở rộng của quy trình thu thập phản hồi, vì việc thu thập và tích hợp lượng lớn phản hồi con người tốn thời gian và chi phí. Thêm nữa, đảm bảo mô hình thưởng trong RLHF phản ánh chính xác hành vi và giá trị mong muốn có thể khó. Bước tối ưu hóa PPO (Proximal Policy Optimization) làm tăng độ phức tạp và có thể gây bất ổn trong huấn luyện.

Các lựa chọn hiện đại xuất hiện nhằm khắc phục nhiều hạn chế của RLHF:

- DPO (Direct Preference Optimization): Loại bỏ hoàn toàn mô hình thưởng riêng, dùng tín hiệu thưởng ngầm rút trực tiếp từ cặp ưu tiên. Cách này đơn giản hơn, ổn định và hiệu quả tính toán hơn so với RLHF dựa trên PPO. DPO hiện được các phòng lab AI lớn áp dụng rộng rãi như một lựa chọn thay thế hoặc bổ trợ cho RLHF truyền thống.

- GRPO (Gradient-based Reward Policy Optimization): Một biến thể kết hợp ưu điểm đơn giản của DPO với một số khía cạnh học kiểu PPO, mang lại cân bằng trung gian.

- RLAIF (Reinforcement Learning from AI Feedback): Thay thế người đánh giá bằng phản hồi từ AI (như đánh giá của các mô hình mạnh hơn hoặc bộ đánh giá chuyên biệt). Cách tiếp cận này giảm đáng kể thách thức về khả năng mở rộng và chi phí vì tạo phản hồi AI rẻ và nhanh hơn thu thập phản hồi con người.

Phần lớn mô hình sản xuất dùng DPO, RLAIF hoặc kết hợp lai thay vì RLHF thuần dựa trên PPO.

So sánh mô hình trạng thái (state-space, như Mamba) với Transformer. Đánh đổi là gì và khi nào dùng mỗi loại?

Ảo giác dựa trên tri thức xảy ra khi mô hình không có thông tin đúng (hoặc thông tin đã lỗi thời), nên bịa ra nội dung có vẻ hợp lý. Cách khắc phục thường gồm:

- Nền tảng hóa mô hình bằng truy xuất (RAG)

- Bổ sung nguồn đã kiểm chứng

- Fine-tuning theo miền

Ảo giác dựa trên logic xảy ra khi mô hình có thông tin liên quan nhưng suy luận sai hoặc tạo ra mâu thuẫn. Cách khắc phục phổ biến là:

- Prompt có cấu trúc

- Bước xác minh/tự kiểm tra (thường qua quy trình dạng agent)

- Đánh giá có mục tiêu

Sự khác biệt giữa ảo giác dựa trên tri thức và dựa trên logic trong LLM là gì, và xử lý từng loại ra sao?

Dù Transformer đang thống trị LLM hiện nay, các mô hình trạng thái (SSM) như Mamba đã nổi lên như một hướng kiến trúc cạnh tranh với đặc tính tính toán và hiệu năng khác biệt cơ bản. Hiểu cả hai ngày càng quan trọng với các chuyên gia LLM hiện đại.

Transformer:

- Thế mạnh: Xuất sắc trong truy xuất thông tin, nhiệm vụ sao chép/dán và học trong ngữ cảnh. Kiến trúc đã được kiểm chứng ở quy mô lớn với hệ sinh thái công cụ và hạ tầng phong phú. Hiệu năng thực nghiệm mạnh ở sinh mã và nhiều benchmark đa dạng.

- Điểm yếu: Độ phức tạp attention O(N²) dẫn đến yêu cầu bộ nhớ và tính toán bậc hai. Điều này thể hiện thành suy giảm hiệu năng ở chuỗi rất dài (>100K token) và độ trễ cao cho ứng dụng cần ngữ cảnh dài.

- Trường hợp sử dụng và khuyến nghị: Phần lớn LLM sản xuất hiện nay (GPT, Claude, Gemini, Llama). Khuyến nghị cho ứng dụng thực tế hiện tại và tương lai gần.

Mô hình trạng thái (Mamba, Mamba-2):

- Thế mạnh: Độ phức tạp O(N) với thang bộ nhớ tuyến tính. Suy luận nhanh hơn 5-10 lần trên chuỗi dài (>50K token). Cơ sở lý thuyết tốt hơn cho xử lý tín hiệu. Hành vi mở rộng có thể dự đoán hơn.

- Điểm yếu: Cần dữ liệu huấn luyện nhiều gấp ~10 lần so với Transformer để đạt hiệu năng tương đương. Yếu hơn ở truy xuất thông tin và nhiệm vụ sao chép. Hệ sinh thái kém trưởng thành hơn với ít công cụ, thư viện và mô hình đã huấn luyện.

- Trường hợp sử dụng và khuyến nghị: Nổi lên cho ứng dụng chuyên biệt—xử lý tài liệu dài, hệ thống thời gian thực với ràng buộc độ trễ, ứng dụng streaming, và có thể là miền chuyên sâu nơi khả năng mở rộng O(N) là then chốt.

Nghiên cứu gần đây cho thấy Transformer và SSM mang tính bổ trợ hơn là cạnh tranh trực tiếp, với các trường hợp sử dụng và ràng buộc khác nhau ưu tiên kiến trúc khác nhau. Transformer vẫn là lựa chọn thực tiễn cho LLM đa mục đích và có khả năng tiếp tục thống trị hiện tại. Tương lai có thể là mô hình lai, với mô hình chuyên biệt cho yêu cầu tính toán và tác vụ khác nhau.

Câu hỏi phỏng vấn LLM dành cho kỹ sư Prompt

Prompt engineering là khía cạnh quan trọng khi sử dụng LLM. Nó liên quan đến việc soạn thảo prompt chính xác và hiệu quả để tạo ra phản hồi mong muốn từ mô hình. Phần này xem xét những câu hỏi trọng tâm mà kỹ sư prompt có thể gặp.

Prompt engineering là gì và vì sao tối quan trọng khi làm việc với LLM?

Prompt engineering liên quan đến thiết kế và tinh chỉnh prompt để dẫn hướng LLM tạo đầu ra chính xác và phù hợp. Điều này rất quan trọng vì chất lượng prompt ảnh hưởng trực tiếp đến hiệu năng của mô hình.

Prompt hiệu quả có thể tăng khả năng hiểu tác vụ của mô hình, tạo phản hồi chính xác, liên quan và giảm khả năng mắc lỗi.

Prompt engineering là thiết yếu để tối đa hóa tính hữu dụng của LLM trong nhiều ứng dụng, từ sinh văn bản đến giải quyết vấn đề phức tạp.

Bạn có thể đưa ví dụ về các kỹ thuật prompt khác nhau (zero-shot, few-shot, chain-of-thought) và thời điểm sử dụng không?

- Zero-shot prompting: Cung cấp mô tả tác vụ mà không có ví dụ nào. Thường dùng khi không có ví dụ sẵn hoặc khi muốn kiểm tra hiểu biết tổng quát và tính linh hoạt của mô hình.

- Few-shot prompting: Cung cấp một vài ví dụ kèm mô tả tác vụ để dẫn hướng mô hình. Hữu ích khi mô hình cần ngữ cảnh hoặc ví dụ để hiểu tác vụ tốt hơn.

- Chain-of-Thought prompting: Chia nhỏ tác vụ phức tạp thành các bước tuần tự để mô hình theo dõi. Có lợi cho các tác vụ đòi hỏi suy luận logic và giải quyết vấn đề nhiều bước.

- Agentic prompting: Cấu trúc prompt để mô hình hành động như tác nhân tự chủ có thể gọi công cụ/API, thu thập thông tin và suy luận qua nhiều bước. Prompt bao gồm định nghĩa không gian hành động, mô tả công cụ và yêu cầu suy luận rõ ràng.

Bạn đánh giá hiệu quả của một prompt như thế nào?

Đánh giá hiệu quả prompt bao gồm:

- Chất lượng đầu ra: Đánh giá mức độ liên quan, mạch lạc và chính xác của phản hồi.

- Tính nhất quán: Kiểm tra xem mô hình có liên tục tạo đầu ra chất lượng cao trên các đầu vào khác nhau không.

- Chỉ số theo tác vụ: Dùng chỉ số đánh giá theo tác vụ, như BLEU cho dịch hoặc ROUGE cho tóm tắt, để đo hiệu năng.

- Đánh giá của con người: Mời người đánh giá để cung cấp phản hồi định tính về đầu ra.

- A/B testing: So sánh các prompt khác nhau để xác định prompt nào cho hiệu năng tốt hơn.

Chiến lược nào để tránh lỗi phổ biến trong thiết kế prompt (ví dụ: câu hỏi dẫn dắt, hướng dẫn mơ hồ)?

- Tránh câu hỏi dẫn dắt: Đảm bảo prompt không hàm ý câu trả lời cụ thể, có thể làm lệch phản hồi của mô hình.

- Chỉ dẫn rõ ràng, súc tích: Cung cấp hướng dẫn không mơ hồ để giảm nhầm lẫn.

- Cung cấp ngữ cảnh: Bao gồm ngữ cảnh liên quan để giúp mô hình hiểu tác vụ nhưng không nhồi nhét thông tin không cần thiết.

- Kiểm thử lặp: Liên tục kiểm tra và tinh chỉnh prompt dựa trên đầu ra và hiệu năng của mô hình.

Bạn tiếp cận tinh chỉnh prompt lặp để cải thiện hiệu năng LLM như thế nào?

Tinh chỉnh prompt lặp bao gồm:

- Thiết kế ban đầu: Bắt đầu với prompt cơ bản dựa trên yêu cầu tác vụ.

- Kiểm thử và đánh giá: Đánh giá hiệu năng prompt bằng nhiều chỉ số và thu nhận phản hồi.

- Phân tích: Xác định điểm yếu hoặc khu vực cần cải thiện trong prompt.

- Tinh chỉnh: Điều chỉnh prompt để giải quyết các vấn đề đã nhận diện.

- Lặp lại: Lặp quy trình kiểm thử và tinh chỉnh cho đến khi đạt hiệu năng mong muốn.

Bạn dùng công cụ hoặc framework nào để tinh gọn quy trình prompt engineering?

Nhiều công cụ và framework có thể tinh gọn quy trình prompt engineering:

- Nền tảng dành cho LLM: LangChain và LlamaIndex cho xâu chuỗi prompt và xây dựng hệ thống dạng agent; Vercel AI SDK cho dựng thử và triển khai nhanh.

- Kiểm thử & tối ưu prompt: PromptFoo (kiểm thử prompt tự động qua nhiều kịch bản), DSPy (tối ưu prompt theo lập trình), Haystack (xây dựng pipeline RAG).

- Môi trường phát triển tương tác (IDE): Jupyter Notebook để thử nghiệm, VS Code với tiện ích LLM (GitHub Copilot, Cursor), Streamlit để xây dựng nguyên mẫu UI tương tác.

- API và SDK: OpenAI API, Anthropic SDK, Together AI và LM Studio cho triển khai mô hình cục bộ.

- Quản lý phiên bản & cộng tác: Quản lý phiên bản prompt dựa trên Git, Weights & Biases để theo dõi thí nghiệm và so sánh, HuggingFace Hub để chia sẻ mô hình và prompt.

- Framework dạng agent: AutoGPT, OpenAI Assistants API, LangGraph để xây dựng quy trình agent nhiều bước phức tạp.

- Đánh giá & giám sát: Ragas (chỉ số đánh giá RAG), LangSmith (tracing, gỡ lỗi, và giám sát sản xuất), Braintrust (quan sát LLM end-to-end).

Bạn xử lý thách thức như ảo giác hoặc thiên lệch trong đầu ra LLM thông qua prompt engineering ra sao?

Câu hỏi này đề cập đến vấn đề đạo đức và thực tiễn của nội dung do LLM tạo. Câu trả lời tốt sẽ thể hiện nhận thức về các vấn đề này và nêu kỹ thuật như sau.

Kỹ thuật giảm ảo giác:

- Prompt xác minh sự thật: Lồng ghép các yêu cầu để mô hình xác minh thông tin với nguồn tin cậy và trích dẫn bằng chứng rõ ràng.

- Tích hợp truy xuất: Dùng RAG hoặc RAG 2.0 để nền tảng hóa phản hồi bằng tài liệu thực, giảm việc bịa đặt bằng cách yêu cầu mô hình tham chiếu thông tin đã truy xuất.

- Vòng lặp xác minh kiểu agent: Cấu trúc prompt để mô hình thực hiện xác minh nhiều bước, tự kiểm tra trước khi trả lời—thực chất tạo các tác nhân tự xác minh.

- Prompt dựa trên ràng buộc: Định nghĩa định dạng đầu ra và ràng buộc logic để làm lộ ra mâu thuẫn hoặc tuyên bố thiếu căn cứ.

Kỹ thuật giảm thiên lệch:

- Prompt đa góc nhìn: Dẫn hướng mô hình cân nhắc nhiều quan điểm và bên liên quan trước khi kết luận.

- Prompt phát hiện thiên lệch: Yêu cầu mô hình nhận diện thiên lệch tiềm ẩn trong lập luận và đầu ra của chính nó.

- Prompt phản sự kiện (counterfactual): Yêu cầu kịch bản hoặc góc nhìn thay thế để thách thức giả định ban đầu và kiểm tra độ vững của suy luận.

- Chỉ dẫn rõ ràng: Quy định rõ phản hồi phải cân bằng, thừa nhận hạn chế và tránh ngôn ngữ phân biệt đối xử.

Bạn có thể giải thích vai trò của template prompt và cách dùng trong prompt engineering không?

Template prompt cung cấp cấu trúc chuẩn cho prompt, thường bao gồm các chỗ trống cho thông tin hoặc hướng dẫn cụ thể. Chúng có thể tái sử dụng qua nhiều tác vụ và kịch bản, cải thiện tính nhất quán và hiệu quả trong thiết kế prompt.

Câu trả lời tốt sẽ giải thích cách template prompt bao hàm thực tiễn tốt nhất, tích hợp tri thức theo miền và tinh gọn quy trình tạo prompt hiệu quả cho nhiều ứng dụng.

Lựa chọn tokenizer ảnh hưởng thế nào đến prompt engineering và hiệu năng mô hình?

Tokenizer đóng vai trò then chốt trong cách LLM diễn giải và xử lý prompt đầu vào. Các tokenizer khác nhau có kích thước từ vựng khác nhau và xử lý từ ngoài từ điển (OOV) theo cách khác nhau. Tokenizer theo đơn vị con như Byte Pair Encoding (BPE) có thể xử lý OOV bằng cách chia thành đơn vị con nhỏ hơn, trong khi tokenizer theo từ có thể coi là token không xác định.

Lựa chọn tokenizer có thể ảnh hưởng hiệu năng mô hình theo nhiều cách. Ví dụ, tokenizer theo đơn vị con có thể hiệu quả hơn trong việc nắm bắt nghĩa của thuật ngữ hiếm hoặc kỹ thuật, còn tokenizer theo từ có thể đơn giản và nhanh hơn cho tác vụ ngôn ngữ tổng quát.

Trong prompt engineering, lựa chọn tokenizer có thể ảnh hưởng đến cách bạn cấu trúc prompt. Chẳng hạn, nếu dùng tokenizer theo đơn vị con, bạn có thể cần chú ý hơn cách từ bị tách để đảm bảo mô hình nắm bắt đúng nghĩa mong muốn.

Agentic prompting là gì và khác gì so với prompt engineering truyền thống?

Agentic prompting là cách thiết kế prompt trong đó mô hình được hướng dẫn hành động như một “tác nhân” có thể lập kế hoạch, thực hiện hành động (ví dụ: gọi công cụ/API hoặc truy xuất tài liệu), quan sát kết quả và lặp lại cho đến khi hoàn thành mục tiêu.

Khác với prompt engineering truyền thống chủ yếu cố gắng nhận phản hồi tốt nhất trong một lượt nhờ chỉ dẫn rõ ràng, ví dụ và ràng buộc định dạng, agentic prompting nhấn mạnh vòng lặp điều khiển nhiều bước (lập kế hoạch → hành động → quan sát → tinh chỉnh).

Nó đặc biệt hữu ích cho các tác vụ mà tính đúng đắn phụ thuộc vào việc tương tác với hệ thống bên ngoài (cơ sở dữ liệu, tìm kiếm, thực thi mã) hoặc xác minh kết quả trung gian thay vì chỉ dựa trên tri thức nội tại của mô hình.

Prompt agentic tốt thường định nghĩa mục tiêu, các công cụ/hành động sẵn có, cách quyết định hành động, và thời điểm dừng. Cũng phổ biến khi bổ sung bước xác minh rõ ràng (ví dụ: “kiểm tra nguồn đã truy xuất” hoặc “tính lại trước khi trả lời cuối cùng”) để giảm ảo giác và tăng độ tin cậy.

Kết luận

Hướng dẫn này cung cấp bộ câu hỏi phỏng vấn giúp bạn chuẩn bị cho các cuộc thảo luận về LLM, từ nguyên lý cơ bản đến chiến lược nâng cao.

Dù bạn đang chuẩn bị phỏng vấn hay muốn củng cố hiểu biết, những nội dung này sẽ trang bị kiến thức cần thiết để định hướng và phát huy trong lĩnh vực trí tuệ nhân tạo.

Nếu bạn muốn đọc về tin tức mới nhất trong AI và LLM, tôi gợi ý các chủ đề sau: