Program

Küçük dil modelleri (SLM’ler) kompakt, verimli ve büyük dil modellerinin (LLM’ler) aksine devasa sunuculara ihtiyaç duymaz. Hız ve gerçek zamanlı performans için geliştirilmişlerdir ve akıllı telefonlarımızda, tabletlerimizde veya akıllı saatlerimizde çalışabilirler.

Bu yazıda 2026’nın en iyi 15 SLM’ini inceleyip güçlü ve zayıf yönlerini, ayrıca her modeli benzersiz kılan noktaları ele alacağız.

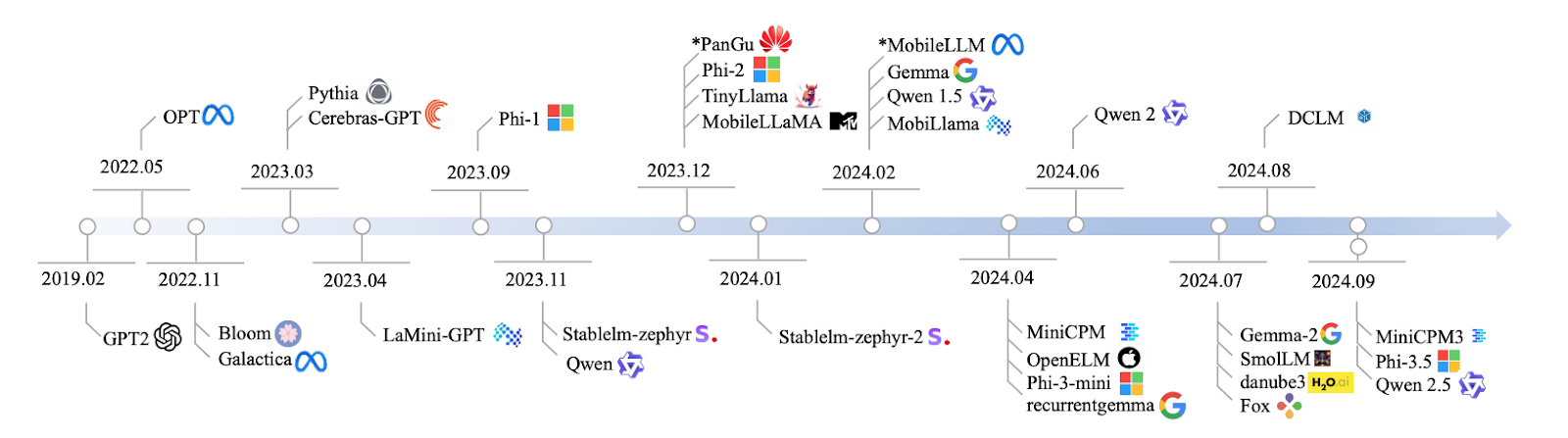

Kaynak: Lu ve diğ., 2024

Doğrudan modellere geçeceğim, ancak küçük dil modellerine dair bir özet ihtiyacınız varsa, burada ayrı bir yazı yazdım: Küçük Dil Modelleri: Örneklerle Rehber.

1. Qwen2: 0.5B, 1B ve 7B

Qwen2, 0,5 milyardan 7 milyar parametreye kadar uzanan bir model ailesidir. Çok hafif bir modele ihtiyaç duyan uygulamalar için 0.5B sürümü idealdir.

Ancak özetleme veya metin üretimi gibi görevler için daha sağlam bir şeye ihtiyacınız varsa, en yüksek performansı 7B modelinde elde edersiniz. Ölçeklenebilirdir ve özel ihtiyaçlarınıza göre uyarlanabilir.

Qwen2 modelleri karmaşık akıl yürütmede devasa yapay zekâ modellerinin geniş yetenekleriyle eşleşmeyebilir, ancak hız ve verimliliğin en kritik olduğu pek çok pratik kullanımda mükemmeldir. Özellikle hızlı yanıtlar veya sınırlı kaynaklar gerektiren uygulamalar için kullanışlıdır.

- Parametreler: 0,5 milyar, 1 milyar ve 7 milyar sürümler

- Erişim: https://huggingface.co/Qwen

- Açık kaynak: Evet, açık kaynak lisansıyla

2. Mistral Nemo 12B

12 milyar parametreli Mistral Nemo 12B modeli, dil çevirisi ve gerçek zamanlı diyalog sistemleri gibi karmaşık NLP görevleri için harikadır. Falcon 40B ve Chinchilla 70B gibi modellerle rekabet eder, ancak yine de devasa bir altyapı kurulumuna ihtiyaç duymadan yerelde çalışabilir. Karmaşıklıkla pratikliği dengeleyen modellerden biridir.

- Parametreler: 12 milyar

- Erişim: https://huggingface.co/mistralai/Mistral-7B-Instruct-v0.2

- Açık kaynak: Evet, Apache 2.0 lisansı ile

Yapay Zeka Uygulamaları Geliştirin

3. Llama 3.1 8B

Llama 3.1 8B’ye geçelim: 8 milyar parametreye sahiptir ve güç ile verimlilik arasında mükemmel bir denge sunar. Soru yanıtlama ve duygu analizi gibi görevler için harikadır.

Llama 3.1 8B, büyük hesaplama gücü olmadan hızlı sonuçlara ihtiyaç duyuyorsanız makul derecede iyi performans sağlar. Hızdan ödün vermeden doğruluk isteyenler için idealdir.

Bu modelle uygulamalı deneyim kazanmak için şu öğreticiyi okuyun: Llama 3.1 8B, Ollama ve Langchain ile RAG.

- Parametreler: 8 milyar

- Erişim: https://ollama.com/library/llama3

- Açık kaynak: Evet, ancak kullanım kısıtlamalarıyla

4. Pythia

Pythia serisinden bahsedelim: 160 milyon ile 2,8 milyar parametre arasında değişen, akıl yürütme ve kodlama becerileri görevleri için tasarlanmış bir model seti. Yazılım geliştirmeyle ilgileniyorsanız, Pythia doğruluk ve mantığın kritik olduğu yapılandırılmış, mantık temelli görevleri yönetmede harikadır. Modelin yapılandırılmış ve mantıklı düşünmesini beklediğiniz kodlama ortamları için idealdir.

GPT-Neo gibi diğer modellere kıyasla, hedefe yönelik bu uygulamalar için tasarlandığından Pythia kodlama ve akıl yürütme gibi görevlerde daha iyi performans gösterir. Ancak daha genel dil görevlerine soktuğunuzda işler biraz sarsılabilir — Phi 3.5 ve Llama 3.1 8B bu daha geniş alanlarda daha tutarlı performans sergileyebilir. Dikkat edilmesi gereken bir nokta, Pythia’nın kamuya açık eğitim şeffaflığı ve özelleştirme seçeneklerinin oldukça etkileyici olmasıdır. Özel ihtiyaçlarınıza uyacak şekilde ince ayar yapabilirsiniz; bu da onu son derece esnek bir araç hâline getirir.

- Parametreler: 160M – 2,8B

- Erişim: https://github.com/EleutherAI/pythia

- Açık Kaynak: Evet

5. Cerebras-GPT

Cerebras-GPT verimli ve hızlı bir modeldir. 111 milyon ile 2,7 milyar arasında değişen parametreleriyle, hesaplama kaynaklarının kısıtlı olduğu ancak yine de iyi performans gerektiği ortamlar için tasarlanmıştır. Cerebras-GPT, kaynaklarınızı tüketmeden iyi sonuçlar sunar.

GPT-3 veya LLaMA 13B gibi daha büyük modellere kıyasla Cerebras-GPT aynı kapsamlı eğitime sahip olmayabilir, ancak Chinchilla ölçekleme yasalarını takip eder; bu da onu son derece hesaplama verimli kılar. GPT-J ve GPT-NeoX gibi modeller daha hantal olabilir, ancak Cerebras-GPT kaynak kullanımını düşük tutarken performansı en üst düzeye çıkarır. Ölçeklenebilirlik ve verimlilik istiyorsanız, bu model her iki dünyanın en iyisini sunacak şekilde optimize edilmiştir.

- Parametreler: 111M – 2,7B

- Erişim: https://github.com/Cerebras

- Açık kaynak: Evet

6. Phi-3.5

Bu model 3,8 milyar parametreye sahiptir; onu benzersiz kılan ise 128K token bağlam uzunluğudur. Bu ne anlama geliyor? Bağlamı kaybetmeden uzun belgeleri veya çok turlu konuşmaları ele alabilir. Çok dilli desteğe de sahiptir; bu da onu Llama 13B ve GPT-3.5 gibi modellere kıyasla çok daha düşük hesaplama gereksinimleriyle güçlü bir rakip yapar. Belge özetleme, çok dilli görevler ve mantıksal akıl yürütme için harikadır.

- Parametreler: 3,8 milyar

- Erişim: https://huggingface.co/microsoft/phi-2

- Açık kaynak: Evet, yalnızca araştırma amaçlı.

7. StableLM-zephyr

StableLM-Zephyr, 3 milyar parametreli küçük bir dil modelidir ve doğruluk ile hız istediğinizde harikadır. Bu model hızlı çıkarım sağlar ve kenar sistemleri veya düşük kaynaklı cihazlar gibi hızlı karar almanın kritik olduğu ortamlarda son derece iyi performans gösterir. Keskin ve hızlı bir şeye ihtiyacınız varsa StableLM-Zephyr iyi bir seçenektir.

StableLM-Zephyr, akıl yürütme ve hatta rol yapma içeren görevlerde başarılıdır. Daha hafif ve hızlı olsa da yazma veya kodlama gibi daha karmaşık görevleri daha büyük modeller kadar iyi yönetemeyebilir; ancak boyutuna göre çok iyi bir performans sergiler. Önceliğiniz hız ve verimlilikse, StableLM-Zephyr sağlam bir tercihtir.

- Parametreler: 3B

- Erişim: https://github.com/StabilityAI/stablelm

- Açık kaynak: Evet

8. TinyLlama

TinyLlama’dan bahsedelim: 1,1 milyar parametreli kompakt bir modeldir ve boyutuna göre gerçekten iyi performans gösterir. Verimlilik için tasarlanmıştır ve daha büyük modellerin ağır hesaplama yükünü kaldıramayan cihazlar için idealdir.

Gerçek dünya görevlerinde TinyLlama, özellikle sağduyu akıl yürütmesinde Pythia-1.4B gibi modellerden daha iyi sonuç verir. LLaMA 13B gibi modellerin ham gücüne sahip olmasa da performansla kaynak verimliliği arasında iyi bir denge kurar. Bu da onu, özellikle mobil ve kenar cihazlarda, sistemi zorlamadan güçlü yapay zekâ yeteneklerine ihtiyaç duyulan senaryolar için ideal kılar.

- Parametreler: 1,1B

- Erişim: https://github.com/tinyLlama

- Açık kaynak: Evet

9. MobileLLaMA

MobileLLaMA, mobil ve düşük güçlü cihazlarda çok iyi performans gösterecek şekilde geliştirilmiş, LLaMA’nın özelleştirilmiş bir sürümüdür. 1,4 milyar parametreyle, özellikle sınırlı kaynaklara sahip cihazlarda performans ile verimlilik arasında denge sunmak üzere tasarlanmıştır.

MobileLLaMA, hareket hâlinde hız ve düşük gecikmeli yapay zekâ uygulamaları için optimize edilmiştir. MobileLLaMA-1.4B ve MobileLLaMA-2.7B gibi sürümleriyle, TinyLLaMA 1.1B gibi daha küçük modelleri rahatça geride bırakır ve OpenLLaMA 3B ile yakından rekabet eder — tüm bunları yaklaşık %40 daha hızlıyken yapar. Cihazınızda gerçek zamanlı yapay zekâya ihtiyaç duyuyorsanız MobileLLaMA tam size göre. Bu model, ağır altyapıya gerek olmadan, yüksek performanslı yapay zekâyı doğrudan mobil veya kenar sistemlere taşımak için geliştirilmiştir.

- Parametreler: 1,4B

- Erişim: https://github.com/mobileLLaMA

- Açık kaynak: Evet

10. LaMini-GPT

LaMini-GPT, 774 milyon ile 1,5 milyar parametre arasında değişen, kompakt ama güçlü bir modeldir ve özellikle çok dilli görevler için tasarlanmıştır. Kaynakların kısıtlı olduğu ortamlarda özellikle güçlüdür; yani, sınırlı kaynaklara sahip cihaz veya sistemlerde çok fazla hesaplama gücüne ihtiyaç duymadan birden çok dili işleyebilir.

LaMini-GPT ile ilgili ilginç bir nokta, GPT ailesinden daha büyük modellerden bilgi damıtımıyla geliştirilmiş olmasıdır; bu sayede yönerge takibi görevlerinde çok iyi performans gösterir. Veri kümesindeki 2,58 milyondan fazla yönerge-yanıt çiftiyle, büyük modellere kıyasla belirli görevleri ve yönergeleri daha verimli şekilde ele alacak biçimde optimize edilmiştir. Bununla birlikte, odaklı görevler için son derece verimli ve hafif olsa da, daha derin bağlamsal anlayış veya daha genel metin üretimi gerektiren geniş kapsamlı uygulamalarda o kadar iyi değildir. Özellikle çok dilli senaryolarda hızlı ve verimli bir şey arıyorsanız, LaMini-GPT sağlam bir tercihtir.

- Parametreler: 774M – 1,5B

- Erişim: https://github.com/LaMiniGPT

- Açık kaynak: Evet

11. Gemma2

Şimdi de Gemma2’den bahsedelim. Bu model 2 milyar parametreye sahiptir ve yerel dağıtımı düşünüyorsanız çok iyi çalışır. Hafif ve verimlidir — metin üretimi veya çeviri gibi işler için idealdir.

Onu OpenAI o1-preview gibi ağır sıkletlerle karşılaştırdığınızda, Gemma2 karmaşık akıl yürütme değil gerçek zamanlı uygulamalara odaklanır. Kenar bilişim için GPT-3.5 veya Llama 65B gibi kaynak canavarı modellere mükemmel bir alternatiftir.

Bu SLM ile uygulamalı çalışmak isterseniz, şu öğreticiyi okuyun: Gemma 2’yi ince ayarlama ve yerelde kullanma.

- Parametreler: 9 milyar ve 27 milyar sürümler

- Erişim: https://ai.google.dev/gemma

- Açık kaynak: Evet; yeniden dağıtım, ince ayar ve ticari kullanıma izin veren serbest bir lisansla.

12. MiniCPM

MiniCPM, 1 milyardan 4 milyara kadar parametre boyutlarıyla performans ve kaynak verimliliği arasında sağlam bir denge sunan bir modeldir. Genel dil görevlerini kolayca ele alacak şekilde tasarlanmıştır ve çok sayıda uygulamada güvenilir performans sunar; bu da onu çok yönlü bir seçenek yapar.

MiniCPM ölçeklenebilir ve verimlidir. Daha küçük boyutuna rağmen Mistral-7B ve LLaMA 7B gibi çok daha büyük modellerle aynı düzeyde performans gösterir. Hem İngilizce hem Çince için dil işleme açısından optimize edilmiştir; bu da onu, hesaplama kaynaklarının sınırlı olduğu ortamlarda yüksek yetkinliğe sahip, hafif bir alternatif hâline getirir. Kısıtlı kaynaklarla çalışıyor ancak yine de sağlam dil işleme yeteneklerine ihtiyaç duyuyorsanız MiniCPM mükemmel bir çözüm sunar.

- Parametreler: 1B – 4B

- Erişim: https://github.com/miniCPM

- Açık kaynak: Evet

13. OpenELM

OpenELM, 270 milyon ile 3 milyar arasında parametre aralığına sahip, esnek ve uyarlanabilir bir modeldir. Çoklu görev ve düşük gecikmeli yanıtların gerektiği ortamlar için tasarlanmıştır. Küçük cihazlarda gerçek zamanlı performans gerektiren görevler için idealdir.

Apple tarafından geliştirilen OpenELM, enerji verimliliği ve cihaz üstü yapay zekâ uygulamalarına odaklanır. MobiLlama ve OLMo gibi modellere karşı iyi rekabet eder ve belirli görevlere göre ayarlandığında önemli iyileşmeler gösterir. Geniş parametre boyutu yelpazesiyle OpenELM, karşılaştırılabilir performans sunmak için daha fazla kaynağa ihtiyaç duyan GPT-4 veya LLaMA gibi ağır modellere kıyasla daha küçük ve kısıtlı ortamlara optimize edilmiştir. Özellikle mobil veya kenar kullanımı için hafif ama yetenekli bir şey arıyorsanız OpenELM çok uygundur.

- Parametreler: 270M – 3B

- Erişim: https://github.com/OpenELM

- Açık kaynak: Evet

14. DCLM

DCLM’yi açalım: 1 milyar parametreli bu model, özellikle sağduyu akıl yürütme için tasarlanmıştır. Anlama ve mantıksal çıkarımların kilit olduğu gerçek dünya görevlerinde iyi performans gösterir.

DCLM, özellikle 7 milyar parametreli sürümüyle dil anlama ve akıl yürütmede iyidir. LLaMA 2 (7B) ve Mistral 7B gibi modellerle rekabet eder ve sağduyu akıl yürütme ile mantıksal çıkarım gibi görevlerde benzer performans gösterir. LLaMA 13B gibi daha büyük modeller kadar güçlü olmasa da DCLM, verimlilik ve daha az hesaplama kaynağı gerektiren gerçek dünya uygulamaları için yüksek düzeyde optimize edilmiştir; yani ağır altyapı olmadan güçlü performansa ihtiyaç duyduğunuz ortamlarda DCLM harika bir seçimdir.

- Parametreler: 1B

- Erişim: https://github.com/DCLM

- Açık kaynak: Evet

15. Fox

Ve son olarak Fox modeli: hız ve verimlilik için özel olarak tasarlanmış, 1,6 milyar parametreli bir model. Gecikmenin düşük tutulmasının kritik olduğu mobil uygulamalar için optimize edilmiştir. Fox, çok fazla hesaplama gücü harcamadan hızlı yanıtlar sunmak üzere geliştirilmiştir.

Fox, hızın gerektiği ortamlarda çok iyi performans gösterir. Düşük gecikmeli görevleri çok hızlı ele alır; bu da mobil veya kenar cihazlar için harikadır. Karmaşık akıl yürütmede o kadar güçlü değildir; ancak Fox, ağır kaynaklar kullanma lüksünüz olmadığında hızlı ve verimli yapay zekâ yanıtlarına ihtiyaç duyduğunuz durumlar için mükemmeldir. Hesaplama gücünün sınırlı, hızın öncelik olduğu senaryolarda başvurulacak modeldir.

- Parametreler: 1,6B

- Erişim: https://github.com/foxmodel

- Açık kaynak: Evet

Küçük Dil Modelleri Karşılaştırması

Bunu bir tabloyla özetleyelim:

|

Model Adı |

Parametreler |

Açık Kaynak |

Temel Özellikler |

|

Qwen2 |

0.5B, 1B, 7B |

Evet |

Ölçeklenebilir, çeşitli görevlere uygun |

|

Mistral Nemo 12B |

12B |

Evet |

Karmaşık NLP görevleri, yerel dağıtım |

|

Llama 3.1 8B |

8B |

Evet* |

Güç ve verimlilik dengesi |

|

Pythia |

160M - 2.8B |

Evet |

Akıl yürütme ve kodlamaya odaklı |

|

Cerebras-GPT |

111M - 2.7B |

Evet |

Hesaplama verimli, Chinchilla ölçekleme yasaları |

|

Phi-3.5 |

3.8B |

Evet** |

Uzun bağlam (128K token), çok dilli |

|

StableLM-zephyr |

3B |

Evet |

Hızlı çıkarım, kenar sistemler için verimli |

|

TinyLlama |

1.1B |

Evet |

Mobil ve kenar cihazlar için verimli |

|

MobileLLaMA |

1.4B |

Evet |

Mobil ve düşük güçlü cihazlar için optimize |

|

LaMini-GPT |

774M - 1.5B |

Evet |

Çok dilli, yönerge takibi görevleri |

|

Gemma2 |

9B, 27B |

Evet |

Yerel dağıtım, gerçek zamanlı uygulamalar |

|

MiniCPM |

1B - 4B |

Evet |

Dengeli performans, İngilizce ve Çince optimize |

|

OpenELM |

270M - 3B |

Evet |

Çoklu görev, düşük gecikme, enerji verimli |

|

DCLM |

1B |

Evet |

Sağduyu akıl yürütme, mantıksal çıkarım |

|

Fox |

1.6B |

Evet |

Mobil uygulamalar için hız odaklı |

*Kullanım kısıtlamalarıyla

**Yalnızca araştırma amaçlı

Sonuç

Ve bu yazı burada bitiyor; 2026’da küçük dil modelleri dünyasına kısa bir tur yaptık. Bu modellerin küçüğün zayıf anlamına gelmediğini — pek çok açıdan daha akıllı anlamına geldiğini gördük.

Bu SLM’lerin günlük teknoloji deneyimlerinizin daha fazlasına entegre edildiğini görmeyi bekleyin. Unutmayın, mesele işe uygun doğru modeldir — ve çoğu durumda doğru model küçük ve çevik olabilir.

Küçük dil modelleri hakkında daha fazla bilgi edinmek için şu iki kaynağı öneriyorum:

Ana Rojo Echeburúa, Uygulamalı Matematik alanında doktora derecesine sahip bir yapay zeka ve veri uzmanıdır. Verileri eyleme dönüştürülebilir içgörülere çevirmeyi sever ve teknik ekipleri yönetme konusunda geniş deneyime sahiptir. Ana, müşterilerle yakın çalışarak onların iş sorunlarını çözmekten ve yenilikçi yapay zeka çözümleri geliştirmekten keyif alır. Sorun çözme becerileri ve açık iletişimiyle tanınan Ana, özellikle üretken yapay zeka olmak üzere yapay zekaya tutkuyla bağlıdır. Sürekli öğrenmeye ve etik yapay zeka geliştirmeye, ayrıca karmaşık sorunları basitleştirmeye ve teknolojiyi anlaşılır biçimde açıklamaya kendini adamıştır.