Tracks

Small language models (SLMs) là các mô hình gọn nhẹ, hiệu quả và không cần máy chủ khổng lồ—khác với các mô hình ngôn ngữ lớn (LLMs). Chúng được xây dựng cho tốc độ và hiệu năng thời gian thực, có thể chạy trên điện thoại thông minh, máy tính bảng hoặc đồng hồ thông minh của chúng ta.

Trong bài viết này, chúng ta sẽ xem xét 15 SLM hàng đầu của năm 2026 và khám phá điểm mạnh, điểm yếu cũng như điều làm nên sự khác biệt của từng mô hình.

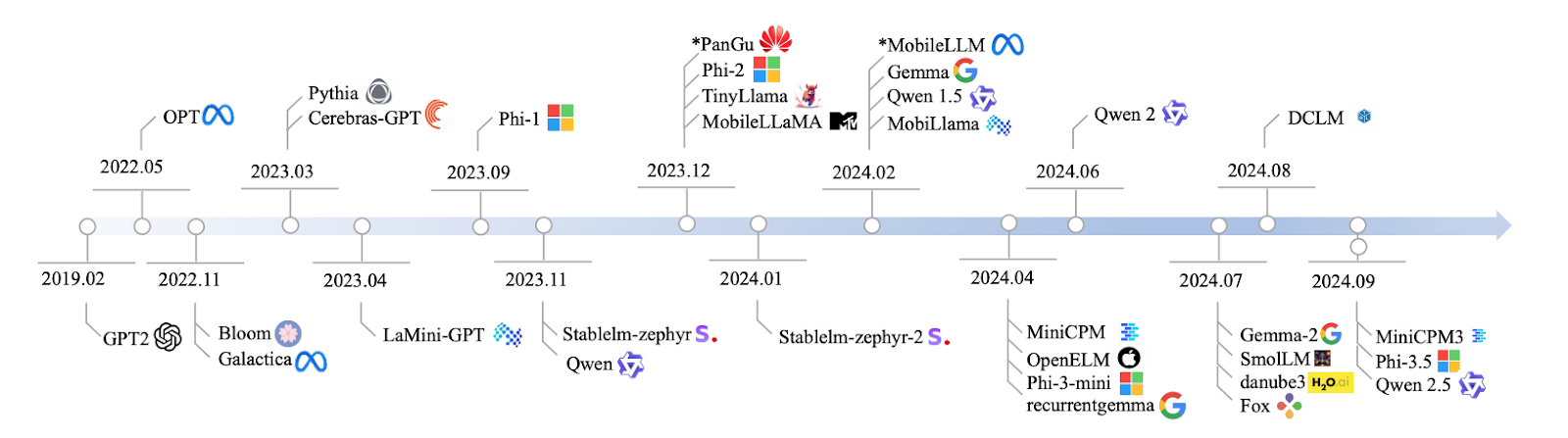

Nguồn: Lu et al., 2024

Tôi sẽ đi thẳng vào phần mô hình, nhưng nếu bạn cần phần nhập môn về các mô hình ngôn ngữ nhỏ, tôi đã viết một bài riêng tại đây: Small Language Models: A Guide With Examples.

1. Qwen2: 0.5B, 1B, và 7B

Qwen2 là một họ mô hình, với kích thước từ 0,5 tỷ đến 7 tỷ tham số. Nếu bạn đang phát triển ứng dụng cần mô hình siêu gọn nhẹ, phiên bản 0.5B là hoàn hảo.

Tuy nhiên, nếu bạn cần thứ gì đó mạnh mẽ hơn cho các tác vụ như tóm tắt hoặc tạo văn bản, mô hình 7B sẽ cho hiệu năng tốt nhất. Nó có khả năng mở rộng và có thể điều chỉnh theo nhu cầu cụ thể của bạn.

Các mô hình Qwen2 có thể không sánh bằng các mô hình AI khổng lồ về tư duy phức tạp, nhưng chúng rất phù hợp cho nhiều tình huống thực tế nơi tốc độ và hiệu quả là ưu tiên hàng đầu. Chúng đặc biệt hữu ích cho các ứng dụng cần phản hồi nhanh hoặc tài nguyên hạn chế.

- Tham số: các phiên bản 0,5 tỷ, 1 tỷ và 7 tỷ

- Truy cập: https://huggingface.co/Qwen

- Mã nguồn mở: Có, với giấy phép nguồn mở

2. Mistral Nemo 12B

Với 12 tỷ tham số, Mistral Nemo 12B rất phù hợp cho các tác vụ NLP phức tạp như dịch ngôn ngữ và hệ thống hội thoại thời gian thực. Nó cạnh tranh với các mô hình như Falcon 40B và Chinchilla 70B, nhưng vẫn có thể chạy cục bộ mà không cần hạ tầng đồ sộ. Đây là một trong những mô hình cân bằng giữa độ phức tạp và tính thực tiễn.

- Tham số: 12 tỷ

- Truy cập: https://huggingface.co/mistralai/Mistral-7B-Instruct-v0.2

- Mã nguồn mở: Có, theo giấy phép Apache 2.0

3. Llama 3.1 8B

Tiếp theo là Llama 3.1 8B, mô hình này có 8 tỷ tham số và mang lại sự cân bằng ấn tượng giữa sức mạnh và hiệu quả. Nó rất phù hợp cho các tác vụ như hỏi đáp và phân tích cảm xúc.

Llama 3.1 8B cho hiệu năng khá tốt nếu bạn cần kết quả nhanh mà không cần sức mạnh tính toán quá lớn. Hoàn hảo cho những ai muốn tốc độ mà không phải hy sinh độ chính xác.

Để trải nghiệm trực tiếp mô hình này, hãy đọc hướng dẫn về RAG với Llama 3.1 8B, Ollama và Langchain.

- Tham số: 8 tỷ

- Truy cập: https://ollama.com/library/llama3

- Mã nguồn mở: Có, nhưng có hạn chế sử dụng

4. Pythia

Hãy nói về dòng Pythia, tập hợp các mô hình từ 160 triệu đến 2,8 tỷ tham số, được thiết kế cho các tác vụ suy luận và kỹ năng lập trình. Nếu bạn làm phát triển phần mềm, Pythia rất mạnh trong việc xử lý các tác vụ có cấu trúc, dựa trên logic, nơi độ chính xác và lập luận là then chốt. Nó lý tưởng cho môi trường lập trình nơi bạn cần mô hình tư duy theo cách có cấu trúc, logic.

So với các mô hình khác như GPT-Neo, Pythia làm tốt hơn ở các tác vụ như lập trình và suy luận vì được xây dựng cho các ứng dụng trọng tâm này. Tuy nhiên, khi đưa vào các tác vụ ngôn ngữ tổng quát hơn, hiệu năng có thể hơi lung lay - Phi 3.5 và Llama 3.1 8B có thể ổn định hơn ở những mảng rộng đó. Một điểm đáng chú ý là tính minh bạch về huấn luyện công khai và khả năng tùy biến của Pythia rất ấn tượng. Bạn có thể tinh chỉnh để phù hợp nhu cầu cụ thể, khiến nó trở thành công cụ cực kỳ linh hoạt.

- Tham số: 160M – 2.8B

- Truy cập: https://github.com/EleutherAI/pythia

- Mã nguồn mở: Có

5. Cerebras-GPT

Cerebras-GPT là một mô hình hiệu quả và nhanh. Với số tham số từ 111 triệu đến 2,7 tỷ, nó được thiết kế cho môi trường tài nguyên tính toán hạn chế nhưng vẫn cần hiệu năng tốt. Cerebras-GPT mang lại kết quả ấn tượng mà không tiêu tốn hết tài nguyên của bạn.

So với các mô hình lớn hơn như GPT-3 hoặc LLaMA 13B, Cerebras-GPT có thể không có quá trình huấn luyện đồ sộ tương tự, nhưng nó tuân theo các quy luật mở rộng Chinchilla, nghĩa là cực kỳ hiệu quả về tính toán. Các mô hình như GPT-J và GPT-NeoX có thể cồng kềnh hơn, còn Cerebras-GPT tối đa hóa hiệu năng trong khi giữ mức sử dụng tài nguyên thấp. Nếu bạn cần khả năng mở rộng và hiệu quả, mô hình này được tối ưu để mang lại cả hai.

- Tham số: 111M – 2.7B

- Truy cập: https://github.com/Cerebras

- Mã nguồn mở: Có

6. Phi-3.5

Mô hình này có 3,8 tỷ tham số, nhưng điểm độc đáo là: độ dài ngữ cảnh 128K token. Nghĩa là gì? Nó có thể xử lý tài liệu dài hoặc các cuộc hội thoại nhiều lượt mà không mất ngữ cảnh. Nó còn hỗ trợ đa ngôn ngữ, khiến nó trở thành đối thủ mạnh so với các mô hình như Llama 13B và GPT-3.5 nhưng đòi hỏi tính toán thấp hơn nhiều. Mô hình này rất phù hợp cho tóm tắt tài liệu, tác vụ đa ngôn ngữ và suy luận logic.

- Tham số: 3,8 tỷ

- Truy cập: https://huggingface.co/microsoft/phi-2

- Mã nguồn mở: Có, chỉ dành cho mục đích nghiên cứu.

7. StableLM-zephyr

StableLM-Zephyr là mô hình ngôn ngữ nhỏ với 3 tỷ tham số, rất phù hợp khi bạn cần độ chính xác và tốc độ. Mô hình này suy luận nhanh và hoạt động cực kỳ tốt trong môi trường cần ra quyết định tức thì, như hệ thống biên hoặc thiết bị ít tài nguyên. Nếu bạn cần thứ gì đó sắc bén và nhanh, StableLM-Zephyr là lựa chọn tuyệt vời.

StableLM-Zephyr xuất sắc ở các tác vụ liên quan đến suy luận và thậm chí nhập vai. Dù nhẹ và nhanh, nó có thể không xử lý tốt các tác vụ phức tạp như viết hoặc lập trình bằng các mô hình lớn hơn, nhưng với kích thước của mình, đây là một “tay chơi” rất đáng gờm. Nếu tốc độ và hiệu quả là ưu tiên, StableLM-Zephyr là lựa chọn vững chắc.

- Tham số: 3B

- Truy cập: https://github.com/StabilityAI/stablelm

- Mã nguồn mở: Có

8. TinyLlama

Hãy nói về TinyLlama, một mô hình gọn nhẹ với 1,1 tỷ tham số nhưng cho hiệu năng rất tốt so với kích thước. Nó được thiết kế cho hiệu quả và hoàn hảo cho các thiết bị không thể gánh tải tính toán nặng của các mô hình lớn.

Trong các tác vụ thực tế, TinyLlama thực sự làm tốt hơn so với các mô hình như Pythia-1.4B, đặc biệt ở suy luận kiến thức thường thức. Nó không có sức mạnh thô như LLaMA 13B, nhưng cân bằng rất tốt giữa hiệu năng và hiệu quả tài nguyên. Điều đó khiến nó lý tưởng cho bối cảnh cần khả năng AI mạnh mà không quá tải hệ thống, đặc biệt trên thiết bị di động và biên.

- Tham số: 1.1B

- Truy cập: https://github.com/tinyLlama

- Mã nguồn mở: Có

9. MobileLLaMA

MobileLLaMA là phiên bản chuyên biệt của LLaMA được xây dựng để hoạt động rất tốt trên thiết bị di động và thiết bị công suất thấp. Với 1,4 tỷ tham số, nó được thiết kế để cân bằng giữa hiệu năng và hiệu quả, đặc biệt trên các thiết bị có tài nguyên hạn chế.

MobileLLaMA được tối ưu cho tốc độ và độ trễ thấp trong các ứng dụng AI di động. Với các phiên bản như MobileLLaMA-1.4B và MobileLLaMA-2.7B, nó vượt trội so với các mô hình nhỏ hơn như TinyLLaMA 1.1B và cạnh tranh sát sao với OpenLLaMA 3B - trong khi vẫn nhanh hơn khoảng 40%. Nếu bạn cần AI thời gian thực ngay trên thiết bị, MobileLLaMA là lựa chọn hoàn hảo. Mô hình này được xây dựng để mang AI hiệu năng cao trực tiếp đến thiết bị di động hoặc hệ thống biên mà không cần hạ tầng nặng nề.

- Tham số: 1.4B

- Truy cập: https://github.com/mobileLLaMA

- Mã nguồn mở: Có

10. LaMini-GPT

LaMini-GPT là mô hình gọn nhưng mạnh, từ 774 triệu đến 1,5 tỷ tham số, được thiết kế đặc biệt cho các tác vụ đa ngôn ngữ. Nó đặc biệt mạnh trong môi trường hạn chế tài nguyên, tức có thể xử lý nhiều ngôn ngữ mà không cần nhiều sức mạnh tính toán, rất phù hợp cho thiết bị hoặc hệ thống tài nguyên hạn chế.

Điều thú vị là LaMini-GPT được phát triển thông qua chưng cất tri thức từ các mô hình lớn hơn thuộc họ GPT, cho phép nó hoạt động rất tốt trong các tác vụ làm theo hướng dẫn. Với hơn 2,58 triệu cặp hướng dẫn-phản hồi trong bộ dữ liệu, nó được tối ưu để xử lý các tác vụ và hướng dẫn cụ thể hiệu quả hơn so với các mô hình lớn. Tuy nhiên, dù cực kỳ hiệu quả và gọn nhẹ, đặc biệt cho các tác vụ trọng tâm, nó không quá mạnh cho các ứng dụng rộng hơn đòi hỏi hiểu ngữ cảnh sâu hoặc tạo văn bản tổng quát. Nếu bạn tìm kiếm sự nhanh và hiệu quả, đặc biệt trong bối cảnh đa ngôn ngữ, LaMini-GPT là lựa chọn vững chắc.

- Tham số: 774M – 1.5B

- Truy cập: https://github.com/LaMiniGPT

- Mã nguồn mở: Có

11. Gemma2

Giờ hãy nói về Gemma2. Mô hình này có 2 tỷ tham số và hoạt động rất tốt nếu bạn tính đến triển khai cục bộ. Nó gọn nhẹ và hiệu quả—lý tưởng cho các tác vụ như tạo văn bản hoặc dịch thuật.

Khi so với các “đàn anh” như OpenAI o1-preview, Gemma2 tập trung vào ứng dụng thời gian thực, không phải suy luận phức tạp. Đối với điện toán biên, đây là lựa chọn thay thế hoàn hảo cho các mô hình như GPT-3.5 hoặc Llama 65B vốn ngốn tài nguyên.

Nếu bạn muốn thực hành với SLM này, hãy đọc hướng dẫn về fine-tuning Gemma 2 và sử dụng cục bộ.

- Tham số: các phiên bản 9 tỷ và 27 tỷ

- Truy cập: https://ai.google.dev/gemma

- Mã nguồn mở: Có, với giấy phép thoáng cho phép phân phối lại, fine-tuning và sử dụng thương mại.

12. MiniCPM

MiniCPM là mô hình có sự cân bằng tốt giữa hiệu năng và hiệu quả tài nguyên, với kích thước tham số từ 1 tỷ đến 4 tỷ. Nó được thiết kế để xử lý dễ dàng các tác vụ ngôn ngữ chung và mang lại hiệu năng ổn định trên rất nhiều ứng dụng, trở thành lựa chọn toàn diện tuyệt vời.

MiniCPM có khả năng mở rộng và hiệu quả. Dù kích thước nhỏ, nó hoạt động ngang ngửa với các mô hình lớn hơn nhiều như Mistral-7B và LLaMA 7B. Nó được tối ưu đặc biệt cho xử lý ngôn ngữ bằng cả tiếng Anh và tiếng Trung, khiến nó trở thành giải pháp gọn nhẹ nhưng rất mạnh cho môi trường hạn chế tài nguyên. Nếu bạn làm việc trong bối cảnh hạn chế nhưng vẫn cần xử lý ngôn ngữ tốt, MiniCPM là lựa chọn xuất sắc.

- Tham số: 1B – 4B

- Truy cập: https://github.com/miniCPM

- Mã nguồn mở: Có

13. OpenELM

OpenELM là mô hình linh hoạt và thích ứng, với dải tham số từ 270 triệu đến 3 tỷ. Nó được thiết kế cho môi trường cần đa nhiệm và phản hồi độ trễ thấp. Rất hoàn hảo cho các tác vụ cần hiệu năng thời gian thực trên thiết bị nhỏ.

Được phát triển bởi Apple, OpenELM tập trung vào hiệu quả năng lượng và ứng dụng AI trên thiết bị. Nó cạnh tranh tốt với các mô hình như MobiLlama và OLMo, cho thấy cải thiện đáng kể khi tinh chỉnh cho các tác vụ cụ thể. Với dải kích cỡ tham số rộng, OpenELM được tối ưu cho môi trường nhỏ, hạn chế, khác với các mô hình nặng như GPT-4 hoặc LLaMA vốn cần nhiều tài nguyên để đạt hiệu năng tương đương. Nếu bạn cần thứ gì đó gọn mà vẫn mạnh, đặc biệt cho di động hoặc biên, OpenELM rất phù hợp.

- Tham số: 270M – 3B

- Truy cập: https://github.com/OpenELM

- Mã nguồn mở: Có

14. DCLM

Cùng tìm hiểu DCLM, mô hình 1 tỷ tham số được thiết kế riêng cho suy luận kiến thức thường thức. Nó hoạt động tốt trong các tác vụ thực tế nơi hiểu biết và suy luận logic là chìa khóa.

DCLM mạnh về hiểu ngôn ngữ và suy luận, đặc biệt với phiên bản 7 tỷ tham số. Nó cạnh tranh với các mô hình như LLaMA 2 (7B) và Mistral 7B, đạt hiệu năng tương đương trong các tác vụ suy luận kiến thức thường thức và suy luận logic. Dĩ nhiên không mạnh bằng các mô hình lớn như LLaMA 13B, nhưng DCLM được tối ưu cao cho ứng dụng thực tế đòi hỏi hiệu quả và ít tài nguyên tính toán; vì vậy khi cần hiệu năng mạnh mà không có hạ tầng nặng, DCLM là lựa chọn rất tốt.

- Tham số: 1B

- Truy cập: https://github.com/DCLM

- Mã nguồn mở: Có

15. Fox

Cuối cùng là mô hình Fox, với 1,6 tỷ tham số, được thiết kế riêng cho tốc độ và hiệu quả. Nó được tối ưu cho ứng dụng di động, nơi việc giữ độ trễ thấp là tối quan trọng. Fox được xây dựng để phản hồi nhanh mà không tiêu hao quá nhiều năng lực tính toán.

Fox hoạt động rất tốt trong môi trường cần tốc độ. Nó xử lý các tác vụ độ trễ thấp cực nhanh, rất phù hợp cho thiết bị di động hoặc biên. Nó không mạnh về suy luận phức tạp, nhưng Fox hoàn hảo cho tình huống bạn cần phản hồi AI nhanh, hiệu quả và không thể dùng tài nguyên nặng. Đây là mô hình “chọn mặt gửi vàng” khi sức mạnh tính toán hạn chế nhưng tốc độ là ưu tiên.

- Tham số: 1.6B

- Truy cập: https://github.com/foxmodel

- Mã nguồn mở: Có

So sánh các mô hình ngôn ngữ nhỏ

Hãy tóm tắt những gì chúng ta đã đề cập qua bảng dưới đây:

|

Tên mô hình |

Tham số |

Mã nguồn mở |

Tính năng chính |

|

Qwen2 |

0.5B, 1B, 7B |

Có |

Khả năng mở rộng, phù hợp nhiều tác vụ |

|

Mistral Nemo 12B |

12B |

Có |

Tác vụ NLP phức tạp, triển khai cục bộ |

|

Llama 3.1 8B |

8B |

Có* |

Cân bằng sức mạnh và hiệu quả |

|

Pythia |

160M - 2.8B |

Có |

Tập trung vào suy luận và lập trình |

|

Cerebras-GPT |

111M - 2.7B |

Có |

Hiệu quả tính toán, tuân theo quy luật mở rộng Chinchilla |

|

Phi-3.5 |

3.8B |

Có** |

Ngữ cảnh dài (128K token), đa ngôn ngữ |

|

StableLM-zephyr |

3B |

Có |

Suy luận nhanh, hiệu quả cho hệ thống biên |

|

TinyLlama |

1.1B |

Có |

Hiệu quả cho thiết bị di động và biên |

|

MobileLLaMA |

1.4B |

Có |

Tối ưu cho di động và thiết bị công suất thấp |

|

LaMini-GPT |

774M - 1.5B |

Có |

Đa ngôn ngữ, tác vụ làm theo hướng dẫn |

|

Gemma2 |

9B, 27B |

Có |

Triển khai cục bộ, ứng dụng thời gian thực |

|

MiniCPM |

1B - 4B |

Có |

Hiệu năng cân bằng, tối ưu cho tiếng Anh và tiếng Trung |

|

OpenELM |

270M - 3B |

Có |

Đa nhiệm, độ trễ thấp, tiết kiệm năng lượng |

|

DCLM |

1B |

Có |

Suy luận thường thức, suy luận logic |

|

Fox |

1.6B |

Có |

Tối ưu tốc độ cho ứng dụng di động |

*Có hạn chế sử dụng

**Chỉ dành cho mục đích nghiên cứu

Kết luận

Và đó là tất cả cho bài viết này, một chuyến dạo qua thế giới các mô hình ngôn ngữ nhỏ năm 2026. Chúng ta đã thấy các mô hình này chứng minh rằng nhỏ không có nghĩa là yếu—ở nhiều khía cạnh còn là “thông minh hơn”.

Hãy kỳ vọng thấy các SLM này được tích hợp nhiều hơn vào trải nghiệm công nghệ hằng ngày của bạn. Hãy nhớ, quan trọng là chọn đúng mô hình cho đúng việc—và trong nhiều trường hợp, mô hình phù hợp có thể nhỏ gọn và linh hoạt.

Để tìm hiểu thêm về các mô hình ngôn ngữ nhỏ, tôi gợi ý hai tài liệu sau:

Ana Rojo Echeburúa là chuyên gia AI và dữ liệu, có bằng Tiến sĩ Toán Ứng dụng. Cô yêu thích việc biến dữ liệu thành những insight có thể hành động và có nhiều kinh nghiệm lãnh đạo các nhóm kỹ thuật. Ana thích làm việc chặt chẽ với khách hàng để giải quyết các vấn đề kinh doanh và tạo ra những giải pháp AI sáng tạo. Được biết đến với kỹ năng giải quyết vấn đề và giao tiếp rõ ràng, cô đam mê AI, đặc biệt là AI tạo sinh. Ana luôn theo đuổi việc học tập không ngừng và phát triển AI có đạo đức, cũng như đơn giản hóa các vấn đề phức tạp và giải thích công nghệ theo cách dễ tiếp cận.