Leerpad

Small language models (SLM’s) zijn compact, efficiënt en hebben geen enorme servers nodig—anders dan hun tegenhangers, de large language models (LLM’s). Ze zijn gebouwd voor snelheid en real-time prestaties en kunnen draaien op smartphones, tablets of smartwatches.

In dit artikel bekijken we de top 15 SLM’s van 2026 en onderzoeken we hun sterke en zwakke punten en wat elk model uniek maakt.

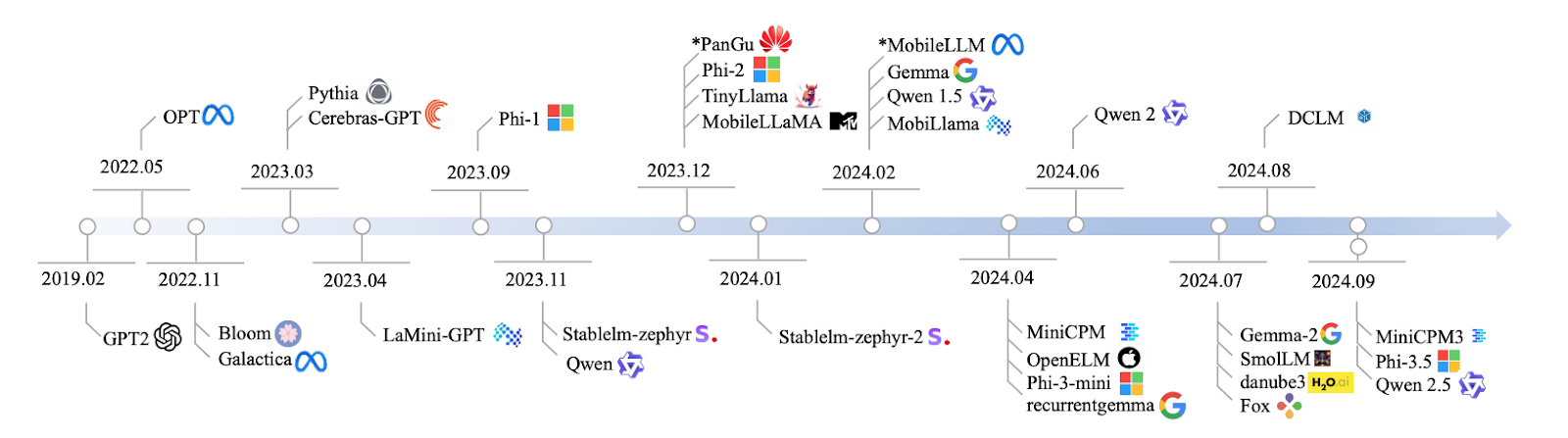

Bron: Lu et al., 2024

Ik ga meteen in op de modellen, maar als je een introductie in small language models nodig hebt, lees dan dit aparte artikel: Small Language Models: A Guide With Examples.

1. Qwen2: 0,5B, 1B en 7B

Qwen2 is een modellenfamilie met groottes van 0,5 miljard tot 7 miljard parameters. Werk je aan een app die een superlicht model nodig heeft, dan is de 0,5B-versie perfect.

Heb je echter iets robuusters nodig voor taken als samenvatten of tekstgeneratie, dan biedt het 7B-model de meeste performance. Het is schaalbaar en af te stemmen op jouw specifieke behoeften.

Qwen2-modellen halen misschien niet de brede capaciteiten van enorme AI-modellen bij complexe redenering, maar ze zijn uitstekend voor veel praktische toepassingen waar snelheid en efficiëntie het belangrijkst zijn. Ze zijn vooral handig voor apps die snelle reacties of beperkte resources vereisen.

- Parameters: versies van 0,5 miljard, 1 miljard en 7 miljard

- Toegang: https://huggingface.co/Qwen

- Open source: Ja, met een open-sourcelicentie

2. Mistral Nemo 12B

Met 12 miljard parameters is Mistral Nemo 12B uitstekend voor complexe NLP-taken zoals vertalen en real-time dialoogsysteemen. Het concurreert met modellen als Falcon 40B en Chinchilla 70B, maar kan lokaal draaien zonder enorme infrastructuur. Het is een model dat complexiteit en praktische inzet mooi in balans houdt.

- Parameters: 12 miljard

- Toegang: https://huggingface.co/mistralai/Mistral-7B-Instruct-v0.2

- Open source: Ja, met een Apache 2.0-licentie

3. Llama 3.1 8B

Dan Llama 3.1 8B: dit model heeft 8 miljard parameters en biedt een geweldige balans tussen kracht en efficiëntie. Het is fijn voor taken zoals vraag-antwoord en sentimentanalyse.

Llama 3.1 8B levert behoorlijk goede prestaties als je snelle resultaten nodig hebt zonder enorme rekenkracht. Perfect voor wie snelheid wil zonder veel in te leveren op nauwkeurigheid.

Wil je hiermee praktisch aan de slag, lees dan deze tutorial over RAG met Llama 3.1 8B, Ollama en LangChain.

- Parameters: 8 miljard

- Toegang: https://ollama.com/library/llama3

- Open source: Ja, maar met gebruiksbeperkingen

4. Pythia

Dan de Pythia-serie, een reeks modellen van 160 miljoen tot 2,8 miljard parameters, ontworpen voor redeneren en codeertaken. Ben je met softwareontwikkeling bezig, dan is Pythia sterk in gestructureerde, logische taken waar nauwkeurigheid en logica centraal staan. Ideaal in codeeromgevingen waar het model gestructureerd en logisch moet denken.

Vergeleken met andere modellen zoals GPT-Neo presteert Pythia beter bij codeer- en redeneertaken, omdat het hiervoor is geoptimaliseerd. Gooi je het op meer algemene taaltaken, dan kan het wat wankeler worden—Phi 3.5 en Llama 3.1 8B zijn daar vaak consistenter. Opvallend is de openheid rond publieke training en de ruime maatwerkopties van Pythia. Je kunt het afstemmen op jouw specifieke behoeften, wat het een enorm flexibele tool maakt.

- Parameters: 160M – 2,8B

- Toegang: https://github.com/EleutherAI/pythia

- Open source: Ja

5. Cerebras-GPT

Cerebras-GPT is een efficiënt en snel model. Met parameters van 111 miljoen tot 2,7 miljard is het ontworpen voor omgevingen met beperkte rekenresources, terwijl je toch sterke prestaties nodig hebt. Cerebras-GPT levert mooie resultaten zonder al je resources op te souperen.

Vergeleken met grotere modellen zoals GPT-3 of LLaMA 13B heeft Cerebras-GPT misschien niet dezelfde omvangrijke training, maar het volgt de Chinchilla-schaalwetten, wat het extreem rekenefficiënt maakt. Modellen als GPT-J en GPT-NeoX zijn zwaarder, maar Cerebras-GPT maximaliseert de prestaties met een laag resourceverbruik. Heb je schaalbaarheid én efficiëntie nodig, dan geeft dit model je het beste van twee werelden.

- Parameters: 111M – 2,7B

- Toegang: https://github.com/Cerebras

- Open source: Ja

6. Phi-3.5

Dit model heeft 3,8 miljard parameters, maar wat het uniek maakt: 128K tokens contextlengte. Wat betekent dat? Het kan lange documenten of gesprekken met meerdere beurten aan zonder de draad kwijt te raken. Het is ook meertalig, waardoor het sterk concurreert met modellen als Llama 13B en GPT-3.5, maar met veel lagere rekenvereisten. Uitstekend voor documentsamenvatting, meertalige taken en logische redenering.

- Parameters: 3,8 miljard

- Toegang: https://huggingface.co/microsoft/phi-2

- Open source: Ja, alleen voor onderzoeksdoeleinden.

7. StableLM-zephyr

StableLM-Zephyr is een small language model met 3 miljard parameters dat uitblinkt wanneer je nauwkeurigheid én snelheid wilt. Het model biedt snelle inferentie en presteert geweldig in omgevingen waar snel beslissen cruciaal is, zoals edge-systemen of apparaten met weinig resources. Als je iets scherps en snel nodig hebt, is StableLM-Zephyr een sterke optie.

StableLM-Zephyr blinkt uit in taken met redenering en zelfs rollenspel. Hoewel het lichter en sneller is, kan het complexere taken zoals schrijven of programmeren minder goed aan dan grotere modellen, maar voor zijn formaat is het een prima performer. Als snelheid en efficiëntie je prioriteiten zijn, is StableLM-Zephyr een solide keuze.

- Parameters: 3B

- Toegang: https://github.com/StabilityAI/stablelm

- Open source: Ja

8. TinyLlama

TinyLlama is een compact model met 1,1 miljard parameters dat voor zijn formaat erg goed presteert. Het is ontworpen voor efficiëntie en perfect voor apparaten die de zware rekenlast van grotere modellen niet aankunnen.

Voor praktische taken presteert TinyLlama zelfs beter dan modellen zoals Pythia-1.4B, vooral bij alledaagse redenering. Het heeft niet de ruwe kracht van modellen als LLaMA 13B, maar biedt een uitstekende balans tussen prestaties en resource-efficiëntie. Ideaal wanneer je sterke AI-capaciteiten wilt zonder het systeem te overbelasten, vooral op mobiele en edge-apparaten.

- Parameters: 1,1B

- Toegang: https://github.com/tinyLlama

- Open source: Ja

9. MobileLLaMA

MobileLLaMA is een gespecialiseerde LLaMA-variant die uitstekend presteert op mobiele en energiezuinige apparaten. Met 1,4 miljard parameters is het ontworpen voor een mooie balans tussen performance en efficiëntie, vooral op devices met beperkte resources.

MobileLLaMA is geoptimaliseerd voor snelheid en lage latentie, ook onderweg. Met varianten als MobileLLaMA-1.4B en MobileLLaMA-2.7B is het duidelijk sneller dan kleinere modellen zoals TinyLLaMA 1.1B en ligt het dicht bij OpenLLaMA 3B—en dat alles ongeveer 40% sneller. Heb je real-time AI nodig op je apparaat, dan is MobileLLaMA ideaal. Dit model brengt krachtige AI rechtstreeks naar je mobiele of edge-systemen zonder zware infrastructuur.

- Parameters: 1,4B

- Toegang: https://github.com/mobileLLaMA

- Open source: Ja

10. LaMini-GPT

LaMini-GPT is een compact maar krachtig model van 774 miljoen tot 1,5 miljard parameters, specifiek ontworpen voor meertalige taken. Het is bijzonder sterk in omgevingen met weinig resources: meerdere talen verwerken zonder veel rekenkracht—perfect voor devices of systemen met beperkte middelen.

Interessant aan LaMini-GPT is dat het door knowledge distillation is ontwikkeld vanuit grotere GPT-familiemodellen, waardoor het heel goed presteert bij instructievolgende taken. Met meer dan 2,58 miljoen instructie-antwoordparen in de dataset is het geoptimaliseerd om specifieke taken en instructies efficiënter af te handelen dan grotere modellen. Het is echter minder geschikt voor bredere toepassingen die diepe context of algemene tekstgeneratie vereisen. Zoek je iets snels en efficiënts, vooral in meertalige scenario’s, dan is LaMini-GPT een solide keuze.

- Parameters: 774M – 1,5B

- Toegang: https://github.com/LaMiniGPT

- Open source: Ja

11. Gemma2

Dan Gemma2. Dit model telt 2 miljard parameters en werkt heel goed als je aan lokale inzet denkt. Lichtgewicht en efficiënt—ideaal voor dingen als tekstgeneratie of vertaling.

Vergeleken met zwaargewichten zoals OpenAI o1-preview richt Gemma2 zich op real-time toepassingen, niet op complexe redenering. Voor edge computing is het een perfect alternatief voor modellen als GPT-3.5 of Llama 65B, die veel resources vragen.

Wil je met deze SLM aan de slag, lees dan deze tutorial over Gemma 2 fine-tunen en lokaal gebruiken.

- Parameters: versies van 9 miljard en 27 miljard

- Toegang: https://ai.google.dev/gemma

- Open source: Ja, met een permissieve licentie die herdistributie, fine-tuning en commercieel gebruik toestaat.

12. MiniCPM

MiniCPM biedt een sterke balans tussen prestaties en resource-efficiëntie, met modelgroottes van 1 miljard tot 4 miljard. Het is ontworpen om algemene taaltaken makkelijk aan te kunnen en levert betrouwbare prestaties in veel toepassingen—een sterke allrounder.

MiniCPM is schaalbaar en efficiënt. Ondanks de kleinere omvang presteert het op niveau met veel grotere modellen zoals Mistral-7B en LLaMA 7B. Het is met name geoptimaliseerd voor taalverwerking in zowel het Engels als het Chinees, waardoor het een capabel, lichtgewicht alternatief is voor omgevingen met beperkte rekenkracht. Werk je met weinig resources maar heb je toch degelijke taalverwerking nodig, dan is MiniCPM een uitstekende oplossing.

- Parameters: 1B – 4B

- Toegang: https://github.com/miniCPM

- Open source: Ja

13. OpenELM

OpenELM is flexibel en aanpasbaar, met een parameterbereik van 270 miljoen tot 3 miljard. Het is ontworpen voor omgevingen die multitasking en respons met lage latentie nodig hebben. Perfect voor taken die real-time performance vereisen op kleinere apparaten.

Ontwikkeld door Apple, focust OpenELM op energie-efficiëntie en on-device AI. Het kan zich meten met modellen als MobiLlama en OLMo en laat duidelijke verbeteringen zien wanneer het voor specifieke taken wordt getuned. Met zijn brede range aan groottes is OpenELM geoptimaliseerd voor kleinere, beperktere omgevingen—anders dan zwaardere modellen zoals GPT-4 of LLaMA, die meer resources nodig hebben voor vergelijkbare performance. Zoek je iets lichts maar capabels, vooral voor mobiel of edge, dan past OpenELM goed.

- Parameters: 270M – 3B

- Toegang: https://github.com/OpenELM

- Open source: Ja

14. DCLM

DCLM is een model met 1 miljard parameters dat specifiek is ontworpen voor gezond-verstand-redenering. Het presteert goed bij real-world taken waarbij begrijpen en logisch afleiden cruciaal zijn.

DCLM is sterk in taalbegrip en redeneren, zeker in de versie met 7 miljard parameters. Het concurreert met modellen als LLaMA 2 (7B) en Mistral 7B en doet niet onder bij taken als commonsense redeneren en logische deductie. Het is zeker niet zo krachtig als grotere modellen zoals LLaMA 13B, maar DCLM is sterk geoptimaliseerd voor praktische toepassingen die efficiëntie en minder rekenkracht vereisen. In omgevingen waar je stevige prestaties wilt zonder zware infrastructuur is DCLM een prima keuze.

- Parameters: 1B

- Toegang: https://github.com/DCLM

- Open source: Ja

15. Fox

Tot slot: het Fox-model, met 1,6 miljard parameters, ontworpen voor snelheid en efficiëntie. Het is geoptimaliseerd voor mobiele toepassingen, waar lage latentie cruciaal is. Fox is gebouwd om snel te reageren zonder te veel rekenkracht te vergen.

Fox presteert uitstekend in omgevingen waar snelheid telt. Het handelt low-latency taken razendsnel af—ideaal voor mobiele of edge-apparaten. Het is minder sterk in complexe redenering, maar perfect wanneer je snelle, efficiënte AI-antwoorden nodig hebt en geen zware resources kunt inzetten. De go-to wanneer rekenkracht beperkt is maar snelheid prioriteit heeft.

- Parameters: 1,6B

- Toegang: https://github.com/foxmodel

- Open source: Ja

Vergelijking small language models

Laten we samenvatten wat we hebben behandeld in deze tabel:

|

Modelnaam |

Parameters |

Open source |

Belangrijkste kenmerken |

|

Qwen2 |

0,5B, 1B, 7B |

Ja |

Schaalbaar, geschikt voor diverse taken |

|

Mistral Nemo 12B |

12B |

Ja |

Complexe NLP-taken, lokale inzet |

|

Llama 3.1 8B |

8B |

Ja* |

Balans tussen kracht en efficiëntie |

|

Pythia |

160M - 2,8B |

Ja |

Gefocust op redeneren en coderen |

|

Cerebras-GPT |

111M - 2,7B |

Ja |

Rekenefficiënt, volgt Chinchilla-schaalwetten |

|

Phi-3.5 |

3,8B |

Ja** |

Lange context (128K tokens), meertalig |

|

StableLM-zephyr |

3B |

Ja |

Snelle inferentie, efficiënt voor edge-systemen |

|

TinyLlama |

1,1B |

Ja |

Efficiënt voor mobiele en edge-apparaten |

|

MobileLLaMA |

1,4B |

Ja |

Geoptimaliseerd voor mobiele en low-power apparaten |

|

LaMini-GPT |

774M - 1,5B |

Ja |

Meertalig, instructie-volgende taken |

|

Gemma2 |

9B, 27B |

Ja |

Lokale inzet, real-time toepassingen |

|

MiniCPM |

1B - 4B |

Ja |

Gebalanceerde prestaties, geoptimaliseerd voor Engels en Chinees |

|

OpenELM |

270M - 3B |

Ja |

Multitasking, lage latentie, energiezuinig |

|

DCLM |

1B |

Ja |

Gezond-verstand-redenering, logische deductie |

|

Fox |

1,6B |

Ja |

Op snelheid geoptimaliseerd voor mobiele toepassingen |

*Met gebruiksbeperkingen

**Alleen voor onderzoeksdoeleinden

Conclusie

Dat was het voor dit artikel: een korte tour door de wereld van small language models in 2026. We hebben gezien dat kleiner niet zwakker betekent—op veel manieren betekent het slimmer.

Verwacht dat deze SLM’s in steeds meer dagelijkse tech-ervaringen opduiken. Onthoud: het gaat om het juiste model voor de klus—en vaak is dat klein en wendbaar.

Wil je meer leren over small language models, dan raad ik deze twee resources aan:

Ana Rojo Echeburúa is een AI- en dataspecialist met een PhD in Toegepaste Wiskunde. Ze houdt ervan om data om te zetten in bruikbare inzichten en heeft ruime ervaring in het aansturen van technische teams. Ana werkt graag nauw samen met klanten om hun bedrijfsproblemen op te lossen en innovatieve AI-oplossingen te creëren. Ze staat bekend om haar probleemoplossend vermogen en heldere communicatie, en is gepassioneerd door AI, vooral generatieve AI. Ana zet zich in voor continue ontwikkeling en ethische AI, en voor het vereenvoudigen van complexe vraagstukken en het op een toegankelijke manier uitleggen van technologie.