Programma

I small language models (SLM) sono compatti, efficienti e non richiedono server mastodontici, a differenza dei loro omologhi LLM. Sono pensati per la velocità e le prestazioni in tempo reale e possono girare su smartphone, tablet o smartwatch.

In questo articolo esamineremo i 15 migliori SLM del 2026 e ne esploreremo punti di forza, limiti e ciò che rende unico ciascun modello.

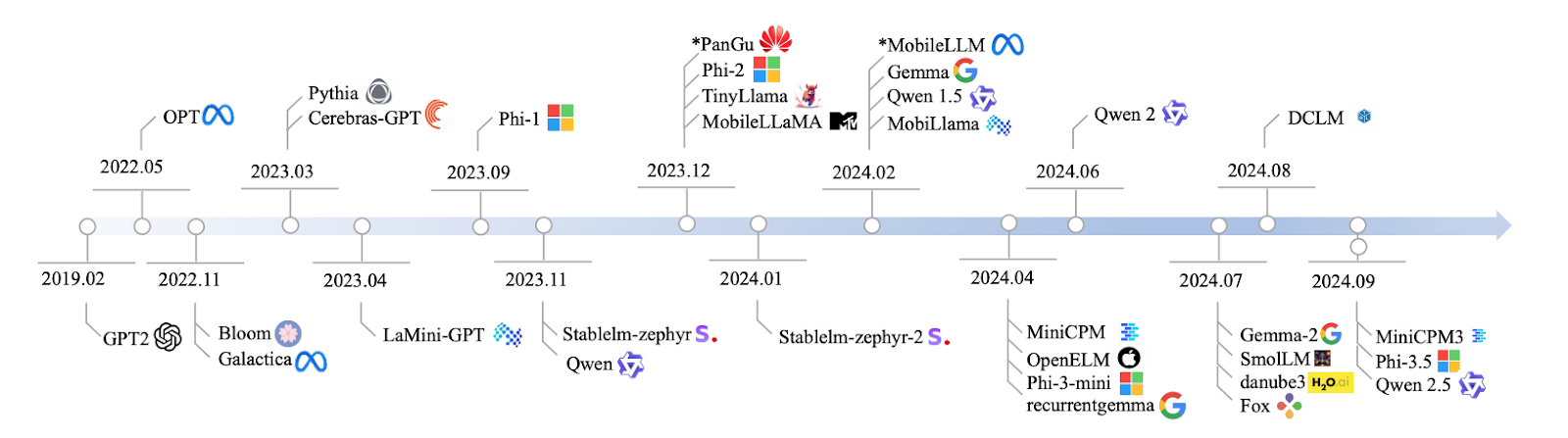

Fonte: Lu et al., 2024

Passo subito ai modelli; se però ti serve un’introduzione agli small language models, ho scritto un articolo a parte qui: Small Language Models: guida con esempi.

1. Qwen2: 0.5B, 1B e 7B

Qwen2 è una famiglia di modelli, con dimensioni che vanno da 0,5 a 7 miliardi di parametri. Se stai lavorando a un’app che richiede un modello super leggero, la versione 0.5B è perfetta.

Se invece ti serve qualcosa di più robusto per attività come riassunti o generazione di testo, il 7B è quello da cui otterrai il meglio. È scalabile e si può adattare alle tue esigenze specifiche.

I modelli Qwen2 forse non eguagliano le capacità generali dei grandi modelli nell’elaborazione complessa, ma sono ottimi per molti casi d’uso pratici in cui contano soprattutto velocità ed efficienza. Sono particolarmente utili per app che richiedono risposte rapide o hanno risorse limitate.

- Parametri: versioni da 0,5 miliardi, 1 miliardo e 7 miliardi

- Accesso: https://huggingface.co/Qwen

- Open source: Sì, con licenza open source

2. Mistral Nemo 12B

Con 12 miliardi di parametri, Mistral Nemo 12B è ottimo per attività NLP complesse come la traduzione e i sistemi di dialogo in tempo reale. Compete con modelli come Falcon 40B e Chinchilla 70B, ma può comunque girare in locale senza un’infrastruttura mastodontica. È uno di quei modelli che bilanciano complessità e praticità.

- Parametri: 12 miliardi

- Accesso: https://huggingface.co/mistralai/Mistral-7B-Instruct-v0.2

- Open source: Sì, con licenza Apache 2.0

3. Llama 3.1 8B

Passando a Llama 3.1 8B, questo modello ha 8 miliardi di parametri e offre un ottimo equilibrio tra potenza ed efficienza. È ideale per attività come question answering e sentiment analysis.

Llama 3.1 8B offre prestazioni più che buone se ti servono risultati rapidi senza grandi risorse di calcolo. È perfetto per chi vuole velocità senza sacrificare l’accuratezza.

Per fare pratica con questo modello, leggi questo tutorial su RAG con Llama 3.1 8B, Ollama e Langchain.

- Parametri: 8 miliardi

- Accesso: https://ollama.com/library/llama3

- Open source: Sì, ma con restrizioni d’uso

4. Pythia

Parliamo della serie Pythia, un insieme di modelli da 160 milioni a 2,8 miliardi di parametri, progettati per attività di ragionamento e coding. Se ti occupi di sviluppo software, Pythia è ottimo per gestire compiti strutturati e basati sulla logica, in cui accuratezza e rigore sono fondamentali. È perfetto in ambienti di programmazione in cui vuoi che il modello ragioni in modo strutturato e logico.

Rispetto ad altri modelli come GPT-Neo, Pythia va meglio in compiti di coding e ragionamento perché è costruito proprio per questi usi mirati. Tuttavia, se lo metti su compiti linguistici più generali, può perdere un po’ di colpi: Phi 3.5 e Llama 3.1 8B potrebbero risultare più consistenti in ambiti più ampi. Da notare che la trasparenza del training pubblico di Pythia e le opzioni di personalizzazione sono notevoli. Puoi adattarlo alle tue esigenze specifiche, il che lo rende uno strumento estremamente flessibile.

- Parametri: 160M – 2,8B

- Accesso: https://github.com/EleutherAI/pythia

- Open source: Sì

5. Cerebras-GPT

Cerebras-GPT è un modello efficiente e veloce. Con parametri da 111 milioni a 2,7 miliardi, è pensato per ambienti con risorse di calcolo limitate, ma che richiedono comunque buone prestazioni. Cerebras-GPT offre ottimi risultati senza prosciugare tutte le risorse.

Rispetto a modelli più grandi come GPT-3 o LLaMA 13B, forse non ha lo stesso training estensivo, ma segue le scaling laws di Chinchilla, risultando estremamente efficiente in termini di calcolo. Modelli come GPT-J e GPT-NeoX sono più ingombranti, ma Cerebras-GPT massimizza le prestazioni mantenendo basso il consumo di risorse. Se ti servono scalabilità ed efficienza, questo modello è ottimizzato per darti il meglio di entrambi i mondi.

- Parametri: 111M – 2,7B

- Accesso: https://github.com/Cerebras

- Open source: Sì

6. Phi-3.5

Questo modello ha 3,8 miliardi di parametri, ma ecco cosa lo distingue: una context length di 128K token. Cosa significa? Può gestire documenti lunghi o conversazioni multi-turno senza perdere il filo. È anche multilingue, il che lo rende un forte concorrente di modelli come Llama 13B e GPT-3.5, ma con richieste computazionali molto inferiori. È ottimo per riassunti di documenti, attività multilingue e ragionamento logico.

- Parametri: 3,8 miliardi

- Accesso: https://huggingface.co/microsoft/phi-2

- Open source: Sì, solo per scopi di ricerca.

7. StableLM-zephyr

StableLM-Zephyr è un small language model con 3 miliardi di parametri ideale quando vuoi accuratezza e velocità. Fornisce inferenza rapida e rende al massimo in contesti in cui servono decisioni al volo, come sistemi edge o dispositivi con poche risorse. Se ti serve qualcosa di scattante e preciso, è un’ottima opzione.

StableLM-Zephyr eccelle in compiti che richiedono ragionamento e persino role-playing. Pur essendo leggero e veloce, può non cavarsela altrettanto bene in attività più complesse come scrittura o coding rispetto ai modelli più grandi, ma per la sua taglia è un gran performer. Se le tue priorità sono velocità ed efficienza, StableLM-Zephyr è una scelta solida.

- Parametri: 3B

- Accesso: https://github.com/StabilityAI/stablelm

- Open source: Sì

8. TinyLlama

Parliamo di TinyLlama, un modello compatto con 1,1 miliardi di parametri che rende molto bene per la sua dimensione. È progettato per l’efficienza ed è perfetto per dispositivi che non possono gestire il carico computazionale dei modelli più grandi.

Per compiti reali, TinyLlama fa meglio di modelli come Pythia-1.4B, soprattutto nel ragionamento di buon senso. Non ha la potenza bruta di modelli come LLaMA 13B, ma offre un ottimo equilibrio tra prestazioni ed efficienza delle risorse. È quindi ideale quando servono buone capacità di AI senza sovraccaricare il sistema, specialmente su dispositivi mobile ed edge.

- Parametri: 1,1B

- Accesso: https://github.com/tinyLlama

- Open source: Sì

9. MobileLLaMA

MobileLLaMA è una versione specializzata di LLaMA pensata per rendere al meglio su dispositivi mobili e a bassa potenza. Con 1,4 miliardi di parametri, è progettata per offrire un buon equilibrio tra prestazioni ed efficienza, soprattutto su device con risorse limitate.

MobileLLaMA è ottimizzata per applicazioni AI veloci e a bassa latenza in mobilità. Con versioni come MobileLLaMA-1.4B e MobileLLaMA-2.7B, supera agevolmente modelli più piccoli come TinyLLaMA 1.1B e compete da vicino con OpenLLaMA 3B, risultando al contempo circa il 40% più veloce. Se ti serve AI in tempo reale direttamente sul dispositivo, MobileLLaMA è l’ideale. Porta prestazioni elevate su mobile o su sistemi edge senza bisogno di infrastrutture pesanti.

- Parametri: 1,4B

- Accesso: https://github.com/mobileLLaMA

- Open source: Sì

10. LaMini-GPT

LaMini-GPT è un modello compatto ma potente, tra 774 milioni e 1,5 miliardi di parametri, progettato specificamente per attività multilingue. È particolarmente forte in ambienti con risorse limitate: gestisce più lingue senza richiedere molta potenza di calcolo, ideale quindi per dispositivi o sistemi con poche risorse.

Un aspetto interessante è che LaMini-GPT è stato sviluppato tramite distillazione della conoscenza da modelli GPT più grandi, il che gli consente di rendere molto bene nei compiti di instruction-following. Con oltre 2,58 milioni di coppie istruzione-risposta nel dataset, è ottimizzato per gestire compiti e istruzioni specifiche in modo più efficiente rispetto a modelli più grandi. Tuttavia, pur essendo estremamente efficiente e leggero, soprattutto per compiti mirati, non è il massimo per applicazioni più ampie che richiedono profonda comprensione contestuale o generazione di testo generale. Se cerchi velocità ed efficienza, in particolare in scenari multilingue, LaMini-GPT è una scelta solida.

- Parametri: 774M – 1,5B

- Accesso: https://github.com/LaMiniGPT

- Open source: Sì

11. Gemma2

Passiamo a Gemma2. Questo modello conta 2 miliardi di parametri e funziona molto bene se stai pensando a un deployment locale. È leggero ed efficiente, ideale per attività come generazione di testo o traduzione.

Se lo confronti con pesi massimi come OpenAI o1-preview, Gemma2 punta alle applicazioni in tempo reale, non al ragionamento complesso. Per l’edge computing è l’alternativa perfetta a modelli come GPT-3.5 o Llama 65B, che sono molto esigenti in termini di risorse.

Se vuoi mettere le mani in pasta con questo SLM, leggi questo tutorial sul fine-tuning di Gemma 2 e il suo uso in locale.

- Parametri: versioni da 9 e 27 miliardi

- Accesso: https://ai.google.dev/gemma

- Open source: Sì, con licenza permissiva che consente ridistribuzione, fine-tuning e uso commerciale.

12. MiniCPM

MiniCPM offre un solido equilibrio tra prestazioni ed efficienza delle risorse, con dimensioni da 1 a 4 miliardi di parametri. È progettato per gestire con facilità attività linguistiche generali e garantisce prestazioni affidabili in tanti scenari, diventando un’ottima opzione tuttofare.

MiniCPM è scalabile ed efficiente. Nonostante la taglia ridotta, rende in linea con modelli molto più grandi come Mistral-7B e LLaMA 7B. È particolarmente ottimizzato per l’elaborazione linguistica in inglese e cinese, il che lo rende una valida alternativa leggera per ambienti con risorse limitate. Se lavori con poche risorse ma ti servono comunque buone capacità linguistiche, MiniCPM è un’ottima soluzione.

- Parametri: 1B – 4B

- Accesso: https://github.com/miniCPM

- Open source: Sì

13. OpenELM

OpenELM è un modello flessibile e adattabile, con un range di parametri da 270 milioni a 3 miliardi. È progettato per ambienti che richiedono multitasking e risposte a bassa latenza. Perfetto per compiti che necessitano di prestazioni in tempo reale su dispositivi più piccoli.

Sviluppato da Apple, OpenELM punta all’efficienza energetica e alle applicazioni on-device. Compete bene con modelli come MobiLlama e OLMo, mostrando miglioramenti significativi quando viene ottimizzato per compiti specifici. Con la sua ampia gamma di dimensioni, è ottimizzato per ambienti piccoli e vincolati, a differenza di modelli più pesanti come GPT-4 o LLaMA, che richiedono più risorse per prestazioni comparabili. Se cerchi qualcosa di leggero ma capace, soprattutto per uso mobile o edge, OpenELM è un’ottima scelta.

- Parametri: 270M – 3B

- Accesso: https://github.com/OpenELM

- Open source: Sì

14. DCLM

DCLM, un modello da 1 miliardo di parametri, è progettato specificamente per il ragionamento di buon senso. Si comporta bene in compiti reali in cui sono fondamentali comprensione e deduzioni logiche.

DCLM è valido per comprensione linguistica e ragionamento, soprattutto nella versione da 7 miliardi di parametri. Compete con modelli come LLaMA 2 (7B) e Mistral 7B, con prestazioni analoghe in compiti di ragionamento di buon senso e deduzione logica. Non è potente quanto modelli più grandi come LLaMA 13B, ma è altamente ottimizzato per applicazioni reali che richiedono efficienza e meno risorse computazionali; quando ti serve un buon livello di prestazioni senza infrastrutture pesanti, DCLM è un’ottima scelta.

- Parametri: 1B

- Accesso: https://github.com/DCLM

- Open source: Sì

15. Fox

Infine, il modello Fox, con 1,6 miliardi di parametri, è progettato specificamente per velocità ed efficienza. È ottimizzato per le applicazioni mobili, dove mantenere bassa la latenza è cruciale. Fox è costruito per fornire risposte rapide senza richiedere troppa potenza computazionale.

Fox rende molto bene quando serve velocità. Gestisce compiti a bassa latenza in modo fulmineo, il che è ottimo per dispositivi mobile o edge. Non eccelle nel ragionamento complesso, ma è perfetto quando ti servono risposte AI rapide ed efficienti e non puoi permetterti di usare molte risorse. È il modello di riferimento quando la potenza di calcolo è limitata ma la velocità è prioritaria.

- Parametri: 1,6B

- Accesso: https://github.com/foxmodel

- Open source: Sì

Confronto tra Small Language Models

Ricapitoliamo quanto visto con questa tabella:

|

Nome modello |

Parametri |

Open source |

Caratteristiche principali |

|

Qwen2 |

0,5B, 1B, 7B |

Sì |

Scalabile, adatto a vari compiti |

|

Mistral Nemo 12B |

12B |

Sì |

Compiti NLP complessi, deployment locale |

|

Llama 3.1 8B |

8B |

Sì* |

Equilibrio tra potenza ed efficienza |

|

Pythia |

160M - 2,8B |

Sì |

Focalizzato su ragionamento e coding |

|

Cerebras-GPT |

111M - 2,7B |

Sì |

Efficiente nel calcolo, segue le scaling laws di Chinchilla |

|

Phi-3.5 |

3,8B |

Sì** |

Context length lunga (128K token), multilingue |

|

StableLM-zephyr |

3B |

Sì |

Inferenza rapida, efficiente per sistemi edge |

|

TinyLlama |

1,1B |

Sì |

Efficiente per dispositivi mobile ed edge |

|

MobileLLaMA |

1,4B |

Sì |

Ottimizzato per dispositivi mobili e a bassa potenza |

|

LaMini-GPT |

774M - 1,5B |

Sì |

Multilingue, compiti di instruction-following |

|

Gemma2 |

9B, 27B |

Sì |

Deployment locale, applicazioni in tempo reale |

|

MiniCPM |

1B - 4B |

Sì |

Prestazioni bilanciate, ottimizzato per inglese e cinese |

|

OpenELM |

270M - 3B |

Sì |

Multitasking, bassa latenza, efficiente dal punto di vista energetico |

|

DCLM |

1B |

Sì |

Ragionamento di buon senso, deduzione logica |

|

Fox |

1,6B |

Sì |

Ottimizzato per la velocità nelle applicazioni mobile |

*Con restrizioni d’uso

**Solo per scopi di ricerca

Conclusione

E con questo è tutto: un piccolo tour nel mondo degli small language models nel 2026. Abbiamo visto come questi modelli dimostrino che più piccolo non significa più debole, anzi in molti casi più intelligente.

Aspettati di vedere sempre più SLM integrati nella tecnologia che usi ogni giorno. Ricorda: conta il modello giusto per il compito giusto—e spesso il modello giusto può essere piccolo e agile.

Per approfondire gli small language models, ti consiglio queste due risorse:

Ana Rojo Echeburúa è una specialista di AI e dati con un dottorato in Matematica Applicata. Le piace trasformare i dati in insight azionabili e ha una vasta esperienza nella guida di team tecnici. Ana ama collaborare da vicino con i clienti per risolvere le loro sfide di business e creare soluzioni di AI innovative. Nota per le sue capacità di problem solving e la comunicazione chiara, è appassionata di AI, in particolare di AI generativa. Ana è dedita all’apprendimento continuo e allo sviluppo etico dell’AI, oltre a semplificare problemi complessi e spiegare la tecnologia in modo accessibile.