Program

Small language models (SLMs) bersifat ringkas, efisien, dan tidak memerlukan server besar—berbeda dengan rekan besarnya, large language models (LLMs). Model ini dibuat untuk kecepatan dan kinerja real-time serta dapat dijalankan di ponsel pintar, tablet, atau jam tangan pintar Anda.

Dalam artikel ini, kita akan membahas 15 SLM teratas tahun 2026 dan menelusuri kelebihan, kekurangan, serta apa yang membuat tiap model unik.

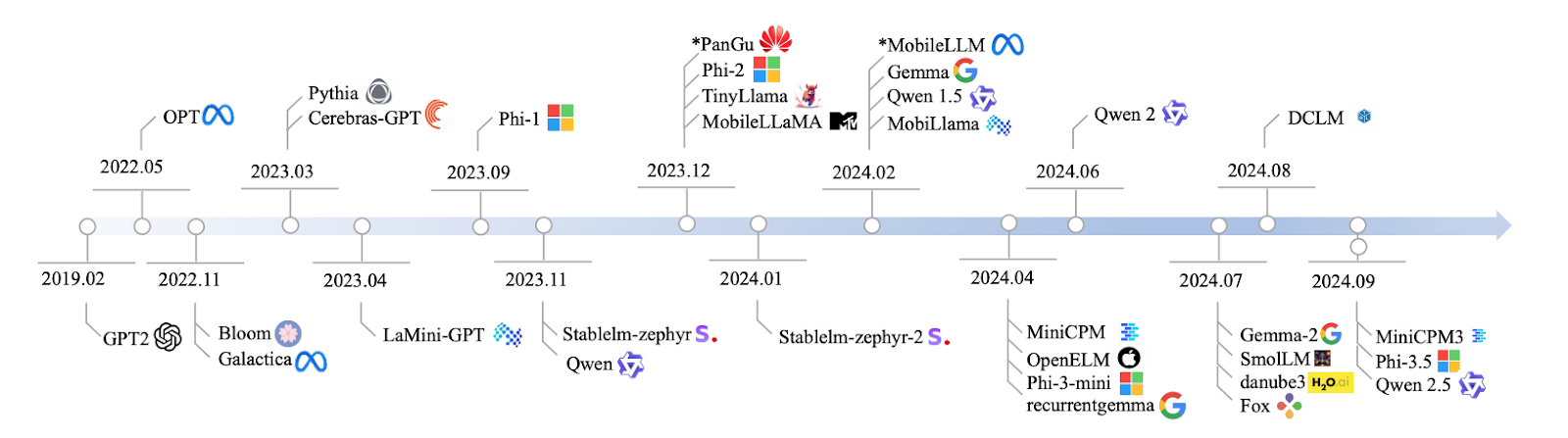

Sumber: Lu et al., 2024

Saya akan langsung membahas modelnya, namun jika Anda memerlukan pengantar tentang small language models, saya menulis artikel terpisah di sini: Small Language Models: A Guide With Examples.

1. Qwen2: 0.5B, 1B, dan 7B

Qwen2 adalah keluarga model, dengan ukuran dari 0,5 miliar hingga 7 miliar parameter. Jika Anda mengerjakan aplikasi yang membutuhkan model sangat ringan, versi 0.5B sangat tepat.

Namun, jika Anda memerlukan sesuatu yang lebih tangguh untuk tugas seperti peringkasan atau pembuatan teks, model 7B akan memberi performa terbaik. Model ini dapat diskalakan dan disesuaikan dengan kebutuhan spesifik Anda.

Model Qwen2 mungkin tidak menyamai kemampuan luas model AI raksasa dalam penalaran kompleks, tetapi sangat andal untuk banyak kegunaan praktis ketika kecepatan dan efisiensi paling utama. Model ini sangat berguna untuk aplikasi yang membutuhkan respons cepat atau sumber daya terbatas.

- Parameter: versi 0,5 miliar, 1 miliar, dan 7 miliar

- Akses: https://huggingface.co/Qwen

- Sumber terbuka: Ya, dengan lisensi open-source

2. Mistral Nemo 12B

Dengan 12 miliar parameter, Mistral Nemo 12B sangat cocok untuk tugas NLP kompleks seperti penerjemahan bahasa dan sistem dialog real-time. Model ini bersaing dengan model seperti Falcon 40B dan Chinchilla 70B, namun tetap dapat dijalankan secara lokal tanpa infrastruktur besar. Ini salah satu model yang menyeimbangkan kompleksitas dan kepraktisan.

- Parameter: 12 miliar

- Akses: https://huggingface.co/mistralai/Mistral-7B-Instruct-v0.2

- Sumber terbuka: Ya, dengan lisensi Apache 2.0

3. Llama 3.1 8B

Berlanjut ke Llama 3.1 8B, model ini memiliki 8 miliar parameter dan memberikan keseimbangan luar biasa antara daya dan efisiensi. Sangat baik untuk tugas seperti tanya jawab dan analisis sentimen.

Llama 3.1 8B memberikan performa yang cukup baik jika Anda membutuhkan hasil cepat tanpa daya komputasi besar. Sempurna bagi yang menginginkan kecepatan tanpa mengorbankan akurasi.

Untuk pengalaman langsung dengan model ini, baca tutorial tentang RAG dengan Llama 3.1 8B, Ollama, dan Langchain.

- Parameter: 8 miliar

- Akses: https://ollama.com/library/llama3

- Sumber terbuka: Ya, tetapi dengan pembatasan penggunaan

4. Pythia

Mari membahas seri Pythia, sekumpulan model dari 160 juta hingga 2,8 miliar parameter, dirancang untuk tugas penalaran dan keterampilan pemrograman. Jika Anda berkecimpung di pengembangan perangkat lunak, Pythia sangat baik untuk menangani tugas terstruktur berbasis logika di mana akurasi dan nalar adalah kunci. Sempurna untuk lingkungan coding yang membutuhkan pola pikir terstruktur dan logis.

Dibandingkan model lain seperti GPT-Neo, Pythia lebih unggul pada tugas seperti coding dan penalaran karena dibangun untuk aplikasi terfokus ini. Namun, ketika digunakan pada tugas bahasa yang lebih umum, hasilnya bisa sedikit goyah—Phi 3.5 dan Llama 3.1 8B mungkin lebih konsisten di area yang lebih luas tersebut. Satu hal yang patut dicatat adalah transparansi pelatihan publik Pythia dan opsi kustomisasinya yang sangat mengesankan. Anda dapat menyesuaikannya dengan kebutuhan spesifik Anda, menjadikannya alat yang sangat fleksibel.

- Parameter: 160M – 2,8B

- Akses: https://github.com/EleutherAI/pythia

- Sumber terbuka: Ya

5. Cerebras-GPT

Cerebras-GPT adalah model yang efisien dan cepat. Dengan parameter dari 111 juta hingga 2,7 miliar, model ini dirancang untuk lingkungan dengan sumber daya komputasi terbatas, namun tetap membutuhkan performa hebat. Cerebras-GPT menghadirkan hasil yang sangat baik tanpa menguras semua sumber daya Anda.

Dibandingkan model yang lebih besar seperti GPT-3 atau LLaMA 13B, Cerebras-GPT mungkin tidak memiliki pelatihan seluas itu, tetapi mengikuti hukum penskalaan Chinchilla, yang berarti sangat hemat komputasi. Model seperti GPT-J dan GPT-NeoX mungkin lebih bongsor, namun Cerebras-GPT memaksimalkan performa sambil menekan penggunaan sumber daya. Jika Anda membutuhkan skalabilitas dan efisiensi, model ini dioptimalkan untuk memberikan keduanya sekaligus.

- Parameter: 111M – 2,7B

- Akses: https://github.com/Cerebras

- Sumber terbuka: Ya

6. Phi-3.5

Model ini memiliki 3,8 miliar parameter, dan yang membuatnya unik: panjang konteks 128K token. Apa artinya? Ia dapat menangani dokumen panjang atau tugas dengan percakapan multi-giliran tanpa kehilangan konteks. Model ini juga multibahasa, sehingga menjadi pesaing kuat terhadap model seperti Llama 13B dan GPT-3.5, namun dengan kebutuhan komputasi jauh lebih rendah. Model ini sangat baik untuk peringkasan dokumen, tugas multibahasa, dan penalaran logis.

- Parameter: 3,8 miliar

- Akses: https://huggingface.co/microsoft/phi-2

- Sumber terbuka: Ya, hanya untuk tujuan riset.

7. StableLM-zephyr

StableLM-Zephyr adalah model bahasa kecil dengan 3 miliar parameter yang sangat baik saat Anda menginginkan akurasi dan kecepatan. Model ini memberikan inferensi cepat dan tampil sangat baik di lingkungan yang membutuhkan pengambilan keputusan cepat, seperti sistem edge atau perangkat ber-sumber daya rendah. Jika Anda butuh sesuatu yang tajam dan cepat, StableLM-Zephyr adalah pilihan bagus.

StableLM-Zephyr unggul dalam tugas yang melibatkan penalaran dan bahkan role-playing. Meski lebih ringan dan cepat, model ini mungkin tidak sebaik model lebih besar dalam tugas kompleks seperti penulisan atau coding, tetapi untuk ukurannya, kinerjanya sangat baik. Jika kecepatan dan efisiensi menjadi prioritas, StableLM-Zephyr adalah pilihan solid.

- Parameter: 3B

- Akses: https://github.com/StabilityAI/stablelm

- Sumber terbuka: Ya

8. TinyLlama

TinyLlama adalah model ringkas dengan 1,1 miliar parameter yang berkinerja sangat baik untuk ukurannya. Dirancang agar efisien, dan sempurna untuk perangkat yang tidak mampu menangani beban komputasi berat dari model yang lebih besar.

Untuk tugas dunia nyata, TinyLlama sebenarnya lebih baik daripada model seperti Pythia-1.4B, khususnya dalam penalaran akal sehat. Ia tidak memiliki kekuatan mentah seperti LLaMA 13B, namun memiliki keseimbangan yang baik antara kinerja dan efisiensi sumber daya. Ini menjadikannya ideal untuk skenario yang membutuhkan kemampuan AI kuat tanpa membebani sistem, terutama pada perangkat seluler dan edge.

- Parameter: 1,1B

- Akses: https://github.com/tinyLlama

- Sumber terbuka: Ya

9. MobileLLaMA

MobileLLaMA adalah versi khusus LLaMA yang dibangun untuk tampil sangat baik pada perangkat seluler dan perangkat berdaya rendah. Dengan 1,4 miliar parameter, model ini dirancang untuk memberi keseimbangan antara performa dan efisiensi, khususnya pada perangkat dengan sumber daya terbatas.

MobileLLaMA dioptimalkan untuk aplikasi AI berkecepatan tinggi dan latensi rendah saat bepergian. Dengan versi seperti MobileLLaMA-1.4B dan MobileLLaMA-2.7B, model ini dengan mudah melampaui model yang lebih kecil seperti TinyLLaMA 1.1B dan bersaing ketat dengan OpenLLaMA 3B—sekaligus sekitar 40% lebih cepat. Jika Anda membutuhkan AI real-time langsung di perangkat, MobileLLaMA sangat cocok. Model ini dibangun untuk menghadirkan AI berperforma tinggi langsung ke perangkat seluler atau sistem edge tanpa perlu infrastruktur berat.

- Parameter: 1,4B

- Akses: https://github.com/mobileLLaMA

- Sumber terbuka: Ya

10. LaMini-GPT

LaMini-GPT adalah model ringkas namun bertenaga dalam rentang 774 juta hingga 1,5 miliar parameter yang dirancang khusus untuk tugas multibahasa. Model ini sangat kuat di lingkungan dengan sumber daya terbatas, artinya mampu menangani banyak bahasa tanpa membutuhkan daya komputasi besar, cocok untuk perangkat atau sistem dengan keterbatasan sumber daya.

Hal menarik dari LaMini-GPT adalah dikembangkan melalui distilasi pengetahuan dari model GPT yang lebih besar, sehingga berkinerja sangat baik pada tugas mengikuti instruksi. Dengan lebih dari 2,58 juta pasangan instruksi-respons dalam datasetnya, model ini dioptimalkan untuk menangani tugas dan instruksi spesifik dengan lebih efisien dibanding model yang lebih besar. Namun, meskipun sangat efisien dan ringan, terutama untuk tugas terfokus, model ini tidak begitu unggul untuk aplikasi yang lebih luas yang memerlukan pemahaman konteks mendalam atau generasi teks umum. Jika Anda mencari yang cepat dan efisien, khususnya dalam skenario multibahasa, LaMini-GPT adalah pilihan solid.

- Parameter: 774M – 1,5B

- Akses: https://github.com/LaMiniGPT

- Sumber terbuka: Ya

11. Gemma2

Sekarang mari membahas Gemma2. Model ini memiliki 2 miliar parameter, dan bekerja sangat baik jika Anda mempertimbangkan penerapan lokal. Ringan dan efisien—ideal untuk hal-hal seperti pembuatan teks atau terjemahan.

Jika dibandingkan dengan yang kelas berat seperti OpenAI o1-preview, Gemma2 berfokus pada aplikasi real-time, bukan penalaran kompleks. Untuk komputasi edge, ini adalah alternatif sempurna untuk model seperti GPT-3.5 atau Llama 65B yang rakus sumber daya.

Jika Anda ingin praktik langsung dengan SLM ini, baca tutorial tentang fine-tuning Gemma 2 dan menggunakannya secara lokal.

- Parameter: versi 9 miliar dan 27 miliar

- Akses: https://ai.google.dev/gemma

- Sumber terbuka: Ya, dengan lisensi permisif yang memungkinkan redistribusi, fine-tuning, dan penggunaan komersial.

12. MiniCPM

MiniCPM adalah model dengan keseimbangan solid antara performa dan efisiensi sumber daya, dengan ukuran parameter dari 1 miliar hingga 4 miliar. Dirancang untuk menangani tugas bahasa umum dengan mudah dan menawarkan performa andal di banyak aplikasi, menjadikannya opsi serba bisa yang hebat.

MiniCPM dapat diskalakan dan efisien. Meski ukurannya lebih kecil, kinerjanya setara dengan model yang jauh lebih besar seperti Mistral-7B dan LLaMA 7B. Model ini dioptimalkan khususnya untuk pemrosesan bahasa dalam bahasa Inggris dan Mandarin, menjadikannya alternatif ringan yang sangat mumpuni untuk lingkungan dengan sumber daya komputasi terbatas. Jika Anda bekerja dalam kondisi terbatas tetapi tetap membutuhkan pemrosesan bahasa yang solid, MiniCPM menawarkan solusi yang sangat baik.

- Parameter: 1B – 4B

- Akses: https://github.com/miniCPM

- Sumber terbuka: Ya

13. OpenELM

OpenELM adalah model yang fleksibel dan mudah diadaptasi dengan rentang parameter dari 270 juta hingga 3 miliar. Dirancang untuk lingkungan yang membutuhkan multitugas dan respons berlatensi rendah. Sempurna untuk tugas yang memerlukan performa real-time di perangkat yang lebih kecil.

Dikembangkan oleh Apple, OpenELM berfokus pada efisiensi energi dan aplikasi AI on-device. Model ini bersaing baik melawan model seperti MobiLlama dan OLMo, menunjukkan peningkatan signifikan saat dituning untuk tugas tertentu. Dengan rentang ukuran parameter yang luas, OpenELM dioptimalkan untuk lingkungan yang lebih kecil dan terbatas, berbeda dengan model yang lebih berat seperti GPT-4 atau LLaMA, yang memerlukan lebih banyak sumber daya untuk memberikan kinerja sebanding. Jika Anda mencari yang ringan namun mumpuni, terutama untuk penggunaan mobile atau edge, OpenELM sangat cocok.

- Parameter: 270M – 3B

- Akses: https://github.com/OpenELM

- Sumber terbuka: Ya

14. DCLM

Mari mengulas DCLM, model dengan 1 miliar parameter yang dirancang khusus untuk penalaran akal sehat. Model ini tampil baik pada tugas dunia nyata yang mengutamakan pemahaman dan penarikan kesimpulan logis.

DCLM bagus untuk pemahaman bahasa dan penalaran, terutama pada versi 7 miliar parameternya. Model ini bersaing dengan LLaMA 2 (7B) dan Mistral 7B, dengan kinerja setara pada tugas penalaran akal sehat dan deduksi logis. Memang tidak sekuat model yang lebih besar seperti LLaMA 13B, tetapi DCLM sangat dioptimalkan untuk aplikasi dunia nyata yang memerlukan efisiensi dan lebih sedikit sumber daya komputasi, sehingga untuk lingkungan yang membutuhkan performa kuat tanpa infrastruktur berat, DCLM adalah pilihan tepat.

- Parameter: 1B

- Akses: https://github.com/DCLM

- Sumber terbuka: Ya

15. Fox

Terakhir, model Fox, model 1,6 miliar parameter yang dirancang khusus untuk kecepatan dan efisiensi. Dioptimalkan untuk aplikasi seluler, di mana menjaga latensi tetap rendah sangat penting. Fox dibangun untuk memberikan respons cepat tanpa menguras terlalu banyak daya komputasi.

Fox berkinerja sangat baik di lingkungan yang membutuhkan kecepatan. Model ini menangani tugas berlatensi rendah dengan sangat cepat, yang sangat cocok untuk perangkat seluler atau edge. Ia tidak sekuat dalam penalaran kompleks, tetapi Fox sempurna untuk situasi yang membutuhkan respons AI cepat dan efisien serta tidak bisa menggunakan sumber daya berat. Ini adalah model andalan ketika daya komputasi terbatas tetapi kecepatan menjadi prioritas.

- Parameter: 1,6B

- Akses: https://github.com/foxmodel

- Sumber terbuka: Ya

Perbandingan Small Language Models

Mari kita ringkas yang telah kita bahas melalui tabel berikut:

|

Nama Model |

Parameter |

Sumber Terbuka |

Fitur Utama |

|

Qwen2 |

0.5B, 1B, 7B |

Ya |

Dapat diskalakan, cocok untuk berbagai tugas |

|

Mistral Nemo 12B |

12B |

Ya |

Tugas NLP kompleks, penerapan lokal |

|

Llama 3.1 8B |

8B |

Ya* |

Keseimbangan daya dan efisiensi |

|

Pythia |

160M - 2.8B |

Ya |

Terfokus pada penalaran dan coding |

|

Cerebras-GPT |

111M - 2.7B |

Ya |

Hemat komputasi, mengikuti hukum penskalaan Chinchilla |

|

Phi-3.5 |

3.8B |

Ya** |

Panjang konteks panjang (128K token), multibahasa |

|

StableLM-zephyr |

3B |

Ya |

Inferensi cepat, efisien untuk sistem edge |

|

TinyLlama |

1.1B |

Ya |

Efisien untuk perangkat seluler dan edge |

|

MobileLLaMA |

1.4B |

Ya |

Dioptimalkan untuk perangkat mobile dan berdaya rendah |

|

LaMini-GPT |

774M - 1.5B |

Ya |

Multibahasa, tugas mengikuti instruksi |

|

Gemma2 |

9B, 27B |

Ya |

Penerapan lokal, aplikasi real-time |

|

MiniCPM |

1B - 4B |

Ya |

Performa seimbang, dioptimalkan untuk Inggris dan Mandarin |

|

OpenELM |

270M - 3B |

Ya |

Multitugas, latensi rendah, hemat energi |

|

DCLM |

1B |

Ya |

Penalaran akal sehat, deduksi logis |

|

Fox |

1.6B |

Ya |

Dioptimalkan untuk kecepatan pada aplikasi seluler |

*Dengan pembatasan penggunaan

**Hanya untuk tujuan riset

Kesimpulan

Demikian ulasan singkat tentang small language models di tahun 2026. Kita melihat bagaimana model yang lebih kecil tidak berarti lebih lemah—dalam banyak hal justru lebih cerdas.

Harapkan SLM ini makin terintegrasi dalam pengalaman teknologi harian Anda. Ingat, yang terpenting adalah model yang tepat untuk tugasnya—dan dalam banyak kasus, model yang tepat bisa jadi justru kecil dan lincah.

Untuk mempelajari lebih lanjut tentang small language models, saya merekomendasikan dua sumber berikut:

Ana Rojo Echeburúa adalah spesialis AI dan data dengan gelar PhD di Bidang Matematika Terapan. Ia senang mengubah data menjadi wawasan yang dapat ditindaklanjuti dan memiliki pengalaman luas dalam memimpin tim teknis. Ana menikmati bekerja langsung dengan klien untuk menyelesaikan masalah bisnis mereka dan menciptakan solusi AI yang inovatif. Dikenal karena keterampilan pemecahan masalah dan komunikasi yang jelas, ia sangat antusias terhadap AI, terutama AI generatif. Ana berkomitmen pada pembelajaran berkelanjutan dan pengembangan AI yang etis, serta menyederhanakan masalah kompleks dan menjelaskan teknologi dengan cara yang mudah dipahami.