Kurs

GPT-4 gibi büyük dil modelleri (LLM’ler) inanılmaz bir ilerleme sağladı, ancak bazı sınırlamalarla birlikte geliyorlar—güncel olmayan bilgi, halüsinasyonlar ve genel geçer yanıtlar. Bu, Retrieval Augmented Generation (RAG) kullanarak çözebileceğimiz bir sorun.

Bu blogda, RAG’in nasıl çalıştığını, neden yapay zeka uygulamaları için oyunun kurallarını değiştirdiğini ve işletmelerin bunu nasıl kullanarak daha akıllı, daha güvenilir sistemler oluşturduğunu anlatacağım.

RAG Nedir?

Retrieval Augmented Generation (RAG), LLM’leri harici veri kaynaklarıyla entegre ederek geliştiren bir tekniktir. GPT-4 gibi modellerin üretken yeteneklerini, kesin bilgi getirme mekanizmalarıyla birleştirerek RAG, yapay zeka sistemlerinin daha doğru ve bağlama uygun yanıtlar üretmesini sağlar.

LLM’ler güçlüdür ancak doğalarından gelen sınırlamalara sahiptir:

- Sınırlı bilgi: LLM’ler yalnızca eğitim verilerine dayanarak yanıt üretebilir; bu veriler güncel olmayabilir veya alanına özgü bilgileri içermeyebilir.

- Halüsinasyonlar: Bu modeller bazen kulağa makul gelen fakat yanlış bilgiler üretebilir.

- Genel yanıtlar: Harici kaynaklara erişim olmadan LLM’ler belirsiz veya tam isabetli olmayan yanıtlar verebilir.

RAG, modellerin veritabanları, dokümantasyon ve API’ler gibi yapılandırılmış ve yapılandırılmamış veri kaynaklarından güncel ve alanına özgü bilgi getirmesine olanak tanıyarak bu sorunları ele alır.

LLM’leri Geliştirmek İçin Neden RAG Kullanmalı? Bir Örnek

RAG’in ne olduğunu ve nasıl çalıştığını daha iyi göstermek için, günümüzde birçok işletmenin karşılaştığı bir senaryoyu ele alalım.

Akıllı telefon ve dizüstü bilgisayar gibi cihazlar satan bir elektronik şirketinde yönetici olduğunuzu düşünün. Ürün özellikleri, sorun giderme, garanti bilgileri ve daha fazlasıyla ilgili kullanıcı sorularını yanıtlayacak bir müşteri destek sohbet botu oluşturmak istiyorsunuz.

Sohbet botunuzu çalıştırmak için GPT-3 veya GPT-4 gibi LLM’lerin yeteneklerinden yararlanmak istiyorsunuz.

Ancak büyük dil modellerinin aşağıdaki sınırlamaları vardır ve bu da verimsiz bir müşteri deneyimine yol açar:

Spesifik bilgi eksikliği

Dil modelleri, eğitim verilerine dayalı olarak genel yanıtlar vermekle sınırlıdır. Kullanıcılar sattığınız yazılıma özgü sorular sorarsa veya derinlemesine sorun giderme hakkında bilgi isterse, geleneksel bir LLM doğru yanıtlar veremeyebilir.

Bunun nedeni, bu modellerin sizin kurumunuza özgü verilerle eğitilmemiş olmasıdır. Ayrıca bu modellerin eğitim verilerinin bir kesme tarihi vardır; bu da güncel yanıt verme yeteneklerini sınırlar.

Halüsinasyonlar

LLM’ler “halüsinasyon” görebilir; yani uydurma olgulara dayanarak kendinden emin bir şekilde yanlış yanıtlar üretme eğilimindedir. Doğru cevabı olmadığında konuyla alakasız yanıtlar da verebilirler; bu da kötü bir müşteri deneyimine neden olur.

Genel yanıtlar

Dil modelleri sıklıkla belirli bağlamlara uyarlanmamış genel yanıtlar verir. Bu, müşteri desteği senaryosunda önemli bir dezavantaj olabilir; çünkü kişiselleştirilmiş bir deneyim için genellikle bireysel kullanıcı tercihlerini dikkate almak gerekir.

RAG, LLM’lerin genel bilgi tabanını, ürün veritabanınız ve kullanıcı kılavuzlarınızda yer alan veriler gibi spesifik bilgilere erişim ile entegre etmenin bir yolunu sunarak bu boşlukları etkili şekilde kapatır. Bu yöntem, kurumunuzun ihtiyaçlarına göre uyarlanmış, son derece doğru ve güvenilir yanıtlar sağlar.

RAG Nasıl Çalışır?

Artık RAG’in ne olduğunu anladığınıza göre, bu yapının kurulmasında yer alan adımlara bakalım:

Adım 1: Veri toplama

Öncelikle uygulamanız için gerekli tüm verileri toplamalısınız. Bir elektronik şirketi için müşteri destek sohbet botu özelinde, buna kullanıcı kılavuzları, bir ürün veritabanı ve SSS listesi dahil olabilir.

Adım 2: Veriyi parçalara ayırma (chunking)

Veri parçalama, verilerinizi daha küçük ve yönetilebilir parçalara bölme işlemidir. Örneğin, uzun bir 100 sayfalık kullanıcı kılavuzunuz varsa, bunu farklı müşteri sorularını yanıtlayabilecek bölümlere ayırabilirsiniz.

Böylece her veri parçası belirli bir konuya odaklanır. Kaynak veri setinden bilgi getirildiğinde, tüm belgenin ilgisiz kısımlarını dahil etmekten kaçındığımız için elde edilen bilginin kullanıcının sorusuna doğrudan uygulanabilir olma olasılığı artar.

Bu aynı zamanda verimliliği artırır; sistem tüm belgeleri işlemek yerine en ilgili bilgi parçalarını hızla elde edebilir.

Adım 3: Belge gömlemeleri

Kaynak veriler daha küçük parçalara ayrıldıktan sonra, bir vektör gösterimine dönüştürülmesi gerekir. Bu, metin verilerinin, metnin ardındaki anlamsal içeriği yakalayan sayısal temsiller olan gömlemelere dönüştürülmesini içerir.

Basitçe söylemek gerekirse, belge gömlemeleri sistemin kullanıcı sorularını anlamasını ve metnin anlamına dayalı olarak, basit kelime kelime karşılaştırma yerine, kaynak veri setindeki ilgili bilgilerle eşleştirmesini sağlar. Bu yöntem, yanıtların ilgili ve kullanıcının sorusuyla uyumlu olmasını güvence altına alır.

Metin verilerinin vektör temsillerine nasıl dönüştürüldüğü hakkında daha fazla bilgi edinmek isterseniz, OpenAI API ile metin gömlemeleri hakkındaki eğitimimize göz atmanızı öneririz.

Adım 4: Kullanıcı sorgularını işleme

Bir kullanıcı sorgusu sisteme girdiğinde, bunun da bir gömme ya da vektör temsiline dönüştürülmesi gerekir. Tutarlılık için hem belge hem de sorgu gömlemesi için aynı model kullanılmalıdır.

Sorgu bir gömmeye dönüştürüldükten sonra, sistem sorgu gömmesini belge gömlemeleriyle karşılaştırır. Kosinüs benzerliği ve Öklid uzaklığı gibi ölçümler kullanarak, gömmeleri sorgu gömmesine en çok benzeyen parçaları belirleyip getirir.

Bu parçalar, kullanıcının sorusuyla en ilgili içerik olarak kabul edilir.

Adım 5: Bir LLM ile yanıt üretme

Getirilen metin parçaları, ilk kullanıcı sorgusuyla birlikte bir dil modeline beslenir. Algoritma bu bilgiyi kullanarak sohbet arayüzü üzerinden kullanıcının sorularına tutarlı bir yanıt üretir.

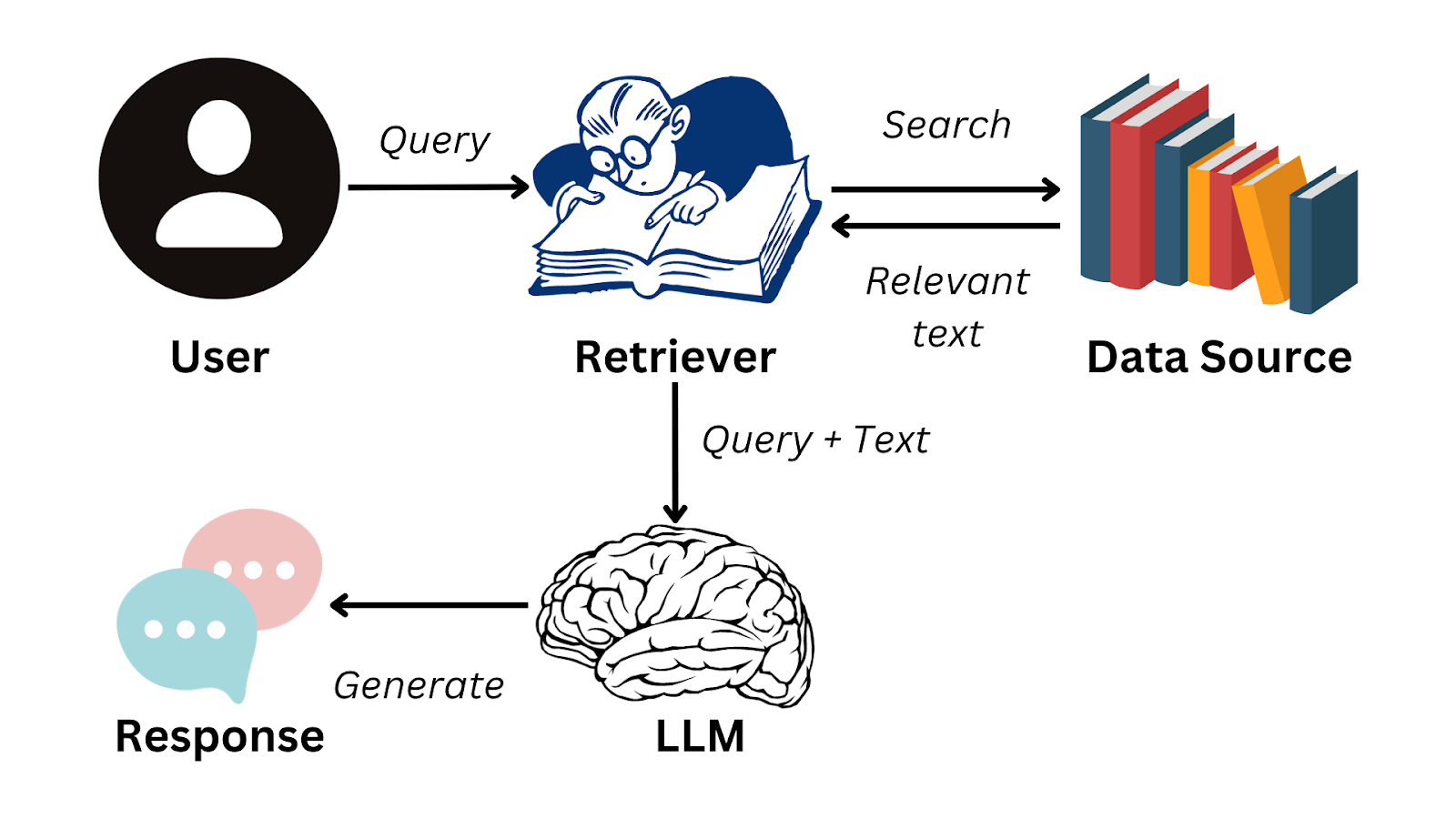

İşte RAG’in nasıl çalıştığını özetleyen basitleştirilmiş bir akış şeması:

Yazarın görseli

LLM’lerle yanıt üretmek için gereken adımları sorunsuzca gerçekleştirmek üzere LlamaIndex gibi bir veri çerçevesi kullanabilirsiniz.

Bu çözüm, harici veri kaynaklarından GPT-3 gibi dil modellerine bilgi akışını verimli biçimde yöneterek kendi LLM uygulamalarınızı geliştirmenize olanak tanır. Bu çerçeve hakkında daha fazla bilgi edinmek ve LLM tabanlı uygulamalar oluşturmak için nasıl kullanabileceğinizi öğrenmek üzere LlamaIndex hakkındaki eğitimimizi okuyun.

RAG’in Pratik Uygulamaları

Artık RAG’in LLM’lerin eğitim verileri dışındaki bilgilere dayanarak tutarlı yanıtlar vermesini sağladığını biliyoruz. Bu tür bir sistemin, kurumsal verimliliği ve kullanıcı deneyimini iyileştiren çeşitli iş kullanım alanları vardır. Yazının başlarında ele aldığımız müşteri sohbet botu örneğinin yanı sıra, RAG’in bazı pratik uygulamaları şunlardır:

Metin özetleme

RAG, harici kaynaklardaki içeriği kullanarak doğru özetler üretebilir ve ciddi zaman tasarrufu sağlar. Örneğin, yöneticiler ve üst düzey yöneticiler, kapsamlı raporları satır satır incelemeye vakit bulamayabilir.

RAG destekli bir uygulama ile metin verilerinden en kritik bulgulara hızla erişebilir, uzun belgeleri okumak yerine daha verimli şekilde karar alabilirler.

Kişiselleştirilmiş öneriler

RAG sistemleri, geçmiş satın alımlar ve yorumlar gibi müşteri verilerini analiz ederek ürün önerileri üretebilir. Bu, kullanıcının genel deneyimini artırır ve nihayetinde kuruma daha fazla gelir sağlar.

Örneğin, RAG uygulamaları, kullanıcının izleme geçmişi ve puanlarına göre yayın platformlarında daha iyi film önerileri sunmak için kullanılabilir. E-ticaret platformlarındaki yazılı değerlendirmeleri analiz etmek için de kullanılabilirler.

LLM’ler metin verilerinin ardındaki anlamı kavrama konusunda başarılı olduğundan, RAG sistemleri, geleneksel bir öneri sistemine kıyasla daha incelikli kişiselleştirilmiş öneriler sunabilir.

İş zekâsı

Kurumlar genellikle rakip davranışlarını izleyip pazar eğilimlerini analiz ederek iş kararları alır. Bu, iş raporlarında, finansal tablolarda ve pazar araştırması belgelerinde yer alan verilerin titizlikle analiz edilmesiyle yapılır.

Bir RAG uygulamasıyla kurumlar bu belgelerdeki eğilimleri elle analiz edip belirlemek zorunda kalmaz. Bunun yerine, anlamlı içgörüleri verimli şekilde çıkarmak ve pazar araştırması sürecini iyileştirmek için bir LLM’den yararlanılabilir.

RAG Sistemlerinin Uygulanmasında Zorluklar ve En İyi Uygulamalar

RAG uygulamaları bilgi getirme ile doğal dil işlemi arasındaki boşluğu kapatmamıza olanak tanırken, uygulamaları bazı özgün zorluklar barındırır. Bu bölümde, RAG uygulamaları geliştirirken karşılaşılan karmaşıklıkları inceleyecek ve bunların nasıl hafifletilebileceğini tartışacağız.

Entegrasyon karmaşıklığı

Bir getirme sistemini bir LLM ile entegre etmek zor olabilir. Farklı formatlarda birden fazla harici veri kaynağı olduğunda bu karmaşıklık artar. RAG sistemine beslenen verilerin tutarlı olması, üretilen gömlemelerin de tüm veri kaynakları arasında yeknesak olması gerekir.

Bu zorluğun üstesinden gelmek için, farklı veri kaynaklarını bağımsız olarak ele alan ayrı modüller tasarlanabilir. Her modüldeki veriler daha sonra tutarlılık için ön işleme tabi tutulabilir ve gömlemelerin tutarlı bir biçime sahip olmasını sağlamak üzere standartlaştırılmış bir model kullanılabilir.

Ölçeklenebilirlik

Veri miktarı arttıkça, RAG sisteminin verimliliğini korumak daha zorlu hale gelir. Gömleme üretme, farklı metin parçaları arasındaki anlamı karşılaştırma ve veriyi gerçek zamanlı getirme gibi birçok karmaşık işlem gerçekleştirilmelidir.

Bu görevler hesaplama açısından yoğundur ve kaynak veri boyutu arttıkça sistemi yavaşlatabilir.

Bu sorunu ele almak için, hesaplama yükünü farklı sunucular arasında dağıtabilir ve sağlam bir donanım altyapısına yatırım yapabilirsiniz. Yanıt süresini iyileştirmek için, sıkça sorulan sorguları önbelleğe almak da faydalı olabilir.

Vektör veritabanlarının uygulanması, RAG sistemlerindeki ölçeklenebilirlik sorununu da hafifletebilir. Bu veritabanları, gömlemelerle kolayca çalışmanıza ve her sorguyla en yakından ilişkili vektörleri hızla getirmenize olanak tanır.

Bir RAG uygulamasında vektör veritabanlarının nasıl uygulandığı hakkında daha fazla bilgi edinmek isterseniz, GPT ve Milvus ile Retrieval Augmented Generation başlıklı canlı kodlama oturumumuzu izleyebilirsiniz. Bu eğitim, açık kaynaklı bir vektör veritabanı olan Milvus’u GPT modelleriyle birleştirmeye yönelik adım adım bir rehber sunar.

Veri kalitesi

Bir RAG sisteminin etkinliği, büyük ölçüde sisteme beslenen verinin kalitesine bağlıdır. Uygulamanın eriştiği kaynak içerik zayıfsa, üretilen yanıtlar da hatalı olacaktır.

Kurumların titiz bir içerik kürasyonu ve ince ayar sürecine yatırım yapması gerekir. Veri kaynaklarının kalitesini artırmak için rafine edilmesi şarttır. Ticari uygulamalarda, veri setini bir RAG sisteminde kullanmadan önce, içerikteki boşlukları gözden geçirmek ve doldurmak üzere konu uzmanlarını sürece dahil etmek faydalı olabilir.

Son Düşünceler

RAG, LLM’lerin dil yeteneklerinden, uzmanlaşmış bir veritabanıyla birlikte yararlanmak için bugün bilinen en iyi tekniktir. Bu sistemler, dil modelleriyle çalışırken karşılaşılan en kritik zorlukların bazılarını ele alır ve doğal dil işleme alanında yenilikçi bir çözüm sunar.

Ancak, diğer tüm teknolojiler gibi RAG uygulamalarının da sınırlamaları vardır—özellikle de girdi verisinin kalitesine bağımlılıkları. RAG sistemlerinden en iyi şekilde yararlanmak için sürece insan denetimini dahil etmek kritik önemdedir.

Veri kaynaklarının titizlikle küratörlüğü ve uzman bilgisi, bu çözümlerin güvenilirliğini sağlamak için zorunludur.

RAG dünyasını daha derinlemesine keşfetmek ve etkili yapay zeka uygulamaları geliştirmek için nasıl kullanılabileceğini anlamak isterseniz, LangChain ile yapay zeka uygulamaları geliştirme konulu canlı eğitimimizi izleyebilirsiniz. Bu eğitim, gerçek dünya senaryolarında RAG sistemlerinin uygulanmasını sağlayan bir kütüphane olan LangChain ile uygulamalı deneyim sunar.

SSS

RAG hangi tür verileri getirebilir?

RAG, ürün kılavuzları, müşteri destek belgeleri, hukuki metinler ve gerçek zamanlı API bilgileri dahil olmak üzere yapılandırılmış ve yapılandırılmamış verileri getirebilir.

RAG herhangi bir LLM ile entegre edilebilir mi?

Evet, RAG; OpenAI’nın GPT modelleri, BERT tabanlı modeller ve diğer transformer mimarileri dahil olmak üzere çeşitli dil modelleriyle uygulanabilir.

RAG gerçek zamanlı uygulamalarda kullanılabilir mi?

Evet, RAG müşteri hizmetleri sohbet botları ve AI asistanları gibi gerçek zamanlı uygulamalarda kullanılabilir; ancak performans, getirme ve yanıt üretiminin verimliliğine bağlıdır.

RAG, bir LLM’i ince ayar yapmaya (fine-tuning) kıyasla nasıldır?

RAG, modeli yeniden eğitmeden dinamik güncellemeler sağlar ve yeni bilgilere daha uyarlanabilir hale getirir; buna karşın ince ayar (fine-tuning) belirli veriler üzerinde yeniden eğitim gerektirir.

RAG, getirme için belirli bir veritabanı türü gerektirir mi?

Hayır, RAG belirli bir veritabanı türü gerektirmez; SQL veritabanları, NoSQL veritabanları ve FAISS ile Milvus gibi vektör veritabanları dahil çeşitli veri saklama çözümleriyle çalışabilir.

Natassha , veri bilimi ile pazarlamanın kesişiminde çalışan bir veri danışmanıdır. Verilerin, akıllıca kullanıldığında, bireyler ve kurumlar için olağanüstü bir büyüme ilhamı olabileceğine inanır. Kendi kendini yetiştirmiş bir veri profesyoneli olarak Natassha , veri bilimi alanına girmek isteyenlere yardımcı olacak makaleler yazmayı sever. Kişisel blogundaki ve harici yayınlardaki makaleleri aylık ortalama 200 bin görüntülenme almaktadır.

Retrieval Augmented Generation (RAG) SSS

Retrieval Augmented Generation (RAG) nedir?

RAG, önceden eğitilmiş büyük dil modellerinin (LLM) yeteneklerini harici veri kaynaklarıyla birleştiren ve daha incelikli, daha doğru AI yanıtları sağlayan bir tekniktir.

RAG, LLM’lerin işlevselliğini geliştirmede neden önemlidir?

RAG, LLM’lerin genel yanıt verme eğilimi, yanlış yanıtlar üretme (halüsinasyon) ve spesifik bilgi eksikliği gibi temel sınırlamalarını ele alır. LLM’leri belirli harici verilerle entegre ederek daha kesin, güvenilir ve bağlama özgü yanıtlar sağlar.

RAG nasıl çalışır? Uygulanmasında hangi adımlar yer alır?

RAG; veri toplama, veriyi parçalara ayırma, belge gömlemeleri, kullanıcı sorgularını işleme ve bir LLM kullanarak yanıt üretme gibi birkaç adımdan oluşur. Bu süreç, sistemin kullanıcı sorgularını harici veri kaynaklarındaki ilgili bilgilerle doğru şekilde eşleştirmesini sağlar.

RAG sistemlerini uygulamadaki bazı zorluklar nelerdir ve nasıl ele alınabilir?

Zorluklar arasında entegrasyon karmaşıklığı, ölçeklenebilirlik ve veri kalitesi bulunur. Çözümler; farklı veri kaynakları için ayrı modüller oluşturmayı, sağlam altyapıya yatırım yapmayı ve titiz içerik kürasyonu ile ince ayar sağlamayı içerir.

RAG, GPT-3 veya GPT-4 dışında farklı türde dil modelleriyle entegre edilebilir mi?

Evet, RAG; GPT-3 veya GPT-4 dışında, sofistike dil anlama ve üretme yeteneğine sahip çeşitli dil modelleriyle çalışabilir. Etkililik, modelin özgül güçlü yanlarına göre değişir.

RAG’i geleneksel arama motorları veya veritabanlarından ayıran nedir?

RAG, arama motorlarının getirme kabiliyetini dil modellerinin incelikli anlama ve yanıt üretme yeteneğiyle birleştirir; böylece yalnızca belgeleri getirmek yerine bağlam farkındalığı yüksek ve ayrıntılı yanıtlar sunar.