Courses

Các mô hình ngôn ngữ lớn (LLM) như GPT-4 đã mang lại những bước tiến đáng kinh ngạc, nhưng chúng cũng có hạn chế—kiến thức lỗi thời, hiện tượng "ảo giác" và câu trả lời chung chung. Đó là vấn đề có thể giải quyết bằng Retrieval Augmented Generation (RAG).

Trong bài viết này, tôi sẽ phân tích cách RAG hoạt động, vì sao đây là bước ngoặt cho các ứng dụng AI, và cách doanh nghiệp đang sử dụng nó để tạo ra hệ thống thông minh, đáng tin cậy hơn.

RAG là gì?

Retrieval Augmented Generation (RAG) là một kỹ thuật nâng cao LLM bằng cách tích hợp với các nguồn dữ liệu bên ngoài. Bằng cách kết hợp khả năng sinh của các mô hình như GPT-4 với cơ chế truy xuất thông tin chính xác, RAG cho phép hệ thống AI tạo ra câu trả lời chính xác hơn và phù hợp với ngữ cảnh.

LLM rất mạnh nhưng có các hạn chế cố hữu:

- Kiến thức hạn chế: LLM chỉ có thể tạo câu trả lời dựa trên dữ liệu huấn luyện, vốn có thể đã lỗi thời hoặc thiếu thông tin chuyên sâu theo lĩnh vực.

- Ảo giác: Đôi khi các mô hình này tạo ra thông tin nghe có vẻ hợp lý nhưng sai.

- Câu trả lời chung chung: Nếu không truy cập nguồn bên ngoài, LLM có thể đưa ra câu trả lời mơ hồ hoặc thiếu chính xác.

RAG khắc phục những vấn đề này bằng cách cho phép mô hình truy xuất thông tin cập nhật và chuyên biệt từ cả dữ liệu có cấu trúc và phi cấu trúc, như cơ sở dữ liệu, tài liệu và API.

Vì sao dùng RAG để cải thiện LLM? Ví dụ minh họa

Để minh họa rõ hơn RAG là gì và cách kỹ thuật này hoạt động, hãy xét một tình huống mà nhiều doanh nghiệp hiện nay đang gặp.

Hãy tưởng tượng bạn là lãnh đạo của một công ty điện tử bán các thiết bị như điện thoại thông minh và máy tính xách tay. Bạn muốn tạo một chatbot hỗ trợ khách hàng để trả lời câu hỏi liên quan đến thông số sản phẩm, xử lý sự cố, thông tin bảo hành, và nhiều nội dung khác.

Bạn muốn tận dụng khả năng của các LLM như GPT-3 hoặc GPT-4 để vận hành chatbot.

Tuy nhiên, các mô hình ngôn ngữ lớn có những hạn chế sau, dẫn đến trải nghiệm khách hàng kém hiệu quả:

Thiếu thông tin cụ thể

Các mô hình ngôn ngữ bị giới hạn ở những câu trả lời chung chung dựa trên dữ liệu huấn luyện. Nếu người dùng hỏi các câu cụ thể về phần mềm bạn bán, hoặc cần hướng dẫn xử lý sự cố chuyên sâu, một LLM truyền thống có thể không đưa ra câu trả lời chính xác.

Nguyên nhân là vì chúng không được huấn luyện trên dữ liệu riêng của tổ chức bạn. Hơn nữa, dữ liệu huấn luyện có ngày cắt, hạn chế khả năng cung cấp câu trả lời cập nhật.

Ảo giác

LLM có thể "ảo giác", nghĩa là chúng tự tin tạo ra câu trả lời sai dựa trên các "sự kiện" tưởng tượng. Thuật toán cũng có thể đưa ra câu trả lời lạc đề nếu không có đáp án chính xác cho câu hỏi, gây trải nghiệm không tốt cho khách hàng.

Câu trả lời chung chung

Các mô hình ngôn ngữ thường đưa ra câu trả lời chung, không phù hợp bối cảnh cụ thể. Đây là điểm trừ lớn trong hỗ trợ khách hàng, vì nhu cầu cá nhân hóa theo từng người dùng thường rất quan trọng.

RAG lấp đầy những khoảng trống này bằng cách cho phép bạn tích hợp nền tảng tri thức tổng quát của LLM với khả năng truy cập thông tin cụ thể, như dữ liệu trong cơ sở dữ liệu sản phẩm và hướng dẫn sử dụng. Cách làm này cho phép tạo ra câu trả lời chính xác, đáng tin cậy và phù hợp với nhu cầu của tổ chức bạn.

RAG hoạt động như thế nào?

Giờ bạn đã hiểu RAG là gì, hãy xem các bước để thiết lập khung này:

Bước 1: Thu thập dữ liệu

Trước tiên bạn phải thu thập tất cả dữ liệu cần thiết cho ứng dụng. Với chatbot hỗ trợ khách hàng của công ty điện tử, dữ liệu có thể gồm hướng dẫn sử dụng, cơ sở dữ liệu sản phẩm và danh sách câu hỏi thường gặp (FAQ).

Bước 2: Chia nhỏ dữ liệu (chunking)

Chia nhỏ dữ liệu là quá trình tách dữ liệu thành các phần nhỏ, dễ xử lý hơn. Ví dụ, nếu bạn có một tài liệu hướng dẫn 100 trang, bạn có thể tách thành nhiều phần, mỗi phần có thể trả lời những câu hỏi khác nhau của khách hàng.

Cách này giúp mỗi mảnh dữ liệu tập trung vào một chủ đề cụ thể. Khi truy xuất thông tin từ tập dữ liệu nguồn, thông tin được lấy sẽ có nhiều khả năng phù hợp trực tiếp với câu hỏi, vì ta tránh đưa kèm nội dung không liên quan từ cả tài liệu dài.

Điều này cũng cải thiện hiệu suất, vì hệ thống có thể nhanh chóng lấy những phần thông tin liên quan nhất thay vì xử lý toàn bộ tài liệu.

Bước 3: Tạo embeddings cho tài liệu

Sau khi dữ liệu nguồn được chia nhỏ, cần chuyển đổi chúng thành biểu diễn vector. Việc này bao gồm biến văn bản thành embeddings, tức các biểu diễn số học nắm bắt ý nghĩa ngữ nghĩa của văn bản.

Nói đơn giản, embeddings cho tài liệu giúp hệ thống hiểu truy vấn của người dùng và ghép nối với thông tin phù hợp trong tập nguồn dựa trên ý nghĩa văn bản, thay vì chỉ so sánh từ-với-từ. Cách này đảm bảo câu trả lời phù hợp và ăn khớp với truy vấn.

Nếu bạn muốn tìm hiểu thêm về cách chuyển văn bản thành biểu diễn vector, hãy xem hướng dẫn về text embeddings với OpenAI API của chúng tôi.

Bước 4: Xử lý truy vấn người dùng

Khi truy vấn của người dùng đi vào hệ thống, truy vấn đó cũng phải được chuyển thành embedding hay biểu diễn vector. Cùng một mô hình cần được dùng cho cả embedding của tài liệu và của truy vấn để đảm bảo tính thống nhất.

Sau khi chuyển truy vấn thành embedding, hệ thống so sánh embedding của truy vấn với embeddings của tài liệu. Hệ thống xác định và truy xuất các mảnh dữ liệu có embedding giống nhất với embedding của truy vấn, sử dụng các thước đo như độ tương đồng cosine và khoảng cách Euclid.

Những mảnh này được xem là phù hợp nhất với truy vấn của người dùng.

Bước 5: Tạo câu trả lời bằng LLM

Các mảnh văn bản được truy xuất, cùng với truy vấn ban đầu, sẽ được đưa vào mô hình ngôn ngữ. Thuật toán sử dụng thông tin này để tạo ra câu trả lời mạch lạc cho câu hỏi của người dùng thông qua giao diện trò chuyện.

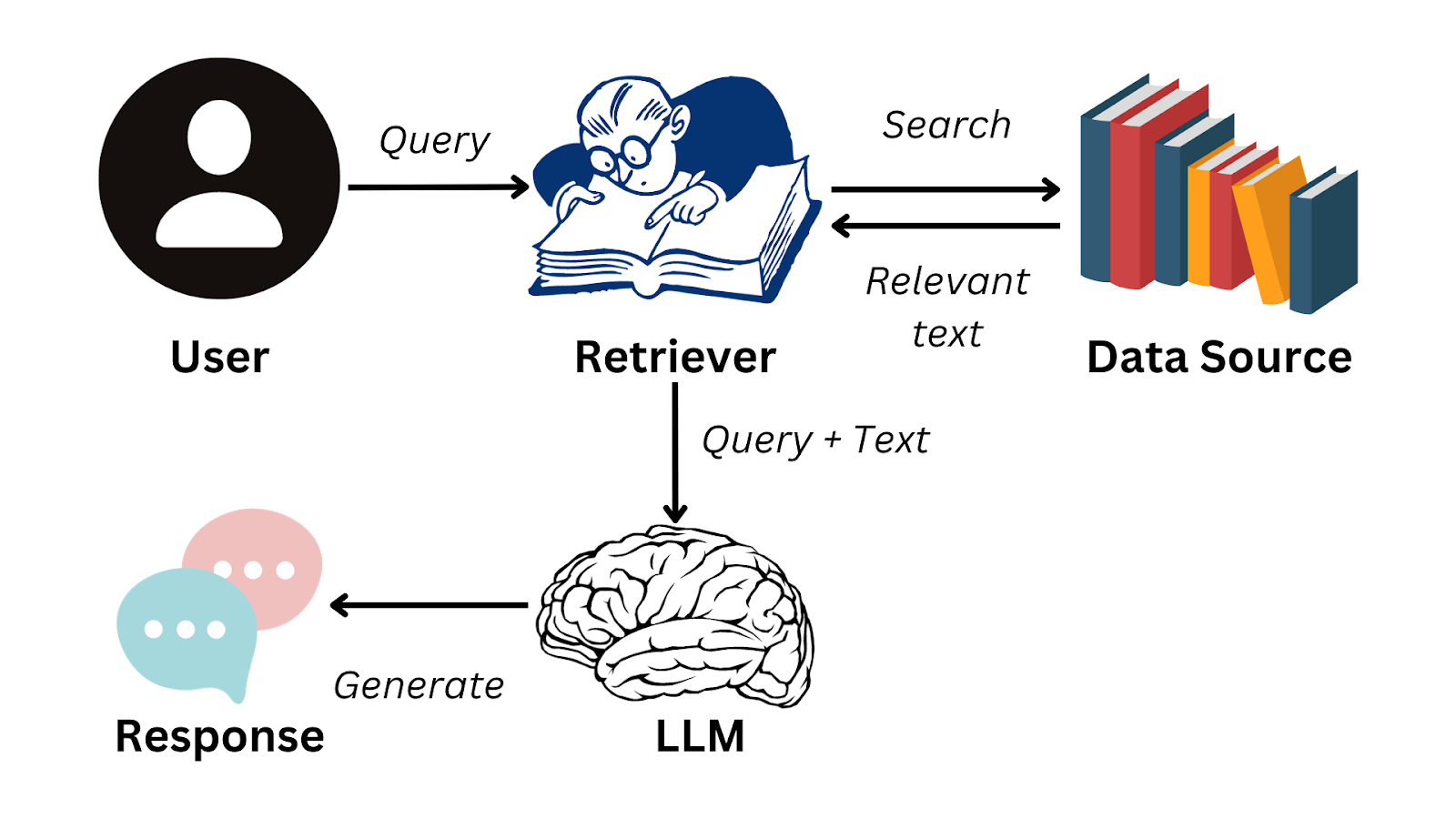

Dưới đây là sơ đồ quy trình tóm tắt cách RAG hoạt động:

Hình ảnh của tác giả

Để thực hiện trơn tru các bước cần thiết nhằm tạo câu trả lời bằng LLM, bạn có thể dùng một khung dữ liệu như LlamaIndex.

Giải pháp này cho phép bạn phát triển ứng dụng LLM của riêng mình bằng cách quản lý hiệu quả luồng thông tin từ nguồn dữ liệu bên ngoài đến các mô hình ngôn ngữ như GPT-3. Để tìm hiểu thêm về khung này và cách dùng để xây dựng ứng dụng dựa trên LLM, hãy đọc hướng dẫn về LlamaIndex của chúng tôi.

Ứng dụng thực tiễn của RAG

Chúng ta đã biết RAG cho phép LLM tạo câu trả lời mạch lạc dựa trên thông tin nằm ngoài dữ liệu huấn luyện. Một hệ thống như vậy có nhiều trường hợp sử dụng trong kinh doanh giúp cải thiện hiệu suất tổ chức và trải nghiệm người dùng. Ngoài ví dụ chatbot chăm sóc khách hàng đã nêu, dưới đây là một số ứng dụng thực tế của RAG:

Tóm tắt văn bản

RAG có thể dùng nội dung từ nguồn bên ngoài để tạo bản tóm tắt chính xác, tiết kiệm đáng kể thời gian. Chẳng hạn, các quản lý và lãnh đạo cấp cao thường bận rộn và không có thời gian đọc kỹ các báo cáo dài.

Với ứng dụng dùng RAG, họ có thể nhanh chóng nắm bắt những phát hiện quan trọng nhất từ dữ liệu văn bản và ra quyết định hiệu quả hơn thay vì đọc hết tài liệu dài.

Gợi ý cá nhân hóa

Hệ thống RAG có thể phân tích dữ liệu khách hàng, như lịch sử mua hàng và đánh giá, để đưa ra gợi ý sản phẩm. Điều này nâng cao trải nghiệm tổng thể của người dùng và cuối cùng tạo thêm doanh thu cho tổ chức.

Ví dụ, các ứng dụng RAG có thể gợi ý phim hay hơn trên nền tảng phát trực tuyến dựa trên lịch sử xem và xếp hạng của người dùng. Chúng cũng có thể phân tích các đánh giá viết tay trên nền tảng thương mại điện tử.

Vì LLM giỏi trong việc hiểu ngữ nghĩa đằng sau dữ liệu văn bản, hệ thống RAG có thể đưa ra gợi ý cá nhân hóa tinh tế hơn so với hệ thống gợi ý truyền thống.

Trí tuệ doanh nghiệp

Tổ chức thường ra quyết định kinh doanh bằng cách theo dõi đối thủ và phân tích xu hướng thị trường. Điều này được thực hiện bằng cách phân tích cẩn thận dữ liệu trong báo cáo kinh doanh, báo cáo tài chính và tài liệu nghiên cứu thị trường.

Với ứng dụng RAG, tổ chức không còn phải phân tích thủ công và tìm xu hướng trong các tài liệu này. Thay vào đó, có thể dùng LLM để rút ra insight có ý nghĩa một cách hiệu quả và cải thiện quy trình nghiên cứu thị trường.

Thách thức và thực tiễn tốt khi triển khai hệ thống RAG

Mặc dù ứng dụng RAG giúp kết nối giữa truy xuất thông tin và xử lý ngôn ngữ tự nhiên, việc triển khai lại có một số thách thức riêng. Phần này sẽ xem xét các phức tạp khi xây dựng ứng dụng RAG và cách giảm thiểu chúng.

Độ phức tạp tích hợp

Tích hợp hệ thống truy xuất với LLM có thể khó. Độ phức tạp tăng khi có nhiều nguồn dữ liệu bên ngoài ở các định dạng khác nhau. Dữ liệu đưa vào hệ thống RAG phải nhất quán, và embeddings tạo ra cần đồng nhất trên mọi nguồn.

Để vượt qua thách thức này, có thể thiết kế các mô-đun riêng xử lý từng nguồn dữ liệu độc lập. Dữ liệu trong mỗi mô-đun sau đó được tiền xử lý để thống nhất, và dùng một mô hình chuẩn hóa để đảm bảo embeddings có định dạng nhất quán.

Khả năng mở rộng

Khi lượng dữ liệu tăng, việc duy trì hiệu suất của hệ thống RAG trở nên khó hơn. Cần thực hiện nhiều thao tác phức tạp—như tạo embeddings, so sánh ý nghĩa giữa các đoạn văn bản, và truy xuất dữ liệu theo thời gian thực.

Những tác vụ này đòi hỏi nhiều tính toán và có thể làm chậm hệ thống khi quy mô dữ liệu nguồn tăng.

Để giải quyết, bạn có thể phân tán tải tính toán lên các máy chủ khác nhau và đầu tư hạ tầng phần cứng mạnh. Để cải thiện thời gian phản hồi, cũng có thể cache các truy vấn được hỏi thường xuyên.

Việc triển khai cơ sở dữ liệu vector cũng giúp giảm thách thức về khả năng mở rộng trong hệ thống RAG. Các cơ sở dữ liệu này giúp xử lý embeddings dễ dàng và có thể nhanh chóng truy xuất các vector gần nhất với mỗi truy vấn.

Nếu bạn muốn tìm hiểu thêm về việc triển khai cơ sở dữ liệu vector trong ứng dụng RAG, bạn có thể xem phiên code-along trực tiếp của chúng tôi, có tiêu đề Retrieval Augmented Generation with GPT and Milvus. Hướng dẫn này cung cấp từng bước kết hợp Milvus, một cơ sở dữ liệu vector mã nguồn mở, với các mô hình GPT.

Chất lượng dữ liệu

Hiệu quả của hệ thống RAG phụ thuộc lớn vào chất lượng dữ liệu đưa vào. Nếu nội dung nguồn mà ứng dụng truy cập kém chất lượng, các câu trả lời sinh ra sẽ thiếu chính xác.

Tổ chức cần đầu tư vào quy trình tuyển chọn nội dung và tinh chỉnh một cách cẩn trọng. Cần tinh lọc nguồn dữ liệu để nâng cao chất lượng. Với ứng dụng thương mại, việc mời chuyên gia lĩnh vực rà soát và lấp đầy khoảng trống thông tin trước khi dùng tập dữ liệu trong hệ thống RAG có thể rất hữu ích.

Kết luận

Hiện nay, RAG là kỹ thuật hiệu quả nhất để khai thác năng lực ngôn ngữ của LLM cùng với cơ sở dữ liệu chuyên biệt. Các hệ thống này giải quyết một số thách thức cấp bách khi làm việc với mô hình ngôn ngữ và mang đến giải pháp đổi mới trong lĩnh vực xử lý ngôn ngữ tự nhiên.

Tuy nhiên, giống như công nghệ khác, ứng dụng RAG cũng có hạn chế—đặc biệt là phụ thuộc vào chất lượng dữ liệu đầu vào. Để khai thác tối đa, điều cốt yếu là có sự giám sát của con người trong quy trình.

Việc tuyển chọn kỹ lưỡng nguồn dữ liệu, cùng với kiến thức chuyên gia, là điều bắt buộc để đảm bảo độ tin cậy của các giải pháp này.

Nếu bạn muốn tìm hiểu sâu hơn về RAG và cách dùng để xây dựng ứng dụng AI hiệu quả, bạn có thể xem buổi đào tạo trực tiếp của chúng tôi về xây dựng ứng dụng AI với LangChain. Hướng dẫn này sẽ cho bạn trải nghiệm thực hành với LangChain, một thư viện thiết kế để triển khai hệ thống RAG trong các tình huống thực tế.

Câu hỏi thường gặp (FAQ)

RAG có thể truy xuất những loại dữ liệu nào?

RAG có thể truy xuất dữ liệu có cấu trúc và phi cấu trúc, bao gồm sổ tay sản phẩm, tài liệu hỗ trợ khách hàng, văn bản pháp lý và thông tin API theo thời gian thực.

RAG có thể tích hợp với bất kỳ LLM nào không?

Có, RAG có thể được triển khai với nhiều mô hình ngôn ngữ khác nhau, bao gồm các mô hình GPT của OpenAI, các mô hình dựa trên BERT và những kiến trúc transformer khác.

RAG có thể dùng cho ứng dụng thời gian thực không?

Có, RAG có thể được dùng cho các ứng dụng thời gian thực như chatbot dịch vụ khách hàng và trợ lý AI, nhưng hiệu năng phụ thuộc vào khả năng truy xuất và tạo phản hồi hiệu quả.

RAG so với việc fine-tune một LLM thì như thế nào?

RAG cung cấp cập nhật động mà không cần huấn luyện lại mô hình, giúp thích ứng tốt hơn với thông tin mới, trong khi fine-tuning yêu cầu huấn luyện lại trên dữ liệu cụ thể.

RAG có yêu cầu loại cơ sở dữ liệu cụ thể nào để truy xuất không?

Không, RAG có thể hoạt động với nhiều giải pháp lưu trữ dữ liệu khác nhau, bao gồm cơ sở dữ liệu SQL, NoSQL và cơ sở dữ liệu vector như FAISS và Milvus.

Natassha là một chuyên viên tư vấn dữ liệu làm việc tại giao điểm giữa khoa học dữ liệu và tiếp thị. Cô tin rằng dữ liệu, khi được sử dụng khôn ngoan, có thể truyền cảm hứng cho sự phát triển vượt bậc của cá nhân và tổ chức. Là một chuyên gia dữ liệu tự học, Natassha thích viết các bài báo giúp những người theo đuổi khoa học dữ liệu bước chân vào ngành. Các bài viết trên blog cá nhân cũng như trên các ấn phẩm bên ngoài của cô thu hút trung bình 200 nghìn lượt xem mỗi tháng.

Câu hỏi thường gặp về Retrieval Augmented Generation (RAG)

Retrieval Augmented Generation (RAG) là gì?

RAG là một kỹ thuật kết hợp khả năng của các mô hình ngôn ngữ lớn (LLM) tiền huấn luyện với nguồn dữ liệu bên ngoài, cho phép AI đưa ra phản hồi tinh tế và chính xác hơn.

Vì sao RAG quan trọng trong việc cải thiện chức năng của LLM?

RAG giải quyết các hạn chế chính của LLM, như xu hướng đưa ra câu trả lời chung chung, tạo phản hồi sai (ảo giác) và thiếu thông tin cụ thể. Bằng cách tích hợp LLM với dữ liệu ngoài cụ thể, RAG cho phép phản hồi chính xác, đáng tin cậy và theo ngữ cảnh.

RAG hoạt động như thế nào? Có những bước nào trong triển khai?

RAG gồm nhiều bước: thu thập dữ liệu, chia nhỏ dữ liệu, tạo embeddings cho tài liệu, xử lý truy vấn người dùng, và tạo phản hồi bằng LLM. Quy trình này đảm bảo hệ thống ghép đúng truy vấn với thông tin liên quan từ nguồn dữ liệu bên ngoài.

Những thách thức khi triển khai hệ thống RAG là gì và có thể giải quyết ra sao?

Thách thức bao gồm độ phức tạp tích hợp, khả năng mở rộng và chất lượng dữ liệu. Giải pháp gồm tạo mô-đun riêng cho từng nguồn dữ liệu, đầu tư hạ tầng mạnh, và đảm bảo tuyển chọn nội dung cùng tinh chỉnh cẩn trọng.

RAG có thể tích hợp với các loại mô hình ngôn ngữ khác ngoài GPT-3 hay GPT-4 không?

Có, RAG có thể hoạt động với nhiều mô hình ngôn ngữ khác nhau, miễn là chúng có khả năng hiểu và sinh ngôn ngữ tinh vi. Hiệu quả phụ thuộc vào điểm mạnh cụ thể của từng mô hình.

Điểm khác biệt giữa RAG và các công cụ tìm kiếm hay cơ sở dữ liệu truyền thống là gì?

RAG kết hợp khả năng truy xuất của công cụ tìm kiếm với khả năng hiểu biết tinh tế và sinh phản hồi của mô hình ngôn ngữ, cung cấp câu trả lời theo ngữ cảnh và chi tiết thay vì chỉ trả về tài liệu.