Kursus

Model bahasa besar (LLM) seperti GPT-4 telah membawa kemajuan luar biasa, tetapi juga memiliki keterbatasan—pengetahuan yang kedaluwarsa, halusinasi, dan respons generik. Itu adalah masalah yang dapat kita atasi dengan Retrieval Augmented Generation (RAG).

Dalam blog ini, saya akan menguraikan cara kerja RAG, mengapa ini merupakan terobosan untuk aplikasi AI, dan bagaimana bisnis menggunakannya untuk membangun sistem yang lebih cerdas dan andal.

Apa Itu RAG?

Retrieval Augmented Generation (RAG) adalah teknik yang meningkatkan LLM dengan mengintegrasikannya dengan sumber data eksternal. Dengan menggabungkan kemampuan generatif model seperti GPT-4 dengan mekanisme pencarian informasi yang presisi, RAG memungkinkan sistem AI menghasilkan respons yang lebih akurat dan relevan secara kontekstual.

LLM sangat kuat tetapi memiliki keterbatasan bawaan:

- Pengetahuan terbatas: LLM hanya dapat menghasilkan respons berdasarkan data pelatihannya, yang mungkin kedaluwarsa atau tidak memiliki informasi khusus domain.

- Halusinasi: Model ini kadang menghasilkan informasi yang terdengar masuk akal tetapi salah.

- Respons generik: Tanpa akses ke sumber eksternal, LLM dapat memberikan jawaban yang samar atau kurang presisi.

RAG mengatasi masalah ini dengan memungkinkan model mengambil informasi yang mutakhir dan spesifik domain dari sumber data terstruktur dan tidak terstruktur, seperti basis data, dokumentasi, dan API.

Mengapa Menggunakan RAG untuk Meningkatkan LLM? Sebuah Contoh

Untuk menunjukkan apa itu RAG dan bagaimana teknik ini bekerja, mari pertimbangkan skenario yang banyak dihadapi bisnis saat ini.

Bayangkan Anda adalah eksekutif di perusahaan elektronik yang menjual perangkat seperti ponsel pintar dan laptop. Anda ingin membuat chatbot dukungan pelanggan untuk menjawab pertanyaan pengguna terkait spesifikasi produk, pemecahan masalah, informasi garansi, dan lainnya.

Anda ingin memanfaatkan kapabilitas LLM seperti GPT-3 atau GPT-4 untuk menggerakkan chatbot Anda.

Namun, model bahasa besar memiliki keterbatasan berikut yang berdampak pada pengalaman pelanggan yang kurang efisien:

Kurangnya informasi spesifik

Model bahasa terbatas pada jawaban generik berdasarkan data pelatihannya. Jika pengguna menanyakan hal-hal spesifik tentang perangkat lunak yang Anda jual, atau memiliki pertanyaan terkait cara melakukan pemecahan masalah secara mendalam, LLM tradisional mungkin tidak mampu memberikan jawaban yang akurat.

Ini karena model tersebut tidak dilatih pada data spesifik organisasi Anda. Selain itu, data pelatihan model memiliki tanggal batas, sehingga membatasi kemampuannya untuk memberikan jawaban yang mutakhir.

Halusinasi

LLM dapat “berhalusinasi,” artinya mereka cenderung dengan yakin menghasilkan jawaban yang salah berdasarkan fakta yang dibayangkan. Algoritme ini juga dapat memberikan respons yang tidak relevan jika tidak memiliki jawaban yang akurat atas pertanyaan pengguna, sehingga menurunkan pengalaman pelanggan.

Respons generik

Model bahasa sering memberikan respons generik yang tidak disesuaikan dengan konteks tertentu. Ini bisa menjadi kelemahan besar dalam skenario dukungan pelanggan karena preferensi individu biasanya diperlukan untuk menghadirkan pengalaman yang dipersonalisasi.

RAG secara efektif menjembatani kesenjangan ini dengan memberi Anda cara untuk menghubungkan basis pengetahuan umum LLM dengan kemampuan mengakses informasi spesifik, seperti data di basis data produk dan buku petunjuk pengguna Anda. Metodologi ini memungkinkan respons yang sangat akurat dan andal, disesuaikan dengan kebutuhan organisasi Anda.

Bagaimana Cara Kerja RAG?

Sekarang Anda memahami apa itu RAG, mari lihat langkah-langkah yang terlibat dalam menyiapkan kerangka kerja ini:

Langkah 1: Pengumpulan data

Pertama, Anda harus mengumpulkan semua data yang diperlukan untuk aplikasi Anda. Dalam kasus chatbot dukungan pelanggan untuk perusahaan elektronik, ini bisa mencakup buku petunjuk pengguna, basis data produk, dan daftar FAQ.

Langkah 2: Pemecahan data (data chunking)

Data chunking adalah proses memecah data menjadi bagian-bagian yang lebih kecil dan lebih mudah dikelola. Misalnya, jika Anda memiliki buku petunjuk pengguna setebal 100 halaman, Anda dapat memecahnya menjadi beberapa bagian, yang masing-masing berpotensi menjawab pertanyaan pelanggan yang berbeda.

Dengan cara ini, setiap potongan data berfokus pada topik tertentu. Saat informasi diambil dari dataset sumber, kemungkinannya lebih besar untuk langsung relevan dengan pertanyaan pengguna karena kita menghindari memasukkan informasi tidak relevan dari seluruh dokumen.

Ini juga meningkatkan efisiensi, karena sistem dapat dengan cepat mendapatkan potongan informasi paling relevan alih-alih memproses seluruh dokumen.

Langkah 3: Embedding dokumen

Setelah data sumber dipecah menjadi bagian yang lebih kecil, data tersebut perlu dikonversi ke dalam representasi vektor. Ini melibatkan transformasi data teks menjadi embedding, yaitu representasi numerik yang menangkap makna semantik di balik teks.

Secara sederhana, embedding dokumen memungkinkan sistem memahami pertanyaan pengguna dan mencocokkannya dengan informasi relevan dalam dataset sumber berdasarkan makna teks, bukan sekadar perbandingan kata demi kata. Metode ini memastikan respons yang relevan dan selaras dengan pertanyaan pengguna.

Jika Anda ingin mempelajari lebih lanjut cara data teks diubah menjadi representasi vektor, kami sarankan menjelajahi tutorial kami tentang embedding teks dengan OpenAI API.

Langkah 4: Menangani kueri pengguna

Saat kueri pengguna masuk ke sistem, kueri tersebut juga harus dikonversi menjadi embedding atau representasi vektor. Model yang sama harus digunakan untuk embedding dokumen dan embedding kueri untuk memastikan keseragaman.

Setelah kueri dikonversi menjadi embedding, sistem membandingkan embedding kueri dengan embedding dokumen. Sistem mengidentifikasi dan mengambil potongan yang embedding-nya paling mirip dengan embedding kueri, menggunakan ukuran seperti cosine similarity dan Euclidean distance.

Potongan-potongan ini dianggap paling relevan dengan pertanyaan pengguna.

Langkah 5: Menghasilkan respons dengan LLM

Potongan teks yang diambil, bersama dengan pertanyaan awal pengguna, dimasukkan ke model bahasa. Algoritme akan menggunakan informasi ini untuk menghasilkan jawaban yang koheren atas pertanyaan pengguna melalui antarmuka chat.

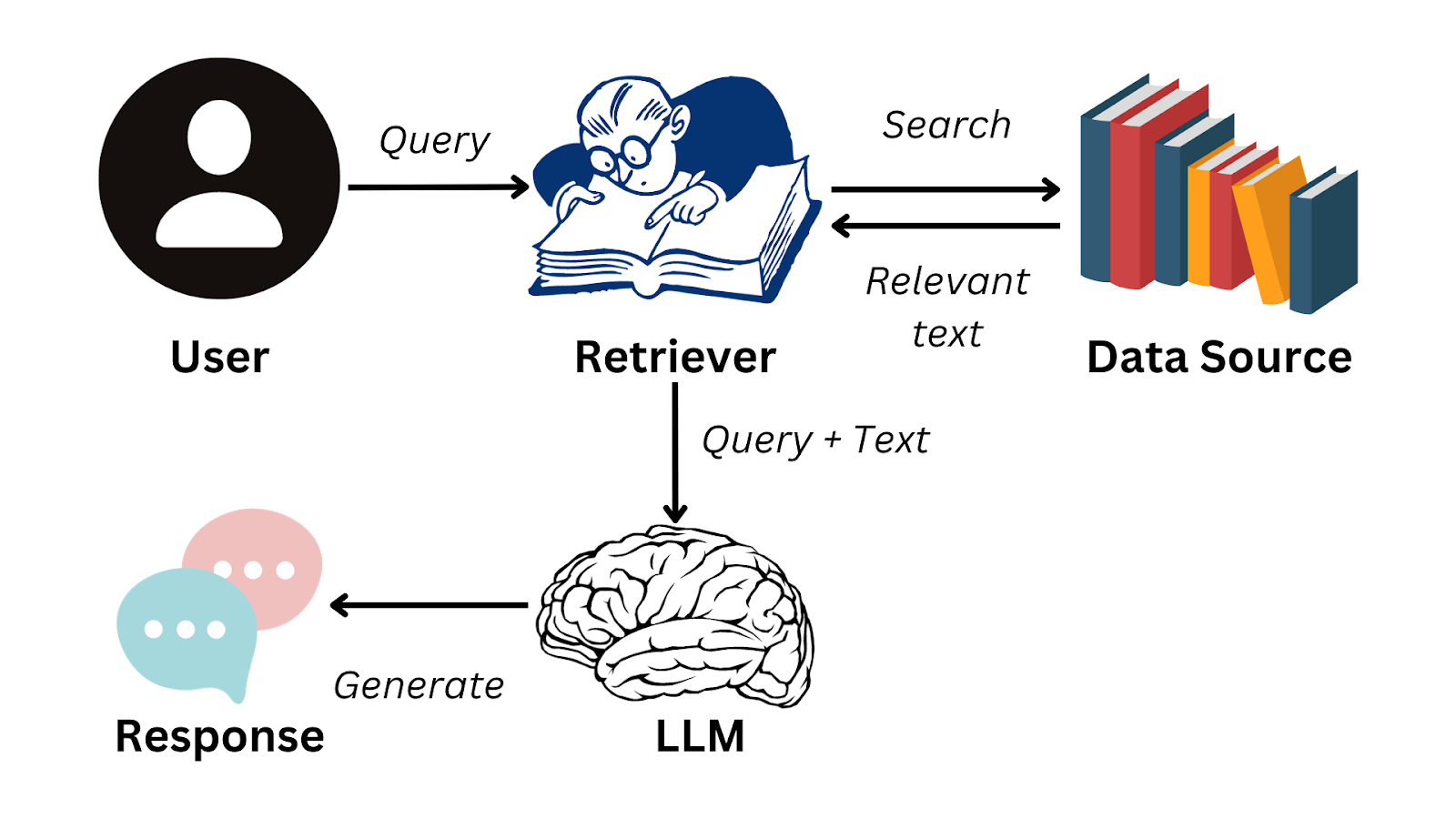

Berikut bagan alir sederhana yang merangkum cara kerja RAG:

Gambar oleh penulis

Untuk menyelesaikan langkah-langkah menghasilkan respons dengan LLM secara mulus, Anda dapat menggunakan kerangka data seperti LlamaIndex.

Solusi ini memungkinkan Anda mengembangkan aplikasi LLM sendiri dengan mengelola aliran informasi secara efisien dari sumber data eksternal ke model bahasa seperti GPT-3. Untuk mempelajari lebih lanjut tentang kerangka ini dan cara menggunakannya membangun aplikasi berbasis LLM, baca tutorial kami tentang LlamaIndex.

Aplikasi Praktis RAG

Kini kita tahu bahwa RAG memungkinkan LLM membentuk respons yang koheren berdasarkan informasi di luar data pelatihannya. Sistem seperti ini memiliki beragam use case bisnis yang akan meningkatkan efisiensi organisasi dan pengalaman pengguna. Selain contoh chatbot pelanggan yang kita lihat sebelumnya, berikut beberapa aplikasi praktis RAG:

Ringkasan teks

RAG dapat menggunakan konten dari sumber eksternal untuk menghasilkan ringkasan yang akurat, sehingga menghemat banyak waktu. Misalnya, manajer dan eksekutif tingkat tinggi adalah orang-orang sibuk yang tidak punya waktu untuk menelusuri laporan panjang.

Dengan aplikasi bertenaga RAG, mereka dapat dengan cepat menggali temuan paling kritis dari data teks dan mengambil keputusan lebih efisien tanpa harus membaca dokumen yang panjang.

Rekomendasi yang dipersonalisasi

Sistem RAG dapat digunakan untuk menganalisis data pelanggan, seperti riwayat pembelian dan ulasan, untuk menghasilkan rekomendasi produk. Ini akan meningkatkan pengalaman pengguna secara keseluruhan dan pada akhirnya menghasilkan lebih banyak pendapatan bagi organisasi.

Contohnya, aplikasi RAG dapat digunakan untuk merekomendasikan film yang lebih sesuai di platform streaming berdasarkan riwayat tontonan dan penilaian pengguna. Aplikasi ini juga dapat digunakan untuk menganalisis ulasan tertulis di platform e-niaga.

Karena LLM unggul dalam memahami semantik di balik data teks, sistem RAG dapat memberikan saran personal yang lebih bernuansa dibandingkan sistem rekomendasi tradisional.

Kecerdasan bisnis

Organisasi biasanya membuat keputusan bisnis dengan memantau perilaku pesaing dan menganalisis tren pasar. Ini dilakukan dengan menganalisis secara cermat data dalam laporan bisnis, laporan keuangan, dan dokumen riset pasar.

Dengan aplikasi RAG, organisasi tidak lagi harus menganalisis dan mengidentifikasi tren dalam dokumen-dokumen ini secara manual. Sebagai gantinya, LLM dapat digunakan untuk secara efisien memperoleh wawasan bermakna dan meningkatkan proses riset pasar.

Tantangan dan Praktik Terbaik Implementasi Sistem RAG

Meskipun aplikasi RAG memungkinkan kita menjembatani kesenjangan antara pencarian informasi dan pemrosesan bahasa alami, implementasinya menghadirkan beberapa tantangan unik. Pada bagian ini, kita akan membahas kompleksitas yang dihadapi saat membangun aplikasi RAG dan bagaimana cara menguranginya.

Kompleksitas integrasi

Mengintegrasikan sistem retrieval dengan LLM bisa sulit. Kompleksitas ini meningkat ketika terdapat banyak sumber data eksternal dengan format yang bervariasi. Data yang dimasukkan ke dalam sistem RAG harus konsisten, dan embedding yang dihasilkan perlu seragam di semua sumber data.

Untuk mengatasi tantangan ini, modul terpisah dapat dirancang untuk menangani berbagai sumber data secara independen. Data dalam setiap modul kemudian dapat dipraproses agar seragam, dan model standar dapat digunakan untuk memastikan embedding memiliki format yang konsisten.

Skalabilitas

Seiring bertambahnya jumlah data, semakin menantang untuk mempertahankan efisiensi sistem RAG. Banyak operasi kompleks harus dilakukan—seperti menghasilkan embedding, membandingkan makna antar potongan teks, dan mengambil data secara real-time.

Tugas-tugas ini intensif komputasi dan dapat memperlambat sistem seiring ukuran data sumber bertambah.

Untuk mengatasinya, Anda dapat mendistribusikan beban komputasi ke berbagai server dan berinvestasi pada infrastruktur perangkat keras yang tangguh. Untuk meningkatkan waktu respons, akan bermanfaat juga melakukan cache terhadap pertanyaan yang sering diajukan.

Penerapan basis data vektor juga dapat mengurangi tantangan skalabilitas pada sistem RAG. Basis data ini memudahkan Anda menangani embedding, dan dapat dengan cepat mengambil vektor yang paling selaras dengan setiap kueri.

Jika Anda ingin mempelajari lebih lanjut tentang penerapan basis data vektor dalam aplikasi RAG, Anda dapat menonton sesi live code-along kami berjudul Retrieval Augmented Generation with GPT and Milvus. Tutorial ini menawarkan panduan langkah demi langkah untuk menggabungkan Milvus, basis data vektor open-source, dengan model GPT.

Kualitas data

Efektivitas sistem RAG sangat bergantung pada kualitas data yang dimasukkan. Jika konten sumber yang diakses aplikasi buruk, respons yang dihasilkan akan tidak akurat.

Organisasi harus berinvestasi dalam kurasi konten yang saksama dan proses fine-tuning. Diperlukan penyempurnaan sumber data untuk meningkatkan kualitasnya. Untuk aplikasi komersial, akan bermanfaat melibatkan pakar materi untuk meninjau dan mengisi kesenjangan informasi sebelum menggunakan dataset dalam sistem RAG.

Pemikiran Akhir

Saat ini, RAG adalah teknik terbaik yang dikenal untuk memanfaatkan kapabilitas bahasa LLM bersama basis data khusus. Sistem ini mengatasi beberapa tantangan paling mendesak saat bekerja dengan model bahasa, dan menghadirkan solusi inovatif di bidang pemrosesan bahasa alami.

Namun, seperti teknologi lainnya, aplikasi RAG memiliki keterbatasan—terutama ketergantungan pada kualitas data masukan. Untuk memaksimalkan sistem RAG, keterlibatan pengawasan manusia sangat penting.

Kurasi sumber data yang teliti, beserta keahlian pakar, mutlak diperlukan untuk memastikan keandalan solusi ini.

Jika Anda ingin menyelami lebih jauh dunia RAG dan memahami bagaimana teknologi ini dapat digunakan untuk membangun aplikasi AI yang efektif, Anda dapat menonton pelatihan langsung kami tentang membangun aplikasi AI dengan LangChain. Tutorial ini akan memberi Anda pengalaman langsung dengan LangChain, sebuah pustaka yang dirancang untuk memungkinkan implementasi sistem RAG dalam skenario dunia nyata.

FAQ

Jenis data apa yang dapat diambil oleh RAG?

RAG dapat mengambil data terstruktur dan tidak terstruktur, termasuk buku petunjuk produk, dokumen dukungan pelanggan, teks hukum, dan informasi API real-time.

Apakah RAG dapat diintegrasikan dengan LLM apa pun?

Ya, RAG dapat diimplementasikan dengan berbagai model bahasa, termasuk model GPT dari OpenAI, model berbasis BERT, dan arsitektur transformer lainnya.

Apakah RAG dapat digunakan untuk aplikasi real-time?

Ya, RAG dapat digunakan dalam aplikasi real-time seperti chatbot layanan pelanggan dan asisten AI, tetapi kinerjanya bergantung pada efisiensi retrieval dan pembuatan respons.

Bagaimana perbandingan RAG dengan melakukan fine-tuning pada LLM?

RAG menyediakan pembaruan dinamis tanpa melatih ulang model, sehingga lebih mudah beradaptasi dengan informasi baru, sedangkan fine-tuning memerlukan pelatihan ulang pada data spesifik.

Apakah RAG memerlukan jenis basis data tertentu untuk retrieval?

Tidak, RAG dapat bekerja dengan berbagai solusi penyimpanan data, termasuk basis data SQL, NoSQL, dan basis data vektor seperti FAISS dan Milvus.

Natassha adalah seorang konsultan data yang bekerja di persimpangan ilmu data dan pemasaran. Ia meyakini bahwa data, ketika digunakan dengan bijak, dapat menginspirasi pertumbuhan luar biasa bagi individu dan organisasi. Sebagai profesional data autodidak, Natassha suka menulis artikel yang membantu para calon praktisi ilmu data menembus industri. Artikel-artikelnya di blog pribadi, serta publikasi eksternal, meraih rata-rata 200 ribu tayangan per bulan.

Pertanyaan Umum Retrieval Augmented Generation (RAG)

Apa itu Retrieval Augmented Generation (RAG)?

RAG adalah teknik yang menggabungkan kapabilitas model bahasa besar (LLM) pra-latih dengan sumber data eksternal, sehingga memungkinkan respons AI yang lebih bernuansa dan akurat.

Mengapa RAG penting untuk meningkatkan fungsionalitas LLM?

RAG mengatasi keterbatasan utama LLM, seperti kecenderungan memberikan jawaban generik, menghasilkan respons yang salah (halusinasi), dan kurangnya informasi spesifik. Dengan mengintegrasikan LLM dengan data eksternal yang spesifik, RAG memungkinkan respons yang lebih presisi, andal, dan kontekstual.

Bagaimana cara kerja RAG? Apa saja langkah-langkah dalam implementasinya?

RAG melibatkan beberapa langkah: pengumpulan data, pemecahan data (chunking), embedding dokumen, penanganan kueri pengguna, dan menghasilkan respons menggunakan LLM. Proses ini memastikan sistem mencocokkan kueri pengguna secara akurat dengan informasi relevan dari sumber data eksternal.

Apa saja tantangan dalam menerapkan sistem RAG dan bagaimana cara mengatasinya?

Tantangannya meliputi kompleksitas integrasi, skalabilitas, dan kualitas data. Solusinya mencakup membuat modul terpisah untuk berbagai sumber data, berinvestasi pada infrastruktur yang tangguh, serta memastikan kurasi konten dan fine-tuning yang saksama.

Bisakah RAG diintegrasikan dengan berbagai jenis model bahasa selain GPT-3 atau GPT-4?

Ya, RAG dapat bekerja dengan berbagai model bahasa, asalkan mampu memahami dan menghasilkan bahasa secara canggih. Efektivitasnya bervariasi sesuai kekuatan spesifik model.

Apa yang membedakan RAG dari mesin telusur atau basis data tradisional?

RAG menggabungkan kemampuan pencarian mesin telusur dengan pemahaman bernuansa dan pembuatan respons dari model bahasa, sehingga memberikan jawaban yang kontekstual dan terperinci alih-alih hanya mengambil dokumen.