Programma

Retrieval-augmented generation (RAG) combina large language models (LLM) con sistemi di retrieval per portare informazioni esterne rilevanti durante il processo di generazione del testo.

Negli ultimi anni, RAG ha guadagnato notevole trazione ed è diventato un argomento ricorrente nelle domande di colloquio per ruoli come AI engineer, machine learning engineer, prompt engineer e data scientist.

Questo articolo ha lo scopo di prepararti alle domande di colloquio legate a RAG offrendo una panoramica completa di 30 quesiti chiave, dai concetti fondamentali a temi più avanzati.

Anche se non stai preparando un colloquio a breve, questo articolo può essere una buona occasione per mettere alla prova le tue conoscenze su RAG.

Domande di base su RAG

Iniziamo con una serie di domande fondamentali su RAG.

Spiega le parti principali di un sistema RAG e come funzionano.

Un sistema RAG (retrieval-augmented generation) ha due componenti principali: il retriever e il generator.

Il retriever cerca e raccoglie informazioni rilevanti da fonti esterne, come database, documenti o siti web.

Il generator, di solito un modello linguistico avanzato, usa queste informazioni per creare testo chiaro e accurato.

Il retriever assicura che il sistema ottenga le informazioni più aggiornate, mentre il generator le combina con la propria conoscenza per produrre risposte migliori.

Insieme forniscono risposte più accurate di quelle che il solo generator potrebbe dare.

Quali sono i principali vantaggi di usare RAG invece di affidarsi solo alla conoscenza interna di un LLM?

Se ti affidi solo alla conoscenza interna di un LLM, il sistema è limitato a ciò su cui è stato addestrato, che potrebbe essere obsoleto o poco dettagliato.

I sistemi RAG offrono un grande vantaggio attingendo a informazioni aggiornate da fonti esterne, producendo risposte più accurate e tempestive.

Questo approccio riduce anche le "allucinazioni"—errori in cui il modello inventa fatti—perché le risposte si basano su dati reali. RAG è particolarmente utile in settori specifici come il diritto, la medicina o la tecnologia, dove servono conoscenze specialistiche e aggiornate.

Quali sono alcune applicazioni comuni di RAG?

RAG è usato in numerose applicazioni AI reali in diversi ambiti:

-

Question answering e sistemi di supporto: RAG alimenta chatbot di assistenza clienti e assistenti per knowledge base recuperando documentazione aggiornata o FAQ e generando risposte accurate per gli utenti. Questo assicura che le richieste dei clienti vengano risolte con le informazioni più recenti (ad esempio, recuperando policy o dettagli di prodotto attuali).

-

Agenti conversazionali: Molti chatbot e assistenti virtuali usano RAG per fornire risposte fattuali e sensibili al contesto. Recuperando fatti rilevanti al volo, un agente conversazionale (come un chatbot per la sanità o la finanza) può dare risposte informate basate su fonti credibili.

-

Generazione e sintesi di contenuti: RAG aiuta a generare o riassumere contenuti con accuratezza fattuale. Per esempio, può recuperare parti di articoli di cronaca o paper di ricerca e produrre sintesi o report coerenti e verificati rispetto ai dati di partenza.

-

Ricerca specifica di dominio: In campi specializzati come diritto o medicina, i sistemi RAG aiutano attingendo a database di dominio (giurisprudenza, riviste mediche, ecc.) per rispondere a quesiti complessi. In questo modo, l'output del modello è ancorato a conoscenze affidabili e aggiornate, fondamentali per casi d'uso professionali.

Quali tipi di fonti di conoscenza esterne può usare RAG?

I sistemi RAG possono raccogliere informazioni da fonti esterne sia strutturate che non strutturate:

- Fonti strutturate includono database, API o knowledge graph, dove i dati sono organizzati e facili da cercare.

- Fonti non strutturate consistono in grandi collezioni di testo, come documenti, siti web o archivi, dove le informazioni vanno elaborate usando la comprensione del linguaggio naturale.

Questa flessibilità consente di adattare i sistemi RAG a diversi settori, come quello legale o medico, attingendo a database di giurisprudenza, riviste di ricerca o dati di trial clinici.

Il prompt engineering conta in RAG?

Il prompt engineering aiuta i modelli linguistici a fornire risposte di alta qualità usando le informazioni recuperate. Come progetti il prompt può influire sulla pertinenza e sulla chiarezza dell'output.

- Template di system prompt specifici aiutano a guidare il modello. Per esempio, invece di un semplice system prompt predefinito come “Rispondi alla domanda”, potresti usare: “Rispondi alla domanda basandoti solo sul contesto fornito.” Questo dà istruzioni esplicite al modello di usare esclusivamente il contesto fornito, riducendo la probabilità di allucinazioni.

- Few-shot prompting significa fornire al modello alcuni esempi di risposta prima di chiedergli di generare la propria, così capisce il tipo di risposta che cerchi.

- Chain-of-thought prompting aiuta a scomporre domande complesse incoraggiando il modello a spiegare il ragionamento passo-passo prima di rispondere.

Come funziona il retriever in un sistema RAG? Quali sono i metodi di retrieval comuni?

In un sistema RAG, il retriever raccoglie informazioni rilevanti da fonti esterne che il generator utilizzerà. Esistono diversi modi per recuperare le informazioni.

Un metodo è il retrieval sparso, che abbina parole chiave (ad es., TF-IDF o BM25). È semplice ma può non cogliere il significato profondo delle parole.

Un altro approccio è il retrieval denso, che usa embedding neurali per comprendere il significato di documenti e query. Metodi come BERT o Dense Passage Retrieval (DPR) rappresentano i documenti come vettori in uno spazio condiviso, rendendo il retrieval più accurato.

La scelta tra questi metodi può influenzare molto le prestazioni del sistema RAG.

Quali sono le sfide nel combinare le informazioni recuperate con la generazione dell'LLM?

Combinare informazioni recuperate con la generazione di un LLM presenta alcune sfide. Per esempio, i dati recuperati devono essere altamente pertinenti alla query, perché dati non pertinenti possono confondere il modello e ridurre la qualità della risposta.

Inoltre, se le informazioni recuperate sono in conflitto con la conoscenza interna del modello, possono generare risposte confuse o imprecise. È quindi fondamentale risolvere questi conflitti senza confondere l'utente.

Infine, lo stile e il formato dei dati recuperati potrebbero non coincidere con la consueta scrittura o formattazione del modello, rendendo più difficile un'integrazione fluida delle informazioni.

Qual è il ruolo di un database vettoriale in RAG?

In un sistema RAG, un database vettoriale aiuta a gestire e archiviare embedding densi di testo. Questi embedding sono rappresentazioni numeriche che catturano il significato di parole e frasi, create da modelli come BERT o OpenAI.

Quando si effettua una query, il suo embedding viene confrontato con quelli archiviati nel database per trovare documenti simili. Questo rende più rapido e accurato il recupero delle informazioni giuste. Questo processo aiuta il sistema a localizzare e recuperare rapidamente le informazioni più pertinenti, migliorando sia la velocità sia l'accuratezza del retrieval.

Quali sono alcuni modi comuni per valutare i sistemi RAG?

Per valutare un sistema RAG, devi considerare sia il componente di retrieval sia quello di generazione.

- Per il retriever, valuti quanto accurati e pertinenti sono i documenti recuperati. Qui puoi usare metriche come precisione (quanti dei documenti recuperati sono pertinenti) e recall (quanti dei documenti pertinenti totali sono stati trovati).

- Per il generator, metriche come BLEU e ROUGE possono essere usate per confrontare il testo generato con esempi scritti da umani e valutarne la qualità.

Per task downstream come il question answering, si possono usare anche metriche come F1 score, precisione e recall per valutare l'intero sistema RAG.

Come gestisci query ambigue o incomplete in un sistema RAG per garantire risultati pertinenti?

Gestire query ambigue o incomplete in un sistema RAG richiede strategie per assicurare che vengano recuperate informazioni pertinenti e accurate nonostante la scarsa chiarezza dell'input dell'utente.

Un approccio consiste nell'implementare tecniche di raffinamento della query, in cui il sistema suggerisce automaticamente chiarimenti o riformula la query ambigua in una più precisa basandosi su pattern noti o interazioni precedenti. Questo può includere domande di follow-up o la presentazione di più opzioni all'utente per restringere l'intento.

Un altro metodo è recuperare un set diversificato di documenti che coprano più possibili interpretazioni della query. Recuperando una gamma di risultati, il sistema si assicura che anche se la query è vaga, è probabile includere qualche informazione rilevante.

Infine, possiamo usare modelli di natural language understanding (NLU) per inferire l'intento dell'utente da query incomplete e affinare il processo di retrieval.

Domande intermedie su RAG

Ora che abbiamo coperto alcune domande base, passiamo a domande intermedie su RAG.

Come scegli il retriever giusto per un'applicazione RAG?

La scelta del retriever dipende dal tipo di dati con cui lavori, dalla natura delle query e dalle risorse computazionali disponibili.

Per query complesse che richiedono una profonda comprensione del significato dietro le parole, metodi di retrieval denso come BERT o DPR sono migliori. Questi metodi catturano il contesto e sono ideali per attività come il supporto clienti o la ricerca, dove conta comprendere i significati sottostanti.

Se il compito è più semplice e ruota attorno al matching di parole chiave, o se hai risorse limitate, metodi sparsi come BM25 o TF-IDF potrebbero essere più adatti. Sono più rapidi e facili da configurare, ma potrebbero non trovare documenti che non corrispondono alle parole chiave esatte.

Il compromesso principale tra retrieval denso e sparso è accuratezza contro costo computazionale. A volte, combinare entrambi gli approcci in un sistema ibrido può aiutare a bilanciare l'accuratezza con l'efficienza computazionale. Così ottieni i benefici di entrambi i metodi in base alle tue esigenze.

Descrivi cos'è una ricerca ibrida.

La ricerca ibrida combina i punti di forza dei metodi di retrieval denso e sparso.

Per esempio, puoi iniziare con un metodo sparso come BM25 per trovare rapidamente documenti in base alle parole chiave. Poi, un metodo denso come BERT ri-classifica quei documenti comprendendone il contesto e il significato. Ottieni così la velocità della ricerca sparsa e l'accuratezza dei metodi densi, ideale per query complesse e dataset di grandi dimensioni.

Serve un database vettoriale per implementare RAG? In caso contrario, quali alternative ci sono?

Un database vettoriale è ottimo per gestire embedding densi, ma non è sempre necessario. Le alternative includono:

- Database tradizionali: Se usi metodi sparsi o dati strutturati, database relazionali o NoSQL possono bastare. Funzionano bene per ricerche per parola chiave. Database come MongoDB o Elasticsearch sono adatti a dati non strutturati e ricerche full-text, ma mancano di ricerca semantica profonda.

- Indici invertiti: Mappano parole chiave a documenti per ricerche rapide, ma non catturano il significato dietro le parole.

- File system: Per sistemi piccoli, documenti organizzati archiviati in file possono funzionare, ma hanno capacità di ricerca limitate.

La scelta giusta dipende dalle tue esigenze specifiche, come la scala dei dati e se serve comprensione semantica profonda.

Come puoi assicurarti che le informazioni recuperate siano pertinenti e accurate?

Per assicurarti che le informazioni recuperate siano pertinenti e accurate, puoi adottare diversi approcci:

- Curare knowledge base di alta qualità: Assicurati che le informazioni nel tuo database siano affidabili e adatte alle esigenze dell'applicazione.

- Fine-tuning del retriever: Adatta il modello di retrieval per allinearlo meglio ai tuoi task specifici. Questo aiuta a migliorare la pertinenza dei risultati.

- Uso del re-ranking: Dopo i risultati iniziali, ordina in base alla pertinenza dettagliata per ottenere le informazioni più accurate. Questo passaggio verifica in maggiore profondità l'allineamento tra risultati e query.

- Implementare feedback loop: Raccogli input da utenti o modelli sull'utilità dei risultati. Questo feedback può aiutare a perfezionare e migliorare il retriever nel tempo. Un esempio è il Corrective RAG (CRAG).

- Valutazione regolare: Misura continuamente le prestazioni del sistema con metriche come precisione, recall o F1 score per migliorare costantemente accuratezza e pertinenza.

Quali tecniche esistono per gestire documenti lunghi o knowledge base di grandi dimensioni in RAG?

Quando si hanno a che fare con documenti lunghi o knowledge base ampie, ecco alcune tecniche utili:

- Chunking: Suddividi documenti lunghi in sezioni più piccole e gestibili. Questo facilita la ricerca e il recupero delle parti pertinenti senza dover processare l'intero documento.

- Sintesi: Crea versioni condensate di documenti lunghi. Consente al sistema di lavorare con sintesi brevi al posto del testo completo, accelerando il retrieval.

- Retrieval gerarchico: Usa un approccio in due fasi in cui prima cerchi ampie categorie di informazione e poi restringi ai dettagli specifici. Aiuta a gestire grandi moli di dati in modo più efficace.

- Embedding efficienti in memoria: Usa rappresentazioni vettoriali compatte per ridurre memoria e potenza di calcolo necessarie. Ottimizzare la dimensione degli embedding facilita la gestione di dataset ampi.

- Indicizzazione e sharding: Suddividi la knowledge base in parti più piccole e distribuiscile su più sistemi. Questo abilita l'elaborazione parallela e un recupero più veloce, soprattutto su larga scala.

Come puoi ottimizzare le prestazioni di un sistema RAG in termini di accuratezza ed efficienza?

Per ottenere il massimo in termini di accuratezza ed efficienza, puoi adottare diverse strategie:

- Fine-tuning dei modelli: Regola i modelli di retriever e generator usando dati specifici per il tuo task. Migliorano le prestazioni su query specialistiche.

- Indicizzazione efficiente: Organizza la knowledge base con strutture dati rapide come indici invertiti o hashing. Velocizza la ricerca di informazioni pertinenti.

- Uso della cache: Memorizza i dati consultati frequentemente per evitare recuperi ripetuti. Migliora l'efficienza e accelera le risposte.

- Riduzione dei passaggi di retrieval: Minimizza il numero di ricerche. Migliora la precisione del retriever o usa il re-ranking per far arrivare al generator solo i migliori risultati, riducendo l'elaborazione superflua.

- Ricerca ibrida: Combina retrieval sparso e denso. Ad esempio, usa il retrieval sparso per trovare rapidamente un set ampio di documenti rilevanti, poi applica il retrieval denso per affinare e ordinare questi risultati con maggiore accuratezza.

Come mantiene il contesto un sistema RAG in una conversazione multi-turno?

Nelle conversazioni multi-turno (es. dialogo con un chatbot), un sistema RAG deve trasferire il contesto rilevante dai turni precedenti per rispondere correttamente alle domande successive. Per farlo, RAG può incorporare la cronologia della conversazione in ogni nuova query:

-

Raffinamento della query: Il sistema può riscrivere o arricchire automaticamente la domanda dell'utente usando le informazioni degli scambi precedenti. Aggiungendo dettagli dai turni passati, il retriever riceve una query più ricca di contesto, così può recuperare documenti pertinenti alla discussione in corso.

-

Inclusione della cronologia: Un altro approccio è fornire al modello un riepilogo o l'elenco dei turni precedenti come parte del contesto di input. Molte architetture RAG permettono di passare una sequenza di messaggi (storia utente e assistente) insieme alla nuova domanda. In questo modo, quando il retriever cerca informazioni, considera il contesto stabilito e il generator può mantenere una conversazione coerente.

Usando questi metodi, il sistema RAG tiene traccia di “chi ha detto cosa” e di ciò che è già stato risolto, evitando di dimenticare dettagli o ripetersi.

Domande avanzate su RAG

Finora abbiamo coperto domande base e intermedie su RAG, ora affrontiamo concetti più avanzati come le tecniche di chunking o la contestualizzazione.

Quali sono le diverse tecniche di chunking per suddividere i documenti e quali pro e contro hanno?

Esistono vari modi per suddividere i documenti per retrieval ed elaborazione:

- Lunghezza fissa: dividere i documenti in chunk di dimensione fissa. È facile, ma a volte i chunk non rispettano le pause logiche, quindi puoi spezzare info importanti o includere contenuto irrilevante.

- Basato sulle frasi: spezzare in frasi mantiene intatte le frasi, ottimo per analisi dettagliate. Tuttavia, può generare troppi chunk o perdere contesto quando le frasi sono troppo brevi per cogliere l'idea completa.

- Basato sui paragrafi: dividere per paragrafi aiuta a mantenere il contesto, ma i paragrafi possono essere troppo lunghi, riducendo l'efficienza del retrieval e dell'elaborazione.

- Chunking semantico: i chunk sono creati in base al significato, come sezioni o argomenti. Mantiene chiaro il contesto ma è più difficile da implementare perché richiede analisi testuale avanzata.

- Finestra scorrevole: i chunk si sovrappongono scorrendo sul testo. Garantisce di non perdere info importanti ma può essere costoso computazionalmente e produrre ripetizioni.

Quali sono i trade-off tra suddividere i documenti in chunk più grandi o più piccoli?

Chunk più piccoli, come frasi o brevi paragrafi, aiutano a evitare la diluizione di informazioni contestuali importanti quando compresse in un singolo vettore. Tuttavia, possono far perdere dipendenze a lungo raggio tra chunk, rendendo difficile comprendere riferimenti che si estendono su più chunk.

Chunk più grandi mantengono più contesto, consentendo informazioni più ricche, ma possono essere meno focalizzati e parte dell'informazione può perdersi cercando di codificare tutto in un unico vettore.

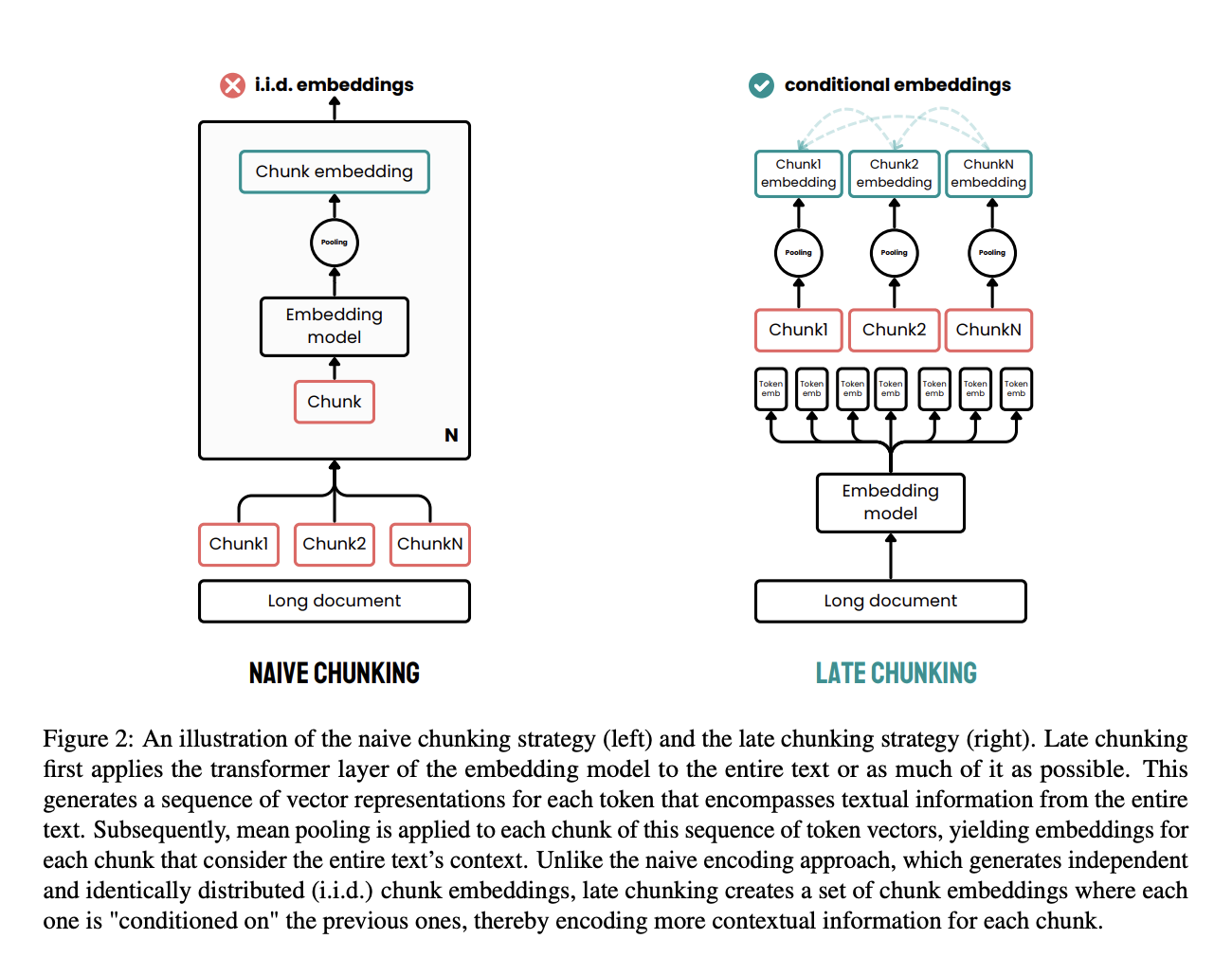

Che cos'è il late chunking e in cosa differisce dai metodi tradizionali?

Il late chunking è un approccio efficace pensato per superare i limiti dei metodi tradizionali di chunking nel processamento dei documenti.

Nei metodi tradizionali, i documenti sono prima divisi in chunk, come frasi o paragrafi, prima di applicare un modello di embedding. Questi chunk sono poi codificati singolarmente in vettori, spesso usando il mean pooling per creare un singolo embedding per ogni chunk. Questo può portare a perdita di dipendenze contestuali a lungo raggio perché gli embedding sono generati in modo indipendente, senza considerare il contesto dell'intero documento.

Il late chunking adotta un approccio diverso. Applica prima il livello transformer del modello di embedding all'intero documento o a quanto più possibile, creando una sequenza di rappresentazioni vettoriali per ciascun token. Questo metodo cattura il contesto completo del testo in questi embedding a livello di token.

Successivamente, si applica il mean pooling ai chunk di questa sequenza di vettori di token, producendo embedding per ogni chunk informati dal contesto dell'intero documento. A differenza del metodo tradizionale, il late chunking genera embedding dei chunk condizionati gli uni agli altri, preservando più informazioni contestuali e risolvendo dipendenze a lungo raggio.

Applicando il chunking più avanti nel processo, si garantisce che l'embedding di ciascun chunk benefici del ricco contesto fornito dall'intero documento, invece di essere isolato. Questo approccio affronta il problema della perdita di contesto e migliora la qualità degli embedding usati per retrieval e generazione.

Fonte: Günther et al., 2024

Spiega il concetto di "contestualizzazione" in RAG e il suo impatto sulle prestazioni.

La contestualizzazione in RAG significa garantire che le informazioni recuperate siano pertinenti alla query. Allineando i dati recuperati con la query, il sistema produce risposte migliori e più rilevanti.

Questo riduce le probabilità di risultati errati o irrilevanti e assicura che l'output risponda alle esigenze dell'utente. Un approccio consiste nell'usare un LLM per verificare se i documenti recuperati sono pertinenti prima di inviarli al modello generatore, come dimostra il Corrective RAG (CRAG).

Come puoi affrontare potenziali bias nelle informazioni recuperate o nella generazione dell'LLM?

Per prima cosa, è essenziale costruire la knowledge base filtrando contenuti faziosi, assicurando che le informazioni siano il più possibile oggettive. Puoi anche riaddestrare il sistema di retrieval per dare priorità a fonti equilibrate e non di parte.

Un altro passo importante può essere adottare un agente dedicato a controllare potenziali bias e garantire che l'output del modello resti obiettivo.

Discute le sfide nella gestione di knowledge base dinamiche o in evoluzione in RAG.

Un problema importante è mantenere i dati indicizzati aggiornati con le ultime informazioni, il che richiede un meccanismo di aggiornamento affidabile. Di conseguenza, il controllo di versione diventa cruciale per gestire diverse iterazioni di informazione e garantire coerenza.

Inoltre, il modello deve potersi adattare in tempo reale a nuove informazioni senza dover essere riaddestrato frequentemente, operazione che può essere onerosa. Queste sfide richiedono soluzioni sofisticate per mantenere il sistema accurato e pertinente man mano che la knowledge base evolve.

Che cos'è CAG e in cosa differisce dal RAG tradizionale? Quando preferiresti CAG rispetto a RAG in produzione?

CAG (Cache-Augmented Generation) è un'evoluzione di RAG in cui i documenti recuperati vengono riassunti o compressi prima di essere passati all'LLM. Questo migliora la pertinenza, riduce l'uso di token e aiuta a inserire più informazioni nella finestra di contesto del modello.

La differenza chiave è che in CAG il contenuto recuperato passa attraverso uno step intermedio, come un riassuntore o un raffinatore di contesto, prima di essere fornito al generatore. Nel RAG tradizionale, invece, i documenti grezzi vengono passati direttamente nel prompt.

CAG è particolarmente utile quando:

-

Lavori con dataset statici (ad es., cataloghi prodotto, paper accademici) che possono essere precompressi e messi in cache.

-

L'efficienza in termini di token è critica (ad es., API sensibili ai costi o inferenza su mobile/on-device).

-

I documenti recuperati sono lunghi o rumorosi e necessitano di distillazione.

RAG, invece, è preferibile quando:

-

I dati sottostanti sono dinamici o frequentemente aggiornati (ad es., ticket di supporto in tempo reale, documentazione live).

-

Vuoi incorporare la conoscenza più fresca al momento della query, senza rielaborare l'intera knowledge base.

In breve, usa CAG per domini stabili in cui puoi ottimizzare il contesto in anticipo, e RAG per scenari dinamici in cui contano freschezza e retrieval on-demand.

Dai un'occhiata a questo articolo su RAG versus CAG per un confronto più dettagliato.

Quali sono alcuni sistemi RAG avanzati?

Esistono molti sistemi RAG avanzati.

Uno è l'Adaptive RAG, in cui il sistema non solo recupera informazioni ma adatta in tempo reale il proprio approccio in base alla query. L'Adaptive RAG può decidere di non fare retrieval, di eseguire RAG a singolo passaggio o RAG iterativo. Questo comportamento dinamico rende il sistema più robusto e pertinente alla richiesta dell'utente.

Un altro sistema avanzato è l'Agentic RAG, che introduce retrieval agent—strumenti che decidono se attingere o meno a una fonte. Dando questa capacità a un modello linguistico, può determinare autonomamente se ha bisogno di informazioni aggiuntive, rendendo il processo più fluido.

Corrective RAG (CRAG) sta diventando popolare. In questo approccio, il sistema rivede i documenti recuperati verificandone la pertinenza. Solo i documenti classificati come pertinenti vengono passati al generatore. Questo step di autocorrezione aiuta a garantire l'uso di informazioni accurate e rilevanti. Per saperne di più, leggi questo tutorial su Implementazione di Corrective RAG (CRAG) con LangGraph.

Self-RAG fa un passo oltre valutando non solo i documenti recuperati ma anche le risposte finali generate, assicurando che entrambe siano allineate alla query dell'utente. Questo porta a risultati più affidabili e coerenti.

Come puoi ridurre la latenza in un sistema RAG in tempo reale senza sacrificare l'accuratezza?

Un approccio efficace è il prefetching di informazioni rilevanti e spesso richieste, così sono pronte quando servono. Inoltre, affinare l'indicizzazione e gli algoritmi di query può fare una grande differenza nella rapidità di recupero ed elaborazione dei dati.

Quali sono alcuni limiti o sfide dei sistemi RAG?

Pur essendo potente, RAG presenta diversi limiti e sfide:

-

Dipendenza dalla qualità dei dati recuperati: Un sistema RAG è valido quanto le informazioni che recupera. Se il retriever porta documenti irrilevanti o errati, anche la risposta del generator ne risentirà. Garantire fonti dati di alta qualità e affidabili (e fare fine-tuning del retriever) è una sfida continua per evitare il classico garbage-in, garbage-out.

-

Aumentata complessità e latenza: RAG introduce uno step di retrieval oltre alla generazione, rendendo il sistema più complesso e oneroso computazionalmente di un LLM standalone. Cercare in una knowledge base ampia può aggiungere latenza e richiedere risorse, quindi i sistemi RAG devono bilanciare accuratezza ed efficienza.

-

Necessità di manutenzione della knowledge base: A differenza degli LLM statici, RAG dipende da un repository esterno che va aggiornato e curato regolarmente. Le organizzazioni devono ingestire continuamente nuovi dati, rimuovere informazioni obsolete e gestire gli indici. Senza fonti affidabili e aggiornate, un sistema RAG può rapidamente diventare meno efficace o fornire risposte datate.

-

Difficoltà di integrazione e tuning: Combinare retrieval e generazione significa più componenti da ottimizzare e monitorare (database vettoriale, modello di retrieval e LLM). La diagnosi degli errori è più difficile perché i problemi possono derivare dal lato retrieval o da quello di generazione. Questa complessità aumenta gli sforzi di sviluppo e manutenzione rispetto all'uso di un solo LLM.

Vale anche la pena notare che, se i dati di un dominio sono in gran parte statici e rientrano nell'addestramento del modello, un LLM fine-tunato potrebbe bastare al posto di RAG. Tuttavia, il fine-tuning non ha la capacità di RAG di incorporare informazioni fresche al volo e può risultare più costoso da riaddestrare a ogni aggiornamento della conoscenza.

Domande su RAG per AI Engineer

Ora affrontiamo alcune domande specifiche per chi sostiene colloqui per posizioni di AI Engineer.

Come valuteresti e miglioreresti le prestazioni di un sistema RAG in produzione?

Per prima cosa, dovrai tracciare il feedback degli utenti per misurare quanto bene sta funzionando il sistema e quanto è pertinente.

Vorrai anche monitorare la latenza per garantire risposte tempestive e valutare la qualità sia dei documenti recuperati sia degli output generati. Metriche chiave come accuratezza delle risposte, soddisfazione degli utenti e throughput del sistema sono importanti.

Per aumentare le prestazioni, potresti riaddestrare parti del sistema con dati aggiornati o ritoccare i parametri. Potresti anche perfezionare gli algoritmi di retrieval per migliorarne pertinenza ed efficienza, e aggiornare regolarmente le fonti di conoscenza per mantenerle attuali.

Revisioni continue delle prestazioni e A/B test possono fornire insight per miglioramenti continui.

Come garantisci affidabilità e robustezza di un sistema RAG in produzione, soprattutto di fronte a possibili guasti o input imprevisti?

Costruire un sistema RAG pronto per la produzione richiede di gestire varie sfide. Soluzioni possibili includono:

- Ridondanza e failover: Implementare componenti ridondanti o sistemi di backup per garantire la continuità operativa in caso di guasti.

- Gestione errori e logging: Implementare meccanismi di gestione e registrazione degli errori per una diagnosi e risoluzione rapide.

- Validazione e sanitizzazione degli input: Validare e ripulire gli input degli utenti per prevenire vulnerabilità e attacchi come le prompt injection.

- Monitoraggio e alerting: Configurare sistemi di monitoraggio e avvisi per rilevare e affrontare problemi di performance o potenziali minacce.

Come progetteresti un sistema RAG per un task specifico (ad es., question answering, sintesi)?

Per un sistema di question answering, puoi iniziare scegliendo un retriever che trovi ed estragga in modo efficiente documenti pertinenti in base alla query dell'utente. Può essere qualcosa di tradizionale, come ricerche per parola chiave, o più avanzato, come l'uso di embedding densi per un retrieval migliore. Poi, devi scegliere o fare fine-tuning di un generator che sappia creare risposte accurate e coerenti usando i documenti recuperati.

Per la sintesi, invece, il compito del retriever è raccogliere contenuti completi relativi al documento o all'argomento. Il generator, dal canto suo, deve saper distillare questi contenuti in sintesi concise e significative.

Il prompt engineering è cruciale qui. A seconda del task downstream, dobbiamo creare prompt che guidino il modello a incorporare le informazioni recuperate per produrre l'output rilevante.

Puoi spiegare i dettagli tecnici di come faresti il fine-tuning di un LLM per un task RAG?

Si parte dalla raccolta e preparazione di dati specifici per il task. Possono essere esempi annotati di coppie domanda-risposta o dataset per la sintesi.

Potresti poi usare tecniche come il retrieval-augmented language modeling (REALM), che aiuta il modello a integrare meglio nei propri output i documenti che recupera. Spesso significa ritoccare l'architettura del modello o i metodi di training per migliorare la gestione del contesto dai documenti recuperati.

Potresti anche usare Retrieval-Augmented Fine-Tuning (RAFT), che combina i punti di forza di RAG con il fine-tuning, permettendo al modello di apprendere sia la conoscenza di dominio sia come recuperare e usare efficacemente informazioni esterne.

Come gestisci informazioni obsolete o irrilevanti in un sistema RAG, soprattutto in domini in rapido cambiamento?

Un approccio è implementare aggiornamenti regolari della knowledge base o dell'indice dei documenti, così che le nuove informazioni vengano incorporate man mano che diventano disponibili. Questo può comportare workflow automatici che periodicamente eseguono scraping o ingest di contenuti aggiornati, assicurando che il retriever lavori sempre con dati recenti.

Inoltre, il tagging di metadati può essere usato per contrassegnare le informazioni obsolete, permettendo al sistema di dare priorità a documenti più recenti e pertinenti durante il retrieval.

Nei domini che cambiano rapidamente, è anche importante integrare meccanismi che filtrino o ri-classifichino i risultati di ricerca in base alla loro tempestività. Ad esempio, attribuire un peso maggiore agli articoli o documenti più recenti durante il retrieval aiuta a garantire che le risposte generate si basino su fonti aggiornate.

Un'altra tecnica consiste in feedback loop o sistemi human-in-the-loop in cui le inesattezze segnalate possano essere corrette rapidamente, e il retriever possa essere regolato per evitare di recuperare informazioni obsolete.

Come bilanci rilevanza e diversità nel retrieval in un sistema RAG per garantire risposte complete?

Bilanciare rilevanza e diversità in un sistema RAG significa fornire risposte accurate e a tutto tondo. La rilevanza assicura che i documenti recuperati corrispondano da vicino alla query, mentre la diversità evita di concentrarsi troppo su un'unica fonte o punto di vista.

Un modo per bilanciare questi aspetti è usare strategie di re-ranking che diano priorità sia alla rilevanza sia alla diversità. Puoi aumentare la diversità attingendo a documenti da un ventaglio di fonti o sezioni della knowledge base.

Anche il clustering di risultati simili e la selezione di documenti da cluster diversi possono aiutare.

Fare fine-tuning del retriever con focus sia su rilevanza sia su diversità può garantire che il sistema recuperi un set di documenti completo.

Come garantisci che l'output generato in un sistema RAG resti coerente con le informazioni recuperate?

Un approccio chiave è un forte accoppiamento tra retrieval e generazione tramite prompt engineering. Prompt progettati con cura che istruiscono esplicitamente il modello linguistico a basare le risposte sui documenti recuperati aiutano a mantenere l'output ancorato ai dati forniti dal retriever.

Inoltre, tecniche come la generazione di citazioni, in cui si chiede al modello di fare riferimento o giustificare le risposte con le fonti recuperate, possono aiutare a mantenere la coerenza.

Un altro approccio è applicare controlli o validazioni post-generazione, confrontando l'output con i documenti recuperati per garantirne l'allineamento. Questo può essere fatto con metriche di similarità o usando modelli di verifica più piccoli che validano la coerenza fattuale tra dati recuperati e testo generato.

In alcuni casi, si possono usare metodi di raffinamento iterativo in cui il modello prima genera un output, poi rivede i documenti recuperati per controllare e affinare la risposta. Anche feedback loop e correzioni degli utenti possono essere sfruttati per migliorare la coerenza nel tempo, man mano che il sistema impara da incongruenze passate e adatta i meccanismi di retrieval e generazione.

Come garantisci privacy e sicurezza dei dati in un sistema RAG, soprattutto con informazioni sensibili?

Garantire privacy e sicurezza nei sistemi RAG è fondamentale quando i dati recuperati o le query degli utenti contengono informazioni sensibili o personali. Strategie chiave includono:

-

Redazione e anonimizzazione dei dati: Prima che i dati entrino nella pipeline RAG, rimuovi o maschera informazioni personali (PII) e altri dettagli sensibili. Ad esempio, i documenti possono essere scansionati e qualsiasi PII redatta in fase di ingestion. Questo approccio zero-trust significa che, anche se i dati vengono recuperati, non esporranno info confidenziali perché sanificati a monte.

-

Archiviazione e trasferimento sicuri: Usa cifratura per i dati a riposo (in database o vector store) e in transito quando il retriever comunica con l'archiviazione. Assicurare che database vettoriali e fonti di conoscenza siano accessibili in modo controllato (con autenticazione e autorizzazione adeguate) previene accessi non autorizzati. Solo applicazioni o servizi fidati dovrebbero poter leggere dalla knowledge base.

-

Controlli di accesso basati sui ruoli: Implementa filtri di accesso rigorosi sui risultati di retrieval. Puoi taggare i chunk di conoscenza con metadati su chi può vederli (es., admin vs. utente) e far sì che il sistema RAG applichi queste regole durante il retrieval. Per esempio, un assistente RAG sanitario può consentire ai medici di recuperare info identificative dei pazienti ma non mostrarle ad altri utenti.

-

Filtraggio dei prompt e monitoraggio dell'output: Integra guardrail AI per impedire all'LLM di emettere dati privati. Tecniche come la difesa dalle prompt injection, lo scanning dell'output o policy (come le linee guida OWASP per LLM) possono aiutare a rilevare e rimuovere contenuti sensibili dalle risposte. Una revisione human-in-the-loop può essere usata in domini critici.

-

Conformità e auditing: Assicurati che il sistema RAG sia conforme alle normative sulla protezione dei dati (GDPR, HIPAA, ecc.) by design. Questo include mantenere log di audit su quali dati sono stati recuperati e quando, ottenere il consenso degli utenti per l'uso dei loro dati e audit regolari delle fonti di conoscenza per informazioni sensibili.

Combinando queste misure, un sistema RAG può gestire in modo sicuro dati sensibili. In un colloquio, ci si aspetta che tu sottolinei che la protezione dei dati degli utenti non è un ripensamento: è integrata nel modo in cui la pipeline RAG acquisisce, archivia, recupera e genera informazioni.

Conclusione

Questa guida ti ha fornito 30 domande chiave per aiutarti a prepararti a discutere di RAG, dai concetti di base ai sistemi RAG avanzati.

Se vuoi approfondire i sistemi RAG, ti consiglio questi blog:

Ryan è un lead data scientist specializzato nello sviluppo di applicazioni di IA con LLM. È dottorando in Elaborazione del Linguaggio Naturale e Knowledge Graph all’Imperial College London, dove ha anche conseguito la laurea magistrale in Informatica. Oltre alla data science, scrive una newsletter settimanale su Substack, The Limitless Playbook, in cui condivide un’idea pratica dei migliori pensatori al mondo e, di tanto in tanto, scrive sui concetti fondamentali dell’IA.