programa

Generación aumentada por recuperación (RAG) combina grandes modelos de lenguaje (LLM) con sistemas de recuperación para incorporar información externa relevante durante el proceso de generación de texto.

En los últimos años, RAG ha ganado mucha popularidad y se ha convertido en un tema habitual en las preguntas de las entrevistas para puestos como ingeniero de IAo ingeniero de machine learning, ingeniero de promptsy científico de datos.

Este artículo tiene como objetivo prepararte para las preguntas de la entrevista relacionadas con RAG, proporcionándote una visión general completa de 30 preguntas clave, que abarcan desde conceptos básicos hasta temas más avanzados.

Aunque no te estés preparando para una entrevista próximamente, este artículo puede ser una buena oportunidad para poner a prueba tus conocimientos sobre RAG.

Conviértete en un Científico ML

Preguntas básicas para una entrevista RAG

Comencemos con una serie de preguntas fundamentales para la entrevista sobre RAG.

Explica las partes principales de un sistema RAG y cómo funcionan.

Un sistema RAG (generación aumentada por recuperación) tiene dos componentes principales: el recuperador y el generador.

El recuperador busca y recopila información relevante de fuentes externas, como bases de datos, documentos o sitios web.

El generador, normalmente un modelo lingüístico avanzado, utiliza esta información para crear un texto claro y preciso.

El recuperador se asegura de que el sistema obtenga la información más actualizada, mientras que el generador la combina con sus propios conocimientos para producir mejores respuestas.

Juntos, proporcionan respuestas más precisas que las que podría dar el generador por sí solo.

¿Cuáles son las principales ventajas de utilizar RAG en lugar de basarse únicamente en el conocimiento interno de un LLM?

Si solo te basas en el conocimiento integrado de un LLM, el sistema se limita a aquello para lo que ha sido entrenado, lo que podría estar desactualizado o carecer de detalles.

Los sistemas RAG ofrecen una gran ventaja al recopilar información nueva de fuentes externas, lo que se traduce en respuestas más precisas y oportunas.

Este enfoque también reduce las «alucinaciones» (errores en los que el modelo inventa datos), ya que las respuestas se basan en datos reales. RAG es especialmente útil para campos específicos como el derecho, medicinao tecnología, donde se necesitan conocimientos especializados y actualizados.

¿Cuáles son algunas aplicaciones comunes de RAG?

RAG se utiliza en diversas aplicaciones de IA del mundo real en diferentes ámbitos:

-

Sistemas de respuesta a preguntas y asistencia: RAG potencia los chatbots de atención al cliente y los asistentes de bases de conocimiento mediante la recuperación de documentación actualizada o preguntas frecuentes y la generación de respuestas precisas para los usuarios. Esto garantiza que las consultas de los clientes se resuelvan con la información más reciente (por ejemplo, obteniendo información actualizada sobre pólizas o detalles de productos).

-

Agentes conversacionales: Muchos chatbots y asistentes virtuales utilizan RAG para proporcionar respuestas objetivas y contextuales. Al recopilar datos relevantes sobre la marcha, un agente conversacional (como un chatbot de atención médica o finanzas) puede dar respuestas fundamentadas basadas en fuentes fiables.

-

Generación y resumen de contenido: RAG ayuda a generar o resumir contenido con precisión factual. Por ejemplo, puede recuperar partes de artículos periodísticos o trabajos de investigación y luego elaborar resúmenes o informes que sean coherentes y cuyas fuentes hayan sido verificadas.

-

Investigación específica del dominio: En campos especializados como el derecho o la medicina, los sistemas RAG ayudan a responder consultas complejas recurriendo a bases de datos específicas del ámbito (jurisprudencia, revistas médicas, etc.). De esta manera, los resultados del modelo se basan en conocimientos fiables y actualizados sobre el ámbito, lo cual es importante para los casos de uso profesional.

¿Qué tipos de fuentes de conocimiento externas puede utilizar RAG?

Los sistemas RAG pueden recopilar información tanto de fuentes externas estructuradas como no estructuradas:

- Las fuentes estructuradas incluyen bases de datos, API o grafos de conocimiento, donde los datos están organizados y son fáciles de buscar.

- Las fuentes no estructuradas consisten en grandes colecciones de texto, como documentos, sitios web o archivos, en las que la información debe procesarse utilizando comprensión del lenguaje natural.

Esta flexibilidad permite adaptar los sistemas RAG a diferentes campos, como el jurídico o el médico, recurriendo a bases de datos de jurisprudencia, revistas de investigación o datos de ensayos clínicos.

¿Es importante la ingeniería rápida en RAG?

La ingeniería de prompts ayuda a los modelos lingüísticos a proporcionar respuestas de alta calidad utilizando la información recuperada. La forma en que diseñes una indicación puede afectar a la relevancia y claridad del resultado.

- Las plantillas específicas de indicaciones del sistema ayudan a guiar el modelo. Por ejemplo, en lugar de tener un sencillo mensaje del sistema predeterminado como «Responde a la pregunta», podrías tener «Responde a la pregunta basándote únicamente en el contexto proporcionado». Esto le da al modelo instrucciones explícitas para que solo utilice el contexto proporcionado para responder a la pregunta, lo que puede reducir la probabilidad de alucinaciones.

- La indicación de pocos ejemplos consiste en proporcionar al modelo algunas respuestas de ejemplo antes de pedirle que genere las suyas propias, para que sepa el tipo de respuesta que buscas.

- La cadena de pensamiento ayuda a desglosar preguntas complejas al animar al modelo a explicar su razonamiento paso a paso antes de responder.

¿Cómo funciona el recuperador en un sistema RAG? ¿Cuáles son los métodos de recuperación más comunes?

En un sistema RAG, el recuperador recopila información relevante de fuentes externas para que la utilice el generador. Hay diferentes maneras de recuperar información.

Un método es la recuperación dispersa, que compara palabras clave (por ejemplo, TF-IDF o BM25). Esto es sencillo, pero puede que no capte el significado más profundo que hay detrás de las palabras.

Otro enfoque es la recuperación densa, que utiliza incrustaciones neuronales para comprender el significado de los documentos y las consultas. Métodos como BERT o Dense Passage Retrieval (DPR) representan los documentos como vectores en un espacio compartido, lo que hace que la recuperación sea más precisa.

La elección entre estos métodos puede afectar en gran medida al funcionamiento del sistema RAG.

¿Cuáles son los retos que plantea combinar la información recuperada con la generación de LLM?

Combinar la información recuperada con la generación de un LLM plantea algunos retos. Por ejemplo, los datos recuperados deben ser muy relevantes para la consulta, ya que los datos irrelevantes pueden confundir al modelo y reducir la calidad de la respuesta.

Además, si la información recuperada entra en conflicto con el conocimiento interno del modelo, puede generar respuestas confusas o inexactas. Por lo tanto, es fundamental resolver estos conflictos sin confundir al usuario.

Por último, es posible que el estilo y el formato de los datos recuperados no siempre coincidan con la escritura o el formato habituales del modelo, lo que dificulta que este integre la información sin problemas.

¿Cuál es la función de una base de datos vectorial en RAG?

En un sistema RAG, una base de datos vectorial ayuda a gestionar y almacenar incrustaciones de texto. Estas incrustaciones son representaciones numéricas que capturan el significado de palabras y frases, creadas por modelos como BERT u OpenAI.

Cuando se realiza una consulta, tu incrustación se compara con las almacenadas en la base de datos para encontrar documentos similares. Esto hace que la recuperación de la información correcta sea más rápida y precisa. Este proceso ayuda al sistema a localizar y extraer rápidamente la información más relevante, mejorando tanto la velocidad como la precisión de la recuperación.

¿Cuáles son algunas formas comunes de evaluar los sistemas RAG?

Para evaluar un sistema RAG, es necesario examinar tanto los componentes de recuperación como los de generación.

- En el caso del recuperador, evalúas la precisión y la relevancia de los documentos recuperados. Aquí se pueden utilizar métricas comola precisión ( ) (cuántos documentos recuperados son relevantes) y la recuperación (recall ) (cuántos de los documentos relevantes totales se encontraron).

- Para el generador, métricas como BLEU y ROUGE pueden utilizarse para comparar el texto generado con ejemplos escritos por humanos y evaluar así su calidad.

Para tareas posteriores, como responder preguntas, métricas como puntuación F1o la precisióny recall también pueden utilizarse para evaluar el sistema RAG en su conjunto.

¿Cómo gestionas las consultas ambiguas o incompletas en un sistema RAG para garantizar resultados relevantes?

El manejo de consultas ambiguas o incompletas en un sistema RAG requiere estrategias que garanticen la recuperación de información relevante y precisa a pesar de la falta de claridad en la entrada del usuario.

Un enfoque consiste en implementar técnicas de refinamiento de consultas, en las que el sistema sugiere automáticamente aclaraciones o reformula la consulta ambigua para que sea más precisa, basándose en patrones conocidos o interacciones anteriores. Esto puede implicar hacer preguntas de seguimiento u ofrecer al usuario varias opciones para concretar su intención.

Otro método consiste en recuperar un conjunto diverso de documentos que abarquen múltiples interpretaciones posibles de la consulta. Al recuperar una serie de resultados, el sistema garantiza que, incluso si la consulta es imprecisa, es probable que se incluya alguna información relevante.

Por último, podemos utilizar modelos de comprensión del lenguaje natural (NLU) para deducir la intención del usuario a partir de consultas incompletas y refinar el proceso de recuperación.

Preguntas de entrevista RAG para nivel intermedio

Ahora que hemos cubierto algunas preguntas básicas, es hora de pasar a las preguntas intermedias de la entrevista RAG.

¿Cómo elegir el recuperador adecuado para una aplicación RAG?

La elección del recuperador adecuado depende del tipo de datos con los que trabajes, la naturaleza de las consultas y la potencia de cálculo de que dispongas.

Para consultas complejas que requieren una comprensión profunda del significado de las palabras, métodos de recuperación densos como BERT o DPR son mejores. Estos métodos capturan el contexto y son ideales para tareas como la atención al cliente o la investigación, en las que es importante comprender los significados subyacentes.

Si la tarea es más sencilla y gira en torno a la coincidencia de palabras clave, o si dispones de recursos computacionales limitados, los métodos de recuperación dispersa, como BM25 o TF-IDF, pueden ser más adecuados. Estos métodos son más rápidos y fáciles de configurar, pero es posible que no encuentren documentos que no coincidan exactamente con las palabras clave.

La principal contrapartida entre los métodos de recuperación densos y dispersos es la precisión frente al coste computacional. A veces, combinar ambos enfoques en un sistema de recuperación híbrido puede ayudar a equilibrar la precisión con la eficiencia computacional. De esta manera, obtienes las ventajas de los métodos densos y dispersos en función de tus necesidades.

Describe qué es una búsqueda híbrida.

La búsqueda híbrida combina las ventajas de los métodos de recuperación densa y dispersa.

Por ejemplo, puedes comenzar con un método disperso como BM25 para encontrar rápidamente documentos basados en palabras clave. Entonces, un método denso como BERT reclasifica esos documentos al comprender su contexto y significado. Esto te proporciona la velocidad de la búsqueda dispersa con la precisión de los métodos densos, lo que resulta ideal para consultas complejas y grandes conjuntos de datos.

¿Necesitas una base de datos vectorial para implementar RAG? Si no es así, ¿cuáles son las alternativas?

Una base de datos vectorial es ideal para gestionar incrustaciones densas, pero no siempre es necesaria. Las alternativas incluyen:

- Bases de datos tradicionales: Si utilizas métodos dispersos o datos estructurados, las bases de datos relacionales o nosql normales pueden ser suficientes. Funcionan bien para las búsquedas por palabras clave. Las bases de datos como MongoDB o Elasticsearch son adecuadas para gestionar datos no estructurados y búsquedas de texto completo, pero carecen de una búsqueda semántica profunda.

- Índices invertidos: Estas palabras clave se asignan a documentos para agilizar las búsquedas, pero no captan el significado que hay detrás de las palabras.

- Sistemas de archivos: Para sistemas más pequeños, los documentos organizados y almacenados en archivos pueden funcionar, pero tienen capacidades de búsqueda limitadas.

La elección correcta depende de tus necesidades específicas, como el volumen de tus datos y si necesitas una comprensión semántica profunda.

¿Cómo puedes garantizar que la información recuperada sea relevante y precisa?

Para asegurarte de que la información recuperada sea relevante y precisa, puedes utilizar varios métodos:

- Selecciona bases de conocimiento de alta calidad: Asegúrate de que la información de tu base de datos sea fiable y se ajuste a las necesidades de tu aplicación.

- Ajustar el recuperador: Ajusta el modelo de recuperador para que se adapte mejor a tus tareas y requisitos específicos. Esto ayuda a mejorar la relevancia de los resultados.

- Utiliza la reordenación: Después de obtener los resultados iniciales, ordénalos según su relevancia detallada para obtener la información más precisa. Este paso consiste en comprobar con mayor profundidad en qué medida los resultados coinciden con la consulta.

- Implementar bucles de retroalimentación: Obtén opiniones de los usuarios o modelos sobre la utilidad de los resultados. Estos comentarios pueden ayudar a perfeccionar y mejorar el recuperador con el tiempo. Un ejemplo de esto es el RAG correctivo (CRAG).

- Evaluación periódica: Mide continuamente el rendimiento del sistema utilizando métricas como la precisión, la recuperación o la puntuación F1 para seguir mejorando la exactitud y la relevancia.

¿Cuáles son algunas técnicas para manejar documentos largos o bases de conocimiento grandes en RAG?

Cuando se trata de documentos largos o bases de conocimiento extensas, aquí tienes algunas técnicas útiles:

- Fragmentación: Divide los documentos largos en secciones más pequeñas y manejables. Esto facilita la búsqueda y recuperación de partes relevantes sin tener que procesar todo el documento.

- Resumen: Crea versiones resumidas de documentos largos. Esto permite que el sistema trabaje con resúmenes más cortos en lugar del texto completo, lo que agiliza la recuperación.

- Recuperación jerárquica: Utiliza un enfoque en dos pasos: primero busca categorías generales de información y luego reduce la búsqueda a detalles específicos. Esto ayuda a gestionar grandes cantidades de datos de forma más eficaz.

- Incrustaciones eficientes en cuanto a memoria: Utiliza representaciones vectoriales compactas para reducir la cantidad de memoria y potencia computacional necesarias. Optimizar el tamaño de las incrustaciones puede facilitar el manejo de grandes conjuntos de datos.

- Indexación y fragmentación: Divide la base de conocimientos en partes más pequeñas y almacénalas en varios sistemas. Esto permite el procesamiento paralelo y una recuperación más rápida, especialmente en sistemas a gran escala.

¿Cómo puedes optimizar el rendimiento de un sistema RAG en términos de precisión y eficiencia?

Para obtener el mejor rendimiento de un sistema RAG en términos de precisión y eficiencia, puedes utilizar varias estrategias:

- Ajustar los modelos: Ajusta los modelos de recuperador y generador utilizando datos específicos para tu tarea. Esto les ayuda a obtener mejores resultados en consultas especializadas.

- Indexación eficiente: Organiza tu base de conocimientos utilizando estructuras de datos rápidas, como índices invertidos o hash. Esto acelera el proceso de búsqueda de información relevante.

- Utiliza el almacenamiento en caché: Almacena los datos a los que se accede con frecuencia para no tener que recuperarlos repetidamente. Esto mejora la eficiencia y agiliza las respuestas.

- Reduce los pasos de recuperación: Minimiza el número de veces que buscas información. Mejora la precisión del recuperador o utiliza la reclasificación para garantizar que solo se envíen los mejores resultados al generador, reduciendo así el procesamiento innecesario.

- Búsqueda híbrida: Combinar métodos de recuperación dispersos y densos. Por ejemplo, utiliza la recuperación dispersa para encontrar rápidamente un amplio conjunto de documentos relevantes y, a continuación, aplica la recuperación densa para refinar y clasificar estos resultados con mayor precisión.

¿Cómo mantiene un sistema RAG el contexto en una conversación de varios turnos?

En conversaciones con múltiples turnos (por ejemplo, un diálogo con un chatbot), un sistema RAG necesita trasladar el contexto relevante de los turnos anteriores para responder correctamente a las preguntas posteriores. Para lograrlo, RAG puede incorporar el historial de conversaciones en cada nueva consulta:

-

Refinamiento de la consulta: El sistema puede reescribir o ampliar automáticamente la pregunta del usuario utilizando información de intercambios anteriores. Al añadir detalles de turnos anteriores, el recuperador obtiene una consulta más rica en contexto, por lo que puede buscar documentos relevantes para la discusión en curso.

-

Incluyendo el historial de conversaciones: Otro enfoque consiste en proporcionar al modelo un resumen o una lista de los turnos de diálogo anteriores como parte de su contexto de entrada. Muchas arquitecturas RAG permiten pasar una secuencia de mensajes (historial del usuario y del asistente) junto con la nueva pregunta. De esta manera, cuando el recuperador busca información, tiene en cuenta el contexto establecido, y el generador puede utilizar el contexto anterior para mantener una conversación coherente.

Mediante el uso de estos métodos, el sistema RAG realiza un seguimiento de «quién dijo qué» y qué se ha resuelto ya. Esto evita que se olviden detalles o se repitan cosas.

Preguntas avanzadas para entrevistas RAG

Hasta ahora, hemos cubierto preguntas básicas e intermedias de entrevistas RAG, y ahora abordaremos conceptos más avanzados como las técnicas de fragmentación o la contextualización.

¿Cuáles son las diferentes técnicas de fragmentación para dividir documentos y cuáles son sus ventajas e inconvenientes?

Hay varias formas de desglosar los documentos para su recuperación y procesamiento:

- Longitud fija: División de documentos en fragmentos de tamaño fijo. Es fácil de hacer, pero a veces los fragmentos pueden no alinearse con las pausas lógicas, por lo que podrías dividir información importante o incluir contenido irrelevante.

- Basado en frases: Dividir los documentos en oraciones mantiene las oraciones intactas, lo que resulta ideal para realizar análisis detallados. Sin embargo, puede dar lugar a demasiados fragmentos o a una pérdida de contexto cuando las oraciones son demasiado cortas para captar ideas completas.

- Basado en párrafos: Dividir por párrafos ayuda a mantener intacto el contexto, pero los párrafos pueden ser demasiado largos, lo que hace que la recuperación y el procesamiento sean menos eficientes.

- Fragmentación semántica: Los fragmentos se crean en función del significado, como secciones o temas. Esto mantiene claro el contexto, pero es más difícil de implementar, ya que requiere un análisis avanzado del texto.

- Ventana deslizante: Los fragmentos se superponen al deslizarse sobre el texto. Esto garantiza que no se pierda información importante, pero puede resultar computacionalmente costoso y dar lugar a información repetida.

¿Cuáles son las ventajas y desventajas de dividir los documentos en fragmentos más grandes o más pequeños?

Los fragmentos más pequeños, como frases o párrafos cortos, ayudan a evitar la dilución de información contextual importante cuando se comprimen en un único vector. Sin embargo, esto puede llevar a la pérdida de dependencias de largo alcance entre fragmentos, lo que dificulta que los modelos comprendan las referencias que abarcan varios fragmentos.

Los fragmentos más grandes conservan más contexto, lo que permite obtener información contextual más rica, pero pueden ser menos específicos y la información puede perderse al intentar codificar toda la información en un único vector.

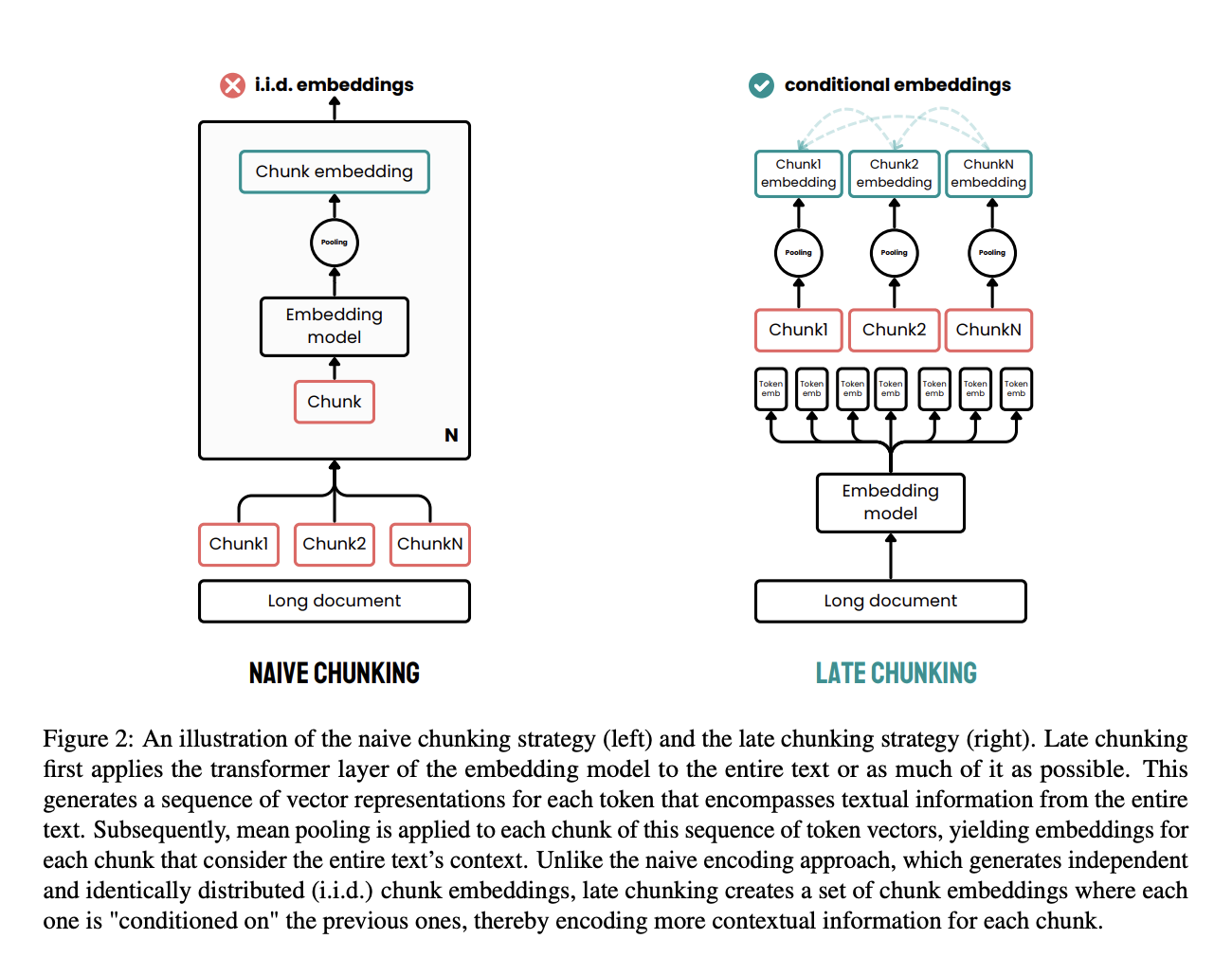

¿Qué es el chunking tardío y en qué se diferencia de los métodos tradicionales de chunking?

El chunking tardío es un enfoque eficaz diseñado para abordar las limitaciones de los métodos tradicionales de chunking en el procesamiento de documentos.

En los métodos tradicionales, los documentos se dividen primero en fragmentos, como oraciones o párrafos, antes de aplicar un modelo de incrustación. A continuación, estos fragmentos se codifican individualmente en vectores, a menudo utilizando el agrupamiento medio para crear una única incrustación para cada fragmento. Este enfoque puede provocar una pérdida de las dependencias contextuales a larga distancia, ya que las incrustaciones se generan de forma independiente, sin tener en cuenta el contexto completo del documento.

El chunking tardío adopta un enfoque diferente. Primero aplica la capa transformadora del modelo de incrustación a todo el documento o a la mayor parte posible del mismo, creando una secuencia de representaciones vectoriales para cada token. Este método captura el contexto completo del texto en estas incrustaciones a nivel de token.

A continuación, se aplica el agrupamiento medio a los fragmentos de esta secuencia de vectores de tokens, lo que produce incrustaciones para cada fragmento que se basan en el contexto de todo el documento. A diferencia del método tradicional, el chunking tardío genera incrustaciones de fragmentos que están condicionadas entre sí, lo que permite conservar más información contextual y resolver dependencias de largo alcance.

Al aplicar la fragmentación más adelante en el proceso, se garantiza que la incrustación de cada fragmento se beneficie del rico contexto que proporciona el documento completo, en lugar de quedar aislada. Este enfoque aborda el problema de la pérdida de contexto y mejora la calidad de las incrustaciones utilizadas para las tareas de recuperación y generación.

Fuente: Günther et al., 2024

Explica el concepto de «contextualización» en RAG y su impacto en el rendimiento.

La contextualización en RAG significa asegurarse de que la información recuperada sea relevante para la consulta. Al alinear los datos recuperados con la consulta, el sistema genera respuestas mejores y más relevantes.

Esto reduce las posibilidades de obtener resultados incorrectos o irrelevantes y garantiza que el resultado se ajuste a las necesidades del usuario. Un enfoque consiste en utilizar un LLM para comprobar si los documentos recuperados son relevantes antes de enviarlos al modelo generador, tal y como se demuestra en Corrective RAG (CRAG).

¿Cómo puedes abordar los posibles sesgos en la información recuperada o en la generación del LLM?

En primer lugar, es fundamental crear la base de conocimientos de manera que se filtre el contenido sesgado, asegurándote de que la información sea lo más objetiva posible. También puedes reeducar el sistema de recuperación para que dé prioridad a fuentes equilibradas e imparciales.

Otro paso importante podría ser contratar a un agente específicamente para que compruebe los posibles sesgos y garantice que los resultados del modelo sigan siendo objetivos.

Discute los retos que plantea el manejo de bases de conocimiento dinámicas o en evolución en RAG.

Una cuestión importante es mantener los datos indexados actualizados con la información más reciente, lo que requiere un mecanismo de actualización fiable. Por lo tanto, el control de versiones se vuelve crucial para gestionar las diferentes iteraciones de la información y garantizar la coherencia.

Además, el modelo debe ser capaz de adaptarse a la nueva información en tiempo real sin tener que volver a entrenarse con frecuencia, lo que puede requerir muchos recursos. Estos retos requieren soluciones sofisticadas para garantizar que el sistema siga siendo preciso y relevante a medida que evoluciona la base de conocimientos.

¿Qué es el CAG y en qué se diferencia del RAG tradicional? ¿Cuándo preferirías utilizar CAG en lugar de RAG en la producción?

CAG (Cache-Augmented Generation) es una evolución de RAG en la que los documentos recuperados se resumen o comprimen antes de pasar al LLM. Esto mejora la relevancia, reduce el uso de tokens y ayuda a incluir más información en la ventana de contexto del modelo.

La diferencia clave es que, en CAG, el contenido recuperado pasa por un paso intermedio, como un resumidor o un refinador de contexto, antes de ser enviado al generador. Por el contrario, el RAG tradicional pasa los documentos sin procesar directamente al prompt.

El CAG es especialmente útil cuando:

-

Trabajas con conjuntos de datos estáticos (por ejemplo, catálogos de productos, artículos académicos) que se pueden comprimir previamente y almacenar en caché.

-

La eficiencia de los tokens es fundamental (por ejemplo, API sensibles al coste o inferencia móvil/en el dispositivo).

-

Los documentos recuperados son largos o contienen ruido y necesitan ser destilados.

Por otro lado, RAG es preferible cuando:

-

Los datos subyacentes son dinámicos o se actualizan con frecuencia (por ejemplo, tickets de soporte en tiempo real, documentación en vivo).

-

Quieres incorporar los conocimientos más recientes en el momento de la consulta, sin volver a procesar toda la base de conocimientos.

En resumen, utiliza CAG para dominios estables en los que puedas optimizar el contexto con antelación, y RAG para escenarios dinámicos en los que la actualidad y la recuperación bajo demanda sean más importantes.

Echa un vistazo a este artículo sobre RAG frente a CAG para obtener una comparación más detallada.

¿Cuáles son algunos sistemas RAG avanzados?

Existen muchos sistemas RAG avanzados.

Uno de estos sistemas es el Adaptive RAG, en el que el sistema no solo recupera información, sino que también ajusta su enfoque en tiempo real en función de la consulta. El RAG adaptativo puede decidir no realizar ninguna recuperación, realizar un RAG único o realizar un RAG iterativo. Este comportamiento dinámico hace que el sistema RAG sea más robusto y relevante para la solicitud del usuario.

Otro sistema RAG avanzado es Agentic RAG, que introduce agentes de recuperación (), herramientas que deciden si extraer o no información de una fuente. Al dotar a un modelo lingüístico de esta capacidad, este puede determinar por sí mismo si necesita información adicional, lo que agiliza el proceso.

El RAG correctivo (CRAG) también está ganando popularidad. En este enfoque, el sistema revisa los documentos que recupera, comprobando su relevancia. Solo los documentos clasificados como relevantes se introducirían en el generador. Este paso de autocorrección ayuda a garantizar que se utilice información precisa y relevante. Para obtener más información, puedes leer este tutorial sobre Implementación de RAG correctivo (CRAG) con LangGraph.

El auto-RAG ( ) va un paso más allá al evaluar no solo los documentos recuperados, sino también las respuestas finales generadas, asegurándose de que ambos estén alineados con la consulta del usuario. Esto conduce a resultados más fiables y consistentes.

¿Cómo puedes reducir la latencia en un sistema RAG en tiempo real sin sacrificar la precisión?

Un enfoque eficaz consiste en precargar la información relevante y más solicitada para que esté lista cuando se necesite. Además, perfeccionar los algoritmos de indexación y consulta puede marcar una gran diferencia en la rapidez con la que se recuperan y procesan los datos.

¿Cuáles son algunas de las limitaciones o retos de los sistemas RAG?

Aunque RAG es potente, tiene varias limitaciones y retos:

-

Dependencia de la calidad de los datos recuperados: Un sistema RAG es tan bueno como la información que recupera. Si el recuperador extrae documentos irrelevantes o incorrectos, la respuesta del generador se verá afectada. Garantizar fuentes de datos fiables y de alta calidad (y ajustar el recuperador) es un reto constante para evitar problemas de «basura entra, basura sale».

-

Mayor complejidad y latencia: RAG introduce un paso adicional de recuperación además de la generación, lo que hace que todo el sistema sea más complejo y computacionalmente más pesado que un LLM independiente. La búsqueda en una gran base de conocimientos puede añadir latencia y requerir importantes recursos informáticos, por lo que los sistemas RAG deben equilibrar la precisión con la eficiencia.

-

Necesidad de mantener la base de conocimientos: A diferencia de los LLM estáticos, el RAG depende de un repositorio de conocimientos externo que necesita actualizaciones y curación periódicas. Las organizaciones deben incorporar continuamente nuevos datos, eliminar la información obsoleta y gestionar los índices. Sin fuentes de datos fiables y actualizadas, un sistema RAG puede perder rápidamente su eficacia o incluso proporcionar respuestas obsoletas.

-

Dificultad de integración y ajuste: Combinar la recuperación y la generación implica más componentes que ajustar y supervisar (la base de datos vectorial, el modelo de recuperación y el LLM). La resolución de errores puede resultar más difícil, ya que los problemas pueden tener su origen tanto en la recuperación como en la generación. Esta complejidad puede aumentar el esfuerzo de desarrollo y mantenimiento en comparación con el uso exclusivo de un LLM.

También cabe señalar que, si los datos de un dominio son en gran medida estáticos y se ajustan al entrenamiento del modelo, un LLM ajustado podría ser suficiente en lugar de un RAG. Sin embargo, el ajuste fino carece de la capacidad de RAG para incorporar información nueva sobre la marcha y puede resultar más costoso volver a entrenar el modelo cada vez que se actualiza el conocimiento.

Preguntas de la entrevista de RAG para ingenieros de IA

Ahora, abordemos algunas preguntas específicas dirigidas a quienes se presentan a entrevistas para puestos de ingeniero de IA.

Obtén una certificación superior en IA

¿Cómo evaluarías y mejorarías el rendimiento de un sistema RAG en un entorno de producción?

En primer lugar, tendrás que programar el seguimiento de los comentarios de los usuarios para evaluar el rendimiento del sistema y su relevancia.

También te interesará supervisar la latencia para garantizar que las respuestas sean oportunas y evaluar la calidad tanto de los documentos recuperados como de los resultados generados. Las métricas clave como la precisión de las respuestas, la satisfacción de los usuarios y el rendimiento del sistema son importantes.

Para aumentar el rendimiento, puedes volver a entrenar partes del sistema con datos actualizados o ajustar los parámetros. También podrías perfeccionar los algoritmos de recuperación para mejorar la relevancia y la eficiencia, y actualizar periódicamente las fuentes de conocimiento para mantenerlas al día.

Las evaluaciones continuas del rendimiento y las pruebas A/B pueden proporcionar información útil para realizar mejoras continuas.

¿Cómo se garantiza la fiabilidad y solidez de un sistema RAG en producción, especialmente ante posibles fallos o entradas inesperadas?

La creación de un sistema RAG listo para la producción requiere hacer frente a diversos retos. Las posibles soluciones podrían incluir:

- Redundancia y conmutación por error: Implementación de componentes redundantes o sistemas de respaldo para garantizar el funcionamiento continuo en caso de fallos.

- Gestión de errores y registro de errores: Implementación de mecanismos de gestión de errores para detectar y registrar errores, lo que permite un diagnóstico y una resolución de problemas rápidos.

- Validación y desinfección de entradas: Validación y desinfección de las entradas de los usuarios para evitar posibles vulnerabilidades y ataques como inyecciones de comandos.

- Supervisión y alertas: Configuración de sistemas de supervisión y alerta para detectar y abordar problemas de rendimiento o posibles amenazas.

¿Cómo diseñarías un sistema RAG para una tarea específica (por ejemplo, respuesta a preguntas, resumen)?

Para un sistema de respuesta a preguntas, puedes empezar por elegir un recuperador que pueda encontrar y obtener de manera eficiente documentos relevantes basándose en la consulta del usuario. Esto podría ser algo tradicional, como las búsquedas por palabras clave, o más avanzado, como el uso de incrustaciones densas para una mejor recuperación. A continuación, debes elegir o ajustar un generador que pueda crear respuestas precisas y coherentes utilizando los documentos recuperados.

En lo que respecta a la síntesis, la función del recuperador es recopilar contenido exhaustivo relacionado con el documento o tema en cuestión. Por otro lado, el generador debe ser capaz de destilar este contenido en resúmenes concisos y significativos.

La ingeniería rápida es crucial aquí. Dependiendo de la tarea posterior, es necesario crear indicaciones que guíen al modelo para que incorpore la información recuperada y produzca el resultado pertinente.

¿Podrías explicar los detalles técnicos de cómo ajustarías un LLM para una tarea RAG?

Comienza con la recopilación y preparación de datos específicos para la tarea. Podrían ser ejemplos anotados de pares de preguntas y respuestas o conjuntos de datos de resúmenes.

Entonces, podrías utilizar técnicas como el modelado de lenguaje aumentado por recuperación (REALM), que ayuda al modelo a integrar mejor los documentos que recupera en sus respuestas. Esto a menudo implica ajustar la arquitectura del modelo o los métodos de entrenamiento para mejorar su manejo del contexto de los documentos recuperados.

También puedes utilizar Retrieval-Augmented Fine-Tuning (RAFT), que combina las ventajas de RAG con el ajuste fino, lo que permite al modelo aprender tanto conocimientos específicos del dominio como a recuperar y utilizar eficazmente información externa.

¿Cómo gestionas la información obsoleta o irrelevante en un sistema RAG, especialmente en ámbitos que cambian rápidamente?

Un enfoque consiste en implementar actualizaciones periódicas de la base de conocimientos o del índice de documentos, de modo que se incorpore la nueva información a medida que esté disponible. Esto puede implicar la configuración de flujos de trabajo automatizados que recopilen o incorporen periódicamente contenido actualizado, lo que garantiza que el recuperador siempre trabaje con los datos más recientes.

Además, el etiquetado de metadatos se puede utilizar para marcar la información obsoleta, lo que permite al sistema dar prioridad a los documentos más recientes y relevantes durante la recuperación.

En ámbitos que cambian rápidamente, también es importante integrar mecanismos que filtren o reclasifiquen los resultados de búsqueda en función de su actualidad. Por ejemplo, dar mayor importancia a los artículos o documentos más recientes durante la recuperación ayuda a garantizar que las respuestas generadas se basen en fuentes actualizadas.

Otra técnica consiste en utilizar bucles de retroalimentación o sistemas con intervención humana, en los que las imprecisiones señaladas pueden corregirse rápidamente y el recuperador puede ajustarse para evitar recuperar información obsoleta.

¿Cómo equilibras la relevancia y la diversidad de la recuperación en un sistema RAG para garantizar respuestas completas?

Equilibrar la relevancia y la diversidad en un sistema RAG consiste en proporcionar respuestas precisas y completas. La relevancia garantiza que los documentos recuperados coincidan estrechamente con la consulta, mientras que la diversidad asegura que el sistema no se centre demasiado en una sola fuente o punto de vista.

Una forma de equilibrar ambos aspectos es utilizar estrategias de reclasificación que den prioridad tanto a la relevancia como a la diversidad. También puedes mejorar la diversidad extrayendo documentos de diversas fuentes o secciones dentro de la base de conocimientos.

Agrupar resultados similares y seleccionar documentos de diferentes grupos también puede ser útil.

El ajuste fino del recuperador, centrándose tanto en la relevancia como en la diversidad, también puede garantizar que el sistema recupere un conjunto completo de documentos.

¿Cómo se garantiza que los resultados generados en un sistema RAG sigan siendo coherentes con la información recuperada?

Un enfoque clave es el estrecho vínculo entre la recuperación y la generación mediante la ingeniería de indicaciones. Las indicaciones cuidadosamente diseñadas que instruyen explícitamente al modelo lingüístico a basar sus respuestas en los documentos recuperados ayudan a garantizar que la generación se mantenga fundamentada en los datos proporcionados por el recuperador.

Además, técnicas como la generación de citas, en las que se pide al modelo que haga referencia o justifique sus respuestas con las fuentes recuperadas, pueden ayudar a mantener la coherencia.

Otro enfoque consiste en aplicar comprobaciones o validaciones posteriores a la generación, en las que se compara el resultado con los documentos recuperados para garantizar la alineación. Esto se puede lograr utilizando métricas de similitud o empleando modelos de verificación más pequeños que validen la coherencia factual entre los datos recuperados y el texto generado.

En algunos casos, se pueden utilizar métodos de refinamiento iterativos en los que el modelo primero genera un resultado y, a continuación, vuelve a revisar los documentos recuperados para comprobar y refinar su respuesta. Los bucles de retroalimentación y las correcciones de los usuarios también pueden aprovecharse para mejorar la coherencia a lo largo del tiempo, ya que el sistema aprende de las incoherencias pasadas y ajusta sus mecanismos de recuperación y generación en consecuencia.

¿Cómo garantizas la privacidad y la seguridad de los datos en un sistema RAG, especialmente cuando se trata de información confidencial?

Garantizar la privacidad y la seguridad en los sistemas RAG es fundamental cuando los datos recuperados o las consultas de los usuarios contienen información confidencial o personal. Las estrategias clave incluyen:

-

Redacción y anonimización de datos: Antes de que los datos entren en el canal RAG, elimina u oculta la información de identificación personal (PII) y otros datos confidenciales. Por ejemplo, se pueden escanear documentos y se puede ocultar cualquier información de identificación personal (PII) en el momento de su ingestión. Este enfoque de confianza cero significa que, incluso si se recuperan los datos, no se revelará información confidencial, ya que se ha limpiado previamente.

-

Almacenamiento y transferencia seguros de datos: Utiliza el cifrado para los datos en reposo (en bases de datos o almacenes vectoriales) y en tránsito cuando el recuperador se comunica con el almacenamiento. Garantizar que la base de datos vectorial y las fuentes de conocimiento tengan control de acceso (con la autenticación y autorización adecuadas) evita el acceso no autorizado. Solo las aplicaciones o servicios de confianza deben poder leer la base de conocimientos.

-

Controles de acceso basados en roles: Implementa filtros de acceso estrictos en los resultados de búsqueda. Puedes etiquetar fragmentos de conocimiento con metadatos sobre quién puede verlos (por ejemplo, administrador frente a usuario) y hacer que el sistema RAG aplique estas reglas durante la recuperación. Por ejemplo, un asistente RAG para el sector sanitario podría permitir a los médicos recuperar información que identifica a los pacientes, pero nunca mostrarla a otros usuarios.

-

Filtrado rápido y supervisión de la salida: Incorporar barreras de seguridad basadas en IA para evitar que el LLM genere datos privados. Técnicas como la defensa contra inyecciones de comandos, el escaneo de salidas o las políticas (como las directrices OWASP para LLM) pueden ayudar a detectar y eliminar contenido confidencial de las respuestas. La revisión con intervención humana también se puede utilizar en ámbitos de alto riesgo.

-

Cumplimiento y auditoría: Asegúrate de que el sistema RAG cumpla con las normativas de protección de datos (RGPD, HIPAA, etc.) desde su diseño. Esto incluye mantener registros de auditoría de los datos que se han recuperado y cuándo, obtener el consentimiento adecuado de los usuarios para utilizar sus datos y auditar periódicamente las fuentes de conocimiento en busca de información confidencial.

Al combinar estas medidas, un sistema RAG puede manejar datos confidenciales de forma segura. En una entrevista, se esperaría que mencionaras que la protección de los datos de los usuarios no es solo una idea de último momento, sino que está integrada en la forma en que el canal RAG ingesta, almacena, recupera y genera información.

Conclusión

Esta guía te ha proporcionado 30 preguntas clave para entrevistas que te ayudarán a prepararte para debates sobre RAG, desde conceptos básicos hasta sistemas RAG avanzados.

Si deseas obtener más información sobre los sistemas RAG, te recomiendo estos blogs:

Ryan es un científico de datos líder especializado en la creación de aplicaciones de IA utilizando LLMs. Es candidato al doctorado en Procesamiento del Lenguaje Natural y Grafos de Conocimiento en el Imperial College de Londres, donde también completó su máster en Informática. Fuera de la ciencia de datos, escribe un boletín semanal de Substack, The Limitless Playbook, donde comparte una idea procesable de los mejores pensadores del mundo y ocasionalmente escribe sobre conceptos básicos de la IA.