Cursus

Zoals we bespreken in ons artikel Aan de slag met MLOps, is MLOps gebouwd op de fundamenten van DevOps: de softwareontwikkelstrategie om bedrijfsapplicaties efficiënt te schrijven, te deployen en te draaien.

Het is een aanpak om machinelearningprojecten op schaal te beheren. MLOps verbetert de samenwerking tussen development-, operations- en datascienceteams. Het resultaat: snellere modeluitrol, geoptimaliseerde teamproductiviteit, minder risico en kosten, en continue modelmonitoring in productie.

Lees waarom MLOps belangrijk is en welke problemen het wil oplossen in onze blog Het verleden, heden en de toekomst van MLOps.

In deze post bekijken we de beste MLOps-tools voor modelontwikkeling, -uitrol en -monitoring om het machinelearning-ecosysteem te standaardiseren, vereenvoudigen en stroomlijnen. Wil je een grondige introductie in de MLOps Fundamentals? Bekijk dan onze Skill Track.

Framework voor Large Language Models (LLM’s)

Met de introductie van GPT-4 en later GPT-4o is de race begonnen om large language models te bouwen en het volledige potentieel van moderne AI te benutten. LLM’s hebben vectordatabases en integratieframeworks nodig om slimme AI-toepassingen te bouwen.

1. Qdrant

Qdrant is een open-source vector similarity search engine en vectordatabase die een productieklare service biedt met een handige API, waarmee je vector-embeddings kunt opslaan, doorzoeken en beheren.

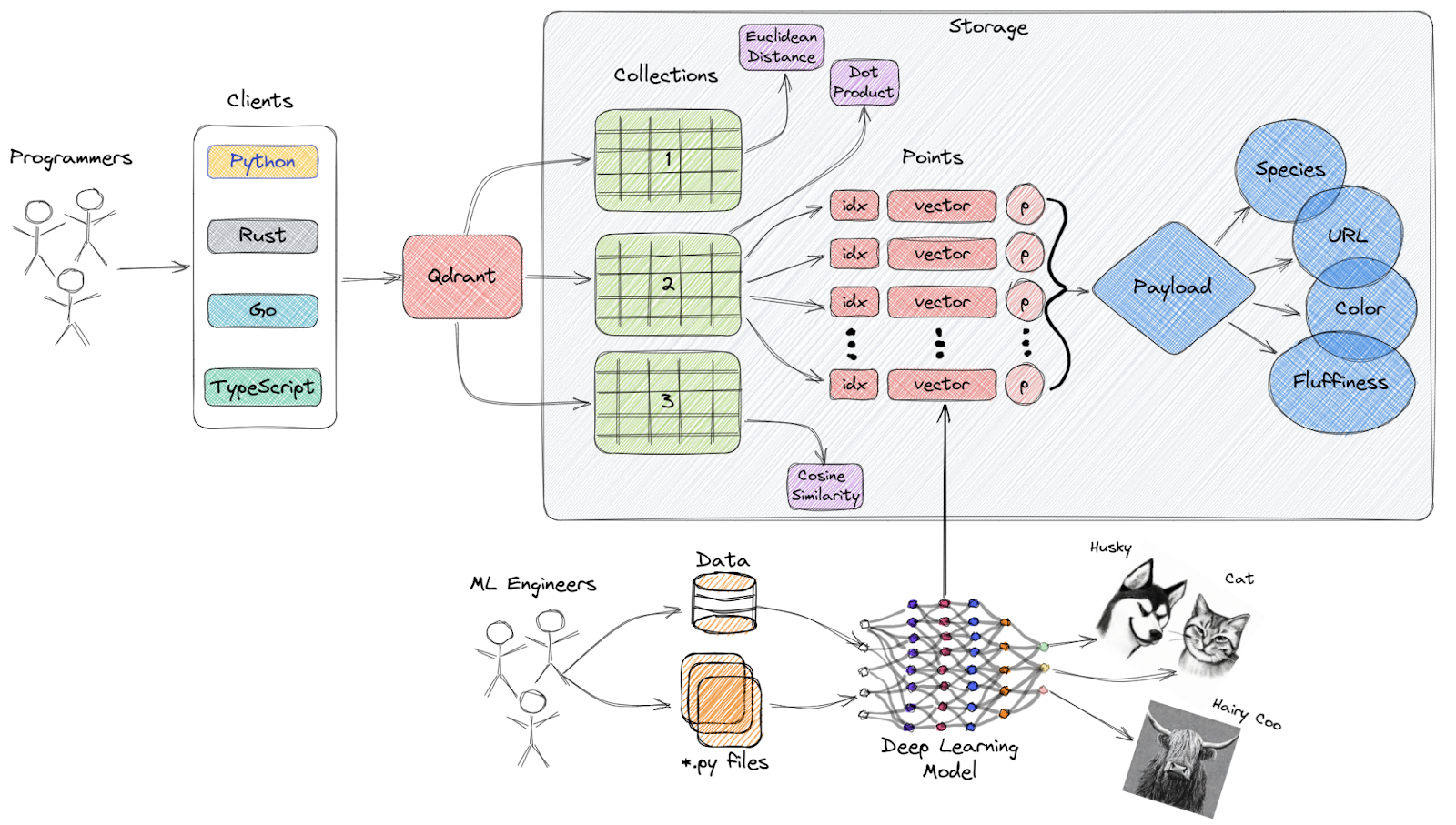

Overzicht op hoog niveau van de architectuur van Qdrant

Belangrijkste functies:

- Eenvoudige API: biedt een gebruiksvriendelijke Python-API en laat ontwikkelaars ook clientbibliotheken genereren in meerdere programmeertalen.

- Snel en nauwkeurig: gebruikt een unieke, aangepaste modificatie van het HNSW-algoritme voor Approximate Nearest Neighbor Search, met state-of-the-art zoeksnelheden zonder in te leveren op nauwkeurigheid.

- Rijke datatypen: Qdrant ondersteunt een brede waaier aan datatypen en querycondities, waaronder stringmatching, numerieke bereiken, geolocaties en meer.

- Gedistribueerd: cloud-native en horizontaal schaalbaar, zodat ontwikkelaars precies genoeg rekenbronnen kunnen inzetten voor elke hoeveelheid data die ze willen serveren.

- Efficiënt: volledig ontwikkeld in Rust, een taal die bekendstaat om performance en efficiënt gebruik van resources.

Ontdek de beste vectordatabases in De 5 beste vectordatabases | Een lijst met voorbeelden.

2. LangChain

LangChain is een veelzijdig en krachtig framework voor het ontwikkelen van toepassingen die worden aangestuurd door taalmodellen. Het biedt diverse componenten waarmee ontwikkelaars contextbewuste en redeneergebaseerde applicaties kunnen bouwen, deployen en monitoren.

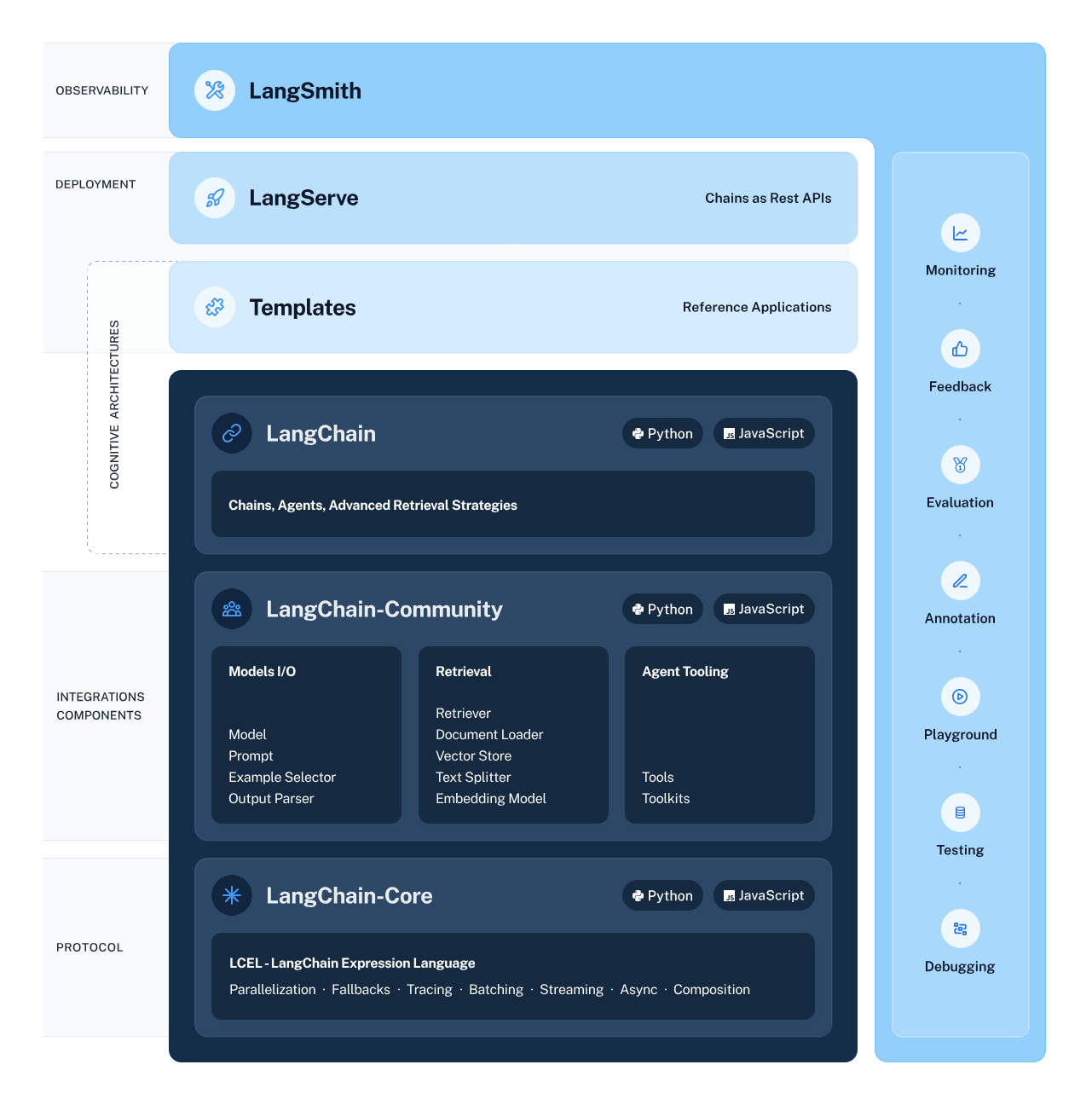

Het framework bestaat uit 4 hoofdonderdelen:

- LangChain-bibliotheken: de Python- en JavaScript-bibliotheken bieden interfaces en integraties waarmee je contextbewuste, redeneergebaseerde apps ontwikkelt.

- LangChain-templates: een collectie eenvoudig te deployen referentiearchitecturen voor uiteenlopende taken, met kant-en-klare oplossingen.

- LangServe: deze bibliotheek maakt het mogelijk om LangChain-ketens als REST API te deployen.

- LangSmith: een platform waarmee je ketens op elk LLM-framework kunt debuggen, testen, evalueren en monitoren.

LangChain-ecosysteem

Leer Hoe je LLM-toepassingen bouwt met LangChain en ontdek het onbenutte potentieel van large language models.

Tools voor experimenttracking en modelmetadata-beheer

Met deze tools beheer je modelmetadata en houd je experimenten bij:

3. MLFlow

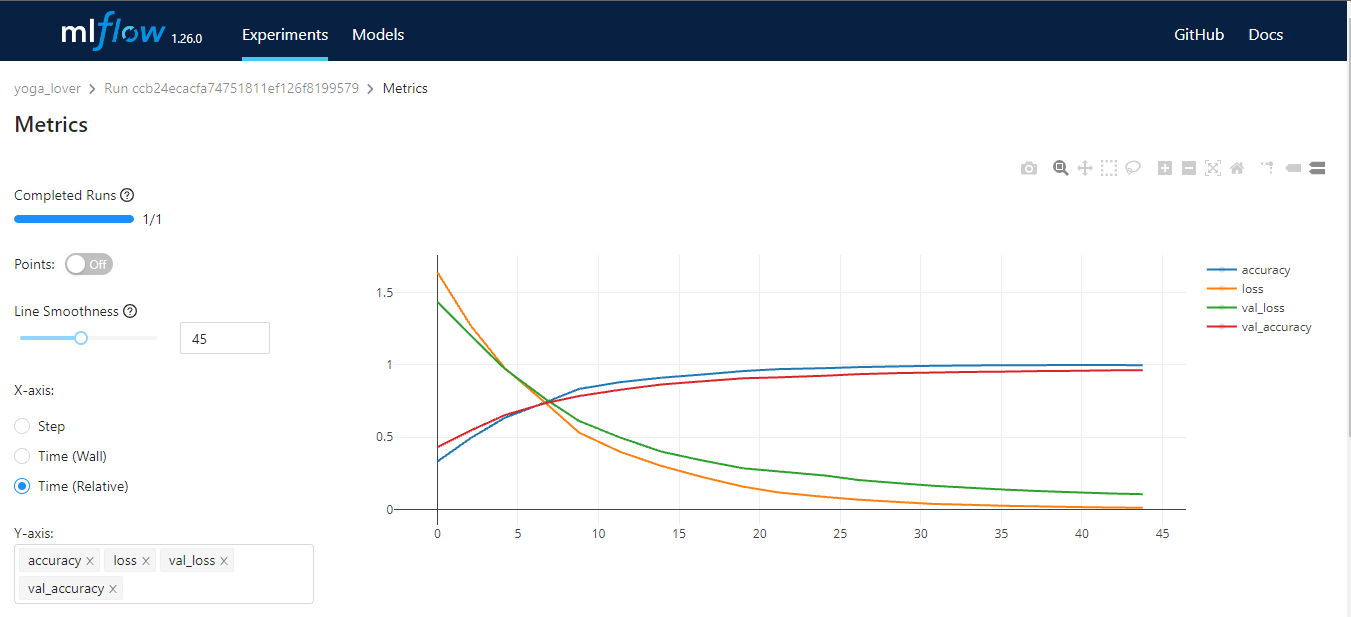

MLflow is een open-sourcetool die helpt bij het beheren van de kernonderdelen van de machinelearning-levenscyclus. Het wordt vaak gebruikt voor het bijhouden van experimenten, maar je kunt het ook inzetten voor reproduceerbaarheid, uitrol en een modelregister. Je kunt machinelearningexperimenten en modelmetadata beheren via CLI, Python, R, Java en REST API.

MLflow heeft vier kernfuncties:

- MLflow Tracking: code, data, configuratie en resultaten opslaan en benaderen.

- MLflow Projects: datasources verpakken voor reproduceerbaarheid.

- MLflow Models: machinelearningmodellen deployen en beheren naar verschillende servingomgevingen.

- MLflow Model Registry: een centrale modelopslag die versiebeheer, fasetransities, annotaties en beheer van machinelearningmodellen biedt.

Afbeelding door de auteur

4. Comet ML

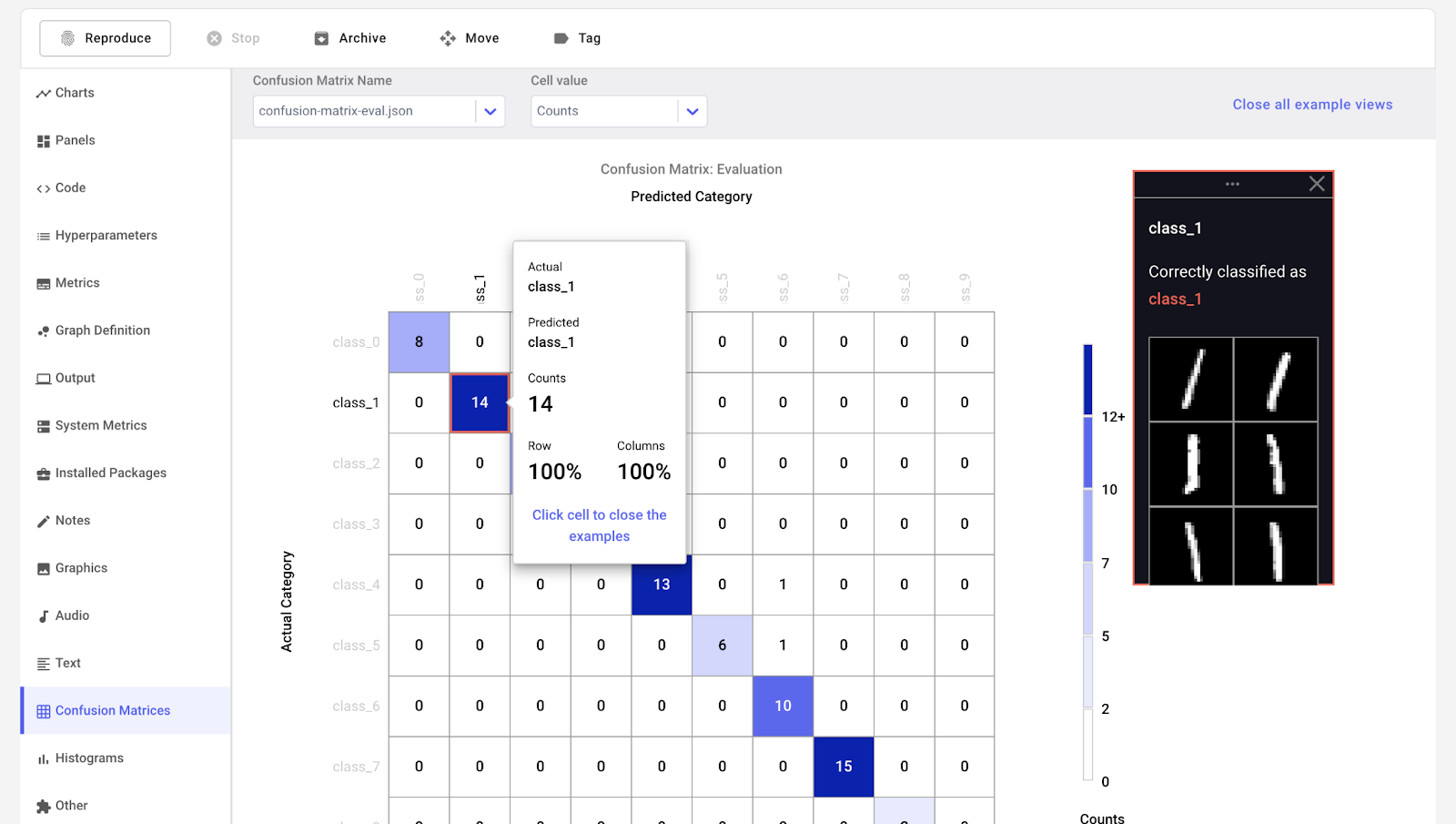

Comet ML is een platform voor het tracken, vergelijken, verklaren en optimaliseren van machinelearningmodellen en -experimenten. Je kunt het gebruiken met elke ML-bibliotheek, zoals Scikit-learn, PyTorch, TensorFlow en HuggingFace.

Comet ML is er voor individuen, teams, bedrijven en academici. Het stelt iedereen in staat om experimenten eenvoudig te visualiseren en te vergelijken. Daarnaast kun je voorbeelden visualiseren uit beeld-, audio-, tekst- en tabeldata.

Afbeelding van Comet ML

5. Weights & Biases

Weights & Biases is een ML-platform voor het bijhouden van experimenten, versiebeheer van data en modellen, hyperparameteroptimalisatie en modelbeheer. Je kunt er bovendien artefacten (datasets, modellen, dependencies, pipelines en resultaten) mee loggen en datasets visualiseren (audio, visueel, tekst en tabulair).

Weights & Biases heeft een gebruiksvriendelijk centraal dashboard voor machinelearningexperimenten. Net als Comet ML kun je het integreren met andere ML-bibliotheken, zoals Fastai, Keras, PyTorch, Hugging Face, Yolov5, Spacy en nog veel meer. Bekijk onze introductie tot Weights & Biases in een apart artikel.

Gif van Weights & Biases

Let op: je kunt ook TensorBoard, Pachyderm, DagsHub en DVC Studio gebruiken voor experimenttracking en ML-metadata-beheer.

MLOps-tools voor orkestratie en workflow-pipelines

Met deze tools bouw je datasci-projecten en beheer je machinelearningworkflows:

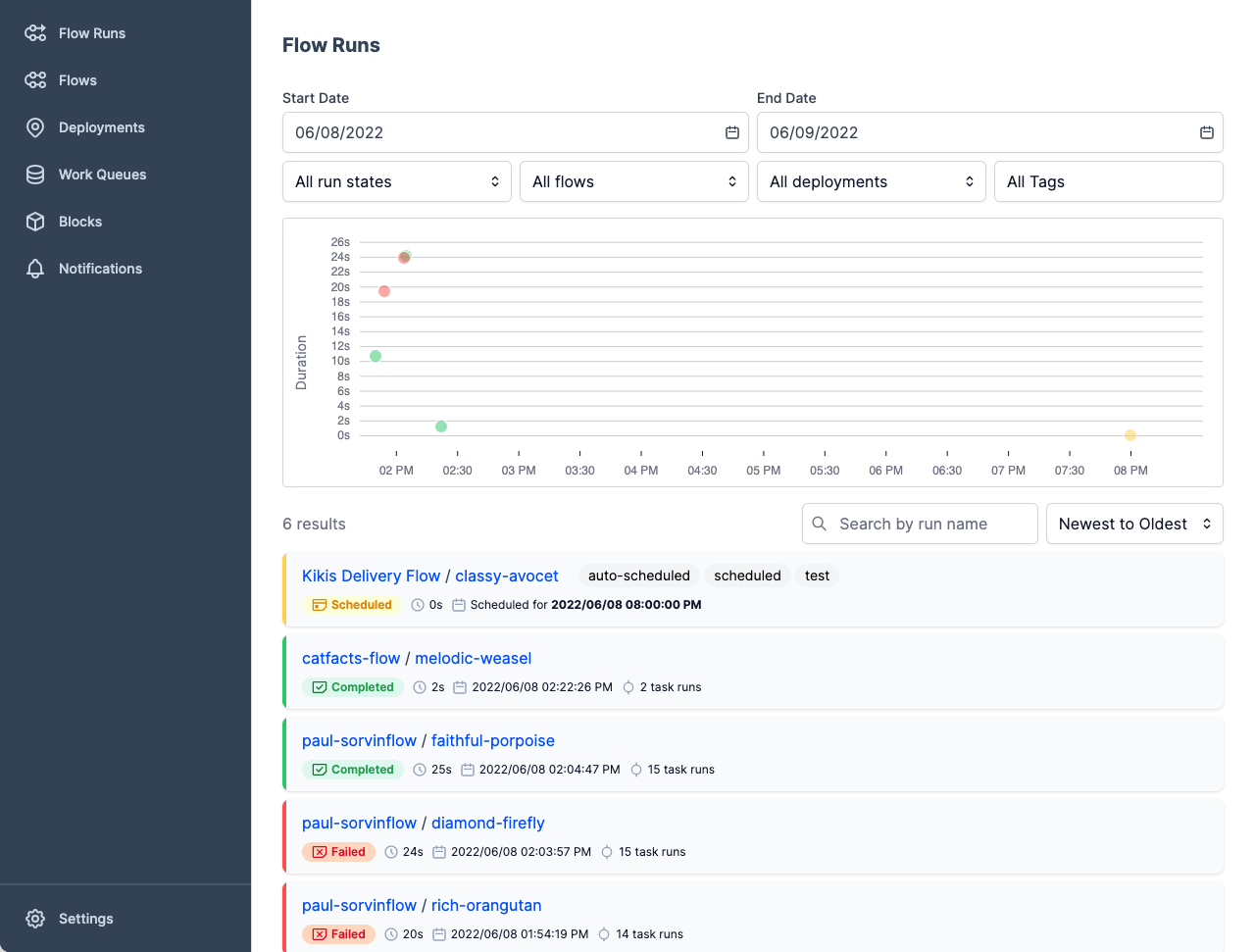

6. Prefect

Prefect is een moderne datastack voor het monitoren, coördineren en orkestreren van workflows tussen en over applicaties heen. Het is een open-source, lichtgewicht tool gebouwd voor end-to-end machinelearningpipelines.

Je kunt voor databases kiezen uit Prefect Orion UI of Prefect Cloud.

- Prefect Orion UI is een open-source, lokaal gehoste orkestratiemotor en API-server. Het geeft inzicht in de lokale Prefect Orion-instantie en de workflows.

- Prefect Cloud is een hosted service om flows, flow runs en deployments te visualiseren. Daarnaast beheer je accounts, workspaces en teamsamenwerking.

Afbeelding van Prefect

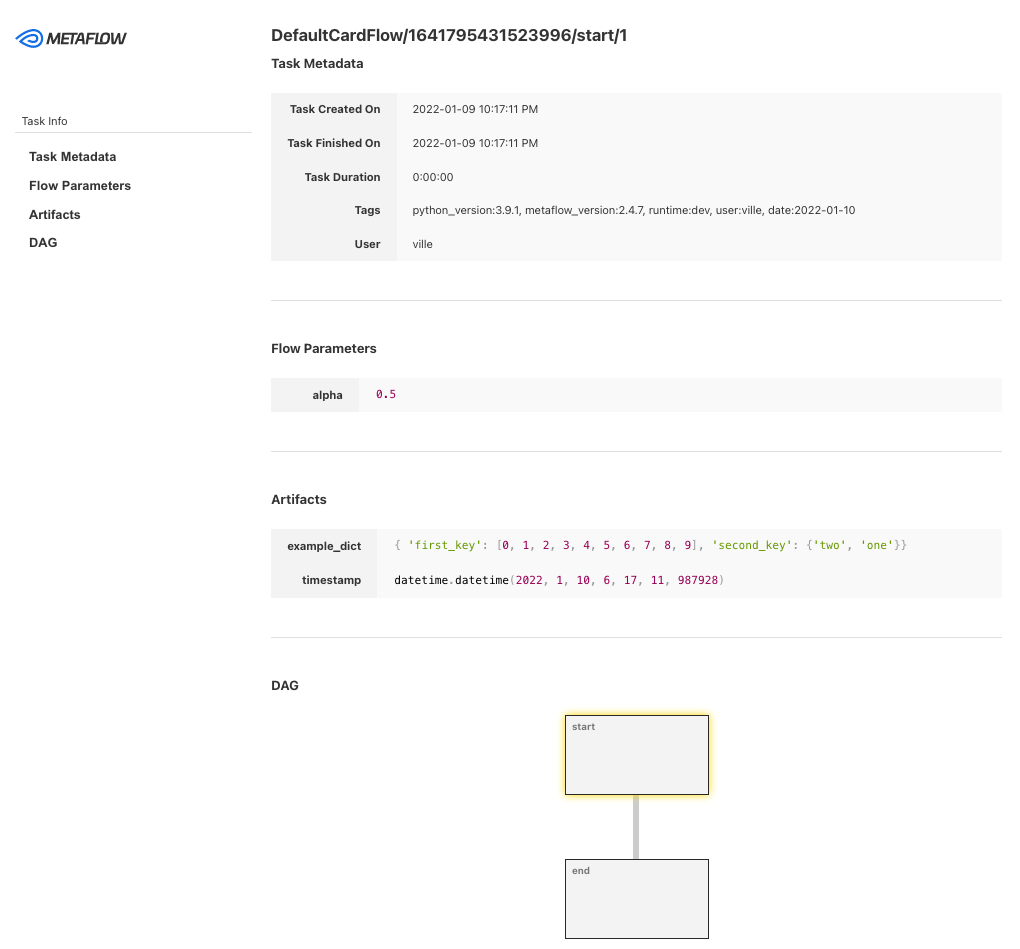

7. Metaflow

Metaflow is een krachtige, door de praktijk geharde workflowmanagementtool voor data science- en machinelearningprojecten. Het is gebouwd voor data scientists, zodat zij zich kunnen richten op het bouwen van modellen in plaats van op MLOps-engineering.

Met Metaflow kun je een workflow ontwerpen, op schaal draaien en het model in productie deployen. Het houdt ML-experimenten en data automatisch bij en versieert ze. Daarnaast kun je resultaten visualiseren in de notebook.

Metaflow werkt met meerdere clouds (waaronder AWS, GCP en Azure) en met diverse ML-Pythonpakketten (zoals Scikit-learn en TensorFlow), en de API is ook beschikbaar voor R.

Afbeelding van Metaflow

8. Kedro

Kedro is een op Python gebaseerde tool voor workflow-orkestratie. Je gebruikt het om reproduceerbare, onderhoudbare en modulaire datasci-projecten te maken. Het integreert softwareengineeringconcepten in machine learning, zoals modulariteit, separation of concerns en versiebeheer.

Met Kedro kun je:

- Dependencies en configuratie instellen.

- Data inrichten.

- Pipelines maken, visualiseren en draaien.

- Logging en experimenttracking uitvoeren.

- Deployen op één of meerdere (gedistribueerde) machines.

- Onderhoudbare datasci-code schrijven.

- Modulaire, herbruikbare code maken.

- Samenwerken met teamgenoten aan projecten.

Gif van Kedro

Let op: je kunt ook Kubeflow en DVC gebruiken voor orkestratie en workflow-pipelines.

Tools voor versiebeheer van data en pipelines

Met deze MLOps-tools beheer je taken rond versiebeheer van data en pipelines:

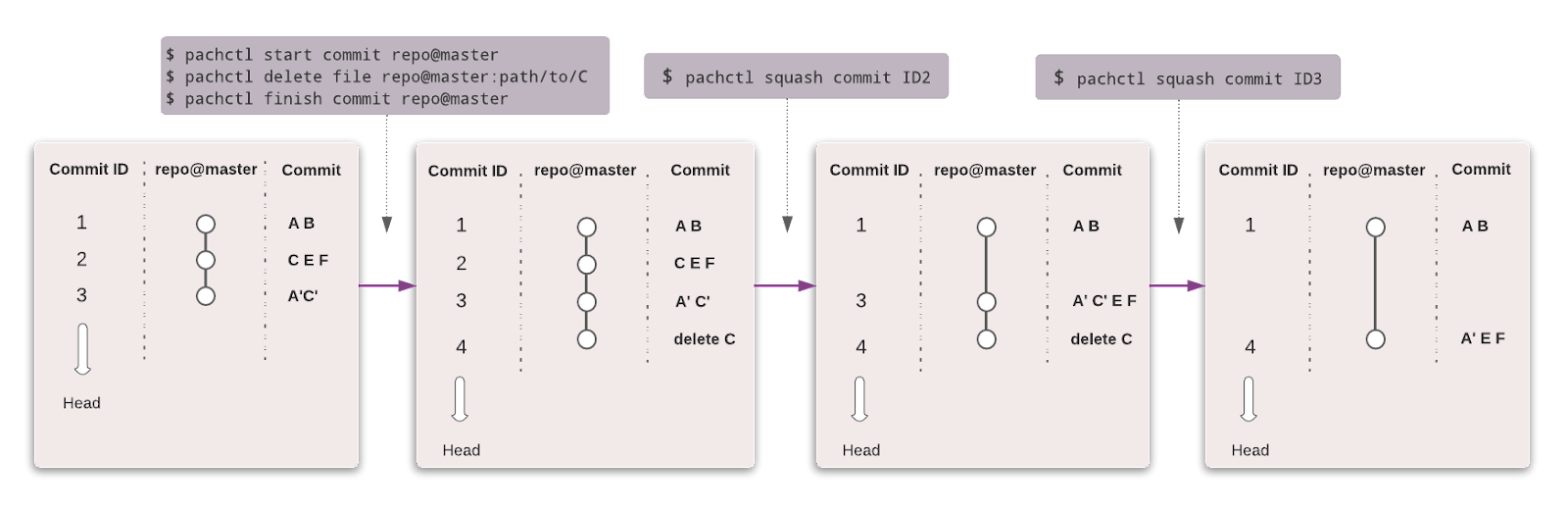

9. Pachyderm

Pachyderm automatiseert datatransformatie met dataversiebeheer, herkomst (lineage) en end-to-end pipelines op Kubernetes. Je kunt integreren met elke vorm van data (afbeeldingen, logs, video, CSV’s), elke taal (Python, R, SQL, C/C++) en op elke schaal (petabytes aan data, duizenden jobs).

De community-editie is open source en geschikt voor een klein team. Organisaties en teams die geavanceerde functies willen, kunnen kiezen voor de Enterprise-editie.

Net als met Git kun je je data versiebeheren met een vergelijkbare syntax. In Pachyderm is het hoogste objectniveau Repository, en je gebruikt Commit, Branches, File, History en Provenance om de dataset te volgen en te versiebeheren.

Afbeelding van Pachyderm

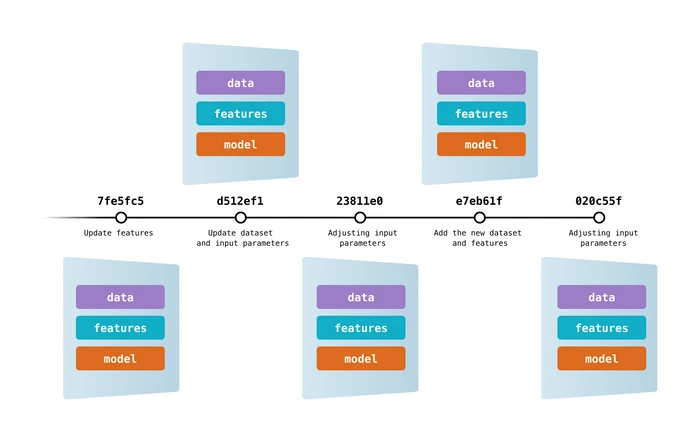

10. Data Version Control (DVC)

Data Version Control is een open-source en populaire tool voor machinelearningprojecten. Het werkt naadloos met Git en voorziet in versiebeheer van code, data, model, metadata en pipelines.

DVC is meer dan alleen een tool voor datatracking en -versiebeheer.

Je kunt het gebruiken voor:

- Experimenttracking (modelmetingen, parameters, versiebeheer).

- Machinelearningpipelines maken, visualiseren en draaien.

- Workflow voor deployment en samenwerking.

- Reproduceerbaarheid.

- Data- en modelregister.

- Continue integratie en deployment voor machine learning met CML.

Afbeelding van DVC

Let op: DagsHub kan ook worden gebruikt voor versiebeheer van data en pipelines.

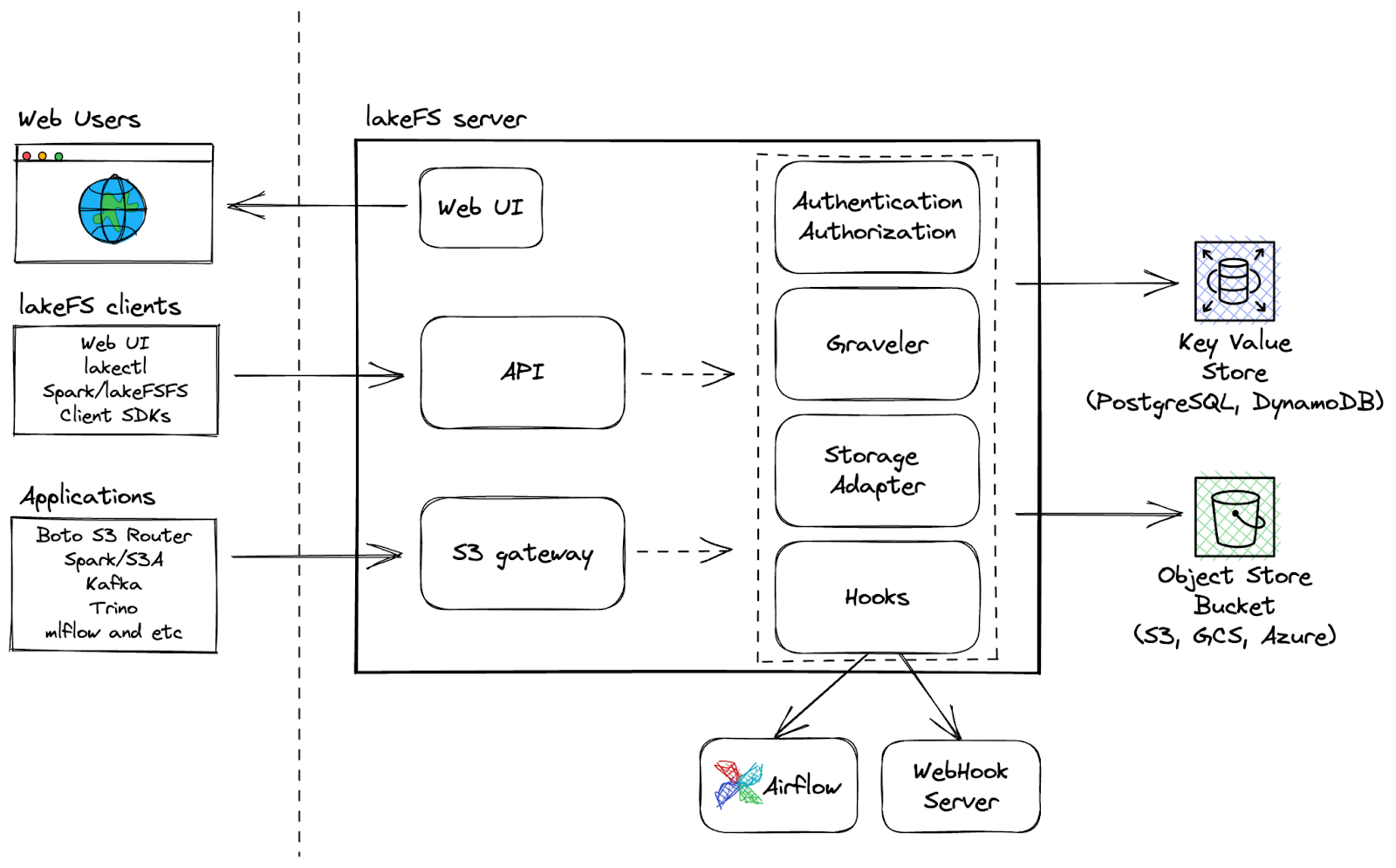

11. LakeFS

LakeFS is een open-source, schaalbare tool voor dataversiebeheer die een Git-achtige interface biedt voor objectopslag, zodat gebruikers hun datalakes kunnen beheren zoals hun code. Met LakeFS kun je data op exabyteschaal versiebeheren, wat het tot een zeer schaalbare oplossing maakt voor grote datalakes.

Aanvullende mogelijkheden:

- Voer Git-bewerkingen uit zoals branch, commit en merge op elke opslagservice

- Snellere ontwikkeling met zero-copy branching voor frictieloos experimenteren en makkelijke samenwerking

- Gebruik pre-commit- en merge-hooks voor CI/CD-workflows voor schone processen

- Veerkrachtig platform waardoor je sneller kunt herstellen van dataproblemen met revert-mogelijkheden.

LakeFS-architectuur

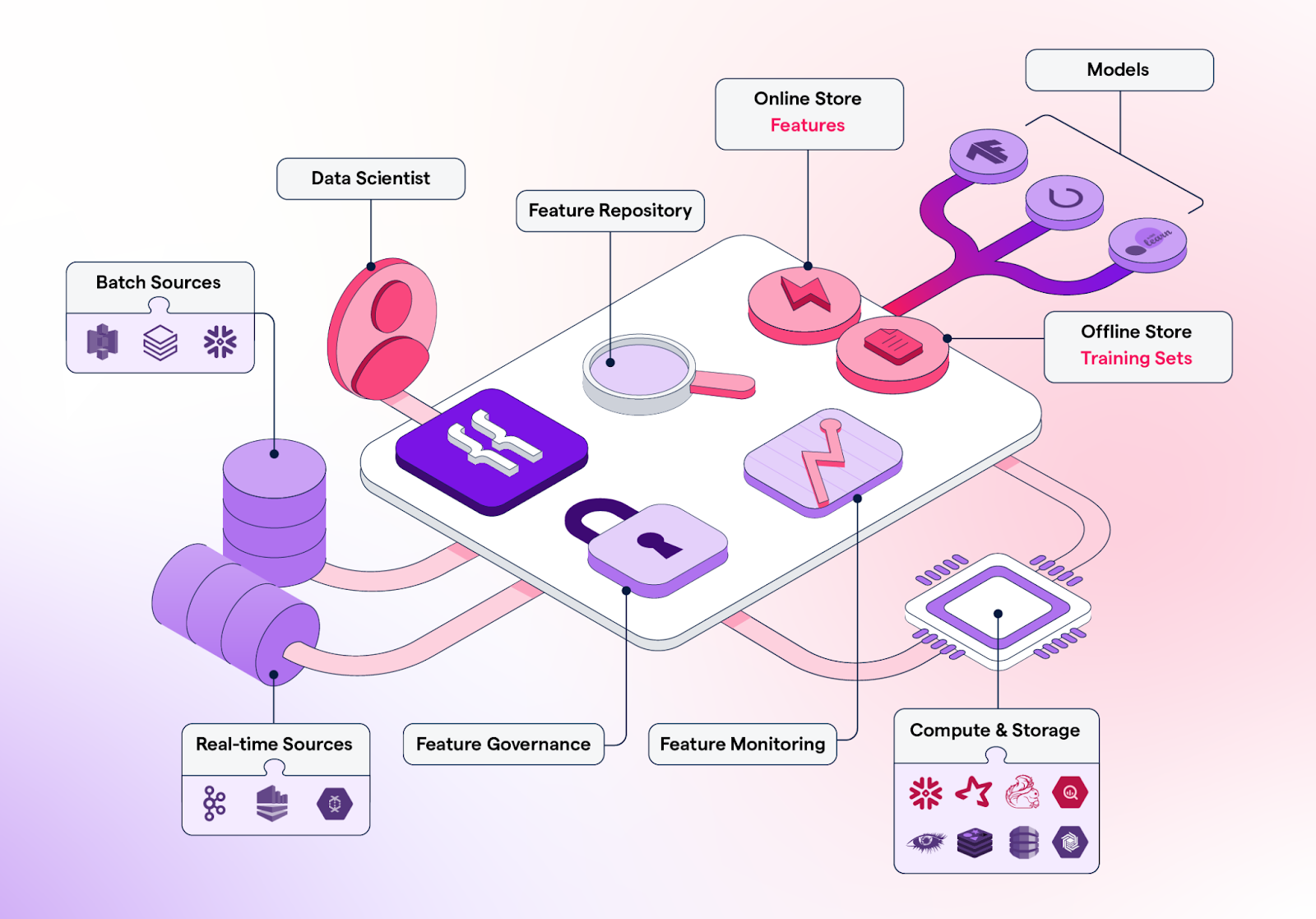

Feature stores

Feature stores zijn centrale repositories voor het opslaan, versiebeheren, beheren en serveren van features (verwerkte data-attributen die gebruikt worden voor het trainen van ML-modellen) voor modellen in productie én voor training.

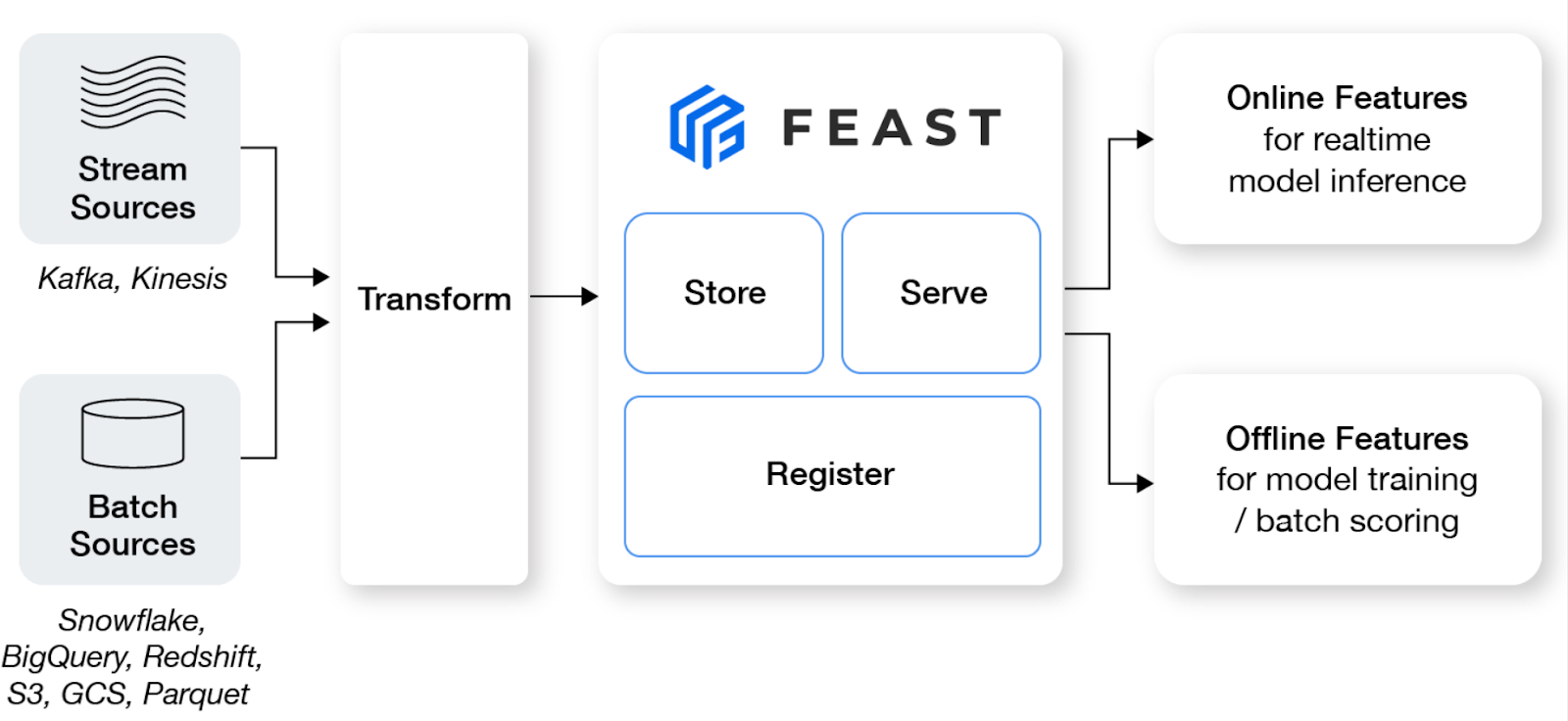

12. Feast

Feast is een open-source feature store die ML-teams helpt realtimemodellen te productiseren en een featureplatform te bouwen dat samenwerking tussen engineers en data scientists stimuleert.

Belangrijkste functies:

- Beheer een offline store, een low-latency online store en een feature server om features consistent beschikbaar te houden voor zowel training als serving.

- Voorkom datalekken door nauwkeurige point-in-time featuresets te maken, zodat data scientists niet hoeven te worstelen met foutgevoelige dataset joins.

- Koppel ML los van de datainfrastructuur met één enkele toegangslaag.

Afbeelding van Feast

13. Featureform

Featureform is een virtuele feature store waarmee data scientists de features van hun ML-modellen kunnen definiëren, beheren en serveren. Het helpt datasci-teams om beter samen te werken, experimenten te organiseren, deployment te faciliteren, betrouwbaarheid te vergroten en compliance te borgen.

Belangrijkste functies:

- Versterk samenwerking door features te delen, hergebruiken en begrijpen binnen het team.

- Als je feature klaar is voor productie, orkestreert Featureform je datainfrastructuur om het productieklaar te maken.

- Het systeem zorgt ervoor dat geen features, labels of trainingsets kunnen worden aangepast, voor meer betrouwbaarheid.

- Met ingebouwde role-based access control, auditlogs en dynamische servingregels kan Featureform je compliancelogica rechtstreeks afdwingen.

Afbeelding van Featureform

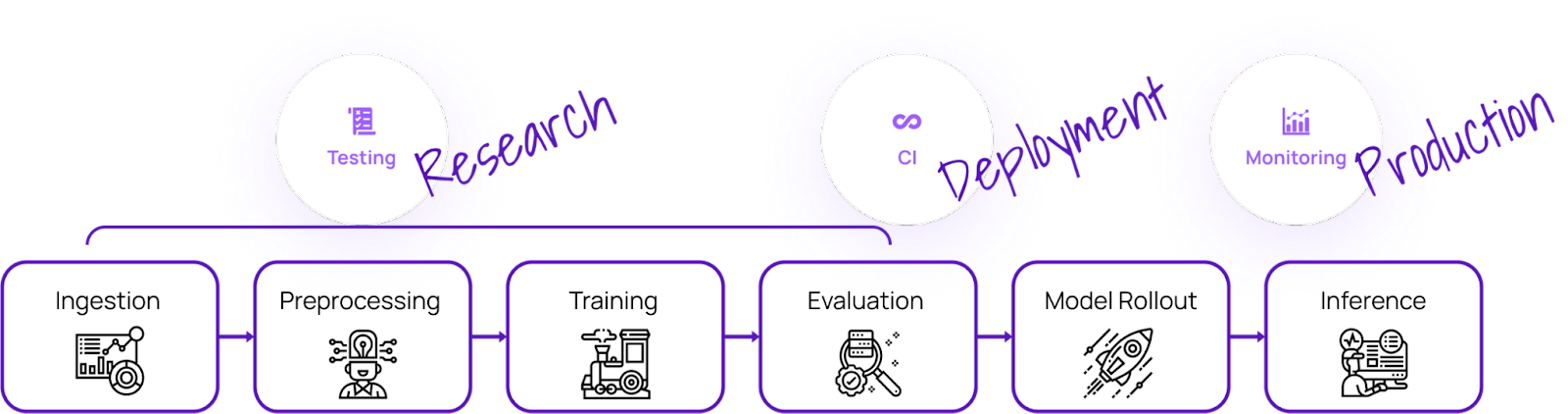

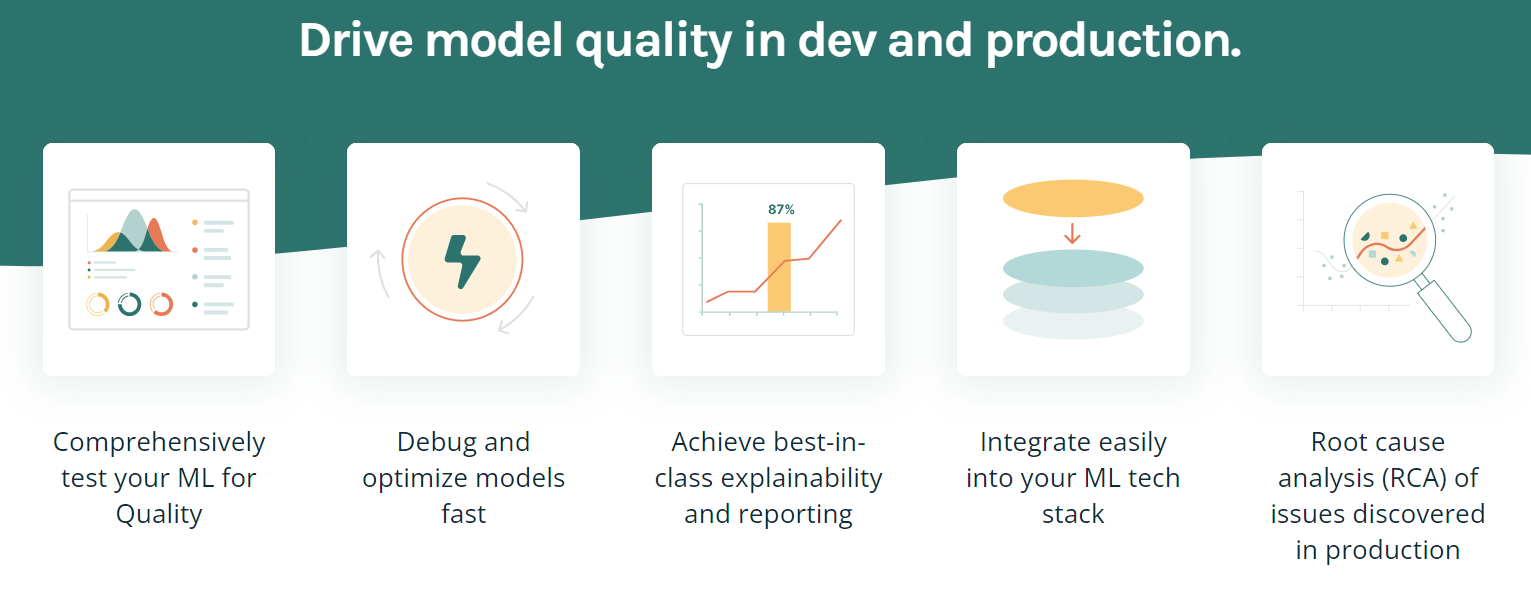

Modeltesten

Met deze MLOps-tools test je modelkwaliteit en borg je de betrouwbaarheid, robuustheid en nauwkeurigheid van machinelearningmodellen:

14. Deepchecks ML Models Testing

Deepchecks is een open-sourceoplossing voor al je ML-validatiebehoeften, zodat je data en modellen grondig getest worden van research tot productie. Het biedt een holistische aanpak om je data en modellen te valideren via verschillende componenten.

Afbeelding van Deepchecks

Deepchecks bestaat uit drie componenten:

- Deepchecks testing: laat je aangepaste checks en suites bouwen voor tabulaire data, natural language processing en computer vision-validatie.

- CI & testing management: biedt CI & Testing Management om samen te werken met je team en testresultaten effectief te beheren.

- Deepchecks monitoring: volgt en valideert modellen in productie.

15. TruEra

TruEra is een geavanceerd platform dat modelkwaliteit en -prestaties aanjaagt via geautomatiseerd testen, verklaarbaarheid en root-causeanalyse. Het biedt verschillende functies om modellen te optimaliseren en te debuggen, best-in-class verklaarbaarheid te bereiken en eenvoudig te integreren in je ML-techstack.

Belangrijkste functies:

- Met modeltesten en -debugging verbeter je modelkwaliteit tijdens ontwikkeling en productie.

- Kan geautomatiseerd en systematisch testen uitvoeren voor prestaties, stabiliteit en eerlijkheid.

- Begrijpt de evolutie van modelversies, zodat je inzichten kunt ophalen die snellere en effectievere modelontwikkeling sturen.

- Identificeer welke specifieke features bijdragen aan modelbias.

- TruEra laat zich eenvoudig integreren in je huidige infrastructuur en workflow.

Afbeelding door TruEra

Tools voor modeluitrol en -serving

Voor het deployen van modellen kunnen deze MLOps-tools enorm helpen:

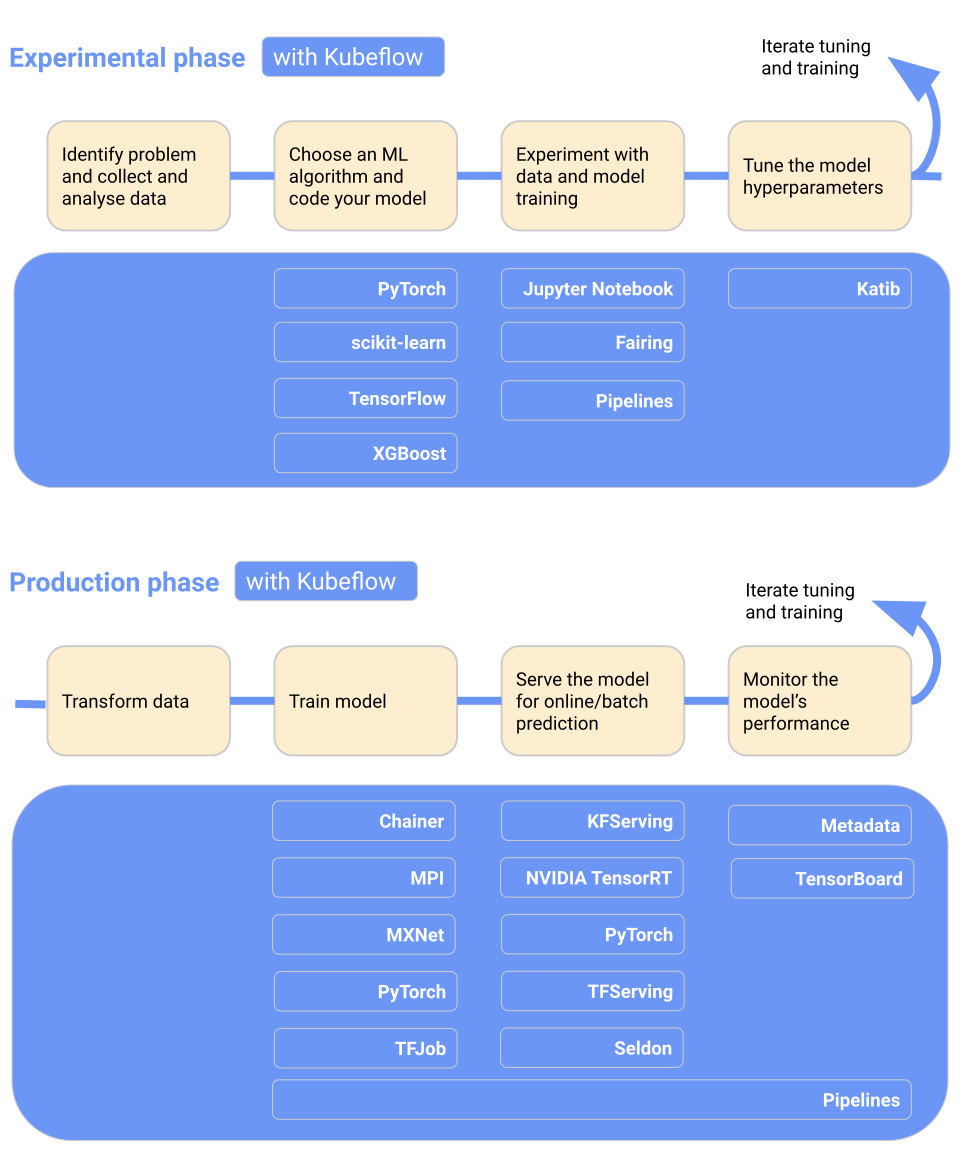

16. Kubeflow

Kubeflow maakt het deployen van ML-modellen op Kubernetes eenvoudig, draagbaar en schaalbaar. Je kunt het gebruiken voor datapreparatie, modeltraining, modeloptimalisatie, prediction serving en het monitoren van modelprestaties in productie. Je kunt ML-workflows lokaal, on-premises of in de cloud deployen. Kortom, het maakt Kubernetes toegankelijk voor datascienceteams.

Belangrijkste functies:

- Gecentraliseerd dashboard met interactieve UI.

- Machinelearningpipelines voor reproduceerbaarheid en stroomlijning.

- Native ondersteuning voor JupyterLab, RStudio en Visual Studio Code.

- Hyperparameter-tuning en neural architecture search.

- Trainingjobs voor TensorFlow, PyTorch, PaddlePaddle, MXNet en XGBoost.

- Taakplanning.

- Multi-user isolatie voor beheerders.

- Werkt met alle grote cloudproviders.

Afbeelding van Kubeflow

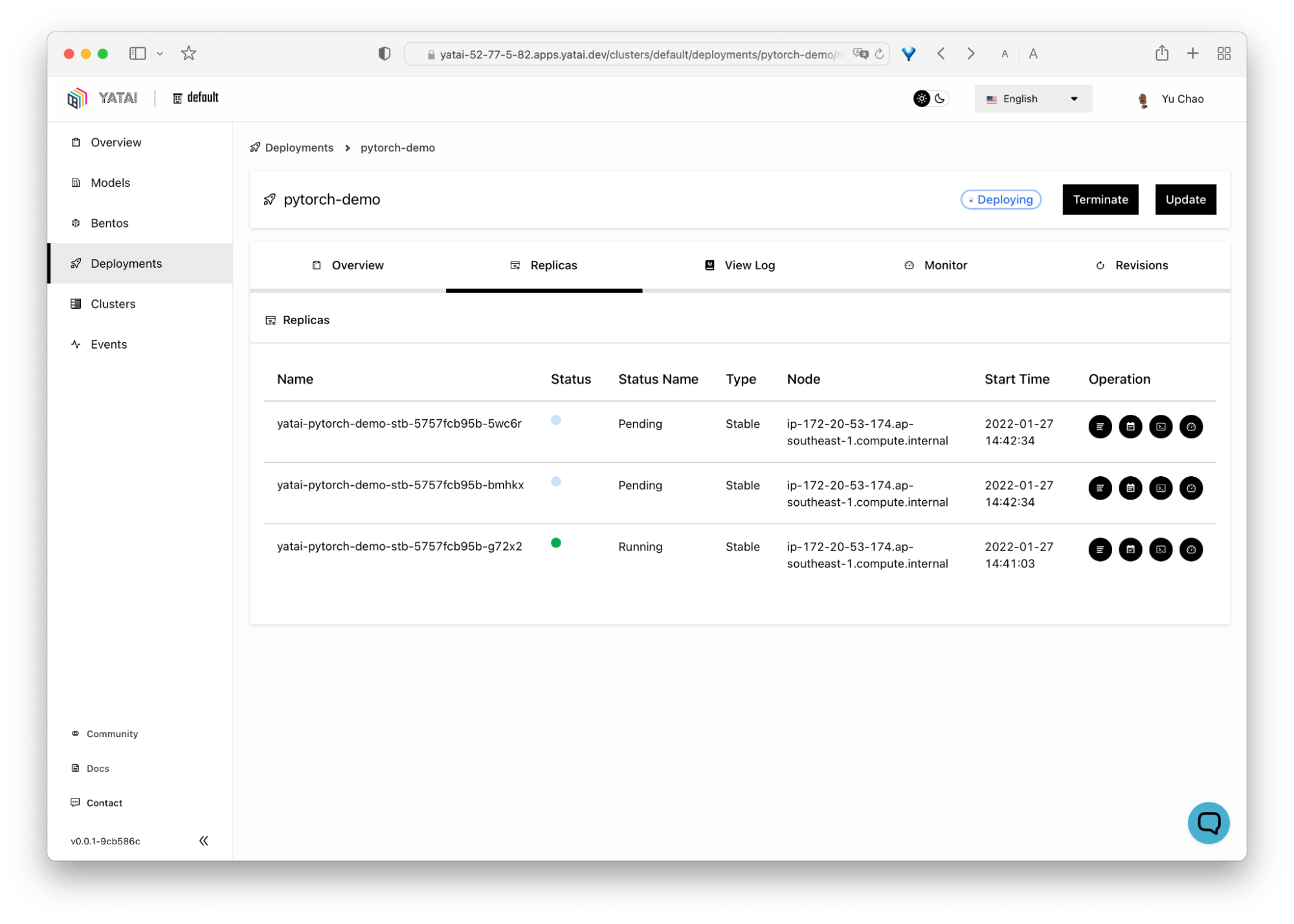

10. BentoML

BentoML maakt het makkelijker en sneller om machinelearningapplicaties te leveren. Het is een Python-first tool voor het deployen en onderhouden van API’s in productie. Het schaalt met krachtige optimalisaties door parallelle inferentie en adaptieve batching te draaien en biedt hardwareversnelling.

Het interactieve centrale dashboard van BentoML maakt het eenvoudig om te organiseren en te monitoren bij het deployen van ML-modellen. Het mooiste is dat het werkt met allerlei ML-frameworks, zoals Keras, ONNX, LightGBM, PyTorch en Scikit-learn. Kortom, BentoML biedt een complete oplossing voor modeluitrol, -serving en -monitoring.

Afbeelding van BentoML

18. Hugging Face Inference Endpoints

Hugging Face Inference Endpoints is een clouddienst van Hugging Face, een alles-in-één ML-platform waar gebruikers modellen, datasets en demo’s kunnen trainen, hosten en delen. Deze endpoints zijn bedoeld om getrainde ML-modellen voor inferentie te deployen zonder zelf de benodigde infrastructuur op te zetten en te beheren.

Belangrijkste functies:

- Houd de kosten laag, vanaf $0,06 per CPU-core/uur en $0,6 per GPU/uur, afhankelijk van je behoeften.

- Eenvoudig te deployen binnen enkele seconden.

- Volledig beheerd en autoscaling.

- Onderdeel van het Hugging Face-ecosysteem.

- Beveiliging op ondernemingsniveau.

Afbeelding van Hugging Face

Let op: je kunt ook MLflow en AWS SageMaker gebruiken voor modeluitrol en -serving.

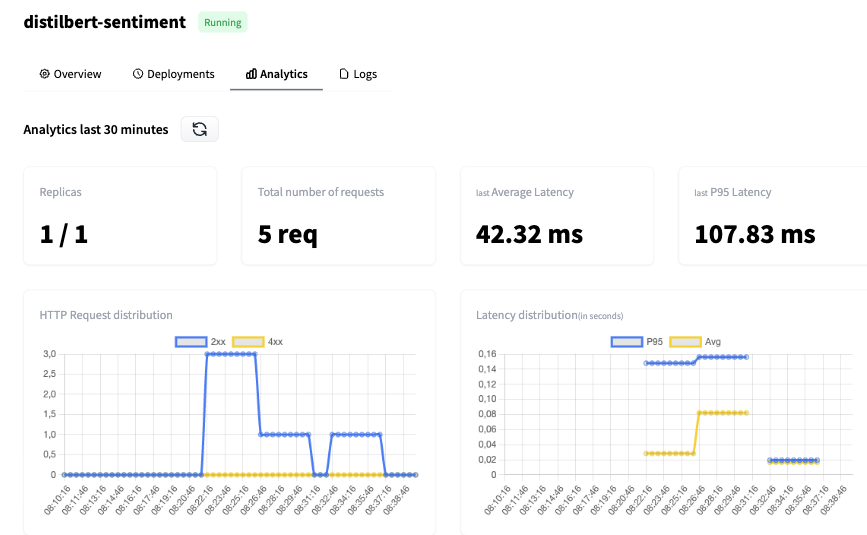

MLOps-tools voor modelmonitoring in productie

Of je ML-model nu in ontwikkeling, validatie of productie zit, deze tools helpen je verschillende factoren te monitoren:

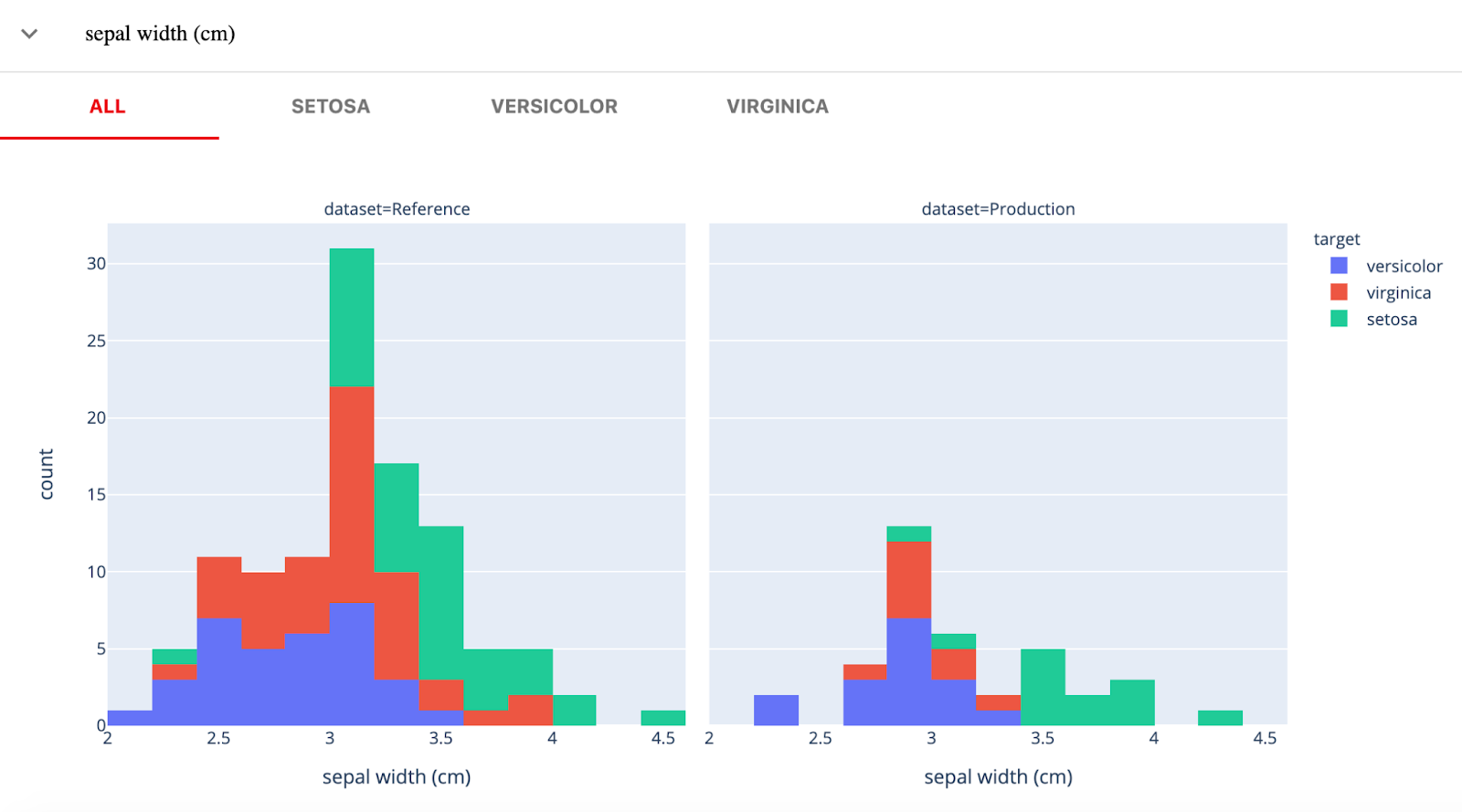

19. Evidently

Evidently AI is een open-source Python-bibliotheek voor het monitoren van ML-modellen tijdens ontwikkeling, validatie en in productie. Het controleert data- en modelkwaliteit, datadrift, target drift en prestaties van regressie en classificatie.

Evidently heeft drie hoofcomponenten:

- Tests (batch model checks): voor gestructureerde data- en modelkwaliteitscontroles.

- Rapporten (interactieve dashboards): interactieve datadrift, modelprestaties en targetvisualisatie.

- Monitors (realtime monitoring): monitort data- en modelmetrics van een gedeployde ML-service.

Afbeelding van Evidently

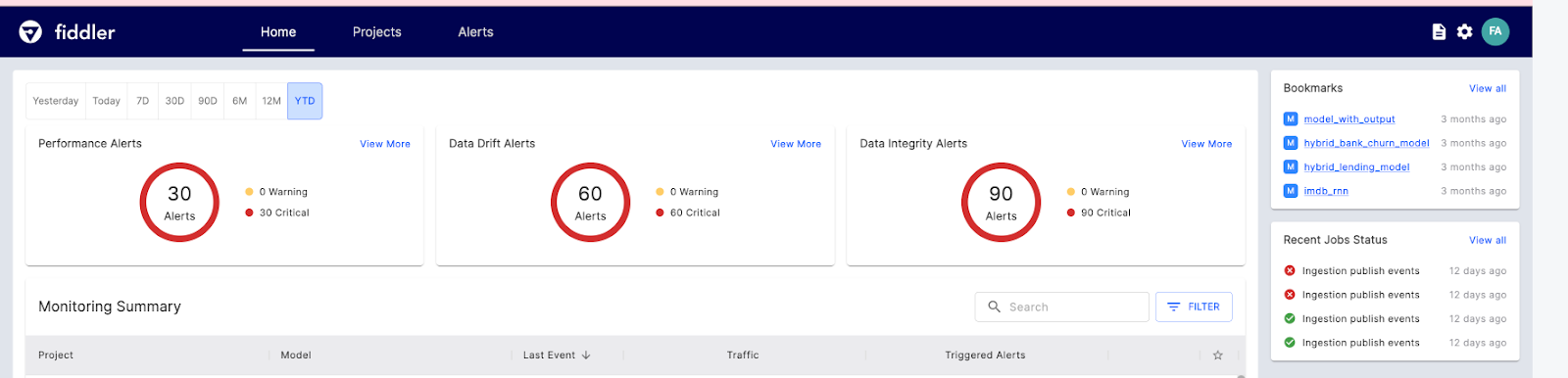

20. Fiddler

Fiddler AI is een ML-modelmonitoringtool met een duidelijke, gebruiksvriendelijke UI. Je kunt er voorspellingen mee verklaren en debuggen, modelgedrag analyseren voor de hele dataset, ML-modellen op schaal deployen en modelprestaties monitoren.

Dit zijn de belangrijkste Fiddler AI-functies voor ML-monitoring:

- Prestatiemonitoring: diepgaande visualisatie van datadrift: wanneer het plaatsvindt en hoe het plaatsvindt.

- Dataintegriteit: voorkom dat onjuiste data worden gebruikt voor modeltraining.

- Outliers bijhouden: toont univariate en multivariate uitschieters.

- Servicemetrics: geeft basisinzichten in ML-service-activiteiten.

- Alerts: stel waarschuwingen in voor een model of groep modellen om problemen in productie te signaleren.

Afbeelding van Fiddler

Runtime-engines

De runtime-engine is verantwoordelijk voor het laden van het model, het pre-processen van invoerdata, het uitvoeren van inferentie en het terugsturen van de resultaten naar de clientapplicatie.

21. Ray

Ray is een veelzijdig framework om AI- en Python-applicaties op te schalen, waardoor ontwikkelaars hun ML-projecten makkelijker kunnen beheren en optimaliseren.

Het platform bestaat uit twee hoofdonderdelen: een core distributed runtime en een set AI-bibliotheken die ML-compute vereenvoudigen.

Ray Core biedt een beperkte set fundamentele bouwstenen waarmee je gedistribueerde applicaties kunt opbouwen en uitbreiden.

- Tasks zijn functies zonder state die binnen het cluster worden uitgevoerd.

- Actors zijn workerprocessen met state die binnen het cluster worden aangemaakt.

- Objects zijn onveranderlijke waarden die door elk onderdeel binnen het cluster benaderd kunnen worden.

Ray levert ook AI-bibliotheken voor schaalbare datasets voor ML, gedistribueerde training, hyperparameter-tuning, reinforcement learning en schaalbare, programmeerbare serving.

Het volgende voorbeeld laat zien hoe je een Gradient Boosting Classifier-model traint en serveert.

import requests

from starlette.requests import Request

from typing import Dict

from sklearn.datasets import load_iris

from sklearn.ensemble import GradientBoostingClassifier

from ray import serve

# Train model.

iris_dataset = load_iris()

model = GradientBoostingClassifier()

model.fit(iris_dataset["data"], iris_dataset["target"])

@serve.deployment

class BoostingModel:

def __init__(self, model):

self.model = model

self.label_list = iris_dataset["target_names"].tolist()

async def __call__(self, request: Request) -> Dict:

payload = (await request.json())["vector"]

print(f"Received http request with data {payload}")

prediction = self.model.predict([payload])[0]

human_name = self.label_list[prediction]

return {"result": human_name}

# Deploy model.

serve.run(BoostingModel.bind(model), route_prefix="/iris")22. Nuclio

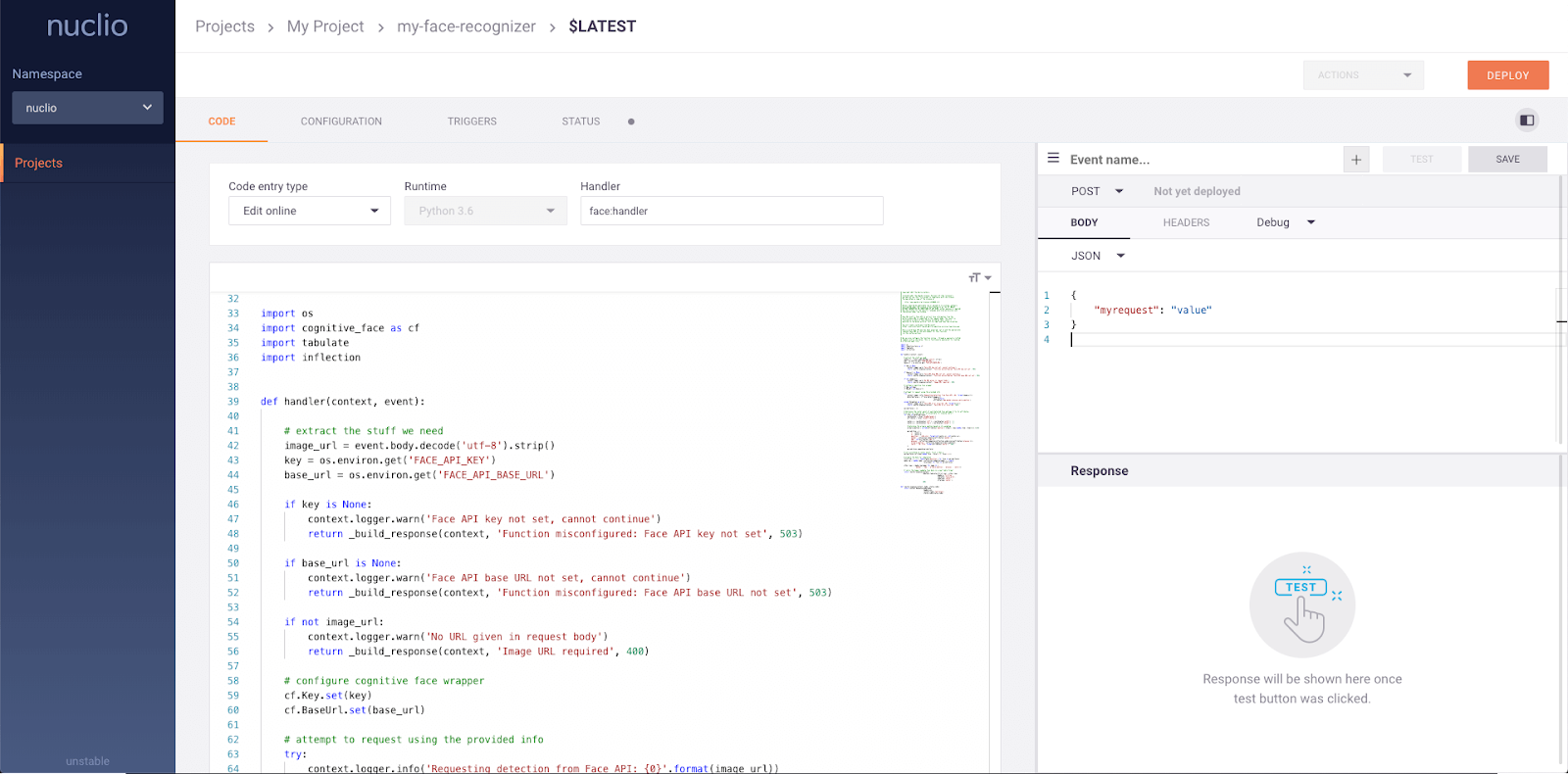

Nuclio is een krachtig framework dat zich richt op data-, I/O- en compute-intensieve workloads. Het is ontworpen om serverless te zijn, zodat je je niet met serverbeheer hoeft bezig te houden. Nuclio is goed geïntegreerd met populaire datasciencetools zoals Jupyter en Kubeflow. Het ondersteunt ook een breed scala aan data- en streamingbronnen en kan draaien op CPU’s en GPU’s.

Belangrijkste functies:

- Vereist minimale CPU/GPU- en I/O-resources om realtime verwerking uit te voeren met maximale paralleliteit.

- Integreert met een breed scala aan databronnen en ML-frameworks.

- Biedt stateful functies met data-pad-acceleratie

- Draagbaarheid over alle soorten devices en cloudplatformen, vooral low-power devices.

- Ontworpen voor de enterprise.

Afbeelding van Nuclio

End-to-end MLOps-platformen

Zoek je een allesomvattende MLOps-tool die tijdens het hele proces helpt? Dit zijn enkele van de beste opties:

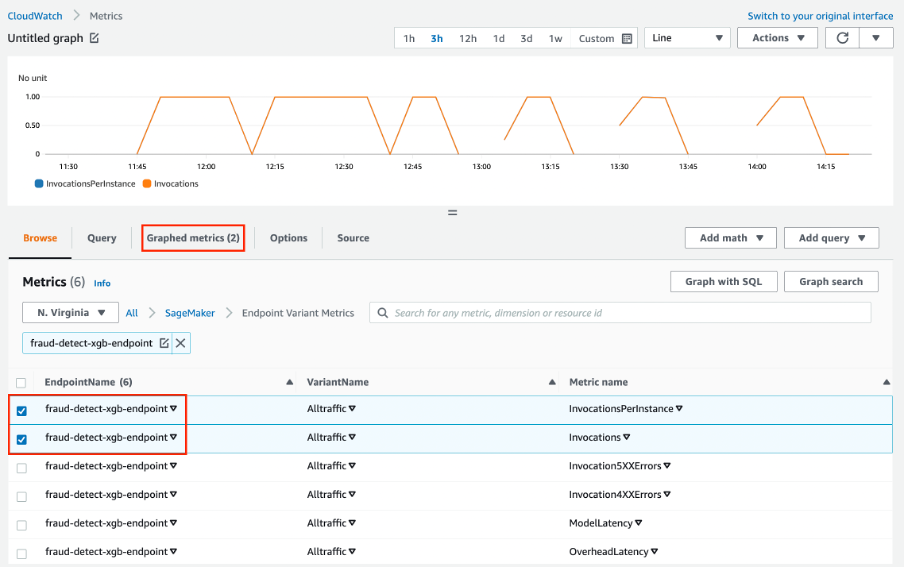

23. AWS SageMaker

Amazon Web Services SageMaker is een one-stopoplossing voor MLOps. Je kunt modelontwikkeling trainen en versnellen, experimenten tracken en versiebeheren, ML-artefacten catalogiseren, CI/CD-ML-pipelines integreren en modellen naadloos deployen, serven en monitoren in productie.

Belangrijkste functies:

- Een samenwerkingsomgeving voor datascienceteams.

- Automatiseer ML-trainingsworkflows.

- Deploy en beheer modellen in productie.

- Houd modelversies bij en onderhoud ze.

- CI/CD voor automatische integratie en deployment.

- Continue monitoring en retraining van modellen om kwaliteit te behouden.

- Optimaliseer kosten en prestaties.

Afbeelding van Amazon SageMaker

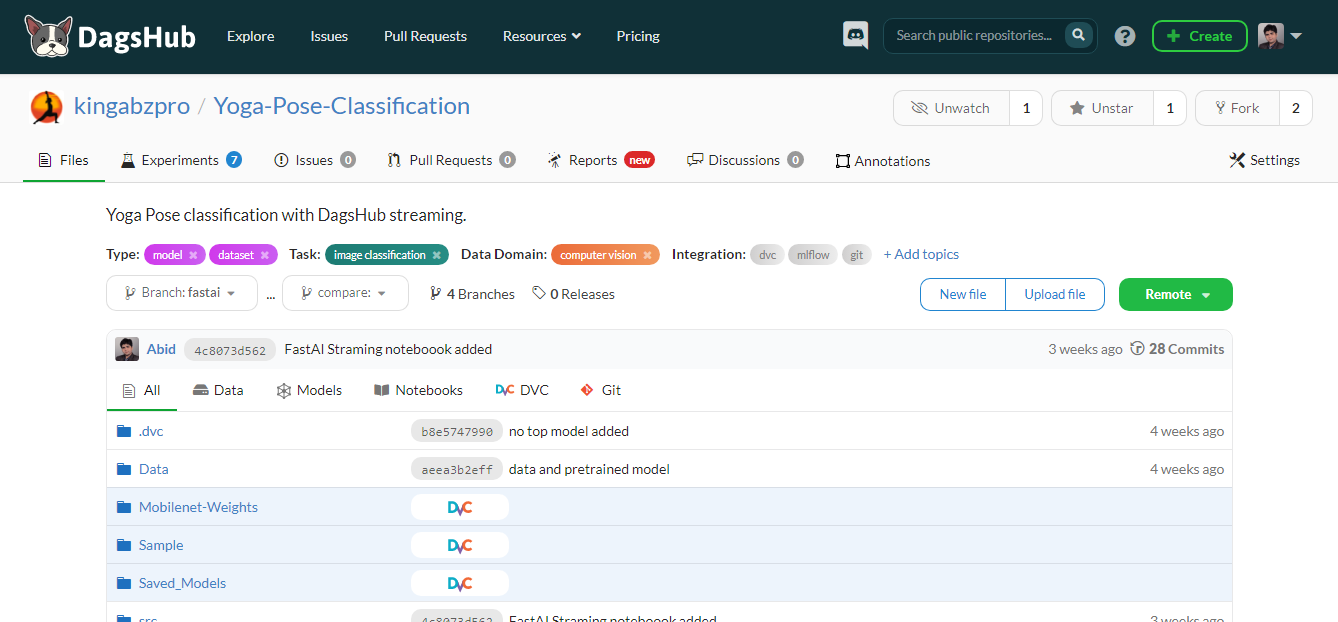

24. DagsHub

DagsHub is een platform voor de ML-community om data, modellen, experimenten, ML-pipelines en code te tracken en te versiebeheren. Het stelt je team in staat om ML-projecten te bouwen, te reviewen en te delen.

Eenvoudig gezegd: het is een GitHub voor machine learning, met diverse tools om het end-to-end ML-proces te optimaliseren.

Belangrijkste functies:

- Git- en DVC-repository voor je ML-projecten.

- DagsHub-logger en MLflow-instantie voor experimenttracking.

- Datasetannotatie via een Label Studio-instantie.

- Diffen van Jupyter-notebooks, code, datasets en afbeeldingen.

- Mogelijkheid om te reageren op het bestand, de codelijn of de dataset.

- Maak een rapport voor het project, net als een GitHub-wiki.

- Visualisatie van ML-pipelines.

- Reproduceerbare resultaten.

- CI/CD draaien voor modeltraining en -deployment.

- Data merging.

- Integraties met GitHub, Google Colab, DVC, Jenkins, externe opslag, webhooks en New Relic.

Afbeelding door de auteur

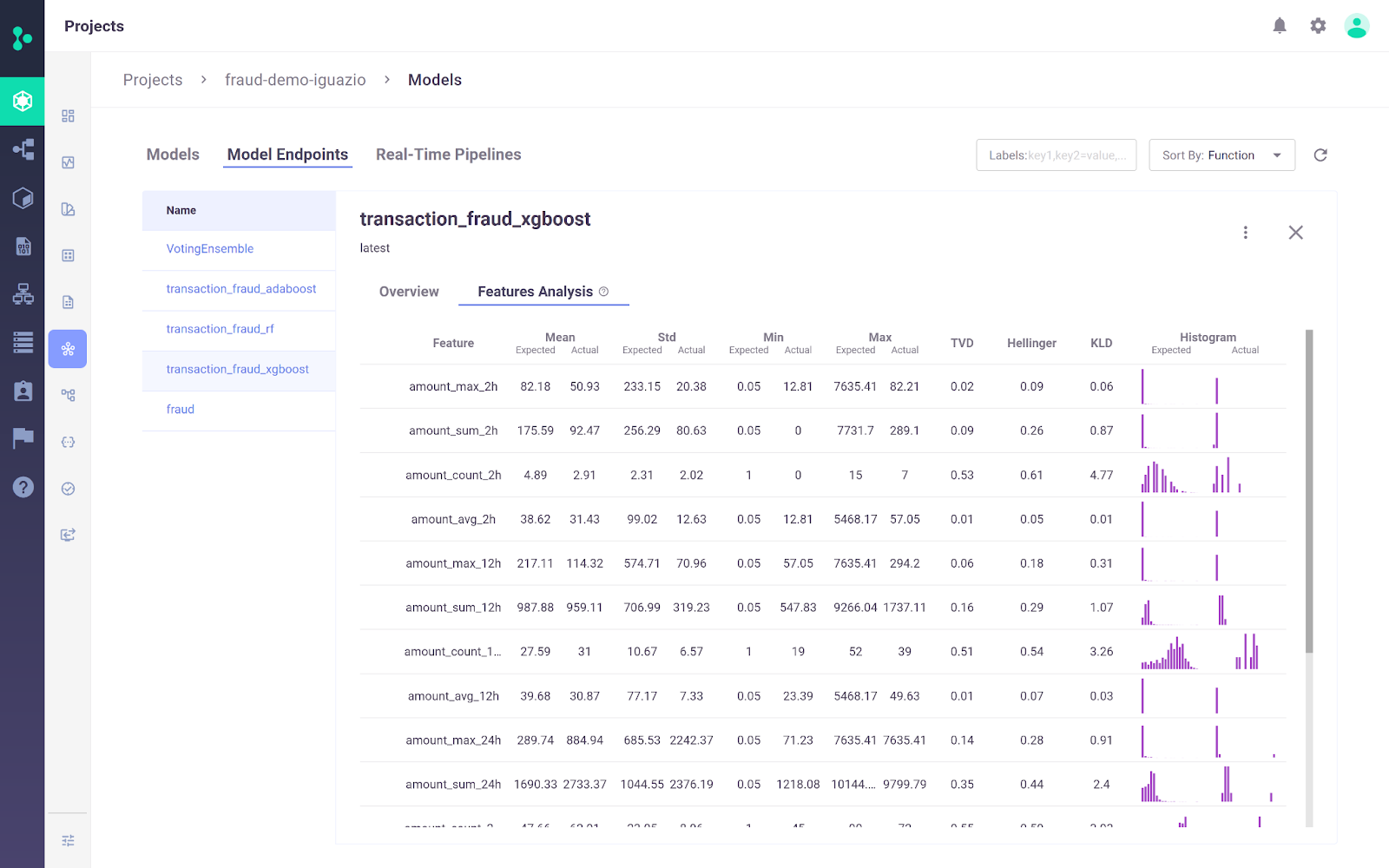

25. Iguazio MLOps Platform

Het Iguazio MLOps Platform is een end-to-end MLOps-platform waarmee organisaties de ML-pipeline kunnen automatiseren, van dataverzameling en -voorbereiding tot training, deployment en monitoring in productie. Het biedt een open (MLRun) en beheerd platform.

Een belangrijk onderscheidend kenmerk van het Iguazio MLOps Platform is de flexibiliteit in deploymentopties. Gebruikers kunnen AI-toepassingen overal deployen: in elke cloud, hybride of on-premises. Dit is vooral belangrijk in sectoren als zorg en financiën, waar on-premises deployment soms vereist is vanwege dataprivacy.

Afbeelding van Iguazio MLOps Platform

Belangrijkste functies:

- Het platform laat gebruikers data uit elke bron opnemen en herbruikbare online en offline features bouwen met de geïntegreerde feature store.

- Ondersteunt continue training en evaluatie van modellen op schaal met schaalbare serverless, met geautomatiseerd tracking, dataversiebeheer en continuous integration en deployment.

- Modellen eenvoudig met een paar klikken naar productie deployen, continu modelprestaties monitoren en modeldrift beperken.

- Het platform heeft een eenvoudig dashboard voor het beheren, besturen en monitoren van modellen en realtime productie.

Overzicht MLOps-tools

Hier is een vergelijkingstabel om deze tools naast elkaar te beoordelen en de beste keuzes voor jouw projecten te maken:

| Tool | Belangrijkste functionaliteit | Ondersteunde frameworks | Deployopties |

|---|---|---|---|

| Qdrant | Vector similarity search en databasemanagement | Python, meerdere talen | Cloud-native, horizontaal schaalbaar |

| LangChain | Toepassingen ontwikkelen met taalmodellen | Python, JavaScript | REST API, templates |

| MLFlow | Experimenttracking, modelregister, deployment | Python, R, Java, REST API | Lokaal, cloud |

| Comet ML | Experimenttracking en optimalisatie | Scikit-learn, PyTorch, TensorFlow, HuggingFace | Lokaal, cloud |

| Weights & Biases | Experimenttracking, versiebeheer van data en modellen | Fastai, Keras, PyTorch, HuggingFace, Yolov5, Spacy | Lokaal, cloud |

| Prefect | Workflow-orkestratie en monitoring | Python | Lokaal (Orion UI), Cloud |

| Metaflow | Workflowmanagement voor data science | Scikit-learn, TensorFlow, Python, R | AWS, GCP, Azure, lokaal |

| Kedro | Workflow-orkestratie, reproduceerbaarheid | Python | Lokaal, gedistribueerd |

| Pachyderm | Datatransformatie, versiebeheer en lineage | Elke taal | Kubernetes |

| DVC | Versiebeheer van data en pipelines | Git, Python | Lokaal, cloud |

| LakeFS | Git-achtig versiebeheer voor datalakes | Elke opslagservice | Lokaal, cloud |

| Feast | Gecentraliseerde feature store voor ML-modellen | Python | Lokaal, cloud |

| Featureform | Virtuele feature store voor ML-modellen | Python | Lokaal, cloud |

| Deepchecks | Testen en valideren van ML-modellen | Python | Lokaal, cloud |

| TruEra | Testen van modelkwaliteit en prestaties | Python | Lokaal, cloud |

| Kubeflow | ML-modeluitrol en orkestratie | TensorFlow, PyTorch, PaddlePaddle, MXNet, XGboost | Kubernetes, cloud |

| BentoML | Modeluitrol en API-beheer | Keras, ONNX, LightGBM, PyTorch, Scikit-learn | Lokaal, cloud |

| Hugging Face | Inferentie en modeluitrol | Elk model | Cloud |

| Evidently | Monitoring van ML-modellen voor data- en targetdrift | Python | Lokaal, cloud |

| Fiddler | Monitoring en debugging van ML-modellen | Python | Lokaal, cloud |

| Ray | AI- en Python-applicaties opschalen | Python | Lokaal, cloud |

| Nuclio | Serverless framework voor data- en compute-intensieve workloads | Jupyter, Kubeflow | Cloud, on-premises |

| AWS SageMaker | End-to-end beheer van de ML-levenscyclus | Python, R, Java, TensorFlow, PyTorch | AWS-cloud |

| DagsHub | Versiebeheer en samenwerking voor ML-projecten | Git, DVC, MLflow | Lokaal, cloud |

| Iguazio | End-to-end automatisering van ML-pipelines | Python, MLRun | Cloud, hybride, on-premises |

Conclusie

We zitten in een periode waarin de MLOps-sector een sterke groei doormaakt. Elke week zie je nieuwe ontwikkelingen, startups en tools die worden gelanceerd om het basale probleem op te lossen: notitieboeken omzetten naar productieklare applicaties. Zelfs bestaande tools verbreden hun horizon en integreren nieuwe functies om super-MLOps-tools te worden.

In deze blog hebben we de beste MLOps-tools voor verschillende stappen in het MLOps-proces bekeken. Deze tools helpen je tijdens de fases van experimenteren, ontwikkelen, deployen en monitoren.

Ben je nieuw met machine learning en wil je de essentiële vaardigheden beheersen om een baan te krijgen als machine learning scientist? Probeer dan onze Machine Learning Scientist with Python-carrièretrack.

Ben je professional en wil je meer leren over standaard MLOps-praktijken? Lees dan ons artikel MLOps Best Practices en hoe je ze toepast en bekijk onze MLOps Fundamentals-skill track.

MLOps-tools: veelgestelde vragen

Wat zijn MLOps-tools?

MLOps-tools helpen het ML-ecosysteem te standaardiseren, vereenvoudigen en stroomlijnen. Deze tools worden gebruikt voor het bijhouden van experimenten, beheer van modelmetadata, orkestratie, modeloptimalisatie, versiebeheer van workflows, modeluitrol en -serving, en modelmonitoring in productie.

Welke vaardigheden heeft een MLOps-engineer nodig?

- Vermogen om cloudoplossingen te implementeren.

- Ervaring met Docker en Kubernetes.

- Ervaring met Quality Assurance via experimenttracking en workflowversiebeheer.

- Vermogen om MLOps-pipelines te bouwen.

- Bekendheid met het Linux-besturingssysteem.

- Ervaring met ML-frameworks zoals PyTorch, TensorFlow en TFX.

- Ervaring met DevOps en softwareontwikkeling.

- Ervaring met unit- en integratietests, data- en modelvalidatie en post-deployment monitoring.

Welke cloud is het beste voor MLOps?

AWS, GCP en Azure bieden een reeks tools voor de machinelearning-levenscyclus. Ze leveren alle drie end-to-endoplossingen voor MLOps. AWS gaat voorop qua populariteit en marktaandeel. Het biedt ook eenvoudige oplossingen voor modeltraining, -serving en -monitoring.

Is MLOps makkelijk te leren?

Dat hangt af van je voorkennis. Om MLOps te beheersen, moet je zowel de machinelearning- als de softwareontwikkel-levenscyclus begrijpen. Naast sterke programmeervaardigheden moet je verschillende MLOps-tools leren. Voor DevOps-engineers is MLOps relatief gemakkelijk te leren, omdat veel tools en strategieën uit de softwareontwikkeling komen.

Is Kubeflow beter dan MLflow?

Dat hangt af van de usecase. Kubeflow biedt reproduceerbaarheid op een hoger niveau dan MLflow, omdat het de orkestratie beheert.

- Kubeflow wordt doorgaans gebruikt voor het deployen en beheren van complexe ML-systemen op schaal.

- MLFlow wordt meestal gebruikt voor het bijhouden van ML-experimenten en het opslaan en beheren van modelmetadata.

Hoe verschilt MLOps van DevOps?

Beide zijn strategieën voor softwareontwikkeling. DevOps richt zich op het ontwikkelen en beheren van grootschalige softwaresystemen, terwijl MLOps zich richt op het deployen en onderhouden van ML-modellen in productie.

- DevOps: Continuous Integration (CI) en Continuous Delivery (CD).

- MLOps: Continuous Integration, Continuous Delivery, Continuous Training en Continuous Monitoring.

Hoe integreren MLOps-tools met bestaande datascienceworkflows?

MLOps-tools zijn ontworpen om naadloos te integreren met bestaande datascienceworkflows. Ze ondersteunen doorgaans diverse datasci-tools en -platformen, bieden API’s voor integratie en plug-ins of extensies voor populaire datasci-omgevingen. Zo kunnen data scientists hun huidige workflows behouden en toch profiteren van MLOps voor betere schaalbaarheid, reproduceerbaarheid en deployefficiëntie.

Kunnen MLOps-tools helpen met modelverklaarbaarheid en eerlijkheid?

Ja, veel MLOps-tools bevatten functies om modelverklaarbaarheid en eerlijkheid te verbeteren. Ze bieden functionaliteit zoals modelinterpretatie, biasdetectie en fairness-metrieken, die helpen te begrijpen en te verbeteren hoe modellen beslissingen nemen. Dit is cruciaal voor verantwoorde AI en om te voldoen aan regelgeving.

Kan ik een MLOps-certificering halen?

MLOps-specifieke certificeringen zijn nog in opkomst, maar er zijn verschillende certificeringen voor machine learning en data science die MLOps-vaardigheden dekken. Lees onze gids over MLOps-certificeringen voor een overzicht.

Als gecertificeerd data scientist haal ik met passie het maximale uit de nieuwste technologie om innovatieve machinelearning-toepassingen te bouwen. Met een sterke achtergrond in spraakherkenning, data-analyse en -rapportage, MLOps, conversationele AI en NLP heb ik mijn vaardigheden aangescherpt in het ontwikkelen van intelligente systemen die echt impact maken. Naast mijn technische expertise ben ik ook een sterke communicator met een talent om complexe concepten terug te brengen tot heldere, beknopte taal. Daardoor ben ik uitgegroeid tot een veelgelezen blogger over data science, waar ik mijn inzichten en ervaringen deel met een groeiende community van data-professionals. Op dit moment richt ik me op contentcreatie en redactie, waarbij ik met large language models werk aan krachtige en aansprekende content die zowel bedrijven als individuen helpt het beste uit hun data te halen.