Corso

Come spieghiamo nel nostro articolo Primi passi con MLOps, MLOps nasce dai fondamenti di DevOps, la strategia di sviluppo software per scrivere, distribuire ed eseguire in modo efficiente applicazioni enterprise.

È un approccio per gestire su larga scala i progetti di machine learning. MLOps migliora la collaborazione tra team di sviluppo, operation e data science. Il risultato è un deployment dei modelli più rapido, produttività del team ottimizzata, riduzione di rischi e costi e monitoraggio continuo dei modelli in produzione.

Scopri perché MLOps è importante e quali problemi punta a risolvere leggendo il nostro blog su Il passato, il presente e il futuro di MLOps.

In questo post vedremo i migliori strumenti MLOps per lo sviluppo, il deployment e il monitoraggio dei modelli, per standardizzare, semplificare e rendere più fluido l’ecosistema del machine learning. Per un’introduzione completa ai Fondamenti di MLOps, dai un’occhiata alla nostra Skill Track.

Framework per Large Language Models (LLM)

Con l’arrivo di GPT-4 e poi di GPT-4o, è iniziata la corsa alla produzione di large language model e alla realizzazione del pieno potenziale dell’AI moderna. Gli LLM richiedono database vettoriali e framework di integrazione per costruire applicazioni AI intelligenti.

1. Qdrant

Qdrant è un motore open-source per la ricerca di similarità vettoriale e un database vettoriale che offre un servizio pronto per la produzione con un’API intuitiva, permettendoti di archiviare, cercare e gestire embedding vettoriali.

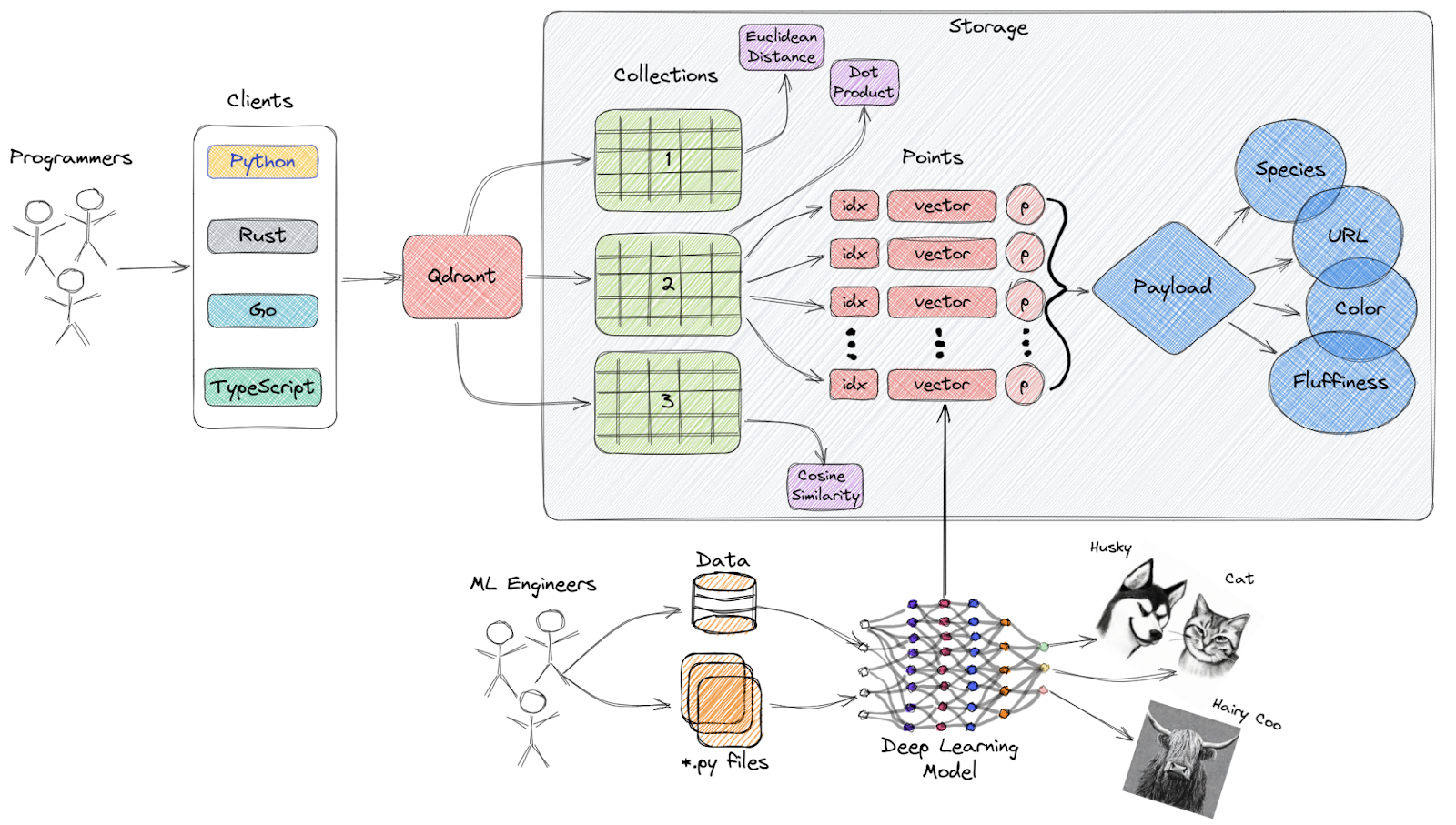

Panoramica ad alto livello dell’architettura di Qdrant

Caratteristiche principali:

- API facile da usare: offre una Python API intuitiva e consente agli sviluppatori di generare librerie client in più linguaggi di programmazione.

- Veloce e accurato: utilizza una modifica personalizzata dell’algoritmo HNSW per l’Approximate Nearest Neighbor Search, garantendo velocità di ricerca all’avanguardia senza compromettere l’accuratezza.

- Tipi di dati ricchi: Qdrant supporta un’ampia varietà di tipi di dati e condizioni di query, tra cui string matching, intervalli numerici, geolocalizzazioni e altro.

- Distribuito: è cloud-native e può scalare orizzontalmente, permettendo di usare esattamente le risorse computazionali necessarie per qualsiasi quantità di dati da servire.

- Efficiente: Qdrant è sviluppato interamente in Rust, un linguaggio noto per le sue prestazioni e l’efficienza nell’uso delle risorse.

Scopri i migliori database vettoriali leggendo I 5 migliori database vettoriali | Elenco con esempi.

2. LangChain

LangChain è un framework potente e flessibile per sviluppare applicazioni basate su modelli linguistici. Offre diversi componenti che consentono agli sviluppatori di creare, distribuire e monitorare applicazioni sensibili al contesto e basate sul ragionamento.

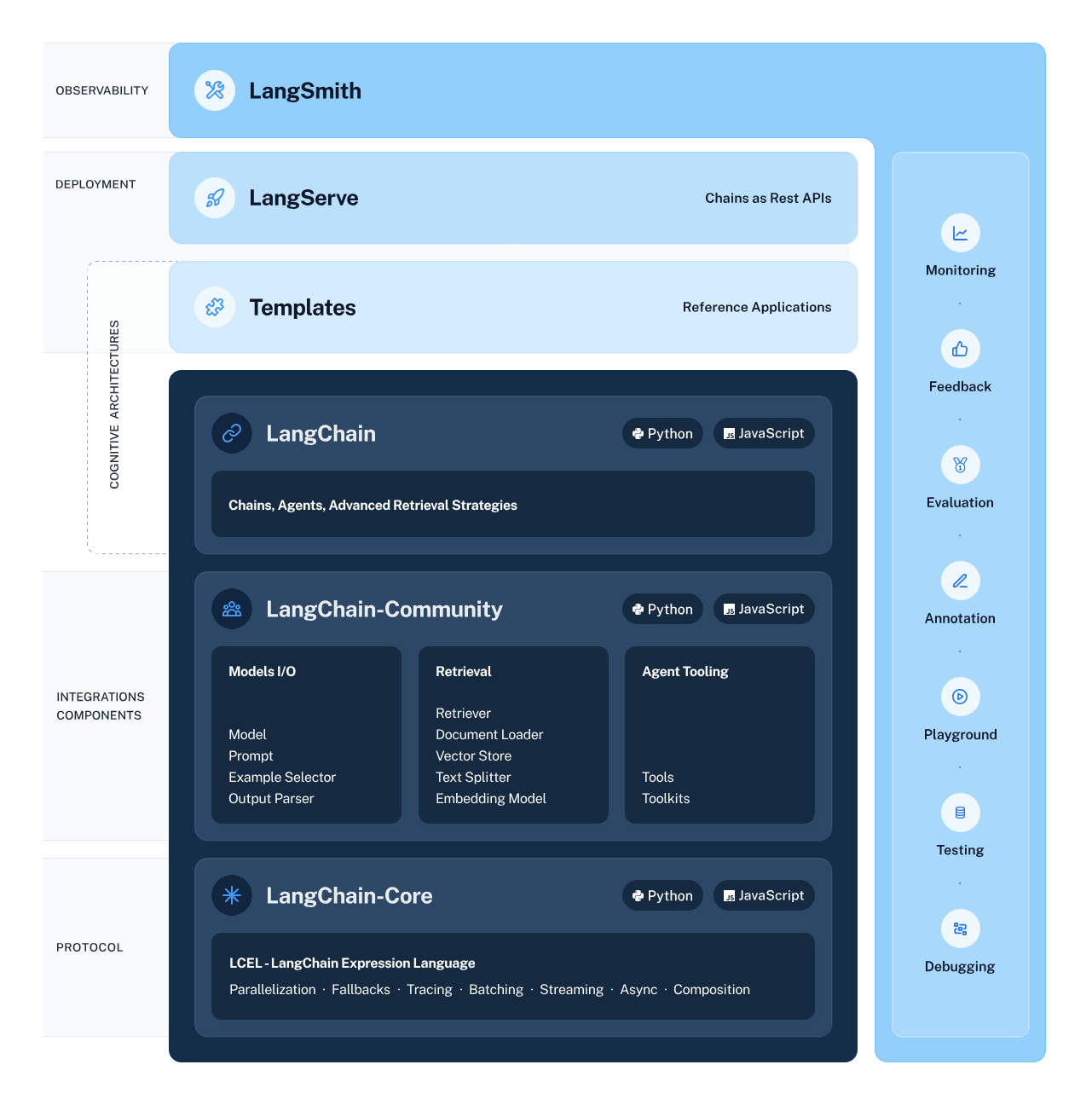

Il framework è composto da 4 componenti principali:

- Librerie LangChain: le librerie Python e JavaScript offrono interfacce e integrazioni per sviluppare applicazioni di ragionamento sensibili al contesto.

- Template LangChain: una raccolta di architetture di riferimento facilmente distribuibili che coprono una vasta gamma di task, fornendo soluzioni predefinite.

- LangServe: una libreria che consente di distribuire le chain di LangChain come REST API.

- LangSmith: una piattaforma che permette di effettuare debug, testare, valutare e monitorare chain costruite su qualsiasi framework LLM.

Ecosistema LangChain

Impara come creare applicazioni LLM con LangChain ed esplora il potenziale ancora inesplorato dei large language model.

Strumenti per il tracciamento degli esperimenti e la gestione dei metadati dei modelli

Questi strumenti ti permettono di gestire i metadati dei modelli e aiutano nel tracciamento degli esperimenti:

3. MLFlow

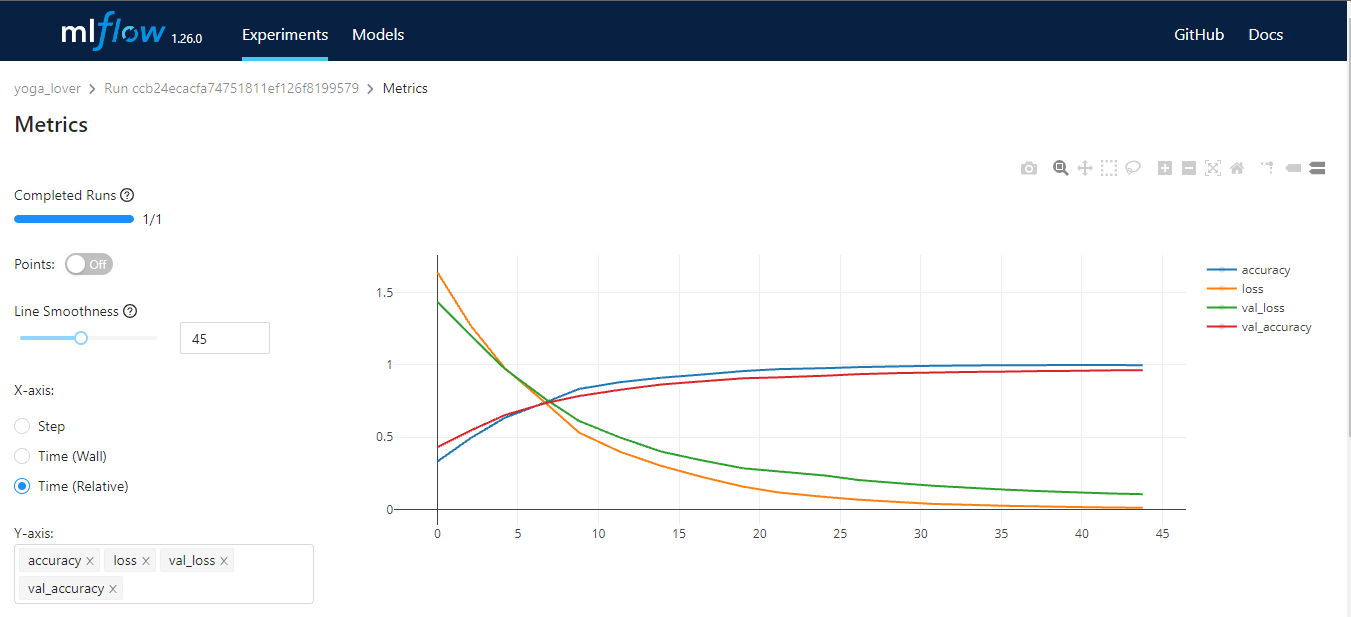

MLflow è uno strumento open-source che ti aiuta a gestire le parti centrali del ciclo di vita del machine learning. È usato in genere per il tracciamento degli esperimenti, ma può essere utilizzato anche per riproducibilità, deployment e model registry. Puoi gestire esperimenti di machine learning e metadati dei modelli tramite CLI, Python, R, Java e REST API.

MLflow ha quattro funzioni principali:

- MLflow tracking: archiviare e accedere a codice, dati, configurazioni e risultati.

- MLflow projects: impacchettare il sorgente data science per la riproducibilità.

- MLflow models: distribuire e gestire modelli di machine learning in vari ambienti di serving.

- MLflow model registry: un archivio centrale dei modelli che fornisce versioning, transizioni di stato, annotazioni e gestione dei modelli di machine learning.

Immagine dell’autore

4. Comet ML

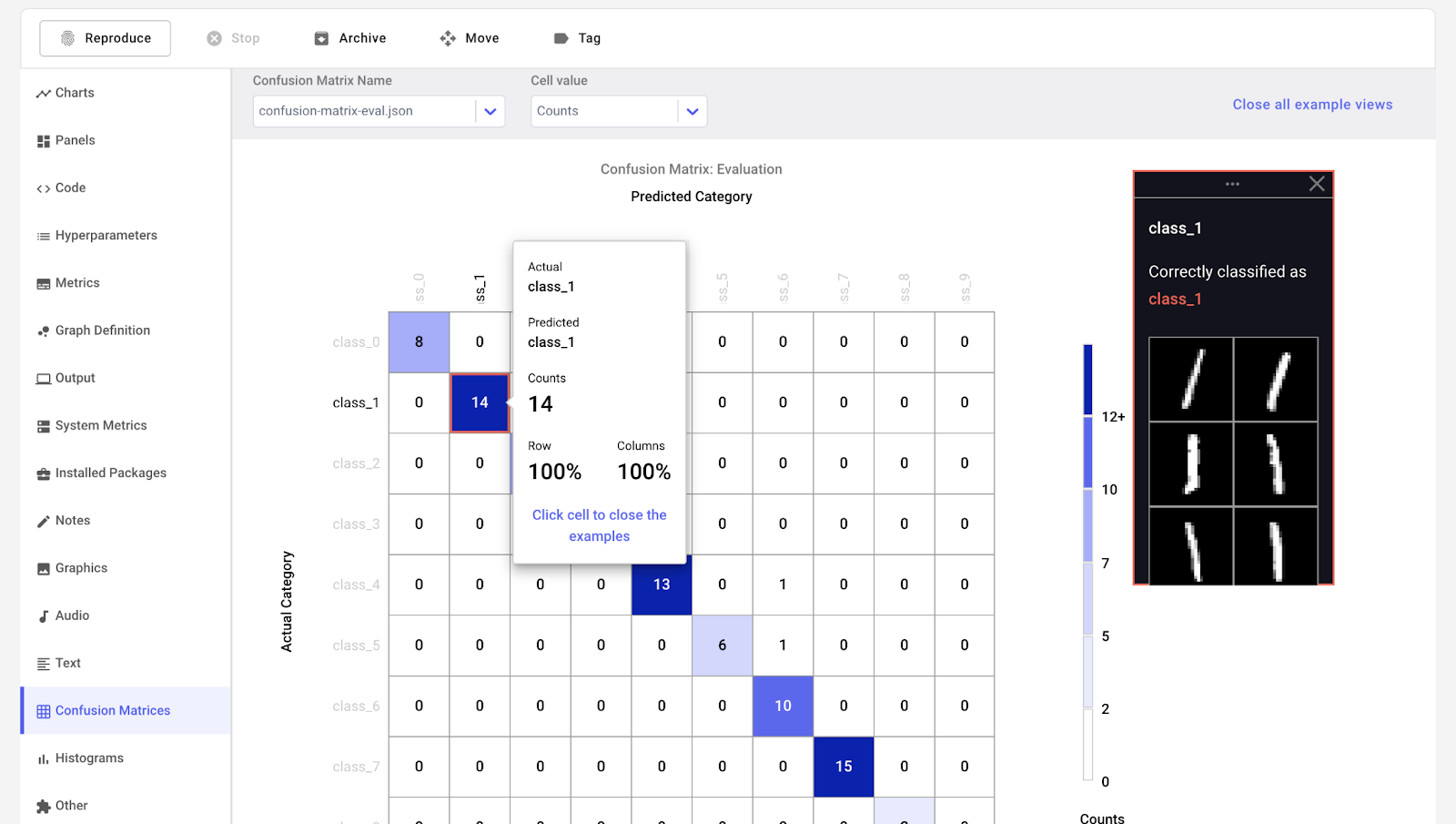

Comet ML è una piattaforma per tracciare, confrontare, spiegare e ottimizzare modelli ed esperimenti di machine learning. Puoi usarla con qualsiasi libreria di machine learning, come Scikit-learn, Pytorch, TensorFlow e HuggingFace.

Comet ML è pensata per individui, team, aziende e accademia. Consente a chiunque di visualizzare e confrontare facilmente gli esperimenti. Inoltre, permette di visualizzare campioni da immagini, audio, testo e dati tabellari.

Immagine da Comet ML

5. Weights & Biases

Weights & Biases è una piattaforma ML per tracciamento degli esperimenti, versionamento di dati e modelli, ottimizzazione degli iperparametri e gestione dei modelli. Inoltre, puoi usarla per registrare artifact (dataset, modelli, dipendenze, pipeline e risultati) e visualizzare i dataset (audio, immagini, testo e tabellari).

Weights & Biases offre una dashboard centrale intuitiva per gli esperimenti di machine learning. Come Comet ML, si integra con altre librerie di machine learning, come Fastai, Keras, PyTorch, Hugging Face, Yolov5, Spacy e molte altre. Puoi consultare la nostra introduzione a Weights & BIases in un articolo dedicato.

Gif da Weights & Biases

Nota: puoi usare anche TensorBoard, Pachyderm, DagsHub e DVC Studio per il tracciamento degli esperimenti e la gestione dei metadati ML.

Strumenti MLOps per orchestrazione e workflow pipeline

Questi strumenti ti aiutano a creare progetti di data science e a gestire i workflow di machine learning:

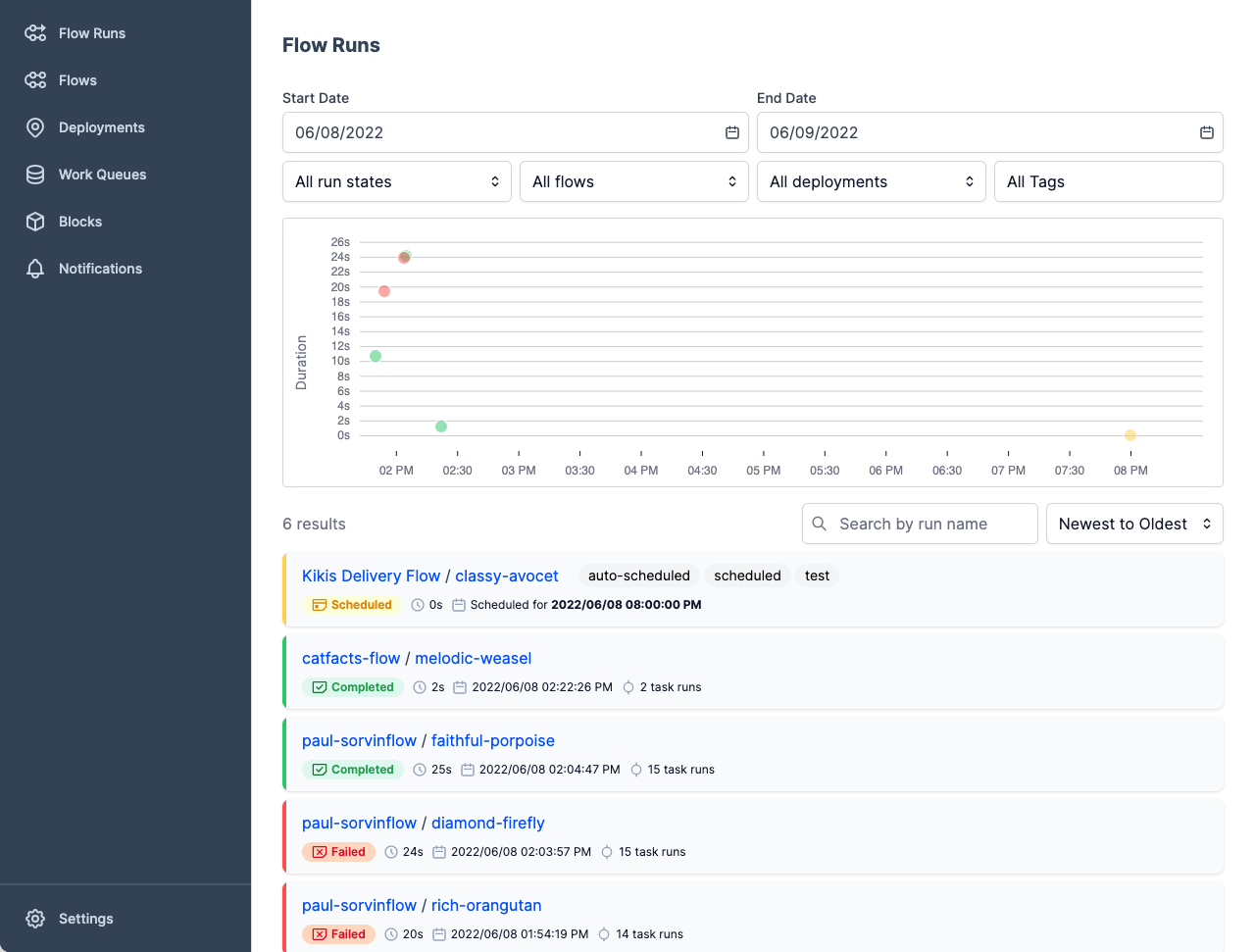

6. Prefect

Prefect è uno stack dati moderno per monitorare, coordinare e orchestrare workflow tra e all’interno delle applicazioni. È uno strumento open-source, leggero, pensato per pipeline di machine learning end-to-end.

Puoi usare Prefect Orion UI oppure Prefect Cloud per le basi dati.

- Prefect Orion UI è un motore di orchestrazione open-source, ospitato in locale, e un server API. Ti offre insight sull’istanza locale di Prefect Orion e sui workflow.

- Prefect Cloud è un servizio ospitato per visualizzare flow, esecuzioni dei flow e deployment. Inoltre, puoi gestire account, workspace e collaborazione del team.

Immagine da Prefect

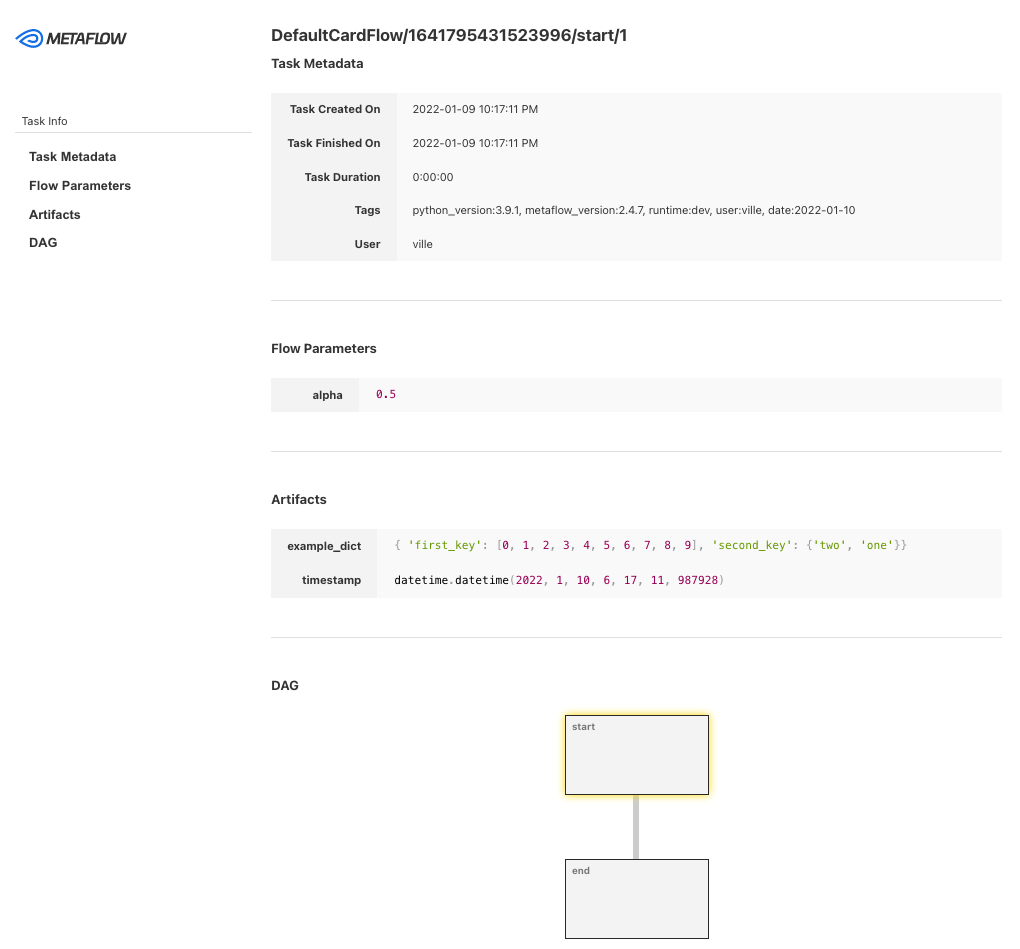

7. Metaflow

Metaflow è un potente strumento, collaudato sul campo, per la gestione dei workflow in progetti di data science e machine learning. È stato creato per i data scientist, in modo che possano concentrarsi sulla costruzione dei modelli invece di preoccuparsi dell’ingegneria MLOps.

Con Metaflow puoi progettare il workflow, eseguirlo in scala e distribuire il modello in produzione. Traccia e versiona automaticamente esperimenti di machine learning e dati. Inoltre, puoi visualizzare i risultati nel notebook.

Metaflow funziona con più cloud (inclusi AWS, GCP e Azure) e varie librerie Python per il machine learning (come Scikit-learn e Tensorflow), e l’API è disponibile anche per il linguaggio R.

Immagine da Metaflow

8. Kedro

Kedro è uno strumento di orchestrazione dei workflow basato su Python. Puoi usarlo per creare progetti di data science riproducibili, manutenibili e modulari. Integra concetti dell’ingegneria del software nel machine learning, come modularità, separazione delle responsabilità e versioning.

Con Kedro puoi:

- Configurare dipendenze e impostazioni.

- Impostare i dati.

- Creare, visualizzare ed eseguire le pipeline.

- Eseguire logging e tracciamento degli esperimenti.

- Effettuare deployment su macchina singola o distribuita.

- Scrivere codice di data science manutenibile.

- Creare codice modulare e riutilizzabile.

- Collaborare con i compagni di team sui progetti.

Gif da Kedro

Nota: puoi usare anche Kubeflow e DVC per orchestrazione e workflow pipeline.

Strumenti per il versionamento di dati e pipeline

Con questi strumenti MLOps puoi gestire le attività legate al versionamento di dati e pipeline:

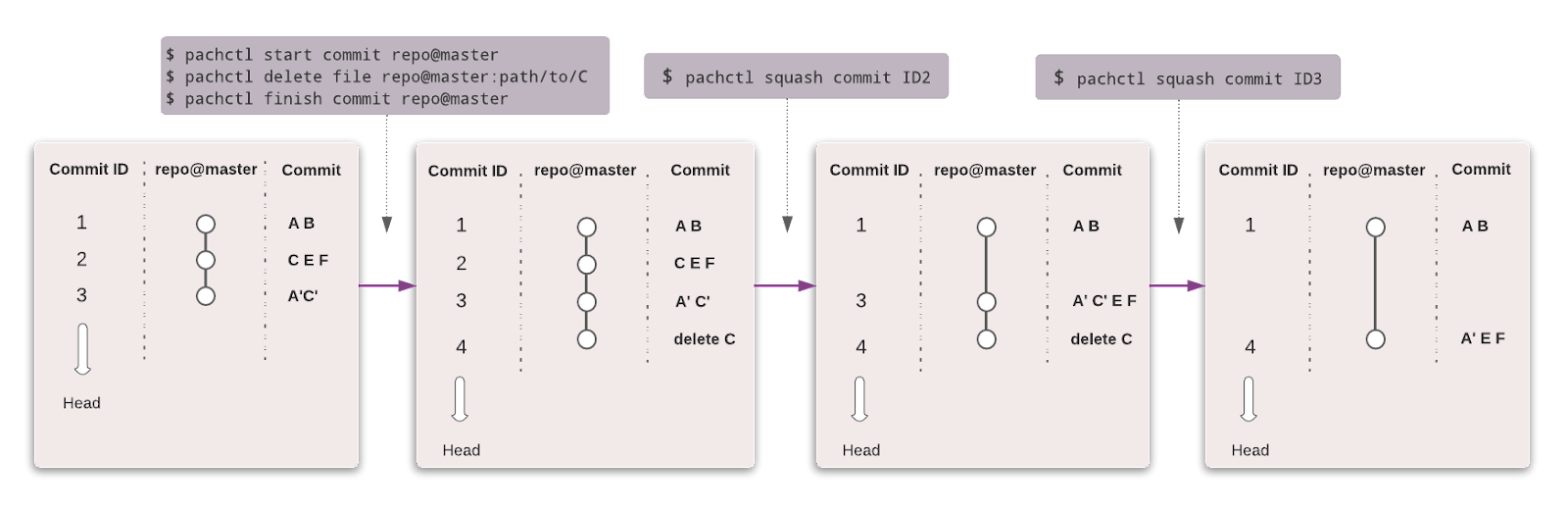

9. Pachyderm

Pachyderm automatizza la trasformazione dei dati con versionamento, lineage e pipeline end-to-end su Kubernetes. Puoi integrare qualsiasi dato (immagini, log, video, CSV), qualsiasi linguaggio (Python, R, SQL, C/C++) e a qualsiasi scala (petabyte di dati, migliaia di job).

La community edition è open-source e adatta a team piccoli. Organizzazioni e team che desiderano funzionalità avanzate possono optare per l’edizione Enterprise.

Proprio come Git, puoi versionare i tuoi dati usando una sintassi simile. In Pachyderm, l’oggetto di livello più alto è il Repository e puoi usare Commit, Branches, File, History e Provenance per tracciare e versionare il dataset.

Immagine da Pachyderm

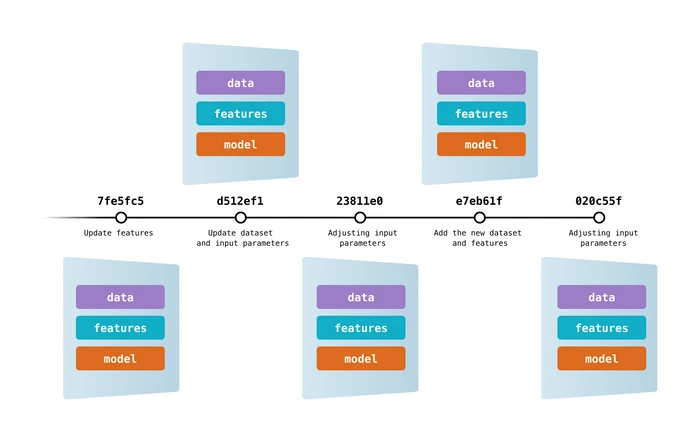

10. Data Version Control (DVC)

Data Version Control è uno strumento open-source e molto diffuso per progetti di machine learning. Funziona perfettamente con Git per offrirti versionamento di codice, dati, modelli, metadati e pipeline.

DVC è molto più di un semplice strumento di tracciamento e versionamento dei dati.

Puoi usarlo per:

- Tracciamento degli esperimenti (metriche del modello, parametri, versioning).

- Creare, visualizzare ed eseguire pipeline di machine learning.

- Workflow per deployment e collaborazione.

- Riproducibilità.

- Registry di dati e modelli.

- Integrazione e deployment continui per il machine learning usando CML.

Immagine da DVC

Nota: anche DagsHub può essere usato per il versionamento di dati e pipeline.

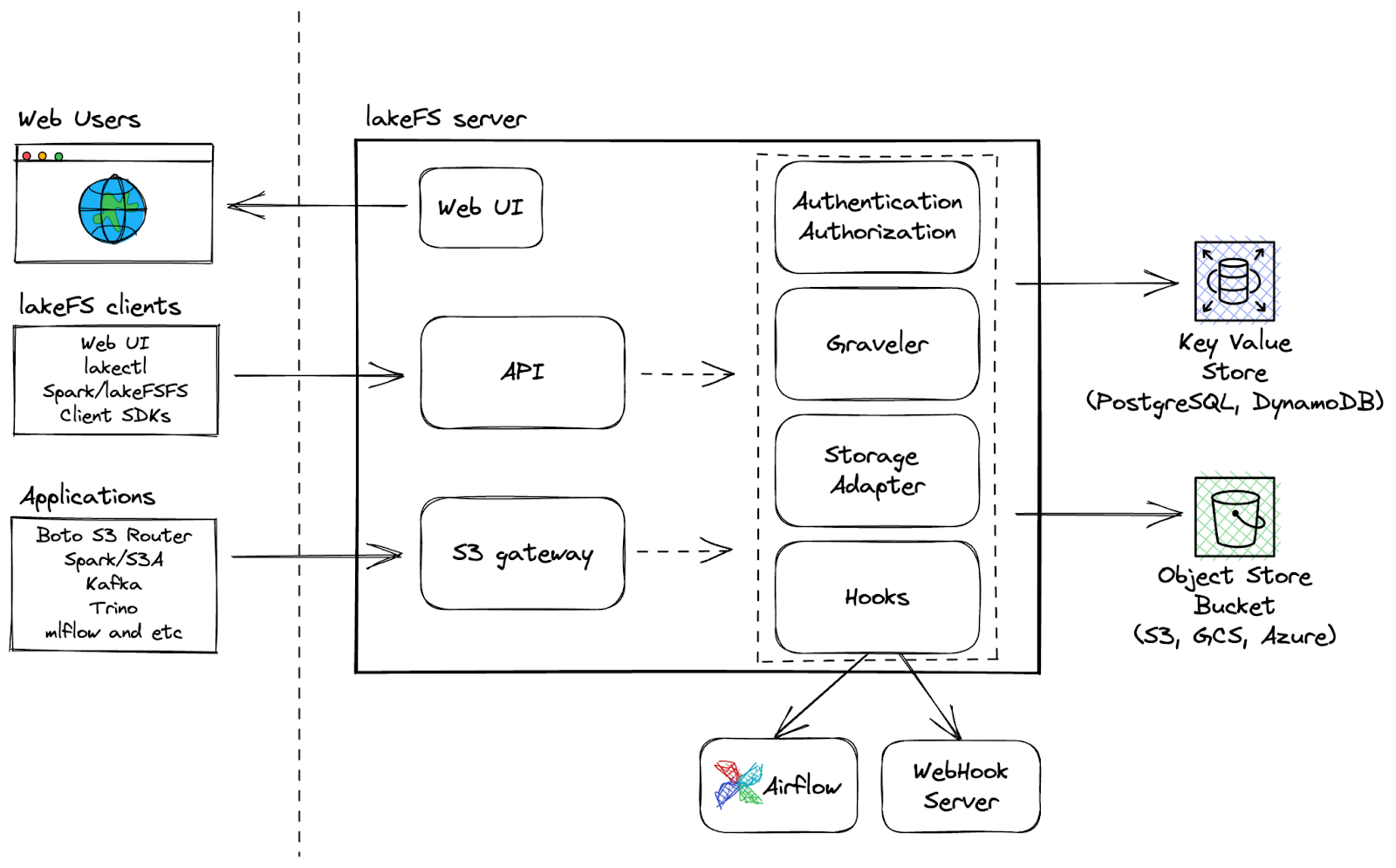

11. LakeFS

LakeFS è uno strumento open-source e scalabile di data version control che fornisce un’interfaccia di controllo versione in stile Git per gli object storage, consentendo di gestire i data lake come si fa con il codice. Con LakeFS è possibile eseguire il controllo versione dei dati a scala exabyte, risultando una soluzione altamente scalabile per la gestione di grandi data lake.

Capacità aggiuntive:

- Eseguire operazioni Git come branch, commit e merge su qualsiasi servizio di storage

- Sviluppo più rapido con branching senza copia per sperimentazione senza attriti e collaborazione semplice

- Usare pre-commit e merge hook per workflow CI/CD e garantire processi puliti

- Piattaforma resiliente che consente un recupero più rapido dai problemi sui dati con la funzionalità di revert.

Architettura di LakeFS

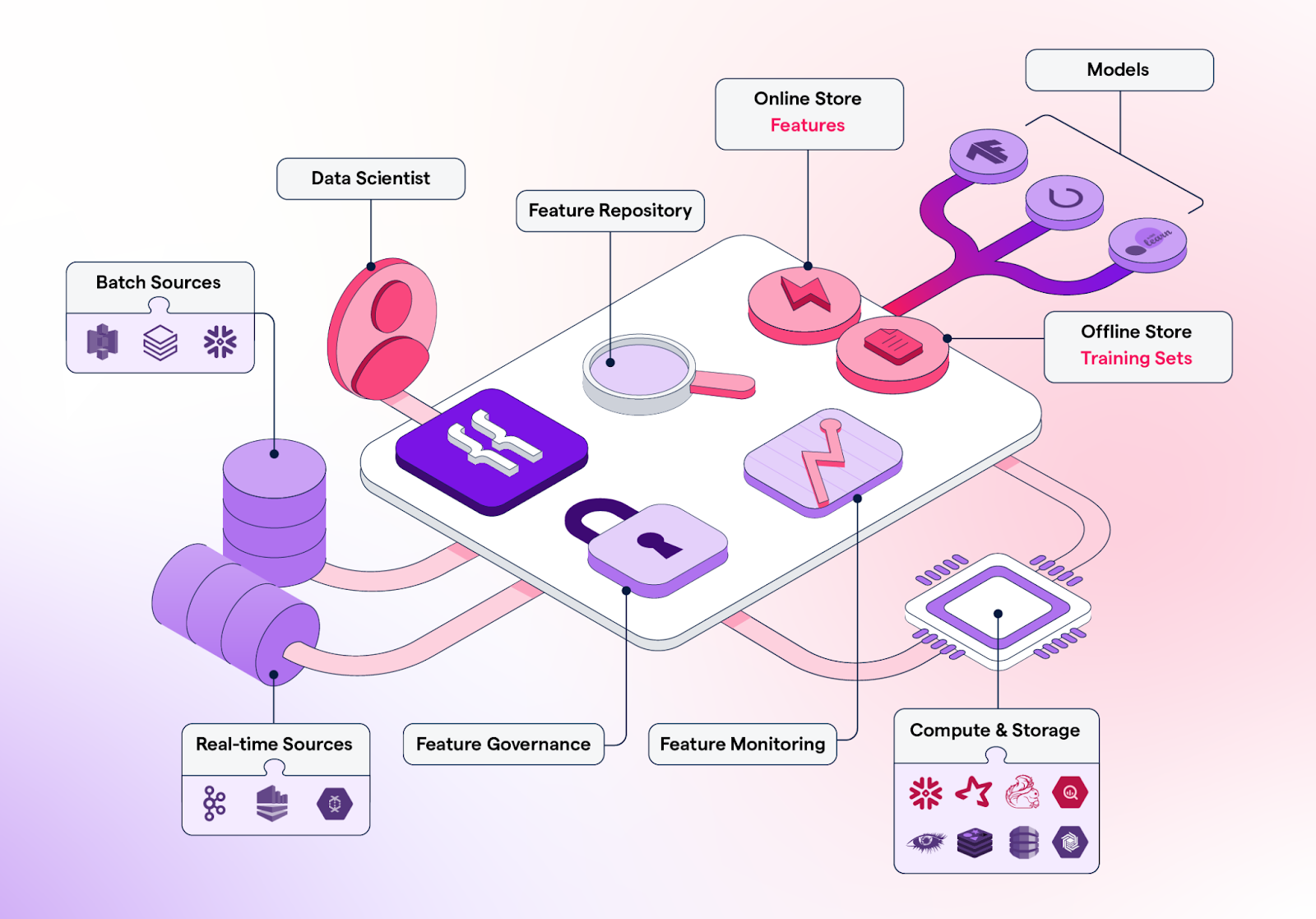

Feature store

I feature store sono repository centralizzati per archiviare, versionare, gestire e servire le feature (attributi di dati elaborati usati per addestrare i modelli di machine learning) sia per l’uso in produzione che per l’addestramento.

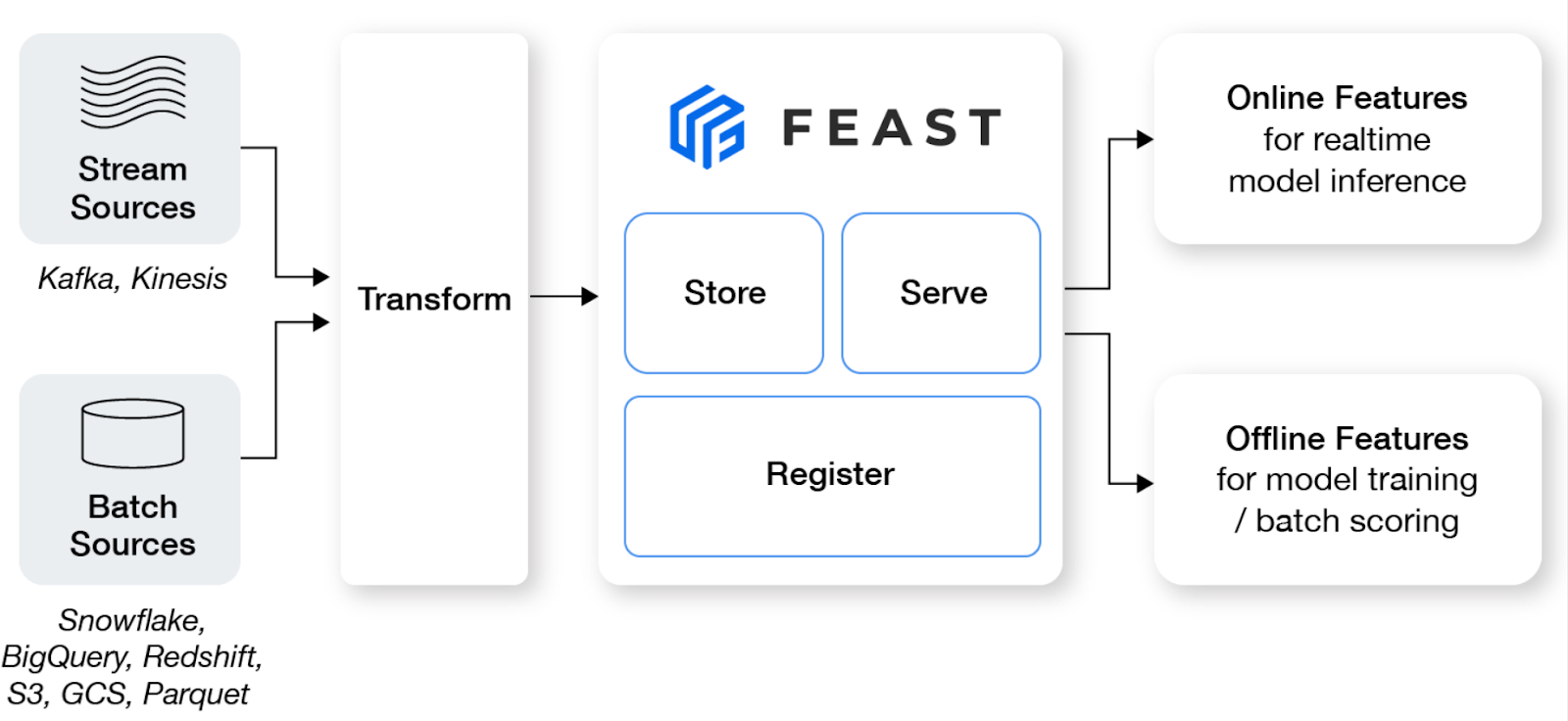

12. Feast

Feast è un feature store open-source che aiuta i team di machine learning a portare in produzione modelli real-time e a costruire una piattaforma di feature che favorisca la collaborazione tra ingegneri e data scientist.

Caratteristiche principali:

- Gestire un archivio offline, un negozio online a bassa latenza e un feature server per garantire la disponibilità coerente delle feature sia per l’addestramento che per il serving.

- Evitare la data leakage creando set di feature accurati point-in-time, liberando i data scientist dalla gestione di join dei dataset soggetti a errori.

- Decouplare l’ML dall’infrastruttura dati grazie a un unico livello di accesso.

Immagine da Feast

13. Featureform

Featureform è un feature store virtuale che consente ai data scientist di definire, gestire e servire le feature dei propri modelli ML. Può aiutare i team di data science a migliorare la collaborazione, organizzare la sperimentazione, facilitare il deployment, aumentare l’affidabilità e garantire la conformità.

Caratteristiche principali:

- Migliorare la collaborazione condividendo, riutilizzando e comprendendo le feature all’interno del team.

- Quando una feature è pronta per il deployment, Featureform orchestrerà l’infrastruttura dati per prepararla alla produzione.

- Il sistema assicura che nessuna feature, etichetta o training set possano essere modificati per aumentare l’affidabilità.

- Con controllo accessi basato sui ruoli integrato, audit log e regole di serving dinamiche, Featureform può far rispettare direttamente la tua logica di conformità.

Immagine da Featureform

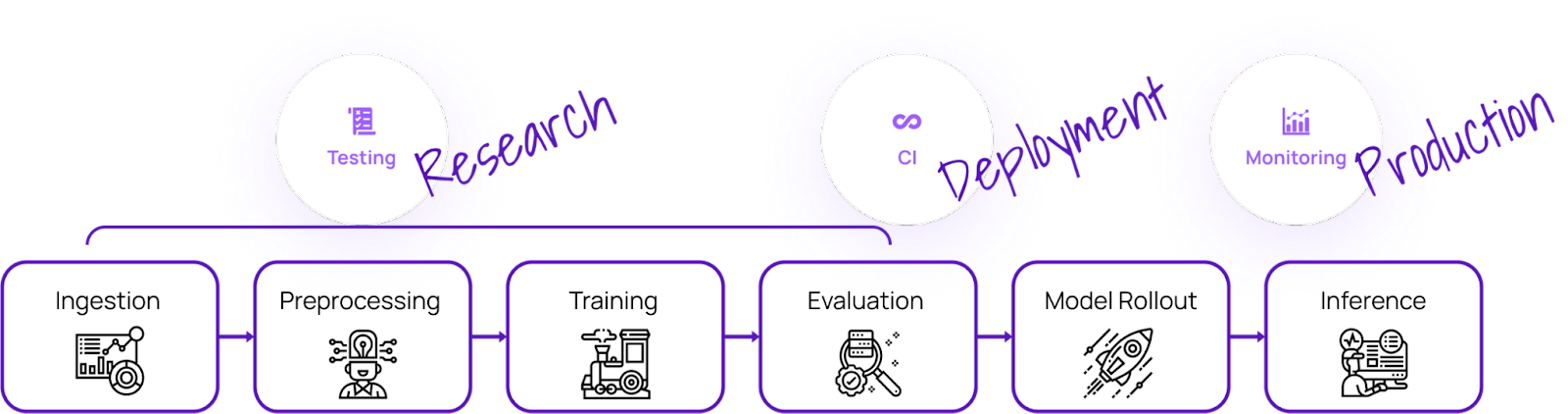

Test dei modelli

Con questi strumenti MLOps puoi testare la qualità dei modelli e garantirne affidabilità, robustezza e accuratezza:

14. Deepchecks ML Models Testing

Deepchecks è una soluzione open-source che copre tutte le esigenze di validazione ML, garantendo che dati e modelli siano testati a fondo dalla ricerca alla produzione. Offre un approccio olistico per validare dati e modelli attraverso i suoi vari componenti.

Immagine da Deepchecks

Deepchecks è composto da tre componenti:

- Deepchecks testing: ti permette di costruire check e suite personalizzate per la validazione tabellare, NLP e computer vision.

- Gestione CI & testing: fornisce gestione di CI & testing per aiutarti a collaborare con il team e gestire efficacemente i risultati dei test.

- Deepchecks monitoring: traccia e valida i modelli in produzione.

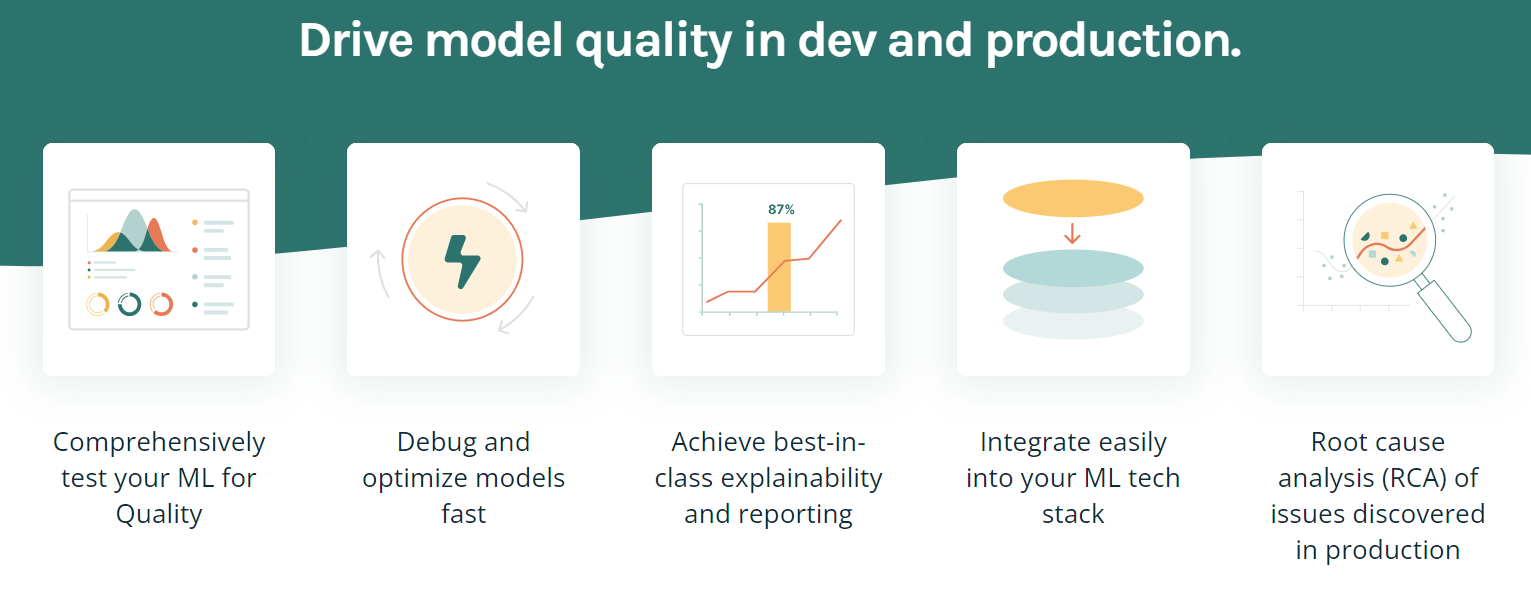

15. TruEra

TruEra è una piattaforma avanzata progettata per migliorare qualità e performance dei modelli tramite test automatizzati, spiegabilità e analisi delle cause radice. Offre varie funzionalità per ottimizzare e fare debug dei modelli, ottenere spiegabilità di livello superiore e integrarsi facilmente nel tuo stack ML.

Caratteristiche principali:

- La funzionalità di test e debugging dei modelli ti permette di migliorare la qualità del modello in sviluppo e in produzione.

- Può eseguire test automatizzati e sistematici per garantire prestazioni, stabilità ed equità.

- Comprende l’evoluzione delle versioni del modello, consentendoti di estrarre insight che guidano uno sviluppo più rapido ed efficace.

- Identificare e individuare quali specifiche feature contribuiscono al bias del modello.

- TruEra può essere integrata facilmente nell’infrastruttura e nel workflow esistenti senza complicazioni.

Immagine di TruEra

Strumenti per deployment e serving dei modelli

Quando si tratta di distribuire i modelli, questi strumenti MLOps possono essere di grande aiuto:

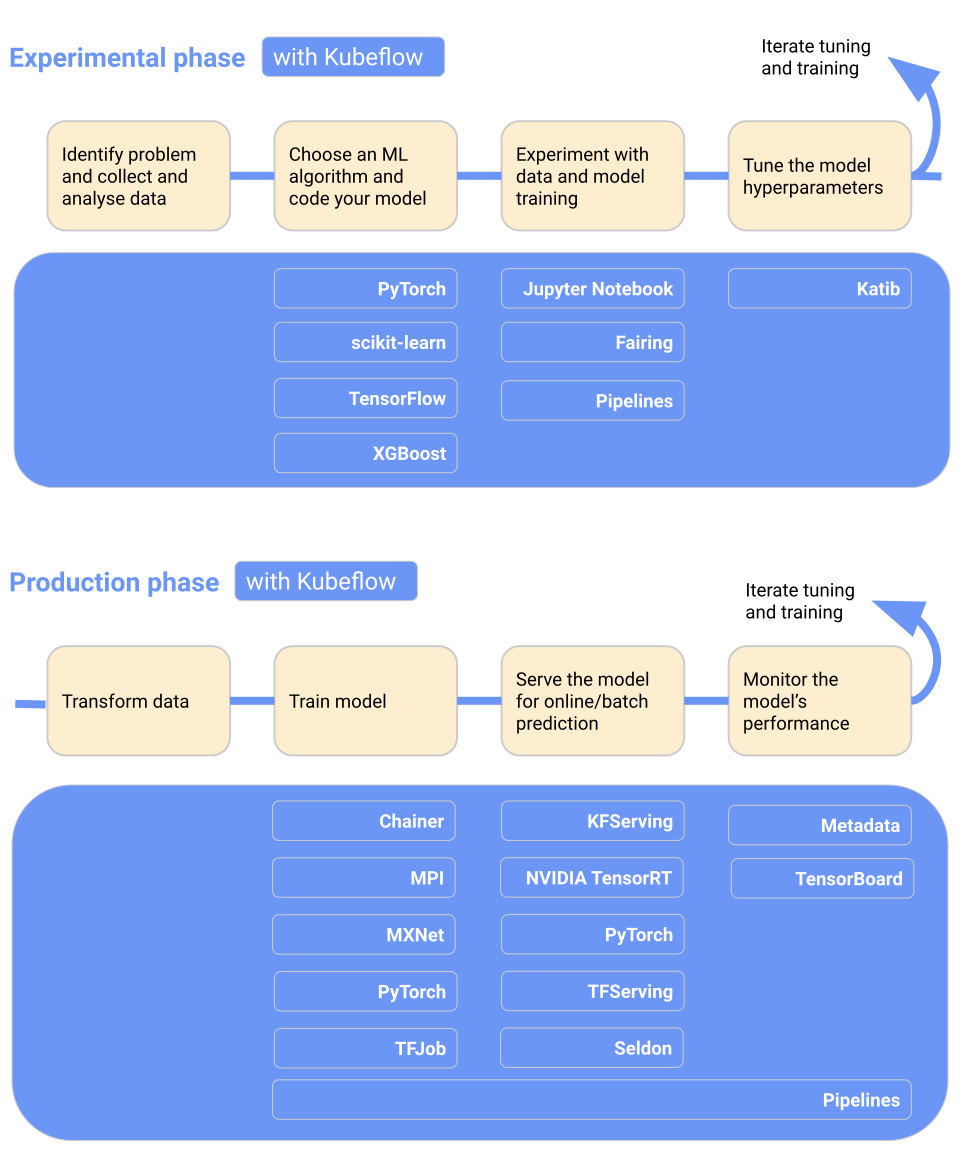

16. Kubeflow

Kubeflow rende semplice, portabile e scalabile il deployment di modelli di machine learning su Kubernetes. Puoi usarlo per preparazione dei dati, training dei modelli, ottimizzazione, serving delle predizioni e monitoraggio delle performance del modello in produzione. Puoi distribuire workflow di machine learning in locale, on-premises o nel cloud. In breve, rende Kubernetes accessibile ai team di data science.

Caratteristiche principali:

- Dashboard centralizzata con UI interattiva.

- Pipeline di machine learning per riproducibilità e semplificazione.

- Supporto nativo per JupyterLab, RStudio e Visual Studio Code.

- Tuning degli iperparametri e neural architecture search.

- Training job per Tensorflow, Pytorch, PaddlePaddle, MXNet e XGboost.

- Scheduling dei job.

- Isolamento multi-utente per gli amministratori.

- Funziona con tutti i principali cloud provider.

Immagine da Kubeflow

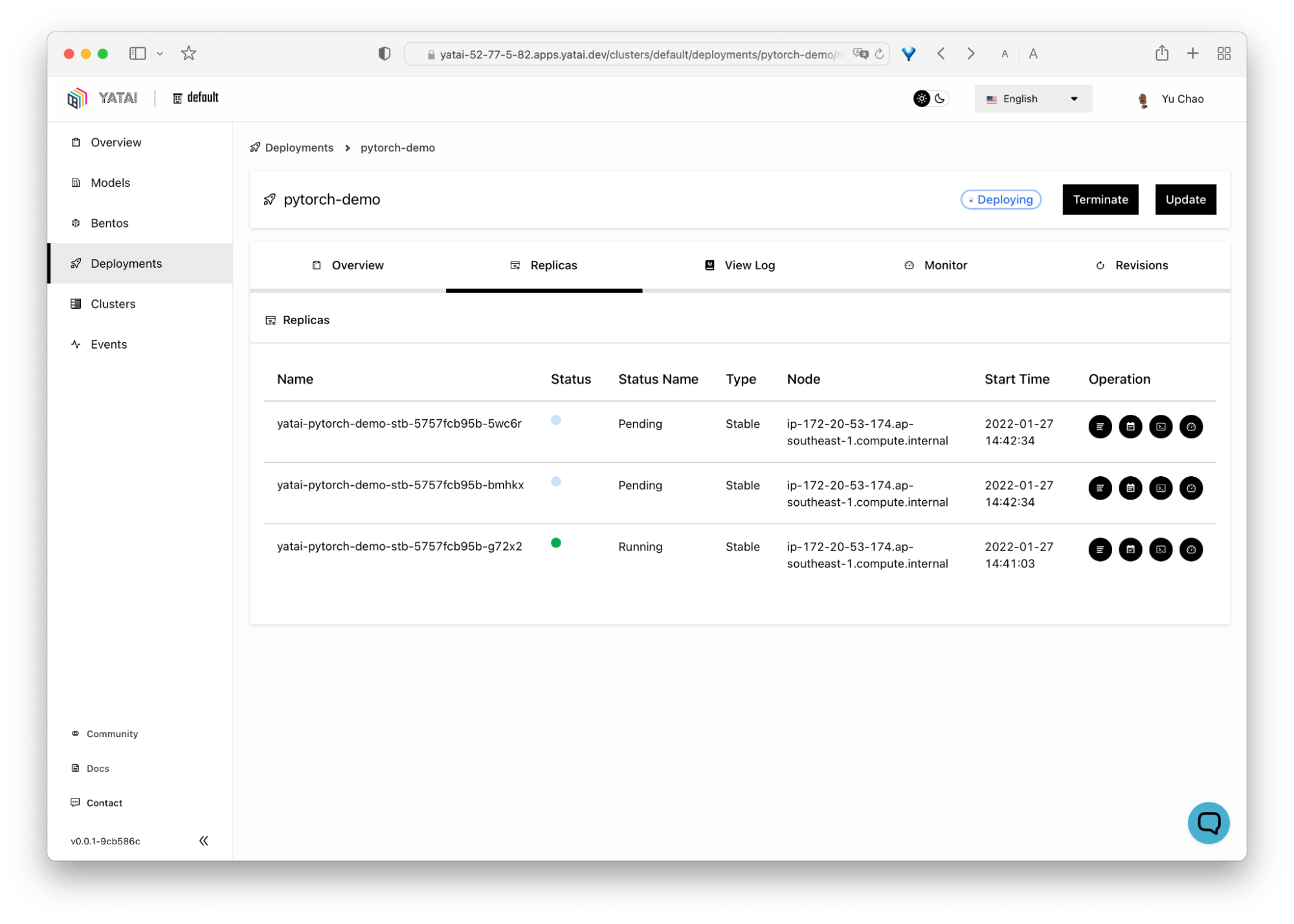

10. BentoML

BentoML rende più semplice e veloce la messa in produzione di applicazioni di machine learning. È uno strumento orientato a Python per distribuire e mantenere API in produzione. Scala con potenti ottimizzazioni eseguendo inferenza in parallelo e batching adattivo e offre accelerazione hardware.

La dashboard centrale interattiva di BentoML semplifica l’organizzazione e il monitoraggio durante il deployment dei modelli di machine learning. La cosa migliore è che funziona con ogni tipo di framework di machine learning, come Keras, ONNX, LightGBM, Pytorch e Scikit-learn. In breve, BentoML fornisce una soluzione completa per deployment, serving e monitoraggio dei modelli.

Immagine da BentoML

18. Hugging Face Inference Endpoints

Hugging Face Inference Endpoints è un servizio cloud offerto da Hugging Face, una piattaforma ML all-in-one che consente di addestrare, ospitare e condividere modelli, dataset e demo. Questi endpoint sono pensati per aiutarti a distribuire i modelli di machine learning addestrati per l’inferenza senza dover configurare e gestire l’infrastruttura necessaria.

Caratteristiche principali:

- Mantenere i costi a partire da $0,06 per core CPU/ora e $0,6 per GPU/ora, a seconda delle esigenze.

- Facile da distribuire in pochi secondi.

- Completamente gestito e autoscalante.

- Parte dell’ecosistema Hugging Face.

- Sicurezza a livello enterprise.

Immagine da Hugging Face

Nota: puoi usare anche MLflow e AWS sagemaker per deployment e serving dei modelli.

Monitoraggio dei modelli in produzione: strumenti ML Ops

Che il tuo modello ML sia in sviluppo, in validazione o in produzione, questi strumenti possono aiutarti a monitorare una serie di fattori:

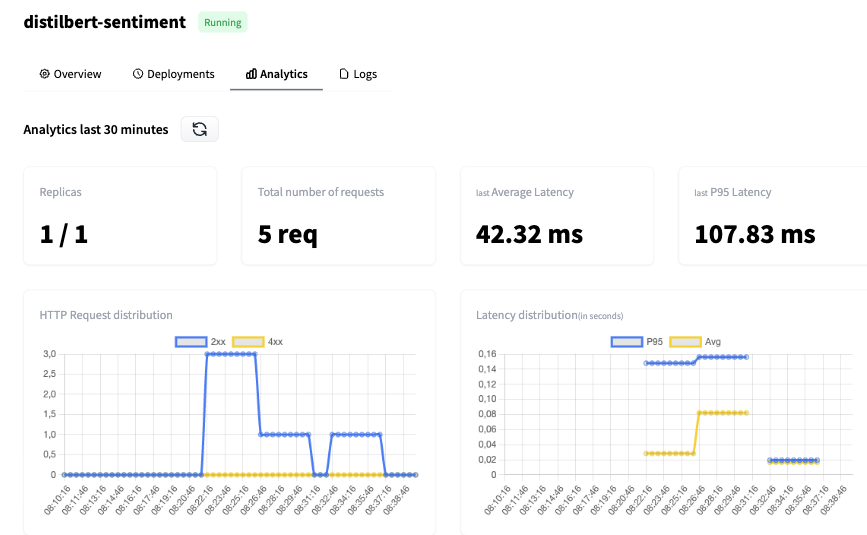

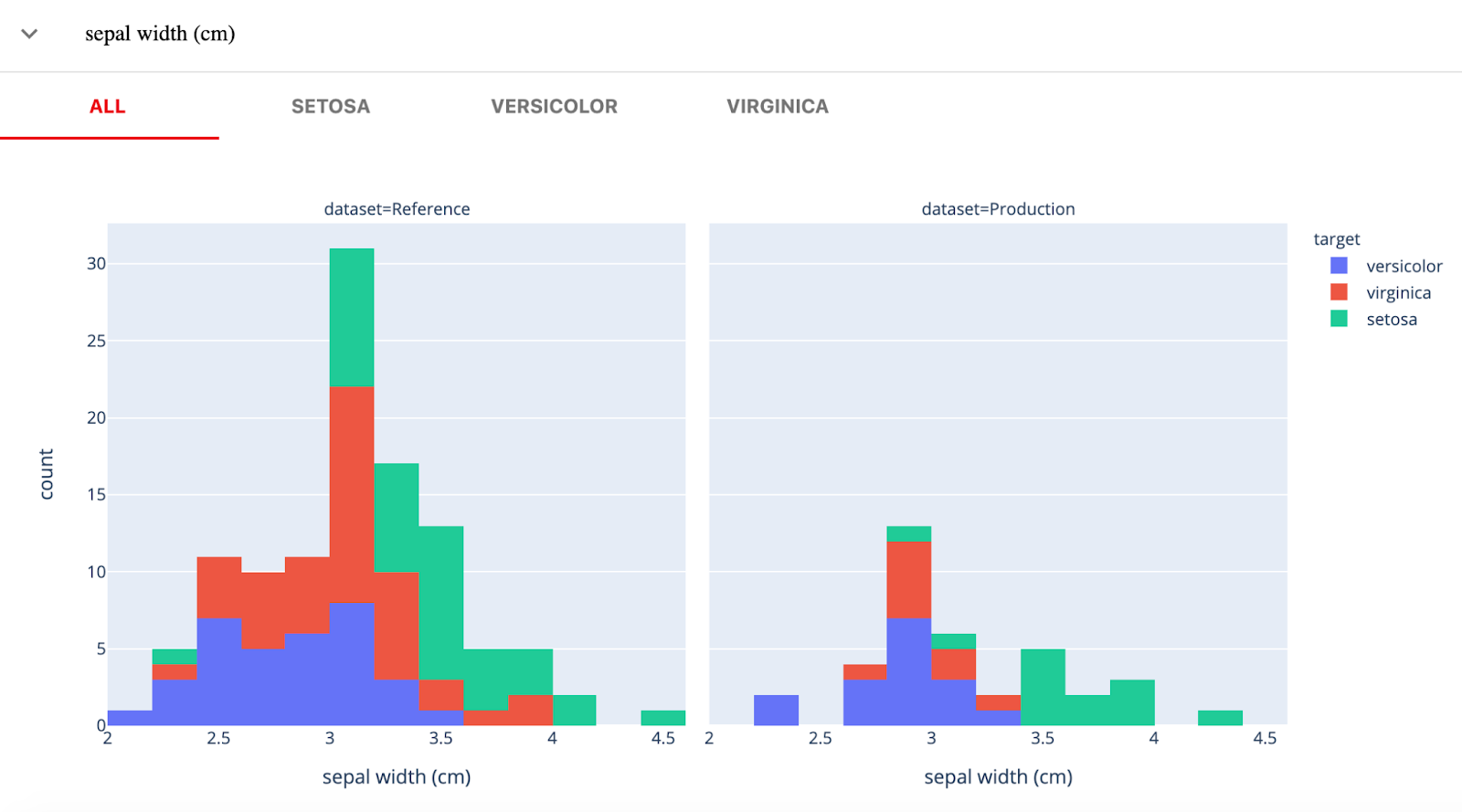

19. Evidently

Evidently AI è una libreria Python open-source per monitorare i modelli ML durante lo sviluppo, la validazione e in produzione. Controlla qualità di dati e modelli, data drift, target drift e performance di regressione e classificazione.

Evidently ha tre componenti principali:

- Tests (verifiche batch del modello): per eseguire controlli strutturati su dati e qualità del modello.

- Reports (dashboard interattive): drift dei dati interattivo, performance del modello e visualizzazione del target.

- Monitors (monitoraggio real-time): monitora dati e metriche del modello da servizi ML distribuiti.

Immagine da Evidently

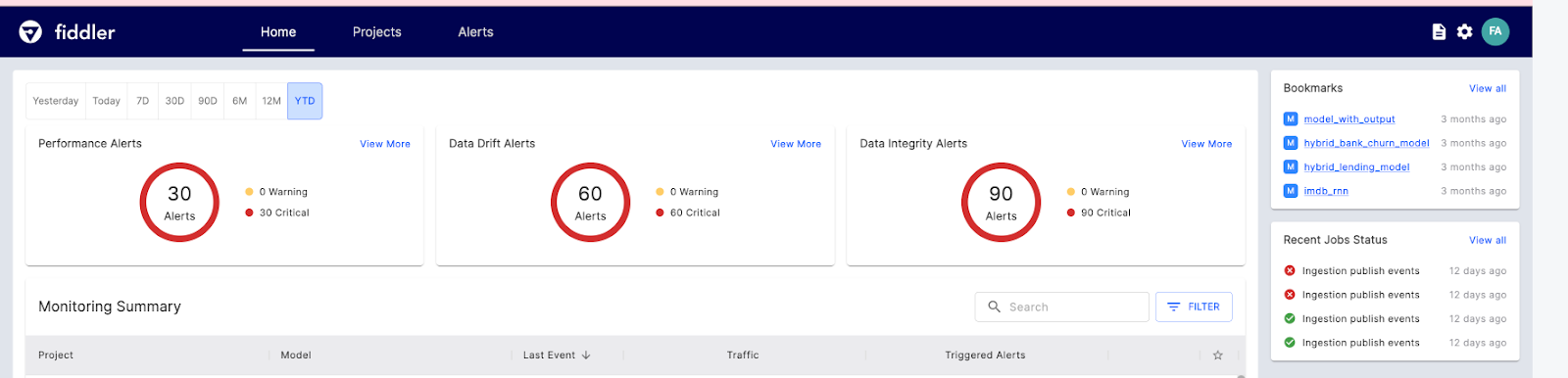

20. Fiddler

Fiddler AI è uno strumento di monitoraggio dei modelli ML con un’interfaccia semplice e chiara. Ti permette di spiegare e fare debug delle predizioni, analizzare il comportamento del modello sull’intero dataset, distribuire modelli di machine learning in scala e monitorarne le performance.

Vediamo le principali funzionalità di Fiddler AI per il monitoraggio ML:

- Performance monitoring: visualizzazione approfondita del data drift, quando avviene e in che modo.

- Integrità dei dati: evitare di alimentare il training del modello con dati errati.

- Rilevamento outlier: mostra outlier univariati e multivariati.

- Service metrics: offre insight di base sulle operazioni del servizio ML.

- Alert: imposta avvisi per un modello o un gruppo di modelli per segnalare problemi in produzione.

Immagine da Fiddler

Motori di runtime

Il motore di runtime è responsabile del caricamento del modello, della pre-elaborazione dei dati in input, dell’esecuzione dell’inferenza e della restituzione dei risultati all’applicazione client.

21. Ray

Ray è un framework versatile progettato per scalare applicazioni di AI e Python, semplificando per gli sviluppatori la gestione e l’ottimizzazione dei progetti di machine learning.

La piattaforma è composta da due componenti principali: un runtime distribuito core e un insieme di librerie AI pensate per semplificare il calcolo ML.

Ray Core offre un set limitato di elementi fondamentali che possono essere usati per costruire ed espandere applicazioni distribuite.

- Task sono funzioni senza stato che vengono eseguite all’interno del cluster.

- Actor sono processi worker con stato creati all’interno del cluster.

- Oggetti sono valori immutabili accessibili da qualsiasi componente del cluster.

Ray fornisce anche librerie AI per dataset scalabili per l’ML, training distribuito, tuning di iperparametri, reinforcement learning e serving scalabile e programmabile.

L’esempio seguente mostra il training e il serving di un modello Gradient Boosting Classifier.

import requests

from starlette.requests import Request

from typing import Dict

from sklearn.datasets import load_iris

from sklearn.ensemble import GradientBoostingClassifier

from ray import serve

# Train model.

iris_dataset = load_iris()

model = GradientBoostingClassifier()

model.fit(iris_dataset["data"], iris_dataset["target"])

@serve.deployment

class BoostingModel:

def __init__(self, model):

self.model = model

self.label_list = iris_dataset["target_names"].tolist()

async def __call__(self, request: Request) -> Dict:

payload = (await request.json())["vector"]

print(f"Received http request with data {payload}")

prediction = self.model.predict([payload])[0]

human_name = self.label_list[prediction]

return {"result": human_name}

# Deploy model.

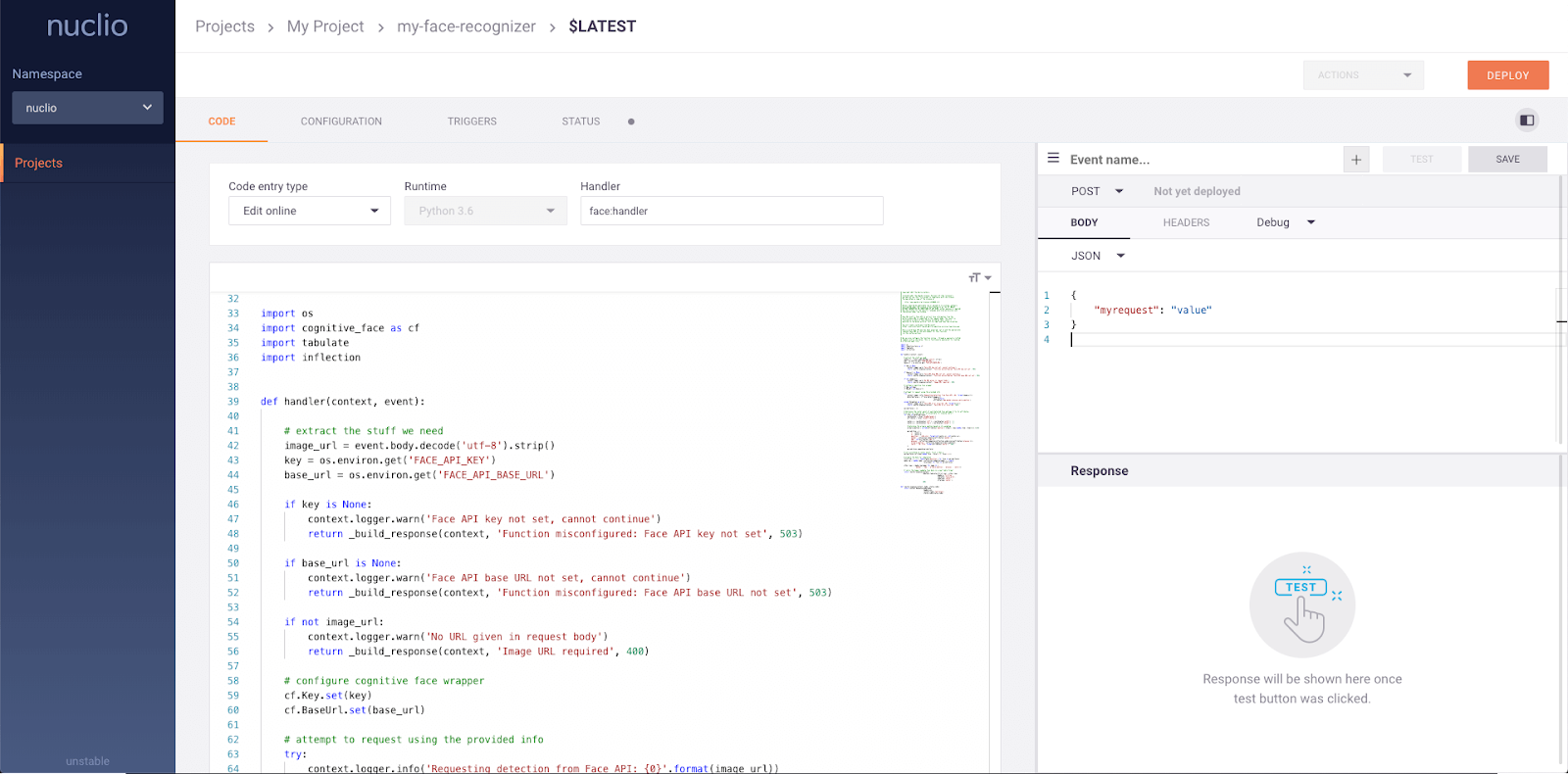

serve.run(BoostingModel.bind(model), route_prefix="/iris")22. Nuclio

Nuclio è un framework potente focalizzato su carichi di lavoro intensivi in dati, I/O e computazione. È progettato per essere serverless, quindi non devi preoccuparti di gestire i server. Nuclio è ben integrato con strumenti di data science popolari, come Jupyter e Kubeflow. Supporta inoltre un’ampia varietà di fonti dati e di streaming e può essere eseguito su CPU e GPU.

Caratteristiche principali:

- Richiede risorse minime di CPU/GPU e I/O per elaborazione in tempo reale massimizzando il parallelismo.

- Si integra con un’ampia gamma di fonti dati e framework ML.

- Fornisce funzioni stateful con accelerazione del data-path

- Portabilità su tutti i tipi di dispositivi e piattaforme cloud, in particolare dispositivi a bassa potenza.

- Progettato per l’enterprise.

Immagine da Nuclio

Piattaforme MLOps end-to-end

Se cerchi uno strumento MLOps completo che ti supporti durante l’intero processo, ecco alcuni dei migliori:

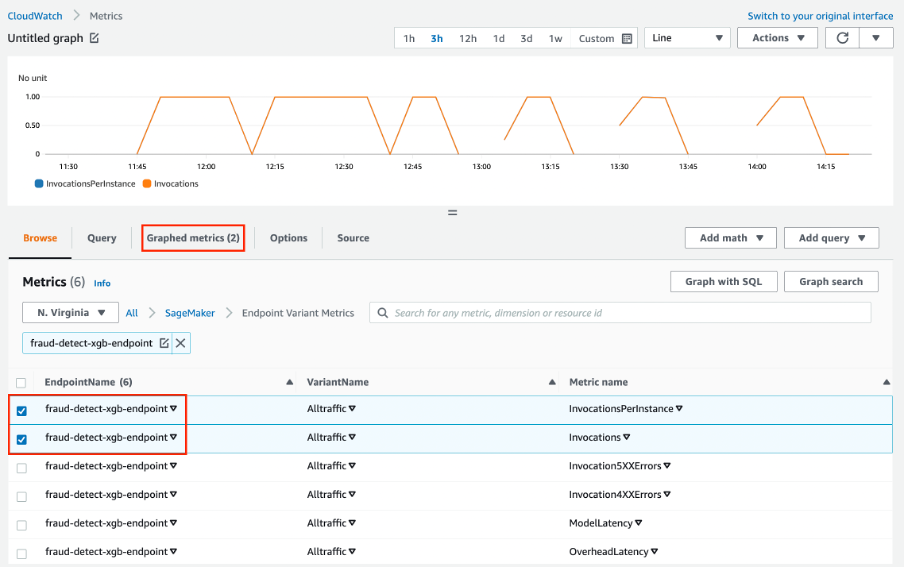

23. AWS SageMaker

Amazon Web Services SageMaker è una soluzione unica per MLOps. Puoi addestrare e accelerare lo sviluppo dei modelli, tracciare e versionare esperimenti, catalogare artifact ML, integrare pipeline ML CI/CD e distribuire, servire e monitorare i modelli in produzione senza interruzioni.

Caratteristiche principali:

- Un ambiente collaborativo per i team di data science.

- Automatizzare i workflow di training ML.

- Distribuire e gestire i modelli in produzione.

- Tracciare e mantenere le versioni dei modelli.

- CI/CD per integrazione e deployment automatici.

- Monitoraggio continuo e riaddestramento dei modelli per mantenere la qualità.

- Ottimizzare costi e performance.

Immagine da Amazon SageMaker

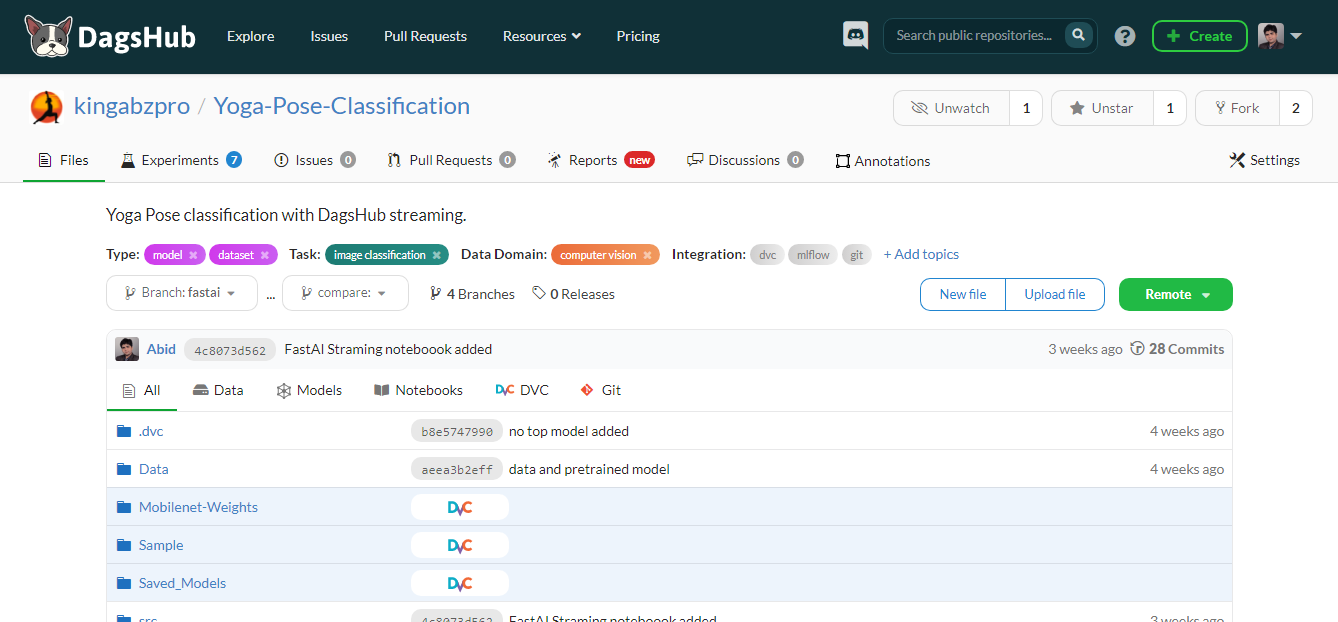

24. DagsHub

DagsHub è una piattaforma pensata per la community del machine learning per tracciare e versionare dati, modelli, esperimenti, pipeline ML e codice. Permette al tuo team di creare, revisionare e condividere progetti di machine learning.

In poche parole, è un GitHub per il machine learning, e offre vari strumenti per ottimizzare il processo end-to-end di machine learning.

Caratteristiche principali:

- Repository Git e DVC per i tuoi progetti ML.

- DagsHub logger e istanza MLflow per il tracciamento degli esperimenti.

- Annotazione dei dataset tramite istanza label studio.

- Diff di Jupyter notebook, codice, dataset e immagini.

- Possibilità di commentare file, righe di codice o dataset.

- Creazione di un report per il progetto come su GitHub wiki.

- Visualizzazione delle pipeline ML.

- Risultati riproducibili.

- Esecuzione di CI/CD per training e deployment del modello.

- Data merging.

- Integrazione con GitHub, Google Colab, DVC, Jenkins, storage esterni, webhook e New Relic.

Immagine dell’autore

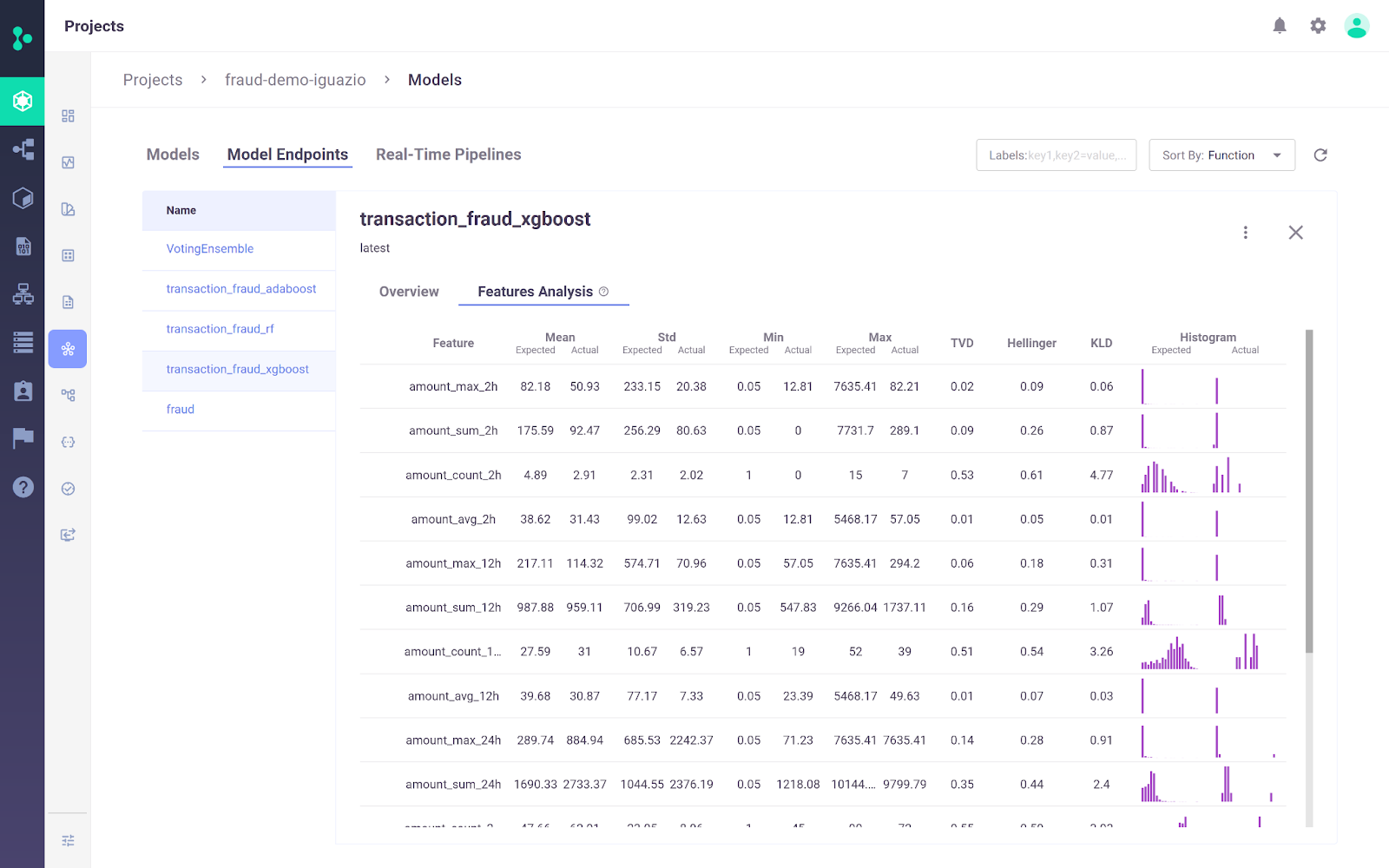

25. Iguazio MLOps Platform

La Iguazio MLOps Platform è una piattaforma MLOps end-to-end che consente alle organizzazioni di automatizzare la pipeline di machine learning, dalla raccolta e preparazione dei dati al training, al deployment e al monitoraggio in produzione. Fornisce una piattaforma open (MLRun) e gestita.

Un elemento distintivo della Iguazio MLOps Platform è la flessibilità nelle opzioni di deployment. È possibile distribuire applicazioni AI ovunque, inclusi cloud, ambienti ibridi o on-premises. Questo è particolarmente importante per settori come sanità e finanza, dove le esigenze di privacy dei dati possono richiedere il deployment on-premises.

Immagine dalla piattaforma Iguazio MLOps

Caratteristiche principali:

- La piattaforma consente di ingerire dati da qualsiasi fonte e creare feature riutilizzabili online e offline usando il feature store integrato.

- Supporta training ed evaluation continui dei modelli su larga scala usando serverless scalabile con tracciamento automatizzato, versionamento dei dati e integrazione e deployment continui.

- Modelli facili da distribuire in produzione con pochi clic, con monitoraggio continuo delle performance e mitigazione del model drift.

- La piattaforma include una dashboard semplice per gestire, governare e monitorare modelli e produzione real-time.

Panoramica degli strumenti MLOps

Ecco una tabella comparativa per valutare questi strumenti fianco a fianco e scegliere i migliori per i tuoi progetti:

| Strumento | Funzionalità principale | Framework supportati | Opzioni di deployment |

|---|---|---|---|

| Qdrant | Ricerca di similarità vettoriale e gestione database | Python, più linguaggi | Cloud-native, scalabile orizzontalmente |

| LangChain | Sviluppare applicazioni con modelli linguistici | Python, JavaScript | REST API, template |

| MLFlow | Tracciamento esperimenti, model registry, deployment | Python, R, Java, REST API | Locale, cloud |

| Comet ML | Tracciamento e ottimizzazione degli esperimenti | Scikit-learn, PyTorch, TensorFlow, HuggingFace | Locale, cloud |

| Weights & Biases | Tracciamento esperimenti, versionamento di dati e modelli | Fastai, Keras, PyTorch, HuggingFace, Yolov5, Spacy | Locale, cloud |

| Prefect | Orchestrazione e monitoraggio dei workflow | Python | Locale (Orion UI), Cloud |

| Metaflow | Gestione workflow per data science | Scikit-learn, TensorFlow, Python, R | AWS, GCP, Azure, locale |

| Kedro | Orchestrazione workflow, riproducibilità | Python | Locale, distribuito |

| Pachyderm | Trasformazione, versionamento e lineage dei dati | Qualsiasi linguaggio | Kubernetes |

| DVC | Versionamento di dati e pipeline | Git, Python | Locale, cloud |

| LakeFS | Controllo versione in stile Git per data lake | Qualsiasi servizio di storage | Locale, cloud |

| Feast | Feature store centralizzato per modelli ML | Python | Locale, cloud |

| Featureform | Feature store virtuale per modelli ML | Python | Locale, cloud |

| Deepchecks | Test e validazione di modelli ML | Python | Locale, cloud |

| TruEra | Test di qualità e performance dei modelli | Python | Locale, cloud |

| Kubeflow | Deployment e orchestrazione di modelli ML | TensorFlow, PyTorch, PaddlePaddle, MXNet, XGboost | Kubernetes, cloud |

| BentoML | Deployment dei modelli e gestione API | Keras, ONNX, LightGBM, PyTorch, Scikit-learn | Locale, cloud |

| Hugging Face | Inference e deployment dei modelli | Qualsiasi modello | Cloud |

| Evidently | Monitoraggio modelli ML per data e target drift | Python | Locale, cloud |

| Fiddler | Monitoraggio e debugging dei modelli ML | Python | Locale, cloud |

| Ray | Scalare applicazioni di AI e Python | Python | Locale, cloud |

| Nuclio | Framework serverless per carichi intensivi di dati e compute | Jupyter, Kubeflow | Cloud, on-premises |

| AWS SageMaker | Gestione end-to-end del ciclo di vita ML | Python, R, Java, TensorFlow, PyTorch | Cloud AWS |

| DagsHub | Versionamento e collaborazione per progetti ML | Git, DVC, MLflow | Locale, cloud |

| Iguazio | Automazione end-to-end delle pipeline ML | Python, MLRun | Cloud, ibrido, on-premises |

Conclusione

Viviamo un momento di boom dell’industria MLOps. Ogni settimana emergono nuovi sviluppi, startup e strumenti che puntano a risolvere il problema di base: trasformare i notebook in applicazioni pronte per la produzione. Anche gli strumenti esistenti stanno ampliando gli orizzonti e integrando nuove funzionalità per diventare super strumenti MLOps.

In questo blog abbiamo visto i migliori strumenti MLOps per le varie fasi del processo MLOps. Questi strumenti ti aiuteranno nelle fasi di sperimentazione, sviluppo, deployment e monitoraggio.

Se sei nuovo al machine learning e vuoi padroneggiare le competenze essenziali per trovare lavoro come machine learning scientist, prova la nostra career track Machine Learning Scientist with Python.

Se sei un professionista e vuoi approfondire le pratiche standard di MLOps, leggi il nostro articolo sulle Best practice MLOps e come applicarle e consulta la nostra skill track MLOps Fundamentals.

MLOps Tools FAQs

What are MLOps Tools?

Gli strumenti MLOps aiutano a standardizzare, semplificare e rendere più fluido l’ecosistema ML. Questi strumenti vengono usati per tracciamento degli esperimenti, gestione dei metadati dei modelli, orchestrazione, ottimizzazione dei modelli, versionamento dei workflow, deployment e serving dei modelli e monitoraggio dei modelli in produzione.

What skills are needed for an MLOps Engineer?

- Capacità di implementare soluzioni cloud.

- Esperienza con Docker e Kubernetes.

- Esperienza con Quality Assurance tramite tracciamento degli esperimenti e versionamento dei workflow.

- Capacità di costruire pipeline MLOps.

- Familiarità con il sistema operativo Linux.

- Esperienza con framework ML come PyTorch, Tensorflow e TFX.

- Esperienza con DevOps e sviluppo software.

- Esperienza con test unitari e di integrazione, validazione di dati e modelli e monitoraggio post-deployment.

Which cloud is best for MLOps?

AWS, GCP e Azure offrono una varietà di strumenti per il ciclo di vita del machine learning. Tutti forniscono soluzioni end-to-end per MLOps. AWS è in testa per popolarità e quota di mercato. Offre anche soluzioni semplici per training, serving e monitoraggio dei modelli.

Is MLOps easy to learn?

Dipende dalla tua esperienza precedente. Per padroneggiare MLOps, devi conoscere sia il ciclo di vita del machine learning sia quello dello sviluppo software. Oltre a una forte padronanza dei linguaggi di programmazione, devi imparare diversi strumenti MLOps. Per gli ingegneri DevOps è più semplice apprendere MLOps, dato che molti strumenti e strategie derivano dallo sviluppo software.

Is Kubeflow better than MLflow?

Dipende dal caso d’uso. Kubeflow offre una riproducibilità a un livello più ampio rispetto a MLflow, poiché gestisce l’orchestrazione.

- Kubeflow è in genere usato per distribuire e gestire sistemi ML complessi su larga scala.

- MLFlow è in genere usato per il tracciamento degli esperimenti ML e per archiviare e gestire i metadati dei modelli.

How is MLOps different from DevOps?

Entrambe sono strategie di sviluppo software. DevOps si concentra sullo sviluppo e la gestione di sistemi software su larga scala, mentre MLOps si focalizza sul deployment e la manutenzione dei modelli di machine learning in produzione.

- DevOps: Continuous Integration (CI) e Continuous Delivery (CD).

- MLOps: Continuous Integration, Continuous Delivery, Continuous Training e Continuous Monitoring.

How Do MLOps Tools Integrate with Existing Data Science Workflows?

Gli strumenti MLOps sono progettati per integrarsi senza problemi con i workflow di data science esistenti. Tipicamente supportano vari strumenti e piattaforme di data science, forniscono API per l’integrazione e offrono plugin o estensioni per gli ambienti di data science più diffusi. Questa integrazione consente ai data scientist di mantenere i workflow attuali sfruttando al contempo i vantaggi di MLOps per una migliore scalabilità, riproducibilità ed efficienza nel deployment.

Can MLOps Tools Help with Model Explainability and Fairness?

Sì, molti strumenti MLOps includono funzionalità per migliorare spiegabilità ed equità dei modelli. Offrono strumenti come interpretazione dei modelli, rilevamento del bias e metriche di fairness, che aiutano a comprendere e migliorare il modo in cui i modelli prendono decisioni. Questo è fondamentale per distribuire AI responsabile e mantenere la conformità agli standard normativi.

Can I take an MLOps certification?

Le certificazioni specifiche per MLOps sono ancora in fase emergente, ma esistono diverse certificazioni in ambito machine learning e data science che coprono competenze MLOps. Leggi la nostra guida alle certificazioni MLOps per un riepilogo.

In quanto data scientist certificato, sono appassionato di sfruttare tecnologie all’avanguardia per creare applicazioni di machine learning innovative. Con una solida esperienza in riconoscimento vocale, analisi e reportistica dei dati, MLOps, AI conversazionale e NLP, ho affinato le mie competenze nello sviluppo di sistemi intelligenti in grado di avere un impatto concreto. Oltre alla mia expertise tecnica, sono anche un comunicatore efficace, con il talento di rendere chiari e sintetici concetti complessi. Di conseguenza, sono diventato un blogger molto seguito in ambito data science, condividendo idee ed esperienze con una community in crescita di professionisti dei dati. Attualmente mi concentro sulla creazione e sull’editing di contenuti, lavorando con large language model per sviluppare contenuti potenti e coinvolgenti che possano aiutare aziende e singoli a valorizzare al meglio i propri dati.